La crisis de reproducibilidad en ciencia

Fuente: Science

Fuente: ScienceUno de los elementos más valiosos con que debiera contar la comunidad científica es con la replicación sistemática de los estudios o, al menos, con aquellos que introducen alguna novedad significativa. Sin embargo, la mayoría de los científicos se muestran poco inclinados a tratar de replicar los experimentos o análisis realizados por otros investigadores. Al fin y al cabo, resulta mucho más gratificante hacer nuevos estudios que puedan aportar novedades de interés en un campo que limitarse a comprobar si se obtienen los mismos resultados que obtuvieron antes otros. Además, las revistas científicas no están interesadas en publicar repeticiones, máxime si las conclusiones no refutan las del primer trabajo; en ese caso no hay novedades que contar.

En varios estudios se ha llegado a la conclusión de que muchos resultados publicados no son reproducibles o solo lo son parcialmente. Aunque lleva años generando preocupación, este problema se manifestó con toda su crudeza a raíz de la publicación en 2015 de un estudio en la revista Science, según el cual tan solo para una treintena de 100 experimentos de psicología publicados en las mejores revistas científicas del campo se habían podido reproducir sus resultados. Pero el problema no se limita a la psicología, sino que afecta a un buen número de disciplinas.

De acuerdo con una encuesta realizada en 2016 por la revista Nature a 1500 investigadores de diferentes campos, el 70% habían sido incapaces de reproducir los resultados de otros colegas y el 50% no lo habían sido de reproducir sus propios resultados. Por disciplinas, estos fueron los datos de la encuesta: en química el 90% y el 60% (ajenos y propios, respectivamente), en biología el 80% y el 60%, en medicina el 70% y el 60%, en física e ingeniería el 70% y el 50%,en medicina, y en ciencias de la Tierra y el ambiente el 60% y el 40% (Baker, 2016).

Parece evidente que la imposibilidad o dificultad para reproducir resultados constituye una severa limitación al ejercicio del escepticismo, sin el cual no es posible someter a contraste los resultados y conclusiones publicadas.

Aunque a veces la imposibilidad de reproducir los resultados se refiere a casos de fraude, lo normal es que no haya trampa ni malas prácticas realizadas de forma voluntaria. Las razones por las que los resultados experimentales no se reproducen al repetirse los experimentos son diversas. Muchas veces no se especifican de forma correcta las condiciones experimentales. En otras los investigadores se ven afectados por sesgos como los expuestos en una anotación anterior y que tienen que ver con el grado de aproximación de los resultados obtenidos a las expectativas iniciales. Cuando en un conjunto de datos alguno destaca como “anómalo” es relativamente común descartarlo basándose en el supuesto de que la anomalía bien puede deberse a un error experimental sin trascendencia. En todo esto influyen de forma decisiva dos factores. Uno es que el personal de universidades y centros de investigación, como ya hemos visto, está sometido a una fuerte presión por publicar. Y el otro es que las revistas científicas rara vez aceptan publicar resultados negativos. Por esa razón, no es de extrañar que funcionen sesgos que, inconscientemente, facilitan la obtención de resultados positivos y, por lo tanto, publicables.

El tratamiento estadístico es también una fuente de resultados de difícil reproducción. Es relativamente común la práctica de ensayar diferentes procedimientos y seleccionar, entre un catálogo más o menos amplio de posibilidades, aquél cuyos resultados mejor se acomodan a las expectativas. Este es un problema serio en los campos en que se realizan ensayos que han de conducir al desarrollo posterior de tratamientos médicos. Pero, el daño que causa es general, ya que esa forma de proceder tiende a neutralizar la emergencia de nuevas ideas que debería caracterizar, de forma intrínseca, a la práctica científica. Si se opta por mostrar los resultados que mejor se acomodan a las expectativas, se deja de lado el examen crítico de posibilidades que podrían haber conducido a nuevas ideas.

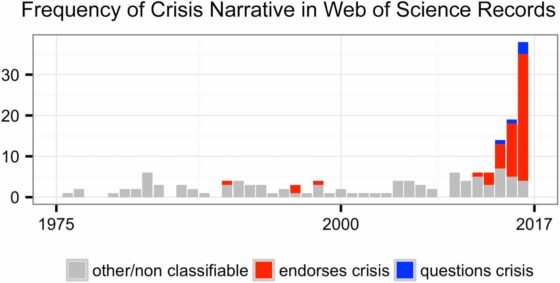

La figura muestra la frecuencia de aparición de expresiones relativas a, reales o supuestas, crisis científicas. Fuente: D Fanelli (2018) PNAS 115 (11): 2628-2631

La figura muestra la frecuencia de aparición de expresiones relativas a, reales o supuestas, crisis científicas. Fuente: D Fanelli (2018) PNAS 115 (11): 2628-2631La revista Proceedings of the National Academy of Sciences, más conocida por sus siglas PNAS y una de las más prestigiosas del mundo, publicó una serie de artículos analizando la llamada “crisis de reproducibilidad” y, en general, la validez de un discurso muy en boga mediante el que se difunde la idea de que la ciencia se encuentra hoy en crisis. De ese conjunto de estudios parece concluirse que esa idea no tiene suficiente base y que se trata, más bien, de una leyenda urbana. Sin embargo, en nuestra opinión, lo que esos estudios documentan es que el fraude no ha crecido durante las últimas décadas, de la misma forma que no ha crecido el número de artículos retractados (retirados de la publicación por los editores) en términos relativos. Pero no es tan clara la conclusión de que no hay problemas de reproducibilidad, porque el procedimiento seguido para llegar a esa conclusión es demasiado indirecto, mientras que los estudios que documentan las dificultades para reproducir resultados anteriores son bastante más directos.

En nuestra opinión, la falta de reproducibilidad procede de una progresiva relajación de los estándares que se consideran aceptables en cuanto calidad de la evidencia científica; nos referimos a asuntos tales como tamaños de muestra, claridad de la significación estadística más allá del valor de p, calidad de los blancos, etc. Los científicos como colectivo somos a la vez autores de los experimentos, autores de los artículos y revisores de estos. Que poco a poco se vayan aceptando niveles cada vez más bajos nos conviene si nuestro objetivo es el de publicar más rápidamente y engrosar un currículo investigador en un tiempo breve. Pero eso conduce, lógicamente, a un declive del rigor y exigencia generales. Ahora bien, al tratarse de un declive gradual, no se aprecia con nitidez la pérdida de calidad. Sin embargo, cuando el deterioro se acentúa se acaban dando por buenos (publicándolos) resultados que realmente no responden a hechos reales y por tanto no se pueden reproducir.

Este artículo se publicó originalmente en el blog de Jakiunde. Artículo original.

Sobre los autores: Juan Ignacio Perez Iglesias es Director de la Cátedra de Cultura Científica de la UPV/EHU y Joaquín Sevilla Moroder es Director de Cultura y Divulgación de la UPNA.

El artículo La crisis de reproducibilidad en ciencia se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El legado de Fisher y la crisis de la ciencia

- Ciencia Patológica

- Sesgos cognitivos que aquejan a la ciencia

Prestakuntza hobea duten pertsonek osasun hobea ere badute

Alabaina, duela lau hamarkada baino gehiago, Samuel Preston demografoa eta soziologoa konturatu zen aldagai horien arteko erlazioa ez zela uste bezain sinplea. Egiaztatu zuen herrialde askotan biztanleen bizi-itxaropena ez zetorrela bat eskema horrekin eta, horretaz gain, ikusi zuen XX. mendean zehar, bizitza-luzera aberastasunaren hazkundearen efektuz espero zitekeena baino handiagoa zela. Eta, orduan, pentsatu zuen agian guztia ez zegoela diru-sarreren mailaren mende. Proposatu zuen osasun kondizioek izandako hobekuntzak eta medikuntzan gertatutako aurrerabideak –faktore ekonomikoen araberakoak ez erabat– izan zirela bizi-itxaropena handiagotzearen eragile nagusiak. Hamarkada bat geroago, John C. Caldwell demografoak ikusi zuen eskualde pobreetan (adibidez, Indiako Keralan, Sri Lankan eta Costa Rican) bizi-itxaropenak nabarmen egiten zuela gora osasun zerbitzuak hobetzeaz gain emakumeek hezkuntzarako sarbidea zuten tokietan.

Irudia: Hezkuntza maila eta osasunaren arteko harremana ikertu zuten 2018an Wolfgang Lutz eta Endale Kebede ikertzaileek. Lortutako emaitzen arabera hainbat egilek adierazitako diru-sarreren eta osasunaren arteko korrelazio estatistikoa faltsua izan litekeela ikusi zuten. Ikerketan adierazi zuten hezkuntza maila hobea dela osasun hobearen eta diru-sarrera gero eta handiagoen funtsezko determinatzailea. (Argazia: Steffen Eckart. Iturria: Pixabay.com)

Datu horiek eta beste azterlan batzuetan ikusitakoa kontuan izanik, Wolfgang Lutz eta Endale Kebede ikertzaileek osasunaren eta bizi-itxaropenaren baldintzatzaile nagusia identifikatzen saiatu ziren, eta, horretarako, oso aberastasun maila desberdinak dituzten 174 herrialderen datuak baliatu zituzten; datuak, 1970‑2010 tartekoak, bost urteko tartetan sailkatu zituzten azterlanerako. Azterlan horretan, jaiotzean bizi-itxaropenean eta haurren heriotza-tasan eragina izan dezaketen bi faktore hartu zituzten kontuan: batetik, herrialdeen batez besteko aberastasun maila (pertsona bakoitzeko barne produktu gordina); bestetik, biztanleriaren hezkuntza maila (azterlan batean, 15 urtetik gorakoen eskolatze urteak; bestean, 20-39 urteko emakumeen eskolatze urteak).

Datuen azterketa estatistikoen arabera ondoriozta daitekeenez, hezkuntza mailak diru-sarreren mailak baino askoz ere hobeki azaltzen du biztanleriaren osasun egoera. Ondorio hori azaltzeko beste modu bat da, jendearen hezkuntza maila herrialdearen aberastasun maila baino garrantzitsuagoa dela haurren heriotza-tasa eta bizi-itxaropenean. Ikertzaileek proposatzen dute hezkuntza mailak irizpide hobea ematen diela pertsonei, osasunarekin loturiko ondorioak dituzten erabakiak hartzeko orduan, dela elikadurari dagokionez, dela bizi ohitura orokorrei gagozkiela. Aberastasun mailaren efektua ez litzateke benetakoa izango; aitzitik, egileen hitzetan, lotura faltsua izango litzateke: herrialde aberatsenetan jendea hobeto prestatuta egotearen ondorioa litzateke diru-sarreren mailaren eta osasun-egoeraren arteko erlazioa.

Azterlanak ez du kontuan hartzen osasun sistemara bideratzen diren baliabideek bizi-itxaropenean duten eragina. Baina, jada azaldu den bezala, zenbat eta handiagoa izan biztanleen prestakuntza maila, orduan eta handiagoa izango da herrialdearen aberastasuna eta, horrenbestez, gehiago dira osasun sistemara bideratzen diren baliabideak. Berriz ere agerian geratzen da prestakuntzan baliabideak inbertitzea oso errentagarria dela. Prestakuntza ona duten pertsonen bizitza ez ezik, biztanleria osoarena ere hobeagotzen du.

———————————————————————————-

Egileaz: Juan Ignacio Pérez Iglesias (@Uhandrea) UPV/EHUko Fisiologiako katedraduna da eta Kultura Zientifikoko Katedraren arduraduna.

———————————————————————————

The post Prestakuntza hobea duten pertsonek osasun hobea ere badute appeared first on Zientzia Kaiera.

Roberto Frucht, matemático en tránsito

Alberto Mercado Saucedo

Fueron varias las fronteras que cruzó Roberto Frucht tanto en las matemáticas como en su trayectoria personal. Obtuvo resultados de gran importancia y profunda belleza en teoría de grafos, cuando esta área recién comenzaba a definirse como tal en el medio académico internacional, y fue autor de algunos de los primeros artículos de investigación matemática realizada en Chile, publicados en revistas internacionales en los años cuarenta del siglo veinte. Además, dejó cantidad de gratos recuerdos entre colegas y estudiantes de la Universidad Técnica Federico Santa María –UTFSM- en Valparaíso, donde fue profesor durante más de medio siglo.

Hace un tiempo tuve la oportunidad de presenciar un bello e inesperado testimonio del poeta Raúl Zurita, que estudió ingeniería a fines de los años sesenta y tuvo a Frucht como profesor. El 2015 Zurita recibió el doctorado honoris causa de la universidad, y en su discurso de aceptación dedicó varios minutos a recordar una clase dictada por un “profesor ya mayor, de baja estatura” en la que el entonces futuro poeta se encontró con la “elegancia, simpleza y belleza” de cierta fórmula matemática. Como si la clase ocurriera en esos momentos, la voz del poeta recordó el áspero andar de la tiza en el pizarrón de cuarenta años atrás: el profesor Roberto Frucht explicando a sus estudiantes la fórmula de Euler, quizá una de las expresiones más hermosas de la matemática, como bien lo percibió Zurita.

¿Dónde reside la belleza de esta fórmula? Quizá simplemente en que aparecen distintos números bien conocidos: los irracionales e, junto con el imaginario i, la raíz cuadrada de -1, relacionados por operaciones matemáticas. Pero también podemos pensar que la fórmula relaciona los mundos del álgebra y la geometría: expresa que el número -1 hace ángulo con el eje x en el plano complejo; lo mismo ocurre con el valor de para cualquier ángulo Quizá fueron estos cruces lo que impactó a Zurita y provocó tan duradero recuerdo.

De hecho, la obra literaria de Zurita hace recurrentes alusiones al mundo de las matemáticas, tema del que no hablaremos ahora pero que podemos conjeturar se originó en momentos iluminadores como el anterior, que en el discurso del poeta tuvo un trágico contrapunto en la alusión al golpe de estado y el inicio de la dictadura, lo cual afectó directamente a Zurita y dejó al pueblo chileno un triste legado, aún vigente en nuestros días. Precisamente, el profesor Frucht había llegado a Sudamérica treinta años antes huyendo de horrores similares.

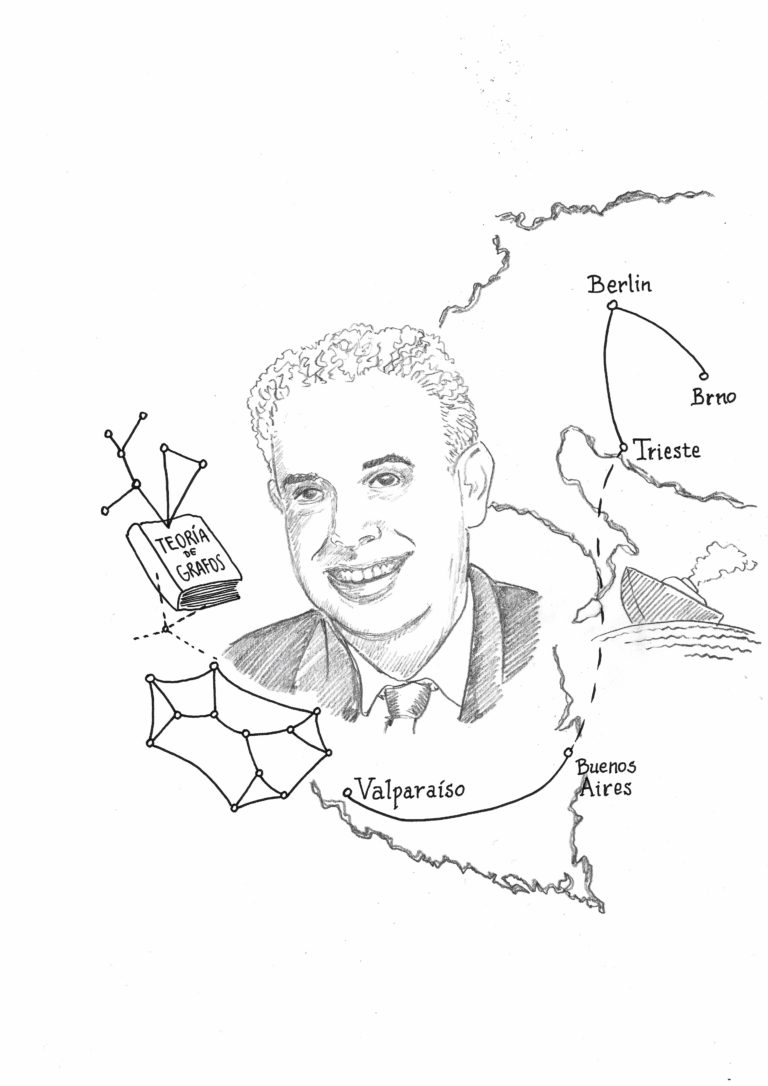

Ilustración de Constanza Rojas-Molina. Todos los derechos reservados; cesión en exclusiva para su publicación en el Cuaderno de Cultura Científica.

Ilustración de Constanza Rojas-Molina. Todos los derechos reservados; cesión en exclusiva para su publicación en el Cuaderno de Cultura Científica.Roberto Frucht nació el 9 de agosto de 1906 en Brno, ciudad que hoy pertenece a la República Checa, y luego vivió en Berlin desde los dos años de edad, cuando su familia se instaló en la ciudad alemana. Allí finalizó estudios universitarios y decidió continuar especializándose en matemáticas, para lo que obtuvo su doctorado en 1930 en teoría de grupos, área del álgebra abstracta. Obtener una de las escasas plazas en la universidad era sumamente difícil, e impartir clase en un Gimnasium (colegio) estaba reservado para los alemanes, nacionalidad que no poseía Frucht. Estas circunstancias, por no hablar del contexto internacional, de lo más complicado para un descendiente de familia judía, hicieron que en 1930 se trasladara a Trieste, Italia, donde trabajaría en una compañía de seguros por casi ocho años. Allí, inició una relación con María Mercedes Bertogna, compañera de trabajo de origen argentino, con quien se casó en 1932.

Podemos imaginar que durante esos años en Trieste el trabajo de Roberto era rutinario, pero se las ingenió para publicar artículos -escritos en alemán- sobre la investigación realizada en su doctorado, además de otros trabajos de contabilidad escritos en italiano. Pero lo mejor estaba por venir, pues un día cualquiera de 1936 un hecho fortuito determinó la trayectoria de Roberto Frucht: recibió en su oficina de seguros un catálogo con información de un libro del matemático húngaro Dénes Kőnig sobre teoría de grafos, prácticamente el primero sobre la materia, y se interesó por el título de un capítulo que era algo así como “aplicaciones de la teoría de grupos a los grafos”. Ordenó el libro y desde que lo recibió se convirtió, según sus propias palabras, en un entusiasta de la teoría de grafos. Tan fue así, que se dedicó a estudiar el tema en detalle y en especial a trabajar en los problemas abiertos planteados en el libro.

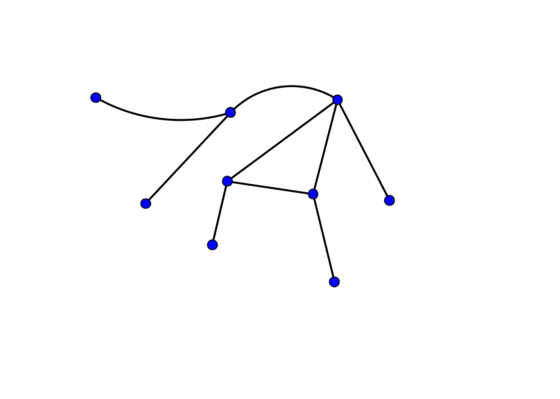

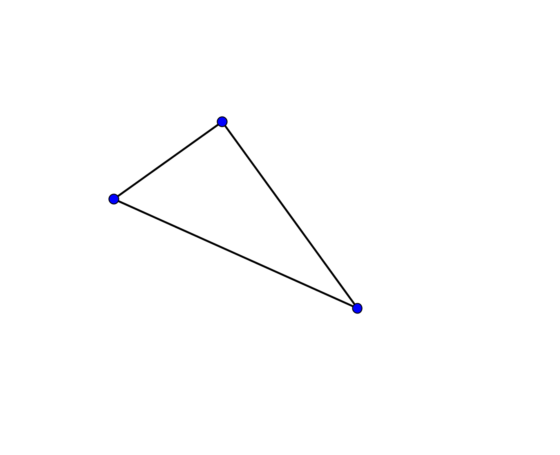

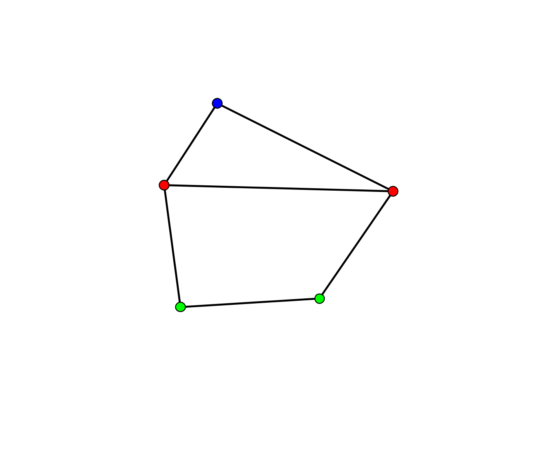

Para comprender la idea de esta área de las matemáticas, pensemos que un grafo es una colección de vértices junto con segmentos que los unen en una combinación dada, y es esta combinación lo que determina el grafo en particular. Por ejemplo un polígono: los triángulos, cuadrados y demás son grafos.

Ejemplo de grafo.

Ejemplo de grafo.

También es un grafo el diagrama del mapa del metro en una ciudad, si pensamos que cada estación es un vértice, que está unido con otro si es que hay una línea de metro entre las estaciones. Lo importante en un grafo es su estructura: el cómo se dan las conexiones, la combinación precisa, y no importan la longitud o la forma con que dibujemos sus segmentos. Es lo mismo que para el usuario del metro cuando lee el mapa, pues lo que le importa es saber si un par de vértices/estaciones dados están o no conectados.

Mapa del metro de Ciudad de México, México D.F.

Mapa del metro de Ciudad de México, México D.F.

En teoría de grafos se estudian problemas planteados sobre estas estructuras, problemas que pueden ser geométricos, combinatorios, algebraicos o de otra índole. El tema en el que se interesó Frucht está relacionado con determinar el conjunto de automorfismos de un grafo, que son permutaciones entre los vértices que no cambian su estructura. Los automorfismos son una especie de simetrías del grafo respecto a sus conexiones, y son transformaciones que forman un grupo, pues se puede definir una operación entre dos de ellas: la composición, que consiste en aplicar una transformación y luego la otra. En el caso de un triángulo, es fácil ver que todas sus permutaciones son simetrías: ya sea realizar una especie de rotación entre los tres vértices o bien intercambiar dos de ellos como en una reflexión especular (el lector podrá determinar cuántos automorfismos hay).

Hacemos hincapié en que no es importante el largo o forma de los segmentos. Por ejemplo, el grafo con forma de pentágono mostrado abajo posee un solo automorfismo (además de la identidad), que consiste en intercambiar los vértices verdes uno con el otro, lo mismo que los vértices rojos también entre sí, dejando fijo el vértice de color azul.

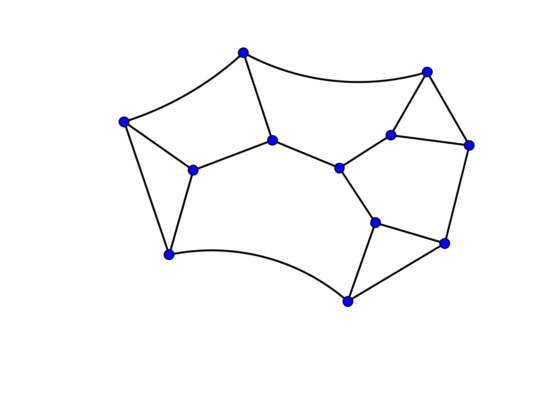

Tras estudiar el libro de teoría de grafos, uno de los primeros resultados de Roberto fue determinar el grupo de automorfismos de algunos sólidos platónicos (equivalente tridimensional de los polígonos regulares). Un año más tarde, resolvió un problema mucho más importante: König había planteado en su libro la pregunta abierta si dado un grupo finito cualquiera, éste corresponderá necesariamente a los automorfismos de un grafo, el que habría que determinar. Esto significa pasar del álgebra a la geometría, algo así como dibujar el grupo dado por medio de su grafo. Frucht respondió afirmativamente a esta pregunta, y definió un procedimiento constructivo para determinar el grafo a partir del grupo dado, lo que se conoce como Teorema de Frucht. Además, encontró un grafo especial: uno que no posee ninguna simetría más que la identidad. A este grafo se le conoce como Grafo de Frucht y se ha convertido en un ejemplo clásico en el área. Es mostrado en la siguiente figura, donde se puede notar que cada vértice posee exactamente tres conexiones; de hecho este es el grafo más pequeño con tal estructura y que no tiene automorfismos.

Grafo de Frucht

Grafo de Frucht

Frucht realizó estos trabajos entre 1936 y 1938, tristes años en Europa, en pleno auge del nazismo alemán y del fascismo italiano. Por esos años se aprobaron en Italia discriminadoras leyes raciales que complicaron la continuidad laboral de Roberto en Trieste. La familia, que ya incluía a su hija Érica, nacida en Trieste poco antes, decide mudarse a Argentina, donde vivían parientes de Mercedes. A principios de 1939 viajaron en el buque de vapor Augustus hasta el puerto de Buenos Aires, donde Frucht trabajó de nuevo en una compañía de seguros, pero también encontró la forma de seguir pensando en matemáticas, pues publicó varias notas sobre geometría diferencial en la revista de la Unión Matemática Argentina UMA, en ediciones bilingües en alemán y español.

De manera un tanto azarosa, la estadía en Buenos Aires llegó pronto a su fin, pues Roberto se encontró con la oportunidad de optar por una plaza como profesor en la UTFSM, institución que había sido recientemente creada y se abocaba a contratar un número de profesores extranjeros, sobre todo alemanes, para poder lograr rápidamente una masa crítica de académicos. Del Atlántico al Pacífico, seguramente la vida en el puerto de Valparaíso era más tranquila que en Trieste o Buenos Aires; en todo caso la familia se acostumbró sin dificultad a Valparaíso, excepto por los no poco frecuentes temblores, según Roberto contaba, un poco en tono de broma, a sus cercanos.

Roberto continuó publicando algunas notas sobre geometría diferencial y álgebra en revistas de la UMA, escritas en español y ahora con afiliación UTFSM. Retomó su trabajo en teoría de grafos gracias a una invitación del matemático Harold S.M. Coxeter para contribuir al recién creado Canadian Journal of Mathematics, para lo que se dispuso a trabajar contra el tiempo, y logró obtener interesantes refinamientos de sus resultados anteriores y publicar un artículo en 1949.

Durante las décadas que siguieron, Roberto Frucht continuó con su investigación en teoría de grafos y se convirtió en uno de los pioneros de la matemática en Chile. Fue decano de la Facultad de Ciencias de la universidad entre 1948 y 1968, director y miembro fundador de la Sociedad de Matemáticas de Chile SOMACHI, colaborador frecuente de la revista local Scientia, entre otras labores académicas, y en 1970 fue nombrado profesor emérito. Desde entonces y hasta poco antes de su fallecimiento en 1997 continuó impartiendo clases en la universidad, como aquella donde enseñó la formula de Euler y transmitió a sus alumnos, en las palabras del poeta que entonces ocupaba un pupitre de estudiante anónimo, la irremediable melancolía de lo que nos parece extremadamente bello.

Referencias:

Gary Chartrand, Ping Zhang. A First Course in Graph Theory. Dover Publications 2012.

R. Frucht. Herstellung von Graphen mit vorgegebener abstrakter Gruppe

Compositio Mathematica, tome 6 (1939), p. 239-250.

Robert Frucht. Graphs of degree three with a given abstract group. Canad. J. Math. 1 (1949), 365–378.

Roberto W. Frucht. (1982). How I became interested in graphs and groups. Journal of Graph Theory. 6(2), 101-104 https://doi.org/10.1002/jgt.3190060203

Harary, F. (1982). Homage to roberto frucht. Journal of Graph Theory, 6(2), 97–99. https://doi:10.1002/jgt.3190060202

Héctor Hevia. Grafos con grupo dado de automorfismos. Proyecciones Vol 14 No 2 (1995).

Iván Szántó, Betsabe González. Breve reseña histórica de la Revista Scientia y las publicaciones de Matemática en Chile. Boletín de la Asociación Matemática Venezolana, Vol. XXI, No. 1 (2014).

Reinhard Siegmund-Schultze. Mathematicians Fleeing from Nazi Germany Individual Fates and Global Impact. Princeton university press. 2009.

Raúl Zurita Canessa. No nos hemos perdido (Discurso). Cuadernos de Educación. Publicación Trimestral Gratuita – ISSN 0719-0271. N 35, 2016.

Sobre el autor: Alberto Mercado Saucedo es profesor de matemáticas en la Universidad Técnica Federico Santa María (Valparaíso, Chile)

Sobre la ilustradora: Constanza Rojas Molina es profesora del departamento de matemáticas de la CY Cergy Paris Université (Cergy-Pontoise, Francia)

El artículo Roberto Frucht, matemático en tránsito se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Ilustraciones artísticas de un matemático

- Pierre Fatou, un matemático poco (re)conocido

- Solomon Lefschetz, matemático ‘por accidente’

Asteon zientzia begi-bistan #291

Esteban Abad Holgado CSICeko kimikaria elkarrizketatu dute Berrian, Zaldibarko luiziaren harira. Zabortegiko suteetako kearen bidez airera zabaldu diren partikulak (dioxinak eta furanoak) kezka dira. Horiei buruz hitz egin du adituak: “Toxikoak dira; kontrolatu egin behar dira maila apaletan ere. OME Osasunerako Mundu Erakundeak berak esana du minbizia eragiten dutela; disruptore endokrino ere badira”. Halere, kimikariak dio ez zaiola aparteko larritasunik eman behar egoerari: “Kezka iturri dira dioxinekiko esposizio iraunkorrak. Kasu honetan, hamar-hamabi eguneko esposizio bati buruz ari gara; ezin dugu esan hori iraunkorra denik”.

Berriki publikatu den ikerketa batek aditzera eman du permafrostean zein izotz-geruzen azpian bilduta dagoen metanoa askatzeak ez duela izango orain uste den bezainbesteko eragina klima-aldaketan. Ondorio horretara iristeko, zientzialari talde batek duela 18.000-8.000 urte inguru, Antartikako izotzetako aire-burbuiletan bildutako metanoa aztertu du. Elhuyar aldizkarian aurkituko dituzue xehetasunak.

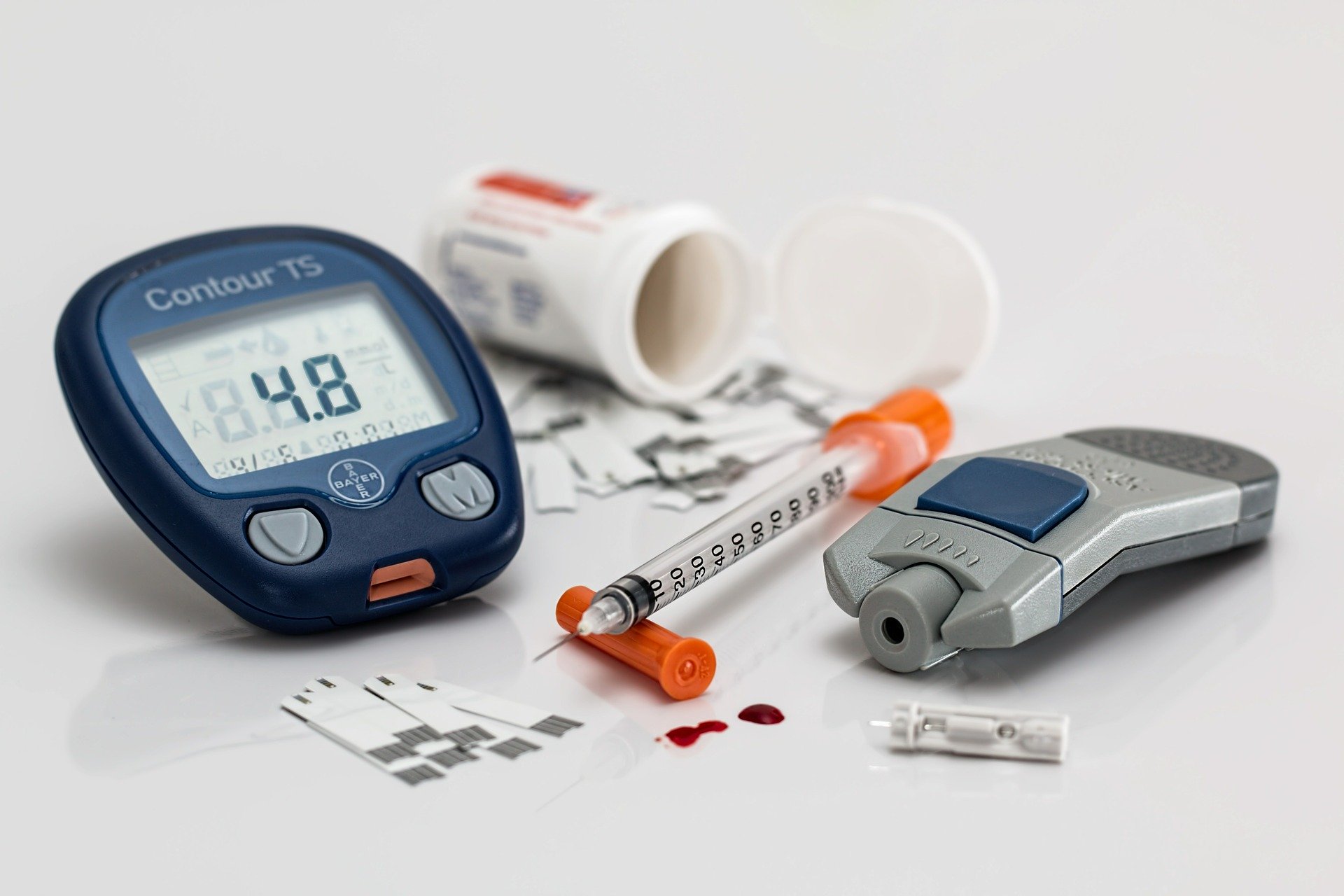

OsasunaAurreko artikulu batean, Josu Lopez-Gazpiok glukosaren metabolismoan intsulinak duen garrantzia azaldu zigun. Eta oraingoan, erregulazio horretan akatsak daudenean gertatzen dena izan du mintzagai. Jakina denez, glukosaren metabolismoa intsulinak erregulatzen du eta bere funtzio garrantzitsuena glukosa odoletik zeluletara igarotzen laguntzea da. Baina pankreak intsulinarik jariatzen ez badu, zeluletako paretetan dauden glukosa garraiatzaileak ez dira behar bezala aktibatzen eta glukosa ez da modu eraginkorrean sartzen zeluletara. Horri 1 motako diabetesa deritzo.

Tontakeria bat dirudi baina aireportuetatik igarotzen diren bidaiariek eskuak ondo garbitzen badituzte, gaitz infekziosoen hedapena murriztu daiteke. Hala adierazi dute Massachusettseko Teknologia Institutuko ikertzaileek. Proposatu dutenez, munduko hamar aireportutan eskuak garbitzeko tasa handitze soilarekin, gaitz biral baten zabalkuntza asko murriztuko litzateke. Informazio guztia Juanma Gallegoren artikuluan.

Berdeguneetatik hurbil bizitzeak menopausia atzeratzen duela erakutsi du ikerketa batek. Datuek argitu digute bidea: hurbil bizi diren emakumeek urrun bizi direnak baino 1,4 urte geroago izaten dute menopausia. Ikertzaileek azaldu dutenez, menopausia hasteko adinean hainbat faktorek dute eragina, hala nola genetikak eta bizi-ohiturek; tabakoa erretzeak, obesitateak, jarduera fisikoa egiteak, etab. Berdeguneen faktoreak kortisolarekin du harremana Elhuyar aldizkarian irakur daitekeenez.

PaleontologiaNeanderthal heldu baten gorpuzkiak topatu dituzte Hego Kurdistanen, inguruan polen arrastoak dituela, eta hori hileta errituak frogatzeko aztarna bat izan daiteke. Cambridge Unibertsitateko laborategietara eraman dute gorpua, haren berreraiketa digitala egiteko. Halaber, ikertzaile taldea leizean aurkitutako sedimentuak ere aztertzen ari da, Berriaren artikuluaren arabera.

AstrofisikaLehenengo aldiz, eguzki-sistematik kanpoko planeta batek bere izarrean eragin ahal izan dituen aurorak identifikatu dituzte. Hala, exoplaneta berri bat aurkitu dutela adierazi dute. Elhuyar aldizkaria azaldu digu LOFAR erabilita –Europan zehar banatutako 20.000 irrati-antenen sarea– hauteman dutela GJ 1151 izar nanoan eztanda aurorarra. Oraingoz hipotesi bat da horren aurkikuntza.

FisikaAntihidrogenoaren propietate fisiko bat doitasun handiz neurtzea lortu dute CERNeko zientzialariek. Ikusi dute propietate hori ohiko hidrogenoaren parekoa dela eta horrekin ikertzaileek berretsi dute materiaren eta antimateriaren arteko simetria. Elhuyar aldizkariak azaldu digunez, antihidrogeno atomo batean dauden bi energia-mailaren arteko aldea neurtu dute eta hidrogenoan atzeman daitekeen alde hori antihidrogenoan ere dagoela frogatu dute.

MikrobiologiaLurpeko biosferari (mikrobio materia iluna deitzen zaio) arreta jarri dio Tennesseeko Unibertsitateko ikertzaile talde batek; izan ere, mikrobio horien populazioa lehen aldiz kalkulatu du. Datuak harrigarriak dira oso: organismo horiek guztiak 2 mila milioi km³-ko arroka bolumenean banatuta daude (Lurreko ozeano guztiek okupatzen duten bolumenaren bikoitza), Lurreko mikrobio-bizitzaren %70 izango litzateke. Nolakoak dira mikroorganismo horiek? Ez galdu artikulu interesgarria hau!

KimikaTeknologia arloan, material porotsuak lortzeko nahia gero eta handiagoa da. Material horien artean ezagunak dira zirkonio-MOFak (ingelesez metal-organic frameworks), propietate bikainak dituelako eta bere sendotasunagatik. Halere, azken urteotan, MOFen aurrerakuntza horrekin lotuta berezko arazoak ere ageri dira, haien artean ezegonkortasun kimikoa eta termikoa. Egun, zientzialariak sendoagoak diren MOFen bila ari dira, artikuluan irakur daitekeenez.

Emakumeak zientzianUPV/EHU Euskal Herriko Unibertsitateko fisika eta matematika departamentuetan emakumeek jasaten duten diskriminazioari buruzko ikerketa bat abiatzea pentsatu zuen Nastassja Ciprianik (Erroma, 1987). Emakunderen beka bati esker, datuekin hori frogatu du. Fisika eta matematika departamentuetako maila guztietako ikertzaileei eta irakasleei galdetuta, gehienek ez zuten ikusten emakumeen diskriminazioa. “Jende askok uste du diskriminazioa sexu jazarpen esplizitua dela”, dio Ciprianik. Ez galdu Berriako elkarrizketa interesgarri hau!

Jone Uria Albizuri matematikan doktorea elkarrizketatu dute honetan Unibertsitatea.neten. Egun BCAM-en ari da doktoretza ondoko ikertzaile gisa, Neurozientzia Matematiko, Konputazional eta Esperimentalen lan taldean. Bertan, neurozientzia ikuspuntu matematiko batetik aztertzea dute helburu. Horretaz gain, elkarrizketa honetan, bere matematikarekiko zaletasunaz eta egindako ikerketaz eta tesiaz mintzatu da.

Iraganera jauzi eginez, Jean Sammet informatikaria ezagutzeko aukera izan dugu artikulu honen bitartez. Zenbakiak maite zituen eta arlo konputazionalean murgildu zen: COBOL (COmmon Business Oriented Language) eta FORMAC (FORmula MAnipulation Compiler) programazio-lengoaiak diseinatu eta garatzeagatik bilakatu zen aitzindari.

–——————————————————————–

Asteon zientzia begi-bistan igandeetako atala da. Astean zehar sarean zientzia euskaraz jorratu duten artikuluak biltzen ditugu. Begi-bistan duguna erreparatuz, Interneteko “zientzia” antzeman, jaso eta laburbiltzea da gure helburua.

———————————————————————————-

Egileaz: Uxue Razkin (@UxueRazkin) kazetaria da.

———————————————————————————-

The post Asteon zientzia begi-bistan #291 appeared first on Zientzia Kaiera.

Los ecos del fondo submarino: imágenes de las estructuras geológicas.

Los fósiles, los minerales o las rocas son, entre otras cosas, en lo primero que pensamos al hablar de geología, pero lo cierto es que la física es un ámbito científico que difícilmente se puede desvincular de la geología. Y es que el fundamento físico resulta clave a la hora de explicar algunos procesos geológicos que suceden tanto en el océano como en la superficie terrestre.

Con el fin de poner sobre la mesa la estrecha relación entre la geología y la física, los días 27 y 28 de noviembre de 2019 se celebró la jornada divulgativa “Geología para poetas, miopes y despistados: La Geología también tiene su Física”. El evento tuvo lugar en la Sala Baroja del Bizkaia Aretoa de la UPV/EHU en Bilbao.

La segunda edición de esta iniciativa estuvo organizada por miembros del grupo de investigación de Procesos Hidro-Ambientales (HGI) de la Facultad de Ciencia y Tecnología de la Universidad del País Vasco, en colaboración con el Vicerrectorado del Campus de Bizkaia, el Geoparque de la Costa Vasca y la Cátedra de Cultura Científica de la UPV/EHU.

Gemma Ercilla, investigadora del CSIC en el Instituto de Ciencias del Mar (Barcelona), nos explica cómo estudiar el fondo marino usando el sonido y que podemos aprender de este estudio.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Los ecos del fondo submarino: imágenes de las estructuras geológicas. se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Otra mirada al planeta: arte y geología

- Geología: la clave para saber de dónde venimos y hacia dónde vamos

- Geología, ver más allá de lo que pisamos

Ezjakintasunaren kartografia #296

Arroparen etiketak ez nabaritzea da ohikoena. Jantzi ostean denbora pasata, arropa bera ez nabaritzea da ohikoena. Ohitze deitutako mekanismoa da hau, bizitzarekin aurrera egitea ahalbidetzen duena. Berdin funtzionatzen du, baina, autismoa duten pertsonengan? JR Alonsoren Habituation and autism

Argumentazio bide bati eusteko arazo batzuk ebakuntzarekin konpondu daitekeen zioa izan dezakete: minbizia. How a meningioma can make you lose your train of thought while speaking Cheyenne Svaldiren eta Adrià Rofesen eskutik.

Hall efektu kuantikoak dirudien baino kontribuzio gehiago ditu. Horietako batzuk errelatibistak dira eta argiaren abiaduraren araberakoak dira. DIPCren An additional contribution to the spin Hall effect induced by an electric current.

–—–

Mapping Ignorance bloga lanean diharduten ikertzaileek eta hainbat arlotako profesionalek lantzen dute. Zientziaren edozein arlotako ikerketen azken emaitzen berri ematen duen gunea da. UPV/EHUko Kultura Zientifikoko Katedraren eta Nazioarteko Bikaintasun Campusaren ekimena da eta bertan parte hartu nahi izanez gero, idatzi iezaguzu.

The post Ezjakintasunaren kartografia #296 appeared first on Zientzia Kaiera.

La topología frágil es una extraño monstruo

Los electrones circulan sobre la superficie de ciertos materiales cristalinos inusuales, los aislantes topológicos, excepto las veces que no lo hacen. Dos nuevos estudios publicados en la revista Science explican la fuente de ese insólito comportamiento y describen un mecanismo para restaurar la conductividad en estos cristales, apreciados por su potencial uso en futuras tecnologías, incluyendo los ordenadores cuánticos.

Los aislantes topológicos tienen un lado frágil. Imagen cortesía de Zhi-Da Song, Universidad de Princeton.

Los aislantes topológicos tienen un lado frágil. Imagen cortesía de Zhi-Da Song, Universidad de Princeton.Durante los últimos 15 años, una clase de materiales conocidos como aislantes topológicos ha dominado la búsqueda de los materiales del futuro. Estos cristales tienen una propiedad poco común: su interior es aislante —los electrones no pueden fluir—, pero sus superficies son conductoras perfectas, donde los electrones fluyen sin resistencia.

Esa era la realidad hasta que hace dos años se descubrió que algunos materiales topológicos son incapaces de conducir la corriente en su superficie, un fenómeno que se acuñó con el nombre de «topología frágil».

«La topología frágil es una extraño monstruo: ahora se predice su existencia en cientos de materiales», comenta B. Andrei Bernevig, profesor de física en Princeton y coautor de ambos trabajos. «Es como si el principio habitual en el que nos hemos basado para determinar experimentalmente un estado topológico se desmoronara”.

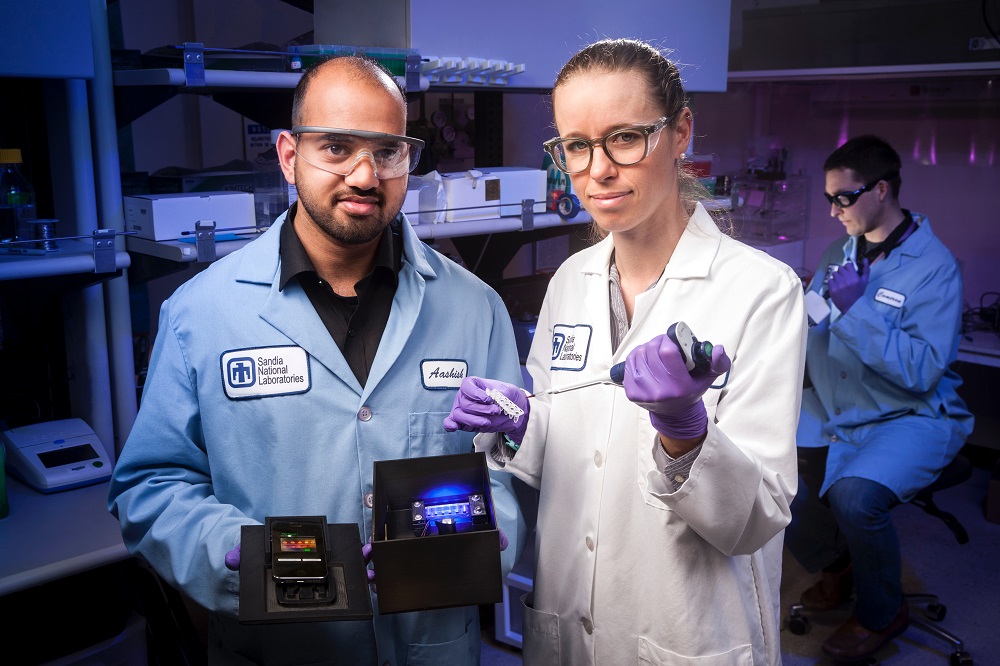

Para conocer cómo se forman los estados frágiles, los investigadores recurrieron a dos recursos: las ecuaciones matemáticas y la impresión 3D. Con la colaboración de Luis Elcoro, profesor del Departamento de Física de la Materia Condensada de la Facultad de Ciencia y Tecnología de la UPV/EHU, Bernevig y el investigador postdoctoral de Princeton Zhi-Da Song, construyeron una teoría matemática para explicar lo que ocurre en el interior de los materiales. A continuación, Sebastian Huber y su equipo en el ETH Zurich, en colaboración con investigadores de Princeton, el Instituto Científico Weizmann en Israel, la Universidad Tecnológica del Sur de China y la Universidad de Wuhan, probaron esa teoría construyendo un material topológico de tamaño real con piezas de plástico impresas en 3D.

Los materiales topológicos toman su nombre del campo de las matemáticas que explica cómo objetos diferentes, por ejemplo las rosquillas o las tazas de café, están relacionadas (ambas tienen un agujero). Esos mismos principios pueden explicar cómo saltan los electrones de un átomo a otro en la superficie de los aproximadamente 20.000 materiales topológicos identificados hasta la fecha. Los fundamentos teóricos de los materiales topológicos les valieron el Premio Nobel de Física de 2016 a F. Duncan Haldane, David J. Thouless y Michael Kosterlitz.

Lo que hace que estos cristales sean tan interesantes para la comunidad científica son sus paradójicas propiedades electrónicas. El interior del cristal no tiene la capacidad de conducir la corriente, es un aislante. Pero si se corta el cristal por la mitad, los electrones se deslizarán sin ninguna resistencia por las superficies que acaban de surgir, protegidos por su naturaleza topológica.

La explicación radica en la conexión entre los electrones de la superficie y los del interior. Los electrones pueden ser considerados no como partículas individuales, sino como ondas que se extienden como las ondas de agua que se generan al arrojar un guijarro a un estanque. En esta visión de la mecánica cuántica, la ubicación de cada electrón se describe por una onda que se extiende y que se denomina función de onda cuántica. En un material topológico, la función de onda cuántica de un electrón del interior se extiende hasta el borde del cristal, o límite de la superficie. Esta conexión entre el interior y el borde da lugar a un estado en la superficie perfectamente conductor.

Esta “correspondencia de interior-borde (bulk-boundary correspondence en inglés)” fue ampliamente aceptada para explicar la conducción topológica de la superficie hasta hace dos años, cuando varios trabajos científicos revelaron la existencia de la topología frágil. A diferencia de los estados topológicos habituales, los estados topológicos frágiles no contienen estados de conducción en la superficie. «El habitual principio de interior-borde se desmoronó», explica Bernevig. Pero no se pudo esclarecer cómo sucede exactamente.

En el primero de los dos trabajos publicados en Science, Bernevig, Song y Elcoro proporcionan una explicación teórica para una nueva correspondencia interior-borde que explica la topología frágil. Los autores muestran que la función de onda de los electrones en topología frágil solo se extiende hasta la superficie en condiciones específicas, que los investigadores han acuñado como correspondencia interior-borde retorcida.

El equipo descubrió, además, que se puede ajustar esa correspondencia interior-borde retorcida, y así hacer reaparecer los estados conductores de la superficie. «Basándonos en las formas de la función de onda, diseñamos un conjunto de mecanismos para introducir interferencias en el borde de tal manera que el estado del borde se convierta inevitablemente en conductor perfecto», comenta Luis Elcoro, profesor de la UPV/EHU.

Encontrar nuevos principios generales es algo que siempre fascina a los físicos, pero este nuevo tipo de correspondencia interior-borde podría además tener un valor práctico, según los investigadores. «La correspondencia interior-borde retorcida de la topología frágil proporciona un procedimiento potencial para controlar el estado de la superficie, que podría ser útil en aplicaciones de mecánica, electrónica y óptica», declara Song.

Pero probar que la teoría funciona era prácticamente imposible, dado que se tendría que interferir en los bordes a escalas atómicas infinitesimalmente pequeñas. Así que el equipo recurrió a otros colaboradores para construir un modelo de tamaño real con el que poner a prueba sus ideas.

En el segundo artículo de Science, Sebastian Huber y su equipo en el ETH Zurich construyeron la imitación en plástico de un cristal topológico a gran escala imprimiendo sus partes en impresoras 3D. Utilizaron ondas de sonido para representar las funciones de onda de los electrones. Insertaron barreras para bloquear el tránsito de las ondas sonoras, lo que es análogo a cortar el cristal para dejar al descubierto las superficies conductoras. De esta manera, los investigadores imitaron la condición de borde retorcido, y luego mostraron que manipulándolo, podían demostrar que una onda sonora que circula libremente se propaga a través de la superficie.

«Esta fue una idea y una ejecución muy de vanguardia», añade Huber. «Ahora podemos mostrar que prácticamente todos los estados topológicos que se han materializado en nuestros sistemas artificiales son frágiles, y no estables como se pensaba en el pasado. Este trabajo proporciona esa confirmación, pero aún más, introduce un nuevo principio general».

Referencias:

Valerio Peri, Zhi-Da Song, Marc Serra-Garcia, Pascal Engeler, Raquel Queiroz, Xueqin Huang, Weiyin Deng, Zhengyou Liu, B. Andrei Bernevig, and Sebastian D. Huber (2020) Experimental characterization of fragile topology in an acoustic metamaterial Science doi: 10.1126/science.aaz7654

Zhi-Da Song, Luis Elcoro, B. Andrei Bernevig (2020) Twisted Bulk-Boundary Correspondence of Fragile Topology Science doi: 10.1126/science.aaz7650

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo La topología frágil es una extraño monstruo se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Aislantes topológicos en sólidos amorfos

- La teoría de bandas de los sólidos se hace topológica

- Un aislante topológico intrínsecamente magnético

Jean Sammet (1928-2017): programazioaren lengoaiak argitu zizkigun emakumea

1. irudia: Jean Sammet informatikaria aitzindaria izan zen konputazio lengoaien alorrean. (Argazkia: SDTimes)

Batzuek akaso, programazioa, alor gisa alegia, kaotiko eta nahasi samar ikusiko dute; miopiadun batek betaurrekoak kentzean sentituko lukeen sentsazioa bailitzan. Ez zitzaion, alabaina, estatubatuar informatikariari horixe gertatu, hark zenbakiak maite zituen eta. Agian, gainerakoak horrenbeste harritzen dituen horrek gidatuta aukeratu zuen Matematika, eta helburu bakarra izan zuen: jende guztiak gai izan beharko luke ordenagailu batekin komunikatzeko.

COBOL (COmmon Business Oriented Language) eta FORMAC (FORmula MAnipulation Compiler) programazio-lengoaiak diseinatu eta garatzeagatik bilakatu zen Sammet aitzindari arlo konputazionalean. Halaber, ACM (Association for Computing Machinery) elkarteko fundatzailea eta lehenengo zuzendaria izan zen.

Uko egitetik liluraraJean Sammet 1928an jaio zen New Yorken. Bere gurasoak, Harry eta Ruth Sammet, abokatuak ziren. Euren alabaren nahia Bronx High School of Science-n ikastea zen, hiriko eskola ospetsuenetarikoan, alegia, baina ez zuten onartu emakumea izateagatik. Hortaz, Julia Richman High School ikastetxean eman zuen izena. Horren ondotik, Matematikako gradua ikasi zuen Mount Holyoke Unibertsitatean. 1948an, titulua lortzeaz gain, arlo horretako klaseak eman zituen laguntzaile gisa. Urtebete geroago, matematikako masterra egin zuen Illinoisko Unibertsitatean.

Ordenagailuen munduak ez zuen batere erakartzen hasieran, alor horri uko egitetik oso gertu zegoen, baina ikasketa akademiko gisa ezarri zutenean, iritziz aldatu zuen. Izan ere, Jeanek 2000. urteko elkarrizketa batean azpimarratu zuen moduan, ordenagailu bat ikusten zuen bakoitzean pentsatzen zuen ez zuela “hardware-pieza lizun horrekin” zerikusirik izan nahi. Batzuetan, norberaren uste osoa zalantzan jarri, eta hasieran pentsatzen zenuenaren kontrakoa egin behar da. Hori dibertigarriagoa da.

1951n, Metropolitan Life Insurance enpresan hasi zen lanean. Urtebete baino ez zuen eman bertan, irakasle izatea nahiago baitzuen. Hala, irakaskuntzan murgildu zen, eta Columbiako Unibertsitatean eman zituen klaseak. Bere programatzaile-lanari dagokionez, esan beharra dago hiru espaziotan garatu zuela. Lehenik, 1955ean, Sperry Gyroscope enpresan hasi zen, eta programatzaileen lehen taldea ikuskatu zuen bertan. Edonola ere, ez zuen alboratu irakasle-lana, horrek ere asebetetzen baitzuen. Modu honetan, 1956 eta 1958 bitartean, Adelphi Unibertsitateko graduondoko batean, Ordenagailuen programazioa ikasgaiaz arduratu zen.

2. irudia: Jean Sammet informatikaria, 1979. urtean hitzaldi bat eman aurretik Marylandeko Unibertsitatean. (Argazkia: Nytimes.com / Ben Shneiderman)

Bigarrenik, Sylvania Electric Products enpresan kontratatu zuten eta 1961era arte iraun zuen bertan. Hasieran, oinarrizkoak ziren lanak egin zituen, adibidez, MOBIDIC (MOBIle DIgital Computer) ordenagailuaren softwarearen garapena kudeatu zuen. Ordenagailu hori AEBtako Seinaleen Armada-gorputzarentzat eraiki zuten. Oro har, enpresa hartan, matematikariak postu ugari izan zituen; aipagarriena da COBOL programazio-lengoaia garatu zuen taldeko kide izan zela. Mundu guztiak bere ordenagailuan erabil zezakeen lengoaia zen COBOL, baina, kontuan hartu behar da sistema hori negozio kontuetarako bideratuta zegoela batez ere. Sammetek hobekuntzak egin zituen, unibertsalagoa bihurtu zuen sistema, gainontzeko arloetan ere erabili ahal izateko, hala nola, bankuetan eta osasunean.

Azkenik, 1961ean, IBM taldean hasi zen lanean; bertan, Bostoneko Programazio Zentroa kudeatzea eta antolatzea izan zuen helburu. Kalkulu sinbolikorako erabili zen lehenengo lengoaia eta programazio-sistemaren (FORMAC) garapena zuzendu zituen. Horretaz gain, programazio-lengoaiaren teknologiako gerente bilakatu zen Sammet 1965ean, aipaturiko enpresako sistema-garapenen departamentuan. Geroago, ADA programazio-lengoaia sortzeko proiektua zuzendu zuen.

Eskuliburu bat eta goraipamen ugariUrteetan zehar egindako lan eta ezagutza guztiak Programming Languages: History and Fundamentals liburuan (1969) bildu zituen, programazio-lengoaien inguruan idatzitako oinarrizko eskuliburuan. Argitalpenaz gain, ugariak izan ziren jaso zituen goraipamenak programazio alorrean egindako lanagatik. 1974an, ACMren (Association for Computing Machinery) lehendakari izateko hautatu zuten (bi urte igaro zituen karguan). Horretaz gain, 1978an, SIGPLAN izeneko elkartea zuzendu zuen, ACMren barruan zegoen erakundea, hain zuzen ere.

1977an, Konputazioaren Historiaren batzordea antolatu zuen American Federation of Information Processing Societies (AFIPS) izeneko elkarterako. Gainera, Sammet bertako zuzendaria izan zen. Halaber, Estatu Batuetako Ingeniaritza Akademiako kide izendatu zuten. Urtebete geroago, honoris causa doktoretza eman zioten Mount Holyoke Unibertsitatean. Horretaz gain, Bostoneko Ordenagailuaren Museoko Administrazio Kontseiluko kide bilakatu zen.

1988an erretiroa hartu eta gutxira, Ada Lovelace Saria jaso zuen, Konputazio alorrean lan egiten duten Emakumeen Elkartearen eskutik. Aipaturiko sari eta errekonozimendu askok ziurtatzen dute Sammetek egindako lan aitzindaria, bera izan baitzen programazio-lengoaien munduan bide-urratzaileetako bat. Sariei dagokienez, nabarmentzekoak dira, alde batetik, IEEE Institutuak (Institute of Electrical and Electronics Engineers) 2009. urtean eman zion saria, eta bestetik, 2013an National Center for Women & Information Technologyren (NCWIT) eskutik jaso zuena.

Badira euren lanaren bitartez besteon bizitza erraztea lortzen duten pertsonak. Sammet izango genuke horren adibide. Haren lanak eta programazio-lengoaien erabilerak erraztu egin zuten gizakien eta makinen arteko harremana; bat-batean, ordenagailuak lan batzuk egiteko tresna eraginkorrak bihurtu ziren. Hiru urte pasa dira ikertzaile estatubatuarra hil zenetik, baina bere ondareak bizirik dirau. 50eko hamarkadan fikzioa zirudien erronka gainditzea lortu zuen.

Iturriak:

- Computer History Museum, Jean Sammet.

- El Mundo, 2017ko ekainaren 5a: Muere Jean Sammet, pionera de los lenguajes de programación.

- Foro Histórico de las Telecomunicaciones, Sammet, Jean E.

- The New York Ties, 2017ko ekainaren 4a: Jean Sammet, Co-Designer of a Pioneering Computer Language, Dies at 89.

———————————————————————–

Egileaz: Uxue Razkin (@UxueRazkin) kazetaria da.

———————————————————————–

The post Jean Sammet (1928-2017): programazioaren lengoaiak argitu zizkigun emakumea appeared first on Zientzia Kaiera.

Así funcionan las baterías de litio

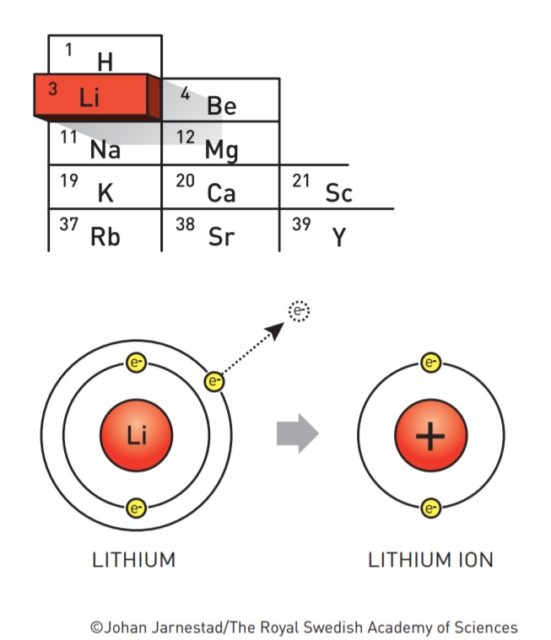

Antes de que se empezasen a fabricar baterías de litio ya se fantaseaba con la idea de poder hacer baterías de litio. La razón es que el litio es un metal que tiene tendencia a desprenderse de su electrón más externo. Al fin y al cabo, la electricidad es el tránsito de electrones, así que para producir electricidad necesitamos sustancias que tiendan a desprenderse de ellos.

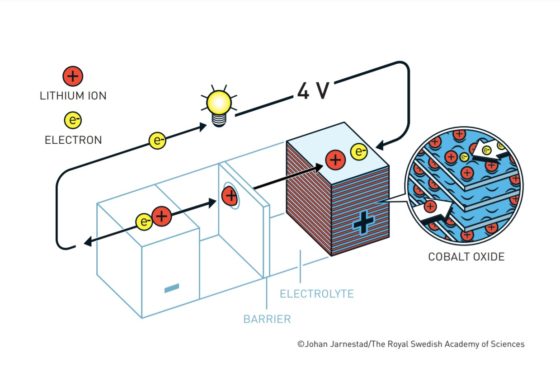

Fuente: nobelprize.org

Fuente: nobelprize.org

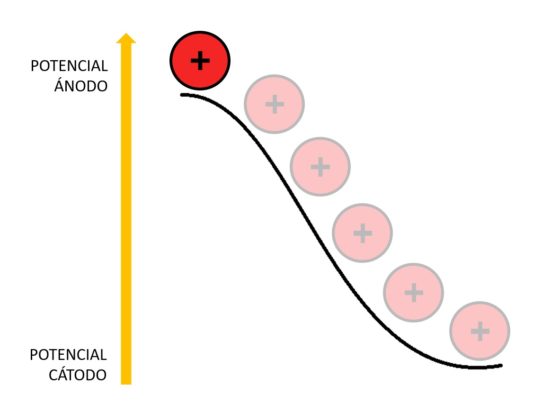

El litio es el metal con el menor potencial de reducción (-3,05V). Esto significa que es el elemento químico que más tendencia tiene a regalar electrones. Cuando regala su electrón más externo, el litio se queda cargado positivamente. Lo representamos como Li+ y lo llamamos ion litio. De ahí que las baterías de litio también se llamen baterías de ion-litio.

Que el litio ceda electrones con tanta alegría obviamente es una ventaja, pero al mismo tiempo es una maldición. Cede electrones a cualquiera. Al aire, al agua, a todo. Esto significa que es un metal muy inestable, que se oxida rápidamente en contacto con el aire, y que en contacto con el agua reacciona de forma violenta. Esa es la razón por la que la historia de las baterías de litio no ha sido un camino de rosas.

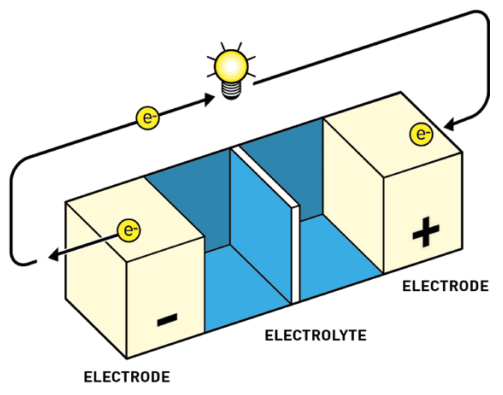

Las baterías tienen todas un mismo esquema fundamental:

-

Ánodo o electrodo negativo. Aquí es donde alguna sustancia se desprende de electrones. A estas reacciones de pérdida de electrones las denominamos reacciones de oxidación. Por convenio, al representar baterías o pilas el ánodo se dibuja a la izquierda.

-

Cátodo o electrodo positivo. Aquí es donde alguna sustancia acepta los electrones. A estas reacciones de captura de electrones las denominamos reacciones de reducción. Es la reacción inversa a la oxidación. Por convenio, al representar baterías o pilas el cátodo se dibuja a la derecha.

-

Electrolito. El electrolito actúa como separador entre el cátodo y el ánodo. Sirve para mantener el equilibrio entre las cargas del ánodo y el cátodo, ya que, si los electrones fluyen de ánodo a cátodo, se produce una diferencia de potencial, algo así como una descompensación de cargas, que frena el flujo de más electrones. El electrolito permite el flujo de iones (no de electrones) que reequilibran la carga entre ambos lados.

El ánodo y el cátodo están unidos en la batería por medio del electrolito. También se unen por fuera por medio de un conductor externo a través del cual solo circulan electrones. El conductor tiene dos extremos, polo positivo y polo negativo, como cualquier pila. Así que por el electrolito fluyen los iones de litio de un extremo a otro, y por el conductor externo fluyen los electrones.

En las baterías recargables las reacciones de oxidación (ceder electrones) y reducción (captar electrones) son reversibles, pueden fluir en ambas direcciones.

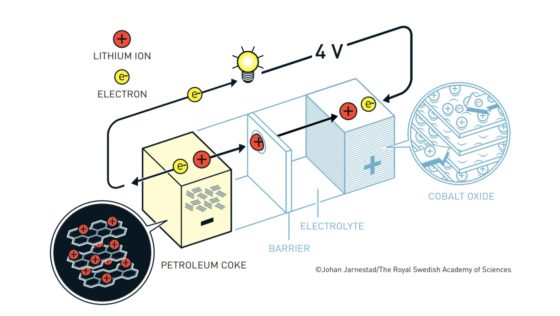

Batería Yoshino. Fuente: nobelprize.org

Batería Yoshino. Fuente: nobelprize.orgLas baterías de ion litio actuales más habituales tienen un cátodo de óxido de cobalto y un ánodo de un material similar al grafito denominado coque. Tanto el cátodo como en el ánodo tienen una disposición laminar en la que pueden albergar al litio. El litio viajará de cátodo a ánodo o de ánodo a cátodo a través del electrolito según el ciclo de carga o descarga. Los electrones, en cambio, circularán a través de un circuito externo.

-

Esto es lo que ocurre cuando se usa la batería

Cuando la batería está cargada, todo el litio está en el ánodo de coque. Durante la descarga los iones fluyen a través del electrolito desde el ánodo de coque hacia al cátodo de óxido de cobalto-litio. Los electrones también fluyen desde el ánodo al cátodo, pero lo hacen a través del circuito exterior, alimentando el móvil, el ordenador o el coche.

Como los iones de litio en el coque están a un potencial electroquímico más alto que en el óxido de cobalto-litio, caen desde el potencial del ánodo al potencial del cátodo. Esa es la razón por la que la batería aporta energía al aparato al que esté conectada.

Imagen: Deborah García Bello

Imagen: Deborah García Bello

El voltaje ofrecido por la batería depende de la diferencia de potencial entre el cátodo y el ánodo. Cuanto mayor sea esta diferencia, mayor voltaje obtendremos.

Cuando todos los iones de litio llegan al cátodo, la batería estará completamente descargada.

-

Esto es lo que ocurre cuando cargamos la batería

La carga de la batería se realiza conectando la batería a una fuente de energía externa como la red eléctrica. Los electrones de la red eléctrica entran en el ánodo a través del circuito externo. Esto provoca que los iones de litio abandonen el cátodo y regresen al ánodo a través del electrolito. Tanto los electrones como los iones litio se quedan acomodados en el ánodo entre las diferentes capas de coque. Cuando no fluyen más indica que la batería está completamente cargada.

La batería almacena energía en este proceso porque el potencial electroquímico del coque es más elevado que el del óxido de cobalto-litio. Esto quiere decir que los iones de litio han tenido que subir desde el potencial del cátodo hasta el potencial del ánodo.

-

Las evolución de las baterías de litio

A lo largo de la historia se han creado diferentes baterías. La de Volta, de 1800, usaba como electrodos zinc y cadmio, llegando a obtener hasta 1,1 V. Las baterías de plomo-ácido que hoy en día se utilizan en muchos coches producen 2 V cada una. Se suelen colocar 6 para producir los habituales 12V. También hay baterías de níquel-hierro (NiFe), de niquel-cadmio (NiCd), de níquel-hidruro metálico (NiMH)…

El problema que presentan estas baterías es que contienen metales tóxicos como el plomo o el cadmio. Además, ofrecen densidades energéticas relativamente bajas. Cuanto mayor sea la densidad de energía, más energía habrá disponible para acumular o transportar (por volumen o por masa). Así, las baterías de plomo-ácido ofrecen 30 Wh/kg de densidad energética, las de NiFe 40 Wh/kg, las de NiCd 50 Wh/kg y las de NiMH 80 Wh/kg. En cambio, las de ion litio ofrecen al menos 120 Wh/kg y un voltaje mayor, de 4,2 V. Hay que tener en cuenta que las pilas alcalinas clásicas, las AA, solo ofrecen 1,5 V. Por eso las baterías de litio son tan compactas y los teléfonos móviles se han aligerado tanto.

El boom en la carrera investigadora de las baterías de litio se desató en los 70 a causa de la crisis del petróleo. Estaba claro que el ánodo perfecto tendría que ser de litio. Ahora faltaba descubrir el cátodo perfecto.

La primera batería de ion litio tenía un cátodo de sulfuro de litio y titanio (LixTiS2) que era capaz de acomodar en su interior los iones de litio que llegaban desde el ánodo. El ánodo era de litio metálico, y el electrolito era de LiPF6 disuelto en carbonato de propileno. En este electrolito el litio estaba protegido tanto del agua como del aire, ganando estabilidad. Así se lograban 2,5 V. La primera batería de litio comercial fue una evolución de esta, desarrollada por la empresa Exxon. En ella se usaba litio como ánodo, TiS2 como cátodo y perclorato de litio (LiClO4) disuelto en dioxolano como electrolito.

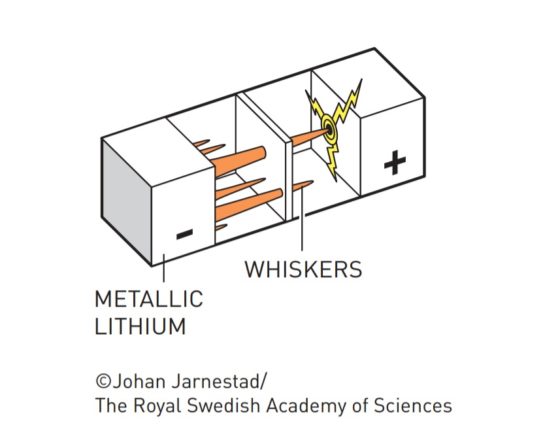

Dendritas («whiskers»). Fuente: nobelprize.org

Dendritas («whiskers»). Fuente: nobelprize.org

Pero se encontraron con un problema: cuando estas baterías se sobrecalentaban, llegaban a explotar. Descubrieron que lo que ocurría es que tras cada ciclo de carga y descarga se iban formando dendritas de litio que traspasaban la barrera de electrolito hasta llegar al cátodo, produciendo así un cortocircuito.

El problema parecía resolverse usando un ánodo diferente. En lugar de un sulfuro metálico, se probó con un óxido metálico, en concreto el dióxido de cobalto (CoO2) que, combinado con el litio se denomina óxido de cobalto-litio (LiCoO2). El LiCoO2 tiene un potencial de reducción tan alto, que ni siquiera hacía indispensable el uso de litio metálico puro como ánodo, sino que podría usarse otra sustancia que acomodase al litio de forma más estable y segura.

Batería Goodenough. Fuente: nobelprize.org

Batería Goodenough. Fuente: nobelprize.org

La respuesta llegaría en 1985 de la mano de la corporación japonesa Asahi Kasei. Descubrieron que el coque de petróleo —un sólido carbonoso derivado del refinado del petróleo— era capaz de acomodar al litio de forma muy eficiente. En muchos textos se le llama grafito. Es cierto que se le parece, pero no es exactamente grafito, sino un material de carbono que presenta dominios cristalinos grafíticos —en capas— y dominios no cristalinos. Entre unos y otros se acomodan los iones de litio.

Imagen: Litio en coque de petróleo. Fuente: nobelprize.org

Imagen: Litio en coque de petróleo. Fuente: nobelprize.org

En 1991, la empresa Sony, en colaboración con Asahi Kasei, sacaron a la venta la primera batería ion litio comercial con ánodo de óxido de cobalto-litio y cátodo de coque. El hecho de que los iones de litio entren y salgan ordenadamente en el ánodo y en el cátodo, forzados por las estructuras bidimensionales del coque y del óxido del cobalto, garantiza que las baterías apenas tengan efecto memoria. Es decir, las podemos cargar sin esperar a que se hayan descargado completamente sin miedo a que la batería se vicie.

En la actualidad se producen baterías de litio con cátodos todavía más eficientes. Como el cobalto es un elemento químico caro y relativamente escaso, el óxido de cobalto-litio se ha sustituido por el de fosfato de hierro-litio (LiFePO4) haciéndolas más baratas de producir. Se conocen como LFP, y adoptan estructuras cristalográficas diferentes. La de LFP con estructura tipo olivino es la que en la actualidad comercializa Sony. Puede durar 10 años si se carga a diario, cuando normalmente no sobrepasaban los 3-4 años. También tienen carga rápida, ya que en 2 h cargan el 95% de su capacidad.

En 2019 el desarrollo de las baterías de ion litio logró el Premio Nobel de Química repartido a partes iguales entre el alemán John B. Goodenough, el británico M. Stanley Whittingham, y el japonés Akira Yoshino. Whittingham fue quien lideró la investigación en la electrointercalación de iones de litio en disulfuros metálicos en los años 70. John Goodenough, que trabajó para Exxon, en los años 80 fue quien propuso la solución a que las baterías explotasen cuando se calentaban. Lo resolvió con el cátodo de óxido de cobalto-litio. Akira Yoshino, que trabajaba para la Corporación Asahi Kasei, en 1985 propuso el ánodo de coque.

La investigación actual en baterías de ion-litio se fundamenta en mejorar su eficiencia y el número ce ciclos de carga y descarga que pueden soportar. Se está experimentando con baterías de dióxido de carbono y litio, aunque hay expertos que aseguran que el futuro estará en el litio-grafeno.

Referencias:

They developed the world’s most powerful battery. Nobelprice.org.

Scientific Background on the Nobel Prize in Chemistry 2019 LITHIUM-ION BATTERIES. Nobelprize.org.

Baterías de iones litio, ¿cómo son?. Por Ignacio Mártil en CdeComunicación

Premio Nobel de Química 2019: Goodenough, Whittingham y Yoshino por las baterías de ión-litio. Por Francis Villatoro en La ciencia de la mula Francis.

Sobre la autora: Déborah García Bello es química y divulgadora científica

El artículo Así funcionan las baterías de litio se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Baterías de litio y oxígeno sólido

- Las baterías ion sodio, la alternativa estacionaria

- ADN para la nueva generación de baterías

Zirkoniozko material porotsu berriak: egitura sendoen bila

1. irudia: Zr-MOFek basamortuan uraren lorpena ahalbidetu dute. 2018. urtean,.

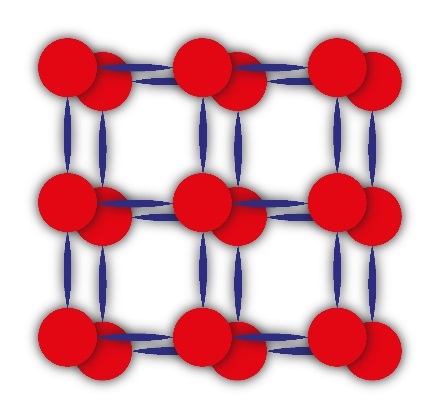

MOFak (ingelesez metal-organic frameworks) ordena handiko material hibrido porotsuak dira, metalez eta estekatzaile organikoz osatutako koordinazio-konposatuen sare hedatuak. Konposatu horietako sare-nodoak ioi metalikoz edo kluster metalikoz osatuta daude. Kluster horiei bigarren mailako eraikin-unitate deritze, edo SBU (ingelesez, secondary building units). Barruko metalaren arabera mota askotako SBUak daude, MOFen eraketan faktore determinatzailea izanik. Nodoen arteko konexioetan estekatzaile organikoak zubi gisa agertzen dira (nagusiki azido karboxilikoak), eta koordinazio-loturen bidez SBUekin lotuta geratzen dira. Antolamendu horren ondorioz porotasun iraunkorra duten sare irekiak sortzen dira, kristalezko esponja molekularrak antzekoak direnak.

2. irudia: Plastilinaz eta zotzez eratutako MOFa. (Irudia: Luz Fidalgo).

Hurrengo analogia hau argigarria izan daiteke. Demagun plastilina bolatxoak eta zotzak ditugula. Bolatxo batean 90 graduko angelua eratuz lau zotz sartuko ditugu eta zotz bakoitzari beste bolatxo bat gehituko dugu. Jarraian bolatxo bakoitean posizio berdinean beste hiru zotz kokatuko ditugu. Hiru dimentsioetan prozedura honi jarraituz, espazioan hedatzen den sare porotsu bat eratuko da, 1.irudian agertzen den moduan. Bolatxoak Zr-klusterrak badira eta zotzak ligando organikoak, horra hor gure Zr-MOFa!

Ikusgarriak dira eskaintzen dizkiguten aukerak bai metalari bai estekatzaile organikoari dagokienez. Hain aldakortasun handiak milaka konposatu sortzeko modua ematen du, eta CSD (Cambridge Structural Database) datu-basean 84000 mila MOFen egiturak agertzen dira. Konposatu horiek porotsuak izan daitezke beren bolumenaren % 90 arte, eta BET (Brunauer-Emmmett-Teller) azalera espezifikoari dagokionez, MOF bat azukre-koskor bat izatekotan sei futbol-zelaiei dagokiena izango litzateke. Harrigarria!

Azken urteotan, MOFen aurrerakuntza horrekin lotuta berezko arazoak ere ageri dira, haien artean ezegonkortasun kimikoa eta termikoa. Hori dela eta, propietate horiek areagotu nahian izugarrizko esfortzuak egin dira eta zientzialariak sendoagoak diren MOFen bila ari dira. Abiapuntua konposatu horietako loturek irmotasuna irabaztea da eta xede horretarako Zr(IV) MOFak baliagarriak izan daitezkeela egiaztatu dute.

Zirkonioak oxidazio-egoera, karga-dentsitatea eta eratzen dituen loturen polarizazioa altua du. Faktore horien ondorioz, Zr(IV)-aren eta karboxilato anioien artean afinitate handia sortzen da.

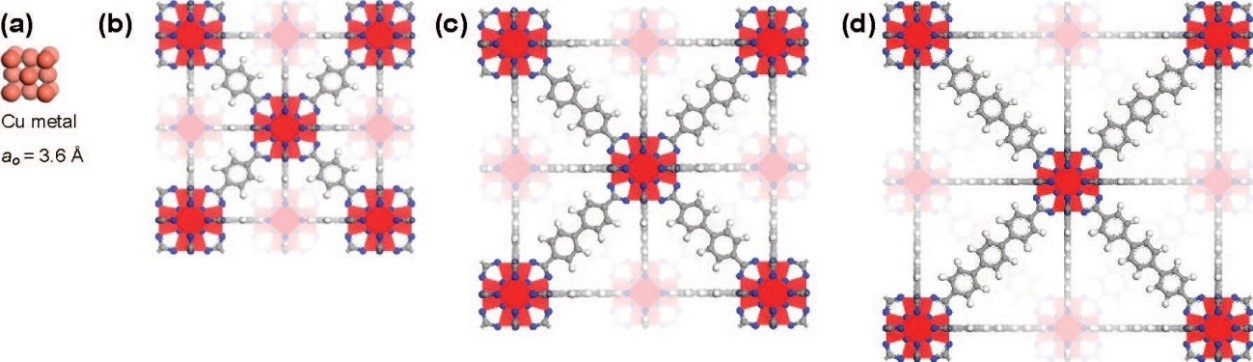

Zr-MOFen lotura honen sendotasunaren lehendabiziko froga 2008.urtean lortu zen, Osloko unibertsitateko Cavka eta lankideek Zr(IV)-MOFaren sintesi berria argitaratu zutenean. 2. irudian ikusten dira UiO-66, UiO-67 eta UiO-68 deritzen MOFak, guztietan SBU bera agertzen denez, Zr6(µ3–O)4(µ3–OH)4(CO2)12. Konposatu horiek guztiek ohiz kanpoko portaera dute. Beraren agerpenak iraultza bat ekarri zuen ikerkuntza-eremu honetara.

3. irudia: Zr(IV)-MOF a) Cu-aren gelaxka-unitatea; b) UiO-66-ren egitura; c) UiO-67-ren egitura; d) UiO-68-ren egitura. (Iturria: DOI: 10.1021/ja8057953)

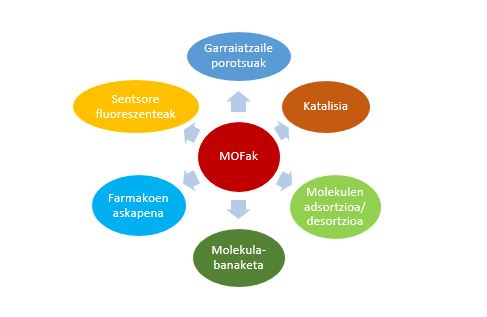

4. irudian azken urteotan izugarrizko garapena izan duten MOFen aplikazio batzuk ageri dira. Nanoteknologia arloan, ere, agertzen ari dira nano-MOF motako konposatuak.

4. irudia: MOFen zenbait aplikazio.

Ikerketa-talde askok Zr-MOFek duten propietateen artean adsortzioarekiko selektibotasuna azpimarratu dute. Adibidez, CO2/CH4 eta CO2/N2 nahasketekin egindako lana, negutegi-efektuan gas horiek duten eraginagatik.

Bestalde, Zr-MOFek basamortuan uraren lorpena ahalbidetu dute. 2018. urtean, Omar Yaghy eta lankideek garatutako gailuan, gaueko aire hezea adsortzioz eta egunean geroko kondentsazioz, 200mL MOF-Kg-tik eskuratu dute.

Azkenik, Zr-MOFak aplikazio biologikoetarako bereziki egokiak dira, bio-bateragarritasun bikaina baitute eta farmakoen askapenean erabiliak dira. Zalantzarik gabe, Zr-MOFak etorkizun handiko materialak dira.

Gehiago jakiteko:

- Chen, Zhijie, et al., (2019). Reticular chemistry in the rational synthesis of functional zirconium cluster-based MOFs. Coordination Chemistry Reviews 386 (2019) 32–49. DOI: https://doi.org/10.1016/j.ccr.2019.01.017

- Fathieh, Farhad, et al., (2018). Practical water production from desert air. Science. Advance, 4. DOI: https://doi.org/10.1126/sciadv.aat3198

- Aldizkaria: Ekaia

- Zenbakia: Ekaia 35

- Artikuluaren izena: Zirkoniozko material porotsu berriak: egitura sendoen bila.

- Laburpena: MOFak (ingelesez metal-organic frameworks) ordena handiko material hibrido porotsuak dira, ioi metalikoz eta estekatzaile organikoz osatutako koordinazio-konposatuen sare hedatuak. Azken urteotan, material porotsuek teknologiaren arloan izan duten interes handiak sustatuta MOF konposatuen aurrerakuntza handia izan da. Hala gertatzeko arrazoien artean berezko ezaugarri eta propietate interesgarriak daude, baita aplikazio ugari eta askotarikoak ere. Aurrerakuntza horrekin lotuta MOFen arazoak ere ageri dira, haien artean ezegonkortasun kimikoa eta termikoa. Hori dela eta, zientzialariok sendoagoak diren MOFen bila ari gara, eta, ildo horri dagokionez, Zr-MOFak adierazgarriak dira beren ohiz kanpoko portaeragatik. Zalantzarik gabe, etorkizun handiko materialak dira.

- Egileak: Luz Fidalgo Mayo.

- Argitaletxea: UPV/EHUko argitalpen zerbitzua.

- ISSN: 0214-9001

- Orrialdeak: 165-183

- DOI: 10.1387/ekaia.19546

————————————————–

Egileez:

Luz Fidalgo Mayo UPV/EHUko Farmazia Fakultateko Kimika Ez-Organikoa sailekoa da.

———————————————–

Ekaia aldizkariarekin lankidetzan egindako atala.

The post Zirkoniozko material porotsu berriak: egitura sendoen bila appeared first on Zientzia Kaiera.

Teselando el plano con pentágonos

Imagen: Osckar Espinosa / Pixabay

Imagen: Osckar Espinosa / Pixabay

Una teselación o mosaico del plano consiste en una serie de polígonos –las teselas o losetas– que lo cubren sin dejar zonas vacías, de manera que si dos teselas se tocan, lo hacen necesariamente lado con lado o vértice con vértice.

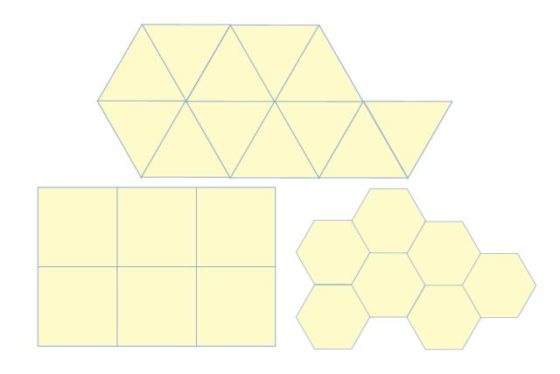

En su obra Harmonice mundi el astrónomo Johannes Kepler estudió qué polígonos regulares podían cubrir el plano. Es decir, se preguntaba si existen mosaicos que utilicen un polígono regular como única tesela base. La respuesta es sencilla: los únicos que existen son los mosaicos por triángulos, cuadrados y hexágonos regulares.

Teselando el plano con triángulos, cuadrados y hexágonos regulares. Imagen: Wikimedia Commons.

Teselando el plano con triángulos, cuadrados y hexágonos regulares. Imagen: Wikimedia Commons.

¿Por qué no hay más? Por ejemplo, en el caso del pentágono regular, su ángulo interno es de 108 grados. Si deseáramos teselar el plano con pentágonos regulares, los vértices de dos losetas colindantes deberían tocarse sin dejar ningún hueco. Pero esto imposible, ya que 360 no es divisible por 108. De otra manera, si colocamos pentágonos regulares alrededor de un vértice, se observa en seguida que solo pueden colocarse tres, pero queda un espacio que no puede cubrirse con pentágonos.

Recordemos que un polígono regular de n lados posee ángulos internos de 180(n-2)/n grados. Así, para polígonos con siete o más lados, el ángulo interior es mayor que 120 grados pero menor que 180, con lo que llegamos a la misma conclusión que con el pentágono. Es decir, el triángulo, el cuadrado y el hexágono (regulares) son los únicos polígonos regulares cuyos ángulos internos (60 grados, 90 grados y 120 grados, respectivamente) son divisores de 360 grados.

En el estudio de mosaicos podríamos proseguir preguntarnos qué sucede al mezclar varios polígonos regulares para cubrir el plano –teselaciones semirregulares, de estos solo hay ocho–, o al usar una única pieza no regular, o al utilizar varias no regulares. Estos problemas no son sencillos de resolver. Cuando su estudio comenzó a sistematizarse llevó al desarrollo de técnicas matemáticas complejas aplicadas al estudio de teselaciones del plano (y del espacio) que después han encontrado utilidad en otros campos.

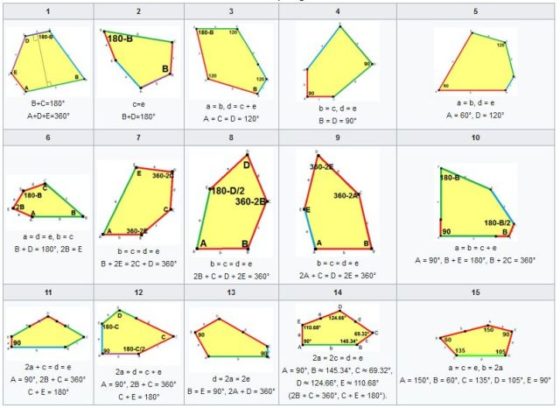

Vamos a elegir uno de estos problemas tomando el pentágono como pieza clave. La pregunta que nos planteamos es: ¿se puede teselar el plano con un único pentágono (convexo) no regular? La respuesta es que se puede, y además existen solo quince maneras de hacerlo –parece casi seguro que esta es la cantidad, aunque está en fase de revisión–.

Los quince tipos de pentágonos convexos que teselan el plano. Se denotan con letras minúsculas los lados de cada pentágono a, b, c, d, e y con letras mayúsculas los ángulos internos. Imagen: Wikimedia Commons.

Los quince tipos de pentágonos convexos que teselan el plano. Se denotan con letras minúsculas los lados de cada pentágono a, b, c, d, e y con letras mayúsculas los ángulos internos. Imagen: Wikimedia Commons.

Citamos a continuación a las personas que han descubierto estas quince clases de pentágonos: Karl Reinhardt(1895-1941)encontró cinco en 1918 (ver [1]);Richard B. Kershner (1913-1982) halló tres más en 1968 (ver [2]); Richard James descubrió el noveno tipo en 1975 tras leer un artículo de Martin Gardner sobre teselaciones pentagonales en la revista Scientific American; ese artículo también inspiró a Marjorie Rice (1923-2017) quien halló otros cuatro tipos en 1976 y 1977 (ver [3] y [4]); Rolf Stein (ver [5]) encontró el decimocuarto tipo de pentágono en 1985; y en 2015 Casey Mann, Jennifer McLoud y David Von Derau descubrieron una nueva clase (ver [6]) con ayuda de un programa informático.

El 1 de mayo de 2017 Michaël Rao anunció (ver [7]) que había realizado una prueba asistida por ordenador en la que demostraba que estos quince pentágonos convexos eran los únicos que teselaban el plano con un único tipo de loseta. La parte computacional de su demostración ha sido revisada y no contiene errores, aunque aún no se ha publicado la prueba definitiva revisada por pares.

De este grupo de personas, algunas no son matemáticas. Richard James es informático y Marjorie Rice matemática aficionada. Ambos se enamoraron de este problema leyendo el artículo de Martin Gardner indicado anteriormente. Y emprendieron su búsqueda en solitario.

El caso de Marjorie es muy especial: aunque no tenía formación en matemáticas, desarrolló su propio sistema de notación para representar las restricciones y las relaciones entre los lados y ángulos de los pentágonos que estaba intentando encontrar. Fue la matemática Doris Schattschneider quien descifró la notación de Marjorie Rice y quien se ocupó de difundir sus descubrimientos entre la comunidad matemática. En la página Intriguing Tesselations, Marjorie Rice mostraba con orgullo sus descubrimientos y algunos mosaicos decorativos que diseñó a partir de ellos. ¡Admirable!

Referencias:

[1] Karl Reinhardt.Über die Zerlegung der Ebene in Polygone, Dissertation Frankfurt am Main (1918), páginas 77-81

[2] Richard Kershner. On paving the plane, American Mathematical Monthly 75 (8) (1968) 839-844

[3] Doris Schattschneider.Tiling the plane with congruent pentagons, Mathematics Magazine 51 (1) (1978) 29-44

[4] Marjorie Rice. Tesselations, Intriguing Tesselations

[5]Doris Schattschneider. A new pentagon tiler, Mathematics Magazine 58 (5) (1985) 308

[6] Casey Mann, Jennifer McLoud-Mann, David Von Derau, Convex pentagons that admit i-block transitive tilings. arXiv:1510.01186(publicado posteriormente en Geometriae Dedicata 194 (2018)141-167)

[7] Michael Rao.Exhaustive search of convex pentagons which tile the plane. arXiv:1708.00274

[8] Natalie Wolchover. Pentagon Tiling Proof Solves Century-Old Math Problem. Quanta Magazine, 11 julio 2017

[9] Pedro Alegría. El caso de los 14 pentágonos que embaldosan un espacio infinito. ABC Ciencia, 10 abril 2017

[10] Teselados pentagonales, Wikipedia [consultado 15 febrero 2020]

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo Teselando el plano con pentágonos se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El teorema de los cuatro colores (2): el error de Kempe y la clave de la prueba

- Shizuo Kakutani y sus teoremas

- La característica de Euler de una superficie: un invariante topológico

Eskuak ondo garbitzea, gaitz infekziosoen aurkako gakoetako bat

Komun publiko batetik atera berritan bazaude eta, doktoretza tesia egiteko adinean egon daitekeen gazteren bat ikusten baduzu, libreta eskutan, zertan ari zaren kuxkuxeatzen eta gaizki disimulatzen, ez haserretu. Edo, behintzat, ez moskeatu gehiegi. Kontuan izan agian ikertzaile bat izan daitekeela, gizateria salbatu nahian. Ados, bai, agian hau gehiegi esatea da. Gizateria salbatzen lagundu nahian, akaso.

Kuxkuxeroaren helburua zure portaera behatzea izan daiteke. Zertarako, bada? Ba, jakiteko ea, behin heldutasunera iritsita, gurasoek txikitan behin eta berriz gogorarazten zizuten agindu hori benetan jarraitzen ote duzun: “Komunetik ateratzean, arren, ondo garbitu eskuak”.

1. irudia: Argi dago eskuen garbitze soilarekin ez dagoela modurik gaitz baten zabalkuntza nazioartean ekiditeko, baina ikertzaileek uste dute oso lagungarria izango litzatekeela garbiketa-tasak handitzea. (Argazkia: Dan Watson/Unsplash)

Ez da soilik arreta erakartzeko kazetariek erabiltzen duten amu txotxolo horietako bat. Era horretako ikerketak egin egiten dira. 2003an, esaterako, halako behaketa baten gaineko emaitzak argitaratu zituzten, mikrobiologiari buruzko kongresu batean. AEBtako aireportuetan egindako ikerketa izan zen. New York, Chicago, San Francisco, Dallas, Miami eta Toronto hirietako aireportuetan 7.541 lagunen portaera aztertu zuten. Eta emaitzek berretsi zutenez, benetako datuak eskuratzeko, galdetzea baino, beharrezkoa da zuzenean begiratzea. Aurreko ikerketetan ikusia zuten jendeari galdetuz gero %95ek esaten zutela baietz, eskuak garbitzen zituztela, baina benetan soilik %67k egiten zuten. 2003ko azterketa horretan, SARS gaitzaren zabalkuntza puri-purian zegoenean, behaketetan eskuratutako datuak hobeak izan ziren: ikusi zuten %78k hori benetan egiten zutela. Sexuaren arabera, emakumezkoak (%83) gizonezkoak (%74) baino txukunago aritu ziren.

Ikerketa horiek aireportuetan egiteak badu arrazoi garrantzitsu bat: nodo baten modura funtzionatzen dute. Bai airelineatarako, pertsonentzako… zein birusetarako ere. Aireportuetan leku askotako lagunak elkartzen dira eta, normala denez, objektu desberdin asko ukitzen dituzte: aulkietako beso-euskarriak, segurtasun-kontroletan objektu pertsonalak uzteko erabiltzen azpilak edota ateetako heldulekuak, esate baterako.

Hori guztia kontuan hartuta, azpiegitura horietan higienea handitzearen garrantzia nabarmendu dute ikerketa berri batean. Massachusettseko Teknologia Institutuko ikertzaileek Risk Analysis aldizkarian proposatu dutenez, munduko hamar aireportutan eskuak garbitzeko tasa handitze soilarekin, gaitz biral baten zabalkuntza asko murriztuko litzateke.

Dena dela, garbiketa horrek egokia izan behar duela azaldu dute. Izan ere, eskuak garbitzen dituztenen artean ere, askok ez dute ondo egiten. Ondo egiteko, gomendatzen da ura eta xaboia erabiltzea, 15-20 segundo inguruz eskuak igurtziz. Halere, askok ura baino ez dute erabiltzen. Germenen propagazioa ekiditeko, gainera, gutxienez ordubetean behin egin behar dela diote. Eta oraingoan aipatu ez badute ere, aurreko ikerketa batek agerian utzi zuen garbitzeaz gain garrantzitsua dela ere eskuak ondo lehortzea.

Hortaz, kalkulatu dute aireportuetan dabiltzan bidaiarien %20k baino ez daramatzatela eskuak ondo garbituta. Bada, munduko aireportu guztienetan kopuru hori hirukoiztuz gero –ondo garbitutako eskuak dituzten bidaiarien kopurua %60ra pasata–, horrek lortuko luke mundu mailan gaitzaren propagazio-maila ia %70 atzeratzea.

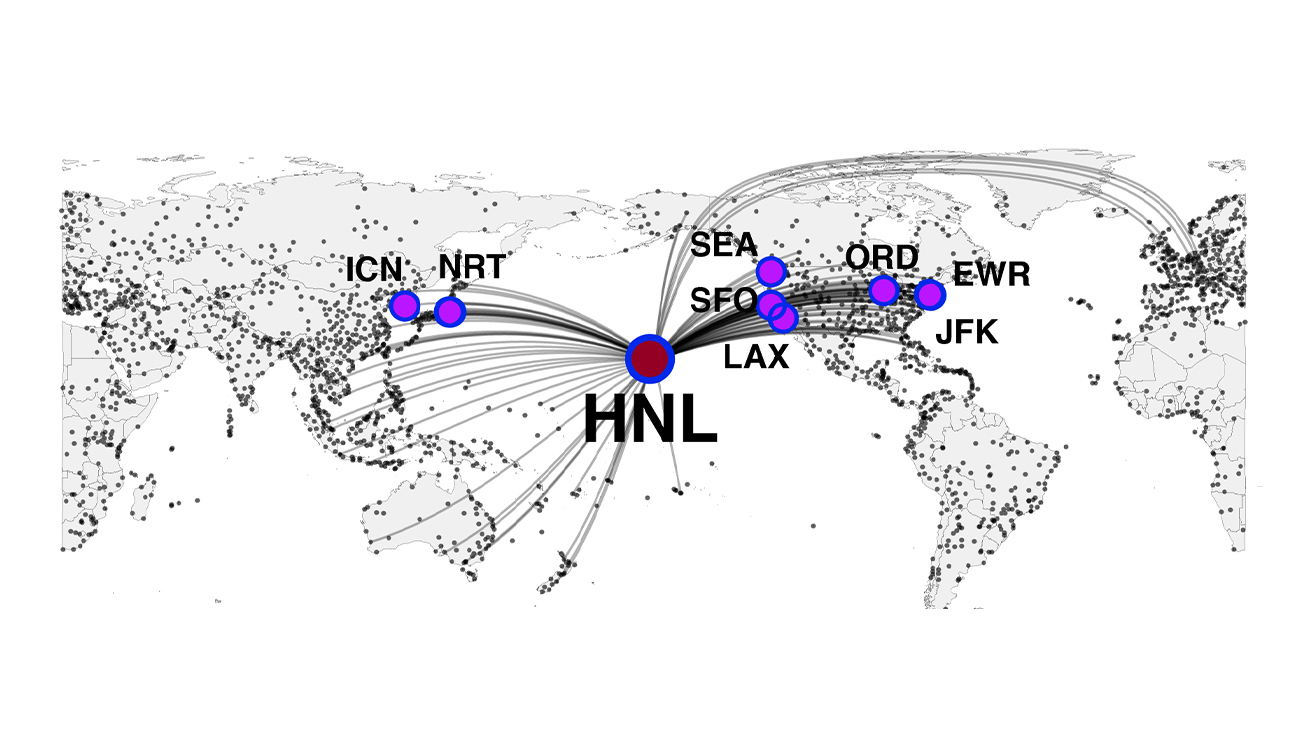

2. irudia: Munduko hainbat aireporturen kokapena eta beste aireportuekiko loturak aztertu dituzte, eta ikusi dute faktore horiek trafiko-kopurua baino garrantzitsuagoak direla gaitzen zabalkuntzari dagokionez. Irudian, Honoluluren adibidea. (Irudia: Nicolaides et al./Risk Analisys)

Halako neurri bat munduko aireportu guztietan ezartzea zaila litzatekeela aitortuta, kalkulatu dute noraino lagunduko lukeen horrelako garbitze-tasak munduko hamar aireportutan lortzeak. Gaitzen zabalkuntza %37 atzera litekeela ondorioztatu dute. Aireportu horien aukeraketa, gaitz infekziosoaren hasierako agerraldiaren jatorriaren arabera egin beharko litzateke. Wuhango koronabirusaren gorakada baino lehenago egindako ikerketa izan arren, egileek diote azken krisi honetan ere aplikagarri direla ondorioak, kutsagarria den edozein gaitzi dagokiolako.

Epidemiologia ereduetan eta datuetan oinarritutako simulazioak baliatu dituzte ikerketa egiteko. Besteak beste, nazioarteko hegaldien inguruko datuak, aireportuetan izaten diren itxarote-tasak eta pertsonen arteko zein pertsonen eta objektuen arteko elkarrekintzei buruzko balioespenak kontuan hartu dituzte, eta baita historikoki izurriteek izan duten bilakaeraren inguruan aurreko ikerketek esan dutena ere.

Higiene neurriak indartzeko, gaiari buruzko komunikazio kanpainen beharra azpimarratu dute. Egin duten beste kalkulu baten arabera, munduko aireportu guztietan eskuen garbitze-tasa %10 handituz gero, nazioarteko gaitz infekziosoen zabaltzea %24 murriztuko litzateke.

Ikertzaileek identifikatu dituzte munduan gaitzen zabalpenean eragin handiena izan dezaketen 120 aireportuak, eta ikusi dute ez direla izan behar, halabeharrez, trafiko gehien dutenak. Kokapena ere garrantzitsua izan daiteke. Tokio (Japonia) eta Honolulu (AEB) jarri dituzte adibidetzat. Hurrenez hurren, trafikoari dagokionez 46. eta 117. postuetan daude, baina euren kokapena eta bertan izaten diren loturak direla eta, garrantzi nabarmena izan ahal dute nazioarteko gaitz infekziosoen zabalkuntzan.

Erreferentzia bibliografikoa:

Nicolaides, C., Avraam, D., Cueto‐Felgueroso, L., González, M.C. and Juanes, R. (2020). Hand‐Hygiene Mitigation Strategies Against Global Disease Spreading through the Air Transportation Network. Risk Analysis. doi:10.1111/risa.13438

———————————————————————————-

Egileaz: Juanma Gallego (@juanmagallego) zientzia kazetaria da.

———————————————————————————-

The post Eskuak ondo garbitzea, gaitz infekziosoen aurkako gakoetako bat appeared first on Zientzia Kaiera.

El principio de complementareidad

Foto: Leonardo Yip / Unsplash

Foto: Leonardo Yip / UnsplashLa mecánica cuántica se fundó sobre la existencia de la dualidad onda-corpúsculo de la luz y la materia, y el enorme éxito de la mecánica cuántica, incluida la interpretación de probabilidad, parece reforzar la importancia de esta dualidad. Pero, ¿cómo puede considerarse un corpúsculo como que «realmente» tenga propiedades de onda? ¿Y cómo puede pensarse que una onda tenga «realmente» propiedades de corpúsculo?