Virus en el sistema de publicaciones científicas

Joaquín Sevilla, Alberto Nájera López y Juan Ignacio Pérez Iglesias

Unsplash/Vlad Kutepov, CC BY-SA

Unsplash/Vlad Kutepov, CC BY-SAEl sistema de publicaciones científicas afronta una situación tan comprometida a causa de la COVID-19 que podría acabar desembocando en su transformación. No sería prudente hacer predicciones acerca de la forma en que se comunicarán los resultados científicos cuando la pandemia haya pasado, pero no cabe descartar ninguna posible evolución. La situación que atraviesa el sistema es de verdadera crisis.

El camino habitual para comunicar resultados científicos consiste en publicarlos en revistas especializadas. Para ello, una propuesta de artículo ha de pasar un proceso, generalmente lento, de revisión por pares. Durante este, otros especialistas en el campo, ajenos a los autores y anónimos para ellos, juzgan su calidad y lo aceptan, rechazan o proponen cambios.

Este proceso ganó peso a lo largo del siglo XX (aunque a Einstein no le gustaba nada) y hoy es un elemento inexcusable de una revista científica de calidad.

Publica o perece

En los últimos años el sistema de publicaciones científicas está sufriendo unas tensiones enormes. Por un lado, el progreso en la carrera científica se basa cada vez más en las publicaciones. Esto ha generado una práctica, condensada en la máxima “publica o perece”, que revela una preocupante confusión entre fines y medios.

Por otro, la irrupción de internet ha transformado el sistema de acceso y manejo de la información científica. La presión generada por las redes ha modificado drásticamente el mercado de todos los productos susceptibles de digitalizarse (música, cine, series y periódicos). A pesar de los cambios, el sistema de publicaciones científicas mantiene una estructura análoga a la que vivió Einstein.

Este contraste entre la transformación del sistema de acceso a los contenidos y el mantenimiento de la estructura editorial genera fuertes tensiones, hasta el punto de que se habla incluso de que “la máquina de hacer ciencia está rota”.

Las tensiones afloran por muchos sitios, lo que da lugar a problemas preocupantes y a diversos “males de la ciencia”. Hay una crisis de revisores, pues cada vez menos científicos están dispuestos a dedicar su tiempo a una labor ingrata, que no reporta ningún beneficio directo (ni económico ni de reconocimiento). Ante esto, muchos editores han optado por pedir a los propios autores que sugieran revisores, cosa que ha dado lugar a comportamientos fraudulentos.

Los conflictos de intereses entre autores y revisores son un problema intrínseco del sistema, pero que se ve agravado por las presiones. La importancia que para el sistema de ciencia tienen las editoriales de las revistas consideradas de prestigio hace que se comporten como un cartel, manteniendo unos precios y sistemas de tarificación que están provocando la cancelación de la suscripción a revistas por países enteros.

Éramos pocos y llegó el SARS-CoV-2

La pandemia de COVID-19 bien pudiera ser el elemento que abra la grieta definitiva en un sistema de publicaciones científicas ya tensionado y aquejado, como hemos visto, de diversos problemas serios.

Una de las características más obvias de la revisión por pares es que es lenta. Por rápido que se quiera hacer, desde que se envía un trabajo, es aceptado para su revisión, tres especialistas lo leen y consensuan su juicio para, finalmente ser aceptado (o rechazado), es difícil que pase menos de un mes. Ese tiempo, que puede ser razonable en condiciones normales, es una eternidad en tiempos de pandemia. La investigación, en estado de frenética actividad, no puede esperar semanas para conocer lo que otros equipos están haciendo, máxime cuando el valor que en realidad aporta la revisión al producto final tampoco es esencial.

No solo se retrasan los artículos científicos que podríamos denominar “estándar” con resultados experimentales, sino también otro tipo de contribuciones que permiten enriquecer el desarrollo científico, como son las cartas, comentarios, editoriales y perspectivas. Muchas revistas, ante la imposibilidad de atender todas las propuestas, han limitado su número o no los aceptan. Alguna, incluso, indica que este tipo de contribuciones se harán por iniciativa propia de la revista o consejo editorial, limitando mucho el acceso a ese tipo de formatos a la comunidad científica.

Esta situación conduce a que la comunidad científica que investiga el SARS-CoV-2, en todos sus ámbitos, genere conocimiento mucho más rápido de lo que el sistema editorial puede asimilar. Por eso se ha visto obligado a buscar alternativas.

El papel ¿mojado? de la prepublicación

En una sociedad donde la comunicación no tiene límites, la científica no puede verse encorsetada por un mundo editorial incapaz de dar respuesta en tiempo y forma. Así que muchos autores se han visto obligados a acudir a plataformas de prepublicaciones (preprints) como ArXiv, medRxiv, bioRxiv, Queios y OSFpreprints para dar a conocer los resultados de sus investigaciones.

Son sitios web donde los autores publican sus artículos para que se puedan leer mientras son revisados en las revistas. Esos sitios existen desde hace décadas y se crearon originalmente para mitigar el problema de posibles robos de ideas por parte de revisores poco éticos. Algunos ponen algunas limitaciones y un consejo “editorial” hace de filtro, otros son mucho más flexibles. Casi todos ofrecen la asignación de un DOI (Digital Object Identifier) que permite identificar el contenido, de forma similar al ISBN.

Algunos de estos espacios permiten que otros científicos, previa acreditación con su ORCID (Open Researcher and Contributor ID“ o «Identificador Abierto de Investigador y Colaborador” en español) discutan y revisen públicamente el contenido de la contribución. El número de científicos que pueden “revisar” un artículo será muchísimo mayor que el ofrecido por un sistema de revisión por pares. ¿Estamos ante un cambio de paradigma hacia una verdadera y plena Open Science?

Quizás lo estemos, pero hay que ser cautelosos. En estos días de ciencia frenética, la gran demanda social de conocimiento hace que estudios de bajísima credibilidad adquieran una importante relevancia pública. Por esa razón, en cualquier caso, cualquier alternativa a la revisión por pares a priori deberá garantizar una mínima calidad de lo que se publique.

Situaciones desesperadas requieren medidas desesperadas

El poner una prepublicación en un repositorio público antes de su aceptación formal no implica que la publicación tenga la misma validez de un artículo en una revista de prestigio. Pero ¿acaso la comunidad científica necesita el dictamen de consejos editoriales y revisores para decidir qué es científicamente aceptable o no? Son unas normas y manera de funcionar tradicionales que, por diversas razones, parecen hacer aguas en una situación de emergencia como la que vivimos.

Una prepublicación solo reconoce, de alguna manera, la autoría de una idea. Algo así como colocar el trabajo en la “pole” en una carrera, pero que, al final, podrá ganar otro si se publica antes. Algunos científicos están prefiriendo compartir sus resultados o ideas para que contribuyan al conocimiento lo antes posible, antes que recibir ese reconocimiento de un “aceptado” editorial porque saben que, por encima del curriculum vitae, estamos hablando de vidas.

La pregunta de si nos encontramos ante un nuevo paradigma no tiene una respuesta fácil. Pero no debemos descartar que la situación actual alumbre un nuevo modelo de comunicación de los resultados de la investigación. Más de una vez ha ocurrido a lo largo de la historia que un sistema débil ha perdurado en el tiempo, por inercia, en tanto no ha habido amenazas exteriores que forzasen su transformación o sustitución. Podemos estar en una coyuntura similar. Es posible que la gran cantidad de información generada con motivo de la pandemia sea la amenaza que acabe propiciando la transformación del sistema de publicaciones científicas. Su crisis sería por tanto, la antesala de un nuevo sistema.![]()

Sobre los autores:Joaquín Sevilla responsable de divulgación del conocimiento y profesor de tecnología electrónica en la Universidad Pública de Navarra; Alberto Nájera López es profesor contratado doctor de radiología y medicina física en la Universidad de Castilla-La Mancha; Juan Ignacio Pérez Iglesias es catedrático de fisiología en la Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Virus en el sistema de publicaciones científicas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Hacia un nuevo sistema de publicaciones científicas

- Las publicaciones científicas

- #Naukas14 Acceso abierto a las publicaciones científicas

Homeostasis y crisis del coronavirus

Juan Luis Arsuaga y María Martinón-Torres

maradon 333 / shutterstock

maradon 333 / shutterstockHomeostasis es una palabra poco común, que se utiliza en biología, pero que podría ser útil en el contexto de la epidemia que estamos padeciendo. La homeostasis tiene que ver con el equilibrio y a la vez con el desequilibrio. Nos habla, en definitiva, de un desequilibrio equilibrado, o de un desequilibrio estable. La vida es una pura paradoja.

El ser humano ha tenido siempre la sensación de vivir en un mundo estable. Nunca sucede nada y las montañas no cambian de sitio. Y es cierto, pero solo a la escala de la generación humana. Hubo un tiempo en que esas montañas que sostienen el horizonte fueron el fondo de un mar, o una gigantesca cámara de magma subterráneo.

Tampoco los continentes han estado jamás quietos. En realidad siguen moviéndose. La tierra se separa, se junta, se quiebra. Se trata de fenómenos geológicos, movidos por fuerzas gigantescas que operan en el interior de la Tierra, donde se encuentra la caldera de su motor. También el clima ha cambiado, y de eso sí alcanzamos a ser testigos. Hace solo un siglo, los glaciares se extendían mucho más que ahora. Lo podemos comprobar en postales antiguas. Sin saberlo, nuestros abuelos y bisabuelos vivían al final de una pequeña glaciación.

Pero la realidad es que tampoco hay estabilidad en biología, a ninguna escala. Las especies están permanentemente enfrentadas a crisis, no conocen otro tipo de existencia. Podríamos afirmar que los seres vivos están siempre sufriendo una crisis o recuperándose de ella. Podríamos ir más allá y asegurar que una especie está continuamente a punto de extinguirse. La extinción consiste, simplemente, en no haber sido capaz de superar la última crisis.

La vida consiste en resolver problemas

En esa lucha continua, los organismos, como individuos, tampoco dejan de estar sometidos a tensiones. El filósofo Karl Popper acertó con su definición de la vida: consiste en resolver problemas. Los minerales y los muertos no tienen problemas que puedan resolver y por eso nunca cambian. Nuestros átomos cambian, nuestras moléculas cambian, nuestras células cambian, pero nosotros permanecemos.

Y es aquí donde entra la palabra homeostasis. Homeostasis es la capacidad de un organismo de reajustarse después de una grave alteración. Los organismos viven en equilibrios dinámicos, no estáticos. El acueducto de Segovia está en equilibrio estático, arquitectónico. Si se cae un solo pilar se hunde una parte de la canalización y el agua deja de circular, con lo que el acueducto se vuelve inútil por completo. No hay forma de que el propio acueducto segregue un nuevo pilar. El equilibrio (o el desequilibrio) constante es inherente a estar vivo.

Así, una bacteria es un sistema muy complejo, con numerosas estructuras internas bien diferenciadas que se reparten el trabajo. Cualquier célula de nuestro cuerpo es todavía más compleja, y la complejidad será mayor en los tejidos, en los órganos y en lo que en biología se denominan propiamente los sistemas, tales como el sistema respiratorio, el nervioso, el circulatorio, el locomotor, el inmune, el digestivo, el reproductor o el excretor. Finalmente, el individuo (una planta, un animal, una persona) es un sistema de sistemas de sistemas de sistemas. Pero no acaba ahí.

Por encima del individuo está el sistema social que los filósofos, a partir de Platón, han comparado con un organismo biológico. También el cuerpo social tiene homeostasis y eso es lo que, precisamente, le permite superar las crisis. En contra de lo que suele pensarse, la caída de un imperio, como el romano de Occidente (no el de Oriente) o el maya, no se produjo por una crisis única, sino por una serie de perturbaciones encadenadas y muy seguidas a las que el imperio no pudo hacer frente. La resiliencia consiste, simplemente, en recuperarse lo bastante rápido como para que la siguiente perturbación nos pille en equilibrio.

Otras crisis vendrán

El coronavirus ha provocado una crisis sanitaria, económica y social que superaremos sin ninguna duda. Otras crisis vendrán en el futuro y probablemente serán muy distintas, porque habremos aprendido a prevenir esta y otras parecidas. Como no podemos adivinar la naturaleza del siguiente embate, lo único que nos queda es reforzar la homeostasis de nuestra sociedad, que es cada vez más global.

Eso no quiere decir que debamos permanecer estáticos, sino todo lo contrario. Se trata de mejorar nuestra capacidad de alcanzar equilibrios dinámicos que permitan afrontar cualquier perturbación sin perder la estabilidad. No es cuestión de imitar a los acueductos romanos, sino a los organismos biológicos.

En su monumental “La montaña mágica”, Thomas Mann recoge en boca del joven Hans Castorp la definición de la vida como una “fiebre de la materia” que se balancea en precario equilibrio “dentro de este complejísimo y febril proceso de descomposición y renovación”. Nuestra sociedad aun herida, está viva. Tras los golpes, de los objetos inanimados solo quedan añicos; a los seres vivos les salen cicatrices.

Y esa es la lección política, en el mejor sentido de la palabra, que podemos extraer de la crisis del COVID-19. La homeostasis solo se logra si el organismo está bien organizado, si no incuba en su seno distorsiones que lo hagan inestable. Superaremos esta crisis, y la siguiente, y la siguiente, y la siguiente, si nos preocupamos ahora de reducir los desajustes internos en educación, salud, medio ambiente, democracia, riqueza, cultura, ciencia, justicia, solidaridad y sensibilidad.

Homeostasis es, por lo tanto, la palabra oportuna. Si nuestra sociedad mantiene sus equilibrios internos, es seguro que sobrevivirá a todas las crisis. Preocupémonos de que la cuerda sobre la que hacemos equilibrios no sea demasiado floja.![]()

Sobre los autores: Juan Luis Arsuaga, es catedrático de paleontología de la Universidad Complutense de Madrid, y trabaja en el Centro Mixto ISCIII-UCM de Evolución y Comportamiento Humanos y en el Museo de Evolución Humana de Burgos; María Martinón-Torres es directora del CENIEH, Centro Nacional de Investigación sobre la Evolución Humana (CENIEH).

Este artículo fue publicado originalmente en The Conversation. Artículo original

El artículo Homeostasis y crisis del coronavirus se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- De la homeostasis

- El coronavirus de Wuhan, ¿qué sabemos hasta ahora?

- La oreja de oso, una joya del Pirineo que guarda el secreto de la resurrección

Nahúm Méndez Chazarra – Naukas Bilbao 2019: Marcianos, extraterrestres y la zona habitable

Foto: Daniel Olah / Unsplash

Foto: Daniel Olah / UnsplashConforme se han ido descubriendo exoplanetas el concepto de zona habitable a aparecido cada vez más en los titulares de prensa. Sin embargo, la zona habitable es un término mucho más relativo de lo que solemos pensar. Nahúm Méndez explica en apenas diez minutos todos los matices que encierra.

.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Nahúm Méndez Chazarra – Naukas Bilbao 2019: Marcianos, extraterrestres y la zona habitable se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Naukas Bilbao 2017 – Álex Méndez: Luz de luna

- José Ramón Alonso – Naukas Bilbao 2019: Son nuestros amos y nosotros sus esclavos

- Naukas Bilbao 2017 – Déborah García Bello: Saboer

El rojo y los cambios climáticos

La Sala Roja de la cueva de Goikoetxe. Foto: G.E. ADES

La Sala Roja de la cueva de Goikoetxe. Foto: G.E. ADESEn muestras tanto geológicas como arqueológicas el color rojo suele deberse a la presencia de distintos óxidos de hierro, que tiñen de manera muy intensa minerales y rocas. Sin embargo, “en el caso de las estalagmitas de la Cueva de Goikoetxe, localizada en la Reserva de la Biosfera de Urdaibai, el color rojo se debe a la presencia de sustancias orgánicas derivadas de la descomposición de la cobertura vegetal en los suelos situados encima de la cueva”, señala Virginia Martínez Pillado, investigadora del departamento de Mineralogía y Petrología de la UPV/EHU. La intensidad del color rojo de las estalagmitas serviría, por tanto, de registro para determinar cambios climáticos.

“En toda la zona de la cornisa cantábrica existe mucha precipitación y vegetación, por lo que se crea una gran cobertura vegetal encima de la cueva; cuando dicha vegetación se degrada estas sustancias orgánicas, fundamentalmente ácidos húmicos y fúlvicos, son arrastradas al interior de la cueva por el agua de la lluvia, y tiñen de rojo los espeleotemas al incorporarse a la red de la calcita que los forma”, explica Virginia Martínez Pillado.

Los investigadores han combinado diferentes técnicas de análisis sobre varias estalagmitas de diferentes coloraciones, como la datación radiométrica por series de uranio, la petrografía, la fluorescencia de rayos X, la espectroscopía y la luminiscencia con luz ultravioleta. “Para la realización de los análisis se han utilizado dos técnicas espectroscópicas llamadas Raman y FTIR que sirven para la identificación de diferentes tipos de moléculas y compuestos. Estas técnicas han sido las que han determinado la presencia de compuestos orgánicos derivados de la degradación de materia vegetal en el interior de las estalagmitas”, indica Martínez Pillado.

Además, “hemos realizado fotografías mediante luz ultravioleta a las mismas estalagmitas, y la respuesta de la calcita frente a la radiación ultravioleta ha mostrado ser cíclica. Es decir, dentro de las estalagmitas rojas, únicamente en las rojas —subraya la investigadora— han aparecido ciertos ciclos en los que hay mayor y menor incorporación de las substancias orgánicas; en los momentos que hay mayor incorporación orgánica parece ser que hay una cobertura vegetal muchísimo más densa. Probablemente sea porque hay una mayor cantidad de precipitaciones, aunque esto es algo que aún habría que estudiar más en profundidad”. Lo que sí está claro es “que la cobertura vegetal y la producción de suelos es muchísimo más intensa en ciertos momentos que en otros a lo largo de todo el Holoceno medio, entre hace 7.000 y 5.000 años, y esto está estrechamente ligado a las condiciones climáticas del exterior de la cueva”.

Estos ciclos detectados, relacionados con el llamativo color rojo, han permitido a los investigadores comenzar nuevas investigaciones para reconstruir la evolución climática en la costa cantábrica en ese periodo.

Referencia:

V. Martínez-Pillado, I. Yusta, E. Iriarte, A. Álvaro, N. Ortega, A. Aranburu, J.L.Arsuaga (2020) The red coloration of Goikoetxe Cave´s speleothems (Busturia, Spain): An indicator of paleoclimatic changes Quaternary International (2020) doi: 10.1016/j.quaint.2020.04.006

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo El rojo y los cambios climáticos se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Los efectos climáticos de un calentamiento sin precedentes en el Mediterráneo

- Verdín, eucaliptos y cambio climático

- El ocre rojo de la antigüedad y los porqués de sus propiedades

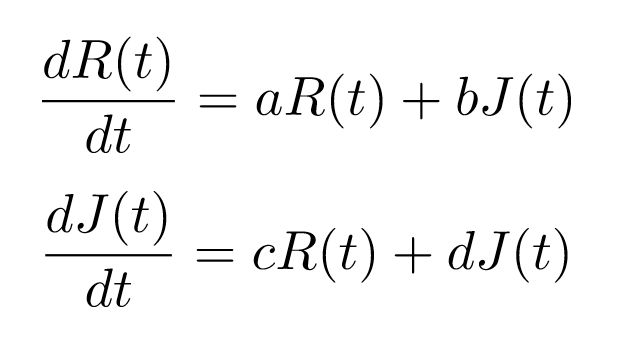

El cuadrante Pasteur español y el efecto Dreadnought

Xabier Irigoien

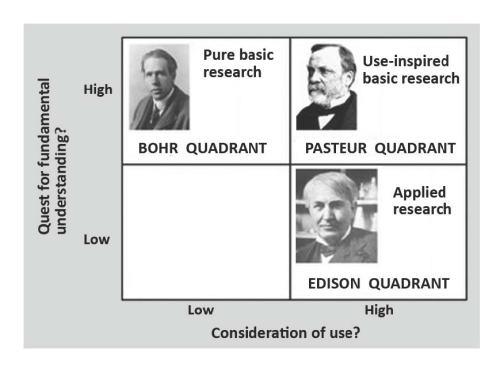

Todo gestor científico conoce el cuadrante Pasteur, y lo usa en sus presentaciones. Arriba a la izquierda, ilustrada por Bohr y la física cuántica, está la ciencia básica que hacemos para entender la naturaleza, que quizás tenga aplicación algún día pero no es obvia cuando se empieza. Arriba a la derecha, están Pasteur y las vacunas, investigación básica pero ya orientada a un objetivo. Y abajo a la derecha queda Edison, investigación aplicada, con un claro producto como objetivo. A todos los gobiernos del mundo el cuadrante que más les gusta es el de abajo a la derecha, el de la investigación aplicada, el que se traduce en productos que pueden vender las empresas y generar negocio. De hecho a todos los gobiernos les gustaría poder prescindir de financiar los otros cuadrantes, pero son conscientes de que no hay ciencia aplicada sin ciencia básica.

Cuadrante Pasteur (Stokes 1997)

Cuadrante Pasteur (Stokes 1997)Sin embargo, nos queda la casilla de abajo a la izquierda, que esta vacía. ¿ Que se supone que va ahí ? Stokes, que es quien produjo el ejemplo del cuadrante Pasteur en 1997, habla del cuadrante Peterson, investigación guiada por la curiosidad pero sin utilidad alguna. Es probable que en versiones posteriores se haya quedado vacío porque la idea de que la investigación guiada por la curiosidad sea inútil es bastante discutible. Así que en España hemos hecho algo mejor, hemos creado nuestro propio cuadrante, el cuadrante Unamuno: el de que inventen ellos.

Cuadrante Pasteur versión española

Cuadrante Pasteur versión españolaObviamente, llamarlo así quedaba mal, por lo que hemos decidido ponerle como titulo el de “Innovación”. A lo que antes le llamábamos I+D, investigación y desarrollo, ahora le llamamos I+D+i, investigación + desarrollo + innovación. Y vamos a ser justos, no es un invento nacional, como veremos Europa está en lo mismo, y todo lo que aquí se menciona vale también para gran parte de Europa. Pero en España tenemos un personaje para ponerle nombre al cuadrante. Y también vamos a distinguir, hay “innovación disruptiva” e “innovación”. Crear la bombilla a partir de conocimiento existente cuando las casas se alumbraban con gas o aceite de ballena es innovación disruptiva, cambiar el color de las bombillas porque hay un mercado para bombillas de colores es innovación.

No todo tiene que ser inventar la bombilla, vamos a explorar una pequeña innovación disruptiva que puso el ordenador personal al alcance de todo el mundo, la interfase grafica (GUI), las ventanas que uso en la pantalla de mi ordenador en vez de escribir líneas de comandos (¿ alguien se acuerda de MS-DOS ?). El inventor fue Douglas Engelbart, en 1968 en la Universidad de Stanford. La primera GUI la desarrollo el Xerox Palo Alto Research Center (PARC), lo que en España llamaríamos un centro tecnológico, en Palo Alto (California) hacia 1973. Steve Jobs visitó PARC en 1979 y Apple incorporó la GUI a sus ordenadores en 1984. De Stanford a Palo Alto hay 3 km, y de Palo Alto a Cupertino 16. Es decir que en el sistema de transferencia más eficiente del mundo, Silicon Valley, desde una de las mejores universidades del mundo a una de las empresas más innovadoras se tardó unos 20 años para llevar una invención muy aplicada a su comercialización, a la velocidad de 1 km por año de la universidad a la empresa.

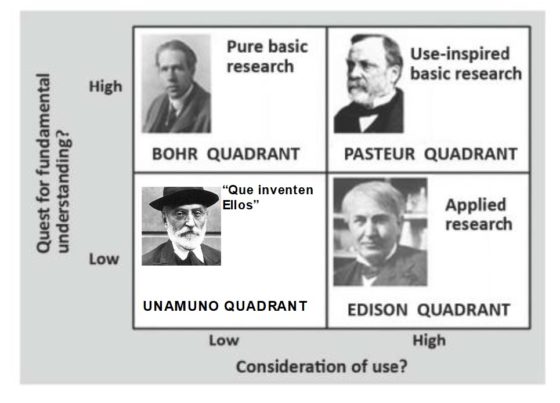

Por ponernos en contexto, en Estados Unidos, paradigma de llevar la investigación al mercado, se dedican unas 70 000 millones de dólares al año a la investigación, de esos unas 40 000 millones (57 %) vienen de fondos federales, 5 000 millones (7%) de la industria y 25 000 (36 %) millones de otras fuentes (estados, fundaciones etc). Esto se traduce en 15 000 solicitudes de patentes, 800 nuevos productos y la creación de 1000 start-ups al año (Figura 3, AUTM licensing survey 2017, www.autm.net). España con una inversión real de alrededor de 10 000 millones tiene lógicamente los resultados escalables, por ejemplo 1800 patentes al año. Pero lo que España (ni gran parte de Europa) no consigue es generar el tipo de innovación disruptiva que surge en los EEUU (o por ejemplo Corea).

Investigación y resultados en los EEUU. Fuente: www.autm.net

Investigación y resultados en los EEUU. Fuente: www.autm.net

En mi opinión esto se debe a que España, siguiendo la tradición unamunoniana, no cree en la ciencia y conocimiento como generadores de nuevo negocio. Realmente nuestra sociedad (nuestros dirigentes son un reflejo de la sociedad) cree que inventarán otros, y que nosotros lo único que necesitamos hacer es mejorar esos inventos, es decir innovar a secas.

Con honrosas excepciones, la universidad española es tradicionalmente mediocre. El Unamuno de “inventen ellos” era a la vez el rector de una de las mejores universidades españolas de la época, la de Salamanca, y eso es un reflejo de nuestra tradición. Siempre se discuten las clasificaciones y es obvio que no somos los EEUU con Stanford, MIT y parecidos. Pero Suiza, un país de 8.5 millones de habitantes, menor que Cataluña, tiene 5 universidades entre las 100 mejores del mundo. España ninguna. Y Suiza no solo son bancos, también es el país de Nestlè, Novartis y Roche entre otras multinacionales basadas en la ciencia. Para cubrir las deficiencias tradicionales de la universidad Española en la transferencia del conocimiento, en las ultimas décadas han proliferado los centros tecnológicos, primero en Euskadi y Cataluña, y luego en el resto del Estado. Estos intentan reproducir el papel del PARC, o, para ser más precisos, toman como modelo el Fraunhofer alemán. Eso sí, sin tener institutos del nivel del Max Planck para generar el conocimiento básico en el que apoyarse.

Sin embargo, aunque han tenido un impacto positivo, a esos centros tecnológicos (CCTT) no se les ha dotado de misiones concretas y presupuestos estables, sino que se ha dejado que crezcan y se multipliquen a medio camino entre lo privado y lo público. Obviamente, cualquier organización que debe autosostenerse, aunque sea sin lucro, busca sus propios mercados, y muchos CCTT han acabado ocupando terrenos que serían mas propios de empresas, como pueden ser los servicios.

Sin embargo, tanto en España como en la UE, una tendencia con todavía peor efecto es la presión cada vez mayor para que universidades y sobre todo centros tecnológicos se acerquen a la empresas. Se les pide que hagan su investigación aplicada atendiendo a las necesidades de las empresas. De hecho cada vez más se pide que las empresas sean parte de los proyectos de investigación y se evalúa tanto el potencial impacto del proyecto como el interés científico del proyecto. Esto acaba convirtiendo a los CCTT en departamentos de I+D de las empresas. Pero también tiene un efecto más pernicioso, al que me gusta denominar efecto Dreadnought (Figura 4).

En 1906, el primer Lord del Mar, John «Jackie» Fisher, lanzó el Dreadnought, lo que hoy en día llamaríamos un caso de escuela de innovación disruptiva. Nada era un invento nuevo, pero al reunir las tecnologías más avanzadas de la época en motores, coraza y artillería, el Dreadnought dejó obsoletos de un plumazo a todos los buques de guerra contemporáneos. Incluidos los de la armada más poderosa en ese momento, la Armada británica. Como resultado, todas las armadas estaban niveladas y comenzó la carrera armamentista naval con Alemania.

El HMS Dreadnought. Fuente: Wikimedia Commons

El HMS Dreadnought. Fuente: Wikimedia CommonsComo hemos dicho, España y la UE tienen un problema reconocido con la innovación: la ciencia básica no se traduce en el mercado de la manera que ocurre, no solo en los EE.UU, sino también en países como Corea y otros. El problema es de tal magnitud que la UE ha incluido para los proyectos de investigación H2020 el requisito de tener PYMES en el consorcio y la participación de las partes interesadas se requiere desde la redacción de la propia propuesta. Además, la propuesta generalmente necesita incluir un plan de negocio, y lo más importante es que el impacto potencial es tan importante como la ciencia en el proceso de evaluación. Esta tendencia se está incorporando a los programas de financiación de investigación nacionales y autonómicos.

Sin embargo, debido al efecto Dreadnought, las compañías ya existentes no promoverán a sabiendas la investigación que conduzca a la innovación disruptiva, ya que de hecho alteraría su estructura de producción y, lo que es más importante, pondrían a los competidores al mismo nivel. Las compañías de gas que iluminaban las calles en el siglo XIX no estaban invirtiendo en la investigación de Menlo Park sobre electricidad (solo por la anécdota, la frase completa de Unamuno en El pórtico del tiempo, 1906, es: “Inventen, pues, ellos y nosotros nos aprovecharemos de sus invenciones. Pues confío y espero en que estarás convencido, como yo lo estoy, de que la luz eléctrica alumbra aquí tan bien como allí donde se inventó”) .Los beneficios que obtenía Bayer por las sulfonamidas no estaban en la base del descubrimiento de los antibióticos e incluso los productos de una empresa famosa por su capacidad innovadora generalmente están en un campo diferente al de su negocio principal.

En realidad, el iPhone es un buen ejemplo de un efecto Dreadnought: Nokia estaba haciendo una excelente investigación para mejorar sus teléfonos móviles cuando la innovación disruptiva proveniente de una compañía de computadoras personales lo sacó del mercado de un solo golpe. Por otro lado, aunque Apple fue el primero en el nuevo mercado, el producto niveló tanto el campo para los competidores que hoy en día, marcas de las que uno nunca había oído hablar, están al frente del mercado. Hay que observar que las gigantescas empresas que asustan a Europa por su dominio global, como Google, Amazon y otros, no tienen en su origen una I+D+i financiada y orientada por una empresa, sino a jóvenes emprendedores que abandonaron la academia y pusieron los últimos conocimientos generados en los laboratorios directamente en el trabajo.

El enfoque adoptado en los proyectos H2020, así como en los programas nacionales y autonómicos, seguramente ayudará a las empresas de la UE y nacionales a seguir siendo competitivas, pero solo hasta que la innovación disruptiva proveniente de otro lugar las borre creando un mercado completamente nuevo. Y como se indicó anteriormente, al tener compañías y partes interesadas estrechamente vinculadas al proyecto desde la concepción del mismo, este enfoque desalienta intrínsecamente la innovación disruptiva.

Por otro lado, toda una serie de estudios en los EEUU sugieren que el mayor retorno de la inversión en ciencia no se genera a través de patentes o secretos industriales, sino a través de la creación de nuevas empresas, start-ups (Valdivia 2013). En lugar de solicitar a las empresas que participen en los proyectos, evaluando el impacto potencial y creando planes comerciales desde la etapa de propuesta, lo que deberíamos promover es la generación de nuevas empresas a partir de proyectos de investigación. Hay que tener en cuenta que no se puede construir un plan comercial sensato para una innovación disruptiva que crea un mercado completamente nuevo, pero en algunas convocatorias se podría omitir la participación empresarial y la evaluación de impacto potencial simplemente solicitando a los proyectos que reserven parte del presupuesto para ayudar a iniciar nuevas empresas. Esto crearía el incentivo para que los proyectos apunten a una investigación disruptiva y al mismo tiempo motivaría a las investigadoras e investigadores jóvenes a correr el riesgo de abandonar la academia para entrar en la empresa. Obviamente, la mayoría de los proyectos no crearán nada disruptivo, pero los resultados siempre seguirán estando disponibles para las empresas existentes como patentes o pequeñas empresas que se pueden adquirir, y al mismo tiempo se establecerán los incentivos adecuados para sembrar las empresas disruptivas que nos faltan hoy en día en España y la UE

Esto debería de ir acompañado de una concienciación de la sociedad sobre el papel real de la ciencia como generador de nuevo negocio. De manera que la sociedad presione para que nuestra universidad mejore significativamente, no solo en su financiación como suelen demandar los rectores, pero también en su organización interna, búsqueda de la excelencia y sobre todo el nivel de autoexigencia. A la vez hay que diseñar mejor el papel de los centros tecnológicos, sus campos de actuación deben de estar claramente definidos. Lógicamente hay que apoyar a la empresa existente, pero también hay que pedirles que ejerzan ese papel de intermediario entre ciencia básica y producto, acercándose tanto a los generadores de conocimiento como se han acercado a las empresas.

Mientras sigamos viviendo en el cuadrante de Unamuno, pensando en que la bombilla la inventen ellos que ya haremos alguna mejora aquí, la luz nos alumbrará, pero nos seguirá sorprendiendo que nuestras empresas sean barridas por algo que viene de fuera y de paso deja sus beneficios e impuestos también fuera.

Referencias:

Stokes, Donald E. (1997). Pasteur’s Quadrant – Basic Science and Technological Innovation. Brookings Institution Press. pp. 196. ISBN 9780815781776.

Valdivia, Walter D. «University start-ups: Critical for improving technology transfer.» Center for Technology Innovation at Brookings. Washington, DC: Brookings Institution (2013).

Sobre el autor: Xabier Irigoien es director científico de AZTI-BRTA

El artículo El cuadrante Pasteur español y el efecto Dreadnought se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El efecto Roseto

- Cristalografía (13): Fiat Pasteur

- Nanopartículas para la consolidación del fuerte español de Bizerta

El problema del final feliz

Casi todos los domingos del invierno de 1933, un pequeño grupo de estudiantes se reunía en algún lugar (un parque o un café) de Budapest para hablar de matemáticas. El especial grupo al que me refiero estaba formado, entre otras personas, por Paul Erdős (1913-1996), Esther Klein (1910-2005), Márta Svéd (¿1910?-2005), George Szekeres (1911-2005) y Pál Turán (1910-1976).

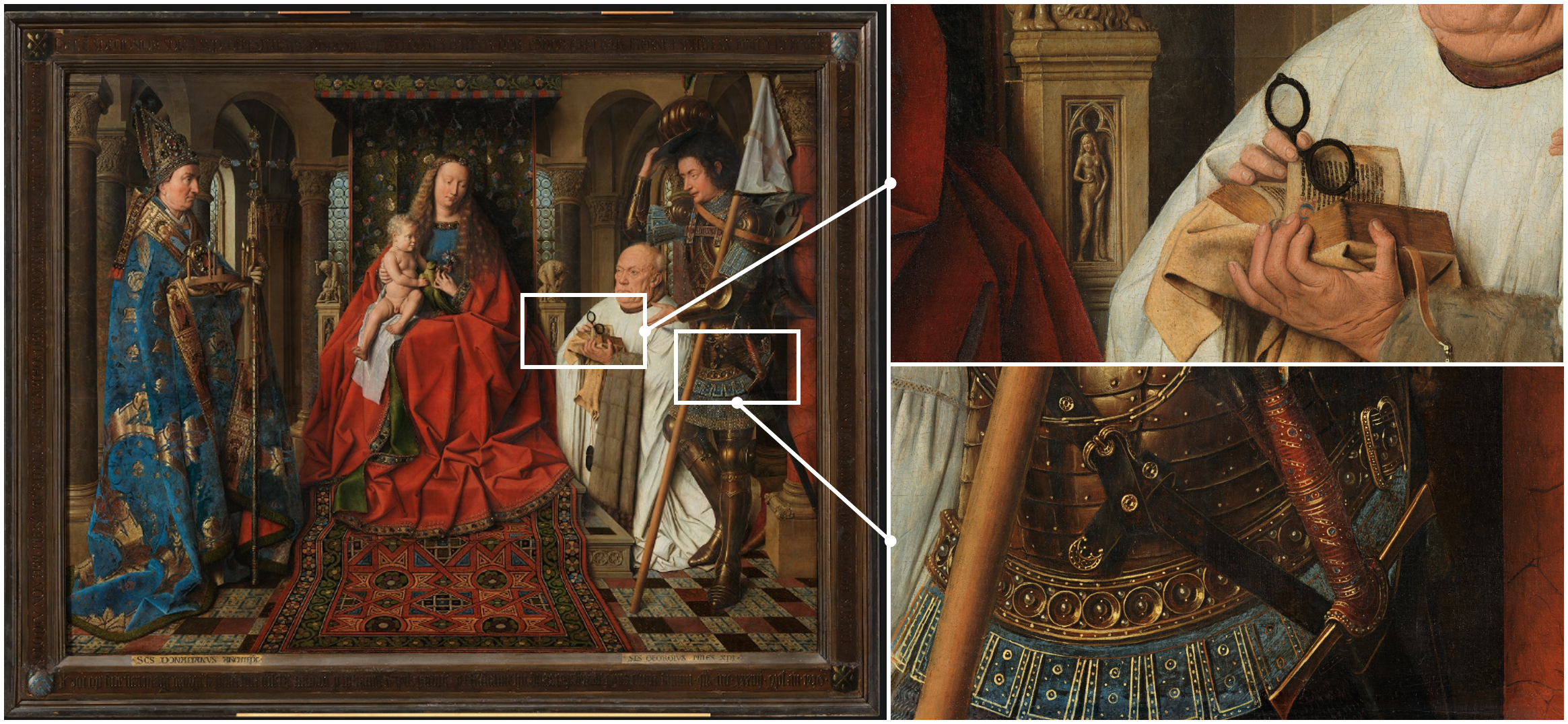

En esta imagen aparecen tres de los protagonistas citados arriba, pero con algunos años más. De izquierda a derecha: Carole Lacampagne, Roger Eggleton, Esther Szekeres (Klein de nacimiento), Paul Erdös, George Szekeres y John Selfridge en 1984.

En esta imagen aparecen tres de los protagonistas citados arriba, pero con algunos años más. De izquierda a derecha: Carole Lacampagne, Roger Eggleton, Esther Szekeres (Klein de nacimiento), Paul Erdös, George Szekeres y John Selfridge en 1984.©The University of Newcastle; UON Photographer.

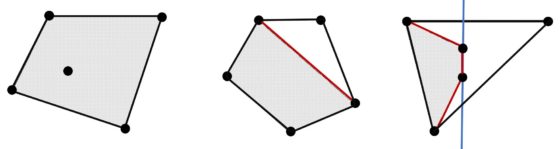

En una de estas reuniones, Esther propuso el siguiente problema:

Dados cinco puntos en el plano en posición general, demostrar que cuatro de ellos forman un cuadrilátero convexo.

Tras dejar al resto del grupo un tiempo para reflexionar sobre el problema, Esther explicó a sus colegas la demostración que ella había pensado.

En 1935 Erdős y Szekeres publicaron un artículo en el que se generalizaba el resultado de Esther (ver [1]); es uno de los trabajos fundamentales de la geometría combinatoria. Paul Erdős denominó el problema original como “El problema del final feliz” porque Esther y George se casaron en 1937… ¿tras conocerse mejor gracias a este enunciado?

Empecemos por aclarar los conceptos involucrados en la proposición de Esther. Que varios puntos del plano estén en posición general significa que no existe ningún subconjunto formado por tres de ellos que sean colineales. Un cuadrilátero es convexo si todos sus ángulos interiores son menores que 180 grados.

La solución de Esther se basaba en que existen tres formas diferentes en las que un polígono convexo encierra cinco puntos. Dicho de otra manera, dados cinco puntos en posición general, su envolvente convexa puede ser uno de los tres polígonos siguientes:

-

puede ser un cuadrilátero cuyos vértices son cuatro de los puntos del conjunto inicial y que deja en su interior el punto restante. En este caso, la solución ya es inmediata;

-

la envolvente convexa puede ser un pentágono cuyos vértices son los cinco puntos dados. Entonces cuatro de esos puntos pueden conectarse para formar un cuadrilátero convexo;

-

finalmente, si la envolvente es un triángulo, los dos puntos que quedan dentro de la figura definen una recta que divide el triángulo en dos partes. En una de ellas hay dos puntos y en la otra uno de los del conjunto de cinco puntos inicial. Estos dos puntos y los interiores forman automáticamente un cuadrilátero convexo.

Los tres casos posibles de envolventes convexas y los cuadriláteros convexos obtenidos.

Los tres casos posibles de envolventes convexas y los cuadriláteros convexos obtenidos.

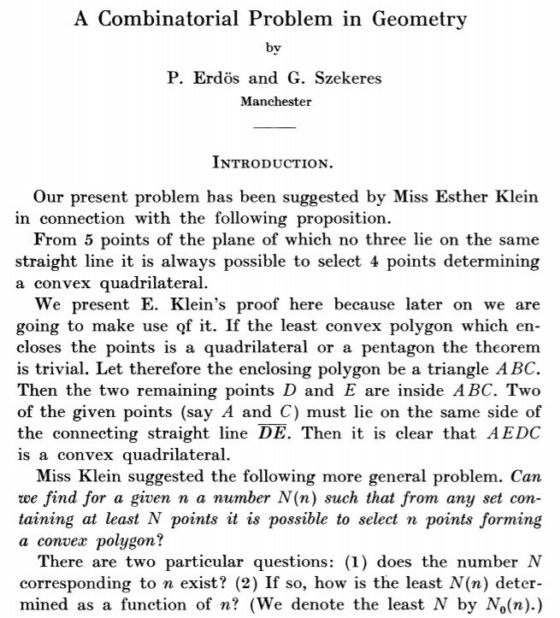

Como hemos comentado antes, Erdős y Szekeres publicaron en 1935 (ver [1]) una generalización del problema planteado por Esther Klein. El artículo comenzaba del siguiente modo:

El problema que nos ocupa ha sido sugerido por la señorita Esther Klein en relación con la siguiente proposición.

A partir de cinco puntos del plano de los cuales no hay tres en una misma línea recta, siempre es posible seleccionar cuatro puntos que determinan un cuadrilátero convexo.

[…] La señorita Klein sugirió el siguiente problema más general. Dado un entero positivo n, ¿es posible encontrar un número N(n) tal que de cualquier conjunto que contenga al menos N(n) puntos sea posible seleccionar n puntos que formen un polígono convexo?

Hay dos preguntas particulares: (1) ¿existe el número N(n) correspondiente a n? (2) Si es así, ¿cómo se determina el menor N(n) en función de n? (denotamos el menor N por N0(n)).

Principio del artículo [1]

Principio del artículo [1]

En [1] los autores demostraban que el número N(n) existe (para n mayor que 2) y conjeturaban que

![]()

basándose en algún caso particular demostrado por otros autores. De hecho, es obvio que N0(3)=3, Esther Klein demostró que N0(4)=5 y en [1] se afirma que E Makai probó que N0(5)=9, aunque no existe evidencia escrita de ello. Años más tarde Szekeres y Lindsay Peters (ver [2]) demostraron con ayuda de un ordenador que N0(6)=17, reafirmando la conjetura.

Y, de momento nadie ha sido capaz de confirmar o refutar la conjetura. Pero la propuesta se ha reformulado proponiendo la alternativa siguiente (ver, por ejemplo, [4]):

![]()

donde la O mayúscula se refiere a la notación de Landau. Confiemos en que pronto se conocerá más sobre esta interesante acotación.

Por cierto, la historia de amor (el “final feliz” entre sus dos colegas, como lo denominaría Erdös) de Esther y George fue larga e incluso poética en su despedida: ambos fallecieron el 28 de agosto de 2005, con una hora de diferencia. Ella tenía 95 años, él 94… y ambos número de Erdös igual a 1.

Referencias

[1] Paul Erdös and George Szekeres, A combinatorial problem in geometry, Compositio Math. 2 (1935), 463-470.

[2] George Szekeres and Lindsay Peters, Computer solution to the 17-point Erdös-Szekeres problem, ANZIAM J. 48 (2006), 151-164

[3] Pierre-Alain Cherix, Shaula Fiorelli Vilmart, Pierre de la harpe, Polygones convexes : le problème de la fin heureuse, Images des Mathématiques, CNRS, 2014

[4] Sara Freyland, The Happy Ending Problem and its connection to Ramsey theory, Report Uppsala University, 2019

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo El problema del final feliz se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El problema de la plantación de árboles en filas (2)

- Un dulce problema de Paul Erdös

- El problema de la plantación de árboles en filas

Superconductores

El Shanghai Transrapid une el aeropuerto Shanghai Pudong con la estación de Longyang. Es un maglev comercial que alcanza los 431 km/h de velocidad de crucero. Fuente: Wikimedia Commons

El Shanghai Transrapid une el aeropuerto Shanghai Pudong con la estación de Longyang. Es un maglev comercial que alcanza los 431 km/h de velocidad de crucero. Fuente: Wikimedia CommonsLa teoría de la bandas ha sido sometida a pruebas experimentales muchas veces y ahora es el modelo de consenso para el comportamiento de conductores y aislantes. Pero tenemos que modificarla para poder explicar la superconductividad.

El modelo de Drude-Lorentz introdujo la idea de que la resistencia eléctrica se debe a colisiones de los electrones [1] con impurezas, imperfecciones y especialmente con las vibraciones reticulares del cristal. Las vibraciones reticulares del sólido disminuirán a medida que disminuya la temperatura, porque la entropía, que representa el desorden [2], también disminuye. Por lo tanto, la resistencia también debería disminuir. Esto es lo que se observa, y está bien explicado por la teoría cuántica de bandas. Pero a temperaturas muy bajas sucede algo extraño: la resistencia de algunos materiales cae repentinamente a cero a partir de cierta temperatura.

Estos materiales se convierten en superconductores, lo que significa que pueden conducir corrientes sin resistencia o, lo que es equivalente, sin pérdida de energía. La temperatura a partir de la que se produce la superconductividad se denomina temperatura crítica. Varía desde 0.015 K para el tungsteno [3], 160 K para ciertas cerámicas, hasta 250 K para algunas formas cristalinas de superhidruro de lantano [4][5].

Podemos imaginar algunas de las posibles ventajas de unos cables eléctricos con resistencia cero. Es como un movimiento sin fricción. Entre las muchas aplicaciones reales y potenciales están las líneas de transmisión eléctrica sin pérdida de energía, ordenadores más rápidas y electroimanes con una fuerza colosal. Estos últimos se usan actualmente en dispositivos de resonancia magnética (MRI), aceleradores de partículas de alta energía y trenes de levitación de alta velocidad, a menudo llamados «mag-lev» [6]. Dado que la temperatura de ebullición del nitrógeno líquido, que es abundante y relativamente fácil de producir, es de 77 K, los superconductores con temperaturas críticas superiores a 77 K pueden mantenerse lo suficientemente fríos manteniéndolos sumergidos en nitrógeno líquido. Sin embargo, un gran inconveniente de estos materiales es que son frágiles, no porque se puedan romper con facilidad, sino porque la superconductividad puede destruirse fácilmente por un campo magnético que no esté controlado. Como es lógico, se investiga intensamente para superar estos problemas y crear materiales superconductores con temperaturas de transición lo más cercanas que sea posible la temperatura ambiente (20 ° C o 293 K) [7].

El desarrollo de dispositivos superconductores tuvo un impulso enorme tras la aparición del modelo básico de la superconductividad propuesto en 1957 por John Bardeen, Leon Cooper y Robert Schrieffer. Los autores de la teoría BCS, como se le conoce, recibieron el Premio Nobel por su trabajo en 1972. Su teoría es altamente técnica, pero la idea básica es que las ondas de electrones en el estado superconductor ya no actúan de forma independiente, como en el modelo de Bloch. En cambio, se emparejan a la temperatura crítica de modo que sus funciones de onda actúan como una unidad a medida que interactúan con la red cristalina. Además, todos los pares de electrones se mueven juntos en un movimiento colectivo, de modo que si un solo electrón se dispersa por la red, su compañero “lo arrastra” hacia la corriente general, y si algún par de electrones se dispersa de alguna manera fuera de la ruta general, todos los demás pares “lo traen” de regreso al flujo colectivo. Como no hay dispersión o colisiones inelásticas, no hay resistencia y el material se convierte en un superconductor.

Aunque la teoría BCS explica bien en general ciertos sólidos cristalinos, se requieren más refinamientos del modelo para otros materiales [8] y para explicar el comportamiento de los superconductores en detalle.

Notas:

[1] Da igual si los tratamos como ondas o como corpúsculos.

[2] En puridad esto es una afirmación muy grosera, pero tolérese para poder visualizar lo que ocurre.

[3] En esta casa obedecemos las normas IUPAC.

[4] En concreto una forma del LaH10 altamente simétrica (grupo espacial Fm-3m), en la que una jaula de hidrógeno envuelve los átomos de lantano. Véase.

[5] Récord a la fecha de publicación. Cualquiera sabe cuando estés leyendo esto.

[6] De levitación magnética dicho en inglés.

[7] 20ºC es la temperatura ambiente estándar. Si nos fijamos ya se ha conseguido la superconductividad a temperatura ambiente en algunas regiones de la superficie del planeta Tierra en según qué épocas del año: 250 K son -23º C.

[8] Véase, por ejemplo, esto.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Superconductores se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Tipos de comportamiento conductor

- La ley del gas ideal y la tercera ley de la termodinámica

- El modelo clásico de electrones libres de Drude-Lorentz

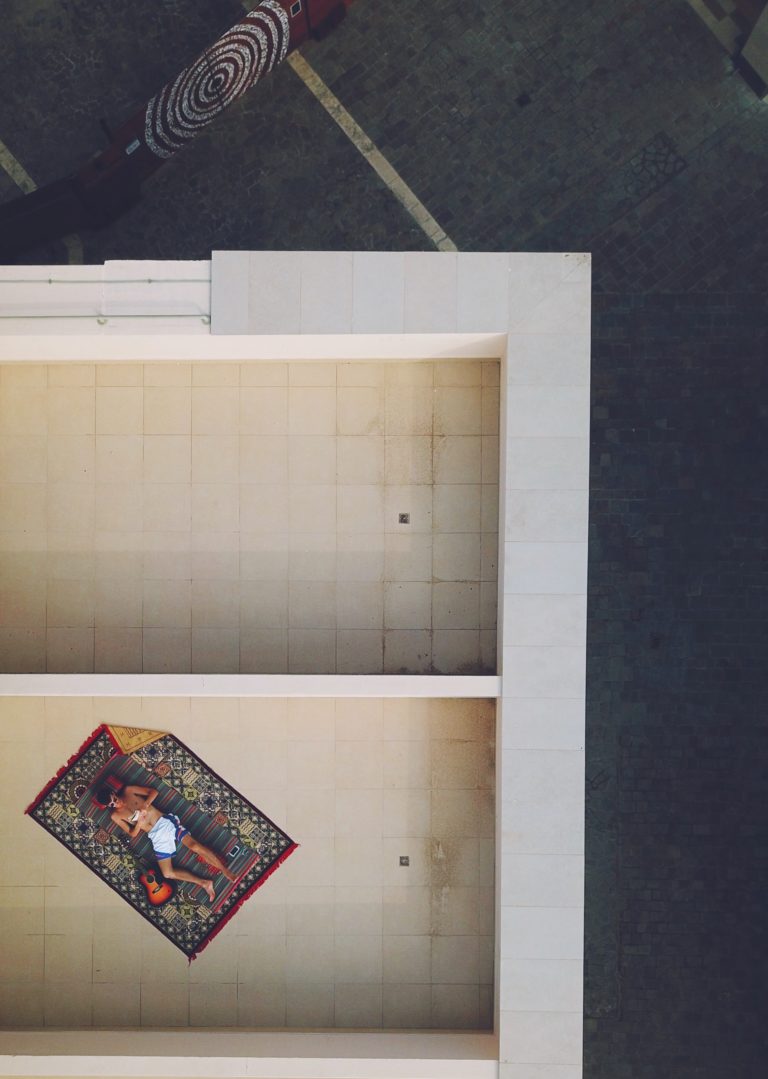

A tomar el sol

Foto: Mincho Kavaldzhiev / Unsplash

Foto: Mincho Kavaldzhiev / UnsplashEn las últimas décadas los expertos han recomendado evitar las exposiciones excesivas al sol pues son la principal causa de daños en la piel y, sobre todo, de la aparición de melanoma, un cáncer extendido y muy peligroso. La revisión, publicada en 2017, por Natalie Matthew y sus colegas, de la Universidad de Providence, en Estados Unidos, informa de que la incidencia del melanoma en todo el planeta ha crecido con rapidez en los últimos 50 años.

La tasa es mayor en personas de piel blanca y en zonas cercanas a los trópicos y al ecuador. Nuestra especie apareció en los trópicos del centro de África, un área geográfica con mucho sol. Homo necesita sol para el metabolismo de la vitamina D en la piel. Sin embargo, la exposición al sol es peligrosa por los rayos ultravioleta que tiene y, para evitarlos, apareció la melanina, el pigmento que oscurece la piel y evita los ultravioleta. Pero, cuando nuestra especie salió de África hacia el norte, hacia Eurasia, colonizó zonas con menos incidencia solar y, por tanto, menos producción de vitamina D en la piel. Se aclaró la piel y se seleccionó piel blanca, con poca melanina, que dejaba pasar la luz solar y permitía la síntesis de vitamina D. Pero, con el tiempo, los originarios de Eurasia se extendieron por todo el planeta, y, con su piel blanca, muchos volvieron a los trópicos, con demasiado sol para este tipo de piel con escasa melanina protectora. El exceso de sol, con su componente ultravioleta, produce daños en la piel y, en último término, la aparición del melanoma.

En conclusión, la relación de la piel de nuestra especie con el sol es complicada: buena para la vitamina D y dañina por el exceso con desarrollo de cáncer. Hasta ahora se ha intentado evitar el melanoma y, para conseguirlo, los protocolos de exposición al sol piden evitar el exceso y el uso de protectores solares.

Para explicar brevemente los efectos sobre la salud de la deficiencia en vitamina D, nos sirve la revisión publicada por Michael Holick, de la Universidad de Boston, el año pasado. Enumera, como consecuencia de la falta de vitamina D, a enfermedades agudas y crónicas como la caries en niños, osteoporosis, psoriasis, enfermedades autoinmunes, enfermedades cardiovasculares, algunos tipos de cáncer, diabetes tipo 2 y desordenes neurológicos.

Hay que tener mucho cuidado con el sol y, para tomarlo, no hacerlo a las horas centrales del día, cubierta la cabeza, con ropa adecuada y gafas de sol y, siempre, con protector solar, a ser posible con un factor superior a 30.

Pero, hemos visto que la vitamina D es esencial para muchas funciones del organismo y se sintetiza en la piel por la acción de los rayos ultravioleta solares. Eleni Linos y su equipo, de la Universidad de Stanford, aseguran que tanta protección frente al sol puede afectar a los niveles de vitamina D en el organismo. Esta deficiencia vitamínica, como hemos visto, aumenta el riesgo de varias enfermedades y en ello interviene el uso de los protectores solares.

Los protectores solares, en experimentos de laboratorio y en experimentos controlados, reducen los niveles de vitamina D. Ahora Eleni Linos pretende relacionar los niveles de vitamina D con el uso de protectores solares en la población en general y en situaciones de vida normal. A partir de una encuesta nacional sobre salud en Estados Unidos, con datos tomados de 2003 a 2006 a 5920 personas, consigue, por una parte, conocer el uso de protectores solares y, por otra, el nivel de vitamina D en sangre de los voluntarios (en realidad, del precursor 25-hidroxi-vitamina D que pasa a vitamina D en el riñón).

Al analizar los resultados, los autores encuentran que más de la mitad de los encuestados se protegen del sol de alguna manera, aunque el método varía según la raza, sobre todo en relación con los protectores solares: más de la mitad de los blancos (56%) los utilizan con frecuencia mientras que sólo lo hace un tercio de los hispanos (31%) y algo menos de la sexta parte de los negros (14%). Estar a la sombra, en cambio, es más frecuente en hispanos (37%) y negros (43%) que en blancos (25%). En cuanto al nivel de vitamina D en sangre, más del 70% de los que tienen deficiencia se protegen del sol a la sombra o usan la ropa adecuada (sobre todo las camisas de manga larga).

Las conclusiones son curiosas: la deficiencia en vitamina D la provoca la sombra y las mangas largas, no así los protectores solares que, según los investigadores, se utilizan poco o en poca cantidad y, por tanto, no protegen adecuadamente del sol y, de rebote, no provocan niveles bajos de vitamina D.

Hay que añadir que el grupo de Pelle Lindqvist, del Instituto Karolinska de Estocolmo, ha encontrado una relación entre evitar la exposición al sol y la tasa de mortalidad. Ha revisado datos de 29518 mujeres entre 1990 y la actualidad y que tenían de 25 a 64 años cuando se inició el estudio. Para este estudio, tomar poco el sol es, durante el verano, no tomarlo nunca, y tomarlo mucho es, en verano, hacerlo más de 30 veces.

Hasta 2011, fecha de la revisión de datos, habían muerto 2545 voluntarias. El número de fallecimientos es mayor cuanto menos se toma el sol. No hay que olvidar que los datos son de Suecia, un país al norte y con escasez de sol. Cuando se compara la mortalidad entre las que evitan el sol y las que lo toman, la tasa de mortalidad se dobla entre las que lo evitan. Para los autores, la causa está en la deficiencia en vitamina D, con las consecuencias para la salud que antes he mencionado. Conciliar el riesgo de melanoma con la deficiencia en vitamina D necesita un estudio más detallado y preciso para elaborar un protocolo adecuado.

El mismo grupo de Estocolmo estableció poco después que tomar el sol baja la tasa de mortalidad por enfermedades cardiovasculares y por otras enfermedades excepto cáncer. Calculan, por el contrario, que evitar el sol disminuye la esperanza de vida entre 0.6 y 2.1 años. Debido a la mayor esperanza de vida y a que evitan algunas enfermedades, las mujeres que toman el sol padecen cáncer años más tarde.

En conclusión, la radiación solar ultravioleta es esencial para la síntesis de vitamina D pero, a la vez, crece el riesgo de cáncer de piel, del peligroso melanoma. Sin embargo, cuando se ha buscado una relación entre el nivel de vitamina D con el riesgo de melanoma, no s eha encontrado. El estudio de Upekha Liyanage y su grupo, del Instituto de Investigación Médica Berghofer de Brisbane, en Australia, con datos de 36077 voluntarios, concluye que los niveles de vitamina D no se pueden asociar como causa y efecto con el riesgo de melanoma.

Foto: Dimitris Vetsikas / Pixabay

Foto: Dimitris Vetsikas / PixabayQueda por mencionar un inesperado daño colateral en esta conducta de evitar el sol: la contaminación marina provocada por los protectores solares. Fue un grupo de las islas Baleares el primero en detectarlo en Mallorca.

El riesgo asociado a la exposición al sol ha llevado, en los últimos 80 años y según cuentan Antonio Tovar y sus colegas del Instituto Mediterráneo de Estudios Avanzados de Esporles, en Mallorca, a la invención, desarrollo y producción masiva de protectores solares. En consecuencia, también ha llegado su entrada masiva en el ambiente marino costero.

Su composición es compleja, con sustancias que filtran los rayos ultravioleta, algunas orgánicas como los aminobenzoatos, las benzofenonas, los derivados del alcanfor y muchos más, y otras inorgánicas como los óxidos de titanio o de zinc. Todas ellas reflejan y dispersan la radiación ultravioleta e impiden que llegue a la piel. Hay unos 45 compuestos de este tipo cuya producción está regulada en diferentes países.

Además de estas sustancias que actúan como filtros de ultravioleta, una crema solar lleva conservantes, colorantes, agentes que forman geles sobre la piel, controladores de viscosidad, fragancias, etcétera. Y todos ellos acaban, antes o después, en el ambiente, sobre todo en el mar.

El grupo de Antonio Tovar ha medido la presencia de alguno de estos compuestos en cinco puntos de tres zonas de costa de la isla de Mallorca con gran ocupación (entre 3 y 5 personas por metro de costa), en agosto y septiembre de 2011, temporada alta de turismo.

El análisis de las muestras de agua demuestra que los cuatro productos medidos están en el medio. Hay una benzofenona entre 53.6 y 577.5 nanogramos (millonésima parte del miligramo) por litro; un derivado del alcanfor entre 51.4 y 113.4 nanogramos por litro; óxido de titanio entre 6.9 y 37.6 microgramos (millonésima parte del gramo) por litro; y óxido de zinc entre 1.0 y 3.3 microgramos por litro. Estas concentraciones varían entre puntos de muestreo y, también a lo largo del día con el máximo entre las 14.00 y las 18.00 horas.

Para conseguir una primera aproximación de la posible influencia de estos compuestos en el medio marino, los ensayan sobre el crecimiento de un alga diatomea habitual en la zona, la Chaetoceras gracilis, y en ensayos cortos de 72 horas, en lo que se denomina toxicidad aguda. Con todos los compuestos hay una caída del crecimiento de la diatomea aunque las concentraciones necesarias son mucho más altas, a nivel de miligramos por litro, es decir, un millón de veces más altas que las encontradas en las playas. Pero no hay que olvidar que el periodo de exposición en el experimento era muy corto, solo 72 horas, y a más largo plazo, semanas, meses o años, incluso con concentraciones más bajas, no conocemos los efectos que provocan y los componentes de los protectores solares podrían ser peligrosos.

Referencias:

Holick, M.F. 2017. The vitamin D deficiency pandemic: Approaches for diagnosis, treatment and prevention. Reviews in Endocrine and Metabolic Disorders 18: 153-165.

Lindqvist, P.G. et al. 2014. Avoidance of sun exposure as a risk factor for all-cause mortality: results from the Melanoma in Southern Sweden cohort. Journal of Internal Medicine doi: 10.1111/joim.12251

Lindqvist, P.G. et al. 2016. Avoidance of sun exposure as a risk factor for major causes of death: a competing risk analysis of the Melanoma in Southern Sweden cohort. Journal of Internal Medicine doi: 10.1111/joim.12496

Linos, E. et al. 2012. Sun protective behaviors and vitamina D levels in the US population: NHANES 2003-2006. Cancer Causes Control 23: 133-140.

Liyanage, U.E. et al. 2020. Is there a causal relationship between vitamin D and melanoma risk? A Mendelian randomization study. British Journal of Dermatology 182: 97-103.

Matthews, N.H. et al. 2017. Epidemiology of melanoima. En “Cutaneous melanoma: ethology and therapy”, p. 3-22. Ed. por W.H. Ward & J.M. Farma. Codon Publ. Brisbane, Australia.

Tovar-Sánchez, A. et al. 2013. Sunscreen products as emerging pollutants to coastal waters. PLOS ONE 8: e6545

Sobre el autor: Eduardo Angulo es doctor en biología, profesor de biología celular de la UPV/EHU retirado y divulgador científico. Ha publicado varios libros y es autor de La biología estupenda.

El artículo A tomar el sol se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Las mutaciones que aclaran la piel

- Biomarcadores para la detección precoz del melanoma

- Cómo nos ayuda la ciencia a tomar decisiones correctas

La hipótesis de la abuela

Foto: djmboxsterman / Pixabay

Foto: djmboxsterman / PixabayLa menopausia es, desde una perspectiva evolutiva y en apariencia, una anomalía. De hecho, es un fenómeno muy poco frecuente en el mundo animal. En casi todas las especies las hembras se mantienen fértiles a lo largo de toda su vida. Nuestra especie forma parte de un pequeño grupo de mamíferos en los que la capacidad reproductiva se deteriora de forma acelerada con relación al declive orgánico general. El grupo lo forman, además de la especie humana, el calderón tropical, la beluga, el narval y la orca, todos ellos cetáceos odontocetos. Las hembras de esas especies pueden vivir décadas después de cesar de ovular y, por lo tanto, de poder procrear.

El biólogo norteamericano George C Williams propuso en 1957 que la menopausia podría ser, en realidad, una adaptación. Pensó que desde el punto de vista evolutivo, podría resultar más conveniente para las mujeres dedicar sus esfuerzos a apoyar a sus descendientes que tener ellas una progenie mayor. Conforme envejecemos aumenta la probabilidad de morir, por lo que si una mujer tiene descendencia a una edad avanzada, no sería improbable que sus últimos hijos no pudieran sobrevivir al morir ella. En tal caso, el esfuerzo que esa mujer hubiese dedicado a esos últimos hijos habría resultado baldío, pues sus genes no habrían podido replicarse y ser transmitidos a las siguientes generaciones a través de esos últimos descendientes. Por otro lado, que en una población haya individuos que no se reproducen carece de sentido desde un punto de vista evolutivo, pues esos individuos consumen unos recursos que podrían utilizar otros en beneficio de su propia progenie.

Por estas razones, Williams propuso que las mujeres de mayor edad contribuyen de una forma más efectiva a transmitir sus genes a las generaciones posteriores dedicando sus esfuerzos a los descendientes que ya forman parte del grupo, o sea, a sus nietos y nietas, en vez de hacerlo a los hijos e hijas que a una edad avanzada pudiera llegar a tener ellas mismas.

La “hipótesis de la abuela”, como se conoce en la actualidad la propuesta de Williams, cuenta con respaldo empírico en nuestra especie. Tanto en grupos de cazadores-recolectores, como en sociedades preindustriales se ha comprobado que las abuelas que no se reproducen aumentan la probabilidad de supervivencia de sus nietos. En otras palabras, su presencia en el grupo facilita que sus genes –los que han llegado hasta los nietos- perduren tras su propia muerte o, dicho en lenguaje darwinista, mejore su propia adecuación o éxito evolutivo (fitness) a través del cuidado que presta a sus nietos.

Hay especies, como el elefante asiático y posiblemente también los africanos, de las que sabemos que las abuelas mejoran la supervivencia de los nietos, aunque en este caso las abuelas se siguen reproduciendo. Pero aparte de la especie humana, en ningún otro animal se contaba con pruebas fehacientes en favor de la “hipótesis de la abuela”. Hasta hace unas semanas, pues se acaba de publicar un estudio con orcas –también llamadas, impropiamente, ballenas asesinas- que documenta el efecto positivo de abuelas que no se reproducen en la supervivencia de sus nietos. El estudio recién publicado no solo confirma ese efecto, también muestra que las abuelas que siguen procreando no prestan un apoyo similar al que brindan las orcas menopaúsicas.

La importancia que ese periodo posmenopáusico tan extenso tiene en seres humanos y en orcas habría impulsado, según los especialistas, un aumento en la longevidad de las dos especies, pues la mayor supervivencia de los nietos durante los años de vida añadidos habría compensado con creces, en términos evolutivos, el cese de la procreación.

Fuente: S. Nattrass et al (2019): Postreproductive killer whale grandmothers improve the survival of their grandoffspring. PNAS.

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo La hipótesis de la abuela se ha escrito en Cuaderno de Cultura Científica.

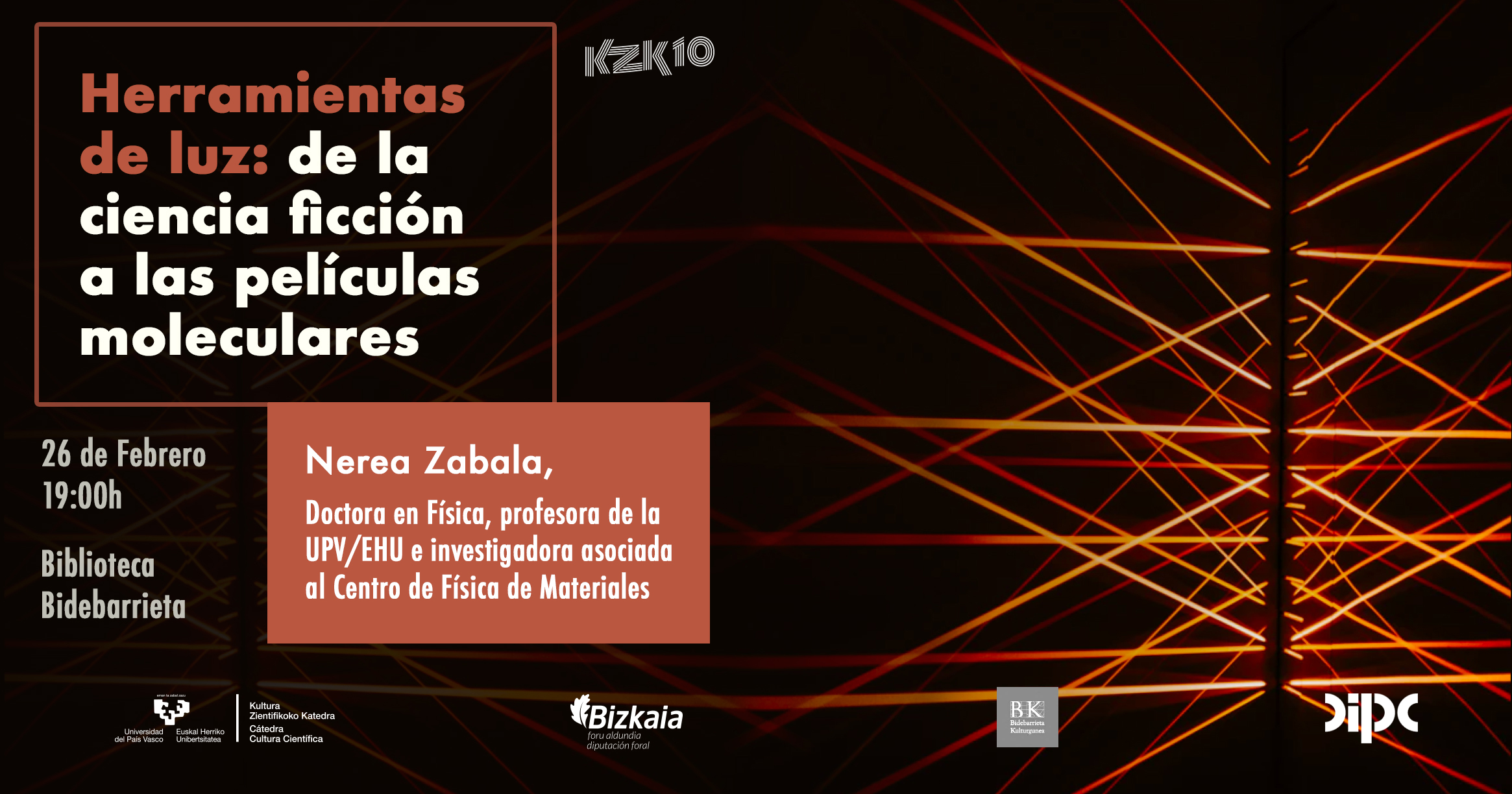

Entradas relacionadas:Herramientas de luz: de la ciencia ficción a las películas moleculares

Desde su descubrimiento en 1960, los rayos láser han servido de inspiración de películas y series de ciencia ficción. Gracias a desarrollos posteriores algunas de estas fantasías se han hecho realidad. De hecho, ha sido posible crear potentes herramientas de luz de aplicación en ámbitos tan diversos como la biología, la medicina, la industria, las telecomunicaciones o la investigación básica en general.

La conferencia titulada “Herramientas de luz: de la ciencia ficción a las películas moleculares” describe algunas de estas aplicaciones de los rayos láser y abordará las nuevas perspectivas que existen con las fuentes láser de gran intensidad concentrada en pulsos de tiempos muy cortos. Estas fuentes láser permiten filmar los procesos moleculares o incluso adentrarse en el mundo de los electrones, ámbitos antes inexplorables para la ciencia.

Nerea Zabala es la ponente de esta charla del ciclo Bidebarrieta Científica, iniciativa impulsada por la Cátedra de Cultura Científica de la UPV/EHU y la Biblioteca Bidebarrieta. La conferencia ttuvo lugar el pasado 26 de febrero de 2020 en la Biblioteca Bidebarrieta de Bilbao.

Nerea Zabala, doctora en Física, es investigadora asociada en el Centro de Física de Materiales (centro mixto CSIC-UPV/EHU) y en el Donostia International Physics Center (DIPC), y profesora en la Facultad de Ciencia y Tecnología de la UPV/EHU. Actualmente su investigación se centra en el estudio del comportamiento de la luz en la nanoescala.

Edición realizada por César ToméLópez

El artículo Herramientas de luz: de la ciencia ficción a las películas moleculares se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- #NaukasKids14 Física y ciencia ficción

- Un equipo de alta fidelidad de ciencia ficción

- Ciencia, arte y cultura callejera: física y música

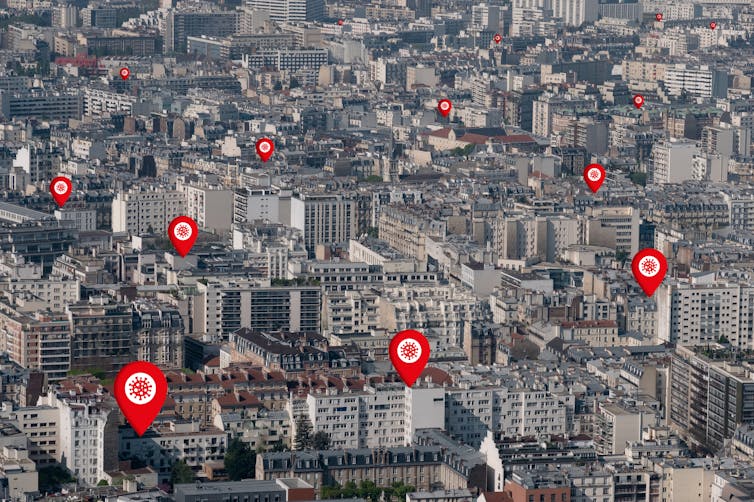

Lo que la búsqueda de inteligencia extraterrestre nos enseña para entender la pandemia

Unsplash/Donald Giannatti, CC BY-SA

Unsplash/Donald Giannatti, CC BY-SAComprender el significado de los números cuando se refieren a cantidades muy grandes o muy pequeñas es complicado. Esto es algo que experimentamos ahora mismo con la pandemia del COVID-19. La combinación de unos números muy grandes (la población total susceptible de ser contagiada) junto con unas probabilidades ínfimas (las asociadas al contagio individual y a la aparición de determinados síntomas graves) da como resultado unas cantidades de muy difícil interpretación. Sobre todo si ignoramos la disponibilidad de servicios hospitalarios. Así, las diferencias entre el riesgo individual y el comunitario se entremezclan y en ocasiones se oscila entre el excesivo alarmismo y el optimismo injustificado.

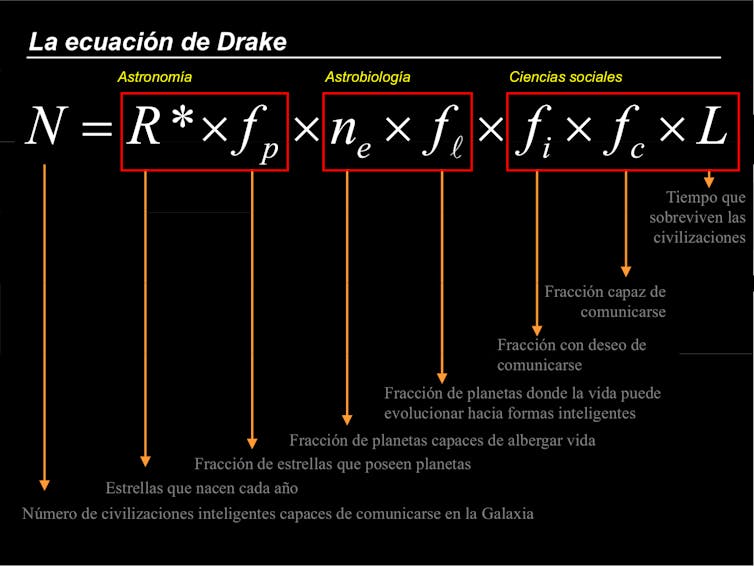

Para ilustrar esta situación en un contexto más amable, podemos utilizar la fórmula presentada en 1961 por el radioastrónomo Frank Drake para dar una base cuantitativa al proyecto SETI (Search for ExtraTerrestrial Intelligence) en la segunda mitad del siglo XX. SETI suponía un intento científico para determinar la probabilidad de establecer contacto con civilizaciones extraterrestres en nuestra galaxia, algo que muchos verán como mera ciencia-ficción pero que podemos abordar con un espíritu analítico.

¿Cómo podríamos determinar el número de eventos de un determinado suceso tan improbable como la comunicación con una sociedad tecnológica extraterrestre? La estrategia consiste en separar los factores que deben concatenarse para lograr un positivo. Asumiremos que todos estos sucesos son independientes y que, por lo tanto, podemos determinar la probabilidad de que se den simultáneamente con una sencilla multiplicación. Añadiendo factores podemos llegar a una estimación razonable sobre la probabilidad del evento final: aquel en el que todos los sucesos se combinan perfectamente.

Esta tarea abarca un buen número de disciplinas que van desde las ciencias experimentales hasta especulaciones de muy discutible fundamento, pasando por áreas del conocimiento más difícilmente mensurables como la historia y las ciencias sociales.

Podríamos comenzar tomando como primeros factores la fracción de estrellas en la galaxia que presentan planetas en su entorno y la cantidad de estos que tienen la composición adecuada y están en la zona de habitabilidad. Estas son cuestiones que las últimas misiones espaciales como Kepler, Gaia y TESS nos permiten cuantificar. Pisamos tierra firme o, al menos, un suelo más firme de lo que Drake pudo hacer en su momento.

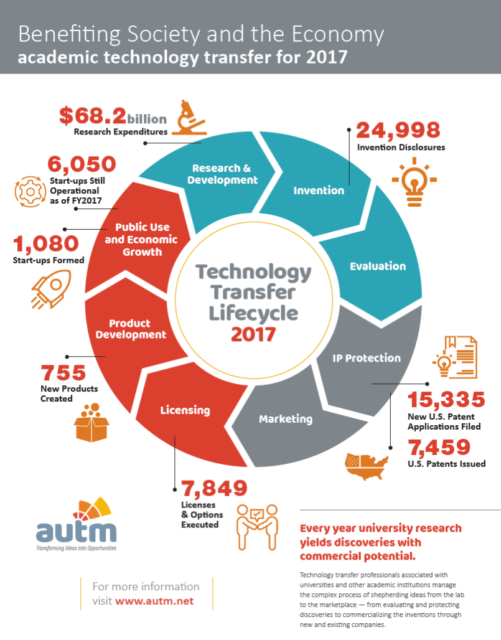

Ecuación de Drake.

Ecuación de Drake.¿Cómo cuantificamos la probabilidad de que surja vida en un planeta que aparentemente reúne las condiciones adecuadas? ¿En cuántos de ellos se ha desarrollado la vida inteligente en forma de civilizaciones? Hasta la fecha, aunque Marte o Venus reunieran condiciones habitables en el pasado, solo conocemos un caso positivo: la Tierra. Ninguno de los más de 4 000 planetas extrasolares conocidos ha demostrado de momento sustentar una biosfera como la nuestra.

A partir de aquí la cuestión se complica. Necesitaríamos cuantificar la evolución de las sociedades hacia la tecnología y el deseo de comunicarse con el resto del universo. También influirá el tiempo durante el cual sean capaces de hacerlo: un siglo, mil años o, como sugirió Drake, hasta 10 000 años. Los datos experimentales para establecer estas cantidades son muy escasos y se basan en la historia humana y en la dinámica de las sociedades que solo comenzamos a comprender de una forma cuantitativa.

En el momento en que Frank Drake asignó valores a todos los términos se encontró con un resultado extraordinario: hasta diez civilizaciones deberían ser detectables mediante SETI. Pero, si así fuera, ¿dónde se encuentran? Esta es la llamada Paradoja de Fermi, opuesta al optimismo de Drake. Encontrar las razones de este inquietante silencio, como se le ha llamado, es también una buena manera de explorar nuestro futuro inmediato y tratar de adivinar los riesgos que como civilización nos pueden esperar a la vuelta de la esquina cósmica.

Otros autores discreparon con los números de Drake desde el primer instante, obteniendo valores mucho más bajos que manifestaban la improbabilidad de lograr el contacto gracias al proyecto SETI. Pequeñas variaciones en los términos que se multiplican en esa larga cadena resultaban en cambios notables del resultado final y, peor aún, las incertidumbres se propagaban exponencialmente en el resultado.

De la ecuación de Drake podemos aprender que los eventos individuales pueden ser realmente infrecuentes o improbables pero, aplicados a una población lo suficientemente grande, su aparición es inevitable. Además, cuando los eventos dependen de una larga cadena de condiciones cuyas probabilidades no podemos estimar con total certeza, nuestra capacidad de predecir los eventos futuros se enturbia. La diferencia con la epidemiología es que, en esta, buscamos que los eventos sucedan en el menor número posible y, para ello, podemos actuar sobre algunos de los factores involucrados.

Desde un punto de vista sanitario, la probabilidad de un evento único, como que enfermemos con síntomas graves, puede ser muy baja, casi despreciable. Aplicada sin embargo sobre el conjunto de la población, terminará sucediendo. Y lo hará más de una vez. Los factores que influyen incluyen la biología, fisiología y la sociología, con una transversalidad similar a la de la astrobiología.

La buena noticia es que cambiar esto se encuentra en nuestra manos: alterando unos pocos factores podemos reducir el número a una cantidad, si no nula, al menos manejable. En ello estamos.![]()

Sobre el autor: Santiago Pérez Hoyos es investigador doctor permanente en astronomía y astrofísica en la Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original

El artículo Lo que la búsqueda de inteligencia extraterrestre nos enseña para entender la pandemia se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La búsqueda de la inteligencia artificial

- Un juego de mesa para entender la irreversibilidad

- La búsqueda de la inteligencia artificial, en la próxima zientziateka

¿Por qué suena triste el modo menor?

Hace cuatro milenios, en Mesopotamia, los sumerios ya utilizaban un sistema musical de siete notas y siete modos para componer sus canciones. Este sistema fue heredado por los griegos que se lo contagiaron al resto de Europa y, desde entonces hasta ahora, —pasando por la larga Edad Media— distintos modos han ido ganando y perdiendo popularidad, según la época. En la actualidad, solemos utilizar preferentemente dos de esos antiguos modos que hemos rebautizado como Modo Mayor y modo menor.

Quizás este desenlace no sea más que un accidente fortuito de la historia. No sabemos si en algún universo paralelo, el reguetón se escribe en el modo frigio y la salsa suena mucho más a mixolidio. Pero, de acuerdo con la hipótesis del profesor David Huron, una vez reducidas las alternativas a dos, su asociación emocional era inevitable: es posible que el modo menor sea, en gran medida un accidente cultural y su asociación con la tristeza deba ser aprendida. Pero esto no significa que sea una asociación arbitraria.

La idea de Huron es que el modo menor suena triste porque suena más triste que el Modo Mayor1. Este, en cambio, saca a relucir su alegría cuando se pone en contraste con su oscuro hermano menor. La clave de esta comparación vuelve a encontrarse en las características de la prosodia humana y cómo esta se ve afectada por nuestras emociones. Pero, para entenderlo, debemos volver a sacar al humano triste de paseo.

Un humano triste, recordemos, es un humano al que le han quitado las pilas. Por eso (y porque tensar las cuerdas vocales también requiere su esfuerzo, aunque no lo parezca), es común que hable bajito, sin cambiar mucho el tono de voz, balbuceando a menudo. Particularmente: es típico que el humano triste produzca sonidos más graves de los que son habituales en él.

Sin embargo, para identificar este cambio en su tono de voz no nos basta con atender a su frecuencia, sin más. Si fuese así, los hombres —que, por lo general, tienen la voz hasta una octava más grave que las mujeres— sonarían siempre tristes, deprimidos, no serían capaces de expresar alegría. Esto, evidentemente, no sucede y el motivo es que, para identificar una voz triste, lo que hacemos es establecer una comparación: entre el tono de esa misma voz en su estado neutro y su tono cuando la invade la tristeza.

Del mismo modo, cuando escuchamos música, realizamos sin darnos cuenta una comparación parecida: entre los tonos que predominan en esa canción y los tonos que se utilizan habitualmente en el resto de nuestra música. O, también, entre los tonos que estamos escuchando en ese momento y los tonos que predominan en el resto de la canción. Y aquí es donde la correspondencia entre los modos Mayor y menor se vuelve relevante, porque si colocamos estas escalas en paralelo, nota a nota, lo que observamos es que el modo menor es una versión oscurecida del Modo Mayor: un modo al que se le han agravado ciertas notas y acortado ciertos intervalos2.

Si bien el uso del modo menor en nuestra tradición musical es, por sí mismo, un accidente cultural, esta especie de tristeza por agravio comparativo parece ser mucho más universal. En 2007, Parag Chordia y Alex Rae quisieron ponerla a prueba utilizando, esta vez, fragmentos musicales procedentes de la India. A través de internet recibieron 22000 respuestas de 500 participantes encargados de clasificar emocionalmente pequeños fragmentos de ragas (los modos melódicos utilizados en la música clásica india). El compendio de todas ellas desvelaba un mismo patrón: los fragmentos con tonos comparativamente más graves e intervalos más pequeños, eran percibidos como más tristes3.

Este es quizás el motivo por el que resulta sorprendente escuchar canciones ya conocidas… a las que alguien ha cambiado el modo (Youtube está lleno de ejemplos). Nuestro recuerdo de la canción original fija un estándar sobre el que inevitablemente superponemos la versión alterada y el contraste saca a relucir la tristeza (o la alegría) percibida

No obstante, mi uso preferido de este contraste se da cuando algún compositor lo establece dentro de una misma canción. Como en esta preciosa canción de El Kanka que, de repente, se quita la ironía y cambia sorpresivamente al modo mayor para hablar de un pasado aparentemente más feliz (se escucha el cambio sobre la misma melodía, en 1’08’’, por ejemplo).

También, me viene a la mente el Lago de los Cisnes de Tchaikovsky. Cuando, en la última escena, después de todo el drama, después de que el tema se haya repetido 500 veces en modo menor, con los protagonistas ya bien muertos y suicidados… el hechizo de los cisnes se rompe y, de repente, escuchamos el mismo tema (2’55’’) ¡pero esta vez triunfante, en Modo Mayor! Parece mentira que pueda tratarse de la misma melodía, cambiando apenas unas pocas notas.

Notas:

1David Huron (2008) A Comparison of Average Pitch Height and Interval Size in Major- and Minor-key Themes: Evidence Consistent with Affect-related Pitch Prosody. Empirical Musicology Review

2El lector que tenga conocimientos musicales quizás se plantee que, al agravar ciertas notas algunos intervalos se harán necesariamente más grandes debido a la estructura cíclica de las escalas. David Huron analizó esta cuestión partiendo de casi 10.000 piezas instrumentales en modo Mayor y menor. Debido a la frecuencia de aparición desigual de los posibles intervalos, el efecto global de cambiar estas notas daba lugar a melodías con intervalos más reducidos en el modo menor.

3Parag Chordia y Alex Rae. “Understanding Emotion in Raag: An Empirical Study of Listener Responses”. Computer Music Modeling and Retrieval. Sense of Sounds, 2008.

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo ¿Por qué suena triste el modo menor? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:La hoja de papel con cuatro caras, una propuesta de taller

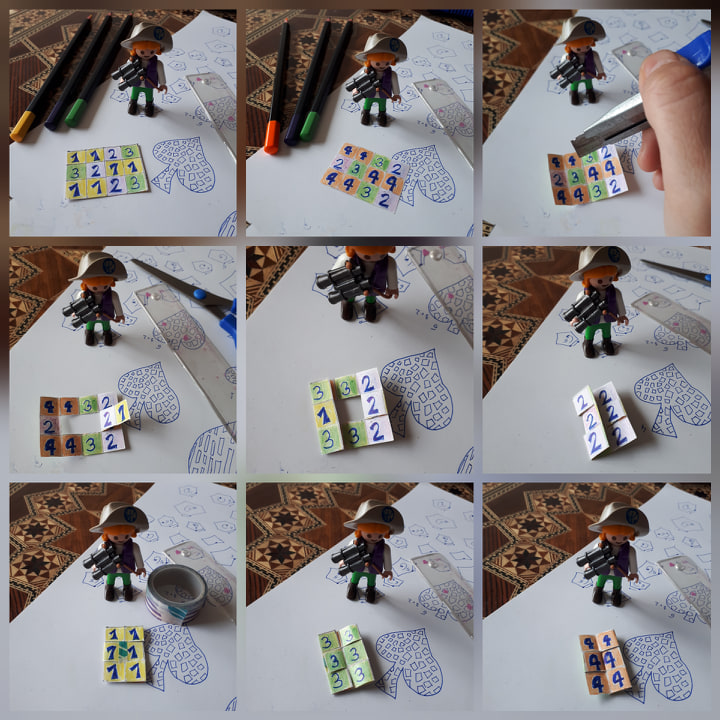

Hace unos cuantos días, pensando en la situación de confinamiento en la que nos encontramos en estos momentos, me pareció que sería una buena idea preparar una actividad sencilla para enviar a la gente y que pudieran realizarla en su casa. Mi idea era que fuese una actividad para personas de cualquier edad, desde pequeños (acompañados si es necesario) hasta mayores. Entonces, me decidí por un taller que hago desde hace algunos años, aunque relacionado con otras cuestiones, y que me gusta mucho. Consiste en construir un objeto matemático sencillo y sorprendente, una hoja de papel con cuatro caras.

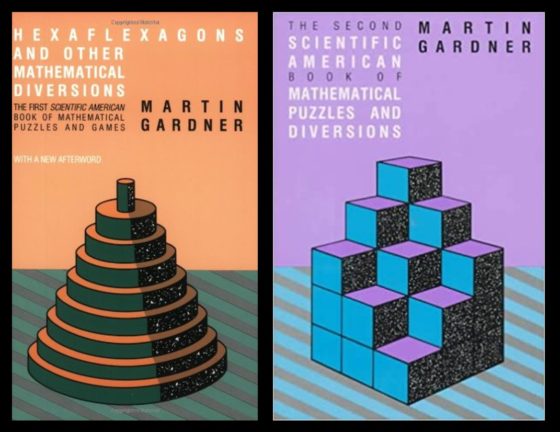

Este objeto matemático, cuyas instrucciones de construcción os voy a explicar en esta entrada del Cuaderno de Cultura Científica, pertenece a la familia de objetos llamados flexágonos y que fue descubierta por el matemático inglés Arthur Stone, de quien ya hemos hablado en relación con el problema de la cuadratura del cuadrado en 1939. Aunque estos objetos fueron dados a conocer y popularizados por el gran divulgador de las matemáticas Martin Gardner (1914-2010) en su columna Juegos matemáticos de la revista Scientific American. En concreto, el objeto matemático que vamos a construir en esta entrada es un tetraflexágono, es decir, un flexágono con cuatro lados (cuadrado o rectángulo), además, como va a poder mostrar cuatro caras, se denomina un tetratetraflexágono.

Portadas de los dos primeros libros de Martin Gardner en los que se recogen los artículos de su columna Juegos matemáticos en la revista Scientific American. En el primero aparece su artículo Hexaflexagons y en el segundo Tetraflexagons

Portadas de los dos primeros libros de Martin Gardner en los que se recogen los artículos de su columna Juegos matemáticos en la revista Scientific American. En el primero aparece su artículo Hexaflexagons y en el segundo Tetraflexagons

Pero vayamos directamente a nuestro objeto matemático, esa hoja de papel de cuatro caras, el tetratetraflexágono, y a su construcción: materiales e instrucciones.

Material básico para el taller: una hoja de papel normal, por ejemplo, din A4, un lápiz y una regla.

Instrucciones para construir el tetratetraflexágono, la hoja de papel con cuatro caras:

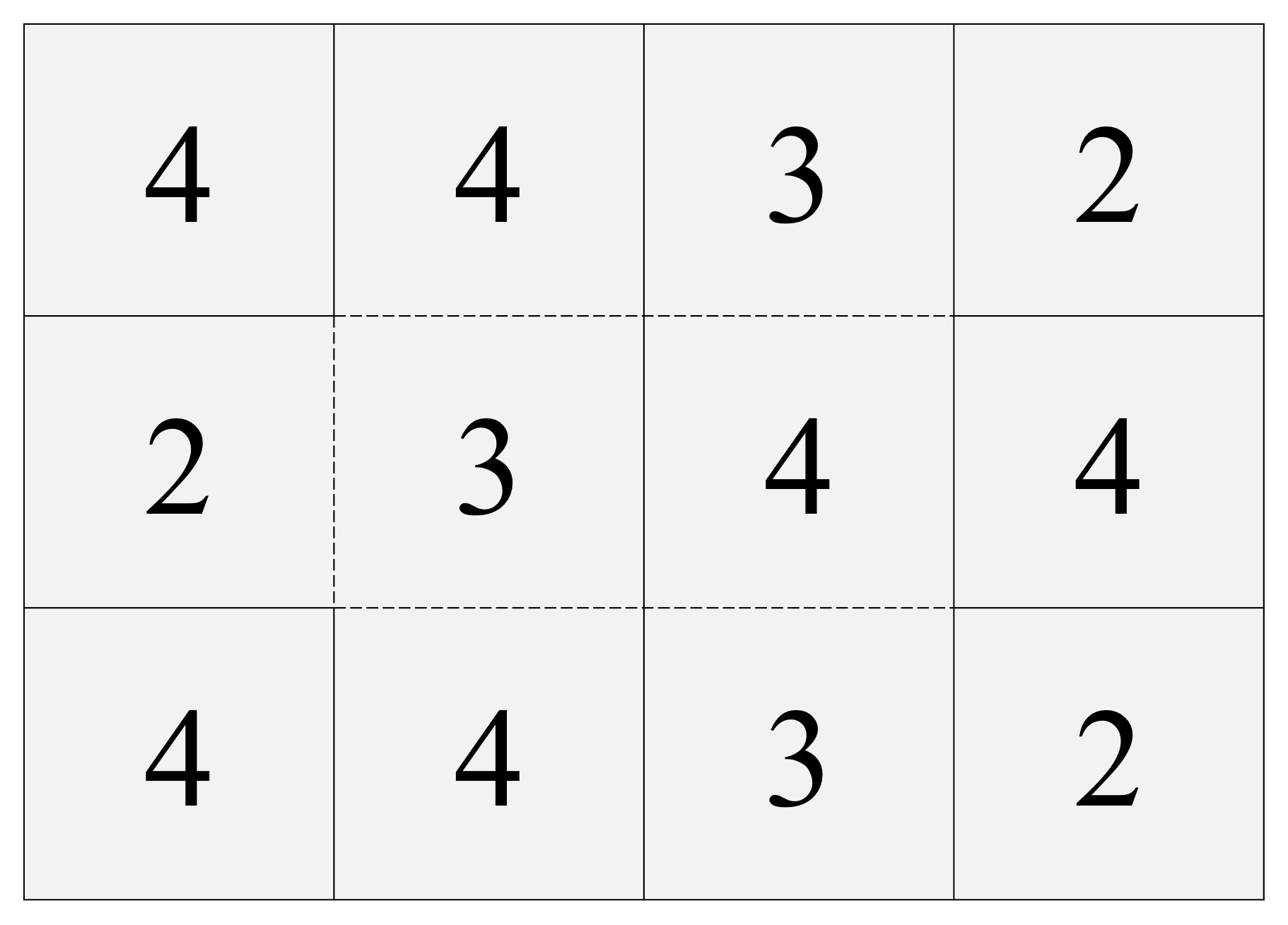

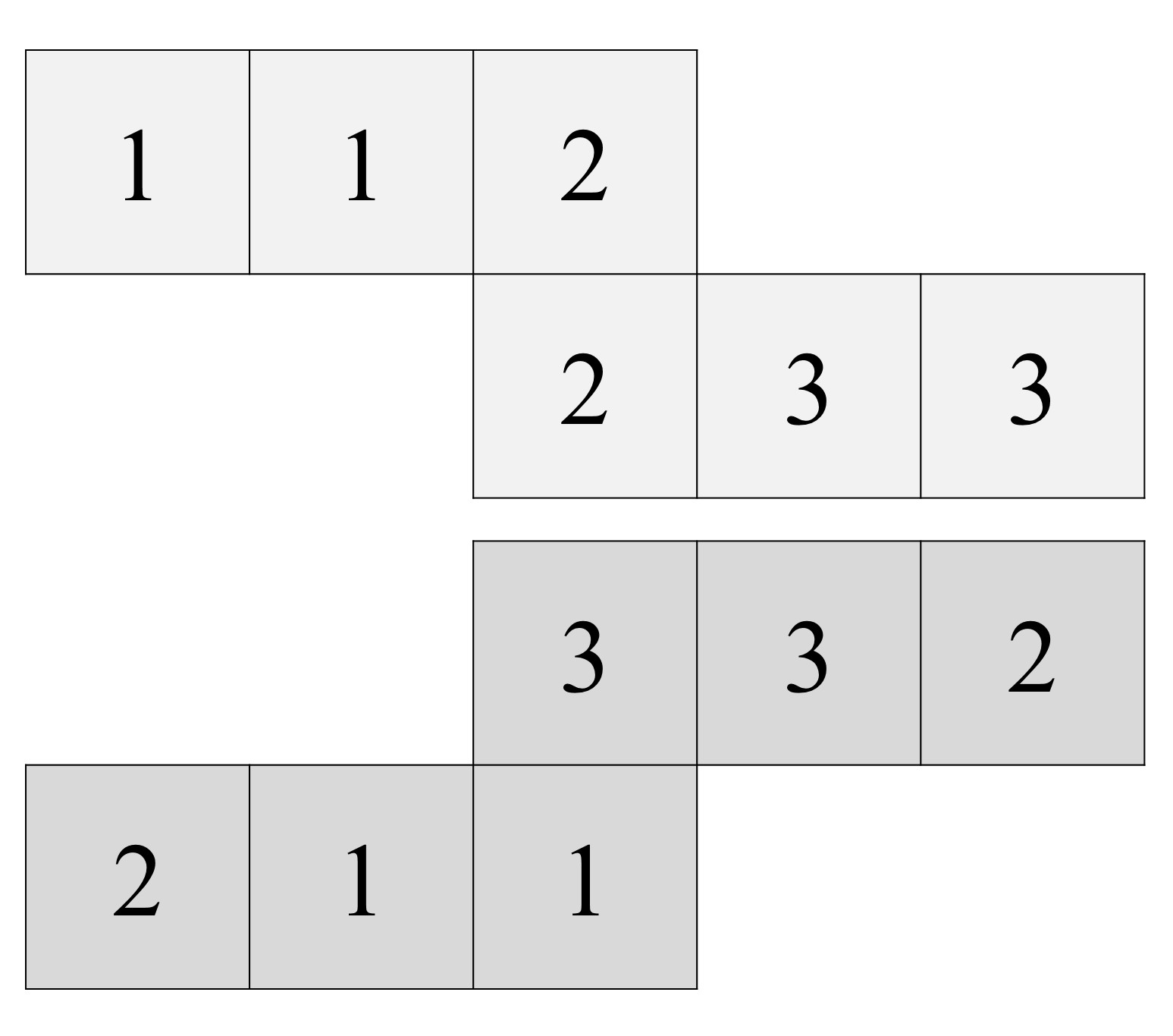

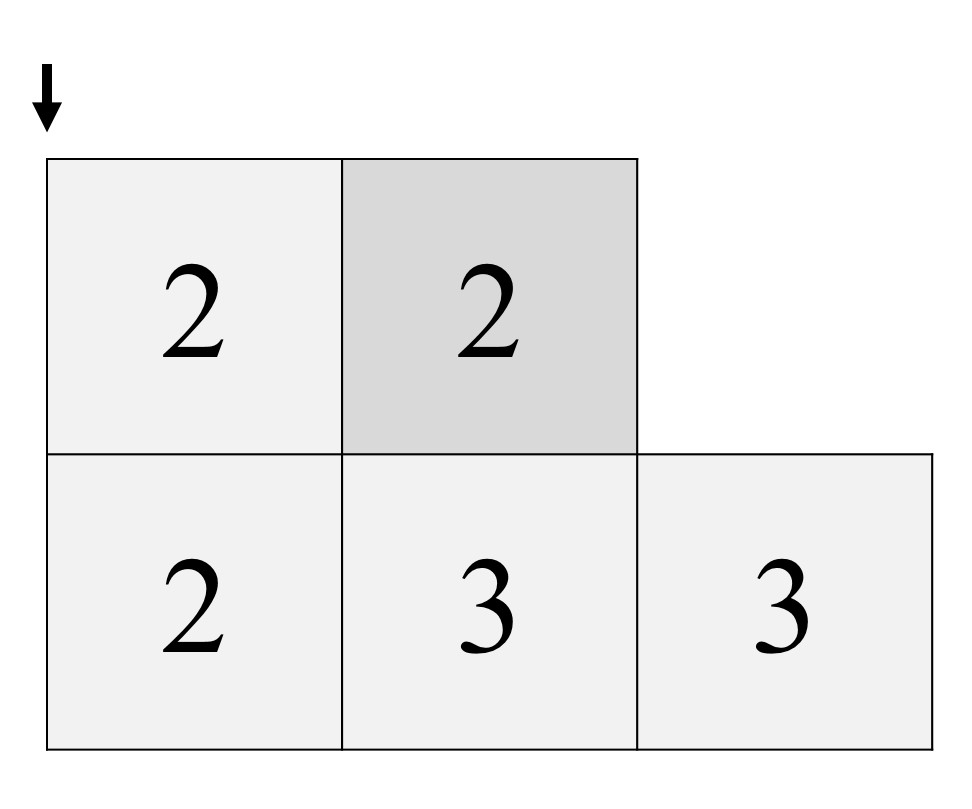

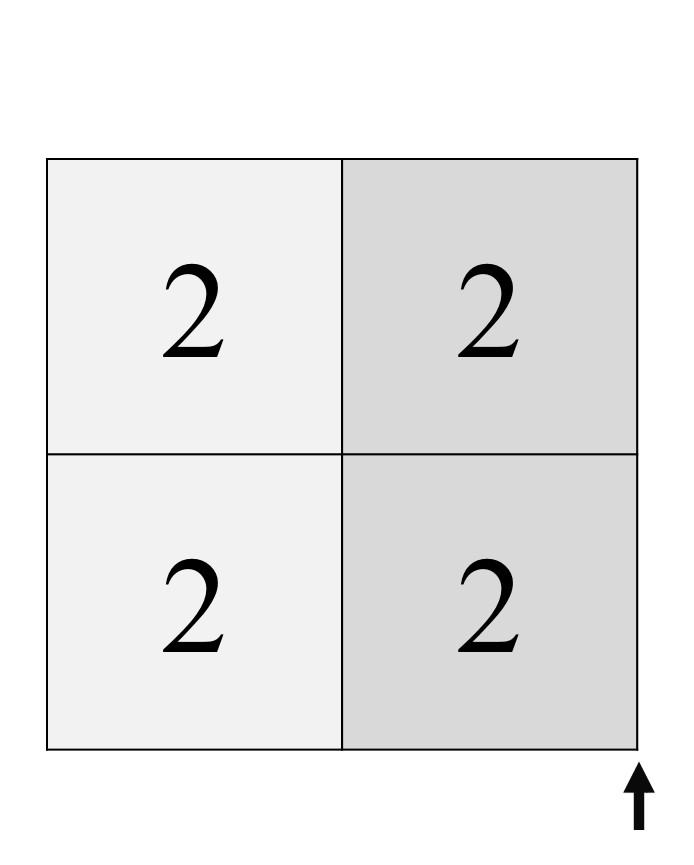

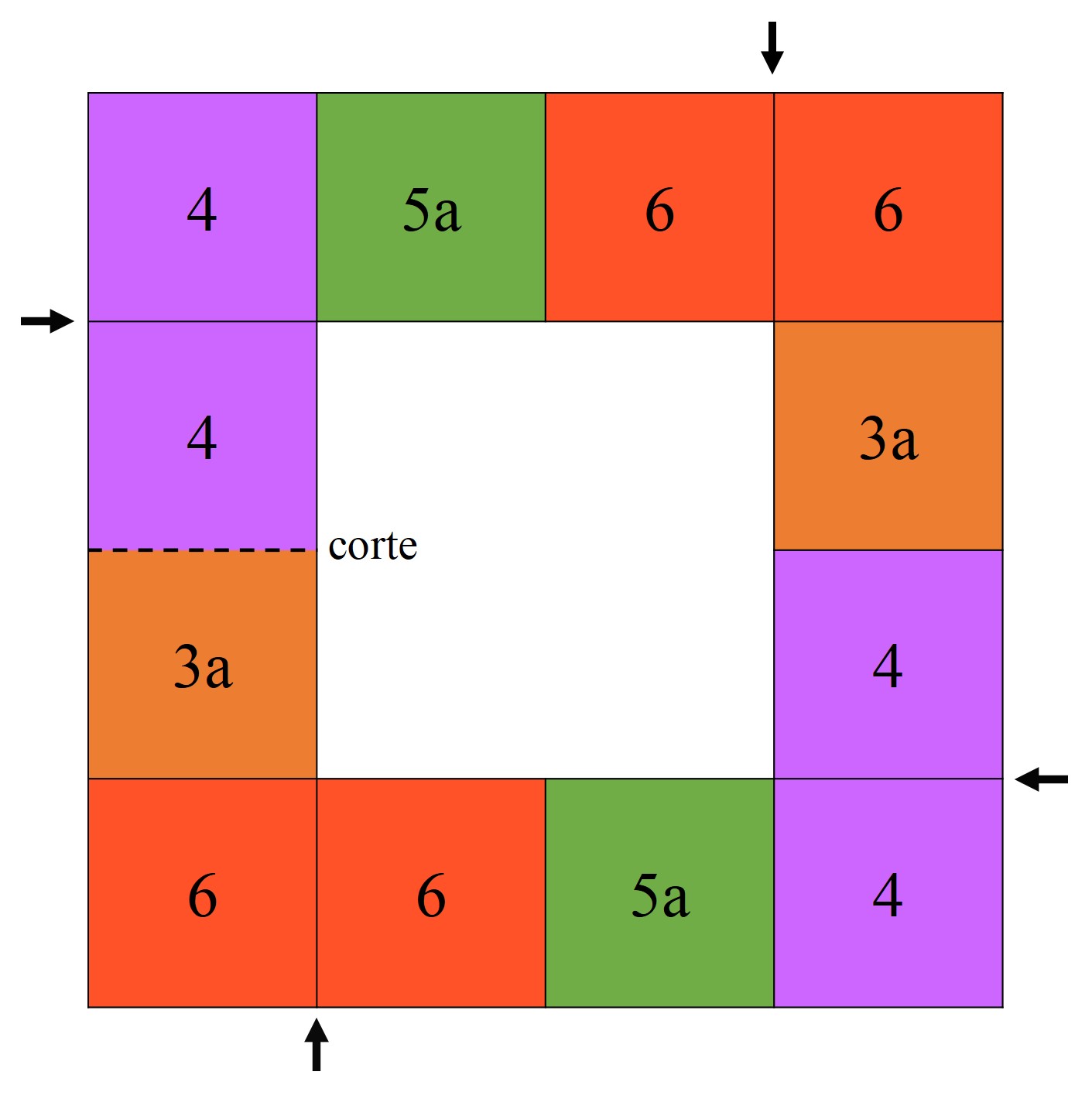

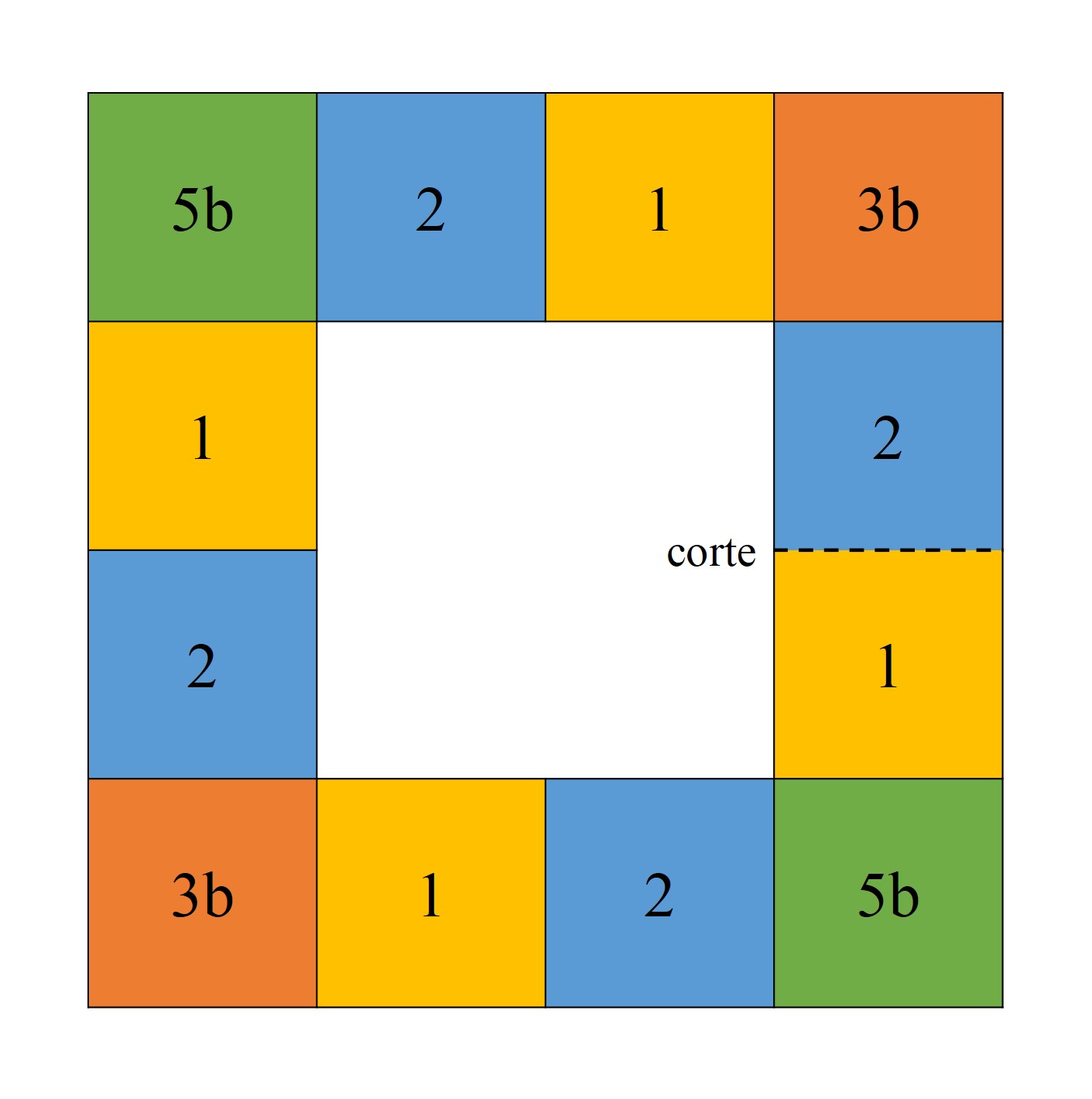

Punto 1. Tomamos la hoja de papel, que colocamos con el lado largo en horizontal, y lo vamos a dividir –por delante y por detrás- en cuatro columnas y tres filas, utilizando líneas trazadas con un lápiz. Generando de esta forma 4 x 3 = 12 casillas rectangulares en cada lado.

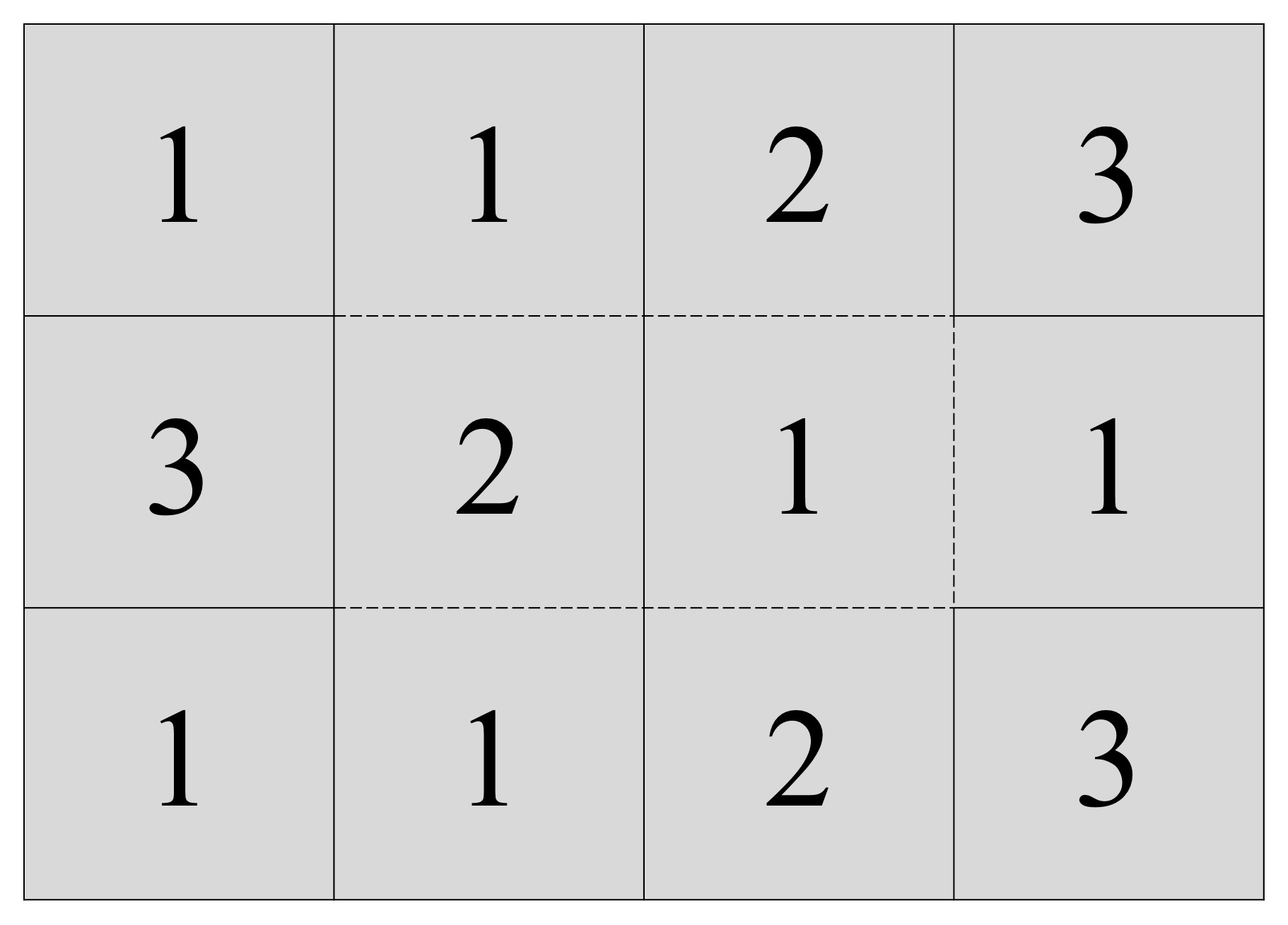

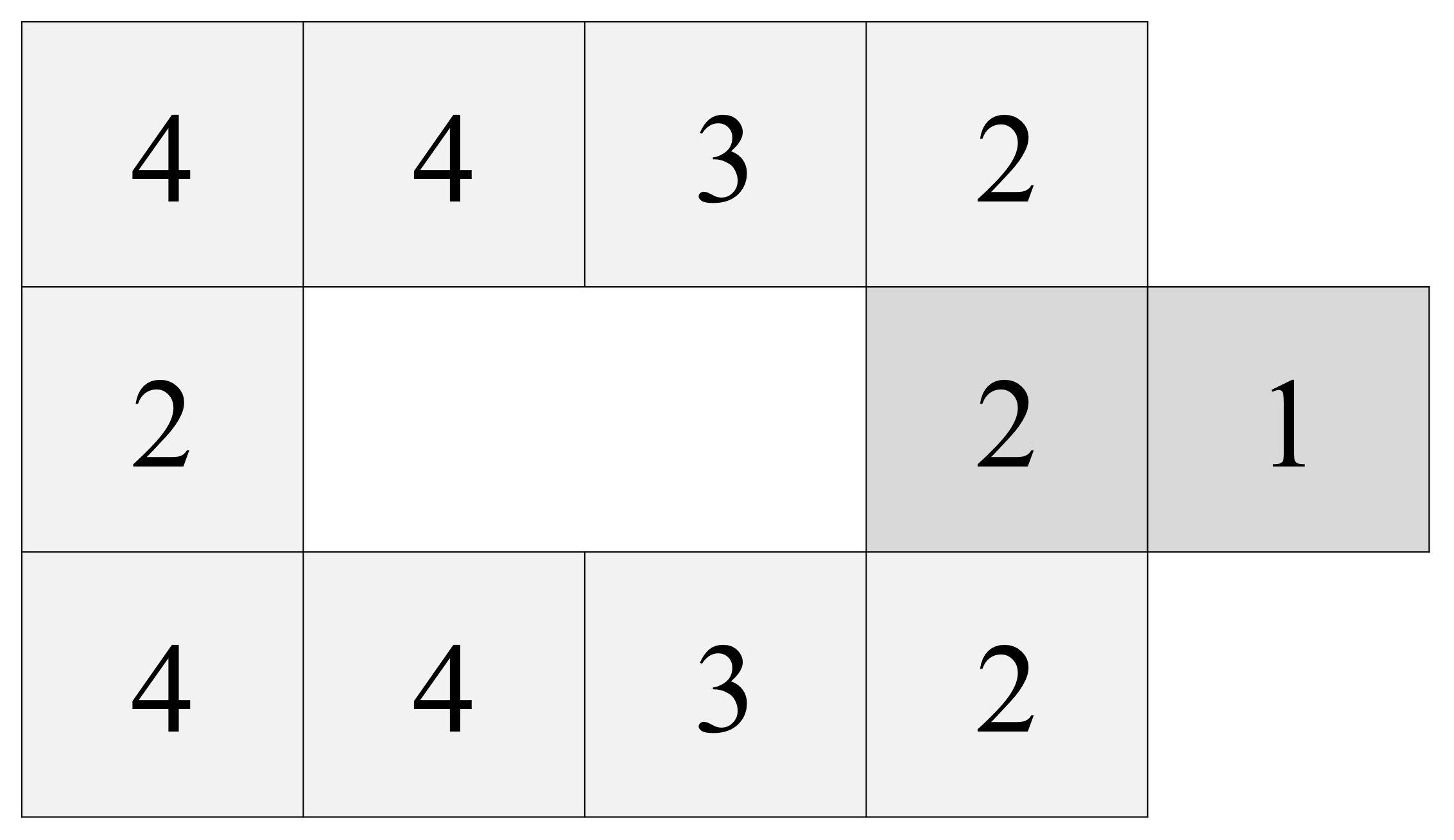

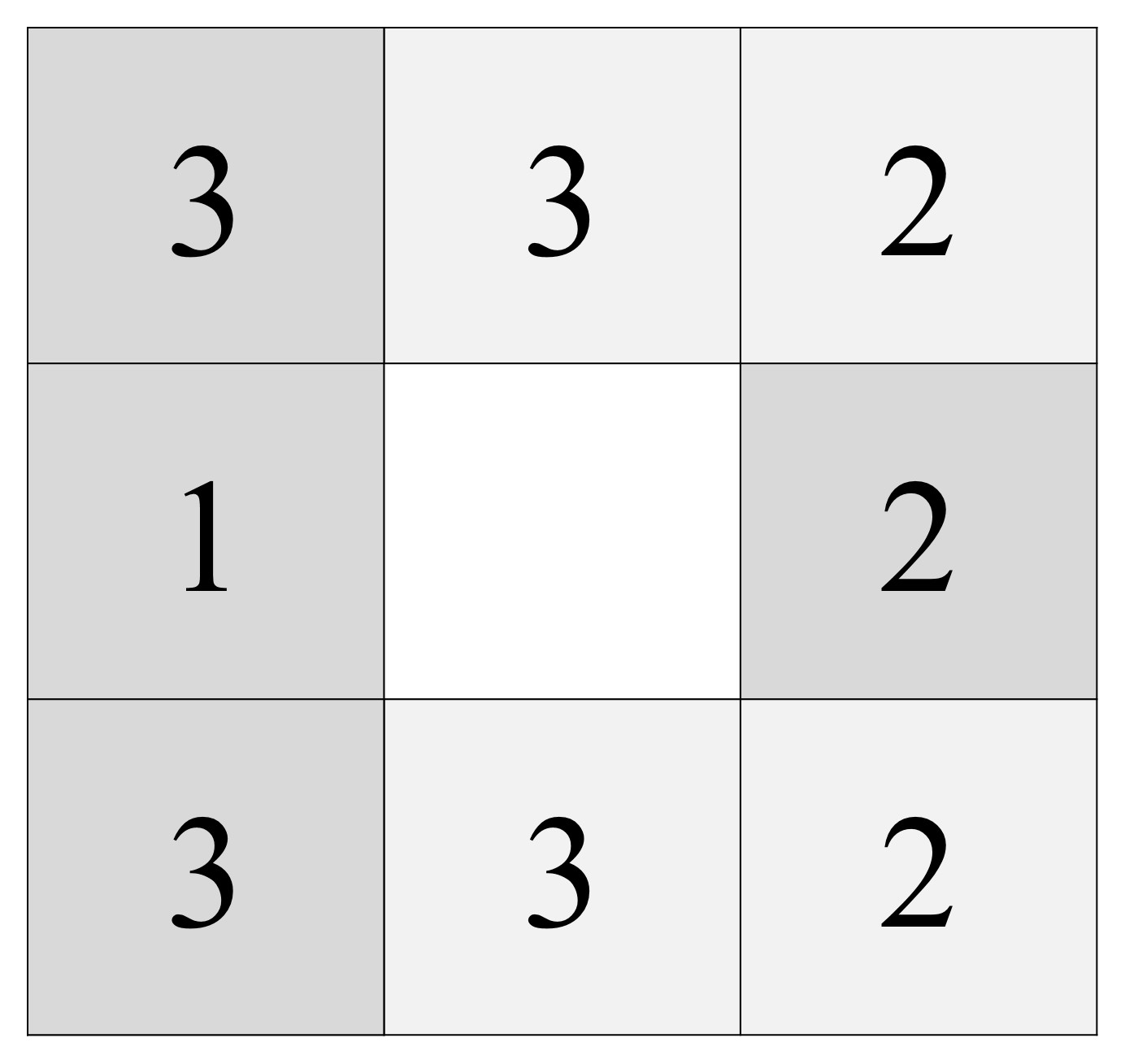

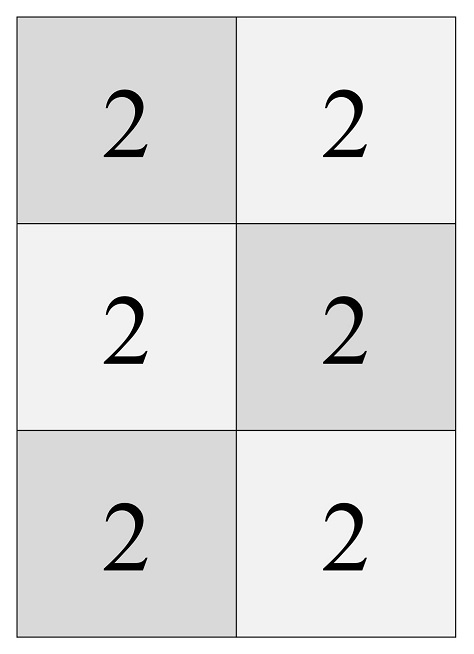

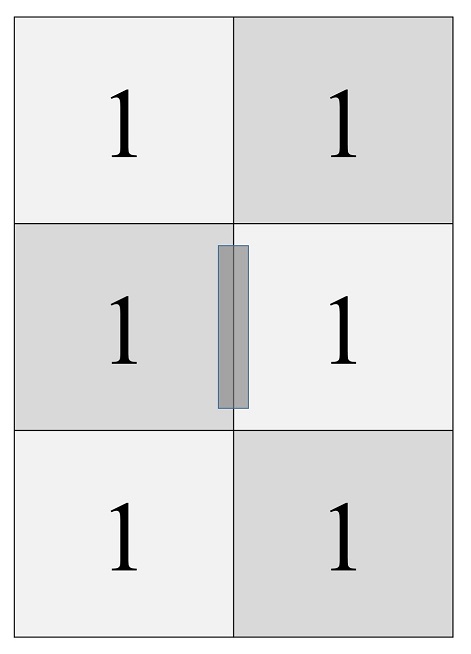

Punto 2. En cada una de las casillas vamos a pintar, centrado, un número. En las 12 casillas de la parte frontal pintamos los números 4, 4, 3, 2 (en la primera fila, la de arriba), luego 2, 3, 4, 4 (en la segunda fila, en medio) y 4, 4, 3, 2 (en la tercera). Ahora en las casillas de la parte trasera pintamos los números 1, 1, 2 y 3 (arriba), 3, 2, 1, 1 (en medio), 1, 1, 2, 3 (abajo). Ojo, aquí quien lo desee puede echarle imaginación y pintar unos números chulos.

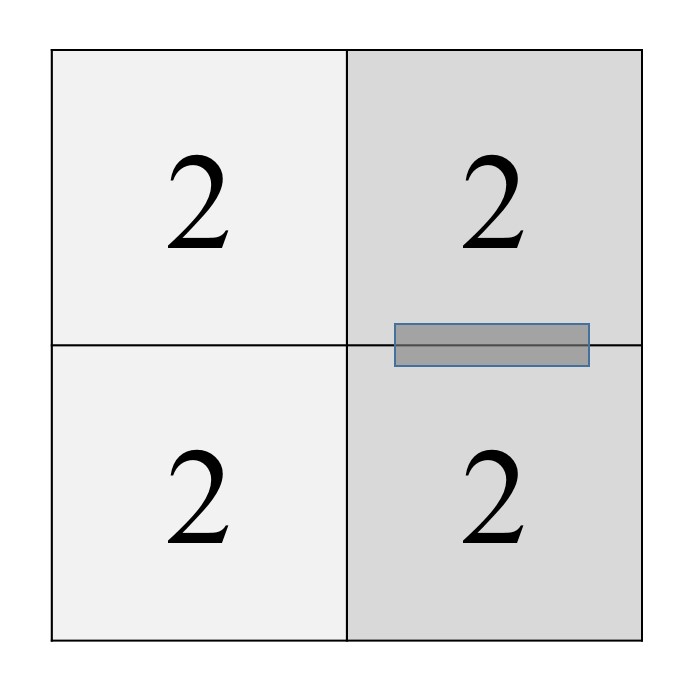

Números de las doce casillas de la parte frontal del folio original

Números de las doce casillas de la parte frontal del folio original

Números de las doce casillas de la parte trasera del folio original

Números de las doce casillas de la parte trasera del folio original

Punto 3. Ahora tenemos que realizar un pequeño corte con unas tijeras, por lo tanto, hay que tener cuidado. Si la actividad la realizan niños y niñas pequeños necesitarán la ayuda, o supervisión, de una persona mayor. Antes de realizar el corte, doblad por las líneas rectas que habéis pintado a lápiz, os ayudará a realizar el corte y además es necesario para la parte final.