Ciencia: es complicado

Explicaciones hay, y las ha habido siempre; para cada problema humano hay siempre una solución bien conocida, elegante, plausible y equivocada. H. L. Mencken

La mente humana es una máquina maravillosa que está poseída por un insaciable deseo de conocer, de satisfacer su curiosidad, pero como todos los sistemas biológicos tiene sus defectos. Y uno de ellos es particularmente perverso: la vagancia. La mente humana quiere saber, pero el cerebro tiene un infinito anhelo de trabajar lo menos posible. Por eso siempre prefiere una explicación sencilla a una compleja; un razonamiento simple a uno más alambicado, una historia directa y sin demasiados condicionales que otra repleta de apartes, casos particulares y rincones que necesitan explicaciones complementarias. No hablamos aquí de la llamada Navaja de Ockham, un principio metodológico razonable, sino del simple problema de la pereza que hace que los seres vivos prefieran el camino con menos cuestas. Y eso, para la ciencia, es un problema, porque resulta que nuestro Universo es complejo, sutil, a veces contradictorio y siempre anti-intuitivo. Comprender el cosmos es siempre cuesta arriba.

Por eso la respuesta a casi cualquier pregunta realmente interesante se puede resumir igual que esas tortuosas relaciones personales se etiquetan en Facebook: Es Complicado.

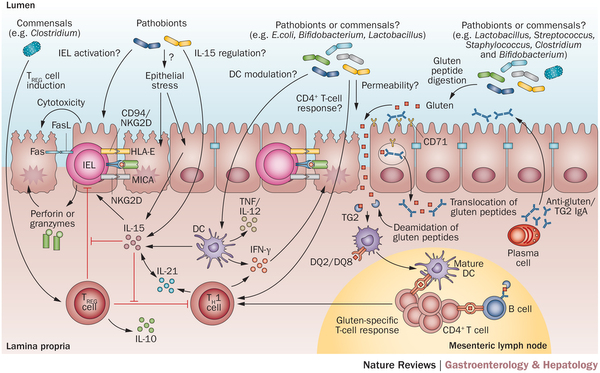

Imagen resumen en la que solo se indica la posible influencia de las bacterias intestinales en la enfermedad celíaca. Nótese la cantidad de interrogantes.

Pongamos un ejemplo relacionado con la actualidad. El pasado domingo 4 de junio de 2017 la periodista Rosa Montero publicó en la revista El País Semanal un artículo sobre intolerancias alimenticias, transgénicos, el poder de la industria farmacéutica y la demonización de la homeopatía. No se trata de desmontar sus numerosos, variados y profundos errores; otros ya lo han hecho, con brillantez. Lo que se pretende aquí es subrayar hasta qué punto este tipo de argumentos revelan el daño que hace el afán de simplicidad enfrentado a la complejidad del conocimiento científico. Porque puramente por casualidad y coincidiendo con el artículo citado la revista The Scientist publicó un amplio repaso de lo que la ciencia conoce ahora mismo sobre la celiaquía, las intolerancias alimentarias no celiacas, su prevalencia, causas y posibles orígenes, además de potenciales avenidas de tratamiento. A diferencia de la elegante, plausible y equivocada explicación defendida por Rosa Montero lo que conocemos es mucho más complejo.

La prevalencia de estas enfermedades está aumentando, es cierto, y no sabemos por qué; pero no se debe a transgénicos (que no están en nuestros campos de cultivo) y mucho menos a que la labor del gran Norman Borlaug y la Revolución Verde crearan nuevos tipos de trigo con un gluten distinto, cosa que no hizo. Sabemos que la verdadera intolerancia celiaca se comporta como una enfermedad autoinmune, creando respuesta de nuestras defensas no sólo contra algunas de las proteínas del gluten, sino sobre células propias del cuerpo. Hay un componente genético, pero resulta que casi el 40% de la población lleva variantes génicas relacionadas con la enfermedad y sólo entre el 1 y el 3% del total la desarrollan, y aún no conocemos el agente detonante que podría ser cualquier cosa en nuestro medio ambiente, tal vez la más insospechada. Existen, además, intolerancias a los cereales que no están relacionadas con el gluten, pero que pueden interactuar modificando el curso de la enfermedad.

Los síntomas abdominales son los más típicos y pueden dañar el intestino, pero ahora están apareciendo otros de síntomas en adultos (osteoporosis, anemia) cuya conexión no conocemos. Sabemos que la composición del microbioma intestinal es diferente en los celiacos, pero no sabemos de qué manera afecta a la enfermedad; aunque resulta que al menos parte del aumento del número de casos podría deberse a nuestra exitosa lucha contra las úlceras de estómago, porque la presencia de Helicobacter pylori (la bacteria que causa muchas de ellas) coincide con menos celiaquía. Y sabemos que en algunas circunstancias la infección deliberada con parásitos, como lombrices intestinales, alivia a algunos enfermos, pero no sabemos cómo ni por qué. Hay pocas certezas y muchos factores en juego. En otras palabras: es complicado.

Sería mucho más sencillo, comprensible y satisfactorio tener un único enemigo contra el que poder luchar. Sería mucho más heroico que ese enemigo tuviese defensores poderosos para así luchar hasta derrotarlos en defensa de la verdad. Sería mucho más elegante y plausible que las cosas tuviesen una explicación sencilla. Pero la realidad no es así. En ciencia muchos fenómenos surgen de la interacción de múltiples factores, lo que complica entenderlos. Por eso uno de los principios metodológicos básicos es el reduccionismo: controlar los factores que participan en un sistema complejo y modificarlos de uno en uno, de modo controlado y sistemático, para detectar cuáles influyen y de qué manera afecta cada uno. Cuando se trata de objetos o seres vivos es fácil realizar este tipo de investigación en un laboratorio. Pero cuando se trata de seres humanos no se pueden hacer experimentos, así que hay que usar los grandes números, las estadísticas y la historia para intentar conseguir los datos. Esto obliga a tratar con múltiples factores y a usar sofisticados métodos de análisis para separar sus efectos. El proceso no es simple y puede conducir a errores que luego hay que corregir, pero es el único disponible.

Esto exige años de estudio, décadas de dedicación, grandes presupuestos, captación de datos a gran escala, y también personas que dedican su carrera y deben vivir con la posibilidad, siempre presente, de que el trabajo de su vida resulte ser uno de esos errores que se descartan en los pies de página de los libros de ciencia. Exige mucho trabajo mental sin ninguna garantía de que el resultado final sea positivo y con la certeza de que, aun siéndolo, la explicación nunca será elegante y sencilla sino retorcida, compleja, llena de excepciones y sutilezas difíciles de entender. La práctica de la ciencia a veces genera la sensación de estar golpeándote la cabeza contra la pared, de estar desperdiciando tu vida dedicándote a pensar con feroz intensidad en resolver un problema que no se puede resolver. Y hacerlo antes de que los chinos, o los estadounidenses, lo consigan antes que tú.

Cuánto más fácil es buscar un culpable, un enemigo malvado, plausible y que explique todo y enfocar en la ira sobre esa imagen, sobre todo cuando lo que se quiere es la explicación de un sufrimiento humano real; cuánto más satisfactorio sentirse seguro y lleno de justicia con una explicación simple y un enemigo claro en lugar de frustrado, inseguro e incluso ignorante. La ciencia no ofrece respuestas sencillas, ni morales, ni justas: busca respuestas reales. El cerebro a veces prefiere ahorrarse el trabajo y las dudas, y es comprensible: siempre es más fácil remar a favor que en contra de la corriente. Pero aunque cueste más trabajo hay que ir donde está la verdad; por eso merece la pena. Aunque sea complicado.

Sobre el autor: José Cervera (@Retiario) es periodista especializado en ciencia y tecnología y da clases de periodismo digital.

El artículo Ciencia: es complicado se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- De los héroes de la ciencia y sus frágiles teorías

- La ciencia y la duda

- Buscar vida extraterrestre va a ser un poquito más complicado

Nektarra jateak dakarren korapiloa

Juan Ignacio Pérez eta Miren Bego Urrutia Janaria

Juan Ignacio Pérez eta Miren Bego Urrutia Janaria ———————————————————————————————————–

Kolibriak hegazti txikienak dira eta nektarra da haien janari nagusia. Nektarra diluzio bat da, intsektuak eta hegazti polinizatzaileak erakartzeko zenbait landareren loreek sortzen duten ur-diluzioa. Hori dela eta, kolibriek 12 ordutan zurrupatu behar duten ur kantitatea haien masaren halako 5 baino gehiago da, eta hori, bistan da, ur asko da, gehiegi beharbada.Ur gehiegi edaten duten animalietan hiperhidratazioa gerta daiteke, hots, urez pozoitzea. Gezurra badirudi eta arraro samarra bada ere, noiz edo noiz hori gertatzen zaie gizabanakoei, gaixotasun batzuen ondorioz batik bat. Paradoxikoa izanik ere, gastroenteritisak, esaterako, hiperhidratazioa ekar dezake. Izan ere, barne-medioaren gatz-kontzentrazioa gehiegi behera daiteke ur gehiegi edaten denean, eta barne-likidoen bolumen handia galdu ondoren gerta daiteke hori. Hori dela eta, zenbait kirolari hil ere egin dira lehiatzen ari ziren bitartean, urez pozoituta. Hiperhidratazioaren zantzuak aurkitu zituzten Andy Warhol artista ezagunaren gorpuan ebakuntza baten osteko bihotz-arritmia baten ondorioz hil zenean. Garunaren funtzioan eragiten ditu kalterik larrienak hiperhidratazioak, zeren barne-medioa gehiegi diluitzen denean neuronen zitoplasmaren eta barne-medioaren arteko elektrolitoen balantzea desorekatu egiten baita. Ezaguna denez, elektrolitoen oreka ezinbestez gorde behar da nerbio-bulkada behar bezala sortu ahal izateko.

Irudia: Odol beroko animaliarik txikiena Kuban bizi da, eta ez da satitsu etruskoa: erle-kolibria da. Mellisuga helenae du zientzia-izena eta “pájaro mosca” edo “zunzuncito” esaten diote gaztelaniaz.

Naturan animalia gutxi egon daitezke hiperhidratazioa pairatzeko arriskuan. Anfibioak egon litezke egoera horretan, larruazal iragazkorra dutelako, baina gernu-bolumen handiak ekoitziz konpontzen dute arazoa; anfibioen gernua, bestalde, oso diluitua da, kasik ez du gatzik, haien giltzurruna oso eraginkorra baita gernutik gatzak berreskuratzen. Ur gezetako arrain teleosteoak ere, urez pozoitu litezke uraren sarrera saihesteko modurik izango ez balute, baina “Ura, bizitzarako ezinbestekoa” atalean ikusi dugun bezala, oso eraginkorrak dira diluzioaren aurka dituzten hiru hesiak [1].

Uretako animalia horiek, beraz, badituzte gehiegizko uraren arazoa saihesteko modu egokiak, bestela ezingo lirateke ur gezetan bizi. Kolibriek ere, lehenago emandako arrazoi bitxiagatik, antzeko arazoei aurre egin behar diete. Kolibriek urarekin duten arazoa ez da arazo makala. Izan ere, uretan bizi diren anfibioek baino ur-sarrera handiagoak pairatzen dituzte.

Kolibrien hesteak nektarraren ur osoaren zati txiki bat bakarrik xurgatzen duela pentsatzen zen hasieran, baina gero frogatu da ezetz, gehiena xurgatzen duela. Ez zen ideia txarra, hala ere, horixe baita Nectariniidae familiako eguzki-txoriek [2] egiten dutena.

Zurrupaturiko uraren % 80 xurgatzen dute kolibriek eta, beraz, giltzurrunak kanporatu behar du ur gehiena. Hortaz, oso eraginkorra da haien giltzurruna, eta oso malgua gainera; azken batean, egunez lan handia egin behar badu ere, gauez ez du ia lanik egiten, kolibriak lozorroan sartzen baitira, eta giltzurrunak ez baitu ia gernurik sortzen.

Hala eta guztiz ere, urarena ez da arazo makala, giltzurrunak mugak dituelako, oso eraginkorra eta ahaltsua bada ere. Izan ere, litekeena da kolibriak toki beroetan bizitzera behartuta egotea. Toki hotzetan animalia homeotermoek bero gehiago galtzen dute eta, ondorioz, toki hotzetan beroetan baino gehiago jan behar dute. Baina kolibriek nekez jan lezakete jaten dutena baino gehiago, giltzurrunak askoz ere ur gehiago prozesatu beharko bailuke orduan. Hortaz, ingurune hotzetan jarritako kolibriek pisua galtzen dute, gehiegizko ur-arazoa dela medio beharko luketen nektar guztia jan ezin dezaketelako.

Lehen esan bezala, bestelakoa da eguzki-txorien jokabide fisiologikoa. Eguzki-txoriek ez dute zurrupatu duten ur guztia xurgatzen, % 60 baztertu baitezakete. Ez dakigu zein den hori egiteko erabiltzen duten mekanismoa, baina badakigu txori horientzat behar-beharrezkoa dela horrela jokatzea, bizi diren tokietan askotan hotza egiten duelako.

Horrelakoxe korapiloak ditu bizitzak: tamaina, tenperatura, giltzurrun-funtzioa eta elikatze-modua, lau faktore horiek batera eragiten diote kolibrien banaketa geografikoari. Bai korapilo ederra!

Oharrak:

[1] Larruazal iragazkaitza da lehen hesia; gernu-bolumen handia ekoizteak eta gernuko gatz-kontzentrazioa oso apala izateak osatzen dute bigarren hesia; eta gatzen barneratze aktiboa dugu hirugarrena. Azken hau da, izan ere, urez pozoitzea eragozten duena, barne-medioaren diluzioaren aurkako berezko mekanismoa baita.

[2] Familiaren izen zientifikoak dioen bezala, txori horiek ere nektar-jaleak dira.

—————————————————–

Egileez: Juan Ignacio Pérez Iglesias (@Uhandrea) eta Miren Bego Urrutia Biologian doktoreak dira eta UPV/EHUko Animalien Fisiologiako irakasleak.

—————————————————–

Artikulua UPV/EHUren ZIO (Zientzia irakurle ororentzat) bildumako Animalien aferak liburutik jaso dugu.

The post Nektarra jateak dakarren korapiloa appeared first on Zientzia Kaiera.

Cómo el Ártico se volvió salado

El Océano Ártico fue una vez un gigantesco lago de agua dulce. Sólo después de que el puente terrestre entre Groenlandia y Escocia se hubiese sumergido lo suficiente, grandes cantidades de agua salada llegaron desde el Atlántico. Con la ayuda de un modelo climático, investigadores del Instituto Alfred Wegener (Alemania) han demostrado cómo tuvo lugar este proceso, permitiéndonos por primera vez comprender con mayor precisión cómo se desarrolló la circulación atlántica que conocemos hoy.

Cada año, aproximadamente 3.300 kilómetros cúbicos de agua dulce fluyen hacia el océano Ártico. Esto equivale al diez por ciento del volumen total de agua que todos los ríos del mundo transportan a los océanos al año. En el clima cálido y húmedo del Eoceno (hace entre 56 a 34 millones de años), la afluencia de agua dulce probablemente fue aún mayor. Sin embargo, a diferencia de hoy, durante ese período geológico no hubo intercambio de agua con otros océanos. La afluencia de aguas salinas del Atlántico y del Pacífico, que hoy encuentra su camino al Océano Ártico desde el Pacífico a través del estrecho de Bering y desde el Atlántico Norte a través de la cresta Groenlandia-Escocia, no era posible. La región que hoy está sumergida estaba por encima del nivel del mar en ese periodo.

Sólo una vez que desapareció el puente terrestre entre Groenlandia y Escocia, surgieron los primeros pasos oceánicos, conectando el Ártico con el Atlántico Norte y haciendo posible el intercambio de agua. Utilizando un modelo climático, los investigadores han simulado con éxito el efecto de esta transformación geológica en el clima. En sus simulaciones, sumergieron gradualmente el puente terrestre a una profundidad de 200 metros, un proceso tectónico de inmersión que en la realidad duró varios millones de años. Curiosamente, los mayores cambios en los patrones de circulación y las características del Océano Ártico sólo se produjeron cuando el puente de tierra había alcanzado una profundidad de más de 50 metros por debajo de la superficie del océano.

Esta profundidad umbral corresponde a la profundidad de la capa superficial de mezcla, esto es, la capa que determina dónde termina el agua superficial relativamente ligera del Ártico y comienza la capa subyacente de agua densa que entra del Atlántico Norte. Sólo cuando la cresta oceánica se encuentra por debajo de la capa de mezcla superficial puede el agua salina más pesada del Atlántico Norte fluir hacia el Ártico con relativamente poco obstáculo. Por tanto, solo una vez que el puente entre Groenlandia y Escocia había alcanzado esta profundidad crítica, se creó el Océano Ártico salino como lo conocemos hoy. La formación de los pasos oceánicos desempeña un papel vital en la historia del clima global, ya que conlleva cambios en el transporte de energía térmica en el océano entre las latitudes media y polar.

La teoría de que la Cuenca Ártica estuvo una vez aislada se apoya en el descubrimiento de fósiles de algas de agua dulce en los sedimentos de aguas profundas del Eoceno que se obtuvieron durante una campaña de perforación internacional cerca del Polo Norte en 2004. Lo que una vez fue un puente terrestre ahora se encuentra alrededor de 500 metros bajo el océano y está formado casi enteramente de basalto volcánico. Islandia es la única sección que queda por encima de la superficie.

Referencia:

Michael Stärz, Wilfried Jokat, Gregor Knorr, Gerrit Lohmann (2017) Threshold in North Atlantic-Arctic Ocean circulation controlled by the subsidence of the Greenland-Scotland Ridge. Nature Communications. DOI: 10.1038/NCOMMS15681

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

Este texto es una colaboración del Cuaderno de Cultura Científica con Next

El artículo Cómo el Ártico se volvió salado se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El óxido de grafeno que se mueve como una oruga y coge cosas como una mano

- Y el Sol se volvió azul

- Cómo usar a las ballenas como detectores de radiación

El teorema de los cuatro colores (y 4): ¿Podemos creer la prueba de la conjetura?

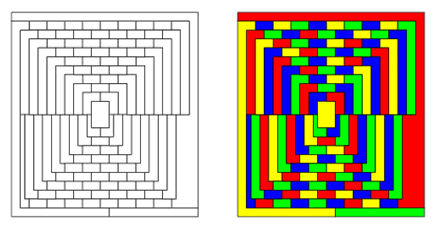

En 1975, el divulgador científico Martín Gardner (1914-2010) publicaba un artículo (ver [1]) en el que afirmaba que el denominado mapa de Mc.Gregor –de 110 regiones– precisaba necesariamente de cinco colores para pintarse, sin que dos regiones adyacentes compartieran color. Es decir, proponía un contraejemplo al teorema de los cuatro colores. ¿Por qué continuaron entonces Appel y Haken intentando demostrar el resultado planteado por Guthrie en 1852?

El artículo de Gardner se publicó el 1 de abril de 1975, el Día de los inocentes en los países anglosajones. Muchos lectores, contrariados, enviaron a Gardner propuestas de coloreado del mapa de Mc.Gregor, para mostrarle que su afirmación era errónea.

El mapa de Mc.Gregor y la propuesta de 4-coloreado de Stan Wagon (1951).

Lo raro es que esos lectores no fueran conscientes de que se trataba de una simple broma; en ese artículo Gardner hablaba de Seis descubrimientos sensacionales que de alguna manera han escapado a la atención pública. En efecto, el divulgador:

-

‘mostraba’ una refutación de la teoría de la relatividad de Einstein, a través de un experimento del físico británico Humbert Pringl;

-

‘anunciaba’ el descubrimiento –en el Codex Madrid I y por parte de Augusto Macaroni de la Universidad Católica de Milán– de que Leonardo de Vinci había inventado el retrete auto-limpiable con el agua de su cisterna;

-

‘comentaba’ la demostración de Richard Pinkleaf –con ayuda del ordenador MacHic– de que en ajedrez, el movimiento de apertura de peón a cuatro torre de rey gana siempre la partida;

-

‘notificaba’ el sorprendente resultado –obtenido por John Brillo de la Universidad de Arizona– de que la base de los logaritmos naturales, el número e,elevado a π(163)½ es el número entero 262.537.412.640.768.744;

-

‘anunciaba’ la construcción –debida al parapsicólogo Robert Ripoff– de un motor funcionando con energía mental; y

-

‘notificaba’ el descubrimiento –por parte del especialista en teoría de grafos William McGregor– del famoso mapa del que hemos hablado antes.

Así que es lógico que, tras el 1 de abril de 1975, se continuara con la búsqueda de una demostración del teorema de los cuatro colores… Durante el largo proceso hasta llegar a su prueba, se desarrollaron teorías matemáticas como la teoría de grafos y de redes. Es decir, ni los errores ni los aciertos intentando demostrar este teorema fueron nimios; todos ellos ayudaron a la puesta a punto de este primer gran teorema demostrado –¿verificado?– usando un ordenador.

Pero, ¿es realmente una demostración? ¿Se puede garantizar la corrección de la compilación realizada por un ordenador? ¿Las computadoras son infalibles? Tras la demostración del teorema de los cuatro colores con ayuda de ordenadores, otras pruebas se apoyaron en este método, como la clasificación de los grupos simples finitos (2004) –que depende de cálculos imposibles de ejecutar con detalle a mano– o la solución de Thomas Hales (1998) del problema de Kepler sobre el empaquetamiento óptimo de esferas. Pero, ¿se puede aceptar como válida una afirmación que sólo una máquina, y no una mente humana, puede comprobar?

¿Qué es una demostración? El filósofo de la ciencia Imre Lakatos (1922-1974) la define (ver [3]) como: “Una sucesión finita de fórmulas de algún sistema dado, donde cada uno de los pasos de la sucesión es o bien un axioma del sistema, una fórmula derivada por una regla del sistema a partir de una fórmula precedente”.

Por su parte, el filósofo Thomas Tymoczko (1943-1996) califica una demostración como algo (ver [6]): convincente –debería persuadir incluso a los escépticos que dudan de la veracidad del resultado–, formalizable –la conclusión debería alcanzarse partiendo de sistemas axiomáticos–, y comprobable.

Este último es el aspecto más controvertido en el caso del teorema de los cuatro colores. ¿Puede estar un teorema probado si no se puede leer (comprobar) su demostración?

Existen dos corrientes principales que intentan responder a este dilema:

Los escépticos opinan que el aspecto de la comprobabilidad es el que pone en duda la credibilidad de la prueba. Si las pruebas deben ser verificadas, parece que entonces una persona –lo opuesto a una máquina– debe completar esta tarea: esto no puede hacerse con la prueba del teorema de los cuatro colores.

El matemático Paul Halmos (1916-2006) opinaba que la demostración realizada con un ordenador tiene la misma credibilidad que si está hecha por un adivino…Y afirmaba: “No puedo aprender nada de la demostración. La prueba no indica la razón por la que sólo se necesitan 4 colores ¿por qué no 13? ¿Qué tiene de especial el número 4?”.

El matemático Pierre Deligne (1954) comentaba: “No creo en una prueba hecha con ordenador. En primer lugar, soy demasiado egocéntrico. Creo en una demostración si la entiendo, si está clara. Un ordenador puede también cometer errores, pero es mucho más difícil encontrarlos”.

Tymockzo afirma que usar un ordenador para establecer una verdad matemática es transformar pruebas en experimentos. Afirma que el teorema de los cuatro colores ha sido confirmado a través de un experimento de física teórica, pero no probado de una manera formal. Aunque se tiene una pequeña idea de lo que el ordenador está testando, no se tiene la seguridad de lo que se está haciendo.

Los no escépticos, por su parte, argumentan del siguiente modo:

-

aunque las equivocaciones cometidas por los ordenadores son más difíciles localizar, los seres humanos fallan con más frecuencia; los ordenadores siguen un programa rígido predeterminado, y no tienen tropiezos motivados por los cambios de humor, el estrés u otros factores externos;

-

la longitud de algunas demostraciones sobrepasa la capacidad de computación humana, pero es perfectamente aceptable por los estándares de las máquinas;

-

la idea de que no pueden usarse ordenadores va a ser cada vez más insólita para las generaciones futuras: los ordenadores serán –¿son?– herramientas como el lápiz y el papel…

-

la prueba de Appel y Haken es, en esencia, tradicional, ya que consiste en una serie de pasos lógicos, que conducen a la conclusión de que la conjetura puede reducirse a una predicción sobre el comportamiento de unos2.000 mapas.

¿Quiénes tienen razón?

Para añadir un poco más de incertidumbre al tema, el filósofo Hud Hudson afirmaba dar en [2] un contraejemplo al teorema de los cuatro colores: presentaba el mapa de Zenopia, una isla formada por seis provincias que necesita seis tonos para colorearse… Entonces, ¿es falso el teorema de los cuatro colores? No, no hay que preocuparse: Zenopia es un mapa con fronteras extrañas, cuya especial geografía queda excluda del enunciado original del teorema…

Bibliografía

[1] Martin Gardner, Mathematical Games: Six Sensational Discoveries that Somehow or Another have Escaped Public Attention, Scientific American 232, 127-131, 1975

[2] Hud Hudson, No basta con cuatro colores, Gaceta de la RSME 8(2), 361-368, 2005.

[3] Imre Lakatos, What does a mathematical proof prove?, Cambridge Univers¡ity Press, 540-551, 1979.

[4] Marta Macho Stadler, Mapas, colores y números, Descubrir las matemáticas hoy: Sociedad, Ciencia, Tecnología y Matemáticas 2006 (2008) 41-68

[5] E.R. Swart, The philosophical implications of the four-colour theorem, American Mathematical Montlhy 87, 697-707, 1980

[6] Thomas Tymoczko, The four-color problem and its philosophical significance, Journal of Philosophy 76, 57-70, 1979

[7]Robin .J. Wilson, Four colors suffice: how the map problem was solved, Princeton University Press, 2002

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo El teorema de los cuatro colores (y 4): ¿Podemos creer la prueba de la conjetura? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El teorema de los cuatro colores (2): el error de Kempe y la clave de la prueba

- El teorema de los cuatro colores (3): Tras más de un siglo de aventura… ¿un ordenador resuelve el problema?

- El teorema de los cuatro colores (1): una historia que comienza en 1852

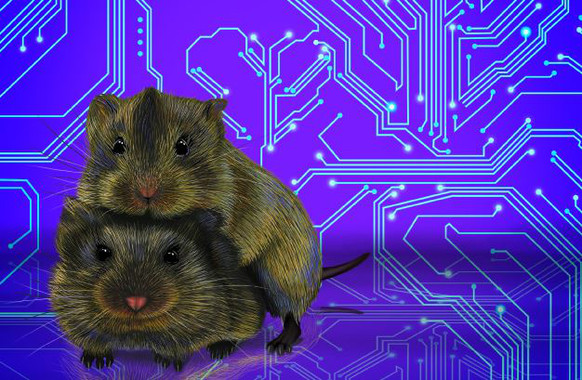

Lursaguek dute maitasunaren gakoa

Abiapuntua bazuten zientzialariok. Izan ere, aurrez beste lan batzuek iradoki izan dutenez, oxitozina eta dopamina bezalako gai kimikoek garuneko bi erregiotan esku hartzen dute, lursaguen arteko bikote loturak sustatze aldera: kortex prefrontal mediala (erabakiak hartzearekin zerikusia duen atala) eta accumbens nukleoa (sari sistema, plazera…) dira bi erregioak. Horiek sakon aztertuta, bikote loturak bideratzen dituen jarduera neural zehatza aurkitzea zen lan honen gakoa.

1. irudia: Microtus ochrogaster lursaguek bikotekide bakarrarekin partekatzen dute bizitza osoa. (Argazkia: Emory Unibertsitatea)

Zunda elektrikoak baliatuta, lursagu emeen garuneko bi erregio horien arteko komunikazio neurala grabatu eta entzun zuten ikertzaileek, arrekin hartu-emanetan zeuden bitartean. Hau da, bikotekide potentzial bat aurkitu, lehenbizikoz harekin ernalketa izan eta, ondotik, biziarteko lotura osatu dutela erakusten duten adierazleak (ez dira gizakiengandik hain desberdinak zentzu horretan, elkarri lapa-lapa eginda ibiltzen baitira) agertzen diren arteko prozesu guztia jarraitu zuten, emearen burmuinari begira.

Ondorioztatu dutenez, erabakiak hartzen dituen kortex prefrontalak lagundu egiten dio sari sistemaren erdigunea den accumbens nukleoari, bertan dauden neuronen oszilazio erritmikoak kontrolatuta. Bi alorren arteko konexio funtzionala iradokitzen du horrek. Gainera, ikertzaileok ikusi dutenez, konexio funtzional horren indarra desberdina da kasu bakoitzean, eta konektibitate sendoena erakusten duten emeak dira balizko bikotearenganako lotura azkarren erakusten dutenak.

Are gehiago, lehen ernalketak bizkortu egin ohi du lursagu bikotearen arteko harremana, eta garuneko konexio funtzionala ere sendotzen duela egiaztatu dute. Konexio horrek zer indar duen eta animaliok bikote lotura zer azkar (edo motel) egiten duten, korrelazioa dago bi aldagai horien artean. Era berean, emeak ar zehatz batekin bikotea osatzeko duen probabilitatea aurresan daiteke, garuneko bi erregioen arteko komunikazio mailari erreparatuta.

2. irudia: Gerora, autismoa bezalako gaitzei aurre egiten ere lagun dezake ikerketa ildo honek.

(Argazkia: Darryl Leja, National Human Genome Research Institute / CC BY 2.0 lizentziapean)

Horiek guztiak ikusita, jarraian, ikertzaileek artifizialki aktibatu zuten garuneko bi erregioen arteko zirkuitu neurala, optogenetikaren bitartez. Hala, lursagu emeen kortex prefrontalaren eta accumbens nukleoaren arteko komunikazioa indartu zuten teknika horrekin. Optogenetika bidezko estimulazioa baliatzen zuten bitarte horretan, emea ar baten ondoan jarri zuten, baina ez zegoen ez ernalketarik, ez eta kontaktu fisiko txikienik ere haien artean, arra kopa garden baten azpian baitzegoen. Harreman hori ahulegia da, berez, lursaguen arteko bikote lotura osatzeko, baina estimulazio artifizialaren ondorioz, ar horrekin bizi arteko harreman sendoa izango balu bezala hasi zen jokatzen emea.

Epe luzera begira, ikerketa ildo honetatik, erronka are zailago bati heldu nahi diote Emory Unibertsitateko kideek, Robert Liu arduradunak azaldu duenez: “Oro har komunikazio neural hobea sustatzea da gure helburua, adibidez autismoaren moduko gaitzen kasuan, kognizio sozialari bultzada emateko”.

Erreferentzia bibliografikoa:

Elizabeth Amadei et al. Dynamic corticostriatal activity biases social bonding in monogamous female prairie voles. Nature (2017). Published online 31 May 2017. DOI: 10.1038/nature22381

———————————————————————————-

Egileaz: Amaia Portugal (@amaiaportugal) zientzia kazetaria da.

———————————————————————————

The post Lursaguek dute maitasunaren gakoa appeared first on Zientzia Kaiera.

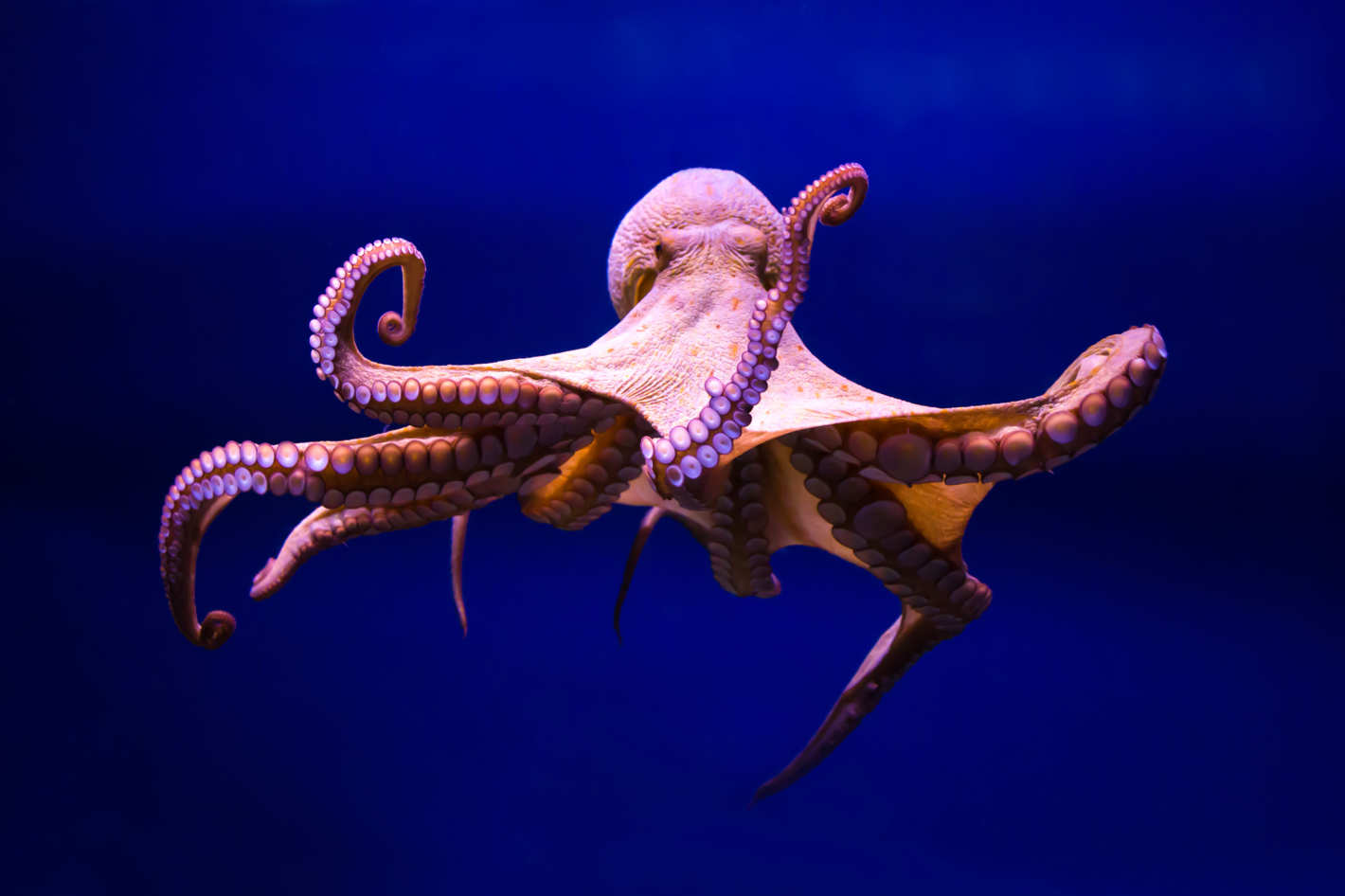

Evolución de los sistemas nerviosos: moluscos

El rasgo más característico del sistema nervioso de los moluscos es la gran importancia relativa que tiene su sistema periférico. En todos los grupos de moluscos se da alguna forma de coalescencia de neuronas que dan lugar a ganglios o encéfalos. Cefalópodos y gasterópodos presentan encéfalos bien definidos, aunque de diferente grado de complejidad y desarrollo. Los bivalvos disponen de ganglios, encefálicos y viscerales, que cumplen funciones análogas a las de los encéfalos de los anteriores. Pero además, todos ellos disponen de un extenso sistema periférico que comprende plexos nerviosos subepidérmicos y pequeños ganglios periféricos. Los ganglios periféricos son responsables del control reflejo y del procesamiento sensorial primario de órganos especiales, tales como branquias o palpos de bivalvos, y en numerosas ocasiones ambos sistemas intervienen de forma coordinada en el desarrollo de algunos comportamientos.

La importancia tan grande del sistema periférico parece deberse a la condición de animales de cuerpo blando y al hecho de tener un esqueleto hidrostático. Al disponer de una compleja y bien organizada musculatura en la superficie corporal, un control preciso a cargo del sistema central requeriría de un muy elevado número de neuronas centrales, por lo que resulta mucho más económico, desde el punto de vista de la organización nerviosa disponer de una extensa organización periférica responsable del control local. La ausencia de articulaciones impide disponer de sentidos de posición; sin la información que proporcionan los receptores de estiramiento de uniones articuladas, los cefalópodos desconocen la posición de sus brazos; tampoco puede estimar el peso de un objeto, sólo conocer su textura y tamaño. La gran importancia funcional del sistema periférico es lo que, sin embargo, les permite alcanzar los grandes tamaños propios de algunas especies.

El sistema nervioso central de los gasterópodos está formado por pares de ganglios conectados por células nerviosas; hay ganglios encefálicos, pedales, osfradiales, pleurales y viscerales, y en algunos casos, bucales también. En este grupo han surgido dos líneas principales, la de los opistobranquios, por un lado, y la de los prosobranquios y caracoles pulmonados, por el otro. La primera corresponde a animales que han abandonado las actividades de excavación de sus antecesores y que ramonean y pastan libremente, por lo que cuentan con elaborados sistemas de defensa química. Viven en ambientes simples y su sistema nervioso es simple, por lo que el comportamiento de estos animales se caracteriza por un repertorio limitado de subrutinas.

Los prosobranquios y pulmonados, sin embargo, ocupan nichos más complejos y presentan ganglios encefálicos más desarrollados, a la vez que sistemas sensoriales de alta resolución. Son capaces de desarrollar comportamientos de orden superior, muy elaborados. Un ilustrativo ejemplo de comportamiento elaborado es el del depredador Fusitriton oregonensis, que adhiere su puesta a la roca y patrulla la zona para rechazar a posibles depredadores; los detecta gracias a ojos muy desarrollados y los ataca propinándoles golpes con sus conchas.

Dada la condición sedentaria de la mayoría de los bivalvos, su sistema nervioso es bastante más simple que el del resto de moluscos. Carecen de un encéfalo, y el sistema consiste en una red nerviosa y una serie de pares de ganglios. En la mayoría de bivalvos hay dos ganglios cerebro-pleurales, a cada lado del esófago, los cerebrales controlan los órganos sensoriales y los pleurales la cavidad del manto. Los ganglios pedales controlan el pie, y los viscerales, que se encuentran tras el músculo aductor posterior, pueden llegar a tener gran tamaño en los bivalvos que nadan; los que tienen largos sifones también cuentan con un par de ganglios que los controlan.

Los cefalópodos, por su parte, tienen modos de vida muy activos, viven en un medio tridimensional y son depredadores. Disponen de desarrollados receptores de equilibrio, receptores de posición corporal análogos a la línea lateral de los peces pelágicos, y habilidades fotorreceptoras muy notables; también pueden identificar texturas.

Tienen encéfalos muy desarrollados, con un elevado número de neuronas, y sus comportamientos pueden ser muy elaborados, con alta capacidad de aprendizaje. El sistema periférico también está muy desarrollado. Cada ventosa de un pulpo tiene su propio ganglio periférico, aunque también está comunicado con el sistema nervioso central. Los ganglios realizan integración quimio y mecanorreceptora y son responsables del control motor de la ventosa.

El sistema central y el periférico actúan en serie y en paralelo. Los comportamientos complejos suelen generarse en el central, aunque el periférico puede participar en la recepción del estímulo y en el control motor final. En los moluscos se producen tanto comportamientos fijados como no fijados. Ejemplos relativamente bien conocidos de modelos de acción fijos son la natación de huida del opistobranquio Tritonia, que está basado en un grupo de cuatro neuronas del sistema nervioso central, y el comportamiento ventilatorio de la branquia de Aplysia. Sin embargo, el comportamiento alimenticio –en el que intervienen el encéfalo y los ganglios bucales-, o el de rechazo de alimento de gasterópodos –en el que interviene el ganglio abdominal- son buenos ejemplos de comportamientos no fijados.

Por último, hay plasticidad en el comportamiento y la actividad neural de moluscos debido a fenómenos de plasticidad de los reflejos simples (habituación, sensitización, aprendizaje asociativo) y a la capacidad para modificar taxias y desarrollar comportamientos complejos gracias al aprendizaje asociativo.

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo Evolución de los sistemas nerviosos: moluscos se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Evolución de los sistemas nerviosos: cnidarios y gusanos no segmentados

- Moluscos en el Arte

- Evolución del tamaño animal

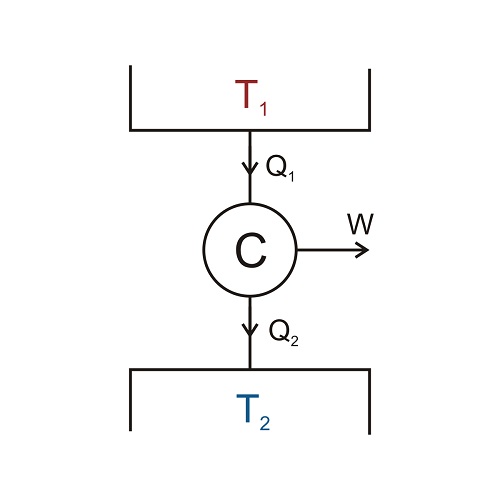

Carnot y los comienzos de la termodinámica (1)

Carnot fue uno de de los ingenieros franceses que se propusieron estudiar los principios científicos subyacentes al funcionamiento de la máquina de vapor con el objetivo de lograr la máxima potencia de salida con la máxima eficiencia. Como resultado de sus estudios, Carnot y otros ayudaron a establecer la física del calor, lo que se conoce como termodinámica.

Nicolas Léonard Sadi Carnot (1796-1832), en este imagen vistiendo el uniforme de estudiante de L’École polytechnique, fue hijo de Lazare Carnot, uno de los generales de confianza de Napoléon. Murió a los 36 años como conseuencia de la epidemia de cólera que se extendió por Europa en la época.

Carnot comenzó con la observación experimental de que el calor no fluye por sí solo de un cuerpo frío a uno caliente. Se deduce entonces que si, en una situación dada, se hace fluir calor de lo frío a lo caliente, debe tener lugar algún otro cambio en otra parte. Es decir, debe realizarse algún trabajo. Por ejemplo, un refrigerador o un acondicionador de aire son también “máquinas térmicas”, pero su ciclo funciona de manera inversa a una máquina de vapor o un motor de automóvil. Hace falta trabajo (en forma de energía eléctrica o mecánica) para bombear el calor de un cuerpo frío (desde el interior del compartimento o la habitación fríos) a uno más caliente (la habitación donde está el refrigerador o el aire exterior). Utilizando una argumentación muy elegante1 Carnot demostró que ninguna máquina puede ser más eficiente que una máquina ideal y reversible, y que todas las máquinas de este tipo tienen la misma eficiencia.

¿Y que es una máquina ideal y reversible? De entrada algo que no existe en el mundo real (por eso se llama ideal), pero que es extremadamente útil para entender los límites de las máquinas reales. Íntimamente ligado a la idealidad está el concepto de reversibilidad. Una máquina reversible es aquella en la que el ciclo desde la energía de entrada al trabajo de salida más la energía residual, y vuelta a la energía de entrada, se puede ejecutar en sentido inverso sin ninguna pérdida o ganancia adicional de calor u otras formas de energía.

Como todas las máquinas reversibles tienen la misma eficiencia, sólo se tiene que elegir una versión simple de una máquina reversible y calcular su eficiencia para un ciclo para encontrar un límite superior a la eficiencia de cualquier máquina. Esta máquina simple se representa esquemáticamente en el siguiente diagrama. Durante un ciclo de funcionamiento, la máquina, representada por la C de Carnot, absorbe la energía térmica Q1 del cuerpo caliente a temperatura T1, produce un trabajo útil W, y descarga una cierta cantidad de energía térmica Q2 al cuerpo frío a temperatura T2. El ciclo puede repetirse muchas veces.

Observando el diagrama y empleando la ley de conservación de la energía vemos que se tiene que cumplir que Q2 = Q1 – W; o, dicho en términos coloquiales, el calor que sale es la diferencia entre el que entra menos el trabajo que realiza la máquina. Pero, como la eficiencia vimos que era la proporción entre la energía de salida (ahora añadimos “útil”, esto es, el trabajo) y la energía de entrada, tenemos que ef = W/Q1.

Carnot calculó la eficiencia de este ciclo esquemático y encontró que las proporciones de calor y trabajo en una máquina reversible dependen solamente de la temperatura2 de la sustancia caliente desde la cual la máquina obtiene el calor y la temperatura2 de la sustancia fría que extrae el calor residual de la máquina.

La expresión que encontró Carnot para la eficiencia de las máquinas reversibles es, escrita con nomenclatura actual, ef = W/Q1 = 1 – T2/T1

Démonos cuenta de que la única forma de obtener una eficiencia del 100%, es decir ef = 1, es si hacemos que T2, la temperatura de la sustancia que recibe el calor residual, sea el cero absoluto, algo físicamente imposible, como veremos. Esto significa, de nuevo en términos coloquiales, que toda máquina debe liberar algo de calor residual al exterior antes de volver a tomar más energía del cuerpo caliente. Y esto, tan simple, es de una importancia enorme.

Notas:

1 Una argumentación a la que, por su simplicidad, importancia y valor formativo, dedicaremos una anotación específica.

2 Las temperaturas usadas en este caso se llaman temperaturas absolutas (T), o Kelvin, (por el señor Kelvin que fue el primero en introducir esta escala). En la escala absoluta, las mediciones de temperatura son iguales a las temperaturas (t) en la escala Celsius (°C) más 273. No se usa signo de grado, °, para grados Kelvin, el símbolo utilizado es K. Por tanto, el agua se congela a T = 273 K y cuando T = 0 K hablamos de cero absoluto. Ya explicaremos el origen de esta escala más adelante en la serie.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Carnot y los comienzos de la termodinámica (1) se ha escrito en Cuaderno de Cultura Científica.

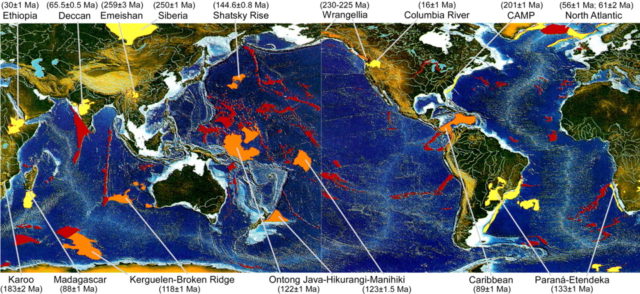

Entradas relacionadas:Lurralde igneo erraldoiak: Lurraren indar-erakustaldia

“Bolkanismo anomalotzat” jotzen da plaken arteko mugetatik urrun gertatzen dena. Ondorioz, onartzen da plaka-tektonikak ezin duela bolkanismo mota hori azaldu. LIPetan pilatutako basalto-bolumenak izugarriak dira; sarritan 1.000-2.000 km-ko diametroko lurraldeak estaltzen dituzte, lodiera kilometrikoa dutelarik (1-5 km); beraz, milioi bat km3 baino basalto gehiago pila daiteke (Elosegi eta Apraiz, 2004). Pilaketa prozesua metro gutxiko laba-kolada bakunen gainezartzaren ondorioa da.

LIPek ezaugarri modura dute, era berean, Geologian laburtzat hartzen den epean azaltzea, eta onartu ohi da 1 ma baino arinago garatzen direla.

Horren epe laburrean horrenbeste arroka igneo azaleratzen delarik, atmosferara gas kantitate izugarriak igortzen dira. Ondorioz, eragina dute bai Lurreko batezbesteko tenperaturan, bai klimatologian, bai eta ozeanoetako baldintzetan, eta zenbait suntsipen biologiko orokor sustatu dituzte.

1. irudia: Fanerozoikoko lurralde igneo erraldoien kokapena (Mahoney eta Coffin, 1997). Kontinente-lurrazalean garatutako basalto-plataformak (flood-basalt) kolore horiarekin daude adierazita, ozeano-lurrazalean kokatutako ozeano-plataformak (oceanic plateau) laranja kolorez. Gorriz, bolkanismo anomaloa adieraten dituzten beste eremuak.

Lurralde igneo erraldoiek daukaten bolumen handia eta isurtze-denbora laburra uztartuz, erraz uler dezakegu produkzio magmatikoa ikaragarrizkoa behar duela, urtero kilometro kubikoa baino handiagoa.

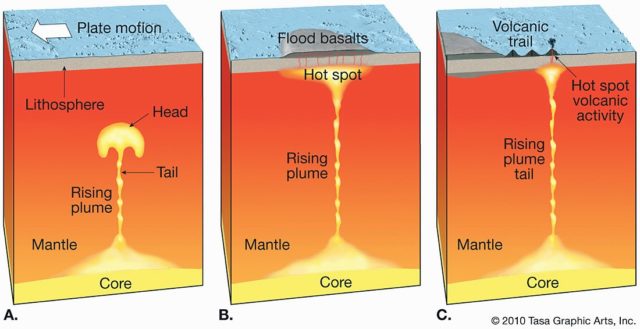

Halako emaria lortzeko mantuak ohiko tenperaturak baino beroagoak behar ditu izan eta magmaren igoera azkarra izan behar da.

Aurrez aipatutako zehaztapenak kontutan hartuz, mendearen hasieran eztabaida sutsua izan zen LIPen jatorria azaltzeko muturreko bi hipotesien artean. Batak mantuko luma gorakorren jarduera (lumen eredua) erabiltzen du eragile gisa, eta besteak, kontinenteko litosferaren lodiera-ezberdintasunetan sortutako, tokian tokiko, konbekzio-korronteak eta mantuaren hetereogeneotasuna (plaken eredua).

Egun, eztabaida baretu da, egindako azken ikerketek zeharo indartu dutelako luma gorakorraren eredua.

Aipagarria da, adibidez, LIP gazte gehienek, sortu zitueneko luma gorakorrekin duten lotura zuzena, bien artean 200-300 km zabal den bolkan-katea edo gandor aseismikoa agertzen baita (2. irudia).

Jakinik LIPen erupzio-proportzioa, lotuta duten bolkan-kateena baino 2-3 magnitude-orden handiagoa dela, luma gorakorren bilakaera logikoa ondorengoa litzateke: luma gorakorren buruek anomalia termiko handia eragiten dute listoferaren azpian, eta horren eraginez, LIPak garatzen dira. Lumaren burua lausotu eta indarra galtzen duenean, lumaren zutabea edo isatsa baizik ez da geldituko, eta zutabe horrek Hawaii-Emperor antzeko bolkan-katea edo gandor aseismikoa baino ez du sortuko, anomalia termiko murritzagoa eragiten duena (2. irudia).

Isatsaren bizia luzea da eta puntu bero bat mantenduko du lurrazalean. Puntu bero horrek, bolkanketa prozesu geologikoki jarraituak izango ditu.

2. irudia: Luma gorakorraren buruak litosferaren oinera iritsita, lurralde igneo erraldoia sortuko du (kasu honetan basalto-plataforma bat). Buruak indarra galtzen duenean aldiz, bolkan-katea edo gandor aseismikoa sortzen da zutabe edo isatsaren eraginez.

Basalto-plataformek eta, ondorioz, luma gorakorrek lotura zuzena dute superkontinenteen edo kontinenteen apurketa prozesuekin. Luma gorakorrek bultzada eragiten dute litosferaren azpian, eta horren eraginez, domo egiturak sortzen dira 1000m-ko altueraraino. Domoek estentsioaren eragipean jartzen dute kontinente-litosfera eta estentsio-indarrek LIPen sorrera erraztu eta ozeano baten garapenarekin buka dezakeen rifting prozesua abiarazten dute.

Rifting prozesua eraginkorra izanik, ozeano berria sortzen denean, normala baino lodiagoa izango da luma gorakorraren eraginpean garatutako ozeano-lurrazala. Aldiz, lodiera normala izan ohi du luma-gorakorren eraginetik urrun sortzen den ozeano-lurrazal berriak. Adibidez, ozeano-lurrazalerako normala dena baino lodiera handiagoa erakusten dute Hego Ameriketako eta Afrikako ertzak Paranáko luma gorakorraren inguruan, Indiako ertzak Deccan luma gorakorraren inguruan edo Groenlandia eta Europako ertzak Islandiako luma gorakorraren inguruan.

LIPen eta kontinenteen apurketaren arteko adin-harremana aspalditik ezaguna da geologoontzat. Azken 300 ma-tan eskala handiko hamar LIP garatu dira. Etiopiakoa da gazteena eta ez dago zalantzetan Itsas Gorriko, Adeneko golkoko eta Eki-Afrikako riftaren sorrerarekin duen harreman estua. Era berean, antzeko harremanak aurkitu dira 55 ma-ko Groenlandiako LIParen eta Ipar Atlantikoaren zabalkuntzaren artean, 66 ma-ko Deccaneko LIParen (3. irudia) eta iparmendebaldeko ozeano Indikoaren irekitzearen artean, 133 ma-ko Paranáko LIParen eta Hego Atlantikoaren irekitzearen artean, 183 ma-ko Karooko LIP-aren eta hegomendebaldeko ozeano Indikoaren zabalkuntzaren artean edo 201 ma-ko Atlantikoaren erdialdeko LIP-aren eta ozeano Atlantikoaren Ekuatore aldeko irekitzearen artean. Hala ere, zalantzak sortzen dituzten salbuespenak ere badaude. Ezagutzen den LIP handienak, Siberiakoak, ez du lotura zuzenik ozeano baten sorrerarekin, nahiz eta bere inguruan estentsioaren aztarnak ugari izan eta arro sedimentario sakonak aurkitu. Baliteke, hasierako estentsio-egoera orokorra kontinenteen apurketa gertatu aurretik aldatu izana eta, ondorioz, arro ozeanikoaren garapena ekiditzea.

3. irudia: Deccaneko LIParen ikuspegi zoragarria. Kilometro bat baino lodiagoa den sekzio honetan oso ondo bereizten dira kolada basaltikoak. Mahabaleshwar, Ghats mendebaldean, India. Hetu Sheth-en argazkia, abenduak, 2005.

Izugarria da Lurralde igneo erraldoiek Lur osoko ingurumenean izan dezaketen eragina. Erupzio basaltikoek sulfuro dioxidoaren, karbono dioxidoaren, kloroaren eta fluorraren kopuru izugarriak igortzen dituzte atmosferara. Bolkanismo-prozesuetan sortzen diren 3-13 km bitarteko erupzio-zutabeen bidez gasak troposferaren goiko aldean eta estratosferaren beheko aldean pila daitezke. Baldintza horietan, berotegi-efektua sortzen duen gasa izanik, Lurreko berotzea eragin dezake karbono dioxidoak. Aldiz, sulfuro dioxidoak aurkako eragina du, eta sasoi hotzak eragin ditzake epe laburrera.

Hain epe laburrean hainbeste arroka bolkaniko azaleratzen delarik, klima-aldaketa azkarrak eragin ditzake atmosferara igortzen den gasak eta, ondorioz, gerta daiteke hainbat organismok baldinza berrietara egokitzeko denborarik ez izatea.

Adibide bat ematearren, Pinatubo bolkanak 20 milioi tona sulfuro dioxido igorri zituen atmosferara 1991. urtean. LIP batean astero Pinatubo antzeko bolkan bat aktibatuko litzateke milaka eta milaka urtean zehar, eta horrela sortuko ziren atmosferan, kliman zein ozeanoen konposizioan aldaketa iraunkorrak. Horrela, klima zein ozeanoetako uren konposizioa suntsipen biologikoak eragiteraino alda daiteke. Frogatu da lotura zuzena dagoela historia geologikoan gertatutako suntsipen biologiko garrantzitsuenen eta LIPen artean (4. irudia) (Courtillot, 1999). Kretazeo-Paleogeno mugan (K/Pg) gertatutako suntsipenak dinosauroen desagerpena, beste hainbat espezieren artean, ekarri zuenak Deccaneko LIPrekin lotzen da. Gaur egun, askok pentsatzen dute K/Pg mugaren aurretik organismo bizidun asko estresatuta zeudela Deccaneko LIPak sortutako klima-aldaketengantik eta Yucatango penintsulan eroritako meteoritoak suntsipena areagotu eta bapatekotu egin zuela. Baina historia geologikoan K/Pg suntsipen orokorraren antzeko eta are suntsipen bortitzagoak gertatu dira (Permiar-Triasiko muga), eta horietarako ez da meteoritoen aztarnarik aurkitu. Zer dugu beraz?

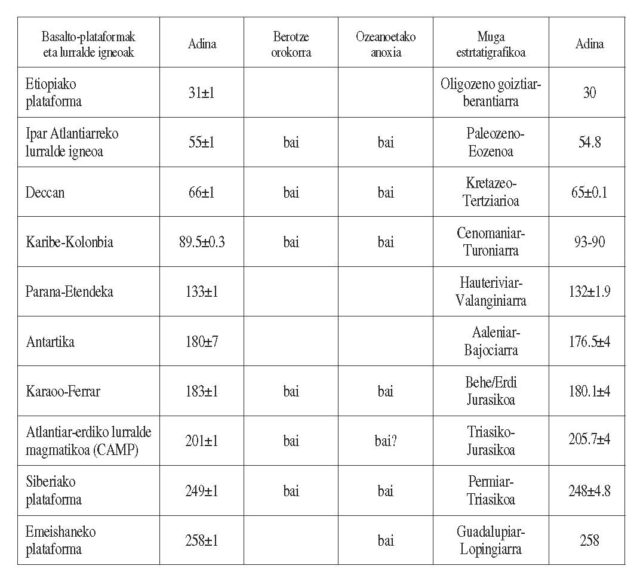

4. irudia: LIP nagusiek Lurreko berotze orokorreko garaiekin, ozeanoetako anoxia garaiekin eta suntsipen biologiko orokorreko garaiekin dituzten adin harremanak.

Erreferentzia bibliografikoak:

- Courtillot, V. (1999): Evolutionary catastrophes: the science of mass extinction. Cambridge Univ. Press, Cambridge.

- Elosegi, M. eta Apraiz, A. (2004): Basalto-plataformak: ezaugarriak, jatorria eta kontinenteen apurketa, eta suntsipen biologiko orokorrekin izan ditzaketen loturak. Ekaia, 18: 31-48.

- Mahoney, J.J. eta Coffin, M.F. (Edk.) (1997). Large Igneous Provinces: Continental, Oceanic, and Planetary Flood Volcanism. Geophys. Monogr., 100.

———————————————————————————-

Egileaz: Arturo Apraiz UPV/EHUko Geodinamika saileko irakaslea eta ikertzailea da.

———————————————————————————-

The post Lurralde igneo erraldoiak: Lurraren indar-erakustaldia appeared first on Zientzia Kaiera.

Historias de la malaria: Charles Louis Alphonse Laveran y el protozoo

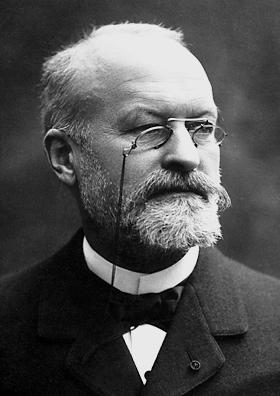

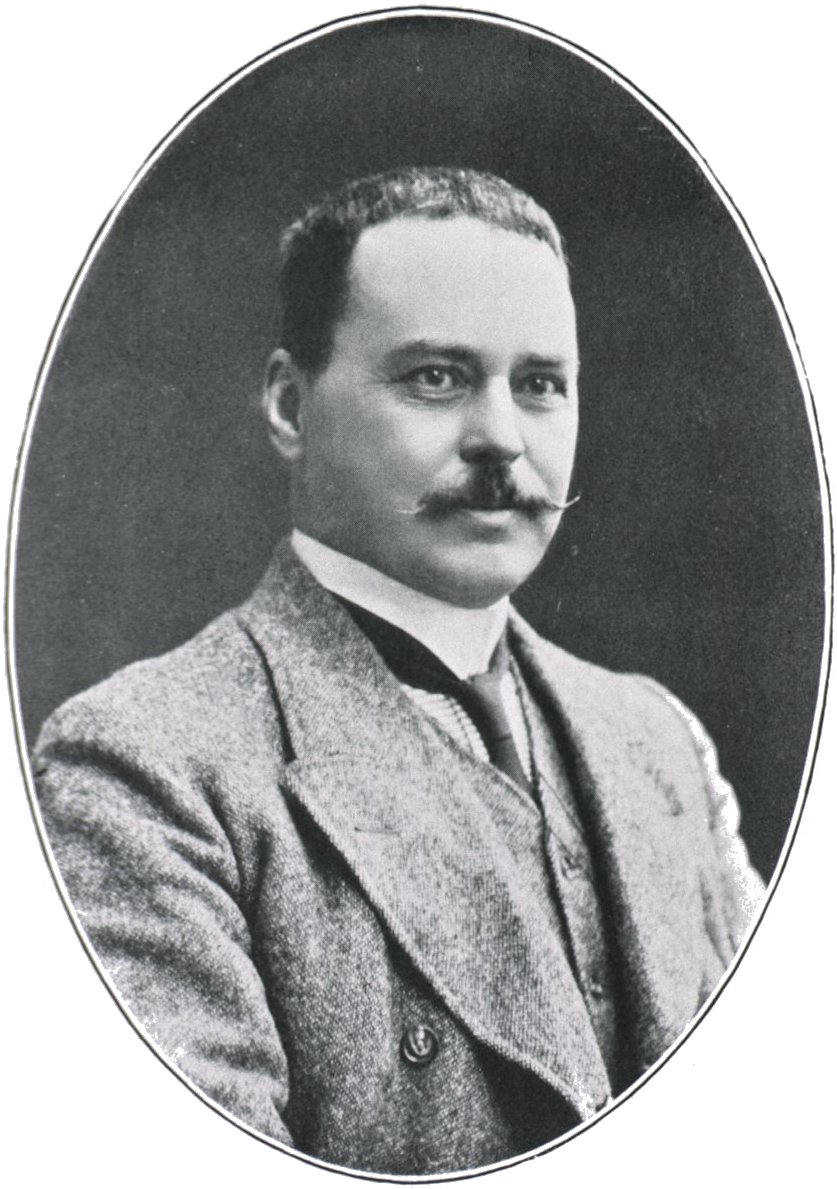

Charles Louis Alphonse Laveran

Fue Alphonse Laveran quien en 1880 identificó correctamente que era un protozoo, al que llamó Oscillaria, el agente causante de la malaria. Nació en 1845 y se licenció en Medicina en 1867. Sirvió como médico militar en la guerra con Prusia en 1870 y en 1874 fue nombrado Director de Enfermedades y Epidemiología en la Escuela de Val de Grâce. En 1878 fue destinado a Argelia donde inició sus estudios sobre la malaria, una de las enfermedades más incapacitantes y extendidas entre los soldados franceses que servían en aquella colonia.

No se conocía su causa y, para aliviar los síntomas, sobre todo los accesos de fiebre, solo era eficaz la quinina. En Bona, Laveran practicó la autopsia a soldados fallecidos por las fiebres, y encontró que padecían anemia y que su sangre tenía un color marrón oscuro por la presencia de un pigmento negro. Todo ello le llevó a estudiar al microscopio muestras de sangre de soldados enfermos, sin preparar la muestra para facilitar el examen como era habitual entonces, algo que no habían probado otros investigadores antes que él.

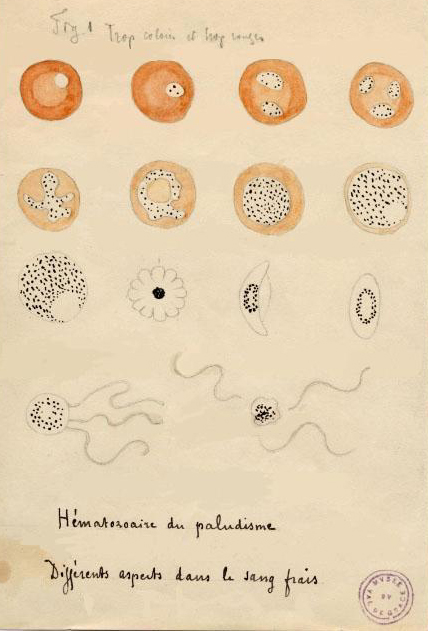

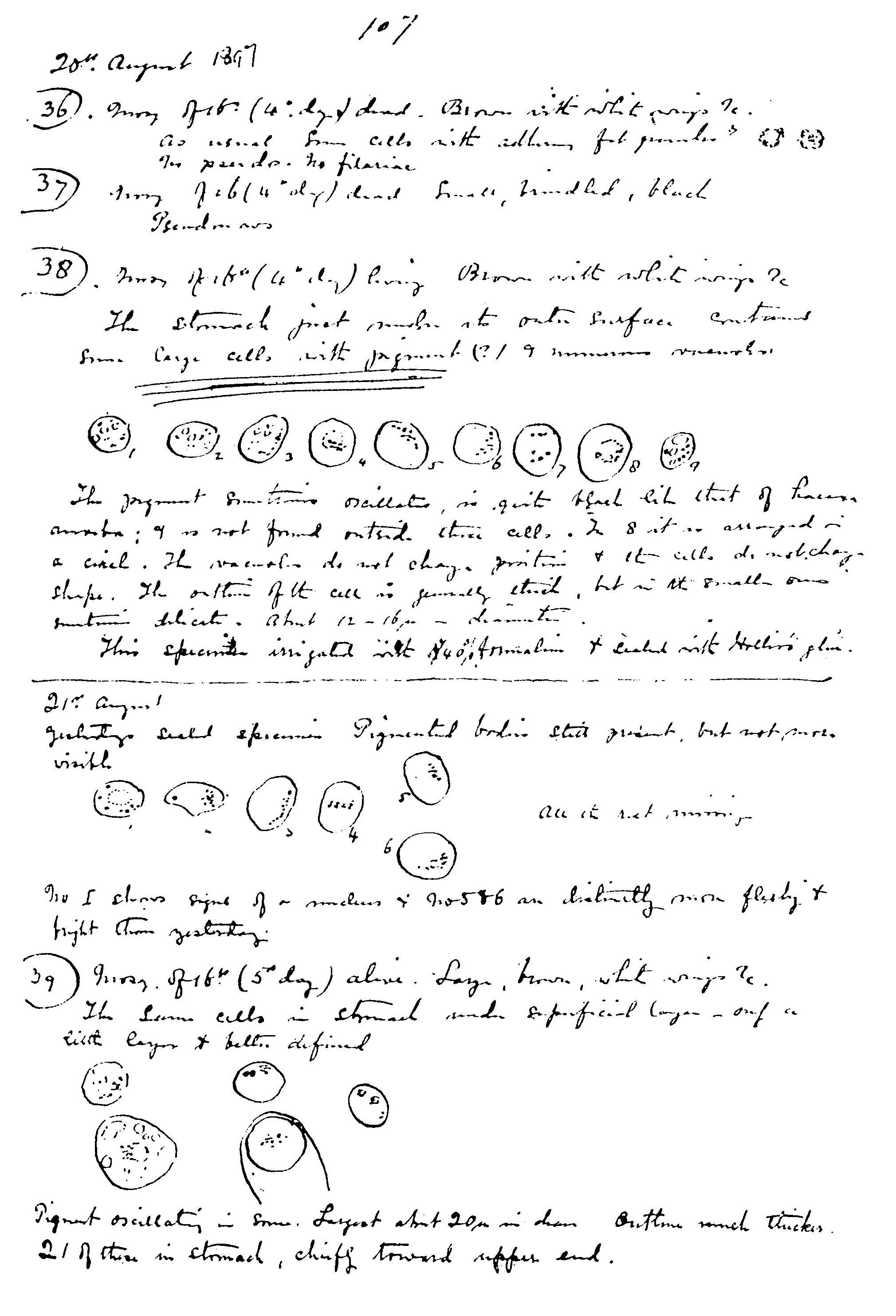

Ilustración de Laveran de 1880 con sus observaciones del parásito de la malaria en sangre fresca.

En su destino en Bona y, más tarde, en Constantina, detectó que los glóbulos rojos de los enfermos llevaban unos gránulos pigmentados. Poco después descubrió en la sangre fresca de esos enfermos, que, a veces, de esos glóbulos rojos se desprendían partículas de menor tamaño con cilios o flagelos móviles. Fue, según lo relata el propio Laveran, el 6 de noviembre de 1880 y en el Hospital Militar de Constantina, cuando observó “unos filamentos móviles o flagelos, con movimientos muy rápidos y variados que no dejaban duda de su naturaleza”. Dos días después observó lo mismo en la sangre de otro enfermo. De inmediato redactó y envió una nota, de fecha 23 de noviembre, comunicando su descubrimiento a la Academia de Medicina de París.

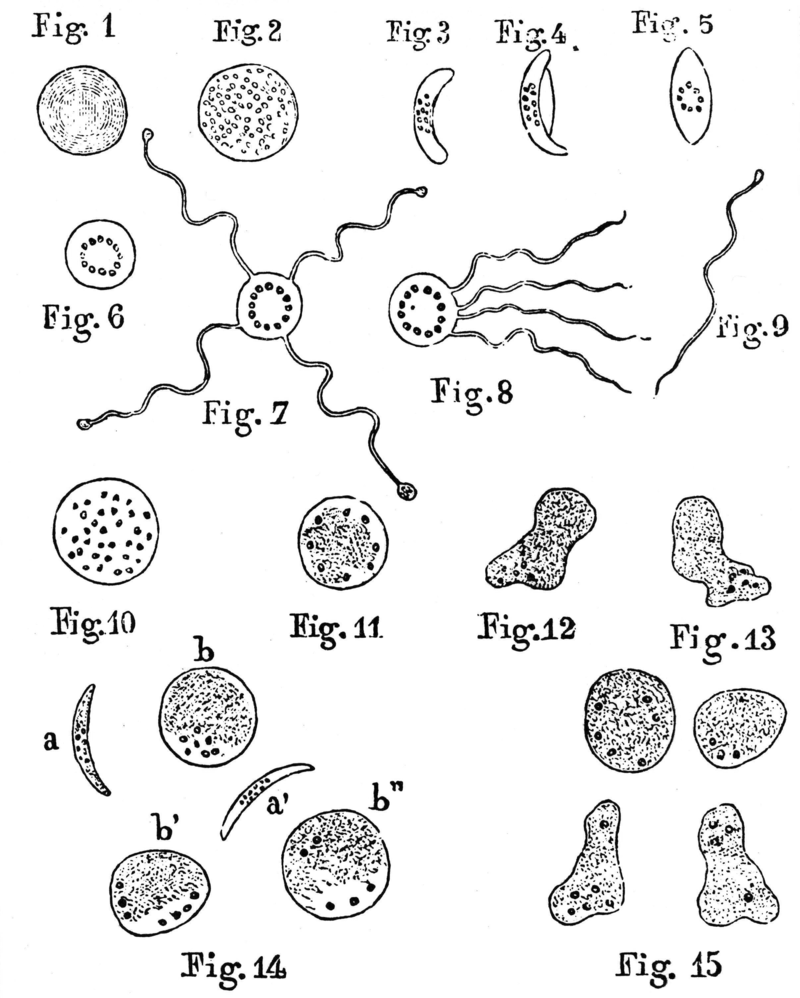

Ilustración de Laveran C.L.A., “Note sur un nouveau parasite trouvé dans le sang de plusieurs malades atteints de fièvre palustres”. Bull Acad Med 1880; 9: 1235-1236.

En 1881, publicó la revista The Lancet, de Estados Unidos, la confirmación del hallazgo de Laveran. En los meses siguientes, Laveran encontró los mismos organismos en la sangre de 148 de 192 enfermos examinados, incluidos algunos de las marismas de Roma y de otros lugares de Italia.

Viajó a París y convenció a Louis Pasteur y a su colaborador Emile Roux, otro prestigioso microbiólogo de la época, de que era un protozoo el parásito que causaba la malaria. Laveran era un médico militar, fuera de los círculos académicos y destinado en una colonia al otro lado del Mediterráneo, lejos de la capital, y sin contactos con los grupos de investigación de la malaria de finales del siglo XIX. Pero también los italianos Ettore Marchiafava y Angelo Celli, con un microscopio más potente, confirmaron el hallazgo de Laveran y le agradecieron expresamente el descubrimiento del protozoo. Pertenecían a la prestigiosa escuela italiana de estudios de la malaria, encargada de las investigaciones sobre esta enfermedad en las numerosas marismas de Italia. De allí nos llega el término malaria, del italiano “mal aria”, o “mal aire” en traducción directa.

Cuatro años más tarde, en 1884, Laveran ya había estudiado 480 casos y concluyó que el parásito de la malaria penetraba y se desarrollaba en los glóbulos rojos, provocaba su ruptura y liberaba esporas al torrente sanguíneo que, a su vez, invadían otros glóbulos rojos. Lo llamó Oscillaria malariae, nombre que, posteriormente, la escuela italiana cambió a Plasmodium, tal como ahora se conoce.

Era la época de la Microbiología y Pasteur, Koch y otros habían demostrado que la causa de las infecciones y de muchas enfermedades eran las bacterias. Así se había confirmado para, entre otras, el ántrax, la tuberculosis, el tifus o el cólera. Aceptar que había otros organismos causantes de enfermedades, como el protozoo descrito por Laveran, costó que lo aceptaran muchos investigadores. Pero las evidencias eran abrumadoras y Laveran recibió el Premio Nobel en 1907.

Ronald Ross

Uno de los expertos en malaria más críticos, en principio, con los trabajos de Laveran fue el médico militar inglés, de servicio en la India, Ronald Ross. Llevaba años estudiando la malaria y, en 1893, estaba convencido, según lo habitual en la época, de que era una enfermedad intestinal provocada por la toma de agua no potable. Escribió un informe para la revista Medical Reporter en que afirmaba que no era necesario otro parásito, un protozoo según Laveran, como causa de la malaria.

Consideraba que la enfermedad era compleja en síntomas y diagnóstico y, por ello, terminaba su informa con una frase llena de ironía, oculta en el típico lenguaje científico:

“Para la solución de la cuestión de la fiebre india, lo que queremos es una definición clara de las ideas, un escrutinio cuidadoso de todas las suposiciones y una interpretación de sentido común de los fenómenos que tenemos ante nosotros; y están muy equivocados quienes se imaginan que un problema siempre tan grande y variado será resuelto por un solo ‘coup de microscope’.”

Por “un vistazo al microscopio” y, además, en francés, o sea, lo que había propuesto Laveran, en francés, años antes de este escrito de Ross.

Página del cuaderno de notas de Ross en la que identifica en parásito de la malaria

Dos años más tarde, en 1895, y después de los consejos de otro médico inglés, Patrick Manson, Ross observó el “denostado” protozoo en el estómago del mosquito Anopheles y demostró que era el parásito y el vector de la malaria. Y, por estos hallazgos, Ronald Ross recibió el Premio Nobel en 1902.

Además de los conocimientos de Microbiología, típicos de su época, a Laveran le permitieron su descubrimiento y los estudios posteriores sobre el protozoo de la malaria otras mejoras en los métodos de investigación. Por ejemplo, los microscopios cambiaron en la segunda mitad del siglo XIX, con adelantos sustanciales en óptica y en la fabricación de lentes. Eran los años de Ernst Abbe, el especialista en óptica que resolvió los problemas teóricos de la fabricación de lentes. Y Carl Zeiss y Otto Schott, que formaron la empresa Carl Zeiss Inc., que todavía fabrica microscopios de gran calidad. A partir de 1884, junto con la fábrica Nachet, de París, ya comercializaban microscopios que mejoraban sustancialmente el material disponible hasta entonces. Fue sorprendente que, cuando Laveran, en 1880, encontró por vez primera el parásito de la malaria, su microscopio no era precisamente de los mejores y no tenía los aumentos, solo llegaba a 400, que después se consideraron necesarios para describir el protozoo. Pero, a pesar de ello, lo hizo con una precisión que se confirmó en años posteriores y con mejor instrumental. Como diría Pablo Picasso, la inspiración le encontró trabajando, o sea, en este caso mirando por el microscopio.

Otro de los adelantos técnicos que permitió la observación del protozoo de la malaria fue el desarrollo de las técnicas de tinción. No eran fáciles los estudios al microscopio tal como hizo Laveran, con sangre fresca y sin teñir. Fue Dimitri Leonidovich Romanowsky, en 1891, quien publicó una tinción que permitió las observaciones en frotis de sangre sobre portaobjetos que, incluso, permitían guardar las muestras y repetir el estudio al microscopio. Además, utilizaba dos colorantes, eosina y azul de metileno, que teñían diferente al protozoo según la fase de su ciclo vital.

En aquellos años, Wilhelm von Drigalski nos cuenta que en Italia llevaban mucho tiempo estudiando las causas de la malaria, sobre todo en las marismas que rodeaban la capital, Roma. Fueron Camillo Golgi, Marchiafava o Celli quienes completaron el ciclo vital del Plasmodium en la sangre de los enfermos, con buenos microscopios y la tinción de Romanowsky. El primero, Golgi, identificó con precisión los parásitos de la malaria y clasificó el Plasmodium vivax y el P.malariae. Y en 1890, Marchiafava y Celli identificaron el P. falciparum. Así quedó establecido que la malaria no era una enfermedad provocada por un solo parásito sino por cuatro (el P. ovale se identificó en 1922) que, a veces, hasta provocaban las fiebres actuando en conjunto.

Fue en la India donde el también médico militar Ronald Ross planteó la hipótesis, y la demostró en aves, de que el parásito llegaba a la sangre de los enfermos por la picadura de mosquitos.

Giovanni Battista Grassi

Y, finalmente, el italiano Giovanni Battista Grassi mostró todo el ciclo de desarrollo del protozoo, con su paso por el mosquito y el hombre como huéspedes.

La historia del protozoo de la malaria está llena de intensos debates, rencillas personales y amargura. Varios de los científicos dedicaron mucho tiempo a reclamar la prioridad de sus descubrimientos, un aspecto importante en la cultura de la ciencia de la época y hoy, en cambio, un debate casi olvidado. Investigadores franceses, alemanes, ingleses e italianos contribuyeron a los descubrimientos sobre la malaria y, también, polemizaron interminablemente sobre muchos aspectos de lo que se iba encontrando.

Además, todos los estudios de finales del siglo XIX sobre la malaria coinciden, en los grandes países europeos, con las aventuras y las exploraciones de otros continentes, con las colonias y los imperios. En ese momento histórico, la malaria era una enfermedad importante para el control europeo de esas colonias y la explotación de sus recursos naturales y, por tanto, era un asunto prioritario para los gobiernos y para la opinión pública.

En cambio, en Italia la malaria era algo muy cercano y, por ello, su investigación era esencial para la salud pública y como problema social. Era una enfermedad de siempre que mantenía empobrecidas extensas regiones del país. Para ingleses y franceses, la malaria es un problema colonial y, para los italianos, era un asunto interno, sobre todo para el centro y sur del país.

Y, por si fuera poco este sustrato político en la investigación sobre la malaria, estamos en la era de los nacionalismos y, también, son habituales en la ciencia. Parte de la polémica entre Grassi, Ross y Laveran, o del rechazo de ingleses e italianos a los descubrimientos del médico militar francés en Argelia, viene de esta competición patriótica entre científicos. Como ejemplo nos sirve lo que Santiago Ramón y Cajal publicó en aquellos años en sus “Reglas y consejos de investigación científica”, pues entre las “cualidades de orden moral” de un investigador está el patriotismo. Inicia el texto afirmando que

“entre los sentimientos que deben animar al hombre de ciencia merece particular mención el patriotismo. Este sentimiento tiene en el sabio signo exclusivamente positivo: ansía elevar el prestigio de su patria, pero sin denigrar a los demás.”

Es oportuno citar que la cualidad que Ramón y Cajal menciona antes del patriotismo es la “pasión por la gloria” y, de ello se derivan las polémicas sobre la prioridad en los descubrimientos. Hoy, quizá, solo se discute por las patentes derivadas de esos hallazgos.

En mayo de 1922, Alphonse Laveran murió en París a los 76 años. Está enterrado en el Cementerio de Montparnasse, junto a celebridades como el filósofo Jean Paul Sartre, o el líder anarquista Pierre-Joseph Proudhon, el poeta Charles Baudelaire o el escritor Julio Cortázar.

Referencias:

Capanna, E. 2006. Grassi versus Ross: who solved the riddle of malaria? International Microbiology 9: 69-74.

Chernin, E. 1984. The malariatherapy of neurosyphilis. Journal of Parasitology 70: 611-617.

Coleman-Jones, E. 1999. Ronald Ross and the great malaria problem: historical reference in the biological sciences. Journal of Biological Education 33: 181-184.

Earle, D.P. 1979. A history of malaria and its ironies. Transactions of the American Clinical and Climatological Association 90: 1-26.

Hommel, M. 2007. Morphologie, biologie et cycle des Plasmodium parasites de l’homme. Bulletin de l’Academie nationale de medicine 191: 1235-1246.

Laverdant, C. 2007. Le context scientifique contemporain de la découverte de Laveran. Bulletin de l’Academie nationale de medicine 191: 1227-1234.

Ledermann, W. 2008. Laveran, Marchiafava y el paludismo. Revista Chilena de Infectiología 25: 216-221.

Macchi, G. 1999. Camillo Golgi: A clinical pathologist. Journal of History of Neurosciences 8: 141-150.

Ramón y Cajal, S. 1940 (1899). Reglas y consejos sobre investigación científica (Los tónicos de la voluntad). 8ª ed. Librería Beltrán. Madrid. 302 pp.

Ross, R. 1893. Some objections to hematozoic theories of malaria. Medical Reporter 2: 65-71.

Schmidt, G.D. & L.S. Roberts. 1985. Foundations of Parasitology. Times Mirror/Mosby College Publ. St. Louis, Toronto. Santa Clara.

Snowden, F.M. 2006. The conquest of malaria. Italy, 1900-1962. Yale University Press. New Haven & London.

Tan, S.Y. & A. Ahana. 2009. Charles Laveran (1845-1922): Nobel lauréate pioneer of malaria. Singapore Medical Journal 50: 657-658.

von Drigalski, W. 1954. Hombres contra microbios. La victoria de la Humanidad sobre las grandes epidemias. Ed. Labor. Barcelona. 368 pp.

Yoeli, M. 1973. Sir Ronald Ross and the evolution of malaria research. Bulletin of the New York Academy of Medicine 49: 722-735.

Sobre el autor: Eduardo Angulo es doctor en biología, profesor de biología celular de la UPV/EHU retirado y divulgador científico. Ha publicado varios libros y es autor de La biología estupenda.

El artículo Historias de la malaria: Charles Louis Alphonse Laveran y el protozoo se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Historias de la malaria: El parásito

- Historias de la malaria: El charlatán y caballero Sir Robert Talbor

- Historias de la malaria: El árbol de la quina

Kotoi-paperezko euskarriak odol analisiak egiteko

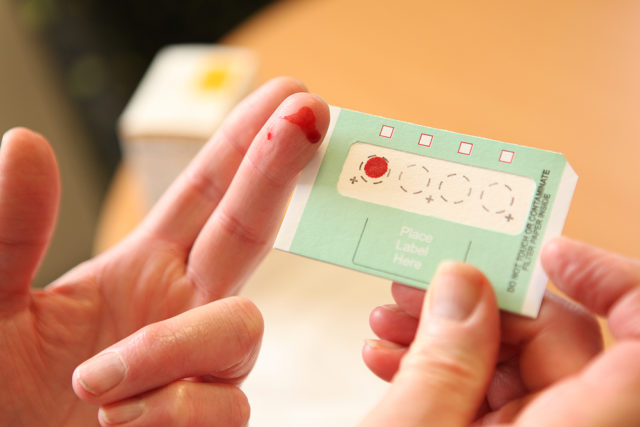

Irudia: Odol Tanta Lehorrean (OTL) erabiltzen den kotoi-paperezko euskarri baten odola biltzen.

Teknika honetan kotoiaz egindako txartel batean odol tanta batzuk ipintzen dira, horretarako gorputzeko edozein tokitan (atzamarra, orpoa edo belarria) orratz batekin ziztada bat eginez. Odola lehortu denean txartel hauek oso erraz gorde daitezke eta edonora eraman. Gero, laborategian odola duen paper zati bat zulatzen da, odola erauzten da eta interesatzen zaigun metabolitoa edo droga analiza daiteke. Modu honetan teknika hau dopin kontroletan, farmakoen monitorizazioan edota gaixotasunen diagnostikotan aplika daiteke. Zeresanik ez izugarri egokia dela jaioberriei odola hartu behar zaienean (ezin diegu odol gehiegi lapurtu!) edo hirugarren munduan erabiltzeko tamalez han odol laginketa klasikoa egiteko arazo asko baitaude.

Orduan, teknika hau hain ona bada, zergatik ez du aspaldi xiringen bidezko odol ateratzea baztertu? Izan ere, 1963. urtean erabiltzen hasi zen eta oraindik gutxik izan duzue ospitaletan OTLa ikusteko aukera. Arrazoi nagusietariko bat analisiak burutzeko behar diren metodo analitikoen mugak izan dira. OTLarekin hain odol bolumen gutxi hartzen da ezen analitoen kantitate izugarri txikiak detektatzeko teknikak beharrezkoak baitira. Zorionez denbora aurrera doan heinean metodo analitikoak askoz sentikorragoak dira eta gaur egun analisi gehienak ahalbidetzeko beharrezkoak diren detekzio mugak lor daitezke.

Hala ere, teknika honen berpiztea berriki geratu denez analisi kuantitatiboetan eragina izan dezaketen faktoreak sakonki aztertu behar dira oraindik. Hori da hain zuzen ere aurkezten dugun lan honetan egin duguna. Alde batetik, OTLan oinarritutako prozedura analitikoa garatu dugu hiru farmako ezberdinen analisi erraza aurrera eramateko kromatografia likido ultra-azkarra eta detekzio fluoreszentea erabiliz. Bestetik, farmako hauen analisi kuantitatiboa baldintza dezaketen hiru faktore sakonki aztertu ditugu: odolaren hematokritoa, euskarrian ipinitako tantaren bolumena, eta analisirako zulatutako paperaren posizioa.

Garatutako metodo azkarrak OTLa farmakoen analisirako etorkizun izugarriko teknika dela erakusten du. Dena den, hematokritoa eta zulatutako paperaren posizioa bezalako faktoreek analitoen kuantifikazioan eragina dutela ikusi dugu. Ondorioz, teknika hau aplikatu baino lehen, analizatu nahi den konposatu bakoitzaren portaera aztertu behar da eskaintzen diren emaitzak fidagarriak direla ziurtatzeko.

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: Ekaia 30

- Artikuluaren izena: Odol Tanta Lehorraren fidagarritasunaren azterketa farmakoen analisi kuantitatiborako UHPLC-PDA-FLDren bidez.

- Laburpena: Lan honetan Odol Tanta Lehorraren (OTLa) laginketa-teknikaren fidagarritasuna ikertu da farmakoen analisirako fotodiodo- eta fluoreszentzia-detektagailuei akoplatutako bereizmen oso altuko likido-kromatografiaren (UHPLC-PDA-FLD) bidez. OTLak, odol-tanta bat kotoi-paperezko euskarri batean jartzean eta lehortzen uztean datzan teknikak, azken urteotan erabileraren handipen garrantzitsua antzeman du bioanalisian. OTLak ohiko odol-analisiekiko hainbat abantaila erakutsi arren, analisi kuantitatiboaren ikuspuntutik hainbat faktorerekiko mendekotasuna duela antzeman da. Ikerketa honetan faktore batzuek (hematokritoa, odol-bolumena eta laginketa-puntua) farmakoen determinazioan duten eragina aztertu da, horretarako amilorida, propranolola eta valsartan farmakoak eredu gisa erabiliz. Emaitzetan oinarrituta, zuloaren kokapenak eta hematokritoak analisien zehaztasunean eta doitasunean eragina dutela ondorioztatu da, teknika honen aplikazio kuantitatiboa mugatuz. Bestalde, analitoen sakabanaketa odol-tantan zehar analitoen propietate fisiko-kimikoen mendekoa dela ikusi da, metodo analitikoaren garapenean analito bakoitzaren sakabanaketa aztertu behar dela ondorioztatuz.

- Egileak: Beatriz Uribe, Oskar Gonzalez eta Rosa M. Alonso

- Argitaletxea: UPV/EHUko argitalpen zerbitzua

- ISSN: 0214-9001

- Orrialdeak: 19-36

- DOI: 10.1387/ekaia.14547

—————————————————–

Egileaz: Beatriz Uribe, Oskar Gonzalez eta Rosa M. Alonso UPV/EHUko Kimika Analitikoa Saileko irakasleak eta ikertzaileak dira.

—————————————————–

Ekaia aldizkariarekin lankidetzan egindako atala.

The post Kotoi-paperezko euskarriak odol analisiak egiteko appeared first on Zientzia Kaiera.

Superelasticidad nanométrica

La superelasticidad es una propiedad física por la que se puede deformar un material en gran medida, hasta un 10 % —un porcentaje muchísimo mayor que en la elasticidad—, de forma que aplicando una tensión a una varilla recta, esta puede formar una U, y al eliminar la tensión aplicada, la varilla recupera completamente su forma inicial. Aunque está más que probada en materiales macroscópicos, “hasta ahora nadie había podido estudiar estas propiedades de superelasticidad en dimensiones micrométricas y nanométricas”, explica José María San Juan, investigador principal y catedrático de la UPV/EHU.

Investigadores del Departamento de Física de la Materia Condensada y de Física Aplicada II de la UPV/EHU han conseguido ver que “el efecto superelástico se mantiene en dispositivos realmente pequeños de una aleación de cobre-aluminio-niquel”. Se trata de una aleación con memoria de forma en la que el equipo de investigación lleva más de 20 años trabajando a nivel macroscópico: Cu-Al-Ni, una aleación que muestra superelasticidad a temperatura ambiente.

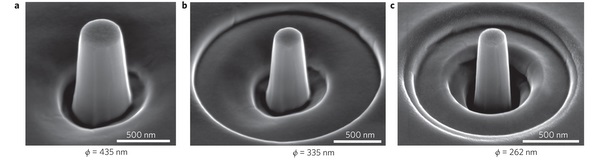

Utilizando un equipo denominado Focused Ion Beam, “un cañón de iones que actúa como una especie de cuchillo atómico que talla el material”, explica San Juan, han construido micropilares y nanopilares de esta aleación de diámetros comprendidos entre 2 µm y 260 nm —un micrómetro es una millonésima parte de un metro y un nanómetro es una mil millonésima parte de un metro— a los que han aplicado una tensión con un sofisticado equipo llamado nanoindentador, que “permite aplicar fuerzas extremadamente pequeñas” y han medido su comportamiento.

Los investigadores han constatado y cuantificado por primera vez que en diámetros menores de un micrómetro hay un cambio notable de las propiedades relacionadas con la tensión crítica para la superelasticidad: “El material se empieza a comportar de manera diferente y requiere una tensión mucho más elevada para que se produzca. La aleación sigue presentando superelasticidad pero para tensiones más elevadas”. San Juan remarca la novedad de ese incremento de la tensión crítica con el tamaño, y subraya, además, que han podido explicar la razón de dicho cambio de comportamiento: “Hemos propuesto un modelo atómico que permite entender por qué y cómo cambia la estructura atómica de estos pilares cuando se les aplica una tensión”.

El catedrático de la UPV/EHU destaca la importancia de este descubrimiento, “un comportamiento superelástico espectacular a pequeña escala”, que abre nuevas vías en el diseño de estrategias de aplicación de aleaciones con memoria de forma para el desarrollo de microsistemas y nanosistemas electromecánicos flexibles. “La electrónica flexible está muy presente en el mercado actual, se utiliza cada vez más en prendas de vestir, zapatillas de deporte, en diversos displays…”. Asimismo, afirma que todo ello es de suma importancia para el desarrollo de dispositivos inteligentes médico-sanitarios implantables en el cuerpo humano, del tipo Lab on a chip o laboratorio en un chip: “Se podrán construir pequeñas microbombas o microactuadores que se puedan implantar en un chip, que permitan liberar y regular una sustancia dentro del cuerpo humano para diversos tratamientos médicos”.

Se trata de un descubrimiento que “se espera que tenga una gran repercusión científica y tecnológica y que pueda revolucionar ciertos aspectos en campos afines”, concluye San Juan, y se congratula de que “hemos sido capaces de transferir todo el conocimiento necesario y de conseguir las herramientas de trabajo que tienen los centros más avanzados para abrir una nueva línea de investigación con la capacidad de desarrollarla íntegramente en la UPV/EHU”.

Referencia:

Jose F. Gómez-Cortés, Maria L. Nó, Iñaki López-Ferreño, Jesús Hernández-Saz, Sergio I. Molina, Andrey Chuvilin and Jose M. San Juan. Size effect and scaling power-law for superelasticity in shape-memory alloys at the nanoscale. Nature Nanotechnology. May 2017. DOI: 10.1038/nnano.2017.91.

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Superelasticidad nanométrica se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Una puerta cuántica robusta y ultrarrápida

- La máquina de vapor (1)

- La fusión nuclear como fuente de neutrones eficiente

Hazkuntza faktoreak askatzen dituzten aldamioak

1. irudia: Hezurretako hutsuneak osatzeko aldamio gisa balia daitezkeen eta hazkuntza-faktoreak askatzen dituzten egitura batzuk sortu dituzte UPV/EHUn.

Aldi baterako aldamio funtzioa izaten dute kaltetutako ehunean, organismoari osatzen laguntzeko. Gelatinazko matrizea garatu du UPV/EHUko NanoBioCel taldeak, hezurren osatze prozesuan euskarri fisiko funtzioa izateaz gain, hazkuntza-faktoreak askatzeko aukera ematen duena, gorputzak modu naturalean egiten duenari jarraiki.

Hezur-kalte kritikoetan (erredura, traumatismo, tumore-erauzketa, …) sor daitezkeen kalteetan aldi batez hezur-matrizea ordezkatu eta hezur-ehuna birsortzen laguntzeko da baliagarria garatutako aldamioa. Kolagenoaren deribatu bat erabili dute, kolagenoa prozesatzean sortzen den gelatina bat, zehazki.

Biodegradagarria izateaz gain, gorputzak errefusatzeko oso arrisku baxua du material honek. Gelatina-proteinak polimerizatu eta aldamioa kohesionatzeko, gardeniaren fruitutik erauzten den molekula bat erabili dute: genipina. Erabili ohi diren beste molekulak (glutaraldehido, adibidez) baino toxizidade baxuagoa du zelulentzat genipinak.

Behin aldamioa diseinatuta, zenbait entsegu eta prozesutan probatu dute; zer-nolako propietate, biobateragarritasun eta zitotoxikotasun dituen jakiteko. Emaitza positiboak lortu dituzte proba guztietan. Are gehiago, entseguetako batean espero baino hobeto erantzun dute zelulek: ohiko euskarri batean aldamioa zelula alfonbra baten gainean jarri zuten, kontaktuan egoteak zelulak intoxikatzen edo hiltzen ziren ikusteko. Aldamioa altxatzean, hutsunea ikusi zuten harekin kontaktuan egondako gainazal osoan eta zelulak hil zirela pentsatu zuten hasieran, baina zelulek aldamiora migratu zutela ikusi zuten orduan, alegia, hazteko jarritako plastikoa baino, nahiago zutela aldamioaren gelatina.

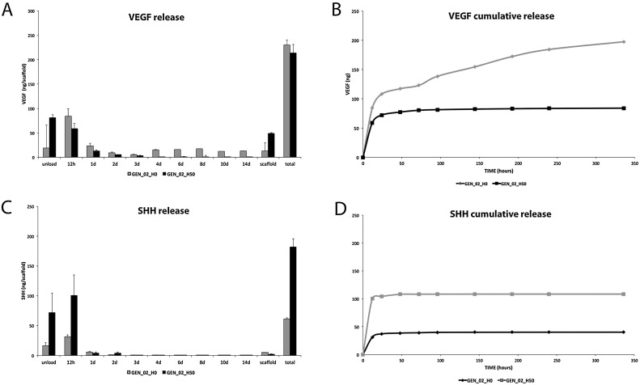

Aldamioa baino gehiagoZelula ama mesenkimalei (hezur-matrizea birsortzen duten zelulei) sostengatzeko egitura emateaz harago, hazkuntza-faktoreak askatzeko gai den materiala bilatu dute ikertzaileek; unean uneko egoeraren arabera beharrezkoa den moduan eta kantitatean egin dezala, gainera. VEGF and SHH proteinak dira, zehazki, gehitu diren hazkuntza faktoreak. Heparina glikosaminoglikanoa lotzeko atalak dituzte bi proteina hauek haien sekuentzietan eta, ezaugarri hori aprobetxatuta, heparina gehitu da aldamio egiturara, hazkuntza-faktoreak harrapatu eta haien askatze profilak gordetzeko.

Hezurra hautsi eta lehenengo bi egunetan baino espresatzen ez den proteina da SHH, hezurra osatzen laguntzeko inguruko zeluletan zenbait gene aktibatzeko funtzioa duena. Heparina baliatuta aldamioetan gehitutakoan, lehenengo 24 orduetan askatu zen SHH proteina entseguetan, gorputzak sortzen duenaren antzeko portaera. VEGF proteinak, bere aldetik, angiogenesia (odol hodien sorrera) bultzatzen du eta, horretaz gain, zelulak erakartzen ditu hezur ehuna sortzen lagun dezaten. Kasu honetan ere, gorputzak askatzen duen moduan, hainbat egunetan zehar askatu zen aldamioan gehitutakoan.

2. irudia: SHH eta VEFG proteinen askapen grafikoak. (Ikerketa artikulutik hartua)

Proiektuaren lehenengo zatia da ikerketa hau. Animalietan azterketa preklinikoak egin dituzte eta emaitza itxaropentsuak lortu dituzte. Etengabe goraka doan diziplina da medikuntza birsortzailea eta askotariko estrategia terapeutikoak hartzen ditu barnean, proteina birkonbinatu eta zelula ametatik hasi eta, kasu honetan bezala, botikak eta hazkuntza-faktoreak askatzeko material eta matrizeetaraino.

Erreferentzia bibliografikoa:

P. Sánchez, J.L. Pedraz, G. Orive.. Biologically active and biomimetic dual gelatin scaffolds for tissue engineering. International Journal of Biological Macromolecules, 98: 486–494 (2017). DOI: 10.1016/j.ijbiomac.2016.12.092.

Iturria:

UPV/EHUko komunikazio bulegoa: Hezurren birsorkuntza-prozesuan organismoa imitatzen duten gelatinazko gailu berriak

The post Hazkuntza faktoreak askatzen dituzten aldamioak appeared first on Zientzia Kaiera.

II Concurso de Cristalización en la Escuela del País Vasco

La final de la segunda edición del Concurso de Cristalización en la Escuela tuvo lugar el pasado 5 de mayo en el Aula Magna de la UPV/EHU en Leioa. En la misma se dieron a conocer los ganadores del concurso quienes, además de un diploma acreditativo, también recibieron un detalle.

El concurso, dirigido a estudiantes de educación secundaria (ESO y bachillerato), tiene el objetivo de acercar el mundo científico al alumnado, aprovechando el atractivo de la cristalografía.

Además de subrayar la importancia que tienen los cristales en la sociedad, el concurso también busca ”fomentar el estudio, el trabajo sistemático, el pensamiento racional y la comunicación, utilizando como base la cristalografía”, tal como explica Begoña Bazán, organizadora del evento.

La edición de este año ha reunido maquetas de todo tipo, desde un parque de atracciones, una réplica del Guggenheim con Puppy incluído, volcanes, fondos marinos, hasta el hundimiento del Titanic pasando por el sistema solar.

Acercar la metodología científica

Para participar en el concurso el alumnado utiliza un kit didáctico que permite hacer crecer cristales de fosfato monoamónico (dihidrógeno fosfato de amonio). El kit permite modificar variables físicas (temperatura solubilidad, concentración, etc.), lo que posibilita variar los procesos de cristalización y obtener distintos resultados.

Los participantes deben presentar, además de una maqueta con los cristales creados, un póster con formato científico en el que se detallan los objetivos, materiales, métodos, resultados y las conclusiones. Por último, también deben presentar un cuaderno de laboratorio con los procesos seguidos y las respuestas obtenidas.

El formato del concurso acerca la metodología científica a los más jóvenes, ya que incluye todos sus elementos empezando por la investigación en el laboratorio hasta la presentación de resultados en un congreso científico creado a tal efecto. Mediante esta actividad amena y visual el alumnado se familiariza con el método científico. También permite introducir la cristalografía y la cristalización en el temario educativo, temas en los que no se suele profundizar o que, directamente, están ausentes.

Implicación docente

La participación no solo atañe a los estudiantes, también requiere el compromiso del profesorado. El concurso tiene una duración aproximada de un curso académico y está dividido en tres fases:

- Fase 1. Curso de formación para el profesorado de secundaria. En esta primera fase el profesorado responsable de cada centro educativo realiza un curso de formación donde personal de la UPV/EHU les dota de las herramientas científico-didácticas para la realización de los experimentos.

- Fase 2. Realización de los proyectos de cristalización y seguimiento del concurso. Durante esta fase el profesorado orienta a los participantes en los experimentos. Esta fase tiene una duración de cinco meses.

- Fase 3. Final del concurso de cristalización. En esta fase se exponen los resultados obtenidos en formato de congreso científico.