El disputado voto del Señor Condorcet (I)

En nuestra sociedad hay innumerables ocasiones en las que un colectivo de personas debe tomar decisiones sobre diferentes alternativas que se le plantean, como quién debe ser la persona que preside una nación, quien el candidato o candidata de un partido político, dónde se celebrarán los siguientes juegos olímpicos, cuál ha sido la mejor película, o libro, del año, qué empresa debe contratar una comunidad de vecinos para arreglar la fachada de su casa o qué política debe de seguir determinado gobierno, partido político o empresa, y muchas otras cuestiones similares.

Ante lo cual se nos plantea la cuestión trascendental de cómo elegir la propuesta que mejor represente las preferencias de los individuos del colectivo, es decir, cómo convertir las preferencias individuales en una preferencia colectiva, de la mejor forma posible.

Portada del libro “El disputado voto del Señor Cayo” (Destino, 1978), del escritor Miguel Delibes, y cartel de la película homónima de 1986 del director Antonio Giménez-Rico

Aunque pueda parecer lo contrario, ya que las votaciones son algo habitual en nuestra vida cotidiana, la cuestión no es precisamente sencilla. Para ilustrar esto vamos a mostrar dos ejemplos clásicos interesantes.

El primero es la paradoja de Condorcet. Marie-Jean-Antoine

Nicolás de Caritat, Marqués de Condorcet (1743-1794) fue un filósofo, matemático y político francés, que tuvo un papel relevante durante la Revolución francesa.

Marie-Jean-Antoine Nicolás de Caritat, Marqués de Condorcet (1743-1794)

Supongamos que se está decidiendo cuál de las tres ciudades, Bilbao, Donosti y Gasteiz, va a ser la capital del País Vasco, y se designa una comisión de expertos internacional, formada por 12 personas, para tal fin.

Tras un tiempo de estudio del problema y las consiguientes deliberaciones llega la votación, obteniéndose un empate entre las tres candidaturas, con cuatro votos cada una. Ante lo cual, se pide a los expertos que indiquen su orden de preferencia entre las tres ciudades, obteniéndose las siguientes preferencias:

El alcalde de Bilbao que está en la reunión, como representante de la capital de Bizkaia, toma la palabra y dice lo siguiente:

“Si comparamos solamente las ciudades de Bilbao y Donosti observaremos que 8 de los 12 expertos prefieren Bilbao a Donosti. Por otra parte, si comparamos ahora Donosti y Gasteiz, observaremos que, de nuevo, 8 de los 12 expertos prefieren Donosti a Gasteiz. En conclusión, los expertos prefieren Bilbao a Donosti, y Donosti a Gasteiz, por lo tanto, la ciudad preferida es Bilbao, que debería ser la capital del País Vasco.”

Pero entonces, el alcalde de Vitoria-Gasteiz, que también está presente en la reunión, manifiesta lo siguiente:

“Querido alcalde de Bilbao, quizás antes de tomar ninguna decisión deberíamos tener en cuenta también la comparación entre Bilbao y Gasteiz, y veremos que la mayoría de los expertos, de nuevo 8 de 12, prefiere Gasteiz a Bilbao. En consecuencia, vuestro razonamiento queda así anulado.”

Como podemos ver en este ejemplo, se ha producido una preferencia cíclica, cuando se comparan las candidaturas dos a dos la mayoría de los expertos prefiere Bilbao a Donosti, Donosti a Gasteiz, y Gasteiz a Bilbao, por lo que no podemos determinar cuál es la ciudad preferida por los expertos, y por tanto, la capital del País Vasco. Esto es lo que se conoce con el nombre de paradoja de Condorcet.

Pero vayamos con un segundo ejemplo, más esclarecedor aún. Imaginemos que hay que elegir la sede de los siguientes Juegos Olímpicos, y que las ciudades candidatas a ser la sede de los mismos son Barcelona (BCN), Johannesburgo (JNB), Los Ángeles (LAX), Sydney (SYD) y Tokio (TYO).

El COI – Comité Olímpico Internacional, que es el “organismo encargado de promover el olimpismo en el mundo y coordinar las actividades del Movimiento Olímpico”, es también quien se encarga de la elección de las sedes de los Juegos Olímpicos.

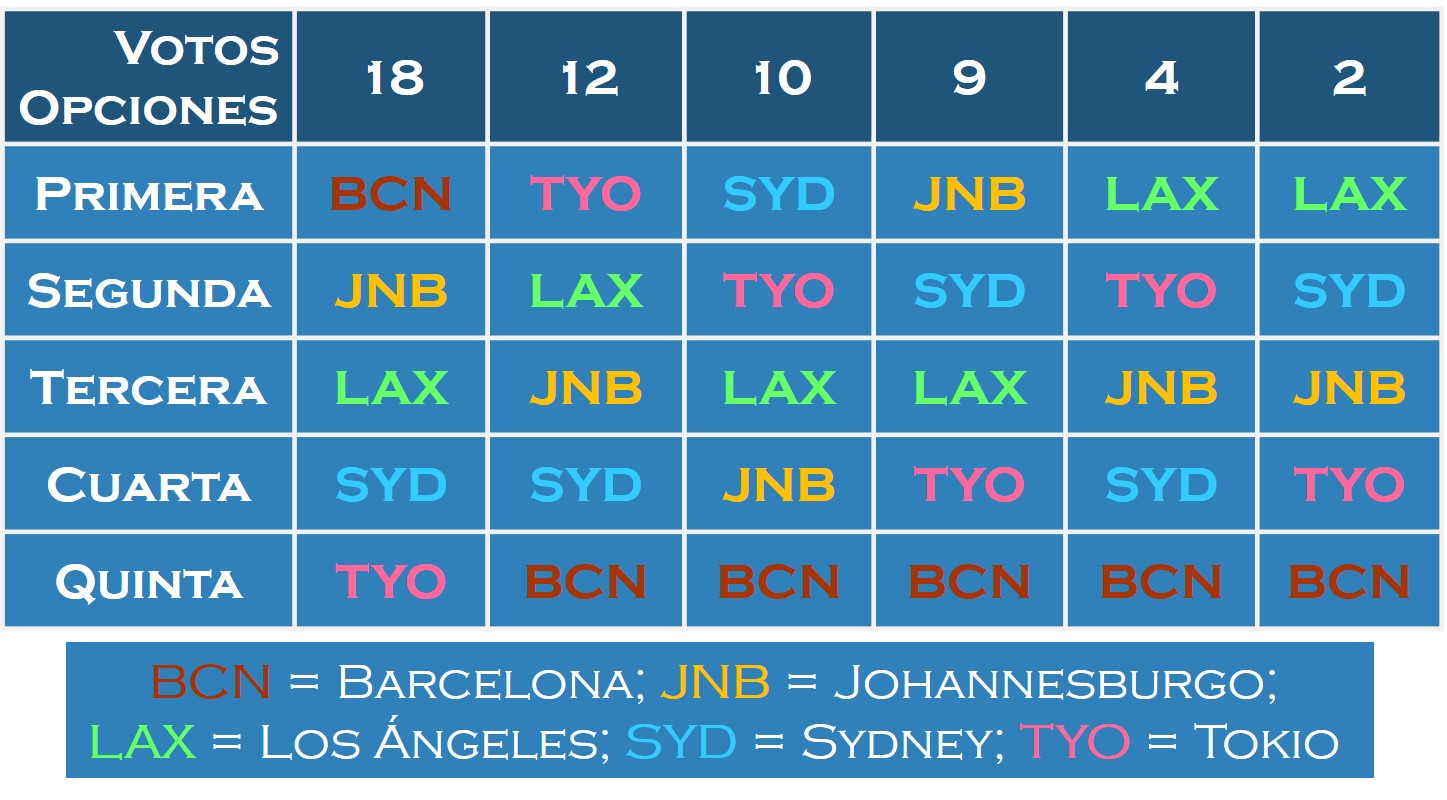

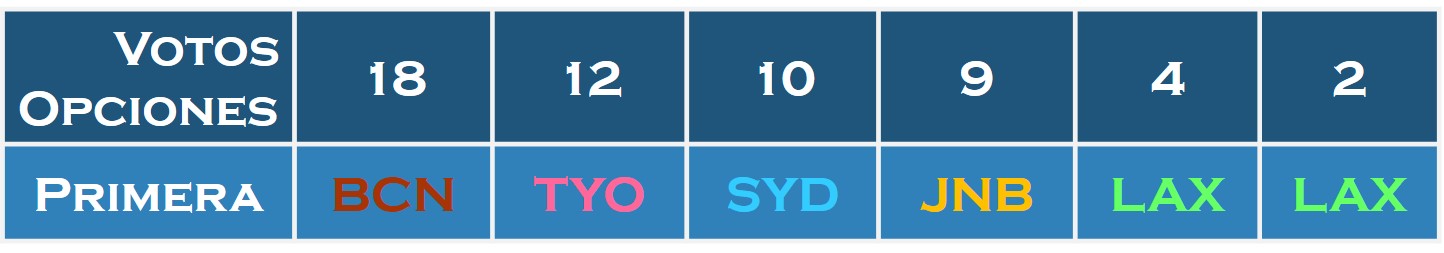

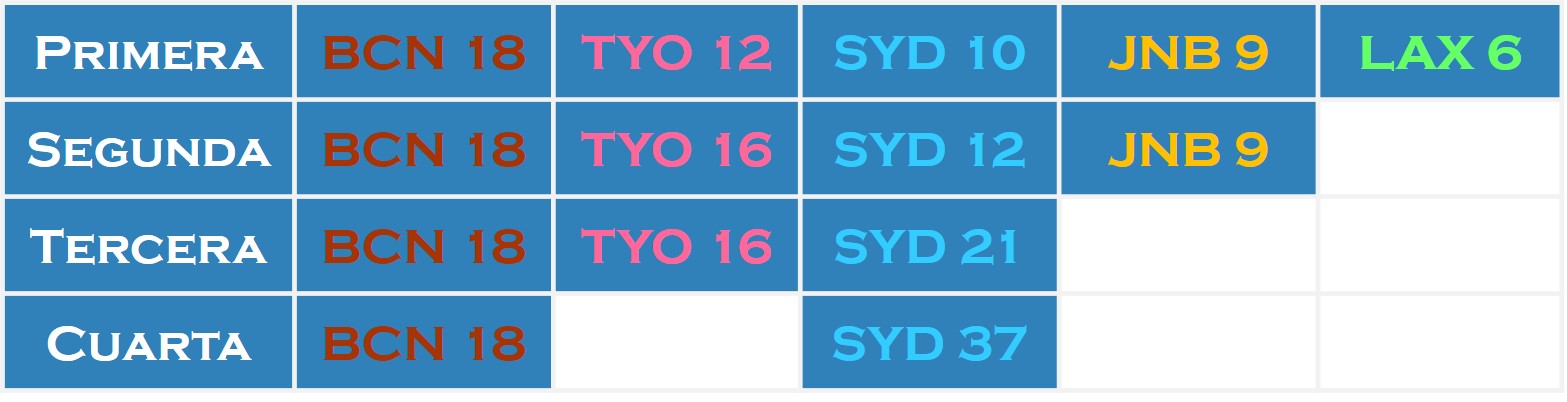

Supongamos que el número de compromisarios del COI que pueden tomar parte en la votación para la elección de la sede de las Olimpiadas es 55 (aunque en realidad son del orden de cien), y que para conocer mejor la opinión personal de cada uno de los compromisarios respecto al problema de la elección de la sede de los JJ. OO., se les pide en esta ocasión que ordenen las ciudades candidatas en función de sus preferencias, primero la ciudad que piensan que debería ser la sede, después su segunda opción, seguida de la tercera, la cuarta y finalmente, la última opción. E imaginemos que el resultado de las votaciones ha sido el siguiente:

Por ejemplo, 18 de los compromisarios han ordenado las ciudades de la siguiente forma: Barcelona es su opción preferida, su segunda opción es Johannesburgo, la tercera es Los Ángeles, seguida de Sydney y por último, Tokio. Y de forma similar, como se indica en la tabla anterior, el resto de compromisarios.

Una vez que tenemos fijadas las preferencias individuales de los miembros del Comité Olímpico Internacional, debemos de decidir cuál es la ciudad ganadora, es decir, establecer la preferencia colectiva.

A. Método de votación “mayoría simple”.

Este método, conocido también como “método de pluralidad”, es el método de votación más antiguo y sencillo que existe. Cada votante expresa su preferencia individual votando por su candidatura preferida y al final se cuentan los votos que recibe cada una de las opciones que se han presentado, y la que ha obtenido más apoyos, más votos, es la ganadora.

Este sencillo sistema es uno de los más utilizados, sobre todo en grandes votaciones. Por ejemplo, es el sistema utilizado en las elecciones presidenciales de Canadá, EE.UU., México, Venezuela, Palestina, Panamá o Ruanda, entre muchos otros países. Así mismo, también suele ser el sistema utilizado en las elecciones primarias de muchos partidos políticos.

Papeleta electoral general de las elecciones de las elecciones de 2016 a Presidente y Vice-presidente de los Estados Unidos de América

Entre los inconvenientes de este sistema de votación está el que puede ganar una candidatura para nada deseada por la mayoría de las personas del colectivo de votantes, si hay varias opciones similares que hacen que el voto se divida dentro de esas opciones parecidas. Es un sistema que permite desarrollar estrategias para manipular el resultado, por ejemplo, si hay dos opciones de voto y quien convoca las elecciones teme que pierda su opción, puede plantear dividir la opción contraria en dos opciones parecidas que se deriven de ella, para que se divida el voto. Por ejemplo, en las elecciones para la salida de Gran Bretaña de la Unión Europea, Brexit, donde había dos opciones SI (salir de la UE) y NO (permanecer), podría haber tenido tres opciones del siguiente estilo:

A. salir de la UE, manteniendo una alianza estratégica con ella;

B. salir de la UE, rompiendo toda relación;

C. permanecer en la UE.

Quizás así el voto del SI se podría haber dividido entre las opciones A y B. Es un ejemplo simple, pero nos sirve para ilustrar la idea.

Utilizando este sistema de votación, el de la mayoría simple, los resultados para la elección de la sede de los siguientes Juegos Olímpicos habrían sido estos:

Es decir, Barcelona (BCN), 18 votos; Tokio (TYO), 12 votos; Sydney (SYD), 10 votos; Johannesburgo (JNB), 9 votos; y Los Ángeles (LAX), 6 votos. Por lo tanto, la ciudad ganadora, y en consecuencia, sede de los siguientes JJ.OO. habría sido

B. Método de votación “segunda vuelta”.

Otro de los métodos de votación utilizado en muchas elecciones presidenciales, como en Francia, Brasil, Portugal, Polonia, Rusia, Colombia, Argentina, Chile, Perú o Indonesia, es el método de segunda vuelta, también llamado “balotaje” (que viene del vocablo francés ballottage).

Este consiste en lo siguiente. Si tras la primera votación, en la que cada persona vota por su candidatura preferida como en el sistema de mayoría simple, alguna de las candidaturas ha alcanzado la mayoría absoluta, es decir, más del 50% de los votos, entonces es la ganadora. En caso contrario, las dos opciones más votadas pasan a la segunda vuelta, produciéndose entonces una votación únicamente entre estas dos opciones.

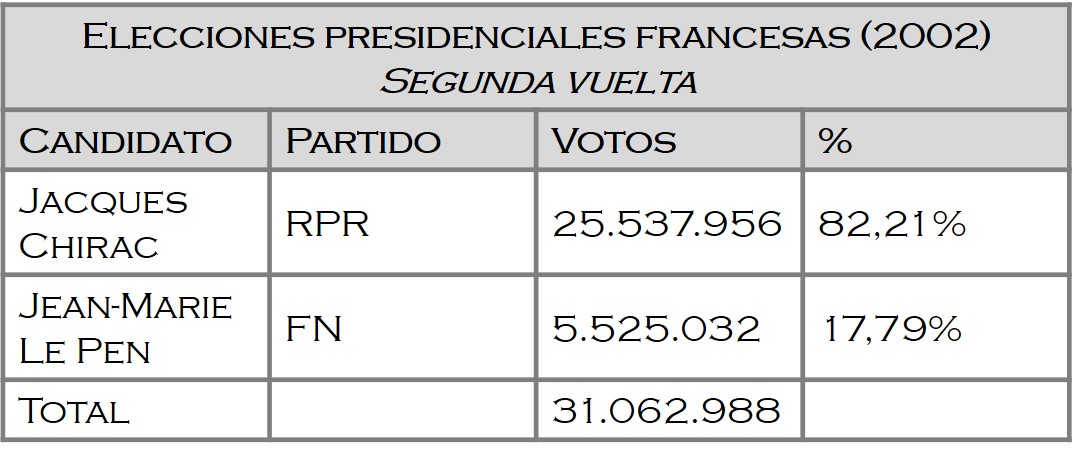

Veamos un caso real, las elecciones francesas de 2002, en las cuales había 16 candidatos a la presidencia de la República Francesa. En la primera vuelta los resultados fueron:

Los dos candidatos que pasaron a la segunda vuelta fueron Jacques Chirac (del RPR – Agrupación por la República, partido conservador francés neo-gaullista) y Jean-Marie Le Pen (del FN – Frente Nacional, partido político de extrema derecha francés). Jean-Marie Le Pen dejó fuera de la segunda vuelta, por un pequeño porcentaje, al socialista Lionel Jospin, que era a priori el candidato natural para pasar a la segunda vuelta.

En la segunda vuelta el resultado de la votación entre Jacques Chirac y Jean-Marie Le Pen fue

con un triunfo aplastante de Jacques Chirac, mientras que Jean-Marie Le Pen no obtuvo un incremento significativo en el porcentaje de votos.

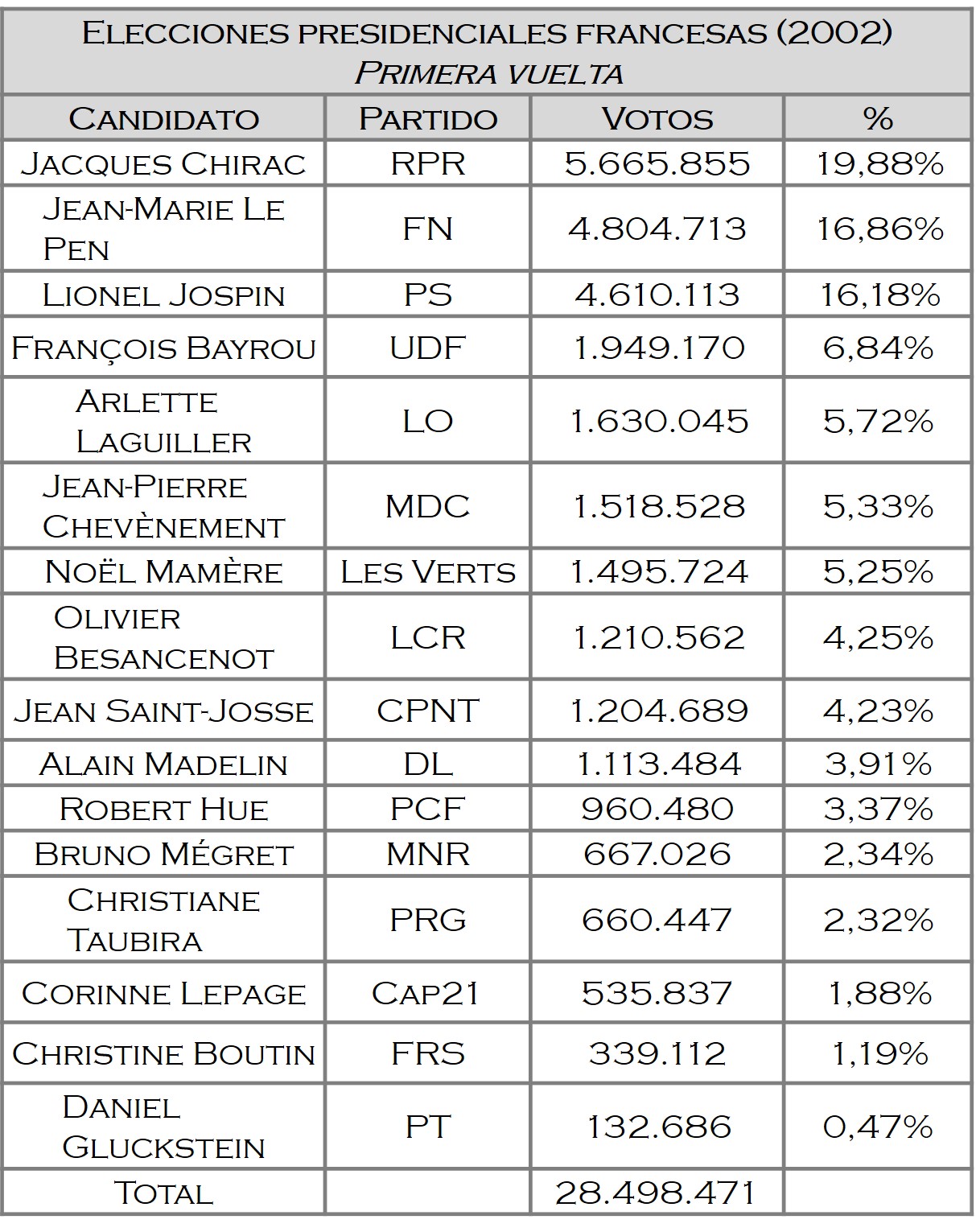

Volviendo a nuestro ejemplo, si observamos los resultados de la votación por parte de los miembros del COI, las dos candidaturas más votadas han sido Barcelona, con 18 votos –que son el 32% de los votos– y Tokio, con 12 votos –que son el 21,8% de los votos–. Como ninguna de las candidaturas ha obtenido mayoría absoluta, esas dos ciudades, Barcelona y Tokio, pasan a la segunda vuelta. Y se produce por tanto una segunda votación.

En la vida real, entre la primera y la segunda votación pueden producirse cambios en la opinión de los votantes. Los motivos pueden ser muy diversos. Por ejemplo, puede que haya votantes que estén desencantados o cansados de las elecciones, o puede que las candidaturas que han pasado a la segunda vuelta no tengan el atractivo suficiente para algunos votantes, o que algunos votantes modifiquen su intención de voto en la segunda vuelta por sugerencia de quienes apoyaban la candidatura por la que habían votado en la primera.

Es decir, en la vida real la cuestión es más complicada que en este ejemplo, donde ya tenemos la intención de voto en la segunda vuelta marcada por las preferencias de la votación realizada. En cualquier caso, si miramos a la tabla de preferencias anterior y vemos cuales son las preferencias de los compromisarios en la votación entre Barcelona y Tokio (en la siguiente tabla hemos dejado solamente las dos ciudades) …

… observamos que el resultado de la segunda vuelta será: Barcelona, 18 votos, y Tokio, 37 votos, puesto que todos los compromisarios que no votaron por Barcelona en la primera vuelta, prefieren Tokio a Barcelona. La ciudad ganadora y, en consecuencia, sede de los siguientes JJ.OO. será

C. Método de votación “eliminación de los perdedores”.

Este es el sistema que utiliza realmente el Comité Olímpico Internacional, con la salvedad de que nosotros estamos contando con la intención de voto desde el inicio para determinar lo que votará cada compromisario en las diferentes vueltas que se van a producir, mientras que, en la realidad, entre una votación y la siguiente, cada compromisario puede cambiar de opinión, ya sea de forma libre, con la intención de manipular el resultado a favor de una opción débil e intentando eliminar alguna candidatura rival con posibilidades o como consecuencia del juego político que se desarrolla en esos momentos “entre bastidores”.

El método de “eliminación de los perdedores” consiste en lo siguiente. Cada votante da su voto a la candidatura que piensa que es la mejor de todas, como en las anteriores, pero después del recuento de votos se elimina la candidatura menos votada. Entonces, se produce la segunda ronda, en la que se vota entre todas las candidaturas, menos la que ha sido eliminada, se cuentan los votos y se elimina la candidatura con menos votos. Así se continúa hasta que solamente queda una candidatura, que será la ganadora de la votación.

Por ejemplo, en octubre de 2009 se produjo la elección de la sede de los JJ.OO. de 2016. Las ciudades candidatas fueron Río de Janeiro, Madrid, Tokio y Chicago. En la primera vuelta los resultados de la votación dentro del COI fueron:

Río de Janeiro, 26 votos; Madrid, 28 votos; Tokio, 22 votos; y Chicago, 19 votos.

Por el método de la mayoría simple habría ganado Madrid. Sin embargo, como utilizan el método de la “eliminación del perdedor” se eliminó a Chicago en esa primera ronda. Los resultados de la segunda votación fueron:

Río de Janeiro, 46 votos; Madrid, 29 votos; Tokio, 20 votos .

Observemos que Tokio no solo no subió en votos, sino que perdió dos de los votos de la primera ronda. Pasaron a la siguiente ronda Río de Janeiro y Madrid, donde perdió Madrid por 66 frente a 32 votos.

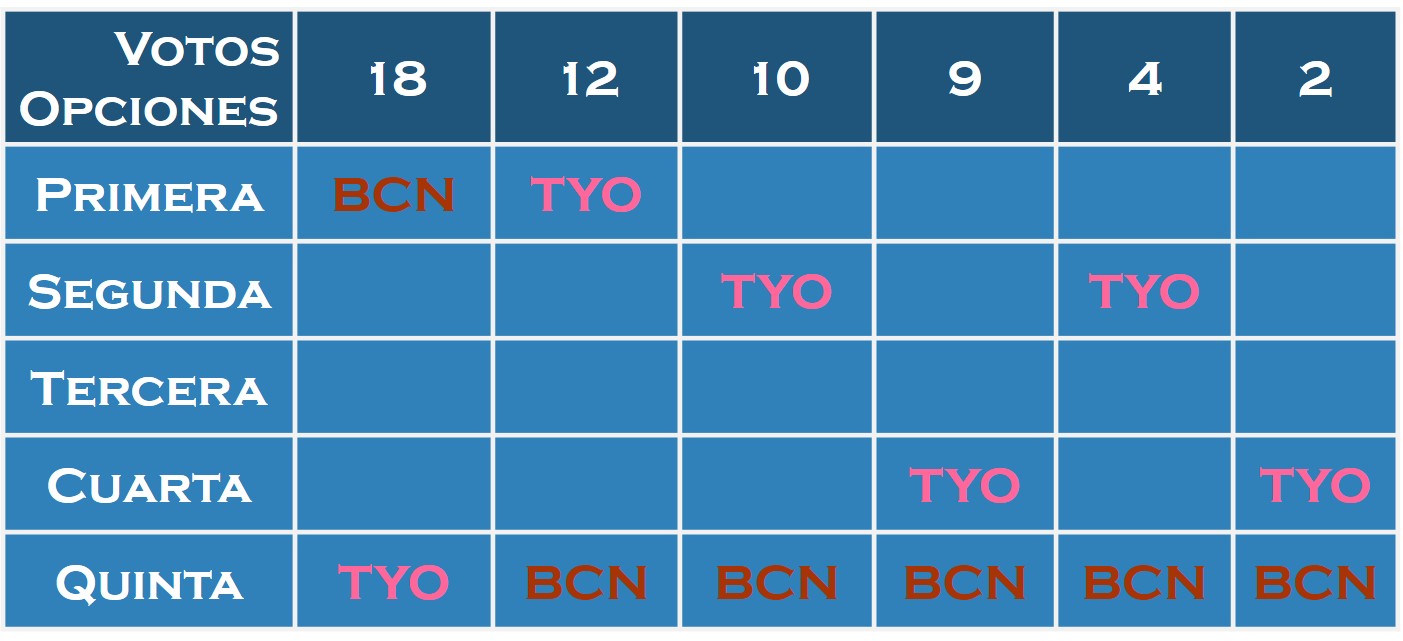

En nuestro ejemplo, tenemos que los resultados de las votaciones en cada una de las rondas, siguiendo la intención de voto que han manifestado inicialmente (véase el cuadro de arriba), serían…

Las ciudades eliminadas en cada ronda serían Los Ángeles, Johannesburgo, Tokio y finalmente Barcelona, quedando como ciudad ganadora y, en consecuencia, sede de los siguientes JJ.OO.

D. Método de votación “recuento de Borda”.

Este sistema de votaciones, propuesto por el matemático, físico, navegante y político francés Jean-Charles de Borda (1733-1799), se utiliza, por ejemplo, en las elecciones primarias de Podemos, en las elecciones presidenciales de Kiribati en el océano Pacífico, o se utilizó también en el proceso de pacificación de Irlanda.

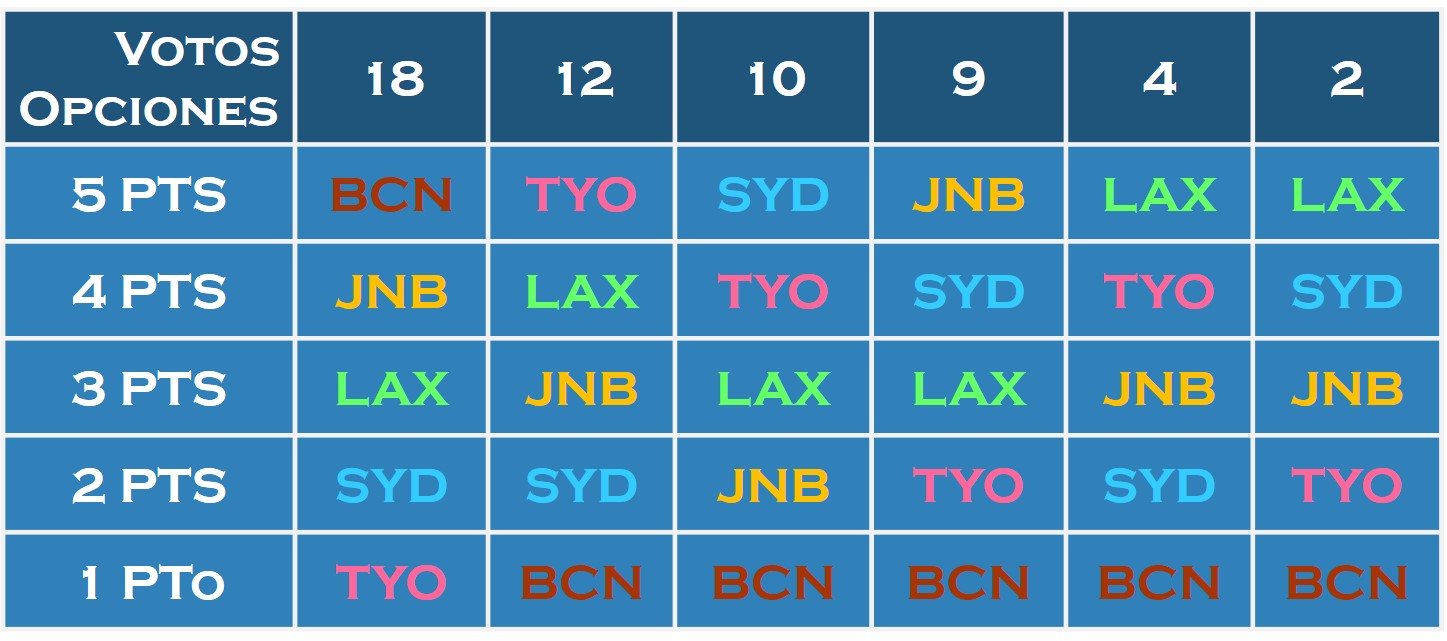

Este método consiste en darle peso a las preferencias de los votantes sobre las candidaturas, mediante la asignación de puntos según el orden de preferencia. De esta forma se prima a las primeras preferencias sobre las últimas.

Así, en nuestra votación para la sede de los JJ.OO. se conceden 5 puntos a la ciudad preferida del votante, 4 puntos a la segunda opción, 3 puntos a la tercera, 2 puntos a la cuarta y 1 punto a la última, como se observa en la imagen.

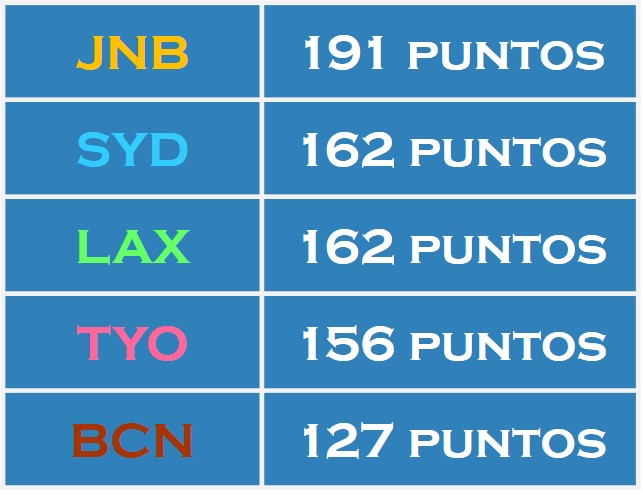

De esta forma, el número de puntos de cada candidatura es:

En consecuencia, la ciudad ganadora y sede de los siguientes JJ.OO. sería

E. Método de votación “de Condorcet”.

El método de Condorcet, como ya se anticipaba en la paradoja que lleva su nombre, es el de los enfrentamientos dos a dos, por parte de todas las candidaturas, es decir, cada candidatura se compara con el resto de candidaturas, y la que “gane” más enfrentamientos gana las elecciones.

En nuestro ejemplo, como tenemos 5 ciudades candidatas a sede de los siguientes juegos olímpicos, el número de enfrentamientos dos a dos será 10. Cada ciudad se enfrenta a cuatro ciudades.

Por ejemplo, si enfrentamos a Los Ángeles y Sydney, el resultado de la votación de los compromisarios si solo votan por una de las dos es (miremos la tabla anterior de preferencias): Los Ángeles, 36 votos; Sydney, 19 votos.

La única ciudad que, en este ejemplo, gana todos sus enfrentamientos es Los Ángeles. En concreto, LAX 28 – JNB 27; LAX 36 – SYD 19; LAX 33 – TYO 22; y LAX 37 – BCN 18. Por lo tanto, la ciudad ganadora de estas elecciones y sede de los siguientes JJ.OO. sería

Cuadro “Voting Line” del artista americano Charly “Carlos” Palmer

Este ejemplo nos ilustra como el ganador de la anterior votación no lo determinan únicamente las preferencias individuales de los votantes, sino también el método de votación elegido. Con unas mismas preferencias individuales (las que hemos recogido en la tabla inicial) se obtiene que cada ciudad candidata podría ganar las elecciones en función del sistema de votación elegido.

Por lo tanto, habrá que tratar de elegir el método de votación que permita determinar la preferencia colectiva que mejor represente las preferencias individuales de los votantes. Este será el tema de nuestra siguiente entrada del Cuaderno de Cultura Científica.

Para terminar, una cita del filósofo, matemático y político francés, Nicolás de Condorcet. Tras la Revolución Francesa, la Asamblea Nacional estuvo trabajando sobre los Derechos del Hombre y del Ciudadano, dejando fuera a las mujeres. Una de las personas que pidió el reconocimiento de los derechos de las mujeres fue precisamente el Marqués de Condorcet.

Quien vota en contra del derecho de otro ser, sean cuales sean su religión, el color de su piel o su sexo, renuncia a los suyos desde ese preciso momento.

“Sobre la admisión de las mujeres al derecho de ciudadanía”

Marqués de Condorcet, 1790

Bibliografía

1.- VV. AA., Las matemáticas en la vida cotidiana, Addison-Wesley/Universidad Autónoma de Madrid, 1999.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo El disputado voto del Señor Condorcet (I) se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- “La cultura científica o la misteriosa identidad del señor Gauss” por Raúl Ibáñez

- La insoportable levedad del TRES, o sobre la existencia de sistemas numéricos en base 3

- Uno, dos, muchos

Sistemas respiratorios: la emergencia de un doble sistema circulatorio

No todos los animales cuentan con lo que puede considerarse, con propiedad, un sistema circulatorio. Y muchos animales, aunque tienen bomba o bombas de impulsión, tienen sistemas circulatorios abiertos. En los sistemas abiertos la sangre o hemolinfa bombeada se vierte a una amplia cavidad interna a través de un sistema de arterias que se ramifican de forma sucesiva. Luego es recogida por un sistema de venas equivalente al anterior y devuelto a la bomba de impulsión. Los sistemas abiertos ejercen un menor control que los cerrados sobre el flujo de sangre a los diferentes órganos, aunque en cualquier caso las demandas de los tejidos son satisfechas de manera conveniente.

El sistema abierto más complejo que se conoce es el de algunos crustáceos, que alcanzan un desarrollo muy similar al de los sistemas cerrados. El sistema arterial llega hasta el final de las extremidades, la hemolinfa se vierte en pequeños espacios abiertos y de ellos es recogida por unos senos a modo de pequeños canales que la devuelven al corazón, no sin antes pasar por las branquias. Así pues, en estos crustáceos la sangre se oxigena en su trayecto de vuelta a la bomba de impulsión.

Las cosas son diferentes en los animales que tienen sistemas cerrados. Los cefalópodos son los únicos moluscos con sistema cerrado. En estos la sangre también pasa por las branquias antes de alcanzar el corazón sistémico o corazón principal, de donde se distribuye al resto de órganos y tejidos. A diferencia de los crustáceos, los moluscos cefalópodos tienen dos corazones branquiales que bombean la sangre venosa procedente de los tejidos a las branquias. Así se oxigena y se descarga de CO2 antes de llegar al corazón sistémico. Una característica notable de este sistema es que al trabajar con sangre venosa, los corazones auxiliares trabajan en condiciones virtualmente anóxicas, con muy escaso aporte de oxígeno.

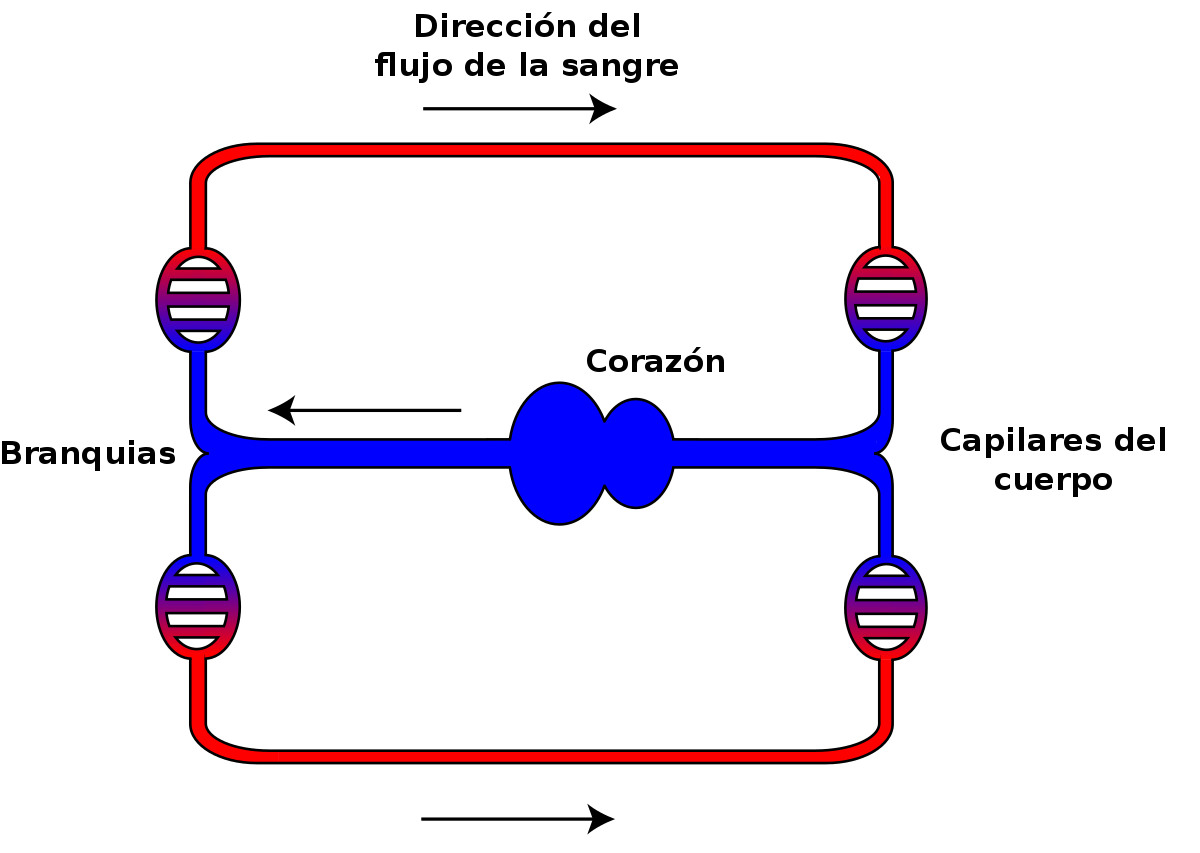

Esquema del sistema circulatorio de los peces. Fuente: Lennert B. / Wikimedia Commons

Los sistemas circulatorios cerrados más desarrollados son los de los vertebrados, y hay una gran variedad de disposiciones anatómicas en este grupo. Lo más probable es que los de los primeros vertebrados consistieran en un circuito muy simple que siguiera, más o menos, la secuencia: corazón, arteria, branquias, aorta, arterias, arteriolas, capilares, vénulas, venas y corazón. Este sistema es diferente de los anteriores porque en aquellos la sangre circulaba de las branquias al corazón y en este circula del corazón a las branquias. Es un buen dispositivo a efectos de oxigenar la sangre, pero reduce mucho la velocidad de circulación desde el corazón a los tejidos, porque al pasar por los capilares branquiales, estos, por su pequeño calibre, ofrecen una gran resistencia al paso de la sangre y la ralentizan. Los peces mantienen las características generales de este sistema, aunque en algunos casos incorporan alguna bomba auxiliar antes del corazón sistémico.

La transición al medio terrestre trajo importantes novedades. La aparición de órganos respiratorios distintos de las branquias complicó de forma notable la arquitectura del circuito. Como vimos aquí, hay peces que son capaces de respirar en aire a través de estructuras tales como la cavidad bucal, el intestino, la vejiga natatoria o la cloaca. En los primeros que desarrollaron esa capacidad el órgano respiratorio recibe sangre del circuito sistémico, lo que da lugar a que, una vez oxigenada, se mezcle con la desoxigenada que procede del resto de los tejidos antes de entrar en el corazón. Por lo tanto, cuando respiran en aire los tejidos sistémicos reciben sangre parcialmente oxigenada, porque las branquias, en caso de ser funcionales, aportan muy poco oxígeno. Esa particularidad, que ha sido tradicionalmente considerada una desventaja de esos peces, tiene sin embargo una ventaja por comparación con los que respiran en agua a través de las branquias: como la sangre que llega al corazón está parcialmente oxigenada, el corazón toma de ella el oxígeno que necesita.

A diferencia de los anteriores, en los peces pulmonados –y en concreto, en el respirador aéreo obligado Protopterus aethiopicus– la sangre procedente de los pulmones no se mezcla con la procedente de los tejidos antes de entrar en el atrio (aurícula) del corazón, sino que entra en este directamente. Y por otro lado, la configuración anatómica del corazón de estos peces es tal que permite que la sangre procedente de los pulmones y la que llega del resto de los tejidos solo se mezclen en una pequeña proporción, de manera que la que viene de los pulmones se dirige preferentemente a la circulación sistémica, y la que procede de los tejidos a los pulmones. Aunque anatómicamente no hay una separación clara entre los dos circuitos, el sistémico o general, y el pulmonar, funcionalmente se produce una cierta diferenciación, lo que constituye un anticipo de los sistemas totalmente diferenciados que aparecieron posteriormente en otros vertebrados.

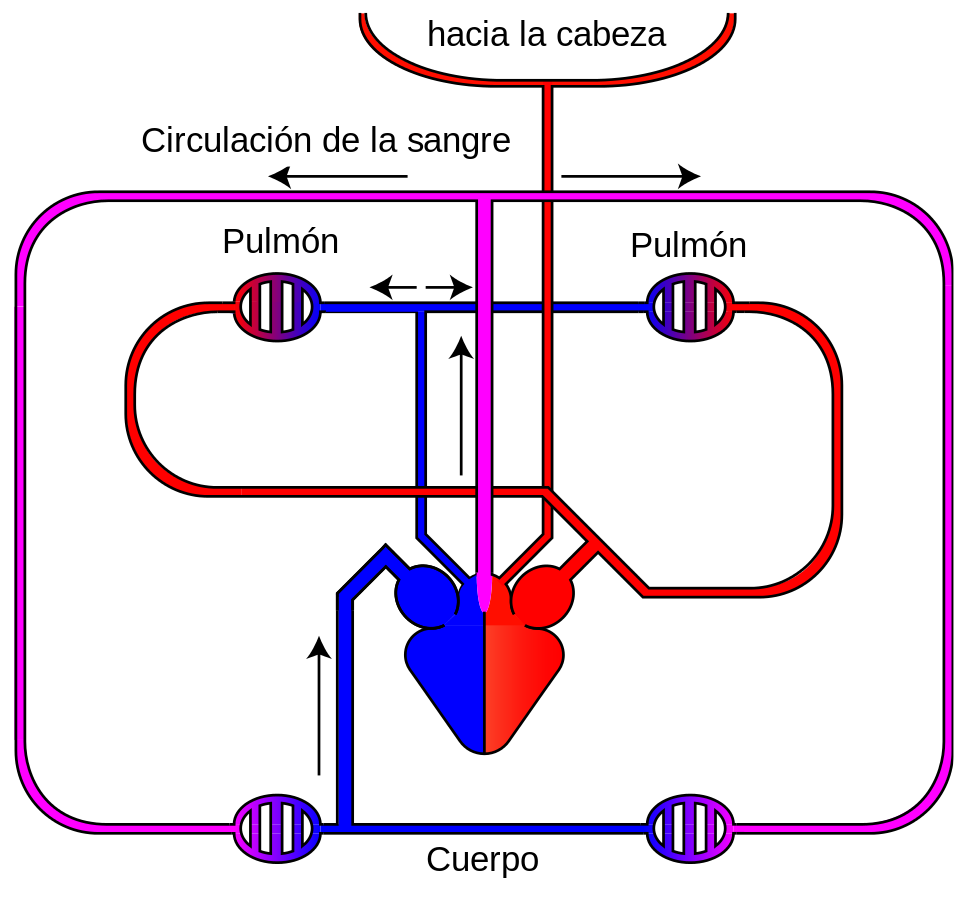

Esquema del sistema circulatorio de los anfibios. Fuente: Lennert B. / Wikimedia Commons

Los anfibios que respiran en aire tienen ya dos cámaras auriculares separadas. La sangre oxigenada procedente de los pulmones entra en la aurícula izquierda, mientras la sangre sistémica venosa entra en la derecha a través del seno venoso. Ambas sangres están separadas hasta que llegan al ventrículo. Pero, gracias a las características ventriculares, tampoco en este se mezclan en una medida significativa. En anfibios, además, hay que introducir la irrigación de la piel en el análisis, dado que puede contribuir de forma significativa al intercambio de gases. El caso de la rana toro (Rana catesbeiana) es muy ilustrativo. Prácticamente toda la sangre oxigenada procedente de los pulmones llega a la aurícula izquierda y sale hacia la circulación sistémica, se descarga de O2 en los tejidos y vuelve al corazón, donde entra por la aurícula derecha; la mayor parte de esa sangre venosa desoxigenada se dirige a la vía pulmo-cutánea (dos tercios a los pulmones, y el otro tercio a la piel). Lo curioso es que la sangre (oxigenada) que procede de la piel se mezcla con la procedente de los tejidos antes de llegar al corazón.

Esquema del sistema circulatorio de los reptiles. Fuente: Basquetteur. / Wikimedia Commons

Los reptiles no cocodrilianos (tortugas, serpientes y lagartos) tienen el ventrículo parcialmente separado en tres cámaras, y aunque la separación no es total, también en estos hay poca mezcla de sangre oxigenada y desoxigenada. No se conoce bien el mecanismo, pero las arterias pulmonares reciben preferentemente sangre desoxigenada. En los cocodrilianos el ventrículo está completamente dividido en dos cámaras por un septo. Del ventrículo izquierdo sale la arteria pulmonar y una arteria sistémica, la izquierda, y del ventrículo izquierdo sale la aorta sistémica derecha; sendas válvulas controlan el flujo a través de ambas aortas y están, además, conectadas nada más salir del corazón. Ese sofisticado dispositivo no solo propicia una distribución selectiva de la sangre desoxigenada a los pulmones prácticamente perfecta, sino que durante el buceo permite limitar el flujo de sangre a los pulmones cuando estos se han quedado sin oxígeno.

Los diferentes dispositivos vistos en peces (de respiración aérea), anfibios y reptiles son funcionales en animales que no tienen garantizado un alto contenido en oxígeno en sus pulmones de manera permanente. Permiten dirigir la sangre desoxigenada y oxigenada hacia diferentes destinos dependiendo de las circunstancias; por ejemplo, dependiendo de la disponibilidad ambiental de O2 y, por ello, de su concentración en el órgano respiratorio. Por eso, la adquisición de un doble sistema, pulmonar y sistémico, por parte de aves y mamíferos no debe entenderse como un “último” paso en la evolución de los sistemas respiratorios hacia una hipotética configuración ideal. La disposición en serie del circuito sistémico y del pulmonar obliga a que los flujos hacia uno y el otro sean idénticos. Ello impide generar flujos diferentes en un y otro circuito, pero en aves y mamíferos no hay tal necesidad, pues, como se ha dicho, estos grupos tienen elevadas concentraciones de oxígeno en sus pulmones de forma permanente.

Por otro lado, esa configuración permite generar presiones hidrostáticas muy diferentes en cada circuito: en el sistémico son necesarias altas presiones para vencer la resistencia que ofrece el sistema capilar, pero en el pulmonar la presión no ha de ser muy alta, pues de lo contrario saldría plasma sanguíneo hacia los espacios extracelulares e, incluso, al interior de los alveolos, lo que aumentaría peligrosamente la longitud de la vía de difusión. Como consecuencia de esa disposición en serie, ambos circuitos se mantienen completamente separados en el corazón. En animales con muy altas demandas metabólicas, como aves y mamíferos, eso es ventajoso pues permite garantizar que sangres con diferentes contenidos de O2 no se mezclan en ningún momento, lo que favorece el transporte de oxígeno a los tejidos. Pero que ese dispositivo resulte muy ventajoso para aves y mamíferos no quiere decir que los animales que carecen de él tengan, a esos efectos, una configuración incompleta. Como hemos visto, el resto de vertebrados que respiran en aire en la práctica también han conseguido evitar la mezcla de sangres, aunque no de forma completa, y disponen, además de otras funcionalidades de las que carecen los dos grupos homeotermos.

Nota:

En las siguientes anotaciones hemos tratado otros aspectos de los sistemas circulatorios que complementan lo expuesto aquí:

La distribución del agua animal y el curioso caso del potasio

Un viaje a través del sistema circulatorio humano

El flujo sanguíneo se reorganiza en respuesta a las necesidades

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo Sistemas respiratorios: la emergencia de un doble sistema circulatorio se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Un viaje a través del sistema circulatorio humano

- Sistemas respiratorios: el pulmón de los mamíferos

- Sistemas respiratorios: los límites a la difusión de los gases

La teoría de la invariancia

El color del oro es inexplicable si no se tiene en cuenta la relatividad

Tras el triunfo de Newton, su forma de plantear la ciencia física se expandió no solo a la mecánica, sino también a las otras ramas de la ciencia, en especial a la electricidad y el magnetismo. Este trabajo culminó a finales del siglo XIX con una nueva teoría de la electricidad y el magnetismo basada en la idea de campos eléctricos y magnéticos. James Clerk Maxwell, quien formuló la nueva teoría del campo electromagnético, demostró que lo que observamos como luz puede entenderse como una onda electromagnética.

La física de Newton y la teoría de Maxwell explican casi todo lo que observamos en el mundo físico cotidiano que nos rodea. Los movimientos de los planetas, los automóviles y los proyectiles, la luz y las ondas de radio, los colores, los efectos eléctricos y magnéticos y las corrientes, ya sean eléctricas o de masas de agua, encajan dentro de la física de Newton, Maxwell y sus contemporáneos. Además, su trabajo hizo posible las muchas maravillas de la nueva era eléctrica que extende por gran parte del mundo desde finales del siglo XIX. No es de extrañar que para 1900 algunos físicos muy distinguidos creyeran que la física estaba casi completa, y que solo eran necesarios algunos ajustes menores.

Albert Einstein en 1904

No es de extrañar, tampoco, que se quedasen estupefactos cuando, apenas 5 años después, un desconocido empleado de patentes suizo, que se había graduado en el Instituto Politécnico Federal de Zúrich en 1900, presentase cuatro trabajos de investigación que desencadenaron una transformación en la física de tal envergadura que todavía está en curso . Uno estos documentos proporcionó la teoría definitiva buscada desde hace tiempo para la existencia de átomos y moléculas y otro inició el desarrollo de la teoría cuántica de la luz.

En el tercer y cuarto artículos, este jovenzuelo de 26 años llamado Albert Einstein introducía una teoría que el llamaba de la invariancia. En esta serie que hoy comenzamos presentaremos la que después sería conocida como teoría de la relatividad y algunas de sus consecuencias.

Aunque la teoría de la relatividad representaba una ruptura con el pasado, fue una ruptura muy suave. Como el mismo Einstein diría en 1954 en “Ideas y opiniones”:

No tenemos aquí ningún acto revolucionario, sino la continuación natural de una línea que puede rastrearse a través de los siglos. El abandono de ciertas nociones relacionadas con el espacio, el tiempo y el movimiento hasta ahora tratadas como fundamentales no debe considerarse como arbitrario, sino solo condicionado por los hechos observados.

Como decíamos antes, la “física clásica” de Newton y Maxwell todavía está plenamente vigente hoy día para lo que observamos en el mundo cotidiano a escala humana, algo nada sorprendente, ya que está física se derivó y diseñó para el mundo cotidiano. Sin embargo, cuando nos alejamos del día a día, necesitamos usar la teoría de la relatividad (para velocidades cercanas a la velocidad de la luz y para densidades extremadamente altas de la materia, como las que se encuentran en estrellas de neutrones y agujeros negros) o la teoría cuántica (para comprender lo que ocurre a escala de átomos y moléculas), o la combinación de ambos conjuntos de condiciones (por ejemplo, para tener en cuenta las los efectos de las velocidades muy altas a escala atómica).

Lo que hace que esta nuevas teoría de la invariancia sean tan asombrosa, y aparentemente difícil de entender, es que nuestras ideas y suposiciones más familiares sobre conceptos básicos como el espacio, el tiempo, la masa y la causalidad deben revisarse desde perspectivas que no nos son tan familiares. Con todo, son fácilmente comprensibles y ni siquiera son necesarias matemáticas más complejas de lo que se estudian en primaria. Iniciamos un viaje para entender una nueva visión del universo que marcó el siglo XX y que en el XXI nos abre posibilidades de conocimiento inimaginables aún.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo La teoría de la invariancia se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Los antecedentes de la teoría cinética

- La teoría cinética y la segunda ley de la termodinámica

- La teoría de bandas de los sólidos se hace topológica

El factor de adecuación f

Rita Levi-Montalcini, premio Nobel de Medicina o Fisiología 1986, el día de la celebración de su centenario en 2009.

La gente más inteligente tiene, por regla general, mayor calidad de vida, mejor salud y vive más años. Siempre se ha pensado que eso es debido a que las personas más inteligentes toman mejores decisiones sobre sus hábitos de vida. Sin embargo, es posible que además de ese factor, en esa relación intervengan otros elementos, como han sugerido estudios que han encontrado sorprendentes relaciones entre la inteligencia general (factor G) y otras variables.

Uno de los estudios da cuenta de la existencia de una correlación altamente significativa (en términos estadísticos) entre dos variables que en principio, y según sus autores, no tienen nada que ver entre sí, que son la calidad del semen y la inteligencia. Los autores plantean la hipótesis de que exista un factor de éxito o adecuación “f” (de fitness) que subyace a características diversas y que hace que éstas covaríen. Éxito debe entenderse en este contexto como una suerte de propensión estadística a la supervivencia y el éxito reproductivo. Y en otro, observaron correlación negativa entre la inteligencia y la presencia de algunas anomalías o malformaciones de base genética, algo que sería igualmente consecuencia de la existencia de ese factor “f” general de éxito o adecuación.

Los autores proponen dos posibles explicaciones para la existencia de ese tipo de asociaciones entre rasgos en principio independientes. Una sería que el fenómeno se deba a la existencia de genes con efectos pleiotrópicos, o sea, con efectos múltiples en más de un carácter fenotípico. Y la otra es que sea el resultado de lo que en inglés se conoce como “assortative mating” y que podría traducirse como emparejamiento según un conjunto (un surtido) de criterios definidos. La covariación de distintos rasgos sería el resultado de que a lo largo de generaciones personas pertenecientes a determinados grupos de población hayan preferido sistemáticamente esos rasgos en sus parejas y, por lo tanto, se hayan seleccionado a la vez. En este caso habrían sido la inteligencia y otros que reflejan lo que podría considerarse como calidad genética del individuo, muestra de la cual serían la calidad espermática y la ausencia de anomalías.

Los autores de estos trabajos, conscientes de lo impopulares que son los estudios que atribuyen a factores hereditarios rasgos como los aquí tratados, se curan en salud de un tipo de posibles críticas con el párrafo final del segundo trabajo. Transcribo, según traducción propia:

“El campo de la epidemiología cognitiva debiera ocuparse de todas las posibles relaciones causales entre inteligencia y salud, y no solo entre inteligencia fenotípica, estilo de vida, ambientes sociales y salud. La eliminación de las desigualdades de salud es uno de los objetivos que se asigna a la epidemiología cognitiva. Si nuestra hipótesis del factor de éxito es correcta, habría que ver las desigualdades de salud bajo un prisma algo diferente. Puede que algunas disparidades entre grupos socio-económicos no sean evidencia de una sociedad disfuncional, sino que reflejen una variabilidad genética en la carga de mutaciones que afecta tanto a la salud física como a la inteligencia en general (que, a su vez, influye en el éxito socio-económico). La misma evolución puede, mediante mutaciones pleiotrópicas y emparejamientos de acuerdo con un surtido de criterios definidos, maximizar el rango de calidad genética entre individuos y la intensidad de las correlaciones genéticas entre caracteres, con el efecto colateral de que se maximiza la aparente injusticia de la situación médica, educativa y económica. Sin embargo, esto no debiera causar pesadumbre. La evolución también nos ha proporcionado perspicacia, comprensión, empatía y un sentido de la justicia. Las buenas personas, equipadas con una buena comprensión del mundo tal y como es, siempre han encontrado oportunidades para reducir el sufrimiento evitable haciendo uso de esos dones.”

Referencias:

Rosalind Arden, Linda S. Gottfredso, Geoffrey Miller, Aran Pierce (2009): Intelligence and semen quality are positively correlated. Inteligence 37 (3): 277-282

Rosalind Arden, Linda S. Gottfredso, Geoffrey Miller (2009): Does a fitness factor contribute to the association between intelligence and health outcomes? Evidence from medical abnormality counts among 3654 US Veterans. Intelligence 37 (6): 581-591

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo El factor de adecuación f se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Curso de verano “La ciencia de nuestras vidas”: La cultura como factor evolutivo, por Juan Ignacio Pérez

- El altruismo en las mujeres se ve recompensado

- Cuestión de contrastes

El tamaño importa en organismos, empresas, ciudades y economías

Juan Ignacio Pérez Iglesias, lector

En biología animal y fisiología nos interesamos por cómo varía la velocidad o intensidad de los procesos con el tamaño de los organismos que estudiamos. Del estudio de esa fuente de variación hemos descubierto que fenómenos tales como el metabolismo, el latido cardiaco, la proporción de grasa corporal o el tamaño del encéfalo no son funciones lineales de la masa corporal. Son funciones potenciales de la misma. Y el valor de la potencia de la ecuación que las relaciona con la masa puede ser mayor o menor que 1. Si fuera 1 la relación sería lineal, por supuesto.

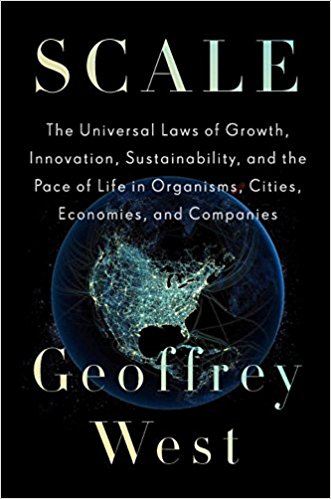

Geoffrey West es un físico al que, hace más de veinte años y por razones que se encarga de explicar él mismo, le empezaron a interesar las relaciones entre ciertas variables y el tamaño de los organismos. Se asoció con otros científicos del campo de la ecología evolutiva y más adelante de otras áreas, e inició una línea de trabajo que a la postre ha resultado ser muy fructífera. Tanto, que además de un ramillete de artículos en algunas de las mejores revistas científicas, ha escrito un libro divulgativo en el que da cuenta de los resultados cosechados. El libro se titula Scale, en versión breve, y Scale: The universal laws of growth, innovation, sustainability, and the pace of life in organisms, cities, economies and companies en toda su extensión.

Como no le resultaban satisfactorias las hipótesis acerca de los factores que determinan esas dependencias de tamaño, propuso una nueva que, todo hay que decirlo, hoy es la que más aceptación tiene, aunque con alguna variación. La hipótesis en cuestión se basa en el carácter fractal de las ramificaciones de los sistemas de distribución de gases, nutrientes y demás sustancias de interés fisiológico en el interior de los organismos animales. A partir de consideraciones puramente geométricas desarrolló, junto con sus colegas, modelos que predecían cuál había de ser el valor de la potencia de las relaciones entre funciones diversas y el tamaño. Y los resultados le satisficieron.

Tras ocuparse de los animales, su metabolismo, su alimentación, sus corazones, el latido cardiaco y demás, pasó a las plantas, al modo cómo se distribuye la savia y llega hasta las hojas. Y no contento con los árboles, siguió con las ciudades: su funcionamiento, la velocidad a la que anda la gente por ellas, el volumen de combustible que consumen, la longitud de las redes de cables, su intensidad innovadora, y bastantes más rasgos cuantitativos que permiten caracterizar cómo funcionan los sistemas urbanos. También se ha ocupado de las empresas, aunque en menor medida.

Partiendo, en todos los casos, de una serie de premisas relativamente sencillas –las relacionadas con la fractalidad de los procesos analizados-, West y colaboradores realizan predicciones que vienen a cumplirse con un alto grado de acierto1 y que básicamente permiten definir una serie de magnitudes muy simples que caracterizan el funcionamiento de organismos o ciudades en función de sus dimensiones. Resumiendo mucho se puede decir que en los organismos las cosas van más lentas cuanto más grandes son, mientras en las ciudades ocurre lo contrario: en las de mayor tamaño casi todo va más rápido.

Lo más notable de los resultados de West es el carácter universal de las relaciones encontradas. Él sostiene que esos resultados reflejan, de hecho, la existencia de leyes que gobiernan el modo en que funcionan organismos de diferente naturaleza en función de su tamaño. Se trataría, según él de leyes de la Naturaleza equivalentes a otras leyes que la ciencia ha ido descubriendo a lo largo de su historia.

Como suele ocurrir en estos caso, no todo lo que he leído en Scale me ha gustado. No me gusta la actitud condescendiente del autor en relación para con sus colegas de otras disciplinas. Tampoco me han convencido algunas explicaciones de índole fisiológica; West es físico y los colegas con los que ha trabajado las materias biológicas son ecólogos y eso, cuando habla de fisiología, se nota. El texto es, a mi juicio, demasiado largo porque ha dedicado mucho espacio a explicar nociones muy básicas; es posible que haya lectores que lo agradezcan, pero no ha sido mi caso. Y por último, tampoco me ha parecido buena idea el ejercicio de prospectiva que hace hacia el final en un línea neomalthusiana. Porque el futuro sigue sin ser predecible.

Pero dicho lo anterior, Scale es un libro muy interesante porque los fenómenos que analiza y la aproximación seguida lo son. Además, para las gentes de ciencia resulta muy gratificante encontrar el tipo de regularidades universales que documenta. A mí, en concreto, me ha resultado muy sugerente, sobre todo lo relativo a las ciudades; creo que entiendo mejor la forma en que funcionan los sistemas urbanos después de leerlo. Es un libro que hace pensar, “thought provoking”, como dicen inglés.

Ficha:

Autor: Geoffrey West

Título: Scale: The universal laws of growth, innovation, sustainability, and the pace of life in organisms, cities, economies and companies.

Año: 2017

Editorial: Penguin Random House/Orion

Nota:

1 De otra forma, imagino que los trabajos no se habrían publicado.

En Editoralia personas lectoras, autoras o editoras presentan libros que por su atractivo, novedad o impacto (personal o general) pueden ser de interés o utilidad para los lectores del Cuaderno de Cultura Científica.

El artículo El tamaño importa en organismos, empresas, ciudades y economías se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- #Naukas14 El tamaño sí importa…sobre todo en el nanomundo

- De los organismos

- Evolución del tamaño animal

Naukas Pro 2017: Inma Estévez y la producción animal

El pasado 14 de septiembre de 2017 se celebró la primera edición de Naukas Pro, en el que Centros de Investigación, Laboratorios, científicos de renombre o equipos de trabajo contaron con 20 minutos para explicar a un público general en qué consiste su trabajo.

5ª Conferencia: Inma Estévez, departamento de producción animal de Neiker Tecnalia

Inma Estévez explica cómo se trabaja en la producción animalEdición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Naukas Pro 2017: Inma Estévez y la producción animal se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Naukas Pro 2017: Julián Estévez y la inteligencia computacional

- Naukas Pro 2017: Leni Bascones y los superconductores

- Naukas Pro 2017: Manuel Collado y las células madre

La compleja transición de cazador-recolector a agricultor

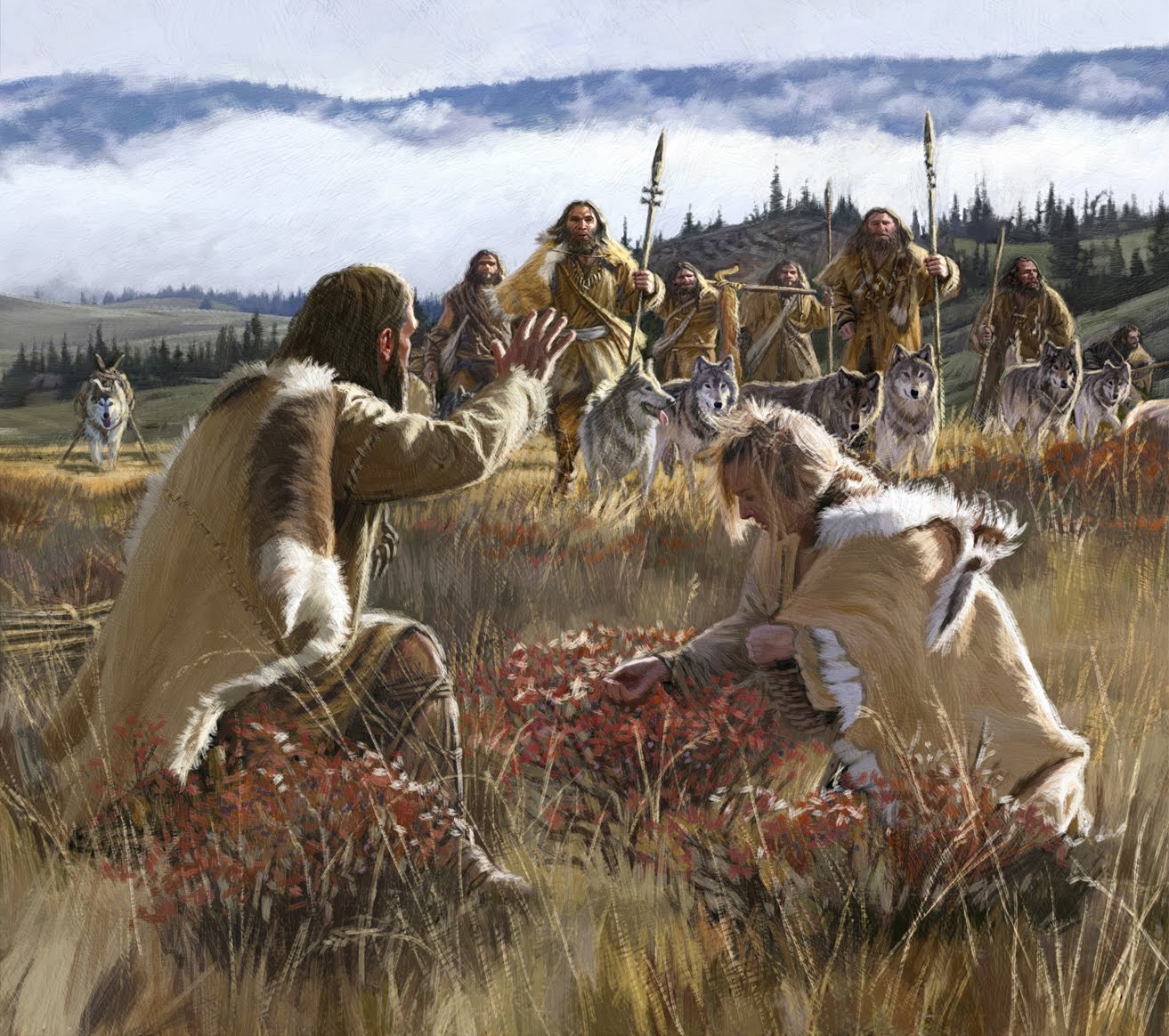

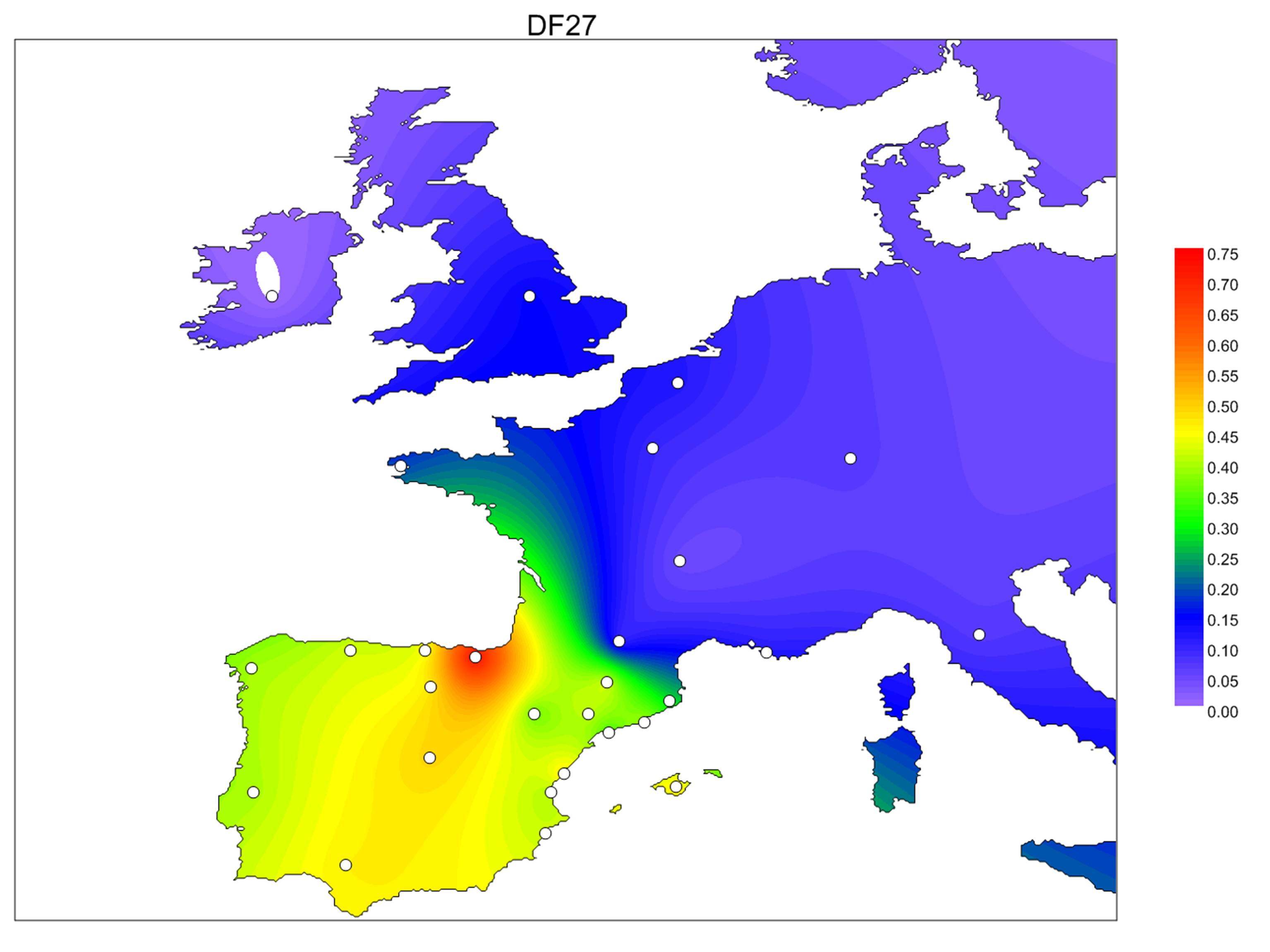

Los investigadores han recuperado 180 genomas de Hungría, Alemania y España de hace entre 8.000 y 4.000 años. Su estudio pone de manifiesto que los primeros agricultores en Europa se entrecruzaron con los cazadores locales durante nada menos que 3.000 años.

Imagen: Dan Burr

El cambio del modo de vida cazador-recolector a agricultor representa la mayor transición demográfica experimentada por el ser humano en millones de años. La agricultura surge en Oriente Próximo hace unos 10.000 años y posteriormente se expande hacia Europa, donde en pocos miles de años reemplaza a los cazadores mesolíticos (el primer genoma mesolítico, secuenciado hace apenas tres años, es el del hombre de La Braña, en León). Aunque desde hace algunos años sabemos que ambos grupos eran genéticamente distintos, las dinámicas locales de dicho proceso de reemplazamiento eran hasta ahora poco conocidas.

Un equipo internacional de investigadores, entre los que se encuentran Javier Fernández Eraso y José Antonio Mujika Alustiza, del Departamento de Geografía, Prehistoria y Arqueología de la Universidad del País Vasco/Euskal Herriko Unibertsitatea, ha logrado secuenciar numerosas muestras antiguas procedentes de tres regiones de Europa (Hungría, Alemania y España). “Gracias a esta secuenciación se ha podido determinar que en los tres casos, después de la llegada inicial de los primeros agricultores, éstos se entrecruzaron con los cazadores locales a lo largo de varios siglos”, han explicado desde el equipo investigador. Es decir, los genomas de los agricultores del neolítico medio, final y del calcolítico de la península Ibérica muestran cerca de un 25% de componente genético procedente de cazadores afines a La Braña, pero los de Europa central muestran afinidades con cazadores de esa región.

En algunos casos, especialmente en Europa central, se detectan individuos con ancestralidades mixtas e incluso cazadores que se incorporan a vivir a las comunidades agrícolas y son enterrados allí. “Este descubrimiento dibuja un panorama más complejo del que existía hasta ahora sobre el proceso de neolitización, que ya no puede considerarse únicamente una migración de agricultores ni un proceso demográfico uniforme”, señalan.

El análisis de más individuos de la prehistoria de la península ibérica ayudará a completar este panorama y a entender los cambios genómicos que tuvieron lugar con posterioridad, con la llegada de los metales e incluso con migraciones que ocurrieron en tiempos históricos. En estos momentos, se dispone de cerca de 400 genomas ibéricos antiguos de todas las regiones y períodos, desde el mesolítico hasta la edad media, que siguen mostrando cambios genéticos posteriores que podrán correlacionarse con cambios a nivel arqueológico.

Referencia:

Mark Lipson et al (2017) ‘Parallel palaeogenomic transects reveal complex genetic history of early European farmers’. Nature doi: 10.1038/nature24476.

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo La compleja transición de cazador-recolector a agricultor se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Si Felipe fuese nutricionista hablaría de la transición nutricional

- #Naukas15 El cazador de cerebros

- #Naukas13 Tractor, azada y bacterias. Las herramientas del agricultor

Microbiota y cáncer

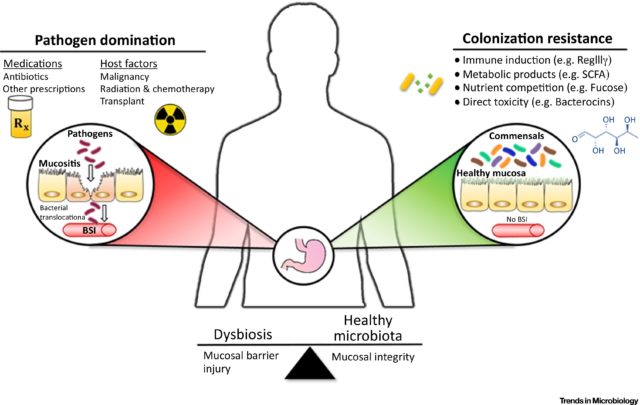

El impacto de la microbiota en las infecciones bacterianas durante el tratamiento del cáncer

Las infecciones son uno de los grandes temores y riesgos que tiene un paciente que está siendo tratado contra el cáncer y pueden llegar a ser una causa importante de su fallecimiento. Esto suele ser debido a los efectos colaterales de la quimioterapia y radioterapia que dañan la mucosa intestinal (lo que se denomina mucositis), y a la medicación inmunosupresora que debilita el sistema inmune, las defensas, lo que favorece la susceptibilidad a padecer infecciones. La pérdida de la integridad de las mucosas aumenta mucho el riesgo de que las bacterias patógenas la atraviesen y causen bacteriemia (presencia de bacterias en sangre). Por eso, los enfermos suelen además recibir un tratamiento antibiótico intenso, lo que puede alterar no sólo la microbiota intestinal del propio paciente, sino también las barreras y mucosas epiteliales. Este mismo ambiente oncológico favorece también la proliferación de bacterias resistentes a los antibióticos.

Los pacientes oncológicos sufren una gran cantidad de infecciones

Depende del tipo de cáncer, pero, por ejemplo, hasta un 15% de los trasplantados de médula ósea pueden padecer complicaciones con infecciones, que pueden llegar a ser mortales. Las infecciones más frecuentes en un enfermo oncológico suelen ser las neumonías, especialmente en los pacientes con cáncer de pulmón. También es frecuente que un paciente oncológico lleve un catéter intravenoso durante largos periodos de tiempo, lo que favorece las infecciones relacionadas con el uso de catéteres o sondas. En los cánceres hematológicos son frecuentes las bacteriemias. Las enterocolitis por Clostridium difficile son hasta un 30% más frecuentes en enfermos oncológicos que en pacientes normales, y, además, la infección por esta bacteria aumenta la mortalidad un 20%. Como hemos dicho, el tratamiento antibiótico aumenta el problema, y en un paciente con cáncer son típicas las infecciones por bacterias Gram positivas como Staphylococcus o Enterococcus, o por Gram negativas como Escherichia coli, Pseudomonas aeruginosa, Klebsiella pneumoniae, Enterobacter o Acinetobacter, muchas de ellas resistentes a los antibióticos como carbapenems, meticilina, vancomicina, etc. Además, estas bacterias pueden acceder y colonizar lugares estériles por haberse roto las barreras epiteliales.

Se necesitan nuevas estratégicas y tratamientos alternativos para evitar todas estas infecciones en los pacientes oncológicos

Hoy sabemos que los microbios que habitan en nuestro cuerpo en condiciones normales (la microbiota) influyen de forma muy importante en la fisiología y la patología del huésped. Entre las funciones de la microbiota está la de prevenir la colonización e infección de bacterias patógenas oportunistas, inducir componentes específicos del sistema inmune, promover una tolerancia inmune intestinal, balancear el proceso inflamatorio, mejorar la barrera epitelial, etc. En general, una microbiota intestinal con una gran diversidad de microorganismos es un indicador de buena salud, y la pérdida de diversidad microbiana suele ser frecuente durante la quimioterapia. Además, el uso de antibióticos para evitar infecciones en los pacientes oncológicos e inmunocomprometidos, no solo favorece la aparición de resistencias a los antibióticos sino que causa también una alteración de la propia microbiota.

Nuestra salud depende también de nuestros microbios.

Cada vez conocemos mejor la composición y función de nuestra microbiota, y hay más estudios que demuestran una correlación entre la microbiota del paciente oncológico y una infección durante el tratamiento con quimioterapia. Se han descrito cambios en la diversidad de la microbiota intestinal que preceden a una eventual infección. La razón es que una microbiota “saludable” puede proteger de una colonización y establecimiento del patógeno, bien porque la microbiota produzca alguna sustancia que inhiba al patógeno (como las bacteriocinas) o por su función moduladora del sistema inmune. Mantener una microbiota diversa y heterogénea en los pacientes con cáncer antes del inicio del tratamiento puede explicar por qué algunos pacientes son más susceptibles a padecer infecciones durante el tratamiento.

Una microbiota “sana” puede proteger del establecimiento de un patógeno

Aunque actualmente no sabemos exactamente qué especies bacterianas podrían prevenir el aumento o predominio de un determinado patógeno, algunos ensayos sugieren, por ejemplo, que un aumento de la bacteria Clostridium scindens en el intestino previene la infección por Clostridium difficile o que la colonización por Barnesiella, un tipo de Bacteroidete, confiere protección frente a Enterococcus. Se sabe que muchas bacterias comensales de la microbiota mejoran la función del epitelio como barrera. Algunos Bacteroides, Bifidobacterium, Faecalibacterium o Lactobacillus aumentan las uniones entre las células del epitelio, reducen la permeabilidad intestinal, aumentan la reparación de los epitelios y la producción de moco protector. Por ejemplo, la producción de butirato por parte de la microbiota ha sido asociada a la producción de mucina (componente principal del moco) que interviene en la integridad del epitelio y de las uniones entre las células epiteliales. Por tanto, algunas bacterias intestinales son muy beneficiosas para evitar infecciones.

En los pacientes con cáncer existe un balance entre una microbiota “saludable” y el desarrollo de una infección gastrointestinal que depende de la integridad de la barrera mucosal (Fuente: ref 1)

Modificar la microbiota intestinal para mejorar la calidad de vida de los pacientes con cáncer

Todavía son necesarios muchos más ensayos clínicos y la investigación está en sus comienzos, pero ya se están proponiendo algunas soluciones terapéuticas basadas en modificaciones de la microbiota intestinal para mitigar las infecciones y mejorar la calidad de vida de los pacientes con cáncer. Por ejemplo, el trasplante de microbiota intestinal (también conocido con el repulsivo nombre de trasplante fecal) se ha utilizado para reducir el riesgo de infección recurrente por Clostridium difficile. Hay ya estudios de su eficacia vía enemas, endoscopias, tubo nasogástrico o cápsulas liofilizadas, pero todavía faltan estudios en pacientes con cáncer y existe la duda de que pueda ser una forma de introducir nuevas infecciones en pacientes inmunocomprometidos. De momento es necesario estandarizar las técnicas y evaluar su efectividad clínica, pero es probable que en el futuro el trasplante de microbiota sea más común de lo que nos imaginamos. También se están proponiendo nuevos diseños de probióticos (una mezcla concreta y bien definida de microbios “saludables”) o de prebióticos (oligosacáridos o ácidos grasos de cadena corta que promuevan la proliferación y colonización de bacterias propias que eviten los patógenos invasores).

Medicina “a la carta” teniendo en cuenta también a tus microbios

Pero, manipular la microbiota y restaurarla en caso de alguna enfermedad, a través de trasplantes, probióticos o prebióticos es mucho más complicado que lo que podíamos imaginar. La razón de esta dificultad puede ser que la microbiota supone un complejo consorcio con millones de interacciones entre los propios microbios y nuestras células. Es necesario seguir investigando para entender mejor los mecanismos por los que la microbiota mantiene la salud o desencadena la enfermedad. Los pacientes con cáncer necesitan estos estudios, es urgente avanzar en el conocimiento del efecto de la microbiota en la infección de estos pacientes.

Lo que sí podemos predecir es que en un futuro muy próximo el análisis del microbioma humano se incorporará a los protocolos de medicina personalizada de precisión. Una medicina “a la carta” que propondrá un tratamiento personalizado teniendo en cuenta los millones de datos del genoma, metabolismo, sistema inmune y microbioma de cada paciente individual. Cuando vayas al hospital, el médico secuenciará y analizará tu genoma, con los datos de tu ARN y proteínas, definirá tu metabolismo y analizará tu sistema inmune. Pero además, estudiará la composición de tu microbiota y su función, identificará microorganismos oportunistas potencialmente patógenos en tu cuerpo, posibles deficiencias y cómo tus microbios pueden afectar al tratamiento. Con todos esos datos tuyos, podrá estudiar tu susceptibilidad genética a padecer una enfermedad, podrá predecir tu respuesta a un tratamiento y posibles reacciones adversas, incluso recomendar un cóctel de microbios concreto, podrá en definitiva diseñar una terapia personalizada para ti: medicina “a la carta”, pero teniendo en cuenta también tu microbiota, porque (no lo olvides) … ¡somos microbios!

En resumen: los tratamientos contra el cáncer alteran la microbiota y favorecen la aparición de infecciones. Es necesario seguir investigando nuevas soluciones terapéuticas basadas en la manipulación de la microbiota en este tipo de enfermos para mitigar las infecciones y mejorar su calidad de vida.

Este post ha sido realizado por Ignacio López-Goñi (@MicrobioBlog) y es una colaboración de Naukas.com con la Cátedra de Cultura Científica de la UPV/EHU.

Referencias científicas y más información:

(1) Impact of the microbiota on bacterial infections during cancer treatment. Galloway-Peña, J., y col. Trends in Microbiology. July 17, 2017. DOI: http://dx.doi.org/10.1016/j.tim.2017.06.006

https://es.wikipedia.org/wiki/Mucositis

https://es.wikipedia.org/wiki/Bacteriemia

https://es.wikipedia.org/wiki/Colitis_seudomembranosa

https://es.wikipedia.org/wiki/Bacteriocina

https://es.wikipedia.org/wiki/Mucina

http://microbioun.blogspot.com.es/2014/09/trasplante-fecal.html

http://www.cell.com/trends/microbiology/fulltext/S0966-842X(17)30151-8

El artículo Microbiota y cáncer se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Soy esa bacteria que vive en tu intestino, mejor vídeo de divulgación “On zientzia”

“Soy esa bacteria que vive en tu intestino” de Julio Ruiz Monteagudo es el vídeo ganador del premio al mejor vídeo de divulgación de la 6ª edición de los premios On Zientzia. Este vídeo musical de animación ofrece en menos de cuatro minutos una introducción al proceloso mundo de las bacterias que viven en ese cuerpo que llamamos nuestro, pero que, en puridad democrática, es de ellas.

¿Tienes una idea genial para explicar un concepto científico en un vídeo? ¿Quieres ver tu trabajo emitido en televisión? La Fundación Elhuyar y el Donostia International Physics Center (DIPC) han organizado la octava edición de On zientzia, un concurso de divulgación científica y tecnológica enmarcado en el programa Teknopolis, de ETB. Este certamen pretende impulsar la producción de vídeos cortos y originales que ayuden a popularizar el conocimiento científico.

On zientzia tendrá tres categorías. El mejor vídeo de divulgación recibirá un premio de 3.000 euros. Para impulsar la producción de piezas en euskera, existe un premio de 2.000 euros reservado a la mejor propuesta realizada en ese idioma. Por último, con el objetivo de impulsar la participación de los estudiantes de ESO y Bachillerato, hay un premio dotado con 1.000 euros para el mejor vídeo realizado por menores de 18 años.

Los vídeos han de tener una duración inferior a los 5 minutos, se pueden realizar en euskera, castellano o inglés y el tema es libre. Deben ser contenidos originales, no comerciales, que no se hayan emitido por televisión y que no hayan resultado premiados en otros concursos. El jurado valorará la capacidad divulgativa y el interés de los vídeos más que la excelencia técnica.

Las bases las encuentras aquí. Puedes participar desde ya hasta el 25 de abril de 2018.

Edición realizada por César Tomé López

El artículo Soy esa bacteria que vive en tu intestino, mejor vídeo de divulgación “On zientzia” se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Keats vs Feynman, mejor vídeo de divulgación “On zientzia”

- On Zientzia, un concurso para divulgadores audiovisuales

- OnZientzia: Una joya de bacteria

Verdad científica y verdad jurídica

El ingeniero estadounidense Mark Jacobson acaba de demandar por difamación a la Academia Nacional de las Ciencias de Estados Unidos y a un investigador que publicó en la reputada revista PNAS (editada por la academia) un estudio que criticaba el trabajo de Jacobson. La demanda pide 10 millones de dólares por daños a su reputación y la retirada y retracción de un artículo publicado en 2017 en PNAS por el matemático Christopher Clack y 20 autores más analizando la metodología de otro artículo publicado por Jacobson en 2015. La crítica llegaba a la conclusión de que los errores metodológicos de Jacobson invalidaban sus conclusiones; el ingeniero considera que se trata de un infundado ataque a su carrera y prestigio profesional y ha llevado el asunto a los tribunales. Una vez más un tribunal de justicia se verá forzado, en la práctica, a determinar cuál es la verdad entre dos alternativas científicas; una vez más el asunto está ligado a un tema políticamente candente, en este caso la política energética e indirectamente el calentamiento global y sus potenciales soluciones. Una vez más será un desastre porque la verdad científica no es democrática ni puede ser determinada por la vía legal.

Fotograma de “Inherit the wind” (1960) de Stanley Kramer

Los tribunales no buscan la verdad, sino la justicia; término de difícil definición pero que desde luego no está relacionado con el funcionamiento del universo, sino en todo caso con el de las sociedades humanas. El cosmos no es justo, ni injusto; simplemente es, y al intentar describir su funcionamiento la ciencia prescinde por completo de cualquier noción de justicia. El rayo no cae donde castiga al malo y favorece al bueno, sino donde la diferencia de potencial se acumula en un grado suficiente. La gacela no puede recurrir a un juez para que la salve del leopardo, como este no puede demandar a la bacteria que infecta la herida de su pata y le va a causar la muerte. Carece por completo de sentido intentar proyectar ideas humanas como responsabilidad o moralidad, sobre un mundo que funcionaría del mismo exacto modo sin la presencia de humanos. Hacerlo tiene nombre: la falacia patética, y el hecho de que se cometa con frecuencia no la hace menos falaz.

Al revés la situación es más compleja porque a menudo la justicia sí que necesita establecer la verdad (o falsedad) de un hecho con el fin de poder juzgar adecuadamente su adecuación a las leyes. Ahí la ciencia frecuentemente ayuda a la justicia dado que proporciona herramientas y métodos para demostrar, o falsear, hechos o vinculaciones entre hechos y personas que ayudan a establecer responsabilidades y a facilitar el cumplimiento de las leyes. Especialmente en estos tiempos de CSIs y de análisis de ADN parece que la administración de justicia está colonizada de científicos y que los abogados necesitan estudiar más biología y menos Derecho Romano. La relación entre ciencia y justicia no es aquí demasiado problemática.

Cuando esta relación se transforma en un verdadero desastre es cuando se exige a la administración de justicia que adjudique cuál es la verdad científica de entre dos puntos de vista contrarios. Y esto es así porque ni la metodología ni el objetivo de los sistemas jurídicos es establecer cuál es la verdad, sino resolver los conflictos entre personas. Y a la verdad científica las personas le importan (le deben importar) poco. Lo que es es lo que es, aunque moleste, aunque no sea justo, aunque no sea democrático. La descripción de lo real no depende de sujeción alguna a normas morales, mucho menos legales.

Demasiadas veces se ha producido y se produce esta anomalía de que un tribunal de justicia sea llamado a dilucidar qué es verdad científica y qué no, a menudo en casos relacionados con conflictos políticos (como el de la demanda de Jacobson) o bien con la existencia de charlatanes que se benefician de curar enfermedades que no existen (hipersensibilidad química o electromagnética), o de vender pseudoterapias (reiki, homeopatía, etc). Ningún tribunal de justicia tiene la capacidad de decidir por sí mismo sobre la veracidad de una proposición científica, de modo que se ve obligado a depender de expertos externos. Si estos expertos están sesgados la sentencia del tribunal será legal, pero no reflejará la realidad del universo. Con lo que podemos llegar a la absurda situación de que una sentencia judicial (una verdad legal) esté dando soporte a una falsedad científica. Y ya ha ocurrido.

Existen, por ejemplo, sentencias judiciales que reconocen grados de invalidez a ciertas personas y que se usan como pruebas de que la hipersensibilidad electromagnética es real. Pero al igual que ocurrirá en el caso de Jacobson una vez sea juzgado la administración de justicia no tiene capacidad para determinar la existencia o inexistencia de un fenómeno: la verdad judicial (se ajusta, o no, a la ley) no tiene nada que ver con la científica (existe, o no), por lo que cualquier intento de usar el dominio legal para demostrar la existencia (o inexistencia) de un fenómeno estará condenado al fracaso. Puede ser que una persona merezca una pensión de invalidez (verdad jurídica) al mismo tiempo que la enfermedad que cree padecer no existe (verdad científica). Y cualquier intento, como la demanda de difamación, para forzar que la justicia determine cuál es la verdad científica tan sólo puede crear confusión y mala ciencia. Por muy buena que sea la sentencia legal.

Sobre el autor: José Cervera (@Retiario) es periodista especializado en ciencia y tecnología y da clases de periodismo digital.

El artículo Verdad científica y verdad jurídica se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:En Marte el viento crea montañas

Si le preguntas al geólogo de guardia cómo se forman las montañas es probable que te diga que los procesos que intervienen están asociados con movimientos a gran escala de la corteza terrestre (lo que se llama tectónica de placas). Te hablará posiblemente de plegamientos, fallas, actividad volcánica, intrusión ígnea y metamorfismo. Será muy interesante, sin duda, pero el único problema es que esto aplica a un planeta, la Tierra. Y es que en Marte las montañas las forma el viento. Algunas, al menos.

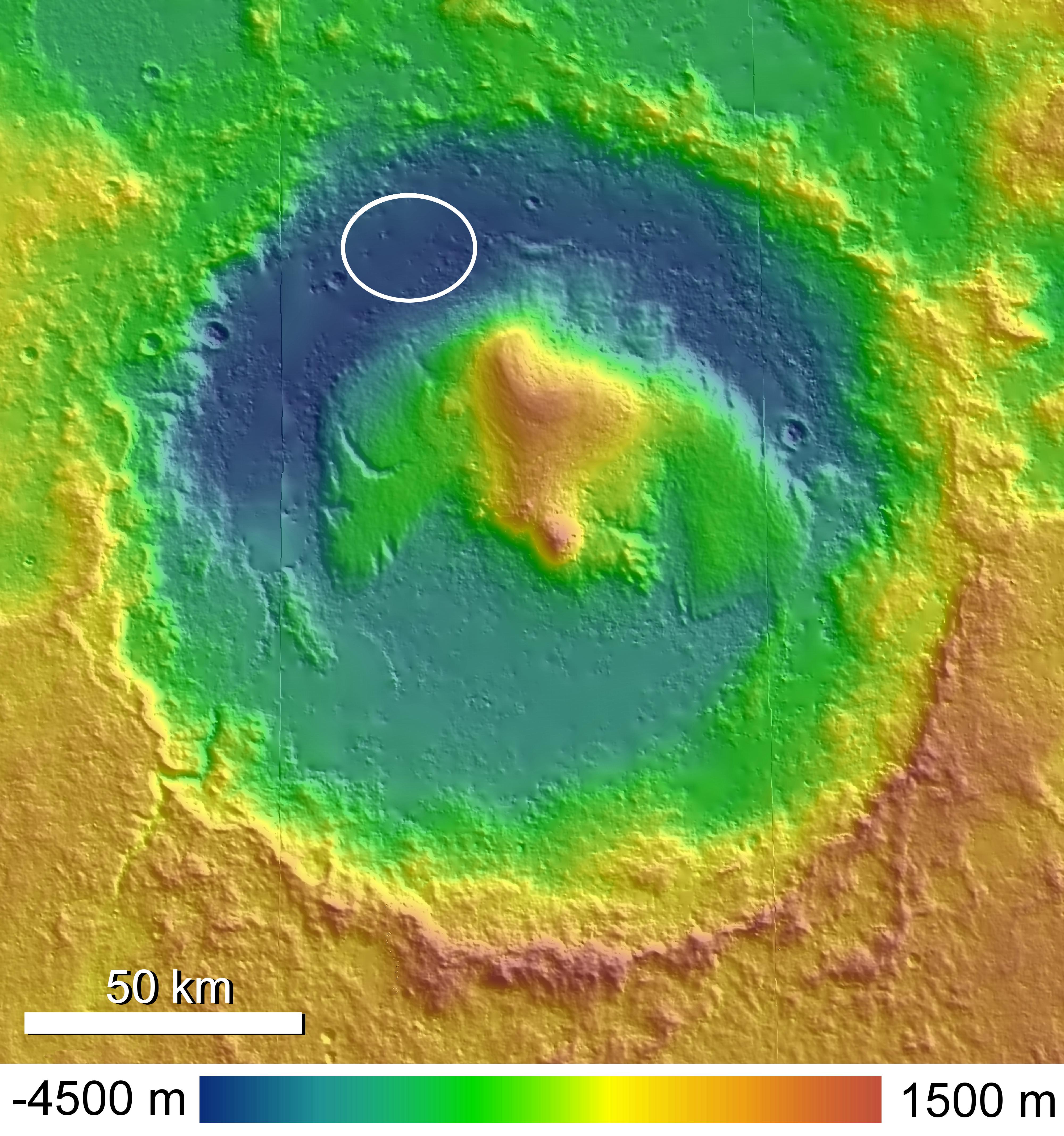

Mapa topográfico del cráter Gale (Marte). El círculo indica la zona de aterrizaje del rover Curiosity.

El cráter Gale en Marte tiene 154 km de diámetro y una montaña en su interior de 5.500 m de altitud, Aeolis Mons. Curiosity es un ingenio humano del tamaño de un coche utilitario que está explorando las estribaciones de Aeolis Mons desde agosto de 2012. El Gale es un cráter creado por impacto de un meteorito hace unos 3.700 millones de años que fue llenándose de sedimentos durante 500 millones de años, probablemente porque llegó a a ser un enorme lago cuando Marte aún era cálido y húmedo.

Cuando este lago se secó, no había montaña en su interior, sino una caldera colmatada de sedimentos. Según las simulaciones de William Anderson (Universidad de Texas en Dallas) y Mackenzie Day (Universidad de Washington en Seattle) habrían sido remolinos de viento dentro de las paredes del cráter los que habrían excavado una región con forma de rosquilla, dejando una montaña en el centro. Como los vientos excavarían un lado de cráter más rápido que el otro, ello resultaría que la montaña no está en el centro del cráter, sino ligeramente desplazada del centro.

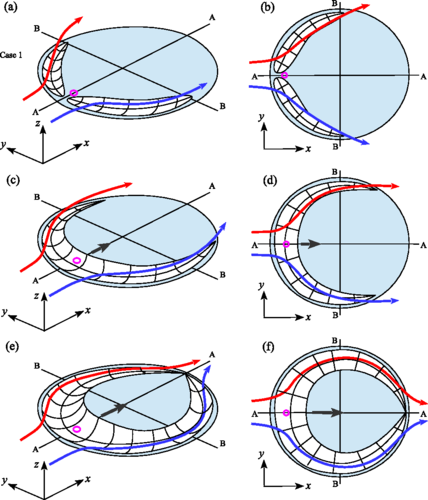

Usando simulaciones de dinámica de fluidos, Day y Anderson estudiaron los patrones de flujo de viento sobre cuatro geometrías de cráter idealizadas: un cráter lleno, un cráter lleno con un foso poco profundo, un cráter con un foso profundo alrededor de los comienzos de una montaña, y un cráter vacío. Estos cráteres idealizados tenían los rasgos principales de Gale y cráteres marcianos similares.

Analizando los patrones de viento los investigadores observaron que los vientos se focalizaban debido a las características topográficas. Los vórtices a pequeña escala se desarrollan cuando el viento golpea por primera vez el borde exterior del borde del cráter. Estos vórtices fluyen sobre el borde hacia el cráter y luego se dividen en dos corrientes que se propagan a sotavento (hacia donde sopla el viento), una corriente a cada lado del borde del cráter. A medida que el foso se profundiza y se alarga, los vórtices aumentan de intensidad.

Las simulaciones indican que la erosión comienza en el lugar donde los vórtices entran en el lado de barlovento (de donde sopla el viento) del cráter. El viento inicialmente crea una depresión en forma de media luna que luego se alarga y profundiza hasta que sus dos extremos se unen, creando un foso completo. El lugar donde el viento golpea por primera vez el cráter experimenta la erosión más duradera, por lo que el foso en ese extremo de la cuenca es más ancho, y la montaña termina situada a sotavento del centro del cráter.

Los resultados muestran que la erosión eólica puede explicar la formación y posición de las montañas dentro de los cráteres de impacto en Marte. Tener un escenario plausible para la evolución del cráter de Gale en los últimos 3 mil millones de años ayudará a interpretar los datos de geología que está siendo recolectados por el rover Curiosity y en la reconstrucción de la historia geofísica de Marte.

Referencia:

William Anderson and Mackenzie Day (2017) Turbulent flow over craters on Mars: Vorticity dynamics reveal aeolian excavation mechanism Phys. Rev. E doi: 10.1103/PhysRevE.96.043110

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

Este texto es una colaboración del Cuaderno de Cultura Científica con Next

El artículo En Marte el viento crea montañas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Los ojos que explorarán la superficie de Marte (Mars2020)

- Datación K-Ar y las edades de Marte

- H. pylori crea túneles en la mucosa del estómago

La ‘reverosis’ de Pablo

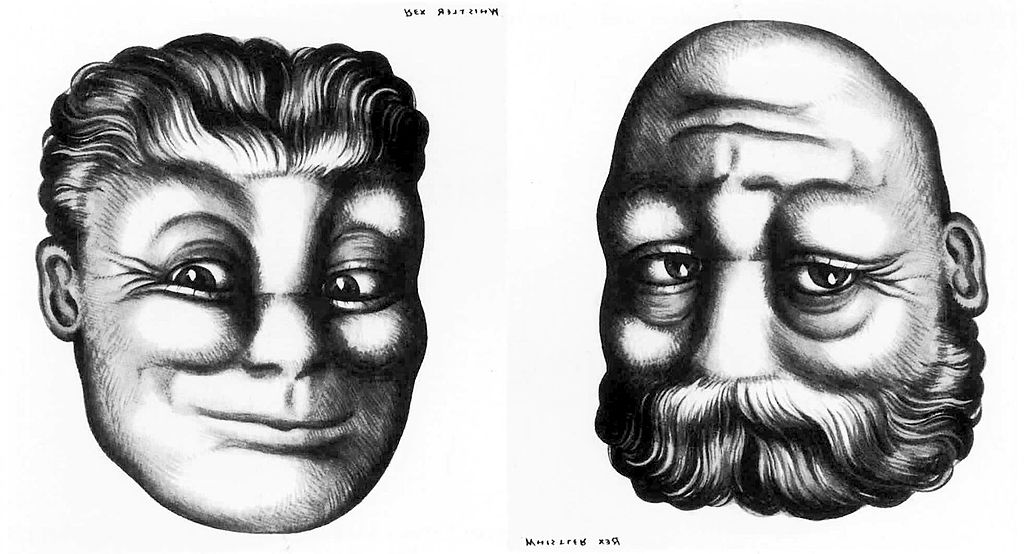

En el texto que sigue hablaremos de una ‘enfermedad’–que claramente no existe– para ilustrar una paradoja de la teoría de la probabilidad –de la que ya se ha hablado en este blog–. Comenzamos con la historia ficticia de Pablo y su posible dolencia.

Rex Whistler: Hombre joven y hombre mayor (cabezas reversibles). Fuente Wikipedia.

Pablo es hipocondríaco. Pedro –que pretende burlarse de la obsesión de su amigo Pablo– le habla de una enfermedad genética recientemente descubierta –la reverosis–, que se manifiesta sólo a partir de los 40 años. Las personas que contraen esta enfermedad entienden al revés gran parte de lo que se les dice, aunque conservan el resto de sus facultades mentales intactas.

La reverosis es una enfermedad tremendamente rara: sólo la padece una persona entre un millón. Pedro comenta a su amigo que existe un test genético que permite averiguar a una persona si padecerá esta dolencia antes de contraerla. Lamentablemente, el test falla una vez de cada mil –es decir, acierta en el 99,9% de los casos–.

El aprensivo Pablo cumple en unos pocos días 40 años y no puede soportar la indecisión. Así que decide acudir a una consulta privada para realizar el test. Unos días más tarde, su médica le dice:

Su test de reverosis ha dado positivo. Pero no se preocupe, tiene sólo una posibilidad sobre mil de estar enfermo.

Pablo piensa que esto no tiene sentido, y reflexiona del siguiente modo:

Si el test se equivoca una vez de cada mil y mi test es positivo, la probabilidad de estar enfermo es del 99,9%… A lo mejor ya soy víctima de la reverosis, y aunque la médica me ha dicho “Su test de reverosis ha dado negativo”, yo he entendido “Su test de reverosis ha dado positivo”… y, entonces, probablemente no estaría enfermo… Pero, ¿cómo se ha invertido sólo su primera frase?

O a lo mejor esta enfermedad, que ya padezco, me ha hecho invertir sólo el sentido de la segunda frase, y en realidad la médica ha dicho: “Su test de reverosis ha dado positivo. Pero preocúpese, porque tiene una posibilidad sobre mil de no estar enfermo”.

Pablo se está dejando llevar por el pánico y está razonando mal. Lo que ha dicho su médica tiene sentido.

Para entenderlo mejor, supongamos que hacemos pasar el test a 100.000.000 personas: aproximadamente 100 de ellas estarán enfermas –recordar que una persona entre un millón padece la reverosis–. Para casi todas estas 100 personas, el test será positivo –recordar que la fiabilidad del test es del 99,9%– con lo que es muy probable que se equivoque para una o dos de esas 100 personas enfermas.

Para las 99.999.900 personas restantes –que están sanas– el test se equivocará aproximadamente 100.000 veces –es decir, una vez por cada mil–. Son los llamados falsos positivos, y la clave está en su gran cantidad. En efecto, a causa de los falsos positivos, entre las aproximadamente 100+100.000 personas para las que el test es positivo, no hay más que unas 100 personas realmente enfermas. Es decir, entre las personas con test positivo, hay aproximadamente 1/1.000 que realmente están enfermas.

Como bien dice su médica Pablo no debería preocuparse por el resultado de este test… Se ha topado con la paradoja del falso positivo, un problema de probabilidades condicionadas.

Nota 1: Como he comentado antes, de falsos positivos ya se ha hablado antes en este blog. Por ejemplo, en Falsos positivos, o la importancia de comprender la información de Raúl Ibáñez, To screen or not to screen de Naia Pereda, o Errar es humano de Juan Ignacio Pérez. Recomiendo cualquiera de ellos para aprender más.

Nota 2: Extraído y adaptado de Jean-Paul Delahaye, Au pays des paradoxes, Bélin, 2008.

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo La ‘reverosis’ de Pablo se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- “La saga Curie y las otras investigadoras” por Flora de Pablo

- Falsos positivos, o la importancia de comprender la información

- Desenmascarando al autómata

Sistemas respiratorios: la ventilación de los pulmones de mamíferos

La presión que ejerce un gas a una temperatura constante varía en función inversa del volumen que ocupa dicho gas. En otras palabras, si un número determinado de moléculas del gas pasa a ocupar mayor volumen del que tenía, la presión que ejerce disminuye. Y al contrario. En esa simplísima norma se basa el mecanismo que permite que fluya aire de la atmósfera a los pulmones y de estos al exterior. Me refiero a pulmones de mamíferos, aunque en realidad sirve para cualquier otro pulmón aunque las cosas ocurran de forma algo diferente.

En los pulmones de mamíferos el movimiento mareal (de entrada y salida) del medio respiratorio está provocado por cambios de volumen de la caja torácica. Ese volumen cambia debido a la contracción alterna de los músculos intercostales internos y externos, así como del diafragma y de los músculos abdominales. El aumento del volumen se produce como consecuencia de la contracción de los músculos intercostales externos y del diafragma; el esternón se eleva al separarse unas costillas de otras y, como consecuencia, se aleja de la columna vertebral. Al elevarse el volumen de la caja también lo hace el del interior pulmonar, por lo que la presión interna disminuye y, dado que la presión exterior no varía (760 mmHg a nivel del mar), el gradiente de presiones produce el flujo hacia el interior. La espiración se produce al relajarse el diafragma y contraerse los músculos intercostales internos y los abdominales. Se reduce así el volumen de la caja, con lo que aumenta la presión intra-alveolar y produce el flujo de aire hacia el exterior.

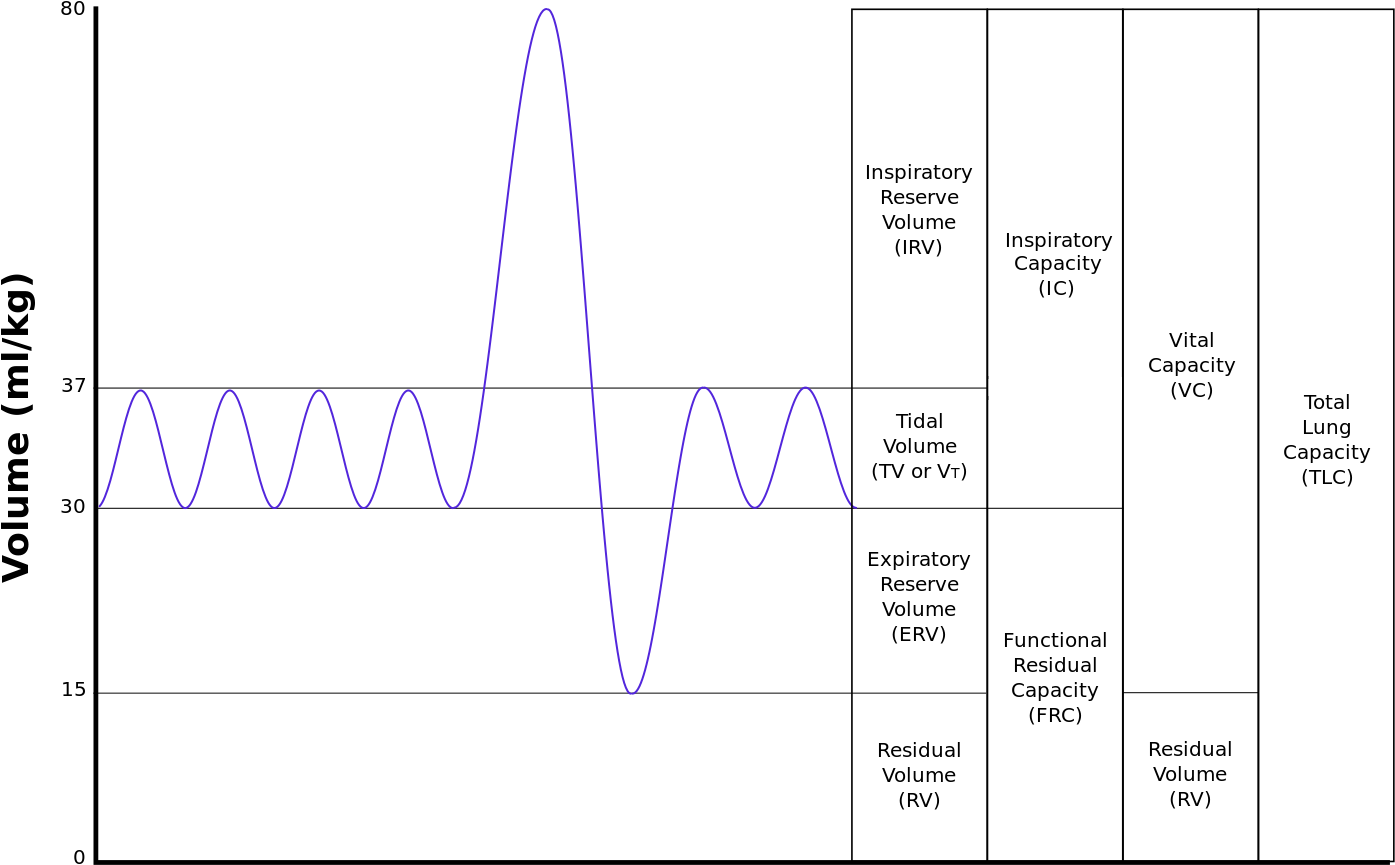

Los movimientos respiratorios en los pulmones de mamíferos definen una serie de volúmenes y capacidades que sirven para caracterizar el funcionamiento del órgano. La técnica que se utiliza para determinar esas magnitudes es la espirometría, realizada mediante un instrumento que mide el volumen de aire que es desplazado tras la ejecución de diferentes movimientos respiratorios. Se ofrecen a continuación esos indicadores junto con el valor de la media para un caballo y un hombre (las mujeres presentan valores algo más bajos):

- Volumen mareal (VM): es el volumen que entra o sale de los pulmones durante una única respiración. [6000 ml; 500 ml]

- Volumen inspiratorio de reserva (VIR): es el volumen extra de aire máximo que puede ser inspirado por encima del volumen mareal en condiciones de reposo. [12000 ml; 3000 ml]

- Capacidad inspiratoria (CI): es el máximo volumen de aire que puede ser inspirado al final de una espiración normal. CI = VM + VIR [18000 ml; 3500 ml]

- Volumen espiratorio de reserva (VER): es el volumen extra de aire que puede ser activamente espirado mediante la contracción máxima de los músculos espiratorios, en añadidura al que se espira normalmente de forma pasiva al final de una espiración normal típica. [12000 ml; 1000 ml].

- Volumen residual (VR): el volumen mínimo de aire que permanece en los pulmones tras una espiración máxima. [12000 ml; 1200 ml] Como es lógico, este volumen no puede establecerse por métodos espirométricos, puesto que ese aire no puede ser expulsado; se mide mediante técnicas de dilución con algún marcador gaseoso inocuo, como el Helio.

- Capacidad residual funcional (CRF): es el volumen de aire que queda en los pulmones al final de una respiración pasiva normal. CRF = VER + VR [24000 ml; 2200 ml]

- Capacidad vital (CV): es el máximo volumen de aire que puede desplazarse durante una única respiración tras una inspiración máxima. Se inspira y, a continuación, se espira todo lo que se puede. CV = VIR + VM + VER [30000 ml; 4500 ml]

- Capacidad pulmonar total (CPT): es el máximo volumen de aire que pueden albergar los pulmones. CPT = CV + VR [42000 ml; 5700 ml]

En resumen, en una respiración normal, tomamos y expulsamos 0,5 l de aire. En esas condiciones quedan en el interior de los pulmones 2,2 l. No obstante, estos pueden llegar a albergar 5,7 l; y dado que el máximo que pueden intercambiar en un único ciclo respiratorio es de 4,5 l, siempre quedarán dentro de los pulmones 1,2 l sin intercambiar. Prácticamente nunca se desplaza todo el volumen que podría intercambiarse como máximo en un único ciclo, por lo que, dependiendo de las necesidades, inspiramos entre 0,5 l y, en caso de gran necesidad, otros 4 l más.

De lo anterior se deriva que en los pulmones siempre hay un cierto volumen de aire con oxígeno (el volumen residual), por lo que incluso durante la espiración y antes de que vuelva a tomarse aire, la transferencia de oxígeno a la sangre no cesa por lo que solo se producen pequeñas variaciones en la concentración sanguínea de este gas al salir de los pulmones.

Por último, merece la pena reparar en la existencia de un volumen de aire que no es fisiológicamente útil. Me refiero al del espacio muerto, un volumen que no participa en el intercambio de gases respiratorios. Ese espacio da cuenta de unos 150 ml. Es el aire que permanece en los bronquios en zonas donde no se produce intercambio de gases o que accede a alveolos mal perfundidos. Para valorar las implicaciones de la existencia de ese espacio muerto, hagamos unas cuentas sencillas.