Minerales que cambian

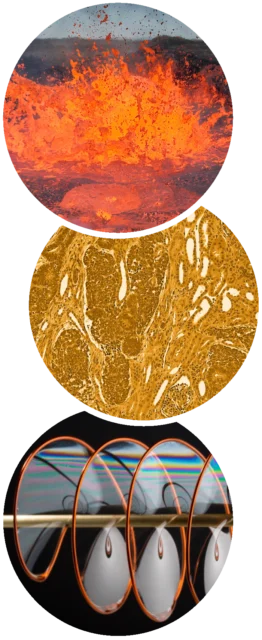

Hace un tiempo os hablé de varios procesos de metamorfismo muy particulares y que se pueden considerar como excepciones que confirman la regla general de formación de rocas metamórficas. Pero no os conté casi nada sobre las fascinantes transformaciones que sufren los minerales cuando se generan este tipo de rocas, porque estaba esperando el momento adecuado que, por fin hoy, ha llegado.

Detalle de una roca metamórfica denominada esquisto que aparece en Monteferro, Pontevedra. Foto: Blanca María Martínez

Detalle de una roca metamórfica denominada esquisto que aparece en Monteferro, Pontevedra. Foto: Blanca María MartínezAntes de meterme en detalle voy a empezar complementando la teoría general que os presenté en ese artículo. Las rocas metamórficas se generan a partir de la transformación que sufren rocas ya existentes, de cualquier naturaleza (sedimentarias, ígneas o, incluso, metamórficas), cuando son sometidas a incrementos en la presión y/o la temperatura. Esta transformación, denominada metamorfismo, siempre implica la formación de nuevos minerales que no estaban presentes en la roca original, pero, salvo en esa excepción del metasomatismo que os describí en el otro artículo, estos cambios se producen en sistemas químicamente cerrados. Es decir, los elementos químicos presentes en la roca original son exactamente los mismos que aparecen en la roca metamórfica final, no entra ningún elemento del exterior ni se pierde ninguno en el proceso. Simplemente, cambia su ordenamiento interno en la nueva roca.

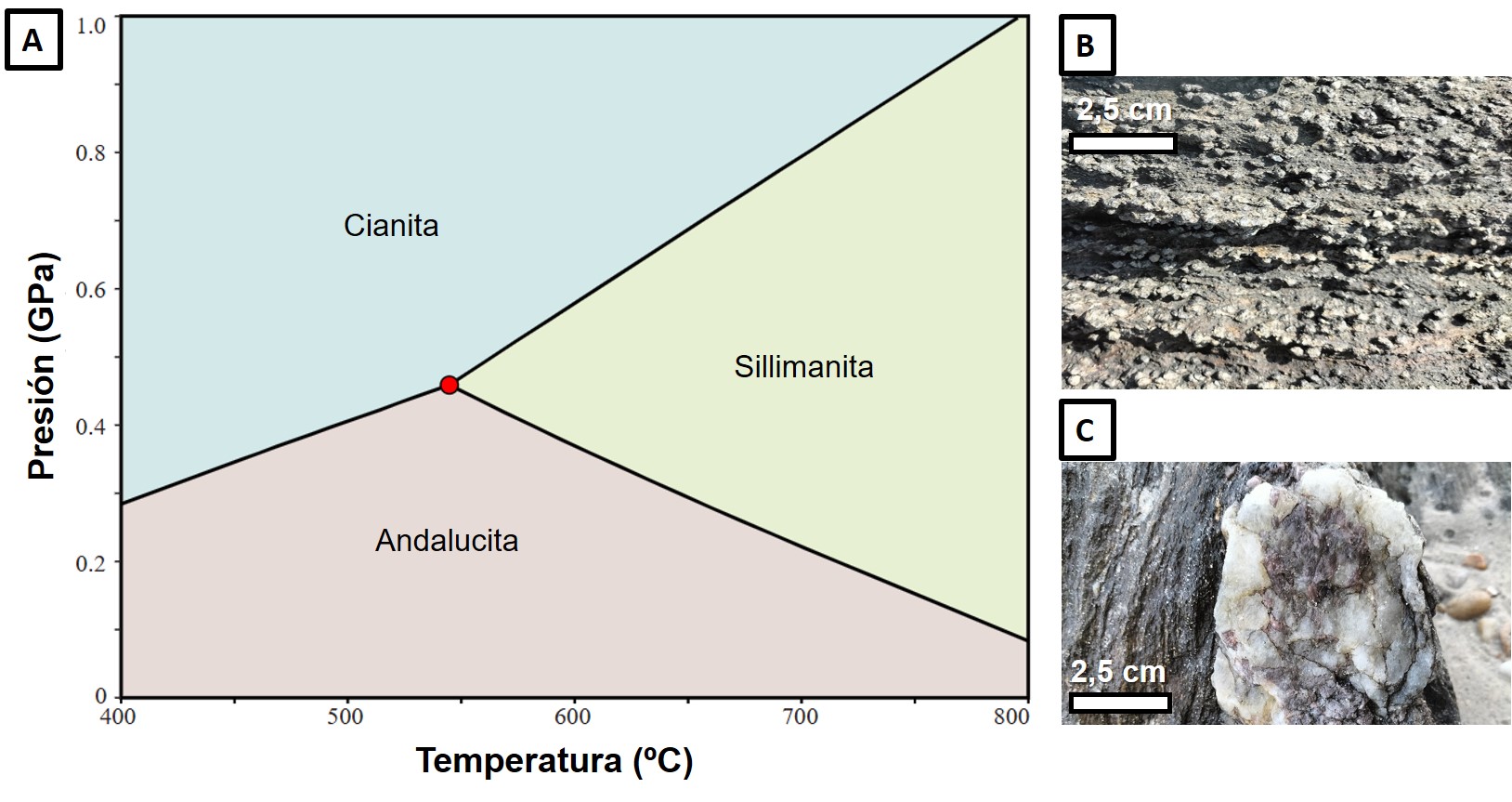

A) Diagrama de fases de tres minerales metamórficos con la misma composición química (Al2SiO5): Cianita, de alta presión; andalucita, de baja presión; y sillimanita, de alta temperatura. Fuente: Smith College. B) Detalle de un esquisto con andalucita encontrado en Monteferro, Pontevedra. Foto: Blanca María Martínez C) Niveles de cuarzo (blanco) y andalucita (rosado) presentes en los esquistos de la playa de Patos, Nigrán, Pontevedra. Foto: Blanca María Martínez

A) Diagrama de fases de tres minerales metamórficos con la misma composición química (Al2SiO5): Cianita, de alta presión; andalucita, de baja presión; y sillimanita, de alta temperatura. Fuente: Smith College. B) Detalle de un esquisto con andalucita encontrado en Monteferro, Pontevedra. Foto: Blanca María Martínez C) Niveles de cuarzo (blanco) y andalucita (rosado) presentes en los esquistos de la playa de Patos, Nigrán, Pontevedra. Foto: Blanca María MartínezSí, lo sé, no habéis entendido nada de lo que acabo de decir, así que vamos por partes. Un mineral es una sustancia sólida formada por la unión de varios átomos de elementos químicos concretos, siguiendo una ordenación interna determinada y que se mantienen estables bajo unas condiciones de presión y temperatura específicas. Pero, cuando una de esas dos variables (presión y/o temperatura) cambian, las uniones de los elementos químicos se rompen, como si estuviéramos deshaciendo los minerales. Sin embargo, bajo esas nuevas condiciones de presión y temperatura, los elementos químicos no se quedan libres sin más, si no que tienden a unirse con otros elementos que se encuentran a su alrededor para volver a crear unas sustancias sólidas cuyos enlaces sean estables en este nuevo medio. Así, acaban formando nuevos minerales que no estaban presentes en la roca original, pero sin haber añadido ni eliminado un solo elemento químico que no estuviera ya presente antes del metamorfismo. Es decir, si en la roca inicial teníamos calcio, sodio, oxígeno, silicio, carbono e hidrógeno unidos de una manera particular para formar unos minerales concretos, en la roca metamórfica tendremos calcio, sodio, oxígeno, silicio, carbono e hidrógeno, exactamente los mismos elementos, pero que se han unido entre sí de otra manera, dando lugar a unos minerales diferentes.

Nivel de grafito (de color oscuro) que aparece en unos esquistos de la playa de Patos, Nigrán, Pontevedra. Foto: Blanca María Martínez

Nivel de grafito (de color oscuro) que aparece en unos esquistos de la playa de Patos, Nigrán, Pontevedra. Foto: Blanca María MartínezGracias a los estudios geoquímicos realizados en el laboratorio, podemos saber cuáles son los rangos de estabilidad de cada mineral, es decir, en qué valores de presión y temperatura se forman esos minerales, lo que nos permite utilizarlos como indicadores o medidores de las condiciones físicas que soportaron las rocas durante el proceso de metamorfismo. Para ello, en Geología se han definido lo que se conoce como diagramas de fases metamórficas, que son unas gráficas en las que el “eje x” representa la variación en la temperatura y el “eje y” el aumento de la presión, sobre las que se dibujan los campos de estabilidad de cada mineral. De esta forma, si yo encuentro una roca metamórfica en cuya composición identifico unos minerales concretos, puedo suponer los valores máximos y mínimos de presión y temperatura que soportó la roca original en su transformación.

Esta información nos permite inferir la historia geológica del lugar en el que aparecen las rocas metamórficas. Así, se puede estimar la profundidad a la que se enterraron los materiales originales para ser sometidos a esos valores de presión y temperatura; se puede demostrar si esta zona estuvo cerca de un límite de colisión de placas tectónicas que provocó un gran aumento en la presión de las rocas originales sin modificar mucho la temperatura; o se puede identificar si fue un magma el que calentó los materiales hasta transformarlos sin alterar las condiciones de presión. Pero también es muy útil en la exploración de materiales con diversos intereses sociales y económicos. El talco, el grafito, el granate, el corindón o el jade son minerales que se forman por metamorfismo en diferentes condiciones de presión y temperatura. Por tanto, si queremos explotarlos, habrá que localizar los contextos geológicos precisos en donde aparezcan rocas metamórficas indicativas de esas condiciones físicas.

Metamorfismo significa “cambio de forma” y es el ejemplo perfecto de que, en la naturaleza, nada se crea ni se destruye, solo se transforma. Incluso, los minerales pueden convertirse en otros diferentes sin necesidad de añadir o quitar ningún componente, simplemente hay que someterlos a variaciones en la presión y la temperatura. Al igual que cambia nuestro carácter si nos enfrentamos a cambios bruscos del clima o nos someten a demasiado estrés en el trabajo.

Sobre la autora: Blanca María Martínez es doctora en geología, investigadora de la Sociedad de Ciencias Aranzadi y colaboradora externa del departamento de Geología de la Facultad de Ciencia y Tecnología de la EHU

El artículo Minerales que cambian se ha escrito en Cuaderno de Cultura Científica.

¿En qué fecha nació Diana?

Hoy presentamos un sencillo problema de lógica en el que se trata de averiguar la fecha de nacimiento de Diana a través de la información que proporciona a tres amigos.

Fuente: freepikEnunciado del problema

Fuente: freepikEnunciado del problema

Diana presenta a Andrés, Beatriz y Carlos una lista de catorce posibles fechas de su nacimiento:

- 14 de abril de 1999

- 19 de febrero de 2000

- 14 de marzo de 2000

- 15 de marzo de 2000

- 15 de abril de 2000

- 16 de abril de 2000

- 15 de febrero de 2001

- 15 de marzo de 2001

- 14 de abril de 2001

- 16 de abril de 2001

- 14 de mayo de 2001

- 16 de mayo de 2001

- 17 de mayo de 2001

- 17 de febrero de 2002

Después declara que va a decir (individualmente) a Andrés el mes, a Beatriz el día y a Carlos el año de su nacimiento. Tras dar esta información (en privado) a cada uno de sus amigos, se reúnen todos y Andrés comenta: «No sé la fecha de nacimiento de Diana, pero Beatriz tampoco».

Tras escuchar a Andrés, Beatriz dice: “Eso es cierto, pero Carlos tampoco sabe la fecha de nacimiento de Diana”.

Carlos comenta entonces: “Sí, y Andrés todavía no ha averiguado la fecha de nacimiento de Diana”.

Beatriz responde inmediatamente: «Bueno, ahora ya sé cuál es el día en el que Diana nació».

Tras este comentario, Andrés afirma: «Sí, ahora todos lo sabemos».

¿Cuándo es el cumpleaños de Diana?

SoluciónVamos a argumentar teniendo en cuenta como se van encadenando los comentarios:

- Andrés: «No sé la fecha de nacimiento de Diana, pero Beatriz tampoco».

- Beatriz dice: “Eso es cierto, pero Carlos tampoco sabe la fecha de nacimiento de Diana”.

- Carlos: “Sí, y Andrés todavía no ha averiguado la fecha de nacimiento de Diana”.

- Beatriz: «Bueno, ahora ya sé cuál es su el día en el que Diana nació».

- Andrés: «Sí, ahora todos lo sabemos».

Andrés afirma que Beatriz desconoce la fecha de nacimiento de Diana. Como Beatriz conoce el día del nacimiento, lo que Andrés afirma es que el día debe de aparecer más de una vez en la lista. Todos los días se repiten excepto el 19, con lo que se puede eliminar la fecha del 19 de febrero de 2000 de la lista. Pero, Andrés solo puede saber este dato si sabe que el mes de nacimiento no es febrero. Así, pueden eliminarse como posibles fechas (además de la anterior) las otras dos que corresponden al mes de febrero. De este modo, los tres amigos de Diana pueden reducir la lista a once posibles fechas:

- 14 de abril de 1999

- 19 de febrero de 2000

- 14 de marzo de 2000

- 15 de marzo de 2000

- 15 de abril de 2000

- 16 de abril de 2000

- 15 de febrero de 2001

- 15 de marzo de 2001

- 14 de abril de 2001

- 16 de abril de 2001

- 14 de mayo de 2001

- 16 de mayo de 2001

- 17 de mayo de 2001

- 17 de febrero de 2002

Ahora, Beatriz afirma que, efectivamente, desconoce la fecha de nacimiento de su amiga. Eso significa que, en la nueva lista reducida, el número de día aparece más de una vez. Por lo tanto, la fecha de nacimiento de Diana no puede ser el 17 de mayo de 2001. Así, las posibles fechas se reducen a diez:

- 14 de abril de 1999

- 19 de febrero de 2000

- 14 de marzo de 2000

- 15 de marzo de 2000

- 15 de abril de 2000

- 16 de abril de 2000

- 15 de febrero de 2001

- 15 de marzo de 2001

- 14 de abril de 2001

- 16 de abril de 2001

- 14 de mayo de 2001

- 16 de mayo de 2001

- 17 de mayo de 2001

- 17 de febrero de 2002

Además, Beatriz afirma que Carlos tampoco conoce la fecha de nacimiento de Diana. Eso significa que el año debe aparecer más de una vez en la lista anterior. Así, se puede descartar la fecha del 14 de abril de 1999. Pero Beatriz solo puede conocer este dato si sabe que el día no es el 14; por ello pueden eliminarse tres fechas más y solo quedan seis posibilidades:

- 14 de abril de 1999

- 19 de febrero de 2000

- 14 de marzo de 2000

- 15 de marzo de 2000

- 15 de abril de 2000

- 16 de abril de 2000

- 15 de febrero de 2001

- 15 de marzo de 2001

- 14 de abril de 2001

- 16 de abril de 2001

- 14 de mayo de 2001

- 16 de mayo de 2001

- 17 de mayo de 2001

- 17 de febrero de 2002

Carlos dice entonces que Andrés no puede saber aún la fecha de cumpleaños de Diana. Eso significa que el mes (que es el dato que conoce Andrés) debe aparecer más de una vez en la lista. Así, descarta el 16 de mayo de 2001. Esto muestra a todos que Carlos sabe que el año no es 2001. Así, la lista se puede reducir a tres posibles fechas:

- 14 de abril de 1999

- 19 de febrero de 2000

- 14 de marzo de 2000

- 15 de marzo de 2000

- 15 de abril de 2000

- 16 de abril de 2000

- 15 de febrero de 2001

- 15 de marzo de 2001

- 14 de abril de 2001

- 16 de abril de 2001

- 14 de mayo de 2001

- 16 de mayo de 2001

- 17 de mayo de 2001

- 17 de febrero de 2002

Beatriz dice entonces que conoce la fecha, lo que significa que el día aparecer una única vez en la lista, con lo que está afirmando que la fecha de nacimiento de Diana es el 16 de abril de 2000. Es decir, como dice finalmente Andrés, todos conocen la fecha de nacimiento de Diana.

BonusYa que hemos hablado de fechas de nacimiento, recordemos la conocida paradoja del cumpleaños que afirma que, si hay 23 personas reunidas, la probabilidad de que al menos dos de ellas cumplan años el mismo día es mayor del 50 %.

El matemático Raymond Smullyan (1919-2017) impartió clases de probabilidad en la Universidad de Princeton. En cierta ocasión, en un aula con 19 estudiantes, aludiendo a la paradoja del cumpleaños, comentó que la probabilidad de que dos de ellos compartieran cumpleaños era bastante baja.

Uno de sus alumnos le contestó: “Apuesto 25 centavos a que dos de nosotros cumplimos años el mismo día».

Smullyan pensó que el alumno apostaba porque conocía la fecha del cumpleaños de uno de sus compañeros, que coincidía con la suya.

El alumno contestó: «No, le doy mi palabra de que no sé el cumpleaños de nadie aquí, excepto el mío. Sin embargo, apuesto a que hay dos personas en el aula que cumplen años el mismo día».

Smullyan aceptó la apuesta y perdió. ¿Por qué?

Esta vez, la respuesta no tiene que ver con la lógica… o quizás sí: en el aula había dos gemelos idénticos, y parece que Smullyan no se había dado cuenta.

Referencias

- Charlie’s Birthday, Futility Closet, 11 marzo 2026

- Clairvoyance, Futility Closet, 25 junio 2022

Más problemas de lógica:

Usando la lógica para averiguar quién es quién

Celebrando a John Venn con un juego de lógica

¿Adivinando o empleando la lógica?

Aplicando la lógica, a veces sin mucho éxito

Los cumpleaños de cinco hermanas

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y editora de Mujeres con Ciencia

El artículo ¿En qué fecha nació Diana? se ha escrito en Cuaderno de Cultura Científica.

Las matemáticas que explican por qué hay campanas de Gauss por todas partes

El teorema central del límite empezó como un truco de bar para los jugadores del siglo XVIII. Hoy en día, los científicos recurren a él a diario.

Un artículo de Joseph Howlett. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

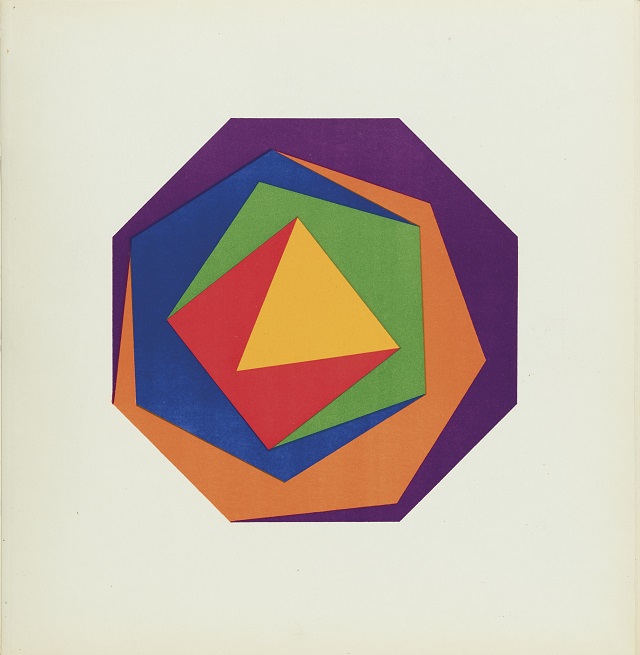

El teorema central del límite es lo que hace que las distribuciones en forma de campana sean tan comunes. Ilustración: Irene Pérez / Quanta Magazine

El teorema central del límite es lo que hace que las distribuciones en forma de campana sean tan comunes. Ilustración: Irene Pérez / Quanta Magazine

Mires donde mires, hay una curva de campana cerca.

Coloca una jarra medidora en tu patio cada vez que llueva y anota la altura del agua cuando deje de llover: tus datos se ajustarán a una curva de campana. Registra las estimaciones de 100 personas sobre el número de caramelos en un tarro, y seguirán una curva de campana. Mide suficientes alturas de mujeres, pesos de hombres, puntuaciones de la selectividad, tiempos de maratón… siempre obtendrás la misma forma suave y redondeada que se estrecha en los extremos.

¿Por qué aparece la curva de campana en tantos conjuntos de datos?

La respuesta se reduce al teorema central del límite, una verdad matemática tan poderosa que a menudo parece imposible para quienes la conocen por primera vez, como un truco de magia de la naturaleza. “El teorema central del límite es bastante asombroso porque es contraintuitivo y sorprendente”, comenta Daniela Witten, bioestadística de la Universidad de Washington. Gracias a él, el caos más aleatorio e inimaginable puede dar lugar a una notable capacidad de predicción.

Hoy es un pilar sobre el que descansa gran parte de la ciencia empírica moderna. Casi cada vez que un científico utiliza mediciones para inferir algo sobre el mundo, el teorema central del límite está presente en algún punto del método. Sin él, sería difícil que la ciencia pudiera afirmar nada, con un mínimo de confianza, sobre nada.

“No creo que el campo de la estadística existiera sin el teorema central del límite”, afirma Larry Wasserman, estadístico de la Universidad Carnegie Mellon. “Lo es todo”.

Del vicio, pureza

Quizá no debería sorprender que el impulso por encontrar regularidad en el azar surgiera del estudio de los juegos de apuestas.

En los cafés del Londres de principios del siglo XVIII, el talento matemático de Abraham de Moivre era evidente. Muchos de sus contemporáneos, entre ellos Isaac Newton y Edmond Halley, reconocieron su brillantez. De Moivre era miembro de la Royal Society, pero también era un refugiado, un francés que había huido de su país siendo joven ante la persecución contra los protestantes. Como extranjero, no pudo conseguir un puesto académico estable acorde con su talento. Así que, para poder pagar sus facturas, se convirtió en asesor de jugadores que buscaban ventaja matemática.

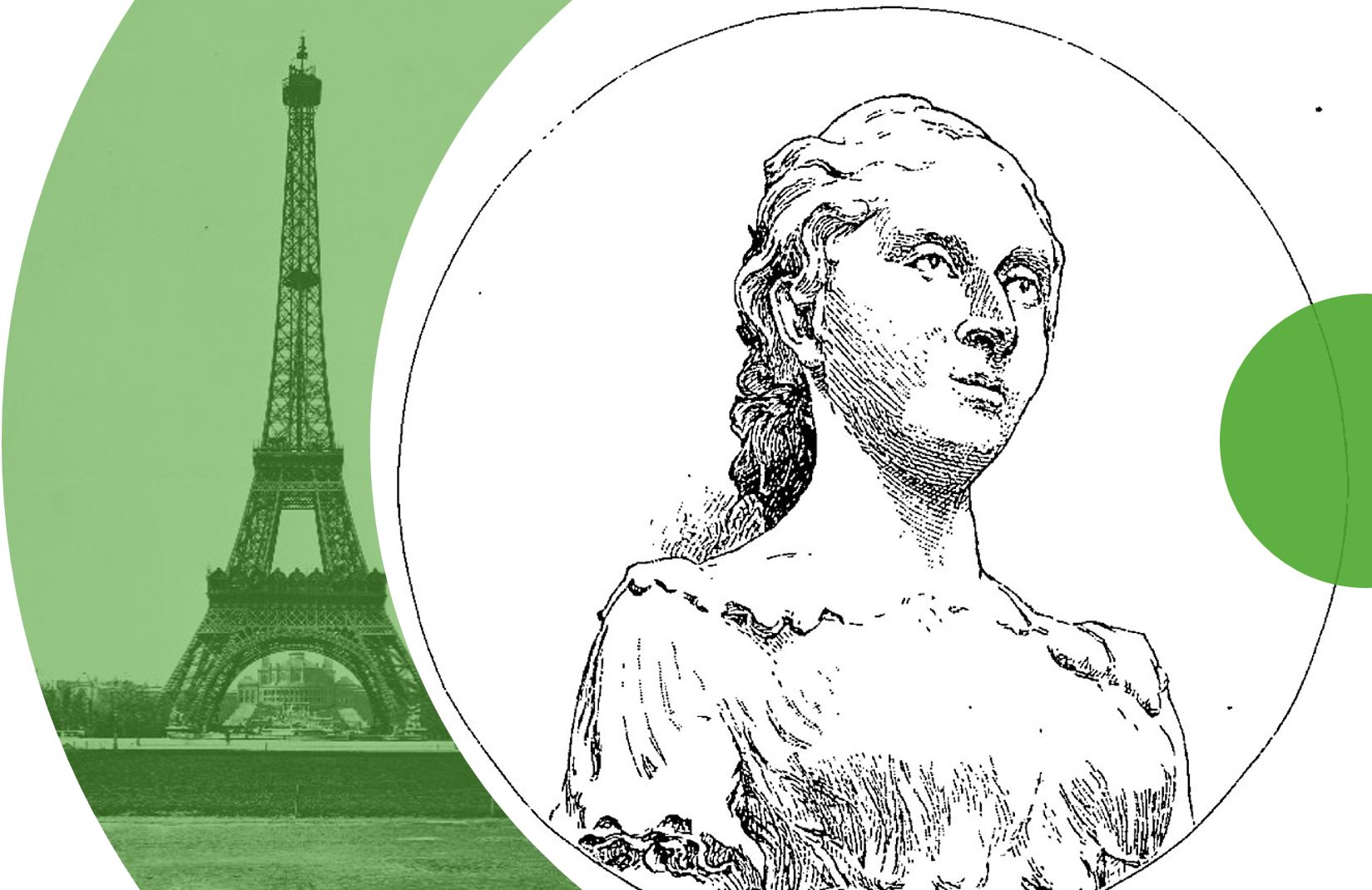

Abraham de Moivre realizó las primeras investigaciones matemáticas sobre juegos de azar. Retrato por Joseph Highmore (1736) / Dominio público

Abraham de Moivre realizó las primeras investigaciones matemáticas sobre juegos de azar. Retrato por Joseph Highmore (1736) / Dominio público

Lanzar una moneda, tirar un dado o sacar una carta de una baraja son acciones aleatorias, con todos los resultados igualmente probables. Lo que de Moivre comprendió es que, al combinar muchas acciones aleatorias, el resultado sigue un patrón fiable.

Lanza una moneda 100 veces y cuenta cuántas veces sale cara. Estará en torno a 50, pero no con gran precisión. Repite este juego 10 veces y es posible que obtengas 10 resultados distintos.

Ahora imagina jugar 1 millón de veces. La mayoría de los resultados estarán cerca de 50. Casi nunca obtendrás menos de 10 caras ni más de 90. Si haces un gráfico del número de veces que aparece cada valor entre cero y 100, verás esa forma clásica de campana, con 50 en el centro. Cuantas más veces repitas el experimento, más suave y definida será la campana.

De Moivre dedujo la forma exacta de esta campana, que pasó a llamarse distribución normal. Esta le permitía, sin necesidad de jugar realmente, conocer la probabilidad de los distintos resultados. Por ejemplo, la probabilidad de obtener entre 45 y 55 caras es de aproximadamente el 68 %.

De Moivre contemplaba con devoción casi religiosa el “orden constante del universo” que finalmente se imponía sobre cualquier desviación respecto a la campana. “Con el tiempo”, escribió, “estas irregularidades no guardarán proporción con la recurrencia de ese orden que resulta naturalmente de un diseño original”.

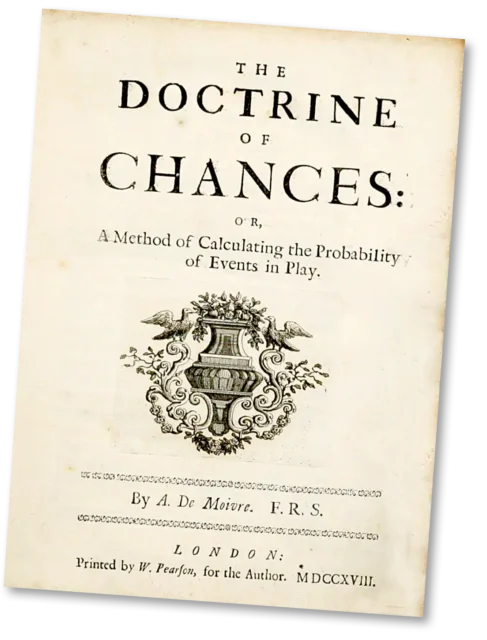

La Doctrina de las Probabilidades, publicado por primera vez en 1718, fue el primer libro de texto sobre teoría de la probabilidad. Una segunda edición, publicada en 1738, incluyó el trabajo que daría lugar al teorema del límite central. Fuente: Dominio público

La Doctrina de las Probabilidades, publicado por primera vez en 1718, fue el primer libro de texto sobre teoría de la probabilidad. Una segunda edición, publicada en 1738, incluyó el trabajo que daría lugar al teorema del límite central. Fuente: Dominio público

Utilizó estas ideas para sostener una vida modesta en Londres, escribiendo un libro titulado The Doctrine of Chances, que se convirtió en la biblia de los jugadores, y ofreciendo consultas informales en el famoso Old Slaughter’s Coffee House. Pero ni siquiera de Moivre comprendió el alcance completo de su descubrimiento. Solo cuando Pierre-Simon Laplace desarrolló la idea en 1810, décadas después de la muerte de de Moivre, se desveló toda su amplitud.

Consideremos un ejemplo algo más complejo que lanzar monedas: tirar dados. Cada lanzamiento de un dado tiene seis resultados igualmente probables. Si lo lanzas repetidamente y registras los resultados, obtendrás un gráfico plano: aparecerán aproximadamente tantos unos como doses, cuatros o seises.

Ahora lanza ese dado 10 veces y calcula la media. Probablemente obtendrás un valor cercano a 3,5. Repite el experimento muchas más veces y representa todos los resultados. Obtendrás una curva de campana con un máximo en 3,5 y una estructura perfectamente definida a ambos lados.

Esa es la magia del teorema central del límite. Partes de una distribución de resultados posibles sin estructura alguna —todas las caras del dado con la misma probabilidad—. Pero al tomar la media de múltiples mediciones, y repetir ese proceso una y otra vez, obtienes una estructura matemática precisa y predecible: la curva de campana.

Laplace condensó esta estructura en una fórmula sencilla, la que más tarde se conocería como el teorema central del límite. No importa cuán irregular sea un proceso aleatorio, incluso si es imposible de modelizar: la media de muchos resultados sigue la distribución que describe este teorema. “Es realmente potente, porque significa que no necesitamos preocuparnos por cuál es la distribución de los valores que se han promediado”, explicó Witten. “Lo único que importa es que la propia media va a seguir una distribución normal”.

Una herramienta omnipresente

Puede parecer que calcular medias es algo propio de los humanos, pero el teorema central del límite se aplica de forma invisible a todo tipo de fenómenos observables en el mundo, como la altura de las personas. “La estatura de alguien puede depender de la de su padre, la de su madre, su genética, su alimentación y todos esos pequeños efectos que se suman”, explica Jeffrey Rosenthal, estadístico de la Universidad de Toronto. Esos efectos son independientes entre sí (por lo general, la altura de tu padre no tiene nada que ver con lo que comes). “Es como hacer la media de muchos pequeños efectos”, añadió Rosenthal, y por eso la estatura sigue aproximadamente una distribución normal.

Daniela Witten, bioestadística de la Universidad de Washington. Foto: Elizar Mercado

Daniela Witten, bioestadística de la Universidad de Washington. Foto: Elizar Mercado

Por eso tantos conjuntos de datos parecen ajustarse espontáneamente a esta forma tan elegante. “En cualquier situación en la que haya una media subyacente, si es una media de suficientes factores, acabarás obteniendo una distribución normal”, dijo Witten.

El teorema también proporciona a los estadísticos la capacidad de detectar cuándo algo no encaja. Supongamos que estás tomando café en el Old Slaughter’s y un cliente te da una moneda apostando a que no puedes obtener 45 caras en 100 lanzamientos. Lo intentas y solo consigues 20. ¿Cómo saber si la moneda está trucada y el proceso no es tan aleatorio como debería? Gracias al teorema central del límite, sabes que los resultados de hasta 20 caras representan solo el 0,15 % de la campana, por lo que hay únicamente un 0,15 % de probabilidad de que una moneda equilibrada produzca un resultado tan bajo. Es casi seguro que te están engañando.

Ese es el verdadero poder de la fórmula de Laplace. Sabía que al promediar cualquier proceso se obtiene una curva de campana, lo que permite decir algo sobre ese proceso sin conocer en profundidad cómo funciona.

Úsese con precaución

A pesar de su papel central en la ciencia moderna, el teorema central del límite tiene sus propios límites. Solo funciona cuando se combinan muchas muestras, y estas deben ser independientes. Si no lo son —por ejemplo, si realizas una encuesta nacional solo en una pequeña localidad de Maine—, repetir el experimento no te acercará a la curva de campana esperada.

Y a veces, en ciencia, los valores atípicos pueden ser más importantes que la media. “Las ‘inundaciones centenarias’ están ocurriendo cada vez con más frecuencia”, señala Richard D. De Veaux, estadístico aplicado en el Williams College. “Hoy en día, modelizar eventos extremos es probablemente tan importante como modelizar la media”.

Afortunadamente, la idea que subyace al teorema central del límite —la potencia y la fiabilidad de las medias— se ha aplicado ampliamente para ampliar el alcance de la estadística. Los estadísticos suelen formular una versión del teorema adaptada al problema específico en el que trabajan. “Hay muchísimas situaciones más complejas en las que, si eres ingenioso, puedes escribirlas como una media muestral más algún término de error”, explicó Wasserman. En esos casos, se puede utilizar una variante del teorema para simplificar el problema.

El teorema central del límite es un pilar de la ciencia moderna, en última instancia, porque es un pilar del mundo que nos rodea. Cuando combinamos muchas mediciones independientes, obtenemos agrupaciones. Y, si somos lo suficientemente ingeniosos, podemos utilizar esas agrupaciones para descubrir algo interesante sobre los procesos que las han generado.

El artículo original, The Math That Explains Why Bell Curves Are Everywhere, se publicó el 16 de marzo de 2026 en Quanta Magazine. Cuaderno de Cultura Científica tiene un acuerdo de distribución en castellano con Quanta Magazine.

Traducido por César Tomé López

El artículo Las matemáticas que explican por qué hay campanas de Gauss por todas partes se ha escrito en Cuaderno de Cultura Científica.

Una comunicación entre tumor y cerebro reduce la respuesta inmune al cáncer

En los últimos años se ha puesto de manifiesto que los tumores malignos son inervados por fibras del sistema nervioso periférico, y que un mayor grado de inervación está asociado a un comportamiento más agresivo del cáncer y un peor pronóstico. En un artículo anterior de “Vida fascinante” describíamos cómo las células tumorales son capaces de “robar” mitocondrias a las neuronas, aumentando así su capacidad de producir energía y, por tanto, su crecimiento y agresividad.

Una investigación, recién publicada en Nature, proporciona una nueva explicación para la relación entre inervación y crecimiento tumoral, explicación que no es menos sorprendente que la anterior. El tumor es capaz de comunicarse con el cerebro e inducir, a través de esta comunicación, una inhibición de las defensas inmunitarias antitumorales.

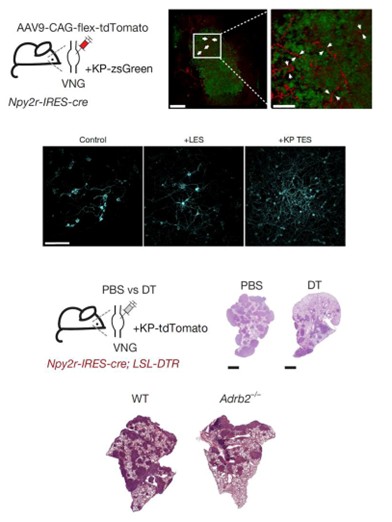

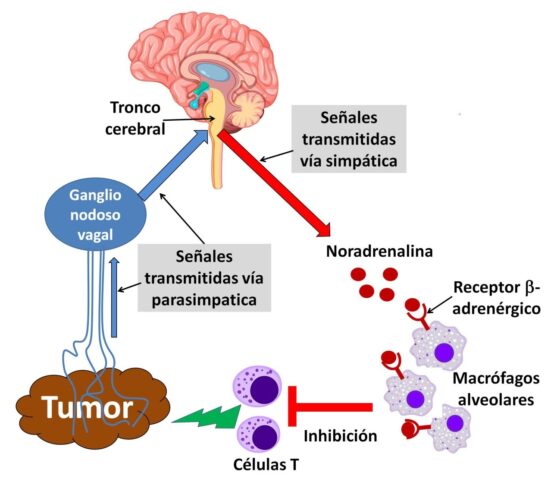

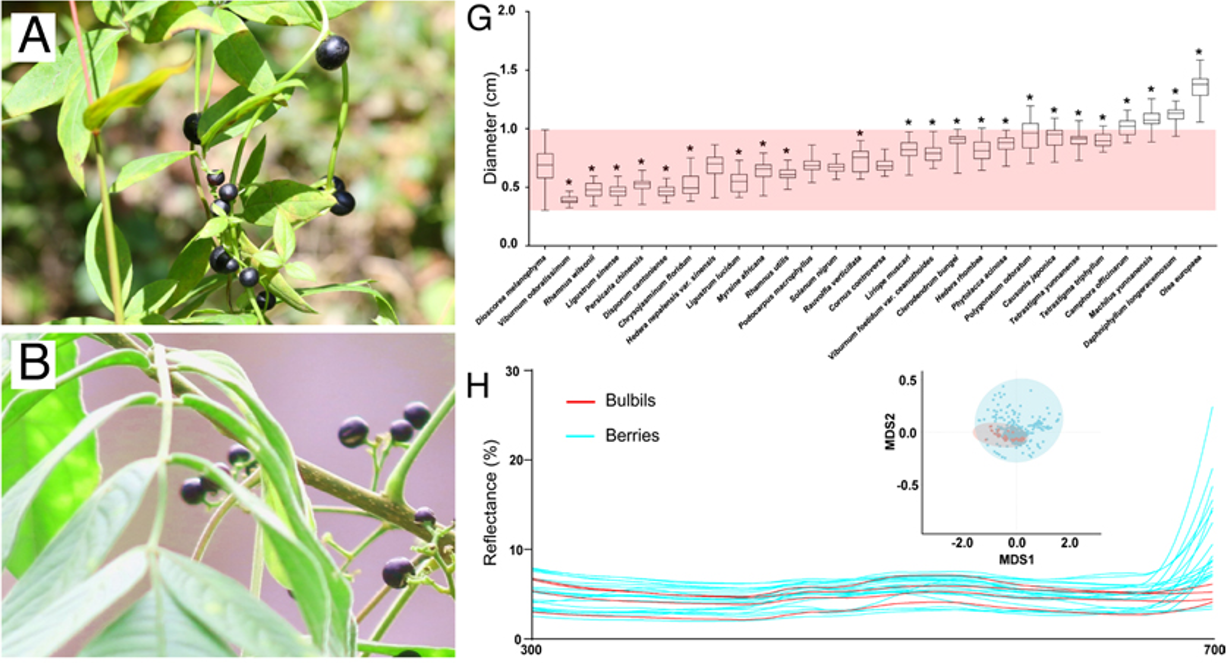

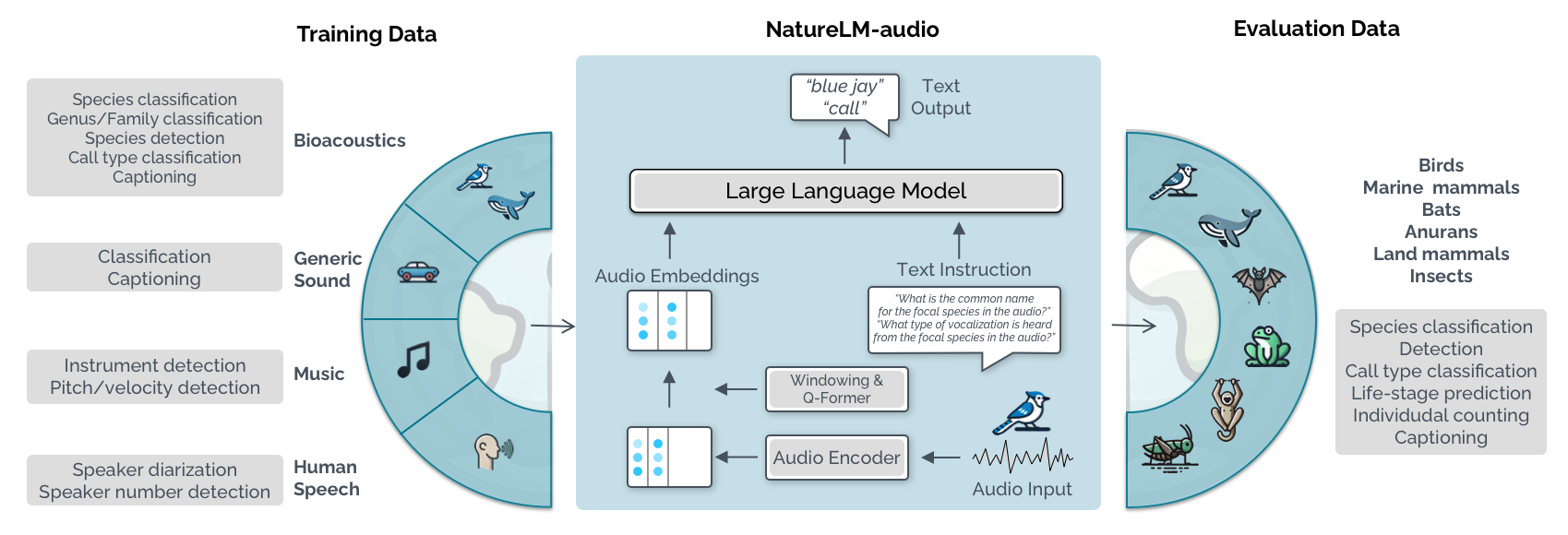

Figura 1. Se muestran algunos de los resultados del artículo de Wei et al. (2026), cuya cita completa aparece en las referencias. En la fila superior, el marcaje específico de las neuronas Npy2r del ganglio nodoso vagal en color rojo revela la presencia de fibras nerviosas derivadas de estas neuronas y que han invadido el tumor pulmonar (marcado en verde). En la segunda fila vemos cultivos de neuronas sensoriales vagales con medio control, con un sobrenadante de cultivo de explante pulmonar sano (LES) y con sobrenadante de cultivo de tumor (+KP TES). Se observa como el sobrenadante tumoral induce el crecimiento de fibras nerviosas. En la tercera fila se muestra cómo la ablación específica de las neuronas Npy2r del ganglio nodoso con toxina diftérica (DT) reduce la carga tumoral en el pulmón (áreas más oscuras). En la fila inferior vemos pulmones de ratones control (WT) y deficientes en el receptor b2-adrenérgico. Este último muestra una reducción de la carga tumoral. Con licencia CC BY 4.0.

Figura 1. Se muestran algunos de los resultados del artículo de Wei et al. (2026), cuya cita completa aparece en las referencias. En la fila superior, el marcaje específico de las neuronas Npy2r del ganglio nodoso vagal en color rojo revela la presencia de fibras nerviosas derivadas de estas neuronas y que han invadido el tumor pulmonar (marcado en verde). En la segunda fila vemos cultivos de neuronas sensoriales vagales con medio control, con un sobrenadante de cultivo de explante pulmonar sano (LES) y con sobrenadante de cultivo de tumor (+KP TES). Se observa como el sobrenadante tumoral induce el crecimiento de fibras nerviosas. En la tercera fila se muestra cómo la ablación específica de las neuronas Npy2r del ganglio nodoso con toxina diftérica (DT) reduce la carga tumoral en el pulmón (áreas más oscuras). En la fila inferior vemos pulmones de ratones control (WT) y deficientes en el receptor b2-adrenérgico. Este último muestra una reducción de la carga tumoral. Con licencia CC BY 4.0.La investigación, liderada por la universidad de Pennsylvania, utilizó como modelo una cepa de ratones modificados genéticamente en los que se puede inducir el desarrollo de adenocarcinomas pulmonares. Se comprobó que estos tumores estaban densamente inervados, y que las fibras nerviosas eran de tipo sensorial y procedían del sistema nervioso parasimpático, en concreto del ganglio nodoso vagal (Figura 1). Este ganglio del nervio vago, situado en la base del cráneo, recibe información del corazón, vías respiratorias y tracto digestivo, una información esencial para regular el funcionamiento de estos sistemas. Diversos experimentos mostraron que el crecimiento de las fibras nerviosas era inducido por el propio tumor, mediante factores neurotróficos (Figura 1). Las fibras nerviosas procedían de un tipo concreto de neuronas vagales, caracterizadas por la expresión del receptor del neuropéptido Y (Npy2r) y un canal iónico (Trpv1).

Estas observaciones sugerían que el tumor estaba emitiendo algún tipo de información a través de las fibras sensoriales. Lo interesante es que cuando se anulaba la función de las neuronas vagales Npy2r se producía una disminución de la carga tumoral en los pulmones (Figura 1). Por tanto, la información que el tumor transmitía por esta vía parecía ser relevante para su progresión.

El equipo investigador constató que en el entorno tumoral se localizaban abundantes células del sistema inmune, en concreto células T, un tipo de linfocitos que atacan a las células cancerosas. Las células T forman parte de los mecanismos inmunitarios con los que intentamos defendernos del cáncer. En los ratones de nuestro caso, la eliminación de las señales transmitidas por el tumor a través de las neuronas vagales no reducía el crecimiento tumoral si al mismo tiempo se eliminaban las células T. Dicho de otra forma, las células T eran las responsables de frenar el crecimiento del cáncer, y las señales enviadas por el tumor a través del nervio vago inhibían de alguna forma esta función defensiva.

La explicación del fenómeno fue sorprendente. Las señales vagales emitidas por el tumor llegaban hasta el tronco cerebral, donde se generaba una respuesta a través del sistema nervioso simpático. Esto no es extraño. El juego de información sensorial parasimpática y respuesta simpática es fundamental para regular el funcionamiento de los sistemas respiratorio, cardiovascular o digestivo. Pero en el caso de los ratones con cáncer, la respuesta simpática se traducía en una producción de noradrenalina que inducía una respuesta de los macrófagos alveolares del pulmón, a través de sus receptores beta-adrenérgicos. Los macrófagos alveolares son células inmunitarias residentes en los alvéolos pulmonares y que fagocitan partículas inhaladas, bacterias y detritos, protegiendo al pulmón y regulando respuestas pro y antiinflamatorias. Pueden desempeñar funciones variadas dependiendo de las señales que reciban, y ahí está la clave de su implicación en el caso de los tumores pulmonares. Las señales adrenérgicas recibidas de los terminales simpáticos polarizaban a los macrófagos alveolares para que desempeñaran una función inhibitoria de las células T. De hecho, ratones deficientes en el receptor b2-adrenérgico mostraron una menor carga tumoral en los pulmones (Figura 1).

Figura 2. Esquema del proceso de comunicación entre tumor y cerebro. Fibras derivadas del ganglio nodoso vagal (en azul) inervan el tumor y transmiten señales hacia el tronco cerebral. Esto genera respuestas que se transmiten por vía simpática, causando la liberación de noradrenalina en el entorno tumoral. Los macrófagos residentes en los alveolos pulmonares reciben la señal a través del receptor b-adrenérgico e inhiben la actividad antitumoral de las células T. Elaboración propia. Se han usado dibujos de Brgfx-Freepik, y A. Rad y M. Häggström (con licencia CC-BY-SA 3.0).

Figura 2. Esquema del proceso de comunicación entre tumor y cerebro. Fibras derivadas del ganglio nodoso vagal (en azul) inervan el tumor y transmiten señales hacia el tronco cerebral. Esto genera respuestas que se transmiten por vía simpática, causando la liberación de noradrenalina en el entorno tumoral. Los macrófagos residentes en los alveolos pulmonares reciben la señal a través del receptor b-adrenérgico e inhiben la actividad antitumoral de las células T. Elaboración propia. Se han usado dibujos de Brgfx-Freepik, y A. Rad y M. Häggström (con licencia CC-BY-SA 3.0).Recapitulemos: el tumor pulmonar induce el crecimiento de fibras de un tipo especial de neuronas del nervio vago y envía a través de ellas señales al tronco cerebral. Este responde aumentando la actividad simpática en el entorno del tumor. Los macrófagos alveolares responden a esta actividad inhibiendo a las células T que deberían estar atacando al tumor. El tumor, por tanto, crece sin que el sistema inmune dificulte su progresión (Figura 2).

Es la primera vez que se observa que células tumorales se comuniquen con el cerebro para manipular señales nerviosas y manejar el sistema inmune en su propio beneficio. Una vez más nos sorprenden las estrategias “inteligentes” que adopta el cáncer para obtener ventajas a costa de su víctima. Pero lo importante es que cada nuevo descubrimiento abre vías alternativas para actuar contra la progresión tumoral. De hecho, en los últimos años se había observado que el tratamiento de pacientes de cáncer pulmonar con beta-bloqueantes (inhibidores de los receptores beta-adrenérgicos) parecía frenar la progresión de la enfermedad. El descubrimiento publicado en Nature puede haber explicado la razón.

Referencias

Wei, H.K., Yu, C.D., Hu, B. et al. (2026) Tumour-brain crosstalk restrains cancer immunity via a sensory-sympathetic axis. Nature doi: 10.1038/s41586-025-10028-8

Sobre el autor: Ramón Muñoz-Chápuli Oriol es Catedrático de Biología Animal (jubilado) de la Universidad de Málaga.

El artículo Una comunicación entre tumor y cerebro reduce la respuesta inmune al cáncer se ha escrito en Cuaderno de Cultura Científica.

Estos pinzones tienen su color favorito y no cambiarán de opinión por lo que digan sus vecinos

¿Los pinzones construyen con su color favorito o les influye lo que hacen sus vecinos? Fuente: Lauren M. Guillette et al. (2026) PLoS One doi: 10.1371/journal.pone.0342277

¿Los pinzones construyen con su color favorito o les influye lo que hacen sus vecinos? Fuente: Lauren M. Guillette et al. (2026) PLoS One doi: 10.1371/journal.pone.0342277La cultura —entendida como la suma de conocimientos y conductas aprendidas socialmente y compartidas entre miembros de un grupo— no es exclusiva de los humanos. A lo largo de décadas de investigación, se ha observado que muchos animales aprenden unos de otros y aceptan una serie de comportamientos comunes, desde métodos de caza hasta vocalizaciones o rutas migratorias. Esta enorme amalgama de reglas, aprendizajes, herramientas, tradiciones, reglas y actitudes, mantenidas a lo largo del tiempo, es lo que constituye la base de nuestra actual civilización. Sin embargo, esa cultura como conjunto social y multitudinario, comparte existencia con un contrapeso muy poderoso: la individualidad. En muchos casos, aceptamos y mostramos «conformidad» adaptando nuestras opciones personales a los estándares y cánones predefinidos. Pero en otros tantos, la influencia establecida por la mayoría se desploma frente a la férrea decisión de un solo individuo que, siguiendo sus instintos y preferencias, decide no dejarse llevar por la corriente.

Estos pequeños e inevitables actos de rebeldía frente a las tendencias mayoritarias representan un soplo de aire fresco y siempre encontramos a alguien que mantiene y exhibe con orgullo sus propios gustos personales, sin dejarse influir por las convenciones o la presión del resto de la sociedad. Por supuesto, no todos somos igual de inconformistas ni tampoco lo somos en todos los aspectos de la cultura: existen diferentes grados de divergencia cultural, en diferentes momentos y con diferentes intensidades.

Estas características individuales son obvias en el ser humano, pero no son únicas de nuestra especie. Aquellos que tienen mascotas habrán notado que su perro tiene su juguete favorito del que no se despega o que su gato tiene un lugar preferido para tumbarse. No obstante, no contamos con demasiados estudios que analicen la intensidad de estos gustos y preferencias o de qué manera responden los animales a la influencia y presión de sus congéneres cuando deciden no seguir al resto del grupo.

En este contexto de decisiones personales alejadas de la tendencia general se enmarca un interesantísimo artículo, publicado hace tan solo unas semanas en PLoS One, en el que los científicos del Grupo de Investigación en Cognición Animal de la Universidad de Alberta (Canadá) han puesto a prueba las inclinaciones y gustos personales de unos pinzones frente a las conductas generales de sus vecinos.

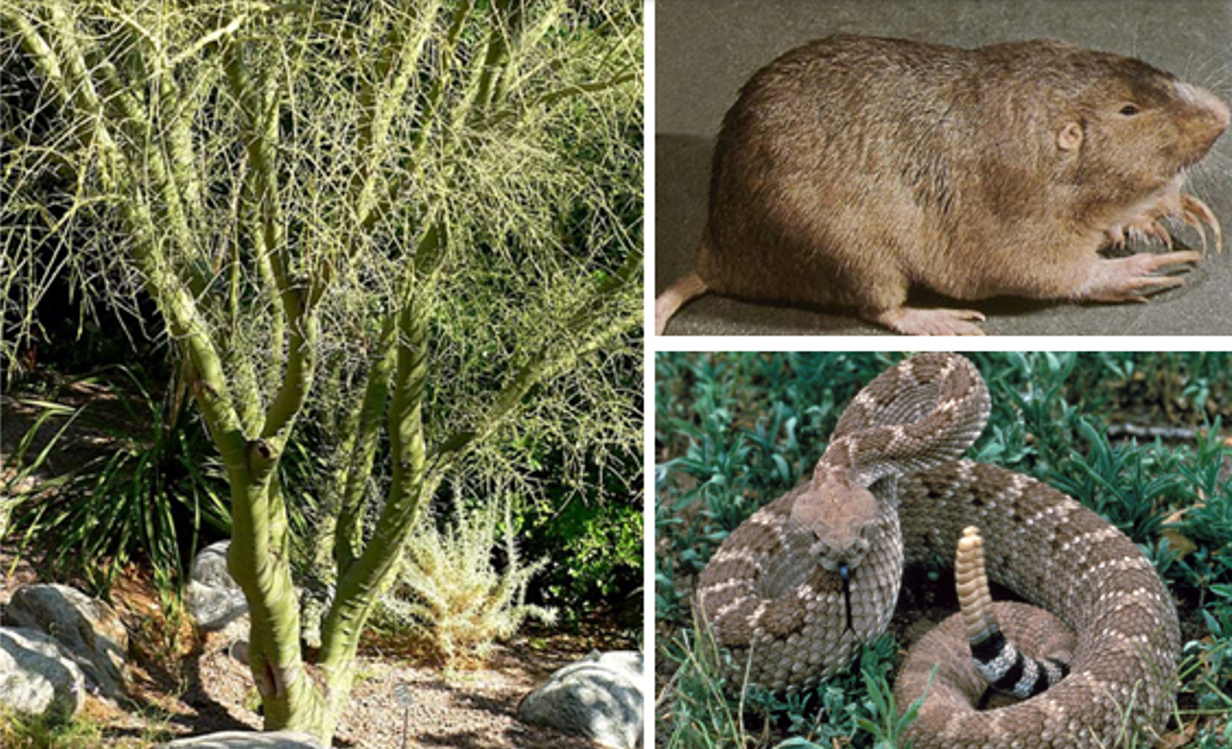

Este pinzón cebra (Taeniopygia guttata) ha decidido que le gusta el rosa. Foto: Lauren Guillette (Universidad de Alberta, Canadá) / IFL Science

Este pinzón cebra (Taeniopygia guttata) ha decidido que le gusta el rosa. Foto: Lauren Guillette (Universidad de Alberta, Canadá) / IFL ScienceEl diamante mandarín, también conocido como pinzón cebra, (Taeniopygia guttata) es un pequeño pájaro que se distribuye por buena parte de Asia y Oceanía, especialmente, en Australia. Son aves muy sociales y nada territoriales que construyen sus nidos muy cerca unos de otros por lo que resultan muy convenientes para el estudio de sus preferencias. En esta especie son los machos quienes se encargan de recolectar y colocar los materiales que formarán su nido y los investigadores canadienses querían saber si cada pinzón tenía sus propias preferencias personales y si estas decisiones podrían verse influenciadas por la conducta mayoritaria de sus vecinos.

Su primer paso fue averiguar si los pinzones mostraban preferencias individuales a la hora de elegir los materiales de su nido y para ello diseñaron un experimento en el que evaluaron la preferencia de cada macho por un determinado color. A cada pinzón se le dio la oportunidad de elegir dos colores diferentes, azul y amarillo, mientras observaban y registraban el tiempo que cada pinzón pasaba con ese color. «Primero, medimos la preferencia de color de cada macho presentándole cuerdas azules y amarillas y registrando el tiempo que interactuaba con cada una. Esto nos permitió calcular qué color prefería y con qué intensidad. Un ave que pasa el 95 % de su tiempo con una cuerda azul muestra preferencias más intensas que una que lo divide al 60 % entre los dos colores», explica en The Conversation Lauren Guillet, autora principal del estudio.

Una vez establecido el color favorito (y la intensidad de esa elección) de cada pinzón, su siguiente movimiento fue colocar «a ese macho y a su hembra en una población donde otras cuatro parejas incubaban huevos en nidos terminados. Estos nidos variaban sistemáticamente. En algunos grupos, los cuatro nidos coincidían con el color preferido del macho. En otros, la mayoría, o todos, lo contradecían. El macho observador pudo observar estos nidos y a sus ocupantes durante varios días. Finalmente, lo devolvimos a su jaula, le proporcionamos cuerda de ambos colores y le permitimos construir».

Ahora que hemos establecido que, al igual que los seres humanos, algunos pinzones muestran fuertes preferencias mientras que otros simplemente muestran un «ni fú, ni fá», queda por saber cómo les influirá que su vecindario esté pintado de un determinado color que no es el suyo. ¿Mostrarán «conformidad» renunciando a su color favorito para ajustarse a la elección mayoritaria del grupo? ¿Cederán ante la tendencia dominante o cantarán como Raphael el «digan lo que digan los demás»?

Los resultados y conclusiones nos acercan mucho a lo que ocurre con los seres humanos. La conformidad existe, su influjo es poderoso, pero no es universal y algunos individuos se resisten. Los pinzones con preferencias personales más débiles tendieron a usar el color mayoritario en su grupo, incluso si ese color no era su favorito originalmente. Sin embargo, los pinzones con preferencias más fuertes resistieron más la influencia social. La mayoría de estos mayos siguieron usando su color preferido en la construcción, aunque la mayoría de los nidos vecinos fuese de otro color.

La conformidad es uno de los procesos que estabilizan las tradiciones culturales. Si los recién llegados adoptan con constancia el comportamiento mayoritario, los patrones grupales se consolidan. Pero si algunos individuos se resisten, debido a fuertes prejuicios o preferencias personales, las tradiciones pueden propagarse con mayor lentitud o no arraigarse, o incluso iniciar unas nuevas.

En el caso de estos pinzones australianos, igual que ocurre con las personas, «no siguieron ciegamente a la multitud. Algunas se conformaron. Otras no. Y la clave de esta diferencia la encontramos en la intensidad de sus preferencias, sentimientos y decisiones individuales».

Referencias científicas y más información:

Lauren M. Guillette, Andrés Camacho-Alpízar, Julia Self et al. (2026) Conformity and individual preference shape nest material use in zebra finches (Taeniopygia guttata) PLoS One doi: 10.1371/journal.pone.0342277

Eleanor Higgs, Tom Leslie These Finches Have A Favorite Color, And Nothing Their Friends Can Say Will Change Their Minds IFL Science, febrero 2026

Lauren M. Guillette, Julia Self Strong opinions matter: Why some birds refuse to follow the flock The Conversation, febrero 2026

Sobre el autor: Javier Peláez (@Irreductible), es escritor y comunicador científico. Autor de «500 Años de Frío» (2019) y «Planeta Océano» (2022), también es guionista en el programa de TVE «Órbita Laika» y ganador de tres premios Bitácoras, un premio Prisma a la mejor web de divulgación científica y un Premio Ondas al mejor programa de radio digital.

El artículo Estos pinzones tienen su color favorito y no cambiarán de opinión por lo que digan sus vecinos se ha escrito en Cuaderno de Cultura Científica.

BCAM Naukas Día de Pi 2026

La fascinación que ha suscitado durante siglos el número π es tal, que se viene estudiando desde hace más de 4.000 años e, incluso, cuenta con su propio día en el calendario: el 14 de marzo. La forma en la que se escribe el 14 de marzo en inglés y euskera coincide con los tres primeros dígitos de la famosa constante matemática: 3-14 martxoaren 14 en euskara / 3-14 March, 14th en inglés.

El número Pi representado por la letra griega π, es una de las constantes matemáticas más famosas e importantes que existen en el mundo y la celebración del Día de Pi a nivel internacional vino de la mano del físico estadounidense Larry Shaw, quien en 1988 lanzó la propuesta de celebrar esta efeméride. En los últimos años, la conmemoración del Día de Pi se ha ido extendiendo, hasta tal punto que el 26 de noviembre de 2019 la UNESCO designó el 14 de marzo Día Internacional de las Matemáticas.

Un año más, el Basque Center for Applied Mathematics-BCAM, la plataforma de divulgación científica Naukas y la Cátedra de Cultura Científica de la Universidad del País Vasco se sumaron a la celebración, organizando la séptima edición del evento BCAM Naukas Día de Pi, que se desarrolló a lo largo del viernes 13 de marzo en el Bizkaia Aretoa – EHU de Bilbao.

A continuación presentamos la grabación de las charlas cortas (15 minutos) que tuvieron lugar de acuerdo con el siguiente programa:

- 18:30 – 18:40: Bienvenida

- 18:40 – 18:45: Presentación del evento – Javier Peláez, Naukas.

- 18:45 – 19:00: “¿Qué forma tiene el espacio?” – Irene Gonzálvez, Basque Center for Applied Mathematics (BCAM).

- 19:00 – 19:15: “El matemático que no sabía contar” – Tomás Teijeiro, Basque Center for Applied Mathematics (BCAM).

- 19:15 – 19:30: “Matematika eta euskal dantzak” (Matemáticas y danzas vascas) – Judith Rivas, Universidad del País Vasco (EHU).

- 19:30 – 19:45: “La carta de Madrás” – Pablo Fernández, Universidad Autónoma de Madrid (UAM).

- 19:45 – 20:00: “Cómo optimizamos: lo que una hormiga y tú tenéis en común” – Leticia Hernando, Universidad del País Vasco (EHU).

- 20:00 – 20:15: “El impostor” – José Antonio Prado Bassas, Universidad de Sevilla (US).

- 20:15 – 20:30: Cierre del evento BCAM Naukas – Javier Peláez, Naukas.

Edición realizada por César Tomé López

El artículo BCAM Naukas Día de Pi 2026 se ha escrito en Cuaderno de Cultura Científica.

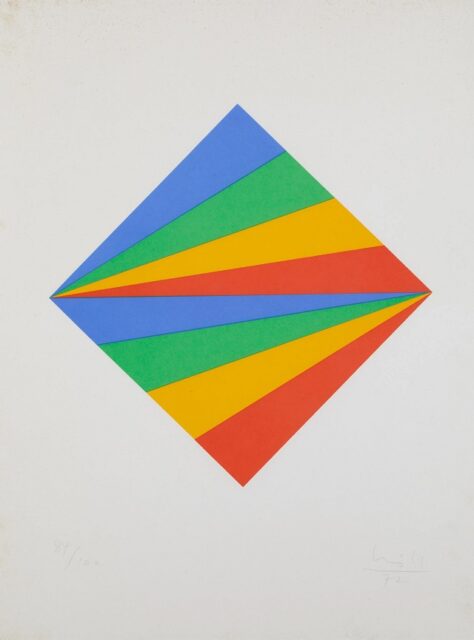

¿Por qué los colores producen diferentes emociones?

Asociamos los colores a distintas emociones.

Asociamos los colores a distintas emociones.Steve Johnson / Unsplash, CC BY-SA

Este artículo forma parte de la sección The Conversation Júnior, en la que especialistas de las principales universidades y centros de investigación contestan a las dudas de jóvenes curiosos de entre 12 y 16 años. Podéis enviar vuestras preguntas a tcesjunior@theconversation.com

Pregunta formulada por el curso de 3º de la ESO de Aranzadi Ikastola. Bergara (Gipuzkoa)

Hay colores que nos acompañan toda la vida. El verde de un jardín que ya no existe, el rojo del traje de aquel superhéroe o el azul oscuro de algo que preferiríamos olvidar. Aprender esas asociaciones no fue una elección: simplemente ocurrieron en el transcurso de nuestra vida. Y cuando volvemos a encontrar esos colores –en una pared, en una camiseta, en un atardecer– algo se mueve por dentro, antes de que hayamos tenido tiempo de pensar.

Algunas de esas asociaciones no son solo nuestras. Quienes vivieron situaciones similares suelen tender a sentir algo parecido ante los mismos colores. Pero quienes nunca estuvieron en ese jardín o se perdieron esa película posiblemente sentirán cosas distintas.

¿De qué manera los colores pueden llegar a despertar emociones y por qué estas pueden ser tan distintas en una persona u otra? Para responder estas preguntas, necesitamos primero entender bien qué es exactamente un color.

Una cosa es el mundo y otra nuestra experiencia de élLa primera idea que tenemos que considerar es algo contraintuitiva: los colores no están ahí afuera. En el mundo, no hay manzanas “rojas”. El color rojo es una creación de nuestro cerebro. Isaac Newton nos ayudó a entenderlo con uno de sus experimentos más célebres. Hizo pasar un rayo de luz por un prisma y reveló algo sorprendente: la luz se descomponía en tonalidades distintas.

Así empezamos a descubrir varias cosas. Primero, que la luz se compone de ondas de distinta longitud. Y, además, que la manzana es un trozo de materia que absorbe casi todas las longitudes de onda pero refleja las de alrededor de 700 nanómetros. La manzana no es roja. El rojo lo empieza a fabricar nuestro cerebro cuando los fotorreceptores de nuestras retinas reaccionan ante esas longitudes.

Hoy conocemos bastante bien los procesos físicos que transforman esas variables físicas en señales neuronales. Pero eso no basta para entender qué es el color. Para ir más allá, recurriremos a un experimento mental que propuso el filósofo Frank Jackson en la década de 1980.

El rojo que nadie puede explicarle a MaryImaginemos a Mary, una científica que sabe absolutamente todo sobre física y neurociencia del color, pero que ha vivido toda su vida en un mundo en blanco y negro. ¿Qué ocurrirá si un día abandona ese mundo de grises y ve una manzana roja por primera vez?

Aunque conozca toda la teoría y cada área cerebral implicada en la percepción del color, experimentará algo completamente nuevo que ningún libro le ha enseñado: cómo se siente el rojo. Esa experiencia subjetiva e intransferible es lo que los filósofos llaman qualia: el “cómo se siente” algo desde dentro.

La ciencia todavía no entiende bien cómo nuestro cerebro genera experiencias tan ricas y subjetivas a partir de meros disparos neuronales. Lo que sí sabemos es que esas vivencias a las que llamamos qualia no están hechas solo de información sensorial. Tienen muchos más ingredientes.

¿De qué están hechos los qualia?Para entenderlo, pensemos en qué ocurre cuando interactúo con esa manzana roja. Mi cerebro no se limita a registrar las longitudes de onda que refleja su superficie: simultáneamente, procesa su textura, su olor, su sabor al morderla, la temperatura del ambiente, la compañía de quienes me rodean. Y, al mismo tiempo que procesa todo eso, genera una reacción emocional: una evaluación automática, casi instantánea, de si lo que estoy viviendo es agradable, amenazante o neutro.

Mi cerebro tiene además otra capacidad admirable: vincular todo lo que registra. Así, cuando miro la manzana, la muerdo y me doy cuenta de que estoy con mis hijas, todo eso –el color, el sabor, la alegría de ese momento– queda entretejido en una sola experiencia que el cerebro almacena, de manera que, cuando uno de esos elementos reaparece, los demás se reactivan con él.

Por eso, la próxima vez que esas mismas longitudes de onda activen mis fotorreceptores –aunque la manzana no esté, aunque mis hijas no estén–, algo de todo aquello regresará. Y, cuantas más experiencias acumule con ese color a lo largo de la vida, más rica, compleja y única se volverá mi experiencia sobre él.

De ahí que el qualia del rojo no sea simplemente el procesamiento de una frecuencia de luz. Es el resultado de fundir, en un instante, información sensorial inmediata, recuerdos almacenados y afectos acumulados. Tres tipos de contenido que el cerebro ensambla tan rápido y tan bien que los vivimos como una sola cosa indivisible. A eso es a lo que llamamos color.

Colores y emociones, un siglo de investigaciónLos colores producen respuestas emocionales sistemáticas. Los resultados de un estudio que analizó 132 investigaciones realizadas en 64 países durante 128 años, con más de 42 000 participantes, muestran patrones consistentes: el rojo se asocia con emociones de alta activación –amor, ira, peligro, pasión–; el azul, con calma y confianza; el amarillo, con alegría; y el negro, con tristeza o poder.

Estos patrones aparecen en culturas muy distintas, algo que apunta a disposiciones innatas o a ciertos aprendizajes omnipresentes: el azul del cielo despejado, el rojo de la sangre, el amarillo del sol son señales ecológicas que compartimos como especie.

Otro hallazgo revelador es que cada color puede evocar emociones muy distintas, y una misma emoción puede ser evocada por colores muy diferentes. Eso no es un reflejo del azar: es la huella de las condiciones particulares de otros muchos aprendizajes.

Los psicólogos Stephen Palmer y Karen Schloss precisaron este mecanismo en su Teoría de Valencia Ecológica: nos gustan los colores asociados a experiencias positivas y rechazamos los vinculados a negativas. Si el amarillo de la infancia de alguien es el de la cocina de su abuela, ese amarillo será reconfortante. Si para otra persona es el del uniforme del colegio que odiaba, evocará exactamente lo contrario.

La misma longitud de onda, distintas emocionesEn definitiva, el rojo que tú ves se parece al rojo que yo veo… pero no es exactamente igual. Se parece porque compartimos la física, la biología y algunas experiencias. Pero no es igual porque, a medida que vivimos nuestras vidas, vamos construyendo una experiencia personal e irrepetible. Cada historia tiñe el color de manera distinta. Por eso, los colores no solo nos ayudan a describir el mundo: nos recuerdan también lo que significa ir viviendo una vida y no otra.

La Cátedra de Cultura Científica de la Universidad del País Vasco colabora en la sección The Conversation Júnior.![]()

Sobre el autor: Gabriel Rodríguez San Juan, Profesor de Psicología del Aprendizaje, Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo ¿Por qué los colores producen diferentes emociones? se ha escrito en Cuaderno de Cultura Científica.

Una nueva estimación del grosor de la corteza de hielo de Europa

Si en el artículo Por qué los satélites de Júpiter son como son hablábamos de por qué los satélites jovianos pueden ser tan radicalmente diferentes, hoy nos vamos a centrar en Europa, un cuerpo fascinante desde el punto de vista de la geología y la astrobiología.

No es casualidad este interés. Cuando miramos a este satélite lo que vemos es un cuerpo que podría contener un océano de agua líquida -subterráneo- con un volumen de alrededor del doble del de los océanos terrestres. Eso sí, encerrado bajo una corteza de hielo bombardeada por la radiación de Júpiter.

Pero, ¿hasta que profundidad llega esa corteza? A lo largo de las últimas décadas, ha habido muchos cálculos basados en distintos datos indirectos y las estimaciones han ido desde unos pocos kilómetros hasta más de treinta. Y responder a esta cuestión es importantísimo, porque el espesor nos indica si el océano interactúa con la superficie permitiendo intercambio de nutrientes y otros elementos necesarios para la vida.

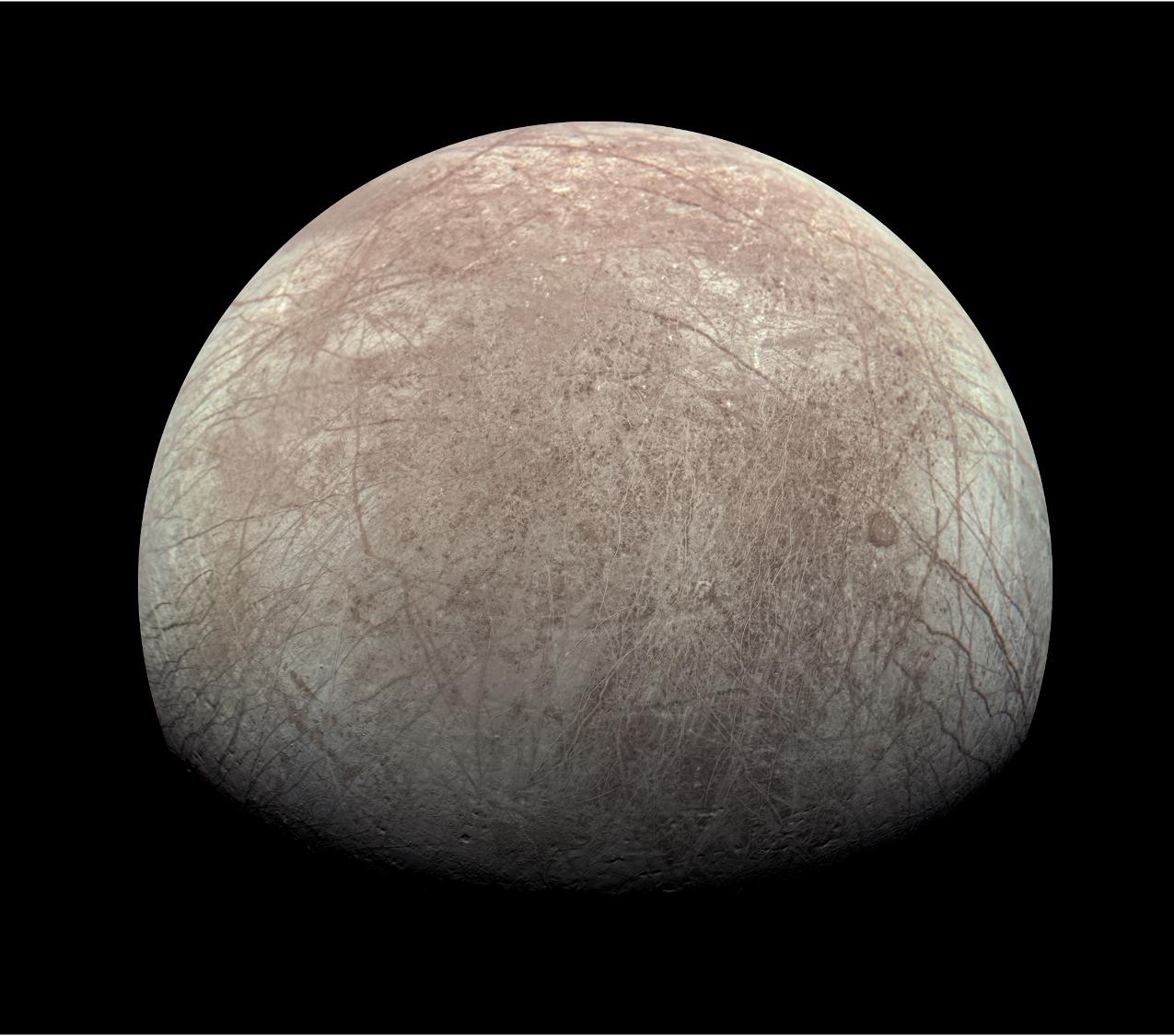

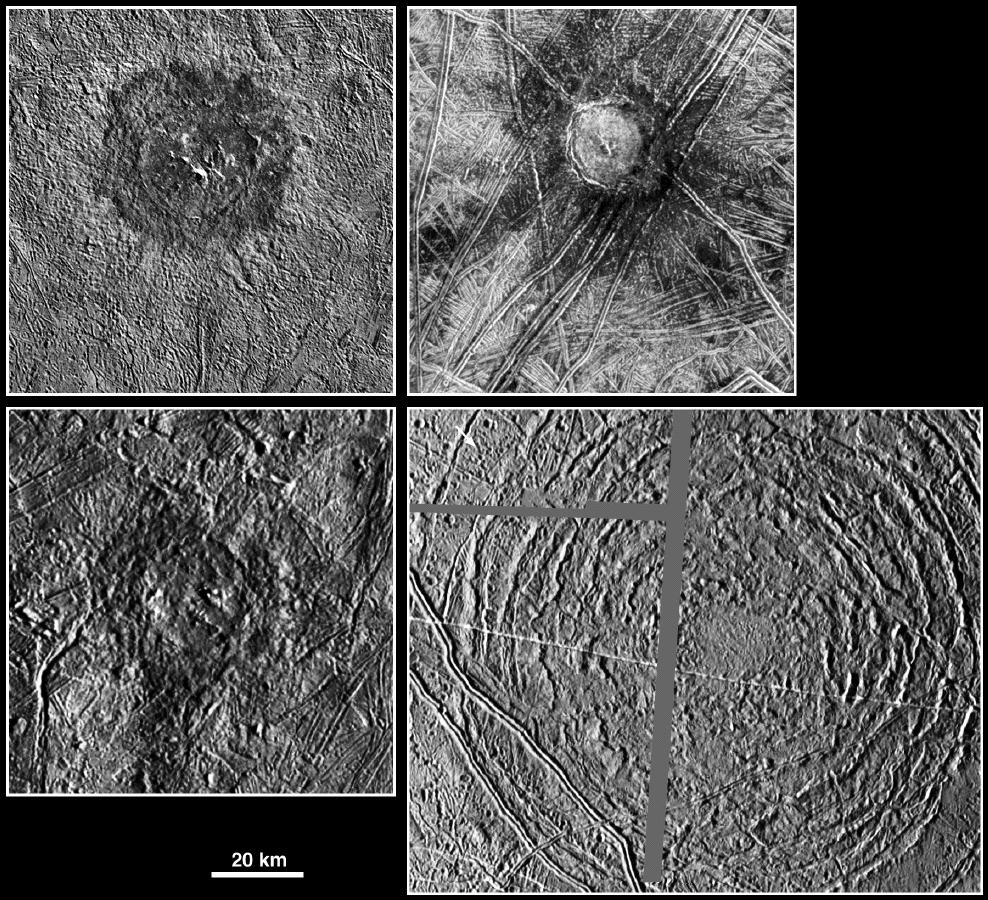

Figura 1. Aquí podemos ver una de las imágenes más recientes -de alta resolución- de Europa, en este caso tomada por la sonda Juno en septiembre de 2022. Lo más llamativo es la gran cantidad de sistemas de fracturas que cruzan la práctica totalidad del satélite y el escaso número de cráteres de impacto, atestiguando la juventud de su superficie. Imagen cortesía de NASA/JPL-Caltech/SwRI/MSSS Image /Kevin M. Gill CC BY 3.0.

Figura 1. Aquí podemos ver una de las imágenes más recientes -de alta resolución- de Europa, en este caso tomada por la sonda Juno en septiembre de 2022. Lo más llamativo es la gran cantidad de sistemas de fracturas que cruzan la práctica totalidad del satélite y el escaso número de cráteres de impacto, atestiguando la juventud de su superficie. Imagen cortesía de NASA/JPL-Caltech/SwRI/MSSS Image /Kevin M. Gill CC BY 3.0.La historia de hoy comienza con la llegada de la sonda Juno al sistema joviano en 2016. La misión, en principio, no tenía previsto estudiar las lunas heladas con tal nivel de detalle, pero uno de sus instrumentos -el radiómetro de microondas (MWR)-, diseñado para estudiar la atmósfera de Júpiter, fue también usado para intentar recabar datos sobre la corteza de Europa durante un sobrevuelo cercano, obteniendo unos datos muy interesantes.

Y bueno, ¿qué es lo que ha “visto” exactamente este instrumento? Para simplificar, lo primero que ha podido estudiar es la temperatura del hielo en profundidad. Si pensamos en las temperaturas que esperamos, la superficie del océano estaría a unos 273ºK, mientras que la superficie del hielo de la corteza estaría a tan solo 100ºK. Por lo tanto, la temperatura del hielo tendría que aumentar conforme vamos descendiendo hacia las profundidades de la corteza. Si este hielo estuviese formado por un bloque sólido y con las mismas propiedades en todas partes, la Juno habría visto una subida gradual de la temperatura de arriba hacia abajo.

Pero eso no es lo que vieron, sino que encontraron una estructura mucho más compleja algo que, por otro lado, no era descartable. Para poder interpretar los datos obtenidos, los científicos han tenido que usar un sofisticado modelo de transferencia radiativa -un modelo matemático que estudia transferencia de energía y su interacción con la materia que atraviesa- para transformar las señales de microondas en una estructura física.

La consecuencia es una nueva estimación del grosor de la corteza de hielo de Europa. Suponiendo que esté hecha de agua pura, los datos obtenidos son consistentes con una corteza de hielo de 29±10 kilómetros de espesor. Estas medidas se sitúan en el margen superior de las estimaciones más aceptadas por la comunidad científica.

Pero ojo, aquí hay otro detalle importantísimo: si debajo de esta capa existiese otra de hielo más cálido y convectivo -algo que no es descartable- habría que añadirla a esta estimación, por lo que probablemente estemos hablando de que esta sería el límite inferior de la horquilla de posibilidades.

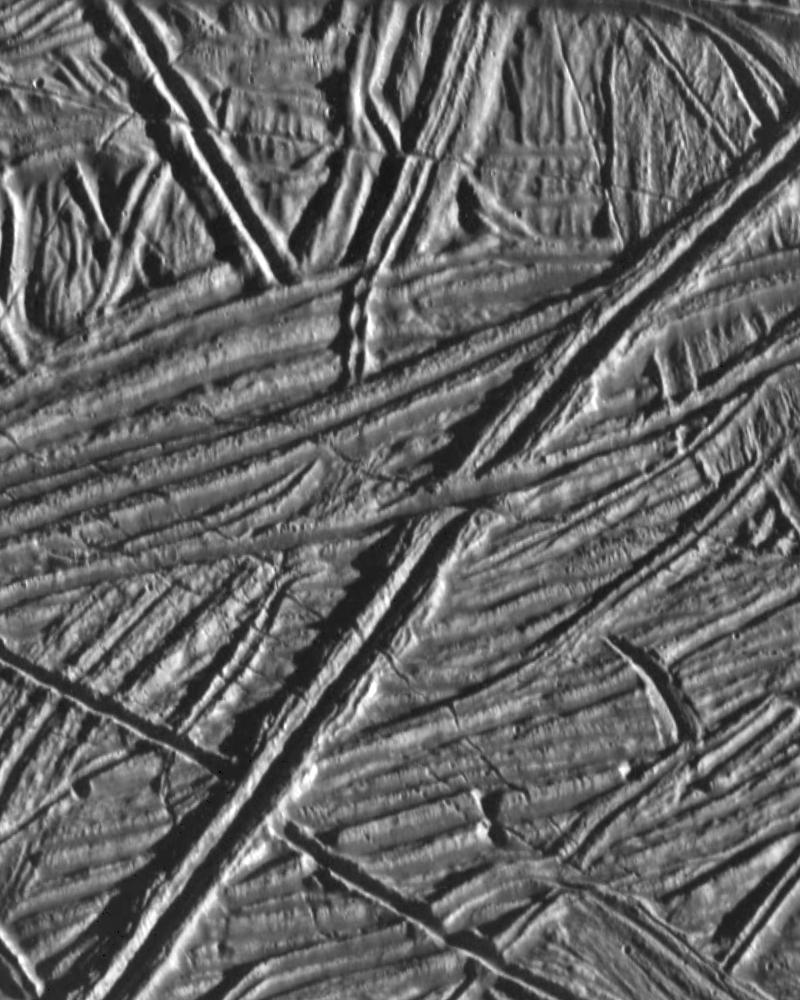

Figura 2. Una de las esperanzas para favorecer la hipótesis de un océano habitable es que estos sistemas de fracturas, crestas y surcos continuasen su estructura hasta partes mucho más bajas de la corteza de Europa… ¿serán finalmente un “arañazo” en la superficie? Imagen cortesía de NASA/JPL.

Figura 2. Una de las esperanzas para favorecer la hipótesis de un océano habitable es que estos sistemas de fracturas, crestas y surcos continuasen su estructura hasta partes mucho más bajas de la corteza de Europa… ¿serán finalmente un “arañazo” en la superficie? Imagen cortesía de NASA/JPL.Este hallazgo tiene grandes implicaciones desde el punto de vista de la geología. El flujo de calor que implica una corteza de este espesor coincide con los modelos de calentamiento por mareas, el origen de una parte importante de la energía interna del satélite, encargada de mantener el océano líquido y alimentar los procesos geológicos.

Y hay un detalle más: el instrumento MWR ha permitido a los científicos estudiar la textura interna de la capa de hielo. Y a partir de estos datos han observado zonas donde el hielo está bastante alterado, lo que en otros momentos ha llevado a especular sobre la posible existencia de lagos subterráneos, bolsas de salmuera o sistemas de grandes fisuras.

Esto se ha visto a partir de la aparición de elementos “dispersores”, discontinuidades en el hielo como fisuras, huecos o poros. Analizando como las distintas frecuencias dispersaban la radiación, el equipo pudo deducir que estos defectos en la capa de hielo son relativamente pequeños, con un tamaño característico de apenas unos centímetros.

Además, estos no estarían distribuidos por la corteza de una manera homogénea, sino que estarían concentrados en la parte superior, hasta unos pocos cientos de metros de profundidad. La fracción del volumen de hielo que ocupan es poca, y va haciéndose menor conforme profundizamos.

Este último detalle, que nos puede parecer un poco técnico, podría tener fuertes consecuencias de cara a la habitabilidad de Europa. Para que este cuerpo tuviese la posibilidad de albergar vida, es muy probable que su océano subterráneo necesitara un suministro de oxidantes y nutrientes generados en su superficie por el efecto de la radiación. Si la capa de hielo está plagada de grandes sistemas de fisuras, fallas o sistemas de poros interconectados, estos materiales podrían llegar hasta el océano.

Sin embargo, los hallazgos de este estudio sugieren que no es el caso. El escaso volumen, el pequeño tamaño y la poca profundidad a la que aparecen, indican que es poco probable que las fracturas que se ven en la superficie sean capaces por si solas de generar un intercambio de elementos y compuestos con el océano, mostrando la imagen de una Europa cuyo exterior e interior están desconectados y, que las formas geológicas que vemos y que nos indican cierta actividad, podrían en realidad encontrarse sobre kilómetros de hielo sólido y aislante.

Figura 3. ¿Podrían ser los cráteres de impacto, en el caso de que la corteza fuese tan gruesa, una forma de conectar el interior de Europa con el exterior? Aquí en esta imagen podemos ver algunas de las grandes estructuras de impacto que hay sobre su superficie. Una manera en la que pudiesen servir estas para permitir el intercambio sería generando sistemas de fracturas -o propagando los existentes- hacia el interior, junto con la fusión del hielo provocada por el impacto. Imagen cortesía de NASA/JPL/DLR.

Figura 3. ¿Podrían ser los cráteres de impacto, en el caso de que la corteza fuese tan gruesa, una forma de conectar el interior de Europa con el exterior? Aquí en esta imagen podemos ver algunas de las grandes estructuras de impacto que hay sobre su superficie. Una manera en la que pudiesen servir estas para permitir el intercambio sería generando sistemas de fracturas -o propagando los existentes- hacia el interior, junto con la fusión del hielo provocada por el impacto. Imagen cortesía de NASA/JPL/DLR.Los cálculos están basados en la asunción de que el hielo de la corteza es de agua pura, pero la presencia de sales en este hielo podría cambiar el ajuste del modelo. De hecho, si asumimos un hielo con unos 15 mg de sal por kilo de hielo -parecido a la composición del hielo de los mares terrestres- la capa de hielo se reduciría 5 kilómetros, aunque seguiría dentro del margen de incertidumbre de los 10 kilómetros que han obtenido los científicos, por lo que la corteza seguiría siendo gruesa.

Estos hallazgos representan un avance francamente importante. Hemos pasado de ver los grandes sistemas de fracturas de Europa en una imagen a conocer el gradiente de temperaturas de toda la capa de hielo. Y lo que surge es una capa estable, gruesa y que aísla al océano del vacío del espacio. Si bien esto confirma que el océano está bien protegido, también sugiere que está más aislado de lo que esperaban los modelos más optimistas.

La vía para que sea un mundo habitable -el intercambio de materia y energía desde fuera hacia adentro- parece ser, a la vista de estos datos, complicado al no observarse una continuidad de los sistemas de fracturas desde el exterior al interior. Este hecho no elimina de un plumazo la posibilidad de que sea un mundo habitable, ya que podría haber otros mecanismos no detectados en este sobrevuelo, como regiones que puedan estar geológicamente activas o el papel de los impactos en facilitar ese intercambio.

Habrá que esperar a las futuras misiones JUICE y Europa Clipper que nos podrán aportar nuevos y mejores datos -al fin y al cabo, Juno no estaba preparada para esto- y confirmar o refinar estas medidas. Y, por supuesto, a abrir nuevas preguntas e interrogantes.

Referencias:

Levin, S. M., Zhang, Z., Bolton, S. J., Brown, S., Ermakov, A. I., Feng, J., Hand, K., Misra, S., Siegler, M., Stevenson, D., McKinnon, W., & Akiba, R. (2025) Europa’s ice thickness and subsurface structure characterized by the Juno microwave radiometer Nature Astronomy doi: 10.1038/s41550-025-02718-0

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo Una nueva estimación del grosor de la corteza de hielo de Europa se ha escrito en Cuaderno de Cultura Científica.

Una feroz batalla espacial… de microbios

Una caja de llena de virus y bacterias ha sido el sorprendente escenario de una fascinante batalla espacial tras completar su viaje de ida y vuelta a la Estación Espacial Internacional. Los contendientes en este enfrentamiento especial, mantienen una rivalidad ancestral y son adversarios desde hace miles de millones de años: la siempre temida bacteria Escherichia coli y su archienemigo viral, el bacteriófago T7.

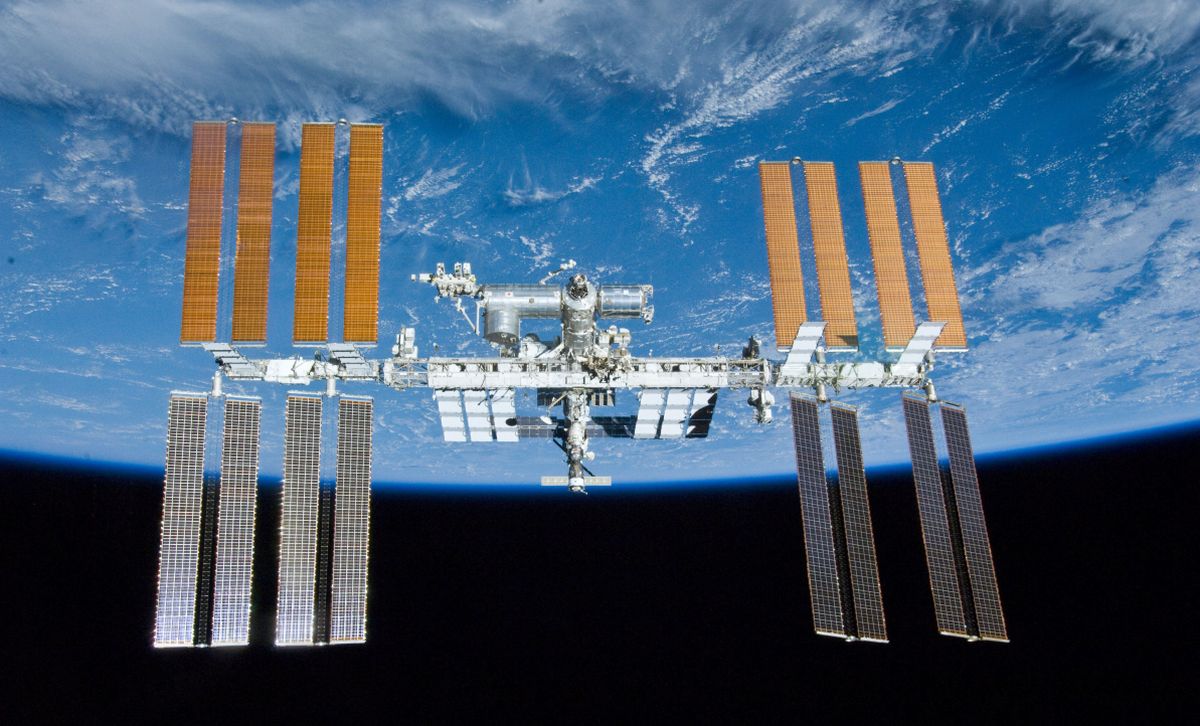

La Estación Espacial Internacional (ISS) Fuente: ESA

La Estación Espacial Internacional (ISS) Fuente: ESA

Por su parte, los fagos actúan como depredadores precisos: se adhieren a la superficie de la bacteria, inyectan su material genético y usan la maquinaria celular para multiplicarse. Si tienen éxito destruyen a la bacteria para liberar nuevas generaciones de virus. Por su parte, las bacterias no se quedan de brazos cruzados y también han desarrollado su propio arsenal de defensas. Algunas cambian la estructura de sus receptores para que los fagos no puedan engancharse, otras producen enzimas que destruyen el ADN viral, y algunas incluso registran fragmentos de virus en su propio genoma para reconocer y atacar futuras invasiones, un mecanismo con unas siglas (CRISPR) que seguro que os suenan.

Tradicionalmente esta batalla ocurre en la Tierra, pero un equipo de investigadores de la Universidad de Wisconsin-Madison, junto con la empresa biotecnológica estadounidense Rhodium Scientific Inc., han querido averiguar qué ocurriría con este enfrentamiento microscópico si se produjese en un entorno de microgravedad… o dicho de una manera más sencilla, en el año 2020 se envió una caja con virus y bacterias a la ISS y ahora, una vez que los contendientes han regresado a tierra firme, han publicado los resultados de su batalla espacial. Los científicos de la ISS incubaron diferentes combinaciones de bacterias y fagos durante 25 días, mientras que el equipo de investigación de bioquímicos mantuvo un grupo de control, con los mismos experimentos, en sus instalaciones de Madison, en la Tierra.

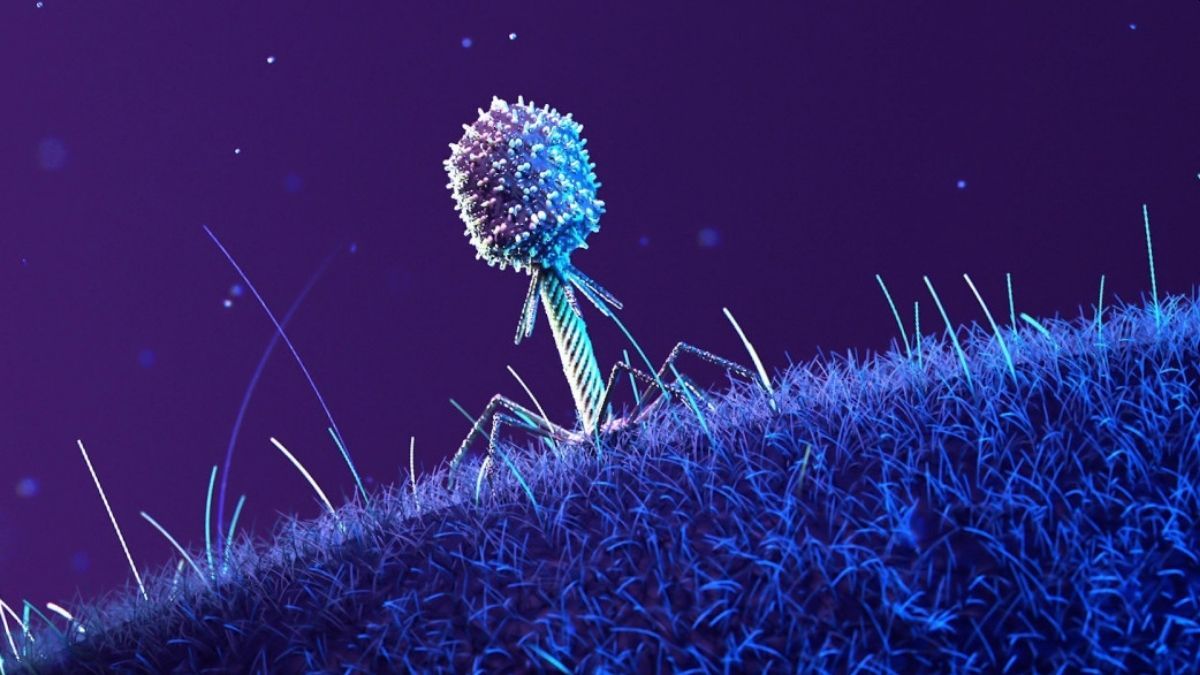

Un fago sobre la superficie de una célula huésped. Fuente: Universidad de Wisconsin-Madison

Un fago sobre la superficie de una célula huésped. Fuente: Universidad de Wisconsin-MadisonPor supuesto, en el espacio la batalla no se detuvo, los virus siguieron infectando a las bacterias y la E. coli continuó con su férrea defensa… pero ambos rivales lo hicieron de una forma distinta a como lo hacen en la Tierra. El entorno de microgravedad influyó tanto en la evolución de los virus como en la de sus bacterias objetivo, impulsando cambios genéticos notables en ambos.

En el entorno de ingravidez de la estación, las bacterias fueron quienes hicieron el primer movimiento adquiriendo mutaciones en genes implicados en la respuesta microbiana al estrés y la gestión de nutrientes. Sus proteínas de superficie también cambiaron. Los fagos tuvieron un inicio algo más lento pero, finalmente, mutaron en respuesta para poder seguir uniéndose a sus víctimas. No obstante, esta respuesta tardía fue fulminante sobre todo si tenemos en cuenta sus posibles aplicaciones médicas: El equipo descubrió que ciertas mutaciones de fagos específicas del espacio eran especialmente eficaces para eliminar bacterias terrestres responsables de infecciones del tracto urinario. Si tenemos en cuenta que más del 90 % de las bacterias responsables de ITU son resistentes a los antibióticos, lo que convierte los tratamientos con fagos en una alternativa prometedora.

Es cierto que cuando pensamos en virus, solemos pensar en enfermedades… pero los fagos se han convertido en un gran aliado, especialmente en el grave problema de la resistencia microbiana. Desde principios del siglo XX, mucho antes de que los antibióticos se convirtieran en la regla general frente a las infecciones, científicos y médicos han explorado su potencial como terapia eficaz. Los resultados del este nuevo artículo nos ofrecen una nueva ventana para desarrollar tratamientos eficaces y incorporar esas mejoras espaciales a nuestros fagos terrestres: «El espacio modifica radicalmente la interacción entre fagos y bacterias: la infección se ralentiza y ambos organismos evolucionan siguiendo una trayectoria distinta a la de la Tierra. Al estudiar estas adaptaciones espaciales, hemos desarrollado nuevos conocimientos biológicos que nos han permitido diseñar fagos con una actividad muy superior contra patógenos resistentes a los fármacos en la Tierra».

Con la experiencia adquirida durante este primer experimento, los investigadores están trabajando ya en un segundo experimento (que por supuesto debe caber en la misma caja pequeña) para un futuro lanzamiento espacial. «Primero, nos hemos planteado preguntas básicas de microbiología aplicada al espacio», explica uno de los autores, «ahora estamos listos para estudiar sistemas de múltiples fagos y bacterias que representan con mayor precisión la complejidad del microbioma humano y averiguar qué interacciones novedosas ocurren en el espacio y qué podemos aprender de ellas aquí en la Tierra».

Referencias científicas y más información:

Phil Huss, Srivatsan Raman, et al. (2026) Microgravity reshapes bacteriophage–host coevolution aboard the International Space Station PLOS Biology doi: 10.1371/journal.pbio.3003568

Renata Solan (2026) Microbes mutated in space hint at biomedical benefits to humans on Earth Universidad de Wisconsin-Madison

PLOS (2026) Scientists sent viruses to space and they evolved in surprising ways Science Daily

Manuela Callari (2026) Viruses that evolved on the space station and were sent back to Earth were more effective at killing bacteria Live Science

Sobre el autor: Javier «Irreductible» Peláez es escritor y comunicador científico. Autor de «500 Años de Frío» (2019) y «Planeta Océano» (2022). Es ganador de tres premios Bitácoras, un premio Prisma a la mejor web de divulgación científica y un Premio Ondas al mejor programa de radio digital.

El artículo Una feroz batalla espacial… de microbios se ha escrito en Cuaderno de Cultura Científica.

La teoría del invariante

Existen muchas formas de explicar la teoría de la relatividad de Einstein. Así, por ejmplo, en nuestra serie Teoría de la invariancia se explica paso a paso y usando muy pocas matemáticas, y las que se usan, elementales. Pero esta síntesis que hace Francis Villatoro en 10 minutos (La teoría del invariante) es, simplemente, magnífica, pues incluye también aspectos geométricos que no se suelen tratar a este nivel.

Francisco Román Villatoro Machuca es profesor titular (acreditado como catedrático) del Departamento de Lenguajes y Ciencias de la Computación de la Universidad de Málaga. Es licenciado en Informática, licenciado en Física y doctor en Matemáticas. Es un divulgador de referencia en el mundo hispanohablante.

Edición realizada por César Tomé López

El artículo La teoría del invariante se ha escrito en Cuaderno de Cultura Científica.

¿Comemos lo que decimos que comemos?

Foto: Artem Podrez / Pexels

Foto: Artem Podrez / Pexels¿Y si una simple gota de sangre pudiera decirnos si nos estamos alimentando bien? Aunque muchas personas afirman seguir una dieta saludable, los métodos tradicionales para medir lo que comemos –como encuestas o diarios alimentarios– no siempre son fiables. Al fin y al cabo, es fácil olvidar lo que hemos comido o incluso tener percepciones erróneas sobre las cantidades ingeridas.

Por suerte, ahora hay alternativas. En un estudio que llevamos a cabo en el centro tecnológico AZTI, analizamos si una pequeña muestra de sangre recogida del dedo (lo que se llama dried blood spot o DBS) puede reflejar con precisión lo que comemos, especialmente respecto al consumo de pescado azul, rico en grasas saludables omega-3.

El estudio incluyó 18 participantes, hombres y mujeres de entre 18 y 65 años, sin enfermedades. Durante cinco semanas, las 18 personas participaron en una intervención nutricional. Primero siguieron su dieta habitual, luego evitaron el pescado y finalmente consumieron caballa enlatada varias veces por semana. En cada fase, recogimos muestras de sangre y analizamos los niveles de diferentes ácidos grasos.

De los cuestionarios a la analítica objetivaLos resultados fueron claros. Antes de comenzar la intervención, el perfil de ácidos grasos reveló distintos patrones de dieta entre los participantes.

Por un lado, aquellas personas que habitualmente consumían lácteos azucarados, bebidas carbonatadas y azúcar presentaron mayores niveles de grasas omega-6 y menores niveles grasas omega-3. Esto es importante porque cuando el omega-6 está descompensadamente elevado, el riesgo de fallecer aumenta. Por el contrario, quienes consumían pescado azul, bebidas alcohólicas fermentadas, edulcorantes y nueces presentaron mayores niveles de grasas monoinsaturadas y omega-3.

Un tercer grupo con mayor consumo de verduras, cereales integrales, quesos y mantequilla presentó niveles intermedios de omega-3 y omega-6, y niveles más altos de grasas saturadas.

Pero ¿cuánto tardan en cambiar nuestro perfil de ácidos grasos tras consumir ciertos alimentos? Menos de lo que imaginamos. En los experimentos vimos que si los sujetos consumían latas de caballa, los niveles en sangre de ciertos omega-3 como el EPA aumentaban en un día. Sin embargo, otros como el DHA tardaban más en reflejarse. Esto demuestra que esta técnica puede detectar cambios en la dieta tanto a corto como a largo plazo.

Además, los niveles de estas grasas cambiaban de manera distinta según el patrón de dieta habitual de cada participante. En los participantes que normalmente no consumían pescado azul, aumentaban más sus niveles de EPA al día siguiente de comer pescado. Sin embargo, aunque el DHA también aumentó en estos participantes durante las dos semanas de intervención, los niveles no llegaron a igualarse a los de los participantes que normalmente sí consumían pescado. Esto quiere decir que para adquirir niveles de omega-3 correspondientes con un consumo de pescado azul adecuado, necesitarían seguir tomándolo durante más de dos semanas.

Identificar si la dieta es adecuada sin cuestionariosEl nuevo método es, sobre todo, rápido, cómodo y poco invasivo. No requiere de profesionales médicos y puede aplicarse fácilmente en grandes muestras, o incluso en casa. Además, permite identificar si la dieta es adecuada y evitar los errores comunes de los cuestionarios alimentarios, que muchas veces no reflejan lo que realmente comemos. Por otro lado, gracias a los cambios a corto y largo plazo de diferentes grasas, también nos permite saber si las personas siguen las pautas indicadas en un plan nutricional.

Esta investigación nos coloca un paso más cerca de ofrecer recomendaciones nutricionales realmente personalizadas. Porque al final lo que importa no es lo que decimos que comemos, sino lo que realmente comemos.![]()

Sobre las autoras: Laura García-Urtiaga, Investigadora Predoctoral en Nutrición de Precisión – AZTI, Universidad del País Vasco / Euskal Herriko Unibertsitatea and Sara Arranz, Investigadora del grupo de Alimentación y Salud de AZTI

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo ¿Comemos lo que decimos que comemos? se ha escrito en Cuaderno de Cultura Científica.

Geología sobre esquís

Durante estas semanas están teniendo lugar los Juegos Olímpicos de Invierno en Italia, gracias a los cuales, y aquí reconozco mi ignorancia deportiva, podemos disfrutar de un montón de deportes y modalidades que no sabía ni que existían. Aunque, y de nuevo me sincero, no consigo centrarme en seguir el desarrollo de las pruebas al aire libre porque me dedico a prestarle más atención al paisaje que rodea las pistas olímpicas. Pero esta vez no me siento tan culpable, porque incluso en el vídeo corto que sirve como entradilla en la retrasmisión televisiva de las competiciones, unas montañas cobran todo el protagonismo: las Dolomitas.

Captura de pantalla del vídeo de entradilla de las pruebas deportivas con las montañas Dolomitas resaltadas en el centro de la imagen. Fuente. Fotograma tomado de RTVE

Captura de pantalla del vídeo de entradilla de las pruebas deportivas con las montañas Dolomitas resaltadas en el centro de la imagen. Fuente. Fotograma tomado de RTVELas Dolomitas son una serie de cordilleras montañosas situadas al sur de los Alpes orientales, en el norte de Italia, y su importancia en estos Juegos Olímpicos radica en que la segunda sede principal, Cortina d´Ampezzo, se sitúa al pie de estas montañas. Pero no es la única, hasta otras cinco localidades emplazadas en las Dolomitas albergan instalaciones en las que se desarrollan los deportes de estos juegos. Todo ello debido a que las laderas y valles dolomíticos son una de las principales zonas europeas para disfrutar de los deportes invernales gracias, como no, a su geología.

Localización de las Dolomitas al norte de Italia (enmarcadas dentro del círculo rojo) y de las sedes de los Juegos Olímpicos de Invierno situadas en las laderas de sus montañas. Fuentes: Mapa topográfico tomado de Google Maps, la localización de las sedes deportivas está tomada de Olympics.

Localización de las Dolomitas al norte de Italia (enmarcadas dentro del círculo rojo) y de las sedes de los Juegos Olímpicos de Invierno situadas en las laderas de sus montañas. Fuentes: Mapa topográfico tomado de Google Maps, la localización de las sedes deportivas está tomada de Olympics.Esta historia comienza hace unos 250 millones de años, en un Periodo geológico llamado Triásico. En aquella época, el supercontinente Pangea aún estaba unido y esta zona de Italia era un mar tropical poco profundo, con aguas cálidas y muy transparentes, en los que vivían algas y otros pequeños organismos con caparazones carbonatados. Esta paz se rompió ligeramente cuando comenzó la rotura de Pangea, hace unos 238 millones de años, porque produjo una serie de erupciones volcánicas submarinas en esta área, depositándose rocas volcánicas entre el barro carbonatado. Pero después de la tormenta llegó otra vez la calma, desarrollándose un nuevo mar tropical tranquilo en el que crecieron abundantes arrecifes de coral. Aunque no duró mucho, ya que, a comienzos del Periodo Jurásico, hace entre unos 200 y unos 180 millones de años, el agua se retiró ligeramente, quedando este lugar como una zona costera con amplias playas por las que paseaban dinosaurios. Sin embargo, el mar no se rindió y recuperó sus dominios, apareciendo así, desde hace unos 180 millones de años hasta finales del Cretácico, una nueva zona marina, más profunda que la anterior, en la que los ammonites fueron los organismos carbonatados protagonistas.

La idílica imagen de mares tropicales se acabó hace unos 65 millones de años, cuando la placa tectónica Africana empezó a moverse hacia el norte, chocando con la placa tectónica Euroasiática. Este empuje produjo que todas las rocas que se formaron desde el Triásico hasta el Cretácico empezaran a ascender, doblándose y fracturándose sin parar. Así, sin prisa pero sin calma, el choque de placas provocó que, en los últimos 10 millones de años, se formasen las enormes elevaciones que hoy conocemos como las Dolomitas. Y, como broche final de esta historia, en los últimos 2 millones de años, los agentes meteorológicos como la lluvia, el viento o las lenguas de hielo que bajaban por las laderas de las montañas, fueran esculpiendo el paisaje actual: crestas, valles y acantilados de paredes casi verticales.

Si me habéis leído en otras ocasiones, seguro que esta historia no os sorprende, porque os la habré contado antes. De hecho, podría valer para muchísimas de las cordilleras más conocidas del mundo, como los Alpes, los Pirineos, los Cárpatos o, incluso, el Himalaya. Entonces, ¿qué hace especial a las Dolomitas? Pues la respuesta a esta pregunta se encuentra en su propio nombre.

Cristales de dolomita encontrados en la cantera de Azcárate (Eugui, Navarra). Fotografía de Didier Descouens / Wikimedia Commons

Cristales de dolomita encontrados en la cantera de Azcárate (Eugui, Navarra). Fotografía de Didier Descouens / Wikimedia CommonsEl barro marino carbonatado que se depositó durante el Triásico tenía calcio y magnesio y acabó convirtiéndose en un mineral llamado dolomita (CaMg(CO3)2), que es el componente principal de la roca conocida como dolomía. Pues es tal la abundancia de este mineral en los Alpes orientales, que fue aquí donde lo descubrió a finales del siglo XVIII un geólogo francés apellidado Dolomieu. Y sí, el nombre del mineral es un homenaje a su descubridor.