Solomon Lefschetz, matemático ‘por accidente’

En los años cincuenta, en Princeton, se decía que había cuatro usos de la palabra ‘obvio’.

Algo es obvio en el sentido de Beckenbach, si es verdad y puedes verlo inmediatamente.

Algo es obvio en el sentido de Chevalley, si es verdad y te costará varias semanas verlo.

Algo es obvio en el sentido de Bochner, si es falso y te costará varias semanas verlo.

Algo es obvio en el sentido de Lefschetz, si es falso y puedes verlo inmediatamente.

Steven G. Krantz en [1]

Esta ocurrente cita nos la envío Natalia Castellana a un grupo de personas que habíamos compartido mesa –y animada conversación– en la cena del XXV Encuentro de Topología celebrado hace unas semanas en Barcelona. Nos comentaba que se la pasaba a su alumnado de topología… quizás para advertirles que eso de ser ‘obvio’ puede tener muchos matices.

Los matemáticos aludidos en esta cita de Steven G. Krantz son Edwin Ford Beckenbach (1906-1982), Claude Chevalley (1909-1984), Salomon Bochner (1899-1982) y Solomon Lefschetz (1884-1972). Todos ellos trabajaron en algún momento en la Universidad de Princeton, en la que Krantz realizó su tesis doctoral.

Solomon Lefschetz. Imagen: Matemáticos en México

Solomon Lefschetz. Imagen: Matemáticos en MéxicoParece que Lefschetz era todo un personaje… De origen ruso, se formó como ingeniero en París y emigró a Estados Unidos. Pero un fatal accidente en el laboratorio en el que trabajaba –en la Westinghouse Electric Company– le hizo perder las dos manos en 1907. Este desafortunado percance provocó que sus intereses giraran hacia las matemáticas, convirtiéndose en un prolífico científico con especiales contribuciones a la topología algebraica y sus aplicaciones a la geometría algebraica.

En el lugar de sus manos llevaba unas prótesis cubiertas con unos guantes negros que escondían unas piezas bien formadas, pero que no tenían ninguna otra función. A primera hora de la mañana, uno de sus estudiantes se encargaba de encajar un trozo de tiza en su mano y retirarla al final del día.

Uno de sus resultados más conocidos es el teorema del punto fijo de Lefschetz (1926) que estudia los puntos fijos de un espacio topológico compacto en sí mismo usando técnicas de homología. En [1] se cuenta una anécdota sucedida en 1966 durante una mesa redonda que tuvo lugar tras una exposición por parte de Lefschetz de su famoso teorema. Alguien del público le recordó que, en los años 1940, habían coincidido en un tren y le preguntó por la diferencia entre el álgebra y la topología. Según esa persona, Lefschetz le había contestado: ‘Si solo se trata de girar la manivela, es álgebra; pero si hay una idea presente, entonces es topología’… el matemático, incómodo y sorprendido, se defendió afirmando que él no podría haber dicho nunca esas palabras.

Sin embargo, parece que Lefschetz tenía mucha seguridad en sí mismo y era bastante ‘temido’ por sus estudiantes y colegas. Prueba de ello es esta cantinela, un tanto cruel, que le dedicaba el alumnado de Princeton:

Here’s to Lefschetz, Solomon L.

Irrepressible as hell

When he’s at last beneath the sod

He’ll then begin to heckle God.

(Aquí está Lefschetz, Solomon L.

Incontrolable como el infierno

Cuando al fin esté bajo el césped

Entonces comenzará a molestar a Dios.)

A pesar de ese ‘miedo’ que provocaba entre algunos, fue un matemático sobresaliente, que dejó un importante legado científico y formó a un buen número de matemáticos. En particular, contribuyó a crear una potente escuela matemática en México, y por ello, el gobierno de este país le condecoró con la orden del Águila Azteca.

Krantz lo describe como ‘uno de esos matemáticos […] que podía dormir durante una conferencia y despertar al final con una pregunta brillante…’

Referencias

[1] Steven G. Krantz, Mathematical anecdotes, Math. Intelligencer 12 (4) (1990), 32-38

[2] Solomon Lefschetz, Fixed Points, Parts 1 and 2, Mathematical Association of America Lecture Films, 1966

[3] J J O’Connor and E F Robertson, Solomon Lefschetz, MacTutor History of Mathematics archive, University of St Andrews

[4] Solomon Lefschetz, Reminiscences of a mathematical immigrant in the United States, American Mathematical Monthly 77 (1970) 344-350

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo Solomon Lefschetz, matemático ‘por accidente’ se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Ilustraciones artísticas de un matemático

- Un convite matemático ‘de altura’

- Pierre Fatou, un matemático poco (re)conocido

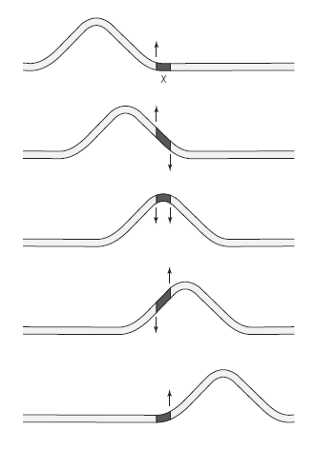

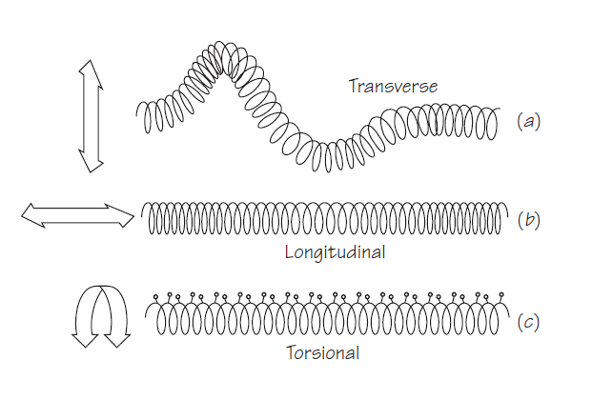

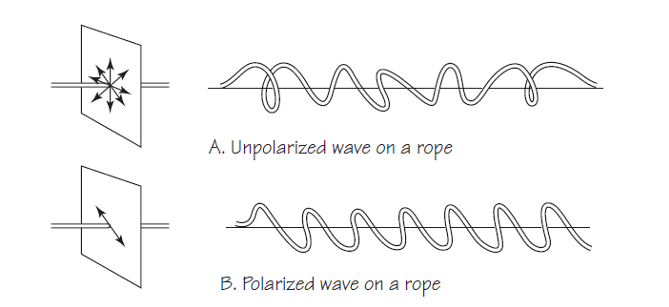

Propagación de una onda

El estudio de las ondas y su comportamiento puede que sea más intuitivo si pensamos en grandes modelos mecánicos y en ondas muy simples no periódicas, como los pulsos. Consideremos, por ejemplo, un tren de carga con muchos vagones unidos a una locomotora pero parado. Si la locomotora arranca bruscamente, su tracción sobre el el primer vagón envía una onda de desplazamiento que corre por la línea de vagones.

La perturbación del desplazamiento inicial procede de la locomotora que va haciendo chasquear los acoplamientos uno por uno. En este ejemplo, la locomotora es la fuente de la perturbación, mientras que los vagones de carga y sus acoplamientos son el medio. El “golpe” que viaja a lo largo de la línea de vagones es la onda. La perturbación se desplaza desde un extremo al otro del tren y con ella va la energía del desplazamiento y del movimiento. Sin embargo, ninguna partícula de materia se desplaza con la onda; cada vagón se mueve solo un poco hacia delante.

¿Cuánto tiempo tarda el efecto de la perturbación creada en un punto en llegar a un punto distante? El intervalo de tiempo depende, por supuesto, de la velocidad con la que se propaga la perturbación. Esta velocidad, a su vez, depende del tipo de onda y las características del medio. En cualquier caso, el efecto de una perturbación nunca se transmite instantáneamente. Cada componente del medio tiene inercia y cada parte del medio es compresible. Por lo tanto, se necesita tiempo para transferir energía de una parte a otra. Esto mismo aplica igualmente a las ondas transversales.

La serie de imágenes siguiente representa una onda, un pulso, en una cuerda. Pensemos en cada imagen como un fotograma de una película cinematográfica, y que daca una se ha tomado a intervalos de tiempo iguales. Ya sabemos que el material de la cuerda no viaja junto con la onda. Pero cada parte de la cuerda pasa se mueve hacia arriba y hacia abajo cuando la onda pasa. Cada trozo sufre exactamente el mismo movimiento que el trozo a su izquierda, excepto que lo hace un poco más tarde.

Fijémonos en el pequeño trozo de cuerda señalado con una X en el primer “fotograma”. Cuando el pulso que viaja por la cuerda alcanza X lo que está ocurriendo es que el trozo de cuerda justo a la izquierda de X ejerce una fuerza hacia arriba en X. Cuando X se mueve hacia arriba, el siguiente trozo ejerce una fuerza restauradora (una fuerza hacia abajo). Cuanto más se mueva X hacia arriba, mayores serán las fuerzas restauradoras. Llega un momento en que X deja de moverse hacia arriba y comienza a bajar de nuevo. La sección de la cuerda a la izquierda de X ahora ejerce una fuerza restauradora (hacia abajo), mientras que la sección de la derecha ejerce una fuerza hacia arriba. Por lo tanto, el movimiento hacia abajo es similar, pero opuesto, al movimiento hacia arriba. Finalmente, X regresa a la posición de equilibrio cuando ambas fuerzas han desaparecido.

El tiempo requerido para que X suba y baje, es decir, el tiempo requerido para que el pulso pase por esa parte de la cuerda, depende de dos factores. Estos factores son la magnitud de las fuerzas en X y la masa de X. Dicho de otra manera y en términos más generales: la velocidad con que se propaga una onda depende de la rigidez y de la densidad del medio. Cuanto más rígido sea el medio, mayor será la fuerza que cada sección ejerce sobre las secciones vecinas y, por tanto, mayor será la velocidad de propagación. Por otro lado, cuanto mayor sea la densidad del medio, menos responderá a las fuerzas* y, por tanto, más lenta será la propagación.

De hecho, la velocidad de propagación depende de la relación entre el factor de rigidez y el factor de densidad. El significado exacto “factor de rigidez” y “factor de densidad” es diferente para cada tipo de onda y para diferentes medios. Por ejemplo, para cuerdas tensas el factor de rigidez es la tensión T en la cuerda, y el factor de densidad es la masa por unidad de longitud, m / l, y la velocidad de propagación v viene dada por v = [T / (m / l)]½

Nota:

*Recordemos que F = m · a, es decir, para una fuerza constante, a mayor masa menor aceleración, que es el efecto que tiene una fuerza que actúa sobre una masa.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Propagación de una onda se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Las ondas están por todas partes

- Incompletitud y medida en física cuántica (VI): la onda piloto

- Tipos de ondas

Tamaño corporal y función renal de aves y mamíferos

Foto: Braden Tucker / flickr

Foto: Braden Tucker / flickrLos riñones de un ave o un mamífero de 1 kg no representan más de un 1% de su masa total. Por otro lado, la relación que mantienen la masa de los riñones con la del organismo es, como la de otros órganos, alométrica. Quiere esto decir que conforme aumenta el tamaño de un animal, también aumenta el de sus riñones, pero en diferente medida.

La masa de los riñones (Mrenal: g) de los mamíferos y de las aves depende de la masa corporal total (Mtotal: kg) de acuerdo con las siguientes ecuaciones:

Mrenal = 7.32 Mtotal0.85 (mamíferos) y

Mrenal = 8.68 Mtotal0.91 (aves).

Por otro lado, si se distingue dentro de las aves entre las que poseen glándulas de sal1 y las que no, las ecuaciones correspondientes son las siguientes:

Mrenal = 7,30 Mtotal0,93 (aves sin glándulas de sal) y

Mrenal = 11,27 Mtotal0,88 (aves con glándulas de sal).

De acuerdo con las expresiones anteriores, para un animal de 1 kg, la masa renal es ligeramente superior en el conjunto de las aves (8,7 g) que en los mamíferos (7,3 g), aunque es mayor el de aves con glándulas de sal (11,3 g) que el de las que carecen de tales órganos (7,3 g). Este hecho resulta paradójico, puesto que cabría pensar que al disponer de dispositivos adicionales para la regulación del balance osmótico (las glándulas de sal), los riñones podrían ser de menor tamaño, puesto que parte del trabajo ya lo hacen las glándulas. Sin embargo, la mayor parte de las aves con glándulas de sal son marinas, por lo que han de soportar mayores niveles de estrés osmótico. En otras palabras: la misma razón por la que han recurrido a dispositivos específicos para eliminar las sales sobrantes es probablemente la que ha conducido a dotarse de riñones de mayor tamaño relativo. En otras palabras, las aves marinas han de hacer un mayor trabajo osmótico, trabajo que se reparte entre las glándulas salinas y unos riñones de mayores dimensiones.

En lo relativo a la dependencia del tamaño renal con respecto al tamaño corporal, hay que fijarse en los valores de las potencias (o exponentes) de las correspondientes ecuaciones. Esos valores son algo superiores al valor esperable teniendo en cuenta que el metabolismo y la masa se relacionan de acuerdo con una ecuación cuya potencia vale 0,75. Para valorar correctamente el significado de los valores anteriores (0,93 y 0,88) conviene tener presente cuáles son las correspondientes relaciones de dependencia entre las funciones renales relevantes y el tamaño corporal.

La tasa de filtración glomerular (Vf.g.: ml min-1) depende del tamaño del organismo (Mtotal: kg) de acuerdo con las siguientes ecuaciones:

Vf.g. = 2,00 Mtotal0,73 (aves) y

Vf.g. = 5,36 Mtotal0,72 (mamíferos).

La tasa de filtración glomerular de un mamífero es, por lo tanto, aproximadamente el doble que la de un ave del mismo tamaño. Esa diferencia es consecuencia de la diferente forma en que aves y mamíferos producen orina. Las aves eliminan sus restos nitrogenados en forma de ácido úrico que, al ser virtualmente insoluble en las condiciones de la cloaca aviar, ejerce un efecto osmótico mínimo en la orina final; mientras que los mamíferos eliminan urea, lo que obliga a concentrar mucho la orina para evitar una pérdida excesiva de agua. Por lo anterior, las aves filtran un menor volumen de plasma y, de hecho, en caso de necesitar limitar la pérdida de agua, pueden reducir mucho y llegar a suprimir la filtración en los glomérulos de las nefronas que, como vimos aquí, carecen de asa de Henle y, por lo tanto, son incapaces de concentrar la orina. Como consecuencia de lo anterior, las aves, a pesar de tener tasas de filtración glomerular muy inferiores a las de los mamíferos, pueden eliminar la misma cantidad de restos nitrogenados que aquellos.

En todo caso, y al margen de las diferencias entre aves y mamíferos en lo que se refiere a los niveles absolutos de filtración glomerular, su dependencia con respecto al tamaño corporal viene expresada mediante una función alométrica en la que la potencia se aproxima mucho al valor de 0,75. Cabe, por tanto, atribuir esa dependencia al efecto del tamaño sobre el metabolismo global.

Y algo parecido cabe decir acerca de la tasa de producción de orina Vo (ml min-1), cuya dependencia con respecto a la masa corporal (Mtotal: kg) es la que, para los mamíferos, expresa la siguiente expresión:

Vo = 0,042 Mtotal0,75.

Por lo tanto, las tasas relevantes (de filtración glomerular y de producción de orina) se relacionan con el tamaño corporal de la misma forma que lo hace el metabolismo. Cabe concluir, por ello, que es la actividad metabólica, con su correspondiente generación de residuos nitrogenados, la que determina el modo en que el tamaño afecta al nivel de actividad renal. El hecho de que la masa renal dependa de la masa total a través de una potencia de valor algo superior a 0,75 es, muy probablemente, consecuencia de factores diferentes, más relacionados con la arquitectura de los riñones, los tejidos de soporte en los que se encuentran embebidas las nefronas con sus glomérulos y la forma en que todos esos elementos se empaquetan en los riñones.

Fuente:

William A. Calder III (1996): Size, Function, and Life History. Dover Publications Inc, Mineola, New York.

Nota:

1 Las glándulas de sal son glándulas tubulares que expulsan sales para evitar que se acumulen en los fluidos corporales.

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo Tamaño corporal y función renal de aves y mamíferos se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La función del asa de Henle en el riñón de mamíferos

- La función respiratoria depende del tamaño de los animales

- La función renal en vertebrados

Carne bovina

“Las vacas domésticas ciertamente descienden de más de una forma salvaje… Los naturalistas generalmente han hecho dos principales divisiones del ganado vacuno: las clases jorobadas habitan los países tropicales, que en la India se llaman cebús, a los que se ha dado el nombre específico Bos indicus; y el ganado vacuno común no jorobado, generalmente incluidos bajo el nombre de Bos taurus.”

Charles Darwin, “La variación en los animales y las plantas domesticadas”, 1868.

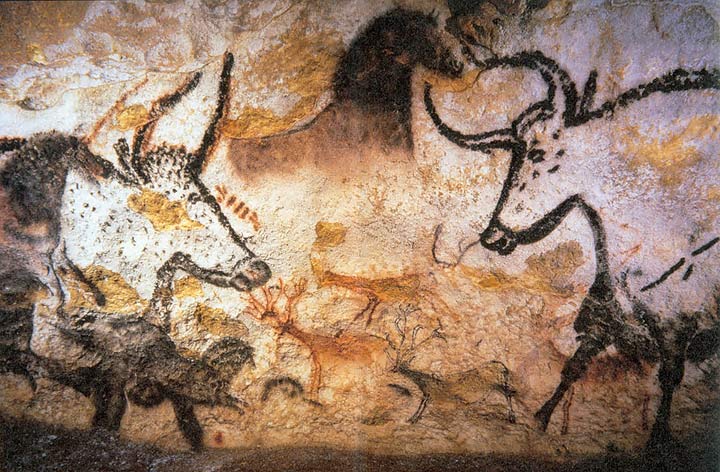

Uros (Bos primigenius) representados en la cueva de Lascaux (Francia)

Uros (Bos primigenius) representados en la cueva de Lascaux (Francia)Vacas, toros, terneras, bueyes,… y chuletones, todos y todas de la familia Bovidae, género Bos. De las siete especies domesticadas de este género hay dos que destacan: Bos taurus y Bos indicus. Ambas descienden del Bos primigenius, el ancestral y mítico uro cuyo último ejemplar del que tenemos constancia fue cazado en Polonia en 1627 y que tenía una distribución amplia por Eurasia, de este a oeste y del sur de la taiga al norte de los desiertos y del bosque tropical. Bos taurus es el ganado bovino europeo llevado a otros continentes y desde el Creciente Fértil en el Oriente Próximo y, quizá, con un proceso de domesticación independiente en África. Bos indicus es el cebú, el ganado bovino con joroba, que viene del sur de Asia, en concreto, del valle del Indo, hoy Pakistán, y se extendió por la India y, hace unos 3000 años, fue introducido en África.

Toro retinto (Bos taurus). Fuente: MAPA

Toro retinto (Bos taurus). Fuente: MAPASon de los animales más importantes del planeta para la especie humana. Contribuyen con su potencia de tiro, carne, leche, pieles y estiércol. Además, al ser rumiantes, con su especial proceso digestivo, convierten la indigerible, para los humanos, celulosa de las plantas en productos asimilables como hidratos de carbono, grasa y proteínas En Mesopotamia, Egipto y el valle del Indo, el ganado bovino era esencial como fuerza de tiro para cultivar los terrenos regados del desierto y las regiones semiáridas. Criar el ganado suponía tiempo y esfuerzo pues necesitaba agua y forraje, que también había que cuidar o cultivar. Entonces era más importante como fuerza de tiro que como alimento. Durante la dinastía de Ur, en Mesopotamia, hace unos 4000 años, solo suponía el 10% de la carne de la alimentación.

Cebú (Bos indicus). Fuente: Wikimedia Commons

Cebú (Bos indicus). Fuente: Wikimedia CommonsPara hacernos una idea de la importancia de los bovinos en la alimentación podemos citar que, en 2011, el censo mundial de bovinos era de 1347 millones de cabezas. De Brasil eran 175 millones, en la India se contaban 174 millones, en Estados Unidos llegaban a los 96 millones, en la Unión Europea 90 millones, y en China 82 millones y creciendo. La producción de carne de vacuno se repartía entre Estados Unidos con el 19.6%, Brasil con el 14.4%, la Unión Europea con el 12.8% y China con el 9.3%. España ocupaba el quinto lugar dentro de la Unión Europea, con un aumento del 40% en la primera década del siglo XXI. En aquel año, 2011, se consumieron 300 millones de kilogramos de carne de bovino en España, con el 75% de ternera. Donde más carne se consume es Castilla y León y donde menos en Extremadura.

Hamburguesa neoyorkina. Fuente: Wikimedia Commons

Hamburguesa neoyorkina. Fuente: Wikimedia CommonsEn la actualidad y en todo el planeta una de las formas más consumidas de la carne de bovino es la hamburguesa. En Estados Unidos llega al 40% del total de carne para la alimentación humana. Es un icono de la cultura popular aunque tiene su origen en Hamburgo, Alemania. Carne “de Hamburgo” ya aparecía en la carta del restaurante Delmonico de Nueva York en 1836. En la Feria Mundial de St. Louis de 1904 se hicieron populares. Allí las preparaban y vendían inmigrantes alemanes.

Las hamburguesas son una consecuencia de la eficiencia típica de Estados Unidos. Se pueden cocinar en menos de ocho minutos y, en los restaurantes se preparan a pedido del cliente. Estos locales aparecen en la década de los veinte del siglo pasado y, años después, las grandes franquicias de la hamburguesa la han llevado a todo el planeta. Así comunican los valores del “American way of life” y, en concreto, de su dieta: eficiencia, servicio y limpieza. Sin embargo, para algunos críticos demuestran la escasa imaginación de la gastronomía de Estados Unidos.

Toros de lidia en la dehesa de Salamanca (España). Hay quien afirma que el toro de lidia sería lo más parecido actualmente al uro primigenio.

Toros de lidia en la dehesa de Salamanca (España). Hay quien afirma que el toro de lidia sería lo más parecido actualmente al uro primigenio.El proceso de domesticación del ganado bovino comenzó hace unos 11000 años, aunque las pruebas directas del proceso que por ahora conocemos tienen fechas más cercanas, como unos 9000 años. En Catal Huyuk, en la actual Turquía, las excavaciones han demostrado el paso de uros, hace 8400 años, a ganado bovino, hace 7800 años. El ganado bovino supone del 20% al 25% de los huesos encontrados hace 8400 años, y se han identificado como de uro. También es bovino domesticado de fechas tempranas el que se ha encontrado en Grecia, en concreto, en Argissa, fechado hace 8500 años, y en Franchthi, hace 7000 años. El estudio genético de Ruth Bollongino y su grupo, del Museo Nacional de Historia Natural de Paris, con 15 muestras de 1500 a 8000 años de Irán, más 26 muestras de bovinos actuales de Turquía e Irak, permite a los autores sugerir que la primera población de bovinos domesticados tenía 80 hembras que, a pesar de ser un número pequeño, es el origen del Bos taurus actual.

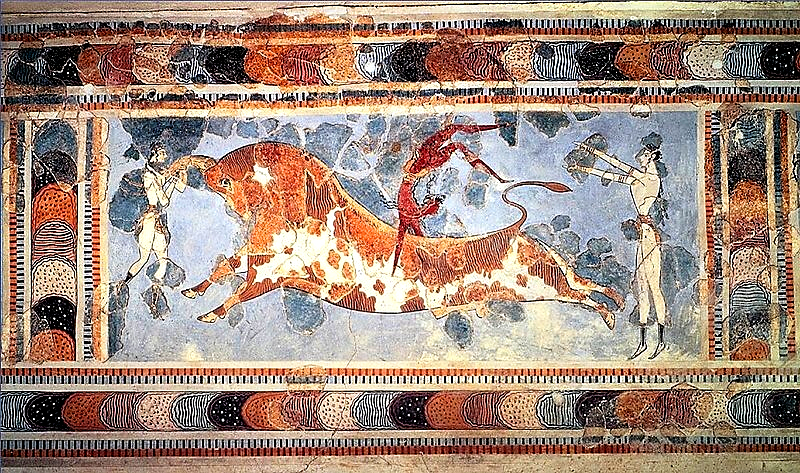

Fresco del salto del toro, que muestra a un acróbata sobre un toro con dos mujeres acróbatas a los lados. Palacio de Cnosos (Creta). Aproximadamente del 1450 a.e.c.

Fresco del salto del toro, que muestra a un acróbata sobre un toro con dos mujeres acróbatas a los lados. Palacio de Cnosos (Creta). Aproximadamente del 1450 a.e.c.Sin embargo, hay hallazgos en Chipre que plantean que hay que ajustar las fechas de la domesticación de animales. El uro no existía en la isla pero hay restos de bovinos de hace algo más de 10000 años. Esos bovinos solo pudieron llegar a Chipre si fueron transportados por nuestra especie y, se puede suponer, que o estaban domesticados o en proceso de domesticación.

Parece que la domesticación de los bovinos fue posterior a la de los cereales, las cabras y las ovejas. Además de las mencionadas domesticaciones del cebú y del bovino europeo en el valle del Indo y en el Creciente Fértil, parece que hubo otros procesos locales cuando era necesario y posible y en fechas diferentes. Por ejemplo, el poeta Virgilio cuenta que en la Roma imperial una virulenta enfermedad acabó con el ganado y los campesinos capturaron y domesticaron uros para reemplazarlo. Datos genéticos actuales indican que hubo cruces entre bovino domesticado y uros en las Islas Británicas y en la Península Ibérica.

Los estudios genéticos del bovino europeo y del cebú implican, por lo menos, a dos grupos distintos del uro en su origen y dos procesos de domesticación diferentes. Para el Bos taurus se han listado 480 razas de bovino en Europa y todas mantienen una continuidad genética con las razas seleccionadas en el Creciente Fértil. Los agricultores y ganaderos ancestrales se movieron en Europa desde el sudeste, el Creciente Fértil, hacia el noroeste, las Islas Británicas y Escandinavia, llevaban con ellos su ganado que se cruzó, no muy a menudo, con los uros salvajes de Europa. El ganado bovino se extendió por Europa a la vez que el arado de madera, esencial para el cultivo. Así aumentó el suelo dedicado a la agricultura. Además, para el uso del bovino como fuerza de tiro fue importante la castración de los machos y la aparición de los bueyes, fuertes, constantes, dóciles y manejables. Eran perfectos para acarrear y para el manejo del arado. Se han encontrado huesos de bueyes en yacimientos de hace 6000 años y, también, fragmentos de cerámica con figuras de bueyes y arados de hace 5000 años en Tsouginza, en Grecia.

En un estudio detallado de ADN del Bos taurus en Europa, Amelie Scheu y sus colegas, de la Universidad Johannes Gutenberg de Mainz, en Alemania, confirman que el bovino domesticado llegó desde Turquía e Irán hace 7000-8000 años y, como ocurre en los procesos de domesticación, la variabilidad genética disminuye con el aumento de la distancia al centro de origen de la especie domesticada. Cuanto más lejos, en Europa, del Creciente Fértil asiático, menos diversidad genética en los bovinos domesticados.

Viajemos a Inglaterra, al Condado de Wiltshire, a un lugar llamado Stonehenge, al conocido monumento megalítico con su extraordinario círculo de piedras. Cerca, a un par de kilómetros se ha descubierto y excavado un poblado, en un lugar llamado Durrington Walls, de hace unos 4000-5000 años. El grupo de Oliver Craig, de la Universidad de York, estudió el poblado y propuso que allí vivían los que construyeron y utilizaron el santuario de Stonehenge.

En las excavaciones encontraron gran cantidad de fragmentos de cerámica y muchos huesos de animales. Analizaron los lípidos adheridos a la cerámica y concluyeron que en esas vasijas se había cocinado carne de cerdo, hasta en un 80% del total de carne, y un 8% de bovino, todo ello en fiestas y banquetes al aire libre, con asados, y en interiores, por cocimiento. Por tanto, hace 5000 años se preparaba el estofado de buey, o de ternera o, quizá, de toro o , incluso, de uro. En la actualidad, en el Condado de Wiltshire todavía se cocina un estofado de bovino, que, quién sabe, quizá tiene reminiscencias de lo que comían los que construyeron Stonehenge.

Así es la receta del estofado de buey al estilo del Condado de Wiltshire:

“Picar una cebolla y dos tallos de apio y freírlos en aceite de colza, aunque por hacerlo más mediterráneo prefiero el aceite de oliva. Lo hacemos a fuego suave por unos cinco minutos. Añadimos un par de zanahorias en trozos, laurel y tomillo y dejamos otros dos minutos. Ahora juntamos tomate frito y salsa Worcestershire, que luego explicaré cómo hacer, y medio litro de agua hirviendo. Mezclamos y lo ponemos en una cazuela a cocer. Añadimos caldo de carne o un par de pastillas de caldo de carne. Sazonamos con pimienta.

En una sartén, freímos en aceite de oliva la carne, algo así como un kilo de falda, que hemos cortado antes en trozos. Cuando esté dorada echamos todo, con el aceite incluido, en la cazuela.

Dejamos cocer, a fuego suave, de ocho a diez horas, y, después, con fuego más fuerte, otras cuatro horas. Se aconseja que el estofado hay que prepararlo de un día para otro, que mejora mucho. Creo que con estos tiempos de cocimiento es inevitable, hay que cocinarlo el día anterior (al festejo, dirían en Durrington Walls).

Para la salsa Worcestershire, o se compra o se hace. Se junta vinagre de manzana, sala de soja, azúcar moreno, jengibre molido, mostaza, cebolla machacada, ajo en polvo, canela y pimienta negra. Mezclamos muy bien, hervimos revolviendo sin parar, cocinamos como un minuto a fuego suave y a la nevera.”

Es evidente que algunos de los ingredientes que he incluido en la receta todavía no habían llegado a Durrington Walls hace 5000 años pero, creo, nos podemos permitir la licencia.

En nuestro entorno más cercano, el ganado bovino aparece en el final del Neolítico y en la Edad del Bronce o Calcolítico, hace unos 5000 años, según Jesús Altuna, y en toda la cornisa cantábrica hay hallazgos de hace 6500 años. Anteriormente solo se encuentran fósiles de uro. Por ejemplo, se encontró un esqueleto casi completo de uro en el yacimiento de Sima Las Grajas, en la Sierra de Guibijo, en Álava, cerca del nacimiento del río Nervión. Se dató de hace algo más de 7000 años. Altuna menciona que hay una gran escasez de datos sobre el uro en toda esta zona. Relata, sin embargo, que en el siglo IV, hace 1600 años, el escritor romano Servio Gramático citó que había uros en el Pirineo.

En la época romana, el bovino era un importante proveedor de carne. También aparecen huesos de bovino en los yacimientos celtíberos y en las escasas excavaciones en el País Vasco de la época medieval que han estudiado los restos animales encontrados. Como ejemplo sirve la excavación del yacimiento de El Castillo, en Astúlez, Álava, con presencia de bovino desde el final de la Edad del Bronce hasta el siglo XIII. Y del siglo XI al XVIII se han estudiado los restos de ganado bovino en las ciudades del País Vasco. El ganado bovino es un componente importante de la dieta, sobre todo en Bilbao, seguida de Orduña y Vitoria. En Orduña han aparecido huesos grandes rotos en sentido longitudinal para la extracción del tuétano. Pero cambia el tamaño del bovino que se cría durante estos siglos. Hay una disminución después de la época romana en los siglos VIII y IX, y un aumento posterior hasta la actualidad.

Más o menos por esos años, hacia el siglo IX, los árabes trajeron a Al-Andalus la receta de un adobo de carne de bovino con fuerte influencia persa e hindú que, creo, merece la pena probar. Benavides Barajas nos lo cuenta así:

“Se corta la carne para guisar en trozos cuadrados y se limpia de grasas. La mezclamos con cebolla picada, dientes de ajo machacados, clavo, nuez moscada, jengibre, perejil, cardamomo en polvo, canela, azafrán, cúrcuma, sal, pimienta y vinagre, y todo en abundancia. Y aceite de oliva.

Se cubre con vinagre y se deja a la fresca, o en la nevera, por dos días. Después de pone en la cazuela a fuego suave. A las dos horas ya está cocinada y se añade tomate en salsa y agua con mostaza. Se calienta un poco y se retira del fuego.

La podemos guardar en la nevera un día y calentar para comer con arroz cocido y suelto y pasas. Si gusta, se puede añadir guindilla. Al recalentar, controlar que no se seque y añadir agua si es necesario.”

El estudio de Albano Beja Pereira y su grupo, de la Universidad de Oporto, con 27 colaboradores de otras 25 instituciones, analiza el ADN mitocondrial de cinco ejemplares de uro de Italia y lo compara con el ADN de más de 1000 ejemplares actuales de 51 razas de toda Europa. En el centro, norte y noroeste de Europa, casi todos los ADNs analizados son cercanos a uno de los tipos del Creciente Fértil, el llamado T3. En el norte de África, quizá desde Egipto, aparece otro grupo de ADN, el T1, que también se encuentra en las razas de los países ribereños del Mediterráneo. En la Península y en la muestra más cercana a nuestro entorno, casi todo el ADN viene del norte de África. Hay hallazgos recientes en Argelia y en el Sáhara oriental de un posible episodio de domesticación fechado hace 5000 años, y en el valle de Nilo desde hace 9500 años.

En África, los estudios genéticos recientes parece que indican dos grupos de bovinos con diferente origen. Hay un grupo con dotación genética como la de los bovinos del Creciente Fértil en el norte y noroeste, y otro grupo con similitud al cebú de Asia, quizá por paso a través del Índico y de la Península Arábica. Como aseguran Diane Gifford-Gonzalez y Olivier Hanotte, de las universidades de California en Santa Cruz y de Nottingham, una domesticación independiente de bovinos en África no está ni demostrada ni rechazada.

Para terminar una receta para cocinar carne de bovino, aunque sea una parte del animal que no se utiliza habitualmente. La he tomado de la Cocina para pobres, del Dr. Juderías, y es una receta autógrafa de la cocinera.

“Lávese y téngase en agua fría la ubre unas dos horas para que se limpie bien; póngase después un cuarto de hora en agua hirviendo y luego se deja enfriar, se saca, se corta y después se cuece y se guisa como los callos.”

Referencias:

Altuna, J. 1980. Historia de la domesticación animal en el País Vasco, desde sus orígenes hasta la romanización. Munibe 32: 1-163.

Beja-Pereira, A. et al. 2006. The origin of European cattle: Evidence from modern and ancient DNA. Proceedings of the National Academy of Sciences USA 103: 8113-8118.

Benavides Barajas, L. 1995. Nueva clásica cocina andalusí. Ed. Dulcinea. Granada. 328 pp.

Bollongino, R. et al. 2012. Modern taurine cattle descended from small number of Near-Eastern founders. Molecular Biology and Evolution 29: 2101-2104.

Castaños Ugarte, P.M. 1997. El pastoreo y la ganadería durante la romanización en el País Vasco. Isturitz 9: 659-668.

Craig, O.E. et al. 2015. Feeding Stonehenge: cuisine and consumption at the Late Neolithic of Durrington Walls. Antiquity 89: 1096-1109.

Gade, D.W. 2000. Cattle. En “The Cambridge World History of Food, vol. 1”, p. 489-496. Ed. por K.F. Kiple & K.C. Ornerlas. Cambridge University Press. Cambridge.

Gifford-Gonzalez, D. & O. Hanotte. 2011. Domesticating animals in Africa: Implications of genetic and archaeological findings. Journal of World Prehistory 24: 1-23.

Grau Sologestoa, I. 2015. Livestock management in Spain from Roman to post-medieval times: a biometrical analysis of cattle, sheep/goat and pig. Journal of Archaeological Science 54: 123-134.

Grau Sologestoa, I. 2016. Urban medieval and post-medieval zooarchaeology in the Basque Country: Meat supply and consumption. Quaternary International 399: 1-12.

Grau Sologestoa, I. 2017. Estudio de los materiales faunísticos del yacimiento de El Castillo (Astúlez, Valdegobía, Álava). Estudios de Arqueología Alavesa 27: 334-345.

Gupta, A.K. 2004. Origin of agricultura and domestication of plants and animals linked to early Holocene climate amelioration. Current Science 87: 54-59.

Juderías, A. 1994. Cocina para pobres. 11ª Ed. Ed. SETECO. Madrid.

Larson, G. & D.Q. Fuller. 2014. The evolution of animal domestication. Annual Review of Ecology, Evolution, and Systematics 45: 115-136.

Martín Cerdeño, V.J. 2011. Consumo de carne de vacuno en España. Distribución y Consumo Marzo-Abril: 95-98.

Orlando, L. 2015. The first aurochs genome reveals the breeding history of British and European cattle. Genome Biology 16: 225.

Park, S.D.E. et al. 2015. Genome sequencing of the extinct Eurasian wild aurochs, Bos primigenius, illuminates the phylogeography and evolution of cattle. Genome Biology 16: 234.

Russell, N. et al. 2005. Cattle domestication at Catalhoyuk revisited. Current Anthropology 46, Suppl.: S101-S108.

Scheu, A. et al. 2015. The genetic prehistory of domesticated cattle from their origin to the spread across Europe. BMC Genetics 16: 54.

Upadhyay, M.R. et al. 2017. Genetic origin, admixture and population history of aurochs (Bos primigenius) and primitive European cattle. Heredity 118: 169-176.

Vigne, J.-D. et al. 2011. The early process of mammal domestication in the Near East. New evidence from the Pre-Neolithic and pre-pottery Neolithic Cyprus. Current Anthropology 52, Suppl. 4: S255-S271.

Sobre el autor: Eduardo Angulo es doctor en biología, profesor de biología celular de la UPV/EHU retirado y divulgador científico. Ha publicado varios libros y es autor de La biología estupenda.

El artículo Carne bovina se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Ingredientes para la receta: el ajo

- Ingredientes para la receta: El conejo

- Ingredientes para la receta: El kiwi

Ciencia, arte y cultura callejera: física y música

La cultura se ha asociado históricamente con la actividad propiamente humana y en definitiva, con todas aquellas acciones que dan un sentido a la existencia del ser humano. En este sentido, todo lo que generamos para conocer el mundo, superarnos, deleitarnos o ensimismarnos, lo podemos definir como cultura.

Un término que abarca múltiples disciplinas y en el que el ser humano, en su afán por clasificar las diferentes formas de conocimiento y tratar de establecer una escala de relevancia, ha establecido una serie de fronteras delimitadoras. De la definición de estos límites surge el estereotipo de las dos culturas, las ciencias y las artes, así como la diferenciación entre las denominadas alta y baja cultura. Pero, ¿son realmente necesarias y útiles estas fronteras?

Con el objetivo de abordar este debate y mostrar una visión alternativa donde el arte y la ciencia se entrelazan, la Biblioteca Bidebarrieta de Bilbao acogió los pasados días 29 de mayo y 13 de junio el ciclo de conferencias “Ciencia, Arte y Cultura Callejera”.

El evento se enmarca dentro del ciclo “Bidebarrieta Científica”, una iniciativa que organiza todos los meses la Cátedra de Cultura Científica de la UPV/EHU y la Biblioteca Bidebarrieta para divulgar asuntos científicos de actualidad.

La primera jornada del ciclo de conferencias abordó el tema física y música desde un punto de vista multidisciplinar con la participación de los compositores Jaime Altozano y Sharif Fernández y la física y pianista Almudena Martín Castro. Se abordan las relaciones que existen hoy en día entre la física y la música, los aspectos elementales de la música, así como la relación entre el rap, la música y la poesía para abordar la brecha entre la alta y baja cultura.

Edición realizada por César Tomé López.

El artículo Ciencia, arte y cultura callejera: física y música se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Arte & Ciencia: Analogías entre el arte y la ciencia como formas de conocimiento

- Arte & Ciencia: Sobre la dimensión cognitiva del arte en relación a la ciencia

- Arte & Ciencia: La importancia de la ciencia para la conservación del arte

Los neandertales respiraban de otra manera

Un grupo de investigación liderado por Asier Gómez-Olivencia, Investigador Ikerbasque en la UPV/EHU y por la Dra. Ella Been, del Ono Academic College de Tel Aviv ha llevado a cabo la primera reconstrucción virtual de un tórax fósil completo del individuo neandertal llamado Kebara 2. El estudio apoya la teoría de que la capacidad pulmonar de los neandertales era mayor y su columna vertebral más estable que la de los humanos modernos.

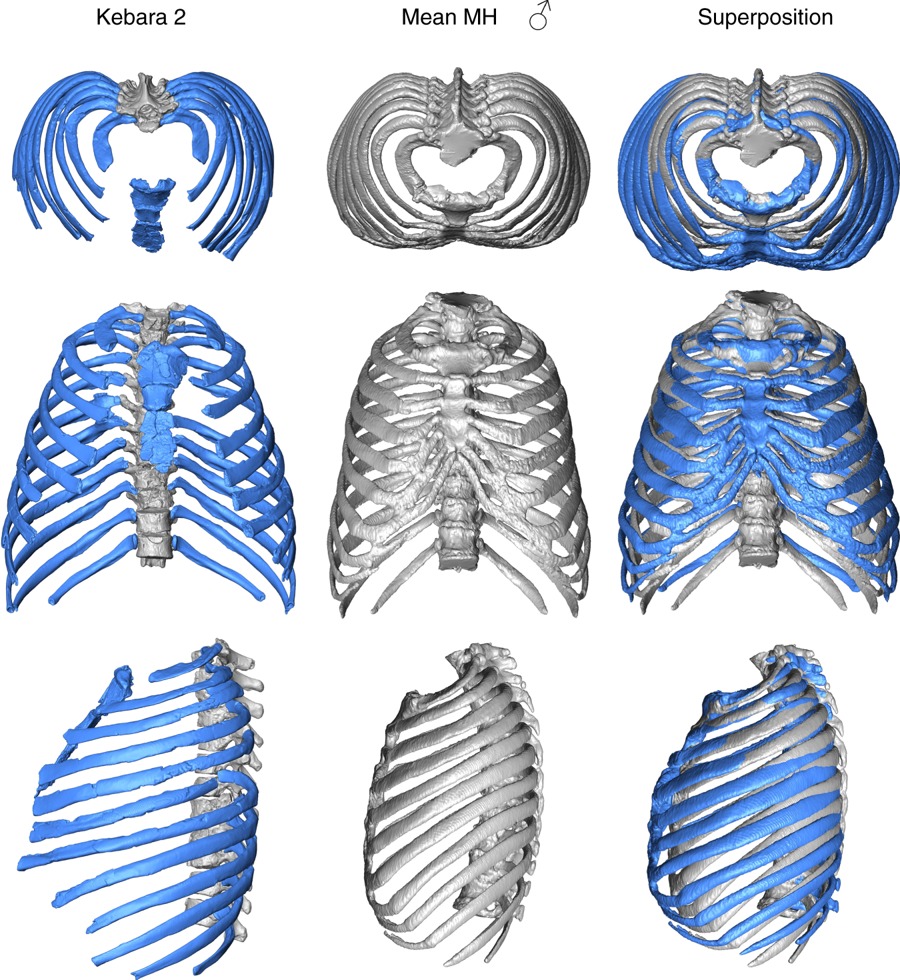

Comparación del tórax de Kebara 2 (azul) con el tórax promedio de un humano moderno masculino (gris). Fuente: Gómez-Olivencia et al (2018)

Comparación del tórax de Kebara 2 (azul) con el tórax promedio de un humano moderno masculino (gris). Fuente: Gómez-Olivencia et al (2018)La columna vertebral de los neandertales era más estable que la de los humanos modernos. Asimismo, tenían las costillas inferiores orientadas de manera más horizontal lo que hace suponer a los investigadores que su respiración dependía en mayor medida del diafragma frente al caso de Homo sapiens donde intervienen tanto el diafragma como la caja torácica. Para llegar a estas conclusiones han trabajado con los restos fósiles del yacimiento de Kebara (Israel), en concreto con los restos fósiles del individuo Kebara 2.

Para crear un modelo virtual del tórax, los investigadores se basaron tanto en las observaciones directas del esqueleto de Kebara 2, guardado actualmente en la Universidad de Tel Aviv, así como en escáneres (tomografía axial computerizada) de las vértebras, costillas y huesos pélvicos. Una vez reunidos todos los elementos anatómicos la reconstrucción virtual se hizo por medio de un software 3D especificamente diseñado para este fin. “Éste fue un trabajo meticuloso”, dice Alon Barash de la Bar Ilan University en Israel, “tuvimos que escanear cada una de las vértebras y todos los fragmentos de costillas para después re-colocarlos virtualmente en 3D”.

“En el proceso de reconstrucción, fue necesario ‘cortar’ y volver a alinear de manera virtual algunos huesos que mostraban deformación, así como hacer imágenes especulares de las costillas mejor conservadas para sustituir aquellas peor conservadas del otro lado”, comenta Gómez-Olivencia.

“Las diferencias entre un tórax neandertal y un humano moderno son llamativas. En los neandertales la posición de columna vertebral respecto a las costillas indica una columna vertebral más estable. Además, el tórax es más ancho en su parte inferior”, comentan Daniel García Martínez y Markus Bastir, investigadores del Museo Nacional de Ciencias Naturales (MNCN-CSIC) co-autores del trabajo.

“Un tórax más ancho en su parte inferior y unas costillas orientadas de manera más horizontal, tal y como se puede ver en la reconstrucción, sugieren que la respiración de los neandertales dependía en mayor manera del diafragma”, comenta Been. “Nuestra especie depende tanto del diafragma como de la expansión de la caja torácica. En este estudio podemos ver cómo el uso de nuevas tecnologías y metodologías en el estudio de los restos fósiles proporcionan nueva información para entender especies extintas”, añade Mikel Arlegi (UPV/EHU-Universidad de Burdeos).

Estos nuevos resultados son coherentes con un reciente trabajo de dos de los co-autores, Bastir y García-Martínez, en el que apoyan la presencia de una mayor capacidad pulmonar para los neandertales.

Patricia Kramer de la Universidad de Washington resume: “Esta es la culminación de 15 años de investigación en el tórax neandertal, y esperamos que futuros análisis genéticos nos den pistas adicionales sobre su fisiología respiratoria”.

Imagen: J. Trueba/Madrid Scientific Films

Imagen: J. Trueba/Madrid Scientific FilmsKebara 2

Los neandertales fueron cazadores-recolectores que habitaron Eurasia occidental durante más de 200 mil años, tanto durante periodos glaciares como interglaciares hasta que se extinguieron hace unos 40 mil años. Mientras que algunas de las regiones anatómicas de estos humanos extintos se conocen relativamente bien, otras como la columna vertebral y las costillas son menos conocidas porque estos elementos son más frágiles y no se conservan bien en el registro fósil.

En 1983, un esqueleto neandertal parcial (denominado oficialmente Kebara 2, y apodado Moisés) perteneciente a un individuo masculino joven que murió hace aproximadamente 60 mil años, fue descubierto en el yacimiento de Kebara (Monte Carmelo, Israel). Este esqueleto no conserva el cráneo, ya que tiempo después del enterramiento el cráneo fue retirado, probablemente como consecuencia de un ritual funerario. En cambio, preserva todas las vértebras y las costillas, así como otras regiones anatómicas frágiles como la pelvis o el hueso hioides (un hueso situado en el cuello donde se insertan algunos de los músculos de la lengua). Es por tanto el esqueleto que, hasta el momento, conserva el tórax más completo del registro fósil de los neandertales.

Durante más de 150 años se han recuperado restos neandertales en muchos lugares en Europa y Asia occidental (incluyendo Oriente medio), y la forma del tórax de esta especie humana ha sido objeto de debate desde 1856, cuando se encontraron las primeras costillas pertenecientes a este grupo humano. En la última década las reconstrucciones virtuales se han convertido en una nueva herramienta, cada vez más usada, en el estudio de los fósiles.

Esta metodología es especialmente útil con restos fósiles frágiles como las vértebras y costillas que conforman el tórax. Hace casi dos años, el mismo equipo de investigación presentó una reconstrucción de la columna vertebral de este mismo individuo, que indicaba la presencia de una columna con curvaturas menos acentuadas en estos humanos con respecto al Homo sapiens.

Referencia:

Asier Gómez-Olivencia, Alon Barash, Daniel García-Martínez, Mikel Arlegi, Patricia Kramer, Markus Bastir & Ella Been (2018) 3D virtual reconstruction of the Kebara 2 Neandertal thorax Nature Communications doi: 10.1038/s41467-018-06803-z

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Los neandertales respiraban de otra manera se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La cronología de la desaparición de los neandertales

- Neandertales ¿crónica de una muerte anunciada?, por María Martinón-Torres

- El aprendizaje del inglés es mejor si se usa para aprender otra cosa

Sin divulgación científica no hay democracia. Sin arte tampoco

El duelo. Christian García Bello, 2017

El duelo. Christian García Bello, 2017156x170x45 cm

Carbón, aceite sobre madera de pino, acero y hormigón

¿Por qué a la gente le fascina una escultura de bronce que parece una colchoneta hinchable? ¿O un enorme agujero en el suelo pintado de negro llamado Descenso al limbo? ¿Por qué resulta atractivo Jeff Koons o Anish Kapoor? Por el misterio.

Esto me lo dijo hace unos días mi hermano Christian cuando conversábamos sobre las implicaciones que tiene el cierre de uno de los museos de arte contemporáneo más importantes de Galicia, el MAC, de la Fundación Naturgy.

La noche en la que se inauguró la que será la última Mostra del museo se respiraba un ambiente de tristeza, pesimismo y enfado. La noticia del cierre del MAC era reciente. Estuve charlando con el comisario de arte y director de la Fundación DIDAC, David Barro. Me comentaba que uno de los problemas es que el arte contemporáneo había dejado de resultar interesante. Al menos antes la gente se indignaba con él. Ahora ni eso. No quieren que gastemos varios miles de euros en crear exposiciones. Quieren que ese dinero se emplee en algo útil, tan útil como puede ser un hospital, como puede ser la investigación científica. El salvavidas al que ha tocado aferrarse es precisamente la creación de alianzas con otras disciplinas. David se refería al diseño. Te alías con ingenieros industriales y puedes crear eventos y exposiciones a las que la gente acude con interés. Es una buena estrategia de divulgación. El diseño es esencialmente útil. Identificamos el diseño con el progreso.

Identificamos la ciencia con el progreso. Sea ciencia útil o inútil, la identificamos con el progreso. Nos rasgamos las vestiduras cuando hay una merma en el presupuesto destinado a ciencia. Sin ciencia no hay futuro y todo eso. Y es cierto que no lo hay, al menos no un futuro que nos ofrezca una mayor calidad de vida y una mayor calidad del conocimiento. Aunque siga habiendo quien pone el grito en el cielo con el gasto en exploración espacial, por ejemplo, a la mayoría nos resulta fascinante. Es por el misterio.

No solo nos fascina la ciencia por lo que tiene de misterioso. No todos los temas científicos sobre los que divulgar tienen un gancho tan goloso como el misterio y, sin embargo, generan un gran interés.

Hace unos días, Joaquín Sevilla, divulgador científico, director de la Cátedra de Cultura Científica y profesor de Tecnología Electrónica de la Universidad Pública de Navarra, decía para una entrevista en The Conversation que la divulgación consiste «en bajar el conocimiento de sus torres de marfil y conseguir que circule por los caminos que transitan habitualmente los ciudadanos comunes. Torres hay de la erudición, del aburrimiento o del desinterés, y una vez apeado de ellas, el conocimiento científico da para historias apasionantes».

La imagen pública que tenemos y hemos tenido de la ciencia y del arte comparten historia. Hubo un tiempo en el que el conocimiento se mantenía a resguardo en las torres de marfil, solo alcanzable para las élites intelectuales. Los científicos y los artistas compartieron esa pertenencia a la élite. Los científicos, gracias a la divulgación, empezaron a apearse de esas torres. A compartir el conocimiento con todo lo que implica la palabra compartir. Si compartes el conocimiento éste ha de ser comprensible. Para ello utilizamos el lenguaje y lo vamos desvistiendo hasta que queda un desnudo precioso, sin jerga del gremio, sin oscurantismo ni pesadas prendas de abrigo que lo protejan. Ese es el lenguaje que transitamos los ciudadanos comunes.

Sin embargo, el arte no se ha apeado todavía de las torres. Hemos pasado de creer que los artistas eran genios inspirados por la divinidad, virtuosos del pensamiento y de la técnica, a indignarnos con ellos. Aunque todo arte en su momento causa indignación. Los impresionistas que hoy gustan a todos fueron los mamarrachos de su tiempo. Los que no sabían pintar bien. Hoy en día el arte contemporáneo está dejando de indignar y está sucumbiendo a la indiferencia. El discurso posmoderno que lo acompaña, esa farsa intelectual, lo ha ido disfrazando de nada.

El arte contemporáneo no se divulga. Si se divulgase, a la gente le fascinaría. Insisto en que no se divulga. Me niego a llamar divulgación a las cartelas que acompañan a las obras de arte, incluso a las audioguías. Ese lenguaje oscuro, pesado y autorreferente deja fuera a quien no estuviese completamente dentro desde antes. Hay gente que no sabe quién Jeff Koons o Anish Kapoor. La mayoría, me temo. Igual que hay gente que no sabe cuáles son las leyes de la termodinámica. A partir de ahí, sin dar nada por sabido, se empieza a divulgar. Y es que, si todas las personas de las que nos rodeamos los divulgadores pertenecen a nuestro gremio, en mayor o menor medida, nos quedamos sin una buena vara de medir.

En mi última charla en Naukas Bilbao, el evento más grande de divulgación científica de España, hablé de Jeff Koons. Del perro gigante de flores del Museo Guggenheim de Bilbao, de los tulipanes y de la colchoneta hinchable de Hulk que era de bronce. Al día siguiente fui a visitar el museo con unas amigas. Había caras conocidas. En la escasa hora que estuvimos allí, decenas de personas se acercaron a decirme que estaban en el museo porque habían asistido a mi charla del día anterior. Gente que había venido a un evento de divulgación científica y que se había topado con una charla de divulgación… ¿artística? ¿científica? Cultural. Aunque este hecho supone una muestra poco o nada representativa, me sirve de ejemplo y para seguir en mis trece: si se divulgase el arte, a la gente le fascinaría.

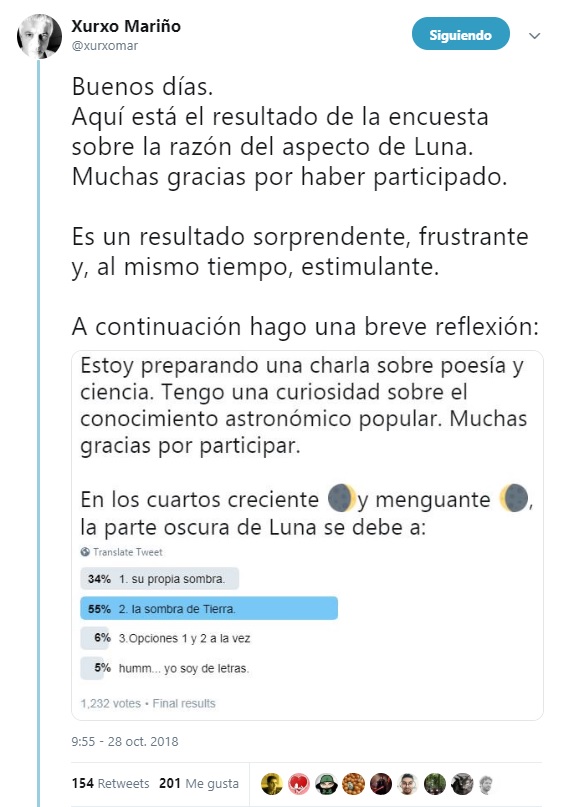

El conocimiento produce gozo. Esa es una de las claves del éxito de la divulgación. Hace unos días, Xurxo Mariño, divulgador científico, doctor en neurofisiología y profesor de la Universidad de A Coruña, hacía una encuesta en Twitter preguntando por qué se ve oscura una parte de la Luna en los cuartos creciente y menguante. El 58% respondió que se debía a la sombra de la Tierra. Respuesta mayoritaria. Respuesta incorrecta.

La respuesta correcta es la 1: su propia sombra.

La respuesta correcta es la 1: su propia sombra.La reflexión de Xurxo partía de la premisa de que el conocimiento produce placer. «Hay una cantidad muy llamativa de personas que conviven, día tras día, año tras año, ante un astro absolutamente hermoso y grandioso y, sin embargo, no dan el paso de reflexionar lo más mínimo sobre la razón de sus cambios de aspecto. El hecho de hacer esa reflexión, ¿qué aportaría a sus vidas?: un placer añadido a la mera observación, que es el placer del conocimiento. ¿Hay una renuncia voluntaria al placer del conocimiento? Lo dudo mucho. Entonces… ¿Hay un desconocimiento de que el conocimiento produce gozo y placer? (placer estético, poético…) Es una opción a tener en cuenta. ¿Qué hacemos los científicos ante eso?: comunicar el placer cognitivo, poético y estético de la ciencia. No se puede guardar el secreto de tanto gozo cuando, además, ese conocimiento es alimento para generar mentes capaces de pensamiento crítico».

El ejemplo de la Luna es intercambiable por cualquier otro conocimiento. Desde luego con el conocimiento artístico sucede lo mismo. «Para saborear hay que saber». Esta frase la pronuncio en casi todas mis charlas.

No creo que haya una renuncia voluntaria al placer del conocimiento. Es cierto que la indiferencia o el rechazo producido por el desconocimiento requiere menos esfuerzo intelectual. Y no hay tiempo, y hay otras prioridades, y toda clase de excusas. Pero cuando descubres algo, lo entiendes con mayor detalle, cuando un conocimiento gana en profundidad, produce una enorme satisfacción. ¿Quién va a renunciar a eso de forma voluntaria?

Con el arte contemporáneo pasa eso. No se renuncia voluntariamente a él. Lo que ocurre es que sigue siendo inaccesible porque no se divulga. Y su inaccesibilidad lo ha ido convirtiendo en un accesorio del que se puede prescindir en tiempos de crisis. Y no me refiero a crisis económica, sino a crisis intelectual, a esta deriva acrítica, simplista, simulada y cortoplacista en la que nos vemos inmersos.

¿Por qué hay gente que quiere que se invierta el dinero de sus impuestos en ciencia y rechaza que se invierta en arte? Obviando el apego por lo útil, -ya sabemos que la ciencia básica es inútil, afortunadamente– el conocimiento científico no genera más placer que el artístico o el conocimiento de cualquier otra naturaleza. Pero es que del conocimiento científico hemos aprendido a hacer mejor propaganda. Propaganda, esa es la palabra clave.

La gente tiene que saber en qué se gastan sus impuestos. Por eso las universidades y centros de investigación tienen que hacer divulgación.

Juan Ignacio Pérez, director de la Cátedra de Cultura Científica y catedrático de Fisiología de la Universidad del País Vasco, decía en The Conversation que la divulgación «ayuda a tomar decisiones mejor fundadas, tanto de forma individual como colectiva, por lo que promueve un ejercicio democrático de la ciudadanía. Y sirve para poner el conocimiento en el espacio público, elevando su prestigio social y favoreciendo el apoyo político a su creación y transmisión».

Si queremos elevar el prestigio social del arte contemporáneo, y favorecer el apoyo político a su creación y transmisión, debemos empezar por la divulgación.

En la inauguración de la última Mostra del MAC, la última antes del anunciado cierre del museo, que coincidía con el último acto antes de la jubilación de su directora, Carmen Fernández Rivera, no se personó ningún representante de las administraciones. ¿Qué había más importante que eso? Hasta la fecha, la única discusión de la que se han hecho eco los medios de comunicación es dónde irá a parar la colección de arte del MAC, si se quedará o no en Galicia. Pero no es solo un problema de patrimonio. El problema tiene más envergadura que eso. En el MAC se crean exposiciones, se hacen conciertos, residencias para artistas, becas de creación, conferencias… Es un motor cultural gallego. No es solo el contenedor de una valiosísima colección de arte contemporáneo. Y lo van a cerrar. Como han cerrado o dejado morir tantos otros centros de arte.

Me niego a sucumbir ante esta dictadura de lo inmediato, de lo útil, de lo de bajo calado intelectual. Tal y como los divulgadores científicos mantenemos un ruido constante que mantiene vivo el prestigio de la ciencia; es hora no solo de cambiar la perspectiva de la empresa del arte, sino de combatir su desprestigio social. Porque si no se entiende lo que hacen los artistas, ¿quién va a apoyar el arte? Si la gente no lo entiende, no le produce placer, no lo apoya. Por eso el arte se está volviendo una cuestión de segunda para los administradores públicos. Ellos son los que están permitiendo que esta crisis intelectual afecte a toda la ciudadanía sin intención de que haya vuelta atrás. Ellos son los que manejarán la situación con disimulo, para que dentro de unos meses nadie, salvo los afectados directos, hablen del cierre del MAC.

La divulgación científica nos sirve para acercar las evidencias científicas a la sociedad, para que esta, al amparo de los hechos, tome decisiones críticas y fundamentadas. El conocimiento es fundamental para el libre ejercicio democrático. Y este conocimiento se hace accesible gracias a la divulgación.

Nuestros gestores destinan fondos a ciencia, arte, o a cualquier otra actividad generadora de conocimiento en función de las exigencias de la ciudadanía. Por eso el hecho de no hacer divulgación sobre alguna de estas actividades deja desprotegida a la sociedad, la incapacita a la hora de la libre toma de decisiones. Quienes pretenden una sociedad dócil y acrítica, pondrán freno a la generación de conocimiento y, sobre todo, a su comunicación.

Es hora de hacer propaganda de todo lo que queremos salvar. No hay tiempo para el duelo. Es hora de actuar. Debemos hacer propaganda de la ciencia. Propaganda del arte contemporáneo. Y la mejor forma de hacer propaganda del conocimiento es la divulgación. Porque sin arte no hay futuro. Sin arte no hay pensamiento crítico. No hay generación de conocimiento. Sin arte no hay democracia.

Sobre la autora: Déborah García Bello es química y divulgadora científica

El artículo Sin divulgación científica no hay democracia. Sin arte tampoco se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Curso de verano: “Ciencia y democracia: los dilemas de la divulgación científica”

- Ciencia y democracia: dilemas de la divulgación científica

- “Divulgación científica y democracia en el siglo XXI” por Félix Ares

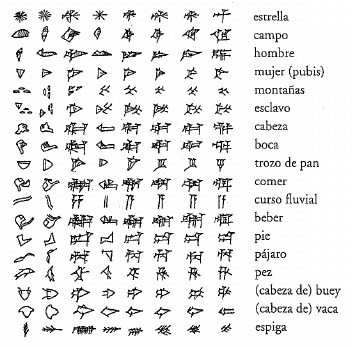

El origen de la escritura de los números

El estudio de la historia de la humanidad se divide en dos grandes períodos, que son la prehistoria, que abarca desde la aparición de la especie humana, desde sus primeros ancestros, hasta la aparición de la escritura, y la historia, que abarca desde el final de la prehistoria hasta la actualidad.

Se considera que el punto de inflexión en el estudio de la historia de la humanidad fue el origen de la escritura. La invención de la escritura supuso un avance intelectual muy importante para el ser humano, puesto que requería que la mente humana desarrollase una capacidad de abstracción significativa, y cambió completamente su existencia. La escritura permite plasmar los pensamientos “en papel”, recoger con precisión el lenguaje hablado y es un medio de expresión y de comunicación que posibilita guardar los registros de forma duradera. Y para la historia, en cuanto disciplina, significó poder disponer de fuentes escritas perdurables para estudiar los hechos históricos.

Simplificando la cuestión, puesto que los diferentes pueblos de la antigüedad fueron desarrollando de forma independiente sus propias formas de comunicación oral y escrita, puede decirse que la escritura fue inventada a finales del milenio IV a.c. en Sumeria, la zona sur de la antigua Mesopotamia, comprendida entre el Tigris y el Éufrates.

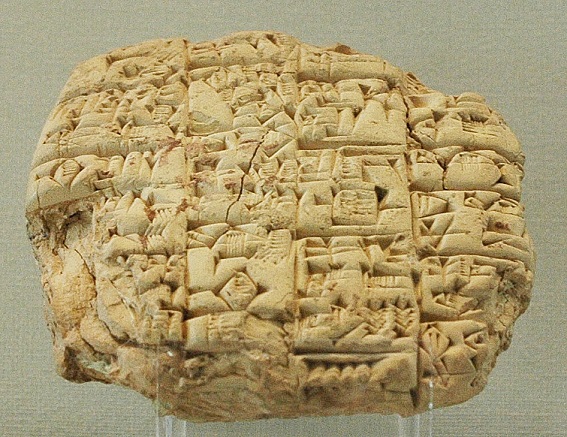

Carta de la Gran Sacerdotisa Lu’enna al rey de Lagash (quizás Urakagina), informándole de la muerte de su hijo en combate. Tablilla de barro, con escritura cuneiforme antigua, de aprox. 2400 a.n.e., encontrada en Telloh (antigua Girsu), Irak. Departamento de Antigüedades Orientales del Museo del Louvre (París). Fuente: Wikimedia Commons

Carta de la Gran Sacerdotisa Lu’enna al rey de Lagash (quizás Urakagina), informándole de la muerte de su hijo en combate. Tablilla de barro, con escritura cuneiforme antigua, de aprox. 2400 a.n.e., encontrada en Telloh (antigua Girsu), Irak. Departamento de Antigüedades Orientales del Museo del Louvre (París). Fuente: Wikimedia CommonsSin embargo, la invención de los números cambió también la existencia de los seres humanos. Los números no son tan solo una parte de nuestro lenguaje, oral o escrito, sino que son una herramienta fundamental en nuestra sociedad, que permiten, por ejemplo, medir, establecer una ubicación física o temporal, contar, ordenar y clasificar, comprar y vender, de hecho, desarrollar toda la economía, o codificar, por no hablar de su papel en la presente era digital. Su creación necesitó también de un significativo proceso de abstracción, que le llevaría varios milenios a la humanidad.

Por último, la invención de la escritura de los números se produce justo antes de la aparición de la escritura, en el sentido usual, pero no como algo casual, sino que el número escrito acompañaría a la palabra escrita en su nacimiento. Como escribe Antonio Durán en Vida de los números, “los números ejercieron de matrona de la escritura”.

El origen de los números, así como su grafía, es un proceso sumamente complejo, que tuvo muchos protagonistas en diferentes partes del planeta y se desarrolló a lo largo de varios milenios.

La primera etapa en la existencia del ser humano hacia la creación de los números fue tomar conciencia de que podía conocerse si dos conjuntos tenían la misma cantidad de objetos, sin que existiera la idea de número. Dos conjuntos poseen la misma cantidad de objetos, independientemente de cuál sea esa cantidad, si podemos establecer una relación “uno a uno” entre los elementos de ambos. Hace milenios los pastores podían comprobar, sin conocer los números, si todas las ovejas que habían sacado a pastar por la mañana regresaban a la tarde. Para ello, los pastores debían de colocar una piedra, u otro pequeño objeto, en algún recipiente, por cada oveja que salía a pastar al campo, y cuando regresaban, iban sacando una piedra por cada animal que llegaba. Sabían que habían regresado todas si al final no quedaba ningún guijarro en el recipiente, y que se había perdido alguna oveja, o habían sido atacadas por los lobos, si aún quedaban piedras.

Pero, además, se produjo un avance significativo hacia el concepto de número porque el ser humano introdujo una familia de objetos de referencia, ya fuesen estos los dedos de las manos, piedras, nudos en una cuerda, muescas en el suelo, en un palo o en un hueso, para poder asociar cualquier cantidad de animales, plantas u objetos con el mismo número del conjunto de referencia. Así, dos ovejas se correspondían con dos dedos, dos muescas o dos piedras, cinco personas con cinco muescas. Este fue el origen del primer concepto de número desarrollado por la humanidad, así como el proceso de contar asociado, operación que consiste en añadir un objeto de referencia más por cada nuevo sujeto a contar. Esos elementos de referencia “inventados” se podían utilizar para “contar” cualquier conjunto de objetos y eran manejados por todas las personas de una misma zona.

El anterior fue un proceso de abstracción que duró varios milenios. Las primeras evidencias de registros numéricos, tengamos en cuenta que si se utilizaban partes del cuerpo humano o materiales degradables el registro desaparecía, son de hace más de 30.000 años, un hueso (peroné) de babuino con 29 muescas y un hueso (tibia) de lobo con 57 muescas, agrupadas de 5 en 5.

El Hueso de Ishango, es un hueso, el peroné de un babuino, del paleolítico superior, aprox. del 20.000 a.n.e., que contiene tres grupos de muescas, quizás como parte de un proceso de contar animales u objetos, o tal vez relacionado con el calendario. Perteneciente al Institut Royal des Sciences naturelles de Belgique, Bruxelles. Fuente: Wikimedia Commons

El Hueso de Ishango, es un hueso, el peroné de un babuino, del paleolítico superior, aprox. del 20.000 a.n.e., que contiene tres grupos de muescas, quizás como parte de un proceso de contar animales u objetos, o tal vez relacionado con el calendario. Perteneciente al Institut Royal des Sciences naturelles de Belgique, Bruxelles. Fuente: Wikimedia CommonsEl siguiente avance lo constituyó la invención de la base de la numeración. Representar números cada vez mayores utilizando los dedos de la mano o por acumulación de muescas, nudos o guijarros se hizo inviable, además de la dificultad para distinguir, sin saber contar, entre un grupo alto de marcas, nudos u otros objetos de referencia, por ejemplo, entre IIIIIII y IIIIIIII. Se empezaron a agrupar formando grupos de 5 o 10, o incluso otras cantidades. Es decir, cada 5 o 10 muescas, piedras o nudos, se marcaba una muesca, piedra o nudo distinto, que tenía el valor de 5 o 10 de los normales, creando una jerarquía de símbolos.

Georges Ifrah, en Historia universal de las cifras, narra la historia de un pueblo de Madagascar que, para contar el número de soldados de su ejército, estos pasaban en fila y cada uno depositaba un guijarro en una pequeña zanja en el suelo, cuando llegaba el décimo, este extraía las 10 piedras de la misma y en su lugar colocaba una en una segunda hendidura, reservada para las decenas. Y se continuaba colocando guijarros en el primer hoyo hasta que este se llenaba de nuevo con 10 piedras, con el soldado 20, momento en el que se vaciaba esa primera cavidad y se colocaba un segundo guijarro en la segunda. Cuando la segunda zanja llegaba a tener diez piedras, se extraían y se colocaba una de ellas en una tercera hendidura, la de las centenas, y así sucesivamente. De manera que, si al terminar de pasar los guerreros había 3 guijarros en la primera zanja, 7 en la segunda y 4 en la tercera, el número de guerreros era 473.

Muchos pueblos han utilizado el 10 como base, debido a que nuestras manos fueron el primer sistema de referencia y la primera calculadora que tuvo el ser humano. Además, esa misma idea en la que se basan los malgaches, es la que se utiliza en el ábaco.

De forma paralela al desarrollo del concepto de número, se fueron desarrollando las operaciones aritméticas. En Kenia cuando iba a salir una expedición militar, cada guerrero masai depositaba un guijarro en un montón, y a la vuelta cada superviviente cogía uno del mismo. De esta forma, se tenía conocimiento de las pérdidas sufridas, ya fueran muertos o prisioneros. La cantidad de piedras que quedaba era el resultado de los guerreros iniciales menos los que habían vuelto.

Quipu inca del Museo Larco, de Lima (Perú), sobre el 1400 d.C. Como se explica en Quipu y yupana, instrumentos matemáticos incas (I), los incas utilizaban un sistema decimal de registro de números, mediante nudos sobre cuerdas. Fotografía: Claus Ableiter / Wikimedia Commons

Quipu inca del Museo Larco, de Lima (Perú), sobre el 1400 d.C. Como se explica en Quipu y yupana, instrumentos matemáticos incas (I), los incas utilizaban un sistema decimal de registro de números, mediante nudos sobre cuerdas. Fotografía: Claus Ableiter / Wikimedia CommonsUn tema de estudio muy interesante son los diferentes sistemas de numeración que se fueron generando en la antigüedad por los diferentes pueblos, así como los algoritmos para el cálculo de las operaciones aritméticas que se desarrollaron. El libro Historia universal de las cifras de Georges Ifrah es la referencia obligada sobre esta cuestión, aunque en la bibliografía se citan algunas entradas del Cuaderno de Cultura Científica en las cuales se muestran algunos ejemplos.

Pero regresemos al tema central de esta entrada del Cuaderno de Cultura Científica, cómo, y porqué, se desarrolló la escritura de los números y qué relación tuvo con la invención de la escritura.

Hacia el final de la prehistoria de la humanidad, el ser humano empezó a asentarse, abandonando su vida nómada, y con los asentamientos inició el desarrollo de la agricultura y la ganadería, y fruto de todo ello, se originó el comercio, primero el intercambio de productos y, posteriormente, la compra-venta. Después empezó a vivir en grandes asentamientos, en ciudades, lo que llevó a la organización y gobierno de las mismas, y de otras estructuras socio-económicas más amplias, a la creación de servicios y a un mayor comercio. Los números y la aritmética se hicieron fundamentales en estas sociedades, fue el origen de la contabilidad. Incluso existieron profesionales dedicados a las labores aritméticas y de registro de la contabilidad.

Una de las zonas de la Tierra en las que se produjo esta transformación fue Mesopotamia, Elam y alrededores, que es el lugar en el que se originó la escritura, también la escritura de los números.

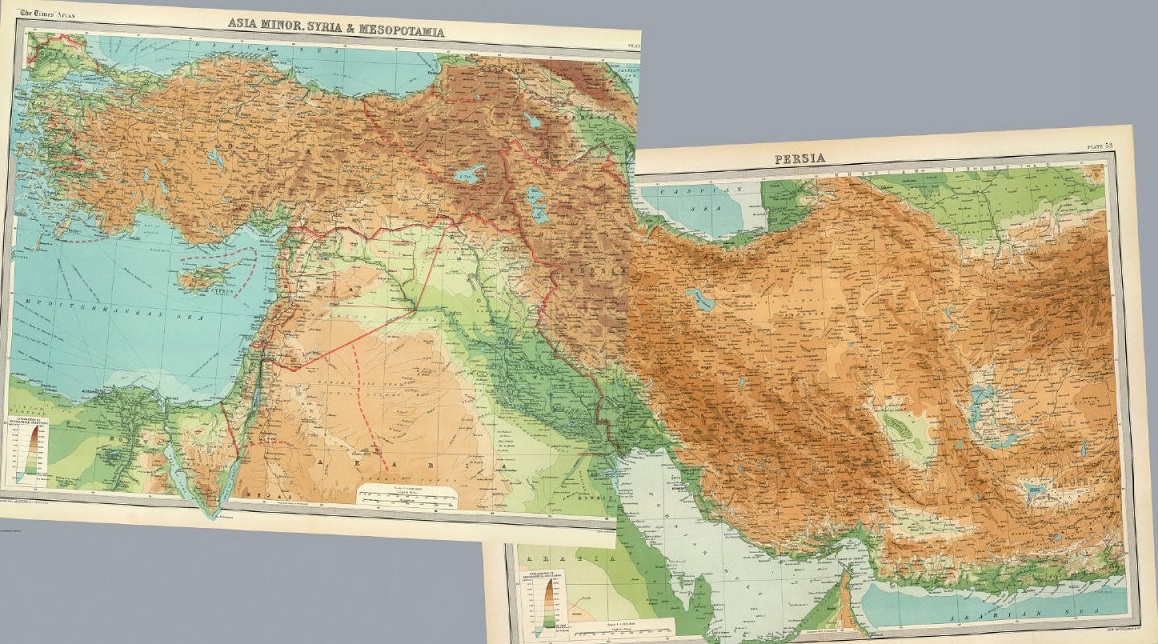

Composición de dos mapas del Atlas de The Times (1922) de John Bartholomew, que incluye toda la zona de Mesopotamia, zona entre los ríos Tigris y Eufrates, Elam, que era la parte de Irán que está junto al Golfo Pérsico, y alrededores

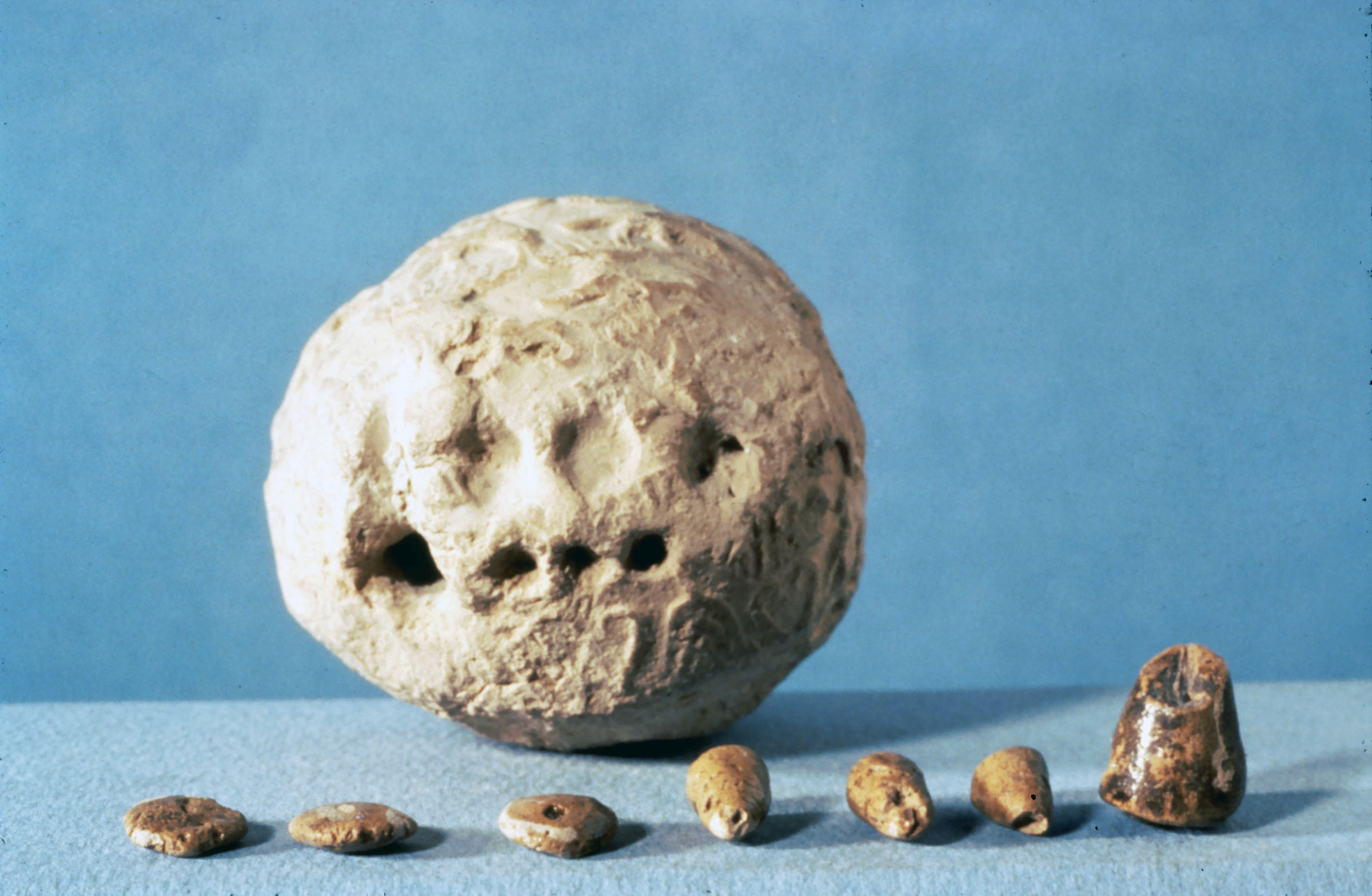

Composición de dos mapas del Atlas de The Times (1922) de John Bartholomew, que incluye toda la zona de Mesopotamia, zona entre los ríos Tigris y Eufrates, Elam, que era la parte de Irán que está junto al Golfo Pérsico, y alrededoresLos primeros números que utilizaron los sumerios o los elemitas fueron “cálculos”, objetos de barro de diferentes formas y tamaños, que utilizaron tanto para representar los números, como para realizar con ellos las operaciones aritméticas. Su antigüedad se remonta, al menos, al milenio IV a.n.e.

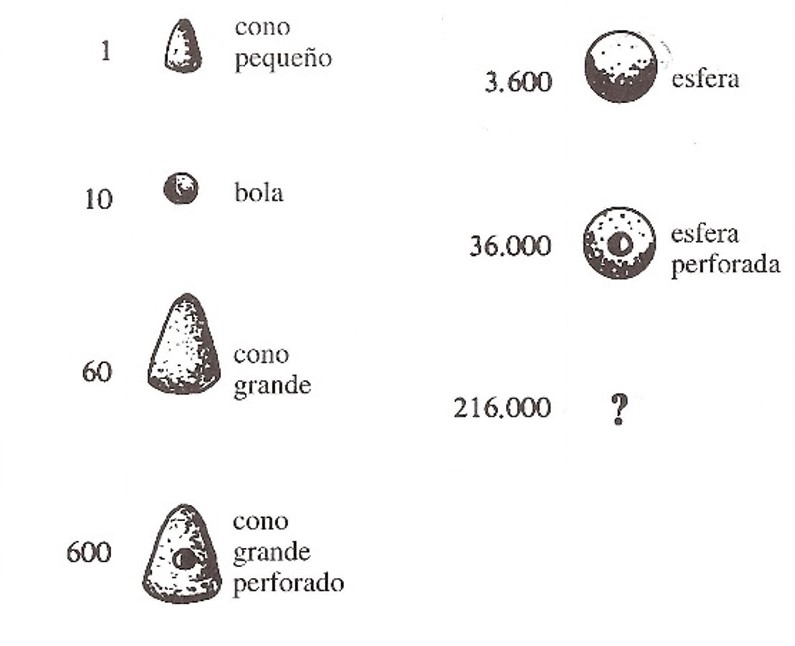

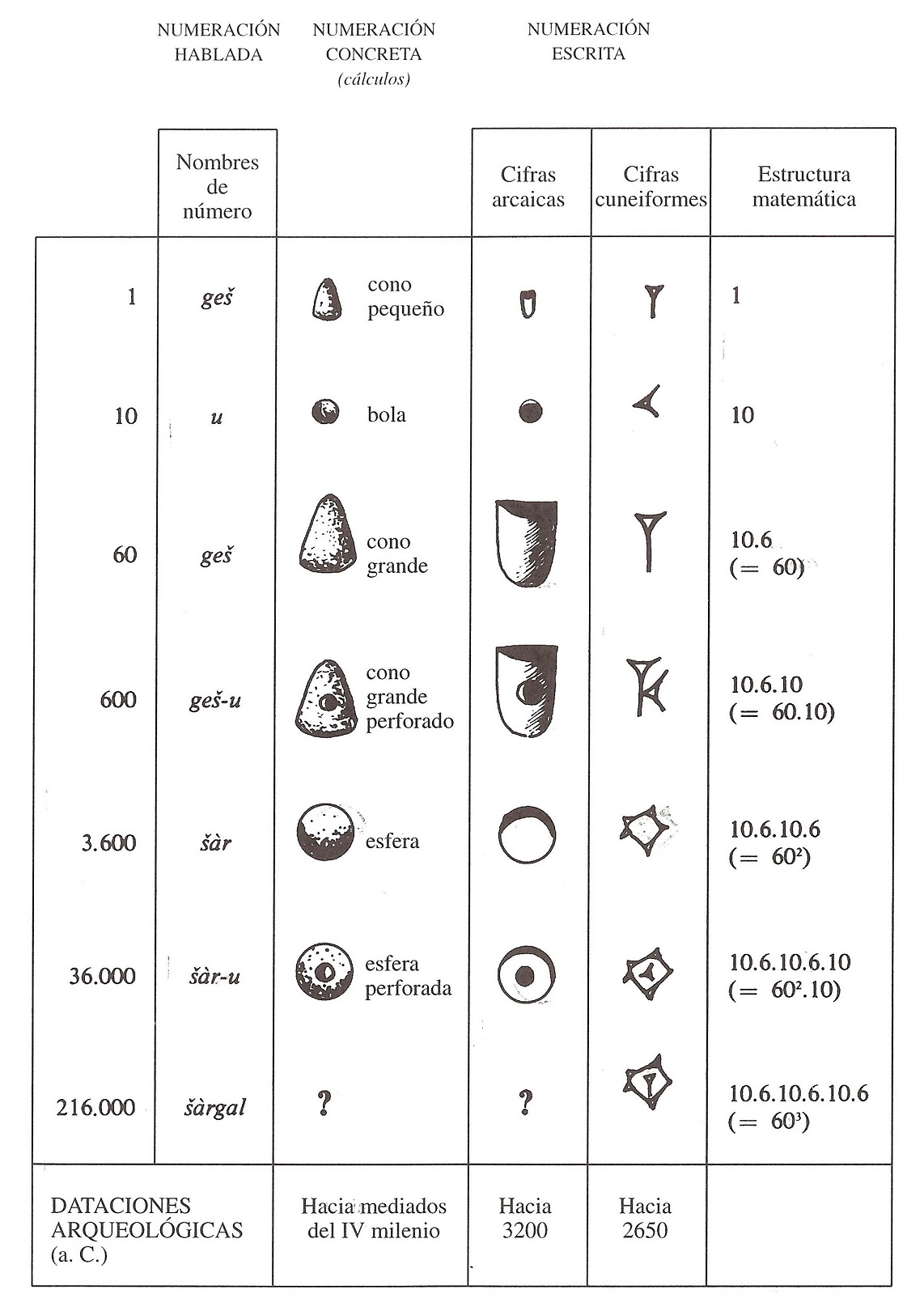

Los números sumerios consistían en un sistema de numeración aditivo (es decir, al igual que los números romanos, cada número se obtiene por acumulación de las cifras básicas), de base mixta 10 y 60, cuyas cifras básicas eran un cono pequeño 1, una bola pequeña 10, un cono grande 60, un cono grande perforado 600 (= 60 10), una esfera 3.600 (= 602) y una esfera perforada 36.000 (= 602 10), y se desconoce cuál era la forma de la figura de barro, si existía, para la siguiente cantidad, 216.000 (603).

Cifras básicas sumerias, que consisten en una serie de “cálculos” de arcilla con diferentes formas. Imagen extraída del libro Historia universal de las cifras, de Georges Ifrah

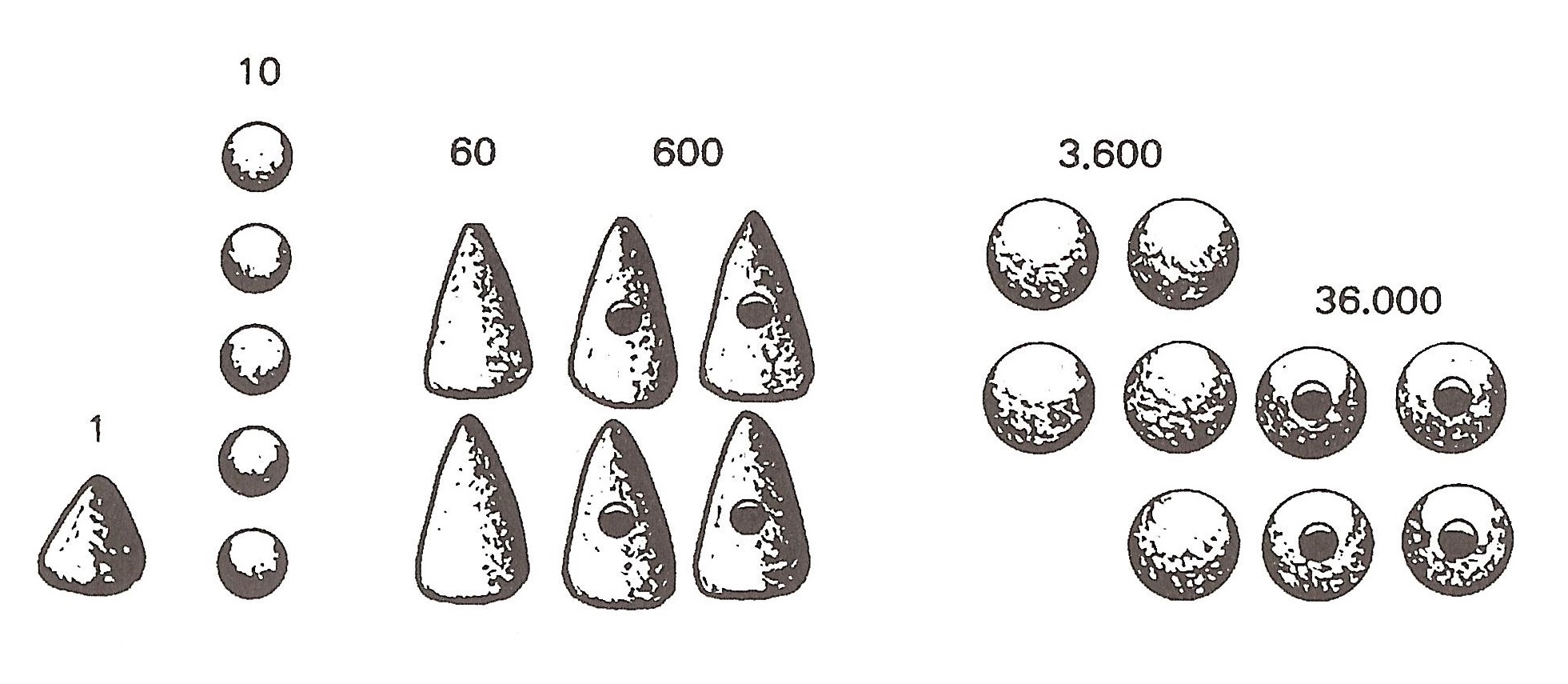

Cifras básicas sumerias, que consisten en una serie de “cálculos” de arcilla con diferentes formas. Imagen extraída del libro Historia universal de las cifras, de Georges Ifrah Como el sistema de numeración sumerio era aditivo, para representar el número 164.571, se utilizaban 4 esferas perforadas, 5 esferas, 4 conos grandes perforados, 2 conos grandes, 5 esferas pequeñas y 1 cono pequeño, ya que 164.571 = 4 36.000 + 5 3.600 + 4 600 + 2 60 + 5 10 + 1 1.

Representación del número 164.571 utilizando los cálculos sumerios, es decir, 4 esferas perforadas, 5 esferas, 4 conos grandes perforados, 2 conos grandes, 5 esferas pequeñas y 1 cono pequeño

Representación del número 164.571 utilizando los cálculos sumerios, es decir, 4 esferas perforadas, 5 esferas, 4 conos grandes perforados, 2 conos grandes, 5 esferas pequeñas y 1 cono pequeñoY con estos guijarros de arcilla, los sumerios realizaban además las operaciones aritméticas que necesitaban para la contabilidad que necesitaban. Eran métodos muy sencillos, que no abordaremos aquí, por falta de espacio, pero que cualquiera puede imaginar, si se pone a ello.

En otras zonas, como la vecina Elam, los cálculos (de arcilla) eran un poco diferentes, así como sus valores, un bastoncillo 1, una bola 10, un disco 100, un cono pequeño 300 y un cono grande perforado 3.000. Aunque esencialmente era un sistema de numeración similar, con idénticos métodos de cálculo de las operaciones aritméticas.

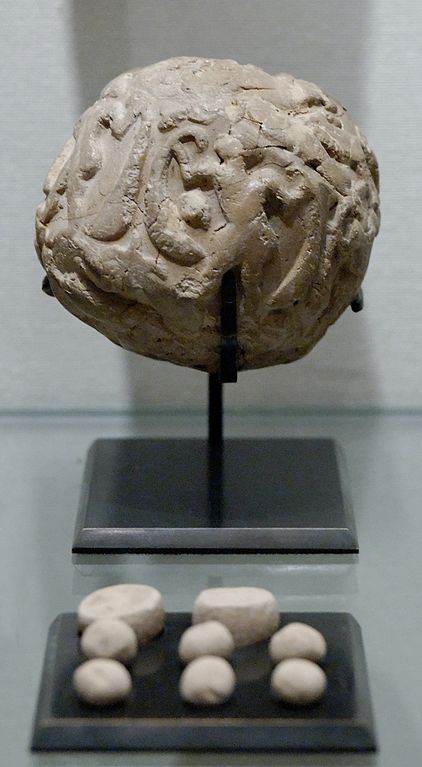

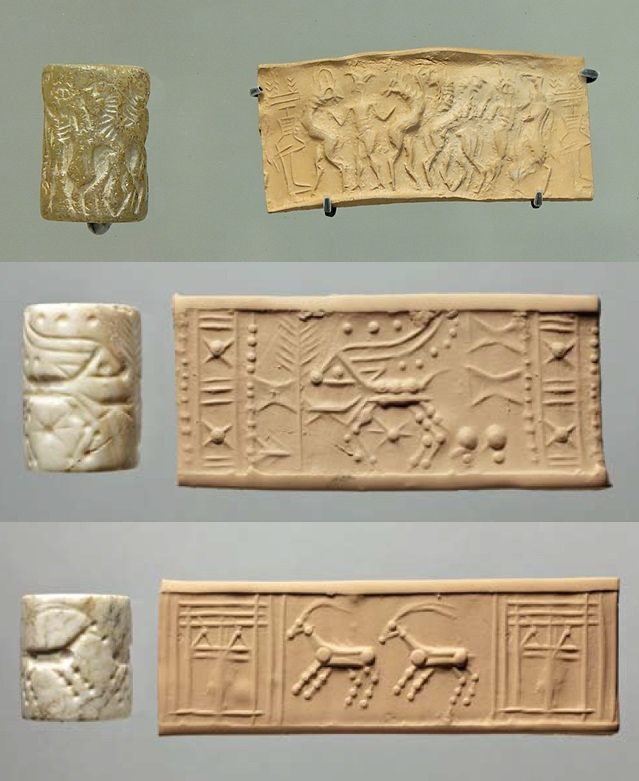

Así, alrededor del año 3.500 a.c. en Sumeria (y también, en Elam) empiezan a sentir la necesidad de guardar constancia de las informaciones numéricas asociadas a las transacciones económicas o de los muy diversos datos estadísticos relacionados con la vida y el gobierno de Sumeria, por ejemplo, las cantidades de cereales y animales implicados en una compra-venta entre un agricultor y un ganadero, el registro del número de ovejas de un pastor o la población de las diferentes ciudades de Sumeria. Para ello se representaba la cantidad en cuestión con los guijarros de arcilla de su sistema de numeración y se introducían estos en el interior de una bola de arcilla fresca, se cerraba y en el exterior de la misma se imprimían uno o dos sellos cilíndricos para garantizar su origen e integridad (por supuesto, los gobernantes o familias poderosas eran quienes tenían sellos cilíndricos). Al secarse la arcilla se conservaba dentro la información numérica deseada. Pasado un cierto tiempo, si era el momento de comprobar la información, por ejemplo, para realizar el pago de la compra-venta, se rompía la bola de arcilla y se podía acceder a la información numérica guardada. Podríamos decir que fue el primer recibo de la historia.

Bolsa de arcilla, con sello cilíndrico impreso en el exterior, junto con algunos “cálculos” de arcilla. Encontrada en la Acrópolis de Susa, que llegaría a ser la capital de Elam, fechada en el período Uruk de Mesopotamia (entre 4.000 y 3.100 a.n.e.). Departamento de Antigüedades Orientales del Museo del Louvre (París). Fotografía: Marie-Lan Nguyen

Bolsa de arcilla, con sello cilíndrico impreso en el exterior, junto con algunos “cálculos” de arcilla. Encontrada en la Acrópolis de Susa, que llegaría a ser la capital de Elam, fechada en el período Uruk de Mesopotamia (entre 4.000 y 3.100 a.n.e.). Departamento de Antigüedades Orientales del Museo del Louvre (París). Fotografía: Marie-Lan NguyenPlanteemos una situación hipotética en las que pudo utilizarse este sistema de registro numérico. Imaginemos un ganadero y un agricultor sumerios que pretenden intercambiar bueyes por trigo, y llegan a un acuerdo de compra-venta de 14 bueyes a cambio de 686 cestos de trigo, a entregar al finalizar la época de siega del cereal. Deberán recoger la información de la transacción, para cuando se produzca esta no haya ninguna duda. Para ello el ganadero introduce una bola y dos conos pequeños, para registrar la cantidad de 12 bueyes, en una bolsa de arcilla fresca, después la cierra e imprime su sello cilíndrico en el exterior. Por su parte, el agricultor introduce un cono grande perforado, un cono grande, dos bolas y seis conos pequeños, para indicar los 686 cestos de trigo, en otra bolsa de arcilla fresca, que después cerrará e imprimirá con su sello cilíndrico personal. Una vez secas, intercambiarán las bolsas de arcilla, con las cantidades registradas, que guardarán hasta el momento de realizar el intercambio de los productos. Otra posibilidad es que exista un funcionario del gobierno que certifique la transacción imprimiendo su sello a la bolsa de arcilla.

Imagen mediante rayos X de una bolsa de arcilla intacta, en la que se puede apreciar en su interior algunos “cálculos” de arcilla, con forma de conos y ovoides. La bolsa de arcilla fue encontrada en Dhahran, Arabia Saudí. Imagen del artículo The Earliest Precursor of Writing de Denise Schmandt-Besserat

Imagen mediante rayos X de una bolsa de arcilla intacta, en la que se puede apreciar en su interior algunos “cálculos” de arcilla, con forma de conos y ovoides. La bolsa de arcilla fue encontrada en Dhahran, Arabia Saudí. Imagen del artículo The Earliest Precursor of Writing de Denise Schmandt-BesseratCon el fin de no tener que romper la bolsa de arcilla cada vez que se quería comprobar la cantidad registrada, lo que implicada además tener que volver a preparar otra bolsa de arcilla nueva, se empezaron a marcar los “cálculos” que luego iban a introducirse en la bolsa de arcilla, sobre el exterior de la misma. De esta forma observando el exterior de la bolsa de arcilla ya se conocía la cantidad representada en el interior.

Bolsa de arcilla cerrada con cálculos marcados, 3300 a.c., Susa, Irán. Musée du Louvre, Département des Antiquités Orientales, París; y Denise Schmandt-Besserat. Imagen: Wikimedia Commons

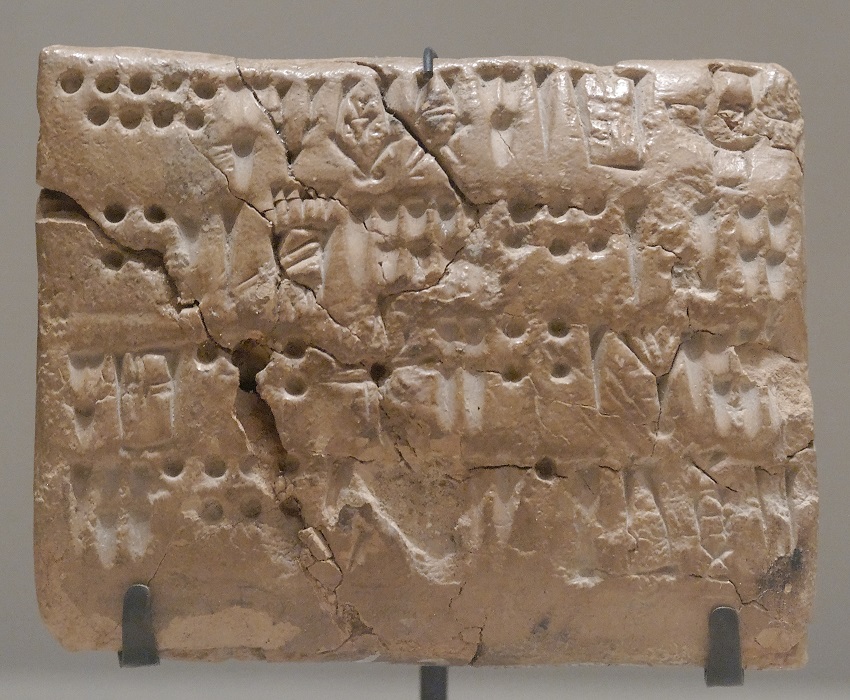

Bolsa de arcilla cerrada con cálculos marcados, 3300 a.c., Susa, Irán. Musée du Louvre, Département des Antiquités Orientales, París; y Denise Schmandt-Besserat. Imagen: Wikimedia CommonsEl siguiente paso en el camino hacia el inicio de la escritura numérica, fue que los sumerios se percataron de que realmente no necesitaban los “cálculos” que estaban dentro de la bolsa de arcilla, bastaba con observar las impresiones en el exterior para conocer el número que se representaba en la misma. Por este motivo, se empezaron a utilizar simplemente tablillas frescas de arcilla sobre las que se presionaban los “cálculos” y quedaba registrado el número contable, manteniendo la idea del sello cilíndrico por encima de las cantidades, como certificación de autenticidad.

Tablilla de arcilla con números impresos en la misma y un sello, tanto delante, como detrás, de la tablilla. Localizada en Jebel Aruda (Siria), del período Uruk V (aprox. 3500-3350 a.n.e.). Imagen: CDLI-Cuneiform Digital Library Initiative. CDLI n. P235757

Tablilla de arcilla con números impresos en la misma y un sello, tanto delante, como detrás, de la tablilla. Localizada en Jebel Aruda (Siria), del período Uruk V (aprox. 3500-3350 a.n.e.). Imagen: CDLI-Cuneiform Digital Library Initiative. CDLI n. P235757En las primeras tablillas de arcilla, atendiendo a las tablillas sumerias arcaicas conservadas, se consignaban solamente las cantidades, sin especificar a qué se referían estas, y una tablilla para cada cantidad. Se utilizaba simplemente una tablilla con el número 137 impreso si por ejemplo se pretendía hacer un registro de 137 sacos de trigo, y si se quería hacer otro registro, por ejemplo, de 63 ovejas, se tomaba otra tablilla de arcilla fresca y se representaba el número 63. Tampoco quedaba registrada la propia naturaleza de la operación contable, una compra-venta, un reparto, un inventario de bienes, etc.

Tablilla de arcilla con marcas impresas representando el número 63 (números elamitas, 6 marcas redondas, correspondientes a bolas, 6 10 = 60, y 3 marcas alargadas de bastoncillos, 3 1 = 3). Puede observarse el sello cilíndrico también. Localizada en Susa (actual Irán), fechada aprox. 3.200 a.n.e. Imagen Musée du Louvre, Département des Antiquités Orientales, París. Fotografía: Denise Schmandt-Besserat

Tablilla de arcilla con marcas impresas representando el número 63 (números elamitas, 6 marcas redondas, correspondientes a bolas, 6 10 = 60, y 3 marcas alargadas de bastoncillos, 3 1 = 3). Puede observarse el sello cilíndrico también. Localizada en Susa (actual Irán), fechada aprox. 3.200 a.n.e. Imagen Musée du Louvre, Département des Antiquités Orientales, París. Fotografía: Denise Schmandt-BesseratComo lo importante eran las marcas que quedaban impresas en la arcilla, y no los propios “cálculos”, se empezaron a realizar esas marcas con un sencillo buril (en el caso de los números sumerios, muesca fina 1, impresión circular pequeña 10, muesca grande 60, muesca con impresión circular pequeña 600, impresión circular grande 3.600, impresión circular grande con impresión circular pequeña 36.000), que irían derivando hacia una grafía cuneiforme.

Tabla en la que se recogen los valores de las cifras básicas sumerias y las diferentes formas de representarlas, primero como “cálculos” de arcilla, después las cifras arcaicas, realizadas con un buril y que intentan imitar la forma de los cálculos al ser impresos en la arcilla húmeda, y las cifras cuneiformes, realizadas con un también buril pero que ya no se asemejan a los guijarros originales. Imagen: Historia universal de las cifras, de Georges Ifrah

Tabla en la que se recogen los valores de las cifras básicas sumerias y las diferentes formas de representarlas, primero como “cálculos” de arcilla, después las cifras arcaicas, realizadas con un buril y que intentan imitar la forma de los cálculos al ser impresos en la arcilla húmeda, y las cifras cuneiformes, realizadas con un también buril pero que ya no se asemejan a los guijarros originales. Imagen: Historia universal de las cifras, de Georges Ifrah  Tablilla contable sumeria del periodo Uruk, de la Acrópolis de Susa, aprox. 3200-2700 a.n.e. Musée du Louvre, Département des Antiquités Orientales, París. Fotografía de Marie-Lan Nguyen / Wikimedia Commons

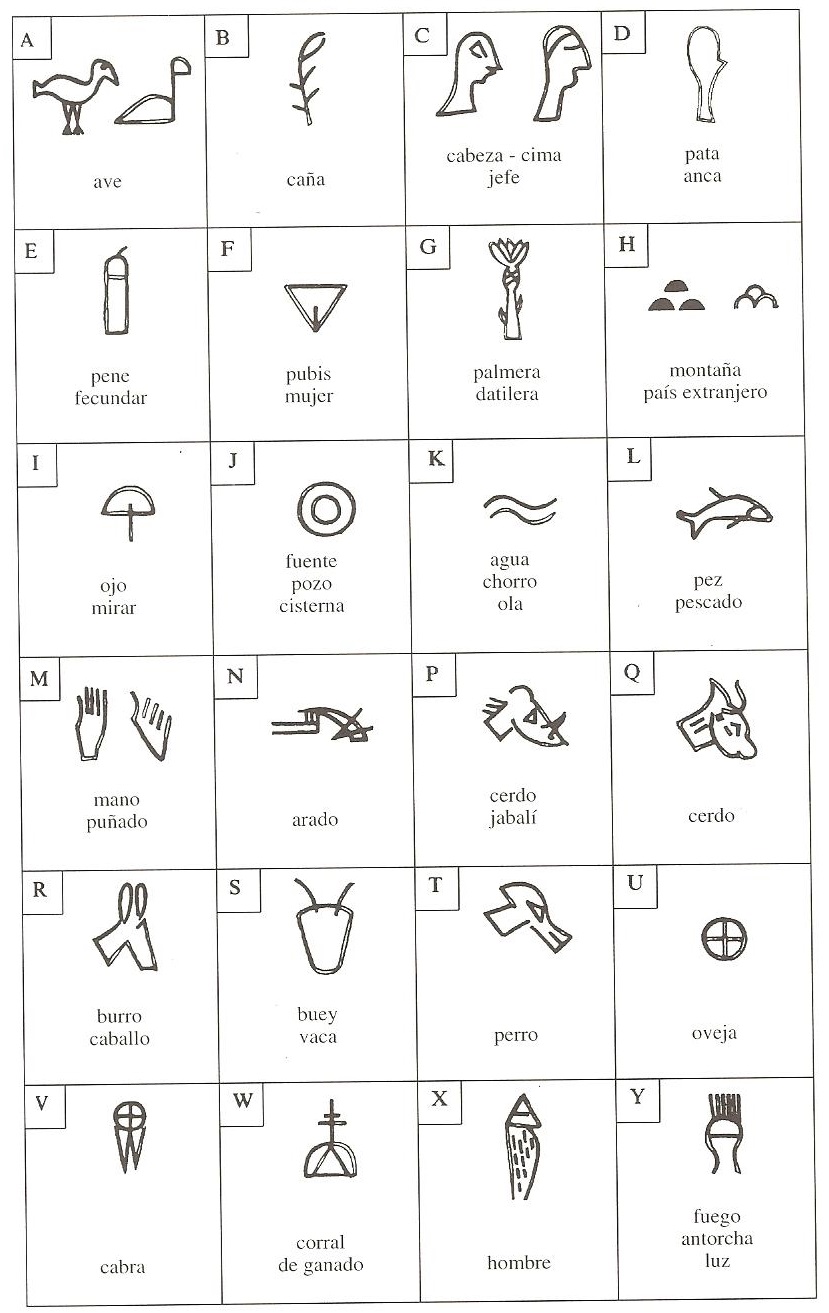

Tablilla contable sumeria del periodo Uruk, de la Acrópolis de Susa, aprox. 3200-2700 a.n.e. Musée du Louvre, Département des Antiquités Orientales, París. Fotografía de Marie-Lan Nguyen / Wikimedia Commons Las transacciones económicas se fueron multiplicando, así como los registros contables de las mismas, por lo que hacia el año 3.100 a.n.e. se empezaron a incluir diferentes registros en una misma tablilla (como en la imagen de arriba) y a utilizarse pictogramas, que son los primeros signos de la escritura, para indicar los objetos a los que se refería cada cantidad de la tablilla (cereales, ovejas, caballos, jabalíes, pan, ropa, etc). Estos pictogramas que al principio solo registraban objetos, poco a poco fueron incorporando otros significados, por ejemplo, acciones. Así mismo, se empezaron a combinar varios pictogramas para obtener nuevos significados. Fue el nacimiento de la escritura.