Neandertalen eta itsasoaren arteko harreman estua azaleratu dute

Begetarianismoaren aldeko hautuek merezi duten errespetu osoarekin, bada argi esan behar den kontu bat: ehiza egiteak eta haragia jateak, hein handi batean, gizaki bihurtu gintuzten. Sarraskijaletza hutsetik aldenduta, animaliak modu aktiboan ehizatzeko estrategien garapenak ahalbidetu zuen eboluzioa, eta proteina animalien kontsumoak ere rol garrantzitsua izan zuen garunaren beraren garapenean.

1. irudia: Neandertalen inguruko datu berriak eskuratzen diren aldiro, gure espeziearekin izan zuten antza azaleratzen da. Argazkian, neandertal baten irudikapena, MEH-Giza Eboluzioaren Museoan. (Argazkia: Juanma Gallego)

Hain ezaguna ez bada, eta txikiagoa izanda ere, askok uste dute bigarren jauzi ebolutibo bat egon zela gizakiak itsas elikagaiak eskuratzeari ekin zionean. Batetik, eta portaeraren ikuspuntutik, arrantza egiteko estrategiek ere lagunduko zutelako trebezia bereziak garatzen. Baina elikagaia motak berak ere badu garrantzia: argudiatu izan denez, gantz azidotan aberatsa da itsasoari lotutako elikadura, eta horrek ere lagunduko zuen gizakiaren eboluzioan, garunaren garapena bultzatuz.

Orain arte, Afrika Hegoaldeko Erdi Harri Aroan (MSA, Europako Erdi Paleolitoaren parekoa) dokumentatu izan dira itsas produktuen kontsumoari lotutako lehen aztarnategi garrantzitsuak. Afrikan, duela 160.000 urte hasi zen itsasoarekiko lotura hori. Baina, neandertalen garaiko Europaren kasuan, lotura horren adibide esanguratsu gutxi egon dira. Arrazoietako bat izan daiteke itsas mailaren igoera. Izan ere, Europako kostaldean egon daitezkeen hainbat aztarna seguruenera galduta daude, azken glaziazio arteko garaian zeuden kostaldeak, hein handi batean, orain itsaspean daudelako.

Dena dela, aurretik ere neandertalen eta itsas elikagaien arteko loturaren zantzuak izan dira. Gugandik gertu, esaterako, Kantabriako El Cuco aztarnategian moluskuen kontsumoa jaso zuten ikerketa batean. Orduan, Joseba Rios-Garaizar arkeologoak bertako industria litikoaren analisiaren bitartez ondorioztatu zuen Moustier aldikoak zirela; hau da, neandertalenak. Duela 45.000 urtekoak ziren arrasto horiek. Duela gutxi, bestalde, PLOS ONE aldizkarian agertutako beste ikerketa batean iradoki zuten neandertalak gai zirela urpean igeri egiteko, txirlak lortu aldera.

Bada, Afrikan ez ezik, zaharragoak ziren garaietan ere Europako neandertalen artean garatu zen itsasoari lotutako jardun hori, orain Science aldizkarian argitu dutenez. Portugalgo Figueira Brava haitzuloan (Lisboatik 30 bat kilometrora) ederki kontserbatu da neandertalen garaiko aztarna sorta zabal bat; besteak beste, arrainak eta itsaskiak daude bertan, kopuru handitan. Hori posible izan da bereziki ingurunea higaduratik babestuta mantendu delako. Kokapenak garrantzi handia izan du: ikertzaileek kalkulatu dutenez, okupazioaren lehenengo fasetan, haitzuloa itsasotik 750 bat metrora zegoen. Azken faseetan, berriz, bi kilometrora egon zen. Orain, zorionez, itsasoaren ertzean dago, eta horregatik bertatik ondorioak ateratzeko moduan egon dira ikertzaileak.

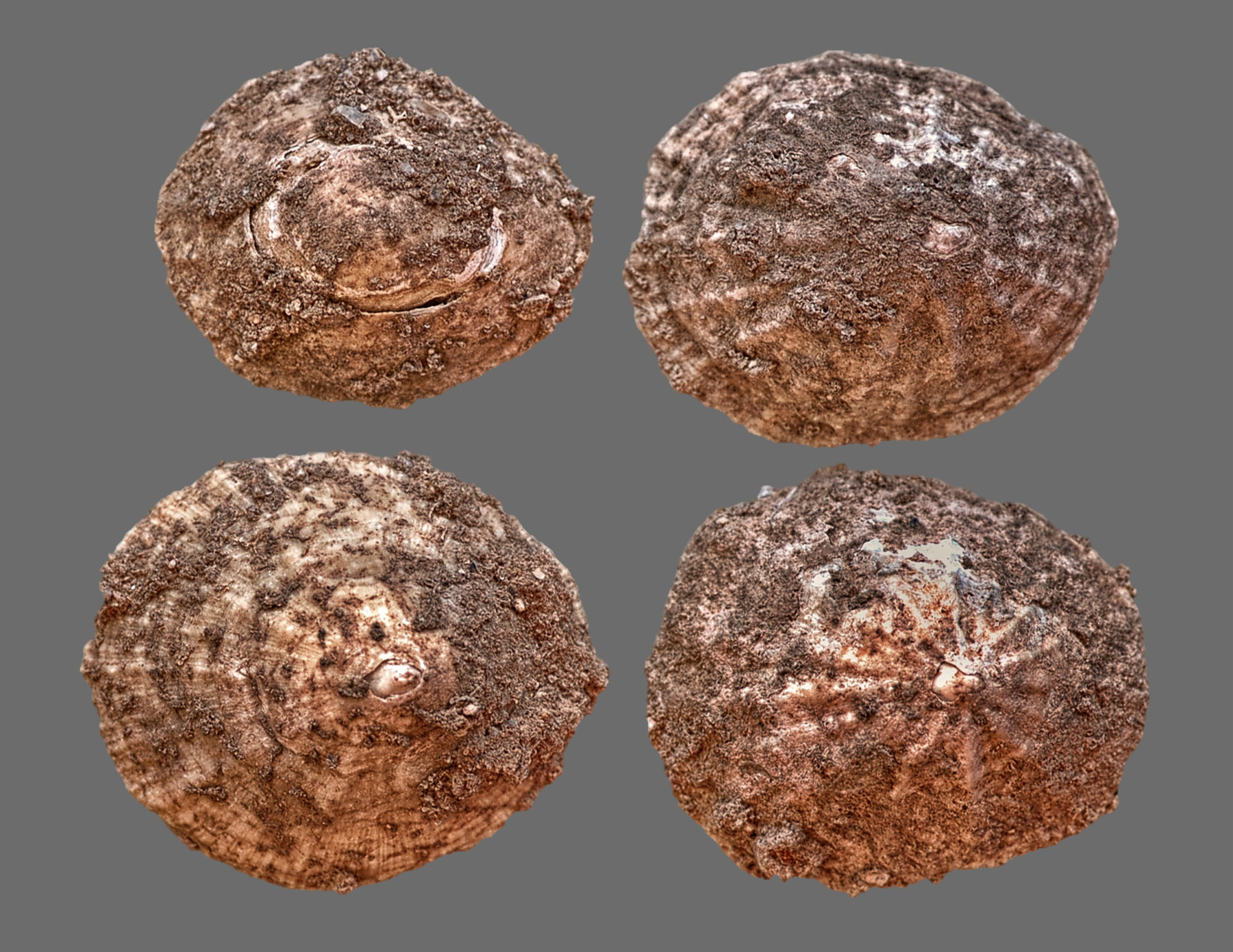

2. irudia: Itsaski eta arrainak kontsumitzen zituzten Figueira Brava haitzuloan. Argazkian, Patella vulgata espezieko lapen aztarnak. (Argazkia: Joao Zilhao / Science)

Duela 106.000-86.000 urteko aztarnategi horretan, neandertalek modu sistematikoan kontsumitzen zituzten itsas produktuak: karramarro handiak, itsas moluskuak, arrainak, itsas hegaztiak eta dortokak, besteak beste. Horrez gain, ungulatuak ere jaten zituzten. Modu berean, pinaburuetan oinarritutako jarduera ekonomikoa izan zela ondorioztatu dute. Pinaburuen garaian, horiek biltzen zituzten, eta haitzuloan gordetzen zituzten, antza, gerora pinaziak jateko.

Gaur egun ezagutzen ditugun ziklo naturaletan oinarrituta, urtaro bakoitzaren araberako elikadura izan zutela proposatu dute. Adibidez, udazkenean eta neguan bereziki hegaztiak jango zituztela iradoki dute, udara karramarroak eskuratzeko garai egokia zelarik, urtaro horretan animalia hauek sakonera txikiko uretara jo ohi dutelako. Egileek zientzia artikuluan babestu dutenez, “Europako neandertalen artean itsas baliabideen kontsumo esanguratsuaren lehen ebidentzia ematen du Figueira Bravak”.

Hain garai urrunetako arkeologian gertatu ohi den moduan, zaila da arrasto hauetatik ondorioztatzea norainoko garapena izan zuen itsasoarekiko harreman hori, adibidez, arrantza bezalako jardueretan. Zentzu honetan, egileak zuhurrak izan dira. Ohi bezala, ikerketarekin batera argitaratutako iruzkin batean egon da askatasun handiagoarekin ideiak plazaratzeko toki aproposa. Bertan, Tubingengo Unibertsitateko (Alemania) Manuel Will ikertzaileak aurkikuntzaren garrantzia goraipatu du. “Badirudi hasierako Homo sapiensek kostaldeekin eta itsas janariekin zuten antzeko elkarrekintzak erakusten dituela aurkikuntza berri honek”. Atzerapauso bat eman eta ikuspegi berri horretatik “irudi osatuagoa” eskuratzeko beharra azpimarratu du: “zenbait egoeratan, bi espezieek antzeko portaerak partekatzen zituzten”. Halere, hutsune gehiegi geratzen direla aitortu du, eta, horregatik, itsasoaren igoeraren arazoa aintzat hartuta, urpeko arkeologia bultzatzeko beharra azpimarratu du Willek.

Erreferentzia bibliografikoa:

Zilhão et al. (2020). Last Interglacial Iberian Neandertals as fisher-hunter-gatherers. Science, 367, eaaz7943. DOI: 10.1126/science.aaz7943.

———————————————————————————-

Egileaz: Juanma Gallego (@juanmagallego) zientzia kazetaria da.

———————————————————————————-

The post Neandertalen eta itsasoaren arteko harreman estua azaleratu dute appeared first on Zientzia Kaiera.

Lienzos y partituras para crear nuevas vacunas

![]()

José de la Fuente, Juan José Pastor Comin y Sara Artigas Jerónimo

“El beso”, de Israel León Viera, que representa la nueva e inexplorada interacción de AKR con AKR o de SUB con SUB.

“El beso”, de Israel León Viera, que representa la nueva e inexplorada interacción de AKR con AKR o de SUB con SUB.KGJ Colección, Author provided

¡Que suene la música! La trucha alpina al oboe. Una rana al clarinete. El fagot para la mosca del vinagre. La única persona de esta peculiar banda toca el violín, mientras que una garrapata se encarga de la viola. Completa el sexteto de viento y cuerda un Caenorhabditis elegans, un pequeño gusano de un milímetro que hará que suene un imponente chelo.

¿Puede un compositor procurar una banda sonora que transcriba los datos que emergen de la rutina experimental de tubos de ensayo y probetas? Todos los componentes de la banda tienen algo en común: una proteína en su ADN. ¿Puede la información genética trasladarse a una partitura?

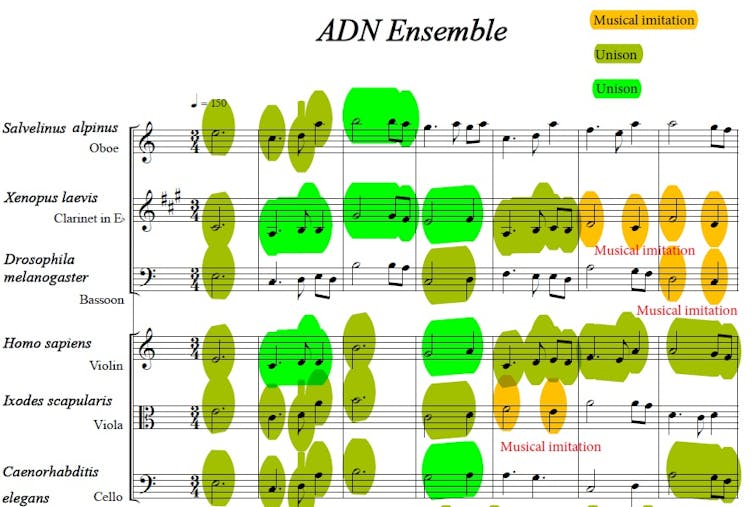

Secuencias de AKR/SUB dispuestas polifónicamente. Recurrencias y motivos.

Secuencias de AKR/SUB dispuestas polifónicamente. Recurrencias y motivos.Juan José Pastor., Author provided

La ciencia consiste en plantear nuevos interrogantes. Innovar es romper con lo establecido ¿Pueden el arte y la música ayudarnos a comprender la respuesta de nuestro organismo a una infección? ¿Y si los diseños de los artistas plásticos pudieran recoger sobre un lienzo los caminos que la ciencia debe abordar en el diseño de nuevos experimentos? ¿Podría una composición musical ayudar a entender con el comportamiento de sus voces, sus líneas melódicas, su forma y su estructura, las interacciones de las proteínas cuando estas responden ante la amenaza de un nuevo patógeno?

Para responder a esto tenemos que abrir nuestra mente. Y experimentar.

Científicos y artistas

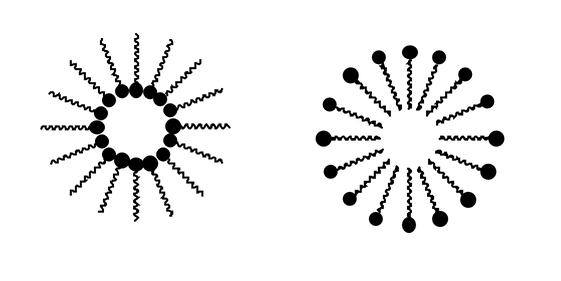

Investigadores del área de Genómica, Proteómica y Biotecnología del grupo SaBio en el Instituto de Investigación de Recursos Cinegéticos, centro mixto de la Universidad de Castilla-La Mancha y el CSIC, hemos desarrollado a través de un equipo interdisciplinar de científicos, artistas y músicos una nueva metodología. Esta nueva aproximación, publicada en el último número de la revista Vaccines, reúne el enfoque artístico y científico en la caracterización de la akirina (AKR), una proteína también conocida como subolesina (SUB) en garrapatas, para avanzar en el estudio del papel que juegan estas moléculas en la regulación de la respuesta inmune.

De esta forma, se identifican los mecanismos y genes que son expresados en nuestras células y se convierten en proteínas con un papel funcional en respuesta a la infección. Estas proteínas están muy conservadas a través de la evolución en distintas especies y han sido eficaces en el desarrollo de vacunas. Este conjunto de proteínas interactúa física y funcionalmente entre ellas en respuesta a algún estímulo, como podría ser su comportamiento ante una infección en células humanas.

La colaboración entre científicos y artistas proporcionó dos resultados:

- Un algoritmo que utiliza conjuntos musicales, basados en la akirina y secuencias de proteínas que interactúan, como un nuevo método para caracterizar la evolución y las interacciones entre proteínas.

- La sugerencia de artistas visuales de propiedades previamente inexploradas.

Este planteamiento proporciona un enfoque combinado para comprender algunas de las preguntas desafiantes de la biología molecular.

Del ADN a la partitura

Tradujimos las secuencias del ADN de la akirina de distintas especies animales a motivos musicales. Para ello utilizamos un primer algoritmo modificado que atendía a la altura y el ritmo. Esto permitió generar el patrón melódico de cada especie animal y su configuración motívica, y también observar las similitudes presentes entre las secuencias en distintas especies y la identificación de los motivos repetidos.

La representación musical no solo permitió una comprensión lineal –-melódica-– de la singularidad de cada especie estudiada, sino que permitió su visión polifónica –conjunta y simultánea-–, como una composición compleja y lógica. El análisis del contrapunto –cómo unas voces o especies se imitan unas a otras-– aportó una textura musical llena de correspondencias, que se mostraba viva a través del sonido.

Ciencia sobre lienzo

En el caso de la pintura, trasladamos al artista una hipótesis científica de partida que sirvió al pintor para expresar un problema biológico sobre los materiales artísticos elegidos y que este tratara de resolverlo a través de formas, composición, trazos y color sobre la tela y el bastidor.

Esta contribución creativa nos ayudó a representar su propia teoría de una forma original y desde un punto de vista completamente diferente, no conceptual, lejos de la organización estadística de los datos recogidos.

La nueva representación visual constituye un nuevo contexto de referencias aperturista que estimula la imaginación y la creatividad y que permite establecer nuevas hipótesis que, a la única luz de los datos experimentales obtenidos, tal vez no hubieran surgido. La representación artístico-visual sirvió no solo para identificar problemas conocidos en las formas de expresión de un lenguaje artístico, sino también para suscitar nuevas ideas divergentes.

KGJ Colección, Ciudad Real, España., Author provided

KGJ Colección, Ciudad Real, España., Author providedLos resultados mostraron de un modo plural e interdisciplinar que la interacción entre varías moléculas de AKR y SUB y las interacciones físicas con diferentes proteínas simultáneamente están involucradas en la regulación de varios procesos biológicos. Además, ayudaron a entender, a través de estas nuevas formas de representación artística y musical, el papel de las interacciones estudiadas en la regulación positiva y negativa de respuesta inmune. Así entendimos cómo se activa o suprime la expresión de algunos genes concretos.

¿Qué implicaciones alcanza esta colaboración? No solo contribuye a la investigación, sino que puede lograr el desarrollo de vacunas para el control de infestaciones por garrapatas, así como para el estudio de patógenos transmitidos por estas.

Este puede ser un avance esencial en contextos de exclusión social en un mundo que cuenta con un importante índice poblacional situado bajo el umbral de pobreza. Ahí es donde científicos y artistas pueden avanzar juntos y de la mano, iluminando el avance de la investigación ante los nuevos desafíos científicos que permitan construir un mundo mejor.![]()

Sobre los autores: José de la Fuente es profesor de investigación en el Instituto de Investigación en Recursos Cinegéticos (CSIC – Universidad de Castilla-La Mancha) y profesor adjunto en el departamente de patobiología veterinaria de la Universidad Estatal de Oklahoma (Estados Unidos); Juan José Pastor Comin es es profesor titular del área de Música en la Universidad de Castilla-La Mancha y co-director del Centro de Investigación y Documentación Musical (CIDoM); Sara Artigas Jerónimo es investigadora predoctoral en el Instituto de Investigación en Recursos Cinegéticos.

Este artículo fue publicado originalmente en The Conversation. Artículo original

El artículo Lienzos y partituras para crear nuevas vacunas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Dudas sobre las vacunas: problemas y soluciones

- Nuevas tecnologías para el estudio del cerebro: Desde Cajal a nuestros días

- Desmitificando: Vacunas peligrosas

Gaztagintzako prentsaketa-teknikak: gure arbasoetatik gaur egunera arte

1. irudia: Juan Atxa Bartolome artzaina (1900-1978) gaur egungo garaietara ekarria (Etxarri Aranatz).

Mamiaren prentsaketa urrats bat besterik ez da gaztagintzan eta hiru helburu nagusi ditu: gazura kanporatzea, gaztaren azala eratzea eta gaztari forma ematea. Berez, prentsaketan zehar, presioa gradualki handitu behar da. Hasieran presio handiegia eragiten bada, gaztaren azala azkarregi eratzen da (poroak itxi), eta honek gazuraren irteera oztopatzen du.

2. irudia: Gaztanontziak: a) gazta-azalarekin erabiltzen zen zortzea eta b) zumitza (Iruñeko Erresumaren Museo Etnografikoa, Arteta).

Prentsaketa-prozesuan molde zulodunak erabiltzen dira, gaztanontziak, alegia. Zulo horietatik gazura ateratzen da mamia prentsatzean. Noizbait zeramikazko eta metalezko gaztanontziez baliatu izan bada ere, Euskal Herrian gehien bat egurrezko gaztanontziak erabili izan dira, gazta-azala eta zumitza, alegia.

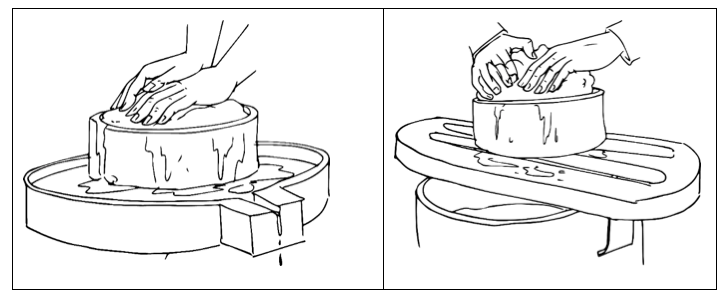

3. irudia: Eskuzko prentsaketa a) gazta-azalarekin eta b) zumitzarekin.

Mendeetan zehar prentsaketa eskuz egin izan da. Leku batzuetan, duela gutxira arte mantendu da ohitura hau, adibidez, Erronkariko ibarrean. Bordatan egurrezko azpil bat izaten zuten, zortze izenekoa. Zortzearen gainean, gazta-azala jarri ohi zuten, eta barruan mamia sartzen zuten prentsatzeko.

Beste toki batzuetan, berriz, zumitza erabiltzen zuten. Mamiaren gainean eskuz, edo estalki baten bitartez, presionatzen zuten. Zumitzaren azpian txurka izeneko ohol luze eta zuloduna jartzen zen, gazura abatzean jasotzeko. Askotan, eskuekin eragin beharrean, zumitzaren estalkiaren gainean zama bat jartzen zen hainbat orduz. Horrela, mamiak, presio konstantepean, gazura askatzen zuen poliki poliki.

Prentsaketa-prozesua errazteko, artzainak prentsak erabiltzen hasi ziren. Zoritxarrez, gaur egun ez dakigu zehaztasunez noiz. Palanka mekanismodun prentsa da Euskal Herrian gehien erabili dena. Holako prentsak oso sinpleak dira, eta horregatik, oso zabalduta daude munduan zehar ere. Eskegitako zamaren indarra 2-3 aldiz biderkatzen zuten (diseinuaren arabera).

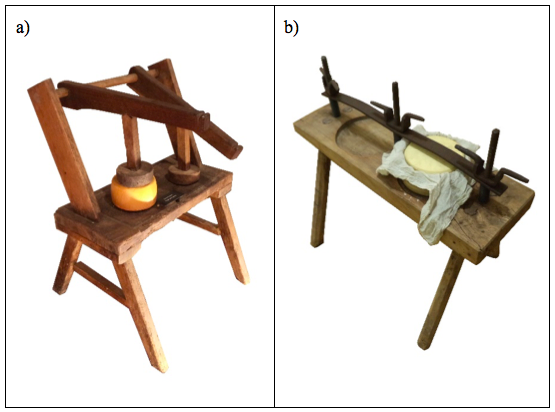

4. irudia: Euskal Herrian erabilitako hainbat gazta-prentsa: a) palankadun prentsa (Erreizabal baserria – Artzaintzaren Ekomuseoa, Legazpi) eta b) torlojudun prentsa (Gaztaren Interpretazio Zentroa, Idiazabal).

Torlojuak erabiltzen dituzten prentsak ere erabili izan dira Euskal Herrian. Prentsa hauek bi torloju izan ohi dituzte, eta horiei esker, eragin beharreko indarra txikia izaten da.

Gaztagintza tradizionalean erabilitako prentsak gehienbat egurrezkoak izan ohi ziren. Berriz, gaur egungo prentsak metalikoak dira, gehienetan aluminiozkoak, eta gaztanontziak plastikozkoak edo altzairu herdoilgaitzetakoak. Horrela, gehiago irauten dute, eta gainera, garbitzeko errazagoak dira.

XX. mendearen bukaeran, malgukidun prentsak hedatu ziren gurean. Holako prentsetan malgukiaren konpresioak sortzen du eragin beharreko presioa. Gaur egun, prentsa pneumatikoak (aire konprimitua) eta hidraulikoak (olioa) ere erabiltzen dira, artzainen lana errazteko. Holako prentsa modernoetan, gaztak multzoka jartzen dira, horizontalki edo bertikalki, eta aldi berean prentsatzen dira.

Iturria:

Campillo-Robles, Jose Miguel; Atxa, Ariane; Telleria, Laura; Domingo, Itxaso (2019). «Gaztagintzako prentsaketa-teknikak: gure arbasoetatik gaur egunera arte»; Ekaia, 35, 2019, 241-257. (https://doi.org/10.1387/ekaia.19681).

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: Ekaia 35

- Artikuluaren izena: Gaztagintzako prentsaketa-teknikak: gure arbasoetatik gaur egunera arte.

- Laburpena:Mamiaren prentsaketa prozesu garrantzitsua da gaztagintzan. Horri esker, mamiak gazura galtzen du. Berez, gaztaren kontserbazio egokia lortzeko, mamiaren hezetasuna txikitu behar da. Gainera, prentsaketari esker, gaztaren azala eratzen da, eta gaztari forma egokia ematen zaio. Mendeetan zehar, eskuzko prentsaketa erabili izan da gehienbat, baina XIX. mendearen bukaeratik prentsen erabilera zabaldu da. Orain arte erabilitako prentsaketa-teknikak eta tresneria oso gutxi deskribatu dira bibliografian. Hori dela eta, dokumentu honetan gai honi buruz egindako bilaketa-lana aurkezten dugu; zehazki, Euskal Herrian erabili izan diren prentsaketa-teknikak jasota daude, bai eta zeregin horretan erabili diren tresnak ere.

- Egileak: Jose Miguel Campillo-Robles, Ariane Atxa, Laura Telleria, Itxaso Domingo.

- Argitaletxea: UPV/EHUko argitalpen zerbitzua.

- ISSN: 0214-9001

- Orrialdeak: 225-238

- DOI: 10.1387/ekaia.19681

————————————————–

Egileez:

Jose Miguel Campillo-Robles UPV/EHUko Zientzia eta Teknologia Fakultateko Fisika Aplikatua II sailean dabil eta Ariane Atxa, Laura Telleria, Itxaso Domingo Mondragon Unibertsitatean dabiltza.

———————————————–

Ekaia aldizkariarekin lankidetzan egindako atala.

The post Gaztagintzako prentsaketa-teknikak: gure arbasoetatik gaur egunera arte appeared first on Zientzia Kaiera.

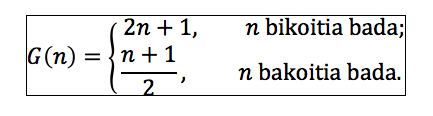

La cuadratura del cuadrado: las redes eléctricas de Kirchhoff

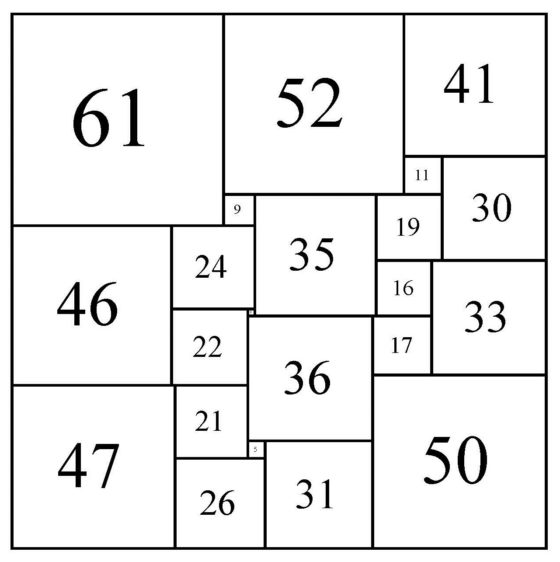

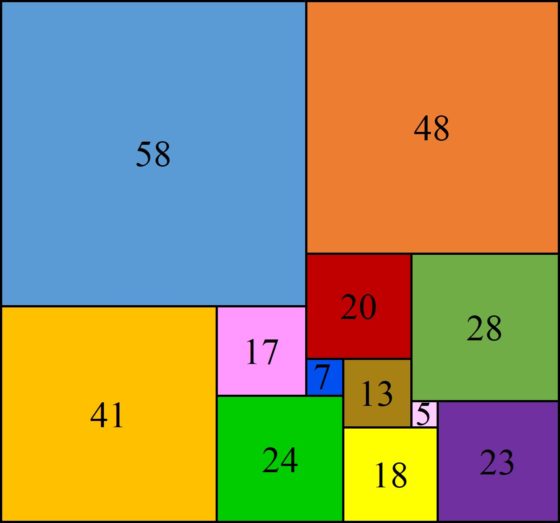

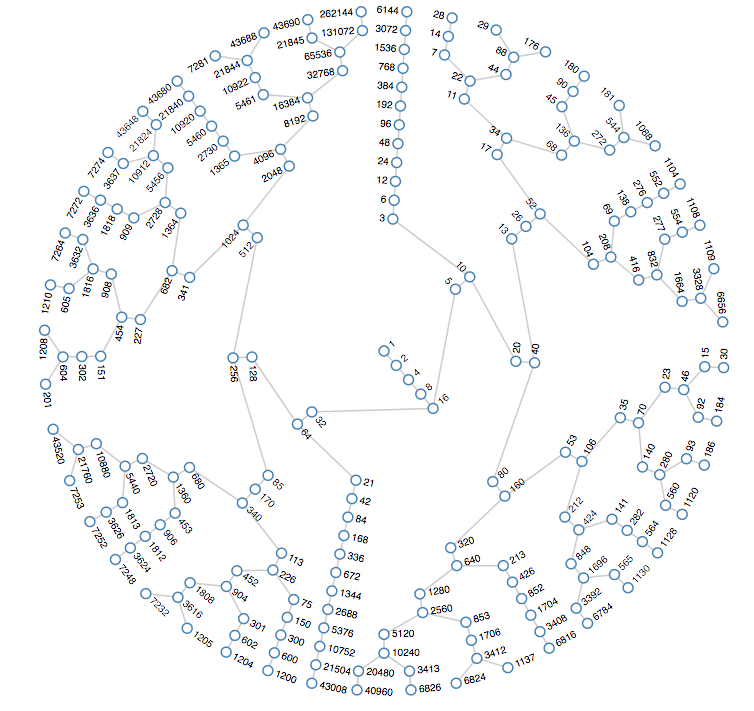

En mi anterior entrada del Cuaderno de Cultura Científica La cuadratura del cuadrado: en busca del santo grial estuvimos hablando de un hermoso rompecabezas matemático, el problema de la cuadratura perfecta del cuadrado, que recuerdo a continuación:

Problema de la cuadratura perfecta del cuadrado (o rectángulo): Dividir un cuadrado (o rectángulo) en un número finito de cuadrados más pequeños, todos de distintos tamaños.

Este problema, que durante mucho tiempo se pensó que no tenía solución para cuadrados, lo que se conoció como la conjetura de Luzin, fue finalmente resuelto en positivo, alrededor del año 1939, por dos grupos de matemáticos. Por una parte, el matemático alemán Roland P. Sprague (1894-1967) construyó un cuadrado con una cuadratura perfecta, pero compuesta (recordemos que eso significa que contiene la cuadratura de algún sub-rectángulo), de orden 55. Mientras que los cuatro estudiantes del Trinity College de la Universidad de Cambridge (Reino Unido), Rowland L. Brooks (1916-1993), Cedric A. B. Smith (1917-2002), Arthur H. Stone (1916-2000) y William Th. Tutte (1917-2002), consiguieron construir el primer cuadrado perfecto simple (no compuesto), también de orden 55. Para ello, los cuatro de Trinity (puede leerse más sobre ellos en la entrada Blanche Descartes y la cuadratura del cuadrado) relacionaron el problema de las disecciones cuadradas de los rectángulos, en particular, de los cuadrados, con la teoría de las redes eléctricas de Kirchhoff, que es de lo que vamos a hablar en esta entrada.

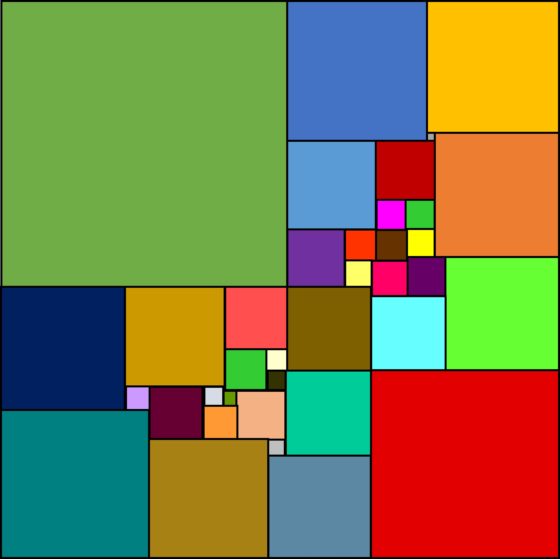

Una de las ocho cuadraturas perfectas simples del cuadrado de orden 22 que existen. Imagen de la página Tiling by squares, de Stuart Anderson

Una de las ocho cuadraturas perfectas simples del cuadrado de orden 22 que existen. Imagen de la página Tiling by squares, de Stuart AndersonComo explicamos en la anterior entrada, La cuadratura del cuadrado: en busca del santo grial, el primer acercamiento de los jóvenes estudiantes de Cambridge, Brooks, Smith, Stone y Tutte, fue experimental. Intentaron construir mediante una sencilla técnica algebraica algún ejemplo de disección de un cuadrado en cuadrados más pequeños de diferentes tamaños. Con esta técnica sí consiguieron construir algunos ejemplos de cuadraturas perfectas de rectángulos, pero no de cuadrados. Este método experimental dependía demasiado de la suerte y podrían no encontrar nunca el ansiado grial, una cuadratura perfecta del cuadrado. Era como encontrar una aguja en un pajar, sin saber además si había aguja. Por este motivo, abandonaron el camino experimental a favor de un enfoque más teórico, que además les permitiera conocer más sobre el problema.

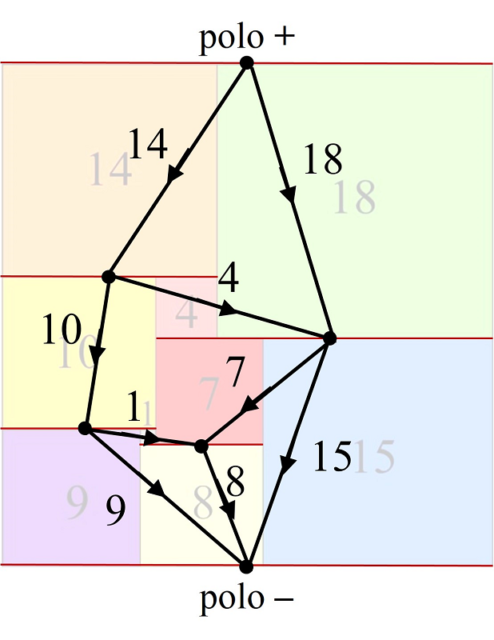

Entonces, empezaron a asociar diferentes tipos de diagramas a las cuadraturas de los rectángulos. Hasta que llegaron a un diagrama propuesto por Cedric Smith, que sus compañeros no dudaron en llamar el “diagrama de Smith”, que asociaba cada cuadratura de un rectángulo con el grafo de una red eléctrica.

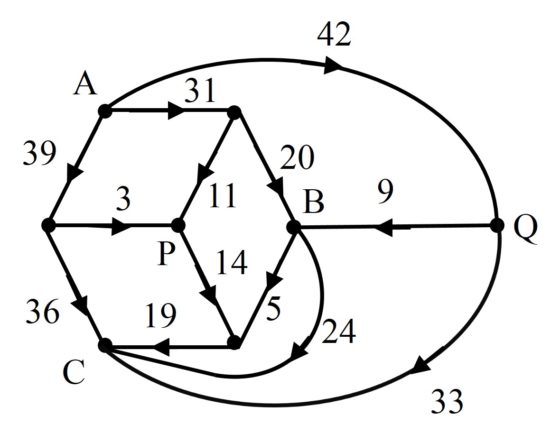

Para ilustrar la construcción de la red eléctrica asociada a una cuadratura, consideraremos el ejemplo de la división de un rectángulo de dimensiones 32 x 33 en 9 cuadrados de distintos tamaños, de lados 1, 4, 7, 8, 9, 10, 14, 15 y 18, luego de orden 9, obtenida por el matemático polaco Zbigniew Moron en 1925, que aparece en la siguiente imagen. Cada segmento horizontal se representará como un vértice del grafo y dos vértices estarán unidos mediante una arista si existe un cuadrado que tiene su lado superior apoyado en el segmento horizontal correspondiente a uno de los vértices y su lado inferior apoyado en el segmento horizontal del otro vértice. Además, el grafo está dirigido, como se muestra mediante las fechas de las aristas, de arriba hacia abajo, que es el orden de la corriente eléctrica, del polo positivo (que consideramos el vértice del lado horizontal superior) al polo negativo (el vértice del lado horizontal inferior). Más aún, es un grafo etiquetado, ya que asociamos a cada arista el valor del lado del cuadrado correspondiente, que será el valor de la corriente eléctrica.

Diagrama de Smith de la cuadratura perfecta del rectángulo de dimensiones 32 x 33 en 9 cuadrados de distintos tamaños, de lados 1, 4, 7, 8, 9, 10, 14, 15 y 18

Diagrama de Smith de la cuadratura perfecta del rectángulo de dimensiones 32 x 33 en 9 cuadrados de distintos tamaños, de lados 1, 4, 7, 8, 9, 10, 14, 15 y 18

Lo curioso es que el diagrama de Smith cumple las leyes de Kirchhoff para las redes eléctricas, asumiendo que la resistencia de cada arista es igual a 1. La primera ley de Kirchhoff establece que en cada nodo (vértice) del circuito eléctrico, con excepción de los polos, la suma de las corrientes debe ser cero, es decir, la suma de las corrientes que entran en el nodo es igual a la suma de las corrientes que salen del mismo. Por ejemplo, si miramos a la red eléctrica anterior, en el primer vértice después del polo positivo, entra una corriente de 14 y salen dos de 10 y 4, o en el siguiente entran dos corrientes de 4 y 18, mientras que salen dos corrientes de 7 y 15. Esto es debido a que, en un segmento horizontal (vértice) cualquiera de la cuadratura del rectángulo, la suma de los lados de los cuadrados que se apoyan en el segmento desde arriba (la suma de las corrientes que entran) es igual a la suma de los lados de los cuadrados que se apoyan en el segmento desde abajo (la suma de las corrientes que salen), que en ambos casos es la longitud del segmento horizontal.

Teniendo en cuenta que, por la ley de Ohm de los circuitos eléctricos, la diferencia de potencial de cada arista del circuito es igual al producto de la resistencia, que en este caso hemos asumido que es 1, por la corriente, ambas –diferencia de potencia y corriente- son iguales. Por lo tanto, la segunda ley de Kirchhoff establece que la suma algebraica de las corrientes –diferencias de potencial- de cualquier circuito cerrado es cero. En el ejemplo de arriba, en el primer circuito cerrado tenemos que 14 + 4 – 18 = 0 o en el segundo 10 + 1 – 7 – 4 = 0. Esto es debido a que cada segmento vertical de la cuadratura del rectángulo se corresponde con un circuito cerrado, y la suma de las longitudes de los lados de los cuadrados a izquierda y derecha del segmento valen lo mismo, la longitud del segmento vertical.

La corriente que entra en el circuito eléctrico por el polo positivo, que es igual a la que sale por el polo negativo, es la longitud de los lados horizontales del rectángulo. En el ejemplo de arriba, 14 + 18 = 9 + 8 + 15 = 32. Por otra parte, la diferencia de potencial entre los dos polos es igual a la longitud de los lados verticales del rectángulo. De nuevo, en el ejemplo la diferencia de potencial la podemos calcular a través de cualquiera de los recorridos entre el polo positivo y el negativo, 14 + 10 + 9 = 14 + 4 + 7 + 8 = 18 + 15 = 33, entre otros. Por lo tanto, si la corriente que entra por el polo positivo, y sale por el negativo, es igual a la diferencia de potencial, estaríamos ante un circuito eléctrico que se corresponde con la cuadratura del cuadrado.

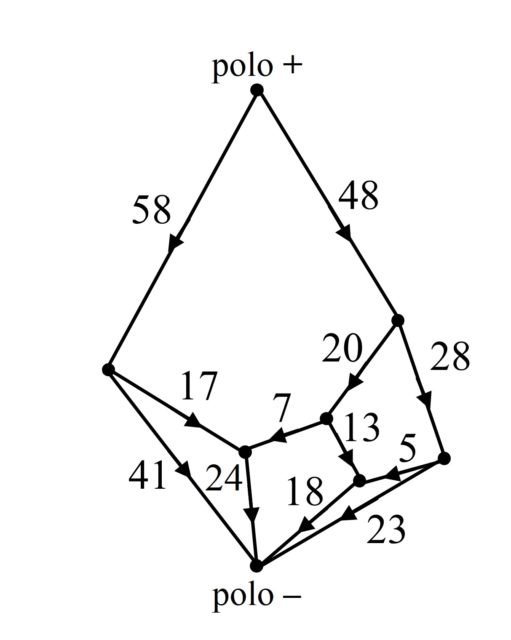

Diagrama de Smith asociado a una cuadratura perfecta de un rectángulo

Diagrama de Smith asociado a una cuadratura perfecta de un rectángulo

En conclusión, cada cuadratura de un rectángulo se corresponde con una red eléctrica, lo cual les permitió utilizar los conocimientos de la teoría de redes eléctricas para estudiar el problema de la cuadratura de los rectángulos, y del cuadrado. Por ejemplo, en la imagen anterior tenemos una red eléctrica, os dejo como divertimento el construir la cuadratura del rectángulo asociada (solución al final de la entrada).

En particular, esto simplificó el problema de construir y clasificar las cuadraturas perfectas simples de rectángulos. Por ejemplo, analizaron todos los circuitos eléctricos con hasta 11 aristas y construyeron las cuadraturas de rectángulos asociadas. Así probaron que no existen cuadraturas perfectas simples de rectángulos de orden menor que 9, que solo hay dos de orden 9 (mostradas en la anterior entrada La cuadratura del cuadrado: en busca del santo grial, una de ellas es la asociada al primer circuito eléctrico que hemos mostrado más arriba), seis de orden 10 y veintidós de orden 11. Y siguieron clasificando las cuadraturas de orden 12, que hay sesenta y siete, y después de orden 13. Este fue el inicio de una fructífera investigación sobre las cuadraturas perfectas de rectángulos. Pero como veremos, también del cuadrado.

Uno de los estudios que realizaron fue el análisis de redes eléctricas con ciertas simetrías. Por ejemplo, consideraron el circuito eléctrico asociado a un cubo, vértices y aristas, que no proporcionaba cuadraturas perfectas de rectángulos, pero cuando se añadía una de las diagonales de una de las caras del cubo, se obtenía el diagrama de Smith de la siguiente imagen y la correspondiente cuadratura perfecta simple del rectángulo, que se muestra después.

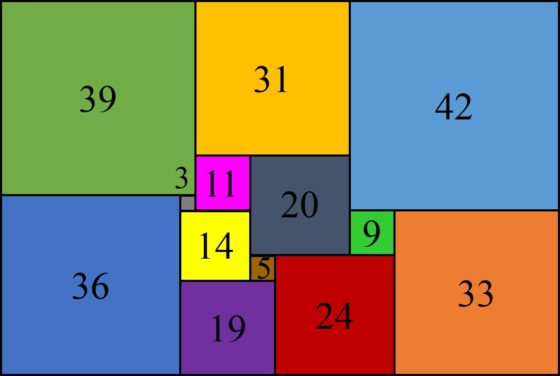

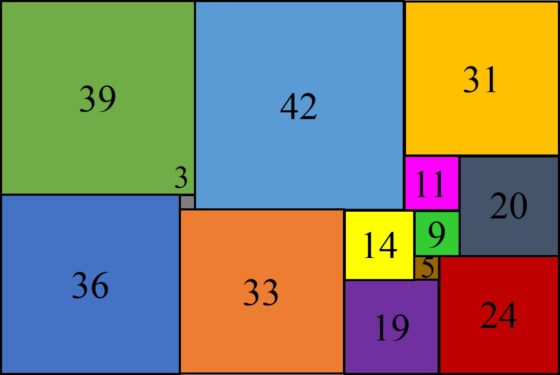

Red eléctrica definida sobre un cubo, junto con una diagonal de una de sus caras, introducida por Brooks, Smith, Stone y Tutte, para construir cuadraturas perfectas simples de rectángulos

Red eléctrica definida sobre un cubo, junto con una diagonal de una de sus caras, introducida por Brooks, Smith, Stone y Tutte, para construir cuadraturas perfectas simples de rectángulos

Cuadratura perfecta simple de un rectángulo de dimensiones 112 x 75 obtenida a través del circuito eléctrico anterior

Cuadratura perfecta simple de un rectángulo de dimensiones 112 x 75 obtenida a través del circuito eléctrico anterior

Una bonita historia relacionada con esta cuadratura del rectángulo es la siguiente. Leonhard Brooks estaba tan satisfecho con este ejemplo que decidió construirse un rompecabezas geométrico cuyas piezas eran los cuadrados de la cuadratura del rectángulo anterior, es decir, de lados 3, 5, 9, 11, 14, 19, 20, 24, 31, 33, 36, 39 y 42, con el que jugar a realizar el rectángulo original. Entonces su madre cogió el rompecabezas para jugar con él y consiguió formar el rectángulo con ellas, pero resultó que no era la misma solución anterior, las piezas estaban colocadas de forma diferente. Con la ayuda de la madre de Brooks, habían encontrado dos disecciones perfectas simples del rectángulo 112 x 75 realizadas con los mismos cuadrados.

Segunda cuadratura perfecta simple del rectángulo de dimensiones 112 x 75 realizada con los mismos cuadrados que la anterior

Segunda cuadratura perfecta simple del rectángulo de dimensiones 112 x 75 realizada con los mismos cuadrados que la anterior

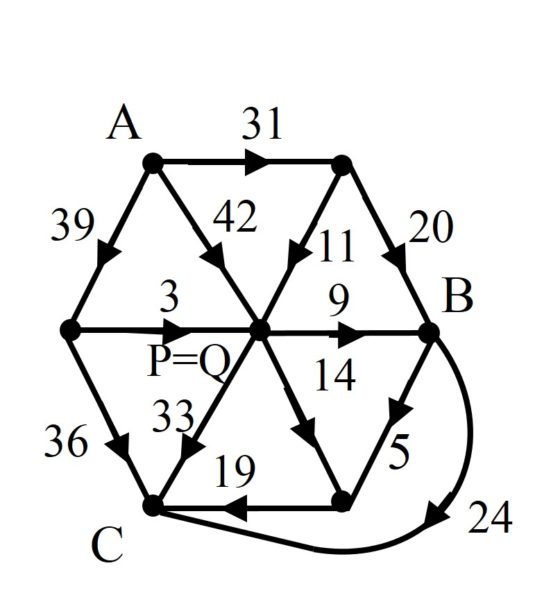

La red eléctrica asociada a esta nueva descomposición perfecta y simple del rectángulo 112 x 75 se puede obtener a partir del primer circuito eléctrico (que está representado arriba) identificando los vértices P y Q, lo cual es posible ya que tienen la misma diferencia de potencial, en concreto, 42.

Red eléctrica asociada a la anterior descomposición perfecta simple del rectángulo 112 x 75, que se puede obtener a partir de la anterior identificando P y Q

Red eléctrica asociada a la anterior descomposición perfecta simple del rectángulo 112 x 75, que se puede obtener a partir de la anterior identificando P y Q

Analizaron el motivo por el cual se producía este fenómeno y tenía que ver con la simetría de algunas redes eléctricas, aunque no entraremos en los detalles técnicos en esta entrada, por este motivo empezaron a analizar circuitos eléctricos en los cuales cogían la red eléctrica anterior, que habían obtenido a partir del cubo, y sustituyeron la parte simétrica central (el hexágono plano que contiene a los vértices A, B, C y centro P) por otras estructuras simétricas. Así consiguieron obtener más ejemplos de dobles cuadraturas perfectas simples de un mismo rectángulo con los mismos cuadrados.

Esta técnica, después de seguir investigando y obtener otros ejemplos, les llevó a encontrar su primer ejemplo de cuadratura perfecta de un cuadrado. La pieza central simétrica tenía la siguiente forma.

La cuadratura perfecta, que era compuesta, que obtuvieron era de orden 39, es decir, formada por 39 cuadrados de diferentes tamaños, que componían un cuadrado de lado 4.639. Utilizando el código de Bouwkamp que explicamos en la anterior entrada, esta era la cuadratura [2.378, 1.163, 1.098], [65, 1.033], [737, 491], [249, 242], [7, 235], [478, 259], [256], [324, 944], [219, 296], [1.030, 829, 519, 697], [620], [341, 178], [163, 712, 1.564], [201, 440, 157, 31], [126, 409], [283], [1231], [992, 140], [852]. Como cada corchete del código de Bouwkamp nos dice qué cuadrados, su lado, están debajo de cada segmento horizontal, de arriba abajo, podemos ver qué cuadratura prefecta del cuadrado, de lado 4.639, habían construido.

Cuadratura perfecta, compuesta, de un cuadrado de lado 4.639, de orden 39, construida por Brooks, Smith, Stone y Tutte utilizando la teoría de las redes eléctricas

Cuadratura perfecta, compuesta, de un cuadrado de lado 4.639, de orden 39, construida por Brooks, Smith, Stone y Tutte utilizando la teoría de las redes eléctricas

Poco después, encontrarían el primer ejemplo de cuadratura perfecta simple de un cuadrado de orden 55, utilizando las mismas técnicas.

Como hemos podido ver, relacionar las cuadraturas perfectas de los rectángulos con redes eléctricas se demostró una técnica muy fructífera en la resolución del problema de la cuadratura del cuadrado, y del rectángulo, y en el estudio general de estas cuestiones.

Y, por cierto, la solución a la cuestión planteada arriba sobre cuál es la cuadratura perfecta asociada a la red eléctrica que habíamos mostrado, es la siguiente.

Cuadratura perfecta simple de un rectángulo de tamaño 106 x 99 de orden 12, que es la solución al divertimento que os he dejado arriba de encontrar la cuadratura asociada a la red eléctrica mostrada

Cuadratura perfecta simple de un rectángulo de tamaño 106 x 99 de orden 12, que es la solución al divertimento que os he dejado arriba de encontrar la cuadratura asociada a la red eléctrica mostrada

Bibliografía

1.- Wolfram MathWorld: Perfect Square Dissection.

2.- Stuart Anderson, Tiling by squares.

3.- Martin Gardner, The 2nd Scientific American Book of Mathematical Puzzles and Diversions, University of Chicago Press, 1987. Contiene el capítulo de W. Th. Tutte Squaring the square.

4.- Wikipedia: Kirchhoff’s circuit laws

5.- Arkadiusz Maciuk, Antoni Smoluk, Tiling by squares, Kirchhoff’s Laws and a Flow Problem in the Economy, Didactics of Mathematics, n. 14 (18), 2017.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo La cuadratura del cuadrado: las redes eléctricas de Kirchhoff se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La cuadratura del cuadrado: en busca del santo grial

- Blanche Descartes y la cuadratura del cuadrado

- ¿Sueñan los babilonios con multiplicaciones eléctricas?

Nola eta zergatik egiten da maionesa?

1. irudia: Maionesa patata frijituak bustitzeko saltsa aproposa da, baita beste hainbat elikagai prestatzeko ere. (Argazkia: skeeze – domeinu publikoko irudia. Iturria: pixabay.com)

Maionesaren gaia ez da lehen aldiz aztertu EHUko Kultura Zientifikoko Katedraren blogetan. Hain zuzen ere, sarean dago irakurgai Déborah García Bello zientzia-dibulgatzailearen ekarpena eta, benetan, irakurtzea merezi du. Hemen beste modu batera emango dira azalpenak, modu osagarrian. Lehenik eta behin, maionesaren gaiak emultsioen kimikaz hitz egiteko aukera ematen du eta hori oso interesgarria da. Beste alde batetik, maionesaren osagaietan ere jar daiteke begirada. Has gaitezen hortik.

Oro har, maionesa egiteko behar diren osagaiak hauek dira: arrautza, olioa, ozpina edo limoi zukua eta gatza. Osagai bakoitza oso garrantzitsua da eta bakoitzak bere funtzio zehatza du. Hasteko, azter dezagun osagai horiek nola nahastu behar diren maionesa zaporetsua lortzeko -maionesa alferrik galdu gabe, noski-. Lehen pausoa ontzi batean arrautza jartzea da. Jarraian, olio pixka bat gehitzen da eta irabiagailua sartzen da ontzian. Ondoren, ozpina -edo limoi zukua- eta gatza gehitzen dira eta irabiagailua sartzen da ontzian. Irabiagailua martxan jarri eta, tresna guztiz geldi dagoela, ondo nahasten dira osagaiak emultsioa sortzen hasi arte. Azkenik, olioa pixkanaka gehitzen jarraitu behar da, orain bai, irabiagailua gora eta behera mugitzen den bitartean –bideo honetan ikus daiteke nola egin-. Gehitutako olio kantitatearen arabera, maionesa lodiagoa edo arinagoa lortu da, baina, hori norberaren nahiaren araberakoa da.

Pausoak aipatutako orden jakin horretan maionesa inoiz ez da minduko eta beti lortuko da saltsa goxo eta zaporetsua. Maionesa, azken batean emultsio bat da, alegia, hasiera batean nahastezinak diren bi substantzia edo gehiagoren nahaste itxuraz homogeneoa. Definizio horretan bertan aurkitzen da maionesa hain delikatua izatearen arrazoia. Nahaste hori egonkorra izateko -denbora batez behintzat- emultsionatzaile deritzen substantziak behar dira. Maionesaren kasuan, ura eta olioa dira hasiera batean nahastezinak diren substantziak. Hain zuzen ere, maionesa olioa-uretan –oil in water, O/W- motako emultsioa da. Alderantzizko emultsioak ere badaude, ura-oliotan –water in oil, W/O-. Horrek esan nahi du, maionesaren kasuan olio tantatxoak urez inguratuta daudela emultsioa osatzen.

Jakina, emultsio hori, bere horretan, ez litzateke oso iraunkorra. Bideo honetan argi ikusten da ura eta olioa irabiatzen direnean emultsioa lor daitekeela, baina, besterik ez bada gehitzen nahaste horrek ez duela asko irauten. Denbora gutxi pasatakoan, ura eta olioa bereizi egiten dira berriz. Alabaina, nahastean beste osagai bat gehitzen bada, substantzia nahastezin horiek emultsio egonkorra osa dezakete. Substantzia horiek emultsionatzaileak dira, hain zuzen ere. Hala ere, horrek bi galdera sortuko dizkio artikulu honen irakurleari. Alde batetik, non demontre dago ura maionesan, osagaietan ez bada aipatu? Eta, beste alde batetik, non daude emultsionatzaileak, osagaietan ez badira aipatu? Bada, bi galdera horien erantzuna bera da: arrautza.

Zientza Kaierako irakurleek dakitenez, arrautzaren osagai nagusiena ura da -%80 inguru, zuringoa eta gorringoa kontuan hartuta-. Hortaz, bertan dago maionesa egiteko beharrezkoa den ura. Bestalde, arrautzaren gorringoan badira hainbat sustantzia emultsionatzaile funtzioa dutenak, besteak beste, lezitina. Lehenago aipatutako bideora itzulita, bertan oso ondo ikusten da ura eta olioari arrautzaren gorringoa gehitzen bazaio, ura eta olioa ez direla berriro banatzen. Emultsionatzaileak zati polarra eta zati apolarra dauka eta, hortaz, mizelak osatzeko gai da dagoen ingurunearen arabera. Uretan badago -disolbatzaile polarra-, emultsionatzailearen zati polarra kanporantz jartzen da eta zati apolarra barrurantz (2. irudian, eskuinean). Oliotan -apolarra- badago, aldiz, emultsionatzailearen zati apolarra kanporantz jartzen da eta zati polarra barrurantz (2. irudian, ezkerrean).

2. irudia: Emultsionatzaileak mizelak osatzen ingurune apolarrean (eskuinean) eta ingurune polarrean (ezkerrean). Puntu beltz lodiak zati polarra adierazten du eta lerro uhinduak zati apolarra. (Argazkia: CIker-Free-Vector-Images – domeinu publikoko irudia. Iturria: pixabay.com)

Maionesa olioa-uretan, O/W, emultsioa denez, horrek esan nahi du uretan egon behar dela emultsionatzailea eta ez alderantziz. Alegia, 2. irudian eskuinean ikusten diren motako mizelak osatu behar dira eta hor barruan sartu behar dira olio tantatxoak. Horrexegatik da hain garrantzitsua lehenik arrautza gehitzea eta ondoren olioa pixkanaka gehitzea. Hasiera batean mizela uretan osatu behar da eta gero, pixkanaka, olioak mizelen barruan sartu behar du. Modu horretan, emultsio egonkorra lortzen da. Alderantziz egiten bada -hasieran olio gehiegi jarrita-, 2. irudian ezkerrean dauden mizelak osatzen dira eta ura sartzen da mizelen barruan. Hori gertatzen denean, maionesa mindu egin dela esaten da eta alferrik galtzen da egindako lana. Maionesa horrek ez du balio.

Maionesan dagoen kimika ulertuta, errazagoa da aztertzea zeintzuk diren saltsa hori prestatzerakoan egiten diren ohiko akatsak. Lehenik eta behin, osagai guztiak giro tenperaturan egotea gomendatzen da. Honen arrazoia zera da: arrautza hotza baldin badago -hozkailutik atera berria- emultsionatzaileei gehiago kostatzen zaie gorringotik atera eta mizelak osatzea. Beste alde batetik, osagaiak gehitzeko ordena gakoa da, aipatu dugun bezala -arrautza eta gero olioa, eta ez alderantziz-. Azkenik, olio gehiegi gehitzea ere akatsa da; izan ere, gorringo batek duen emultsionatzaile kantitatearen arabera osatu ahal izango dira mizelak, baina, olio gehiago badago, ezingo dira tantatxoak osatu.

Maionesaren osagai guztiak garrantzitsuak dira, baina, gatza eta limoi zukua edo ozpina oraindik ez dira aipatu. Limoi zukuak azido zitrikoa dauka eta ozpinak, aldiz, azido azetikoa. Edozein dela aukeratzen dena -gustuen arabera-, azidoak emultsioa egonkortzen du eta, hortaz, errazago osatzen da emultsioa eta behin osatuta, denbora gehiago irauten du. Gatzak ere badu bere funtzioa: horri esker, gorringoa errazago apurtzen da eta emultsionatzaileek lehenago osatzen dituzten mizelak. Kalkuluen arabera, maionesaren %80 arte izan daiteke olioa edo, beste modu batera, olio bolumen bakoitzeko bolumen horren herena izan behar da beste osagai guztien batura -gorringoa, zuringoa, ozpina, ura eta beste osagaiak, baldin badaude-.

Esandako guztiaren ondorioz, orain hobeto uler daiteke maionesa nola egiten den, baina, batez ere, zergatik egin behar den horrela. Osagaietako bakoitzak bere funtzio kimikoa du eta pausoak arrazoi kimiko baten ondorioz egin behar dira horrela. Nolanahi ere, maionesak sekretu gutxi ditu bere kimika ulertzen bada eta beti lortuko dugu maionesa goxoa egitea inoiz alferrik galdu gabe. Jakina, sukaldea laborategi kimiko bat bada ere, sukaldariaren sena behar-beharrezkoa da elikagai zaporetsuak lortzeko eta, horretarako, esperimentatzen hastea da bide bakarra.

Informazio gehiago:

- La cocina y los alimentos, Harold McGee, Debate, 2017.

- ¿Por qué se corta la mayonesa y qué relación tiene esto con la cosmética?, Deborah García Bello, Cuaderno de Cultura Científica, culturacientifica.com, 2019.

—————————————————–

Egileaz: Josu Lopez-Gazpio (@Josu_lg) Kimikan doktorea, irakaslea eta zientzia dibulgatzailea da. Tolosaldeko Atarian Zientziaren Talaia atalean idazten du eta UEUko Kimika sailburua da.

—————————————————–

The post Nola eta zergatik egiten da maionesa? appeared first on Zientzia Kaiera.

Sólidos cuánticos

Foto: Pixabay

Foto: PixabayUno de los primeros grandes éxitos de la hipótesis cuántica de Planck surgió, no del estudio de la radiación, sino de la teoría de los sólidos. Una vez más, Albert Einstein fue la vanguardia.

Después de presentar la hipótesis de los cuantos de luz que explicaba el efecto fotoeléctrico en 1905, Einstein demostró en 1906 que los resultados anteriores de Planck sobre la distribución de energía en la radiación electromagnética podrían derivarse utilizando dos supuestos. El primero, ya presente en su artículo de 1905, fue que la luz se compone de cuantos de luz; el segundo fue que los cuantos de luz son emitidos y absorbidos por cargas oscilantes dentro de la materia que vibran solo con ciertas energías cuantificadas. Esto significa que la luz es emitida por cargas oscilantes dentro de la materia, como podría esperarse de la teoría de Maxwell, pero las energías tanto de la luz emitida como de los osciladores están restringidas a ciertos valores permitidos, lo que contradice la teoría clásica. Los osciladores se comportaron como cargas unidas a resortes, oscilando de un lado a otro solo con ciertas frecuencias correspondientes a ciertas energías cuánticas.

En 1904, Paul Drude había propuesto un modelo de sólido cristalino en el que los átomos están dispuestos en una red tridimensional de tal manera que cada átomo está unido a sus átomos vecinos por enlaces que pueden actuar como pequeños muelles (osciladores). Drude demostró, utilizando la física clásica, que la oscilación tridimensional de los átomos de la red puede explicar la absorción observada de la radiación infrarroja por algunos sólidos, si se supone que los átomos están ionizados. Una oscilación similar de los electrones, unidos a los átomos o iones, explicaba la absorción observada de la radiación ultravioleta en estos sólidos.

Figura 1. Modelo de Drude de átomos y muelles. Fuente: Wikimedia Commons

Figura 1. Modelo de Drude de átomos y muelles. Fuente: Wikimedia CommonsEn 1907, Einstein aplicó la hipótesis cuántica a los osciladores clásicos de Drude. Incluso antes del modelo de Drude, Einstein había especulado desde 1901 con la idea de que la energía cinética interna de los sólidos y líquidos podría considerarse como la energía de los «resonadores eléctricos». Un enigma considerable en ese momento era el comportamiento del calor específico, c, de los sólidos a medida que la temperatura disminuía. Normalmente se supone que el calor específico es una constante en la relación entre la transferencia de calor y el cambio de temperatura de una sustancia ΔQ = m·c·ΔT [2]. Y la aplicación de la física clásica al modelo de red de átomos y muelles de Drude llega a la conclusión de que, efectivamente, el calor específico c debe ser una constante para los sólidos a todas las temperaturas.

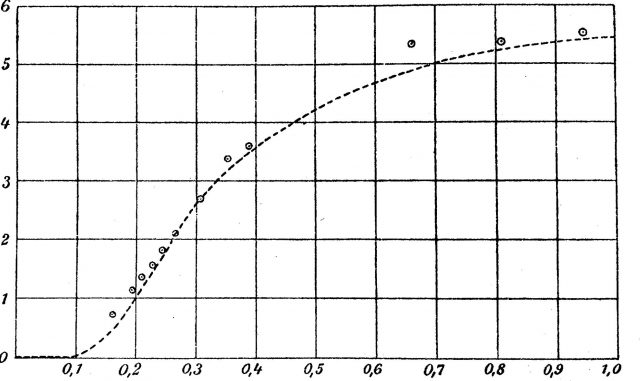

Sin embargo, cuando Einstein aplicó la hipótesis cuántica a los osciladores en el modelo de Drude obtuvo una expresión para el calor específico que afirmaba que el valor del calor específico debería cambiar con la temperatura. Para ser precisos, decía que debería ser constante a temperatura ambiente o algo menos, pero que el calor específico debería caer rápidamente a cero conforme la temperatura se va a cero (absoluto), como se muestra en la figura 2. Visto de otra forma: partiendo desde 0 K, el valor de Einstein para el calor específico de una sustancia cristalina en función de su temperatura debe acercarse a un valor constante que se alcanza más o menos a temperatura ambiente.

Figura 2. Gráfica original del artículo de Einstein de 1907

Figura 2. Gráfica original del artículo de Einstein de 1907Es importante recalcar esto: las predicciones de Einstein para el comportamiento del calor específico de los sólidos en función de la temperatura se basaron en una aplicación de la hipótesis cuántica a un modelo de un sólido cristalino en el que los átomos de la red se comportan como osciladores tridimensionales que vibran con energías cuantificadas. Los físicos Walther Nernst y Frederick A. Lindemann, que trabajan en un laboratorio de bajas temperaturas en Berlín, asombraron a la comunidad científica con una confirmación completa de la predicción de Einstein sobre la forma en la que el calor específico de un sólido cristalino cambia con la temperatura. Fue la primera confirmación de la hipótesis cuántica fuera del campo de radiación, y demostraba inequívocamente que los sólidos cristalinos pueden considerarse como una red tridimensional de átomos oscilantes sujetos a los requisitos de la hipótesis cuántica y, más tarde, de la mecánica cuántica.

Este modelo ha servido como modelo básico de sólido cristalino desde entonces. Como escribieron Nernst y Lindemann:

«[…] que las observaciones en su totalidad suponen una confirmación brillante de la teoría cuántica de Planck y Einstein es obvio».

Notas:

[1] Este artículo es una adaptación de nuestro Einstein and quantum solids

[2] Nosotros lo asumimos en El misterio de la temperatura constante, por ejemplo. En el ejemplo que usamos en ese texto es suficientemente cierto.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Sólidos cuánticos se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Los experimentos de Joule

- La teoría cinética y la segunda ley de la termodinámica

- La ley del gas ideal a partir del modelo cinético

Zelulen portaera-aldaketa metastasiaren giltzarri

Ikuspuntu filosofiko batetik, minbizia berekoitasunaren muturreko adibidea dugu; gure gorputzeko atal txiki batek, zelula (adreilu) batek, berez dagokion funtzioari eta biziraupenari uko egin eta organismo osoaren kontra gailentzen da; ugalketaren ugalketaz ez dagokion tokia okupatuko du (tumore primarioa edo jatorrizko tumorea) eta printzipioz, arrotzak zaizkion gorputzeko kokapen berrietara mugitzera heldu daiteke (metastasia). Jatorrizko organoan, ohikoa duten jardueran diharduten zelulei lekua kentzen diete minbizi-zelulek, eta ondorioz, organoaren beraren funtzionamendua eragozten dute. Antzerako jokabidea daukate jatorrizko mugetatik haratago organo berriak kolonizatzen dituzten minbizi-metastasiek. Gauzak horrela, minbiziaren esparruan galdera nagusi gutxi (baina konplexu) batzuk daude eta, munduan zehar, pertsona ugari erantzun egokiak aurkitu nahirik. Zerk eragiten du minbiziaren agerpena? Zerk bideratzen du minbizia jatorrizko organoetatik beste kokapen batzuetara mugitzea? Nola egin geniezaioke aurre gaixotasun honi?

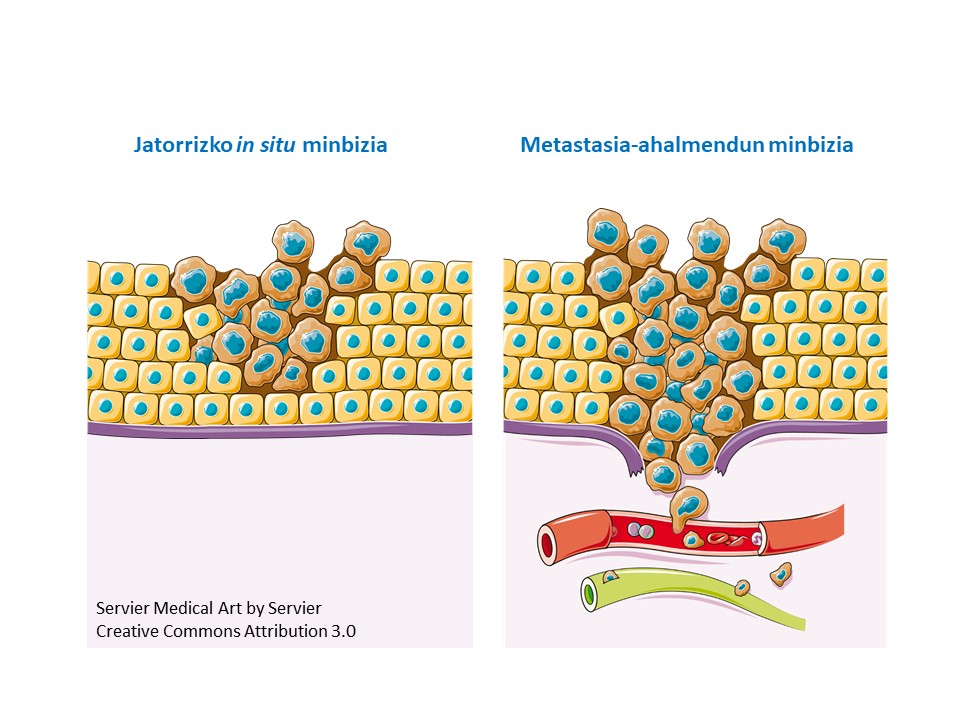

1. irudia: Minbiziaren garapena, egoera goiztiar batetik metastasia garatzeko ahalmena izatera. (Ilustrazioa: Aintzane Apraiz – Creative Commos Attribution 3.0 lizentziapean)

Klasikoki, proposatutako hiru galdera horien erantzunaren oinarrian mutazioak egon dira, hau da, zelulen funtzionamendua kontrolatzen duen informazio-liburuan (genoma) gertaturiko aldaketak. Mutazio bakoitza hizki aldaketa bat dela onartuz gero, erraz uler daiteke hitzetan hizkiak aldatzeak liburuan ekar lezakeen nahaspila.

Joan Massagué eta bere ikerketa taldearen jakin-mina metastasiaren esparruan dago zentratua aspalditik. Haiek egindako ikerketen arabera, minbizi-zelulak jatorrizko organoetatik beste organo batzuetara mugitzeko, ez dira derrigorrezkoak mutazioak, zelulen portaera-aldaketak berak eman baitiezaioke ahalmen hori zelulari. Egoera horretan, arestian aipatutako informazio-liburuan ez legoke hizki-aldaketarik, baina zelulak normalean irakurtzen ez duen kapitulua irakurriko luke. Kapitulu horretan, zauri bortitzen aurrean jarraitu beharreko pausuak azalduko lirateke, zeintzuek, besteak beste, zelulari desabantaila egoeran bizirik irautea baimenduko lioketen. Ikuspegi honen arabera, eta asko sinplifikatuz, metastasia alegiazko zauri baten ezinezko konponketan diharduten minbizi-zelulen ondorioa litzateke. Ikuspegi hau hainbat ikertaldek partekatzen dute, baina hipotesia baieztatzen duten emaitzak eskuratzea ez da lan erraza.

Massaguéren taldearen azken lanak portaera-antzekotasunak deskribatzen ditu metastasia garatuko duten minbizi-zelulen eta kalte handi bat pairatu duen organo bateko zelulen artean. Normalean irakurtzen ez duten kapitulua irakurtzearen ondorioz, L1CAM deritzon proteina bat ekoizten dute metastasia garatzeko ahalmena duten minbizi-zelulek zein zauria konpondu behar duten zelulek. Ikerketa talde horren emaitzen arabera, proteina honek, alboko zeluletatik askatu ondoren, bizirik irautea erraztuko lioke zelulari; baita odol- edo linfa-hodietan zehar bidaiatu ondoren gorputzeko beste kokapen batera heldu eta bertan, bikoizteko ahalmena izatea ere.

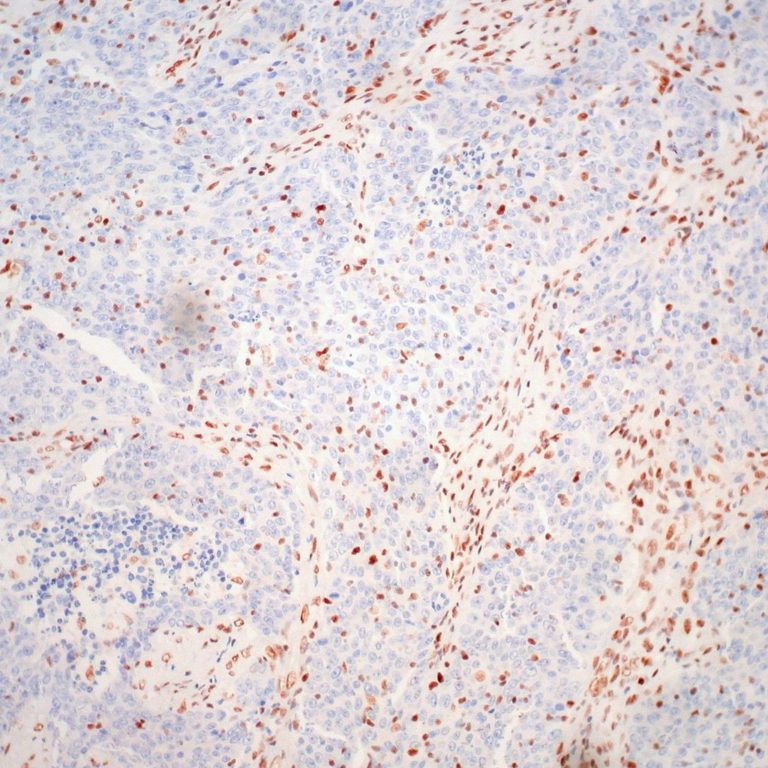

2. irudia: Joan Massagué ikertzaileak zuzendutako ikerketa batek, 2020ko hasieran Nature Cancer aldizkarian argitaratutakoa, L1CAM proteinak kolon-ondesteko minbizian metastasia sortzen duten zeluletan duten papera erakusten du. Irudian kolon metastasikoaren adenokartzinoma nodulu linfatikoan. (Argazkia: Ed Uthman – CC BY 2.0 lizentziapean)

Ikerlana, batez ere, koloneko minbizi-ereduan garatu zuten; hesteko zauri-eredua eratzeko, ordea, saguak erabili zituzten. Animaliei konposatu toxiko bat eman zitzaien eta hestea kaltetu ondoren, berezko konponketa-prozesua aztertu zuten. Ikerketan askotan gertatzen denez, behaketek hipotesietara garamatzate eta esperimentuek, hipotesiak baieztatu edo ukatzera. Massaguéren ikertaldearen behaketen artean, badira zenbait funtsezkoak direnak: gizakietatik erauzitako koloneko tumore primarioak aztertzean, L1CAMen adierazpena ikusi zuten minbizi-zelula gutxi batzuetan; pertsona beretik erauzitako gibeleko metastasietan, ordea, askoz ugariagoak ziren L1CAM adierazten zuten minbizi-zelulak; baita minbiziaren kontrako tratamenduaren ondoren bizirik mantendutako minbizi-zelulen artean ere. Bestalde, L1CAMen ekoizpena nabaria zen kaltetutako hestearen berezko konponketa-prozesuan zebiltzan hesteko zeluletan; ez, ordea, kalte gabeko hestean. Behaketa hauek aditzera ematen dutenez, hesteko zeluletan, L1CAMen agerpena egoera berezi eta zelula zehatz batzuetan ageri den gertaera bat da, baina, behin agertuta, zelula horiek gaitasuna garatzen dute egiturak berreraikitzeko eta kontrako egoeretan bizirauteko. Horrez gain, ikertzaileak gai izan dira hesteko epitelio-zeluletan L1CAMen ekoizpena eraentzeko mekanismoa deskribatzeko: zelulak alboko zeluletatik askatzeko prozesuak berak aktibatuko luke proteina honen produkzioa.

Azaltzeko konplexuak diren eta burutzeko are konplexuagoak diren esperimentuen arabera, interes handiko beste emaitza bat ere lortu zuten: ikustea L1CAM ez dela beharrezkoa jatorrizko kokapenean minbizia garatzeko; bai, ordea, jatorrizko minbizi horretatik metastasiak garatzeko. Minbiziaren aurkako estrategien ikuspuntutik, aurkikuntza honek metastasien aurkako balizko itu farmakologiko baten identifikazioa dakar: L1CAM blokeatzeko edo deuseztatzeko moduren bat lortuz gero, farmako berriak ez luke hesteko atal osasuntsurik kaltetuko eta etorkizunean metastasia garatzeko aukerak neurri handian murriztuko lirateke. Baliteke honek arazo guztiaren konponbidearen itxura ez edukitzea, baina kontuan hartu behar da, hesteko minbiziaren kasuan (zein beste hainbat minbizitan), kirurgia bidez ezabatu ohi dela jatorrizko tumorea. Arazo nagusia, beraz, minbizi-mota gehienetan bezala, metastasien garapena izaten da, behin barreiatuta, bestelako organoetako metastasien kontrola konplexua izaten baita.

L1CAMen adierazpena bestelako minbizietan ere identifikatu izan da, zeinak balizko itu terapeutiko honen erabilpen teorikoa hedatzen duen. Hala ere, badaude kontuan hartu beharreko beste alderdi batzuk; besteak beste, L1CAM proteina oso ugaria dela nerbio sisteman, burmuina bezalako organoetan. Nola kaltetu L1CAM daukaten minbizi-zelulak nerbio sisteman kalte garrantzitsurik eragin gabe? Horra hor erabilpen terapeutikoari begira gainditu beharreko erronka.

——————————————-

Egileaz: Aintzane Apraiz UPV/EHUko Medikuntza eta Erizaintzako irakaslea eta minbiziaren esparruko ikertzailea da.

——————————————-

The post Zelulen portaera-aldaketa metastasiaren giltzarri appeared first on Zientzia Kaiera.

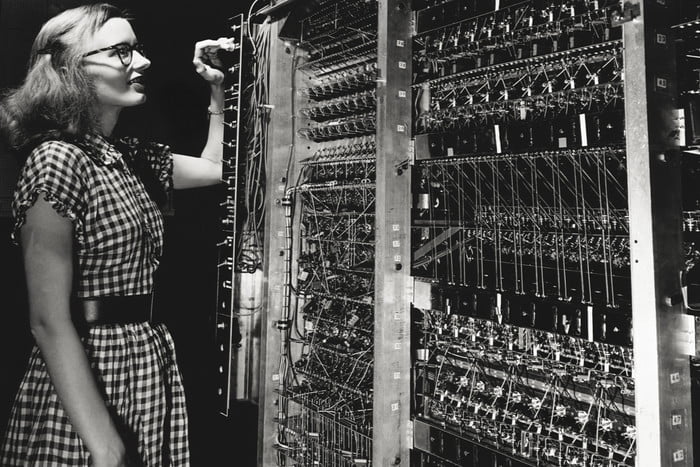

La ciencia al servicio de la guerra

Lois Cook-Leurgan examinando la unidad aritmética principal del MANIAC ( Mathematical Analyzer, Numerical Integrator And Computer). El ordenador jugó un papel importante en los cálculos termonucleares que se llevaron a cabo en el Los Alamos Scientific Laboratory de la Universidad de California dentro del Proyecto Manhattan. Klara Dan von Neumann fue la autora de los primeros programas.

Lois Cook-Leurgan examinando la unidad aritmética principal del MANIAC ( Mathematical Analyzer, Numerical Integrator And Computer). El ordenador jugó un papel importante en los cálculos termonucleares que se llevaron a cabo en el Los Alamos Scientific Laboratory de la Universidad de California dentro del Proyecto Manhattan. Klara Dan von Neumann fue la autora de los primeros programas.En las guerras siempre se ha utilizado el conocimiento del que se disponía en la época. Por tanto, la ciencia y la tecnología, en tanto que formas de conocimiento, no han sido ajenas a los conflictos bélicos. Más bien habría que decir que las guerras han incentivado la generación de conocimiento científico y tecnológico, y lo siguen haciendo en la actualidad.

A Arquímedes (s III aec) se le atribuye haber inventado un dispositivo basado en espejos ustorios para concentrar rayos de luz solar y producir suficiente calor como para dar fuego a las naves que transportaban las tropas romanas que pretendían ocupar la ciudad de Siracusa. Aunque en realidad, no sabemos si esa atribución es correcta.

Si nos limitamos al siglo XX y lo que llevamos del XXI, está claro que laboratorios y despachos de científicos han tenido un protagonismo determinante en los conflictos bélicos.

Fritz Haber fue galardonado con el premio Nobel por su descubrimiento del proceso llamado de Haber-Bosch, para la síntesis catalítica de amoniaco a partir de hidrógeno y nitrógeno atmosférico bajo condiciones de alta presión y temperatura. Ese proceso abrió la era de la producción industrial de fertilizantes y, en general, de la industria química. Pues bien, él fue el químico al frente del programa de producción de gases letales que utilizó Alemania en la I Guerra Mundial. F Haber puso sus conocimientos al servicio del esfuerzo bélico alemán por su forma de entender el patriotismo; llegó a decir que «en tiempo de paz, un científico pertenece al mundo, pero en tiempo de guerra pertenece a su país».

No solo él, James Franck, Gustav Hertz y Otto Hahn, futuros premios Nobel, también formaron parte de la unidad de Haber. Y en el bando galo, otro galardonado con el Nobel, Victor Grignard, participó en el esfuerzo francés para producir gases venenosos.

El radar, invención basada en la patente obtenida por Robert Watson-Watt (descendiente de James Watt), fue seguramente determinante del curso que siguió la II Guerra mundial. El invento, de 1935, de Watson-Watt se basaba en el uso de ondas de radio para detectar y alertar de movimientos de objetos invisibles con la vista. En este caso se trató de una invención de carácter defensivo (sirvió, entre otras cosas, para poder anticipar los bombardeos alemanes sobre la población civil británica), pero en lo relativo a su influencia sobre el curso de la guerra, a largo plazo no es posible diferenciar la función defensiva de la ofensiva.

El ejemplo más evidente de contribución científica a la guerra es el proyecto Manhattan, nombre clave con el que se conocía el proyecto que desarrolló Estados Unidos para fabricar la bomba atómica durante la II Guerra Mundial. El objetivo del proyecto era producir la bomba antes de que los nazis lo consiguieran. Lo lograron, como es bien sabido. Y como consecuencia de ello, lanzaron sendas bombas sobre las ciudades japonesas de Hirosima y Nagasaki, provocando de esa forma la rendición del Japón. El proyecto, en su parte científica, fue dirigido por el físico Julius Robert Oppenheimer y de una u otra forma, participaren numerosos científicos e ingenieros. También estos científicos tomaron parte en el proyecto por una causa. Todos ellos quisieron colaborar en la derrota de las potencias del Eje.

En las guerras del siglo XXI los científicos e ingenieros siguen teniendo una función determinante en el perfeccionamiento del armamento clásico y en las innovaciones. Drones, robots, inteligencia artificial, sistemas de telecomunicaciones, invisibilidad a los sistemas de detección son áreas en las que los ejércitos más poderosos del mundo invierten enormes cantidades de recursos. Muchos científicos e ingenieros participan en el desarrollo de nuevas ideas con fines militares.

Tanto Haber como Oppenheimer ejemplifican bien el tipo de dilemas éticos al que se han de enfrentar los científicos que toman parte activa en el desarrollo de armas de gran potencial para segar vidas humanas. Ambos actuaron motivados por su compromiso con el destino de los conflictos bélicos en que se vieron involucrados. Haber por patriotismo y Oppenheimer para frenar el avance del fascismo. Sus casos son especiales porque el resultado de su trabajo científico tuvo como consecuencia la pérdida de miles de vidas humanas, pero en rigor, nada los diferencia de la actuación de otros científicos que han desarrollado y desarrollan su actividad al servicio del ejército de sus países.

Este artículo se publicó originalmente en el blog de Jakiunde. Artículo original.

Sobre los autores: Juan Ignacio Perez Iglesias es Director de la Cátedra de Cultura Científica de la UPV/EHU y Joaquín Sevilla Moroder es Director de Cultura y Divulgación de la UPNA.

El artículo La ciencia al servicio de la guerra se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Gizakien zirkulazio sistemaren zenbakiak

Ernalketa gertatu eta hemezortzi egun igarotakoan, enbrioia garatzen hasten da. Zortzigarren astean ia amaitzen da prozesu hori. Funtzionatzen hasten den lehen organoa da; hiru asterekin hasten da, bihotz hodi primitiboa baino ez denean. Bosgarren astean, bihotz gisa konfiguratuta dagoenean, minutuko 80 taupadako (aurrerantzean, bpm) erritmoan aritzen da. Erritmoa azkartuz doa. Bederatzigarren astean, trenkadak, balbulak eta lau ganberak osatuta daudenean, gehienezko balioak erdiesten ditu bihotzak, 155 eta 195 bpm bitartean. Une horretatik aurrera, 120-160 bpm arte moteltzen da erritmoa.

Helduen bihotza segundoko taupada bateko maiztasunean baino pixka bat handiagoan aritzen da. Hala ere, aldatu egiten da norbanako batetik bestera, pisua, adina, egoera fisikoa eta sexuaren arabera. Batez beste, ehun mila aldiz egiten du taupada egunean, hau da, hogeita hamar milioi inguru urtean.

Irudia: Odolak gure gorputzaren barruan atal batetik bestera mugitzeko behar duen denborari erreparatzen badiogu, ikusiko dugu, esaterako, globulu gorri batek 3 segundo behar dituela bihotzetik eskumuturrera iristeko. (Argazkia: Arek Socha / Iturria: Pixabay.com)

Bi hodi sistemaren bidez odola ponpatzean datza bere lana. Txikienak biriketara eraman –hor O2 hartzen eta CO2 botatzen du– eta bihotzera itzultzen du. Handiak helburu hauetarako bultzatzen du odola: giltzurruneko iragazkietan garbitzeko, zelulei O2 emateko, ekoitzitako CO2 jasotzeko, digestio sistemako elikagaiaren molekulak ehunetara eramateko, hormonak eta beste substantzia batzuk garraiatzeko, plaketak beharrezkoak diren lekura gidatzeko, immunitate sistemako zelulak patogenoen erasoari aurka egitera eramateko, organismoan beroa banatzeko eta organoen artean komunikatzeko eta substantziak garraiatzeko beste zeregin batzuk egiteko.

Geldi, minutuko bost bat litro odol ponpatzen du helduen bihotzak ehunetara; hau da, zazpi mila eta berrehun litro eguneko, gutxi gorabehera. Bestela esanda: minutu batean ponpatzen du gorputzeko odol guztia; jarduera bizia egitean, halere, hamabost segundotan egiten du. Odol gehien jasotzen duten organoak digestio sistema (% 27), giltzurrunak (% 20) eta entzefaloa (% 15) dira. Nolanahi ere, muskuluek odol fluxu osoaren bi herenak ere jaso ditzakete organismoak ariketa bizia egiten duenean.

Giza gorputzeko odol hodiak ondoz ondo jarriz gero, berrogei mila kilometro inguru egingo lituzkete. Distantzia hori, dena dela, paraleloan zirkulatzen duten milaka hodi batzetik lortzen da; izan ere, zirkulazio sistema arteria, arteriola eta kapilarretan adarkatzen da, gure gorputzeko bazter guztietara heldu eta, ondoren, benula eta zainetan taldekatzeko, bihotzera itzuli aurretik. Hori dela eta, odol tanta, odol zelula edo partikula eseki bakoitzak ez du distantzia hori egiten sistemari itzuli osoa ematen dion bakoitzean. Odol zelula batek, adibidez, minutu bat behar du batez beste zirkuitua osatzeko; hortaz, bi kilometro orduko abiaduran bidaiatzen du, eta hogeita hamahiru bat metro egiten ditu.

Odol bolumen osoaren % 45 globulu gorriak dira –eritrozito ere esaten zaie–. Nukleorik gabeko zelulak dira, O2 eta CO2 garraiatzeaz arduratzen dira eta lau hilabete inguru baino ez dira bizitzen. Egunero, halako ehun mila milioi zelula berritzen dira gutxi gorabehera. Bere bizitza laburrean, eritrozitoa ehun eta berrogeita hamar mila aldiz igarotzen da bihotzetik, eta ehun eta hirurogei mila kilometro egiten ditu.

Eta hori guztia gu ia ezertaz ohartu gabe.

———————————————————————————-

Egileaz: Juan Ignacio Pérez Iglesias (@Uhandrea) UPV/EHUko Fisiologiako katedraduna da eta Kultura Zientifikoko Katedraren arduraduna.

———————————————————————————

The post Gizakien zirkulazio sistemaren zenbakiak appeared first on Zientzia Kaiera.

El límite entre la vida y la muerte en las neuronas

![]()

Jorge Valero Gómez-Lobo y Amanda Sierra

La apoptosis de la neurona es un tipo de muerte autoinducida.

La apoptosis de la neurona es un tipo de muerte autoinducida.Kateryna Kon / Shutterstock

“Hasta que la muerte nos separe”. Esa es la fecha de caducidad que tienen la mayoría de nuestras neuronas. Estas células, encargadas de transmitir el impulso nervioso en el cerebro, son de las más longevas de nuestro organismo. Nacen prácticamente a la vez que nosotros y, por lo general, no se renuevan.

Pero existe una excepción a toda regla, y esta no iba a ser menos. No hace mucho que sabemos que en el cerebro de la mayoría de los mamíferos se producen nuevas neuronas a lo largo de toda la vida. Este fenómeno, que conocemos como neurogénesis adulta, sólo ocurre en unas pocas regiones del cerebro. Entre ellas el hipocampo, una región especializada en procesos de memoria y aprendizaje.

Las conexiones que establecen las neuronas dan forma a nuestros pensamientos y manera de ser, haciéndolas únicas e insustituibles. De ahí que la pérdida de neuronas que sufrimos al envejecer, o cuando caemos en las garras de una enfermedad neurodegenerativa, suela ser irreparable.

Lo normal es morir

Las neuronas mueren cuando envejecemos debido a que acumulan residuos y defectos que hacen que pierdan su función y degeneren. Este proceso natural se limita a unas pocas neuronas pero se ve agravado en enfermedades neurodegenerativas como las enfermedades de Parkinson o Alzheimer. Sin embargo, también hay mucha muerte neuronal al inicio de la vida.

De hecho, antes del nacimiento se producen muchas más neuronas de las necesarias. Tantas que la mayoría no sobreviven al no establecer las conexiones adecuadas. No solo eso, sino que gran parte de las neuronas que se generan en la vida adulta y sus precursores mueren sin llegar a incorporarse a los circuitos cerebrales. Esta muerte temprana no es patológica: todo lo contrario. Estos procesos de muerte neuronal se producen de forma normal y están destinados a mantener el buen funcionamiento del cerebro.

Una muerte limpia

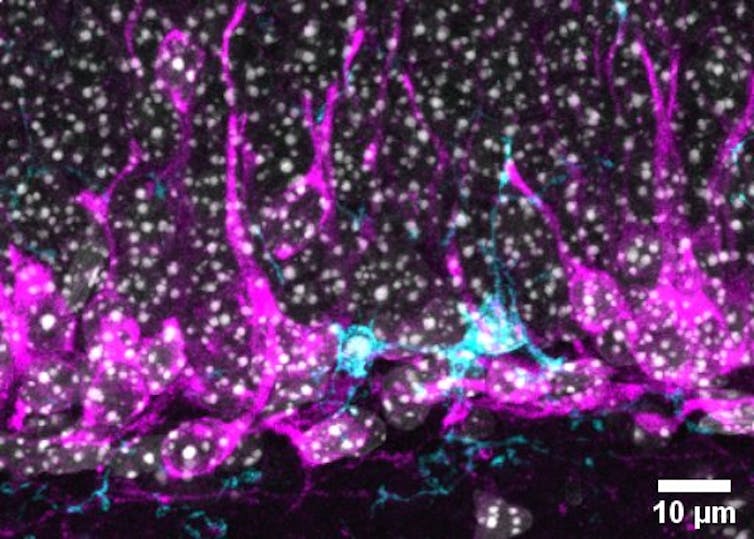

La muerte temprana de las neuronas se produce de manera controlada a través de un proceso que llamamos apoptosis. Para entendernos, la apoptosis es una tipo de muerte autoinducida y limpia, que no genera desechos tóxicos dispersos y evita daños mayores. Solo deja atrás un residuo: los restos de las células que acaban de morir. Estos “cadáveres neuronales” son eliminados por unas células del cerebro llamadas microglía.

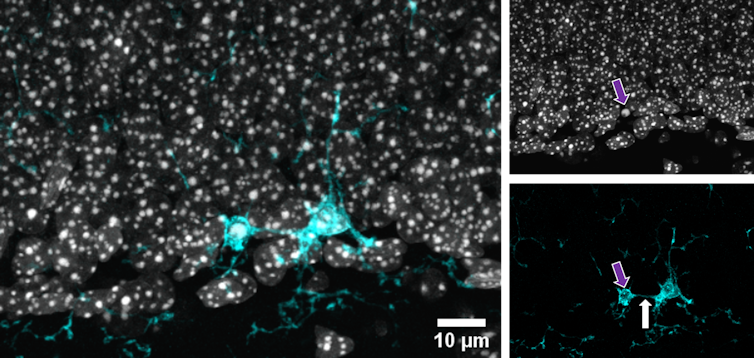

Microglía (cian) fagocitando una célula muerta, apoptótica. Arriba a la derecha una imagen de los núcleos celulares. La flecha morada señala a la célula muerta, apoptótica. La célula apoptótica tiene un tamaño menor que el resto de núcleos debido a que su contenido se ha compactado. En la imagen inferior derecha se ve la microglía, la flecha blanca señala la prolongación que la microglía extiende hasta la célula muerta.

Microglía (cian) fagocitando una célula muerta, apoptótica. Arriba a la derecha una imagen de los núcleos celulares. La flecha morada señala a la célula muerta, apoptótica. La célula apoptótica tiene un tamaño menor que el resto de núcleos debido a que su contenido se ha compactado. En la imagen inferior derecha se ve la microglía, la flecha blanca señala la prolongación que la microglía extiende hasta la célula muerta.Author provided

Las células de la microglía son células muy dinámicas cuyos cuerpos tiene prolongaciones finas que escanean continuamente el cerebro. Su misión es contener cualquier tipo de daño. Y como parte de esta función se encargan de detectar, englobar y destruir los restos de células muertas.

A este proceso por el que la microglía “se come” a las células muertas y “las digiere” lo llamamos fagocitosis. La fagocitosis es necesaria para evitar que los restos celulares degeneren y produzcan residuos tóxicos. La fagocitosis, por tanto, constituye el último paso en la gestión de la muerte de las neuronas: su eliminación definitiva. Pero, ¿qué ocurre después de la fagocitosis? ¿Acaba ahí, con la eliminación de los residuos?

Microglía en movimiento. Imagen “en vivo” del cultivo de una rodaja de hipocampo. El punto rojo representa la zona en la que se generó daño con un láser.La microglía regula la producción de nuevas neuronas

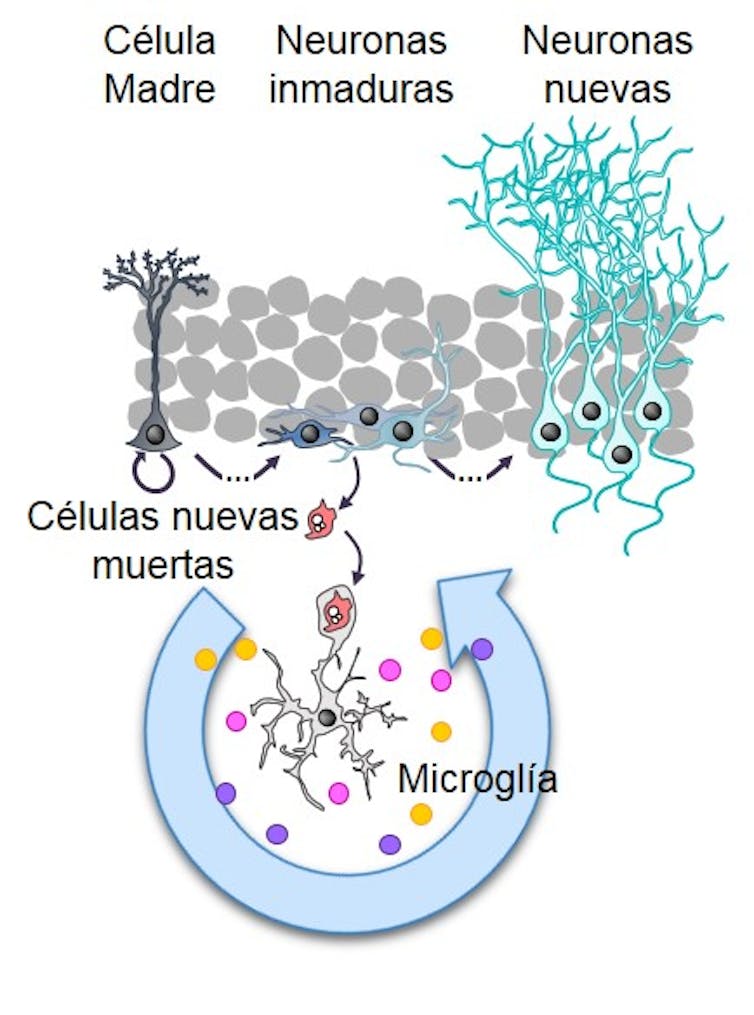

Los resultados de nuestra investigación muestran que la microglía no se limita a retirar los residuos del sistema sin más. Por el contrario, cuando la microglía se “come” a las células muertas comienza un proceso de auto-reprogramación que cambia la expresión de sus genes. Este cambio en la expresión génica se da, entre otros, en genes que codifican para sustancias que pueden regular la propia neurogénesis. Es decir, que las células de microglía fagocítica liberan factores que limitan la formación de nuevas neuronas. Pero, ¿cuál puede ser el sentido de todo esto?

Microglía (cian) fagocitando una célula muerta y rodeada de nuevas neuronas (magenta).

Microglía (cian) fagocitando una célula muerta y rodeada de nuevas neuronas (magenta).Author provided

La formación de nuevas neuronas en el cerebro adulto tiene un coste. Estas neuronas se generan a partir de células madre que se activan y se agotan en el proceso. Producir un exceso de nuevas neuronas cuando no son necesarias agotaría la reserva de células madre rápidamente y la capacidad de formar neuronas cuando realmente se necesite.

La microglía detecta un exceso en la producción de neuronas al fagocitar a aquellas que mueren y, mediante las moléculas que secreta, le indica al hipocampo que frene la producción porque está gastando recursos sin sentido. De esta manera, podemos especular que la microglía fagocítica regula el equilibrio entre la oferta y la demanda, y ajusta la tasa de producción de nuevas neuronas en función de cuántas se mueren y cuántas se pueden incorporar al circuito neuronal.

La microglía tras fagocitar libera sustancias que regulan la producción de nuevas neuronas.

La microglía tras fagocitar libera sustancias que regulan la producción de nuevas neuronas.Author provided

Estos hallazgos tienen implicaciones en el campo de las enfermedades neurodegenerativas. En estas patologías, las neuronas mueren y la microglía es la encargada de retirarlas del tejido cerebral. En ocasiones, como hemos observado en anteriores estudios sobre la epilepsia, la naturaleza de la enfermedad impide a la microglía ejercer su función fagocítica y retirar los residuos celulares. Estos resultados nos llevan a plantear lo siguiente: incrementar la actividad fagocítica de la microglía

puede constituir una nueva vía terapéutica.

En los próximos años determinaremos si potenciar los mecanismos de auto-reparación devuelve al cerebro el adecuado equilibrio entre la vida y la muerte en las enfermedades neurodegenerativas.![]()

Sobre los autores: Jorge Valero Gómez-Lobo y Amanda Sierra son investigadores del Achúcarro Basque Center for Neuroscience

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo El límite entre la vida y la muerte en las neuronas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Más allá de las neuronas

- La microglía es un sensor de mortalidad neuronal

- Muerte entre las ecuaciones (Historias de muerte y matemáticas 1)

Asteon zientzia begi-bistan #294

COVID-19 gaixotasunak mehatxupean jarri du Europako belaunaldi askoren bizimodua. Osasunari dagozkion ondorioez gain, beste batzuk ere sufrituko ditugu: politikoak, ekonomikoak… Baina badaude itxaropena ematen diguten datuak ere: potentzia zientifikoak buru-belarri ari dira lanean eta hori ezinbestekoa izanen da birusari aurre egiteko. Azken finean, ezagutza boterea da.

Egunotan, gehien entzun dugun mezua hau izan daiteke: “garbitu eskuak!” Sinplea dirudi baina hori izan liteke koronabirusaren aurkako tresnarik eraginkorrena. Hala mintzatu da Guillermo Quindos EHUko katedraduna Berriako artikulu honetan. Kutsatzeko modu nagusietako bat da: “Birusa ahotik, sudurretik eta begietatik sartzen da; eskuekin aurpegia askotan ukitzen dugu”. Horretaz gain, etxeko garbitasuna eta beste hainbat neurri izango dituzue irakurgai honetan, ez galdu!

Egoera honetan, garrantzi handia du osasun mentalak. Orain, konfinamenduari aurre egiteko, errutina bat ezartzea ezinbestekotzat jo du Izar Arregi psikologo kliniko eta familia terapeutak, bestela, antsietatea, depresioa eta insomnioa ager daitezke. Berriako elkarrizketa interesgarri honetan xehetasun gehiago aurkituko dituzue.

Azken egunotan, asko hitz egin da COVID-19 gaitzaren kontrako txertoaren inguruan. Bada, txertoen garapena ez da kontu erraza. Miren Basaras ibarzabal, Mikrobiologiako irakasle titularra UPV/EHUn Berrian mintzatu da garapen horri buruz. Txinak koronabirus berri honen sekuentzia partekatu zuenetik 60 egun pasatu ondoren, jadanik lehen txertoaren proba hasi da gizakietan. Ikerketa asko abiatu dira herrialde ezberdinetan baina argi izan behar dugu txerto hori populazio guztira ailegatzeko 18 hilabete itxaron beharko ditugula, gutxienez.

GenetikaBerriki ezagutu dugu COVID-19 gaitza eragiten duen birusak gripearenak baino gutxiago mutatzen duela. Informazio asko falta zaigu oraindik baina. Elhuyar aldizkariak azaltzen digunez, oraindik, adibidez, ez dute lortu jakitea izaten ari den aldaketak zeri eragiten dioten: erasokortasunari, birulentziari edo transmisio-ereduei.

Covid-19aren letalitatea handiagoa izan da gizonetan emakumeetan baino. Elhuyar aldizkariak azaldu digu gizonei gogorrago eragiten diela, batetik, emakumeen immunitate-sistema indartsuagoa delako koronabirus berriaren aurrean, eta, bestetik, generoari lotutako portaera ere kaltegarriagoa delako gizonen artean. Alabaina, ikerketa taldeak adierazi du infektatzeko eta hura transmititzeko arriskua handiagoa dela gizonetan baino, osasun-langile gehienak emakumeak baitira.

Koldo Garciak, SARS-CoV-2a hizpide hartuta, itxialdirako testu zientifikoen bilduma bat oparitu digu. Bost artikulu labur dira eta horietan, birusaren jatorria, PCR teknika, antigorputzak, immunitate-sistema eta, oro har, birusei buruz idatzi du.

Koronabirusak jatorri artifiziala ez duela argi gelditu zaigu baina joan gaitezen pixka bat harago eta ezagutu dezagun zergatik ez den artifiziala izan. Argitaratu duten ikerketa-lan batean egin dutena, Garciak azaltzen digun moduan, izan da SARS-CoV-2aren genoma aztertu eta beste koronabirus batzuekin erkatu. Zehazki, punta proteina aztertu dute eta horrek dituen bi ezaugarri nabarmendu dituzte: alde batetik, SARS-CoV-2a giza ACE2 hartzaileari lotzeko duen gaitasun handia, eta bestetik, lotura hori burutzeko erabil ditzakeen bitartekarien heina zabalagoa izan dezakela 12 baseko insertzio bati esker.

Zer da PCR teknika? Orain, SARS-CoV-2 birusaren testa egiteko hori erabiltzen dela entzun dugu askotan baina zer da zehazki? Garciak azaltzen digu DNAren kopurua handitzeko erabiltzen dela. Ez galdu bere azalpena!

Egoera honek, gainera, zenbait elementu argitzea eskatzen du; hala nola, immunitate-sistemak nola funtzionatzen duen, zein den haren mekanismoa, zeintzuk diren antigorputzak kodetzen dituzten geneak, eta lan txukun hau borobiltzeko, birusak zer diren azaldu digu. Ez galdu!

Osasun gene-testak Internet bidez eros daitezke, beste edozein produktu bezalaxe. Bi mota daude: alde batetik, norberaren jatorria aztertzeko erabiltzen direnak eta bestetik, osasunarekin lotuta daudenak. Azken hauei buruz argitaratu berri dute lan bat. Bertan, ikertzaile talde batek aztertu ditu gene-testen merkatu-garapen ezberdina duten lau herrialde: AEB, Erresuma Batua, Japonia eta Australia. Emaitzen arabera, kontsumitzaileek ez dute azaldu osasunarekin lotutako gene-testak erabiltzeko prestutasun handirik. Eta, erabiltzekotan, beren medikuekin lehenago eztabaidatuko lukete.

BiologiaBiziaren hasierako lehenengo entzimen egitura proposatu du AEBko ikertzaile talde batek. Hasierako metabolismo hartan gakoak izan ziren bi egitura proteiko identifikatu ditu. Ikertzaileen ustez, lehenengo entzima metabolikoak lirateke egitura xume haiek, bizia sor zedin funtsezkoak izan zirenak. Elhuyar aldizkarian aurkituko dituzue xehetasunak.

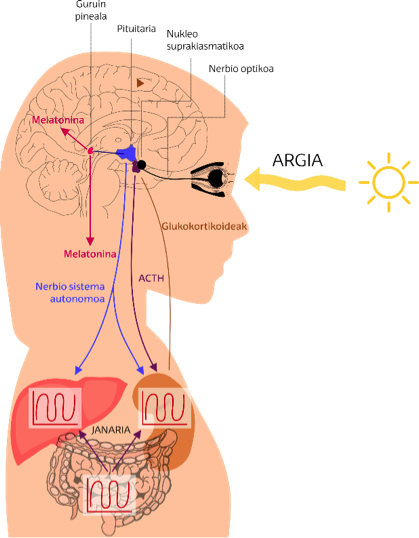

Zer dira erloju zirkadianoak? Eta nola funtzionatzen dute? Hori jakitea oso garrantzitsua da. Izan ere, haietan asaldurak gertatzen direnean nolako arazo eta gaixotasunak gertatzen diren azaltzea gero eta garrantzi handiagoa hartzen ari da. Egun dauden hainbat arazo, gizentasuna, gaixotasun kardiobaskularrak eta minbizia kasu, erlazionaturik daude erloju zirkadianoekin.

Emakumeak zientzianBertha Lutz zoologoa izan dugu protagonista aste honetan. Brasileko mugimendu feministaren oinarriak finkatu zituen; politikan hasi eta lorpen handiak egin zituen arlo honetan: bere sorterriko emakumeen sufragio eskubidea lortu zuen (1932an) eta Nazio Batuen Gutunean parte hartu zuen. Bertan, modu esplizituan emakumeak aipatu ziren lehen aldiz. Zientziari dagokionez, Natur Zientziak ikasi ondoren, anuroetan espezializatu zen. Horren ondotik, intsektuen bidezko malaria eta lepraren kutsadura aztertu zuen.

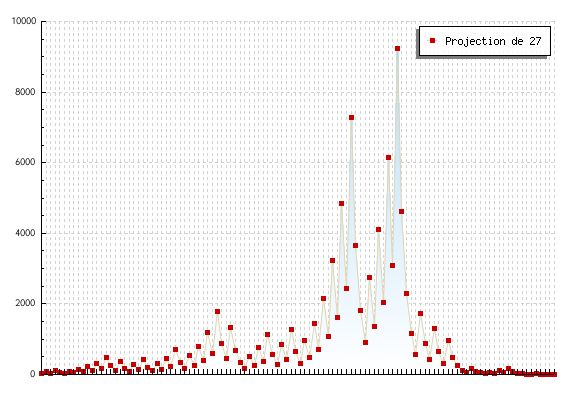

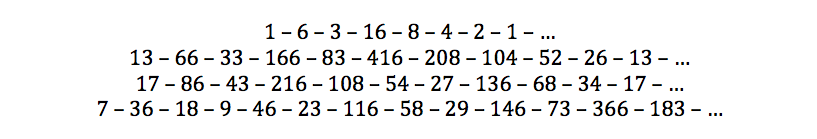

MatematikaJoko matematiko bat ekarri digu Javier Duoandikoetxeak artikulu honen bidez: Collatzen aierua. Lothar Collatz (1919-1990) matematikari alemaniarra dugu problema matematiko horren egile. Horri buruzko azalpenaz gain, testuaren amaieran, ariketa bat aurkituko duzue. Ez galdu!

TeknologiaAurreko astean ezagutu genuen Elhuyarrek Aditu hizketa ezagutzaile elebiduna sortu zuela. Euskarazko eta gaztelaniazko audioak eta bideoak testu bihurtzen dituen plataforma da, hain zuzen. Nola funtzionatzen du Adituk? Erreportaje interesgarri honetan aurkituko duzue erantzuna.

–——————————————————————–

Asteon zientzia begi-bistan igandeetako atala da. Astean zehar sarean zientzia euskaraz jorratu duten artikuluak biltzen ditugu. Begi-bistan duguna erreparatuz, Interneteko “zientzia” antzeman, jaso eta laburbiltzea da gure helburua.

———————————————————————————-

Egileaz: Uxue Razkin (@UxueRazkin) kazetaria da.

———————————————————————————-

The post Asteon zientzia begi-bistan #294 appeared first on Zientzia Kaiera.

Las mareas del pasado leídas en las rocas del presente

Los fósiles, los minerales o las rocas son, entre otras cosas, en lo primero que pensamos al hablar de geología, pero lo cierto es que la física es un ámbito científico que difícilmente se puede desvincular de la geología. Y es que el fundamento físico resulta clave a la hora de explicar algunos procesos geológicos que suceden tanto en el océano como en la superficie terrestre.

Con el fin de poner sobre la mesa la estrecha relación entre la geología y la física, los días 27 y 28 de noviembre de 2019 se celebró la jornada divulgativa “Geología para poetas, miopes y despistados: La Geología también tiene su Física”. El evento tuvo lugar en la Sala Baroja del Bizkaia Aretoa de la UPV/EHU en Bilbao.

La segunda edición de esta iniciativa estuvo organizada por miembros del grupo de investigación de Procesos Hidro-Ambientales (HGI) de la Facultad de Ciencia y Tecnología de la Universidad del País Vasco, en colaboración con el Vicerrectorado del Campus de Bizkaia, el Geoparque de la Costa Vasca y la Cátedra de Cultura Científica de la UPV/EHU.

Las mareas, esos movimientos de mares y océanos provocados por la Luna, dejan su marca en el proceso de formación de las rocas sedimentarias. Estas marcas las podemos leer hoy para saber que ocurrió hace millones de años. Lo explica en esta conferencia Isabel Emma Quijada, profesora del departamento de geología de la Universidad de Oviedo.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Las mareas del pasado leídas en las rocas del presente se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La eternidad en un grano de arena

- Geotermia urbana

- Los ecos del fondo submarino: imágenes de las estructuras geológicas.

Ezjakintasunaren kartografia #300

Zergatik du arrakasta abesti batek eta ez besteak? Badirudi “zu” dela gakoa. Agian ez hainbeste, dena den. Jose Ramón Alonsoren You are the success of this song

Pentsa zure bizitza bost aldiz luzeago izan daitekeela, 400 urte. Hauxe lortu dute zizare batekin aldaketa genetikoen bidez. Rosa García-Verdugoren Gene modification drives 500% life extension in worms