La textura de los alimentos como generador de emociones en la infancia

La textura es un aspecto fundamental en la aceptación de los alimentos por parte de la población infantil. A lo largo de los años, numerosos estudios [1]–[3] han demostrado que los niños y niñas tienden a preferir texturas homogéneas y fáciles de masticar, mientras que las texturas más complejas pueden generar rechazo. Sin embargo, la aceptabilidad no es el único criterio que influye en sus elecciones alimentarias. En este sentido, estudios predictivos [4]–[6] han mostrado que el comportamiento alimentario está influenciado en gran medida por respuestas inconscientes e involuntarias como las emociones.

Foto: Raymond Petrik / UnsplashEmociones y alimentos: una conexión profunda

Foto: Raymond Petrik / UnsplashEmociones y alimentos: una conexión profunda

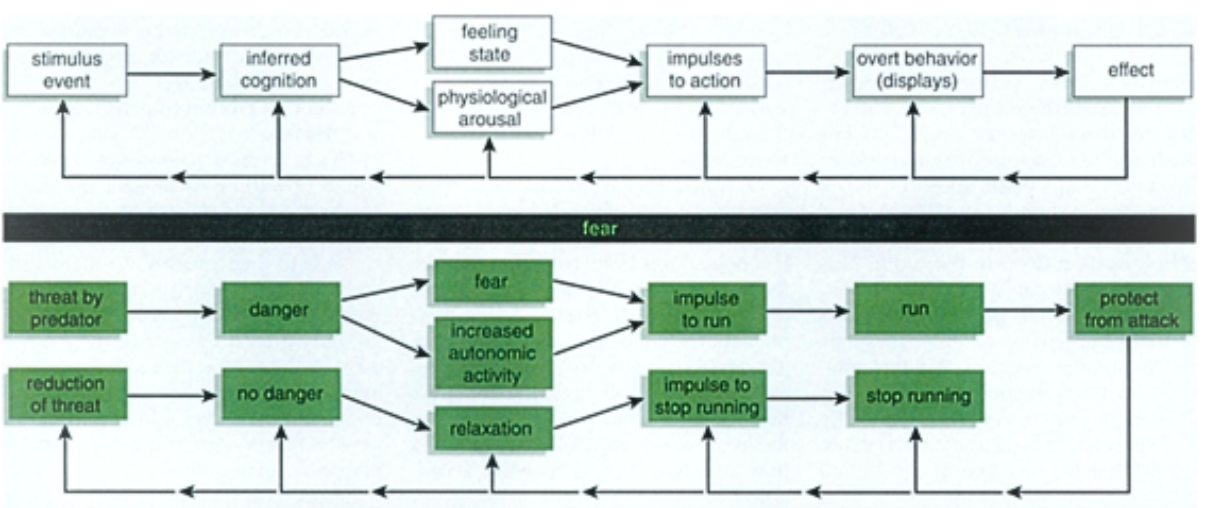

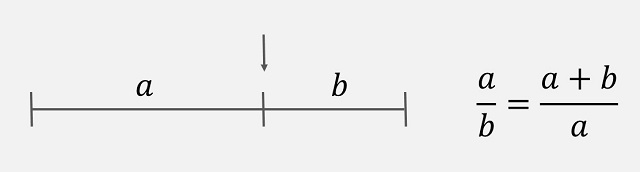

Desde hace siglos, los filósofos y científicos han intentado responder a una pregunta fundamental: ¿qué es una emoción y cómo se genera? Existen distintas teorías que buscan explicarlo.La teoría de las emociones básicas [7], inspirada en Darwin [8], sostiene que las emociones son respuestas universales e innatas que nos han ayudado a sobrevivir a lo largo de la evolución. Según esta perspectiva, emociones como la alegría, el miedo o la ira están asociadas a patrones específicos de expresiones faciales y reacciones fisiológicas. Un ejemplo de estos patrones se muestra en la Figura 1.

Figura 1. Proceso de generación de las emociones de acuerdo con la teoría de las emociones básicas que muestra cómo se evalúa la información y se traduce en acciones que desarrolla el individuo en función del evento desencadenante de la emoción [9]. La figura también muestra un ejemplo relacionado con la emoción de miedo.

Figura 1. Proceso de generación de las emociones de acuerdo con la teoría de las emociones básicas que muestra cómo se evalúa la información y se traduce en acciones que desarrolla el individuo en función del evento desencadenante de la emoción [9]. La figura también muestra un ejemplo relacionado con la emoción de miedo.Por otro lado, las teorías dimensionales [10] consideran que las emociones no son categorías discretas, sino experiencias que varían en dos dimensiones principales: la valencia emocional (cómo de positiva o negativa es la emoción) y el nivel de activación emocional (cómo de excitada o relajada es la emoción). Finalmente, las teorías de la evaluación (o appraisal en inglés) [11] sugieren que las emociones surgen a partir de la evaluación cognitiva que hacemos de una situación, basándonos en nuestras experiencias previas. Desde este punto de vista, el cerebro no solo reacciona automáticamente, sino que interpreta el contexto y ajusta la respuesta emocional de forma flexible.

Aunque cada teoría aborda la emoción desde una perspectiva distinta, todas coinciden en que se trata de un fenómeno complejo que involucra múltiples componentes del organismo: desde cambios conductuales o fisiológicos hasta procesos cognitivos que influyen en nuestra forma de actuar.

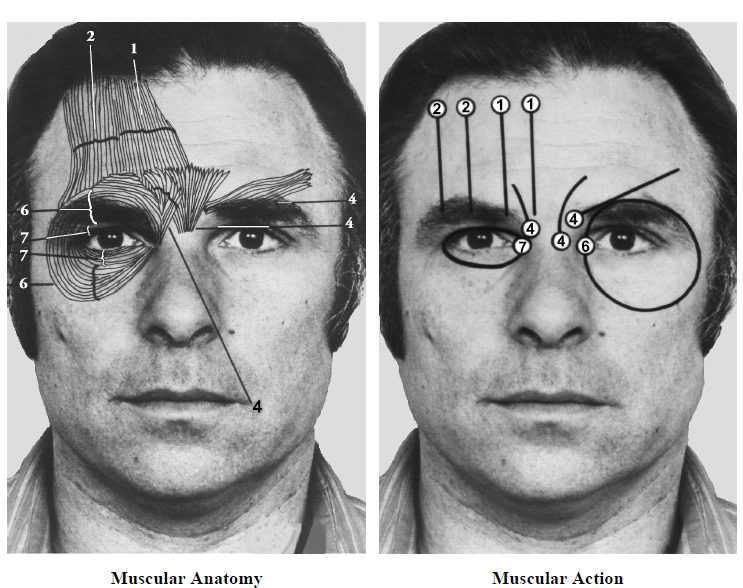

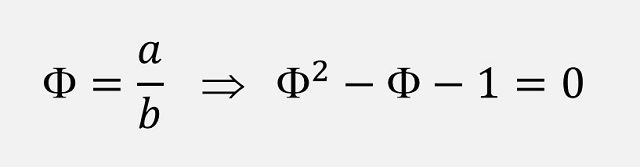

Una de estas respuestas conductuales puede ser la expresión facial. Desde hace décadas, los científicos han estudiado cómo la expresión de nuestra cara refleja nuestras emociones. En este sentido, el sistema Facial Action Coding System (FACS; Figura 2) [12], desarrollado por Paul Ekman y colaboradores, establece que ciertos movimientos musculares en el rostro están asociados a puntos concretos de la expresión (denominados en inglés Action Units o AUs) que a su vez se relacionan con emociones básicas como la alegría, la tristeza o el miedo.

Figura 2. Ejemplo de la identificación de músculos y puntos de expresión facial (Action Units) en la zona superior de la cara de acuerdo con el sistema FACS [12].

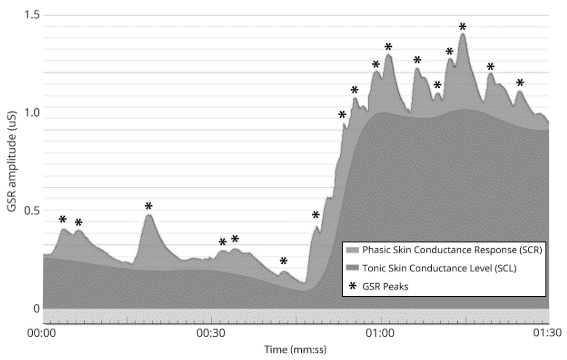

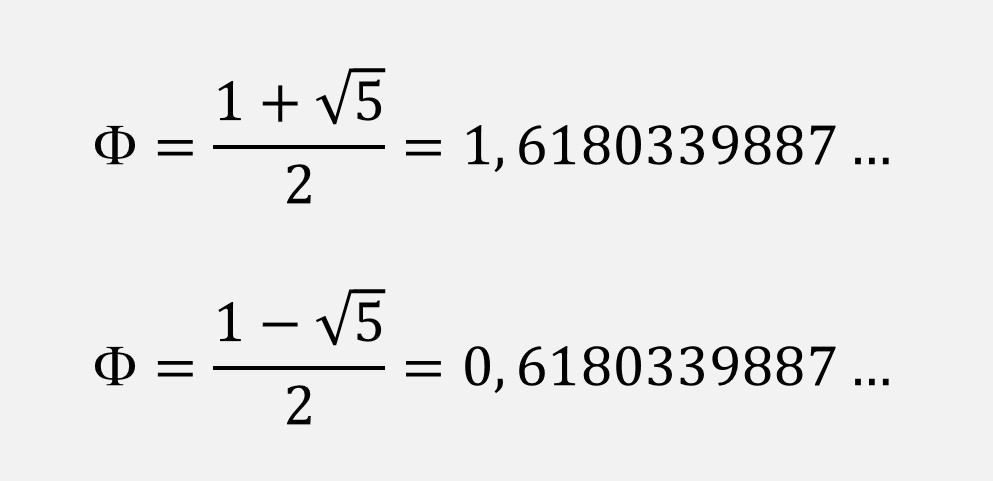

Figura 2. Ejemplo de la identificación de músculos y puntos de expresión facial (Action Units) en la zona superior de la cara de acuerdo con el sistema FACS [12].Mientras que el rostro refleja la emoción a nivel conductual, el sistema nervioso autónomo (ANS por sus siglas en inglés) revela lo que sucede en el interior del cuerpo. Una de las formas de medir esta respuesta es a través de la conductividad de la piel (SCR, por sus siglas en inglés; Figura 3), un método que detecta cambios en la actividad de las glándulas sudoríparas en la piel, especialmente en las manos. Cuando experimentamos una emoción intensa—como sorpresa, miedo o excitación—, nuestro sistema nervioso activa automáticamente la producción de sudor. Estos pequeños cambios en la humedad de la piel alteran su conductividad eléctrica, lo que puede ser medido mediante sensores colocados en los dedos.

Figura 3. Curva de la actividad electrodérmica en la que se diferencian dos fases: (i) fase tónica (SCL), relacionada con cambios suaves de la actividad eléctrica; y (ii) fase fásica (SCR), en la cual se generan cambios de la actividad eléctrica ocasionados por eventos desencadenantes como las emociones [13]–[15] Los picos de respuesta electrodérmica se corresponden con aumentos de SCR por encima de un umbral específico.La textura de los alimentos y las emociones en la infancia

Figura 3. Curva de la actividad electrodérmica en la que se diferencian dos fases: (i) fase tónica (SCL), relacionada con cambios suaves de la actividad eléctrica; y (ii) fase fásica (SCR), en la cual se generan cambios de la actividad eléctrica ocasionados por eventos desencadenantes como las emociones [13]–[15] Los picos de respuesta electrodérmica se corresponden con aumentos de SCR por encima de un umbral específico.La textura de los alimentos y las emociones en la infancia

En este contexto, un estudio reciente publicado en la revista científica Food Quality and Preference [16] ha profundizado en la relación que existe entre la textura de los alimentos y las emociones de la población infantil analizando cómo reaccionan los niños y niñas de entre 5 y 12 años ante alimentos sólidos con diferentes texturas. Para ello, se combinaron métodos tradicionales, como los cuestionarios, con tecnologías avanzadas que miden tanto sus expresiones faciales como la conductividad de su piel, lo que permite captar reacciones emocionales tanto conscientes como inconscientes.

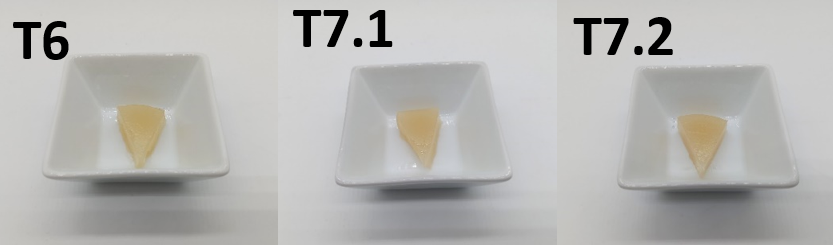

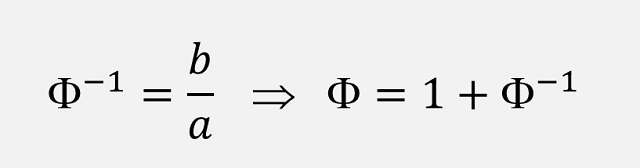

En este estudio, las investigadoras trabajaron con un grupo de 45 niños y niñas, a quienes se les ofrecieron tres muestras de un mismo producto elaborado a partir de zumo de manzana, pero con distintas texturas: una blanda (denominada T6), otra de fácil masticación (T7.1) y una más firme (T7.2; Figura 4). Cada individuo evaluó estos productos en cuatro etapas sensoriales: observación, olfacción, manipulación y consumo. Durante todo el proceso, sus expresiones faciales fueron registradas con el software de reconocimiento automatizado FaceReader (Noldus Information Technology, Países Bajos) que analiza estos movimientos musculares y los traduce en emociones específicas, así como su nivel de excitación emocional que se midió con sensores de conductividad de la piel. Además, después de probar cada muestra, se les pidió que calificaran cuánto les gustaba en una escala del 1 al 7.

Figura 4. Muestras evaluadas en el estudio da Quinta et al. (2024) [16] con textura blanda (denominada T6), textura de fácil masticación (T7.1) y textura firme (T7.2).

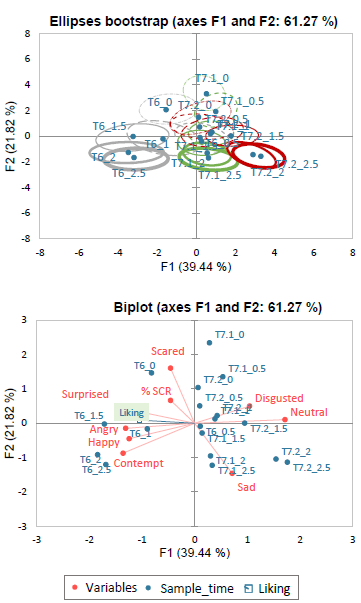

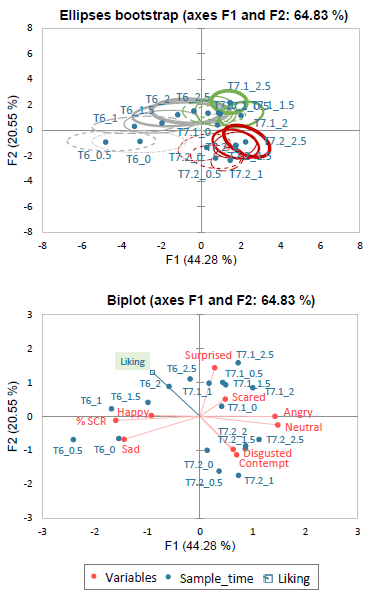

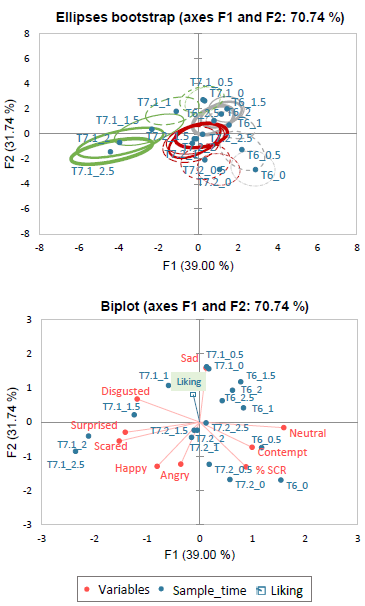

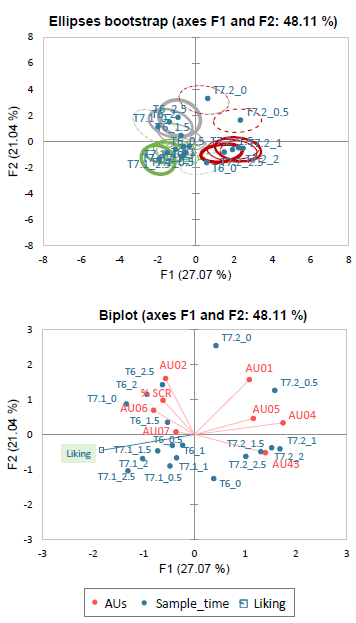

Figura 4. Muestras evaluadas en el estudio da Quinta et al. (2024) [16] con textura blanda (denominada T6), textura de fácil masticación (T7.1) y textura firme (T7.2).Uno de los hallazgos más llamativos fue que, aunque los niños y niñas calificaron los tres productos con niveles de aceptabilidad similares (textura T6: 4,6+1,8; textura T7.1: 4,6+2,0; textura T7.2: 4.3+2.0), sus reacciones emocionales fueron significativamente diferentes según la textura del alimento y la etapa sensorial en la que se encontraban (Figuras 5-8).

-

El producto más blando provocó más expresiones faciales de sonrisa en la fase inicial.

-

Las texturas más firmes generaron más expresiones de miedo y desagrado, especialmente durante la masticación. La textura más dura también generó expresiones faciales de miedo y sorpresa durante la fase de consumo, lo que sugiere una reacción negativa de alerta ante lo que se percibe como un alimento más difícil de masticar.

-

Curiosamente, las investigadoras también encontraron que las reacciones emocionales eran más intensas y la activación emocional mayor durante la observación y la olfacción que durante la manipulación y el consumo. Esto sugiere que la población infantil de edad escolar desarrolla expectativas sobre el alimento antes de probarlo, y que estas expectativas pueden influir en su respuesta emocional cuando finalmente lo consumen.

Figura 5. Perfil emocional obtenido durante la observación de diferentes texturas sólidas en población infantil (N = 45). En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms.

Figura 5. Perfil emocional obtenido durante la observación de diferentes texturas sólidas en población infantil (N = 45). En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms. Figura 6. Perfil emocional obtenido durante la olfacción de diferentes texturas sólidas en población infantil (N = 45). En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms.

Figura 6. Perfil emocional obtenido durante la olfacción de diferentes texturas sólidas en población infantil (N = 45). En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms. Figura 7. Perfil emocional obtenido durante la manipulación de diferentes texturas sólidas en población infantil (N = 45). En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms.

Figura 7. Perfil emocional obtenido durante la manipulación de diferentes texturas sólidas en población infantil (N = 45). En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms. Figura 8. Perfil emocional obtenido durante el consumo de diferentes texturas sólidas en población infantil (N = 45). Durante la fase de consumo los resultados se muestran en base al movimiento observado en los puntos de expresión facial correspondientes a la parte superior de la cara para evitar alteraciones de la medida ocasionadas por la masticación y el procesado oral del alimento1. En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms.Industria y nutricionistas

Figura 8. Perfil emocional obtenido durante el consumo de diferentes texturas sólidas en población infantil (N = 45). Durante la fase de consumo los resultados se muestran en base al movimiento observado en los puntos de expresión facial correspondientes a la parte superior de la cara para evitar alteraciones de la medida ocasionadas por la masticación y el procesado oral del alimento1. En el gráfico de elipses, la forma y el grosor de las líneas corresponden a la evolución del tiempo de exposición. Los tiempos iniciales de exposición se representan con líneas punteadas y finas, mientras que los tiempos de exposición más largos corresponden a líneas continuas y más gruesas. Los productos con diferentes texturas aparecen coloreados de diferente manera, siendo: T6 = gris. T7.1 = verde. T7.2= rojo. Las etiquetas para los rangos de tiempo aparecen en cada gráfico de la siguiente manera: Textura_0: 0–500 ms. Textura_0.5: 500–1000 ms. Textura_1: 1000–1500 ms. Textura_1.5: 1500–2000 ms. Textura_2: 2000–2500 ms. Textura_2.5: 2500–3000 ms.Industria y nutricionistas

Estos resultados son especialmente relevantes para la industria alimentaria y para quienes trabajan en nutrición infantil. Aunque el público infantil pueda aceptar un alimento desde el punto de vista del gusto, su respuesta emocional podría afectar su disposición a consumirlo regularmente. Por ejemplo, si un alimento genera expresiones faciales de sorpresa y/o miedo durante la observación o la olfacción, es posible que sea rechazado antes de probarlo, incluso si luego gusta su sabor. Esto refuerza la idea de que, para mejorar la aceptación de ciertos alimentos es crucial considerar no solo su sabor, sino también la forma en que se presentan y su textura.

Referencias:

[1] A. S. Szczesniak, “Texture is a sensory property,” Food Qual. Prefer., vol. 13, no. 4, pp. 215–225, 2002, doi: 10.1016/S0950-3293(01)00039-8.

[2] M. Laureati et al., “Individual differences in texture preferences among European children: Development and validation of the Child Food Texture Preference Questionnaire (CFTPQ),” Food Qual. Prefer., vol. 80, p. 103828, 2020, doi: https://doi.org/10.1016/j.foodqual.2019.103828.

[3] M. Laureati, C. Cattaneo, V. Lavelli, V. Bergamaschi, P. Riso, and E. Pagliarini, “Application of the check-all-that-apply method (CATA) to get insights on children’s drivers of liking of fiber-enriched apple purees,” J. Sens. Stud., vol. 32, no. 2, 2017, doi: 10.1111/joss.12253.

[4] J. R. Dalenberg, S. Gutjar, G. J. Ter Horst, K. De Graaf, R. J. Renken, and G. Jager, “Evoked emotions predict food choice,” PLoS One, vol. 9, no. 12, pp. 1–16, 2014, doi: 10.1371/journal.pone.0115388.

[5] G. Juodeikiene et al., “Effects of emotional responses to certain foods on the prediction of consumer acceptance,” Food Res. Int., vol. 112, no. May, pp. 361–368, 2018, doi: 10.1016/j.foodres.2018.06.064.

[6] S. S. Samant, M. J. Chapko, and H. S. Seo, “Predicting consumer liking and preference based on emotional responses and sensory perception: A study with basic taste solutions,” Food Res. Int., vol. 100, no. April, pp. 325–334, 2017, doi: 10.1016/j.foodres.2017.07.021.

[7] P. Ekman, “All emotions are basic,” in The nature of emotion, P. Ekman and R. J. Davidson, Eds., Oxford University Press, 1994, pp. 56–58.

[8] C. Darwin, The expression of the emotions in man and animals. Cambridge: Cambridge University Press, 1872. doi: DOI: 10.1017/CBO9781139833813.

[9] R. Plutchik, “The nature of emotions: Human emotions have deep evolutionary roots, a fact that may explain their complexity and provide tools for clinical practice,” Am. Sci., vol. 89, no. 4, pp. 344–350, Apr. 2001, [Online]. Available: http://www.jstor.org/stable/27857503

[10] J. A. Russell, “A circumplex model of affect,” J. Pers. Soc. Psychol., vol. 39, no. 6, pp. 1161–1178, 1980, doi: 10.1037/h0077714.

[11] L. Barrett, “Solving the emotion paradox: Categorization and the experience of emotion,” Pers. Soc. Psychol. Rev., vol. 10, pp. 20–46, Feb. 2006, doi: 10.1207/s15327957pspr1001_2.

[12] P. Ekman, W. Friesen, and J. C. Hager, Facial Action Coding System: The manual on CD-ROM. Instructor’s Guide. Salt Lake City: Network Information Research Co, 2002.

[13] iMotions Biometric Research Simplified, “What is GSR? The definite guide,” 2015. [Online]. Available: https://imotions.com/guides/facial-expression-analysis/

[14] J. J. J. Braithwaite et al., “A guide for analysing Electrodermal Activity (EDA) & Skin Conductance Responses (SCRs) for psychological experiments,” 2015. doi: 10.1017.S0142716405050034.

[15] S. D. Kreibig, “Autonomic nervous system activity in emotion : A review,” Biol. Psychol., vol. 84, no. 3, pp. 14–41, 2010, doi: 10.1016/j.biopsycho.2010.03.010.

[16] N. da Quinta, A. B. Baranda, Y. Ríos, R. Llorente, A. B. Naranjo, and I. Martinez de Marañón, “Children’s physiological and behavioural response during the observation, olfaction, manipulation, and consumption of food products with varied textures. Part 2: Solid products,” Food Qual. Prefer., vol. 115, p. 105120, 2024, doi: https://doi.org/10.1016/j.foodqual.2024.105120.

[17] R. Soussignan and B. Schaal, “Children’ s facial responsiveness to odors: Influences of hedonic valence of odor, gender, age, and social presence,” Dev. Psychol., vol. 32, no. 2, pp. 367–379, 1996, doi: 10.1037/0012-1649.32.2.367.

[18] G. G. Zeinstra, M. A. Koelen, D. Colindres, F. J. Kok, and C. de Graaf, “Facial expressions in school-aged children are a good indicator of ‘dislikes’, but not of ‘likes,’” Food Qual. Prefer., vol. 20, no. 8, pp. 620–624, 2009, doi: 10.1016/j.foodqual.2009.07.002.

Nota:

1 El significado de los puntos de expresión facial de la parte superior de la cara es: AU01: elevador de cejas interno (inner brow raiser); AU02: elevador de cejas externo (outer brow raiser); AU04: bajador o descensor de cejas (brow lowerer); AU05: elevador de párpado superior (upper lid raiser); AU06: elevador de mejillas (cheek raiser); AU07: tensor de párpado (lid tightener); AU43: ojos cerrados (eyes closed) [12].

La asociación de dichos puntos de expresión facial con emociones se realizó en base a las indicaciones aportadas por otras publicaciones científicas [12], [17], [18]. Los puntos de expresión AU01, AU02, AU04 y AU43 se asociaron con emociones negativas. Por otro lado, AU06 se asoció con emociones neutras. Finalmente, se consideró que AU05 y AU07 no tienen relación directa con una emoción.

Sobre la autora: Noelia Da Quinta es doctora en Calidad y Seguridad alimentarias e investigadora postdoctoral en comportamiento del consumidor en AZTI.

Sobre AZTI: El propósito de AZTI es impulsar un cambio positivo para el futuro de las personas, contribuyendo a una sociedad saludable, sostenible e íntegra. Especializado en el medio marino y la alimentación, AZTI aporta productos y tecnologías de vanguardia y de valor añadido basados en ciencia e investigación sólidas. AZTI es miembro de Basque Research and Technology Alliance (BRTA).

Basque Research & Technology Alliance (BRTA) es un consorcio que se anticipa a los retos socioeconómicos futuros globales y de Euskadi y que responde a los mismos mediante la investigación y el desarrollo tecnológico, proyectándose internacionalmente. Los centros de BRTA colaboran en la generación de conocimiento y su transferencia a la sociedad e industria vascas para que sean más innovadoras y competitivas. BRTA es una alianza de 17 centros tecnológicos y centros de investigación cooperativa y cuenta con el apoyo del Gobierno Vasco, SPRI y las Diputaciones Forales de Araba, Bizkaia y Gipuzkoa.

El artículo La textura de los alimentos como generador de emociones en la infancia se ha escrito en Cuaderno de Cultura Científica.

Los casquetes polares de Marte y el interior del planeta rojo

Cuando en una de esas noches en las que Marte y la Tierra se encuentran relativamente cerca -bueno, cerca en el sentido astronómico, ya que es difícil que nos acerquemos a menos de 55 millones de kilómetros- y miramos con un telescopio modesto, hay algo que salta a la vista y que, sin poder ver ningún otro detalle de la superficie con tanta claridad entre la turbulencia atmosférica, nos hace sentir cierta familiaridad: los casquetes polares de Marte.

Más allá de que para los geólogos las capas de polvo y hielo de los casquetes polares -como una inmensa tarta de chocolate y galletas- pueden albergar una importantísima información sobre la historia climática del planeta rojo, hay algo más que nos pueden enseñar estas grandes masas de hielo al igual que las hemos podido aprovechar en la Tierra: conocer mejor la rigidez del manto y, a la vez, como de frío está el interior del planeta.

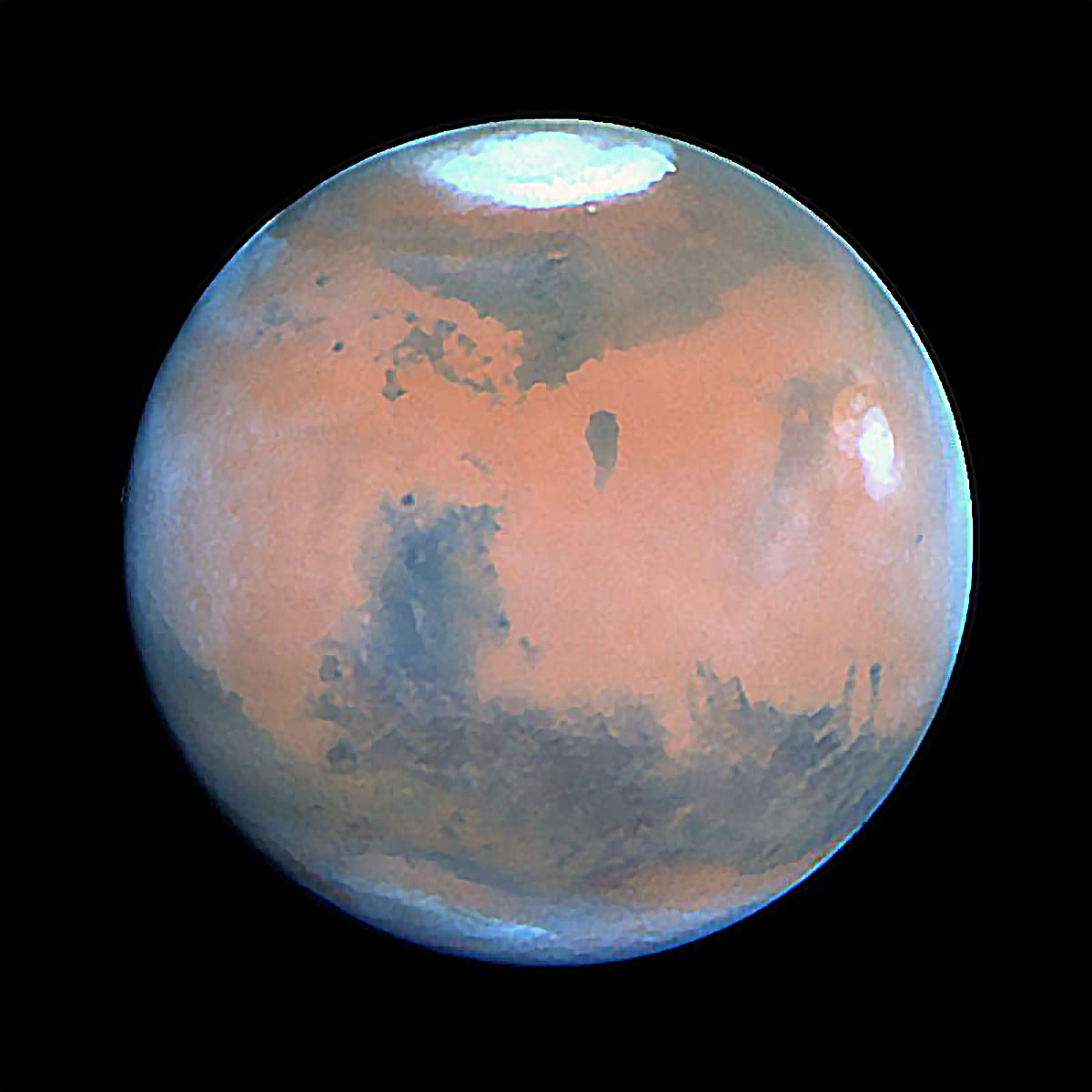

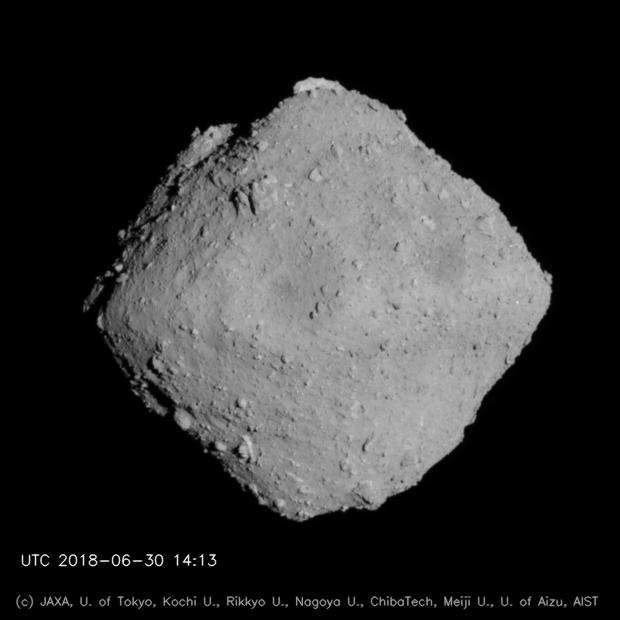

Marte observado desde el telescopio espacial Hubble. El casquete polar del hemisferio Norte es claramente visible en la parte superior del planeta. Si en vez de rojo, fuese azul, muy probablemente encontraríamos un parecido todavía más asombroso con nuestro planeta. Cortesía de JPL/NASA/STScI.

Marte observado desde el telescopio espacial Hubble. El casquete polar del hemisferio Norte es claramente visible en la parte superior del planeta. Si en vez de rojo, fuese azul, muy probablemente encontraríamos un parecido todavía más asombroso con nuestro planeta. Cortesía de JPL/NASA/STScI.En la Tierra tenemos una compleja historia de periodos glaciares e interglaciares. Durante las popularmente conocidas como “edades del hielo” -los periodos glaciares-, sobre los continentes suelen formarse grandes masas de hielo y, con su enorme peso, tienen la capacidad de ir hundiendo la corteza que hay debajo, flexionándola como cuando clavamos un dedo sobre una bola antiestrés.

Cuando el clima va cambiando hacia un periodo más cálido -o interglaciar- y el hielo comienza a fundirse, este peso se va liberando y la corteza “rebota” hacia arriba en un proceso que conocemos como rebote isostático, que como decía en el párrafo anterior, nos da pistas sobre el estado del interior de nuestro planeta.

En Marte podemos medir estos procesos gracias al casquete de hielo que existe en el polo Norte, un enorme depósito de hielo y polvo de varios kilómetros de espesor acumulados durante millones de años y que es capaz de, por su peso, deformar la corteza de con una magnitud que podemos medir a través de las misiones espaciales. Y un nuevo artículo publicado por Broquet et al. (2025), nos ha abierto, gracias a la deformación que produce el peso de este hielo sobre la corteza del planeta, una ventana para conocer mejor el funcionamiento interno de Marte.

¿Cómo han abordado los científicos este problema? Porque no ha habido ninguna misión específica dedicada a estudiar esta cuestión en la superficie de Marte, pero tampoco desde la órbita. A pesar de eso, han logrado cuatro indicios diferentes para reconstruir con más detalle estos procesos de deformación y respuesta de la corteza y el manto marciano.

La primera de estas pistas viene dada por el estudio de los perfiles de radar tomados por los instrumentos MARSIS y SHARAD, que les ha permitido observar una especie de “radiografía” de los casquetes polares gracias a las ondas de radio que rebotan -y en algunos casos son absorbidas- por las distintas capas del casquete polar. Con estos perfiles se ha podido calcular el espesor real de la capa de hielo y estudiar el estado de las rocas que soportan esta masa de hielo, descubriendo que no ha sufrido una flexura o flexión muy grande como consecuencia del peso.

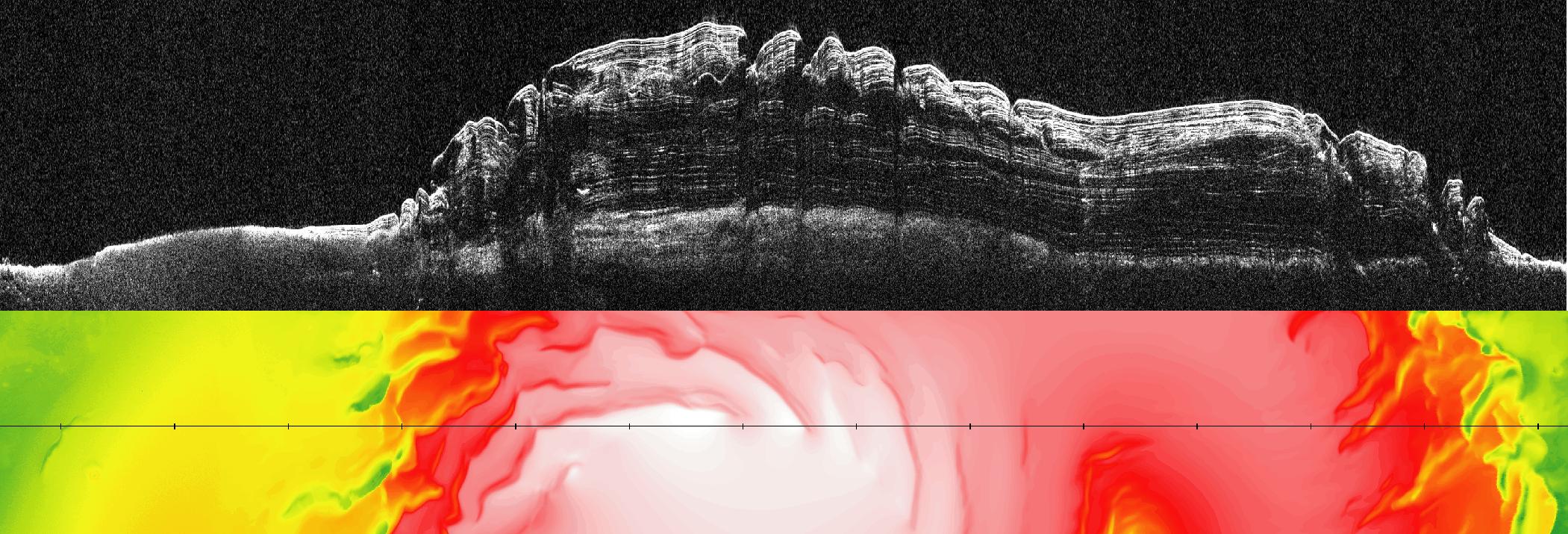

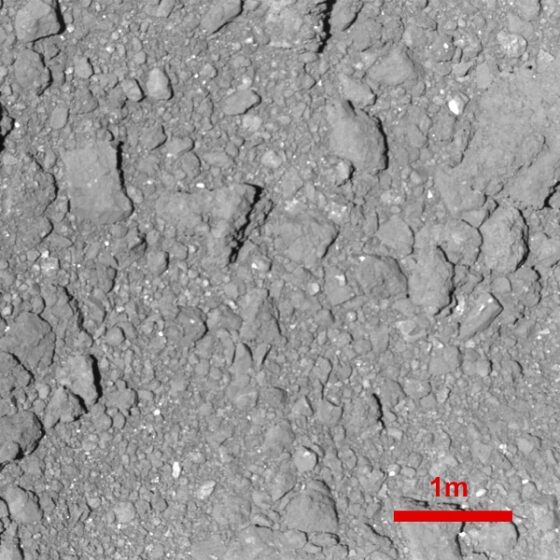

En esta imagen podemos ver un perfil de radar del polo norte marciano tomado por el instrumento SHARAD que viaja a bordo de la sonda Mars Reconaissance Orbiter. Se aprecian perfectamente distintas capas dentro del hielo -quizás relacionadas con alternancias climáticas- así como la roca sobre la que se apoya el hielo. Cortesía de NASA/JPL-Caltech/University of Rome/SwRI.

En esta imagen podemos ver un perfil de radar del polo norte marciano tomado por el instrumento SHARAD que viaja a bordo de la sonda Mars Reconaissance Orbiter. Se aprecian perfectamente distintas capas dentro del hielo -quizás relacionadas con alternancias climáticas- así como la roca sobre la que se apoya el hielo. Cortesía de NASA/JPL-Caltech/University of Rome/SwRI.Por otro, el estudio del campo gravitatorio de Marte, que no es estático, sino que va cambiando con el paso del tiempo. Cuando el hielo se va acumulando sobre los casquetes y se deforma la corteza, ocurren cambios sutiles que se pueden ir siguiendo a lo largo de los años marcianos, permitiendo a los científicos ver que parte de la superficie rebota o se hunde. Este hecho incluso puede observarse con el cambio de las estaciones, ya que hay parte del hielo que se sublima a la atmósfera durante la primavera y el verano y cae de nuevo durante el invierno, generando una alteración del campo gravitatorio suficientemente perceptible.

Los datos sísmicos de la misión InSight han sido también muy importantes, ya que de ellos se aprecia que no han ocurrido terremotos importantes cerca del polo norte, indicando que la deformación en la corteza del planeta es muy pequeña, permitiendo acotar a los científicos que cantidad de flexión está sufriendo la corteza con respecto a la actividad sísmica observada. Por cierto, este hecho tiene también una derivada práctica importante, y es que, de cara al riesgo sísmico para las futuras misiones tripuladas marcianas, el polo norte podría ser relativamente “tranquilo” y, por lo tanto, un lugar seguro. Si las rocas que sirven de apoyo al casquete polar hubiesen sufrido una mayor deformación, lo más probable es que hubiese una mayor actividad sísmica también.

Por último, los investigadores han confeccionado una serie de modelos físicos que simulan la evolución del calor interno de Marte desde su formación hasta el día de hoy, permitiendo poner a prueba varios escenarios sobre como podía ser la estructura interna del planeta, y, combinando estos escenarios con los datos reales, saber cuales podrían ser los más certeros.

¿Y qué resultados arroja la combinación de todos estos datos junto con los modelos? El primero es que el manto de Marte, la capa que hay justo debajo de la corteza, es más viscosa de lo que se había pensado hasta ahora. La viscosidad, en este sentido, es la resistencia a fluir del manto. Esto no quiere decir que el manto esté fundido, si no que, a escala geológica, las rocas del manto se comportan como un fluido, pero se encuentran en estado sólido.

Detalle del casquete polar del hemisferio norte tomado por la sonda europea Mars Express. Se aprecia muy bien la forma “arremolinada” de las capas de hielo y polvo. Cortesía de ESA/DLR/FU Berlin (G. Neukum).

Detalle del casquete polar del hemisferio norte tomado por la sonda europea Mars Express. Se aprecia muy bien la forma “arremolinada” de las capas de hielo y polvo. Cortesía de ESA/DLR/FU Berlin (G. Neukum).Esto es importante porque un manto muy viscoso nos indica que el interior de Marte está hoy relativamente frío -si no sería menos viscoso- y que los elementos radiogénicos que producen calor a partir de la desintegración radioactiva probablemente no estén distribuidos de una manera uniforme en su interior. Y de hecho es probable que muchos de estos elementos estén concentrados en la corteza, permitiendo que, por otro lado, esta esté más caliente.

Las implicaciones de esta observación son muy importantes: Sabemos que Marte ha tenido actividad volcánica en el pasado reciente -incluso en los últimos miles de años- y que puede que este fenómeno se deba no a la presencia de magmas que puedan provenir del manto, sino que estos podrían incluso formarse dentro de la propia corteza gracias a una mayor concentración de elementos radiogénicos suficientes para elevar la temperatura, fundir la roca y dar lugar a los magmas que posteriormente fluirían hacia la superficie.

Para concluir, otro aspecto que me ha parecido muy interesante del estudio es que el casquete polar del hemisferio norte es relativamente joven -a escala geológica- y que el hielo podría haberse estado acumulando desde hace entre 1.7 y 1.2 millones de años, por lo que la deformación de la corteza todavía estaría en marcha y no podemos apreciar todavía su verdadera magnitud debido a la lentitud de este proceso. Dicho esto, el poder establecer una fecha para cuando se comenzó a formar este casquete polar nos puede ayudar a comprender mejor la historia climática del planeta y la relación de este con los distintos ciclos astronómicos (oblicuidad, excentricidad, precesión…).

Todavía nos queda mucho para saber todos los detalles de la estructura interna del planeta Marte, pero cada trocito que descubrimos -aunque sea a través de misiones que muchas veces no parecen conectadas entre si- nos ayuda a estar más cerca de poder responder a por que Marte y la Tierra son planetas tan diferentes.

Bibliografía:

A. Broquet, et al. (2025) Glacial Isostatic Adjustment Reveals Mars’s Interior Viscosity Structure. Nature doi: 10.1038/s41586-024-08565-9

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo Los casquetes polares de Marte y el interior del planeta rojo se ha escrito en Cuaderno de Cultura Científica.

Glaucoma, un vacío inquietante en un campo lleno de milagros

El glaucoma afecta a más de 70 millones de personas y representa la segunda causa principal de ceguera en todo el mundo. Foto: Pixabay CC

El glaucoma afecta a más de 70 millones de personas y representa la segunda causa principal de ceguera en todo el mundo. Foto: Pixabay CCMás allá de la celebrada conversión del agua en vino, si tuviésemos que citar el milagro bíblico por excelencia seguramente diríamos «devolverles la vista a los ciegos». Pero, lo que durante siglos ha sido casi una habilidad mágica, disponible en exclusiva para divinidades, en nuestros días empieza a considerarse algo accesible y cercano en numerosas investigaciones biomédicas. Vivimos tiempos fascinantes en biomedicina y, cuando hablamos de «curar la ceguera» nos encontramos, casi a diario, un buen puñado de estudios científicos y noticias que nos colocan un paso más cerca de conseguirlo.

Ya sea con células madre para recuperar lesiones oculares, o implantes biónicos que, mediante neuroestimulación, podrían permitir restaurar funciones sensoriales, o el desarrollo avanzado de prototipos de córnea artificial, e incluso mediante técnicas de edición genética CRISPR para reparar la retina. Las posibilidades que se abren ante nosotros son tantas y tan variadas que no parece demasiado arriesgado adelantar que, en las próximas décadas, asistiremos a la conclusión de un milagro milenario.

Sin embargo existen ciertas enfermedades de la vista que no parecen avanzar tan rápido, determinados trastornos que afectan a un alto porcentaje de las personas ciegas y que no aún no cuentan con ningún avance revolucionario. Es el caso del glaucoma un amplio y heterogéneo grupo de enfermedades oculares neurodegenerativas caracterizadas por un daño gradual e irreversible del nervio óptico que en la actualidad afecta a más de 70 millones de personas. El daño por glaucoma es permanente, no cuenta con cura o tratamiento y se ha convertido en la segunda causa principal de ceguera en todo el mundo.

Ante este aparente vacío entre tanto milagro cotidiano y, teniendo en cuenta las elevadas cifras que ostenta el glaucoma, cualquier avance sobre el tema, por pequeño y lejano que parezca, resulta más que bienvenido. Encontramos un esperanzador ejemplo en un estudio publicado hace unas semanas en PNAS Nexus, el journal open Access de la célebre Proceedings of the National Academy of Sciences (PNAS), por el que se presentan dos anticuerpos que «podrían detener esta degradación y posiblemente salvar la visión de las personas antes de que sea demasiado tarde».

Comencemos el análisis de este estudio con una aproximación a las causas que generan la enfermedad. En términos generales el glaucoma consiste en un daño al nervio óptico, responsable de llevar al cerebro las imágenes convertidas en impulsos eléctricos en la retina. La mayoría de las veces ese daño en el nervio óptico está provocado por un aumento de la presión intraocular. Si nuestro ojo fuese un balón de baloncesto su correcto funcionamiento dependería de una delicada presurización, que está regulada por la producción y el drenaje equilibrados del humor acuoso, un líquido transparente que nutre el segmento anterior ocular. En un ojo sano, ese líquido se drena continuamente permitiendo una correcta visión mientras que «en la mayoría de las formas de glaucoma un drenaje deficiente del humor acuoso desemboca en un aumento de la presión intraocular».

Este mal drenaje del líquido y su consecuente aumento de la presión pueden tener varias causas y la principal de ellas nos lleva a hablar de una proteína en concreto que, a la postre, se ha convertido en la protagonista del nuevo estudio: la miocilina.

Las proteínas realizan o regulan miles de funciones en nuestro cuerpo y, a grandes rasgos, son largas cadenas de aminoácidos que se pliegan de determinadas formas para realizar su trabajo. Es fundamental que el plegamiento sea el correcto, de lo contrario, la proteína no podrá llevar a cabo su función biológica. De hecho, es un problema inquietante ya que una proteína mal plegada puede «contagiar» su mala configuración a otras, dando lugar a un amplio grupo de enfermedades, como el Alzheimer, el Parkinson, o las enfermedades priónicas. Precisamente, la investigación sobre plegamiento de proteínas realizada en este tipo de enfermedades neurodegenerativas ha sido la base e inspiración para la nueva publicación sobre el glaucoma.

«Una de las mutaciones que causa glaucoma congénito y que es la responsable de un alto porcentaje de los casos de esta enfermedad provoca que una proteína, miocilina, debido a esta mutación, se sintetice mal plegada en las células que la producen, perdiendo su función», nos explica la neurocientífica Conchi Lillo, investigadora en patologías visuales en el Instituto de Neurociencias de Castilla y León y profesora titular de la Universidad de Salamanca. «Esta proteína es importante para el correcto drenaje del humor acuoso que baña la cámara anterior del ojo, así que el mal funcionamiento de la proteína, debido a este plegamiento incorrecto, provoca que este drenaje no se produzca de una forma eficiente».

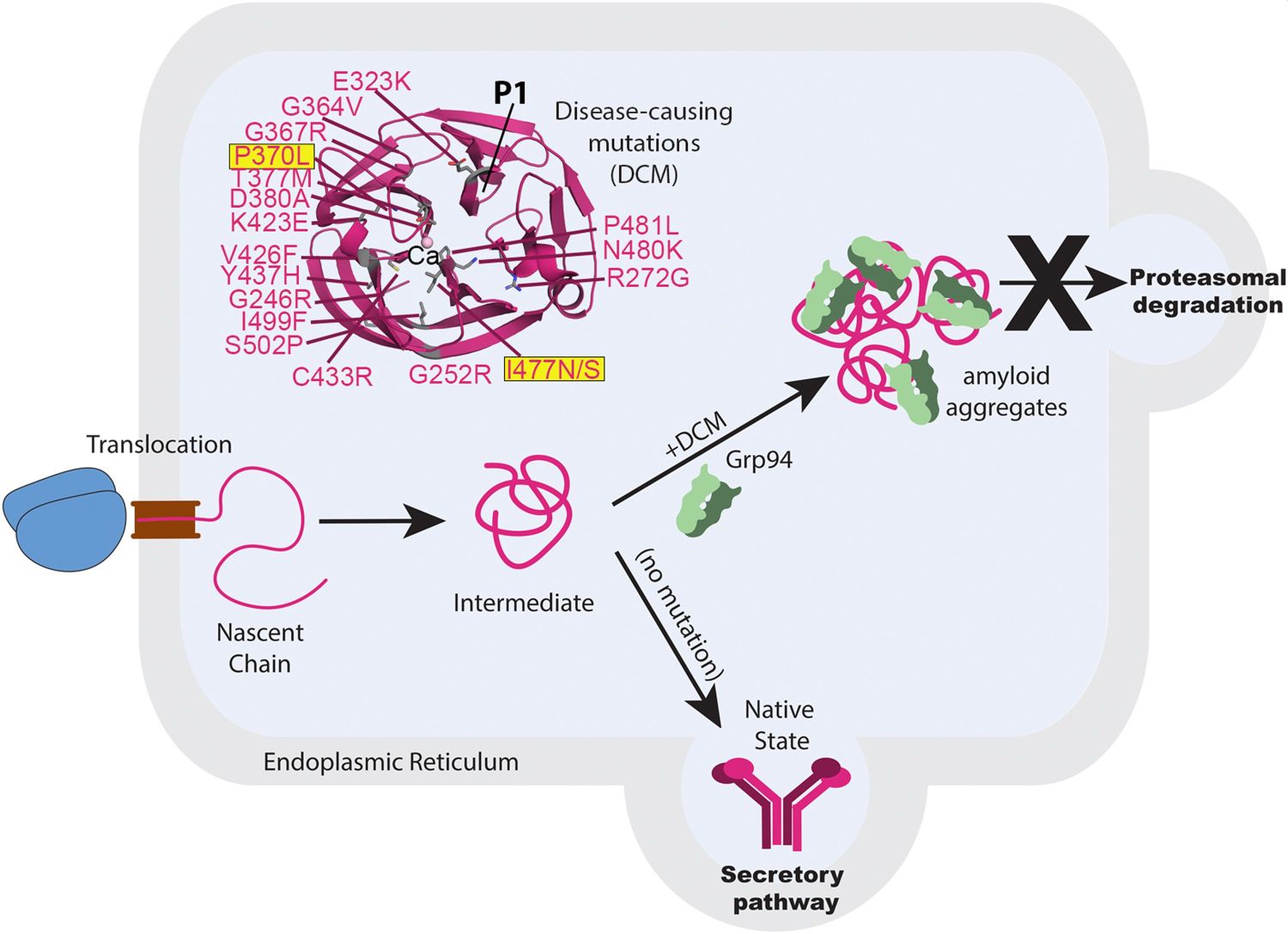

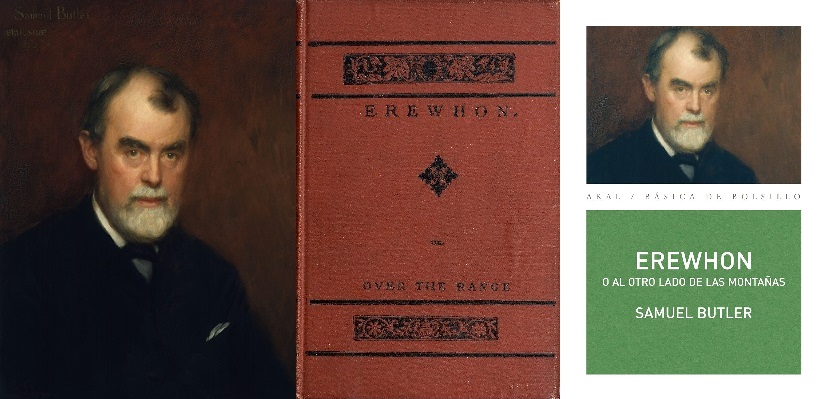

Descripción general del mecanismo patogénico subyacente al glaucoma asociado a la miocilina. Fuente: Raquel L Lieberman, et al. (2025) PNAS Nexus

Descripción general del mecanismo patogénico subyacente al glaucoma asociado a la miocilina. Fuente: Raquel L Lieberman, et al. (2025) PNAS NexusEn el estudio publicado en PNAS Nexus los autores presentan un posible tratamiento para frenar el glaucoma congénito producido por el mal plegamiento de la miocilina empleando anticuerpos generados en el laboratorio que son capaces de neutralizar la forma incorrecta de la proteína. «Los anticuerpos que neutralizan la miocilina mal plegada se sintetizaron inmunizando a ratones con antígenos de esta proteína. La reacción inmunitaria que provoca esta inmunización en su organismo hace que en su suero sanguíneo aparezcan los anticuerpos contra ese antígeno, que se pueden aislar y utilizar para comprobar si son eficaces para neutralizar miocilina», explica Lillo. «Para ello, se probó su efectividad usando estos anticuerpos aislados en células en cultivo que expresaban esta proteína miocilina mal plegada, comprobando que efectivamente, realizaban esa función».

El glaucoma representa un vacío en un mundo repleto de milagros. Entre los extraordinarios éxitos logrados en el complejo, y casi divino, arte de devolver la vista al ciego, esta patología sigue siendo un preocupante oasis en el que avanzar está siendo muy difícil. Por eso resulta fácil dejarse entusiasmar por cualquier pequeño detalle o ventana al futuro, pero hay que ser realista y entender que este estudio publicado aún está muy lejos de ser aplicable. «Son resultados prometedores porque se ha encontrado una posible diana terapéutica para abordar la raíz del problema que se produce en el glaucoma, pero hay que tener cautela con las expectativas, ya que este “posible tratamiento” no se ha probado aún en animales de experimentación y ni siquiera las células en cultivo empleadas para estas pruebas son las que en los ojos humanos producen la miocilina mal plegada en la enfermedad de glaucoma».

Referencias:

Raquel L Lieberman, et al. «Antibody-mediated clearance of an ER-resident aggregate that causes glaucoma» PNAS Nexus (2025) DOI:10.1093/pnasnexus/pgae556

Tess Malone «Under Pressure: Georgia Tech Researchers Discover a New Way to Treat Glaucoma» Georgia Tech (2025)

Sobre el autor: Javier «Irreductible» Peláez (Puertollano, 1974) es escritor y comunicador científico. Autor de 500 años de frío. La gran aventura del Ártico (Crítica, 2019) y Planeta Océano (Crítica 2022). Es uno de los fundadores de la plataforma Naukas.com, editor de ciencia en Yahoo España y Latinoamérica. Es guionista científico en los programas de televisión «El Cazador de Cerebros» y «Órbita Laika» de RTVE. Durante más de una década ha escrito en diferentes medios de comunicación (El País, El Español, National Geographic, Voz Populi). Es autor de los podcasts Catástrofe Ultravioleta y La Aldea Irreductible, y ha colaborado en diferentes proyectos radiofónicos y televisivos (Radio Nacional de España, Radio Televisión Canaria). Es ganador de tres premios Bitácoras, un premio Prisma a la mejor web de divulgación científica y un Premio Ondas al mejor programa de radio digital.

El artículo Glaucoma, un vacío inquietante en un campo lleno de milagros se ha escrito en Cuaderno de Cultura Científica.

Aprender y convivir en contextos multiculturales en educación infantil

La jornada Las Pruebas de la Educación regresó un año más para revisar la eficacia de las estrategias educativas actuales a partir de la evidencia científica. El desarrollo del lenguaje oral en la infancia y su poder en la creación de distintas realidades sobre un mismo tema, así como la riqueza del aprendizaje en entornos multiculturales fueron algunas de las cuestiones analizadas durante la séptima edición de este seminario.

Andrea Khalfaoui, profesora en el departamento de Ciencias de la Educación en la Universidad del País Vasco, argumenta en “Aprender y convivir en contextos multiculturales en Educación Infantil: una mirada informada por la evidencia” cómo la multiculturalidad, presente hoy día en muchas aulas, puede emplearse como palanca de aprendizaje.

La jornada, fruto de la colaboración entre la Cátedra de Cultura Científica de la Universidad del País Vasco y la Facultad de Educación de Bilbao, tuvo lugar el 21 de febrero de 2025 en la sala Juliana Agirrezabala de la Facultad de Educación de Bilbao de la Universidad del País Vasco UPV/EHU en Leioa (Bizkaia). Las ponencias fueron impartidas por un abanico de expertos y expertas del ámbito de la educación, la formación y el aprendizaje.

La séptima edición del seminario está especialmente dirigida a profesionales del ámbito de la educación y a quienes, en un futuro, formarán parte de este colectivo. El objetivo es crear un espacio de reflexión compartida, desde la evidencia científica, sobre la validez de las estrategias utilizadas hoy en día.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Aprender y convivir en contextos multiculturales en educación infantil se ha escrito en Cuaderno de Cultura Científica.

El fascinante invento para detectar materia oscura en el interior de Júpiter

Miremos a los cielos imitando a los antiguos. Y con ello tratemos de entender cosas casi incomprensibles como la materia oscura. Acaso esto alivie el desconsuelo de que sea más sencilla la cosmología que la política.

Hagamos volar nuestra curiosidad como si fuera una cometa pensando en unas partículas ligeras y extrañas. Y redondeemos nuestro juego de niños imaginando planetas gigantes que quieren atraparlas. Pues de eso justamente trata uno de los últimos retos de la astrofísica: pretende descubrir a fondo la naturaleza de la materia oscura entendiéndola como algo formado por partículas hipotéticas propuestas por los científicos. Y para ello se recurre a Júpiter, uno de nuestros vecinos pesados. Y cuando digo pesado no es que nos aburra, sino que es muy masivo. No por casualidad lo llamamos el gigante rojo.

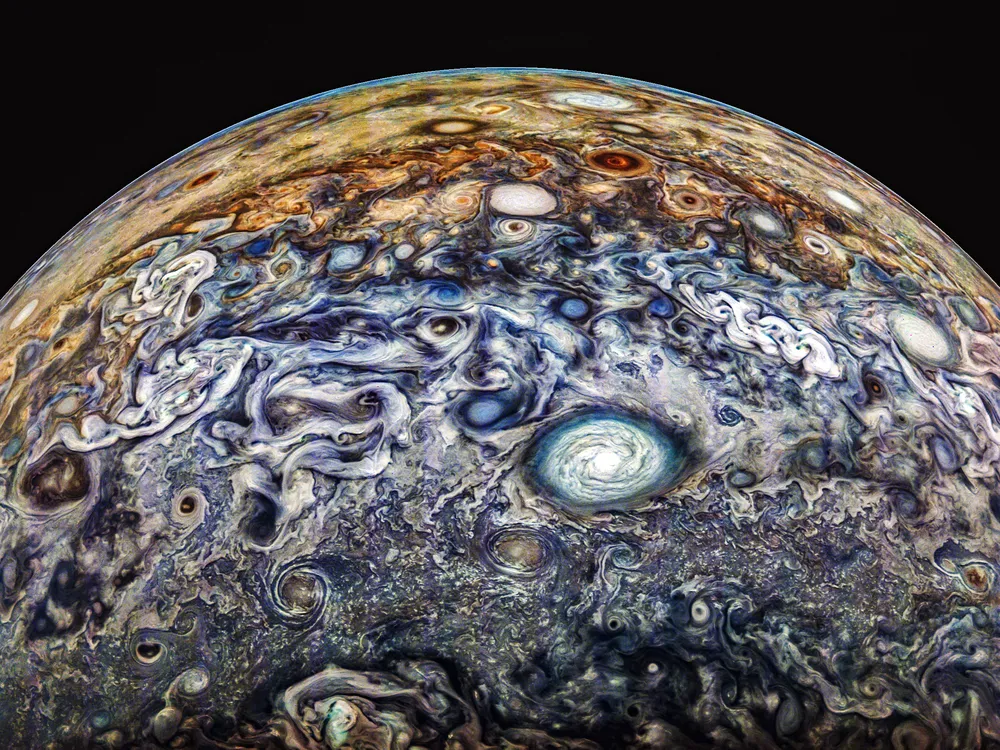

Imagen procesada de Júpiter tomada por la sonda Juno. Fuente: NASA / JPL / SwRI / MSSS / Gerald Eichstädt / Thomas Thomopoulos CC BY 3.0El poderío de Júpiter para atrapar WIMP

Imagen procesada de Júpiter tomada por la sonda Juno. Fuente: NASA / JPL / SwRI / MSSS / Gerald Eichstädt / Thomas Thomopoulos CC BY 3.0El poderío de Júpiter para atrapar WIMP

Este planeta fundamentalmente gaseoso tiene una densidad baja, y su gravedad en la superficie tan solo es algo más de 2 veces la de la Tierra. Sin embargo, el campo gravitatorio en el interior parece que podría ser muy intenso, según sugieren las complejas mediciones de la misión Juno. Esto se debería a la presencia de elementos metálicos atrapados a muy altas presiones en el núcleo del planeta.

Este poderío gravitatorio confiere a Júpiter la capacidad de atrapar unas partículas ligeras que teóricamente podrían componer la materia oscura, los llamados WIMP. Claro que “ligera” significa aquí que es una partícula con la misma energía que un protón o un neutrón, es decir, del orden del gigaelectronvoltio.

Como bien sabían los electroduendes, esta sería precisamente la energía necesaria para hacer que un electrón se mueva por una diferencia de potencial de mil millones de voltios. No debería sorprendernos esta semejanza en escalas de energía. De hecho, hay hipótesis que sugieren que las partículas de materia oscura podrían ser neutrones espejo.

Pero no solo tenemos que entender qué es la materia oscura. Tan o más importante es detectarla.

Materia oscura errantePodría haber partículas de materia oscura vagando por el universo que se adentrasen en el acogedor Júpiter. Y en ese traicionero albergue sufrirían diversos choques con todo el resto de partículas (idénticas o las del propio planeta). Sería como si la materia oscura jugase un campeonato planetario de billar. En cada uno de estos topetazos las partículas de materia oscura irían perdiendo energía para quedar finalmente aniquiladas siguiendo las reglas de la mecánica cuántica, que este año está de aniversario.

El fructífero resultado de la destrucción de los WIMP sería la emisión de neutrinos susceptibles de ser detectados en la Tierra.

Los efectos de la aniquilaciónUna de las maneras de saber que ha llegado a nuestro planeta uno de esos neutrinos, fruto de la aniquilación de los WIMP, es el efecto Cherenkov. Se manifiesta como un destello característico en forma de cono de luz azul (pura radiación electromagnética) que producen ciertas partículas cargadas.

Para que el efecto se produzca, las cargas han de viajar más rápido que la luz al atravesar un medio como agua o gas. Pero no nos llevemos las manos a la cabeza: por su naturaleza, esas partículas no superarían la velocidad de la luz en el vacío. Este fenómeno luminoso es muy parecido al “boom sónico”. Y en el campo de la astrofísica experimental se construyen sensores especializados que identifican esas vertiginosas partículas y miden sus velocidades.

El medio de preferencia de muchos de estos sensores es el agua, por la particular interacción que tienen los neutrinos con el H₂O. Además, no nos vamos a engañar, el agua es abundante y barata (o lo era).

Los detectores colosalesPero para hacernos una idea del tamaño de un bicharraco de estos vamos con los datos del detector Super-Kamiokande (de tipo Cherenkov, obviamente). Este ingenio, crucial para entender algunos aspectos de la física de los neutrinos, contiene 50 000 toneladas de agua purísima.

Conviene enfatizar que los neutrinos que escaparían de Júpiter, como cualquier otro neutrino, no tienen carga. Así que no son exactamente esas las partículas que detectarían el detector Cherenkov. Más bien iría a la caza y captura de partículas cargadas secundarias surgidas de las interacción de los neutrinos con la materia. En concreto, serían producidas en esos encuentros no consentidos entre los neutrinos y las moléculas de agua.

Pero sabiendo que Super-Kamiokande se ha usado para detectar neutrinos solares y sumando dos y dos surge esta pregunta: ¿no serviría el Sol también como diana idónea para la materia oscura ligera?

La temperatura importaEn principio el campo gravitatorio del Sol es también muy intenso y tiene capacidad de ser penetrado por los WIMP. Debería ser entonces susceptible de poder usarse del mismo modo que Júpiter.

La contrariedad es que el interior de nuestra estrella tiene una temperatura elevadísima. Por este motivo, los núcleos atómicos protagonistas de los choques más relevantes se moverían muy rápido. Esto causaría una ganancia de energía cinética por parte de la partícula ligera de materia oscura. Con este aumento de velocidad, a las partículas de materia oscura les sería más fácil escapar de esa prisión estelar sin ser aniquiladas. Y si no se aniquilan, no podríamos detectarlas.

En cambio, la temperatura de Júpiter aún siendo alta no lo es tanto y le resulta más fácil capturar WIMP. Pasa algo parecido a lo que ocurre con la sopa del cuento de Ricitos de Oro y los tres osos. Para que un astro pueda atrapar en su interior a la materia oscura ha de estar a una temperatura propicia.

El invento para el porvenirEl afán por comprender estos y otros fenómenos impulsa la construcción de detectores aún más potentes, como el proyectado Hyper-Kamiokande, un ingenio que ahora cuenta con participación española. Este futuro detector tendrá 5 veces más agua que su predecesor. Sus colosales especificaciones lo harán protagonista de mucha física del futuro.

Pero siempre me queda la duda de si realmente queremos llegar a ese porvenir. Descubrir por fin la naturaleza de la materia oscura traerá consigo cierta melancolía. Poco a poco nos quedaremos sin preguntas que resolver y la física será solo para nostálgicos. Aunque la intuición, o la esperanza, me dicen que falta mucho para que el universo nos ceda todos sus secretos.![]()

Sobre la autora: Ruth Lazkoz es catedrática de física teórica de la Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo El fascinante invento para detectar materia oscura en el interior de Júpiter se ha escrito en Cuaderno de Cultura Científica.

(Ni son) tierras (ni son) raras

Uno de los temas más candentes de la actualidad mundial son las tierras raras, debido a la urgencia que están mostrando ciertos países por hacerse con ellas. Pero, ¿qué son las tierras raras? Y ¿por qué son tan importantes?

Pues debo comenzar diciendo que su nombre nos lleva, directamente, a dos errores. Por un lado, la palabra tierra hace que pensemos en ese sedimento que cubre la parte más superficial del terreno, es decir, en algún tipo de suelo, pero nada más lejos de la realidad. Tierra es un término arcaico utilizado en química para referirse a los elementos que aparecen en forma de óxidos en la naturaleza y que se ha mantenido hasta la actualidad, prácticamente a modo de homenaje, pero no tiene nada que ver con la definición geológica de “tierra” como sedimento. Y, por otro lado, la palabra rara nos lleva a suponer que son muy escasos, pero tampoco es cierto. Estos elementos son relativamente comunes en nuestro planeta, incluso en términos totales que calcula que son más abundantes que todo el oro presente en la Tierra, pero se les denomina “raros” porque, generalmente, aparecen en concentraciones muy pequeñas dentro de los minerales y rocas y, sobre todo, porque su diferenciación química (es decir, su extracción del resto de componentes de los minerales) es muy compleja y bastante difícil.

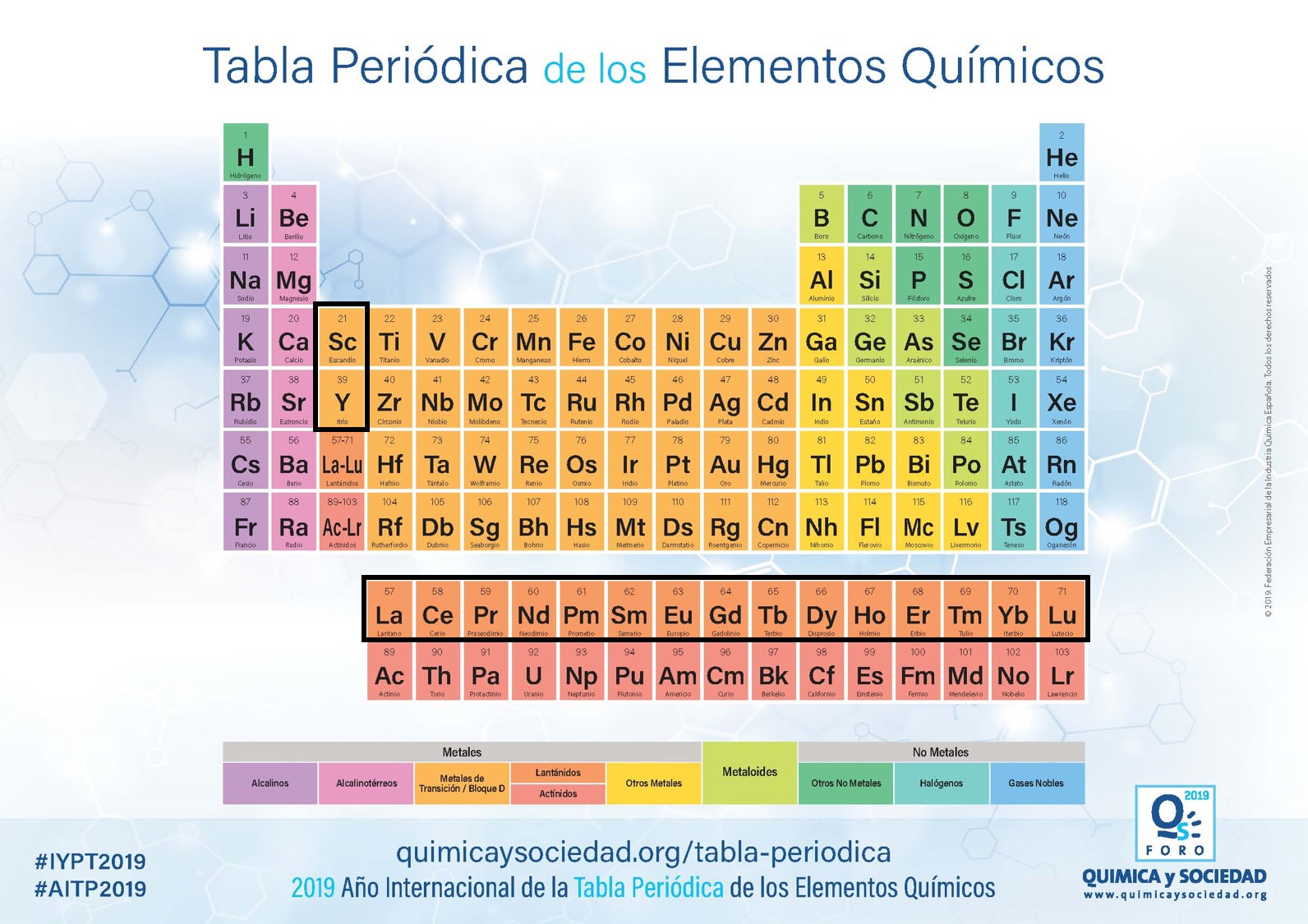

Tabla periódica de los elementos químicos, donde se marcan las tierras raras. Fuente: Federación Empresarial de la Industria Química Española vía Química y Sociedad

Tabla periódica de los elementos químicos, donde se marcan las tierras raras. Fuente: Federación Empresarial de la Industria Química Española vía Química y SociedadEntonces, ¿qué son las tierras raras? Pues este término hace referencia a 17 elementos químicos de la Tabla Periódica, los 15 de la serie de los lantánidos* (lantano, cerio, praseodimio, neodimio, prometio, samario, europio, gadolinio, terbio, disprosio, holmio, erbio, tulio, iterbio y lutecio) a los que se suman el escandio y el itrio. Estos elementos no aparecen en nuestro planeta en forma nativa, como lo pueden hacer el cobre o el oro, sino que siempre aparecen formando compuestos en la estructura química de ciertos minerales en concentraciones muy bajas, concretamente de partes por millón (para que os hagáis una idea, las concentraciones en porcentaje corresponden a 1/100 partes, mientras que las concentraciones en partes por millón equivalen a 1/1.000.000 del total).

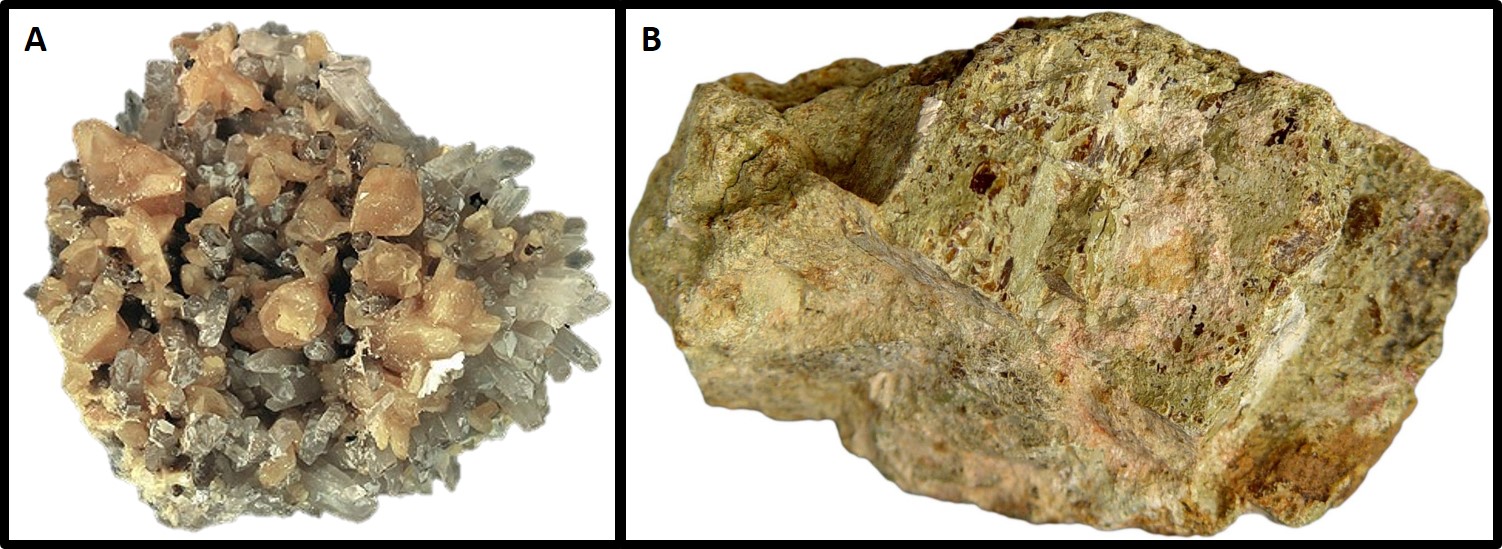

Las tierras raras pueden aparecer en minerales más o menos conocidos, como el apatito o los clinopiroxenos, o en otros con nombres algo más raros, como la monacita o la bastnasita. Pero estos minerales con ciertas concentraciones de tierras raras no se forman en cualquier lugar, sino que lo hacen en contextos geológicos muy concretos. Principalmente, se trata de zonas en las que afloran rocas ígneas, principalmente volcánicas, que se han producido por el ascenso de magmas muy profundos que se han ido enriqueciendo en estos elementos químicos mientras iban ascendiendo por el manto y la corteza terrestres. También aparecen en lugares que han sufrido metamorfismos particulares en los que han estado relacionados fluidos hidrotermales que han atravesado rocas ricas en tierras raras y, en su circulación hacia la superficie, han ido precipitándolas a su paso en diferentes venas minerales. Y hay un tercer contexto un poco más especial aún, los medios sedimentarios formados por la erosión y el depósito de fragmentos de estas rocas ígneas y metamórficas con minerales que incluyen tierras raras en su composición.

A) Ejemplar con cristales del mineral monacita (de color anaranjado) entre cristales de cuarzo (incoloros), extraído de la mina Siglo Veinte, en Bolivia. B) Ejemplar del mineral bastnasita obtenido en Burundi. Fuentes: A) Robert M. Lavinsky / Wikimedia Commons, B) Kouame / Wikimedia Commons

A) Ejemplar con cristales del mineral monacita (de color anaranjado) entre cristales de cuarzo (incoloros), extraído de la mina Siglo Veinte, en Bolivia. B) Ejemplar del mineral bastnasita obtenido en Burundi. Fuentes: A) Robert M. Lavinsky / Wikimedia Commons, B) Kouame / Wikimedia CommonsComo os decía al principio, la explotación de estos yacimientos minerales no es ni barata, ni sencilla. Los minerales que incluyen tierras raras suelen aparecer entremezclados con otros que no nos interesan, por lo que hay que hacer una selección previa, junto con un estudio geológico muy detallado, de las zonas y los materiales que queremos extraer. Y, una vez obtenidos esos minerales, hay que someterlos a un proceso químico largo y complejo para poder aislar las tierras raras. Eso implica un análisis preliminar de la viabilidad económica del yacimiento, para asegurar que se va a obtener un beneficio con su explotación, porque es muy fácil que las empresas acaben en bancarrota si no tienen cuidado.

Una vez visto todo esto, ¿por qué son tan famosas e importantes las tierras raras? Pues por sus propiedades magnéticas y luminiscentes. Actualmente se han convertido en componentes indispensables en la estrategia de transición ecológica, ya que forman parte de catalizadores, imanes, baterías, componentes electrónicos o pantallas de aerogeneradores, vehículos eléctricos o mecanismos informáticos. También tienen un papel primordial en el avance médico, ya que permiten generar nuevas herramientas de diagnóstico y tratamiento para enfermedades tan dañinas como el cáncer. Por estos motivos, han entrado de cabeza en los listados de materiales críticos y estratégicos a nivel mundial, por lo que su búsqueda y explotación evitará la dependencia de Europa o Estados Unidos de terceros países, como China, principal exportador de tierras raras en la actualidad.

Pero hay un motivo menos noble y más prosaico por el que han cobrado tanta importancia social hoy en día. Las tierras raras también son unos materiales básicos para el desarrollo de la industria armamentística. Satélites más eficientes, mejores sistemas de comunicación, nuevos dispositivos de posicionamiento y vigilancia nocturna, vehículos militares autopropulsados y con dispositivos de blindaje mejorados, armamento con mayor capacidad destructiva, capaces de recorrer distancias más largas y con más autonomía, y un largo etcétera. Quizás este uso de las tierras raras explica más cosas de las que suceden en el mundo actual que la búsqueda de un futuro más sostenible.

Películas post-apocalípticas, como Mad Max, nos enseñaron que las guerras del futuro se producirían por el agua y el combustible. Parece que se olvidaron de un tercer origen: la búsqueda de minerales críticos. Yo prefiero pensar que esas cosas no van a suceder y que, lo único que tenemos seguro hoy en día, es que la Geología nos permitirá buscar y explotar de manera segura y sostenible los recursos naturales que necesita la humanidad para seguir evolucionando, socialmente hablando. Espero no equivocarme.

Sobre la autora: Blanca María Martínez es doctora en geología, investigadora de la Sociedad de Ciencias Aranzadi y colaboradora externa del departamento de Geología de la Facultad de Ciencia y Tecnología de la UPV/EHU

*Nota del editor: La IUPAC, prescriptivista ella, «recomienda» (como lo haría don Vito) el nombre «lantanoides». Pero esto se debe a la necesidad de mantener la coherencia en inglés, donde la terminación -ide de «lanthanide» (lantánido) se reserva para determinados compuestos que, en castellano, acaban en -uro (carburo o hidruro, por ejemplo, son carbide o hidride en inglés). Podemos, por tanto, emplear en castellano el nombre que creó Victor Goldschmidt en 1925 para denominar este conjunto de elementos sin incurrir en anatema.

El artículo (Ni son) tierras (ni son) raras se ha escrito en Cuaderno de Cultura Científica.

Liudmila Vsévolovna Kéldysh, de la teoría de conjuntos a la topología geométrica

Con una habilidad pedagógica poco común, [Liudmila Kéldysh] sabe cómo conducir a un estudiante desde la solución de los problemas más simples hasta el trabajo independiente.

P. S. Aleksandrov, A. B. Sosinskii, A. V. Chernavskii, M. A. Shtan’ko (1974).

Liudmila Vsévolovna Kéldysh. Fuente: Russian Mathematical Surveys.

Liudmila Vsévolovna Kéldysh. Fuente: Russian Mathematical Surveys.Liudmila Vsévolovna Kéldysh nació en Oremburgo (Rusia) el 12 de marzo de 1904. Era la hija mayor (de siete) de Maria Aleksándrovna Skvórtsova y Vsévolod Mijáilovich Kéldysh, un ingeniero militar. Debido a la naturaleza del trabajo de su padre, la familia viajaba con frecuencia; Liudmila vivió en Helsinki (1905-1907), San Petersburgo (hasta 1909) y después en Riga (Letonia) hasta que la invasión alemana obligó a la familia a huir a Moscú.

Tras terminar sus estudios secundarios, continuó su educación en la Universidad Estatal de Moscú, graduándose en 1925. En 1923, mientras estudiaba, se unió al grupo de investigación de Nikoláai Luzin, el grupo Luzitania. Allí conoció a Piotr Serguéyevich Nóvikov, con quien se casó en 1934.

Trabajando en teoría de conjuntosEn 1930 Keldysh comenzó a enseñar en el Instituto de Aviación de Moscú. Un año más tarde tuvo a su primer hijo, Leonid Kéldysh, nacido de un matrimonio anterior al comentado anteriormente.

A partir de 1934 comenzó a enseñar en el Instituto de la Academia de Ciencias de la URSS especializándose en teoría de conjuntos. En los años posteriores nacieron sus hijos Andréi Petróvich Nóvikov y Serguéi Petróvich Nóvikov; este último se convirtió en el primer matemático soviético en recibir la Medalla Fields, fue en 1970.

Liudmila defendió su tesis, supervisada por Luzin, en 1941. Trataba sobre conjuntos de Borel. Antes de recibir su título de doctora en Ciencias Físicas y Matemáticas, la familia huyó del avance de las tropas alemanas, instalándose en Kazán, en los institutos evacuados de la Academia de Ciencias. Keldysh y sus hijos no tenían el estatus de evacuados, solo el de refugiados. Finalmente fueron alojados en el gran gimnasio de la Universidad de Kazán, junto con varios cientos de refugiados como ellos. Su marido llegó posteriormente, enfermo. Resistieron pasando numerosas necesidades e incertidumbre.

A finales de 1942 pudieron regresar a Moscú y la situación comenzó a mejorar. En esa época, el matrimonio tuvo dos hijas, Nina y Elena.

Trabajando en topología geométricaA partir de 1945, su trabajo se centró más en la topología geométrica. Publicó numerosos trabajos de investigación hasta la década de 1960. Por todo su trabajo, entre otros, recibió en 1958 el Premio del Presidium del Soviet Supremo.

A finales de los años 1950, Keldysh organizó un seminario sobre topología geométrica en el Instituto Steklov de Matemáticas, centrándose en particular en embebimientos topológicos. Este seminario resultó importante para el desarrollo de las matemáticas en Rusia y estuvo activo hasta 1974. Uno de sus estudiantes más brillantes, Alekséi Chernavskii, comenzó a participar en el seminario en 1970, y comentaba sobre la manera en la que trabajaban:

Comenzamos a organizar nuestros talleres sistemáticamente en varios puntos del campo de Moscú, combinando topología, fútbol o esquí según la estación, anécdotas, conversaciones serias sobre la vida, etc.

En 1964, Liudmila fue nombrada profesora titular en la Universidad Estatal de Moscú, publicando en 1966 el libro Embebimientos topológicos en el espacio euclidiano (en ruso) para ayudar a sus estudiantes de investigación. Se dedicó a la docencia hasta 1974, año en el que renunció a su trabajo en protesta por la expulsión de uno de sus estudiantes.

Liudmila falleció el 16 de febrero de 1976, un año después de su marido. En agosto de 2004, en el centenario de su nacimiento, se celebró en Moscú el congreso en su honor «Topología geométrica, geometría discreta y teoría de conjuntos«.

BonusEn una entrevista realizada al matemático Serguéi Nóvikov (1938-2024) en 2001, comentaba que su familia jugó un papel muy importante en su decisión de dedicarse a la ciencia; en particular hablaba de su madre:

Mi padre, Piotr Serguéyevich Nóvikov, fue un matemático famoso. Todos los matemáticos conocen su trabajo sobre la teoría de algoritmos y la teoría combinatoria de grupos, incluida la indecidibilidad del problema de la palabra y la solución del problema de Burnside para grupos de torsión. En la década de 1930 fue uno de los mejores expertos en la llamada teoría descriptiva de conjuntos y en la década de 1940 en lógica matemática. También inició en la década de 1930 una nueva rama de la física matemática: la reconstrucción de un dominio homogéneo acotado a partir de su potencial gravitatorio en el infinito. Mi madre, Liudmila Vsévolovna Kéldysh, también fue una matemática destacada: profesora titular y experta en teoría de conjuntos y topología geométrica. La familia tuvo cinco hijos, y yo era el tercero de ellos, el más joven de los tres hijos. Todos los hijos se hicieron físicos y matemáticos, mientras que las hijas eligieron otras profesiones. Mi hermano mayor, Leonid Kéldysh, es uno de los teóricos de la física del estado sólido y de la física de la materia condensada más conocidos a nivel internacional. Mi otro hermano, Andréi Nóvikov, era un experto en teoría algebraica de números, pero lamentablemente murió prematuramente. Además, el hermano de mi madre, Mstislav Kéldysh, era un matemático muy talentoso en la teoría de funciones de variable compleja y en ecuaciones diferenciales. Hizo una contribución especialmente fundamental a las ramas aplicadas de la aerodinámica. […]

Referencias

- J J O’Connor and E F Robertson, Ljudmila Vsevolodovna Keldysh, MacTutor History of Mathematics Archive, University of St. Andrews

- P. S. Aleksandrov, A. B. Sosinskii, A. V. Chernavskii, M. A. Shtan’ko, Lyudmila Vsevolodovna Keldysh (on the occasion of her seventieth birthday), Russian Mathematical Surveys 29 (4) (1974) 155-161

- S. I. Adian, A. A. Mal’tsev, E. V. Sandrakova, A. B. Sosinskii, A. V. Chernavskii, M. A. Shtan’ko, Lyudmila Vsevolodovna Keldysh (on the centenary of her birth), Russian Mathematical Surveys 60 (4) (2005) 581-588

- Ludmila Keldysh, Wikipedia

- Victor M. Buchstaber, Interview with Sergey P. Novikov, EMS Newsletter 42 (2001) 17-20

El artículo Liudmila Vsévolovna Kéldysh, de la teoría de conjuntos a la topología geométrica se ha escrito en Cuaderno de Cultura Científica.

¿Por qué los investigadores se interesan por los modelos de lenguaje reducido?

Los modelos más grandes pueden lidiar con una mayor variedad de tareas, pero el tamaño reducido de los modelos más pequeños los convierte en herramientas atractivas.

Un artículo de Stephen Ornes. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

Los modelos de lenguaje extenso funcionan bien porque son muy grandes. Los modelos más recientes de OpenAI, Meta y DeepSeek utilizan cientos de miles de millones de “parámetros”: los botones ajustables que determinan las conexiones entre los datos y que se modifican durante el proceso de entrenamiento. Con más parámetros, los modelos pueden identificar mejor los patrones y las conexiones, lo que a su vez los hace más potentes y precisos.

Pero esta potencia tiene un coste. Entrenar un modelo con cientos de miles de millones de parámetros requiere enormes recursos computacionales. Para entrenar su modelo Gemini 1.0 Ultra, por ejemplo, Google habría gastado 191 millones de dólares. Los modelos de lenguaje extenso (LLM, por sus siglas en inglés) también requieren una potencia computacional considerable cada vez que responden a una solicitud, lo que los convierte en notorios devoradores de energía. Una sola consulta a ChatGPT consume aproximadamente diez veces más energía que una sola búsqueda en Google, según el Electric Power Research Institute.

En respuesta, algunos investigadores están pensando ahora en pequeño. IBM, Google, Microsoft y OpenAI han lanzado recientemente modelos de lenguaje reducido (SLM, por sus siglas en inglés) que utilizan unos pocos miles de millones de parámetros, una fracción de sus contrapartes LLM.

Los modelos reducidos no se utilizan como herramientas de uso general como sus primos más grandes, pero pueden ser excelentes para tareas específicas, más definidas, como resumir conversaciones, responder preguntas de pacientes como un chatbot de atención médica y recopilar datos en dispositivos inteligentes. “Para muchas tareas, un modelo de 8 mil millones de parámetros es, de hecho, bastante bueno”, afirma Zico Kolter, un científico informático de la Universidad Carnegie Mellon. También pueden ejecutarse en un ordenador portátil o un teléfono móvil, en lugar de en un gran centro de datos. (No hay consenso sobre la definición exacta de “reducido”, pero todos los nuevos modelos alcanzan un máximo de alrededor de 10 mil millones de parámetros).

Para optimizar el proceso de entrenamiento de estos modelos reducidos, los investigadores utilizan algunos trucos. Los modelos extensos suelen extraer datos de entrenamiento sin procesar de Internet, y estos datos pueden estar desorganizados, desordenados y ser difíciles de procesar. Pero estos modelos grandes pueden generar un conjunto de datos de alta calidad que se puede utilizar para entrenar un modelo reducido. El enfoque, llamado destilación de conocimiento, hace que el modelo más grande transmita eficazmente su entrenamiento, como un maestro que da lecciones a un estudiante. “La razón por la que [los SLM] son tan buenos con modelos tan reducidos y tan pocos datos es que utilizan datos de alta calidad en lugar de material desordenado”, explica Kolter.

Los investigadores también han explorado formas de crear modelos reducidos comenzando con modelos extensos y recortándolos. Un método, conocido como poda, implica eliminar partes innecesarias o ineficientes de una red neuronal, la extensa red de puntos de datos conectados que subyace a un modelo extenso.

La poda se inspiró en una red neuronal de la vida real, el cerebro humano, que gana eficiencia al cortar las conexiones entre las sinapsis a medida que una persona envejece. Los enfoques de poda actuales se remontan a un artículo de 1989 en el que el científico informático Yann LeCun, ahora en Meta, argumentaba que hasta el 90% de los parámetros de una red neuronal entrenada podrían eliminarse sin sacrificar la eficiencia. Llamó al método «daño cerebral óptimo». La poda puede ayudar a los investigadores a ajustar un modelo de lenguaje reducido para una tarea o entorno en concreto.

Para los investigadores interesados en cómo los modelos de lenguaje hacen lo que hacen, los modelos más reducidos ofrecen una forma económica de probar ideas novedosas. Y como tienen menos parámetros que los modelos extensos, su razonamiento puede ser más transparente. “Si quieres crear un modelo nuevo, necesitas probar cosas”, apunta Leshem Choshen, científico investigador del Laboratorio de Inteligencia Artificial Watson del MIT-IBM. “Los modelos reducidos permiten a los investigadores experimentar con riesgos menores”.

Los modelos grandes y costosos, con sus parámetros cada vez más numerosos, seguirán siendo útiles para aplicaciones como chatbots generalizados, generadores de imágenes y el descubrimiento de fármacos. Pero para muchos usuarios, un modelo reducido y específico funcionará igual de bien, y además será más fácil para los investigadores entrenarlo y construirlo. “Estos modelos eficientes pueden ahorrar dinero, tiempo y computación”, afirma Choshen.

El artículo original, Why Do Researchers Care About Small Language Models?, se publicó el 12 de febrero de 2025 en Quanta Magazine.

Traducido por César Tomé López

El artículo ¿Por qué los investigadores se interesan por los modelos de lenguaje reducido? se ha escrito en Cuaderno de Cultura Científica.

El gen NOVA1 y el origen de nuestro lenguaje hablado

El lenguaje hablado desempeñó un papel esencial en la evolución de la especie humana. Un lenguaje simbólico complejo nos permitió comunicarnos oralmente, coordinar actividades, transmitir conocimientos, mitos y valores. En definitiva, hizo posible una cultura que nos dio ventaja sobre otras especies animales.

El origen del lenguaje hablado implicó complicadas adaptaciones anatómicas relacionadas con la fonación, y el desarrollo de nuevas conexiones cerebrales. Hasta ahora sabemos muy poco de los cambios genéticos que estuvieron detrás de estas innovaciones evolutivas. Una investigación realizada por un equipo de la Universidad Rockefeller y publicada en Nature Communications acaba de proporcionar una interesante pista acerca de estos cambios genéticos.

NOVA1 (neuro-oncological ventral antigen-1) es un gen que se expresa en el sistema nervioso central de los vertebrados. Era conocido por su papel en un síndrome paraneoplásico neurológico. Si células tumorales expresan de forma aberrante NOVA1, se generan anticuerpos que pueden atacar a las neuronas, con graves consecuencias para el sistema nervioso.

La inactivación de NOVA1 en ratones es letal, por fallos en el desarrollo neuromotor. Se empezó a sospechar su relación con el lenguaje humano a partir del estudio de un paciente que tenía mutada e inactivada una de las dos copias del gen. Este paciente tenía graves deficiencias en el aprendizaje y particularmente en el desarrollo del lenguaje.

El estudio de la secuencia de la proteína NOVA1 humana mostró algo sorprendente. Se trata de una secuencia muy bien conservada, prácticamente sin diferencias entre humanos. Eso sí, nuestra proteína difiere en un solo aminoácido de la de neandertales y denisovanos, nuestros parientes más próximos. En la posición 197 de la secuencia una isoleucina fue sustituida por una valina en el linaje de Homo sapiens. Esta variante es conocida como I197V.

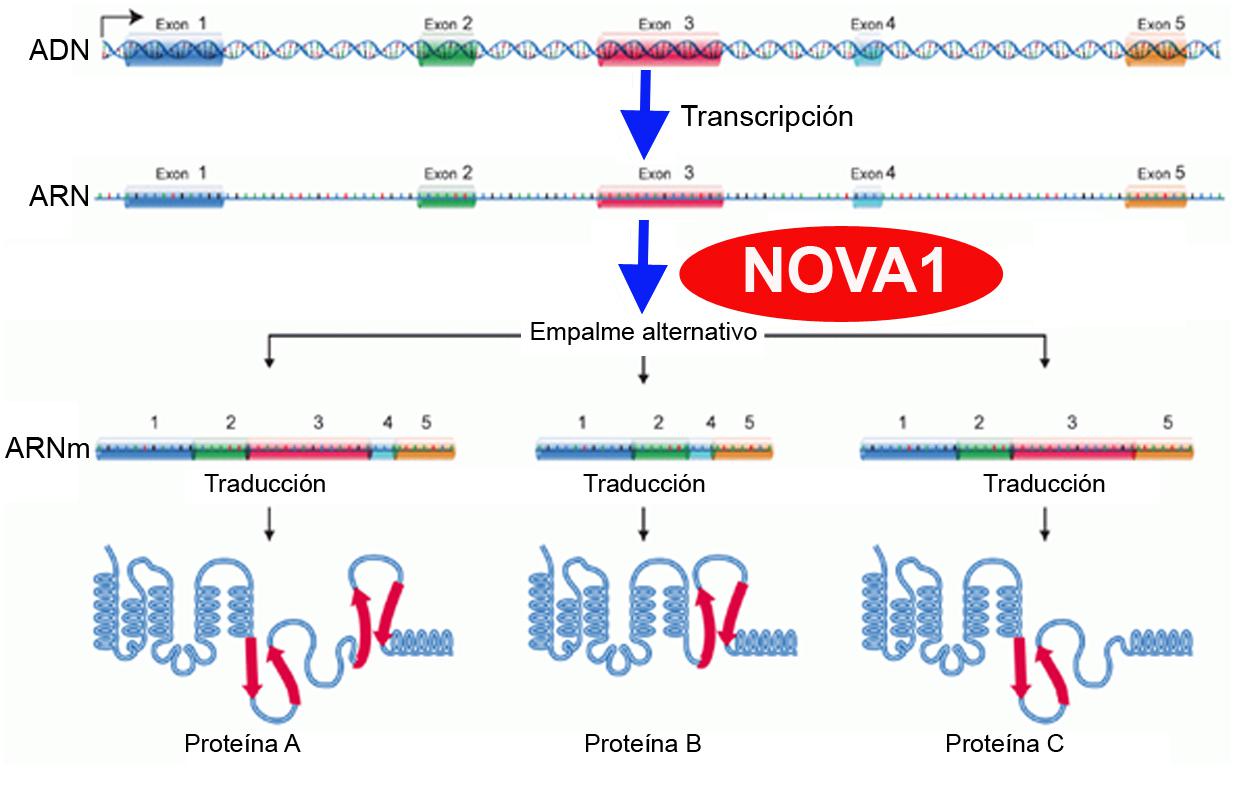

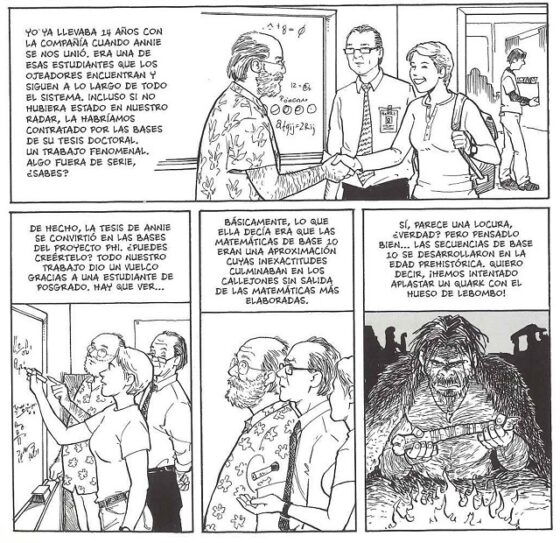

Antes de analizar qué significa esta sustitución vamos a ver cuál es la función de NOVA1. Se trata de una proteína que se une al ARN y regula el empalme alternativo (alternative splicing) controlando la formación de diferentes ARN mensajeros a partir de un mismo gen (explicado en la figura 1). De esta forma, NOVA1 puede modular la expresión de un gran número de proteínas en el sistema nervioso.

Figura 1. Los exones son los segmentos del ADN que codifican secuencias de aminoácidos. El ADN de un gen determinado se transcribe a una primera cadena de ARN que contiene la secuencia de todos los exones. Mediante el proceso de empalme alternativo se generan ARN mensajeros con diferentes combinaciones de exones. De esta forma, diferentes proteínas pueden derivar de un mismo gen. NOVA1 interviene en este proceso de empalme alternativo modulando la expresión de genes expresados en el sistema nervioso, incluyendo algunos implicados en la vocalización. Modificado de National Human Genome Research Institute, dominio público

Figura 1. Los exones son los segmentos del ADN que codifican secuencias de aminoácidos. El ADN de un gen determinado se transcribe a una primera cadena de ARN que contiene la secuencia de todos los exones. Mediante el proceso de empalme alternativo se generan ARN mensajeros con diferentes combinaciones de exones. De esta forma, diferentes proteínas pueden derivar de un mismo gen. NOVA1 interviene en este proceso de empalme alternativo modulando la expresión de genes expresados en el sistema nervioso, incluyendo algunos implicados en la vocalización. Modificado de National Human Genome Research Institute, dominio públicoCuando el grupo de la Rockefeller identificó los ARN afectados por la función de NOVA1 se observó una elevada proporción de genes relacionados con la vocalización. Además, NOVA1 mostraba una elevada expresión en el cerebro medio y particularmente en la sustancia gris periacueductal, vinculada a comportamientos de miedo y reacciones defensivas en mamíferos. Las neuronas de esta área conectan con el tronco cerebral y el núcleo ambiguo, desde donde se controlan las vías motoras respiratorias y, en particular, la musculatura de boca, faringe y laringe. De esta forma se coordina la respiración con la producción de sonidos, que solo se produce durante la espiración.

¿Influyó la variante humana I197V en el desarrollo de nuestra fonación? Para responder a esta pregunta, el equipo generó ratones modificados genéticamente para expresar la proteína NOVA1 humana, con la variante I197V. Por supuesto, los ratones no comenzaron a charlar entre ellos, pero mostraron sorprendentes diferencias en su vocalización.

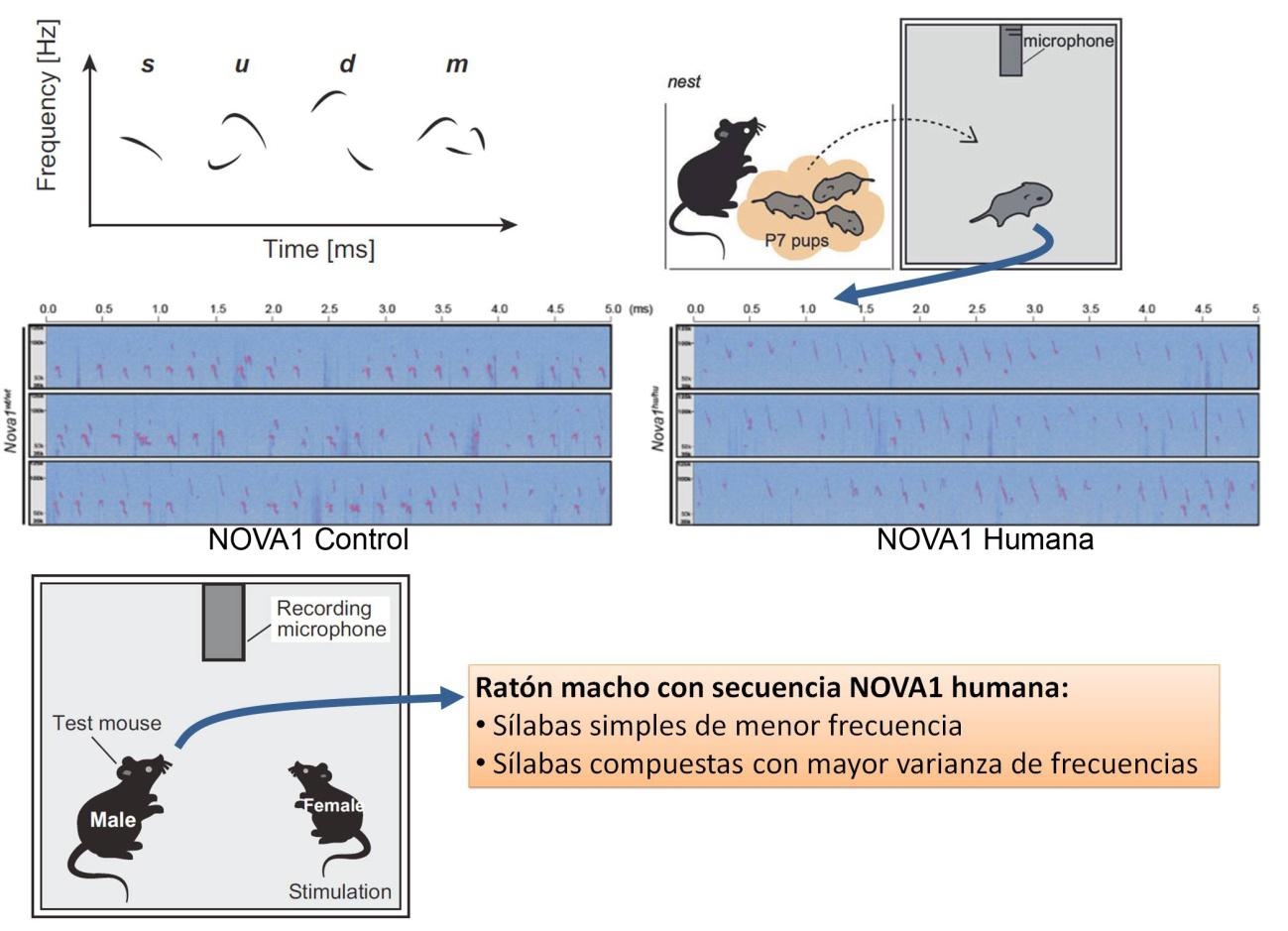

Los ratones recién nacidos, cuando son separados de sus madres, emiten ultrasonidos para llamarlas. Estos chillidos constan de cuatro tipos de “sílabas”: simples (una sola nota), ascendentes y descendentes (dos notas separadas por un salto de frecuencia hacia arriba o abajo) y múltiples (varias notas de diferente frecuencia) (Figura 2). Los ratones humanizados (I197V) utilizaron más las sílabas simples en sus llamadas. Esto no varió la respuesta de sus madres, que los buscaban igual que a los ratoncillos no humanizados.

Figura 2. Arriba a la izquierda vemos los diferentes tipos de ultrasonidos emitidos por los ratones. Las sílabas pueden ser simples (s) con dos notas separadas por un intervalo ascendente (u) o descendente (d) o con múltiples notas (m). Cuando un neonato es separado de su madre emite chillidos para llamarla. Los ratoncillos con secuencia NOVA1 humana emiten muchas más sílabas simples, en lugar de las ascendentes de los ratones control. Cuando un ratón macho con secuencia NOVA1 humana es colocado en presencia de una hembra receptiva, emite sílabas simples de menor frecuencia y sílabas compuestas con frecuencias más variadas. Modificado de Tajima et al., referencia completa en bibliografía. Licencia CC-BY 4.0

Figura 2. Arriba a la izquierda vemos los diferentes tipos de ultrasonidos emitidos por los ratones. Las sílabas pueden ser simples (s) con dos notas separadas por un intervalo ascendente (u) o descendente (d) o con múltiples notas (m). Cuando un neonato es separado de su madre emite chillidos para llamarla. Los ratoncillos con secuencia NOVA1 humana emiten muchas más sílabas simples, en lugar de las ascendentes de los ratones control. Cuando un ratón macho con secuencia NOVA1 humana es colocado en presencia de una hembra receptiva, emite sílabas simples de menor frecuencia y sílabas compuestas con frecuencias más variadas. Modificado de Tajima et al., referencia completa en bibliografía. Licencia CC-BY 4.0Más diferencias se encontraron en ratones machos adultos en presencia de hembras sexualmente receptivas. Las sílabas simples de los ratones humanizados se emitieron en frecuencias más bajas, y en las demás sílabas aumentó la varianza de sus frecuencias. Dicho de otra forma, su vocalización se volvió más compleja y rica en tonos. Lo que sería importante comprobar, como reconocen los propios autores del artículo, es si esta vocalización aumentó su atractivo para las hembras.

Estos resultados son similares a los que se obtuvieron hace algunos años con el gen FOXP2, el conocido como “gen del lenguaje”, ya que sus mutaciones alteran el lenguaje hablado en humanos. La proteína FOXP2 humana tiene dos aminoácidos diferentes respecto a la del ratón. Los ratones transgénicos dotados de la secuencia FOXP2 humana muestran ciertos cambios en la vocalización de sílabas complejas, pero las simples se hacen más frecuentes, disminuyendo la complejidad global de sus “conversaciones”. Por otra parte, la secuencia FOXP2 humana no es exclusiva de nuestra especie, ya que es idéntica a la de neandertales y denisovanos.

Falta mucho por hacer, por ejemplo, comprobar si la actuación de NOVA1 sobre la fonación se produce a nivel del control motor de la respiración y la musculatura laríngea, o si lo hace a nivel de la corteza cerebral, donde se expresa a menores niveles. Nuestra corteza cerebral regula el tono, la amplitud y la modulación de la frecuencia del lenguaje hablado. De todas formas, NOVA1, junto a lo que ya sabíamos de FOXP2, sin duda contribuirá al conocimiento de los mecanismos moleculares que dirigieron la evolución de nuestro lenguaje hablado.

Referencias

Tajima, Y., Vargas, C.D.M., Ito, K. et al. (2025). A humanized NOVA1 splicing factor alters mouse vocal communications. Nat Commun. doi: 10.1038/s41467-025-56579-2

Sobre el autor: Ramón Muñoz-Chápuli Oriol es Catedrático de Biología Animal (jubilado) de la Universidad de Málaga

El artículo El gen NOVA1 y el origen de nuestro lenguaje hablado se ha escrito en Cuaderno de Cultura Científica.

Cine y Ciencia: High Life

Portada del DVD. Fair use

Portada del DVD. Fair useDentro la octava edición del ciclo Cine y Ciencia, coorganizado por Filmoteka y el DIPC junto a otros agentes culturales, durante enero y febrero he presentado High Life, una fascinante película de Claire Denis (2018). La veo como una respuesta contemporánea a 2001: A Space Odyssey de Stanley Kubrick, usando una perspectiva de género que subvierte los cánones tradicionales del cine de exploración espacial. Mientras Kubrick idealizó la figura del bebé como símbolo de un futuro utópico y abstracto, Denis nos presenta un bebé real, corporal y vulnerable, que exige cuidado y genera nuevas formas de parentesco en un futuro distópico, sucio y extractivista.