Asteon zientzia begi-bistan #264

Eusko Jaurlaritzak ohartarazi duenez, Araban, Bizkaian eta Gipuzkoan %44 areagotu dira sexu transmisiozko infekzio kasuak eta %25 GIBarenak. Iaz, GIBaren 169 infekzio kasu detektatu zituzten; 2017an baino 34 kasu gehiago, eta 2016an baino 11 gehiago. Gorakada hori ikusita, kontzientziazio kanpaina bat abiaraziko du Osasun Sailak. Informazio guztia Berrian.

Txinako bi lekutan tigre eltxoa ia desagerraraztea lortu dute, bakterio bat eta emeak antzutzeko teknika bat erabilita. Tigre eltxoak arriskutsuak izan daitezke hainbat birus transmiti ditzaketelako: Dengea, Chikungunya eta Zika, besteak beste. Birus horiek eragiten dituzten gaixotasunek ez dutenez txertorik, eltxoen populazioak kontrolatzea da gelditzen den aukera, Elhuyar aldizkarian azaltzen dutenez.

BiologiaKoldo Garciaren eskutik bakailaoa gertutik ezagutzeko aukera izan dugu honetan. Ternua izan da arrantzarako gune nagusiena eta Kanadak bakailaoaren arrantza debekatu bazuen ere, ez da berreskuratu bakailaoaren kopurua Ternua aldean. Horren harira, orain dela gutxi ikertzaile talde batek bakailaoaren gene-egitura aztertu du bakailaoaren kudeaketa hobetzeko eta bakailaoaren berreskurapenean laguntzeko. Ikertzaileek ondorioztatu dute Ternua aldean gertatu den bakailaoaren gehiegizko arrantzak bakailaoaren gene-egituran eragina izan duela.

FisikaZientzialariak hegazkinek sortzen dituzten kondentsazio-lorratzak kezkatuta daude. Ondorioztatu dutenez, lorratza horiek dira planeta bereziki berotzen dutenak, hegazkinetako erregai bera baino. Kalkulatu dute, gainera, hodei artifizialen inpaktua hiru aldiz handiagoa izango dela 2050ean. Horretaz gain, kliman ere eragina dutela uste dute, baina klima-sistema oso konplexua denez, zaila da neurtzea norainoko inpaktua sortzen duten. Informazio gehiago Juanma Gallegoren eskutik.

MatematikaMatematikak behin baino gehiagotan izan dira protagonistak Oscar sarietan. Aleka McAdamsek, adibidez, efektu bereziei buruz idatzi zuen bere tesia eta horren ondotik, Walt Disney estudioetan eman zioten lana. McAdams eta bere tesi-zuzendaria daude Frozen eta Moana bezalako filmen arrakastaren atzean. Animaziozko film onenaren Oscar saria lortu zuen Frozen filmak 2014an. Izotza eta elurra ziren protagonista eta haien diseinu egokia lortzea, ahalik eta irudi errealena ematea, nahi izan zuten zuzendari artistikoek. Eredu matematiko berri bat proposatu zuen elurraren mugimenduen simulaziorako eta hori erabili zuten filmean. Honi buruz gehiago jakiteko, irakur ezazue osorik artikulu interesgarri hau!

Emakumeak zientzianMarie Curiek bi aldiz irabazi zuen Nobel saria: lehenengoa, Fisikako Nobel saria izan zen (1903), bere senar Pierre Curie eta Henri Becquerelekin batera erradiazioaren fenomenoa ikertzeagatik, eta, zortzi urte geroago, berak bakarrik, Kimikako Nobel saria lortu zuen, radioa eta polonioa aurkitzeagatik. 1893an Fisikako ikasketak bukatu zituen eta urtebete geroago, Matematika Zientzietan lizentziatu zen. Lehen Mundu Gerran parte hartu zuen ere. Erabilpen militarrerako lehen zentro erradiologiko mugikorrak sortu zituen berak; Petite Curie gisa ezagunak. Datu gehiago artikuluan.

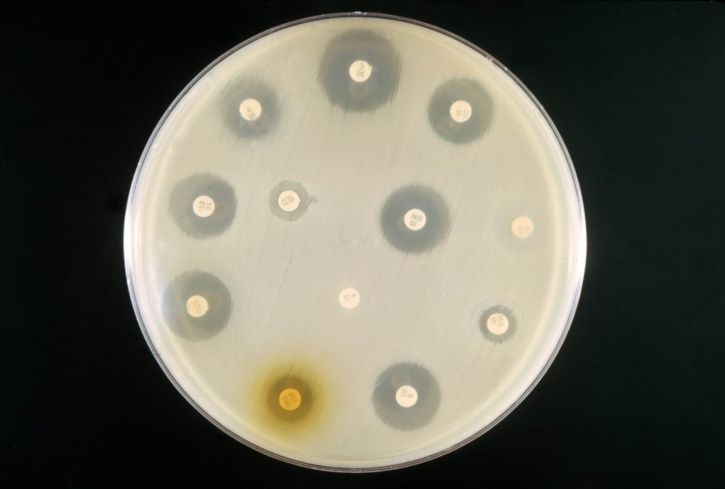

BiokimikaAntibiotikoekiko erresistentziaz mintzatu da Itziar Alkorta UPV/EHUren ikastaroetan, Berrian irakur daitekeenez. Bertan, ohartarazi du botika horien erabilera demasak handitu egin duela egoera “apokaliptiko” baten arriskua. “Antibiotikoak medikuntzan sartu ahala, demasa izan dela horien erabilera. Eta, testuinguru horretan, bakterioek erresistentzia metodo berriak garatu dituzte, edota metodo horiek partekatu egin dituzte beren artean”, azaldu du elkarrizketa honetan. Egoera kezkatzekoa dela azpimarratu du: “Bakterioek jarraitzen badute multierresistentziak garatzen, antibiotikorik gabe gera gaitezke”.

———————————————————————–

Egileaz: Uxue Razkin kazetaria da.

——————————————————————

The post Asteon zientzia begi-bistan #264 appeared first on Zientzia Kaiera.

Pizza y terraplanistas

Es razonable pensar que la Tierra tiene forma de pizza. Y puede ser muy complicado convencer a una persona que crea que esto es así de lo contrario. Salvo que intervengan las matemáticas y la definición de curvatura. Alberto Márquez, de la Universidad de Sevilla, lo explica.

Quizás sea el número más famoso de la historia. Lo cierto es que el número Pi, representado por la letra griega π, es una de las constantes matemáticas más importantes que existen en el mundo, estudiada por el ser humano desde hace más de 4.000 años. La fascinación que ha suscitado durante siglos es tal que el popular número cuenta con su propio día en el calendario, así el mes de marzo se celebra el Día de Pi en todo el planeta.

Este evento internacional vino de la mano del físico estadounidense Larry Shaw, quien lanzó en 1988 la propuesta de celebrar esta efeméride. La forma en la que se escribe el 14 de marzo en inglés y euskera coincide con los tres primeros dígitos de la famosa constante matemática. (3-14 martxoaren 14 en euskara / 3-14 march, 14th en inglés) y además, la celebración coincide con la fecha del nacimiento de Albert Einstein. En 2009, el congreso de EEUU declaró oficialmente el 14 de marzo como el Día Nacional de Pi.

Actualmente, el Día de Pi es una celebración mundialmente conocida que sobrepasa el ámbito de las matemáticas. Este número irracional, que determina la relación entre la longitud de una circunferencia y su diámetro, concierne a múltiples disciplinas científicas como la física, la ingeniería y la geología, y tiene aplicaciones prácticas sorprendentes en nuestro día a día.

Este 2019 nos unimos de nuevo al festejo con el evento BCAM–NAUKAS, que se desarrolló a lo largo del 13 de marzo en el Bizkaia Aretoa de UPV/EHU. BCAM-NAUKAS contó durante la mañana con talleres matemáticos para estudiantes de primaria y secundaria y durante la tarde con una serie de conferencias cortas dirigidas al público en general.

Este evento es una iniciativa del Basque Center for Applied Mathematics -BCAM, enmarcada en la celebración de su décimo aniversario, y de la Cátedra de Cultura Científica de la Universidad el País Vasco.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Pizza y terraplanistas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Sigue al conejo blanco

- Matemáticas modernas

- Diagnóstico de enfermedades: una cuestión de probabilidades

Ezjakintasunaren kartografia #271

Onddo batek txitxarren portaera sexualari zelan eragiten dion izugarria da. JR Alonsok azaltzen du Sex, drugs and rock & roll, cicada style

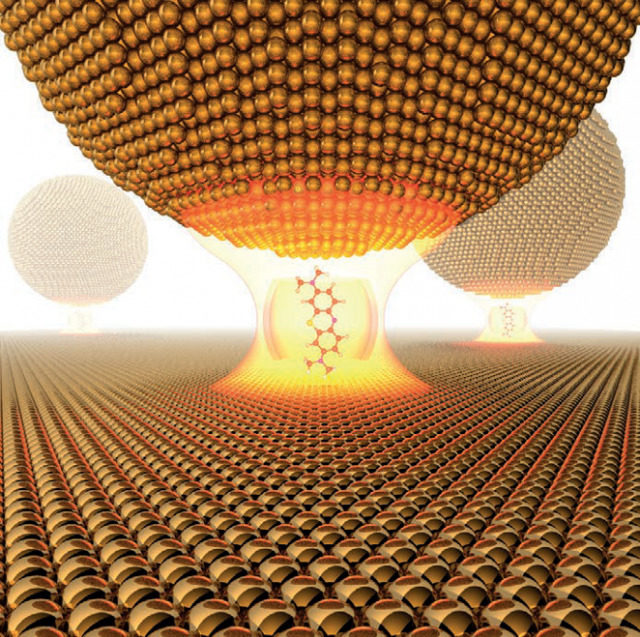

Espazio txikietan, nanometro kubiko bateko espazioetan, argiarekin gertatzen dena oso interesgarria da. Hainbeste, ezen kontsumo baxuko dispositibo nanometrikoak eta aukera handiak martxan dauden. Javier Aizpurua (CFM &DIPC), nanofotonika aditua, berrikuspena egin du taldekideekin batera. The extreme nanophotonics of the plasmonic nanopatch

–—–

Mapping Ignorance bloga lanean diharduten ikertzaileek eta hainbat arlotako profesionalek lantzen dute. Zientziaren edozein arlotako ikerketen azken emaitzen berri ematen duen gunea da. UPV/EHUko Kultura Zientifikoko Katedraren eta Nazioarteko Bikaintasun Campusaren ekimena da eta bertan parte hartu nahi izanez gero, idatzi iezaguzu.

The post Ezjakintasunaren kartografia #271 appeared first on Zientzia Kaiera.

Barbacoas, ciencia y salud

La Facultad de Ciencias de Bilbao comenzó su andadura en el curso 1968/69. 50 años después la Facultad de Ciencia y Tecnología de la UPV/EHU celebra dicho acontecimiento dando a conocer el impacto que la Facultad ha tenido en nuestra sociedad. Publicamos en el Cuaderno de Cultura Científica y en Zientzia Kaiera una serie de artículos que narran algunas de las contribuciones más significativas realizadas a lo largo de estas cinco décadas.

Foto: Victoria Shes / Unsplash

Foto: Victoria Shes / UnsplashQue Bilbao fuera galardonada como la mejor ciudad gastronómica del mundo no sorprendería a muchos, máxime cuando ha sido elegida como la mejor ciudad europea en 2018. Y como las ciudades las hacemos los ciudadanos pues nos congratulamos por la parte que nos toca. Ciertamente es Bilbao cuna de la ‘fine cuisine’ vasca, europea y mundial, con grandes maestros de los fogones y una elevada concentración de restaurantes en la Guía Michelín.

Sin embargo, no todo en la cocina debería orientarse a la obtención de nuevos y sofisticados sabores para alegrarnos el paladar. Alimentos muy dorados, flambeados o incluso parcialmente quemados realzan su sabor y por ello se utilizan con frecuencia en las recetas más sofisticadas de los mejores restaurantes. Pero esta ganancia en sabor tiene su precio. Una gran parte de las propiedades nutritivas de los alimentos tratados de esta manera se pierden, al mismo tiempo que se generan moléculas no deseadas, a menudo tóxicas para el organismo.

Los alimentos muy cocinados (a temperaturas de 120 º C o superiores), sobre todo los que requieren contacto directo con la llama, a la brasa o cocinados sobre planchas metálicas cambian sus características químicas (organolépticas) convirtiéndose en serias amenazas para la salud. Vamos con algunos ejemplos…

Cada vez son más típicas las barbacoas entre amigos, o los asados de carne, o pescados a la plancha en nuestras mesas. Y uno podría pensar que si esto fuera acompañado de un buen arroz socarrado, formado por los granos de arroz caramelizados en el fondo de la paella, sería el acompañamiento perfecto de una comida ideal. Exquisito sabor sin duda alguna, pero con toda seguridad estaríamos introduciendo una cantidad muy elevada de moléculas perjudiciales para la salud.

Concretamente, el almidón del arroz y el de todos los alimentos ricos en este tipo de polisacárido vegetal (fécula de pata, pan simple…), está formado por unidades de glucosa enlazadas y son muy susceptibles de formar acrilamida cuando se calientan a temperaturas relativamente elevadas (120 °C o superiores). Lo mismo ocurriría con el polisacárido de reserva animal, el glucógeno, el cual también está formado por unidades de glucosa. Muchos estudios realizados con animales de laboratorio han demostrado que la acrilamida es altamente cancerígena. La acrilamida se forma al reaccionar las unidades de glucosa de los polisacáridos con el aminoácido asparragina, el cual está presente en las proteínas tanto vegetales como animales.

Sin duda alguna la manera de cocinar los alimentos tiene un impacto muy importante sobre los niveles de acrilamida que pueden generarse. Los alimentos poco cocinados (poco dorados) o sometidos a temperaturas más bajas que las indicadas anteriormente tendrán mucha menor concentración de acrilamida que los alimentos muy cocinados o sometidos a temperaturas elevadas. Dado que la acrilamida es altamente carcinogénica, los científicos no se atreven a establecer un nivel ‘tolerable’ de esta sustancia en nuestra dieta. Por otra parte, hay que tener en cuenta que los niños son más vulnerables a los efectos de la acrilamida debido a su menor peso corporal.

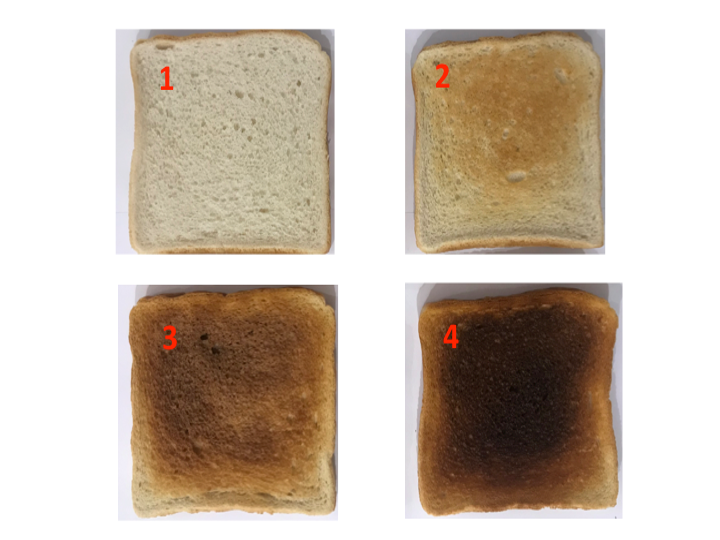

No obstante, a día de hoy, todos los estudios realizados sobre la toxicidad de la acrilamida se han llevado a cabo utilizando animales de laboratorio y no existen estudios epidemiológicos exhaustivos en humanos. A título simplemente orientativo la Figura 1 muestra cuatro niveles de tostado que van desde un nivel recomendable al no recomendable para el consumo. Nivel 1: recomendable; nivel 2: aceptable; nivel 3: poco recomendable; nivel 4: no recomendable.

Figura 1. Cuando cocines alimentos piensa siempre en blanco o en dorado, nunca en negro o marrón. Así se reducirá la formación de sustancias tóxicas para la salud.

Figura 1. Cuando cocines alimentos piensa siempre en blanco o en dorado, nunca en negro o marrón. Así se reducirá la formación de sustancias tóxicas para la salud.Al igual que los alimentos ricos en hidratos de carbono, las carnes, los pescados y las verduras cocinadas a elevadas temperaturas también dan lugar a la formación de sustancias tóxicas para el organismo. Concretamente, la carne demasiado hecha puede contener dos tipos de sustancias químicas carcinogénicas: hidrocarburos aromáticos policíclicos (HAPs) y aminas aromáticas heterocíclicas (AAHs). Los HAPs se generan, por ejemplo, por contacto directo de la carne o el pescado con la llama o cuando la carne o el pescado a la parrilla gotean sobre el fuego o sobre el dispositivo de calentamiento. Muchas de estas toxinas son volátiles y pueden ser transportadas por el humo acabando de nuevo sobre la carne o el pescado que nos vamos a comer, agravando así el problema. Igualmente, los alimentos ahumados pueden poseer cantidades importantes de este tipo de moléculas tóxicas.

Tanto los HAPs como las AAHs son sustancias mutagénicas, es decir, que producen cambios químicos importantes en el ácido desoxirribonucleico (ADN) de las células contribuyendo así al desarrollo de diferentes tipos de cáncer. En cuanto a los vegetales, tampoco conviene cocinarlos a temperaturas altas, ya que esto daría lugar a la formación de benzopireno, otro potente agente carcinogénico perteneciente a la familia de los HAPs. Al igual que para la acrilamida, no se pueden establecer límites de tolerancia de estos compuestos en la dieta debido a su elevado potencial carcinogénico.

Algunos consejos para reducir la formación de sustancias nocivas cuando cocinamos

1. Cocinar los alimentos en presencia de diferentes tipos de especias (albahaca, ajo, jenjibre, pimienta, tomillo, romero, salvia, orégano) o marinados en vinagre, lima, limón, vino o cerveza. Las especias se conocen desde muy antiguo. Ya en el siglo I las utilizaban griegos y romanos en sus recetas culinarias, como se describe en el tratado de botánica ‘Dioscórides’. Las especias no solo realzan el sabor de los alimentos o se suman a sus características organolépticas sino que resultan indispensables para proteger a los alimentos contra la formación de moléculas tóxicas que afectan seriamente a nuestra salud.

2. Cocinar carne magra, evitando las carnes grasas para prevenir el goteo sobre la fuente de calor.

3. Cuando cocines piensa en dorado, nunca en negro ni en marrón. Asegúrate siempre de que los alimentos no sobrepasen los límites de color por la acción del calor. Y si te pasas, siempre puedes rascar o eliminar las partes más quemadas.

Sobre el autor: Antonio Gómez Muñoz es catedrático en el Departamento de Bioquímica y Biología Molecular de la Facultad de Ciencia y Tecnología de la UPV/EHU.

El artículo Barbacoas, ciencia y salud se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Salud: ciencia y comunicación (seminario)

- Curso de verano “Las dos culturas y más allá”: La ciencia al servicio de la salud humana, por Icíar Astiasarán

- Ciencia para todos a través del cine y la literatura de ciencia ficción

Marie Curie (1867-1934): Mitoaren azpian dagoen zientzialaria

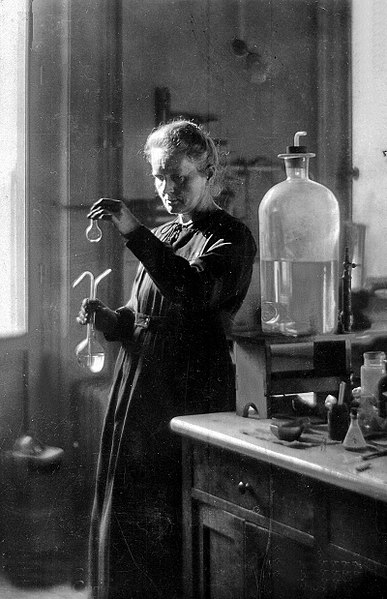

1. irudia: Fisikako Nobel saria irabazi eta zortzi urtera Kimikako Nobel saria eskuratu zuen Marie Curiek.

Marie Curiek bi aldiz irabazi zuen Nobel saria erradioaktibitateari lotutako lanengatik eta modu berean, hori lortzen lehen emakumea izan zen ere. 1903an, Fisikako Nobel saria irabazi zuen bere senar Pierre Curie eta Henri Becquerelekin batera erradiazioaren fenomenoa ikertzeagatik, eta, zortzi urte geroago, berak bakarrik, Kimikako Nobel saria lortu zuen, radioa eta polonioa aurkitzeagatik.

Marie Curie (jatorriz Marie Sklodowska) Varsovian jaio zen, 1867an. Etxea izan zuen eskola; bere aita, Władysław Skłodowska, fisikako eta matematikako irakaslea zen eta bere ama, Bronisława Boguska, nesken eskola bateko zuzendaria. Hala, etxean ikasi zituen fisika eta kimika arloetako oinarrizko kontzeptuak goi-mailako ikasketak egin ahal izan zituen arte. Bere ahizpa Bronislawarekin batera, emakumeak onartzen zituen unibertsitate polako batean hasi zen ikasten. Mariek beti izan zuen amets Parisera joatea, Sorbona Unibertsitatean ikasi nahi zuen. Lortu zuen, baina sakrifizio handia eginez, jakina. Matrikula ordaintzeko dirua lortu behar zuenez, irakasle gisa aritu zen. Gainera, jada Sorbonan zegoela, kasik ez zuen jaten gehiago ikastearren eta behin baino gehiagotan klasean zorabiatu omen zen. Halere, 1893an Fisikako ikasketak bukatu zituen eta urtebete geroago, Matematika Zientzietan lizentziatu zen. Gizonezkoen munduan gailendu zen fisikaria historia idazten hasia zen.

Erradioaktibitatearen lehen urratsakWilhelm Roentgen eta Henri Becquerel fisikariak X izpiak eta uranioaren erradiazioak aurkitu zituzten eta Mariek bide hori jarraitzea erabaki zuen tesia egiteko: argi zeukan substantzia erradioaktiboen inguruko ikerketak abiatuko zituela. Uranioaren mea desberdinen erradioaktibitatea neurtzen ari zela ikusi zuen horietako batzuk beste batzuk baino erradioaktiboagoak zirela. Bere senar Pierre Curie liluratuta zegoen Mariek egindako aurrerapausoekin eta, hortaz, magnetismoari buruzko ikerketak alboratu eta bere emaztea laguntzea erabaki zuen. Hala, senar-emazteek erradioelementu batekin egin zuten topo, uranioa baino erradioaktiboagoa zena: Polonioa –izen hori ipini zioten Marieren jaioterriaren omenez–. Urte berean, torioaren erradioaktibitatea zehaztu zuen. Eta urtebete geroago, radioa aurkitu zuten. Aurkikuntzek ez zuten etenik.

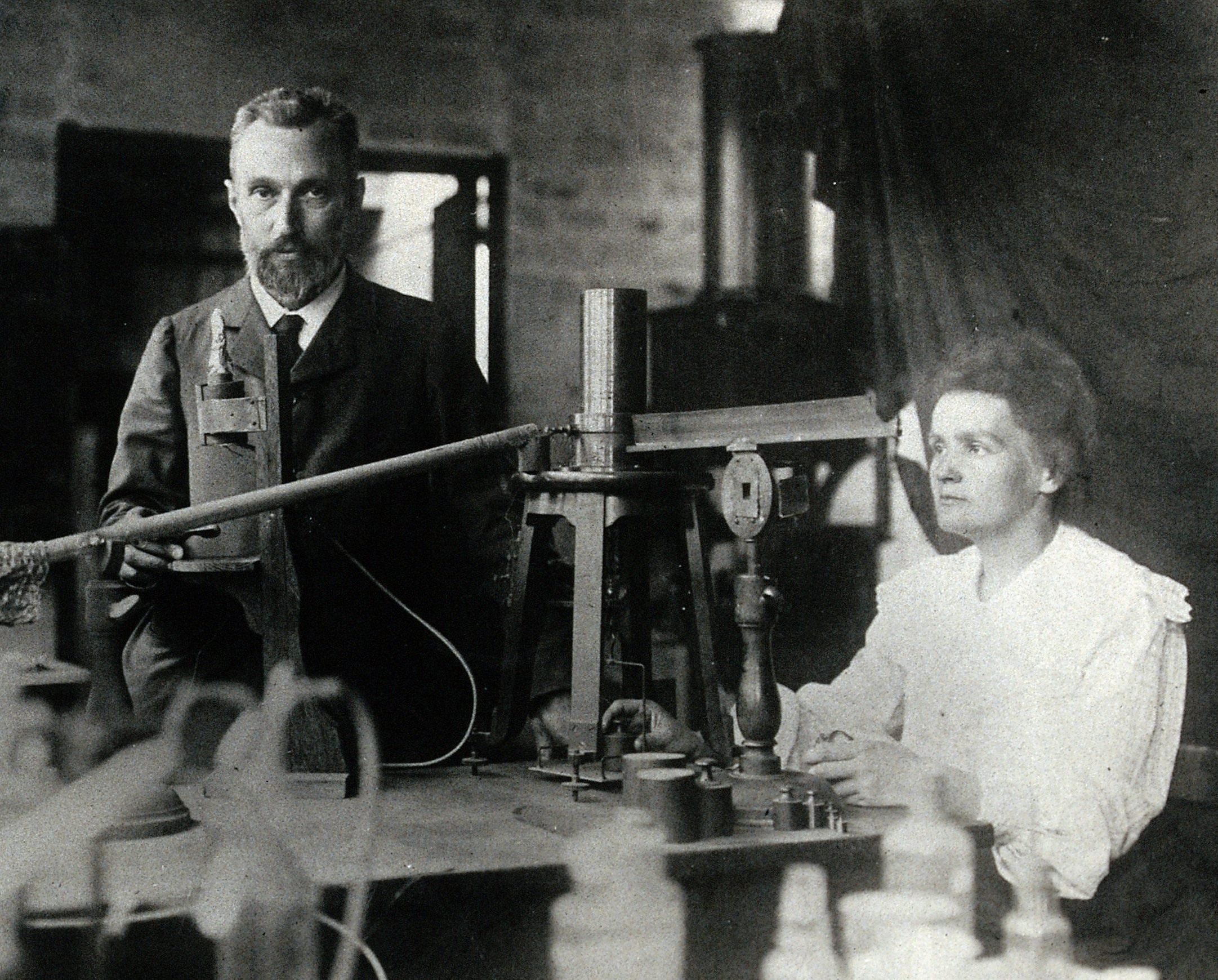

2. irudia: Hasiera batean, Becquerelek eta Pierre Curiek baino ez zuten jaso Fisikako Nobel sariak, baina Pierrek bere emaztea sarituen artean agertzea nahi zuen.

1903an Curiek bere tesia aurkeztu zuen Sorbonan eta zientzian doktore bihurtu zen. Urte horretan, Fisikako Nobel saria jaso zuen. Hasiera batean, Becquerel eta Pierre Curie izan ziren sarituak bakarrik baina Pierrek bere emaztea sarituen artean agertzea nahi zuen. Horretarako, hainbat gutun bidali zituen eta azkenean, bere helburua lortu zuen. 1906 urteaz geroztik, Sorbonako Unibertsitateko fisika laborategiko zuzendaria izan zen Marie eta bertan aritu zen irakasle –hori lortzen lehen emakumea izan zen!–; Frantziako Akademiak, ordea, ez zuen onartu emakumea zelako. Halere, urte hura ez zen onena izan Marierentzat, bere senarra hil baitzen istripu baten ondorioz eta horrek Marieri depresioa eragin zion. Dena dela, aurrera jarraitu zuen, ez zuen beste irtenbiderik. Gauzak horrela, Sorbonako Unibertsitateko lehen emakume katedraduna bilakatu zen eta horren ondotik, 1911n, jaso zuen Kimikako Nobel saria polonioa eta radioa aurkitu eta azken hori isolatzeagatik.

Lehen Mundu Gerrak aldatu zuen MarieLehen Mundu Gerrak ikerketak uztera behartu zuen fisikaria. Hala, buruan zituen nozio guztiak praktikan jartzeko aukera izan zuen. Ez zuen txarto egin: milaka bizitza salbatzen lagundu zuen. Erabilpen militarrerako lehen zentro erradiologiko mugikorrak sortu zituen; Petite Curie gisa ezagunak. Horretaz gain, ospitaleetan soldaduei erradiografiak egin zizkien eta medikuen lana erraztu zuen horrela, horiei esker soldaduen gorputzetan balak aurkitzea errazagoa baitzen. Gainera, erizainei makina horiek nola erabiltzen ziren irakasten aritu zen. Bere laguntza ikaragarria izan zen baina ez soilik gerran. Izan ere, Curiek berak sortu zuen Radioaren Institutuan minbiziaren aurkako tratamenduak ikertu zituen. Bere alaba, Irene-Joliot Curie, bertan aritu zen ere, bere amaren laguntzaile gisa.

Erradioaktibitateak eman zion bere bizitzako arrakasta baina modu berean kondena izan zen harentzat. Izan ere, leuzemiaz hil zen 1934an, ziurrenik bere bizitzan zehar jasotako erradiazioarengatik.

Marie Curie ez da soilik tentuz ahoskatzen duzun izen bat, ezta kondaira baten pertsonaia bat ere. Jakina da Marie Curie biltzen duen arrakasta-geruza lodia dela baina azken batean, zientzian gauza bikainak egin zituen emakume zientzialari bat da: mitoaren azpian dagoen fisikari aparta, haren lana betierekoa izango dena.

Iturriak:

- Zientzia.eus: Marie Curie zientzian eta gizartean aitzindari eta Curie, Marie (Marie Sklodowska)

- Canal Historia: Perfiles: Marie Curie.

- Zientzia Kaiera: Ikertzaile aitzindari bat ezagutzeko erakusketa: Marie Curie.

———————————————————————–

Egileaz: Uxue Razkin (@UxueRazkin) kazetaria da.

———————————————————————–

The post Marie Curie (1867-1934): Mitoaren azpian dagoen zientzialaria appeared first on Zientzia Kaiera.

El sonido del viento

Cuando se habla de los orígenes del arte, o de “Arte Prehistórico”, la primera imagen que se nos viene a la cabeza se suele parecerse mucho a una pintura: las Cuevas de Altamira por ejemplo, de 18 mil años de antigüedad, ocupan un lugar privilegiado en el imaginario colectivo. En algunos casos, habrá también quienes piensen en esculturas paleolíticas, como la Venus de Willendorf de 28 mil años de antigüedad. Es mucho menos habitual pensar en otras formas artísticas y, sin embargo, se han encontrado flautas de hueso de hace 43 mil años que sitúan a la música en los orígenes mismos del pensamiento simbólico humano en Europa.

La cifra resulta apabullante y aún así se piensa que la primera música que hicieron los humanos debe de ser todavía más antigua. Lo más probable es que los primeros músicos no fuesen flautistas, sino cantantes. Para producir melodías, los humanos comenzamos por controlar nuestra voz y luego, probablemente, añadimos algo de percusión (como palmadas, o golpes contra cualquier objeto). Pero estas voces y estas palmadas, evidentemente, no se ha conservado, así que hoy la primera evidencia que tenemos de la música son huesos perforados: huesos de buitre o de oso que, con toda probabilidad funcionaron como flautas.

Esto nos da una pista de por qué son precisamente los instrumentos de viento los más antiguos conservados. Para empezar, pueden fabricarse usando materiales rígidos, no perecederos (al contrario que las cuerdas, por ejemplo, que suelen estar hechas con tripas o pelo de animal). Pero además, son muy fáciles de construir. Para fabricar un instrumento de viento sólo se necesita viento (claro) y un tubo. El viento lo llevamos todos de serie en los pulmones y para conseguir un tubo, basta con encontrar un hueso de animal o alguna caña hueca y rígida. En realidad, la única función de este tubo es la de “contener” el aire, dando cabida a ciertas longitudes de onda, su material y forma exacta son poco cruciales. Toda la magia de los instrumentos de viento tiene lugar más allá del tubo, en uno de sus extremos: el lugar donde el aire se “excita” y comienza a vibrar.

Existen distintas maneras de poner en marcha esta vibración y cada una de ellas da lugar a un timbre característico. Por eso, la forma en que se excita el aire es el verdadero criterio que distingue a las familias de instrumentos de viento. Es muy probable que todos hayáis oído hablar de instrumentos de viento madera y viento metal. La paradoja de estas etiquetas es que poco tienen que ver con el material de que están hechos los instrumentos. Las flautas traveseras de las orquestas contemporáneas, por ejemplo, suelen estar hechas de plata u oro incluso y, sin embargo, la flauta pertenece a la familia del viento madera. Por su parte, dentro del viento metal, encontramos instrumentos tan poco dúctiles o brillantes como las caracolas o las vuvuzelas.

Steve Turre tocando un instrumento de viento metal… poco convencional.

Steve Turre tocando un instrumento de viento metal… poco convencional.Lo que caracteriza en realidad a los instrumentos de viento metal es que el sonido procede de la vibración de los labios del instrumentista. La presión procedente de la boca fuerza al aire a pasar por un mínimo hueco que se abre y cierra constantemente gracias a la elasticidad de los labios. Lo que viene siendo una pedorreta. O lo que sucede cuando dejamos escapar el aire de un globo mientras estiramos la goma junto a la salida: la membrana flexible lucha por recuperar su posición mientras el aire sale intermitentemente. Esa intermitencia puede ser más rápida o más lenta, según lo tensa que esté la goma. Por eso, cuanto más estiramos el globo, más agudo es el sonido resultante (mayor es la frecuencia de las oscilaciones de la presión). Del mismo modo: los trompetistas, trompistas y demás instrumentistas de viento metal, pueden modificar la tensión de sus labios para obtener distintas notas.

Dentro del viento madera, por su parte, encontramos distintas maneras de romper el aire. La flauta, por ejemplo, funciona mediante un bisel: una pieza rígida y afilada que fuerza al aire a desviarse en un sentido u otro, generando nuevamente una oscilación periódica de la presión más comúnmente conocida como sonido.

También son instrumentos de viento madera los que utilizan lengüetas para sonar. La lengüeta (o caña) es una pieza semirígida que interrumpe el paso del aire de manera intermitente gracias al principio de Bernoulli: cuando el aire fluye junto a ella, la presión disminuye y atrae a la lengüeta. Al ser esta flexible, se curva en la dirección del flujo e interrumpe su paso, la velocidad del aire disminuye y la presión vuelve a aumentar. Esto devuelve la lengüeta a su posición inicial y así el ciclo vuelve a empezar.

Existen distintos tipos de cañas y lengüetas, pero generalmente se clasifican como simples, dobles o libres, dependiendo de si se apoyan contra una superficie rígida, contra una segunda caña o si oscilan libremente obstruyendo por sí mismas el flujo del aire. Algunos instrumentos dentro de este grupo son el saxofón (lengüeta simple), la gaita (lengüeta doble) o la armónica (lengüeta libre). Los timbres, como puede verse, son enormemente diferentes pero si he de elegir uno, yo me quedo con la dulzura y la enorme versatilidad del clarinete.

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo El sonido del viento se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La física del sonido orquestal

- Máquinas inteligentes (I): Del molino de viento al test de Turing

- En Marte el viento crea montañas

Bakailaoa bere gene-saltsan

1. irudia: Amaren bakailaoa, pil-pilean. (Argazkia: Koldo Garcia)

Bakailaoa (Gadus morhua) Ozeano Atlantikoaren iparraldean bizi da. Arrantzarako bi gune nagusi izan ditu: Ipar-mendebaldea, Ternua inguruan (Kanada eta Groenlandia); eta ipar-ekialdea, Svalbard inguruan (Norvegia). Lehenbizikoak 1970.eko hamarkadan bakailao-populazioaren kolapsoa izan zuen eta jada ez dago ia arrantzarik; azkenekoak osasun ona du eta arrantza-gune nagusia da orain. Ternuan gertatutako kolapsoa azaldu izan da gehiegizko arrantzaren eta klima-aldaketaren ondorio bezala. Bakailaoaren ugaritasunaren gainbeheraz gain ipar-mendebaldeko bakailaoak ere tamainan eta heldutasun-adinean gainbehera izan du, arrantzaren menpeko hautespenaren ondorioz. Kolapsoa gertatu ostean Kanadak bakailaoaren arrantza debekatu bazuen ere, ez da berreskuratu bakailaoaren kopurua Ternua aldean. Orain dela gutxi ikertzaile talde batek bakailaoaren gene-egitura aztertu du bakailaoaren kudeaketa hobetzeko eta bakailaoaren berreskurapenean laguntzeko.

Ternuako bakailaoaren gene-egitura ezagutzeko aztertu dituzte bostehun bakailao baino gehiago. Bakailao horiek 2001 eta 2015 urteen artean jaso ziren ipar-mendebaldeko Atlantikoko hamazortzi tokitan: hamahiru Ternua eta Labrador penintsularen inguruetan; hiru Kanadako hegoaldean; eta bana Gilbert badian eta San Laurendi golkoaren hegoaldean. Azterketa egiteko bakailao horien ia zazpi mila gene-aldaera erabili dituzte, mota honetako azterketak egiteko informazio gehien ematen dituzten gene-aldaerak hain zuzen ere.

2. irudia: Gehiegizko arrantzak eragin zuen bakailaoaren populazioaren gainbehera ikaragarria Ternuan. (Argazkia: kazuphotos – Pixabay lizentzia. Iturria: pixabay.com)

Ikertzaileek ikusi zuten bakailaoak hiru taldetan banatzen zirela. Banaketa horren oinarria da lehenengo kromosoman gertatu den berrantolaketa bat; eta bakailaoak kromosoma bakoitzaren bi kopia dituenez, konbinaketa ezberdinetatik defini daitezke hiru taldeak:

- talde bat osatzen zuten berrantolaketarik ez duten bi kopien eramaileek;

- beste talde bat berrantolaketa duten bi kopien eramaileek;

- eta hirugarren taldea heterozigotoak ziren, hau da, lehenengo kromosomaren kopia batean berrantolaketa zuten eta bestean ez.

Aurretik ezaguna zen kromosoma-berrantolaketa hau ekialdeko Atlantikoko bakailaoetan. Kromosoma-berrantolaketa horretan alboan dauden bi genoma-eskualde atzekoz aurrera agertzen dira, kromosomaren egitura aldatuz. Berrantolaketa horrek eragin du bertan kokatzen diren geneak supergene bakar bat bailiran bezala heredatzea eta eragina izatea bakailao-populazioaren egituran, zailagoa baita gurutzatzea berrantolaketa duten bakailaoak eta ez dutenak. Izan ere, uste da kromosoma-berrantolaketa hori ekialdeko Atlantikoko bakailaoetan gertatu zela orain dela 1,6 eta bi milioi urte artean eta eragin zuela ipar-mendebaldeko bakailaoan aldakortasuna emendatzea.

Aurretik ezaguna zen ere kromosoma-berrantolaketa horrek lotura zuela bakailaoaren migratzeko gaitasunarekin eta ikerketa honetan berretsi dute lotura hori. Oro har, berrantolaketa ez duten bakailaoak ez dira migratzaileak, kostaldekoak dira; berrantolaketa dutenek, aldiz, joera handiagoa dute migratzeko. Kromosoma-berrantolaketa gertatu den eskualdean kokatzen dira igeri-maskuriarekin eta muskuluen errendimenduarekin lotutako geneak; eta iradoki da horrek migrazioak egiteko gaitasunean eragina izan duela. Ideia honen alde, azken lan honetan ikusi dute hautespenak modu ezberdinean jokatu duela berrantolaketa izatearen arabera: migrazioa hobetzen duten gene-aldaeren aldeko hautespen naturala gertatu da kromosoma-berrantolaketa duten bakailaoetan.

3. irudia: irudia: Bakailaoaren gene-egituraren aldaketak Ternuako ekosisteman eragina izan dezake (Argazkia: jzabloski – Pixabay lizentzia. Iturria: pixabay.com)

Baita ere, gene-datuetan oinarrituta eta simulazioak erabilita, aztertu dute talde bakoitzaren kopuruaren bilakaera. 1860. urtean talde bakoitzak antzeko tamaina bazuen ere, kromosoma-berrantolaketarik ez zuen taldean eta heterozigotoak ziren taldean populazioa nabarmen hazi zen 1970. urtera arte, hau da, populazio oso emankorrak izan ziren. Kromosoma-berrantolaketa zuen taldean, ordea, ez zen halakorik ikusi, populazioaren jaitsiera txiki bat baizik. 1970. urtetik aurrera hiru taldeetan populazioaren kopuruak nabarmen behera egin zuen eta horrek eragin du orain talde bakoitzaren kopurua ezberdina izatea: kromosoma-berrantolaketa duen taldea oso urria da eta talderik handiena kromosoma-berrantolaketarik ez duena da. Gainera, tokian toki, ikusi da talde bakoitzaren proportzioa aldatu dela eta horrek iradoki dezake hautespenaren intentsitatea, edo arrantzaren eragina, lekuaren araberakoa izan dela.

Egileen ustez argi dago gehiegizko arrantzak batez ere kromosoma-berrantolaketa duen populazioan eragina izan duela, hau da, migrazioak egiten dituzten bakailaoetan. Egileen aburuz, populazio mota ezberdinen proportzio aldaketak eragin du kostako ekosistemaren berrantolaketa eta, gehiegizko arrantzak jarraituko balu, migratzen duen bakailao-taldea guztiz desagertuko litzateke. Ondorioz, bakailaoaren bioaniztasuna, banaketa eta iraunkortasuna aldatuko litzateke eta horrek aldaketak sortuko lituzke ipar-mendebaldeko Atlantikoko ekosistemen funtzioan eta osaketan. Hortaz, bakailaoaren kudeaketa egiterako orduan aholkatzen dute genoma-egitura kontutan hartzea, bioaniztasuna mantentzeko eta, horrela, etorkizunean bakailaoaren populazioaren beste kolapso bat ekidin.

Laburbilduz, badirudi Ternua aldean gertatu den bakailaoaren gehiegizko arrantzak bakailaoaren gene-egituran eragina izan duela eta, horrek, Ternuako ekosisteman eragina izan dezakeela. Horrela, uda honetan egingo diren bakailao-lehiaketa batean parte hartzen baduzu edo kuxkuxeatzen baldin bazaude, zure kideei eta lehiakideei azal ahal diezu nola gure zaletasun horrek bakailaoaren gene-egitura aldatu duen.

Erreferentzia bibliografikoa:

Kess et al. (2019). A migration-associated supergene reveals loss of biocomplexity in Atlantic cod. Science Advances, 5(6), eaav2461. DOI: 10.1126/sciadv.aav2461

—————————————————–

Egileaz: Koldo Garcia (@koldotxu) Biodonostia OIIko ikertzailea da. Biologian lizentziatua eta genetikan doktorea da eta Edonola gunean genetika eta genomika jorratzen ditu.

—————————————————–

The post Bakailaoa bere gene-saltsan appeared first on Zientzia Kaiera.

Kaisa-talo, geometría en la biblioteca

Esa fuerza interior se transmite de forma brillante hacia fuera en las dos fachadas, especialmente en la que da a la calle Kaisaniemenkatu. Una trama de pequeñas ventanas cuadradas dan una luz muy tamizada interrumpida por unos grandes ventanales de formas parabólicas por la que se introduce la luz hacia el espacio central.

Alberto Corral

La biblioteca de la Universidad de Helsinki es la biblioteca universitaria multidisciplinaria más grande de Finlandia. Funciona como un instituto independiente e incluye la Biblioteca Central –llamada Kaisa-talo, es decir, casa Kaisa en finés– y las bibliotecas de los campus de Kumpula, de Meilahti y de Viikki.

Fachada principal (este) de Kaisa-talo. Fotografía: Inés Macho Stadler.

Fachada principal (este) de Kaisa-talo. Fotografía: Inés Macho Stadler.Kaisa-talo reúne las colecciones de libros y documentos de las facultades de arte, derecho, teología y ciencias sociales de la Universidad de Helsinki; está situada en el centro del campus. El solar que alberga esta biblioteca estaba antes ocupado por un centro comercial –construido en dos fases en 1973 y 1984 y posteriormente demolido– que era poco respetuoso con el paisaje urbano debido a su fachada de cemento. Los niveles subterráneos, antes ocupados por los aparcamientos, han sido conservados y forman parte de la biblioteca como zona de mantenimiento y almacenaje.

La firma de arquitectos Anttinen Oiva de Helsinki se presentó en 2007 a un concurso para diseñar el nuevo edificio que iba a alojar la biblioteca central de la universidad de esta ciudad, y lo ganó. En 2011 la propuesta de Anttinen Oiva comenzó a construirse como parte de La Capital de Diseño Mundial, un proyecto de promoción de ciudades patrocinado por el Consejo Internacional de Sociedades de Diseño Industrial (International Council of Societies of Industrial Design, World Design Organization) en el que la ciudad elegida – en el año 2012 fue Helsinki– tiene la oportunidad mostrar sus logros de innovación en diseño y sus estrategias urbanas. Kaisa-talo fue inaugurada el 3 de septiembre de 2012.

Fachada oeste de Kaisa-talo. Fotografía: Inés Macho Stadler

Fachada oeste de Kaisa-talo. Fotografía: Inés Macho StadlerEl exterior del edificio es de ladrillo rojo –caracteriza el modernismo finlandés– y respeta la altura de los edificios colindantes, lo que le ayuda a integrarse en su entorno. Situado en una cuesta, Kaisa-talo tiene forma de L y siete pisos. Su entrada principal está en el lado este, dos pisos por encima de los accesos a las tiendas situadas en la fachada opuesta. La fachada este posee un arco catenario que ocupa cuatro pisos y otro similar invertido aparece en la fachada oeste. Las paredes exteriores albergan grandes ventanales curvos y también numerosas ventanas pequeñas y cuadradas que forman una retícula uniforme que contrasta con la zona curvilínea.

Small Worlds (2012). Imagen: Wikimedia Commons.

Small Worlds (2012). Imagen: Wikimedia Commons.Ya en el interior del edificio, en el hall de entrada se sitúa un mural de 18 metros, donado por el Consejo de Arte del Estado: Small Worlds realizado por las artistas Terhi Ekebom y Jenni Rope. Esos Pequeños mundos, algunos de ellos enlazados mediantes estrechos caminos, quizás aludan a los muchos espacios interconectados en la biblioteca.

Una impresionante escalera en forma de espiral comunica los pisos principales de la biblioteca, exceptuando el centro logístico y las instalaciones de mantenimiento bajo tierra a los que se accede fundamentalmente por ascensor.

Escalera interior en forma de espiral. Fotografía: Inés Macho Stadler

Escalera interior en forma de espiral. Fotografía: Inés Macho StadlerEn la entrada principal, se observan dos grandes vacíos: unos en forma de elipse –que van disminuyendo su tamaño al subir de piso en piso– y otros en forma de parábola e hipérbola –que van aumentando a medida que se sube en el edificio–. Ambos proporcionan luz natural además de comunicar las diferentes alturas del edificio.

Vacío interior en forma de elipse. Fotografía: Inés Macho Stadler

Vacío interior en forma de elipse. Fotografía: Inés Macho StadlerEn las referencias pueden verse numerosas fotografías en las que se aprecian los detalles descritos anteriormente. El siguiente video del arquitecto Alberto Corral realiza un buen recorrido por el interior del edificio.

Nota: Un especial agradecimiento a mi hermana Inés por hablarme de Kaisa-talo y cederme las fotografías utilizadas en esta anotación.

Referencias

-

Sinikara, K. & Lukkari, A-M., A case study on a post-occupancy evaluation of the new Helsinki University Main Library en Post-Occupancy Evaluation of Library Buildings, Latimer, K. & Sommer, D. (eds.). IFLA Publications Series 169 (2015) 175-191

-

Alberto Corral, Kaisa-talo, un edificio único en Helsinki, Blog, 23 febrero 2014

-

Mara Corradi, Anttinen Oiva y la Helsinki University Main Library (Kaisa house), Floornature, 29 julio 2015

-

Amy Frearson, Curving voids pierce the floors of Anttinen Oiva Architects’ Helsinki library, DeZeen, 13 noviembre 2014

-

Manuela Londoño Laserna y Juliana Marroquín DeCastro, Biblioteca Universidad de Helsinki. Sede Centro, Unidad taller de Cartagena, 2013

-

Imágenes para prensa, Universidad de Helsinki

-

Kaisa-talo, Wikipedia (consultado el 14 julio 2019)

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo Kaisa-talo, geometría en la biblioteca se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La geometría de la obsesión

- El tamaño sí importa, que se lo pregunten a Colón (o de la geometría griega para medir el diámetro de la Tierra)

- Quad: pura geometría

Arrazoi dute: zeruan ikusten diren lorratzak kezkagarriak dira

The Cloudspotter’a Guide liburuan, CAS Hodeiak Estimatzeko Elkarteko presidente Gavin Pretor-Pinneyk “hodeien familiako sasikume” berritzat hartzen ditu kondentsazio-lorratzak. “Gaur egun, agian hobe da mugatzea esatera haien ez direla sortuak izan haien anai-arrebak sortuak izan diren modu berean”, gaineratzen du, iseka puntu batekin. Egileak argitzen duenez, bi hodei mota horien artean dagoen desberdintasun bakarra da, hain zuzen, batzuk modu naturalean sortzen direla, eta besteak giza jardunaren ondorio direla.

1. irudia: Denbora askoan ez da kontuan hartu kondentsazio-lorratzen eragina klima aldaketan, baina orain ikerketa batek azaleratu du eragin esanguratsua izan dezaketela. (Argazkia: William Hook/Unplash)

Hegazkin komertzialek eragiten dituzten lorratz horiek 8.000-12.000 metroko altueran sortu ohi dira; horixe baita, hain zuzen, hegazkin gehienen gurutzaldi-abiadurarako altituderik hoberena. Baina bertan dagoen tenperatura oso baxua da, 30-60 gradu zero azpitik, eta hegazkinen motorretatik ateratzen diren gas heze eta beroak atmosferan dagoen aire hotzarekin nahastean ur-tanta txikiak eragin daitezke, modu horretan izotz-kristal txikiak sortzen direlarik. Kristalen eraketa horretan motorretik ateratzen diren partikulak ere lagungarri dira, horien inguruan biltzen baita hezetasuna. Alabaina, ez dira beti lorratzak sortzen: airean hoztasun eta hezetasun nahikoa egon ezean, kristal horiek ia berehala sublimatzen dira. Horregatik, eguraldia iragartzen trebezia nahikoa dutenentzat, zeruan marraztutako marra horiek troposferaren goiko aldearen tenperaturaren adierazle izan daitezke.

Eguraldian ez ezik, hodei artifizial horiek kliman ere eragina dutela uste dute zientzialariek, baina klima-sistema hain konplexua denez, askotan zaila izan da neurtzea norainoko inpaktua duten. Batetik, lorratz hauek eta bestelako partikulek iluntze efektu bat sortzen dutela proposatu da behin baino gehiagotan, eguzkiaren energiaren zati bat islatzen dutelako. Hau da, planeta berotu beharrean, planeta hozten lagunduko lukete. Efektu bera dute ere hodei gehienek, baina hodei artifizialen kasuan efektua kontrakoa dela uste dute zientzialariek, haien tamainagatik eta dauden altitudeagatik energia kopuru bat igarotzen uzten dutelako; baina, aldi berean, bertan dauden izotz kristalek energia kopuru bat ere metatzen dutelako.

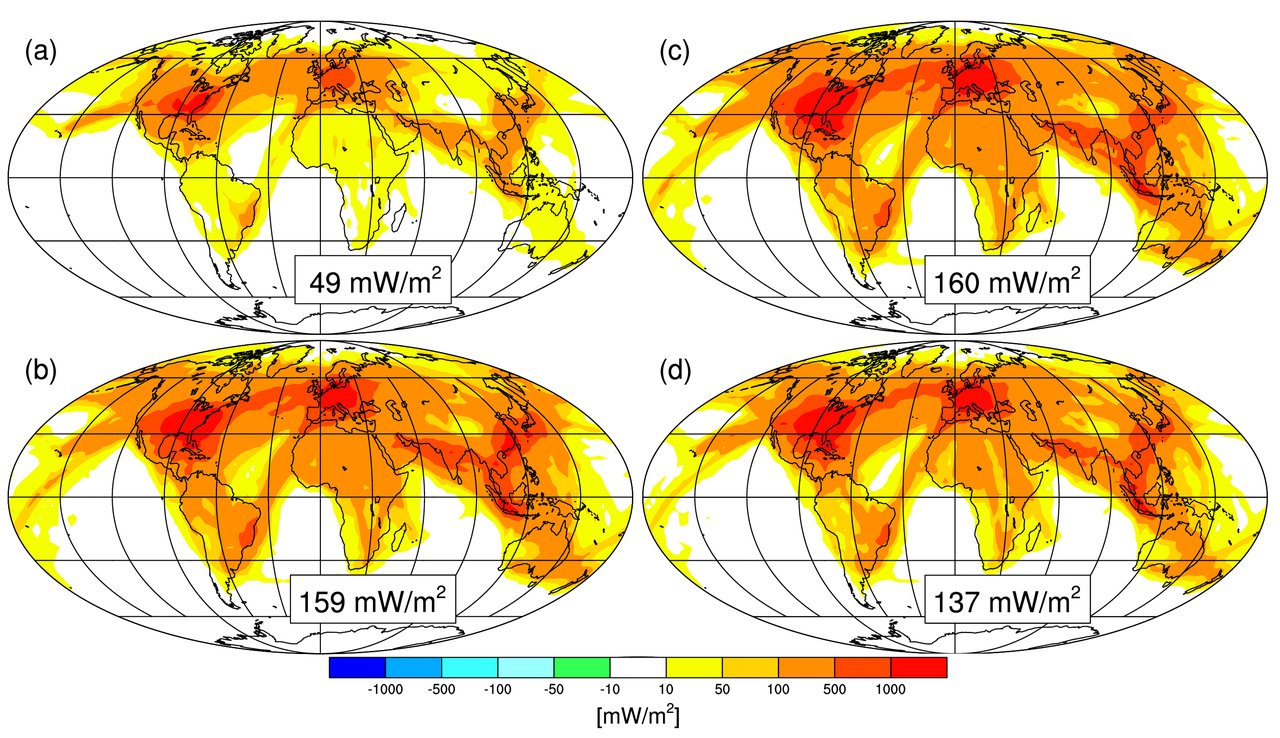

Orain, aurrenekoz, ikerketa batek zehaztu du lorratz horiek klima aldaketan daukaten eragina, mundu mailan. DLR Alemaniako Zentro Aeroespazialeko bi ikertzailek egin dute kalkulua. Gaur egungo egoera kontuan hartzeaz gain (berez, 2006. urtea hartu dute erreferentzia modura), eta klimatologian egin ohi den moduan, 2050. urterako aurreikuspenak ere egin dituzte. EGU Europako Geozientzien Batasuna elkarteak argitaratzen duen Atmospheric Chemistry and Physics aldizkarian zabaldu dituzte emaitzak.

2. irudia: Mapetan azaltzen da hegazkinetako lorratzek sortzen duten beroketa, metro koadroko miliwattetan neurtuta. 2006ko datuak (a), eta 2050erako aurreikuspenak (b). Erakusten dira ere berotegi efektuak eragindako berotze erantsia (c), eta motorren efizientzian aurreikusitako hobespenak (d). (Grafika: EGU)

Egileek proposatu dute beroketa globalean orain arte behar bezala kontuan hartu ez den eragina badutela hodei artifizial hauek. Bi dira atera dituzten ondorio nagusiak. Batetik, ikusi dute kondentsazio lorratzen bitartez kliman sortzen den eragina hegazkinetan erabilitako erregai fosilen errekuntzagatik sortzen dena baino handiagoa dela. Bestetik, egin dituzten kalkuluen arabera, hodei artifizial horien eragina hiru aldiz handiagoa izango da 2050ean. Zehaztu dutenez, hodei artifizialen eragina abiazioaren hasieratik egindako CO2 isuriak baino zertxobait handiagoa izan da. Kalkulatu dutenez, hegazkinen inpaktua 2006an metro koadroko 49 miliwattekoa izan zen, baina 2050ean eragin hori 159 mW/m2 izango dela aurreikusi dute. Izan ere, eta Europako Batzordeak egin dituen aurreikuspenak kontuan hartuta, aireko zirkulazioa 3-7 aldiz handiagoa izango da data horren bueltan. Hemendik 30 urtera bitarteko egoera kalkulatzeko, egileek azaldu dute haien ikerketan ere kontuan hartu dutela hegazkintzaren industriak motorretan hobekuntzak garatuko dituela.

Argitu dute abiazioak erradiazio bidezko indartze antropogenikoaren %5 sortzen duela, hau da, planetak jasotzen duen erradiazioak eta giza jardueraren ondorioz espaziora bueltatzen den erradiazioaren arteko aldean eragina baduela.

Munduaren tokiaren arabera, ezberdina da hodei artifizial hauen presentzia. Hala, aurretik egindako ikerketa batek zehaztu zuen batez bestean zeruen %0,61 okupatzen dutela hodei artifizial hauek, baina kopurua handitzen da noski populazio gehien duten guneetara hurbildu ahala. Modu horretan, Europan %2 da batez bestekoa, baina kontinente zaharreko erdigunean zein Ameriketako Estatu Batuetako hainbat eremutan portzentajea %10era iristen da.

Toki hauetan ez ezik, eta gaur egun ekonomiari lotuta egiten diren aurreikuspenak kontuan izanda, egileek ondorioztatu dute datozen urteetan bereziki Asiaren ekialdean eta hegoaldean handituko dela lorratzek sorraraziko erradiazio bidezko indartzea.

Erreferentzia bibliografikoa:

Bockand, Lisa; Burkhardt, Ulrike (2019). Contrail cirrus radiative forcing for future air traffic. Atmospheric Chemistry and Physics, 19, 8163-8174. DOI: https://doi.org/10.5194/acp-19-8163-2019

———————————————————————————-

Egileaz: Juanma Gallego (@juanmagallego) zientzia kazetaria da.

———————————————————————————-

The post Arrazoi dute: zeruan ikusten diren lorratzak kezkagarriak dira appeared first on Zientzia Kaiera.

El descubrimiento de los rayos X

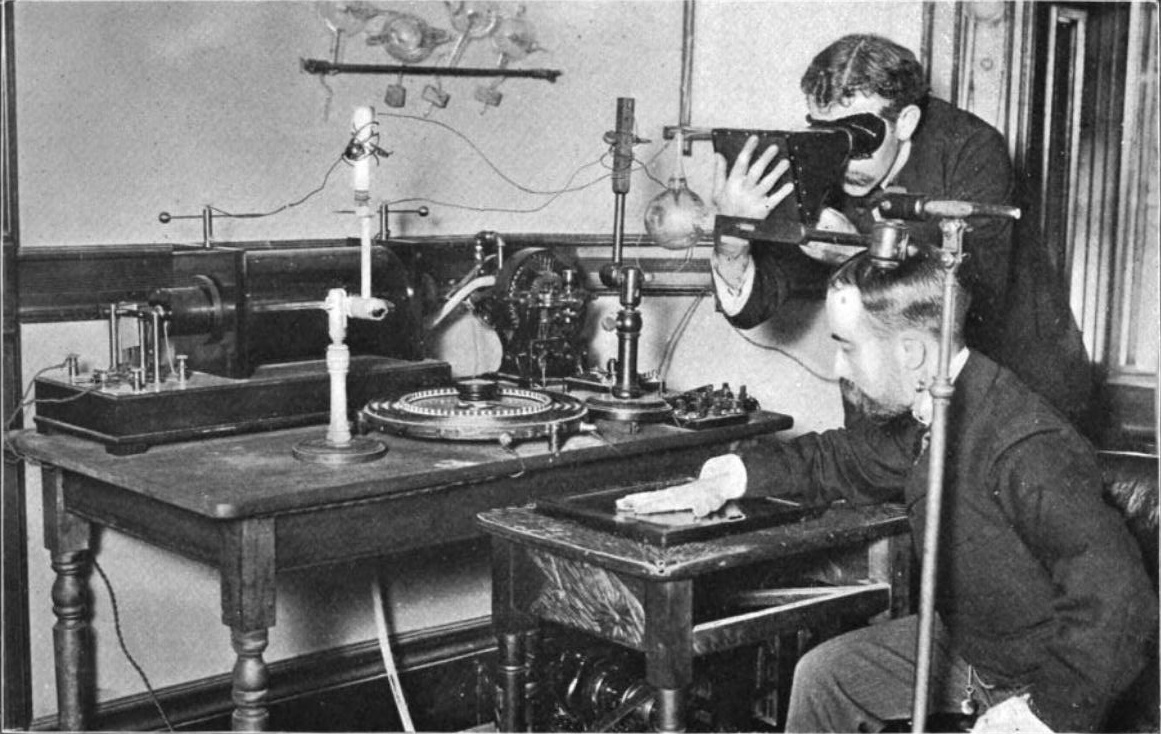

Fuente: Wikimedia Commons.

Fuente: Wikimedia Commons.En 1895, Wilhelm Konrad Röntgen hizo un descubrimiento que lo sorprendió primero a él y luego a todo el mundo. Al igual que el efecto fotoeléctrico, no encajaba con las ideas aceptadas sobre las ondas electromagnéticas y, finalmente, también requirió la introducción de los cuantos para una explicación completa. Las consecuencias del descubrimiento de los rayos X para la física atómica, la medicina y la tecnología fueron enormes.

El 8 de noviembre de 1895, Rontgen estaba experimentando con los nuevos rayos catódicos, al igual que muchos físicos de todo el mundo. Según un biógrafo [*]:

. . . había cubierto el tubo de cristal en forma de pera [un tubo de Crookes] con trozos de cartón negro, y había oscurecido la habitación para probar la opacidad de la cubierta de papel negro. De repente, a aproximadamente un metro del tubo, vio una débil luz que brillaba en un pequeño banco que sabía que estaba cerca. Muy emocionado, Rontgen encendió una cerilla y, para su sorpresa, descubrió que la fuente de la misteriosa luz era una pequeña pantalla de platino-cianuro de bario depositada en el banco.

El platino-cianuro de bario, un mineral, es uno de los muchos productos químicos que se sabe que producen fluorescencia (emiten luz visible cuando se ilumina con luz ultravioleta). Pero no había ninguna fuente de luz ultravioleta en el experimento de Röntgen. Se sabía además que los rayos catódicos viajan solo unos pocos centímetros en el aire. Por lo tanto, ni la luz ultravioleta ni los propios rayos catódicos podrían haber causado la fluorescencia. Röntgen dedujo que la fluorescencia involucraba la presencia de rayos de un nuevo tipo. Los llamó rayos X, ya que los rayos eran de naturaleza desconocida.

En una intensa serie de experimentos sistemáticos durante las siguientes 7 semanas Röntgen determinó las propiedades de esta nueva radiación. Informó de sus resultados el 28 de diciembre de 1895 en un artículo cuyo título (traducido) es «Sobre un nuevo tipo de rayos». El artículo de Röntgen describía casi todas las propiedades de los rayos X que se conocen.

Hand mit Ringen (mano con anillos). Impresión de la primera radiografía médica tomada por Wilhelm Röntgen usando rayos X. Corresponde a la mano de su mujer y fue tomada el 22 de diciembre de 1895. Röntgen se la regaló a Ludwig Zehnder del Physik Institut de la Freiburg Universität el 1 de enero de 1896.

Hand mit Ringen (mano con anillos). Impresión de la primera radiografía médica tomada por Wilhelm Röntgen usando rayos X. Corresponde a la mano de su mujer y fue tomada el 22 de diciembre de 1895. Röntgen se la regaló a Ludwig Zehnder del Physik Institut de la Freiburg Universität el 1 de enero de 1896.Röntgen describió el método para producir los rayos y probó que se originan en la pared de vidrio del tubo, donde los rayos catódicos lo golpean. Demostró que los rayos X viajan en línea recta desde su lugar de origen y que oscurecen una placa fotográfica. Informó detalladamente de la capacidad variable de los rayos X para penetrar en diversas sustancias como el papel, la madera, el aluminio, el platino y el plomo. Su poder de penetración era mayor en los materiales “ligeros” (papel, madera, carne) que en los materiales “densos” (platino, plomo, hueso). Describió y exhibió fotografías que mostraban «las sombras de los huesos de la mano, de un conjunto de pesas dentro de una pequeña caja, y de un pedazo de metal cuya inhomogeneidad se hace evidente con los rayos X.» Dio una descripción clara de las sombras proyectadas por los huesos de la mano sobre la pantalla fluorescente. Röntgen también informó que los rayos X no se desviaban por la presencia de un campo magnético. Tampoco constató reflexión, refracción o interferencia usando aparatos ópticos ordinarios.

Experimentando con rayos X. Fuente: William J. Morton & Edwin W. Hammer (1896) «The X-ray, or Photography of the Invisible and its value in Surgery», American Technical Book Co., New York, fig. 54 / Wikimedia Commons

Experimentando con rayos X. Fuente: William J. Morton & Edwin W. Hammer (1896) «The X-ray, or Photography of the Invisible and its value in Surgery», American Technical Book Co., New York, fig. 54 / Wikimedia CommonsJ.J. Thomson descubrió una de las propiedades más importantes de los rayos X uno o dos meses después de que los rayos se diesen a conocer. Encontró que cuando los rayos pasan a través de un gas, lo convierten en un conductor de electricidad. Thomson atribuyó este efecto a «una especie de electrólisis, la molécula se divide o casi se divide por los rayos de Röntgen». Hoy sabemos que los rayos X, al pasar a través del gas, liberan electrones de algunos de los átomos o moléculas del gas. Los átomos o moléculas que pierden estos electrones se cargan positivamente. Siguiendo con el símil electrolítico a estas moléculas cargadas se las llamó iones porque se parecen a los iones positivos de la electrólisis, y de ahí que se diga que el gas está “ionizado”. Además, los electrones liberados pueden unirse a átomos o moléculas previamente neutros, cargándolos negativamente.

Röntgen y Thomson descubrieron, independientemente que los cuerpos electrificados pierden sus cargas cuando el aire a su alrededor se ionizado por los rayos X. (Ahora es fácil ver por qué: el cuerpo electrificado atrae iones de la carga opuesta presentes en el aire ionizado). La velocidad de descarga depende de la intensidad de los rayos (ya que de ella depende la cantidad de ionización). Por lo tanto, esta propiedad se usó, y se sigue usando, como un medio cuantitativo conveniente para medir la intensidad de un haz de rayos X. Este descubrimiento implicaba, pues, que se podían realizar mediciones cuantitativas cuidadosas de las propiedades y efectos de los rayos X.

Nota:

* Hay varias versiones del descubrimiento. Incluso existe una de consenso que no es más válida que la que ofrecemos. Lo cierto es que la única persona presente era Röntgen, él no lo contó a nadie que tomase notas de ello de forma fidedigna y fiable y dejó dicho que sus notas de laboratorio, que podrían haber arrojado algo de luz [nótese el ingeniosísimo juego de palabras], se destruyesen a su muerte. La cuestión es que los elementos fundamentales de todas las narraciones (tubo de Crookes, cartón negro y pantalla de platino-cianuro de bario) están presentes.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo El descubrimiento de los rayos X se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La luz se propaga en línea recta pero los rayos de luz no existen

- Rayos X y gamma

- El tubo de rayos catódicos, auge y caída de una pieza clave del siglo XX

Oscarretarako bide matematikoa

Star Wars, Karibeko piratak, Toy Story, Frozen eta beste film asko ikusita, sumatzen dugu ordenagailuak zeregin handia izan duela haien atzean dagoen lan teknikoan. Zer ote da, baina, ordenagailuaren lana? Baten batek eman behar dizkio aginduak…

Elurra, ura, ilea, haizea eta abarAleka McAdamsek 2011n aurkeztu zuen tesia UCLAn, Joseph Teran irakaslearen zuzendaritzapean. Matematika aplikatuko tesia zen eta izenburuan efektu berezietako erabilera aipatzen zuen (applications to physical simulation in visual effects). Walt Disney estudioetan eman zioten lana. Alexey Stomakhinek urte bi geroago amaitu zuen bere tesia, zuzendari berarekin lan eginda, eta hura ere Walt Disneyra joan zen lanera. Hirurak, Teran, McAdams eta Stomakhin, agertzen dira Frozen eta Moana filmen arrakastaren atzean, beste zenbait lankiderekin batera, haietariko batzuk UCLAko ikasleak.

1. irudia: Stomakhin, Teran eta UCLAko beste ikasle bi, Frozen filmaren amaiera ospatzen. (Argazkia: UCLA Newsroom)

Animaziozko film onenaren Oscar saria lortu zuen Frozen filmak 2014an. Izotza eta elurra ziren protagonista eta haien diseinu egokia lortzea, ahalik eta irudi errealena ematea, nahi izan zuten zuzendari artistikoek. Teranen taldeak, Stomakhin barne zela, eredu matematiko berri bat proposatu zuen elurraren mugimenduen simulaziorako eta hortik sortu zen programa erabili zuten filmean. McAdamsen lantaldeak beste eginkizun bat izan zuen film berean: haizearen eragina jantzietan eta ilean simulatu zuten.

2. irudia: Aleka McAdams Frozen filmak irabazitako Oscarrarekin. (Argazkia: TigerBands)

Moana filma (Vaiana, hemengo aretoetan) Polinesiako itsasoetan kokatzen da. Urari protagonismo berezia eman nahi izan zioten, filmeko beste pertsonaia bat bailitzan. Zaila da uraren simulazioa egitea, masa osoaren mugimenduaz gain, olatuen talkak eta baita zipriztinak ere erakutsi behar baitira, itxura erreala lortzeko. Ordurako beste film batzuetan ere agertu zen uraren mugimendua, baina hobetu nahi izan zuten. Stomakhinek garatu zuen simulazio berriaren kodea, talde baten barruan, eta bertan zen berriro Teran irakaslea ere. McAdamsek ere hartu zuen parte filmean, oraingoan ilearen simulazio berri bat proposatu zuen taldean.

Joseph Teranen tesi-zuzendaria Stanford Unibertsitateko Ronald Fedkiw izan zen, entzutetsua eta saritua zinemarako egin duen lanagatik. Fedkiwren zuzendaria izan zena, berriz, ospe handiko matematikaria da: Stanley Osher, UCLAko irakaslea. Besteak beste, matematika arloko sari garrantzitsu bat eman zioten Osher jaunari 2014n, Gauss saria. Berak sortu zuen, James Sethianekin batera, maila-multzoen metodoa (level-set method) gainazalen irudikapenerako eta horrekin gainazalen mugimendua, nahastea edo bateratzea deskribatzeko tresna bat. Fedkiwk tresna matematikoa zena zinearen teknologiara egokitu zuen eta hainbat filmetan erabili da.

Sci-Tech (Oscar) sariakZinemako Arte eta Zientzien Akademiak ematen ditu Oscar sariak mundu guztian ikus daitekeen zeremonia arranditsu batean. Askok ez dute jakingo, ordea, glamour gutxiagoko beste zeremonia batean Sci-Tech sariak banatzen dituela. Horien bidez Akademiak ohoratzen ditu “gizon, emakume eta enpresak, zeinen aurkikuntza eta berrikuntzek modu garrantzitsu eta iraunkorrean lagundu baitioten zinemari”. Ohiko da matematikariak, fisikariak eta informatikariak saritzea. Aurtengo adibidea aipatzearren, 2019ko Zientzia eta Ingeniaritza alorreko saridunen artean Edwin Catmull, Tony DeRose eta Jos Stam izan dira, hiru dimentsioko geometriaren eredu digitaletarako gainazalen zatitze-metodoa sortu eta garatzeagatik. Irudi poligonal edo poliedriko batetik abiatuta, forma leunak lortzen dituzte iterazio bidez.

3. irudia: Jos Stam, Edwin Catmull eta Tony DeRose saria jasotzen. (Argazkia: Todd Wawrychuk / ©A.M.P.A.S)

Edwin Catmull aitzindaria izan zen animazioa ordenagailuz egiten, 1970eko hamarkadan hasi baitzen, informatika eta fisikako ikasketak amaitu berritan. Laster kontratatu zuen George Lucas zinegile ospetsuak bere enpresetan lan egiteko, zinemaren industrian konputazioa sartzearen beharraz konbentzituta. Catmullek ekarpen tekniko asko egin ditu eta, gainera, Pixar eta Walt Disney Animation Studios enpresen presidentea izan da. Bost bider irabazi ditu Zinemako Akademiaren sariak, haietako bat Gordon E. Sawyer sari berezia (2009).

Tony DeRose Pixar enpresaren ikerketa taldeko burua izan da denbora luzez, unibertsitateko irakasle izan eta gero. Gazteen artean matematika, fisika eta ingeniaritza bultzatzeko Pixar in a box programa abiatu zuen Pixar eta Khan Academy elkartuta. Bertan bideo laburren bidez azaltzen da Pixarren animazio lana (bideo-sorta honetan, adibidez, aipatu dugun zatitze-metodo saritua).

Jos Stam, holandarra jaiotzez, Suitzan hazi zen eta informatika eta matematika ikasi zituen Genevan. Gero Toronton egin zuen tesia informatikan eta fenomeno fisikoen animazioan hasi zen lanean. Fluidoen simulazioan arrakasta handiko Maya Fluid Effects programaren sortzaileetako bat da. Bere lana aurkezteko hala dio: “nire ikerketan atsegin dut konbinatzea artea, matematika, zientzia, ordenagailuak eta beste zenbait gauza exotiko”.

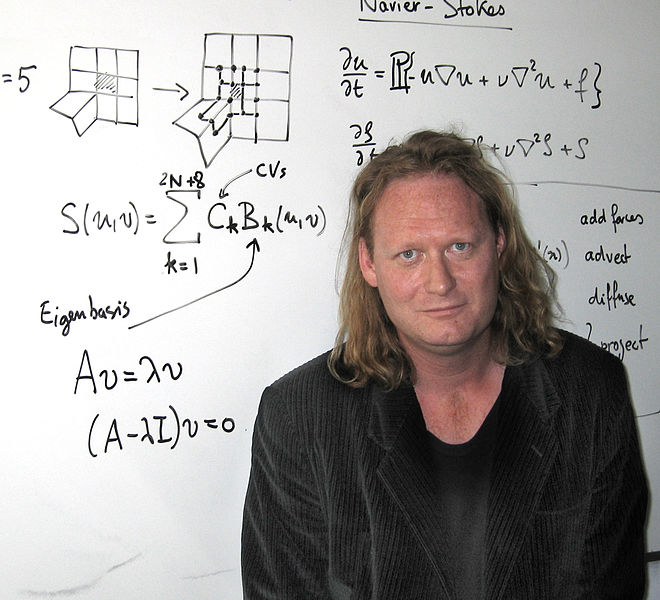

4. irudia: Jos Stam, konputazio grafikoan aditua, zenbait ekuazio matematikoren aurrean. (Argazkia: Azam Khan / Wikipedia – CC BY 3.0 lizentziapean)

Aurtengo hiru hauen moduan, hainbat zientzialari agertzen dira beste urte batzuetako sarituen artean.

Kirurgia birtualaJosep Teranek zinemarako lan egiteaz gain, badu beste ikerketa-ildo interesgarri bat: kirurgia birtuala. Ez du berak sortu, lehenago ere egiten zen, baina bereziki interesatzen zaion alor bat da. Medikuak ordenagailuan egiten du ebakuntza, trebatzeko edo ondorioak probatzeko, eta ez du gorpurik behar. “Pazientea” hiltzen bazaio, berriro has daiteke ebakuntza egiten.

Garrantzitsua da horretarako ordenagailuen kalkuluak denbora errealean egitea, esan nahi baita, medikuaren mugimendu bakoitzaren erantzuna berehala agertu behar da pantailan, benetako ebakuntza bat simulatuz. Horrek esan nahi du atzean dauden ekuazio matematikoak ebazteko denbora oso txikia izan behar dela. Esandako horrek zinemarako ere balio du, komenigarria baita talde artistikoarentzat irudien segida jarraitua ikustea. Hortaz, segundoko 30 fotograma hartzeko, beste horrenbeste bider ebatzi beharko dira ekuazioak, aldi bakoitzean lortutako datuetatik abiatuz hurrengoen kalkulua.

Azken hitzak McAdams, Osher eta Teranen artikulu batetik (2010) hartuko ditugu:

“konputazio zientziaren teknikak duela gutxi bihurtu dira praktikoak zineman eskala handian, beraz, oraindik ez dakigu zein izango den haien eraginkortasuna eta tokia zinemagintzan. Ahaleginak egingo dira hurrengo urteetan erabat ulertzeko matematika aplikatuaren gaitasuna industrian, eta hori bakarrik egin dezakete matematikan, konputazio zientzian eta fisikan oinarri sendoa duten ikertzaileek”.

Gehiago jakiteko:

- McAdams, S. Osher eta J. Teran, (201). Crashing waves, awesome explosions, turbulent smoke, and beyond: applied mathematics and scientific computing in the visual effects industry, Notices of the American Matematical Society 57(5).

- Khan Academyren Pixar in a box: Pixarreko langileek zer egiten duten azaltzen dute bideo laburretan, erabiltzen dituzten teknika matematikoak barne.

- Tony DeRose: The math behind the movies, TedEd hitzaldia; eta artikulu bat.

- Jos Stam: elkarrizketa bat.

- Joseph Teran eta Ronald Fedkiw irakasleen webguneetan informazio ugari aurki daiteke egin duten eta egiten ari diren lanari buruz, irudi eta bideoekin hornituta. Gomendagarriak dira, era berean, Alexey Stomakhin eta Jos Stamen webguneak.

——————————————-

Egileaz: Javier Duoandikoetxea Analisi Matematikoko Katedraduna da UPV/EHUn.

——————————————-

The post Oscarretarako bide matematikoa appeared first on Zientzia Kaiera.

La certeza de la incertidumbre en los informes del IPCC

El año 2018 fue el más caluroso de la historia moderna de la Tierra. Batió el récord de temperatura media global desbancando al año 2017, el cual había superado la espectacular marca del año 2016. El listón de temperaturas elevadas en nuestro planeta está llegando a límites, paradójicamente, escalofriantes. Los que seguimos – con preocupación – la evolución del clima global hemos observado cómo la Organización Meteorológica Mundial (OMM) ha ido informando que durante los últimos 22 años se han batido 20 récords de temperatura media. Y que esta tendencia va en aumento: la Tierra acumula 400 meses seguidos de temperaturas superiores a la media histórica, sumando más de 33 años consecutivos por encima de la referencia del siglo XX.

El cambio climático puede considerarse una certeza y ello supone una verdadera amenaza para el mundo que conocemos. Una amenaza que, además, todo indica que ha sido generada principalmente por la actividad industrial humana. El informe especial “Global Warming of 1,5 ºC” del IPCC, publicado a finales de 2018, no da lugar a dudas: estima que esta actividad ha aumentado la temperatura del planeta en aproximadamente 1ºC con respecto a los niveles preindustriales. En unos pocos decenios, la concentración de CO2 en la atmósfera ha aumentado más del 30%, superando los 400 ppm y batiendo el récord datado hace 3 millones de años. No se trata de una evolución natural del clima: la evidencia es abrumadora y el consenso de la comunidad científica es prácticamente unánime.

Sin embargo, así como el cambio climático pasado es avalado por el histórico de datos recogidos a lo largo del último siglo, para conocer el futuro de este no hay observación posible. Si queremos estimar los posibles escenarios a los que se enfrenta nuestro planeta, dependemos casi exclusivamente de modelos de simulación compleja, los cuales están compuestos por un conjunto de submodelos en continuo desarrollo por centros como la NASA, la UK Met Office, o el Beijing Climate Center.

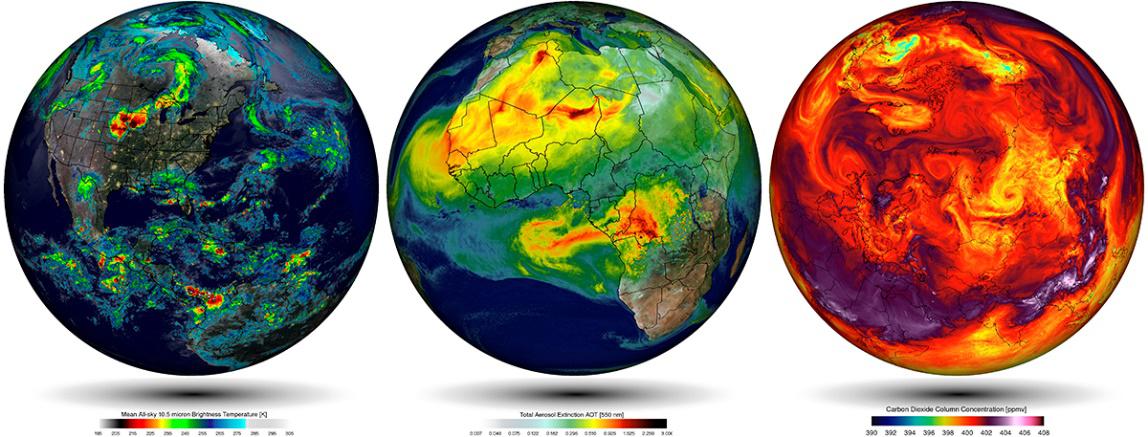

Simulaciones empleando el modelo climático del Goddard Earth Observing System (GEOS-5) de la NASA. Fuente: William Putman, NASA/Goddard

Simulaciones empleando el modelo climático del Goddard Earth Observing System (GEOS-5) de la NASA. Fuente: William Putman, NASA/GoddardEstas simulaciones se rigen por un corpus teórico introducido previamente. Por ejemplo, en el caso de las simulaciones atmosféricas este corpus es construido con (i) las leyes de movimiento de Newton aplicadas en elementos finitos de fluidos, (ii) la ley de la conservación de la masa, y (iii) ecuaciones termodinámicas que permiten calcular el efecto calorífico en cada parcela de aire a través de valores parametrizados de la radiación solar. Estas tres componentes se traducen en ecuaciones diferenciales parciales no-lineales de solución analítica irresoluble, por lo que se aplican métodos numéricos que discretizan las ecuaciones continuas y permiten determinar una aproximación a la solución de estas a través técnicas de modelización y simulación computacional.

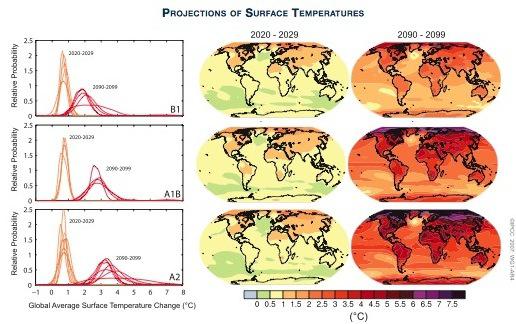

En conjunto con otros submodelos, como la simulación del ciclo del carbono o el movimiento tectónico, estas simulaciones se utilizan para construir posibles escenarios futuros, que son una herramienta utilizada para la toma de decisiones en política de mitigación o de adaptación medioambiental, ya sea en forma de monetización del carbón o de aplicación de estrategias de geoingeniería, por ejemplo. Sin embargo, a pesar de que los mecanismos que gobiernan el cambio climático antropogénico son bien entendidos, estas proyecciones presentan incertidumbre en la precisión de sus resultados. Su cuantificación es, precisamente, la principal herramienta para comunicar el (des)conocimiento de expertos a políticos.

La literatura especializada establece hasta siete fuentes de inseguridad epistémica que determinan el grado de incertidumbre: (a) la estructura de los modelos que sólo permiten describir un subconjunto de componentes e interacciones existentes, (b) aproximaciones numéricas, (c) resolución limitada que implica que los procesos de microescala tengan que ser parametrizados y, por tanto, tengan que describir su efecto − sin resolver realmente el proceso− en términos de cuantificaciones disponibles a gran escala, (d) variabilidad natural interna, (e) observación de datos, (f) condiciones iniciales y de contorno, y (g) escenario económico futuro. Todas estas fuentes de incertidumbre se derivan de la existencia de diferentes representaciones del clima para cada uno de los distintos modelos.

Fuente: Policymaker Summary of The Phisical Science Basis (4th IPCC Report)

Fuente: Policymaker Summary of The Phisical Science Basis (4th IPCC Report)

La primera impresión que genera esta incertidumbre en el público general es que el cambio climático es una hipótesis, de algún modo, incierta. Sin embargo, los modelos de incertidumbre presentados en los sucesivos informes del Grupo I del IPCC no se presentan para dilucidar si el cambio climático es incierto o no, sino para informar de la calidad de los modelos obtenidos y trasladar la toma de decisiones políticas fuera del proceso de obtención de resultados por parte de decenas de miles de científicos.

Parece claro que el futuro no podemos conocerlo a ciencia cierta y, como diría Zygmunt Bauman, la única certeza que tenemos es la incertidumbre. Ello no impide, sin embargo, que podamos estimar de forma más o menos robusta el futuro plausible que nos espera. Por ello, acompañar los resultados de las simulaciones con modelos probabilísticos de incertidumbre no es una muestra de debilidad, sino un instrumento que permite comunicar esas estimaciones de manera transparente, sin comprometer la investigación científica con cuestiones políticas, sociales o éticas. Se trata de una actividad que los científicos y el IPCC consideran como un ejemplo de rigor, a pesar de que haya mercaderes de la duda que la exploten como una debilidad. Y es que la certeza de la incertidumbre en los informes del IPCC consiste, paradójicamente, en que es la única forma disponible para hacer que las proyecciones del clima que nos espera sean lo más certeras posible.

Para saber más:

Winsberg, Eric (2018), Philosophy and Climate Science, New York: Cambridge University Press.

Sobre el autor: José Luis Granados Mateo es investigador predoctoral en Historia y Filosofía de la Ciencia en UPV/EHU.

El artículo La certeza de la incertidumbre en los informes del IPCC se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El clima, los informes y la política

- Migraciones…¿vegetales?

- ¿Una charla? ¿de ciencia?, prefiero el bar…

Zelan eragiten digu klima-aldaketak?

Aspaldi honetan denok sumatu dugu beroaldiak, hezeagoak, luzeagoak eta larriagoak direla. Hauek, klima-aldaketaren ondorioak dira. Beroaldi horiek are eta larriago eragiten diete aire zabalen lan egiten dutenei, kirolariei, haurrei, adinduei eta bihotzeko arazoak dituztenei ere. Baina, zehazki, zein arazo dakar muturreko beroak osasunarentzat?

Maiz egiten diren galderak ataleko bideoek labur eta modu entretenigarrian aurkeztu nahi dituzte, agian, noizbait egin ditugun galderak eta hauen erantzunak. Bideoak UPV/EHUko Kultura Zientifikoko Katedrak eginak daude eta zientzia jorratzen duen Órbita Laika (@orbitalaika_tve) telebista-programan eman dira gaztelaniaz.

The post Zelan eragiten digu klima-aldaketak? appeared first on Zientzia Kaiera.

La enfermedad del hígado graso no alcohólico, una gran desconocida

Jenifer Trepiana, Saioa Gómez-Zorita, María P. Portillo, Maitane González-Arceo

La enfermedad del hígado graso no alcohólico (EHGNA) consiste en una acumulación excesiva de grasa en las células del hígado o hepatocitos (más del 5% del peso del hígado sería grasa) sin un consumo excesivo de alcohol, siendo en la actualidad la causa más frecuente de enfermedad hepática (Ahmed, 2015). Puede presentarse como esteatosis (acumulación de grasa) simple o como esteatohepatitis, situación de mayor gravedad que comporta ya inflamación y un inicio de fibrosis.

La prevalencia de la esteatosis simple oscila entre un 14% y un 30% en la sociedad occidental, aunque es probable que sea mayor ya que como muchos pacientes son asintomáticos, en ocasiones no son diagnosticados (Abd El-Kader SM y El-Den Ashmawy EM, 2015).

¿Cómo se desarrolla la EHGNA?

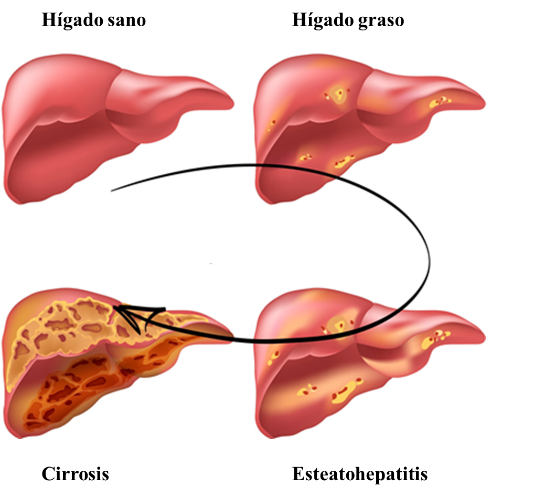

El hígado graso no alcohólico comprende numerosas lesiones hepáticas, comenzando con la esteatosis simple, que supone el 80-90% de los casos. Hay que destacar que el hígado graso no alcohólico se desarrolla de una manera progresiva y lenta, siendo la esteatosis simple reversible, y pudiendo dejar de progresar. Sin embargo, en el 10-20% de los pacientes avanza hasta la siguiente etapa llamada esteatohepatitis o inflamación del hígado. De la misma manera, la esteatohepatitis puede no seguir progresando o, por el contrario, puede evolucionar mediante la aparición de fibrosis a su etapa final, llamada cirrosis, con riesgo de desarrollar carcinoma de hígado en el peor de los casos (Hashimoto et al., 2013).

Lo que ocurre en la esteatosis simple, es que la excesiva acumulación de lípidos en el hígado lo hace vulnerable a otras agresiones como el estrés oxidativo, provocado por un desequilibrio entre los radicales libres y la disponibilidad de antioxidantes, además de promover la liberación de moléculas que producen inflamación provocando esteatohepatitis. En la esteatohepatitis, aparece inflamación y daño en las células de manera crónica que puede cursar con fibrosis (formación excesiva de un tejido llamado tejido conectivo para intentar reparar la víscera). Según estudios científicos, un 41% de los pacientes que sufren la EHGNA desarrollan fibrosis (Ekstedt et al., 2006). Por otra parte, el riesgo de padecer hepatocarcinoma en los pacientes con EHGNA que no sufren cirrosis es mínimo (de 0-3% en 20 años), mientras que en pacientes con cirrosis el riesgo asciende a 12,8% en 3 años (White et al., 2012).

Figura 1. Esquema de los estadios de la enfermedad del hígado graso. Modificado de: Non Alcoholic Fatty Liver Disease NAFLD. Preventicum (2016).

Figura 1. Esquema de los estadios de la enfermedad del hígado graso. Modificado de: Non Alcoholic Fatty Liver Disease NAFLD. Preventicum (2016).Al analizar la morfología del hígado de pacientes que sufren EHGNA tras una biopsia, se observa una acumulación de grasa en las células del hígado (hepatocitos) en forma de triglicéridos. Se ha aceptado que el criterio mínimo para diagnosticar la EHGNA mediante el estudio con microscopía de este órgano, es que el hígado contenga una cantidad mayor al 5% de hepatocitos esteatóticos (Neuschwander-Tetri y Caldwell, 2003), es decir que más de un 5% de las células del hígado contengan una gran cantidad de grasa en su interior. Así, mediante estas técnicas de imagen, se puede clasificar la EHGNA en diferentes tipos, desde una esteatosis simple, hasta esteatohepatitis con o sin fibrosis.

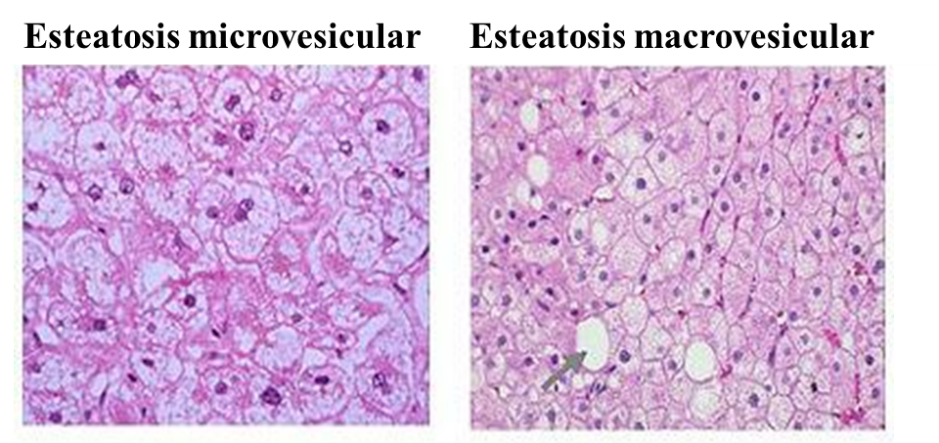

Centrándonos más en lo que le ocurre al hepatocito, podemos decir que normalmente, la esteatosis en el hígado graso no alcohólico, es de tipo macrovesicular. Esto es, que el hepatocito contiene una única gota grande de grasa, o varias gotas de grasa algo más pequeñas, lo que provoca el desplazamiento del núcleo de la célula a la periferia (extremos) del hepatocito. Sin embargo, en la esteatosis de tipo microvesicular, el núcleo se mantiene en el centro del hepatocito con diminutas gotículas de grasa presentes en la célula (Brunt y Tiniakos, 2010). Este último tipo, no suele ser la forma más típica de esteatosis, encontrándose sobre todo en los hepatocitos más pequeños o en los que no se encuentran en las zonas donde la esteatosis es más prominente. Cuando se da esta situación, el paciente suele tener peor pronóstico. En alguna ocasión, también puede ocurrir que se produzca una esteatosis mixta, donde se encuentran hepatocitos con una esteatosis macrovesicular, a la vez que encontramos grupos de hepatocitos con esteatosis microvesicular.

Figura 2. Esteatosis microvesicular y macrovesicular. Análisis mediante técnicas de imagen. Mofrad P, Sanyal, A. Nonalcoholic Fatty Liver Disease. Medscape (2003).

Figura 2. Esteatosis microvesicular y macrovesicular. Análisis mediante técnicas de imagen. Mofrad P, Sanyal, A. Nonalcoholic Fatty Liver Disease. Medscape (2003).

¿Qué factores influyen en el desarrollo de esta enfermedad?

El origen de la EHGNA no está claro, aunque probablemente sea la resistencia a la insulina la causa principal. Otros factores de riesgo asociados con el hígado graso son el sobrepeso y la obesidad, la dislipemia (altos niveles de colesterol y/o triglicéridos en sangre), y la diabetes mellitus tipo 2. Hay que tener en cuenta que la EHGNA afecta a todos los segmentos de la población, no solo a los adultos, y también a la mayoría de los grupos raciales. Se estima que entre el 74% y el 80% de los individuos obesos presentan hígado graso. Además de la obesidad, la presencia de diabetes mellitus tipo 2 incrementa no solo el riesgo, sino también la severidad de la EHGNA (Angulo, 2002). Esto quiere decir, que la diabetes mellitus tipo 2 constituye un perfil metabólicamente desfavorable para los pacientes que presentan EHGNA, aumentando el riesgo de sufrir enfermedades cardiovasculares.

¿Cómo se detecta la EHGNA?

Como hemos indicado al inicio, con mucha frecuencia, la EHGNA cursa de manera asintomática, y cuando produce síntomas estos son bastante inespecíficos. Por ello, muchas veces pasa desapercibida, tanto para los médicos como para los pacientes. El síntoma más frecuente es dolor en la zona abdominal derecha y fatiga.

Para la detección de la EHGNA, primeramente se suelen valorar las transaminasas hepáticas (AST, aspartatoaminotransferasa y ALT, alaninaaminotransferasa), que se suelen encontrar aumentadas. No obstante, aunque los niveles de transaminasas son lo primero que se analiza mediante una extracción de sangre del paciente, no son consideradas buenos marcadores ya que en algunos individuos con esteatosis los niveles de transaminasas en sangre no están elevados, incluso en algunos pacientes con cirrosis tampoco lo están. Además, solo pueden indicar daño hepático en general, no siempre teniendo que ir asociado a la EHGNA. Por otro lado, la AST aparece en otros tejidos como el corazón o el músculo esquelético, por lo que en caso de que se eleve, también puede deberse a una alteración en otros órganos o tejidos. También se recurre a técnicas de imagen para ayudar en el diagnóstico de la enfermedad o para la detección de hepatomegalia (hígado más grande de lo normal), como son la ecografía, TAC (Tomografía Axial Computarizada) o RMN (Resonancia Magnética), siendo esta última la más eficaz en su diagnóstico. Estas pruebas de imagen son útiles para saber si hay infiltración de grasa en el hígado, pero presentan la limitación de que no muestran si el hígado presenta inflamación o fibrosis.

Por ello, el mejor método de diagnóstico es la biopsia, que además permite conocer el grado de EHGNA del paciente. No obstante, dado que se trata de una técnica invasiva, únicamente se suele realizar en aquellos pacientes que muestran signos de estar en un estadio avanzado de enfermedad hepática (por ejemplo, cirrosis) o en aquellos pacientes que presentan mayor probabilidad de esteatohepatitis. Una limitación de esta técnica es que las lesiones hepáticas sufridas no son uniformes en todo el hígado, lo que dificulta el análisis de las biopsias. Es decir, según de qué zona del hígado se tome la muestra, el diagnóstico puede variar.

Ante la necesidad de detectar la EHGNA sin tener que recurrir a la biopsia hepática, se está profundizando en el estudio de biomarcadores para analizar la función hepática de una manera no agresiva para el organismo. Entre ellos encontramos marcadores específicos para la fibrosis, como la medición de concentraciones de proteínas implicadas en la fibrolisis o rotura del tejido fibrótico (colagenasas, α2-macoglobulina, MMPs, C3M) o de proteínas que participan en la fibrogénesis o generación del tejido fibrótico (colágeno tipo IV, pro-C3/C5). En la práctica clínica se suelen utilizar diversos test como el SteatoTest que calcula el grado de esteatosis hepática en pacientes con riesgo metabólico elevado, el FibroTest que valora los niveles de fibrosis y cirrosis, así como el grado de inflamación del hígado, y el NashTest que predice la presencia o ausencia de esteatohepatitis. Los marcadores que se analizan mediante estos tests son la α2-macroglobulina, haptoglobina, apolipoproteína A1, bilirrubina total, ALT, GGT, glucosa en ayunas, triglicéridos, y colesterol. Estos parámetros se ajustan a la edad, sexo, peso y tamaño del paciente. Estos índices y biomarcadores pueden ser útiles no solo para el diagnóstico de la enfermedad, sino también para estudiar la evolución de esta y los efectos del tratamiento.

¿Qué se puede hacer para prevenir la EHGNA?

Es importante remarcar que para la prevención de la EHGNA la principal medida es evitar los factores de riesgo asociados a la enfermedad (obesidad, dislipemia, resistencia a la insulina). Para ello son esenciales una rutina de ejercicio físico en nuestro día a día y llevar una dieta equilibrada.

Tratamientos en la actualidad

Actualmente, no existe un tratamiento específico para la EHGNA. Por ello, lo que se suele hacer es tratar los factores causales, es decir, la obesidad, y otros componentes del síndrome metabólico, como son la hipertensión (mediante el tratamiento farmacológico con estatinas), la diabetes mellitus y la dislipemia. Al igual que en el caso de la prevención, una dieta equilibrada y la actividad física serán los pilares básicos para tratar el hígado graso no alcohólico.

Además, se ha comprobado que seguir un patrón de alimentación mediterráneo se asocia con una menor probabilidad de presentar esteatosis y esteatohepatitis (Aller et al., 2015).

Recomendaciones en el estilo de vida

-

Pérdida de peso: 3-5% en la esteatosis simple y 7-10% en la esteatohepatitis (Jeznach-Steinhagen et al., 2019).

-

Reducción del consumo de hidratos de carbono simples (

-

Reducción de la grasa saturada de la dieta. Una dieta rica en grasas saturadas, intensifica el estrés oxidativo en el organismo, aumentando la inflamación en la zona afectada por la esteatosis. Sin embargo, el consumo de ácidos grasos poliinsaturados del grupo n-3 (omega 3) mejora la esteatosis hepática (Dasarathy et al., 2015).

-

Aumento del consumo de antioxidantes, presentes en altas cantidades en frutas y verduras.

-

Evitar la cantidad de alcohol ingerida. Dado que un abuso del alcohol provoca un desarrollo rápido de la enfermedad, se recomienda la abstinencia del alcohol.

Tratamientos farmacológicos

Como se ha mencionado anteriormente, algunos tratamientos farmacológicos están dirigidos a reducir las enfermedades asociadas al hígado graso, como son la diabetes, obesidad, y desordenes lipídicos.

-

Suplementación con vitaminas, especialmente aquellas que son antioxidantes como la vitamina E (precaución con las dosis elevadas ya que pueden tener efectos secundarios graves). Debido a la dosis empleada la vitamina E o α-tocoferol se incluye dentro de los tratamientos farmacológicos para tratar esta enfermedad.

-

Fármacos antidiabéticos: pioglitazone, rosiglitazona, liraglutide, metformina, etc. (al igual que en el caso anterior pueden tener efectos secundarios).

En la actualidad están siendo probados en diversos ensayos clínicos fármacos novedosos como el agonista del receptor Farnesoil X, o el agonista de PPARα y PPARδ (estudios en fase 2).

Referencias bibliográficas

Ahmed M. Non-alcoholic fatty liver disease in 2015. World J Hepatol. 18;7(11):1450-9 (2015).

Abd El-Kader SM, El-Den Ashmawy EM. Non-alcoholic fatty liver disease: The diagnosis and management. World J Hepatol. 28;7 (6):846-58 (2015).

Hashimoto E, Taniai M, Tokushige K. Characteristics and diagnosis of NAFLD/NASH. J Gastroenterol Hepatol. 28 Suppl 4:64-70 (2013).

Non Alcoholic Fatty Liver Disease NAFLD. Preventicum (2016).