¿Es el número 13 un número nefasto?

En la anterior entrada del Cuaderno de Cultura Científica titulada Propiedades matemáticas del número 13 iniciamos una pequeña serie, de dos entradas, sobre un número que causa miedo o rechazo entre muchas personas, aunque para muchas otras es un número de la suerte, el número 13.

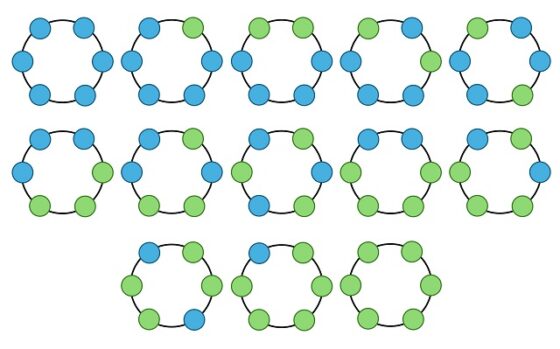

Esa primera entrada la dedicamos a las propiedades matemáticas del número trece, que como se comentaba, es un número primo, miembro de la famosa sucesión de Fibonacci, solución al problema de los collares de dos colores, un número poligonal centrado, perteneciente a dos ternas pitagóricas e incluso a las familias de los números felices y los de la suerte, entre otras propiedades.

La solución al problema de los collares (o pulseras) para 6 cuentas (de dos colores distintos) es 13

La solución al problema de los collares (o pulseras) para 6 cuentas (de dos colores distintos) es 13

Esta segunda entrada la vamos a centrar en las supersticiones, creencias y miedos alrededor del número 13, un número que increíblemente ha sido eliminado de la numeración de los pisos de los hoteles, de las filas de los aviones o de las calles de algunas poblaciones, pero que también se ha considerado por muchas personas como un número de buena suerte.

Triscaidecafobia

Aunque este término no esté recogido en el Diccionario de la Real Academia Española, la triscaidecafobia es el miedo irracional al número 13. De hecho, esta palabra se deriva de las palabras griegas treiskaideka, “trece”, o más concretamente “tres y diez”, y fobia, “miedo” o “temor”. También se suelen utilizar los términos tredecafobia o tridecafobia, aunque son menos habituales que el anterior.

La superstición alrededor del número 13 es lo que ha provocado que muchos hoteles y edificios a lo largo del mundo, con más de trece plantas, hayan decidido eliminar la planta 13 de los mismos, como los hoteles Waldorf Astoria o The Plaza en Nueva York (EE.UU.), o el rascacielos londinense One Canada Square.

La triscadecafobia estaba muy extendida en Estados Unidos a finales del siglo XIX y principios del XX, época en la que se empezaron a construir los rascacielos. Tanto las constructoras, como los hoteles, se dieron cuenta que era más difícil vender o alquilar un piso situado en la planta número 13, o que los clientes de un hotel quisieran reservar una habitación en esa planta. Como el dinero manda, rápidamente se empezó a no incluir la denominación de planta 13 en muchos rascacielos, que pasaban directamente de la planta 12 a la planta 14.

Cuadro de botones de un ascensor de un edificio en el que no hay planta 13, luego tampoco botón en el ascensor para la misma

Cuadro de botones de un ascensor de un edificio en el que no hay planta 13, luego tampoco botón en el ascensor para la misma

Por supuesto, la planta número 13 en estos rascacielos sí existe, solo se ha suprimido el nombre “planta 13”, se ha sustituido por el nombre “planta 14” y se han trasladado los nombres de las demás plantas, pero eso parece que calma a los que sufren de triscaidecafobia.

Pero la triscaidecafobia no se manifiesta solo en los hoteles. Muchas ciudades del mundo han eliminado el número 13 de algunas sus calles. Por ejemplo, varias de las calles de Londres no tienen portal número 13, entre ellas Fleet Street, Oxford Street, Park Lane, Praed Street, St James’s Street, Haymarket y Grosvenor Street, según se menciona en el libro London The Biography (2000), del escritor y crítico británico Peter Ackroyd. Además, según el sitio web inmobiliario británico Zoopla, las casas cuyo número es el 13 son más baratas que sus vecinas con números 11, 12, 14 o 15 (de media una cantidad de 4.500 euros, según un estudio publicado en 2011, que serían unos 6.500 euros en la actualidad). Dicho estudio dice más aún, comenta que el 28% de las calles de Gran Bretaña no tienen el temido número 13. Siguiendo con Londres, podemos comentar que la famosa atracción turística London Eye, la noria más alta de Europa, posee 32 cápsulas, numeradas entre 1 y 33, ya que, una vez más, se ha eliminado el número 13.

La atracción turística London Eye, al lado del río Támesis, en Londres. Fotografía de Khamtran

La atracción turística London Eye, al lado del río Támesis, en Londres. Fotografía de KhamtranMedios de transporte

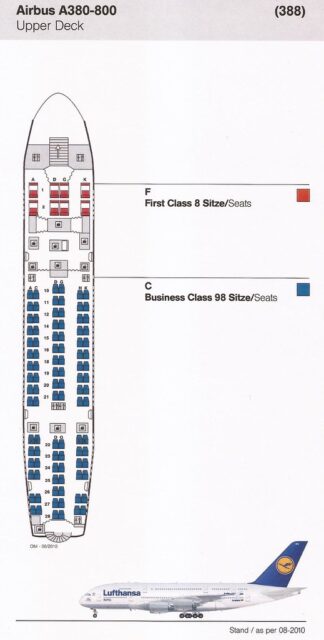

Pero los rascacielos o las calles de las ciudades no son los únicos ejemplos en los cuales se ha eliminado el odiado número 13. Muchas compañías aéreas han suprimido la fila 13 de sus aviones para evitar el malestar de sus clientes supersticiosos, como la aerolínea francesa Air France, la aerolínea estadounidense United Airlines, la británica British Airways o la española Iberia, entre muchas otras, como la aerolínea alemana Lufthansa que no solo ha eliminado esta fila, sino también la fila 17, ya que el número 17 también es considerado nefasto en Italia.

Dibujo del interior de un avión AIRBUS de la compañía Luftansa, en el que puede apreciarse que no hay fila 13, se pasa de la fila 12 a la fila 14

Dibujo del interior de un avión AIRBUS de la compañía Luftansa, en el que puede apreciarse que no hay fila 13, se pasa de la fila 12 a la fila 14

Pero podemos hablar de otros medios de transporte. Por ejemplo, la empresa de transporte público de Madrid, la EMT (Empresa Municipal de Transportes de Madrid), que tiene más de doscientas líneas de autobuses, no tiene precisamente la línea 13 entre ellas. Entre las líneas 1 (Cristo Rey – Prosperidad) y 100 (Moratalaz – Valderrivas), están todos los números incluidos, salvo el número 13. Se pasa de la línea 12 a la línea 14. Aunque, el 23 de junio de 2011, de forma puntual y con motivo de la celebración de un festival internacional de magia, circuló un autobús con el número 13 (conocido como la “línea mágica”) con un recorrido circular alrededor del Retiro llevando a magos que iban realizando trucos de magia a lo largo de su recorrido.

En Madrid no hay línea 13 de autobuses, aunque durante un día, el 23 de junio de 2011, circuló un bus mágico, con magos realizando trucos de magia, que llevó el número 13

En Madrid no hay línea 13 de autobuses, aunque durante un día, el 23 de junio de 2011, circuló un bus mágico, con magos realizando trucos de magia, que llevó el número 13

Siguiendo con Madrid, en la actualidad existen doce líneas de metro, entre la línea 1, azul claro (Pinar de Chamartín – Valdecarros), y la línea 12, dorado (circular). Como se explica en el artículo Así sería la línea 14 del Metro de Madrid: el trayecto fantasma que nunca fue, publicado por el periódico El Español (enero, 2024), en 2003 se planeó, con la apertura de Metrosur, la creación de la línea 14 del Metro de Madrid que conectaba la capital con Alcorcón, Móstoles, Leganés, Getafe y Fuenlabrada. De esta forma se saltaba de la línea 12 a la línea 14. Sin embargo, esta línea se quedó en proyecto y nunca se realizó. En diferentes medios se ha hablado de la construcción de nuevas líneas, en particular de la línea 13, pero ya veremos que nombre recibe cuando se haya construido.

Superstición en la Fórmula 1

Preparando esta entrada he descubierto que en la Fórmula 1 no se utiliza el número 13. En las competiciones de Fórmula 1 los coches se identifican con un número entre 2 y 99, pero ya no se utiliza el número 13. En el pasado sí se utilizó este número, pero se produjeron dos accidentes mortales en años consecutivos de pilotos que conducían coches con el número 13, el belga Paul Torchy en 1925 y el italiano Giulio Masetti en 1926, que tuvieron como consecuencia que se dejase de utilizar el nefasto 13.

En el artículo La maldición del número 13 en la Fórmula 1, publicado en el periódico deportivo MARCA (noviembre 2024), se comenta que desde entonces solo se ha utilizado en cuatro ocasiones. El piloto alemán Mauritz von Strachwiz en la clasificación del Gran Premio de Alemania de 1953, pero no consiguió la clasificación. El piloto mexicano Moisés Solana, en su debut en el Gran Premio de México de 1963, que terminó en el puesto 11, a pesar de que su coche tuvo problemas y acabó quemándose a falta de ocho vueltas. Por su parte, la piloto británica Divina Galica utilizó el número 13 en su coche para el Gran Premio de Gran Bretaña de 1976, pero tampoco consiguió clasificarse. Y, por su parte, el piloto venezolano Pastor Maldonado utilizó el número 13 durante las temporadas de 2014 y 2015, aunque no tuvo mucha suerte, ya que tuvo 28 abandonos, 16 de los cuales fueron con el dorsal 13 en su coche. Desde entonces ningún piloto ha vuelto a utilizar este número.

Fotografía del accidente del coche, con el número 13, conducido por el piloto Paul Torchy durante el Gran Premio de San Sebastián de 1925, en el que falleció el piloto. Fotografía del libro Circuito de Lasarte. Memorias de una pasión, de Ángel Elberdin

Fotografía del accidente del coche, con el número 13, conducido por el piloto Paul Torchy durante el Gran Premio de San Sebastián de 1925, en el que falleció el piloto. Fotografía del libro Circuito de Lasarte. Memorias de una pasión, de Ángel ElberdinEl documento nacional de identidad

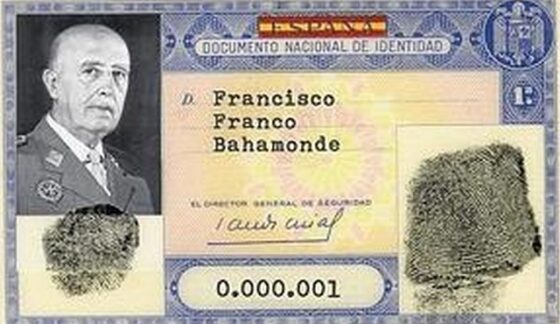

La superstición también es el motivo por el cual no existe el documento nacional de identidad con el número 13, como ya explicamos en la entrada Un código detector de errores: la letra del DNI. Cuando se creó el documento nacional de identidad, en tiempos del dictador Francisco Franco (1892-1975), este se quedó con el número 1, su mujer Carmen Polo con el número 2 y su hija Carmen Franco el número 3. Por su parte, la familia real tiene reservados los números que van del 10 al 99. El rey emérito Juan Carlos I tiene el 10 y la reina Sofía el 11. Las infantas Elena y Cristina tienen el 12 y el 14, el rey Felipe VI tiene el número de DNI 15, la princesa Leonor el 16 y la infanta Sofía el 17. Se saltaron el 13, seguramente por motivos supersticiosos.

Documento Nacional de Identidad del dictador español Francisco Franco con el número 1

Documento Nacional de Identidad del dictador español Francisco Franco con el número 1El origen de la superstición

Podemos preguntarnos por el origen de la superstición que existe alrededor del número 13, el motivo por el cual se considera que es un número de mala suerte, que causa rechazo e incluso miedo entre muchas personas.

Aunque no está claro cuál es este origen, pero podemos aportar algunos elementos que podrían estar relacionados con el mismo.

Por una parte, los calendarios lunisolares son calendarios que utilizan tanto el ciclo lunar, para establecer la duración de los meses (el ciclo lunar es de 29,5 días), como el ciclo solar para establecer la duración del año (que recordemos que es de 365,25 días). Si dividimos 365,25 entre 29,5 nos da 12,38, motivo por el cual en el calendario lunisolar un año tiene 12 o 13 meses. En concreto, suelen tener 12 meses (a la repetición de doce meses lunares se le llama año lunar), pero a algunos años se les añade otro mes, el 13, para ajustarse a los años solares y compensar el déficit.

Por ejemplo, así ocurría en los calendarios lunisolares de los sumerios y babilonios en Mesopotamia (sobre el III milenio a.n.e.) o en el calendario chino (sobre el siglo XIV a.n.e.), entre otros. Lo cual hacía que ese mes decimotercero fuera especial, así como los años que lo contenían, como ocurre hoy en día con los años bisiestos, y el 29 de febrero. Aunque esto hace que ese mes 13 sea un mes especial, pero no necesariamente que se considere nefasto, pudiendo incluso ser considerado favorable.

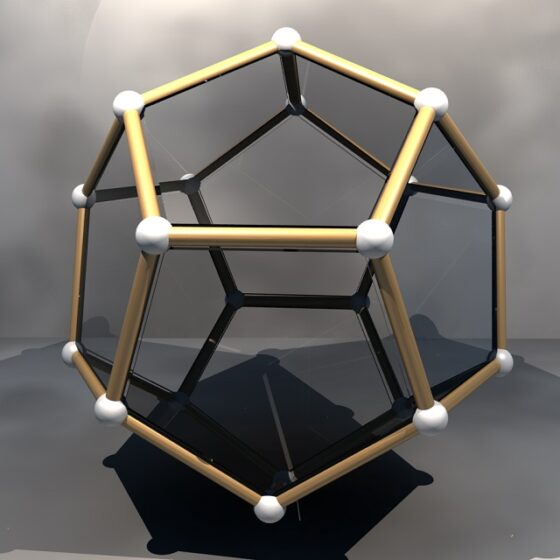

El dodecaedro es uno de los cinco sólidos platónicos, que, según el filósofo griego Platón (siglos V-IV, a.n.e.), fue utilizado para crear el universo. Imagen de KoenB

El dodecaedro es uno de los cinco sólidos platónicos, que, según el filósofo griego Platón (siglos V-IV, a.n.e.), fue utilizado para crear el universo. Imagen de KoenB

Algunos autores hablan de que el número 13 (que es un número primo) tenía una connotación negativa desde la antigüedad por ser el número que seguía al 12 (número con muchos divisores, 2, 3, 4, 6), un número considerado perfecto, muy utilizado en diferentes culturas y con connotaciones positivas (sobre este número podéis leer la entrada El sistema duodecimal, o si los humanos hubiésemos tenido seis dedos en las manos).

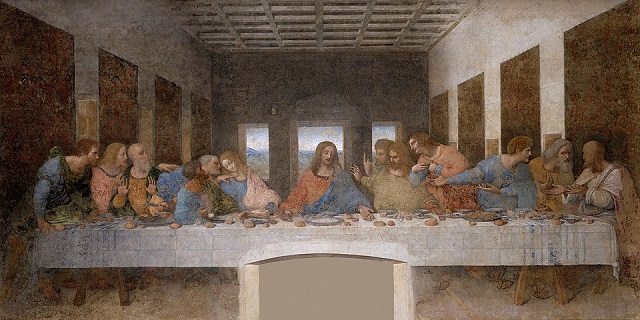

Pero normalmente la relación del 13 con la mala suerte se asocia con la última cena, de Jesús y sus doce apóstoles. Resulta que el apóstol Judas Iscariote, que llegó en último lugar siendo el comensal número 13 a la mesa, fue el que traicionó a Jesús. De ahí que se considere de mala suerte que haya 13 personas en una misma mesa. También dentro del cristianismo nos encontramos que el capítulo 13 del Apocalipsis de San Juan es el dedicado a la bestia del apocalipsis (anticristo).

La última cena (1495-1498), del polímata italiano (de la ciudad-estado de Florencia) Leonardo da Vinci (1452-1519)

La última cena (1495-1498), del polímata italiano (de la ciudad-estado de Florencia) Leonardo da Vinci (1452-1519)

Curiosamente, el dios nórdico Loki, que estaba resentido con los demás dioses, fue el invitado número 13 en llegar a un banquete en el Valhala y engañó a otro invitado para que matara al dios Baldur, segundo hijo del dios Odín, el dios principal de la mitología nórdica. Además, la carta 13 del Tarot es la muerte.

Sentarse a la misma mesa

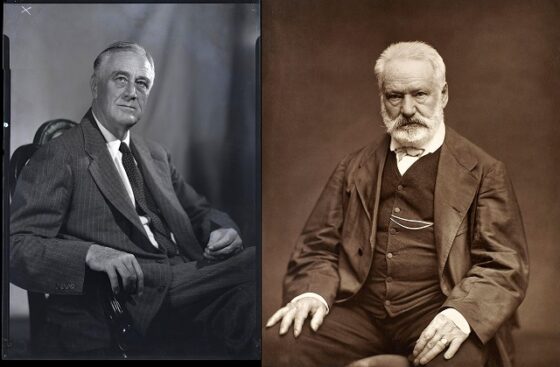

Hay muchas personas supersticiosas que no se sientan a una mesa si el número de comensales es 13. Por ejemplo, el que fuera presidente número 32 de los Estados Unidos de América, Franklin D. Roosevelt (1882-1945), era muy supersticioso, nunca viajaba el día 13 de cualquier mes, ni se sentaba a una mesa en la que hubiese 13 comensales. La secretaria personal de Roosevelt, Grace Tully (1900-1984), en su biografía sobre el presidente de los Estados Unidos, FDR: My Boss / FDR: Mi Jefe (1949), lo explicaba así:

El Jefe era supersticioso, especialmente con el número trece y la costumbre de encender tres cigarrillos con una sola cerilla. En varias ocasiones recibí invitaciones de última hora para asistir a un almuerzo o una cena porque una baja de última hora o una incorporación tardía había hecho que la lista de invitados pasase a trece.

Fotografías del político estadounidense Franklin D. Roosevelt, durante una campaña electoral de 1944 (fotografía del fotógrafo estadounidense Leon Perskie), y del escritor francés Victor Hugo en 1876 (fotografía del periodista y fotógrafo francés Étienne Carjat), ambos muy supersticiosos con el número 13 y el número de comensales en una mesa

Fotografías del político estadounidense Franklin D. Roosevelt, durante una campaña electoral de 1944 (fotografía del fotógrafo estadounidense Leon Perskie), y del escritor francés Victor Hugo en 1876 (fotografía del periodista y fotógrafo francés Étienne Carjat), ambos muy supersticiosos con el número 13 y el número de comensales en una mesa

Otro presidente de Estados Unidos que también padecía de triscadecafobia era el presidente Herbert C. Hoover (1874-1964), presidente número 31.

El escritor francés Victor Hugo (1802-1885), autor de Los Miserables (1862), también era una persona supersticiosa, que no se sentaba a una mesa con 13 comensales. De hecho, el escritor francés Richard Lesclide (1825-1892), quien fuera secretario de Victor Hugo durante sus últimos diez años de vida, menciona esta superstición en el libro de recuerdos Propos de table de Victor Hugo / Comentarios de mesa de Victor Hugo, 1885:

La única superstición que Victor Hugo confiesa es la que le impide reunir a trece personas en su mesa, incluyéndose a sí mismo. No discute la cuestión; cuenta multitud de casos y circunstancias en los que el número trece ha sido fatal para él y para sus hijos. Como es muy fácil ser doce o catorce a la mesa, es habitual no sentarse trece a cenar.

Cuando, de improviso, por casualidad, se alcanza el número desafortunado, se hace cenar a los niños en una mesa pequeña, lo que no siempre les divierte.

Otro escritor con una relación complicada con el sexto número primo es el escritor de terror estadounidense Stephen King (1947), quien en unas declaraciones afirmó lo siguiente:

El número 13 nunca deja de recorrerme la espalda, arriba y abajo, con su frío dedo. Cuando escribo, nunca dejo de trabajar si la página es la número 13 o un múltiplo de 13; sigo escribiendo hasta llegar a un número seguro. Siempre doy los dos últimos pasos de la escalera trasera como uno solo, convirtiendo el 13 en 12. Al fin y al cabo, hasta 1900 más o menos, la horca inglesa tenía 13 peldaños. Cuando leo, no me detengo en las páginas 94, 193 o 382, ya que la suma de estos números da 13.

Parece ser que Napoleón Bonaparte también tenía triscaidecafobia y nunca iniciaba un viaje o programaba eventos importantes en viernes, y sobre todo en viernes 13.

El Club del Trece

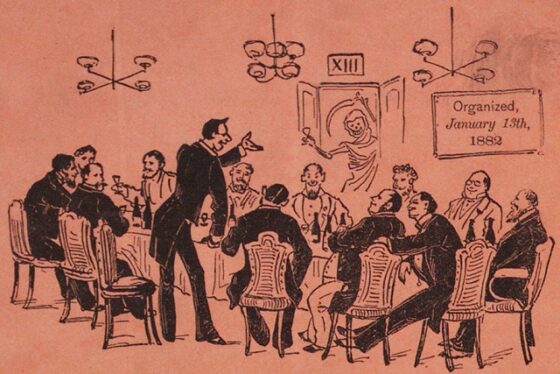

Mientras que el presidente número 32 de los Estados Unidos de América, Franklin D. Roosevelt, era muy supersticioso, su primo lejano Theodore Roosevelt (1858-1919), presidente 26 de los Estados Unidos de América, era todo lo contrario. De hecho, formó parte de un curioso club, El club del trece (The Thirteen Club), que tenía como objetivo combatir la superstición relacionada con este número.

Ilustración de la primera reunión del Club del trece, que tuvo lugar el viernes 13 de enero de 1882, a las 20:13, en la habitación número 13 del Knickerbocker Cottage (Manhattan, Nueva York)

Ilustración de la primera reunión del Club del trece, que tuvo lugar el viernes 13 de enero de 1882, a las 20:13, en la habitación número 13 del Knickerbocker Cottage (Manhattan, Nueva York)

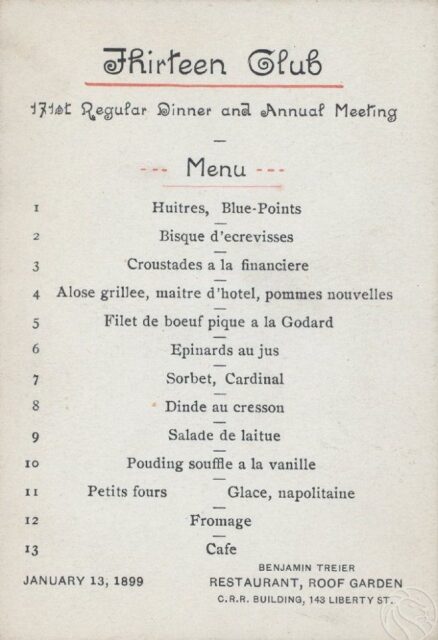

El viernes 13 de enero de 1882, a las 20:13, en la habitación número 13 del Knickerbocker Cottage (Manhattan, Nueva York) tuvo lugar la primera reunión fundacional de El Club del trece (The Thirteen Club), organizada por el capitán William Fowler (1827-1897), en la que se reunieron los trece primeros miembros de este club. En el artículo Friggatriskaidekaphobes Need Not Apply / Los friggatriscaidecafobicos no necesitan postularse (2012), publicado en la web The New York Historical, se menciona que los invitados, para llegar a la mesa, tuvieron que pasar por debajo de una escalera y bajo un cartel que decía “Morituri te Salutamus” (es decir, los que vamos a morir te saludamos). Trece velas iluminaban la mesa sobre la que se sirvieron los trece platos que formaban parte del menú de esa noche. Los saleros yacían volcados sobre la mesa, pero estaba estrictamente prohibido echar una pizca de sal derramada por encima del hombro. Y los discursos durante la cena se limitaron a 13 minutos. A partir de entonces, todos los 13 de enero se celebró la cena anual de El Club del trece en la habitación 13 del Knickerbocker Cottage.

El segundo año, 1883, el Club ya contaba con 169 miembros (que recordemos que es 13 veces 13, 13 x 13 = 169). El club fue creciendo, por ejemplo, en 1887 ya contaba con 487 miembros. Entre sus miembros más famosos han estado cuatro presidentes de los Estados Unidos, presidente 21, Chester Arthur (1829-1886), presidente 22 y 24, Grover Cleveland (1837-1908), presidente 23, Benjamin Harrison (1833-1901) y el presidente 26, Theodore Roosevelt.

El menú de la cena anual de El Club del trece de 1899

El menú de la cena anual de El Club del trece de 1899

Poco a poco se fue extendiendo la idea de El Club del trece y se abrieron clubs similares en Chicago, Londres o París, entre otros sitios. El club es sus inicios estaba formado únicamente por hombres, aunque sus miembros empezaron a animar a las mujeres a participar en algunas celebraciones especiales (aunque bajo su idea de que las mujeres eran “el sexo más supersticioso”). Finalmente, las mujeres acabaron formando sus propios clubs del trece.

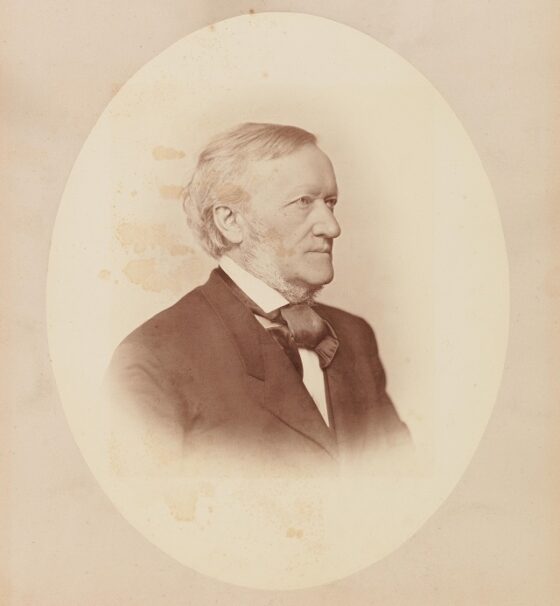

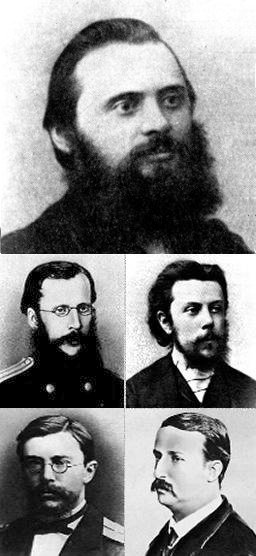

El compositor Richard Wagner

No sabemos si el compositor, director de orquesta y escritor alemán Richard Wagner (1813-1883) tenía miedo del número 13, lo consideraba un número de la suerte o le era indiferente, lo que sí sabemos, como he podido leer en el tercer volumen de los Mathematical Circles / Círculos matemáticos, del matemático y divulgador estadounidense Howard W. Eves (1911-2004), es que el compositor alemán tenía una relación especial con este número.

Fotografía del compositor alemán Richard Wagner tomada en 1870 por el fotógrafo alemán Josef Albert (1825-1886)

Fotografía del compositor alemán Richard Wagner tomada en 1870 por el fotógrafo alemán Josef Albert (1825-1886)

Su nombre, Richard Wagner, tiene doce letras; nació en 1813, que además de ser el año 13 del siglo xix, sus dígitos suman 13, 1 + 8+ 1 + 3 = 13; compuso 13 óperas, entre ellas Tristán e Isolda (1865), El anillo del Nibelungo (1876) o Tannhäuser, que Wagner terminó el 13 de abril de 1845 y su estreno (de la versión revisada) fue el 13 de marzo de 1861, en París; otra de sus grandes óperas Parsifal (1882), la acabó el 13 de enero de 1882; su ópera La valquiria (1870) se estrenó el 26 de junio de 1870, siendo 26 el doble de 13; el Festival de Bayreuth (Alemania) dedicado a las óperas del compositor Richard Wagner, y que él mismo diseñó y promovió, fue inaugurado el 13 de agosto de 1876 con la representación completa de El anillo del Nibelungo; finalmente, Richard Wagner murió el 13 de febrero de 1883.

Un número de la suerte

Aunque el número 13 es considerado, por muchas personas, como un número nefasto, también hay quienes consideran que es un número que transmite buena suerte.

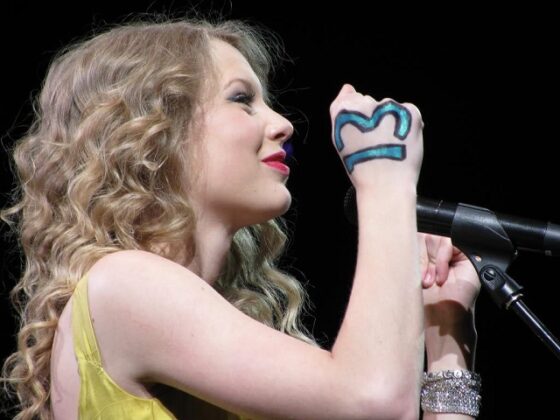

Como comentábamos en nuestra anterior entrada sobre el número XIII la cantante estadounidense Taylor Swift (1989) considera este es un número de la suerte que ha estado presente en momentos muy importantes de su vida, desde su nacimiento, el 13 de diciembre. Esto empezó a ser público cuando en su tour de 2009/2010, que precisamente se llamaba Fearless Tour / Tour sin miedo, la artista se pintó el número 13 en su mano. Cuando le preguntaron sobre esta cuestión, Swift contestó:

El significado del número 13 en mi mano… Me lo pinto en la mano antes de cada concierto porque el 13 es mi número de la suerte, por muchas razones. Es muy curioso.

Nací un día 13. Cumplí 13 años un viernes 13. Mi primer álbum fue disco de oro en 13 semanas. Mi primera canción que fue número uno tenía una introducción de 13 segundos. Cada vez que he ganado un premio, me han sentado en el asiento 13, en la fila 13, en la sección 13 o en la fila M, que es la decimotercera letra.

Su relación con el trece ha ido creciendo desde entonces. En una conversación publicada entre Taylor Swift y el músico británico Paul MacCartney, miembro de los Beatles, la cantante afirma “Me encantan los números. Los números gobiernan todo mi mundo. Los números 13, … 89 es uno importante. Hay otros que me parecen…”.

Incluso el simétrico de 13, es decir, 31, es importante para ella. Cuando cumplió 31 años, el 13 de diciembre de 2020, escribió en una red social “Desde que tenía 13 años, me emocionaba cumplir 31 porque es mi número de la suerte al revés, por eso quería sorprenderos con esto ahora”. Se estaba refiriendo a su álbum Evermore (2020) que acababa de publicar, pocos meses después de su anterior álbum Folklore (2020), el primero con 16 canciones y el segundo con 15 canciones, en total, 31 temas para el año 2020.

Su pasión por el número 13 ha seguido aumentando con el paso del tiempo.

Aunque el número 13 suele asociarse con la mala suerte en el deporte, también hay quienes lo consideran un número favorable, como el exjugador profesional de fútbol americano Dan Marino (1961) que lució el número 13 tanto en la Universidad de Pittsburg en sus años universitarios, como en su exitosa carrera profesional en los Miami Dolphins, de hecho, además de todos sus records y premios, es uno de los jugadores que está en el Salón de la Fama de la NFL. Otro ejemplo, es el jugador de fútbol alemán Gerd Müller (), jugador del Bayern de Múnich, que lució el número 13 jugando con la selección alemana, en particular en el Mundial de 1970 (en el que fue el máximo goleador del torneo), la Eurocopa de 1972 (en el que Alemania se proclamó ganadora) y el Mundial de 1974 (que también ganó Alemania).

Pero no solo hay personas que consideran que el 13 es un número de la suerte, también en distintos países, sociedades y culturas. Por ejemplo, el número 13 no es visto con miedo en China. Su significado es muy positivo. En el idioma mandarín, la pronunciación del 13 (shí sān) se asemeja a las palabras para “definitivamente vibrante” o “crecimiento asegurado”, lo que lo convierte en un número asociado a la prosperidad y el éxito. Por esta razón, no es raro ver el 13 en direcciones, teléfonos o incluso en el precio de productos.

En el Tibet no solo se considera al 13 como un número afortunado, más aún es un número sagrado. En la antigua cosmogonía tibetana se consideraba que el cielo estaba compuesto de 13 capas, siendo la última capa, la número 13, la asociada con la pureza espiritual. Además, los budistas tibetanos realizar la Kora (peregrinación) alrededor del monte sagrado Kailash trece veces es un ritual que purifica los pecados y trae felicidad y fortuna.

Para los budistas tibetanos, realizar la Kora (una peregrinación ritual) alrededor del monte Kailash, una montaña sagrada, 13 veces es una práctica de gran devoción. Se cree que completar este ritual purifica los pecados y trae una gran felicidad y fortuna.

Bibliografía:

1.- R. Ibáñez, La gran familia de los números, Libros de la Catarata, 2021.

2.- Alicia Bonilla, Así sería la línea 14 del Metro de Madrid: el trayecto fantasma que nunca fue, El Español, 2024.

3.- Javier Pazos, La maldición del número 13 en la Fórmula 1, MARCA, 2024.

4.- Ángel Elberdin, Circuito de Lasarte. Memorias de una pasión, Kutxa, 1998.

5.- Lamberto García del Cid, Números notables, el 0, el 666 y otras bestias numéricas, El mundo es matemático, RBA, 2010.

6.- Five Men Who Hated (or Loved) the Number 13, Smithsonian Magazine, 2012.

7.- Joseph Ditta, Friggatriskaidekaphobes Need Not Apply, New York Historical, 2012.

8.- Clara Giaimo, The 1880s Supper Club That Loved Bad Luck, Atlas Obscura, 2017.

9.- Howard H. Eves, Mathematical Circles, vol. 3, The Mathematical Association of America (MAA), 2003.

10.- Joyann Jeffrey, MC Suhocki, Ariana Brockington, The full history of Taylor Swift and her ‘lucky number’ 13, TODAY, 2024.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo ¿Es el número 13 un número nefasto? se ha escrito en Cuaderno de Cultura Científica.

El misterio de la materia oscura: ANAIS y COSINE desafían la señal de DAMA/LIBRA

La materia oscura, uno de los mayores enigmas de la cosmología moderna, no emite ni absorbe luz, lo que la hace invisible a nuestros telescopios. Sin embargo, los astrónomos estiman que constituye cerca del 85 % de la materia del universo, deduciendo su existencia por sus efectos gravitacionales en la rotación de galaxias, la formación de cúmulos y la distribución de materia a gran escala.

Durante décadas, los científicos han intentado detectar partículas de materia oscura mediante experimentos que buscan señales de colisiones con núcleos atómicos en detectores ultrasensibles. Sin embargo, un análisis conjunto de los experimentos ANAIS-112 (España) y COSINE-100 (Corea del Sur) ha desafiado la única señal persistente que, hasta ahora, parecía indicar una detección directa: la reportada por el experimento DAMA/LIBRA.

Fuente: ESO/M. Kornmesser, CC BY 4.0 / Wikimedia Commons

El caso DAMA/LIBRA y su enigmática variación anual

Fuente: ESO/M. Kornmesser, CC BY 4.0 / Wikimedia Commons

El caso DAMA/LIBRA y su enigmática variación anual

En 1997, el experimento DAMA/NaI, sucedido por su versión mejorada DAMA/LIBRA, reportó un hallazgo intrigante. Usando cristales de ioduro de sodio (NaI) en un laboratorio subterráneo para minimizar la interferencia de rayos cósmicos, ambos detectaron una variación estacional en la tasa de eventos: un aumento en verano y una disminución en invierno.

Esta oscilación, conocida como modulación anual, parecía consistente con la hipótesis de que la Tierra, al orbitar el Sol, atraviesa un “viento” de materia oscura que rodea nuestra galaxia. En ciertos meses, el movimiento de la Tierra se alinea con el del Sol, aumentando el flujo de partículas de materia oscura que impactan el detector; en otros, el efecto se reduce. Durante más de dos décadas, esta señal se mantuvo estable, llevando a algunos físicos a considerarla la primera detección directa de materia oscura.

Sin embargo, otros experimentos, que empleaban materiales y técnicas distintas, no encontraron señales compatibles. Esto generó escepticismo en la comunidad científica, que comenzó a sospechar que la modulación de DAMA/LIBRA podría deberse a un efecto ambiental o instrumental no identificado.

La réplica de ANAIS-112 y COSINE-100

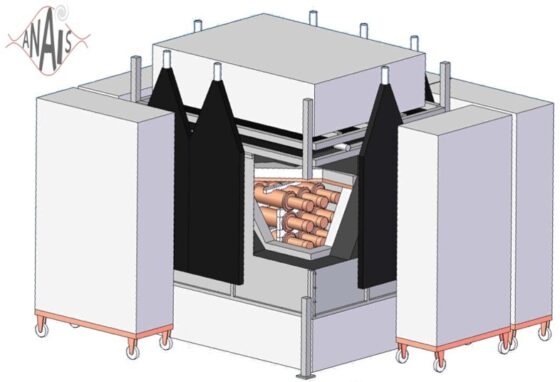

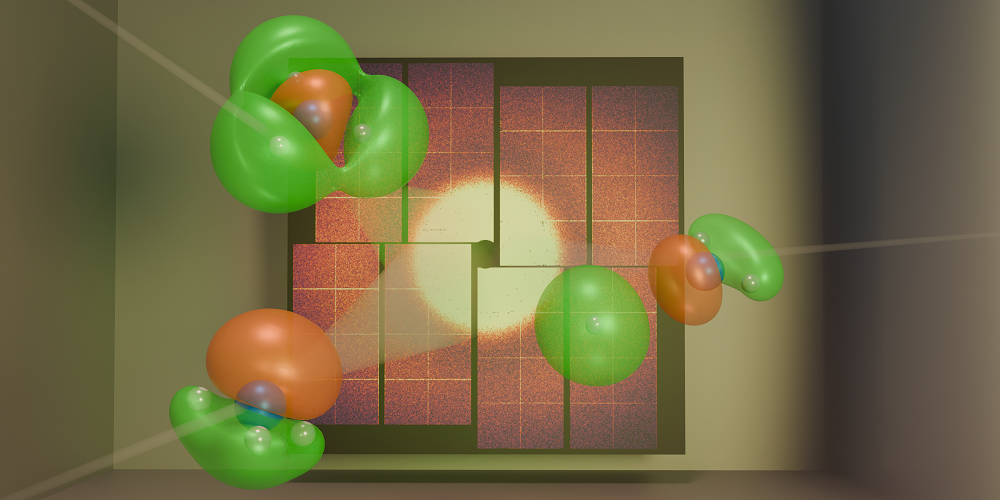

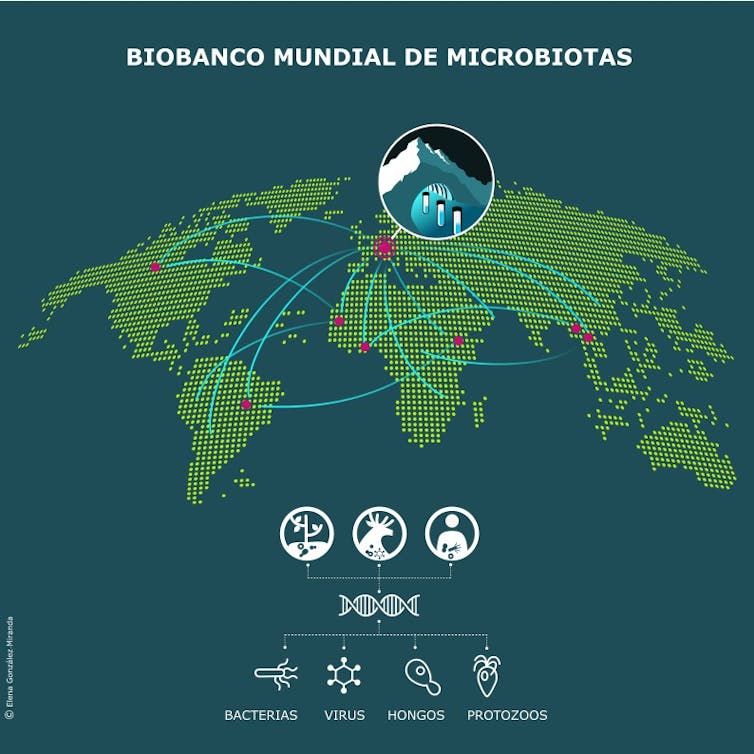

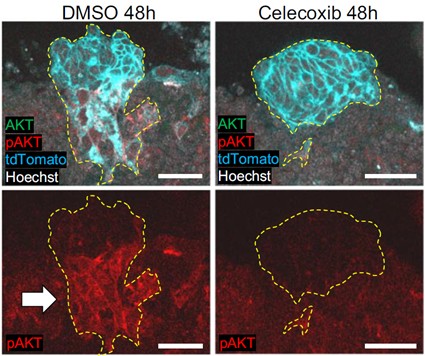

Diseño esquemático del experimento ANAIS-112, en el que pueden apreciarse los nueve módulos cilíndricos que contienen cada uno 12,5 kg de cristales de NaI ultrapuro. Fuente: ANAIS Experiment / Universidad de Zaragoza

Diseño esquemático del experimento ANAIS-112, en el que pueden apreciarse los nueve módulos cilíndricos que contienen cada uno 12,5 kg de cristales de NaI ultrapuro. Fuente: ANAIS Experiment / Universidad de ZaragozaPara resolver esta controversia, los experimentos ANAIS-112, en el Laboratorio Subterráneo de Canfranc (España), y COSINE-100, en el Laboratorio Subterráneo de Yangyang (Corea del Sur), fueron diseñados para replicar la búsqueda de DAMA/LIBRA. Ambos utilizaron cristales de NaI, como DAMA, pero incorporaron mejoras técnicas para reducir el ruido de fondo y aumentar la sensibilidad. Tras varios años de recolección de datos, analizaron si sus detectores registraban la misma modulación anual.

Los resultados fueron claros: ni ANAIS-112 ni COSINE-100 observaron variaciones significativas en las tasas de detección que coincidieran con la señal de DAMA/LIBRA. Al combinar sus datos, los investigadores concluyeron, con una confianza estadística superior al 99,999 %, que la señal de DAMA no puede atribuirse a interacciones de partículas de materia oscura. Este hallazgo descarta la interpretación de materia oscura para la señal de DAMA/LIBRA.

Implicaciones para la física

Este resultado no implica que la materia oscura no exista. Su presencia sigue siendo crucial para explicar fenómenos cosmológicos, como la formación de galaxias y la dinámica de cúmulos. Sin embargo, los datos de ANAIS-112 y COSINE-100 indican que la modulación de DAMA/LIBRA probablemente se debe a otra causa, como radiación ambiental no identificada o efectos sistemáticos en los detectores.

La investigación sugiere que la materia oscura podría tener propiedades distintas a las asumidas, quizás interacciones aún más débiles que las que los detectores actuales pueden captar. Este revés impulsa a la comunidad científica a explorar nuevas estrategias, desde detectores más avanzados hasta modelos teóricos alternativos, para desentrañar el enigma de la materia oscura.

Un recordatorio de la actitud científica

Este episodio subraya un principio fundamental de la ciencia: un resultado, por intrigante que sea, debe ser reproducido de forma independiente para considerarse válido. La señal de DAMA/LIBRA, que durante años alimentó debates en la física de partículas y la cosmología, ha sido cuestionada con solidez por ANAIS-112 y COSINE-100. Lejos de ser un final, este resultado abre nuevas puertas para investigar uno de los mayores misterios del universo, con la promesa de descubrimientos que podrían revolucionar nuestra comprensión del cosmos.

Referencia:

COSINE-100 Collaboration & ANAIS-112 Collaboration (2025) Combined Annual Modulation Dark Matter Search with COSINE-100 and ANAIS-112 Phys. Rev. Lett. doi: 10.1103/9j7w-qp1c

El artículo El misterio de la materia oscura: ANAIS y COSINE desafían la señal de DAMA/LIBRA se ha escrito en Cuaderno de Cultura Científica.

Una nueva hipótesis sobre la formación de Mercurio

Mercurio es un planeta raro, y más si lo comparamos con el resto de los planetas rocosos. Para sus reducidas dimensiones -algo más de 1/3 del diámetro de nuestro planeta- es un planeta “pesado”. Esto nos ha hecho pensar que bajo su superficie se esconde un núcleo que podría albergar hasta el 70% de la masa total de Mercurio, mucho si lo comparamos con la Tierra, donde este porcentaje es de alrededor de un 30%.

Durante muchos años, los investigadores se han preguntado por el origen de esta diferencia tan marcada sin hallar una respuesta definitiva que convenza a toda la comunidad científica. Pero un nuevo estudio publicado por Franco et al. (2025) ofrece una visión alternativa a la teoría imperante sobre la formación de Mercurio, donde el planeta actual sería la consecuencia de un gran impacto. Más o menos.

Esta teoría dice que el Mercurio original, o proto-Mercurio, tendría aproximadamente el doble de tamaño que en la actualidad, pero que en algún momento de esos agitados primeros momentos de la historia de nuestro sistema solar se encontró de frente con un cuerpo mucho más pequeño. La colisión habría sido tan fuerte que una gran parte la corteza y el manto del protoplaneta habrían sido expulsados al espacio.

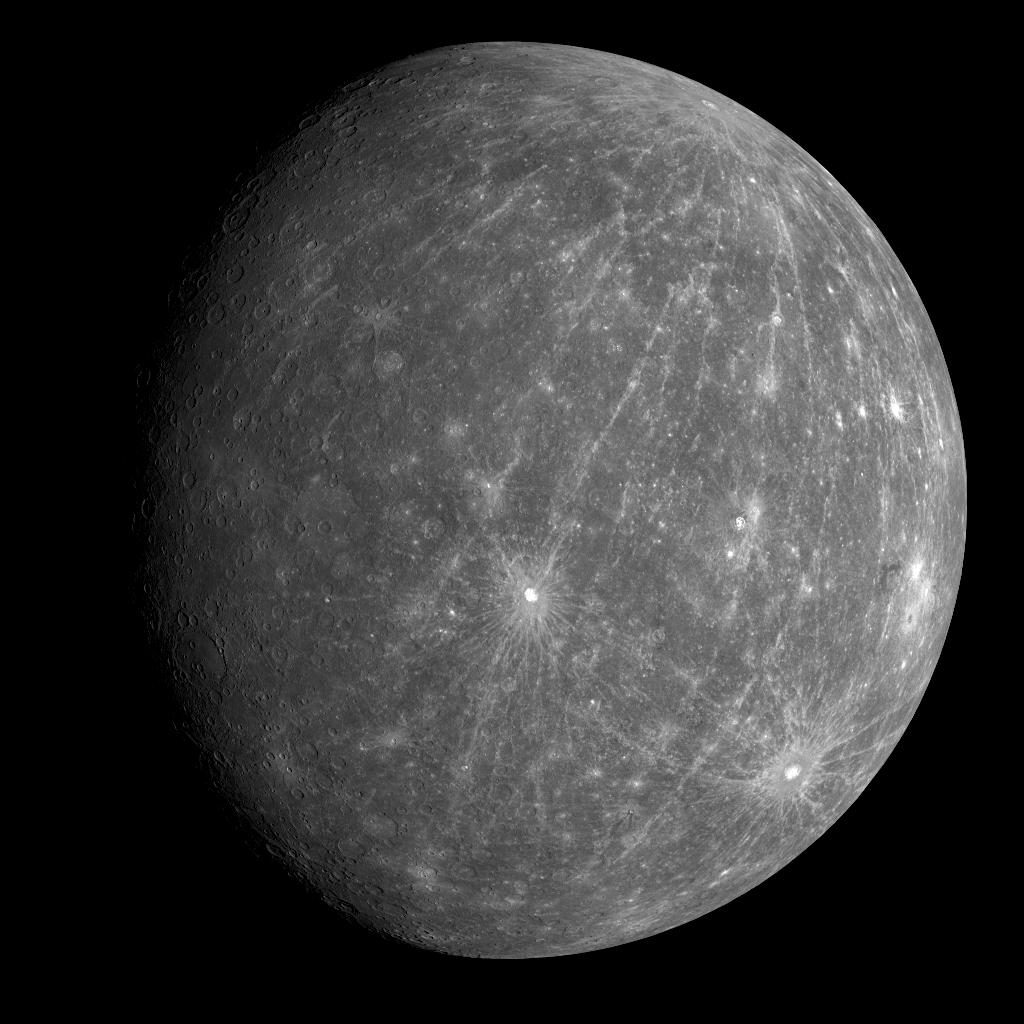

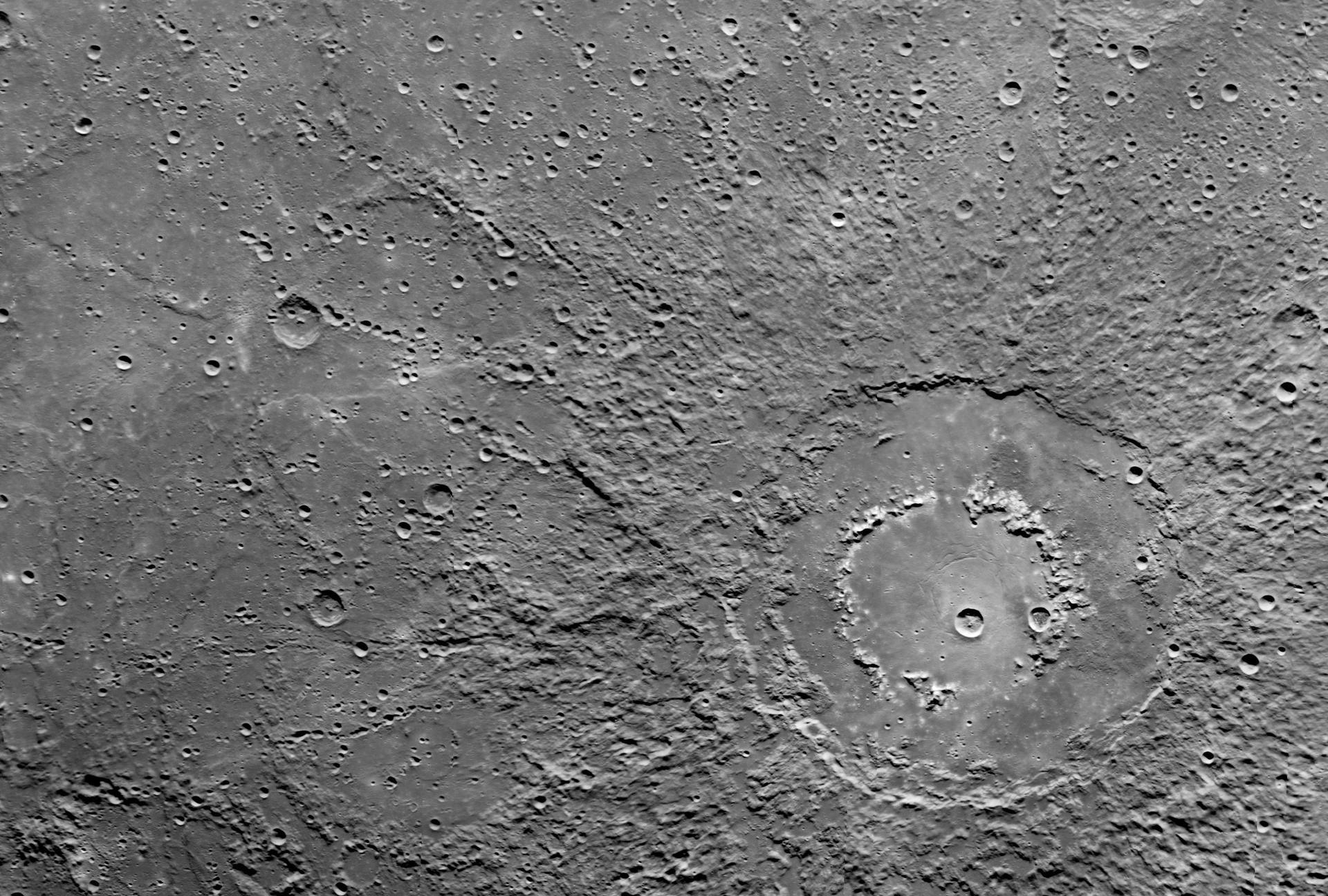

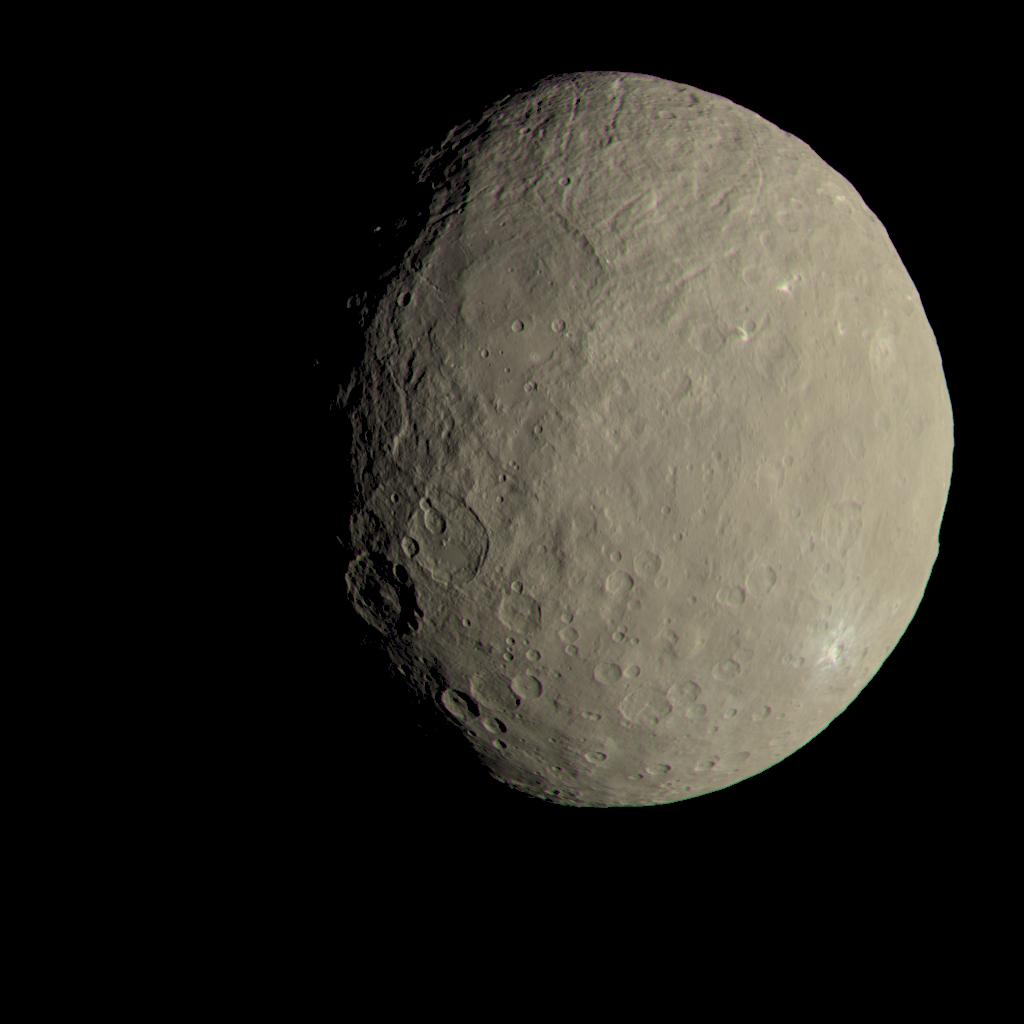

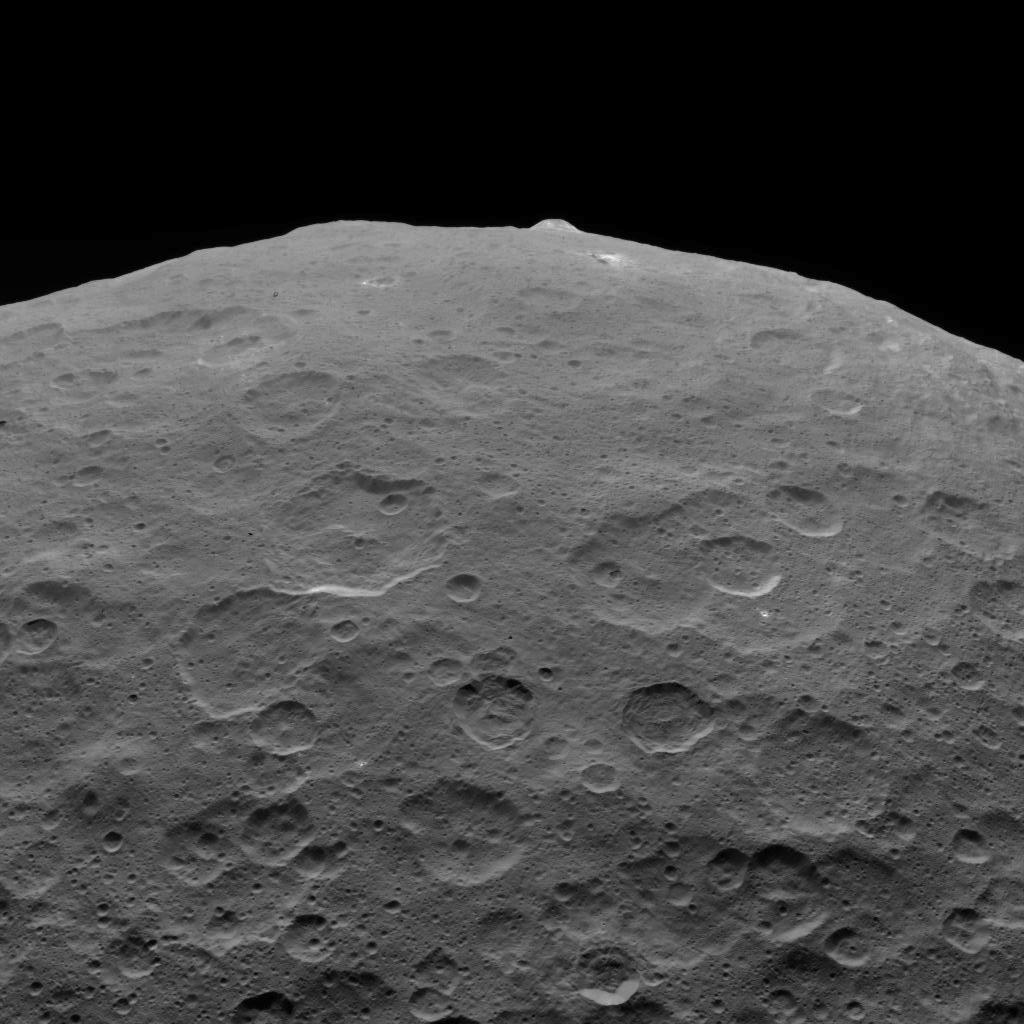

Mercurio visto a través de la sonda MESSENGER. Aunque por fuera puede parecerse mucho a nuestra Luna -salvando los mares-, lo cierto es que por dentro son cuerpos muy diferentes como atestiguan las grandes diferencias de densidad entre uno y otro. Quizás una de las cosas más llamativas de la imagen es la presencia de muchos cráteres con una eyecta clara que contrasta con la superficie más oscura. Imagen cortesía de NASA/Johns Hopkins University Applied Physics Laboratory/Carnegie Institution of Washington.

Mercurio visto a través de la sonda MESSENGER. Aunque por fuera puede parecerse mucho a nuestra Luna -salvando los mares-, lo cierto es que por dentro son cuerpos muy diferentes como atestiguan las grandes diferencias de densidad entre uno y otro. Quizás una de las cosas más llamativas de la imagen es la presencia de muchos cráteres con una eyecta clara que contrasta con la superficie más oscura. Imagen cortesía de NASA/Johns Hopkins University Applied Physics Laboratory/Carnegie Institution of Washington.Pero esta versión de la historia tiene varios problemas: El primero es que las simulaciones de las colisiones sugieren que este tipo de encuentros capaces de arrancar la corteza y el manto de un planeta son bastante raras. Estos eventos tan energéticos requerirían que el cuerpo más pequeño que impacta sobre el otro tenga una órbita inusualmente excéntrica, algo que no es habitual -o poco frecuente- en los modelos de formación planetaria.

Además, una gran parte de los materiales expulsados por la colisión y que originalmente formarían parte del manto y de la corteza del protoplaneta, volverían a caer de nuevo sobre este, ayudando a formar de nuevo esas capas, al menos parcialmente.

Esto ha llevado a los científicos a buscar teorías alternativas en las que, aunque siga necesitándose una colisión, esta sea más tangente y no frontal, pero al igual que en el caso anterior, se necesitan unos parámetros orbitales muy específicos y poco probables según lo que sabemos hasta el momento gracias a los modelos de formación planetaria.

Y en este punto es donde entra este nuevo estudio a plantear otra solución al problema que nos plantea Mercurio. En lugar de ser una colisión de un cuerpo pequeño contra uno grande se han preguntado que pasaría si los dos cuerpos que chocaron tuviesen una masa similar. Y es que cuando estudiamos a fondo las simulaciones de formación de sistemas planetarios, vemos que los impactos gigantes son generalmente poco frecuentes, pero entre protoplanetas de un tamaño similar son mucho más comunes.

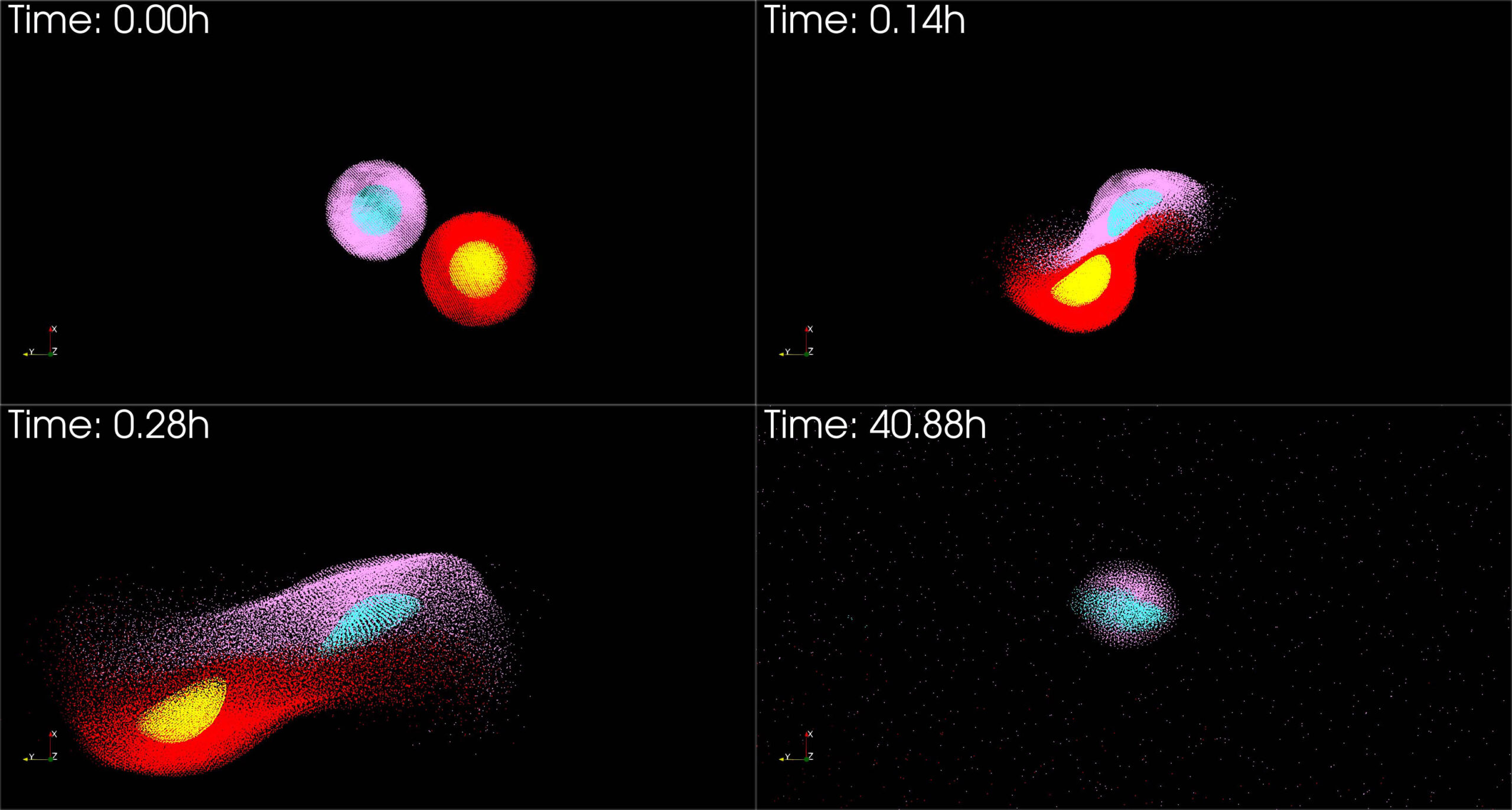

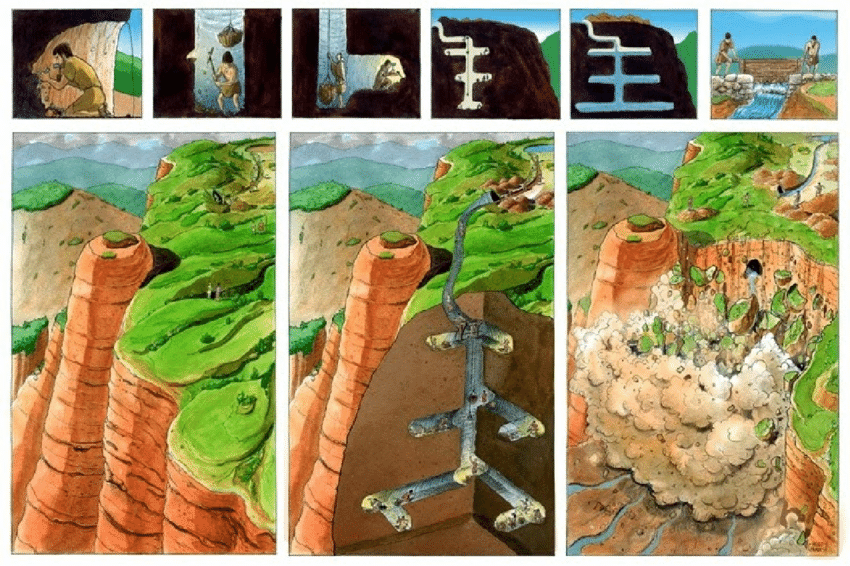

Para poder dar respuesta a esta cuestión, los autores de este estudio realizado una serie de simulaciones por ordenador en la que cada planeta no es un único objeto sólido, sino que está formado por miles de partículas individuales, cada una con propiedades como la velocidad, posición, la temperatura y el tipo de material del que están compuestas.

Además, en las condiciones iniciales del modelo hicieron que los planetas ya estuviesen diferenciados, es decir, que su interior estuviese formado por capas de distintas propiedades, como nuestro planeta hoy día. En este caso, el proto-Mercurio tendría unas dimensiones aproximadas de 2.4 veces el planeta actual y estaría formado por un 30% de hierro y un 70% de rocas formadas por silicatos, una composición que podríamos considerar típica para los cuerpos del Sistema Solar interior.

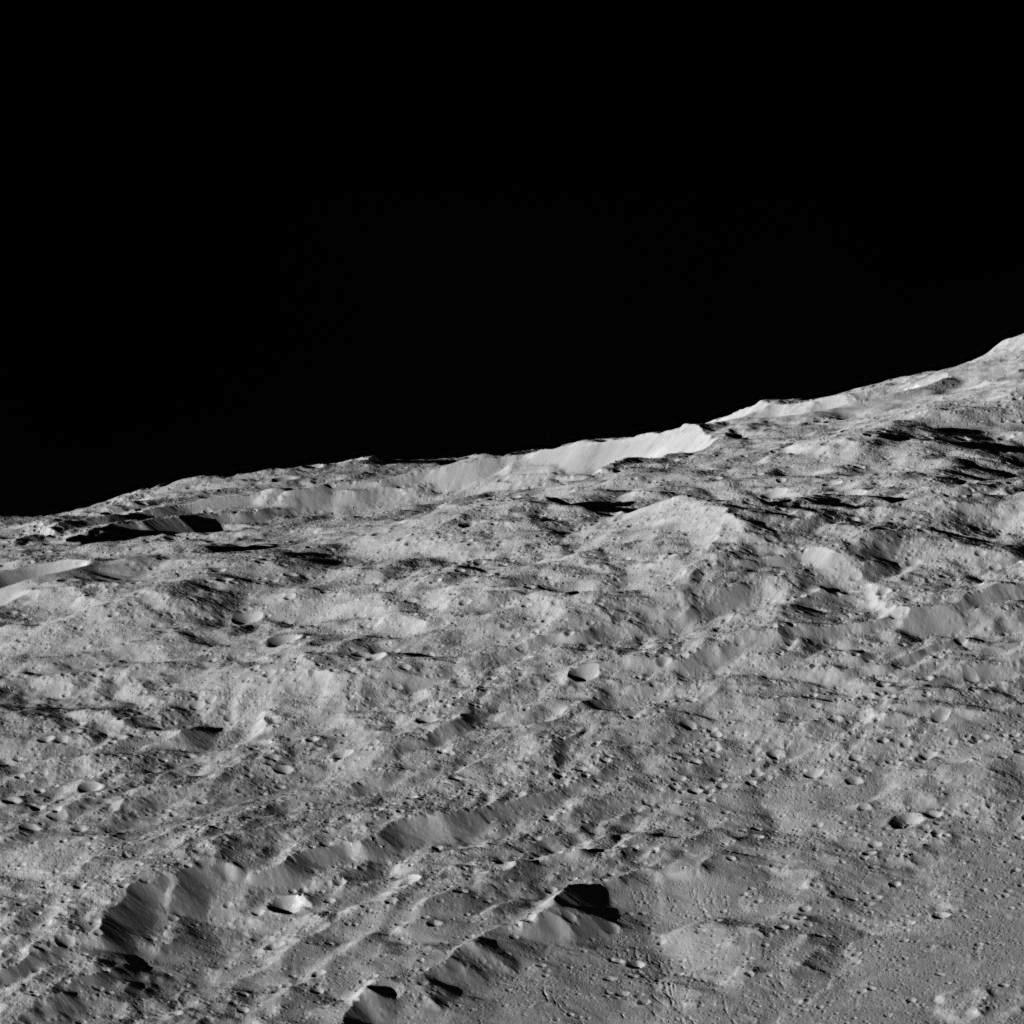

Fotogramas de la simulación en los que se puede apreciar distintos momentos de la colisión y el resultado de esta. Los colores muestran el manto y el núcleo de ambos protoplanetas. Fuente: Franco, P., et al. (2025) Nat Astron. doi: 10.1038/s41550-025-02582-y / fair use

Fotogramas de la simulación en los que se puede apreciar distintos momentos de la colisión y el resultado de esta. Los colores muestran el manto y el núcleo de ambos protoplanetas. Fuente: Franco, P., et al. (2025) Nat Astron. doi: 10.1038/s41550-025-02582-y / fair useEl cuerpo con el que chocaría, en cambio, tendría un tamaño variable que oscila entre las 3.6 y las 10 veces el tamaño del Mercurio actual, pero con una composición idéntica a la que hemos comentado en el párrafo anterior. Hay diferencia de tamaños, pero no estaríamos ante un caso extremo como el propuesto en otros modelos, donde la diferencia es mucho más grande.

En vez de hacer miles de simulaciones al azar, analizaron los casos que podrían dar lugar a que el cuerpo más pequeño resultante de la colisión tuviese un tamaño similar al Mercurio actual, ejecutando las simulaciones ya con un rango de ángulos y velocidades de impacto mucho más acotado.

Pero no fue tan fácil. En las primeras simulaciones intentaron usar los ángulos de impacto que se denominan “críticos”, aquellos que requerirían la menor energía para conseguir el objetivo y, de hecho, las colisiones eran tan suaves que el proto-Mercurio acababa con una masa casi el doble de la que tiene hoy actualmente y con un porcentaje de hierro por debajo del 50%.

Así que probaron otra aproximación: redujeron el ángulo de impacto en un 30%, lo que supone que los cuerpos se tocan mucho más durante la colisión, haciendo que esta sea mucho más disruptiva. Y aquí se acercaron mucho más a lo que buscaban, con Mercurios resultantes que tenían una masa de hierro de aproximadamente el 60-65%. Estaban cerca, pero todavía no del todo.

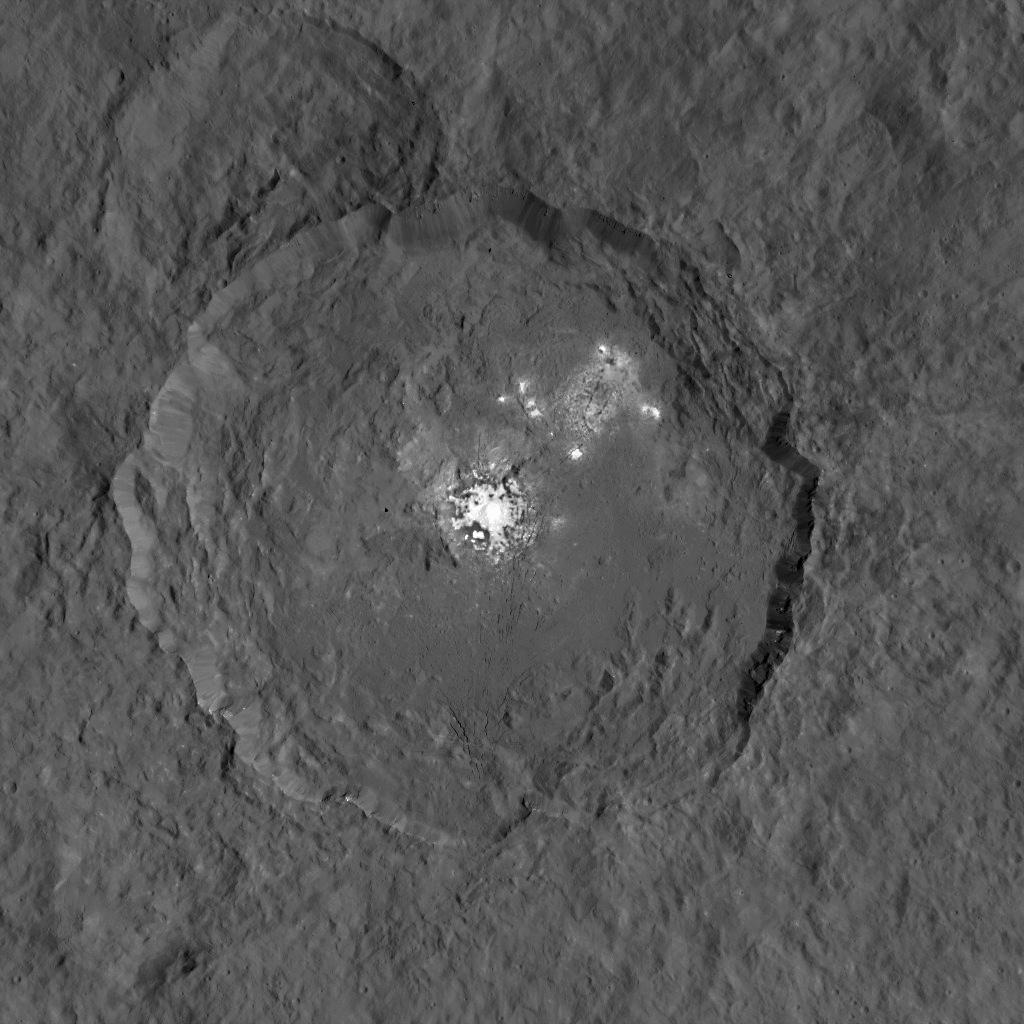

Una doble cuenca de impacto sobre la superficie de Mercurio. Además, se puede ver perfectamente cadenas de cráteres secundarios que surgen radialmente desde esta cuenca. Cortesía de NASA/Johns Hopkins University Applied Physics Laboratory/Carnegie Institution of Washington.

Una doble cuenca de impacto sobre la superficie de Mercurio. Además, se puede ver perfectamente cadenas de cráteres secundarios que surgen radialmente desde esta cuenca. Cortesía de NASA/Johns Hopkins University Applied Physics Laboratory/Carnegie Institution of Washington.Por último, probaron a realizar un tercer conjunto de simulaciones para afinar un poco más los modelos y que el resultado no fuese una destrucción completa de los cuerpos o una “fusión”. Y aquí es donde el acierto parecía evidente: Chocaron dos cuerpos -uno con masa de 0.13 veces la de la Tierra y otro de 0.20 veces- produciendo como resultado un cuerpo de 0.056 veces la masa de la Tierra… muy cerca del valor actual de Mercurio, que es de 0.055 y, además, un núcleo de hierro que pesaba aproximadamente el 68% de la masa total del planeta. Casi un gemelo idéntico.

Este nuevo estudio demuestra que incluso una colisión relativamente tangencial entre dos cuerpos similares sería una de las posibles formas de dar lugar al Mercurio que conocemos hoy, sobre todo porque no necesitamos que las configuraciones de las órbitas sean más exóticas ni tampoco cuerpos muy grandes. Y además, esto cuadra bastante bien con la imagen de un Sistema Solar donde embriones planetarios del tamaño de Marte chocaban unos contra los otros, destruyéndose y fusionándose hasta dar lugar a los planetas que conocemos hoy.

A pesar de esto, quedan dos grandes preguntas abiertas… especialmente a dónde fueron los restos de esta colisión y el por qué hay tantos elementos volátiles en la corteza de Mercurio. Pero, aun así, este nuevo modelo abre la puerta a comprender un poquito mejor la formación de un planeta que quizás, después de todo, no sea nada raro.

Referencias:

Franco, P., Roig, F., Winter, O.C. et al. (2025) Formation of Mercury by a grazing giant collision involving similar-mass bodies. Nat Astron doi: 10.1038/s41550-025-02582-y

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo Una nueva hipótesis sobre la formación de Mercurio se ha escrito en Cuaderno de Cultura Científica.

¿Cómo se puede saber la apariencia de los dinosaurios si solo tenemos sus huesos?

Reconstrucción de un dinosaurio del género ‘Deinonychus’ con su plumaje, tal y como se piensa que era a la luz de los conocimientos actuales. Museo de Historia Natural LWL, en Münster (Alemania). Fuente:frantic00/Shutterstock/ uso editorial

Reconstrucción de un dinosaurio del género ‘Deinonychus’ con su plumaje, tal y como se piensa que era a la luz de los conocimientos actuales. Museo de Historia Natural LWL, en Münster (Alemania). Fuente:frantic00/Shutterstock/ uso editorial

Este artículo forma parte de la sección The Conversation Júnior, en la que especialistas de las principales universidades y centros de investigación contestan a las dudas de jóvenes curiosos de entre 12 y 16 años. Podéis enviar vuestras preguntas a tcesjunior@theconversation.com

Pregunta formulada por el curso de 2º de la ESO del Instituto de Educación Secundaria Miguel de Unamuno, en Vitoria-Gasteiz (Álava)

A veces, a los paleontólogos les llaman “cazadores de fósiles”. Sin embargo, George Gaylor Simpson, uno de los paleontólogos más influyentes del siglo XX, decía que “el cazador (o la cazadora) de fósiles no mata, resucita”. Resucitar en el sentido de hacer revivir, aunque sea en sentido figurado, animales extintos.

Es decir, la labor de los paleontólogos consiste en reconstruir mundos pasados a partir de las evidencias conocidas en el registro fósil.

Cómo “resucitar” un dinosaurio en tres pasosLos fósiles de dinosaurios que estudian los paleontólogos son principalmente de dos clases: restos esqueléticos, como huesos y dientes, y restos indirectos o icnofósiles. En esta última categoría entran las huellas fósiles (icnitas), los excrementos fosilizados (coprolitos), etc. En ocasiones excepcionales, pueden conservarse “partes blandas”: impresiones de la piel o restos orgánicos (tejidos blandos y proteínas).

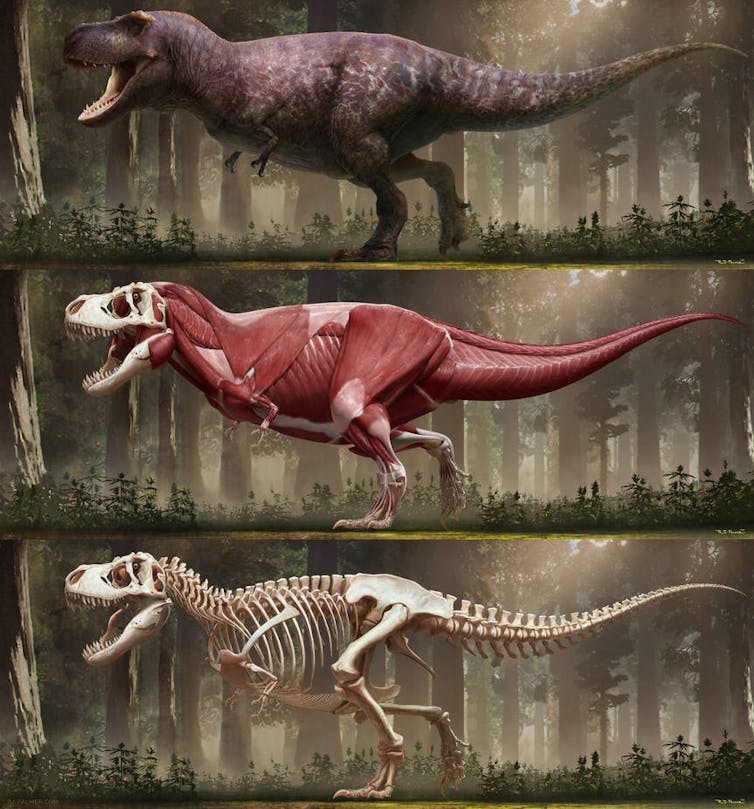

El primer paso para conocer la apariencia en vida de un dinosaurio es reconstruir el esqueleto a partir de sus huesos y dientes fósiles. Muchas especies están basadas en restos parciales y, a menudo, desarticulados; los esqueletos articulados completos no abundan.

También hay que tener presente que los huesos fósiles pueden estar deformados o alterados debido a la llamada diagénesis (los procesos que experimentan los sedimentos durante su transformación en rocas sedimentarias). Cuando faltan elementos óseos, se tienen en cuenta las partes simétricas del mismo individuo y se completa con información basada en “parientes” vivos, como aves y cocodrilos.

El segundo paso es reconstruir los músculos y tejidos. Las marcas de inserción muscular en los huesos fósiles sirven para averiguar la forma y disposición de los músculos.

Y el paso final consiste en imaginar la apariencia externa del animal, como la piel (con la presencia de escamas o plumas), pero es la parte más especulativa. En ciertos casos, se pueden inferir rasgos que no se han conservado en el registro fósil haciendo una correlación con especies actuales (se llama principio de homología). Por ejemplo, la presencia de plumas en aves y otros dinosaurios terópodos sería un carácter heredado de un ancestro común.

Para realizar todos estos estudios se aplica la anatomía comparada, disciplina que consiste en comparar las semejanzas y diferencias de las estructuras anatómicas entre especies. Los estudios de biomecánica y paleoicnología (huellas fósiles) ayudan a reconstruir el movimiento de los dinosaurios y a deducir cómo se desplazaban y a qué velocidad lo hacían.

Propuesta de reconstrucción del icónico predador Tyrannosaurus rex: esqueleto, musculatura y aspecto externo, según R. J. Palmer, para el juego Saurian.

Propuesta de reconstrucción del icónico predador Tyrannosaurus rex: esqueleto, musculatura y aspecto externo, según R. J. Palmer, para el juego Saurian.Urvogel Games, LLCReconstruir el paisaje donde vivieron

Llegados a este punto, no basta con reconstruir el aspecto de un dinosaurio: también es importante conocer en qué entorno natural vivió cuando formaba parte de un ecosistema e interaccionaba con otros organismos.

Para ello es necesario identificar otros vestigios del yacimiento y entender el contexto geológico en que este se formó. Su estudio permitirá hacerse una idea del ambiente pasado y reconstruir un “paleopaisaje” con el dinosaurio como parte integrante del mismo.

Pero ¿de qué color eran los dinosaurios?Hasta hace poco, el color de la piel de los dinosaurios era una incógnita. Ahora podemos deducir ese rasgo gracias al estudio de la forma, tamaño y distribución de los melanosomas (pequeños órganos celulares que contienen pigmentos como la melanina, responsable del color cutáneo) mediante técnicas de vanguardia (microscopía electrónica) y comparando con el aspecto de las aves actuales.

Por ejemplo, Anchiornis, un pequeño terópodo, tendría plumas de diferentes colores: grises, blancas, negras, así como un copete rojizo. El plumaje de Microraptor, otro terópodo con plumas en las cuatro extremidades, sería de color oscuro y con un brillo iridiscente, como ocurre en algunos córvidos actuales.

Dinosaurios cuya piel no estaba cubierta de plumas, como el pequeño ceratopsio Psittacosaurus y el anquilosaurio Borealopelta, se han reconstruido atribuyéndoles un cuerpo de color marrón oscuro o rojizo. En ambos casos, lucen un vientre más claro: este patrón cromático, conocido como contrasombra o contracoloración, está presente en muchos animales y sirve para camuflarse.

Modelo del ornitisquio Psittacosaurus con piel escamosa y largos filamentos queratinosos en la cola. Está basado en un fósil del Cretácico Inferior de China (Jehol Biota) conservado en el Museo Senckenberg de Frankfort, en Alemania. El patrón de color o contrasombreado, con la parte dorsal más oscura que la ventral, servía probablemente de camuflaje.

Modelo del ornitisquio Psittacosaurus con piel escamosa y largos filamentos queratinosos en la cola. Está basado en un fósil del Cretácico Inferior de China (Jehol Biota) conservado en el Museo Senckenberg de Frankfort, en Alemania. El patrón de color o contrasombreado, con la parte dorsal más oscura que la ventral, servía probablemente de camuflaje.Imagen de Jakob Vinther et al. (2016) en Current BiologyTalento artístico con conocimiento de causa

Con todos los datos, los paleoartistas reviven en sus ilustraciones el aspecto de los dinosaurios y otros seres del pasado. Algunos son paleontólogos o trabajan en colaboración con ellos. Entonces, el talento artístico se combina con los conocimientos científicos para mostrar la posible apariencia en vida de animales que ya no existen.

Dependiendo de la naturaleza fragmentaria del registro fósil y de otros factores, estas obras tendrán siempre una parte de especulación. Las reconstrucciones de dinosaurios conocidos a partir de decenas de esqueletos pertenecientes a individuos en diferentes fases de crecimiento (juveniles, adultos, etc.), como el citado Psittacosaurus, estarán mejor fundamentadas que otras basadas en restos fragmentarios pertenecientes a un único individuo.

Evolución de la imagen de los dinosauriosLa imagen de los dinosaurios ha ido cambiando a lo largo del tiempo, ya que es un reflejo de los conocimientos científicos de cada época. Las primeras reconstrucciones del siglo XIX los muestran como gigantescos lagartos. Para Richard Owen, el inventor del término “dinosaurio” (1842), eran cuadrúpedos corpulentos parecidos a los mamíferos llamados mastodontes, como reflejan los modelos a tamaño natural del Crystal Palace Park, al sur de Londres.

Estatuas del dinosaurio iguanodonte en el Crystal Palace Park, Londres.

Estatuas del dinosaurio iguanodonte en el Crystal Palace Park, Londres.Wikimedia Commons, CC BY

La iconografía de la segunda mitad del siglo XIX, basada en descubrimientos hechos en Norteamérica y Europa, representa a terópodos y ornitópodos como formas bípedas con aspecto de canguro. Durante la primera mitad del siglo XX, los esqueletos de dinosaurios montados en los museos los muestran con la cola apoyada en el suelo. Hay que esperar hasta los años 1960-1970, cuando se produjo una revolución conceptual en paleontología llamada “Renacimiento de los dinosaurios”, para tener una imagen más realista de estos animales.

Los esqueletos de los museos y las imágenes de cine y televisión modernas presentan a los dinosaurios en una posición más dinámica, con la columna vertebral horizontal y la cola levantada por encima del suelo.

Estas reconstrucciones tienen en cuenta las más recientes interpretaciones paleontológicas y representan a los dinosaurios como seres activos. En el momento de su estreno (1993), la película Parque Jurásico nos enseñó las reconstrucciones más modernas de la historia.

No obstante, la imagen de algunas criaturas de la saga no ha evolucionado a la par que las interpretaciones paleontológicas. Por ejemplo, los famosos “raptores” siguen teniendo una piel escamosa y prácticamente desprovista de plumas a pesar de que las evidencias fósiles indican que dinosaurios como los dromeosaurios estaban cubiertos de plumas o protoplumas.

Esto demuestra que, aunque el cine puede conseguir que la ciencia resulte más atractiva, los intereses científicos y cinematográficos no son necesariamente los mismos.

Reconstrucción moderna del dromeosaurio Deinonychus por el ilustrador Fred Wierum. A diferencia de los raptores de la saga Parque Jurásico, el cuerpo está cubierto de plumas, reflejo de los últimos descubrimientos en paleontología.

Reconstrucción moderna del dromeosaurio Deinonychus por el ilustrador Fred Wierum. A diferencia de los raptores de la saga Parque Jurásico, el cuerpo está cubierto de plumas, reflejo de los últimos descubrimientos en paleontología.Fred Wierum/Wikimedia Commons

En definitiva, es posible conocer la apariencia de los dinosaurios gracias a los conocimientos científicos que proporcionan los fósiles y a la utilización de técnicas modernas. Cuanto más completos sean los datos, menos especulativa será la reconstrucción. Los paleoartistas ayudan a recrear mundos poblados de aquellos asombrosos animales extintos y otros seres del pasado.

La Cátedra de Cultura Científica de la Universidad del País Vasco colabora en la sección The Conversation Júnior.![]()

Sobre el autor: Xabier Pereda Suberbiola, Investigador (Paleontología), Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo ¿Cómo se puede saber la apariencia de los dinosaurios si solo tenemos sus huesos? se ha escrito en Cuaderno de Cultura Científica.

Seguimos valiendo un potosí

Existe una expresión en el arraigo de frases castellanas que se lleva repitiendo durante siglos, pero que, desgraciadamente, se está perdiendo rápidamente en el acervo lingüístico moderno, y que a mí me encanta. Esta expresión reza así: “vale un potosí”. Con estas simples palabras nos estamos refiriendo a algo o alguien que tiene un enorme valor, hasta el punto de considerarlo como un auténtico tesoro. Pero, ¿de dónde viene esta palabra tan rara?

Aspecto actual de la Villa Imperial de Potosí (Bolivia), con el Cerro Rico al fondo. Foto: Parallelepiped09 / Wikimedia Commons

Aspecto actual de la Villa Imperial de Potosí (Bolivia), con el Cerro Rico al fondo. Foto: Parallelepiped09 / Wikimedia CommonsPara buscar la respuesta, debemos viajar a mediados del siglo XVI. En aquella época, los exploradores españoles que recorrían Sudamérica llegaron a la zona que ocupa la actual Bolivia. Allí se encontraron con una montaña en la que los pueblos indígenas explotaban varios minerales metálicos, entre ellos plata, a la que llamaron Cerro Rico por esa gran abundancia minera. Pero la población se refería a ese lugar con el término quechua “potoq” o “potojsi”, así que rápidamente esta localidad pasó a denominarse Potosí. En pocos años, esta explotación minera aportó toneladas de plata a la corona española, facilitando la expansión imperial por Sudamérica y convirtiendo a los buques que traían a la España peninsular [*] este preciado metal en auténticos objetos de deseo de piratas, bucaneros y corsarios. Incluso, Potosí tuvo una casa de la moneda para poder acuñar reales con la plata extraída del Cerro Rico. Y así es como la palabra potosí acabó convirtiéndose en sinónimo de riqueza desde finales del siglo XVI.

Reales de a 8 de plata acuñados en Potosí durante el siglo XVIII. Foto: Carlomorino / Wikimedia Commons

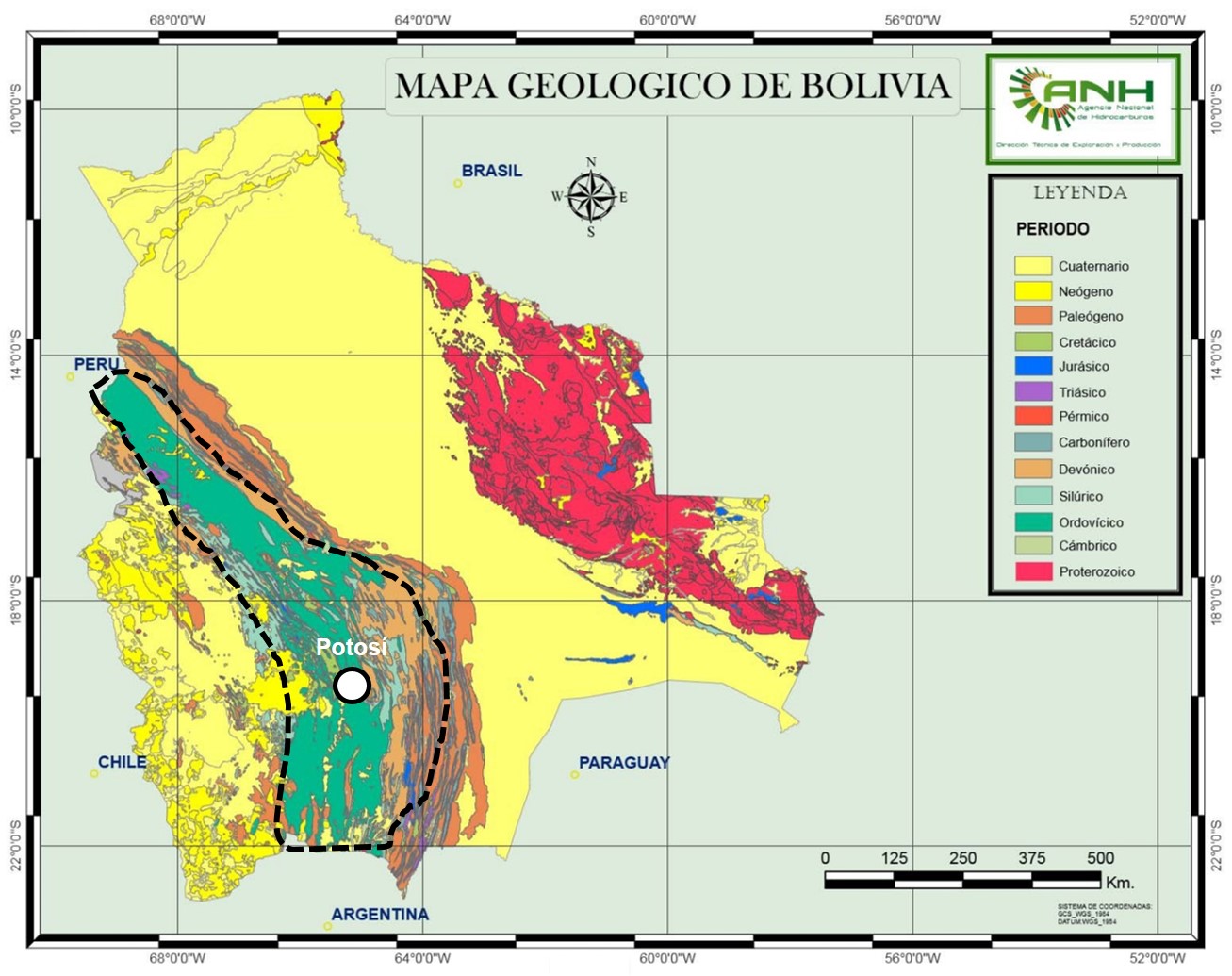

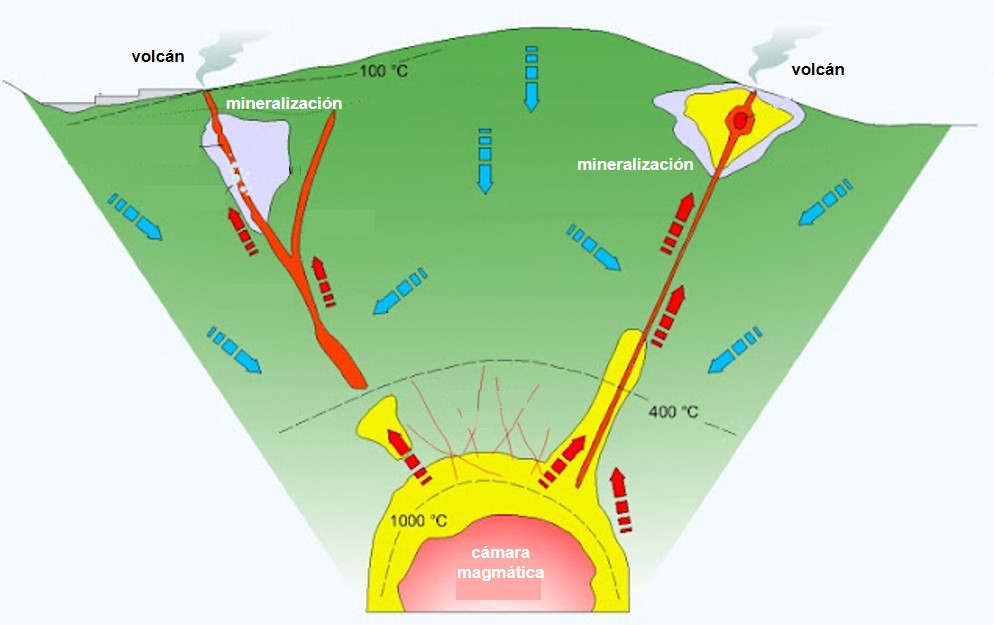

Reales de a 8 de plata acuñados en Potosí durante el siglo XVIII. Foto: Carlomorino / Wikimedia CommonsPero vamos a dejar la historia y pasemos a hablar de Geología. Si nos fijamos en el margen occidental de Bolivia, podemos encontrarnos con una serie de cordilleras que dibujan una pequeña curvatura y que están formadas, principalmente, por rocas depositadas en un fondo marino durante el Periodo Ordovícico, hace más de 400 millones de años. Pero lo más interesante empezó a ocurrir durante el Mioceno, hace más de 15 millones de años, cuando muchas estas montañas fueron sometidas a un importante vulcanismo, como le pasó a Cerro Rico. Cuando esos magmas empezaron a ascender hacia la superficie desde las cámaras magmáticas emplazadas bajo las cordilleras, lograron calentar las aguas subterráneas que circulaban junto a ellas, permitiendo además que varios de los elementos metálicos del magma acabasen disueltos en esos fluidos calientes. Estas aguas cargadas de elementos químicos circularon también hacia la superficie, pero, antes de salir al exterior, se enfriaron a poca profundidad, perdiendo la capacidad de transportar los elementos metálicos, que acabaron formando niveles mineralizados. Y aquí entra lo más importante, ya que este circuito de fluidos calientes generando mineralizaciones metálicas no se detuvo hasta que terminó la actividad volcánica, ya que el agua fría que se infiltraba en el terreno y circulaba bajo tierra, en cuanto se acercaba al magma, se convertía en nueva fuente de depósitos minerales.

Mapa geológico simplificado de Bolivia, donde se señalan la localización de Potosí (círculo blanco) y la distribución de la banda de yacimientos metálicos de la cordillera boliviana (línea negra discontinua). Imagen modificada de la Agencia Nacional de Hidrocarburos de Bolivia.

Mapa geológico simplificado de Bolivia, donde se señalan la localización de Potosí (círculo blanco) y la distribución de la banda de yacimientos metálicos de la cordillera boliviana (línea negra discontinua). Imagen modificada de la Agencia Nacional de Hidrocarburos de Bolivia.Sé que, dicho así, este proceso puede parecer muy complejo. Pero, en realidad, es como si esta zona hubiese actuado como varias ollas a presión llenas de agua y con varios minerales metálicos en el fondo. Al poner las ollas al fuego, el agua de la parte inferior se calienta, disuelve los elementos metálicos y se los lleva consigo en su ascenso hasta la parte superior de la olla, donde se enfría, suelta los minerales y vuelve a bajar al fondo, para comenzar de nuevo su viaje.

Modelo conceptual simplificado del contexto geológico de las mineralizaciones de origen volcánico que se dan en lugares como Potosí y el resto de la banda de yacimientos metálicos de Bolivia. En rojo, fluidos profundos calientes; en azul, fluidos superficiales fríos. Fuente: González, O.A. (2010). Características principales de los depósitos epitermales en el noroeste de México, un análisis y comparación. Universidad de Sonora. CC-BY-NC-ND/ Scribd

Modelo conceptual simplificado del contexto geológico de las mineralizaciones de origen volcánico que se dan en lugares como Potosí y el resto de la banda de yacimientos metálicos de Bolivia. En rojo, fluidos profundos calientes; en azul, fluidos superficiales fríos. Fuente: González, O.A. (2010). Características principales de los depósitos epitermales en el noroeste de México, un análisis y comparación. Universidad de Sonora. CC-BY-NC-ND/ ScribdGracias a estos procesos volcánicos, en las cordilleras occidentales de Bolivia encontramos una banda con numerosos yacimientos de minerales metálicos entre los que encontramos elementos químicos tan preciados como la plata, el plomo, el zinc, el estaño o, incluso, el oro, en cantidades descomunales. Minerales que ya fueron explotados por los pueblos indígenas desde hace cientos de años, incluso antes de adquirir fama internacional a partir de mediados del siglo XVI por los conquistadores españoles, y que aún en la actualidad siguen siendo minados por el pueblo boliviano. Aunque las minas de Potosí han sido declaradas Patrimonio de la Humanidad y se han convertido en un tesoro turístico y nacional de Bolivia, por lo que la mayoría de las cooperativas mineras están abandonando la explotación de Cerro Rico, para asegurar su protección y conservación de cara a las generaciones futuras.

Para quienes os lo estéis preguntando, este dicho popular no aparece tal cual en el Quijote. En aquella España de finales del siglo XVI, la palabra potosí ya se había convertido en un sinónimo de algo valioso, así que Miguel de Cervantes la utilizó con ese significado en algunos de sus escritos. De esta forma, el propio ingenioso hidalgo la utiliza para asegurarle a su fiel escudero que, ni con todas las minas de potosí, podría pagarle el sacrificio que está a punto de realizar. Aprovechando que el manco de Lepanto vuelve a estar de moda gracias al cine, creo que es el momento más adecuado para recuperar esta expresión tan geológica que nunca debería abandonar el maravilloso mundo del dicho popular.

Agradecimientos:

Quiero dar las gracias a mis colegas y grandes amigas Iranzu Guede y Jone Mendicoa por darme la idea y las referencias científicas básicas para escribir este artículo. ¡Vosotras sí que valéis un potosí, chicas!

[*] Nota del editor: Debido a la influencia cultural anglosajona, muchas personas se refieren a la España de Ultramar como «colonias», cuando el Imperio Español nunca tuvo colonias, sino provincias (virreinatos) que eran parte integral del imperio, tan España era Potosí como Valladolid. Es similar al Imperio Romano, que tenía provincias, no colonias, y se distinguía así de Grecia, que sí tenía colonias (empórion, asentamientos comerciales; de esta palabra, por ejemplo, viene el nombre de la localidad de la costa catalana Ampurias, en catalán, Empúries). Una colonia es una empresa mercantil (o religiosa, como algunas inglesas en América) y, por tanto, privada y autónoma, aunque suele requerir un permiso del monarca para su implantación, y este está representado por un gobernador que vela por sus intereses económicos. Los virreinatos eran «tierra del rey», por eso los gobernaba un virrey, y eran una parte integral del estado. En la España americana se podía acuñar moneda en nombre del rey, como se hacía en la España europea. Como contraste, las pocas monedas acuñadas en las colonias inglesas de América no se hicieron con permiso del rey, y, finalmente, fueron expresamente prohibidas y la ceca clausurada. Toda esta explicación viene a cuenta de lo que se observa en la parte superior de los reales de a ocho españoles y permite entenderla: VTRAQUE (se escribe junto en latín, aunque se separa en la moneda por motivos estéticos) VNUM, ambos como uno.

El artículo Seguimos valiendo un potosí se ha escrito en Cuaderno de Cultura Científica.

Aprendiendo estadística a través de la danza

Llevo casi 10 años enseñando métodos de investigación en psicología, y puede ser un reto. Mis alumnos suelen decir que la estadística es la parte más aterradora de su carrera, que no les gustan las matemáticas y que no entienden por qué son tan importantes. Como muchos otros, intento que las clases y sesiones sean amenas y atractivas, y a menudo me encuentro rimando y, en general, moviéndome mucho; soy de esos profesores que se mueven mucho.

Intento presentar el material de forma visual siempre que sea posible, usando los brazos y todo el cuerpo para reforzar lo que digo, como, por ejemplo, formando posturas de diagrama de dispersión positivo/negativo o de distribución normal. A menudo resulta vergonzoso, pero parece efectivo. Bromeé con algunos colegas comentándoles que debería intentar enseñar estadística con baile y no se rieron. Esto me sorprendió.

Me preguntaba por qué enseñar así funcionaba (y seguía preguntándome por qué la gente no se reía). Quizás usar el movimiento en lugar de las palabras era una forma más sutil de presentar información que normalmente generaba ansiedad en la gente: basta con mencionar la palabra «estadística» a estudiantes de psicología para ver cómo el miedo se apodera de sus rostros y palidecen ligeramente.

En el año 2013, la psicóloga Lucy Irving (Middlesex University) lideró el proyecto Communicating Psychology to the Public through Dance (Comunicar la psicología al público a través de la danza), también conocido como Dancing statistics (Bailando estadística). Financiado por la British Psychological Society, este proyecto contó con la asesoría estadística del también psicólogo y profesor de métodos cuantitativos Andy Field (University of Sussex).

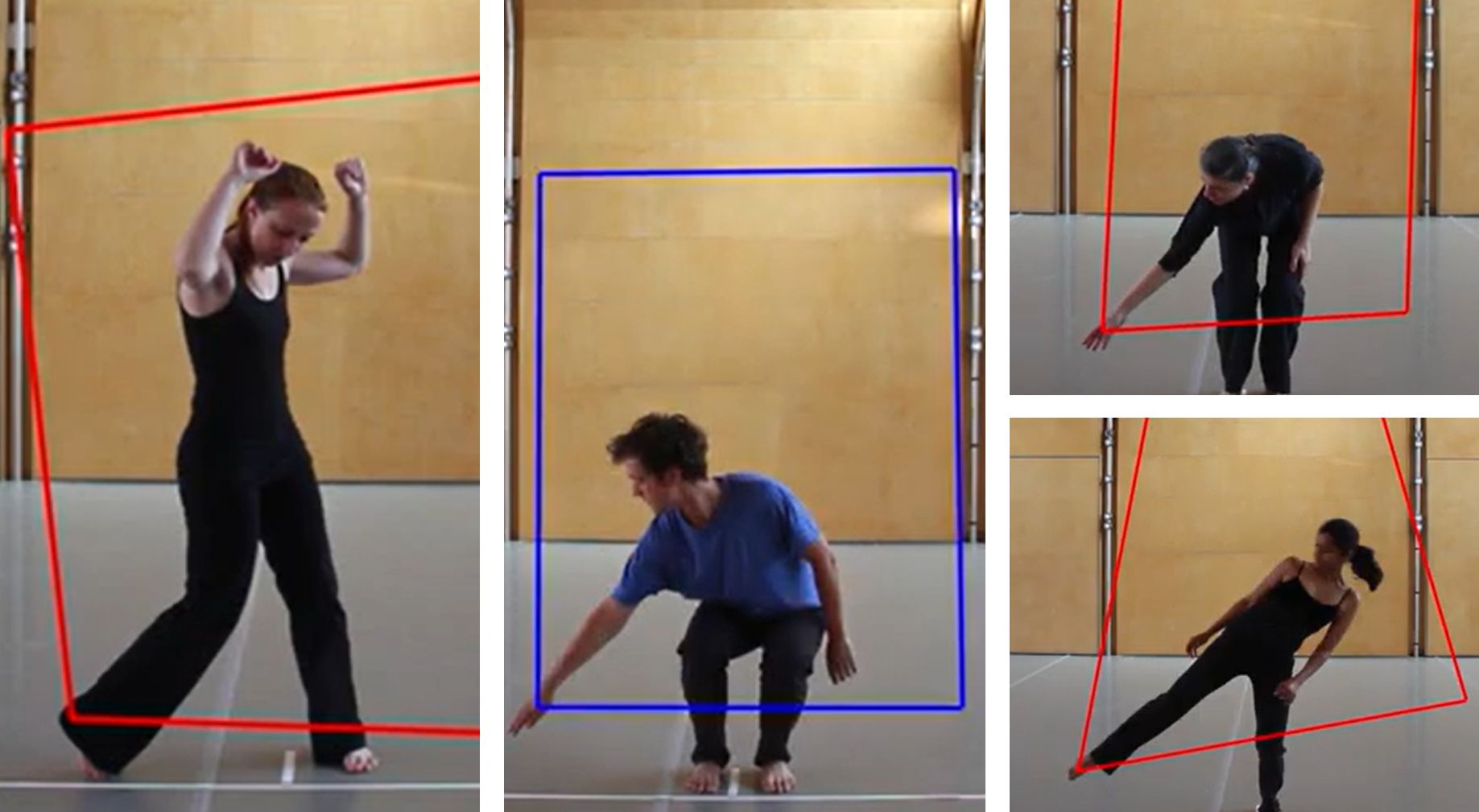

Varias capturas de pantalla del cortometraje sobre muestreo y error estándar.

Varias capturas de pantalla del cortometraje sobre muestreo y error estándar.

Irving y Field produjeron cuarto cortometrajes en los que se introducen diferentes conceptos estadísticos: el muestreo y el error estándar, la varianza, la distribución de frecuencias y la correlación se explican por medio de ocurrentes bailes ideados por la coreógrafa Masha Gurina.

Este fue posiblemente el proyecto más inusual en el que participé como coreógrafa, pero también uno de los más emocionantes. Trabajando con un equipo de diez bailarinas y bailarines, una cineasta, el destacado psicólogo estadístico del Reino Unido, el profesor Andy Field, y la profesora de Psicología y Métodos de Investigación, Lucy Irving (fundadora y productora), he coreografiado películas que visualizan algunos conceptos estadísticos fundamentales para estudiantes de psicología. El resultado tuvo una excelente acogida en la comunidad psicológica, y me alegra mucho haber podido contribuir a la educación en este país.

En cada uno de los cortometrajes se explica cada uno de los momentos de la danza desde el punto de vista de la estadística, intentando aclarar esos conceptos que generan tanta “ansiedad” a algunas y algunos estudiantes.

Explicando el concepto estadístico de muestreo y error estándar

El muestreo es la técnica para seleccionar una muestra a partir de una población estadística y el error estándar es la desviación estándar (medida que cuantifica la variación o la dispersión de un conjunto de datos numéricos) de la distribución muestral (resultado de considerar todas las muestras posibles que pueden tomarse de una población) de un estadístico (una función medible).

Explicando el concepto estadístico de varianza

La varianza es una medida de dispersión; es una medida que indica cuánto se desvían los valores de un conjunto de datos respecto a su media. Es la media aritmética del cuadrado de las desviaciones respecto a la media de una distribución estadística.

Explicando el concepto estadístico de distribución de frecuencias

La distribución de frecuencias es una ordenación (en forma de tabla) de los datos estadísticos, que asigna a cada dato su correspondiente frecuencia.

Explicando el concepto estadístico de correlación

La correlación es una medida estadística que indica el grado de relación lineal entre dos variables numéricas. Se considera que dos variables cuantitativas están correlacionadas cuando los valores de una de ellas varían sistemáticamente con respecto a los valores correspondientes de la otra. Recordemos que la correlación entre dos variables no implica, por sí misma, ninguna relación de causalidad.

Los cortometrajes «Dancing Statistics» se diseñaron para guiar al público sin formación en danza a través de la observación y comprensión de coreografías cuidadosamente compuestas que demuestran conceptos estadísticos fundamentales.

¿Sirven estos videos para enseñar estadística? ¿Son únicamente un método de información divulgativo? En realidad, poco importa. Si ayudan a reducir esa “ansiedad” por esta materia, sin duda, ya son útiles. Además, en mi opinión, trabajar entre personas con formaciones tan diversas en un proyecto de este tipo, rompe estereotipos. ¿Están realmente tan lejos las matemáticas y el arte?

Referencias

- Lucy Irving, Statistics through the medium of dance, Significance, 14 enero 2014

- Avner Bar-Hen, Statistique et danse pour l’enseignement, Images des mathématiques, 20 julio 2014

- Elise Phillips, Any more Dancing Statistics?

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y editora de Mujeres con Ciencia

El artículo Aprendiendo estadística a través de la danza se ha escrito en Cuaderno de Cultura Científica.

Un solo agujero negro «desnudo» reescribe la historia del universo

El Telescopio Espacial James Webb ha descubierto un solitario agujero negro en el universo primitivo, con una masa equivalente a 50 millones de soles. Un descubrimiento trascendental: este objeto complica las teorías sobre el cosmos joven.

Un artículo de Charlie Wood. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

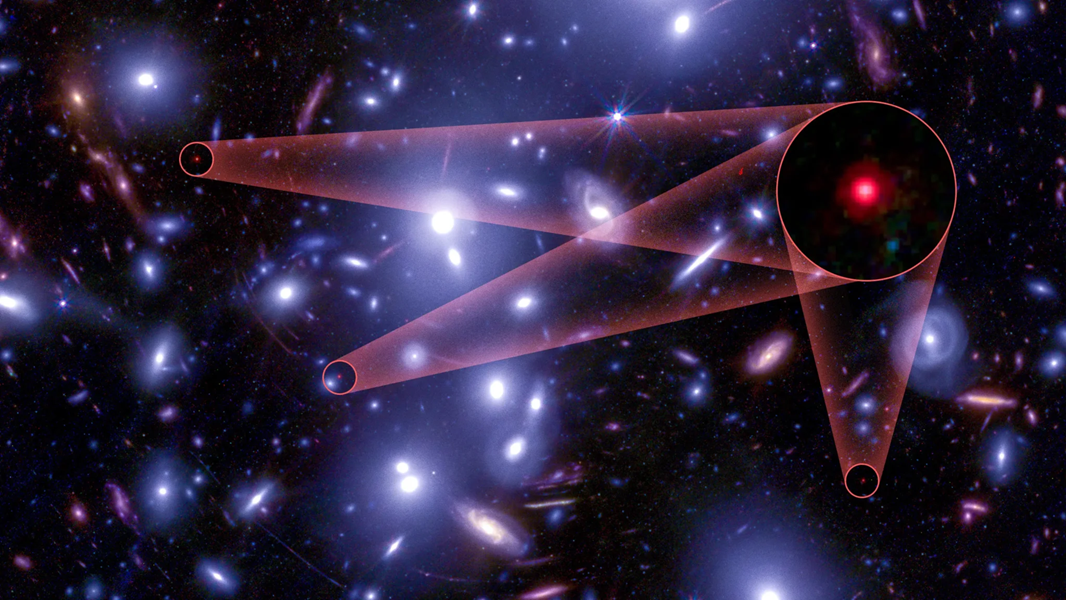

Un agujero negro gigantesco, visto tres veces en esta imagen del JWST, aparece misteriosamente en el universo primitivo sin una galaxia a su alrededor. Imagen: Quanta Magazine / Fuentes: JWST/NASA/ESA/CSA y Lukas Furtak

Un agujero negro gigantesco, visto tres veces en esta imagen del JWST, aparece misteriosamente en el universo primitivo sin una galaxia a su alrededor. Imagen: Quanta Magazine / Fuentes: JWST/NASA/ESA/CSA y Lukas FurtakSe ha descubierto un agujero negro sin precedentes en el universo temprano. Es enorme y parece estar prácticamente solo, con pocas estrellas orbitándolo. El objeto, que podría representar una clase completamente nueva de enormes agujeros negros “desnudos”, pone en entredicho la comprensión tradicional del universo joven.

“Esto está completamente fuera de escala”, afirma Roberto Maiolino, astrofísico de la Universidad de Cambridge que ayudó a desvelar la naturaleza del objeto en un preprint publicado el 29 de agosto. “Es tremendamente emocionante. Es muy revelador.”

“Está empujando los límites de lo que creemos que puede ser cierto, de lo que creemos que puede ocurrir”, comenta Dale Kocevski, astrónomo del Colby College que no participó en la nueva investigación.

Los astrónomos detectaron el agujero negro desnudo usando el Telescopio Espacial James Webb (JWST), un mega-instrumento construido por la NASA y sus socios en parte para desvelar cómo se formaron las galaxias durante el primer millardo de años del universo. Este nuevo agujero negro, con una masa equivalente a 50 millones de soles y bautizado como QSO1, entra en conflicto con la visión provisional de que la formación galáctica no comenzaba con agujeros negros. Se creía que estos aparecían solo después de que las estrellas de una galaxia colapsasen gravitacionalmente en agujeros negros que luego se fusionaban y crecían. Pero Maiolino y sus colegas describen a un leviatán solitario, sin rastro de galaxia madre.

La pregunta ahora es cómo llegó a existir este agujero negro.

Roberto Maiolino, de la Universidad de Cambridge, ha dirigido un estudio que ha identificado definitivamente el nuevo objeto. Foto cortesía de Roberto Maiolino

Roberto Maiolino, de la Universidad de Cambridge, ha dirigido un estudio que ha identificado definitivamente el nuevo objeto. Foto cortesía de Roberto MaiolinoLa posibilidad más emocionante —y polémica— se remonta a una propuesta de 1971 del físico británico Stephen Hawking: que los agujeros negros surgieron en la sopa primordial del propio Big Bang. En tal caso, el objeto habría permanecido en la oscuridad desde los primeros instantes del cosmos, esperando a que las estrellas y galaxias lo iluminaran.

QSO1 es uno de los cientos de objetos similares, apodados “pequeños puntos rojos”, que JWST ha detectado en sus primeros años explorando las profundidades del tiempo. Los astrofísicos aún no pueden afirmar si todos estos puntos son agujeros negros, y en general siguen desconcertados por la caótica infancia del universo. Pero las imágenes del telescopio sugieren un cosmos juvenil y alborotado que fabricó grandes agujeros negros y galaxias tanto en paralelo como de forma independiente, o quizás incluso un universo en el que los agujeros negros fueron de las primeras estructuras de gran escala en existir: burbujas oscuras en un té cósmico por lo demás homogéneo.

QSO1 y el resto de los pequeños puntos rojos “nos dicen que no sabemos nada”, afirma John Regan, teórico de la Universidad de Maynooth en Irlanda. “Ha sido realmente emocionante y electrizante para el campo.”

Puntos rojo pálidoLukas Furtak, astrónomo de la Universidad Ben-Gurion en Israel, supo que QSO1 era extraordinario en el mismo momento en que lo vio —o en que vio sus tres reflejos escondidos entre un cúmulo de manchas blancas de galaxias en una imagen tomada por JWST en 2023. “Es algo que destaca de inmediato”, apunta Furtak por Zoom, señalando tres motas rojas casi imperceptibles. “Aquí hay tres fuentes puntuales rojas: aquí, aquí y aquí arriba.”

En la imagen, una alineación fortuita de galaxias y materia oscura había doblado los rayos de luz de objetos de fondo, como lo haría una lente de cristal; esta “lente gravitatoria” revela objetos más profundos en el universo temprano de lo que el telescopio podría ver por sí solo. La lente amplía y estira lo que hay detrás, creando a veces múltiples imágenes. Furtak estaba cartografiando las formas alargadas de galaxias que la lente había proyectado en varios lugares cuando descubrió los tres puntos rojos de QSO1.

Los puntos le llamaron la atención porque no mostraban signos de estiramiento. Sabía que lo único que sigue viéndose como un punto pequeño y redondo tras ser estirado es algo aún más pequeño y más redondo. No era una galaxia, concluyó: debía de tratarse de un agujero negro, una concentración de masa tan densa que su gravedad crea una región de la que nada puede escapar.

Durante los seis meses siguientes, Furtak y sus colaboradores apuntaron el JWST hacia cada uno de los tres puntos rojos durante 40 horas para obtener un censo de los colores de la luz que emitían, es decir, su espectro. Ese estudio concluyó que QSO1 es muy probablemente un agujero negro brillante que concentra decenas de millones de masas solares en una región de como máximo 100 años luz de diámetro, tal como era cuando el universo tenía solo 750 millones de años. (Hoy el cosmos se acerca a los 14.000 millones de años).

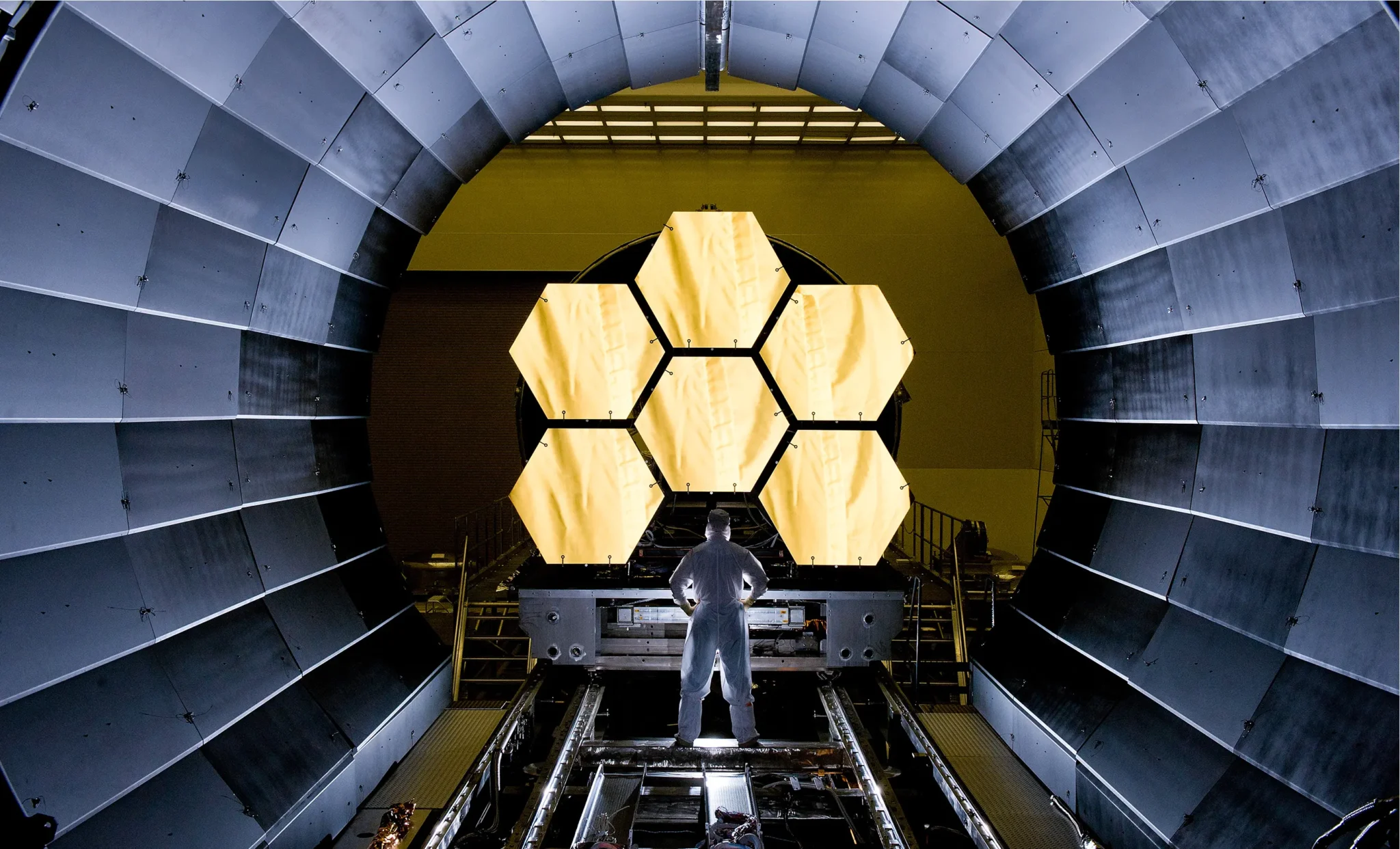

El Telescopio Espacial James Webb, lanzado en 2021, ha detectado cientos de extraños agujeros negros y galaxias en el universo primitivo, revelando los caóticos primeros mil millones de años de historia cósmica. Foto: NASA/MSFC/David Higginbotham

El Telescopio Espacial James Webb, lanzado en 2021, ha detectado cientos de extraños agujeros negros y galaxias en el universo primitivo, revelando los caóticos primeros mil millones de años de historia cósmica. Foto: NASA/MSFC/David HigginbothamQSO1 fue uno de los primeros pequeños puntos rojos descubiertos. Hoy se conocen más de 300, y el debate sobre su naturaleza lleva dos años encendido. Presentan algunas características clásicas de agujeros negros brillantes, pero no todas. Y hasta ahora las estimaciones de sus masas eran algo indirectas. Como resultado, algunos astrofísicos han argumentado —como hizo un grupo en un análisis de más de 100 pequeños puntos rojos en agosto— que en realidad son galaxias extrañas sin agujeros negros.

“El campo ha estado obsesionado con ellos”, destaca Kocevski. “Rara vez se encuentran cosas que no puedes explicar.”

Ampliando el zoomEn diciembre de 2024, Maiolino, junto con Hannah Übler (ahora en el Instituto Max Planck de Física Extraterrestre) y otros colaboradores, enfocaron el JWST en QSO1 durante 10 horas más. Aumentaron la resolución del punto hasta convertirlo en una mancha pixelada y midieron los colores específicos que provenían de cada píxel. A partir de estos espectros calcularon la velocidad a la que el material brillante de cada píxel se movía hacia nosotros o se alejaba. Descubrieron que ese material —probablemente gas caliente— giraba en un torbellino furioso, confirmando los hallazgos preliminares de Furtak.

Su análisis detallado, descrito en dos preprints publicados en mayo y agosto, reveló definitivamente la identidad de QSO1.

Una de las pistas fue su masa. Al reconstruir el torbellino, el equipo midió directamente la masa del objeto alrededor del cual orbitaba: 50 millones de veces la del Sol. Este resultado coincidía con el de Furtak y su equipo. (Este logro ya es un gran avance: sugiere que el método indirecto, basado en el espectro global del objeto, funciona para agujeros negros jóvenes, algo que era motivo de debate).

Hasta la fecha, se han observado más de 300 «pequeños puntos rojos»: objetos misteriosos del universo primitivo que, en algunos aspectos, parecen grandes agujeros negros brillantes y, en otros, galaxias inusuales. Composición cortesía de Jorryt Matthee / Datos de los sondeos EIGER /FRESCO.

Hasta la fecha, se han observado más de 300 «pequeños puntos rojos»: objetos misteriosos del universo primitivo que, en algunos aspectos, parecen grandes agujeros negros brillantes y, en otros, galaxias inusuales. Composición cortesía de Jorryt Matthee / Datos de los sondeos EIGER /FRESCO.Además, el grupo no encontró indicios de una galaxia estrellada alrededor de QSO1. El gas orbita el píxel central igual que la Tierra orbita el Sol, lo que indica que la masa está concentrada en un punto. El equipo estima que el agujero negro representa al menos dos tercios de la masa de QSO1, siendo el resto gas y quizá algunas estrellas dispersas. Regan, que no participó en la investigación, cree que esta estimación es conservadora y que QSO1 podría ser hasta un 90 % agujero negro. “Nunca hemos visto nada parecido”, afirma.

Por último, los espectros píxel a píxel mostraron que el gas que orbita el agujero negro es esencialmente hidrógeno puro, un elemento que se remonta al Big Bang. Las estrellas brillan fusionando hidrógeno en elementos más pesados y, cuando explotan, esparcen esos elementos por todas partes. QSO1 parece haber alcanzado su estado actual antes de que muchas estrellas cercanas vivieran y murieran.

“La explicación más plausible parece ser que el agujero negro se desarrolló antes que la galaxia”,apunta Marta Volonteri, teórica del Instituto de Astrofísica de París que participó en el análisis de QSO1.

Orígenes veladosUna de las principales tareas de los astrofísicos ahora será desentrañar cómo se formaron QSO1 y sus semejantes, y cómo se convirtieron en los agujeros negros supermasivos que hoy se encuentran en el centro de las galaxias. Estos agujeros negros supermasivos, con masas de hasta miles de millones de soles, ya anclaban galaxias al final del primer millardo de años del universo.

Los agujeros negros supermasivos llevan tiempo desconcertando a los astrofísicos. Saben que las galaxias pueden generar agujeros negros cuando sus estrellas más grandes agotan su combustible y mueren. Esos cadáveres estelares se fusionan y devoran gas y polvo, creciendo hasta formar un agujero negro gigante en el centro galáctico. El problema es que todo este proceso lleva tiempo, y resulta difícil imaginar que ocurra lo bastante rápido como para explicar los agujeros negros supermasivos que ya existían cuando el universo tenía apenas mil millones de años. Por ello, los teóricos llevan décadas ideando teorías alternativas sobre su formación.

Lukas Furtak, astrónomo de la Universidad Ben-Gurión de Israel, detectó inmediatamente el QSO1 en un campo de brillantes galaxias blancas. Foto: Sarah Libanore

Lukas Furtak, astrónomo de la Universidad Ben-Gurión de Israel, detectó inmediatamente el QSO1 en un campo de brillantes galaxias blancas. Foto: Sarah LibanoreAhora, QSO1 —que carece de galaxia visible— demuestra que debe de existir otro mecanismo.

¿Cómo podría el universo fabricar directamente agujeros negros gigantescos? El grupo de Maiolino se inclina por la propuesta de Hawking. El Big Bang produjo un universo infantil con regiones más densas que otras. Allí donde la densidad fue suficiente, el colapso directo podría haber formado un agujero negro, que luego crecería absorbiendo materia a su alrededor. Tras cientos de millones de años, algunos de estos agujeros negros “primordiales” podrían haber alcanzado tamaños colosales, parecidos a QSO1.

“Es la explicación más plausible que veo”, reconoce Volonteri. “Pero estoy segura de que en los próximos seis meses habrá mil personas proponiendo otras teorías.”

No tendrán que esperar seis meses. Incluso antes del descubrimiento de QSO1, Priyamvada Natarajan, astrofísica teórica de la Universidad de Yale, y colaboradores habían publicado ya dos teorías no primordiales que podrían explicar el origen de QSO1.

Diversas teorías podrían explicar el misterioso origen de QSO1. Priyamvada Natarajan, teórica de la Universidad de Yale, ha contribuido al desarrollo de algunas de ellas. Sasha Maslov para Quanta Magazine