Revistas predadoras y la Ley de Goodhart

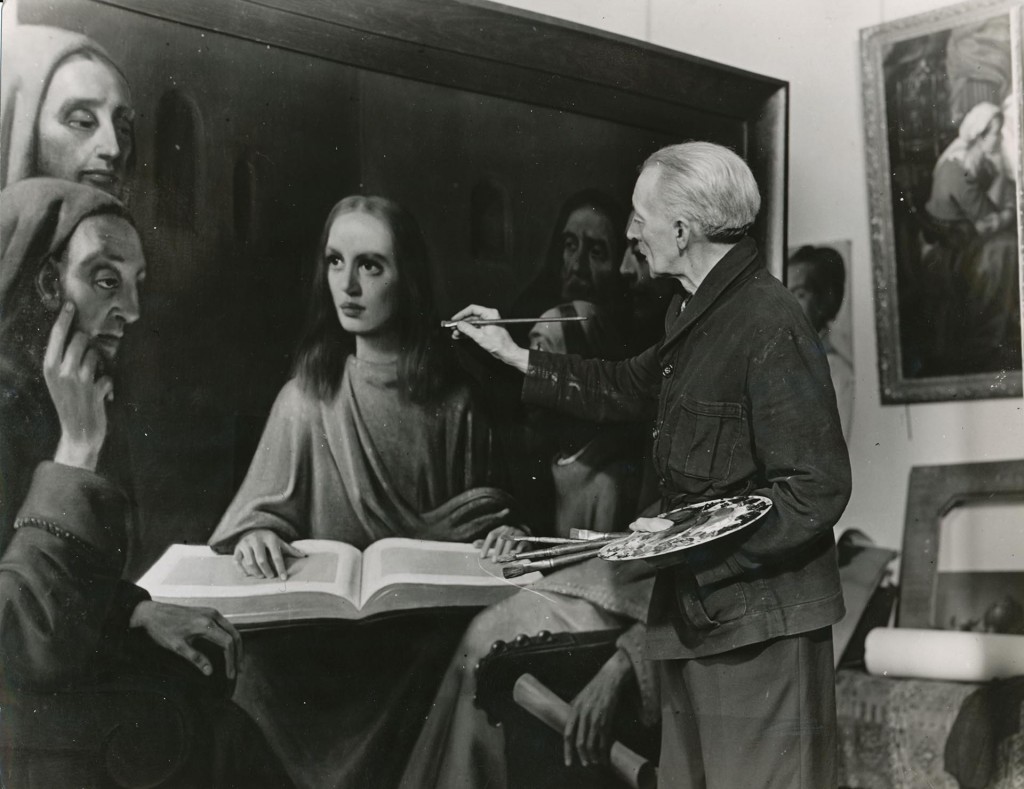

Ilustración de Dusan Petricic

Cuando una medida se convierte en un objetivo deja de ser una buena medida, dice la Ley de Goodhart, bien conocida en el campo de la sociología. Y si lo pensamos un poco es lógico:Los humanos somos, bueno, humanos, de manera que consciente o inconscientemente tendemos a tomar el camino del mínimo esfuerzo hacia el cumplimiento de nuestros objetivos. Si el objetivo es una medida concreta buscaremos la manera de alcanzarla con el menor coste para nosotros, tenga o no tenga sentido desde el punto de vista de la intención original; como en el viejo chiste soviético, si el objetivo de la factoría es hacer 1.000 toneladas de tornillos podemos cumplirlo fabricando un único tornillo de 1.000 toneladas, aunque sea perfectamente inútil y absurdo en el contexto de la planificación global. Y si en algo somos buenos los humanos es en buscar atajos, simplificaciones, recortes y reinterpretaciones para justificar casi cualquier manipulación de esta clase.

Por eso cualquier medida que se designa como objetivo es susceptible de ser retorcida del modo más torticero posible, y por eso deja de ser una buena medida de lo que ocurre en el sistema: porque automáticamente deja de tener valor como indicación objetiva de su estado. Esta es la razón de que el número de publicaciones se haya convertido en una pésima medida del estado de un sistema de investigación, y de la existencia de un nuevo fenómeno como son las famosas ‘revistas predadoras’. Un resultado previsible según la ley de Goodhart.

Si el modo de avanzar en lo profesional y de recibir mejor financiación para la investigación científica es aumentar el número de publicaciones (maximizar esta medida en particular) los científicos se encuentran con un poderoso incentivo para manipular esta variable. Si pueden estirar los resultados de un experimento a tres publicaciones en lugar de a una, lo harán; si pueden maximizar los resultados de su tesis en términos de número de artículos publicados tienen que hacerlo. Si lo que cuenta a la hora de obtener un puesto de trabajo o de conseguir una beca es el número de artículos publicados quien no lleve a cabo este tipo de estrategias resultará perjudicado en la carrera y se quedará atrás. Las plazas, y los proyectos, serán para quien sí lo haga.

Aquí es donde surgen las ‘revistas predadoras’, que simplemente aprovechan esta necesidad de millones de investigadores de todo el mundo para sacar dinero. Lo que ofrecen es simple: publicar artículos de baja o nula calidad de modo rápido y sin muchas preguntas a cambio de dinero. Muchos investigadores cuentan con presupuestos para publicar, ya que algunas revistas (incluso de la máxima calidad) cobran por la publicación. Estas ‘revistas predadoras’ tan sólo obvian la parte cara del asunto: la revisión por pares, el análisis de calidad previo, y proporcionan una vía para a cambio de dinero añadir de modo sencillo una línea al currículo. Dotadas de nombres rimbombantes que suenan legítimos, con frecuencia radicadas en países como China o la India y a veces complementadas por congresos y seminarios de nombre impresionante y calidad nula estas revistas cubren un nicho de mercado: el de los investigadores desesperados por cumplir con el requisito de número de publicaciones que se les impone.

El resultado, por supuesto, es que el sistema completo deja de funcionar. Los criterios de calidad casi han desaparecido reemplazados por criterios basados en la pura cantidad; el dar mayor puntuación a las revistas de alto impacto no basta, porque ahora es el impacto de las revistas lo que se ha pervertido (siguiendo la Ley de Goodhart). Los currículos se alargan y en el fárrago de publicaciones resulta muy difícil separar el grano (las revistas serias que son leídas por otros científicos) de la paja (las predadoras que nadie lee). Los requisitos de mínimos se hacen astronómicos, como los recientes de la ANECA española que de media exigen 130 artículos para cualificarse para la categoría de catedrático. Y la medida, que se supone que sirve para garantizar una producción científica razonable, se hace completamente irrelevante e incluso contraproducente. Hasta tal punto que ahora es necesario luchar contra la proliferación de ‘revistas predadoras’ que, como malas hierbas, amenazan con ahogar el sistema científico convencional.

Sobre el autor: José Cervera (@Retiario) es periodista especializado en ciencia y tecnología y da clases de periodismo digital.

El artículo Revistas predadoras y la Ley de Goodhart se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Flujo de manuscritos entre revistas científicas

- La contradicción de la publicación

- Qué es un dato: la longitud de un hueso

Algo raro pasa alrededor de Gliese 436

En el imaginario colectivo los planetas de un sistema solar giran alrededor de su estrella en el mismo plano, y este plano es también el plano ecuatorial de la estrella. La estrella también gira, y su eje de giro se alinea con los ejes de giro de las órbitas planetarias, dando la impresión de un sistema bien ordenado. Pero el universo es caprichoso en sus creaciones.

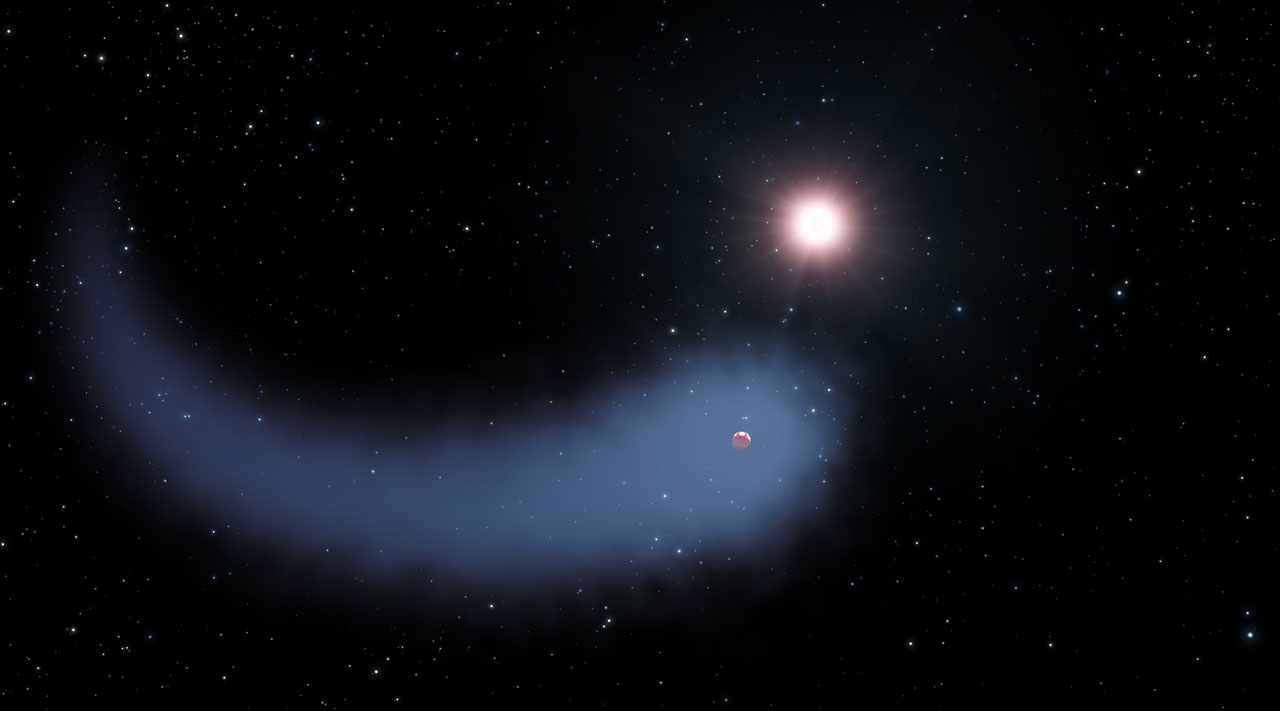

Gliese 436 es una estrella de la que se ha escrito mucho, ya que alberga un planeta del tamaño de Neptuno, Gliese 436b, que se evapora como un cometa. En una investigación cuyos resultados se publican ahora en Nature, un equipo de investigadores encabezados por Vincent Bourrier, de la Universidad de Ginebra (Suiza), demuestran que, además de su enorme nube de gas, el planeta Gliese 436b también tiene una órbita muy especial. Es “polar”: en lugar de orbitar en el plano ecuatorial de la estrella, el planeta pasa casi por encima de los polos estelares.

La inclinación orbital es la última pieza de un rompecabezas que ha desconcertado a los astrónomos durante 10 años: a diferencia de los planetas del Sistema Solar cuyas órbitas forman círculos casi perfectos (aunque sean en realidad elipses), la de Gliese 436b forma una elipse muy plana, es decir, su distancia a la estrella varía mucho a lo largo de su órbita.

Gliese 436b está sometido a enormes fuerzas de marea porque pasa increíblemente cerca de su estrella, apenas el 3% de la distancia que separa la Tierra del Sol. La estrella Gliese 436 es una enana roja cuya vida activa es muy larga, por lo que las fuerzas de marea que induce deberían haber conseguido haber acercado la órbita del planeta a un círculo pero, por alguna razón, no lo ha hecho.

¿Y cual podría ser la causa?

Las arquitecturas orbitales de los sistemas planetarios son registros fósiles que nos dicen cómo se han formado y evolucionado. Un planeta perturbado por el paso de una estrella cercana o por la presencia de otros planetas masivos en el sistema mantendrá un registro, por así decirlo, en su órbita. La existencia de un planeta desconocido, más masivo y distante que lo perturbase explicaría no solo por qué Gliese 436b no está en una órbita circular, sino también por qué está en una órbita polar.

Los mismos cálculos que apuntan a esta conclusión también predicen que el planeta no siempre ha estado tan cerca de su estrella, sino que podría haberse acercado recientemente (en términos astronómicos). Por lo tanto, el “planeta que se evapora” no siempre se habría evaporado, sino que habría sido empujado hacia la estrella por la gravedad de un planeta compañero aún no detectado. La caza no ha hecho más que empezar.

Referencia:

Vincent Bourrier et al (2017) Orbital misalignment of the Neptune-mass exoplanet GJ 436b with the spin of its cool star Nature doi: 10.1038/nature24677

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

Este texto es una colaboración del Cuaderno de Cultura Científica con Next

El artículo Algo raro pasa alrededor de Gliese 436 se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La habitabilidad de las exotierras alrededor de estrellas enanas rojas

- ¿Qué pasa si me río de todo?

- Catástrofe Ultravioleta #16 RARO

¡Es la Aritmética!

El niño y los sortilegios es una fantasía lírica (en dos partes para solistas y coros con orquesta) de Maurice Ravel sobre un libreto de la escritora Sidonie Gabrielle Colette. Se estrenó en Montecarlo el 21 de marzo de 1925 y, un año más tarde, se presentó en el Teatro de la Ópera Cómica de París.

Portada diseñada por André Hellé para la primera edición de la ópera. Imagen: Wikipedia.

En 1916, Jacques Rouché, en ese momento el director de la Ópera de París, solicitó a su amiga Colette que escribiera un libreto para ballet, de ambiente fantástico, sobre los sueños de un niño perseguido por animales y objetos por él maltratados: Ballet pour ma fille. Ravel fue elegido para musicalizar la historia. Pero, debido a problemas personales, abandonó el proyecto hasta 1919, año en que retomó el libreto y descubrió sus posibilidades, decidiendo crear una ópera y no un ballet.

El niño y los sortilegios es una sucesión de cuadros independientes que mezclan diferentes géneros musicales: jazz, foxtrot, ragtime, polka, dúo maullador, vals y música coral. Para reproducir las numerosas onomatopeyas del libreto de Colette, Ravel utilizó instrumentos poco habituales, como un rallador de queso, una carraca con manivela, crótalos, bloques de madera, látigo,…

La obra tiene lugar en el interior de una casa en Normandía. El protagonista, el niño, intenta, con pereza, hacer sus deberes. A ver que las tareas no están terminadas, la madre castiga al niño dejándole como merienda una taza de té y un trozo de pan duro. Al quedarse solo, el protagonista demuestra su enojo rompiendo objetos y maltratando a los animales domésticos. Aburrido, se recuesta sobre un sillón; en ese momento entran en acción los sortilegios a los que alude el título: el sillón comienza a danzar con una silla, los muebles lo imitan enfadados con el protagonista,… El niño, atemorizado, llora. De las páginas de un libro por él destrozado acude una princesa a consolarlo, aunque le reprocha su conducta. Ella desaparece para ocupar su lugar un viejo amenazante, que le plantea problemas matemáticos para resolver: es la Aritmética. Sale la luna, el gato y la gata se unen en un ceremonioso dueto amoroso. Los animales que habitan el jardín desafían y amenazan al niño: entablan extraños diálogos, realizan frenéticas danzas, con tanta euforia que hieren a una ardilla. El niño, conmovido, ayuda al roedor. El resto de los animales, al ver el acto de compasión del protagonista, comienzan a dudar de su maldad. Lo acompañan hasta la casa, finalizando de este modo los sortilegios: el niño regresa al mundo real, reclamando a gritos la presencia de su madre.

En una de las escenas, las matemáticas son las encargadas de atormentar al niño.

[…] (Los patea. Voces chillonas salen de entre las páginas que dejan ver a las gesticulantes figuritas de los números. De un álbum abierto como un techo, salta un viejecillo jorobado, de nariz ganchuda, barbado, vestido con números, sombrero en forma de “pi”, ceñido con una cinta métrica y armado con una regla. Sostiene un libro de madera que golpea cadenciosamente. Baila mientras recita fragmentos de problemas.)

EL VIEJECILLO: ¡Dos grifos de agua fluyen a un tanque! ¡Dos ómnibus dejan una estación a veinte minutos de intervalo, valo, valo, valo! ¡Una campesina, sina, sina, sina, lleva todos sus huevos al mercado! ¡Un mercader de telas, telas, telas, telas, vende seis metros de trapo! (ve al niño y se le acerca de una manera malévola.)

EL NIÑO: (aterrado) ¡Dios mío! ¡Es la Aritmética!

EL VIEJECILLO, LOS NÚMEROS: ¡Tica, tica, tica! (Danzan alrededor del niño multiplicando sus maléficos pases.) Once más seis: ¡veinticinco! Cuatro más cuatro: ¡dieciocho! Siete por nueve: ¡treinta y tres!

EL NIÑO: (sorprendido) ¿Siete por nueve, treinta y tres?

LOS NÚMEROS: (levantando las hojas y chillando) Siete por nueve: ¡treinta y tres! etc.

EL NIÑO: (con audacia) Tres por nueve: ¡cuatrocientos!

EL VIEJECILLO: (balanceándose para mantener el ritmo) Milímetro, centímetro, decímetro, decámetro, hectómetro, kilómetro, miriámetro. ¡Sin fallar! ¡Qué felicidad! ¡Millones, billones, trillones, y fracciones!

LOS NÚMEROS, EL VIEJECILLO: ¡Dos grifos de agua fluyen a un tanque! etc.

LOS NÚMEROS: (hacen bailar al niño con ellos) Tres por nueve: ¡treinta y tres! Dos por seis: ¡veintisiete! ¿Cuatro más cuatro?… ¿Cuatro más cuatro?…Cuatro por siete: ¿cincuenta y nueve? Dos por seis: ¡treinta y uno! Cinco por cinco: ¡cuarenta y tres! Siete más cuatro: ¡cincuenta y cinco! (Giran desenfrenadamente. El niño, aturdido, cae al suelo. El Viejecillo y el coro se retiran.) Cuatro más cuatro: ¡dieciocho! Once más seis: ¡veinticinco!

(El niño se sienta con dificultad. La luna ilumina la habitación. El gato negro se desliza bajo el sillón. Se estira, bosteza y se relame. El niño no lo ve pues, cansado, tiene la cabeza apoyada en un taburete. El gato juega, haciendo rodar una bola de estambre. Se acerca al niño e intenta jugar con su cabeza rubia como si fuera una pelota.)

EL NIÑO: ¡Oh! ¡Mi cabeza! ¡Mi cabeza! […]

Es una lástima que las matemáticas se perciban sistemáticamente como una ‘maldición’… ¡incluso en la ópera!

Os dejo debajo la original versión de Giovanni Munari y Dalila Rovazzani, de esta escena de El niño y los sortilegios:

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo ¡Es la Aritmética! se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Sistemas respiratorios: los pigmentos respiratorios

Cangrejo (Cancer productus ) visto desde abajo. El color púrpura lo proporciona la hemocianina, un pigmento respiratorio.

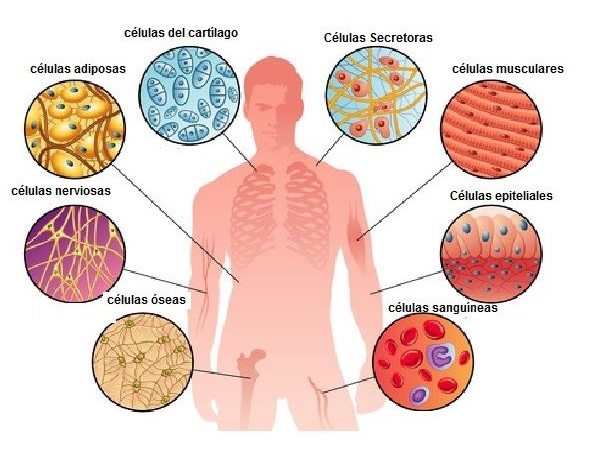

Llamamos pigmentos respiratorios a un grupo de proteínas que tienen la propiedad de combinarse de forma reversible con oxígeno molecular. Por esa razón, pueden transportar oxígeno, captándolo en un lugar y liberándolo en otro. Todos los pigmentos respiratorios son metaloproteínas, o sea, proteínas que contienen átomos metálicos. Y los llamamos pigmentos porque, al menos en algunos momentos, tienen un color intenso.

El O2 tiene una solubilidad relativamente baja en agua, por lo que es muy limitada la capacidad de las disoluciones acuosas, como son la hemolinfa o el plasma sanguíneo, para transportar oxígeno. Gracias a los pigmentos respiratorios de los que los animales se han dotado, la capacidad de la sangre o equivalente para transportarlo es muy superior a la que tendrían sin ellos, y pueden satisfacer las necesidades que se derivan de altos niveles de actividad metabólica. Para hacernos una idea de lo que representa su contribución, 100 ml de sangre humana contienen, al salir del pulmón, 0,4 ml de O2 en forma disuelta y 19,6 ml combinados con la hemoglobina. O sea, la denominada capacidad de oxígeno de la sangre se multiplica por cincuenta gracias a su pigmento. Es cierto que los mamíferos somos los animales en los que la contribución del pigmento es máxima y que en otros puede ser muy inferior, pero en cualquier caso, se trata de una contribución importante.

Cuando un pigmento respiratorio se encuentra combinado con el oxígeno decimos que está oxigenado y, en caso contrario, que está desoxigenado. No utilizamos los términos oxidado y reducido para denominar esos dos estados alternativos. La combinación del oxígeno con un pigmento no es químicamente equivalente a una oxidación. En una oxidación los electrones de los átomos metálicos del pigmento son parcialmente transferidos a la molécula de oxígeno, pero no es una transferencia completa como la que ocurre en una oxidación. De hecho, si la molécula de pigmento se oxidase realmente perdería su capacidad para transportar oxígeno. Utilizamos los prefijos oxi- y desoxi- para denominar a las dos formas del pigmento: oxihemoglobina y desoxihemoglobina, por ejemplo. Hay cuatro tipos o categorías de pigmentos respiratorios: hemoglobinas, hemocianinas, hemeritrinas y clorocruorinas. Cada una de esas categorías agrupa a compuestos relacionados, no a estructuras químicas únicas.

Existen notables similitudes entre la forma en que los pigmentos respiratorios se unen al oxígeno y la forma en que las enzimas se unen a sus sustratos. En ambos casos la unión ocurre en sitios específicos, y se produce mediante enlace débil no covalente. Al unirse el O2 con el pigmento, este modifica ligeramente su conformación, como ocurre con las enzimas. Igualmente, en ambos casos cabe hablar de afinidad, que en este caso refleja la facilidad con la que el oxígeno se une al pigmento. Los pigmentos se puede unir con otras sustancias, también en sitios específicos, y esa unión modifica sus propiedades y la facilidad con que se combina con el oxígeno; a esas sustancias se las denomina moduladores alostéricos. Las moléculas de pigmento suelen estar formadas por dos o más subunidades. Las subunidades son proteínas unidas entre sí mediante enlaces no covalentes. Cada subunidad tiene un sitio de unión para el oxígeno y muestran cooperatividad entre los sitios de unión de las diferentes subunidades. Quiere ello decir que la unión de una molécula de oxígeno al sitio de unión de una subunidad, modifica la facilidad con la que otros sitios se combinan con otras moléculas de O2. Esas variaciones se producen como consecuencia de los cambios conformacionales antes citados.

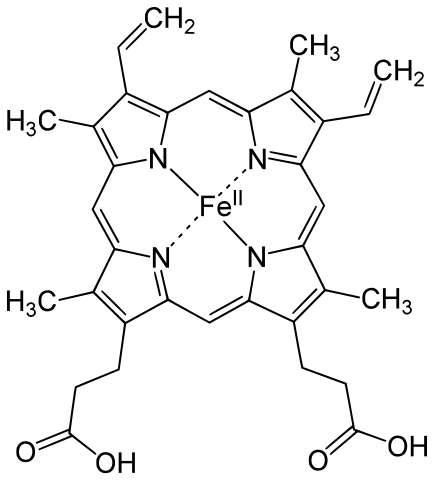

Grupo hemo

Las hemoglobinas y las clorocruorinas consisten en largas cadenas de aminoácidos (globinas) unidas de forma no covalente a sendos grupos prostéticos (grupos hemo) que son metaloporfirinas. El grupo prostético es común a todos los pigmentos de una misma categoría, ya sean hemoglobinas o clorocruorinas, y es ahí donde se produce la unión con el oxígeno. Los pigmentos de una misma categoría difieren en las cadenas polipeptídicas. De hecho, la diversidad de propiedades y funciones de unas y otras hemoglobinas, por ejemplo, tiene su origen en las diferentes estructuras de sus cadenas. Los grupos hemo de las hemoglobinas y de las clorocruorinas son metaloporfirinas en las que el metal es el hierro. Las clorocruorinas tienen la particularidad de ser verdes en disoluciones diluidas y rojas en concentradas. Las hemoglobinas son rojas. Las hemocianinas son la segunda categoría pigmentaria más común. A diferencia de hemoglobinas y clorocruorinas, no tienen grupo hemo. Y además, en vez de hierro contienen cobre, que se encuentra unido directamente a la proteína. El sitio de unión con la molécula de O2 contiene dos átomos de metal. Cuando se encuentran desoxigenadas carecen de color, y cuando están combinadas con el O2 son azules. Por último tenemos las hemeritrinas, que, como las hemocianinas, carecen de grupo hemo. El metal de estas es el hierro, también ligado directamente a la proteína.

Esquema básico de la hemoglobina humana. Se muestran las dos parejas de globinas, α y β, y los cambios de estructura al enlazarse el oxígeno (no mostrado)

El pigmento respiratorio mejor conocido es la hemoglobina humana. La de un individuo adulto consta de cuatro subunidades (se dice que es tetramérica) cuyas globinas están formadas por algo más de 140 aminoácidos. Se conocen más de un centenar de formas mutantes, la mayoría de las cuales solo difiere de la forma normal en un único aminoácido. El peso molecular de las subunidades se encuentra entre 16000 y 17000 daltons. La sangre adulta contiene dos tipos de globinas, denominadas α (141 aminoácidos) y β (146 aminoácidos), de manera que en una molécula de hemoglobina hay dos de cada tipo. Hemos especificado que los datos anteriores corresponden a la hemoglobina de personas adultas, porque a lo largo del desarrollo, desde la fase embrionaria hasta semanas después del nacimiento, cambian de manera notable su composición y características. En otras especies no es raro que coexistan más de una variedad de hemoglobina en la sangre, cada una con diferentes características en lo relativo a su unión con el O2; esa variedad permite a los animales que la poseen transportar oxígeno en un amplio rango de condiciones ambientales.

Fuentes:

Richard W. Hill, Gordon A. Wyse & Margaret Anderson (2004): Animal Physiology. Sinauer Associates, Sunderland

John D. Jones (1972): Comparative physiology of respiration. Edward Arnold, Edinburgh

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo Sistemas respiratorios: los pigmentos respiratorios se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Sistemas respiratorios: los límites a la difusión de los gases

- Sistemas respiratorios: la emergencia de un doble sistema circulatorio

- Sistemas respiratorios: la ventilación de los pulmones de mamíferos

El principio de constancia de la velocidad de la luz

El principio de relatividad es uno de los dos postulados a partir de los cuales Einstein derivó las consecuencias de la teoría de la invariancia, popularmente llamada de la relatividad. El otro postulado se refiere a la velocidad de la luz, y es especialmente importante cuando se comparan las observaciones entre dos marcos de referencia inerciales, aquellos marcos de referencia que están en reposo o se mueven con una velocidad uniforme relativa entre sí, ya que dependemos principalmente de la luz para hacer observaciones.

Cuando Einstein dejó la secundaria a la edad de 15 años, estudió por su cuenta para poder ingresar en el Instituto Politécnico Federal de Zúrich (Suiza). Probablemente fue durante esta época cuando Einstein consideró por primera vez un experimento mental importante. Se preguntó qué pasaría si pudiera moverse lo suficientemente rápido en el espacio como para alcanzar un rayo de luz. Maxwell había demostrado que la luz es una onda electromagnética que se propaga a la velocidad de la luz. Si Albert pudiera viajar en paralelo y a su misma velocidad no vería una onda propagándose. En cambio, vería los “valles” y las “crestas” de la onda fija y estacionaria con respecto a él. Esto contradecía la teoría de Maxwell, en la que no era posible ese paisaje “estacionario” en el espacio libre. De estas y otras consideraciones principalmente teóricas, Einstein concluyó en 1905 que la teoría de Maxwell debía ser reinterpretada: la velocidad de la luz tiene que ser exactamente la misma, debe ser una constante universal, para todos los observadores, independientemente de si se mueven (con velocidad constante) respecto a la fuente de la luz. Esta idea revolucionaria se convirtió en el segundo postulado de la relatividad especial de Einstein, el principio de constancia de la velocidad de la luz:

La luz y todas las demás formas de radiación electromagnética se propagan en el espacio vacío con una velocidad constante c que es independiente del movimiento del observador o del cuerpo emisor.

Lo que Einstein está diciendo es que ya estemos moviéndonos a una velocidad uniforme hacia, o alejándonos de una la fuente de luz, o de si nos movemos en paralelo o no a un haz de luz, siempre mediremos exactamente el mismo valor para la velocidad de la luz en el vacío, que es exactamente de 299.792.458 m/s [1] . A esta velocidad se le dio el símbolo c de “constante”. Si la luz viaja a través del vidrio o el aire su velocidad será algo más lenta, pero la velocidad de la luz en el vacío es una de las constantes físicas universales.

Es importante recordar que este principio solo se aplica a los observadores y las fuentes que están en marcos de referencia inerciales. Esto significa que se están moviendo a una velocidad uniforme o están en reposo uno con relación al otro [2].

Veamos una implicación inmediata de este principio tan simple, en el que empiezan a intuirse las peculiaridades de la teoría de la invariancia que la apartan de nuestro sentido común. Para ello hagamos unos pocos experimentos mentales muy sencillos.

Imaginemos que Mónica está sobre una plataforma con ruedas moviéndose a una velocidad uniforme de 5 m/s hacia Esteban, que permanece estático en el suelo. Mientras Mónica se mueve, arroja una pelota de tenis a Esteban a una velocidad para Mónica de 7 m/s. Esteban la atrapa, pero justo antes de hacerlo, rápidamente mide su velocidad [3]. ¿Qué velocidad obtiene? La respuesta, obviamente, es 5 +7 = 12 m/s, ya que las dos velocidades se suman.

Hagamos otro experimento. Mónica está en la plataforma alejándose a 5 m/s de Esteban. Nuevamente lanza la pelota a 7 m/s para ella a Esteban, quien nuevamente mide su velocidad antes de atraparla. ¿Qué velocidad mide ahora? Esta vez es -5+7 = 2 m/s, donde hemos adoptado la convención de que las cosas que se mueven hacia Esteban tienen velocidad de signo positivo y las que se alejan de signo negativo. Las velocidades se suman de nuevo [4]. Todo muy convencional e intuitivo.

Ahora intentemos estos mismos experimentos usando rayos de luz en lugar de pelotas de tenis. Cuando Mónica se mueve hacia Esteban, le apunta con el haz de un lápiz láser [5]. Esteban tiene un detector de luz que también mide la velocidad de la luz. ¿Qué velocidad de la luz mide? Mónica y Esteban se sorprenden al descubrir que Einstein tenía razón: la velocidad es exactamente la de la luz, ni más ni menos [6]; la velocidad de la plataforma no se ha añadido a c. Obtienen la misma velocidad c cuando la plataforma se aleja de Esteban. De hecho, incluso si aumentan la velocidad de la plataforma hasta casi la velocidad de la luz misma [3], la velocidad de la luz medida sigue siendo la misma, c,en ambos casos. Por extraño que parezca, la velocidad de la luz (o de cualquier onda electromagnética) siempre tiene el mismo valor, c,sin importar la velocidad relativa de la fuente y el observador.

En las próximas entregas veremos algunasde las consecuencias a las que llegó Einstein cuando juntó los dos postulados fundamentales de la teoría de la relatividad especial, el principio de relatividad y el principio de constancia de la velocidad de la luz en el vacío.

Notas:

[1] La exactitud de esta cifra es una convención moderna, ya que la unidad de longitud se deriva de la velocidad de la luz.

[2] El autor comprende que se pone pesado con estas repeticiones, y pide disculpas por ello. Pero considera imprescindible que la persona que lea cualquiera de estas entregas independientemente del resto sea en todo momento consciente de los límites de aplicación de las ideas que se discuten.

[3] Una licencia que permite el hecho de que esto solo sea un experimento mental

[4] Las restas no existen, son siempre sumas, lo que cambia es el signo de los factores.

[5] Asumimos que Mónica evita los ojos de Esteban y que ambos usan protección ocular adecuada durante el experimento.

[6] Despreciamos el pequeñísimo, pero no nulo, efecto del aire sobre la velocidad de la luz para no tener que realizar el experimento en el espacio.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo El principio de constancia de la velocidad de la luz se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El principio de relatividad (y 4): la versión de Einstein

- El principio de relatividad (2): la versión de Galileo

- El principio de relatividad (1): movimiento relativo

El filósofo que baila con las sepias

Antonio Martínez Ron, lector

Encontrar un libro de filosofía que se entienda y que además te atrape con su lectura no es fácil en los tiempos que corren. Y eso es lo que consigue Peter Godfrey-Smith con “Otras mentes. El pulpo, el mar y los orígenes profundos de la consciencia”, publicado por Taurus. Uno de los principales méritos del libro es precisamente el de centrarse en un asunto que no suele ser tema de conversación en el ascensor y convertirlo en algo apasionante. Durante más de 200 páginas el autor nos adentra en la evolución de los sistemas nerviosos y la naturaleza misma de la consciencia a partir de su experiencia con los cefalópodos. ¿Se imagina usted enfrascado en las andanzas de pulpos y sepias en el fondo del mar? Al principio yo tampoco, y terminé lamentando que se el libro se acabara tan rápido.

“Otras mentes” es un libro escrito por alguien que sabe de biología y además sabe pensar, una tarea para lo que la mayoría de nosotros ni sacamos tiempo ni estamos entrenados. Se agradece su sencillez y lucidez a la hora de explicar los procesos evolutivos que han llevado a los seres vivos a desarrollar diferentes soluciones para navegar por el mundo e interactuar con el entorno. Su comprensión sobre estos procesos es tan profunda que uno tiene la impresión de que los explica con más destreza que muchos especialistas con años de divulgación a sus espaldas.

El libro es un soplo de aire fresco por muchos motivos, pero el principal es la magistral mezcla entre dos campos del conocimiento, biología y filosofía, que deberían solaparse con más frecuencia de lo que estamos acostumbrados. A partir de lo que le han enseñado los pulpos en sus horas de inmersión en aguas australianas, Godfrey-Smith es capaz de hacernos pensar en lo que somos nosotros mismos y en lo que otorga al pensamiento consciente su singularidad. Para ello no nos habla de las frías abstracciones y enrevesadas entelequias a las que nos tienen habituados la mala filosofía y la mala neurociencia, sino que toma un punto de partida terrenal y cercano: ¿cómo integran otros seres sus experiencias sensoriales? ¿Cómo sería estar dentro del cuerpo de otra criatura, si es que acaso esto significa algo?

El resultado es como asomarse a un abismo en el que el artificio del “yo” se desvanece por momentos ante la certidumbre de que existen otras integraciones sensoriales cuya naturaleza no terminamos de entender, un viaje fascinante entre sepias con nombres de pintores expresionistas, pulpos que escupen a sus captores y calamares que nos miran con el interés que lo haría un alienígena. Y, sobre todo, un pequeño ejercicio de humildad para recordarnos que no somos únicos y que quizá la vida muestra una particular tendencia a crear sistemas conscientes, no solo aquí, sino en otros rincones del universo.

Ficha:

Autor: Peter Godfrey-Smith

Título: Otras mentes. El pulpo, el mar y los orígenes profundos de la consciencia

Año: 2017

Editorial: Taurus / Colección: Pensamiento

En Editoralia personas lectoras, autoras o editoras presentan libros que por su atractivo, novedad o impacto (personal o general) pueden ser de interés o utilidad para los lectores del Cuaderno de Cultura Científica.

El artículo El filósofo que baila con las sepias se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Jan van Helmont, filósofo por el fuego (1)

- Las cartas de Darwin: El capitán y el filósofo

- ¿Es el universo un holograma?, y otras grandes preguntas de la ciencia actual

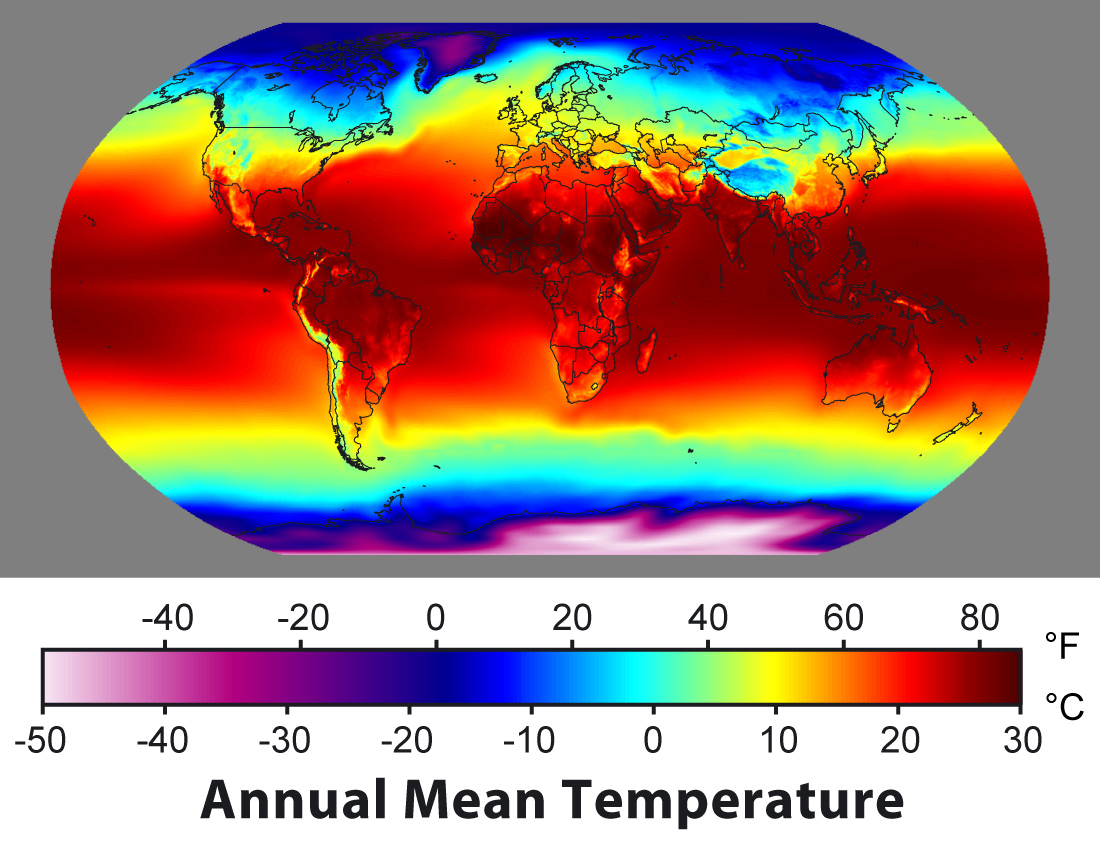

¿Y si el cambio climático nos termina haciendo a todos más simpáticos?

Foto: Pxhere

Tienen las personas nacidas en el sur de España fama de ser alegres, abiertas a lo nuevo, amistosas y ‘echás p’alante’, especialmente comparadas con las del norte, más reservadas, calmadas, y conservadoras. En esto se mezclan los tópicos y las costumbres. También se mezcla la ciencia: según un estudio reciente, la temperatura del lugar en el que crecemos modela nuestro hábitos y con ello nuestra personalidad.

Esto nos sorprende apenas, porque la idea de que el clima afecta a nuestro estado de ánimo no es una novedad: está demostrado que los meses de invierno, más fríos y oscuros, generan estados similares a la depresión, especialmente en países nórdicos donde la luz del sol pasa meses en los que apenas brilla, mientras que al volver el calor los ánimos se elevan y nos sentimos llenos de energía.

El nuevo estudio sugiere que la cosa tiene mucha más miga de la que creíamos, y que el clima puede incluso modelar nuestra personalidad, y esto tendría una consecuencia inesperada: ¿si sigue avanzando el cambio climático, cambiará también nuestra personalidad?

Si tuviésemos que quitar paladas de nieve para salir de casa por las mañanas, ¿seríamos más huraños? Foto: US Air Force.

Pero vayamos por partes. Investigaciones anteriores ya habían señalado que muchos aspectos de la personalidad humana varían de una región geográfica a otra: unas culturas son más acogedoras que otras, unas disfrutan más las actividades en el exterior que otras, unas disfrutan más relacionándose con otras personas que otras… Las causas de estas diferencias era lo que aun estaba por aclarar.

Una posible explicación es la temperatura media a la que viven las distintas culturas. Eso es lo que apunta este estudio, realizado por científicos de la Universidad de Pekín: que puesto que la temperatura es una cosa que varía de forma muy marcada a lo ancho y sobre todo a lo alto del globo, impacta en la personalidad de la gente a través de su influencia en sus hábitos cotidianos. No se trata, según los autores, de mirar simplemente si las personas han crecido en climas fríos o calientes; también de si lo han hecho en climas templados (unos 22 grados de media) o extremos, ya sea por arriba o por abajo.

El paper contempla de hecho dos estudios distintos, llevados a cabo en dos países enormes pero muy diferentes, Estados Unidos y China, para evitar que en las conclusiones se mezclasen otros factores, como las diferencias culturales o económicas que también pudiesen afectar a la personalidad de las personas. Analizaron datos de 5.500 personas de 59 ciudades chinas diferentes, y de 1,66 millones de personas de 12.500 códigos postales estadounidenses. Trazaron relaciones entre sus respuestas a tests de personalidad y las temperaturas medias de los lugares donde habían crecido.

Mapa mundial de temperaturas medias

Los resultados mostraron que las personas crecidas en climas con temperaturas templadas eran generalmente más afables, responsables, emocionalmente estables, extrovertidos y abiertos a nuevas experiencias, y que lo eran en ambos países sin importar su edad, género o ingresos económicos.

“Crecer en temperaturas cercanas a la comodidad psicofisiológica óptima anima a los individuos a pasar más tiempo en el exterior, y por tanto influye en su personalidad”, concluyen los autores.

Claro que aun hay algunas cosas a tomar con cautela en este tema. Por ejemplo, el estudio señala los habitantes de regiones chinas con climas más duros (Heilongjiang, Xinjang o Shandong ) son más colectivistas y se preocupan más por la comunidad, en comparación con sus compatriotas de zonas más templados (Sichuan, Guangdong o Fujian); mientras que los habitantes estadounidenses de zonas más extremas (Dakota del Norte y del Sur, Montana o Minnesota) son más individualistas que sus compatriotas de zonas más templadas (Hawaii, Luisiana, California o Florida).

¿Nos hará el cambio climático más simpáticos, abiertos y emocionalmente estables? Foto: Pxhere

Esto pone de manifiesto que el clima no es la única variable, y que también las condiciones económicas, entre otras muchas cosas, parecen tener algún impacto en cómo somos.

No es solamente que la relación entre clima y personalidad no sea todopoderosa. Es que insinuar que lo es nos pone ante una situación un poco incómoda: ¿si el clima moldea nuestra personalidad, y el clima está cambiando, cambiará nuestra personalidad con él? ¿Nos encaminamos hacia un mundo en el que todos seremos más afables, extrovertidos y aventureros? ¿Tan maleables resultamos por la temperatura?

Los autores son conscientes de este problema, y dejan la puerta abierta a seguir investigando: “a medida que el cambio climático continúa a través del mundo, podríamos observar cambios asociados en la personalidad humana. Las preguntas sobre la extensión de esos cambios esperan respuesta en futuras investigaciones”.

Referencia:

Wenqi Wei, Jackson G. Lu, Lei Wang. Regional ambient temperature is associated with human personality. Nature Human behaviour, 27 de noviembre de 2017. doi: 10.1038/s41562-017-0240-0

Sobre la autora: Rocío Pérez Benavente (@galatea128) es periodista

El artículo ¿Y si el cambio climático nos termina haciendo a todos más simpáticos? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Del cambio climático

- Verdín, eucaliptos y cambio climático

- “El cambio climático: ciencia, política y moral” por José Manuel Sánchez Ron

Las epidemias del pasado… y del futuro

“La plaga de Atenas” de Michiel Sweerts. Alrededor de 1652.

Tras las guerras médicas, finalizadas en 448 a.e.c. con la derrota del ejército persa de Artajerjes I y la Paz de Calias, Atenas se encontraba en su máximo apogeo. Pericles, seguramente la máxima figura política de la Grecia clásica, gobernaba un imperio marítimo y, a decir del historiador Tucídides, lo hacía con talento y prudencia. Y sin embargo, la era de Pericles llegaría a su fin 17 años después, en parte al menos, por una serie de malas decisiones promovidas por el “primer ciudadano”.

En 431 a.e.c. Esparta, que lideraba una confederación de ciudades del Peloponeso, tuvo que apoyar a sus aliadas Mégara y Corinto que habían sido perjudicadas por Atenas, y atacó por tierra con sus hoplitas. Pericles había preparado a Atenas fortificando la ciudad y construyendo los dos “Muros Largos” que protegían el corredor hasta el Pireo, el puerto por el que afluían a la ciudad los suministros que necesitaba. Atenas era inferior a Esparta en tierra, pero tenía la flota más poderosa del Egeo y era, además, muy rica. Cuando la coalición lacedemonia atacó el Ática, las gentes de toda la región se refugiaron en el interior del recinto amurallado. A los 150.000 atenienses se les unieron entre 200.000 y 250.000 nuevos pobladores. En el verano de 430 se declaró una epidemia terrible que asoló la ciudad.

Tenemos noticias precisas de la epidemia gracias a Tucídides, quien sufrió en su persona la enfermedad. Los enfermos se arrastraban por las calles y morían cerca de las fuentes –a donde iban a beber-, y en los templos, donde se hacinaban los refugiados. “Morían como ovejas” escribe Tucídides. Pericles perdió a sus dos hijos legítimos, y él mismo también cayó enfermo y murió en el otoño de 429.

Se desconoce cuál es el patógeno que causó la epidemia. El mal surgió, según Tucídides, en Etiopía; se desplazó por el valle del Nilo hasta Egipto; y desde allí, por mar, llegó a Atenas a través del Pireo. Acabó con la vida de un tercio de los atenienses.

Según el epidemiólogo Paul Ewald, de la Universidad de Louisville (EEUU), la conocida como Gran Plaga de Atenas puede darnos una idea de cómo pueden desarrollarse las enfermedades más peligrosas para los seres humanos en el futuro. Frente a la extendida creencia de que las peores pandemias serán las que causen patógenos procedentes de animales –como el ébola o las gripes aviares- Ewald sostiene que esos patógenos no han convivido suficiente tiempo con los seres humanos como para haber desarrollado mecanismos eficaces para transmitirse entre personas. Los virus y bacterias con que convivimos producen síntomas e inducen respuestas por nuestra parte que facilitan mucho su dispersión.

Por esa razón, Ewald piensa que, en buena lógica evolutiva, es más probable que sean los virus y bacterias con los que más tiempo llevamos coevolucionando, y que han desarrollado buenos mecanismos de dispersión los que, bajo determinadas condiciones, puedan generar peligrosas epidemias. Enfermedades como el cólera, la viruela y las causadas por Staphylococcus aureus serían las mejores candidatas a protagonizar una pandemia peligrosa. Para que eso ocurra bastaría con que su capacidad de transmisión y virulencia se vieran favorecidas, tanto por las condiciones ambientales –grandes números de personas hacinadas- como por la aparición de alguna cepa de especial peligrosidad. Por esa razón, Ewald considera importante evitar condiciones que faciliten a los patógenos aumentar su virulencia y transmisibilidad, como las que se dan en hospitales hacinados o en grandes campos de refugiados. Porque puede que las epidemias del futuro se produzcan de modo similar a como lo hicieron en el pasado.

Fuentes:

Javier Murcia Ortuño (2007): De banquetes y batallas, Alianza Editorial, Madrid.

Wendy Orent (2017): How plagues really work Aeon.

El artículo Las epidemias del pasado… y del futuro se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Otra ventana al futuro

- ¿Se puede predecir el éxito futuro de un científico?

- El futuro ya no es lo que era

Naukas Bilbao 2017 – Guillermo Peris: Los trapecistas del genoma

En #Naukas17 nadie tuvo que hacer cola desde el día anterior para poder conseguir asiento. Ni nadie se quedó fuera… 2017 fue el año de la mudanza al gran Auditorium del Palacio Euskalduna, con más de 2000 plazas. Los días 15 y 16 de septiembre la gente lo llenó para un maratón de ciencia y humor.

Guillermo Peris nos habla de la consecuencias que tienen para los humanos los saltos que pegan dentro del genoma algunos genes, unos trapecistas llamados transposones.

Guillermo Peris ''Los trapecistas del genoma''Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Naukas Bilbao 2017 – Guillermo Peris: Los trapecistas del genoma se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Naukas Bilbao 2017- Daniel Torregrosa: ¡Estamos rodeados!

- Naukas Pro 2017: Carlos Briones y el origen de la vida

- Naukas Bilbao 2017, en directo

¿Son eficientes las plantas de energía marina?

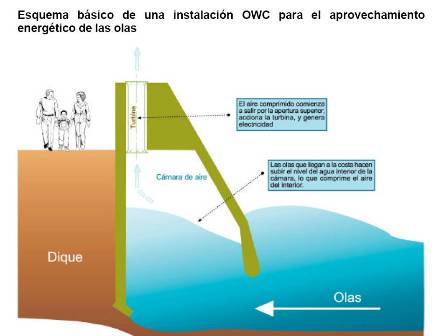

La planta de energía marina o planta undimotriz de Mutriku es la única instalación comercial (no es un prototipo) en el mundo que funciona inyectando energía eléctrica generada por las olas a la red de manera regular. Está en funcionamiento desde el año 2011 y el estudio del grupo EOLO de la UPV/EHU ha analizado su comportamiento en el periodo 2014-2016. “Es importante conocer el funcionamiento real de la planta undimotriz, analizar cómo se comporta la tecnología empleada, y observar qué carencias y ventajas presenta para contribuir en su mejora”, afirma Gabriel Ibarra Berastegi, el autor principal del estudio. “La extracción de energía de las olas se encuentra en sus inicios y varios tipos de dispositivos y tecnologías se encuentran actualmente en desarrollo. Entre ellas, la tecnología OWC (Oscillating Water Column) empleada en Mutriku”, añade.

En la tecnología OWC, no son las olas las que mueven las turbinas directamente, sino una masa de aire comprimido que estas empujan. Se trata de una estructura cuya parte superior forma una cámara de aire y cuya parte inferior está sumergida en el agua. De esta manera, la turbina aprovecha el movimiento provocado por la ola tanto cuando viene como cuando se va, y el generador al que está acoplada inyecta la energía en la red. “Las turbinas generan electricidad que se vende de manera regular a la red eléctrica. En el caso de Mutriku, sucede en el 75% del tiempo. Hay ciertos parones cuando las olas son muy calmadas o incluso cuando son demasiado fuertes”, explica Ibarra.

La investigación se ha centrado en el estudio y análisis de los datos operacionales facilitados por el Ente Vasco de la Energía, que es quien gestiona la planta.

Una vez analizados y ordenados esos datos, “hemos visto que un indicador de rendimiento es el Factor de Capacidad (FC), que permite comparar distintas tecnologías de producción eléctrica”, explica el investigador principal del artículo. “En este caso, hemos calculado el FC de la planta de Mutriku y su valor es de 0,11, mientras que las instalaciones de energía eólica tienen un FC del orden de 0,2-0,3 y las solares de 0,4. Ello indica —apunta Ibarra— que la tecnología OWC de Mutriku necesita mejorar su FC para poder lograr situarse al nivel de los valores del resto de las fuentes de energías renovables”. “Creemos que la manera de lograrlo es mejorar la regulación y control de la velocidad de giro de las turbinas, es decir, gestionar adecuadamente la velocidad con la que gira la turbina en relación a las olas que vienen”, concluye.

Según Gabriel Ibarra, “estas conclusiones obtenidas a partir de los datos de una planta real como la de Mutriku, representan un avance que permite enfocar e identificar los siguientes pasos a dar para que la tecnología OWC alcance su madurez, facilitando así su penetración e implementación”.

Referencia:

G. Ibarra-Berastegi, J. Sáenz, A. Ulazia, P. Serras, G. Esnaola, C. García-Soto (2017) Electricity production, capacity factor, and plant efficiency index at the Mutriku wave farm (2014-2016) Ocean Engineering doi: 10.1016/j.oceaneng.2017.10.018

El artículo ¿Son eficientes las plantas de energía marina? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Robots más eficientes energéticamente sin pérdida de precisión

- Se intuye la conservación de la energía (1)

- Se establece el principio de conservación de la energía

¡Iniesta de mi vida!

Uno de mis objetivos como divulgador científico es mostrar a la sociedad que la ciencia forma parte de sus vidas. Para ello divulgo la importancia del progreso científico en el desarrollo de fármacos, alimentos, ropa, dispositivos móviles y otro instrumentos sin los cuales sería imposible disfrutar de la calidad de vida que tenemos. Creo que entre muchos lo hemos conseguido. Una parte mayoritaria de la sociedad tiene claro que detrás de cada uno de los ejemplos que he citado se encuentra la ciencia. En los últimos tiempos he dado un paso más allá e intento mostrar al ciudadano como el progreso científico y tecnológico también se encuentra en lugares aparentemente alejados del mismo como, por ejemplo, una procesión de Semana Santa, un simple sándwich de queso o la embestida de un toro de lidia. Con ese objetivo hoy toca hablar de la ciencia y tecnología que esconde el deporte rey: el fútbol.

Todos nosotros nos acordamos lo que hicimos en momentos puntuales de nuestras vidas. El atentado de las Torres Gemelas o el golpe de Estado del 23-F son fechas que jamás se nos olvidarán. Tampoco donde estábamos la noche del 11 de julio de 2010, el día que la Selección Española se proclamó por primera y única vez en su historia Campeona del Mundo de Fútbol.

Iniesta celebrando el gol durante la final

Aquel día vi el partido con los ojos del gran aficionado al fútbol que soy pero también, y aunque ustedes no lo crean, con los ojos de un científico. Mi reacción como aficionado no creo que les interese pero sí las dos conclusiones científico-tecnológicas que saqué tras el partido. La primera es que la ciencia se encuentra muy presente en el fútbol moderno. La segunda es que sin el progreso científico y tecnológico poco de lo ocurrido aquella noche en Johannesburgo hubiese sido posible. Se lo demostraré analizando desde el punto de vista de la ciencia y la tecnología lo que ocurrió en el minuto 116 de partido, momento en el que Andrés Iniesta marcó el gol que nos hizo campeones del mundo.

La presencia de la ciencia en el gol de Iniesta comenzó mucho antes de la final de Sudáfrica. Disciplinas como la medicina, la fisioterapia y, sobre todo, la psicología, fueron cruciales para que Andrés marcara el gol que jamás olvidaremos. Los tratamientos psicológicos no solo ayudan a motivar al futbolista. También a mantener la frialdad en momentos de máxima tensión como los muchos que hubo en el Mundial de 2010 donde ganamos casi todos los partidos por la mínima.

¿Y cómo ayudó la psicología a Andrés Iniesta? Ayudándolo a recuperarse muscular y mentalmente de un año dificilísimo. La lesión que sufrió meses antes Iniesta en el Barça y la muerte de su gran amigo Dani Jarque erosionó tanto su estado físico y mental que estuvo a punto de no ser convocado para ir al Mundial. Como Andrés reconoce en este fantástico capítulo del programa “Informe Robinson” el apoyo de médicos y fisioterapeutas, tanto del Barça como de la selección española, fueron vitales para que se recuperara a tiempo… y también para que superara la pequeña lesión que tuvo en el primer partido del Mundial ante Suiza que le impidió jugar el siguiente contra Honduras.

Un partido del que pocos se acuerdan pero que pudo dejarnos sin la copa de campeones del mundo fue el de octavos de final contra Paraguay. Aquel día otra disciplina científica, la estadística, tuvo un papel prioritario. A falta de media hora para el final el árbitro pitó un claro penalti contra España. Si hubiese marcado Cardozo, el jugador paraguayo encargado de lanzar la pena máxima, habría sido dificilísimo remontar. Sin embargo Casillas se lanzó al lado adecuado y detuvo el balón con una seguridad pasmosa.

La intuición y el azar tuvieron mucho que ver pero la ciencia también. Como se observa en el siguiente vídeo Casillas, tras detener el penalti, miró al banquillo y dedicó su decisiva parada a Pepe Reina, el portero suplente. ¿Por qué? Porque antes del partido Reina había estudiado detenidamente la forma de tirar los penaltis de Cardozo. Tras visionar muchos vídeos del jugador paraguayo había llegado a la conclusión de que casi todos los tiraba a la izquierda del portero. Se lo dijo a Iker desde el banquillo antes del lanzamiento, Casillas le hizo caso y atrapó el balón. Pura estadística.

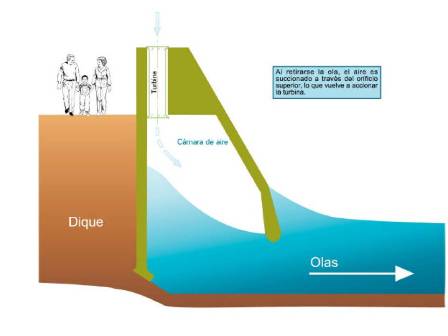

Centrémonos en el gol de Iniesta en la final. La jugada más importante de la historia del fútbol español comenzó en el área española con un pase de Carles Puyol a Jesús Navas que recibió el esférico muy lejos de la portería rival. El balón que se empleó en el Mundial de Sudáfrica 2010, el controvertido Jabulani, ha sido uno de los más discutidos en la historia de los mundiales. Su inestable vuelo fue criticado por muchos porteros que no veían la forma de controlarlo… y es que en el diseño de los balones modernos la aerodinámica tiene mucho que decir. Polímeros como el poliuretano o el etiilvinilacetato se han sumado (y en algunos casos sustituido) al nailon, poliéster, caucho y algodón. Las modernas tecnologías de unión de los materiales que forman los balones les otorgan mayor redondez y mejor resistencia al agua. Además, las ranuras integradas de los modernos balones proporcionan buenas características de vuelo, corrigiendo los errores del Jabulani y haciéndolos más estables.

Jabulani

Tras recibir el esférico de Puyol, Jesús Navas hizo una carrera por la banda de más de 30 metros gracias a su potente zancada… y a la química de los nuevos materiales de las camisetas que mejoran el rendimiento deportivo de los futbolistas. Los jugadores holandeses, al ver que eran mas lentos que el extremo andaluz, intentaron agarrarlo pero no pudieron con la fuerza del sevillano ni con la elasticidad de la camiseta. La presencia en las equipaciones actuales de un compuesto químico como el elastano, también llamado lycra o spandex, las hace más elásticas. Sin esta fibra sintética, que en realidad es un copolímero uretano-urea, Navas no hubiese podido seguir corriendo al ser agarrado. Además, la ausencia de este material o un defecto en la fabricación provoca que las camisetas terminen desgarradas como le ocurrió en la pasada Eurocopa a 7 jugadores de la selección Suiza, lo que trajo nefastas consecuencias para la empresa responsable de la equipación.

El poliéster de las camisetas modernas provoca que sean transpirables y no retengan tanto el sudor como ocurría antiguamente con la ropa de algodón. La final del Mundial de Sudáfrica fue intensísima y tras 120 minutos trepidantes los jugadores acabaron casi deshidratados. ¿Se imaginan que todo el sudor hubiese quedado retenido en la camiseta? Muchos de ellos no hubiesen acabado el partido. Tampoco podemos olvidar la importancia de la presencia en las camisetas del poliuretano, compuesto que actúa como aislante térmico y es resistente al agua. En el Mundial de Fútbol 2010, donde la selección española jugó muchos partidos en condiciones climáticas muy diferentes, su papel fue fundamental.

La química de una camiseta de fútbol

La fantástica conducción del balón que hizo Navas fue posible gracias a la calidad del jugador pero también al buen césped del Soccer City, el campo de fútbol de Johannesburgo donde se jugó la final. La botánica, la biotecnología y la química agrícola ayudan a que los campos actuales se encuentren en perfecto estado y no tengan nada que ver con los irregulares terrenos donde se jugaron otros mundiales anteriormente. Las nuevas variedades de hierba, los fertilizantes y los modernos sistemas de regadío hacen que el balón circule a las mil maravillas.

Sin lugar a dudas, una de las grandes revoluciones del fútbol moderno reside en los campos con césped híbrido. De hecho el Mundial de Sudáfrica 2010 fue el primero donde se empleó este tipo de césped en varias sedes. En el césped híbrido predomina el natural (95%) sobre el sintético (5%) pero las millones de fibras artificiales implantadas por todo el campo tienen un efecto trascendental. Estas fibras se entrelazan con el césped natural logrando que el terreno de juego sea más resistente y más estable a la degradación, permitiendo una frecuencia de juego superior. Además, el césped híbrido tiene una mayor densidad vegetal por lo que el color verde es mucho más intenso. Pero la característica más importante para el futbolista de los céspedes híbridos es que tienen mayor capacidad de amortiguación, lo que reduce el número de lesiones.

Tras su maravillosa carrera Jesús Navas, exhausto, entregó el balón a Andrés Iniesta. El manchego hizo algo de lo que poco se ha hablado pero que fue crucial en el gol. Cuando recibió el balón se encontró rodeado de cuatro jugadores holandeses pero se deshizo de ellos dando un taconazo. Cesc Fábregas, que estaba a su espalda, quedó completamente solo con el esférico. La visión periférica de Iniesta es uno de sus valores añadidos… y también se entrena.

El equipo alemán del Hoffenheim utiliza en sus entrenamientos un sistema llamado ‘Helix’ que pone a prueba la visión periférica de los futbolistas. Se trata de una especie de simulador formado por una pantalla circular de 180 grados en la que van apareciendo jugadores realizando diferentes acciones del juego. Los jugadores, que emplean unas Google Glass en los entrenamientos, deben reconocer quiénes son los oponentes, quiénes son sus compañeros y definir sus acciones para pensar rápidamente cómo crear una situación de pase o cómo dejar atrás a sus rivales.

Cesc Fábregas, el jugador que recibió el balón procedente del taconazo de Iniesta gracias a su visión periférica, es uno de esos jugadores procedentes de La Masía que tienen lo que se conoce como el “ADN azulgrana”. Me refiero a intentar tener la posesión del balón el máximo tiempo posible. Desde que Cruyff fue nombrado entrenador del Barca ese es el sello de identidad del equipo azulgrana que luego adaptaron a la sección española Luis Aragonés y Vicente del Bosque.

Hay dos grandes culpables de que durante todos los partidos de la selección en el Mundial de Sudáfrica la posesión del balón cayera del lado español. Uno de ellos es la gran calidad de sus jugadores… el otro, las matemáticas. La disposición geométrica de los jugadores de “la Roja” a lo largo del terreno de juego fue perfecta y los diagramas de Voronoi (una construcción geométrica que permite construir una partición del plano euclídeo y que en el caso del fútbol muestran el espacio controlado por cada jugador) y las triangulaciones de Delaunay (una red de triángulos conexa y convexa que en el deporte rey conecta los jugadores con líneas), estaban presentes por todo el campo.

La aplicación al fútbol de estos conceptos matemáticos, asociados a la geometría computacional, es la clave de los famosos rondos de la selección que tanto daño hicieron a los rivales. Potentes selecciones como Portugal o Alemania sufrieron muchísimo ante “las matemáticas de la roja”. En el siguiente vídeo, del que tuve conocimiento gracias al blog del gran divulgador Francisco Villatoro, se aprecia la importancia de la geometría en la presión y posterior robo del balón, dos aspectos importantísimos en el juego de la selección española. Tras el saque inicial el equipo rojo presiona, fuerza un error del equipo azul y gana el control del balón. El centrocampista del equipo rojo abre espacio en el centro del campo, logrando tras un par de pases crear una oportunidad que acaba en gol.

Pero además de las matemáticas se necesita algo más para tener la posesión del balón: calidad técnica en los jugadores. Pocas veces se han juntado en un mismo equipo futbolistas con la técnica de Xavi Hernández. Busquets, Silva, Xabi Alonso, Navas, Iniesta, Fábregas, Villa, etc. Sus grandes virtudes son el perfecto control del balón, la rapidez de desplazamiento que imprimen al esférico y la precisión en el pase al “primer toque”, cualidades que muchos equipos entrenan con ayuda de modernas tecnologías.

En el siguiente vídeo se observa cómo hay equipos que emplean el innovador “Footbonaut” en sus centros de entrenamiento. Se trata de una caja de 20 metros cuadrados con cuatro máquinas que ‘disparan’ balones a diferentes velocidades y trayectorias hacia los futbolistas. El jugador tiene que recibir la pelota y en dos toques enviarla hacia el panel indicado de los 64 que tiene la estructura. Este instrumento es fundamental a la hora de realizar transiciones rápidas, con un máximo de dos toques seguidos de pase o tiro.

Mediante aplicaciones informáticas la máquina recoge los aciertos y errores de cada jugador y almacena la información. Posteriormente el entrenador analiza los resultados y elige qué jugadores son los que mejor se adaptan a su sistema de juego… y es que el fútbol no es ajeno al Big Data. Gracias al mismo los entrenadores conocen al instante cuantos pases correctos e incorrectos han dado sus jugadores, la distancia recorrida por cada uno, los futbolistas que mejor se acoplan al sistema defensivo u ofensivo diseñado, etc. El Big Data, que ha entrado de lleno en el fútbol moderno, también le sirve a los clubes para recoger información sobre futuros fichajes.

Sigamos con el gol de Iniesta. Fábregas, tras recibir el taconazo del jugador de Fuentealbilla, devolvió con ese primer toque que ya hemos visto como se entrena el balón a Jesús Navas. El sevillano, exhausto, dio un pase a Fernando Torres. El “Niño” realizó un centro al área buscando a Iniesta que se había desmarcado… pero se equivocó. Torres golpeó el balón suavemente y con el empeine de su pie derecho. El esférico salió en línea recta siguiendo la primera Ley de Newton, según la cual un cuerpo se mueve en la misma dirección y a la misma velocidad hasta que se le aplica una fuerza que lo haga variar de dirección. Como no apareció ninguna fuerza, el balón siguió su trayectoria rectilínea hasta que fue interceptado por un rival.

¿Qué hubiese ocurrido si Fernando Torres hubiese golpeado el esférico con el exterior del pie derecho (en lugar de con el empeine) imprimiéndole más fuerza, elevación y, sobre todo, mayor efecto? Que gracias al Efecto Magnus la pelota hubiese llegado a Iniesta, que se había desmarcado perfectamente buscando la región óptima de Voronoi.

En un lado del balón el aire se hubiese movido en dirección contraria al giro del mismo, aumentando la presión. En el otro lado el aire se movería en la misma dirección del giro de la pelota, creando un área de baja presión. Como consecuencia de la diferencia de presiones hubiese aparecido una fuerza perpendicular a la dirección de la corriente de aire. Esto hubiese provocado que el balón se curvara hacia la zona de baja presión y cambiara su trayectoria, superando a la defensa holandesa y dejando solo a Andrés Iniesta delante del portero gracias a la física del Efecto Magnus.

Para explicar el Efecto Magnus en el fútbol tradicionalmente se muestra el mítico gol de Roberto Carlos a la selección francesa que pueden observar aquí. También se aprecia en un gol de la selección española en el Mundial de Sudáfrica, concretamente en el que marcó David Villa a Chile en el tercer partido del Mundial y que nos dio el pase a octavos de final. En este enlace pueden verlo.

Pero hoy les voy a mostrar una joya donde se aprecia mucho mejor el Efecto Magnus. Se trata del gol que marcó Mohd Faiz Subri, jugador del Penang que milita en la liga de Malasia, y que ganó el Premio Puskas al mejor gol del 2016. Alucinante.

Desgraciadamente en Sudáfrica Torres no golpeó correctamente el balón y este fue interceptado por un defensa holandés. Por fortuna para el equipo español el esférico cayó de nuevo en los pies de Cesc Fábregas que, haciendo gala de su entrenada precisión, dio un pase perfecto a Andrés Iniesta dejándolo solo ante el portero holandés… y se armó la mundial, nunca mejor dicho.

Iniesta golpeó con fuerza el balón, que salió con una aceleración tremenda de su bota derecha y se coló en la portería holandesa… lo que tampoco hubiese ocurrido sin ayuda de los nuevos materiales con los que se fabrican las botas actuales y de su avanzada tecnología. Las botas modernas, mucho más ligeras que las antiguas, han mejorado la fricción entre el pie y la pelota favoreciendo el control, el pase y la precisión del tiro. Además de ser muy ligeras, las nuevas zapatillas se adaptan al pie como un guante y tanto las lengüetas, las suelas y los tacos están preparados para los innumerables disparos, giros y cambios de ritmo del fútbol moderno. Incluso para conseguir que el balón adquiera una gran aceleración ya no hace falta la fuerza con la que los jugadores de épocas pasadas golpeaban el esférico. Los innovadores materiales con los que se elaboran las botas son capaces de conseguir gran aceleración con mucho menor potencia de disparo. El balón disparado por Iniesta salió con tal aceleración de su bota derecha que dobló las manos del portero.

Lo que ocurrió después ya lo saben. Yo me abalancé sobre mi vecino rompiéndole una costilla y mi paisano José Antonio Camacho, en la retransmisión que hizo televisión de la final, gritó la célebre frase que ha quedado grabada para la eternidad: “¡¡Iniesta de mi vida!!”.

Estimados lectores, lo ocurrido en el gol de Iniesta en la final del Mundial de 2010 demuestra que la ciencia, la tecnología y el fútbol van cogidos de la mano… y es necesario que la sociedad sepa que el progreso científico y tecnológico se encuentra presente hasta en los sitios más insospechados. Disciplinas como la medicina, la química, la física, la informática, la fisioterapia, la óptica, las matemáticas, la botánica, el big data, la psicología y muchas otras aparecieron en el momento más importante de la historia del fútbol español que hizo feliz a millones de personas. Más de diez años después los avances científicos y tecnológicos siguen revolucionando el fútbol.

Sin embargo, después de Sudáfrica 2010 no hemos vuelto a ganar un Mundial. ¿Por qué? Porque en el fútbol, al igual que en el mejor de los laboratorios, el progreso científico no se pone de manifiesto si no está detrás el talento humano. A buen entendedor…

Este post ha sido realizado por José M. López Nicolás (@ScientiaJMLN) y es una colaboración de Naukas.com con la Cátedra de Cultura Científica de la UPV/EHU.

El artículo ¡Iniesta de mi vida! se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:El frustrante viaje de un átomo de carbono, mención especial del jurado “On zientzia”

“El frustrante viaje de un átomo de carbono” de Julio Ruiz Monteagudo recibió la mención especial del jurado en la 7ª edición de los premios On zientzia. El ciclo del carbono puede explicarse de muchas maneras, pero pocas serán tan musicales, divertidas y didácticas como este vídeo de poco más de 4 minutos.

¿Tienes una idea genial para explicar un concepto científico en un vídeo? ¿Quieres ver tu trabajo emitido en televisión? La Fundación Elhuyar y el Donostia International Physics Center (DIPC) han organizado la octava edición de On zientzia, un concurso de divulgación científica y tecnológica enmarcado en el programa Teknopolis, de ETB. Este certamen pretende impulsar la producción de vídeos cortos y originales que ayuden a popularizar el conocimiento científico.

On zientzia tendrá tres categorías. El mejor vídeo de divulgación recibirá un premio de 3.000 euros. Para impulsar la producción de piezas en euskera, existe un premio de 2.000 euros reservado a la mejor propuesta realizada en ese idioma. Por último, con el objetivo de impulsar la participación de los estudiantes de ESO y Bachillerato, hay un premio dotado con 1.000 euros para el mejor vídeo realizado por menores de 18 años.

Los vídeos han de tener una duración inferior a los 5 minutos, se pueden realizar en euskera, castellano o inglés y el tema es libre. Deben ser contenidos originales, no comerciales, que no se hayan emitido por televisión y que no hayan resultado premiados en otros concursos. El jurado valorará la capacidad divulgativa y el interés de los vídeos más que la excelencia técnica.

Las bases las encuentras aquí. Puedes participar desde ya hasta el 25 de abril de 2018.

Edición realizada por César Tomé López

El artículo El frustrante viaje de un átomo de carbono, mención especial del jurado “On zientzia” se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Fallos científicos en el cine, mejor vídeo de divulgación joven “On zientzia”

- El mecanismo de la vida, mejor vídeo de divulgación joven “On zientzia”

- Soy esa bacteria que vive en tu intestino, mejor vídeo de divulgación “On zientzia”

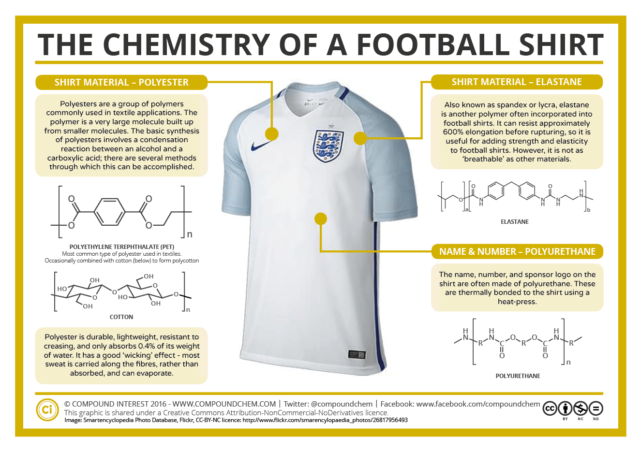

La potencia sin control no sirve de nada

«La potencia sin control no sirve de nada». Este es el eslogan de la que, con toda probabilidad, ha sido la campaña publicitaria de neumáticos más exitosa de la historia. Fue realizada en 1995 por la agencia de publicidad Young & Rubicam para Pirelli.

Uno de los cometidos pretendidos en el diseño de automóviles es que se mantengan pegados a la carretera. Esto se logra sobre todo gracias a la aerodinámica, de manera que, al aumentar la potencia el automóvil no se separe del suelo. Podríamos decir que la aerodinámica de un automóvil sería la contraria a la de un avión.

La aerodinámica es fundamental, sobre todo en los coches deportivos y de competición, pero, no hay que olvidar la importancia de los neumáticos. Mi padre, que se dedicó durante años a la industria del neumático, siempre dice que «los neumáticos son la única parte del coche que está en contacto directo con la carretera», por eso son tan importantes. No le falta razón.

Utilizamos ruedas desde hace miles de años, pero la idea de ponerle caucho en el borde exterior es relativamente nueva. Fue a principios del siglo XIX cuando por primera vez se utilizó este polímero natural para recubrir las ruedas de madera. Antiguamente se enfundaban en cuero o metal.

El caucho se obtiene de varios tipos de plantas, pero principalmente se extrae del látex que surge de los cortes hechos del tronco de Hevea brasiliensis. En la década de 1920 los laboratorios de Bayer inventarían el caucho sintético.

El caucho natural se somete a varios procesos sucesivos como la coagulación, el lavado y el refinado. El caucho natural resulta poco elástico y se reblandece fácilmente con el calor. Se desgasta con rapidez, así que su futuro no parecía muy prometedor.

El químico Charles Goodyear dedicó varios años de su vida a investigar el caucho. En 1839 descubrió el vulcanizado, que es un procedimiento que consiste en calentar el caucho en presencia de azufre en polvo. En resultado final es que las moléculas elásticas de caucho se quedan unidas entre sí mediante puentes de azufre. De esta manera se consigue un caucho más duro y resistente sin perder elasticidad. El vulcanizado es el proceso químico que dio origen a los neumáticos que utilizamos hoy en día.

Desgraciadamente Charles Goodyear no patentó su invento. El ingeniero Thomas Hancock, habiendo llegado más tarde a la misma conclusión se hizo con la patente en 1843. Fue entonces cuando se hicieron populares las ruedas de goma maciza.

Charles Goodyear sigue estando asociado al mundo del neumático debido a que una empresa de éxito de la industria de la automoción tomó su nombre. Sin embargo, esta compañía no tiene ninguna relación con él.

Hasta entonces los neumáticos eran de color claro, por lo que se ensuciaban con facilidad y comprometían la estética. En 1885 la empresa Goodrich decidió fabricar ruedas de color negro. Al tintar el caucho se hizo un descubrimiento sorprendente, los neumáticos negros duraban más. Esto es debido a que el tinte negro absorbe los rayos ultravioletas que son, en parte, los causantes del agrietamiento del caucho.

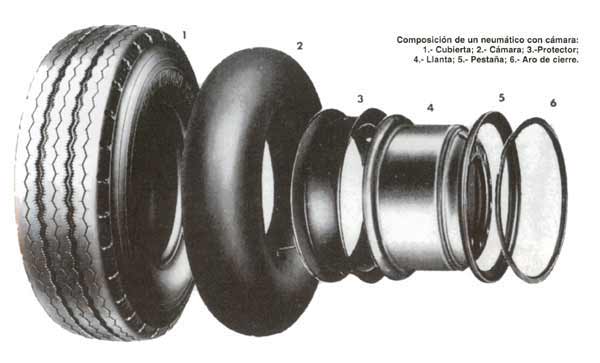

La primera rueda neumática —llena de aire— fue patentada en 1845 por el ingeniero Robert W. Thomson. Sin embargo, no fue hasta 1888 que el ingeniero John Boyd Dunlop, desarrolló el primer neumático con cámara de aire. Lo inventó para envolver las ruedas del triciclo que su hijo de nueve años usaba para ir a la escuela por las calles bacheadas de Belfast. Esas precarias cámaras de aire consistían en unos tubos de goma hinchados. Envolvió los tubos con una lona y los pegó sobre las llantas de las ruedas del triciclo. Patentó el neumático con cámara de aire en 1889. Había ganado en comodidad, aun así, al neumático le faltaban algunos obstáculos por vencer. Era muy trabajoso repararlos, ya que estaban adheridos a la llanta.

En 1891, Édouard Michelin, quien era conocido por su trabajo con el caucho vulcanizado, decidió desarrollar un neumático que pudiera separarse de la llanta y así facilitar el trabajo. Los neumáticos de Michelin resultaron tan prácticos que al año siguiente ya eran los que utilizaban la mayoría de ciclistas. Poco después también los llevarían los carruajes. En 1946, la compañía Michelin desarrolló el método de construcción de neumáticos radiales que supusieron un antes y un después en la conducción deportiva.

En los años 40 se incluyeron nuevos materiales en la composición del neumático, como el rayón, el nailon y el poliéster. Cuando terminó la segunda guerra mundial, se empezó a trabajar en la fabricación de un neumático que sellara herméticamente sobre la rueda, lo que al fin eliminó la necesidad de acompañarlos de cámara de aire. La evolución fue vertiginosa, propiciada en gran medida por la Fórmula 1. En los neumáticos modernos se utilizan más de doscientos materiales distintos, entre ellos el acero, la fibra de carbono o el kevlar. En la actualidad el caucho vulcanizado lo encontramos, sobre todo, en la superficie del neumático.

En automoción —y en otros aspectos de la vida— sigue siendo muy certero eso de que «la potencia sin control no sirve de nada». En las vallas publicitarias y en prensa, bajo este eslogan de Pirelli salía una magnífica imagen del deportista Carl Lewis con zapatos de tacón. En la versión televisiva del anuncio, la planta de sus pies estaba cubierta de caucho.

Y es que, entre otros aspectos ingenieriles, los neumáticos y en consecuencia la ciencia del caucho es fundamental para el control de la conducción. Al fin y al cabo, como dice mi padre, es la única parte del coche que está en contacto directo con el asfalto. Cuando vamos en coche los neumáticos son nuestros pies en el suelo.

Sobre la autora: Déborah García Bello es química y divulgadora científica

El artículo La potencia sin control no sirve de nada se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- ¿La publicidad no sirve para nada?, ¡ja!

- Potencia y eficiencia de una máquina

- Fotovoltaicos siempre a máxima potencia

Una hiperlente que permite ver un virus en la superficie de una célula viva

Imagina que te digo que existe una lente óptica tan potente, una hiperlente, que permite ver detalles del tamaño de un pequeño virus en la superficie de una célula viva en su entorno natural. Suena increíble, tanto más cuanto más sepas de biología o de física, pero existe realmente.

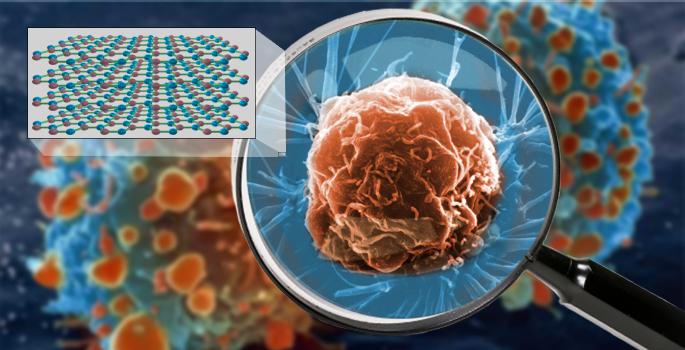

Una representación artística de una hiperlente que permite ver una célula viva con detalle. Arriba a la izquierda, la estructura cristalina del nitruro de boro hexagonal (hBN). Imagen de Keith Wood, Vanderbilt University

La ciencia y la ingeniería han desarrollado muchos instrumentos capaces de producir imágenes con resolución a nanoescala, como microscopios basados en flujos de electrones y otros llamados de fuerza atómica. Sin embargo, estos instrumentos son incompatibles con organismos vivos, ya que, o bien operan bajo un alto vacío, o exponen las muestras a niveles nocivos de radiación, o requieren técnicas letales de preparación de muestras como la liofilización o extraen las muestras de su entorno natural basado en disoluciones.

La razón principal para desarrollar las llamadas hiperlentes (lentes ópticas con una resolución mucho menor que la longitud de onda de la luz empleada) es la posibilidad de que pudiesen proporcionar imágenes detalladas de las células vivas en sus entornos naturales utilizando luz de baja energía que no las dañe. El trabajo realizado por un equipo de investigadores encabezado por Alexander Giles, del Laboratorio de Investigación Naval de los Estados Unidos, ha llevado la construcción de hiperlentes un paso más allá simplemente purificando el material a niveles que hace unas décadas eran inimaginables.

El material óptico empleado es el nitruro de boro hexagonal (hBN), un cristal natural con propiedades de hiperlente. La mejor resolución que se había conseguido previamente usando hBN fue de 36 veces más pequeña que la longitud de onda infrarroja utilizada: aproximadamente el tamaño de la bacteria más pequeña. El nuevo trabajo describe mejoras en la calidad del cristal que mejoran su capacidad en un factor de diez.

Los investigadores lograron esta mejora al fabricar cristales de hBN usando boro isotópicamente purificado. El boro natural contiene dos isótopos que difieren en peso en aproximadamente un 10 por ciento, una combinación que degrada significativamente las propiedades ópticas del cristal en el infrarrojo.

Los científicos calculan que una lente hecha de su cristal purificado puede, en principio, capturar imágenes de objetos de 30 nanómetros de tamaño. Para poner esto en perspectiva, un pelo humano tiene entre 80.000 y 100.000 nanómetros de diámetro. Un glóbulo rojo humano tiene aproximadamente 9.000 nanómetros y los virus varían de 20 a 400 nanómetros.

La física de las hiperlentes es bastante compleja. El nivel de detalle con el que los microscopios ópticos pueden generar imágenes está limitado por la longitud de onda de la luz y el índice de refracción del material de la lente. Cuando esto se combina con los factores de apertura de la lente, la distancia desde el objeto a la lente y el índice de refracción del objeto bajo observación, se traduce en un límite óptico típico de aproximadamente la mitad de la longitud de onda utilizada para la obtención de las imágenes.

En las longitudes de onda infrarrojas utilizadas en este experimento, este “límite de difracción” es de aproximadamente 3.250 nanómetros. Este límite puede superarse mediante el uso de hBN debido a su capacidad para soportar polaritones de fonones superficiales, partículas híbridas formadas por fotones de luz que se acoplan con átomos del cristal que poseen carga y vibran. Estos polaritones tienen longitudes de onda mucho más cortas que la luz incidente.

El problema con el uso de polaritones ha sido siempre la rapidez con la que se disipan. Mediante el uso de cristales de hBN hechos con un 99% de boro isotópicamente puro, los investigadores han podido comprobar que existe una reducción drástica de las pérdidas ópticas en comparación con los cristales naturales, es decir, que aumenta el tiempo de vida del polaritón, lo que les permite viajar el triple de distancia. Este mayor recorrido se traduce en una mejora significativa en la resolución de las imágenes. El análisis teórico de los investigadores sugiere que es posible incluso otro factor de mejora de diez adicional.

En 1654, Anton van Leeuwenhoek utilizó uno de los primeros microscopios para descubrir el mundo desconocido hasta ese momento de la vida microscópica. Este resultado en el desarrollo de hiperlentes es un paso importante para llevar el descubrimiento de van Leeuwenhoek a un nivel completamente nuevo, que permitirá a los biólogos observar directamente los procesos celulares en acción, como virus invadiendo células o células inmunes que atacan invasores extraños, abriendo innumerables posibilidades en la investigación biomédica.

Referencia:

Alexander J. Giles et al (2017) Ultralow-loss polaritons in isotopically pure boron nitride Nature Materials doi: 10.1038/nmat5047

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

Este texto es una colaboración del Cuaderno de Cultura Científica con Next

El artículo Una hiperlente que permite ver un virus en la superficie de una célula viva se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Otra pieza en el puzle de la fotosíntesis

- Cómo fabricar hielo extraterrestre y verlo molécula a molécula

- Estroncio en la leche

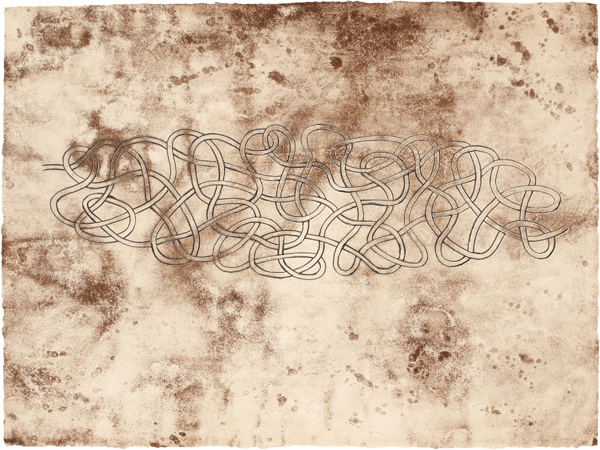

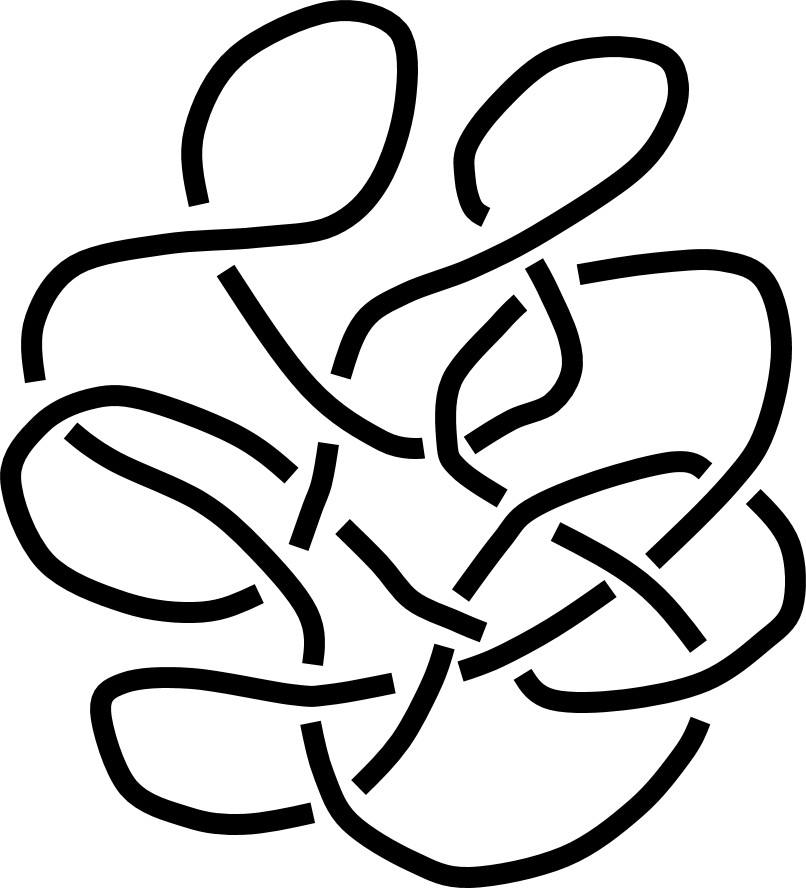

La artista Anni Albers, The Walking Dead y la teoría de nudos

Las personas que han visitado durante las últimas semanas el Museo Guggenheim de Bilbao han tenido la suerte de poder disfrutar de una exposición interesante e inspiradora, “Anni Albers, tocar la vista” (6 de octubre de 2017 – 14 de enero de 2018). Esta exposición nos acerca a la obra de la artista de origen alemán, afincada en Estados Unidos, Anni Albers (1899-1994), quien seguramente sea la artista textil más importante del siglo XX, aunque también trabajó otras técnicas como el grabado, la pintura o el diseño de joyas.

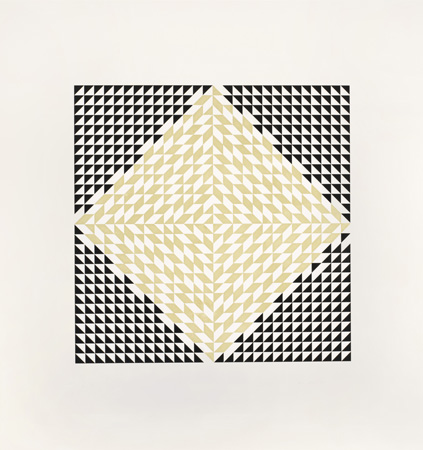

Anni Albers, “Estudio para Colgadura no realizada” (sin fecha), Gouache sobre papel, The Josef and Anni Albers Foundation

La exposición está compuesta por alfombras y colgaduras textiles, telas, diagramas geométricos, dibujos y estudios para el diseño de obras textiles, joyas, aguatintas, litografías, serigrafías e impresiones offset, acuarelas y otros tipos de pinturas, en las cuales la geometría juega un papel fundamental.

Las personas que deseen más información sobre la exposición pueden visitar la página del Museo Guggenheim-Bilbao Anni Albers, tocar la vista o ver los cuatro videos que el museo ha colgado en su canal de youtube y que están aquí.

Anni Albers, “Segundo movimiento V” (1972), Aguatinta, The Josef and Anni Albers Foundation