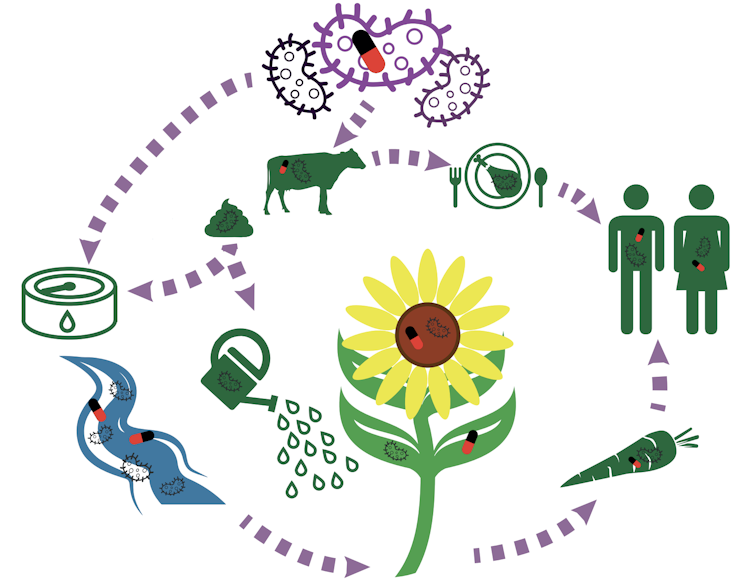

Materia microbiana oscura

Foto: Dariusz Sankowski / Pixabay

Foto: Dariusz Sankowski / PixabayLa visión que tenemos acerca de la distribución de la vida en la Tierra empezó a cambiar cuando en 1977 un sumergible descubrió en el lecho del Océano Pacífico una fuente hidrotermal (fumarola) llena de vida. A partir de entonces, los descubrimientos se sucedieron, tanto en nuevas fumarolas con comunidades complejas en su entorno, como en otros enclaves verdaderamente extraños.

Los lugares más inesperados en que se han hallado seres vivos han sido, quizás, los que se encuentran en el interior de rocas a gran profundidad. Hay formas microbianas a unos pocos metros por debajo de la superficie terrestre y del fondo marino, y las hay a profundidades mucho mayores. Se han hallado bacterias y arqueas a 5 km bajo tierra en China. También se han encontrado microbios a 2,5 km por debajo del fondo del mar.

Hay toda una biosfera en el interior de las rocas, dentro de sus grietas y poros. Se ha estimado que todos esos organismos se distribuyen en un volumen de roca de 2 mil millones de km3 (el doble del volumen que ocupan todos los océanos de la Tierra), y alcanzarían un número de 1030 células, lo que representa un 70% del total de vida microbiana en la Tierra. De hecho, la mayor parte se encuentra en esa biosfera subterránea, formada por bacterias y arqueas en su mayor parte aunque también hay algas unicelulares y hongos.

Una pequeña parte de esos microorganismos son heterotrofos, lo que quiere decir que se alimentan de materia orgánica; y como viven en entornos en los que hay muy poco oxígeno o no lo hay en absoluto, lo más normal es que muchos sean anaerobios. No obstante, la mayoría son quimiolitotrofos: utilizan sustancias inorgánicas como fuente de energía. Esos microorganismos generan residuos que son la base de una cadena trófica en la que participan otros seres vivos. En al menos un caso, esa red trófica incluye un animal que actúa como superpredador, el gusano nemátodo Halicephalobus mephist, de medio milímetro de longitud, que fue hallado en 2011 en una mina de oro a 1.300 m bajo tierra.

Hay zonas con gran diversidad de formas de vida, pero en otras hay muy pocas o, incluso, una sola especie. A 2,8 km bajo la superficie terrestre, en la mina de oro sudafricana de Mponeng se ha encontrado el ecosistema más singular que se conoce: más del 99,9 % de los organismos pertenecen a una única especie, la bacteria Desulforudis audaxviator.

Y aún hay muchísimos seres vivos por descubrir bajo el suelo, organismos con una biología muy diferente a la que conocemos. Seguramente tienen vías metabólicas desconocidas, y lo más probable es que su metabolismo sea muy lento. En 2010 se descubrieron microbios enterrados en los sedimentos del Pacífico Sur de los que se ha estimado que llevaban allí 100 millones de años. Estaban vivos, aunque su actividad metabólica era extraordinariamente baja.

El metabolismo de los microorganismos varía con la composición química de las rocas en las que viven. O sea, depende de si la roca es, por ejemplo, granito, basalto, arenisca o arcilla. Debido a esa heterogeneidad metabólica las comunidades microbianas varían mucho entre diferentes localidades, precisamente porque las rocas son distintas en unos lugares y otros.

Han denominado materia microbiana oscura a esta biosfera subterránea por analogía con la materia oscura del Universo. Pero la microbiana ya la hemos empezado a conocer. Y no debería descartarse que su presencia no se limite a nuestro planeta: el subsuelo de Marte podría albergar su propia biosfera.

Fuente: Graham Lawton (2019): Earth’s deep, dark secret. New Scientist 242 (3229): 42-45

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo Materia microbiana oscura se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- #Naukas14 Espadas romanas para detectar materia oscura

- ¿Está la materia oscura detrás de las extinciones masivas?

- Ondas gravitacionales en la materia oscura

Atención: qué es y cómo educarla

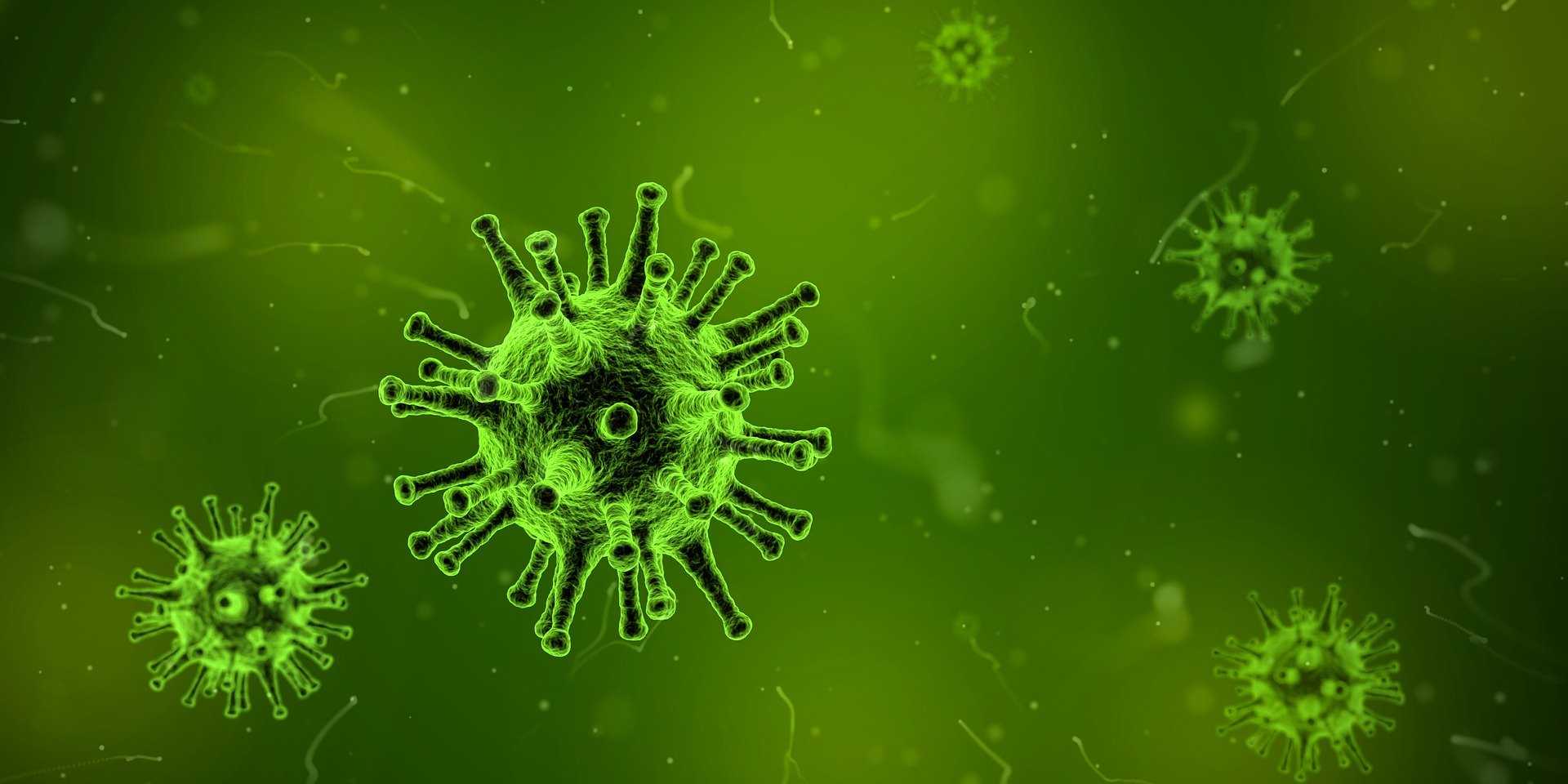

Vitoria-Gasteiz acogió por primera vez el pasado 18 de octubre el evento Las pruebas de la educación, una jornada que abordó diversos temas educativos desde la evidencia científica. El acto, organizado por el Consejo Escolar de Euskadi y la Cátedra de Cultura Científica de la UPV/EHU, tuvo lugar en el Salón de Actos del Centro de Investigación Micaela Portilla, ubicado en el Campus de la capital alavesa de la UPV/EHU.

La jornada consta de un total de cinco charlas que tratan temas como el rendimiento académico, los métodos de aprendizaje y la innovación educativa, entre otros. La dirección del seminario corre a cargo de la doctora en psicología Marta Ferrero.

Charo Rueda, catedrática de psicología experimental en la Universidad de Granada, explica en esta charla cómo diversos estudios científicos avalan que la atención del alumnado puede mejorarse a través de intervenciones educativas.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Atención: qué es y cómo educarla se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Un estudio dice que…

- Cómo destruir un buen sistema de educación. El ejemplo sueco

- El error como ocasión de aprendizaje

Radiografía de un cerebro enganchado al móvil

Foto: Omar Prestwich / Unsplash

Foto: Omar Prestwich / UnsplashDurante los últimos años, el empleo de las nuevas tecnologías se ha extendido con fuerza en la sociedad. Está prácticamente generalizado el uso de internet en toda la población, principalmente entre los más jóvenes. Según datos de la encuesta del Ministerio de Sanidad ESTUDES 2018, el 99,6 % de los estudiantes de 14 a 18 años había utilizado internet en los últimos 12 meses.

El principal problema radica en que se puede pasar fácilmente de un uso generalizado de las nuevas tecnologías a un abuso de las mismas. Se ha detectado que el uso compulsivo de las nuevas tecnologías (internet, teléfono móvil, juegos online…) es un fenómeno creciente de nuestro tiempo, sobre todo, en los grupos de gente más joven.

Las últimas encuestas ESTUDES muestran que mientras casi un 3 % de la población de 15 a 64 años hace un uso compulsivo de internet, la prevalencia de este problema es siete veces mayor entre los estudiantes de 14 a 18 años.

El uso patológico de las nuevas tecnologías ha trascendido en los últimos años la consideración de trastorno del control de impulsos para encuadrarse dentro de las adicciones de comportamiento o sin sustancia. Se acepta que tiene una base común con el resto de conductas adictivas clásicas. Esta raíz común hace que la prevalencia de consumo de drogas como el alcohol y el cannabis sea superior entre los individuos que realizan un uso compulsivo de internet.

¿Qué pasa en el cerebro?

Conocemos desde tiempo atrás los mecanismos cerebrales que median la adicción a sustancias como el alcohol, la cocaína o el tabaco. Pero la aparición de estas nuevas adicciones sin sustancia ha obligado a los investigadores a repensar los mecanismos que podrían explicar este nuevo fenómeno.

En las personas que presentan dependencia a las nuevas tecnologías se han observado cambios estructurales y/o funcionales en regiones cerebrales como la corteza prefrontal, cingular, orbitofrontal y el sistema límbico. Estas zonas alteradas están implicadas en el procesamiento de fenómenos como la recompensa, la motivación o el control de impulsos.

Alteraciones similares aparecen también en personas con otros tipos de adicciones asociadas a drogas de abuso clásicas como la cocaína o las anfetaminas. El riesgo de aparición de estos trastornos es mayor entre los adolescentes porque las regiones cerebrales implicadas no han terminado de madurar a estas edades y son más vulnerables.

Estos déficits estructurales conllevan también un peor funcionamiento de estas regiones cerebrales. Aumenta la impulsividad, disminuye el control del comportamiento y crece la dificultad para tomar las decisiones más acertadas. Todos estos fenómenos contribuyen a generar un mayor riesgo de desarrollar una dependencia de las nuevas tecnologías.

Foto: Gaelle Marcel / Unsplash

Foto: Gaelle Marcel / UnsplashCaracterísticas de las personas más vulnerables

También se ha descrito en los sujetos que abusan de las nuevas tecnologías la existencia de alteraciones neuroquímicas y genéticas que podrían contribuir a una mayor vulnerabilidad de estas personas a convertirse en dependientes de estas tecnologías. Factores como la existencia de estados emocionales alterados, una baja autoestima, una falta de identidad o una personalidad tímida o insegura pueden ser también factores de riesgo a tener en cuenta para valorar el peligro de desarrollar una dependencia a las nuevas tecnologías.

Como consecuencia de esta dependencia pueden aparecer síntomas ansiosos, irritabilidad, desajuste emocional y problemas en la interacción social. Los adictos a las nuevas tecnologías descuidan habitualmente sus rutinas diarias para permanecer más tiempo conectados, o bien sustraen horas al sueño nocturno, invirtiendo el ritmo circadiano. La cantidad y la calidad de su sueño son peores que en la población general. Esto disminuye el rendimiento académico o laboral asociado a la falta de concentración.

Permanecer conectados a la red más de 3 o 4 horas diarias facilita el aislamiento de la realidad, el desinterés por otros temas, los trastornos de conducta, así como el sedentarismo y la obesidad. También puede generar alteraciones físicas como sequedad de ojos, pérdida de audición, dolor de cuello y de espalda o inflamación e incluso artrosis de la articulación de la base del dedo pulgar. No basta con tratar estas afecciones de manera directa si no modificamos los hábitos que las han provocado. Si no lo hacemos, volverán a aparecer.

Es importante conocer tanto los mecanismos que median la dependencia a las nuevas tecnologías, como los factores de riesgo para su aparición. El objetivo es poder aplicar políticas de prevención eficientes y centradas en los grupos de población más vulnerables.

Una educación adecuada basada en la información veraz y en las evidencias científicas puede ser clave a la hora de reducir el riesgo de generalización del abuso de las nuevas tecnologías.![]()

Sobre el autor: Luis F. Callado es profesor agregado de farmacología en la Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Radiografía de un cerebro enganchado al móvil se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Nuevas tecnologías para el estudio del cerebro: Desde Cajal a nuestros días

- La dependencia entre conectividad estructural y funcional en el cerebro

- Daños estructurales por consumo de alcohol en el cerebro humano

El sonido de la tristeza

Foto: Mariana Vusiatytska / Unsplash

Foto: Mariana Vusiatytska / UnsplashEven when listening to music made by instruments rather than the human voice, we treat music as a virtual person and attribute to it an emotional state and sometimes a personality and intention. It is also now clear why so much of music is structured as if a conversation is taking place within the music itself, and why we often intuitively feel that a piece of music should have a meaning attached to it, even though we cannot grasp what that might be.[*]

Steven Mithen. The singning Neanderthals.

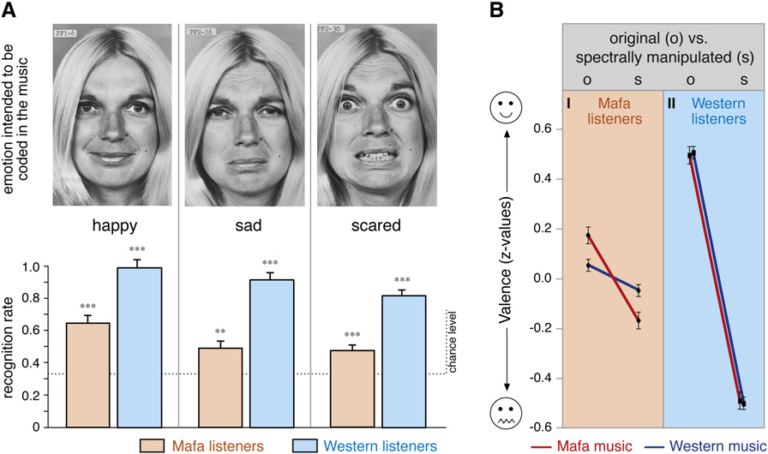

Los humanos somos bastante buenos reconociendo emociones y usos en contextos musicales desconocidos, al menos, cuando se trata de decidir entre emociones básicas como la felicidad, el miedo o tristeza1. La aprenciación de estas emociones y, en concreto, el disfrute de la música triste tiene, además, mucho que ver con nuestra capacidad para la empatía2.

Parece que la música nos pone tristes, no porque sea en sí misma portadora de malas noticias o porque nos inflija dolor de manera directa, sino por una especie de contagio emocional. La cuestión es, ¿por qué habríamos de empatizar con algo así?, ¿por qué sentir lástima por un violín con corazón de madera?, ¿sufren acaso las ondas de presión en el aire?

El motivo es que existen otro tipo de ondas con las que estamos más acostumbrados a congeniar: las ondas que forman las voces de otros humanos tristes.

El lenguaje, de hecho, tiene su propia melodía: su tono, su ritmo y sus cadencias. Todo lo que no son estrictamente letras y símbolos, todo lo que se pierde cuando uno pasa del habla al papel (todo lo que se añadiría a este texto, si lo dibujase en el aire una voz)… constituye lo que en ligüística se conoce como prosodia. Y la prosodia —las melodías del habla— se utiliza, precisamente, para comunicar emociones de un modo que a menudo parece trascender las barreras culturales.

Imagina que escuchas una conversación en japonés, finlandés o húngaro. Incluso sin entender ni una palabra del contenido, probablemente lograrías identificar, grosso modo, los estados emocionales de sus hablantes; quién está enfadado, contento o desanimado. Incluso, sin ver sus caras: cuando hablamos por teléfono, podemos adivinar cuando la persona al otro lado nos sonríe (o todo lo contrario) simplemente por cambios en el tono de voz, el ritmo y la forma de hablar. Son pistas que se repiten de manera parecida en todos los idiomas, a lo largo y ancho del planeta.

Y las misma pistas se repiten también en la música. Cuando escuchamos una canción, inferimos la emoción basándonos en claves melódicas que imitan la prosodia humana.

¿Cómo suena, entonces la tristeza en una voz?, ¿qué es lo que la hace tan reconocible al oído, traspasando incluso las barreras culturales? De acuerdo con el profesor David Huron, el sonido de la tristeza es producto del estado fisiológico del humano triste que la padece. Y ese estado se caracteriza, principalmente, por su bajo nivel de excitación: una especie de falta de energía generalizada.

Imaginemos, por un momento, a ese humano triste. Al pobre le pesan los brazos, sus hombros se deploman perezosamente y desembocan sin muchas ganas en los flecos de las manos. Es probable también que arrastre los pies. Se diría que su espalda está hecha de huesos blanditos porque apenas consigue mantenerse erguido. El bipedismo ha dejado de ser un equilibrio fácil de alcanzar. En consecuencia, es normal que la posición preferida del humano triste sea estar tumbado, hecho una bolita quizás. Y con una manta suave porque, con el bajón de actividad, es probable que haya empezado a pasar frío.

Su cara misma representa una derrota contra la gravedad. Los párpados cuelgan a media asta. La sonrisa se desinfla y deja caer, a sus lados, las mejillas. Nada merece el esfuerzo de abrir la boca o mover la lengua para articular. Muchos menos, tensar las cuerdas vocales. En consecuencia, el humano triste balbucea, habla bajito, en un rango más grave de lo normal, con pocos cambios de tono y pocos brillos en la voz.

El humano triste es, en definitiva, un humano al que le han quitado las pilas. Por eso, no es de extrañar que la tristeza se confunda tan a menudo con el cansancio —”¿qué te pasa, estás triste? no, sólo un poco cansada”—, incluso a nivel subjetivo. Y tampoco es de extrañar que todos los discos de “música relajante” del mundo incluyan temas más bien tristes (escritos por Erik Satie en un 80% de los casos, según una estadística que me acabo de inventar).

Sin embargo, no todos los temas tristes valen. Ninguna antología para la hora de la siesta incluiría el Adagio de Barber, por ejemplo, por muy lento y lánguido que suene al principio… según nos acercamos al clímax, la calma se pierde, la tensión se vuelve dolorosa, algo cambia. No todas las tristezas son mansas. Y para distinguirlas usando los oídos, hace falta hilar más fino.

Nota:

* Incluso cuando escuchamos música hecha por instrumentos en lugar de la voz humana, tratamos la música como una persona virtual y le atribuimos un estado emocional y, a veces, una personalidad e intención. Queda ahora claro también por qué gran parte de la música está estructurada como si una conversación se llevara a cabo dentro de la música misma, y por qué a menudo intuitivamente sentimos que una pieza musical debe tener un significado, aunque no podamos comprender qué puede ser.

Referencias:

1Thomas Fritz et al. “Universal Recognition of Three Basic Emotions in Music”. Current Biology, 2009.

2Ai Kawakami, Kenji Katahira. “Influence of trait empathy on the emotion evoked by sad music and on the preference for it”. Frontiers in Psychology, 2015

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo El sonido de la tristeza se ha escrito en Cuaderno de Cultura Científica.

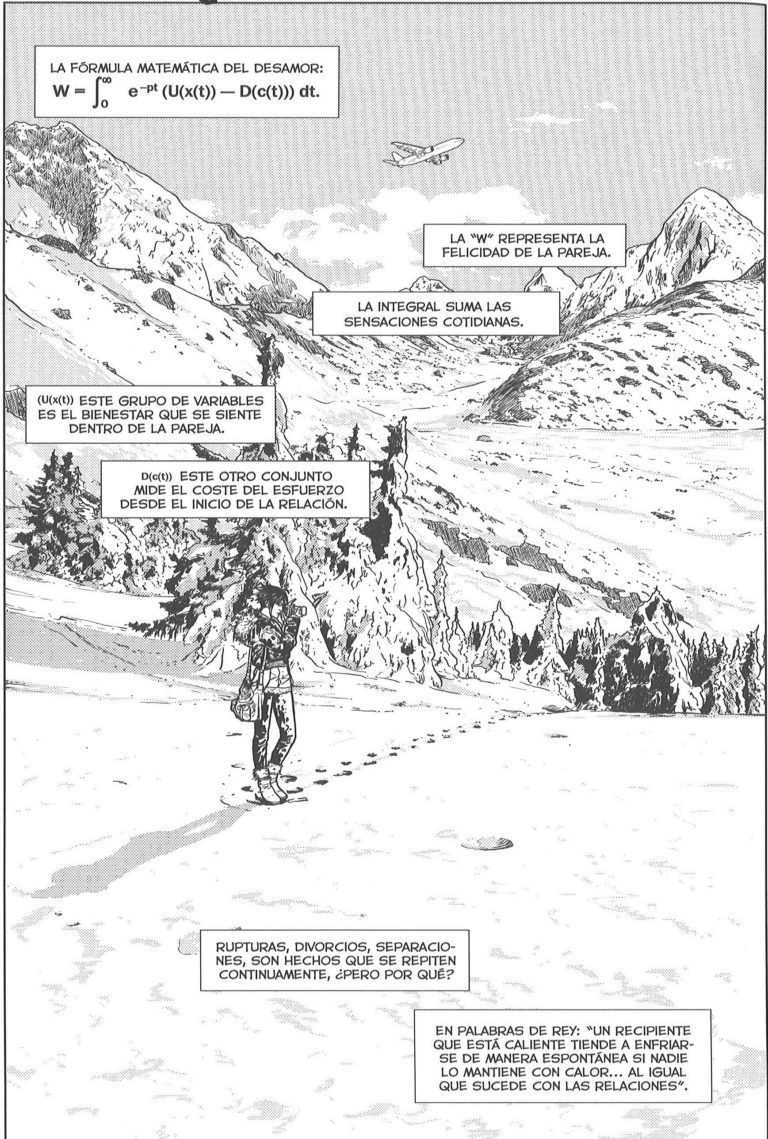

Entradas relacionadas:De menú para hoy, dos novelas gráficas negras con salsa matemática

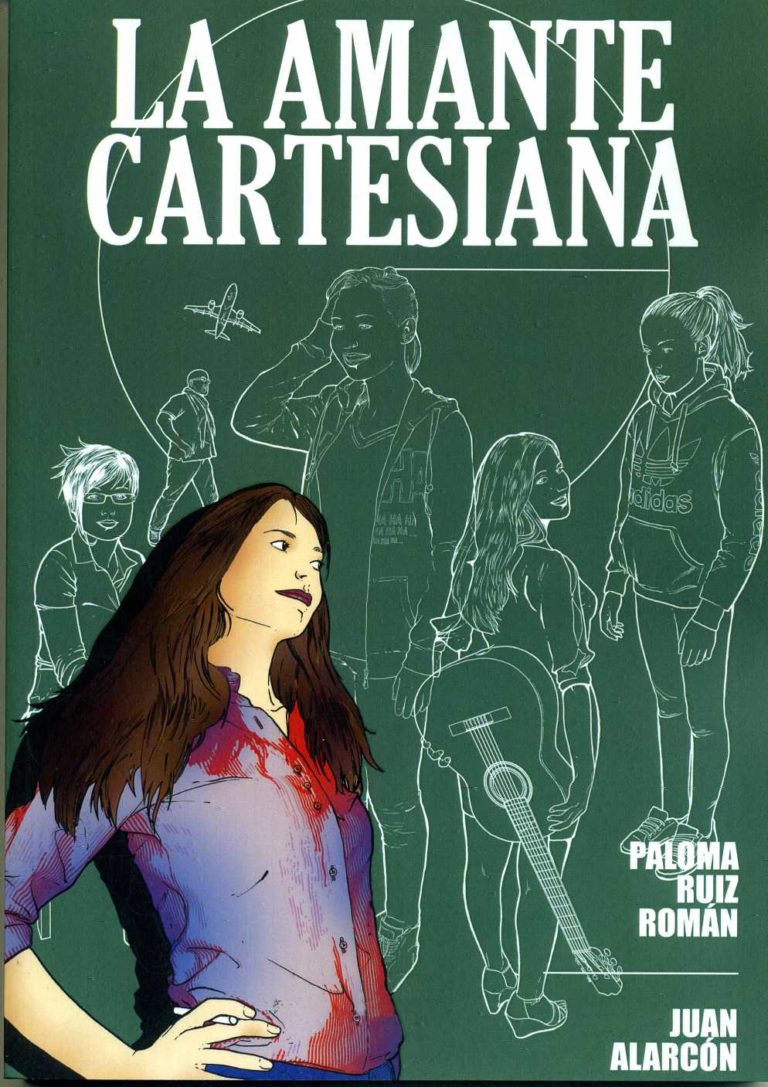

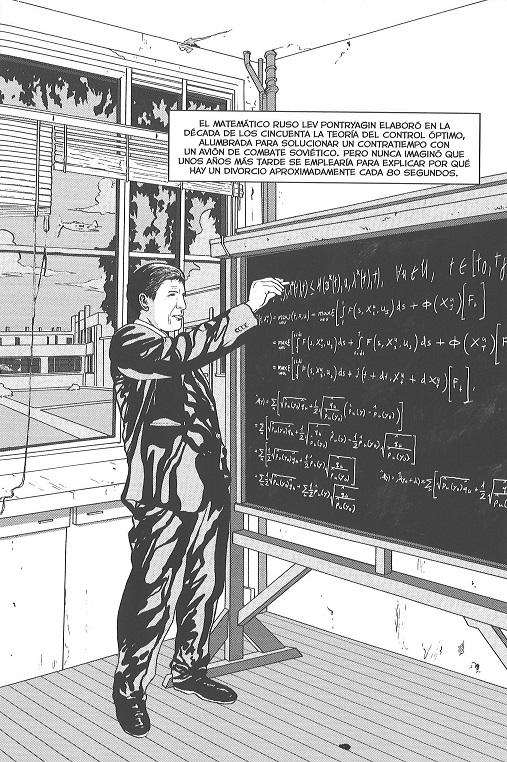

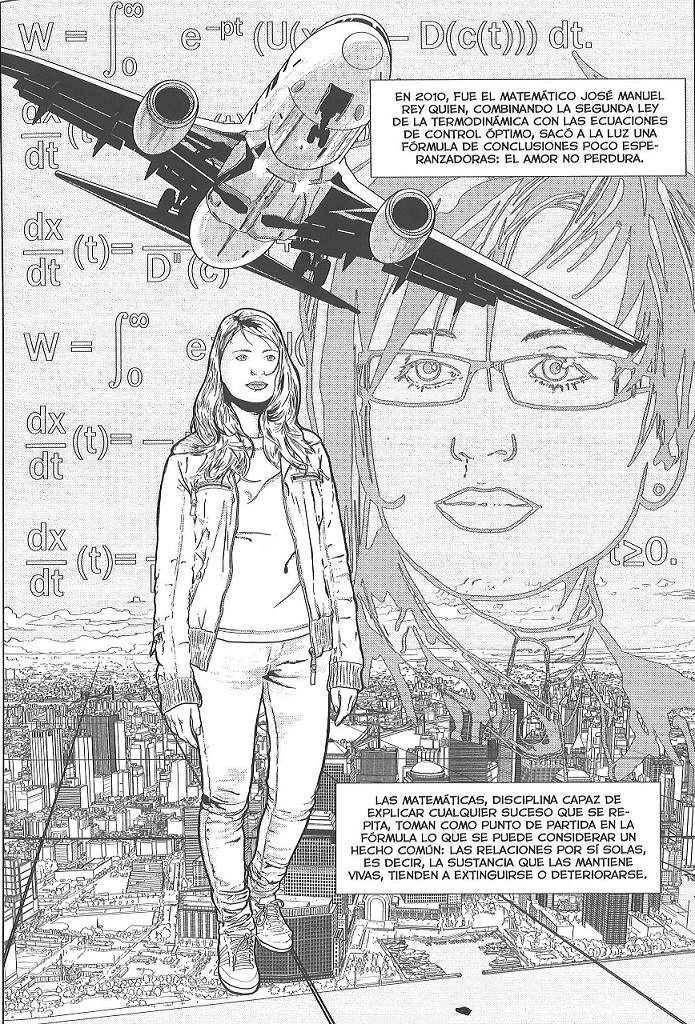

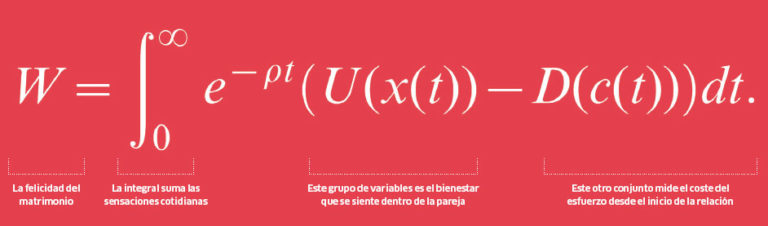

En la entrada de hoy del Cuaderno de Cultura Científica, tras la entrada sobre la novela gráfica La amante cartesiana(Egales, 2016), escrita por Paloma Ruiz Román y dibujada por Juan Alarcón (véase La amante cartesiana), seguiremos adentrándonos en el mundo de los cómics y las novelas gráficas con contenido matemático, pero nos centraremos en lo que podríamos denominar “novelas gráficas negras”, es decir, novelas gráficas con temática policíaca.

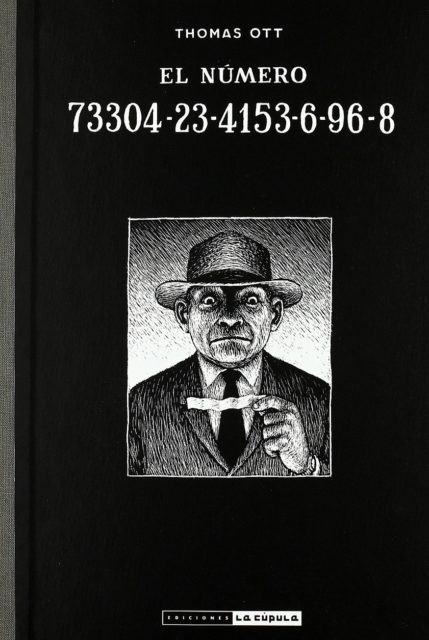

Ya habíamos tocado el género en la entrada Las matemáticas en el cómic Ken Games, donde analizábamos el cómic Ken Games (Diábolo, 2009-10), de José Robledo (guionista) y Marcial Toledano (dibujante). En concreto, analizaremos las novelas gráficas El número 73304-23-4153-6-96-8 (La cúpula, 2008), de Thomas Ott, y El vendedor de estropajos (Astiberri, 2011), de Fred Vargas (guión) y Edmond Baudin (dibujo).

Portada de la novela gráfica El número 73304-23-4153-6-96-8 (La cúpula, 2008), de Thomas Ott

Portada de la novela gráfica El número 73304-23-4153-6-96-8 (La cúpula, 2008), de Thomas OttThomas Ott es un historietista suizo, nacido en Zurich en 1966, que ha destacado dentro del cómic independiente europeo en las últimas décadas. Realiza sus novelas gráficas utilizando la técnica “Carte a gratter”, algo así como “tarjeta raspada”, que consiste en una cartulina, en el caso de este dibujante blanca, sobre la que se extiende una cierta pasta, en este caso de color negro, de forma que al raspar la superficie generada por la pasta, se descubre el blanco de la base, creándose así las imágenes blancas sobre fondo negro. Esta técnica permite a Thomas Ott crear un tipo de dibujo muy particular en blanco y negro, que va muy bien con las historias oscuras, fundamentalmente historias de terror, que nos narra. Además, la historia no tiene texto, salvo el que pueda aparecer en los propios dibujos. Entre sus obras más conocidas están Hellville (1995), Dead End (1996), t.o.t.t. (2002), Cinema Panopticum (2005) o El número 73304-23-4153-6-96-8 (2008).

Thomas Ott trabajando una ilustración con la técnica “Carte a gratter”. Imagen del artículo Thomas Ott, maestro del ‘scratch’, de Juan Batalla, para Infobae

Thomas Ott trabajando una ilustración con la técnica “Carte a gratter”. Imagen del artículo Thomas Ott, maestro del ‘scratch’, de Juan Batalla, para InfobaeEn su obra El número 73304-23-4153-6-96-8 nos cuenta una de esas historias negras de las clásicas, con los típicos ingredientes, como son una cárcel, una ejecución en la silla eléctrica, un verdugo, un oscuro bar, un casino, la ruleta rusa, una mujer fatal, mucha pasta, una casa de empeños, una pistola, un robo, una navaja, algunos lugares oscuros de la ciudad, una paliza, etcétera, pero con ese toque de terror tan característico en su obra.

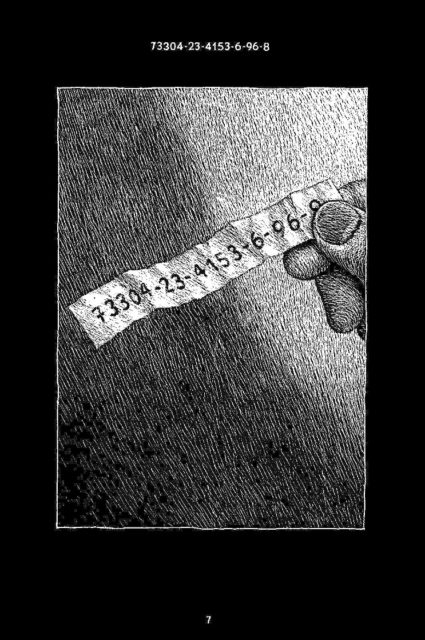

En el primer dibujo ya nos destaca la importancia que tiene el número que da título a la obra, ya que nos presenta unos dedos sujetando un pequeño papel que contiene solamente ese número, o conjunto de números,… 73304-23-4153-6-96-8. Es la mano de un recluso que va a morir en la silla eléctrica. Tras ser ejecutado el papel quedará caído al lado de la silla eléctrica y lo recogerá el funcionario que se encarga de la ejecución. Este es el inicio de una historia en la que esos números tienen una gran importancia, ya que esos números marcarán su vida a partir de ese momento, primero hacia el éxito y después hacia el fracaso.

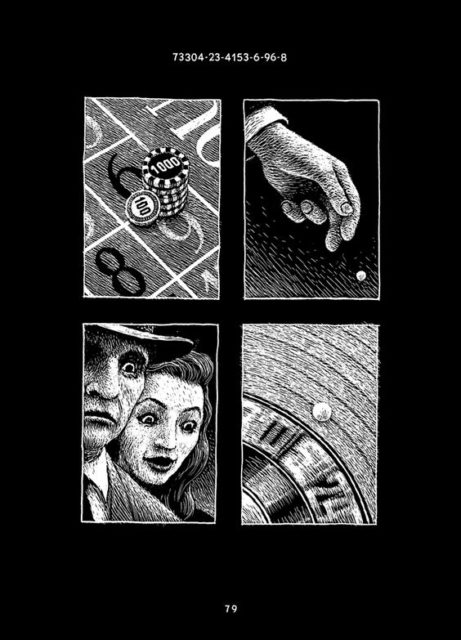

Primera página de la obra El número 73304-23-4153-6-96-8, de Thomas Ott, en la que se ve los dedos del condenado a muerte sujetando un papelito con los números 73304-23-4153-6-96-8

Primera página de la obra El número 73304-23-4153-6-96-8, de Thomas Ott, en la que se ve los dedos del condenado a muerte sujetando un papelito con los números 73304-23-4153-6-96-8¿Puede el destino de una persona estar marcado por una serie de números? En la historia, el funcionario de prisiones va descubriendo poco a poco como los números de ese papel empiezan a aparecer en su vida y a determinar su futuro … el número de identificación de un perro encontrado en la calle (73304), el dorsal de un atleta en el periódico que lee (23), el teléfono (4153696) en un cartel en el que se busca al perro. llamado Lucky, es decir, “afortunado”, la dirección de quien contesta (número 8), una mujer.

Después descubrirá que la fortuna parece estar de su lado y le va conduciendo hacia el éxito… saca cartas de una baraja al azar y van saliendo en orden los números del papel 7, 3, … saca un fajo de billetes, lo cuenta, y su valor es de 304, … mientras llama a la mujer descubre que ese día es 23 … queda con la mujer en un bar, tira dos dados y sale primero 4 y 1, después 5 y 3. Todo va dirigiéndolo hacia la suerte y se marchan al casino.

A lo largo de toda la novela el número 73304-23-4153-6-96-8 está escrito en la parte de arriba de cada página, para que quien lee la historia pueda ir siguiendo los números que aparecen en ella.

Página de la obra El número 73304-23-4153-6-96-8, de Thomas Ott, en la que su protagonista, junto con la mujer con la que se ha citado, apuestan a la ruleta, a los números 6 y 9, que son los que toca en la sucesión de números aparecidos de la secuencia 73304-23-4153-6-96-8

Página de la obra El número 73304-23-4153-6-96-8, de Thomas Ott, en la que su protagonista, junto con la mujer con la que se ha citado, apuestan a la ruleta, a los números 6 y 9, que son los que toca en la sucesión de números aparecidos de la secuencia 73304-23-4153-6-96-8A la mañana siguiente, tras una noche increíble, los números seguirán estando presentes en su vida, pero su suerte se dará la vuelta, como en una banda de Moebius, y la desgracia se cebará con el protagonista.

No desvelemos más de esta historia circular, de la que ya hemos contado demasiadas cosas. Es una novela gráfica muy recomendable, con una segunda parte muy interesante desde un punto de vista dramático.

Solo un detalle matemático más, la banda de Moebius (recordemos que es una superficie con una única cara, que es una banda retorcida, que podemos construir de forma sencilla de la siguiente forma … si tomamos una tira de papel y pegamos los extremos se obtiene una banda normal con dos caras, pero si primero giramos uno de los extremos del papel media vuelta y después juntamos los extremos se obtiene la banda de Moebius) como símbolo del cambio de fortuna en la vida del protagonista, de la buena a la mala fortuna. La banda de Moebius aparece dos veces. La primera en nombre, ya que el grupo que toca en el bar es el The Dr Moebius Octet. Y la segunda es un dibujo de la misma en el escaparate de la casa de empeños a la que acudirá más adelante el protagonista.

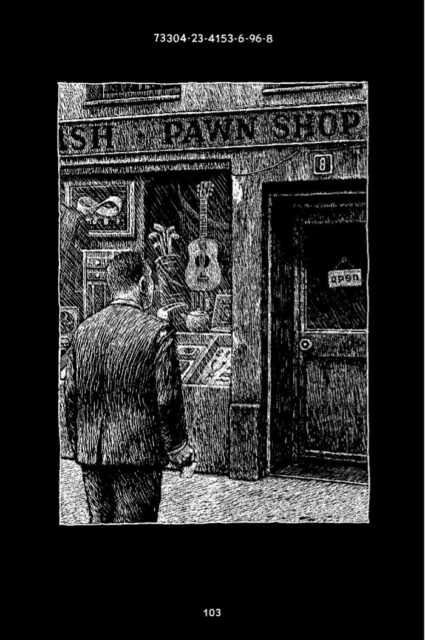

Página de la obra El número 73304-23-4153-6-96-8, de Thomas Ott, en la que su protagonista se dirige a una tienda de empeños, pawn shop, en cuyo escaparate, arriba a la izquierda, podemos observar la imagen de la banda de Moebius

Página de la obra El número 73304-23-4153-6-96-8, de Thomas Ott, en la que su protagonista se dirige a una tienda de empeños, pawn shop, en cuyo escaparate, arriba a la izquierda, podemos observar la imagen de la banda de MoebiusLa siguiente novela gráfica que traemos a esta entrada de la sección Matemoción del Cuaderno de Cultura Científica es El vendedor de estropajos (Astiberri, 2011), cuyo guion es de la escritora de novela negra francesa Fred Vargas (Premio Princesa de Asturias de las Letras 2018), seudónimo de Frédérique Audoin-Rouzeau, basado en su relato corto Cinco francos unidad del libro Fluye el sena (Siruela, 2012), y cuyos dibujos son del historietista e ilustrador francés Edmond Baudoin.

La escritora Fred Vargas es la autora de la serie de novelas policíacas del comisario Adamsberg que se inició con el El hombre de los círculos azules (1991), con 12 títulos, entre los que están Tiempos de hielo (2015) y Cuando sale la reclusa (2017), así como otras novelas entre las que están Los que van a morir te saludan (1994) o Que se levanten los muertos (1995). Por su parte, Edmond Baudoin es autor de más de 50 novelas gráficas, entre las que podemos citar El viaje (1996), Viva la vida, los sueños de Ciudad Juarez (2011), en colaboración con Troubs, Dalí (2012), o Soñadores, cuatro genios que cambiaron la historia (2015), con Cédric Villani. Juntos tienen dos novelas gráficas, la que estamos analizando en esta entrada y Los cuatro ríos (2000), publicada por Astiberri en 2015.

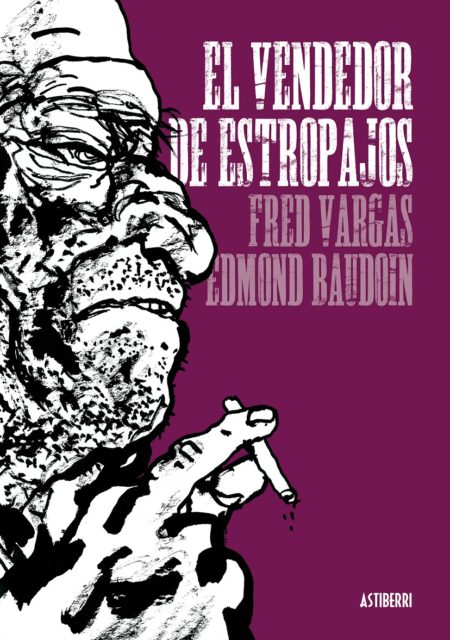

Portada de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas (guion) y Edmond Baudoin (dibujo)

Portada de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas (guion) y Edmond Baudoin (dibujo)Como podemos leer en la sinopsis que realiza la editorial Astiberri de El vendedor de estropajos:

“Un asesinato trastorna el día a día de Pi, vagabundo y, a ratos, vendedor de estropajos. Interrogado como testigo, conoce a Adamsberg, un comisario con métodos desconcertantes, que prefiere mantener un largo diálogo con el vagabundo, antes que los métodos habituales de la policía. La verdad sobre el caso se desvela poco a poco, al mismo tiempo que se dibuja el retrato de un hombre roto por la vida”.

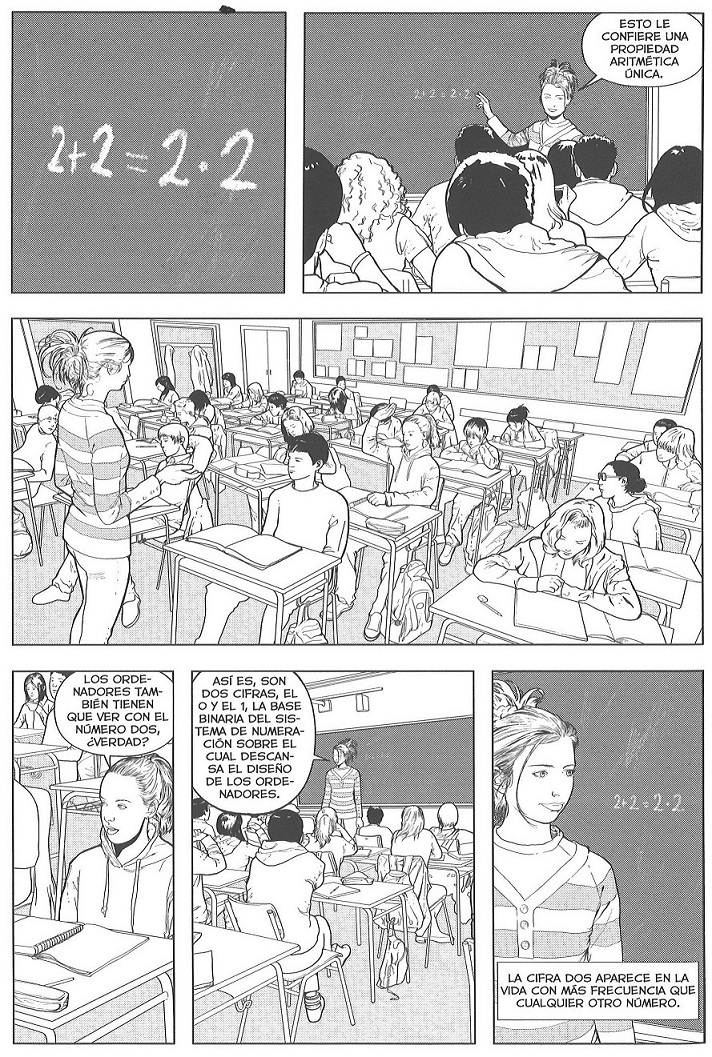

Las matemáticas están relacionadas con el vagabundo, vendedor circunstancial de estropajos, de quien se dice que “los números siempre habían sido lo suyo”.

Nos encontramos el siguiente texto en la novela gráfica, similar al que aparece en el relato corto que da lugar a la misma.

“Su Martín [el carro metálico de la compra] transportaba estropajos, miles. Cuando descubrió aquella mina de estropajos en el hangar de Charenton, creyó que estaba salvado. 9.732 estropajos vegetales, los había contado. Era bueno con los números, era algo de nacimiento.

Un euro por cada estropajo vendido, 9.732 euros en total.

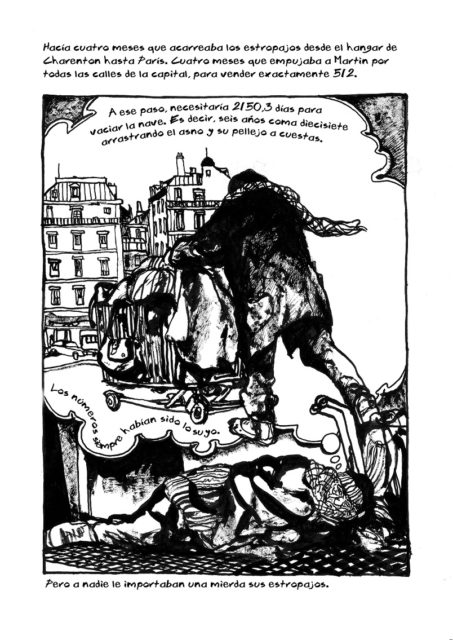

Hacía cuatro meses que acarreaba los estropajos desde el hangar de Charenton hacia París. Cuatro meses que empujaba a Martín por todas las calles de la capital, para vender exactamente 512.

A ese paso necesitaría 2.150,3 días para vaciar la nave. Es decir, seis años coma diecisiete arrastrando el asno [el carrito] y su pellejo a cuestas.”

Página de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas (guion) y Edmond Baudoin (dibujo), en la que se ve al protagonista empujando su carro de la compra con sus estropajos

Página de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas (guion) y Edmond Baudoin (dibujo), en la que se ve al protagonista empujando su carro de la compra con sus estropajos

Curiosamente, para ser una muestra de que se le dan bien los números, resulta que las cuentas no están muy claras. Para empezar, 6,17 años son 2.253,53 días, si consideramos el año solar de 365,24 días, pero si tomamos que un año son aproximadamente 365 días, entonces serían 2.252,05 días. Como vemos hay algo que no cuadra en esos números. ¿Quizás es una errata y son 2.250,3 días? Si fuese así, tomando un año de 365 días, tendríamos que 2.250,3 días son 6,1652… años, que redondeando sí son 6,17 años. Podría ser.

El problema es que mirando a las cuentas de la venta de estropajos también nos encontramos con algunas incongruencias. Empecemos con una cuenta orientativa. Si ha vendido 512 estropajos en cuatro meses y consideramos que 4 meses son 122 días (dos meses de 31 días y dos de 30, aunque hay otras opciones), entonces habría vendido aproximadamente 4,2 estropajos por día. Si fuesen 2.150,3 días, obtendríamos 2.150,3 x 4,2 = 9.031,26, que aunque le sumemos los 512, no llega a 9.732 estropajos. Si asumimos que es una errata y son 2.250,3 días, entonces obtendríamos 2.250,3 x 4,2 = 9.451,26, que no llegan a 9.732, pero si le sumamos 512 nos pasamos.

Una opción podría ser que Fred Vargas se refiriera a cuatro meses aproximadamente, es decir, que podrían ser algunos días más o menos. Por ejemplo, si el vendedor de estropajos hubiese vendido los 512 estropajos en 125 días, entonces habría vendido 4,096 estropajos por día. Ahora, para vender los 9.732 – 512 = 9.220 estropajos habría necesitado 2.250,98 días, que casi el la cantidad que se escribe.

Por otra parte, si el vendedor de estropajos hubiese vendido los 512 estropajos en 119 días, entonces habría vendido unos 4,3 estropajos por día y para vender los 9.732 estropajos habría necesitado unos 2.263 días. Tomando 118 días salen unos 2.242 días. Con uno nos pasamos un poco y con otro nos quedamos corto.

Bueno, estas son mis cuentas, pero las que habría que conocer son las de Fred Vargas.

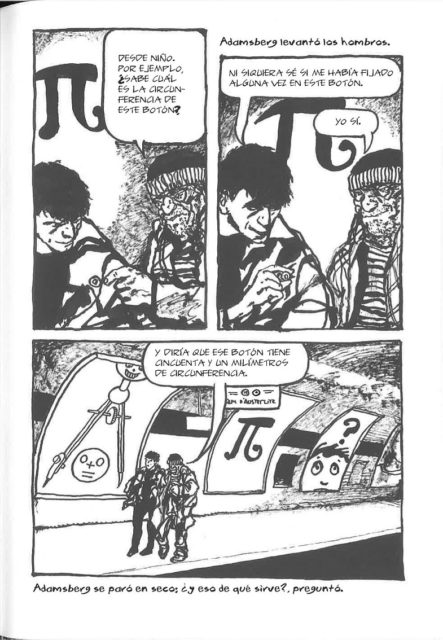

Página de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas y Edmond Baudoin, en la que se ve al comisario Adamsberg y al vendedor de estropajos conversando en el metro de París, con dibujos del número Pi a su alrededor

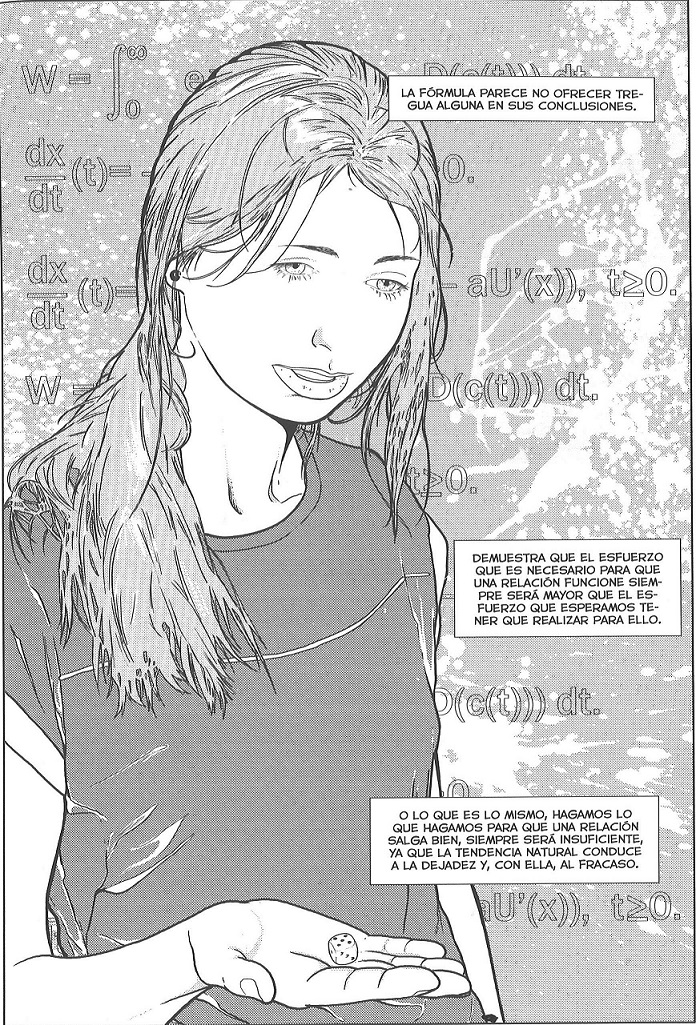

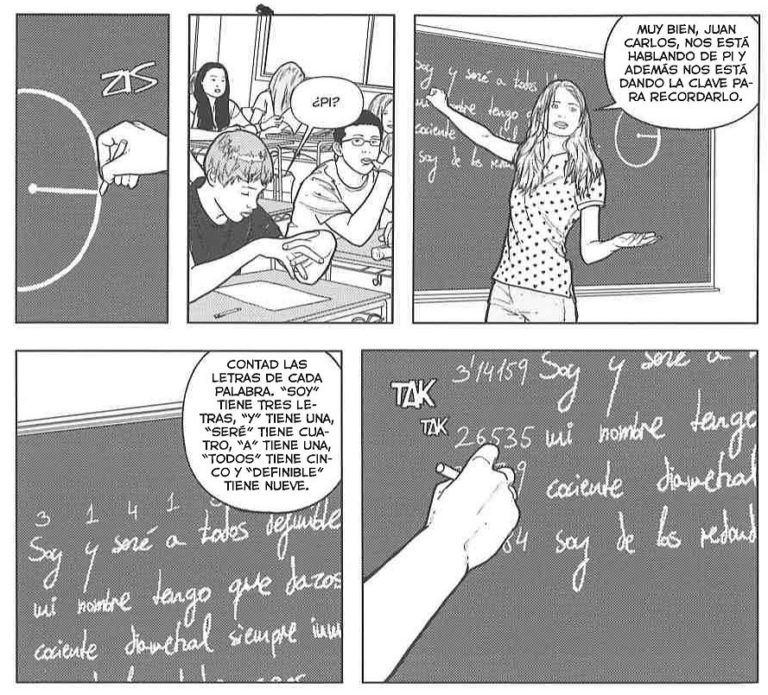

Página de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas y Edmond Baudoin, en la que se ve al comisario Adamsberg y al vendedor de estropajos conversando en el metro de París, con dibujos del número Pi a su alrededorPor otra parte, el nombre del vendedor de estropajos es Pi. Como el mismo cuenta en la historia.

“El día de todos los santos mi madre me llevó al orfanato. Me inscribió en el registro. Alguien me cogió en brazos. Otro apoyó la taza de café en el libro de registro. Y mi nombre se disolvió en la mancha de café. Solo quedaron dos letras [se refiere a Pi].”

Y más adelante sigue contando cosas de su infancia relacionadas con su particular nombre, Pi.

“Cuando era pequeño, en el colegio del orfanato me llamaban 3,14. ¿Pilla la broma? ¿Pi? ¿3,14? ¿Diámetro de la circunferencia por 3,14, igual a la circunferencia?”

Más adelante en la historia, el comisario Adamsberg, teniendo en cuenta la anécdota anterior, decide poner a la víctima, para ocultar su identidad, el seudónimo de 421, en alusión al juego de dados, que se juega con tres dados, llamado “421”.

Pero sigamos con el número pi y el vendedor de estropajos. Pi es bueno estimando a ojo el perímetro de diferentes circunferencias. Por ejemplo, cuando están en el metro le dice al comisario “Y diría que ese botón tiene cincuenta y un milímetros de circunferencia”. Teniendo en cuenta la expresión que el mismo Pi menciona más arriba “diámetro de la circunferencia por 3,14, igual a la circunferencia”, tenemos que el botón tiene un diámetro de unos 16 milímetros, es decir, 1,6 centímetros.

Página de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas y Edmond Baudoin, en la que se ve al comisario Adamsberg y al vendedor de estropajos conversando sobre el número Pi

Página de la novela gráfica El vendedor de estropajos (Astiberri, 2011), de Fred Vargas y Edmond Baudoin, en la que se ve al comisario Adamsberg y al vendedor de estropajos conversando sobre el número PiPi, el vendedor de estropajos, le explica al comisario Adamsberg la importancia del número Pi. En la imagen anterior le está contando lo siguiente.

“Pi funciona con cualquier círculo. Lo inventó un griego hace mucho tiempo. Eran inteligentes los griegos. El reloj. ¿Quiere saber, por curiosidad, la circunferencia del reloj? La circunferencia de la rueda del carrito, la de la cabeza, la del sello del ayuntamiento, la del agujero del zapato, la del centro de la margarita, la del culo de la botella, la de una moneda de un euro, la de un vaso de vino. ¿Quiere saber qué circunferencia a bebido? El mundo está hecho solo de círculos. ¿Lo había pensado alguna vez? Pues yo, Pi, conozco todos los círculos. Si no me cree, pregúnteme por cualquiera”.

Y se da el siguiente diálogo entre ambos. El comisario contesta “¿una margarita?”, Pi pide aclaraciones “¿con los pétalos o solo el centro amarillo?”. Por respuesta “el centro”. Y Pi da la solución “Doce con veinticuadro milímetros. Estamos hablando de una margarita bastante grande”.

Una margarita con una circunferencia de 12,24 milímetros, tiene un diámetro de 3,9 milímetros, es decir, 0,39 centímetros. Ni medio centímetro. Por lo tanto, es una margarita pequeña, salvo que la medida de la circunferencia , 12,24, fuese en centímetros.

Finalmente, para resolver el asesinato el comandante Adamsberg utiliza, no la lógica, sino la humanidad.

Bibliografía

1.- Thomas Ott, El número 73304-23-4153-6-96-8, La cúpula, 2008.

2.- Fred Vargas, Edmond Baudin, El vendedor de estropajos, Astiberri, 2011.

3.- Fred Vargas, Fluye el sena (tres casos del comisario Adamsberg), Siruela, 2012. [incluye el relato “Cinco francos unidad”]

4.- Página web de Thomas Ott

5.- Página web de Edmond Baudoin

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo De menú para hoy, dos novelas gráficas negras con salsa matemática se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Un kilogramo de novelas y matemáticas

- Gráficas para la ciencia y ciencia para las gráficas

- El principio del palomar, una potente herramienta matemática (parte 2)

Más allá del modelo de Bohr

Foto: Matthew Hicks / Unsplash

Foto: Matthew Hicks / UnsplashAdemás de la incapacidad de predecir ciertas propiedades de los átomos, el modelo de Bohr tenía dos deficiencias adicionales. Primero, predecía algunos resultados que no estaban de acuerdo con el experimento (como espectros incorrectos para elementos con dos o tres electrones en las capas electrónicas más externas). En segundo lugar, predecía resultados que no se podían comprobar de ninguna manera conocida (como los detalles de las órbitas de los electrones). Aunque las órbitas eran fáciles de dibujar en papel, no podían observarse directamente. Tampoco podían relacionarse con ninguna propiedad observable de los átomos [1]. Era evidente pues que el modelo de Bohr planteaba cuestiones que no tenían respuesta experiment [2].

A principios de la década de 1920, los físicos, especialmente el propio Bohr, comenzaron a trabajar seriamente en la revisión de las ideas básicas del modelo. Un hecho que destacaba era, como Rutherford había señalado, que el modelo se basaba en una mezcla de ideas clásicas y cuánticas. Se suponía que un átomo actuaba de acuerdo con las leyes de la física clásica hasta el punto en que estas leyes ya no funcionaban. Más allá de este punto, se introducían ideas cuánticas. La imagen del átomo era el producto de una mezcla inconsistente. Combinaba ideas de la física clásica con conceptos para los que no había lugar en la física clásica.

Las órbitas de los electrones estaban determinadas por las leyes de movimiento clásicas newtonianas, muy parecidas a las órbitas de los planetas alrededor del Sol. Pero de las muchas órbitas teóricas, solo un pequeño número se consideraba posible. Incluso estas pocas órbitas eran seleccionadas por reglas para las que no había lugar en la mecánica clásica. Además, la frecuencia calculada para la revolución orbital de los electrones era bastante diferente de la frecuencia de la luz emitida o absorbida cuando el electrón se movía desde o hacia esta órbita. Por si fuese poco, la decisión de que el número n nunca podía ser cero parecía completamente arbitraria, pero era necesaria evitar que el modelo colapsara dejando que el electrón cayera sobre el núcleo. Se hizo evidente así que un modelo de estructura atómica mejor necesitaría basarse más consistentemente en conceptos cuánticos.

En definitiva, la contribución del modelo de Bohr se puede resumir de la siguiente manera. Proporcionó algunas respuestas excelentes a las preguntas planteadas sobre la estructura atómica. Aunque el modelo resultó ser inadecuado, llamó la atención sobre cómo se pueden usar los conceptos cuánticos. Indicaba el camino que tendría que tomar un nuevo modelo. Un nuevo modelo que tendría que proporcionar las respuestas correctas que daba el modelo de Bohr, pero que también tendría que proporcionar las respuestas correctas para los problemas que el modelo de Bohr no podía resolver.

Uno de los aspectos más fascinantes del trabajo de Bohr fue la prueba de que las propiedades físicas y químicas de la materia ponen de relieve el papel fundamental de los enteros (números cuánticos como n = 1, 2, 3, …). Como dijo Bohr: «La solución de uno de los sueños más audaces de las ciencias naturales es construir una comprensión de las regularidades de la naturaleza sobre la consideración del número puro». Aquí resuenan las ideas de Pitágoras y Platón, de Kepler y Galileo.

Desde la década de 1920, se ha desarrollado un nuevo modelo de éxito de la estructura atómica. Es parte de la mecánica cuántica, llamada así porque es una nueva mecánica construida directamente sobre conceptos cuánticos. La mecánica cuántica va mucho más allá de comprender la estructura atómica. De hecho, es la base de la concepción moderna de los acontecimientos a escala submicroscópica. [3]

Notas:

[1] El modelo planetario tiene un significado muy diferente cuando se aplica a un planeta en una órbita observable que cuando se aplica a un electrón en un átomo. La posición precisa de un planeta es importante, especialmente en experimentos como fotografiar un eclipse o una porción de la superficie de Marte desde un satélite. Pero la posición momento a momento de un electrón en su órbita no tiene ese significado porque no tiene relación con ningún experimento que los físicos hayan podido idear.

[2] En cierto modo pasa una cosa parecida con la teoría de cuerdas hoy día. Otra cuestión es si la solución sigue un camino paralelo al que apuntamos que siguió el modelo atómico.

[3] Algunos aspectos fundamentales de la mecánica cuántica serán objeto de una próxima serie.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Más allá del modelo de Bohr se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El modelo de Bohr explica las regularidades en el espectro del hidrógeno

- Las limitaciones del modelo de Bohr

- El modelo de Bohr explica la fórmula de Balmer

Historia de cómo el VIH ayudó a derribar el dogma central de la biología molecular

![]()

Rosario Sabariegos Jareño y Antonio Mas López

Imagen de Arek Socha / Pixabay

Imagen de Arek Socha / Pixabay

“El sentido común nos dice que todas las enfermedades han tenido que ser nuevas en algún momento de la historia, pero muchas epidemias que parecen enfermedades nuevas puede que solo sean reconocidas como nuevas por la población que las describe, o puede ser que hayan alcanzado proporciones epidémicas por primera vez”.

Robert Gallo, codescubridor del VIH.

La infección por el virus de la inmunodeficiencia humana (VIH), responsable del síndrome de inmunodeficiencia adquirida (SIDA), cobró importancia en los ochenta, cuando empezaron a aparecer casos en occidente. Todo empezó mucho antes, entre 1910 y 1930, en África.

En función de la secuencia genómica, el VIH se divide en dos grandes grupos: VIH-1 y VIH-2. El VIH-1 (causante de la pandemia) tiene una gran similitud genómica con el virus de inmunodeficiencia en simios (VIS) que afecta a los chimpancés que viven en zonas del sur de Camerún.

Si tenemos en cuenta la biología de estos virus, la transmisión desde los simios a las personas debió ocurrir por la exposición de heridas o mucosas a la sangre o los fluidos contaminados del chimpancé. Esto seguramente ocurrió durante la caza de estos animales. Al principio la enfermedad se limitó a pequeñas zonas de África hasta que llegó, a través del río Congo, a un núcleo urbano grande: Kinshasa (antes, Leopoldville). El río Congo era la ruta principal de viaje y comercio y esta, la ciudad más grande de la época en esa zona.

Kinshasa fue la cuna de la pandemia del sida.

Kinshasa, República Democrática del Congo.

Kinshasa, República Democrática del Congo.Shutterstock/Valeriya Anufriyeva

Desde ahí el virus se fue extendiendo por el resto del continente sin mayor problema con la garantía que ofrece el contagio sexual. Además, las medidas de higiene sanitaria de la época eran muy deficientes, lo que contribuyó a su diseminación.

También a principios del siglo XX, muy lejos de allí, en Estados Unidos, Peyton Rous y su grupo hicieron un descubrimiento que muchos años después iluminaría los caminos que llevaron al hallazgo del VIH.

Entre 1910 y 1911 demostraron que un tipo de tumor que afecta a los pollos podía ser transmitido mediante la inoculación del tejido afectado a un pollo sano. También vieron que el tumor se transmitía cuando inoculaban en el animal sano tan solo extractos libres de células que habían sido filtrados.

Fue la primera vez que se describió la acción de un retrovirus, familia a la que pertenece el VIH.

¿Qué es un retrovirus?

Hasta 1970 el dogma de la biología molecular decía que la información genética fluía siempre en esta dirección: ADN -> ARN -> proteínas. Así funciona en las células humanas.

En los años sesenta del siglo XX solo un grupo muy reducido de científicos creía que los virus de ARN causantes de tumores hacían algo inaudito: al reproducirse, pasaban su información genética a ADN.

Esto iba contra el dogma central de la biología molecular y llevó un tiempo demoler ese edificio.

Temin y Baltimore, por separado, describieron en 1970 la enzima que sintetiza ADN a partir de ARN en los retrovirus, la retrotranscriptasa o transcriptasa inversa (RT). Esto permitió entender la forma en la que estos virus insertaban su material genético en el genoma humano. La transcriptasa inversa copia el ARN y lo pasa a ADN, que se integra en el genoma humano como si fuera un componente más. Allí queda latente y puede reactivarse en cualquier momento. Reactivarse significa que el virus se replica dentro de las células del sistema inmune (linfocitos T CD4+) a las que destruye, lo que explica que las personas infectadas vean disminuidas sus defensas.

El tratamiento actual contra el sida funciona sobre el virus que se está replicando, no sobre el que está integrado. Las células con genoma de VIH integrado son el reservorio de la enfermedad.

De media, en una infección activa, mueren unos diez millones de linfocitos al día. Estos son reemplazados por otros nuevos, pero hasta la médula ósea tiene sus límites. Cuando los niveles de estas células caen por debajo de un umbral aparece la sintomatología que todos conocemos como sida. El paciente se ha quedado sin defensas y es vulnerable a múltiples infecciones.

Cómo evolucionar para resistir los medicamentos

La transcriptasa inversa tiene otras características que la hacen interesante. Es una polimerasa que comete muchos errores cuando copia el material genético.

Esto tiene un coste evolutivo, ya que se generan variantes que son menos eficaces desde el punto de vista biológico. También es una ventaja indiscutible, pues se crea variabilidad que, en términos de evolución molecular, es lo mismo que decir que se genera flexibilidad.

Los errores son producidos al azar, pero la selección de los mismos no. Cuando el virus está en presencia de un fármaco, se seleccionan aquellas variantes del virus que sobreviven. Dichas variantes pasan a ser mayoritarias en la población viral y la evolución sigue su curso. El medicamento es lo que llamamos una presión selectiva y a las poblaciones virales que aparecen las llamamos resistentes.

Si imaginamos el genoma como un gigantesco puzle de pequeñas piezas, la transcriptasa inversa se equivoca una vez cada 10 000 piezas. El genoma del VIH tiene ese tamaño, lo que significa que cada copia lleva al menos un error. Como se generan mil millones de virus al día, cada día se generan todos los mutantes posibles en cada pieza (posición del genoma) del puzle.

Cuando se comenzó a dar el fármaco 3TC como monoterapia, el virus sensible se había reemplazado totalmente por virus resistente en tan sólo 16 días.

La transcriptasa inversa genera tantas variantes que ha sido necesario el desarrollo de multitud de fármacos que atacan al virus en distintos puntos de su ciclo de replicación. Si apareciera un mutante que escapara a todos los fármacos sería un virus con grandes dificultades para replicar. Por eso funciona la terapia contra el VIH.

La cantidad ingente de dinero invertida en la investigación del VIH nos ha dado un conocimiento igual de grande sobre la biología de los virus. Este ha podido ser extrapolado a otros temas. La terapia combinada se extendió hacia el tratamiento del cáncer (terapia ortogonal), ya que la población de células tumorales es también muy heterogénea. Algunos fármacos anti-VIH han demostrado su eficacia frente a otros virus. El primer fármaco que se diseñó por ordenador fue el saquinavir, un inhibidor de uno de los componentes del VIH. Luego han venido otros.![]()

Rosario Sabariegos Jareño es contratada doctora interina y Antonio Mas López profesor titular de universidad en el laboratorio de virología molecular del área de microbiología del Departamento de Ciencias Médicas de la Universidad de Castilla-La Mancha.

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Historia de cómo el VIH ayudó a derribar el dogma central de la biología molecular se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- «El bacteriófago ø29 como sistema modelo en biología molecular» por Margarita Salas

- Niosomas como vectores de terapia génica del sistema nervioso central

- #Quantum13 De cómo la ciencia ayudó a a ganar una guerra

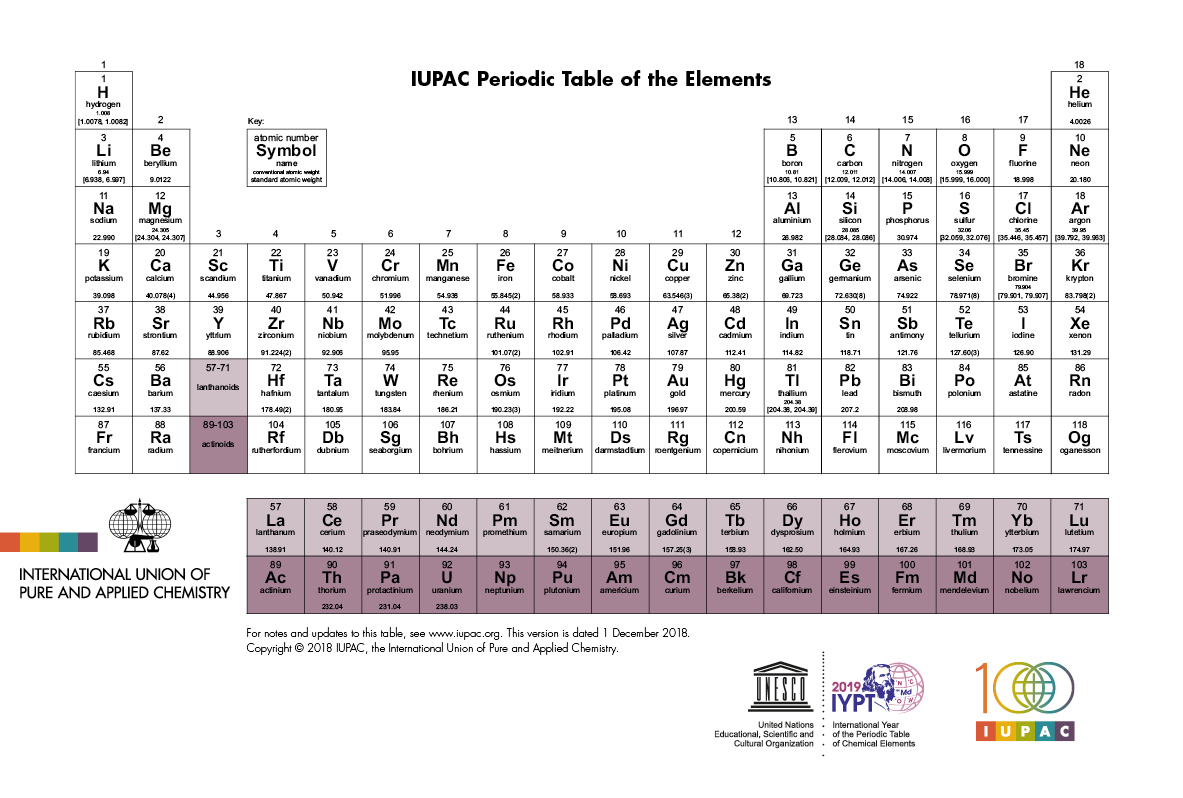

La tabla periódica en el arte: Oro

Los alquimistas, el rey Midas, y los exploradores norteamericanos tenían un mismo objeto de deseo: el oro. Este metal, además de su intrínseco valor, posee un destacado papel simbólico a nivel religioso: era la carne de los dioses egipcios y el material del que estaban hechos el vellocino que persiguió Jasón, las manzanas que guardaban las Hespérides o la estatua del dios Marduk en Babilonia. La religiones judeocristianas no son una excepción: cuando Moisés se descuidó un momento para recoger las tablas de la Alianza, los israelitas ya estaban idolatrando a un becerro de oro. Siendo un elemento tan arraigado en nuestra tradición y conocido desde hace milenios, es comprensible que sea uno de los materiales más importantes a lo largo de la historia del arte.

De oro macizo

El oro es un elemento químico muy estable, por lo que es raro que forme compuestos con otros elementos y es más frecuente que aparezca en forma nativa, es decir, como metal puro. Esto supone una gran ventaja, ya que, aunque sea escaso, se puede hallar en la naturaleza sin tener que recurrir a complejos métodos de extracción. Pensad por ejemplo en las pepitas de oro de las películas del Lejano Oeste. Eso sí, luego se precisan métodos de purificación para separar el oro de otros metales con los que suele estar aleado.

Imagen 1. Pepita de oro. Fuente: James St. John.

Imagen 1. Pepita de oro. Fuente: James St. John.

La fascinación que sentimos por el oro se remonta a tiempos prehistóricos como demuestran las piezas de orfebrería más antiguas que conocemos. Se encontraron en la necrópolis de Varna (Bulgaria) y fueron elaboradas en el quinto milenio antes de nuestra era. Sin duda, una de las razones por las que el oro nos atrae es su color: al contrario que todos los elementos metálicos (a excepción del cobre) no es plateado, sino amarillento. Para explicar esta propiedad tendríamos que recurrir a la teoría de la relatividad de Einstein, así que conformémonos con decir que los átomos de oro absorben la luz en la parte azul del espectro y la reflejan en la zona del amarillo-rojo. Pero las propiedades maravillosas del oro no se limitan a su color: tiene una maleabilidad fuera de lo común, lo que permite trabajar con él sin que se rompa y es extremadamente estable, por lo que no se degrada fácilmente como puede suceder con el hierro o el cobre.

En la formidable estabilidad del oro estriba gran parte del simbolismo que se le ha otorgado históricamente. Al ser un elemento prácticamente inmutable se asocia con la eternidad, tal y como hacían los antiguos egipcios, quienes lo vinculaban al faraón y al todopoderoso dios Ra. Pese a que el saqueo y hurto de las tumbas egipcias nos ha privado de un gran número de joyas, han llegado a nuestro días magníficos ejemplares de collares, colgantes, estatuillas, amuletos o pectorales que muestran el buen hacer de los orfebres del país del Nilo.

Imagen 2. Collar con cabezas de halcón y pectoral que representa a la diosa Nekhbet (1479-1425 a.e.c.). Fuente: Metropolitan Museum.

Imagen 2. Collar con cabezas de halcón y pectoral que representa a la diosa Nekhbet (1479-1425 a.e.c.). Fuente: Metropolitan Museum.Al igual que los egipcios, las grandes civilizaciones hicieron un uso extensivo del oro: fue símbolo de distinción para los persas, dio forma a máscaras mortuorias micénicas, se combinó con el marfil en las estatuas de crisoelefantina griegas, coloreó los mosaicos bizantinos y coronó a reyes y reinas. La conquista de América supuso un flujo constante de oro hacia Europa, pero los pueblos precolombinos también habían desarrollado el arte de trabajar un metal del que disponían en relativa abundancia. Cuando los conquistadores llegaron a aquellos desconocidos territorios quedaron maravillados por las riquezas que ofrecían. Enseguida surgieron todo tipo de leyendas que llevaron a los más intrépidos a la búsqueda de lugares como El Dorado, la legendaria ciudad construida en oro. Aunque tal lugar no existiese, el mito tiene una justificación tal y como refleja una singular balsa dorada de la cultura muisca que se descubrió en Colombia (Imagen 3). Esta pieza representa la ceremonia de coronación del cacique del reino, quien cubierto en polvo de oro arrojaba ofrendas del valioso metal a la laguna de Guatavita. Ante tal maravilloso derroche, normal que se sobreestimasen las riquezas de aquellos pueblos indígenas.

Imagen 3. Balsa muisca elaborada con una aleación de oro, plata y cobre (Entre 600 y 1600). Fuente: Wikimedia Commons.

Imagen 3. Balsa muisca elaborada con una aleación de oro, plata y cobre (Entre 600 y 1600). Fuente: Wikimedia Commons.

Bañados en oro

A estas alturas ha quedado claro que realizar obras de arte con oro es costoso, especialmente si pensamos en piezas de gran formato. Afortunadamente existe una alternativa mucho más económica que visualmente no afecta al valor de la obra: el dorado. Mediante esta técnica se cubren materiales más pobres con oro, de modo que se abaratan costes y se pueden decorar piezas de un tamaño que sería dificilísimo obtener con el metal macizo: retablos, estatuas, órganos, etc. Por ejemplo, en Quito, el interior de la Iglesia de la Compañía está completamente cubierto en oro. Si este interior hubiese sido realizado en metal macizo sería un tesoro más valioso que las reservas de muchos bancos centrales. Sin embargo, gracias al dorado, este delirio barroco se pudo realizar con poco más de cincuenta kilogramos de oro. No es moco de pavo, pero los jesuitas no se caracterizaban precisamente por su austeridad artística.

Imagen 4. Iglesia de la Compañía de Jesús de Quito (s. XVI-XVIII). Fuente: Wikimedia Commons

Imagen 4. Iglesia de la Compañía de Jesús de Quito (s. XVI-XVIII). Fuente: Wikimedia CommonsA lo largo de la historia se han desarrollado diferentes métodos para dorar objetos. Uno de los más interesantes desde el punto de vista químico es el que se realiza mediante amalgama de mercurio y que ya explicamos en su momento. Afortunadamente este procedimiento tan perjudicial se pudo abandonar en el s. XIX con la llegada de la galvanoplastia y el dorado por electrólisis. Pero no avancemos tan rápido y quedémonos con una técnica más clásica: el dorado mediante pan de oro. El pan de oro es una finísima lámina de metal que se logra mediante el batido con martillo y que, gracias a la ductilidad del oro, puede alcanzar grosores inferiores a una micra. De este modo, pese a que el material sea caro, se puede lograr mucho pan de oro con una pequeña cantidad de metal (10 000 láminas de 8 x 8 cm pesan unos 130 gramos).

La aplicación del pan de oro depende del material que se vaya a cubrir y, en muchos casos, es una labor costosa. Tradicionalmente se han usado dos técnicas: el dorado al mordiente, en el que se emplea como adhesivo una substancia grasa, y el dorado al agua. En este último, muy habitual para decorar estatuas de madera, la pieza se cubre primero con una cola, luego con una preparación a base de yeso y, finalmente, con una capa de bol. El bol es una arcilla de tonos rojizos que sirve de fondo para el dorado y proporciona una superficie homogénea sobre la que se pegan las láminas del oro para su posterior bruñido. Una vez asentadas las láminas, se pueden lograr decoraciones exquisitas mediante el estofado, técnica que consiste en cubrir el metal con pintura y luego levantarla en las zonas que se quieren dejar el oro al descubierto.

Imagen 5. Ángel con instrumentos de la Pasión (95×40 cm), de Tydeman Maes (1425-1435). El manto luce un rico paño estofado. Fuente: Museo del Prado.

Imagen 5. Ángel con instrumentos de la Pasión (95×40 cm), de Tydeman Maes (1425-1435). El manto luce un rico paño estofado. Fuente: Museo del Prado.

Oro parece…

Cuando un material es codiciado por el ser humano es inevitable que surjan imitaciones. El oro no es una excepción, pese a que por sus particulares características no resulte fácil de falsificar. Si bien existen compuestos químicos o aleaciones con un brillo dorado que podrían dar el pego, no presentan la misma ductilidad, resistencia a oxidarse o densidad que el áureo elemento. Una de estas substancias es la pirita (FeS2), un mineral de brillo atractivo que la naturaleza suele presentar en forma de cubos. Por su aspecto es conocida con el esclarecedor nombre de oro de los tontos y, aunque se usa en joyería, es fácil de diferenciar del codiciado metal: la pirita es más dura (más difícil de rayar), liviana y menos amarilla, especialmente si se ha oxidado. Otros de los minerales que pueden dar falsas alegrías a quienes juegan a ser geólogos son la calcopirita o algunos tipos de micas.

En todo caso, más allá de los sustitutos naturales, el material más empleado para imitar el oro es el latón, una aleación de cobre y zinc. Este material ya era conocido en época clásica como oricalco, en griego cobre de la montaña, nombre que podría ser un vestigio de cuando el latón se obtenía de menas de cobre ricas en zinc. Los romanos transformaron la etimología de la aleación y la acercaron a la del metal al que se asemejaba con el nombre de aurichalcum. Fue el mismísimo Augusto quien decidió que ese sería el material empleado para elaborar los sestercios del Imperio y en la reforma del año 23 les dio el significativo valor de una centésima de áureo, la valiosa moneda de oro. Claro que, gracias al parecido entre el metal y la aleación, hay estafadores que han conseguido rentabilizar mejor el latón haciendo pasar por piezas de gran valor objetos que no eran más que baratijas.

Otra manera muy efectista de lograr superficies de aspecto dorado es la corladura, técnica en la que se aplica un barniz transparente sobre metales como la plata o el estaño. Allá por el s. VIII este barniz se lograba mezclando algún colorante amarillo como el azafrán con aceites, pero posteriormente se fue avanzando hacia el uso de la goma laca como disolvente. Entre las substancias empleadas para lograr la corla dorada podemos encontrar una gran variedad de productos naturales además del azafrán: la rubia, la cúrcuma, el achiote, la gualda, el ámbar, la gutagamba y hasta la sangre de drago, resina extraída de un árbol tropical. La corla se aplica en capas muy finas conocidas como veladuras, ya que el efecto deseado sólo se logra si se combina el color de esta sustancia con la reflectividad de la plata o el estaño.

Imagen 6. Los relieves de yeso del frontal del altar de Esterri de Cardós (s. XIII) en el Museo Nacional de Arte de Cataluña estaban recubiertos de estaño y corladura.

Imagen 6. Los relieves de yeso del frontal del altar de Esterri de Cardós (s. XIII) en el Museo Nacional de Arte de Cataluña estaban recubiertos de estaño y corladura.

El artista que pintaba con oro

Como ya hemos visto, el oro se ha empleado para realizar obras de orfebrería, dorar piezas o crear pequeñas esculturas, pero también ha tenido cierta relevancia en la pintura. Aunque aplicar oro con un pincel puede parecer complicado, existe una especie de pintura dorada: el oro en concha. Este curioso nombre es un vestigio de la época en la que el producto se guardaba en conchas de mar. Como el resto de pinturas, ésta consiste en partículas que otorgan color y una substancia que aglutina las partículas. Obviamente, en este caso el color lo otorga el oro metálico, mientras que el aglutinante puede ser goma arábiga, la miel u otras substancias dependiendo de la época y el origen. Aunque esta pintura no ha sido muy empleada para elaborar cuadros, resultaba especialmente útil para cubrir lagunas en dorados o alcanzar zonas a las que no se podía acceder con pan de oro.

En cualquier caso, si hablamos de oro y pintura, hay una figura que destaca por encima de todas las demás: la de Gustav Klimt, hijo de un grabador de oro. El artista austriaco no pintaba con oro en concha, sino que combinaba de forma magistral el óleo con el pan de oro. Klimt fue un creador todoterreno que a finales del s. XIX abanderó la Secesión de Viena, un movimiento de artistas que impulsó la renovación de estilos en Austria. Su primera gran obra con pan de oro fue Palas Atenea (1898), un cuadro donde la diosa griega posa altiva con su casco, égida y vara de noble metal. La blanquecina piel nos recuerda al marfil que Fidias usó para otra Atenea, la virgen (Partenos)que otrora se alzaba imponente en el Partenón.

Imagen 7. Palas Atenea (75×75 cm), de Gustav Klimt (1898) y recreación de la Atenea Partenos de Fidias en Nashville (Tenessee, Estados Unidos). Fuente: Wikimedia Commons.

Imagen 7. Palas Atenea (75×75 cm), de Gustav Klimt (1898) y recreación de la Atenea Partenos de Fidias en Nashville (Tenessee, Estados Unidos). Fuente: Wikimedia Commons.

Klimt creó sus obras más célebres durante la primera década del siglo XX. En ese momento llega el cenit de su fase dorada, un periodo en el que el artista produce piezas que recuerdan a los antiguos mosaicos bizantinos. Posiblemente la más conocida es El Beso (1908), uno de los grandes iconos del arte mundial, aunque Retrato de Adele Bloch-Bauer I (1907) no le anda a la zaga. Esta última gozó durante unos pocos meses del mérito de haber sido el cuadro más caro de la historia. Pero permítanme que acabemos este artículo con una obra que refleja como pocas la unión entre el valor simbólico y artístico del oro: Dánae.

Imagen 8. Dánae (77×83 cm), de Gustav Klimt (1907-1908). Fuente: Wikimedia Commons.

Imagen 8. Dánae (77×83 cm), de Gustav Klimt (1907-1908). Fuente: Wikimedia Commons.

Para saber más:

Ainhoa Gómez Pintado. El oro en el arte. Materia y espíritu : contribución a la restauración en el arte contemporáneo. UPV/EHU (2009).

El oro de los faraones. National Geographic.

Sofía Martinez Hurtado. El dorado. Técnicas, procedimientos y materiales. Ars Longa (11) (2002) 137-142.

Sobre el autor: Oskar González es profesor en la facultad de Ciencia y Tecnología y en la facultad de Bellas Artes de la UPV/EHU.

El artículo La tabla periódica en el arte: Oro se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La tabla periódica en el arte: Cobre

- La tabla periódica en el arte: Plata

- La tabla periódica en el arte: Hierro

Un estudio dice que…

Vitoria-Gasteiz acogió por primera vez el pasado 18 de octubre el evento Las pruebas de la educación, una jornada que abordó diversos temas educativos desde la evidencia científica. El acto, organizado por el Consejo Escolar de Euskadi y la Cátedra de Cultura Científica de la UPV/EHU, tuvo lugar en el Salón de Actos del Centro de Investigación Micaela Portilla, ubicado en el Campus de la capital alavesa de la UPV/EHU.

La jornada consta de un total de cinco charlas que tratan temas como el rendimiento académico, los métodos de aprendizaje y la innovación educativa, entre otros. La dirección del seminario corre a cargo de la doctora en psicología Marta Ferrero.

Ante el bombardeo diario que recibimos con resultados de estudios científicos, a veces sorprendentes, cuando no contradictorios, Miguel A. Vadillo, director del Cognition, Attention and Learning Lab en el Departamento de Psicología Básica de la Universidad Autónoma de Madrid, explica en esta charla cómo funciona la ciencia, qué es razonable esperar de ella y en qué plazos.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Un estudio dice que… se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Estudio de eficacia escolar en el País Vasco

- La innovación educativa actual desde la perspectiva histórica

- La letra pequeña de algunos métodos de aprendizaje

Atajos adiabáticos: lo bueno si breve…

En el mundo cuántico, los procesos ‘adiabáticos’ son aquellos en los que los controles del sistema se modifican lentamente. Muy comunes para preparar o cambiar estados sin excitar el sistema que queremos controlar, sufren sin embargo los mismos problemas que hemos mencionado en el párrafo anterior: falta de tiempo y probabilidad muy alta de ser perturbados. Son problemas graves en este contexto, ya que los estados de los sistemas cuánticos tienden a ser muy delicados y a degradarse rápidamente perdiendo precisamente sus valiosas y extrañas propiedades cuánticas como la posibilidad de explorar varios caminos a la vez. Para colmo, en un tiempo demasiado prolongado un átomo puede acabar escapándose de la trampa que lo contiene.

Los ‘atajos a la adiabaticidad’ son técnicas para soslayar las dificultades que acabamos de describir: se trata de conseguir los mismos resultados que los lentos procesos adiabáticos pero en poco tiempo. El término apareció por primera vez en 2010 en un trabajo publicado en Physical Review Letters por investigadores de la UPV/EHU con colaboradores de Alemania y Francia. Desde entonces estas ideas se han desarrollado por los autores del artículo y por muchos otros grupos, y se han puesto en práctica en numerosos experimentos con todo tipo de sistemas cuánticos. Da una idea del crecimiento exponencial de las aplicaciones el que solo en 2018 los atajos se han mencionado o utilizado en más de 1.500 artículos. El concepto de ‘atajo a la adiabaticidad’ se ha extendido también más allá del dominio cuántico hacia campos como la óptica, para fabricar dispositivos más compactos; o la ingeniería, donde, sorprendentemente, permite, por ejemplo, acelerar una grúa mecánica sin poner en riesgo la seguridad.

Un equipo europeo, con Gonzalo Muga (del equipo original) y Sofía Martínez Garaot, como investigadores de la UPV/EHU (Facultad de Ciencia y Tecnología), más otros cuatro coautores, ha compilado los conceptos, métodos y aplicaciones de los ‘atajos’ desarrollados durante estos diez últimos años en un sustancioso artículo –casi un breve libro- que servirá de referencia básica para cualquier avance posterior. El artículo, publicado en Review of Modern Physics, que ocupa el primer lugar entre las revistas de Física según varios criterios como el índice de Scimago o las citas por documento, combina según sus autores el rigor científico con una intención didáctica y tono ameno, como demuestra la Figura 1, que ilustra metafóricamente el espíritu de los atajos mediante una tortuga sobre ruedas.

Referencia:

D. Guéry-Odelin, A. Ruschhaupt, A. Kiely, E. Torrontegui, S. Martínez-Garaot, and J.G. Muga (2019) Shortcuts to adiabaticity: Concepts, methods, and applications Rev. Mod. Phys. doi: 10.1103/RevModPhys.91.045001

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Atajos adiabáticos: lo bueno si breve… se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Sin atajos frente al cáncer

- Breve historia de las ciencias del clima

- El ‘truelo’ de «el bueno», «el feo» y «el malo»

¿Qué es el pH?

Foto: Kelly Sikkema / Unsplash

Foto: Kelly Sikkema / UnsplashA menudo en cosmética se hace referencia al pH. También en productos de limpieza e higiene, y en alimentación. Incluso hay dietas anticientíficas, como la dieta alcalina, que dicen fundamentarse en el concepto de pH.

Para entender qué es el pH, primero debemos entender qué es un ácido.

A lo largo de la historia hemos dado descripciones cada vez más sofisticadas de qué es un ácido y, en consecuencia, hemos diseñado una variable para medir el nivel de acidez de una sustancia: el pH.

Al principio hablábamos de ácidos como sustancias con una serie de propiedades comunes con respecto al sabor. El sabor ácido del limón o del vinagre, por ejemplo. Ahora sabemos que estos sabores dependen del ácido cítrico y del ácido acético, respectivamente. Además, descubrimos que estas sustancias de “sabor ácido” tiñen de rojo determinados pigmentos, como el tornasol que se extrae de algunos líquenes. Tradicionalmente se extrae de roccellas y dendrographas. También atacan al mármol y reaccionan con algunos metales desprendiendo gas hidrógeno. El químico Robert Boyle fue el primero en llamar ácidos a estas sustancias con propiedades similares. Fue en 1663.

Hay sustancias que son opuestas a los ácidos. Que en contacto con los ácidos amortiguan sus propiedades. Son sustancias de sabor amargo, que producen sensación jabonosa en la piel y tiñen de azul el tornasol. A estas sustancias las denominamos álcalis, del árabe al kali, que significa cenizas vegetales.

Cuando mezclamos una sustancia ácida con otra alcalina se obtiene una sal que pierde las propiedades de ambas. Así los álcalis recibieron más tarde el nombre de bases, del griego basis, que significa fundamento para la obtención de sales. Cuando se mezcla un ácido con una base se forma una sal.

Sabemos que las propiedades de cualquier sustancia dependen de su composición y de su estructura. El químico Lavoisier conjeturó que los ácidos eran sustancias que contenían un elemento químico que en 1777 denominó oxígeno. La palabra oxígeno está formada por dos raíces griegas, oxys, ácido, por el sabor punzante de estas sustancias, y genes, productor o engendrador. De modo que la palabra oxígeno significa engendrador de ácidos.

Sin embargo, años más tarde se descubrieron otras sustancias con propiedades ácidas que no contenían oxígeno en su composición. Como el ácido muriático (hoy llamado ácido clorhídrico, HCl) que sirvió al químico Humphry Davy para conjeturar en 1810 que la acidez de las sustancias depende del hidrógeno, no del oxígeno.

Más adelante, el químico Justus von Liebig quiso completar la idea de Davy. En 1838 propuso la existencia de dos tipos de hidrógeno, siendo el hidrógeno que puede sustituirse por metales el responsable de las propiedades de los ácidos.

El químico Svante August Arrhenius fue más allá. En 1887 propuso que el hidrógeno ácido era hidrógeno que se desprendía de las sustancias ácidas como ion hidrógeno, escrito H+ y coloquialmente denominado protón.

Esto permitió dar una definición más concreta sobre las bases. Arrhenius conjeturó que, si las bases neutralizaban a los ácidos sería porque contienen un ion de carga opuesta que da lugar a la formación de una sustancia que no es ni ácida ni básica, sino neutra. Pensó que ese ion sería el OH–, ya que al unirse al H+ de los ácidos, daría lugar a la formación de agua, H2O.

Las definiciones de Arrhenius para los ácidos y las bases son limitadas, sobre todo para las bases, ya que no todas las sustancias de propiedades básicas contienen OH–, como por ejemplo una conocida base que utilizamos como producto de limpieza: el amoníaco, NH3. Sin embargo, y a pesar de sus inconvenientes, esta teoría estuvo vigente casi cuarenta años, durante los cuales se fueron sucediendo nuevas ideas que darían lugar a teorías más completas.

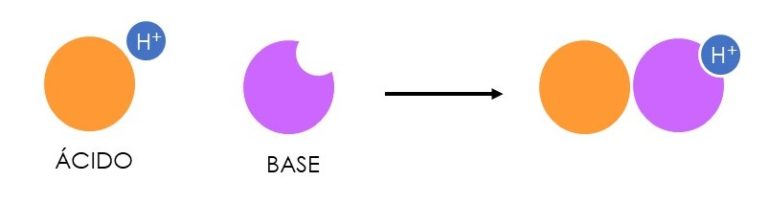

El químico Johannes Nicolaus Brønsted y el químico Thomas Martin Lowry, simultáneamente, pero siguiendo líneas de trabajo diferentes, propusieron en 1923 una definición más precisa sobre los ácidos y las bases. Esta definición forma parte de la que conocemos como teoría ácido-base de Brönsted-Lowry. Según esta teoría, los ácidos son sustancias capaces de donar un protón (H+), mientras que las bases son capaces de aceptarlos. De esta manera las reacciones entre ácidos y bases pueden interpretarse como reacciones de transferencia de protones. Así por ejemplo el amoníaco (NH3), es una base porque es capaz de captar H+ y formar el ion amonio (NH4+).

Imagen: Deborah García Bello

Imagen: Deborah García BelloEn la actualidad existen teorías más completas que la de Brönsted-Lowry, siendo la más conocida la teoría de Lewis de 1938, que se basa en un concepto electrónico de mayor complejidad. Aun así, la definición de uso más común de ácidos y bases es la que formularon Brönsted y Lowry.

A partir de la definición de ácido de Brönsted y Lowry, el químico Søren Peter Lauritz Sørensen introdujo por primera vez en 1909 el concepto de pH. El pH está ligado a la cantidad de H+.

Mediante el uso de electrodos podemos medir la cantidad de H+ presente en una disolución, es decir, la concentración de H+.

Para darle una numeración más manejable, Sørensen decidió aplicar la función logaritmo sobre el valor de la concentración de H+. Esa es la definición matemática del pH: el logaritmo en base 10, cambiado de signo, de la concentración de H+, cuando ésta se expresa en moles por decímetro cúbico.

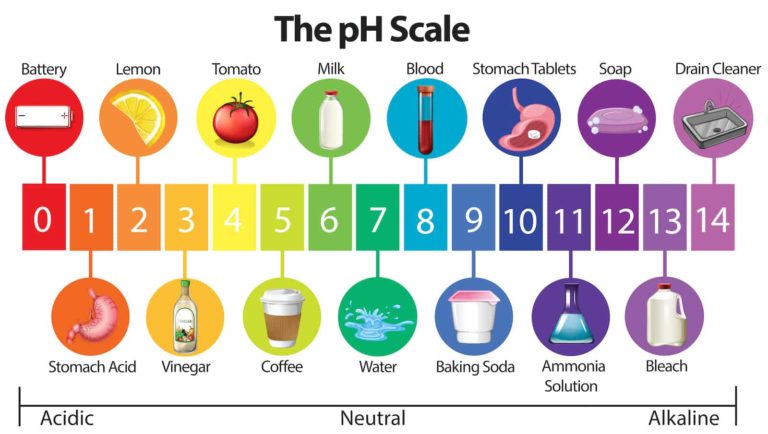

Fuente: Vectores por Vecteezy

Fuente: Vectores por VecteezyDe esa manera obtuvo una escala de pH, que es la que utilizamos en la actualidad, que normalmente oscila entre los valores 0 y 14. Así, el valor de pH 7 se corresponde con las sustancias neutras. El agua pura tiene pH 7. Las sustancias ácidas son las que tienen un pH inferior a 7, y las básicas superior a 7.

En la actualidad, para medir el pH utilizamos un electrodo sensible a los H+. Se conoce como pH-metro (pronunciado peachímetro). Cada vez que se usa hay que calibrarlo usando unas disoluciones de referencia cuyo pH es conocido y sirven de patrón para que el aparato construya la escala de pH.

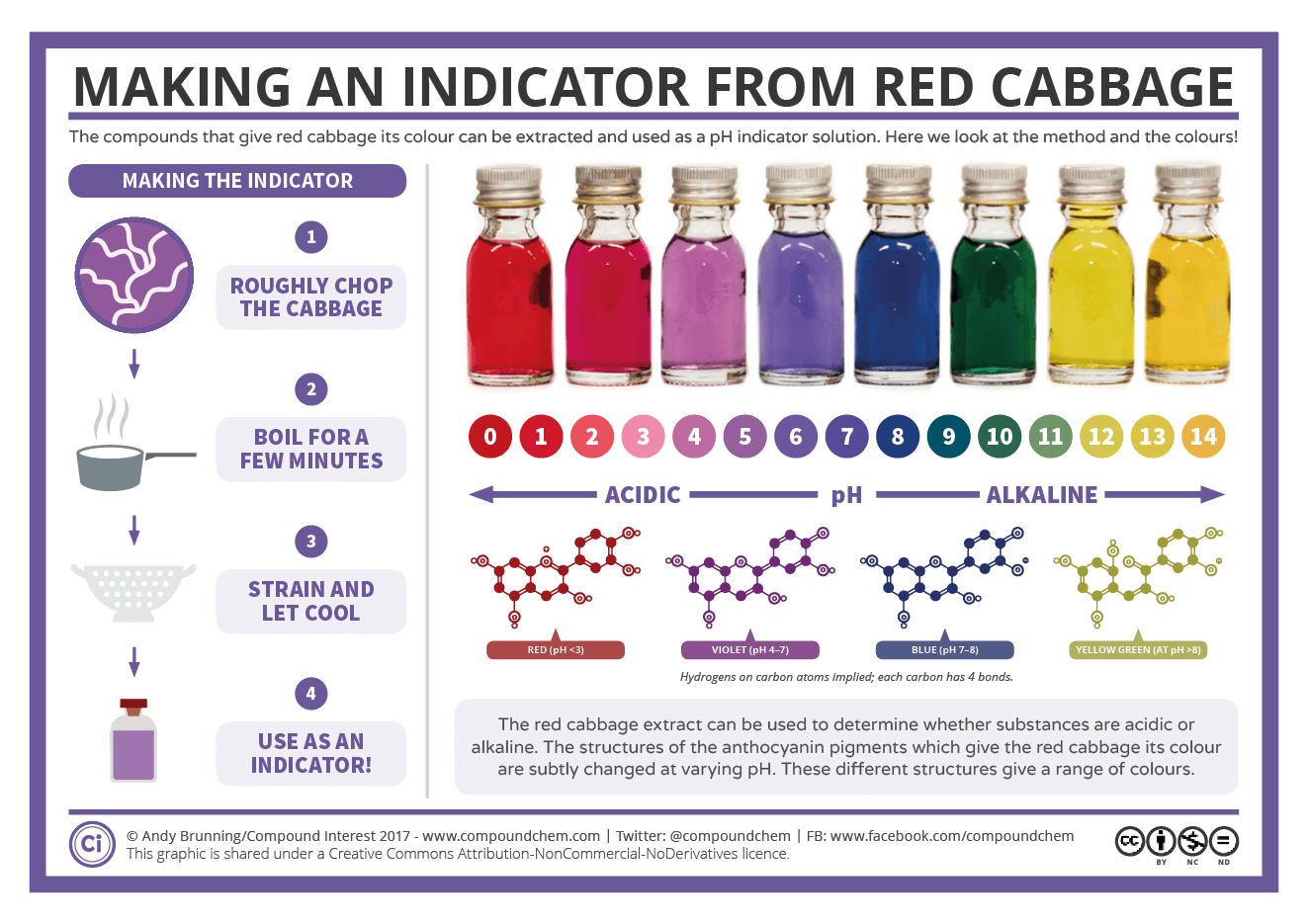

Hay otras maneras de medir el pH. Una manera no tan precisa, pero útil, es el uso de indicadores colorimétricos de pH. Según el color que adquieren, podemos saber el valor aproximado del pH. El más antiguo y que se sigue usando es el tornasol. En disoluciones ácidas, de pH inferior a 5, el tornasol es rojo, mientras que cuando el pH excede de 8 se vuelve azul.

Los indicadores son ácidos débiles, es decir, aunque tengan preferencia por donar iones H+, también coexisten con otra forma básica que puede aceptarlos, y cada una de estas formas presenta una coloración diferente.

Otro indicador colorimétrico de origen vegetal son las antocianinas. Las antocianinas de la col lombarda se pueden aprovechar para fabricar un papel indicador ácido-base casero. Para eso se empapa un papel de filtro con zumo concentrado de lombarda macerada y hervida. El papel se deja secar y finalmente se corta en tiras para obtener varios indicadores de pH. A pH entre 1 y 2 el color del zumo de lombarda será rojizo, a pH 4 será color ciruela, a pH 5 será púrpura, a pH 6-7 será azul, a pH 8 será azul verdoso, a pH 9-10 será verde esmeralda, a pH 10-11 será verde hierba, a pH 12-13 será verde lima y a pH 14 amarillo.

En el laboratorio utilizamos varios indicadores de pH. Los más habituales son la fenolftaleína, el naranja de metilo o el azul de metileno.

El pH es una variable química que nos permite medir el grado de acidez de una sustancia. Su definición tiene cierta complejidad, y aun así ha calado en el lenguaje coloquial. Sin embargo, la palabra pH no siempre se emplea de manera correcta. De hecho, ignorar el significado del pH, igual que ignorar qué es un ácido o qué es un álcali, hace que las decisiones también sean ignorantes. Como decantarse por la compra de un producto, sin entender si su pH lo hace mejor o peor, o decidir seguir una dieta aberrante porque presuntamente está basada en este concepto científico. Por cierto, el zumo limón no es alcalino, es ácido.

Sobre la autora: Déborah García Bello es química y divulgadora científica

El artículo ¿Qué es el pH? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Por qué se corta la mayonesa y qué relación tiene esto con la cosmética

- Sal de la piscina si te pican los ojos y no mezcles lejía con amoniaco

- El ácido hialurónico no sirve para todo, aunque lo parezca

¿Cuántas bolas contiene el jarrón al mediodía?

Un buen chiste matemático es mejor, y mejor matemática, que una docena de publicaciones mediocres.

John Edensor Littlewood, A Mathematician’s Miscellany, 1953

El matemático británico John Edensor Littlewood (1885-1977) publicó en 1953 su autobiografía, A Mathematician’s Miscellany, que contenía numerosas anécdotas. Se reeditó en 1986, añadiendo más contenidos, bajo el título de Littlewood’s miscellany.

En este último libro, Littlewood utiliza ese sentido del humor al que alude la cita inicial para enunciar la llamada ley de Littlewood que establece que «una persona puede esperar que le suceda un milagro aproximadamente una vez al mes». Pero, ¿qué es un milagro? Littlewood lo define así:

Un evento extraordinario que tiene un significado especial y ocurre con una frecuencia de uno entre un millón.

Y el matemático argumenta entonces de la siguiente manera:

Mientras una persona está despierta puede percibir ‘un evento’ por segundo, evento que puede ser ordinario o extraordinario. Supongamos que una persona es ‘receptiva’ aproximadamente durante ocho horas al día. Así, experimenta 28.800 eventos al día –una hora tiene sesenta minutos y cada minuto sesenta segundos: son 8x60x60–. Así, en 35 días, una persona experimentará 1.008.000 de eventos. Según la definición dada de milagro, una persona puede esperar un acontecimiento milagroso cada 35 días.

Es decir, según Littlewood, los milagros no son tan extraños, ni tienen que ver con poderes sobrenaturales. En efecto, tan solo hay que tener en cuenta la ley de los grandes números…

En A Mathematician’s Miscellany, Littlewood describe un problema conocido actualmente como la paradoja de Ross-Littlewood. Toma su nombre del matemático Sheldon Ross (1943) quien lo detalló en su libro A First Course of Probability (1988). Esta paradoja intenta ilustrar los problemas conceptuales relacionados con la noción de supertarea –sucesión infinita numerable de operaciones que se producen secuencialmente en un intervalo de tiempo finito–.

Planteamiento del problema

Tenemos un jarrón vacío y una cantidad infinita numerable de bolas a nuestra disposición. En cada paso –recordemos que hay un número infinito de ellos– se agregan 10 bolas al jarrón y se retira 1 bola del mismo. Se supone que el jarrón está vacío un minuto antes del mediodía, y que se realizan los infinitos pasos de la manera siguiente:

-

el primer paso se realiza 30 segundos antes del mediodía;

-

el segundo paso se realiza 15 segundos antes del mediodía;

-

así, cada paso siguiente se realiza en la mitad del tiempo del paso anterior, es decir, el paso n se realiza 2−n minutos antes del mediodía.

Continuando de este modo, transcurrido un minuto, se han realizado una cantidad infinita numerable de pasos. La pregunta es: «¿cuántas bolas hay en el jarrón al mediodía?».

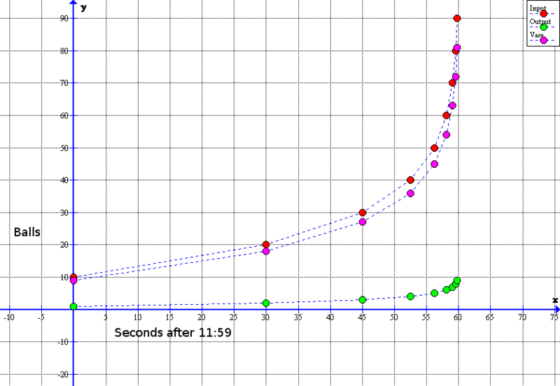

Gráfica que muestra el número de bolas dentro y fuera del jarrón en los diez primeros pasos. Imagen: Wikimedia Commons.

Gráfica que muestra el número de bolas dentro y fuera del jarrón en los diez primeros pasos. Imagen: Wikimedia Commons.

No hay una única respuesta como veremos a continuación, y de allí que hablemos de paradoja… ¿Quizás estemos asistiendo a ese acontecimiento milagroso que es posible que nos ocurra este mes de noviembre?

Algunas respuestas a la pregunta

-

El jarrón contiene infinitas bolas

En efecto, en cada paso se añaden más bolas de las que se eliminan. Es decir, en cada paso habrá un número mayor de bolas que en el paso anterior. Así, si el número de bolas aumenta en cada paso y hay un número infinito de ellos, habrá infinitas de bolas al mediodía.

-

El jarrón está vacío

Supongamos que las bolas están numeradas. Argumentamos del siguiente modo: en el paso 1 se meten en el jarrón las bolas 1 a 10 y se saca la bola número 1. En el paso 2, se introducen las bolas numeradas 11 a 20, y se retira la bola 2. Si se continúa de este modo, al mediodía, la bola número n introducida en el jarrón se elimina en un paso posterior –en el paso n–. Así, si cualquier bola se extrae en alguno de los pasos, el jarrón está obviamente vacío al mediodía.

-

Depende de las condiciones

Esta respuesta afirma que la cantidad de bolas contenidas en el jarrón al mediodía depende del orden en el que se sacan las bolas del jarrón. Antes hemos visto la manera en la que se consigue demostrar que el jarrón está vacío al mediodía. Supongamos ahora que la bola número 10 se retira del jarrón en el paso 1, la bola número 20 en el paso 2, y así sucesivamente. Procediendo de esta manera, es claro que al mediodía quedan infinitas bolas en el jarrón.

Pero, más aún, es posible razonar de manera que, al mediodía, queden cualquier número de bolas –n– en el jarrón. En efecto, si p es el número de paso que se está realizando, se procede del siguiente modo:

-

se ponen las bolas numeradas 10p-9 a 10p en el jarrón,

-

si p≤n, se saca la bola número 2p,

-