Tenperatura ultra-beroak eragindako egitura kontinentala

Lurrazalak pentsa baino tenperatura altuagoak jasan zituen gaur egun ezagutzen ditugun kontinenteetan egonkortzeko. Hori da Pennsylvaniako eta Columbiako bi ikertaldek milaka arrokaren konposizio kimikoa aztertu ostean ondorioztatu dutena. Aurkikuntza berriak ez ditu soilik prozesu geologikoez dugun ulerkuntza eta mineral kritikoen kokalekuen identifikazioa hobetzen; horrez gain, beste planeta batzuen etorkizuneko bizigarritasuna aztertzeko bidea ere zabaltzen du.

Lurrazal kontinentala mendi, haran eta lurreko ekosistema guztiak eusten dituen oinarri fisikoa da. Alabaina, egitura geologiko hau, lurreko ekosistemen oinarri izateaz gain, bada ere lurreko klima egonkor iraunarazten duen geruza. Izan ere, duen konposizio kimikoa dela eta, erregulatu egiten du, meteorizazio kimikoaren bitartez, gure atmosferako karbono dioxidoaren kontzentrazioa. Beraz, gaur egun ezagutzen dugun bizitza milaka milioi urtez egonkor iraun duen egitura geologikoari esker garatu da. Alabaina, hauskorra da geruza kontinentala. Izan ere, egonkortasun fisiko, kimiko eta estrukturala hiru elementu kimikoren kontzentrazioan oinarritzen da: beroa igortzen duten uranio (U), torio (Th) eta potasioan (K). Hain zuzen ere, ikertzaileek aurkitu dutenaren arabera, kontinenteen egonkortasunak iraun dezan lurrazalaren azken 10-15 kilometroetan elementu hauen kontzentrazioa nabarmen handiagoa izan behar da beheko geruzetan dagoena baino.

1. irudia: Pennsylvaniako eta Columbiako Unibertsitateko ikertzaileek arroken konposizio kimikoei buruz egin duten ikerketa berri batek frogatzen du tenperatura dela lurreko kontinenteen egonkortasunaren gakoa. (Argazkia: Jaydyn Isiminger. Iturria: Penn State Unibertsitatea)

1. irudia: Pennsylvaniako eta Columbiako Unibertsitateko ikertzaileek arroken konposizio kimikoei buruz egin duten ikerketa berri batek frogatzen du tenperatura dela lurreko kontinenteen egonkortasunaren gakoa. (Argazkia: Jaydyn Isiminger. Iturria: Penn State Unibertsitatea)Azken mendean zehar teoria ugari saiatu dira geruza geologikoan dauden elementu bereizketa azaltzen. Teoria hedatuenaren arabera, elementu kimikoen bereizketaren eragilea izan zen lurrazal kontinental sakona urtzea eta funtsezko mineralak disolbatzea. Hala ere, gaur egun, ikertzaileek ebidentzia enpiriko gehiago dituzte erakusten dutenak uranioan eta torioan aberatsak diren mineralak ez direla disolbatzen 900 °C-tik beherako fusio partzialeko prozesuetan, eta horrek zalantzan jartzen du teorema nagusia.

Orain, Pennsylvaniako eta Columbiako bi ikertaldek lurrazal kontinentaletako gertakari geologikoen egonkortasun-prozesua azaltzen duen ebidentzia nabarmena aurkeztu dute Nature Geoscience aldizkarian argitaratutako artikuluan.

Elementu kritikoen eta bizigarritasunaren bilaMilaka milioi urte dituen lurrazal kontinental egonkorra sortzeko, 900ºC baino gehiagoko tenperaturak behar izan ziren planetaren beheko lurrazalean. Tenperatura altu horiek funtsezkoak izan ziren uranioa eta torioa bezalako elementu erradioaktiboak bereizteko. Izan ere, elementu horiek beroa askatzen dute desintegratzean, eta, beraz, geruza sakonetik gainazaleraino mugitzean, berekin eraman zuten beroa, eta, lurrazal sakona hoztu eta egonkortu egin zen horrela.

Artikuluaren egile nagusia den Andrew Smye-k azaltzen duenez, “Kontinenteen egonkortasuna bizitza aurrera eramateko ezinbesteko baldintza da, baina egonkortasun hori lor dezaten, hoztu egin behar dira kontinenteak”. Hori gertatzeko, beroa sortzen duten elementuak gaineko lurrazal kontinentalera mugitu behar dira; izan ere, “elementu horiek sakonuneetan geratzen badira, beroa sortzen dute, ondorioz, azala urtu eta egitura geologikoa ezegonkortu”, dio Smye-k.

Halaber, ikertzaileek lortutako emaitzek ez dute soilik kontinenteen prozesu geologikoak ulertzen laguntzen; horrez gain, gaur egun, teknologia eta aplikazio askotan erabiltzen ditugun mineral kritikoen kokalekuen inguruko gakoak eskaintzen dituzte. Izan ere, ikerketan azaltzen diren kontinenteen estabilizazio-prozesuek litioa, eztainua eta tungstenoa bezalako elementu kritikoak mugiarazi zituzten.

Gainera, kontinenteen egonkortze-prozesuak ulertzeak beste planeta batzuen etorkizuneko bizigarritasunaren inguruko ikerketak hobetzeko atea irekitzen du. Gaur egun espazio-esplorazioetan aurkitzen diren planeta berriek tenperatura ultra-beroak izaten dituzte, baina agian tenperatura altuak jasatea aurrebaldintza bat izan daiteke kontinenteak egonkortzeko.

Gakoa tenperaturan dagoOrain arte, mundu osoko zientzialariek pentsatzen zuten gakoa kontinenteak eratu aurretik existitzen zen lurrazalaren konposizioan zegoela. Iraganeko lurrazalak silizio-kontzentrazio askoz ere handiagoa zuen, baina Nature Geoscience aldizkarian argitaratutako artikuluak ezezaguna zen datu bat uzten du agerian: lurrazalak muturreko tenperaturak jasan behar ditu egonkortzeko.

Prozesua azaltzeko, Smye-k kontinenteen egonkortze-prozesua altzairuaren forjaketarekin alderatzen du: “metala muturreko tenperaturetara berotzen da mekanikoki moldatu ahal izateko. Horrela materialaren egitura birsortzen da eta horrek ezpurutasun estruktural guztiak desagerrarazten ditu. Bi faktore hauek altzairu forjatuaren indarra handitzen duten bezala, orain badakigu antzeko prozesu bat gertatu behar dela kontinenteen egonkortasuna lortzeko”.

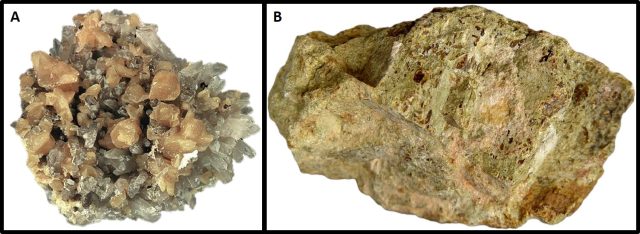

2. irudia: ikertzaileek Europako Alpeetako eta Estatu Batuetako hego-mendebaldeko arroken laginak hartu zituzten lurrazalaren geruzak mapeatzeko. (Argazkia: Jaydyn Isiminger. Iturria: Penn State Unibertsitatea)Bi kontinentetan eta bi tenperaturatan jasotako laginak

2. irudia: ikertzaileek Europako Alpeetako eta Estatu Batuetako hego-mendebaldeko arroken laginak hartu zituzten lurrazalaren geruzak mapeatzeko. (Argazkia: Jaydyn Isiminger. Iturria: Penn State Unibertsitatea)Bi kontinentetan eta bi tenperaturatan jasotako laginak

Ondorioak ateratzeko, ikertaldeek ehunka lagin jaso zituzten Europako Alpeetan eta AEBko hego-mendebaldean. Hain zuzen ere, lurrazaleko behe-geruza osatzen duten arroka metasedimentario eta metaigneoak jaso zituzten, konposizio kimikoa aztertu zuten eta, ondoren, haien tenperatura metamorfiko maximoen arabera sailkatu zituzten. Horrela, ikertzaileak bi baldintzatan eratutako arrokak bereiztu zituzten: tenperatura altuetako arrokak eta tenperatura bortitzetako arrokak. Zientzialariak harritu egin ziren 900ºC-tik gorako tenperaturetan urtutako arroken aniztasun errepikakorra aurkitzean: “Harrigarria da hainbeste lekutako arrokek osatzen duten seinalea ikustea”, dio Smye-k.

Horrela lortutako emaitzen bidez, ikertzaileek ondorioztatu zuten beroa igortzen duten arroka erradioaktiboak gainazalerantz mugitu zirela lurrazal sakona hozteko eta kontinenteak egonkortzeko. Gainera, Smye-k azaltzen duenez, “garai hartako elementu erradioaktiboek bero gehiago igortzen zuten eta, beraz, bero gehiago zegoen sisteman. Gaur egun, ezinezkoa da prozesu hau errepikatzea, bero gutxiegi du lurrazalak arroken forja erako eragiketa gauzatzeko”.

Erreferentzia bibliografikoa:Smye, Andrew J.; Kelemen, Peter B. (2025). Ultra-hot origins of stable continents. Nature Geoscience, 1–7. DOI: 10.1038/s41561-025-01820-2

Egileaz:Oxel Urra Elektrokimikan doktorea da, zientziaren eta artea uztartzen duten proiektuetan aditua, egun zientzia-komunikatzailea da.

The post Tenperatura ultra-beroak eragindako egitura kontinentala appeared first on Zientzia Kaiera.

γ-Laktama-deribatuen osagai anitzeko sintesi enantioselektiboa

Industria farmazeutikoek eta sendagaiak arautzen dituzten agentziek, lehentasun estrategiko nagusien artean, molekula enantiomeriko puruen sintesia ezarri dute. Izan ere, frogatu da molekula kiral baten nahaste errazemikoaren eta enantiomero bakoitzaren artean eraginkortasun eta segurtasun desberdintasun nabarmenak daudela. Ondorioz, kimika organikoaren arloan, molekula kiral optikoki puruak lortzeko protokolo sintetiko berriak garatzea erronka zientifiko eta teknologiko garrantzitsua bilakatu da. Helburu hau lortzeak, sendagai berrien garapena sustatzeaz gain, molekula kiralen propietate espezifikoak hobeto ulertzea ahalbidetuko luke.

Industria mailan, molekula optikoki puruak lortzeko metodo erabiliena errazematoen erresoluzioa da, zeinak molekula kiral baten bi enantiomeroak bereiztea ahalbidetzen duen. Erresoluzioa hainbat tekniken bidez erdiesten da, hala nola, kristalizazioaren bidez, non enantiomero baten kantitate txiki bat gehitzeak kristalizazioa bultzatzen duen. Era berean, errazematoen erresoluzioa kromatografia kiralaren bidez ere gauzatu daiteke, fase geldikor kiralez betetako zutabeak erabiliz enantiomeroak banatzeko. Gainera, produktu baten enantiomeroek erreaktibo kiral batekin abiadura desberdinarekin erreakzionatzen dutenean, banaketa erresoluzio zinetikoaren bidez lor daiteke, % 50eko etekin maximoa lortuz. Molekula optikoki puruak kiraltasunaren gordailua teknikaren bidez lor daitezke ere. Metodo honetan, substratu natural optikoki puruak lehengai gisa erabiltzen dira, eta transformazio sintetikoen bidez helburu produktua eskuratzen da. Azkenik, sintesi asimetrikoa laguntzaile kiralen bidez edo metodo katalitiko asimetrikoen (katalisi entzimatikoa, katalisi metalikoa edo organokatalisia) bidez egiten da. Azken metodo honek abantaila ugari eskaintzen ditu besteen aurrean, hala nola, urrats sintetikoen kopurua murriztea eta katalizatzailearen kantitate azpiestekiometrikoak erabiltzea.

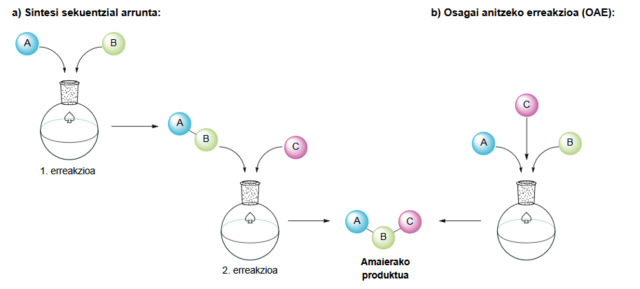

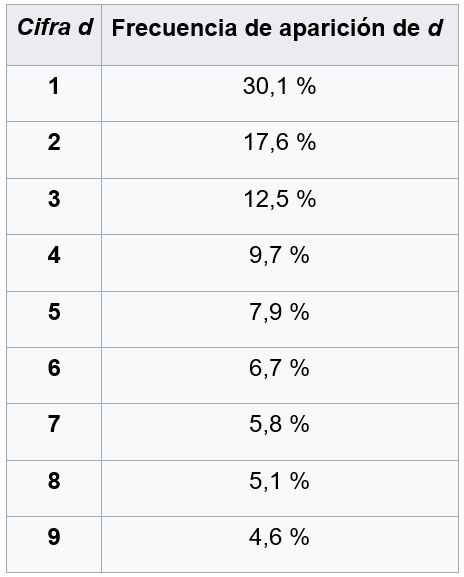

Irudia: sintesi sekuentzial arrunta vs. osagai anitzeko erreakzioa (OAE). (Iturria: Ekaia aldizkaria)

Irudia: sintesi sekuentzial arrunta vs. osagai anitzeko erreakzioa (OAE). (Iturria: Ekaia aldizkaria)Testuinguru honetan, osagai anitzeko erreakzioak (OAE) metodologia ezin hobeak bilakatu dira molekula konplexuak sintetizatzeko, izan ere, OAE-k hiru erreaktibo edo gehiagoren erreakzioa ahalbidetzen dute ‘ontzi bakarreko’ prozeduran. Honek hainbat abantaila erakusten ditu urrats anitzeko protokoloen aurrean, esate baterako, denboraren optimizazioa, efizientzia atomiko handia eta hondakinen murrizketa lortzea. Bereziki, farmazia arloan potentzial handia erakutsi dute, aktibitate handiko molekulen sintesia errazten dutelako.

Lan honetan, potentzial biologiko handia duten γ-laktama α,β-asegabeak era enantioselektiboan lortzeko osagai anitzeko prozedura bat garatu da. Horretarako, etil pirubatoa, bentzaldehidoa eta p-toluidina erabili dira eredu erreakzioaren lehengai gisa, eta katalizatzaile moduan BINOL eta VAPOLetik eratorritako azido fosforiko kiral desberdinak frogatu dira. BINOLetik eratorritako trifenil silil ordezkatzailea duen azido fosforikoak soberakin enantiomeriko altuena eman du (% 67). Katalizatzaile eraginkorrena identifikatu ondoren, optimizazio prozesua jarraitu zen, eta dietil eterra disolbatzaile egokiena eta katalizatzailearen karga optimoa % 10ekoa zela frogatu zen, eredu erreakzioan % 96ko soberakin enantiomeriko aparta lortuz.

Behin erreakzio-baldintzak optimizatu ondoren, osagai anitzeko erreakzioa amina eta aldehido desberdinekin frogatu da, erreakzioaren potentziala argitzeko. Amina aromatikoen ordezkatzaileen kasuan, halogenoek eta talde elektroi-emaileek soberakin enantiomeriko altuak ematen dituzte. Aldehidoen kasuan, aromatikoekin etekin eta enantioselektibitate altuak neurtu dira; aldiz, aldehido heteroaromatikoen erabilerak erreakzioen enantiokontrolaren murrizketa eragin du. Aldehido alifatikoekin, aldiz, soberakin enantiomeriko onargarriak lortu dira. Azpimarratu behar da erreakzio honen bidez % 99 baino altuagoa den soberakin enantiomerikoa lortu dela. Azkenik, X-izpien difrakzioaren analisiaren bidez, lortutako γ-laktama α,β-asegabeen konfigurazio absolutua S dela baieztatu da.

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: 47

- Artikuluaren izena: γ-Laktama-deribatuen osagai anitzeko sintesi enantioselektiboa.

- Laburpena: Gaur egun, industria farmazeutikoak eta sendagaiak erregulatzen dituzten agentziek molekula enantiomeriko puruen sintesia lortzea ezarri dute beren lehentasun sintetikoen artean. Hori dela eta, kimika organikoan interes handiko helburua bilakatu da molekula kiral optikoki puruak lortzeko egokiak diren protokolo sintetiko berriak garatzea. Testuinguru honetan, osagai anitzeko erreakzioak (OAE) metodologia ezin hobeak dira, sintesi sekuentzial arrunten aurrean erakusten dituzten abantailen ondorioz. Dokumentu honetan, BINOLetik eratorritako azido fosforiko kiralen bidez katalizatutako aminen, aldehidoen eta etil pirubatoaren arteko osagai anitzeko metodologia enantioselektiboa garatu da, konposatu natural eta ez-natural anitzen egituretan aurki daitezkeen γ-laktama α,β-asegabeak eskuratzeko.

- Egileak: Zuriñe Serna-Burgos, Adrián López-Francés, Javier Vicario eta Xabier del Corte

- Argitaletxea: EHUko argitalpen zerbitzua

- ISSN: 0214-9001

- eISSN: 2444-3255

- Orrialdeak: 75-92

- DOI: 10.1387/ekaia.26205

Zuriñe Serna-Burgos, Adrián López-Francés, Javier Vicario eta Xabier del Corte EHUko Farmazia Fakultateko OSMC ikerketa-taldeko eta Kimika Organikoa I Saileko ikertzaileak dira.

Ekaia aldizkariarekin lankidetzan egindako atala.

The post γ-Laktama-deribatuen osagai anitzeko sintesi enantioselektiboa appeared first on Zientzia Kaiera.

Ana M. González Ramos: «Gizarte zientzietan onartzen dugu ikerketa bidea dela, eta ez soluzio finalista bat»

Ana M. González Ramos Zientzia Ikerketen Kontseilu Nagusiko (CSIC) zientzialari titularra da Kordobako Gizarte Ikerketa Aurreratuen Institutuan (IESA). Hauek dira bere ikerlanen ardatzak: Osasunaren arloko Generoaren Dimentsio Soziala, diziplinarteko ikuspegi feminista batetik, eta nola androzentrismoak (subjektu maskulinoaren zentralitatea behaketa unitate unibertsal gisa) medikuntzan ezagutza zeharka ebaki eta emakumeen osasuna baztertuta utzi duen.

Espejo Internet. Ensayo sobre los trastornos de la conducta de la alimentación en la era de la información (Internet ispilua. Informazioaren garaiko elikadura-jokabidearen nahasmenduei buruzko saiaketa) bere liburuan (Icaria argitaletxea, 2021), elikadura-nahasmenduak lantzen ditu sare sozialetatik eta gizarte garaikidearen balio erreputazionaletatik abiatuta. «La dimensión social y de género en la salud y la medicina. El caso de las guías de salud como instrumento de atención biomédica» (Dimentsio soziala eta generoarena osasunean eta medikuntzan. Osasun giden kasua arreta biomedikoko tresna gisa) proiektuaren bidez, aztertu egiten du nola medikuntzaren erreferentziako baliabideek genero itsutasun hori islatzen duten. Egun, CSICen Soziologiari buruzko Nazioarteko Aldizkariko zuzendarikidea eta Valladolideko Unibertsitateko Soziologiari eta Teknozientziari buruzko aldizkariko zuzendariordea da.

Irudia: Ana M. González Ramos ikertzailea. (Argazkia: Ana M. González Ramosek emana).Zein da zure ikerketa arloa?

Irudia: Ana M. González Ramos ikertzailea. (Argazkia: Ana M. González Ramosek emana).Zein da zure ikerketa arloa?

Nire ezagutza eremua soziologia da. Soziologiaren barruan, hainbat ildo eta ikerketa galderatatik igaro naiz, baina beti orientatu ditut genero ikuspegitik (edo, egun esango litzatekeen moduan, genero ikuspegia gehitu diot jorratutako ikergaietako edozeini). Hau da, garunen ihesak eta nazioarteko mugikortasunak zientzia eta teknologiaren sistema espainiarra nola hobetzen zuten ikertzen ari nintzenean, nire ikuspegia izan da zein zailtasun izan dituzten emakumeek eta gizonek beren bikaintasuneko karrera profesionalak garatzeko orduan. Baita zer gertatzen den ikerketa programek edo herrialdeek zientzialarien bikoteen mugikortasuna sustatzen dutenean. Zer-nolako eragina duten emakumeen karrerek kasu horietan, ea beren bikotekideak diren bien bizitzetako une erabakigarri guztietan erabakia hartzen dutenak, lekualdaketei buruzkoak, adibidez, ere ikertu ditut. Nire ikerketa Interneti buruzko azterlanetan zentratu denean, horrek emakumeen bizitzan dituen eragin positiboak eta negatiboak jaso ditut, zer-nolako estereotipoak erreproduzitzen diren oraindik ere sare sozialetan (edertasun motak, nutrizioa, erreputazioa), eta ea eraldatzen eta desegiten ari garen genero kode tradizionalak.

Egun, osasunaren esparrura itzuli naiz. Esparru hori benetan maite dut, 90eko hamarkadaren erdialdean bekadun hasi nintzenetik Granadako Osasun Publikoaren Andaluziako Eskolan. CSICen, eta, zehatzago, Gizarte Ikerketa Aurreratuen Institutuan, Osasunaren Dimentsio Sozialari eta Genero Dimentsioari buruz ikertzen dut. Osasuna ikuspegi biomediko batetik aztertzen da, eta horrek, askotan, faktore sozialekin dituen interferentziak aztertzeko beharra bazter uzten du: Nahikoa da diabetesa kontrolatuko duen printzipio aktiboa ezagutzearekin? Ez litzateke arduratsuagoa izango haurren portaera ezagutzea gaixotasunaren garapena prebenitzeko?

Gizartearen antolaketaren eta ezagutza zientifikoaren beste alderdi batzuek bezala, osasunak eta medikuntzak ikuspegi androzentrikoa hartu dute. Ezagutza objektiboa partzialki eraikita dago, maskulinotik: ikertzailea, esperimentuak egiteko animalia, medikua… baina errealitatea, guztiz kontrara, konplexua eta orokortua da. Adibidez, farmako berri bat esperimentatzen baldin bada gizon talde batekin, antzeko ezaugarriak dituzten beste gizon batzuentzako dosi zehatza jakingo dugu, baina ez dugu jakingo, ordea, zer-nolako eragina duen farmako horrek emakume helduengan, nagusiengan edo gazte eta adingabeengan. Zientziaren oinarrizko printzipio hori, maiz, bazter utzi da. Horregatik esan ohi dugu medikuntzak ezagutza hutsuneak dituela emakumeei buruz, beste populazio batzuen artean. Gizonen eta emakumeen arteko alderaketa azpimarratzen dut, baina baita ikuspegi intersekzionala ere. Izan ere, haurdunaldiko arriskuak ez dira berberak auzo pobre bateko emakume beltz batentzat edo osasun baliabideak dituen emakume zuri batentzat.

Elementu historikoek, kulturalek, ingurumenekoek eta nutrizioari lotutakoek inguratzen dituzte biomedikuntzan kontrolatutako aldagaiak, eta baztertu ohi den azalpenezko indar handia dute. Horren erakusle garbia da gaixotasunen bilakaera: tabakismoa, egun, handiagoa da emakumeen artean gizonen artean baino; bai eta gauzatutako rol aldaketekin lotura duen arrisku kardiobaskularra ere. Gizarte aldaketak kode eta rol sozial berriak ekartzen ditu, eta horrek arriskuan jar gaitzake edo arriskutik babestu, adibidez, sexu-osasunari eta ugalketa-osasunari buruz kontzienteki erabakitzeko gaitasunari dagokionez.

Gizarte zientziek, osasunaren arloko dimentsio soziala eta genero dimentsioa aztertzeak, biomedikuntzari proposatzen dio laborategian kotatutako parametroez edo giza gorputzaren parametro estandarizatuez harago joatea.

Zergatik aritzen zara arlo horretan?Arrazoietako bat da txunditu egiten nautela gaiaren konplexutasunak eta zergatik jokatzen dugun jokatzen dugun moduan, kontzienteki, baina gidatzen gaituzten rol eta praktika inkontziente jakin batzuk islatuta.

Adibide historikoek aukera ematen digute emaitzarekin hain kritikoak ez izateko, ez dutelako planteatutakoa zalantzan jartzen; hortaz, horrelako bat erabiliko dut: Rubensen garaian, zergatik zen emakume lodia edertasun femeninoaren erreferente, eta, egun, aldiz, loditasuna edertasunaren kanonetik baztertzen da? Emakumearen bi edertasun eredu horiek dira osasunaren ispilu dagokien garai historikoan, baina baita elkarren aurkakoak ere. Horrez gain, agentziaren gaia ere badago: Rubensen modeloak ispiluari plazerez begiratzen dio, jakitun munduari eta haren ezbeharrei bizirauteko gai dela; eta modu berean begiratzen dio ispiluari garai garaikide honetan kirol jarduera exijente batean entrenatuta dagoen gimnasta argalak. Biek pentsatzen dute euren gustuaren arabera jarduten dutela, baina biek jarduten dute beren gizartean indarrean dauden rol eta balioen eraginpean.

Konplexutasun soziala ikertzea “frustranteagoa” da, ez soilik zaila delako, aldaketaren menpekoa delako baizik. Gizarte zientzietan aldaketa ikertzen dugu eta aldaketa hori kudeatzen saiatzen gara; adibidez, hobetzeko neurriak iradokitzearen bidez, politika publikoei jakinaraztearen bidez. Eta, hasierara itzulita, oro har, emaitzak eztabaidagarriagoak dira. Mundu guztiak dauka iritzi jakin bat ikertzen ditugun gai guztiei buruz, eta iritzi horren balioa azpimarratu nahi dute. Hala ere, oraindik uste dut Asimoven testuak etorkizunerako inspirazio izan daitezkeela eta, Fundazioaren sailean bezala, soziologia, historia eta matematikak uztartzen dituen zientzia bat gai izango dela norantz goazen asmatzen (ahal dela, tartean diktadorerik izan gabe, uf!).

Izan al duzu erreferentziazko figurarik zure ibilbidean?Ez dut erreferentziako figurarik izan modu tradizionalean; hau da, bidean lagundu didan pertsona bat. Hala ere, behatzeko eta haiengandik ikasteko adibide asko izan ditut. Eta adierazi nahi dut erreferente onak zein txarrak izan ditudala. Edo, zehatzago, batzuetan erreferente on edo txar gisa jokatu duten pertsonak. Azkenean, zure bideari eragiten dioten alderdi positiboez nahiz negatiboez ikasten duzu, eta errepikatu nahi zenituzkeen estrategiak integratzen dituzu eta beste batzuk saihestu, zure bizitzatik aldentzeko.

Positiboki baloratzen dut, egun, errazagoa dela emakumeek beren estrategiak eta ikaskuntzak kontatzen dituzten liburuak eta autobiografiak aurkitzea. Oraintxe liburu inspiratzaile bat irakurtzen ari naiz, Soledad Murillorena: Supervivencia de las políticas de igualdad (Berdintasun-politiken biziraupena) (Comares argitaletxea); liburuak oso ongi islatzen ditu dokumentu hain baliotsu horiek. Gure belaunaldiko eta aurrekoetako emakumeak askoz bakarrago egon gara. Seguruena, asko ez ditugu ezagutzen bidea utzi zutelako.

Eta, galderara itzuliz: emakumezko kide askok lagundu didate bidean, eta eskertuta nago oso, elkarrekin izan baikara unerik gogorrenetan ere.

Zer aurkitu edo konpondu nahiko zenuke zure arloan?Gizarte zientzietan zaila da “eureka” identifikatzea: munduko pobrezia azalduko duen teoria orokor bat ezartzea, diskriminazioa eta desberdinkeria erabat baztertzeko politika publiko egokiak lortzea…? Guztia da pixka bat ezinezkoa, eta, beste zientzia batzuetan ez bezala, onartzen dugu ikerketa bidea dela, eta ez soluzio finalista bat.

Hortaz, benetan lortu nahi nukeena da etorkizun urrunenean nik idatzi eta landutako kontuak irakur zitezela, eta erantzunarekin hunkitu zitezela; edo, agian, azalpena jada ez da baliogarria izango, mundua asko aldatu delako eta ez delako halakorik behar, baina barnealdean igartze eder bat gordeko du. Nerabea nintzela Madame de Châteleten Zoriontasunari buruzko Diskurtsoa irakurri nuenenean emozionatu nintzen; nagusia naizela Perkins Gilman irakurri dudanean, garaiko beste emakume batzuk konbentzitu nahian ariketa egitea gomendagarria zela, emozionatu naiz. Harentzat, hortxe dago, hain zuzen, gizon osasuntsuen eta emakume gaixoen arteko aldea: azken horien arropek estutzen dute, ez dute baimenik zelaira ateratzeko, tenisera jolasteko edo bizikletan ibiltzeko. Egun, zorionez, emakume gehienek ez dute arropa deserosoa erabiltzen eta edozein kirol egin dezakete; hortaz, idazlearen erantzunak balio ez badu ere, barruan badu egi eder bat, eta hori baloratzen jarraitzen dugu.

Zer aholku emango zenioke ikerketaren munduan hasi nahi duen norbaiti?Aholkurik onena da ekin dezala, bere senari jarrai diezaiola, eta pertsona egokiez ingura dadila (kideak lanean eta lagunak bizitza pertsonalean eta amodiozkoan; azken hori Madame de Châteletengandik ikasi nuen).

Jatorrizko elkarrizketa Mujeres con Ciencia blogean argitaratu zen 2025eko maiatzaren 25ean: “Ana M. González Ramos: «En las ciencias sociales aceptamos que la investigación es el camino, no una solución finalista»“.

Itzulpena: UPV/EHUko Euskara Zerbitzua.

Ikertzen dut atalak emakume ikertzaileen jardunari erreparatzen die. Elkarrizketa labur baten bidez, zientzialariek azaltzen dute ikergai zehatz bat hautatzeko arrazoia zein izan den eta baita ere lanaren helburua.

The post Ana M. González Ramos: «Gizarte zientzietan onartzen dugu ikerketa bidea dela, eta ez soluzio finalista bat» appeared first on Zientzia Kaiera.

Gorilak al gara behe-laino artean?

K.a. 500ean Hanno Nabigatzaileak “Gorillae” izeneko izaki iletsuak aipatu zituen Afrikako mendebaldean; izen hori erabili zuten XIX. mendeko zientzialariek berriro ere gorilak aurkitu zituztenean.Gorilek lau hanken gainean ibiltzen dira, habiak egiten dituzte eta haremetan bizi dira, ar heldu batekin eta eme talde batekin. Gure eta txinpantzeen lehengusu genetikoak dira eta duela 8-10 milioi urte bizi izan zen haiekin partekatzen dugun arbaso komuna. Gure arbaso hori ez zen ez gizakia ez gorila, beste zerbait zen, baina zaila da oihanean fosilak sortzea, eta horregatik oso gutxi dakigu gorilen eboluzioaren inguruan.

Mendebaldeko munduak gorilak “basati” eta “beldurgarri” gisa irudikatu zituen luzaroan, King Kong edo XIX. mendeko irudi arrazistetan ikusten den bezala. Baina, paradoxikoki, gizakia da gaur egun gorilarentzat arrisku handiena. Ekialdeko gorila 8.000 ale baino gutxiagotan dago, eta mendebaldekoa, 200.000 inguruk osatua, desagertzeko arriskuan. Gerren, ehizaren eta habitataren suntsiketaren ondorioz ari gara gure lehengusu urrunak galtzen.

“Gure arbasoak” Ikusgela hezkuntza proiektuaren bideo-sorta bat da. Euskal Wikilarien Kultur Elkartearen ikus-entzunezko egitasmoa da eta EHUko Kultura Zientifikoko Katedraren kolaborazioa izan du.

The post Gorilak al gara behe-laino artean? appeared first on Zientzia Kaiera.

Ez harrak, ezta erreginak ere. Inurri arpilatzaile klonikoaren aparteko kasua

Himenopteroek, oro har, eta inurriek, bereziki, beren sexua haplodiploidiaren bidez zehazten dute. Horrek esan nahi du emeak diploideak direla eta bi dotazio kromosomiko oso dituztela; hori da animalien artean ohikoena. Harrak, aitzitik, haploideak dira eta dotazio kromosomiko bakarra dute. Eme baten obulu haploidea espermatozoide batek ernaltzen duenean, dotazio kromosomiko bikoitza berrezarri eta beste eme bat izango dugu. Obulu hori ernaldu ezean, horren garapenaren bidez ale maskulino haploide bat sortuko da.

Himenopteroen artean ohikoa da antolakuntza sozial jakin bat izatea: erregina bat edo batzuk (ugalketarako emeak); erreginari laguntzen dioten eta koloniara elikagaiak ekartzen dituzten eme langile antzu ugari; eta har gutxi batzuk, erregina ernaltzeko oinarrizko zeregina dutenak.

Hori da arau orokorra, baina salbuespenak daude. Erregistratuta dauzkagun inurrien 15 000 espezieen artean, ehuneko pare batek ez dute erreginarik kolonietan. Zenbait kasutan, langileetako batzuk ugalkorrak dira; eta harrik ez dagoenean, ugalketa asexualeko kasuak gerta daitezke. Horietan, obuluek diploidia berrezarri eta emeak sortzen dituzte.

Harrik gabeko emeen ugalketa horri partenogenesi deritzo, eta, besteak beste, landare-zorrien artean gertatzen da. Sistema horren abantaila bat du, azkar sortzen baititu ondorengo asko, baina aniztasun genetiko berria sortzea eragozten du. Hori dela eta, ugalketa denboraldiaren amaieran, landare-zorriek harrak sortzeko obulu haploideak jartzen dituzte, eta, horrela, ugalketa sexualera itzultzen dira.

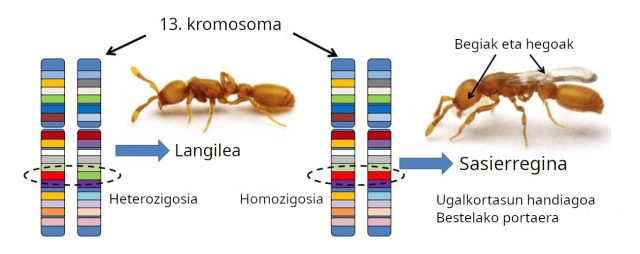

1. irudia: Ooceraea biroi inurri arpilatzaile klonikoa. Iturria: Erin Prado / © AntWeb.org / CC-BY-SA-3.0

1. irudia: Ooceraea biroi inurri arpilatzaile klonikoa. Iturria: Erin Prado / © AntWeb.org / CC-BY-SA-3.0Oso modu ezberdinean, Ooceraea biroi inurri arpilatzaile klonikoa asexualki ugaltzen da, erregina eta harrik gabe. Genetikoki berdin-berdinak diren langileak sortzen ditu (klonak), eta guztiek dute obulu diploideak jartzeko gaitasuna. O. biroi inurri itsu txiki bat da (<3 mm), eta planeta osoko eremu tropikal eta subtropikaletan zabaltzen ari da (1. irudia). Kolonia nomada txikiak sortzen ditu. Lurralde batean zabaltzen doazen heinean, beste espezie batzuen inurritegiak arpilatzen dituzte, eta aurkitzen duten guztia jaten dute.

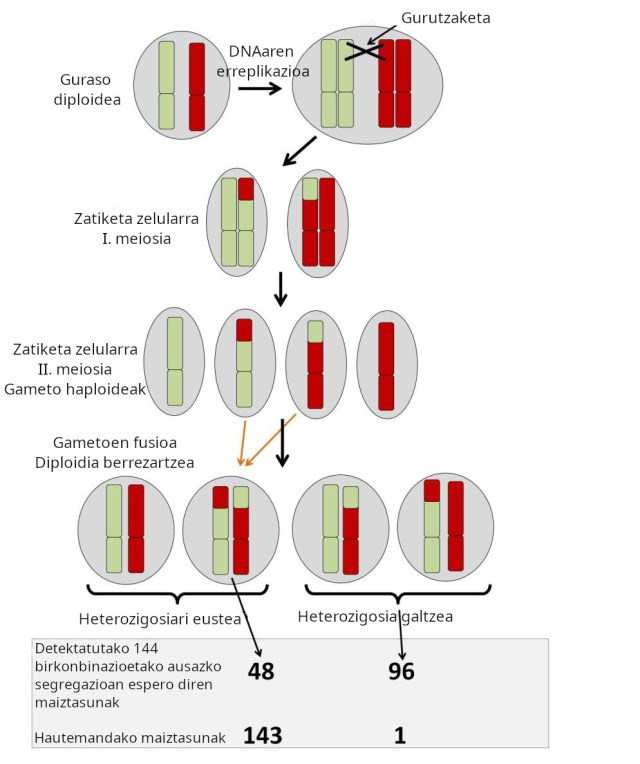

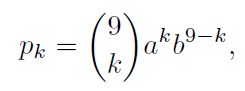

O. biroi espeziearen partenogenesia ulertzeko, meiosiaren kontzeptua errepasatu behar dugu (2. irudia). Obuluak eta espermatozoideak zelula haploideak dira, eta guraso diploideetatik datoz. Kromosoma kopuruaren murrizketa kromosomen erreplikazio baten ondorioz gertatzen da eta jarraian zatiketa zelularraren bi ziklo gertatzen dira (I. meiosia eta II. meiosia). I. meiosian kromosoma homologoen arteko gurutzaketa edo zatien trukea gerta daiteke. Hori oso garrantzitsua da aniztasun genetikoa sortzeko. Izan ere, aleloen —gen zehatz batek izan ditzakeen aldagaiak— konbinazio berriak sortzen dira.

2. irudia: meiosiaren eskema. Kromosoma bikote bakar bat irudikatu da. DNAa erreplikatu ondoren, gurutzaketa bat gerta daiteke DNAaren kateen eta kromosomaren zati baten birkonbinazioaren artean. Horrela, aleloen konbinazio berriak sortzen dira. Bigarren zatiketa meiotikoan, ondoriozko zelulak obulu haploideak dira. O. biroiren ugalketa asexuala bi obuluren fusioaren ondoriozkoa da, eta dotazio kromosomiko bikoitza berrezartzen da. Prozesu horretako ohiz kanpoko ezaugarria honako hau da: birkonbinatutako kromosomek aukera handiagoak dituztela fusioaren ostean batera heredatzeko (gezi laranjak). Kronauerren taldeak detektatutako 144 birkonbinazioetatik, 143k heterozigositateari eusten zioten; aitzitik, segregazioa ausaz gertatzen bada, 48 espero izaten dira (% 33).

2. irudia: meiosiaren eskema. Kromosoma bikote bakar bat irudikatu da. DNAa erreplikatu ondoren, gurutzaketa bat gerta daiteke DNAaren kateen eta kromosomaren zati baten birkonbinazioaren artean. Horrela, aleloen konbinazio berriak sortzen dira. Bigarren zatiketa meiotikoan, ondoriozko zelulak obulu haploideak dira. O. biroiren ugalketa asexuala bi obuluren fusioaren ondoriozkoa da, eta dotazio kromosomiko bikoitza berrezartzen da. Prozesu horretako ohiz kanpoko ezaugarria honako hau da: birkonbinatutako kromosomek aukera handiagoak dituztela fusioaren ostean batera heredatzeko (gezi laranjak). Kronauerren taldeak detektatutako 144 birkonbinazioetatik, 143k heterozigositateari eusten zioten; aitzitik, segregazioa ausaz gertatzen bada, 48 espero izaten dira (% 33).Inurri arpilatzaile klonikora itzulita, meiosiaren ondoriozko lau zelula haploideak lerrokatu eta erdiko biak fusionatzen dira, dotazio diploidea berrezartzen dute eta ale berria ekarriko duen obulua sortu. Horrek arazo larria izan behar luke; izan ere, belaunaldiek aurrera egin ahala, aleloak galduko lirateke eta aniztasun genetikoa murriztuko litzateke. Fenomeno horri heterozigositatearen galera1 deritzo. Daniel Kronauerren taldeak duela gutxi argitaratutako ikerketa batean (New Yorkeko Rockefeller Unibertsitatea), argitu dute O. biroik nekez galtzen duela heterozigositatea ugalketaren bidez, eta aniztasunari eusten diola bere aleloetan. Nola da posible? Kromosomek Mendelen legeak urratzen dituztelako eta ez direlako ausaz segregatzen II. meiosian (azalpena 2. irudian). Birkonbinatu diren kromosomak batera heredatzen dira oraindik ezezagun zaigun mekanismo baten bidez. Hori horrela, inurri klonikoak ez du ugalketa sexualaren beharrik aniztasun genetikoa “freskatzeko”, landare-zorrien kasuan gertatzen denaren kontra.

Eta hori ez da O. biroik ekarritako sorpresa bakarra. Daniel Kronauer espezie horren populazioak ikertzen ari zenean, Okinawan doktorego ondokoa egiten ari zela, hauteman zuen kolonietan, bat-batean, hegoak eta begi errudimentarioak zituzten inurriak agertzen zirela, beste espezie batzuetako inurri erreginen antzekoak (3. irudia). Eta “sasierregina” (queen-like) horiek berriro agertu zitzaizkion Kronauerri bere laborategian urte batzuk geroago. Morfologia ez ezik, inurrien portaera ere inurri erreginen portaeraren antzekoa zen (ez du elikagairik bilatzen, langileen zaintzaren menpe dago), baita horien ugalkortasuna ere, bere ahizpena bikoizten baitzuen.

3. irudia: bat-batean, beste espezie batzuen inurri erreginen antzeko morfologia eta portaera duten O. biroi aleak agertzen dira kolonietan. Hori 13. kromosomaren eskualde espezifiko batean heterozigositatea galtzearen ondoriozkoa da (ikusi 2. oharra). Iturria: W. Trible et al. (2023). CC BY-SA 4.0

3. irudia: bat-batean, beste espezie batzuen inurri erreginen antzeko morfologia eta portaera duten O. biroi aleak agertzen dira kolonietan. Hori 13. kromosomaren eskualde espezifiko batean heterozigositatea galtzearen ondoriozkoa da (ikusi 2. oharra). Iturria: W. Trible et al. (2023). CC BY-SA 4.0Sasierreginen genomaren azterketak emaitza harrigarriak ekarri zituen. Geneen multzo batek2 alelo ezberdinak zituen langile arrunten 13. kromosoman (heterozigosia), baina berdin-berdinak ziren sasierreginetan (homozigosia) (3. irudia). Hau da, gene multzo horren homozigosiak “parasitismo soziala” deitutakoa egiten duten inurri espezie batzuen fenotipo oso antzeko bat sortzen zuen.

Estrategia horren xedea da langilerik ez duen espezie jakin bateko inurriek beste espezie batzuetako erreginen itxurak egitea, langileek babestu eta elikatu ditzaten eta beren kumeak zaindu ere bai. Denbora luzez espekulatu zen ea zer-nolako eboluzio prozesuek eragin zezaketen portaera hori. Bada, emaitza berrien arabera, ekitaldi genetiko sinple bat, 13. kromosomako geneen multzoko homozigosia, izango litzateke estrategia horren eboluzioaren jatorria. Portaera eta morfologia arloko muturreko aldaketa bat da, belaunaldi bakar batean gertatzen dena, aldaketa genetiko zehatz baten ondorioz.

Inurri klonikoa intsektu sozialak ikertzeko aparteko eredu bilakatzen ari da, bere homogeneotasun genetikoagatik eta oso erraza delako laborategian erreproduzitzea. Are gehiago, Kronauerren taldeak lortu du modelo horretan ezartzea intsektu sozial baten lehenengo lerro transgenikoa. Intsektu ñimiño horrek sorpresa asko ekarriko dizkigu etorkizun hurbilean.

Oharrak:1 Heterozigosia gertatzen da gene baten bi bertsio (alelo) daudenean, amarengandik eta aitarengandik heredatuta. Bi aleloak berdinak badira, homozigosiari buruz arituko gara.

2 Seguruena portaera sozialekin lotura duen “supergene” bat osatzen duen baseen 2.25 milioi pareko eskualdea da. Supergene bat eskuarki blokean heredatzen diren geneen multzo bat da, ohikoa baino birkonbinazio askoz ere gutxiago izaten dutelako.

Erreferentzia bibliografikoak:Lacy, Kip D.; Hart, Taylor; Kronauer, Daniel J.C. (2024). Co-inheritance of recombined chromatids maintains heterozygosity in a parthenogenetic ant. Nature Ecology Evolution. DOI: 10.1038/s41559-024-02455-z

Trible, Waring; Chandra, Vikram; Lacy, Kip D.; Limón, Gina; McKenzi, Sean K.; Olivos-Cisneros, Leonora; Arsenault, Samuel V.; Kronauer, Daniel J.C. (2023). A caste differentiation mutant elucidates the evolution of socially parasitic ants. Current Biology, 66, 6.DOI: 10.1016/j.cub.2023.01.067

Egileaz:Ramón Muñoz-Chápuli Oriol Animalien Biologiako Katedraduna (erretiratua) da Malagako Unibertsitatean.

Jatorrizko artikulua Cuaderno de Cultura Científica blogean argitaratu zen 2025eko urtarrilaren 27an: “Ni machos, ni reinas. El extraordinario caso de la hormiga saqueadora clónica“.

Itzulpena: UPV/EHUko Euskara Zerbitzua.

The post Ez harrak, ezta erreginak ere. Inurri arpilatzaile klonikoaren aparteko kasua appeared first on Zientzia Kaiera.

Allie Vibert Douglas: Kanadako astrofisikako lehen emakumezko doktorearen izena dute krater batek eta asteroide batek

Venus planetan bederatziehun krater baino gehiago daude eta guztiek dute emakume baten izena. Artista nabarmenen erreferentziak daude, hala nola Greta Garbo aktorea, Edith Piaff abeslaria edo Frida Kahlo margolaria, baina hamar bat besterik ez dira astronomoen izenak. Eta horietako bat da Alice Vibert Douglas (1894-1988), “Allie” edo “Vibert” izenez ezagunagoa, duela ehun urte pasatxo Kanadan Astrofisikan doktoregoa lortu zuen lehen emakumea.

Zientzialaria Montrealen jaio zen, Quebec probintzian (Kanada), 1894ko abenduaren 15ean.

Bere herrialdea atzean utzi behar izan zuen 1916an, McGill Unibertsitatean Astronomiako gradua ikasten ari zela, Londresera joateko (Erresuma Batua). Londresen estatistikako aditu aritu zen orduko Defentsa Ministerio britainiarrean, Lehen Mundu Gerran.

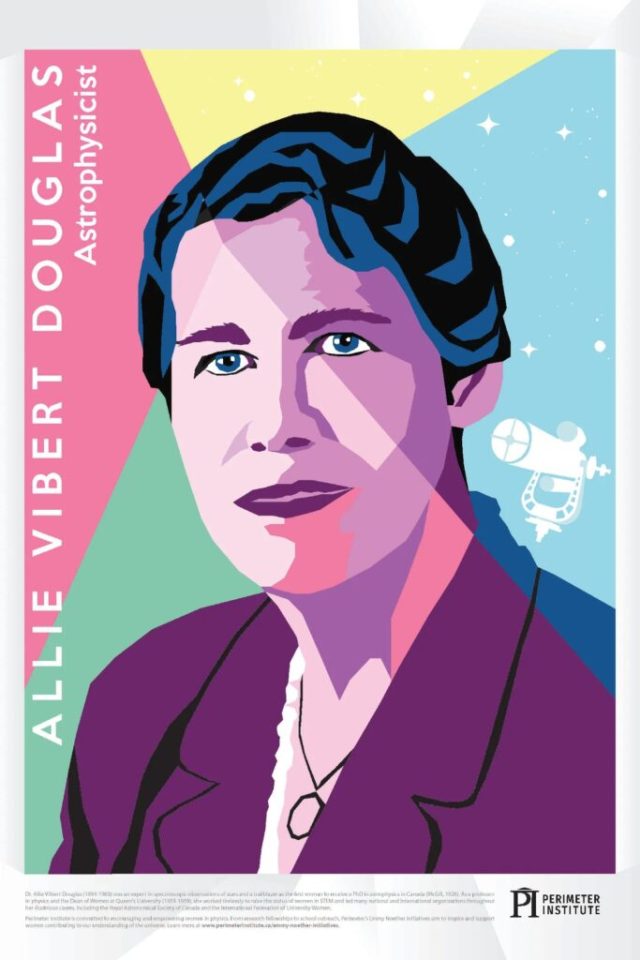

1. irudia: Allie Vibert Douglas astronomoa. (Iturria: Mujeres con Ciencia)

1. irudia: Allie Vibert Douglas astronomoa. (Iturria: Mujeres con Ciencia)Aldi horretan egindako lanarengatik Britainiar Inperioko Ordenako kide (MBE) izendatu zuten 1918an.

Aitzindaria izan zen emakumezko zientzialarientzako espazioak irekitzenAlice Kanadara itzuli zen 1920an, eta Astronomiako graduko titulua eskuratu zuen hurrengo urtean. Ondoren, Ingalaterrara joan zen berriro, eta han bi urtez ikertu zituen astroak Cambridgeko Behatokian eta Cavendish Laborategian.

1925ean, Amerikara itzultzea erabaki zuen. Lehendabizi, ikerketa lanetan hasi zen Yerkes Behatokian, XX. mendeko ikergune astronomiko garrantzitsuenetako batean (Winsconsin, Estatu Batuak).

Gero Kanadara itzuli zen eta bere astronomiako doktoregoa amaitu zuen 1926an. Horrela, herrialde horretan titulu hori lortu zuen lehen emakumea izan zen.

Baina hori ez zen izan Douglasek emakumezko zientzialarientzat zabaldu zuen espazio bakarra. Izan ere, McGill Unibertsitatean hamarkada batez baino gehiagoz fisika eta astrofisikako irakasle aritu ondoren, Emakumeen dekano izendatu zuten Queen’s Unibertsitatean (Kingston, Ontario). Hogei urtez baino gehiagoz bete zuen kargu hori, eta, horri esker, emakume asko medikuntza eta ingeniaritzako karreretan sartzea ahalbidetu ahal izan zuen.

1943an, Kanadako Astronomiako Errege Sozietateko lehen emakumezko presidentea izan zen, eta lan horretan aritu zen 1944ra arte.

Allie Nazioarteko Astronomia Batasuneko lehen presidente kanadarra izan zen 1947an. Mundu mailako organismo zientifiko horren egoitza nagusia Parisen (Frantzia) dago eta planeta osoko sozietate astronomikoak biltzen ditu; gorputz astronomikoak (asteroideak, kometak eta planetan) edo gorputz astronomikoen zatiak (mendiak eta kraterrak) izendatzeko ahalmena duen erakunde bakarra da.

Argitalpenak, sariak eta posta-trukea EinsteinekinDouglasek John Stuart Foster astronomoarekin egin zuen lan, eta elkarrekin ikertu zituzten A motako eta B motako izarren espektroak eta Stark efektua Dominion Astrofisikako Behatokian, Vancouverretik (Kanada) gertu dagoena. Ikerketa horien emaitzak bien izenean argitaratu zituzten.

Horrez gain, Alliek artikulu bat idatzi zuen Arthur Eddington astrofisikari ospetsu britainiarrarekin: bere oharrekin, Albert Einsteinen erlatibitate orokorraren teoriaren baliozkotasuna konfirmatu zuen. Ondoren, ikertzaile horren biografia idatzi zuen; Cambridgen bere irakaslea izan zen.

Argitalpen horretarako eginiko ikerketei esker, gutunak trukatu zituen Einsteinekin. Liburua, The Life of Arthur Eddington izenekoa, ohoreekin eta aintzatespen handiarekin editatu zen 1956an.

Britainiar Inperioko Ordenako kide (MBE) izendatzeaz gain, aurretik adierazi dugun moduan, McGill Unibertsitatearen ohorezko diploma jaso zuen 1960an, bai eta Queen’s Unibertsitatekoa ere 1965ean. Bi urte geroago, Kanadako Ordenaren aintzatespena jaso zuen; sari hori Ingalaterrako Isabel II.a erreginak sortu zuen herritar kanadarrek beren komunitatearen eta nazioaren alde egiten zituzten aparteko ekintzak aintzatesteko.

2. irudia: Allie Vibert Douglasen omenez Perimeter Institutek egindako irudia. (Iturria: Mujeres con Ciencia)Bere legatua Lurrean eta Unibertsoan

2. irudia: Allie Vibert Douglasen omenez Perimeter Institutek egindako irudia. (Iturria: Mujeres con Ciencia)Bere legatua Lurrean eta Unibertsoan

Douglasek sutsuki borrokatu zuen emakumeek sarbidea eta aintzatespena izan zezaten zientzian. Hori dela eta, 1967an, Kanadako Emakume Juduen Kontseilu Nazionalak XX. mendeko herrialdeko hamaika pertsonalitate femenino nabarmenetako bat izendatu zuen. Eta, 2024an, McGill Unibertsitateak (han graduatu zen duela ehun urte baino gehiago) Allie Viberts Douglas saria aurkeztu zuen; ordutik, urtero ematen zaio Astrofisikako doktorego tesi onenari.

Alliek eginiko lan zientifikoaren eta karreran zehar lortu zituen merituen ondorioz, 1988an, hil zen urte berean, 3269 asteroideari Vibert-Douglas izena jarri zioten. Halaber, 2003an, Venus planetako krater irregular bati ere jarri zioten bere izena (Vibert-Douglas patera).

Alice Vibert Douglas 1988ko uztailaren 2an hil zen Kingstonen (Ontario), bere bizitzako azken urteak han igaro ondoren. Queen’s Unibertsitateak esteka publiko bat dauka artxibo digitala kontsultatzeko, eta han ikus daitezke bere herrialdeko astrofisikaren historia aldatu zuen zientzialariaren oharrak, artikuluak eta korrespondentzia.

Iturriak:- Eddington, Arthur; and Douglas, Alice Vibert (1923). The progression of stellar velocity with absolute magnitude, Monthly Notices of the Royal Astronomical Society, 83 112-118

- Brandswell, Brenda (2024). Astrophysics award honours student research with nod to pioneer, Universidad McGill University, 2024ko ekainaren 4a

- Poulin, Jessica (2024). Alice Vibert Douglas, The Canadian Encyclopedia, 2024ko abuztuaren 2a

- Douglas, Allie Vibert (1894-1988), Queen’s Encyclopedia

- Sánchez, Lorena (2019). ¿Por qué solo hay nombres de mujer en Venus y no en otros planetas?, Homínidas, 2019ko uztailaren 26a

- Allie Douglas, Encyclopedia Uranica, The Royal Astronomical Society of Canada

- Une astronome sur Vénus, Agence Science-Presse du Canada, 26 febrero 2003

- Dutil, Yvan (2006). L’astronomie Québécoise d’hier à aujourd’hui, Agence Science-Presse du Canada, 2006ko martxoaren 27a

Analía Boggia Komunikazio Sozialean lizentziaduna, kazetaria, irakaslea eta dibulgatzailea da. Egun, Ikerketa Zientifikoko Komunikazio Sozialari buruzko Master ofiziala egiten ari da Valentziako Nazioarteko Unibertsitatean.

Jatorrizko artikulua Mujeres con Ciencia blogean argitaratu zen 2025eko apirilaren 25ean: “Allie Vibert Douglas, primera doctora en astrofísica canadiense da nombre a un cráter y un asteroide“.

Itzulpena: UPV/EHUko Euskara Zerbitzua.

The post Allie Vibert Douglas: Kanadako astrofisikako lehen emakumezko doktorearen izena dute krater batek eta asteroide batek appeared first on Zientzia Kaiera.

Seigarren zentzumena gure mikrobiotan egongo ote da?

Ikusmena, entzumena, ukimena, dastamena eta usaimena dira bost zentzumenak; guztiak ere zientziak ondo deskribatu ditu eta jakinak dira zentzumen hauek ahalbidetzen dituzten mekanismo eta zelulak. Modu misteriotsuan eta ezagutzen ditugun zentzumenak erabili barik zerbait nabaritzeko gai garenean “seigarren zentzumen” bat dugula esaten dugu eta sarri erabili izan da eguneroko bizimoduan ez ezik kulturako hainbat esparrutan zientziatik baino magiatik hurbilago dagoen gaitasun hau. Baina gaur egun badirudi zientzialariek “seigarren zentzumen” bat aurkitu dutela eta enpirikoki demostratu ere egin dutela.

Amerikako Estatu Batuetako Duke Unibertsitateko ikertzaile talde batek “zentzumen neurobiotiko” deitu duen interakzio berri bat deskribatu du saguetan. Burmuinaren eta hesteen arteko harremana aspaldi deskribatu zen eta ezaguna da grelina edo leptina moduko hormonek hipotalamoan duten eragina aski jakina da gosearen erregulazioan. Baina gure gorputzean, “gureak” diren zelulez gain, beste gizaki batzuk ditugu gurekin bizitzen; mikrobiota moduan ezagutzen ditugun mikroorganismoak. Gorputzeko hainbat organotan aurki ditzakegu: azalean, ahoan, arnas-bideetan baina beharbada ezagunena hesteetan agertzen zaiguna da. Hesteetako mikrobiotak funtzio oso garrantzitsua betetzen du digestio-prozesuan eta, ondorioz, eragin zuzena du osasunean. Deskribatu berri den zentzumen neurobiotikoak hesteetako mikrobiota honen gainean jartzen du fokua.

Irudia: zentzumen neurobiotiko berri bat deskribatu dute; lerro berri honek ateak zabaltzen dizkio asetze-sentsazioari, besteak beste. (Argazkia: Nikolett Emmert – pexels lizentziapean. Iturria: Pexels.com)

Irudia: zentzumen neurobiotiko berri bat deskribatu dute; lerro berri honek ateak zabaltzen dizkio asetze-sentsazioari, besteak beste. (Argazkia: Nikolett Emmert – pexels lizentziapean. Iturria: Pexels.com)Hesteetako epitelioan neuropodo izeneko zelula sentikor batzuk daude. Zelula hauek nerbio bagoarekin egiten dute kontaktua eta burmuinera zuzenean bidaltzen dute hesteetan detektatzen dutena. Besteak beste, gai dira irentsi ditugun jakien osaketaren berri emateko burmuinari, izan proteinak, gantzak edo azukreak. Baina Diego Bohórquez zientzialariak gidatutako taldea haratago joan da eta gai izan da saguetan mikrobiotaren eta neuropodoen arteko interakzio zuzena deskribatzeko. Jana heste lodira heltzean, bertan dauden mikroorganismo batzuek flagelina izeneko proteina sortzen dute. Flagelina neuropodoen mintzean agertzen den hartzaile jakin batera lotzen da: TLR5; eta, ondorioz, neuropodoek burmuinera bidaltzen dute seinalea nerbio bagoaren bidez. Ikertzaileek baraurik zeuden saguei flagelina jartzen zieten heste lodian, baina saguek ez zuten jaten, elikagaia eskura eduki arren. Ostera, genetikoki manipulatutako TLR5 gabeko saguek etengabe jaten zuten eta ez ziren asetzen.

Ikerketa hau saguetan egin den arren badirudi gizakietan ere egon daitekeela antzerako sistemaren bat. Lerro berri honek ateak zabaltzen ditu, bai asetze-sentsazioari dagokionez, eta bai beste molekula batzuek burmuinean eragin ditzaketen portaera-aldaketei dagokienez. Agerikoa da hesteetako mikrobiota osasuntsua izatea digestio-aparatuaren funtzionamendu zuzenaz haratago doan zerbait dela, eta gurekin bizi diren mikrorganismoek gorputzeko hainbat sistema eta aparatutan eragiteko duten gaitasunaren adibide bat baino ez da azaldutakoa.

Erreferentzia bibliografikoa:Liu, Winston W.; Reicher, Naama; Alway, Emily; Rupprecht, Laura E.; Weng, Peter; Schaefgen, Chloe; Klein, Marguerita E.; Villalobos, Jorge A.; Puerto-Hernandez, Carlos; Altún, Yolanda Graciela Kiesling; Carbajal, Amanda; Aguayo-Guerrero, José Alfredo; Coss, Alam; Sahasrabudhe, Atharva; Anikeeva, Polina; de Araujo, Alan; Bali, Avnika; de Lartigue, Guillaume; Gil-Lievana, Elvi; Gutierrez, Ranier; Miao, Edward A.; Rawls, John F.; Kaelberer, M. Maya; Bohórquez, Diego V. (2025). A gut sense for a microbial pattern regulates feeding. Nature, volume 645, pages 729–736. DOI: 10.1038/s41586-025-09301-7

Egileaz:Iker Badiola Etxaburu (@ikerbadiola.bsky.social) EHUko Medikuntza eta Erizaintza Fakultateko irakaslea eta EHUko Kultura Zientifikoko Katedrako zuzendaria da.

The post Seigarren zentzumena gure mikrobiotan egongo ote da? appeared first on Zientzia Kaiera.

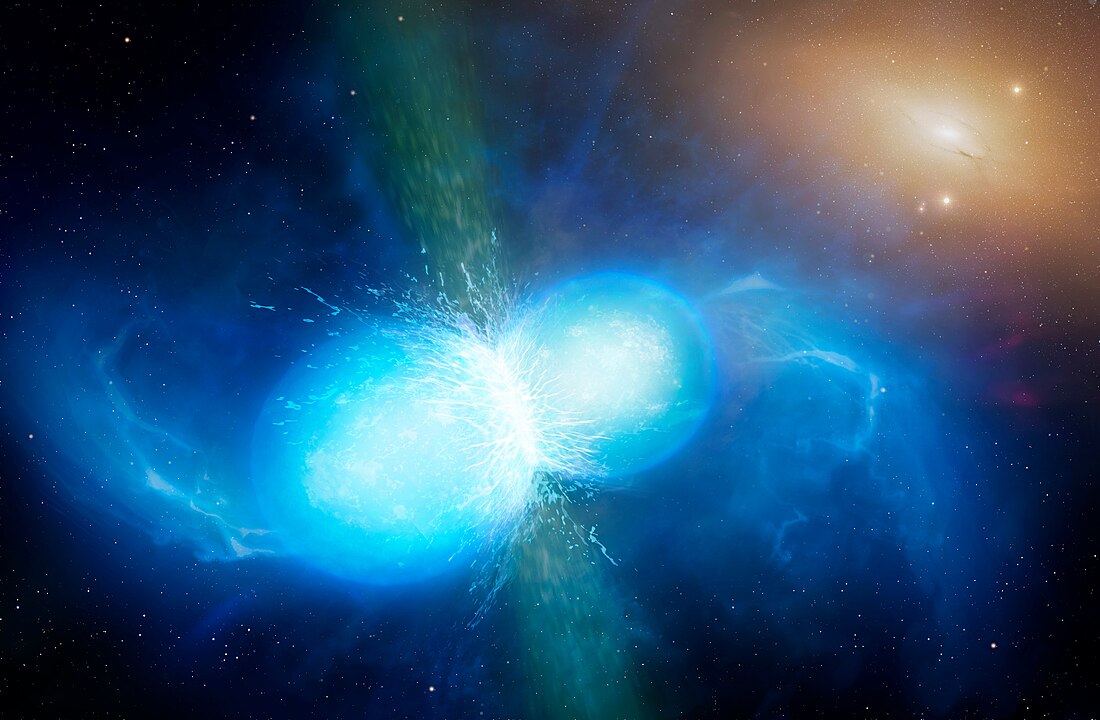

La viscosidad altera la música de las estrellas

Ilustración artística de la fusión de dos estrellas de neutrones, proceso que genera ondas gravitacionalesFuente: University of Warwick/Mark Garlick, CC BY 4.0, Wikimedia Commons

Ilustración artística de la fusión de dos estrellas de neutrones, proceso que genera ondas gravitacionalesFuente: University of Warwick/Mark Garlick, CC BY 4.0, Wikimedia CommonsLas ondas gravitacionales son vibraciones del propio espacio-tiempo, ondas que se propagan tras sucesos muy violentos como la fusión de agujeros negros o de estrellas de neutrones. Estas ondas, tan débiles que apenas deforman los detectores más sensibles de la Tierra, también atraviesan planetas, gases y estrellas. Pero ¿qué ocurre cuando una de esas ondas pasa a través de objetos que no son rígidos, sino fluidos y, por tanto, viscosos?

Recordemos que la viscosidad mide la resistencia de un fluido a fluir y es una expresión de la existencia de fuerzas de rozamiento internas y, por lo tanto, de cómo disipa energía. Así, un líquido muy viscoso, como la miel, amortigua las vibraciones más rápido que el agua. Las estrellas y otros objetos compactos como los planetas, aunque puedan parecer sólidos, son en realidad fluidos extremadamente densos. Algunas partes de su interior —como el núcleo de una estrella de neutrones— pueden comportarse como un líquido con cierta viscosidad.

La viscosidad altera…En un nuevo estudio los autores han modelado la interacción de las ondas gravitacionales y la materia siguiendo las leyes de la relatividad general, pero incluyendo los efectos de la viscosidad. De esta manera han podido calcular cómo se propagan las perturbaciones a través de las estrellas y cómo se ve afectada la onda gravitacional al atravesarlas.

El resultado principal es que, como era de esperar, la viscosidad absorbe parte de la energía de la onda. Si la materia fuera un fluido ideal, sin viscosidad, la onda las atravesaría casi sin alteración; pero si hay fricción interna, la onda deja parte de su energía en la estrella. Simplificando, es como si la onda gravitacional hiciera vibrar el interior de la estrella y esa vibración se fuera convirtiendo en calor.

Cuando la viscosidad es pequeña, la absorción es débil. Si se incrementa, la onda empieza a perder más energía dentro de la estrella. S la materia es muy viscosa la onda puede incluso reflejarse parcialmente, igual que una ola rebota contra un muro. Los autores demuestran que, para ciertos valores, la reflectividad puede parecerse a la de un agujero negro.

Sin embargo, alcanzar esos niveles de viscosidad extrema no es fácil: si se exagera, el modelo empieza a violar principios básicos de la relatividad, como la causalidad. En otras palabras, la materia no puede ser infinitamente viscosa sin dejar de tener sentido físico. Por eso, aunque el hallazgo es fascinante, no implica que existan objetos capaces de reflejar ondas gravitacionales de manera perfecta; más bien marca los límites teóricos de lo que la física permite.

…la música de las estrellasEl estudio también muestra que la viscosidad cambia las notas naturales de vibración de las estrellas. Igual que una campana produce tonos característicos cuando se la golpea, una estrella vibra en modos característicos cuando una onda gravitacional la alcanza. La presencia de viscosidad altera ligeramente esas frecuencias y los tiempos en los que las oscilaciones se amortiguan. La viscosidad introduce un nuevo tipo de vibraciones internas, propias del material viscoso, que podrían dejar señales específicas en la radiación gravitacional emitida por el sistema. Detectar esas huellas sería una manera de estudiar las propiedades internas de las estrellas más densas sin necesidad de observarlas directamente.

Desde el punto de vista astrofísico, los cálculos muestran que el efecto de absorción o calentamiento que una onda gravitacional produce en una estrella es minúsculo en la mayoría de los casos. Incluso en las colisiones más energéticas del universo, la cantidad de energía que una onda transfiere a una estrella es despreciable. Aun así, en entornos muy extremos —por ejemplo, cerca del centro de una galaxia activa o dentro de cúmulos donde las ondas gravitacionales son intensas—, estos efectos podrían tener un papel interesante y observable.

Imitadores de agujeros negrosEl artículo toca dos grandes temas actuales. El primero es la idea de que ciertos objetos extremadamente compactos, pero sin horizonte de sucesos, podrían imitar el comportamiento de los agujeros negros. Si son lo bastante viscosos, podrían reflejar parte de las ondas gravitacionales y producir ecos en las señales que registran detectores como LIGO o Virgo. El segundo es la posibilidad de que la viscosidad y la rotación generen superradiancia, un fenómeno en el que una onda sale del objeto amplificada, robándole energía a su rotación. Este mecanismo podría producir inestabilidades o patrones característicos en las observaciones futuras.

Este trabajo demuestra que la viscosidad no es un detalle menor: influye en cómo las estrellas absorben, reflejan o incluso amplifican las ondas que las atraviesan. También recuerda que, para interpretar correctamente las señales detectadas en la Tierra, debemos tener en cuenta la microfísica de las estrellas y los efectos disipativos que pueden modificar esas vibraciones del espacio-tiempo.

Es un paso más hacia una astronomía gravitacional más completa, en la que no sólo observamos cómo las ondas viajan por el universo, sino también cómo los distintos tipos de materia responden a ellas, revelando su estructura interna y, quizás, las propiedades más sutiles de la gravedad misma.

Referencias:

Valentin Boyanov, Vitor Cardoso, Kostas D. Kokkotas, and Jaime Redondo-Yuste (2025) Dynamical Response of Viscous Objects to Gravitational Waves Phys. Rev. Lett. doi: 10.1103/smlr-v7b2

Sumanta Chakraborty (2025) Viscous Stars Can Reflect Gravitational Waves like Black Holes Do Physics 18, 169

César Tomé López (2019) Ondas (serie) Cuaderno de Cultura Científica

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo La viscosidad altera la música de las estrellas se ha escrito en Cuaderno de Cultura Científica.

Udazkeneko koloreen atzean dagoen zientzia

Udazkenarekin batera zuhaitzetako hostoak kolorez aldatzen dira eta hosto berdeek kolore horixka, marroixka edo gorrixka hartzen dute, erori aurretik. Zientzia asko dago hosto erorkorren zuhaitzetan (kaduzifolioak) urtero gertatzen den fenomeno honen atzean.

Zuhaitzetako hostoek kolore berdea izaten dute: klorofila izeneko pigmentu berdeari zor zaio hori. Konposatu hau beharrezkoa da fotosintesia gauzatzeko: prozesu honetan landareek eguzkiaren energia erabiltzen dute karbono dioxidoa eta ura azukre bihurtzeko. Klorofila sintetizatzeko, hostoek eguzki-argia eta tenperatura altuak behar dituzte. Baina uda amaitzen den heinean argi gutxiago jasotzen dute, motzagoak eta hotzagoak baitira egunak. Horrela, mantsotu egiten da klorofilaren ekoizpena eta deskonposatuz doa hostoetan dagoena.

Irudia: klorofila kantitatea murriztean, hostoek kolore horilaranja hartzen dute, agerian uzten baitute hostoetan dauden karotenoideen kolorea. (Argazkia: Pixabay – pexels lizentziapean. Iturria: Pexels.com)

Irudia: klorofila kantitatea murriztean, hostoek kolore horilaranja hartzen dute, agerian uzten baitute hostoetan dauden karotenoideen kolorea. (Argazkia: Pixabay – pexels lizentziapean. Iturria: Pexels.com)Klorofila kantitatea murriztean, hostoek kolore horilaranja hartzen dute, agerian uzten baitute hostoetan dauden karotenoideen kolorea. Karotenoideak naturan aurki daitezkeen pigmentu organikoak dira, karbono eta hidrogenoz, eta zenbait kasutan, oxigenoz osatuak daude. Izan ere, klorofilaren kolore berdeak karotenoideen kolorea estaltzen zuen. Konposatu hauen artean beta karotenoa aurki daiteke, azenarioen kolore laranja ematen duena, edo luteina, arrautzaren gorringoari kolore horixka ematen diona. Karotenoideek argia absorbatzen dute 450-550 nm eremuan, hau da, eguzki-argiaren eremuan. Absorbaturiko energia klorofilari transferitzen diote, eta fotosintesia ahalbidetzen dute horrela. Karotenoideen bigarren funtzioa eta garrantzitsuena foto-degradazioa ekiditea da argi asko dagoenean. Klorofilaren antzera, udazkena heltzean, karotenoideen kantitatea gutxitu egiten da, baina klorofila gutxitzea baino erritmo motelagoan.

Zenbait hostok kolore gorrixka hartzen dute, antozianinen ondorioz. Hauek landareetan aurki daitezkeen pigmentu organikoak dira. Flabonoideen familikoak dira, konposatu fenolikoak baitira, eta uretan disolbatzen dira. Antozianinak, karotenoideak ez bezala, hostoetan udazken aldean bakarrik azaltzen dira. Konposatu hauek karbohidrato gehiegi dagoenean eta argiaren laguntzaz sortzen dira zitoplasman, zelula mintzaren barnean aurkitzen den disoluzioan non gatza, proteinak edo organelak aurki daitezkeen. Oraindik ez dago oso argi zergatik sortzen diren konposatu hauek. Ikertzaile batzuen arabera, belarjaleak uxatzeko estrategia bat izan daiteke; beste batzuen arabera, toxinak botatzeko estrategia bat. Ulertzeko beste era bat da konposatu hauek landarea eguzki-argitik babes dezaketela, eta, horrela, oxidazioaren ondoriozko kalteak murriztu. Hedatuen dagoen teoria da konposatu hauek hostoen azpiproduktu bat direla, funtzio berezirik betetzen ez duena.

Udazkena aurrera joan ahala, hostoak kolorez aldatu eta erori egiten dira. Hostoen erorketari abzisio deitu ohi zaio. Prozesu honen bitartez landareek behar ez dituzten atalak askatzen dituzte; hostoak izan daitezke baina baita loreak edo fruituak ere. Prozesu honen helburua zuhaitz edo landareak negurako prestatzea da, energia eta ura aurreztu ahal izan ditzaten neguko giro gogorrerako, zeinetan eguzki-argi gutxi dagoen eta tenperaturak baxuak diren. Landareek organoen oinarrian abzisio eremua deritzona daukate, askotariko morfologia daukaten zelulez osatua. Abzisio prozesua auxina hormona gabeziaren bidez aktibatu daiteke. Auxina-kontzentrazio altua iristen bada abzisio eremuko zeluletara, prozesua ez da aktibatzen. Auxina-kontzentrazioa murrizten bada, ordea, abian jartzen da abzisio prozesua. Orduan etileno-produkzioa areagotzen da eta sintetizatu egiten dira zelulen paretan dauden polisakaridoak hidrolizatzen dituzten entzimak. Modu honetan, hostoa zuhaitzera lotzen duen ehuna ahultzen da eta, ondorioz, erori egiten da hostoa. Lurrera erortzen diren hostoak lehortuz eta deskonposatuz doaz, eta kolore marroixka hartzen dute.

Erreferentzia bibliografikoak:Feild, Taylor S.; Lee, David W.; Holbrook, N. Michele (2001). Why leaves turn red in autumn. The role of anthocyanins in senescing leaves of red-osier dogwood. Plant physiology, 127, 566-574. DOI: 10.1104/pp.010063

Manninen, Marianna; Vesterinen, Veli Matti; Salminen, Juha Pekka (2020). Chemistry of autumn colors: quantitative spectrophotometric analysis of anthocyanins and carotenoids and qualitative analysis of anthocyanins by ultra-performance liquid chromatography–tandem mass spectrometry. Journal of chemical education, 97, 772-777. DOI: 10.1021/acs.jchemed.9b00436

Olsson, Vilde; Butenko, Melinka A. (2018). Abscission in plants. Current Biology, 28, R338-R339. DOI: 10.1016/j.cub.2018.02.069

Pace, Madeline (2021ko urriaren 18a). The Science behind fall foliage. Science & Nature UNC-Chapel Hill. 2025eko urriaren 24a kontsultatua. www.unc.edu

Egileez:Leire Sangroniz Kimikan doktorea da eta EHUko Kimika Fakultatearen PMAS Saileko (Polimero eta Material Aurreratuak: Fisika, Kimika eta Teknologia Saila) ikertzailea Polymaten eta Ainara Sangroniz Kimikan doktorea da eta EHUko Kimika Fakultateko irakaslea Polymaten.

The post Udazkeneko koloreen atzean dagoen zientzia appeared first on Zientzia Kaiera.

El violento nacimiento de Venus

Cuando hablamos en términos coloquiales muchas veces nos referimos al planeta Venus como una especie de gemelo de nuestro planeta, pero la realidad nos dice que de gemelos más bien tienen poco. Quizás sí podríamos llamarlos hermanos, ya que ambos son planetas rocosos y tienen un tamaño, composición y densidad similar.

A pesar de este aparente parecido son dos mundos antagónicos. La Tierra es un planeta templado, con océanos de agua líquida y casquetes polares, mientras que Venus sería lo más parecido al infierno: Un mundo con temperaturas que se acercan a los 500 ºC rodeado por una densa e irrespirable atmósfera de dióxido de carbono, nitrógeno y dióxido de azufre.

Pero hay muchas más diferencias, alguna de ellas muy llamativas. El día de Venus dura nada más y nada menos que 243 días terrestres y, por si fuese poco, gira sobre sí mismo al revés. Bueno, en sentido contrario al de la Tierra y al de la mayoría de los planetas. Y hay un detalle más que fascina a los científicos y del que todavía no tenemos una respuesta clara al porqué: Venus está solo, no tiene ni un solo satélite natural que quizás hubiese podido ser clave para estabilizar su giro e incluso su clima.

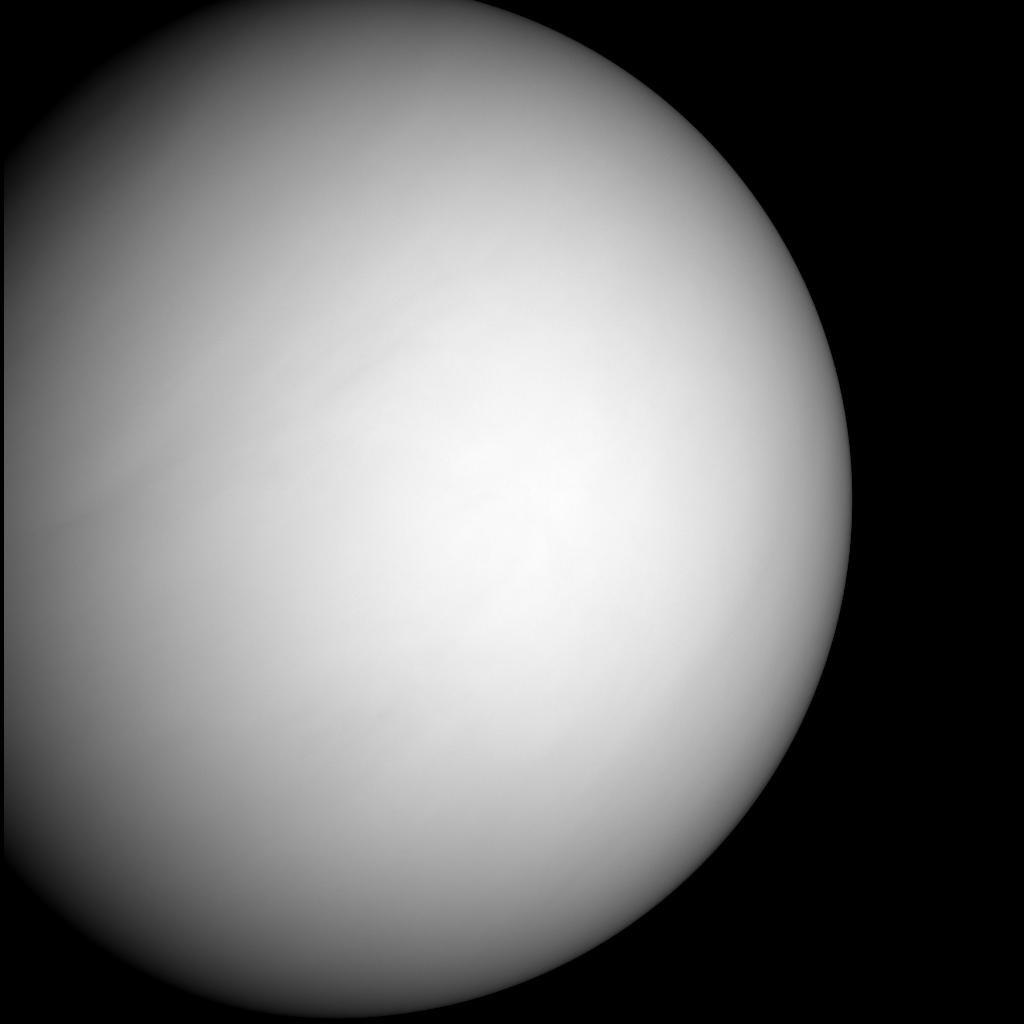

Imagen de Venus tomada en luz visible por la sonda Messenger en junio de 2007. Así lo veríamos con nuestros propios ojos si estuviésemos en sus proximidades, con una capa de nubes que oscurece de manera perpetua su superficie. Cortesía de NASA/Johns Hopkins University Applied Physics Laboratory/Carnegie Institution of Washington..

Imagen de Venus tomada en luz visible por la sonda Messenger en junio de 2007. Así lo veríamos con nuestros propios ojos si estuviésemos en sus proximidades, con una capa de nubes que oscurece de manera perpetua su superficie. Cortesía de NASA/Johns Hopkins University Applied Physics Laboratory/Carnegie Institution of Washington..¿Cómo pudieron ambos planetas empezar siendo tan parecidos y evolucionar hacia mundos tan diferentes? Un nuevo estudio publicado por Bussmann et al. (2025) parece haber sido capaz de traer una nueva teoría para explicar las causas y al menos resolver -aparentemente- estas dos últimas diferencias mediante la simulación de un impacto gigante contra la superficie de Venus cuando el Sistema Solar era mucho más joven.

Los inicios del Sistema Solar fueron realmente agitados. Las simulaciones sobre la formación de nuestro sistema planetario muestran que las últimas etapas de su formación estuvieron probablemente dominadas por colisiones de una magnitud inimaginable.

De hecho, la teoría más ampliamente aceptada sobre la formación de nuestra propia Luna tiene mucho que ver con esto, ya que incluye un cuerpo del tamaño de Marte chocando con nuestra proto-Tierra. Y no sería raro pensar que Venus hubiese sufrido un destino similar, pero… ¿qué tipo de impacto podría haber dejado a Venus tal y como lo conocemos hoy?

Para responder a esta pregunta, los científicos han ejecutado una serie de modelos numéricos que permiten analizar con gran nivel de detalle la física de estas grandes colisiones. Crearon un proto-Venus diferenciado en dos capas con un núcleo de hierro que formaría un 30% de la masa del planeta y un manto rocoso que ocuparía el 70% restante.

Tras la creación de este gemelo digital, comenzaron a “dispararle” cuerpos planetarios de distintos tamaños, con distintos ángulos y velocidades. La clave no era el hacer una sola simulación, sino explorar el amplio abanico de posibilidades en cuanto a los parámetros de impacto. En total realizaron 81 simulaciones diferentes variando los parámetros más importantes para ver que pasaba.

Como decíamos en el párrafo anterior, dispararon contra el proto-Venus cuerpos de distintos tamaños, desde cuerpos de tan solo 0.01 veces la masa terrestre hasta otros del tamaño de Marte y con una masa de 0.1 veces la de nuestro planeta. También variaron las velocidades de colisión en un rango entre los 10 y los 15 km/s, suficientes para alcanzar la velocidad de escape de Venus.

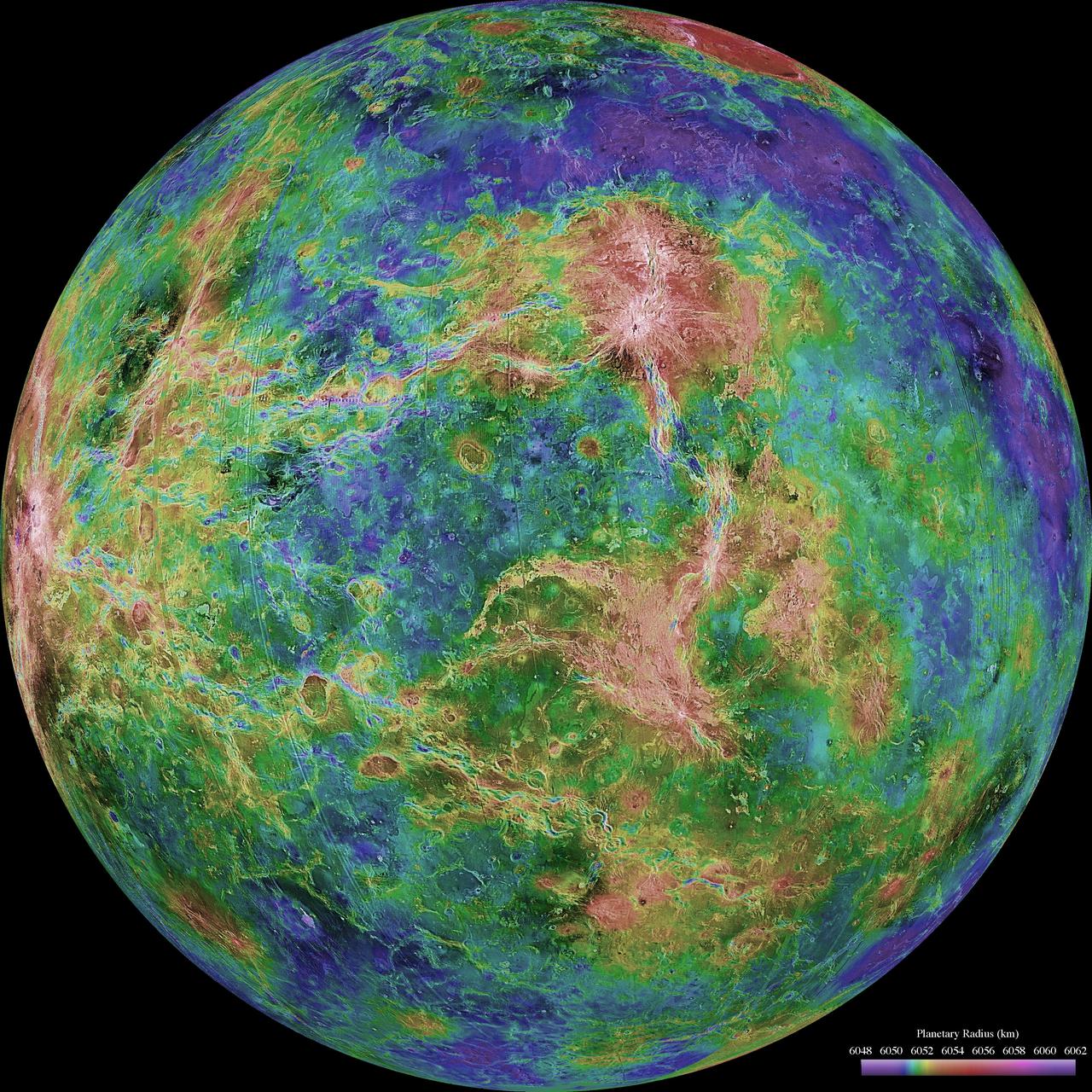

Mapa topográfico de Venus centrado en la longitud 270º. Si miramos la distribución de alturas -cuya leyenda esta en la parte inferior derecha de la imagen- veremos que se parece muy poco a la de nuestro planeta, donde hay una fuerte distribución bimodal donde se distinguen los continentes y las cuencas oceánicas. Imagen cortesía de NASA/JPL/USGS.

Mapa topográfico de Venus centrado en la longitud 270º. Si miramos la distribución de alturas -cuya leyenda esta en la parte inferior derecha de la imagen- veremos que se parece muy poco a la de nuestro planeta, donde hay una fuerte distribución bimodal donde se distinguen los continentes y las cuencas oceánicas. Imagen cortesía de NASA/JPL/USGS.También cambiaron las condiciones iniciales de este proto-Venus. Ya que no sabemos cómo podría haber sido este embrión planetario antes de la gran colisión, probaron también con diferentes periodos de rotación, desde uno de cero horas -es decir, con el planeta sin girar sobre si mismo- hasta uno en el que el día tan solo duraba dos horas y media, más rápido que Júpiter. También probaron distintas geometrías de impacto, desde unas colisiones “frontales” hasta otras más oblicuas y tangenciales capaces de añadir o restar momento angular al planeta.

El primer objetivo de los investigadores era el intentar resolver el misterio de la lenta velocidad de rotación y su sentido “inverso”. Para considerar que habían dado en el clavo, el escenario del impacto no necesitaba producir una velocidad de rotación como la actual, que es equivalente a 243 días terrestres. Solo necesitaban que la velocidad de rotación tras el impacto fuese de aproximadamente de 2 días o más.

Este es el umbral conservador que marcan algunos modelos de como podría haber sido la velocidad de rotación de Venus en el pasado. Y es que un Venus girando tan lentamente, con una atmósfera tan densa como la actual, permitiría que las mareas gravitatorias y térmicas que provoca la atmósfera sobre la superficie sirviesen como un freno que, a lo largo de miles de millones de años, frenase al planeta hasta la velocidad de rotación de hoy día, como un enorme lastre.

Curiosamente, los científicos se dieron cuenta que un gran número de los escenarios de impacto simulados son capaces de generar este resultado sin problemas. Si el proto-Venus no giraba sobre sí mismo antes del impacto, la solución era directa: una colisión frontal con un objeto del tamaño de Marte sería suficiente. Pero con un cuerpo pequeño, incluso con un impacto muy tangencial podría dejar al planeta con periodos de rotación superiores a las 48 horas.

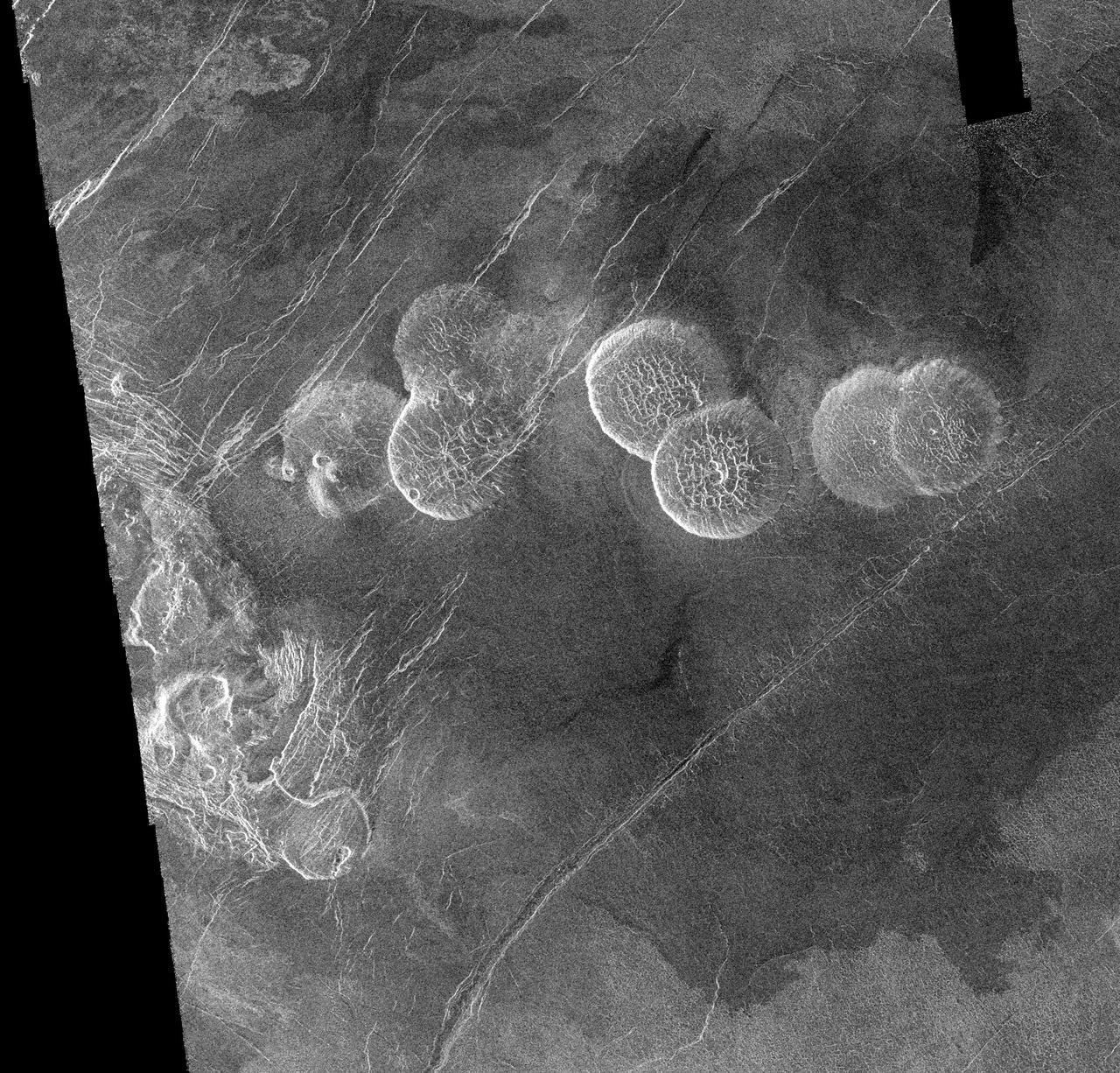

Venus es un mundo tan diferente al nuestro que incluso tiene formas geológicas que no se parecen en nada a las de la tierra, como estos pancake domes o, en traducción libre conocidos como “domos tortita” y que parecen ser domos de lava formados por la erupción de una lava muy viscosa, en este caso situados en Alpha Regio. Imagen cortesía de NASA/JPL.

Venus es un mundo tan diferente al nuestro que incluso tiene formas geológicas que no se parecen en nada a las de la tierra, como estos pancake domes o, en traducción libre conocidos como “domos tortita” y que parecen ser domos de lava formados por la erupción de una lava muy viscosa, en este caso situados en Alpha Regio. Imagen cortesía de NASA/JPL.Pero más llamativos fueron los resultados cuando simularon el impacto con un Venus girando sobre sí mismo. En este caso, el cuerpo que impactaba contra el proto-Venus tenía no solo que cambiar su velocidad de rotación, sino también de invertirla.

Para conseguir este efecto, se necesitaba un impacto oblicuo que golpease al planeta en contra de su dirección de rotación, algo que en las simulaciones es un escenario posible. Eso sí, en el caso de un Venus con una rotación muy rápida -el escenario de 2.5 horas- necesitaría de múltiples impactos para frenarlo e invertir su rotación, algo mucho más difícil desde el punto de vista estadístico.

Y ahora que tenemos resuelta la primera parte del puzle, ¿Por qué Venus no tiene un satélite natural? Estos mismos impactos son capaces de lanzar una gran cantidad de materia a la órbita, formando anillos cuyos fragmentos pueden ir fusionándose para formar un satélite, como en el caso de la Tierra y la Luna.

No todo iba a ser tan fácil ni tan bonito para Venus. El estudio tiene una derivada muy importante: los investigadores han encontrado una fuerte correlación positiva entre el momento angular del sistema tras el impacto y la masa del disco de materia producido por el impacto. Es decir, si el impacto acelera mucho al planeta, también lanza hacia afuera una gran cantidad de materia, mientras que los impactos que dejan al planeta con una velocidad de rotación pequeña, la cantidad de materia que se expulsa al espacio es mucho menor.

También hay formas que nos son más familiares, como esta imagen de radar de Sapas Mons, un volcán que alcanza los 1500 metros y cuyas coladas de lava -en esta imagen de radar en tonos muy claros- nos recuerda mucho a una imagen cenital de los volcanes terrestres. Imagen cortesía de NASA/JPL.

También hay formas que nos son más familiares, como esta imagen de radar de Sapas Mons, un volcán que alcanza los 1500 metros y cuyas coladas de lava -en esta imagen de radar en tonos muy claros- nos recuerda mucho a una imagen cenital de los volcanes terrestres. Imagen cortesía de NASA/JPL.Aquí es donde se unen las dos partes del estudio, ya que los investigadores opinan que son las dos caras de una moneda. Los escenarios que fueron capaces de explicar por qué Venus gira tan lentamente son los mismos que no pudieron crear un gran disco de materia alrededor del planeta y que acabase formando un satélite.

Además, la estabilidad del disco de materia alrededor de los planetas depende de su distancia con respecto a la órbita síncrona del planeta, la altitud a la cual una satélite gira a la misma velocidad que el propio planeta, un caso similar al de los satélites geoestacionarios en el ecuador de la Tierra.

Para el caso de un Venus girando tras el impacto con un periodo de 48 o más horas, la órbita síncrona estaría muy lejos, en torno a unas 10 veces el radio del planeta. Los investigadores analizaron todos los discos de materia formados en las simulaciones observando que, en cada caso, la poca materia que acaba en órbita lo hacía muy dentro de la órbita síncrona.

Este material estaría, de algún modo, condenado. En vez de unirse formando un satélite con una vida prolongada -en tiempo geológico, claro- las fuerzas de marea irían acercándolo a Venus. Este disco de materia iría lentamente haciendo una espiral descendente hacia el planeta, cayendo finalmente sobre su superficie.

Los resultados de este modelo no son un final en sí mismo, sino un inicio para comprender mejor la evolución de Venus. Un impacto de esta magnitud es capaz de “reiniciar” un planeta, ya que introduce una inmensa cantidad de energía cinética que, a su vez, se transforma en energía térmica, fundiendo grandes cantidades de la corteza y manto de Venus y alterando su evolución geodinámica.

Comprender mejor como Venus se ha ido enfriando, como se ha desarrollado la convección en el manto y conocer detalles que nos permitan entender el por qué, por ejemplo, no ha desarrollado una tectónica de placas, puede ser fundamental para por fin responder a la pregunta de por qué dos planetas que nacieron siendo tan iguales, acabaron teniendo un destino antagónico.

Referencias:

Bussmann, M., Reinhardt, C., Gillmann, C., Meier, T., Stadel, J., Tackley, P., & Helled, R. (2025) The possibility of a giant impact on Venus. Astronomy & Astrophysics doi: 10.1051/0004-6361/202555802

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo El violento nacimiento de Venus se ha escrito en Cuaderno de Cultura Científica.

Farmazia komunitarioaren eta lehen mailako arretaren integrazioa Euskal Herrian: aliantza estrategiko bat

Gaur egungo osasun sistemek hainbat erronkari aurre egin behar diete, hala nola biztanleriaren zahartzearen eraginei, gaixotasun kronikoen gorakadari edo antimikrobianoen aurkako erresistentzia geroz eta handiagoei. Erronka hauek osasun sistemen fragmentazioa eta koordinazio falta nabarmentzen dituzte, eta pazienteei kalitatezko osasun arreta emateko zailtasunak sortzen dituzte.

Zailtasun hauei aurre egiteko, Osasunaren Mundu Erakundeak osasun sistemak integratzeko beharra azpimarratu du, (1) pazienteak zaintzeko zerbitzuen koordinazioan; (2) diziplina anitzeko taldeak integratzeko politikak diseinatzean; (3) osasun zerbitzuen eskaintzen ebaluazioan eta gaixoen jarraipenean; (4) osasun esparruaren eta esparru sozialaren arteko koordinazioan; (5) baloreen eta kulturaren sustapenean; (6) informazioa partekatzeko sarbidea hobetzean; eta (7) tokiko zerbitzuei laguntzen jarduten baitu. Horretarako, osasun profesionalen arteko lankidetza estuagoa bultzatzea eta arreta jarraitu eta kalitatezkoa eskaintzea bermatzea beharrezkoa da.

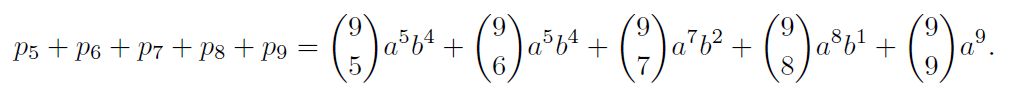

Irudia: antza denez, zientziak ebatzi egin du zebrak zuriak ala beltzak diren. (Argazkia: hosnysalah – domeinu publikoko irudia. Iturria: pixabay.com).

Irudia: antza denez, zientziak ebatzi egin du zebrak zuriak ala beltzak diren. (Argazkia: hosnysalah – domeinu publikoko irudia. Iturria: pixabay.com).Hala ere, osasun sistemaren integrazio ahaleginetan baliabide baliotsu bat alde batera uzten da askotan, farmazia komunitarioa dena. Hau, osasun sistemaren sarbide puntu nagusietako bat da, eta bere integrazioa lehen mailako arretarekin diziplina anitzeko talde baten, pazientearen osasun emaitzak hobetzen lagundu dezake. Nahiz eta aurreko mendearen amaierara arte farmazia oro har sendagaien dispentsazioan zentratzen bazen ere, azken urteotan eraldaketa nabarmena izan du. Izan ere, farmazia, gaur egun, pazientearengan zentratuago dagoen ikuspegi baterantz eboluzionatzen ari da, Farmazia Zerbitzu Profesional Asistentzialen, arreta farmazeutikoaren eta tratamenduen indikazioaren bidezko osasun arreta eskainiz.

Ildo horretan, osasun hezkuntza eta gaixotasunen prebentzioko kanpainak egiten ditu, esaterako, Euskal Autonomia Erkidegoan (EAE) metadona bidezko mantentze programetan eta GIBa edo sifilisa bezalako gaixotasunen detekzio goiztiarrean. Hala ere, nahiz eta pazienteekiko arreta hobetzeko potentzial handia duen, lehen mailako arretan duen parte hartzea oraindik murritza da. Dena den, gauzak aldatzen ari dira, izan ere, 2024ko martxoaren 25ean sinatu zen farmazia itunean, berariaz esaten da: “Itun honek farmazia bulegoak Osasun Sisteman integratzen ditu eragile laguntzaile gisa gainerako arreta mailekin koordinatuta”.

Farmaziak autonomia erkidego osoan banatuta daude, herritar guztien eskura daude, osasun publikorako funtsezkoa izan daitekeena. Gainera, osasun zentroetako profesionalekin lankidetzan, farmaziak prebalentzia altua duten gaixotasun kronikoak modu eraginkorrean kudeatzen lagundu dezaketela frogatu da, tratamendu erregimenak optimizatuz, pazientearen heziketan eraginez eta pazientearen medikamentuekiko atxikimendua hobetzeko jarraipen pertsonalizatua eskainiz. Honek guztiak iradokitzen du farmazia komunitarioaren integrazioa aukera handiak eskaintzen dituela osasun sistemaren baliabideak optimizatzeko eta eraginkortasuna eta emaitzak hobetzeko.

Artikulu honetan, farmazia osasun sisteman eraginkortasunez integratzeko harreman interprofesionalek bete behar dituzten baldintzak jorratzen dira. Hala, funtsezkoa da konektibitate ona, noranzko biko komunikazioa, adostasuna eta konfiantza ezartzea talde desberdinen artean. Funtsezkoa da, halaber, sektore bakoitzaren rol profesionalak aitortzea eta profesionalen arteko errespetua sustatzea. Bestalde, integrazioa gauzatzeko osasun sisteman inplikatuta dauden aktore desberdinek duten funtzioa azaltzen da artikuluan.

Azkenik, funtsezkoa da existitzen diren oztopoak gainditzea (kulturalak, testuingurukoak, finantzakoak, etab.), eta horretarako, farmazia eta lehen mailako arreta integratzeko plan bat ezartzea beharrezkoa da, gaur egun osasun sistemek dituzten erronkei erantzun berritzaile eta eraginkorra emateko.

Argi dago farmazia komunitarioa osasun sistemaren funtsezko eragilea dela, osasun zerbitzuen epe luzerako iraunkortasuna bermatzea susta baitezake. Bada garaia dauden oztopoak gainditzeko, sektore honen potentziala ezagutzeko eta pazientearengan zentratutako osasun arreta integralago baten bilaketan aliatu gisa baliatzeko.

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: 47

- Artikuluaren izena: Farmazia komunitarioaren eta lehen mailako arretaren integrazioa Euskal Herrian: Aliantza estrategiko ba.

- Laburpena: Gaur egun, osasun-sistemek erronka konplexuei egin behar diete aurre, hala nola krisi sanitario globalei, presio ekonomiko eta sozialei, edo arreta sanitarioaren eskaeraren etengabeko handipenari. Lehen mailako osasun-arreta funtsezkoa da erronka horiei aurre egiteko, baina osasun-arretaren zenbait zerbitzutan dagoen fragmentazioak zaildu egiten du koordinazio asistentziala. Osasun-arretaren integrazioa erronka hauei aurre egiteko estrategia gisa aurkezten da, osasun-sistemaren kalitatea eta eraginkortasuna hobetuko bailituzke. Testuinguru honetan, farmazia komunitarioa lehen mailako arreta indartzeko eta pazientearen koordinazio asistentziala hobetzeko gai den baliabide baliotsua izan daiteke. Herritarrengandik hurbil eta eskuragarri kokatuta dagoenez, farmaziak funtsezko zeregina izan dezake osasunaren sustapenean, gaixotasunaren prebentzioan, osasun-arazoen detekzioan, gaixotasun kronikoen kudeaketan eta osasun-sistemetan erabilgarri dauden baliabideen optimizazioan. Farmaziak ikuspegi asistentzialago baterantz izan duen bilakaerak azpimarratu egitren du lehen mailako arretan ekarpen nabarmena egiteko duen ahalmena, sendagaiak emateaz haraindiko zerbitzu sorta zabala eskaintzen baitu. Gainera, farmazialariek sendagaien inguruko prestakuntza zabala dute; beraz, lehen mailako arretarekin modu eraginkorrean integratuz, farmazia komunitarioek pazientearen osasun-arreta hobea eskaintzen lagundu dezakete, eta horrek aukera ematen du tratamendu-erregimenak optimizatzeko, tratamendu farmakologikoekiko atxikipena hobetzeko, alferrikako bisita medikoekin lotutako kostuak murrizteko eta osasun emaitza hobeak lortzeko. Hala ere, farmazia komunitarioa eta lehen mailako osasun-arreta integratzeko, beharrezkoa izango da jarduera-protokolo bateratuak ezartzea, rol argiak definitzea eta inplikatutako eragile guztien parte hartze aktiboa bermatzea. Integrazioa lortzeko, ezinbestekoa da gaur egun dauden oztopo kulturalak gainditzea, farmazia komunitarioak pazienteari zuzendutako osasun-arreta integrala hobetzen lagun dezan bere asistentzia-gaitasuna baliatuz. Artikulu honen bidez, eztabaida piztu nahi da komunitate zientifikoan farmazia komunitarioa osasun-sisteman integratzeko beharrari eta aukerari buruz.

- Egileak: Amaia Urionagüena, Miguel Ángel Gastelurrutia, María Ángeles Solinís Aspiazu, Arantxazu Isla Ruiz, Ana del Pozo Rodríguez eta Begoña Calvo Hernáez

- Argitaletxea: EHUko argitalpen zerbitzua

- ISSN: 0214-9001

- eISSN: 2444-3255

- Orrialdeak: 57-73

- DOI: 10.1387/ekaia.26262

Amaia Urionagüena eta Begoña Calvo Hernáez EHUko farmazia fakultateko Pharmacy Practice Research ikerketa-taldeko eta Farmakozinetika, Nanoteknologia eta Terapia Genikoa ikerketa-taldeko ikertzaileak dira.

Miguel Ángel Gastelurrutia EHUko farmazia fakultateko Pharmacy Practice Research ikerketa-taldeko eta Gipuzkoako Farmazialarien Elkargoko ikertzailea da.

María Ángeles Solinís Aspiazu, Arantxazu Isla Ruiz eta Ana del Pozo Rodríguez EHUko farmazia fakultateko Pharmacy Practice Research ikerketa-taldeko, Farmakozinetika, Nanoteknologia eta Terapia Genikoa ikerketa-taldeko eta Bioaraba Osasun Ikerketa Institutuko Mikrobiologia, Gaixotasun Infekziosoak, Antimikrobianoak eta Gene Terapia taldeko ikertzaileak dira

Ekaia aldizkariarekin lankidetzan egindako atala.

The post Farmazia komunitarioaren eta lehen mailako arretaren integrazioa Euskal Herrian: aliantza estrategiko bat appeared first on Zientzia Kaiera.

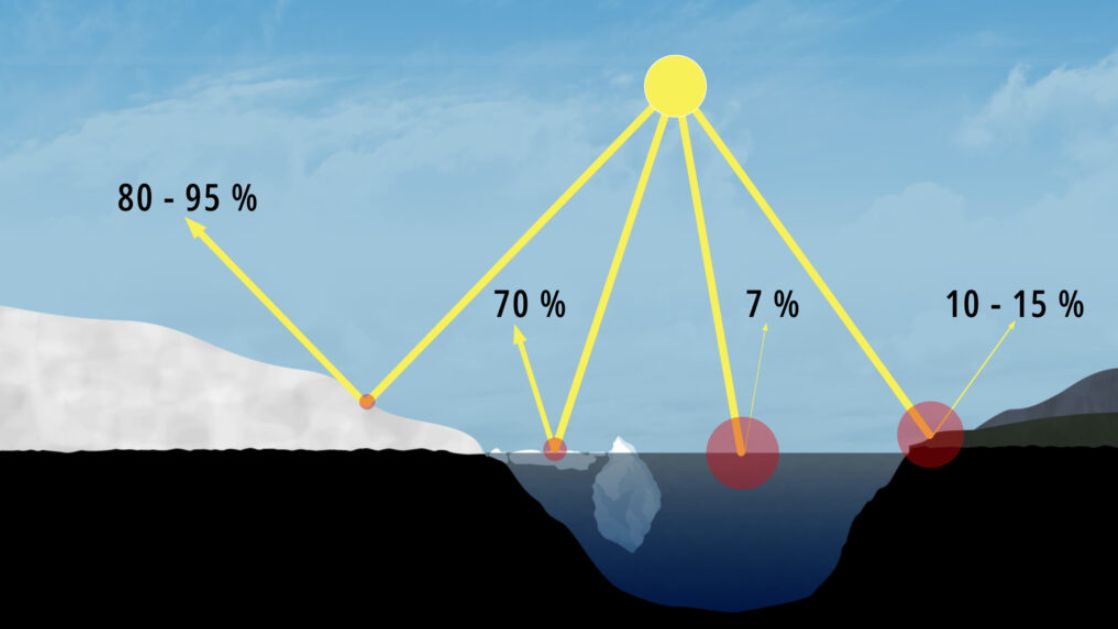

Adiós a la canica azul: La Tierra se está oscureciendo y no son buenas noticias

La Tierra vista por la misión lunar Apolo 17 en 1972. Foto: NASA / Dominio Público