El lugar de nacimiento y las probabilidades de ser futbolista profesional

Partido clasificatorio de la Eurocopa 2025 entre España y Bélgica en el estadio de Riazor (2024). En la imagen, Alexia Putellas.

Partido clasificatorio de la Eurocopa 2025 entre España y Bélgica en el estadio de Riazor (2024). En la imagen, Alexia Putellas.Wikimedia Commons., CC BY

Si pudiéramos por un segundo desarrollar una herramienta capaz de detectar el próximo Lamine Yamal o Nico Williams, o la próxima Alexia Putellas o Salma Paralluelo, seguro que seríamos de las personas más perseguidas por la industria deportiva. Siendo el fútbol uno de los deportes de mayor impacto social y económico, es cada vez mayor la inversión que los distintos clubes realizan en sus canteras para encontrar y formar a las futuras estrellas del fútbol.

Durante muchos años, la investigación relacionada con la detección de estrellas futbolísticas estaba suscrita al debate de si el futbolista nace o se hace. Este interrogante ha ocupado centenares de investigaciones y ha evolucionado desde una visión dicotómica hasta el reconocimiento de la compleja interacción de factores genéticos y ambientales.

Mientras que la predisposición genética desempeña un papel crucial en el rendimiento, la práctica deliberada y las influencias ambientales son esenciales para hacer realidad el potencial genético.

La identificación del talento debe adoptar un enfoque multidimensional y dinámico, y afrontarse desde la interacción de todos los factores, ya sean innatos (genéticos, antropométricos…), adquiridos (entrenamiento) o contextuales (familia, lugar de nacimiento…).

Ciudad mediana, un buen punto de partidaNuestra investigación se ha centrado en conocer cómo el lugar de nacimiento influye en el desarrollo del futbolista, tanto en su participación como en su rendimiento deportivos.

Estudios previos sugieren que nacer en determinados tamaños de ciudad, normalmente ciudades más pequeñas o medianas, puede suponer ventajas en el desarrollo del talento.

Entre los motivos que contribuyen a este efecto se encuentran la proximidad a instalaciones deportivas y la estructura social.

Lamine Yamal después de que la selección española ganara la Eurocopa 2024. Fuente:

Lamine Yamal después de que la selección española ganara la Eurocopa 2024. Fuente:Wikimedia Commons., CC BY

En una revisión sistemática centrada en el fútbol, se ha observado que la combinación de la densidad de población y el nivel de las instalaciones del lugar de nacimiento son cruciales, existiendo una relación entre el lugar de nacimiento y el rendimiento futbolístico.

Como idea general, se ha observado que, en ciudades de mayor tamaño y densidad, aumentan las posibilidades de alcanzar un estatus profesional en el fútbol. Este fenómeno se atribuye a diversas razones como un mayor número posible de clubes y oportunidades competitivas disponibles en las zonas urbanas.

Las características sociodemográficas de las poblaciones más grandes como renta media más alta, mejores instalaciones deportivas, entrenadores más cualificados o estructuras competitivas más profundas también pueden contribuir al desarrollo del talento futbolístico.

No obstante, aunque las ciudades más grandes ofrecen muchas ventajas, algunos estudios sugieren que las ciudades más pequeñas pueden fomentar asimismo el desarrollo del talento, al ofrecer un entorno comunitario más solidario y menos competencia por las plazas en los clubes locales. Esto puede permitir una atención más individualizada y más oportunidades.

Un puzle complejoEn cualquier caso, como todo lo relacionado con el desarrollo del talento, no se debe entender el lugar de nacimiento como un factor aislado, sino como algo dinámico que interactúa con otros factores de diversas formas.

Así, por ejemplo, se ha observado que, para ingresar en una academia de fútbol, los jugadores provenientes de zonas con mayor densidad de población tenían más probabilidades de ser seleccionados inicialmente. Sin embargo, una vez dentro de la academia, las probabilidades de debutar profesionalmente eran mayores para los jugadores de zonas de menor densidad.

Del lugar de nacimiento al lugar de crecimientoEsto lleva a la necesidad de una investigación más profunda relacionada con el “lugar de desarrollo”. Porque parece evidente que, en el mundo actual, donde la globalización impera y provoca movimientos migratorios laborales, el lugar de nacimiento no tiene por qué coincidir con el lugar donde las personas crecen y reciben su formación.

En un estudio realizado en una academia de fútbol, se observó que los jugadores que experimentaron una transición geográfica –cambio de su municipio de nacimiento a otro lugar de crecimiento deportivo– tenían aproximadamente un 38 % más de probabilidades de debutar en el equipo profesional.

Este hallazgo indica que la movilidad geográfica puede aumentar las oportunidades de éxito en el fútbol, y sugiere que es necesario considerar ambos lugares como variables conjuntas para comprender los procesos de gestión del talento.

En resumen, el lugar de origen y el lugar donde se crece desempeñan un papel crucial en la configuración del rendimiento y las oportunidades de los jugadores de fútbol. En general, el vínculo con el tamaño de la población es complejo, con ventajas y desventajas según el contexto específico. Toda la investigación al respecto insiste en la naturaleza polifacética del desarrollo del talento, abogando por un enfoque que considere tanto los factores individuales como los contextuales.![]()

Sobre las autoras: Alberto Lorenzo Calvo, Profesor Titular de Universidad de Procesos de Detección y Desarrollo en el Talento Deportivo, Universidad Politécnica de Madrid (UPM); Julio Calleja-Gonzalez, Catedrático de Entrenamiento Deportivo, Universidad del País Vasco / Euskal Herriko Unibertsitatea; Lander Hernández Simal, Licencia UEFA PRO, Responsable del Departamento de Formación y Desarrollo del Athletic Club (Bilbao), Profesor del Grado en Ciencias de la Actividad Física y del Deporte de la Universidad de Deusto; y Maite Aurrekoetxea Casaus, Profesora Doctora en Sociología en la Facultad de Ciencias Sociales y Humanas, Universidad de Deusto.

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo El lugar de nacimiento y las probabilidades de ser futbolista profesional se ha escrito en Cuaderno de Cultura Científica.

Aprendiendo Geología mientras buscamos oro en Alaska

Estos días de vacaciones navideñas en los que el tiempo andaba revuelto y no invitaba a salir a disfrutar de un agradable paseo, he remoloneado en el sofá delante de la tele. Y un día, haciendo zapping de manera despreocupada, me encontré con una serie tipo docu-reality en la que se muestra el trabajo diario de varios equipos de minería en Alaska, con un título muy directo y evocativo: La Fiebre del Oro. Y digo evocativo porque hace alusión directa a esa locura colectiva que ocurrió en Norteamérica a finales del siglo XIX que condujo a muchos hombres a abandonarlo todo y marcharse a lugares remotos con una pala en una mano y un tamiz en la otra, convencidos de que iban a encontrar la pepita de oro que les haría millonarios. Locura que, visto lo visto en el programa, parece que sigue vigente. Pero lo que llamó mi atención en esta serie no fueron las aventuras y desventuras de estas personas, sino el hecho de que, intercaladas entre las habituales labores de minería, se encontraban pequeñas animaciones con explicaciones geológicas para que pudiésemos entender de dónde salía ese oro o porqué los jefes mineros se centraban en buscar ciertas rocas o niveles de tierra muy concretos. Incluso, defendían el uso de algunas técnicas geológicas para asegurarse de que podrían obtener beneficios económicos con sus explotaciones. Así que hoy voy a haceros un pequeño resumen de lo que nos han querido mostrar en esta serie de televisión.

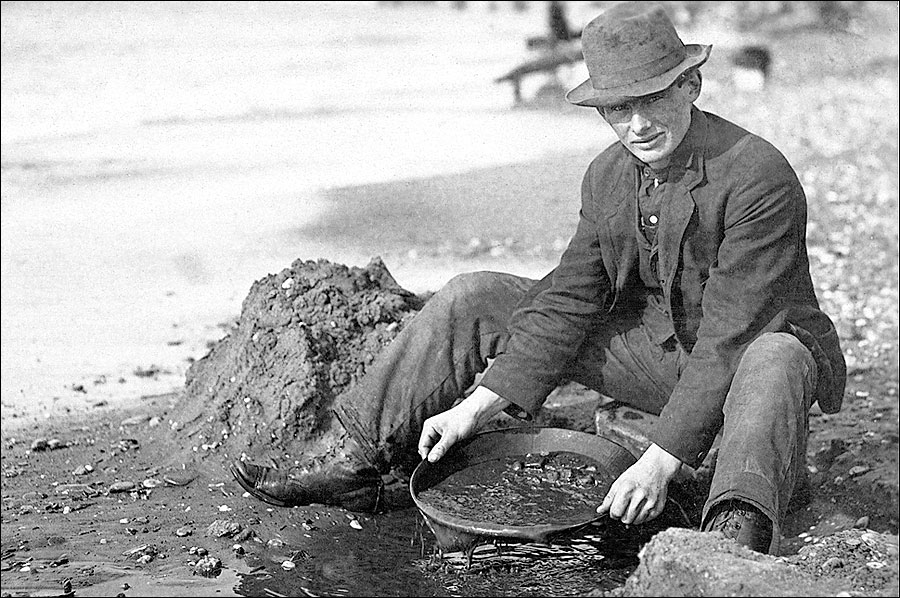

Hombre bateando los sedimentos de la playa de Nome, en Alaska, buscando oro en 1900. Imagen de los hermanos Lomen, conservada en el The McMahan Photo Art Gallery and Archive.

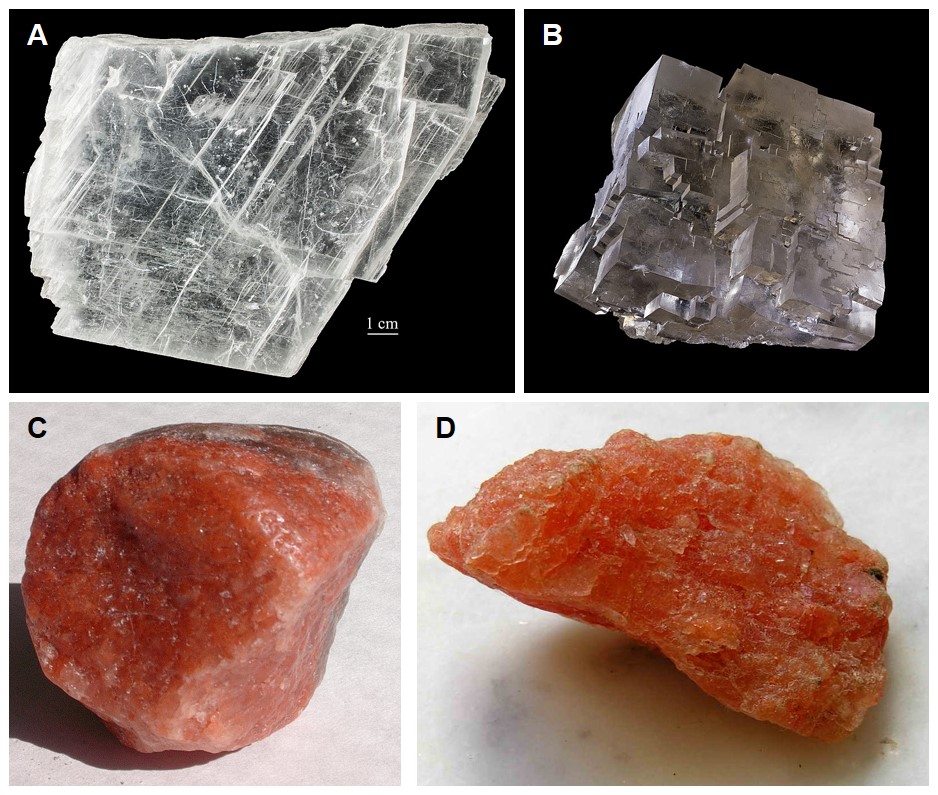

Hombre bateando los sedimentos de la playa de Nome, en Alaska, buscando oro en 1900. Imagen de los hermanos Lomen, conservada en el The McMahan Photo Art Gallery and Archive.Los depósitos de oro de Alaska se formaron hace menos de 150 millones de años, debido a varios procesos de colisión que se produjeron por el acercamiento de la Placa tectónica del Pacífico y la Placa tectónica Norteamericana. En este contexto no solo se formaron diversas cadenas montañosas, también se favoreció el ascenso de varias acumulaciones de magma hacia la parte superior de la corteza y se generaron muchas zonas de fractura. Asociados a esos magmas aparecieron fluidos calientes que fueron atrapando todos los elementos químicos presentes en las rocas de su alrededor, incluido el oro. Y en cuanto estos fluidos se encontraban con una fractura, empezaron a ascender hacia la superficie, dando lugar a unas mineralizaciones de cuarzo ricas en oro que, en Geología, se denominan diques y, en minería, se conocen como filones.

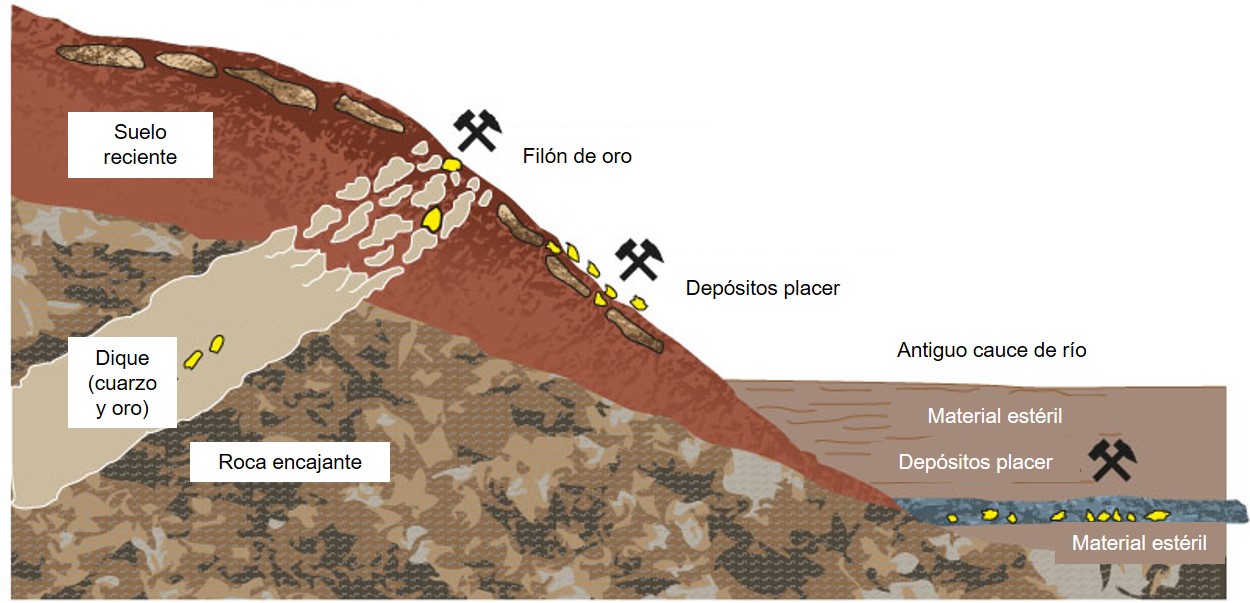

Pero su historia no termina aquí. En los últimos 20 millones de años, los ríos se han encargado de erosionar estos diques y arrastrar el oro corriente abajo, hacia su desembocadura, depositando el mineral en las zonas curvadas del cauce donde el agua perdía fuerza. Y, en los últimos 2 millones de años, el hielo también se ha sumado al arrastre de oro desde su depósito original, acumulándolo en áreas deprimidas en la zona del frente de avance de los glaciares. Estos depósitos de oro generados por el efecto del agua, tanto líquida como sólida, se conocen como placeres, y son lo que los equipos mineros actuales buscan explotar. Por este motivo cavan la tierra hasta llegar a niveles en los que encuentran una mezcla de arcillas con abundantes fragmentos de cuarzo y rocas redondeadas, ya que son las chivatas de que han sido arrastradas y erosionadas por el agua desde un filón mineralizado. Entonces hacen una batea manual para ver si también incluye oro y determinar si es rentable explotar ese material.

Depósitos de oro asociados a un dique hidrotermal, incluidos los de tipo placer. Imagen modificada de la original de Michael Priester. Fuente: Minelab

Depósitos de oro asociados a un dique hidrotermal, incluidos los de tipo placer. Imagen modificada de la original de Michael Priester. Fuente: MinelabPero estas excavaciones no las hacen al azar por cualquier lugar, siempre van a tiro hecho. Para ello cuentan con la ayuda de especialistas en la geología de Alaska que utilizan diversas técnicas comunes en la exploración mineral para ayudarles a encontrar el yacimiento de oro que se esconde bajo tierra. Y me voy a centrar en explicaros las dos que describieron en los pocos capítulos que he visto.

La primera es la resistividad eléctrica. Se trata de una técnica geofísica que consiste en introducir unos electrodos cilíndricos en el suelo conectados en serie mediante un cableado que, además, se conecta a una caja medidora de resistividad. Estos electrodos son capaces de enviar una corriente eléctrica que se transmite en profundidad y que va cambiando de potencial según atraviesa diferentes materiales o estructuras geológicas. Estos cambios en el potencial eléctrico quedan marcados en la caja medidora, lo que nos permite tratar los datos para realizar una especie de radiografía tridimensional del subsuelo. En el programa, emplearon esta técnica para identificar antiguos canales fluviales y acumulaciones de materiales metálicos transportados por los glaciales hace milenios, calculando la profundidad a la que se encontraban estas estructuras geológicas y, por tanto, los posibles yacimientos auríferos.

Estudio de resistividad eléctrica del terreno en la mina de crisoprasa de Szklary (Baja Silesia, Polonia). Fuente: Wikimedia Commons

Estudio de resistividad eléctrica del terreno en la mina de crisoprasa de Szklary (Baja Silesia, Polonia). Fuente: Wikimedia CommonsLa segunda técnica os debería sonar más, porque ya he hablado de ella: los testigos de sondeo. En este caso, realizaron varias perforaciones a lo largo del terreno que tenían pensado explotar para obtener un registro continuo del subsuelo hasta la base rocosa. A estos sedimentos se les realizaron dos análisis consecutivos. En primer lugar, un estudio geoquímico para conocer los elementos químicos presentes en el mismo, buscando niveles que dieran positivo en oro. Y, en segundo lugar, lavaron y tamizaron esos niveles para calcular la concentración de oro con respecto al total de sedimento. De esta manera, pudieron determinar dónde y a qué profundidad se encontraban los yacimientos y, así, decidir si les era rentable o no explotarlos.

Debo reconocer que la serie no consiguió engancharme, así que no os puedo contar si estos equipos mineros se hicieron millonarios o si acabaron en la ruina, a mí únicamente me interesaron las animaciones explicativas que describían estos procesos y técnicas geológicas. Y, aunque eran más sencillas y resumidas de lo que yo os he comentado aquí, científicamente hablando sí que eran muy correctas. Así que puedo utilizarlas como otro ejemplo más no solo de que la Geología está en todo lo que nos rodea, sino también de que podemos aprender Ciencias de la Tierra gracias a cosas que, a priori, no parecen muy centradas en aumentar nuestro conocimiento científico. Únicamente hay que saber mirarlo todo con ojos geológicos.

Sobre la autora: Blanca María Martínez es doctora en geología, investigadora de la Sociedad de Ciencias Aranzadi y colaboradora externa del departamento de Geología de la Facultad de Ciencia y Tecnología de la UPV/EHU

El artículo Aprendiendo Geología mientras buscamos oro en Alaska se ha escrito en Cuaderno de Cultura Científica.

Cinco rompecabezas para celebrar el “Puzzle Day”

Cada 29 de enero, desde hace más de treinta años, se celebra en Estados Unidos el Puzzle Day. Esta conmemoración es una iniciativa de la creadora de rompecabezas Jodi Jill, que nació precisamente el 29 de enero de 1971.

Un rompecabezas. Fuente: Wikimedia Commons.

Un rompecabezas. Fuente: Wikimedia Commons.

Nos unimos a esta celebración con cinco rompecabezas, en nuestro caso, matemáticos. Para solucionarlos no está de más recordar estas palabras del matemático Henry Ernest Dudeney (1857-1930)

Un buen rompecabezas debe exigir el ejercicio de nuestro mejor ingenio y habilidad, y aunque el conocimiento de las matemáticas y la lógica son a menudo de gran utilidad en la solución de estas cosas, sin embargo, a veces sucede que una especie de astucia y sagacidad naturales son de considerable valor.

El puzle de los cuatro roblesEste es un problema de ingenio propuesto por Sam Loyd (1841-1911) en su Cyclopedia of 5000 Puzzles, Tricks, and Conundrums With Answers (1914):

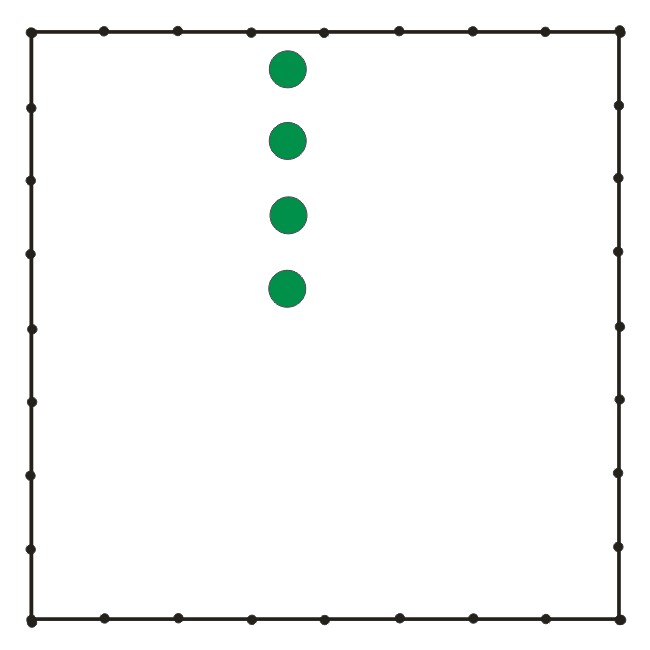

Un padre deja a sus cuatro hijos un campo cuadrado conteniendo cuatro robles [ver debajo]. Pero les pone una condición para obtener este legado: deben dividir el campo en cuatro partes, todas de la misma forma y tamaño, de manera que cada trozo de tierra contenga uno de los árboles. ¿Cómo lograrán hacerlo?

El planteamiento del problema. Fuente: Wikimedia Commons.

El planteamiento del problema. Fuente: Wikimedia Commons.

Piensa un poco antes de mirar la solución en este enlace.

Un puzle con dos dadosEl autor de este rompecabezas es Pierre Berloquin (1939):

Timoteo y Sofía están jugando con dos dados de seis caras. Pero no son dados normales: en vez de tener un número, cada cara está coloreada de rojo o azul.

Los dos amigos tiran los dados por turnos. Deciden que Timoteo ganará la partida si las dos caras superiores son del mismo color y Sofía lo hará si son diferentes. Se sabe que sus probabilidades de ganar son iguales.

También se sabe que el primer dado tiene 5 caras rojas y 1 cara azul.

¿Cuáles son los colores del segundo dado?

Pensemos en los posibles resultados en cada tirada: al lanzar dos dados de seis caras se obtienen 36 resultados posibles. Como Timoteo y Sofía tienen las mismas probabilidades de ganar, debe haber 18 resultados en los que ambos dados tengan el mismo color y otros 18 en los que la tirada muestre caras de distinto color. Si x es la cantidad de caras rojas en el segundo dado, debe cumplirse que:

18 = 5x + 1(6 – x).

Se deduce inmediatamente que x = 3, y entonces el segundo dado debe tener 3 caras rojas y 3 caras azules.

Un puzle numéricoEl creador de rompecabezas japonés Nobuyuki Yoshigahara (1936-2004) consideraba que este puzle era su obra maestra:

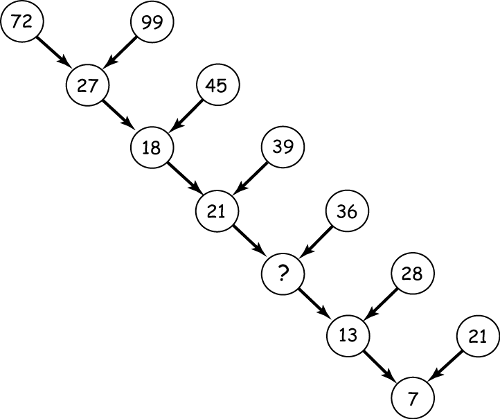

Los números que se muestran en la imagen de debajo están ordenados según una regla determinada. ¿Cuál es el número que falta?

Fuente: Futility Closet.

Fuente: Futility Closet.

Por supuesto, lo importante es encontrar la regla. Intenta encontrarla antes de leer la solución.

Se observa en una primera mirada que 99 – 72 = 27, 45 – 27 = 18, 39 – 18 = 21, … parece que esta es la regla, es decir, la diferencia de los números de una fila devuelve el número del círculo de debajo. Así, como 28 – ? = 13, parece que debe ser ? = 15. Pero si miramos lo que sucede en la última fila, tenemos que 21 – 13 = 8, no 7 como se indica en el diagrama. Así que esta no es la regla.

Mirando de nuevo el diagrama, se puede comprobar que al sumar los dígitos de una fila se obtiene el número que se encuentra en el círculo de debajo. Por ejemplo, 7 + 2 + 9 + 9 = 27 para la primera fila, 4 + 5 + 2 + 7 = 18. Se comprueba que esta regla funciona en todas las filas. Así, 2 + 1 + 3 + 6 = 12, que es el número que falta en la imagen.

Un puzle olímpicoEsta propuesta procede de un problema de la Olimpiada Matemática rusa de 1999:

Se pide demostrar que los números del 1 al 15 no se pueden dividir en un grupo A de 13 números y otro B de 2 números de modo que la suma de los números de A sea igual al producto de los números de B.

Haremos la demostración por reducción al absurdo: supongamos que fuera posible dividir los números en dos grupos con las condiciones que se indican. Llamemos x e y a los dos números en B. Entonces se cumple que:

(1 + 2 + … + 15) – x – y = xy,

Es decir, 120 = xy + x + y, o lo que es lo mismo:

121 = (x + 1) (y + 1).

El número 121 = 112, con lo que es necesariamente x = y = 10. Pero esta solución no es válida, porque x e y son números distintos. Así, queda demostrado lo que se pedía.

Un puzle en el campo de tiroEste último rompecabezas se debe al matemático Peter Winkler (1946):

Sofía y Timoteo (que ya se han cansado de jugar a los dados) acuden a un campo de tiro. Sofía acierta a un objetivo pequeño el 75 % de las veces y Timoteo, con peor puntería, solo el 25 % de las veces.

Los dos apuntan a ese objetivo pequeño y disparan simultáneamente. Una bala lo alcanza.

¿Cuál es la probabilidad de que haya venido del arma de Sofía?

Como Sofía posee el triple de calidad de aciertos que Timoteo, dan ganas de decir que la probabilidad es del 75 %. Pero ese argumento no es válido porque hay que tener en cuenta los aciertos y los fallos. Pensemos en todas las situaciones posibles:

-

La probabilidad de que Sofía y Timoteo acierten en la diana es de 3/4 × 1/4 = 3/16,

-

La probabilidad de que ni Sofía ni Timoteo acierten su tiro es de 1/4 × 3/4 = 3/16,

-

la probabilidad de que Sofía acierte y Timoteo no es de 3/4 × 3/4 = 9/16, y, finalmente,

-

la probabilidad de que Timoteo acierte y Sofía no es de 1/4 × 1/4 = 1/16.

Como solo una bala alcanza el objetivo, se da necesariamente una de las situaciones descritas en 3) o en 4). Así, hay una probabilidad de 9/10 de que la bala que ha alcanzado en el blanco sea la de Sofía.

Referencias

-

The Four Oaks Puzzle, Futility Closet, 8 febrero 2024

-

A Dice Puzzle, Futility Closet, 23 octubre 2014

-

Nob’s number puzzle, Futility Closet, 30 abril 2014

-

15 Puzzle, Futility Closet, 2 julio 2013

-

Gun control, Futility Closet, 15 enero 2025

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y editora de Mujeres con Ciencia

El artículo Cinco rompecabezas para celebrar el “Puzzle Day” se ha escrito en Cuaderno de Cultura Científica.

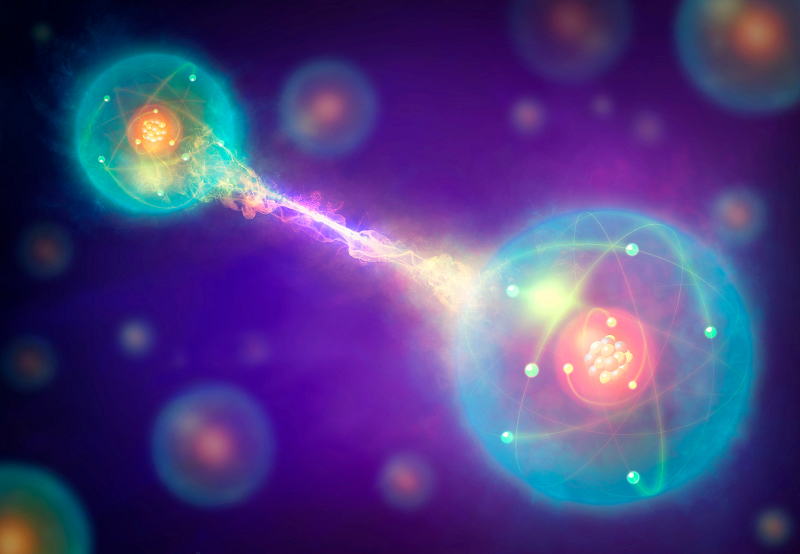

El calor destruye el entrelazamiento cuántico

Mientras ideaban un nuevo algoritmo cuántico, cuatro investigadores establecieron accidentalmente un límite estricto para el fenómeno «fantasma».

Un artículo de Ben Brubaker. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

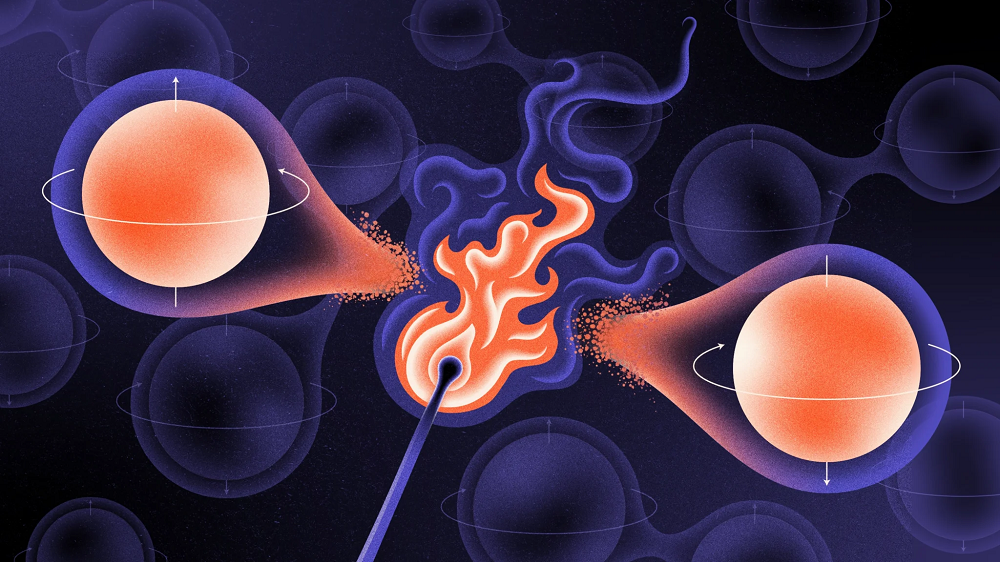

Kristina Armitage/Quanta Magazine

Kristina Armitage/Quanta MagazineHace casi un siglo, el físico Erwin Schrödinger llamó la atención sobre una peculiaridad del mundo cuántico que ha fascinado y desconcertado a los investigadores desde entonces. Cuando las partículas cuánticas, como los átomos, interactúan, se deshacen de sus identidades individuales en favor de un estado colectivo que es mayor y más extraño que la suma de sus partes. Este fenómeno se llama entrelazamiento.

Los investigadores tienen una comprensión sólida de cómo funciona el entrelazamiento en sistemas idealizados que contienen solo unas pocas partículas. Pero el mundo real es más complicado. En grandes conjuntos de átomos, como los que forman las cosas que vemos y tocamos, las leyes de la física cuántica compiten con las leyes de la termodinámica y las cosas se complican.

A temperaturas muy bajas, el entrelazamiento puede extenderse a grandes distancias, envolviendo a muchos átomos y dando lugar a fenómenos extraños como la superconductividad. Sin embargo, si aumentamos la temperatura, los átomos se mueven y rompen los frágiles enlaces que unen a las partículas entrelazadas.

Los físicos llevan mucho tiempo intentando precisar los detalles de este proceso. Ahora, un equipo de cuatro investigadores ha demostrado que el entrelazamiento no se debilita simplemente a medida que aumenta la temperatura, sino que, en los modelos matemáticos de sistemas cuánticos, como las formaciones de átomos en los materiales físicos, siempre hay una temperatura específica por encima de la cual desaparece por completo. “No es solo que sea exponencialmente pequeño”, explica Ankur Moitra, del Instituto Tecnológico de Massachusetts, uno de los autores del nuevo resultado. “Es cero”.

Los investigadores ya habían observado indicios de este comportamiento y lo habían denominado la “muerte súbita” del entrelazamiento, pero sus pruebas eran en su mayoría indirectas. El nuevo hallazgo establece un límite mucho más fuerte al entrelazamiento de una manera matemáticamente rigurosa.

Curiosamente, los cuatro investigadores que están detrás del nuevo resultado ni siquiera son físicos y no se proponían demostrar nada sobre el entrelazamiento. Son científicos informáticos que se toparon con la prueba por accidente mientras desarrollaban un nuevo algoritmo.

Independientemente de su intención, los resultados entusiasmaron a los investigadores del área. “Es una afirmación muy, muy contundente”, comenta Soonwon Choi, físico del MIT. “Me quedé muy impresionado”.

En busca del equilibrioEl equipo hizo su descubrimiento mientras exploraba las capacidades teóricas de los futuros ordenadores cuánticos: máquinas que explotarán el comportamiento cuántico, incluidos el entrelazamiento y la superposición, para realizar ciertos cálculos mucho más rápido que las ordenadores convencionales que conocemos hoy.

Una de las aplicaciones más prometedoras de la computación cuántica es el estudio de la propia física cuántica. Supongamos que queremos entender el comportamiento de un sistema cuántico. Los investigadores primero deben desarrollar procedimientos específicos, o algoritmos, que los ordenadores cuánticos puedan utilizar para responder a nuestras preguntas.

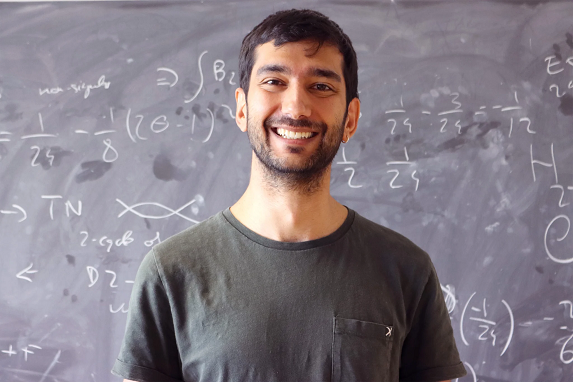

Ewin Tang ayudó a diseñar un nuevo algoritmo rápido para simular cómo se comportan ciertos sistemas cuánticos a altas temperaturas. Foto: Xinyu Tan

Ewin Tang ayudó a diseñar un nuevo algoritmo rápido para simular cómo se comportan ciertos sistemas cuánticos a altas temperaturas. Foto: Xinyu TanPero no todas las preguntas sobre los sistemas cuánticos son más fáciles de responder utilizando algoritmos cuánticos. Algunas son igualmente fáciles para los algoritmos clásicos, que se ejecutan en ordenadores comunes, mientras que otras son difíciles tanto para los algoritmos clásicos como para los cuánticos.

Para entender en qué aspectos los algoritmos cuánticos y las ordenadores que pueden ejecutarlos pueden ofrecer una ventaja, los investigadores suelen analizar modelos matemáticos llamados sistemas de espín, que capturan el comportamiento básico de conjuntos de átomos en interacción. A continuación, pueden preguntarse: ¿qué hará un sistema de espín cuando lo dejamos solo a una temperatura determinada? El estado en el que se establece, llamado estado de equilibrio térmico, determina muchas de sus otras propiedades, por lo que los investigadores han buscado durante mucho tiempo desarrollar algoritmos para encontrar estados de equilibrio.

El hecho de que esos algoritmos sean realmente útiles por su naturaleza cuántica depende de la temperatura del sistema de espín en cuestión. A temperaturas muy altas, los algoritmos clásicos conocidos pueden hacer el trabajo fácilmente. El problema se complica a medida que la temperatura disminuye y los fenómenos cuánticos se hacen más fuertes; en algunos sistemas se vuelve demasiado difícil incluso para que los ordenadores cuánticos lo resuelvan en un tiempo razonable. Pero los detalles de todo esto siguen siendo turbios.

“¿Cuándo se llega al espacio donde se necesita la cuántica y cuándo se llega al espacio donde la cuántica ni siquiera ayuda?”, se pregunta Ewin Tang, investigadora de la Universidad de California en Berkeley y una de los autoras del nuevo resultado. “No se sabe mucho al respecto”.

En febrero, Tang y Moitra comenzaron a pensar en el problema del equilibrio térmico junto con otros dos científicos informáticos del MIT: un investigador postdoctoral llamado Ainesh Bakshi y el doctorando de Moitra, Allen Liu. En 2023, todos habían colaborado en un algoritmo cuántico innovador para una tarea diferente que involucraba sistemas de espín y estaban buscando un nuevo desafío.

“Cuando trabajamos juntos, las cosas fluyen”, afirma Bakshi. “Ha sido fantástico”.

Antes de ese gran avance de 2023, los tres investigadores del MIT nunca habían trabajado en algoritmos cuánticos. Su formación era en teoría del aprendizaje, un subcampo de la informática que se centra en algoritmos para el análisis estadístico. Pero, como los ambiciosos novatos de todo el mundo, vieron su relativa ingenuidad como una ventaja, una forma de ver un problema con nuevos ojos. “Uno de nuestros puntos fuertes es que no sabemos mucho de cuántica”, cuenta Moitra. “La única cuántica que conocemos es la cuántica que Ewin nos enseñó”.

El equipo decidió centrarse en temperaturas relativamente altas, donde los investigadores sospechaban que existirían algoritmos cuánticos rápidos, aunque nadie había podido demostrarlo. Pronto encontraron una forma de adaptar una vieja técnica de la teoría del aprendizaje a un nuevo algoritmo rápido. Pero mientras escribían su artículo, otro equipo presentó un resultado similar: una prueba de que un prometedor algoritmo desarrollado el año anterior funcionaría bien a altas temperaturas. Se les había adelantado.

La muerte súbita renaceUn poco decepcionados por haber quedado en segundo lugar, Tang y sus colaboradores comenzaron a comunicarse con Álvaro Alhambra, físico del Instituto de Física Teórica de Madrid y uno de los autores del artículo rival. Querían determinar las diferencias entre los resultados que habían obtenido de forma independiente. Pero cuando Alhambra leyó un borrador preliminar de la prueba de los cuatro investigadores, se sorprendió al descubrir que habían demostrado algo más en un paso intermedio: en cualquier sistema de espín en equilibrio térmico, el entrelazamiento desaparece por completo por encima de cierta temperatura. “Les dije: ‘Oh, esto es muy, muy importante’”, cuenta Alhambra.

De izquierda a derecha: Allen Liu, Ainesh Bakshi y Ankur Moitra colaboraron con Tang, aprovechando su experiencia en una rama diferente de la informática. “Uno de nuestros puntos fuertes es que no sabemos mucho sobre la computación cuántica”, afirma Moitra. Fots, de izquierda a derecha: Cortesía de Allen Liu; Amartya Shankha Biswas; Gretchen Ertl

El equipo revisó rápidamente su borrador para destacar el resultado accidental. “Resulta que esto simplemente se desprende de nuestro algoritmo”, explica Moitra. “Obtenemos más de lo que esperábamos”.

Los investigadores habían observado esta muerte súbita del entrelazamiento desde la década del 2000 en experimentos y simulaciones en ordenadores clásicos comunes. Pero ninguno de estos trabajos anteriores había podido medir directamente la desaparición del entrelazamiento. Además, solo habían estudiado el fenómeno en sistemas pequeños, que no son los más interesantes.

“Podría haber sido que para sistemas cada vez más grandes habría que alcanzar temperaturas cada vez más altas para ver la ausencia de entrelazamiento”, explica Alhambra. En ese caso, el fenómeno de muerte súbita podría ocurrir a temperaturas tan altas que sería irrelevante en materiales reales. El único límite teórico anterior, de 2003, dejaba abierta esa posibilidad. En cambio, Tang y sus colaboradores demostraron que la temperatura a la que desaparece el entrelazamiento no depende del número total de átomos en el sistema. Lo único que importa son los detalles de las interacciones entre los átomos cercanos.

Álvaro Alhambra, un físico que trabajaba en el mismo problema que Tang, Moitra, Bakshi y Liu, se dio cuenta de que habían demostrado accidentalmente un nuevo resultado sobre el entrelazamiento cuántico mientras desarrollaban su algoritmo. Foto: Laura Marcos

Álvaro Alhambra, un físico que trabajaba en el mismo problema que Tang, Moitra, Bakshi y Liu, se dio cuenta de que habían demostrado accidentalmente un nuevo resultado sobre el entrelazamiento cuántico mientras desarrollaban su algoritmo. Foto: Laura MarcosEl método que utilizaron en su demostración fue inusual en sí mismo. La mayoría de los algoritmos para hallar estados de equilibrio térmico se inspiran en la forma en que los sistemas físicos reales se acercan al equilibrio. Pero Tang y compañía utilizaron técnicas muy alejadas de la teoría cuántica.

“Eso es lo que hace tan asombroso este artículo”, comenta Nikhil Srivastava, un científico informático de Berkeley. “La prueba en cierto modo ignora la física”.

La búsqueda continúaLa prueba de los cuatro investigadores de que los sistemas de espín de alta temperatura carecen de entrelazamiento ayuda a explicar otra característica interesante de su nuevo algoritmo: muy poco de él es realmente cuántico. Es cierto que el resultado del algoritmo (una descripción completa de cómo se orientan los átomos en un sistema de espín en equilibrio térmico) es demasiado difícil de manejar para almacenar en una máquina clásica. Pero, salvo el último paso que genera este resultado, cada parte del algoritmo es clásica.

“Es esencialmente el cálculo cuántico más trivial”, afirma Liu.

Tang tiene una larga trayectoria en el descubrimiento de resultados de “descuantización”, es decir, pruebas de que los algoritmos cuánticos no son realmente necesarios para muchos problemas. Ella y sus colaboradores no estaban tratando de hacer eso esta vez, pero la prueba de la desaparición del entrelazamiento con la que se toparon equivale a una versión aún más extrema de la descuantización. No es solo que los algoritmos cuánticos no ofrezcan ninguna ventaja en un problema específico que involucre sistemas de espín de alta temperatura; es que no hay nada cuántico en esos sistemas.

Pero eso no significa que los investigadores de computación cuántica deban perder la esperanza. Dos artículos recientes identifican ejemplos de sistemas de espín de baja temperatura en los que los algoritmos cuánticos para medir estados de equilibrio superan a los clásicos, aunque aún queda por ver lo extendido que está este comportamiento. Y aunque Bakshi y sus colaboradores han demostrado un resultado negativo, el método poco ortodoxo que utilizaron para llegar a él indica que pueden surgir nuevas ideas fructíferas de lugares inesperados.

“Podemos ser optimistas y pensar que se descubrirán nuevos algoritmos increíbles”, afirma Moitra. “Y que, en el proceso, podremos descubrir hermosas matemáticas”.

El artículo original, Computer Scientists Prove That Heat Destroys Quantum Entanglement, se publicó el 28 de agosto de 2024 en Quanta Magazine.

Traducido por César Tomé López

El artículo El calor destruye el entrelazamiento cuántico se ha escrito en Cuaderno de Cultura Científica.

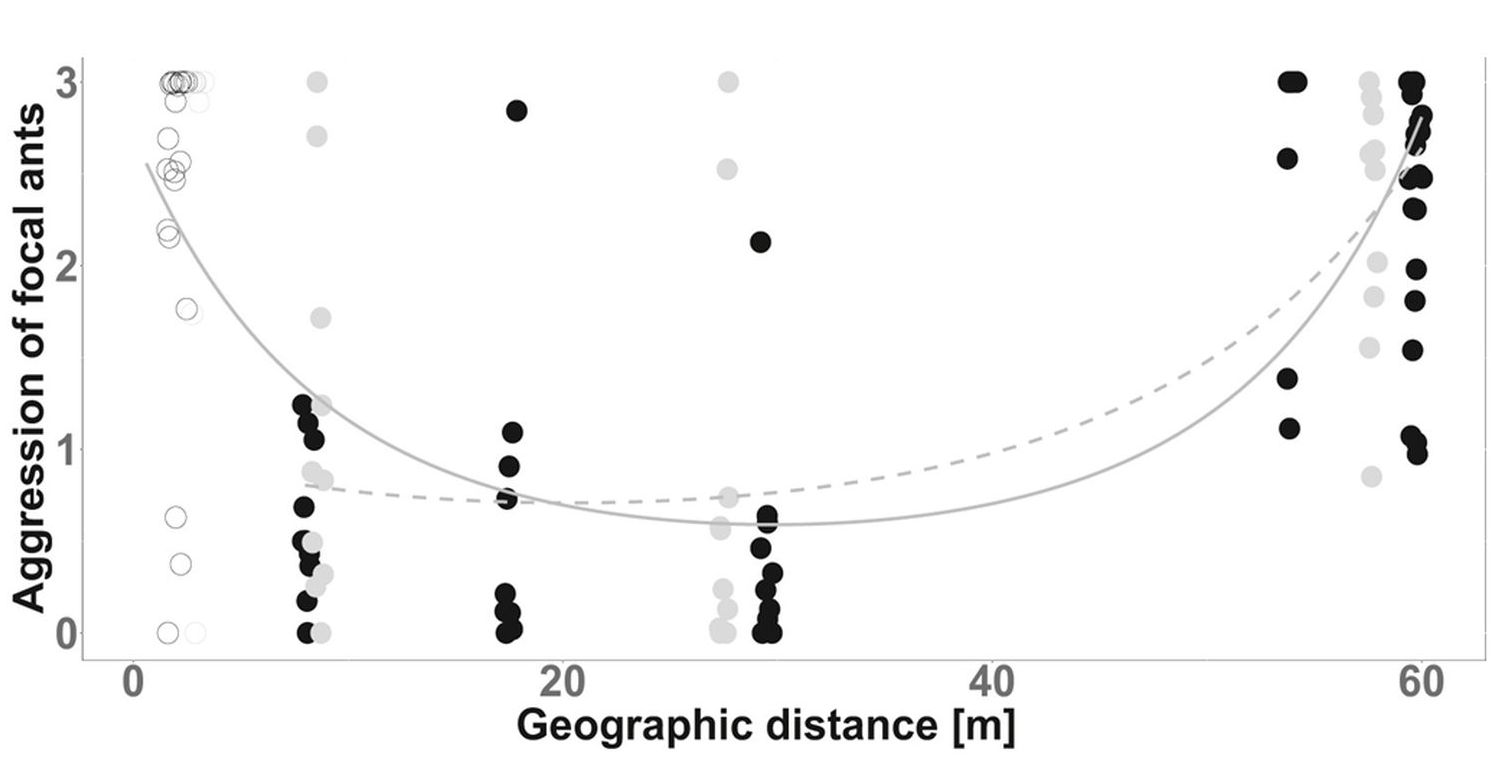

Ni machos, ni reinas. El extraordinario caso de la hormiga saqueadora clónica

Los himenópteros en general, y las hormigas en particular, determinan su sexo mediante la haplodiploidía. Esto significa que las hembras son diploides y tienen dos dotaciones cromosómicas completas, lo habitual entre los animales. Los machos, en cambio, son haploides y solo tienen una dotación cromosómica. Cuando el óvulo haploide de una hembra es fecundado por un espermatozoide, se restaura la doble dotación cromosómica y tenemos otra hembra. Si el óvulo no es fecundado, su desarrollo dará lugar a un individuo masculino haploide.

Entre los himenópteros también es frecuente la organización social consistente en una o varias reinas (hembras reproductivas), un gran número de hembras obreras estériles, que asisten a la reina y proporcionan alimento a la colonia, y un reducido número de machos cuya función básica es fecundar a la reina.

Esta es la regla general, pero hay excepciones. Entre las 15 000 especies registradas de hormigas, hay un par de centenares que carecen de reinas en sus colonias. Su reproducción puede basarse en la fertilidad adquirida por una parte de las obreras o, en ausencia de machos, pueden ocurrir casos de reproducción asexual en los que los óvulos restauran la diploidía y producen hembras.

La producción de hembras sin intervención de machos se denomina partenogénesis, y se produce, por ejemplo, en los pulgones. Este sistema tiene la ventaja de producir muchos descendientes de forma rápida, pero impide que se genere nueva diversidad genética. Por ello, al final de la temporada reproductora, los pulgones ponen huevos haploides que producen machos y se regresa a la reproducción sexual.

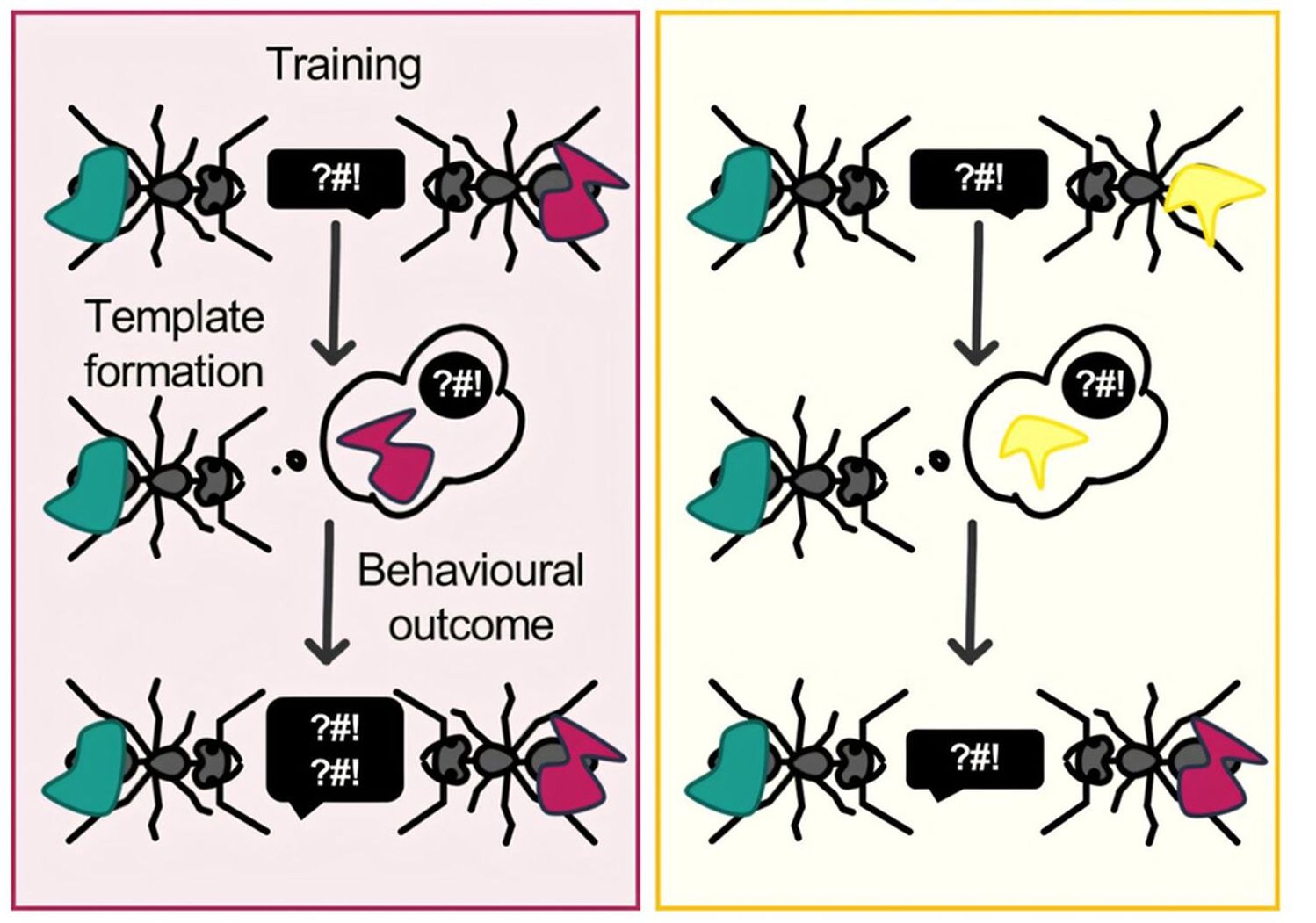

Figura 1. La hormiga saqueadora clónica Ooceraea biroi. Fuente: Erin Prado / © AntWeb.org / CC-BY-SA-3.0

Figura 1. La hormiga saqueadora clónica Ooceraea biroi. Fuente: Erin Prado / © AntWeb.org / CC-BY-SA-3.0De forma muy diferente, la hormiga saqueadora clónica, Ooceraea biroi, se reproduce asexualmente sin reinas ni machos, originando obreras genéticamente idénticas (clones), todas ellas con capacidad de producir huevos diploides. O. biroi es una pequeña hormiga ciega (<3 mm) que se está extendiendo por áreas tropicales y subtropicales de todo el planeta (Figura 1). Forma colonias nómadas y poco numerosas. A medida que se desplazan por un territorio, saquean los hormigueros de otras especies y devoran todo lo que encuentran.

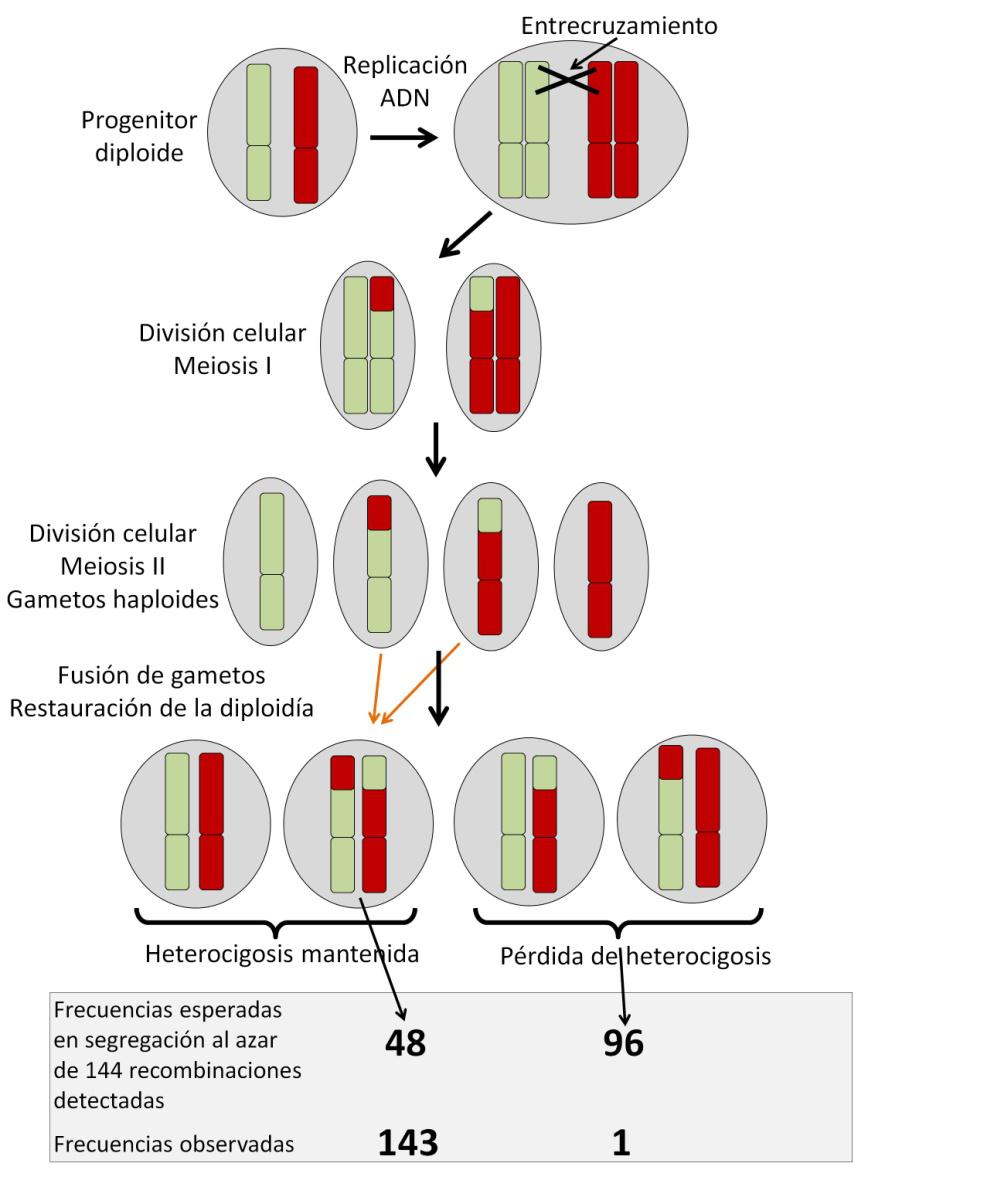

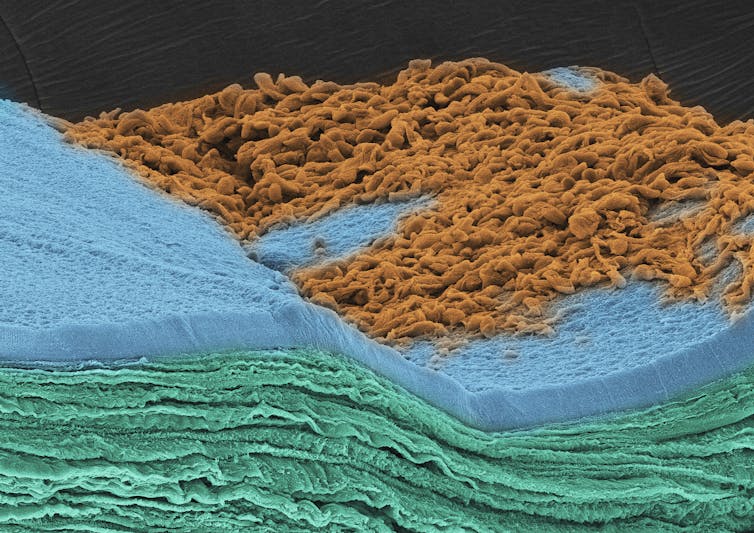

Para entender la partenogénesis de O. biroi debemos repasar el concepto de meiosis (Figura 2). Óvulos y espermatozoides son células haploides que derivan de progenitores diploides. La reducción en el número de cromosomas se produce por una replicación de los cromosomas seguida de dos ciclos de división celular (meiosis I y meiosis II). En la meiosis I puede producirse un entrecruzamiento o intercambio de fragmentos entre cromosomas homólogos. Esto es muy importante para generar diversidad genética, ya que se producen nuevas combinaciones de alelos, las distintas variantes que puede tener un gen determinado.

Figura 2. Esquema de la meiosis. Se ha representado un solo par de cromosomas. Tras la replicación del ADN se puede producir un entrecruzamiento entre las cadenas de ADN y la recombinación de una porción del cromosoma. De esta forma se generan nuevas combinaciones de alelos. En la segunda división meiótica las células resultantes son óvulos haploides. La reproducción asexual de O. biroi se produce por la fusión de dos óvulos, restaurando la doble dotación cromosómica. Lo excepcional del proceso es que los cromosomas que han recombinado tienen una mayor probabilidad de coheredarse tras la fusión (flechas naranjas). De 144 recombinaciones detectadas por el grupo de Kronauer, 143 mantenían la heterocigosidad, frente a las 48 esperadas si la segregación se produce al azar (33%).

Figura 2. Esquema de la meiosis. Se ha representado un solo par de cromosomas. Tras la replicación del ADN se puede producir un entrecruzamiento entre las cadenas de ADN y la recombinación de una porción del cromosoma. De esta forma se generan nuevas combinaciones de alelos. En la segunda división meiótica las células resultantes son óvulos haploides. La reproducción asexual de O. biroi se produce por la fusión de dos óvulos, restaurando la doble dotación cromosómica. Lo excepcional del proceso es que los cromosomas que han recombinado tienen una mayor probabilidad de coheredarse tras la fusión (flechas naranjas). De 144 recombinaciones detectadas por el grupo de Kronauer, 143 mantenían la heterocigosidad, frente a las 48 esperadas si la segregación se produce al azar (33%).Volviendo a la hormiga saqueadora clónica, las cuatro células haploides derivadas de la meiosis se alinean y las dos centrales se fusionan, restituyendo la dotación diploide y generando el huevo que dará lugar al nuevo individuo. Esto debería suponer un serio problema, ya que a lo largo de las generaciones, se perderían alelos disminuyendo la diversidad genética, un fenómeno denominado pérdida de heterocigosidad1. Un reciente estudio publicado por el grupo de Daniel Kronauer en la Universidad Rockefeller de Nueva York ha mostrado que O. biroi raramente pierde heterocigosidad en su reproducción, manteniendo la diversidad de sus alelos. ¿Cómo es posible? Porque los cromosomas violan las leyes de Mendel y no se segregan aleatoriamente en la meiosis II (explicación en la Figura 2). Los cromosomas que se han recombinado se heredan conjuntamente mediante un mecanismo todavía desconocido. De esta forma, la hormiga clónica no necesita la reproducción sexual para “refrescar” la diversidad genética, como sucede en los pulgones.

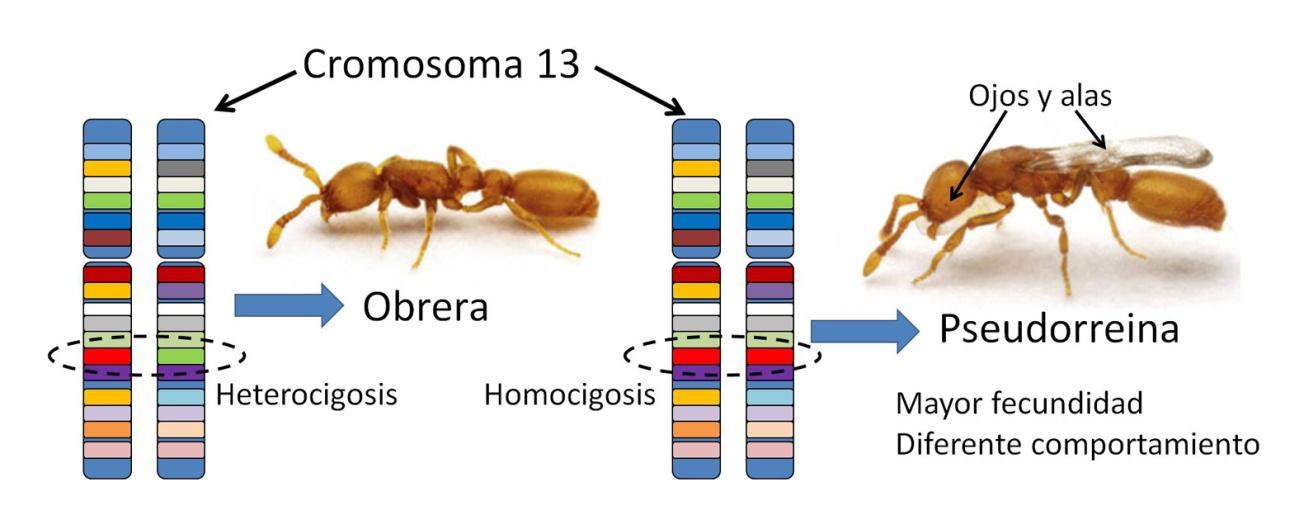

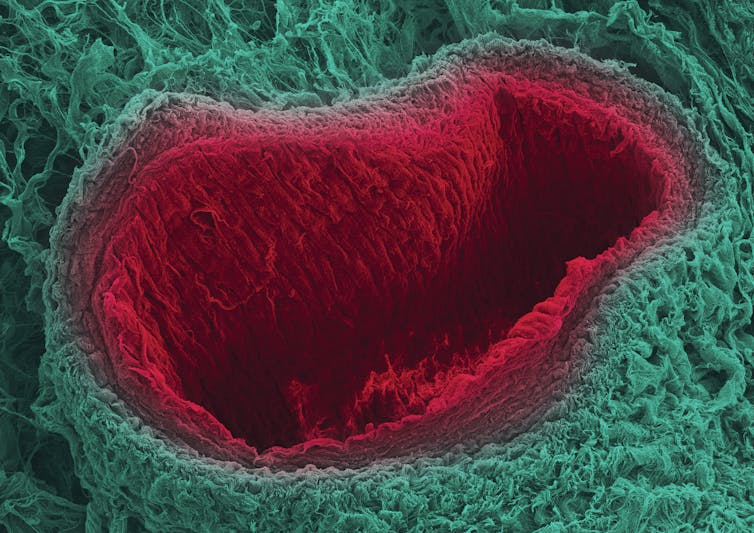

No es esta la única sorpresa que ha deparado O. biroi. Cuando Daniel Kronauer estudiaba sus poblaciones durante su postdoctorado en Okinawa, observó que aparecían espontáneamente en las colonias hormigas con alas y ojos rudimentarios, parecidas a las hormigas reina de otras especies (Figura 3). Estas “pseudorreinas” (queen-like) volvieron a aparecer en el laboratorio de Kronauer años después. No solo su morfología recordaba a las hormigas reina, también lo hacía su comportamiento (no busca alimento, dependiendo de los cuidados de las obreras) y su fecundidad, que duplicaba a la de sus hermanas.

Figura 3. De forma espontánea aparecen en las colonias de O. biroi individuos semejantes en morfología y comportamiento a las hormigas reina de otras especies. Esto se debe a una pérdida de heterocigosidad en una región específica del cromosoma 13 (véase nota 2). Fuente: W. Trible et al. (2023). CC BY-SA 4.0

Figura 3. De forma espontánea aparecen en las colonias de O. biroi individuos semejantes en morfología y comportamiento a las hormigas reina de otras especies. Esto se debe a una pérdida de heterocigosidad en una región específica del cromosoma 13 (véase nota 2). Fuente: W. Trible et al. (2023). CC BY-SA 4.0El estudio del genoma de las pseudorreinas reveló algo sorprendente. Un conjunto de genes2 mostraba alelos diferentes en una región del cromosoma 13 de las obreras normales (heterocigosis), pero aparecían idénticos en las pseudorreinas (homocigosis) (Figura 3). Dicho de otra forma, la homocigosis de este conjunto de genes daba lugar a un fenotipo muy similar al de ciertas especies de hormigas que practican el llamado “parasitismo social”.

Esta estrategia consiste en que hormigas de una especie determinada que carece de obreras se hacen pasar por reinas de otras especies, obligando a sus obreras a protegerlas, alimentarlas y cuidar a sus crías. Durante mucho tiempo se especuló sobre qué tipo de procesos evolutivos podrían conducir a este comportamiento. Según los nuevos resultados, un evento genético simple, la homocigosis del conjunto de genes situados en el cromosoma 13, estaría en el origen de la evolución de esta estrategia. Se trataría de un cambio radical de comportamiento y morfología en una sola generación debido a una modificación genética puntual.

La hormiga clónica se está convirtiendo en un extraordinario modelo para el estudio de insectos sociales, por su facilidad de reproducción en laboratorio y su homogeneidad genética. De hecho, el grupo de Kronauer ha conseguido establecer en este modelo la primera línea transgénica en un insecto social. Este minúsculo insecto nos deparará muchas sorpresas en un futuro cercano.

Referencias

Lacy, K.D., Hart, T. & Kronauer, D.J.C. (2024) Co-inheritance of recombined chromatids maintains heterozygosity in a parthenogenetic ant. Nat Ecol Evol. doi: 10.1038/s41559-024-02455-z

Trible, W., Chandra, V., Lacy, K.D. et al. (2023) A caste differentiation mutant elucidates the evolution of socially parasitic ants. Curr Biol. doi:10.1016/j.cub.2023.01.067

Sobre el autor: Ramón Muñoz-Chápuli Oriol es Catedrático de Biología Animal (jubilado) de la Universidad de Málaga

Notas:

1 La heterocigosis se produce cuando se poseen dos versiones (alelos) de un mismo gen, heredadas de la madre y del padre. Si los dos alelos son iguales hablamos de homocigosis.

2 Se trata de una región de 2.25 millones de pares de bases que probablemente constituye un “supergén” relacionado con comportamientos sociales. Un supergén es un conjunto de genes que normalmente se heredan en bloque ya que sufren mucha menos recombinación de lo habitual.

El artículo Ni machos, ni reinas. El extraordinario caso de la hormiga saqueadora clónica se ha escrito en Cuaderno de Cultura Científica.

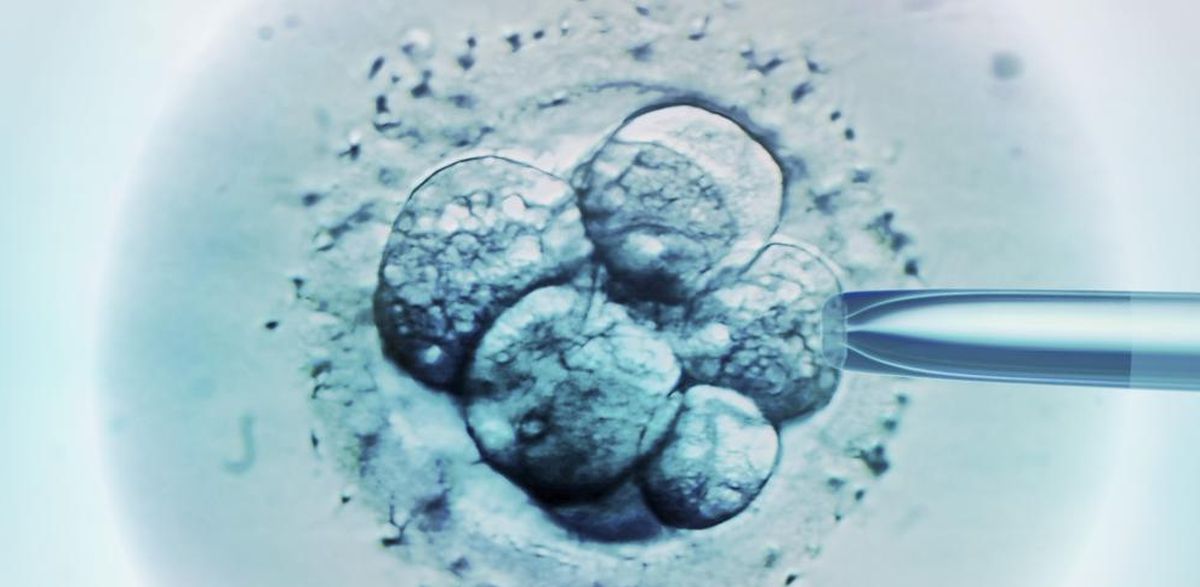

Edición genética hereditaria: lo que era imprudente en 2018 lo sigue siendo en 2025

Edición genética de embriones una imprudencia antes y ahora

Edición genética de embriones una imprudencia antes y ahora

«Hace tan solo unas semanas, dos pequeñas y preciosas niñas chinas, llamadas Lulu y Nana, llegaron al mundo llorando tan sanas como cualquier otro bebé. Las niñas están ya en casa, con su madre Grace y su padre Mark».

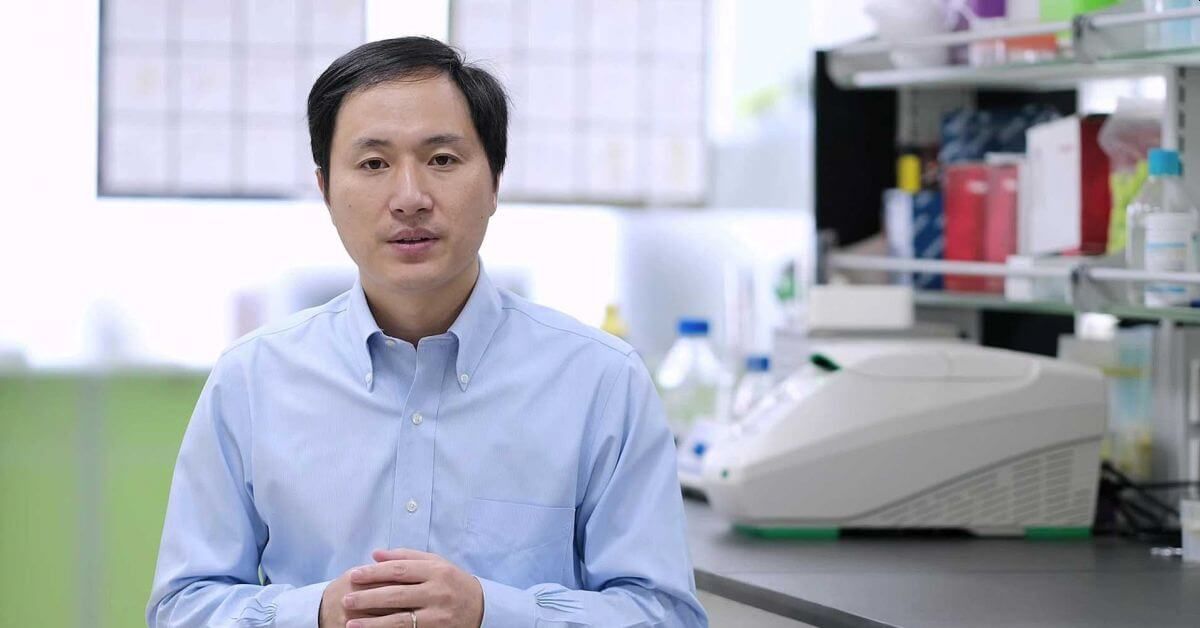

Así comenzaba el video del informático He Jiankui en el que anunciaba la primera edición genética en embriones humanos de la historia. Su intención era que los bebés no expresaran una proteína, codificada por el gen CCR5, que el virus de inmunodeficiencia humana (VIH) utiliza como receptor para infectar las células. Era noviembre de 2018 y la comunidad científica se echó las manos a la cabeza ante uno de los experimentos más imprudentes que se han realizado jamás. El trabajo se llevó en secreto, sin relación alguna con la Universidad en la que desde hace meses ya no trabajaba y se comunicaba a través de un simple anuncio en Youtube. No había sido revisado por pares, no se había publicado en ninguna revista científica y, por supuesto, no había pasado ningún control bioético durante ninguna fase del proceso.

«Ni siquiera era médico, ni genetista, ni biomédico, ni nada parecido, era un informático especializado en física», explica Lluis Montoliu, divulgador, biólogo e investigador del CSIC en el Centro Nacional de Biotecnología. «He Jiankui estaba convencido de que iba a aportar un gran avance a la humanidad y con este mesianismo realizó una serie de fechorías. Manipuló los permisos del comité de ética del hospital, reunió a varias parejas, en las que el padre estaba infectado con el VIH, y las convenció de que la única manera para tener hijos libres del virus era mediante el protocolo que él les proponía, ocultándoles que ya existe un procedimiento establecido desde hace muchos años por el que se consiguen espermatozoides sin el virus que se usan luego en fecundación in vitro. En definitiva, les engañó, les ocultó la realidad científica y les empujó a un procedimiento completamente experimental de manera imprudente e improcedente».

Con el paso de las semanas se descubrieron irregularidades aún más graves en el trabajo de He Jiankui. «Hoy sabemos que hizo una biopsia de cada embrión, un análisis genómico en el que constató que el experimento le había salido mal, no solo era consciente de que el gen que quería inactivar seguía activo sino que además había inactivado genes que no tendría que haber tocado», cuenta Montoliu. «En ese momento Jiankui debería haber parado el experimento pero le pudo más el protagonismo de convertirse en una leyenda, y tal vez ganar un Premio Nobel, que embaucó a los ginecólogos del hospital dándoles a entender que se trataba de un procedimiento de fecundación in vitro normal».

Los desmanes de He Jiankui no acaban aquí. Además de las gemelas Lulu y Nana, hubo otra pareja engañada que dio a luz un tercer bebé modificado genéticamente, una niña llamada Aurea. La reacción gubernamental llegó a continuación y las autoridades chinas lo detuvieron, lo juzgaron y fue condenado a una multa de tres millones de yuanes y tres años de cárcel. Curiosamente esta condena no fue por realizar el experimento ya que, en aquel momento, China no contaba con una regulación en contra (ahora sí la tiene) sino por haber falsificado la revisión ética de su trabajo para atraer así a las parejas voluntarias, por haberse saltado el requisito del consentimiento informado y por usurpar profesionalmente una carrera que no tenía, ya que se presentaba ante esas parejas como médico.

Desde entonces no sabemos absolutamente nada de esos tres bebés. Ahora deberían tener siete años pero es como si hubieran desaparecido. «Yo he preguntado a varios colegas chinos en algunos congresos y ninguno tiene noticias. Lo más probable es que estas niñas tendrán que ser supervisadas médicamente el resto de su vida porque el hecho de que tengan alteraciones genéticas descontroladas pueden suponer un fallo orgánico o sistémico en cualquier momento, por lo tanto se les trasladó un riesgo muy alto y totalmente innecesario», asegura Montoliu.

A los pocos meses, la propia Organización Mundial de la Salud (OMS) anunció la creación de un registro global para rastrear las investigaciones en edición genética humana, enfatizando que «los países no deben permitir ningún trabajo adicional sobre la edición del genoma de la línea germinal humana hasta que se hayan considerado adecuadamente las implicaciones técnicas y éticas» y adelantó la creación de instrumentos de gobernanza eficaces para disuadir y prevenir usos irresponsables e inaceptables de embriones editados genéticamente para iniciar embarazos humanos.

He Jiankui durante su polémica presentación en Youtube

He Jiankui durante su polémica presentación en Youtube

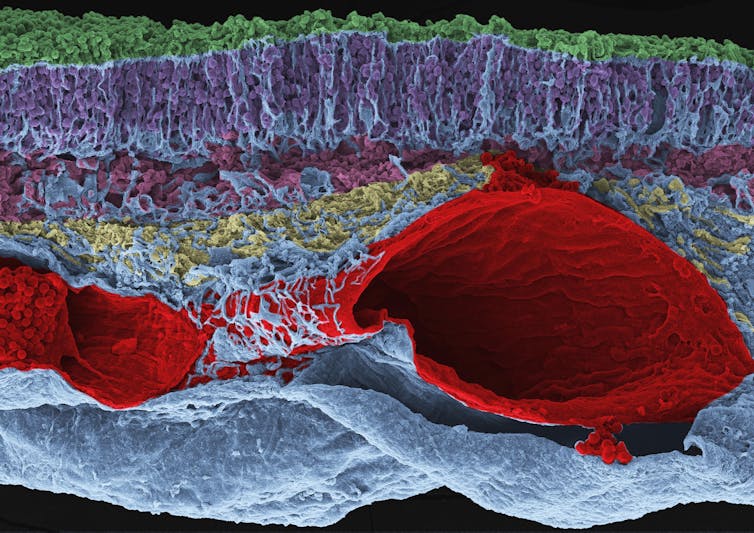

Así llegamos hasta nuestros días en enero de 2025, un año que ha comenzado con un artículo escandaloso publicado por la propia Nature. El autor principal es el australiano Julian Savulescu, filósofo y bioeticista de la Universidad de Oxford, donde no solo presenta la posibilidad de editar un solo gen (como hizo He Jiankui) sino que abre la puerta a la edición de muchos genes a la vez para conseguir las variantes más adecuadas que eviten la enfermedad, que ofrezcan más salud o más longevidad. Sus conclusiones las extrae de un desarrollo matemático con el que está convencido de que «la edición poligénica hereditaria para proteger a las generaciones futuras de enfermedades, sin requerir intervenciones adicionales para cada generación, puede verse como una ventaja que la convierte en una opción más deseable que la edición somática».

A grandes rasgos, la edición genética se divide en dos grandes clases: la edición genética somática, también conocida como edición terapéutica, que tan solo implica cambios realizados en una persona que no son hereditarios y no van a ser transmitidos a la descendencia, y la edición genética hereditaria, de línea germinal o de embriones, que supone modificar el genoma heredable y que se transmitirá a generaciones futuras. De esta manera, el artículo de Savulescu especula directamente con la posibilidad de editar el genoma en embriones humanos, no solo en una posición, sino en múltiples localizaciones, escogiendo para cada gen determinadas variantes genéticas asociadas a características aparentemente beneficiosas, protectoras frente a enfermedades, con el objeto de mejorar los seres humanos, no para curarlos.

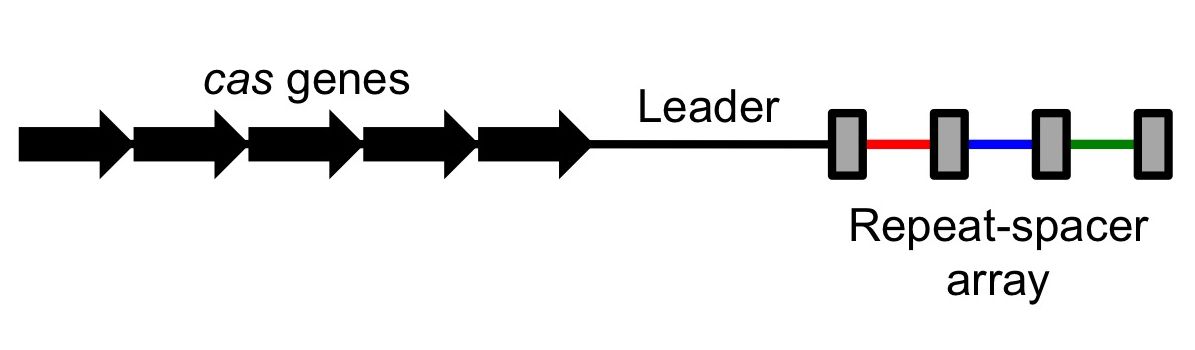

«Esto es, simple y llanamente, eugenesia», afirma Montoliu. «Es un ejercicio teórico matemático que falla por todos lados y da a entender que la edición genómica con las herramientas CRISPR es mucho más segura, certera y reproducible de lo que sabemos hoy en día que es, y de lo que probablemente va a ser durante mucho tiempo, para este tipo de modificaciones que requieren precisión y reproducibilidad. La mayoría de las estrategias terapéuticas actuales que usan las herramientas CRISPR no intentan corregir ni modificar genes, sino inactivarlos, destruirlos, algo muy diferente para lo que no se requiere tanta precisión».

Junto al artículo publicado por Savulescu, la revista Nature ofrece también un artículo crítico firmado por Kevin Mitchel, genetista del Trinity College de Dublin. En esta respuesta, Mitchel desmonta las especulaciones matemáticas de Savulescu y afirma que la edición en línea germinal es insegura, no tiene evidencias científicas y que implica un riesgo considerable y beneficios inciertos. De igual modo, la asociación científica ARRIGE (Asociación para la Investigación Responsable e Innovación en Edición Genética), desde la que se promueve un uso responsable de las técnicas de edición genética, también ha publicado un comunicado rechazando, por irresponsable e innecesaria, esta propuesta de edición genética múltiple del genoma humano.

Diagrama simplificado de un locus CRISPR

Diagrama simplificado de un locus CRISPR

Hace aproximadamente once años, a principios de 2014, escribí un artículo en este mismo Cuaderno de Cultura Científica de la UPV/EHU, titulado «La inminente revolución de la ingeniería genética basada en el sistema CRISPR/cas» y, me di cuenta de que su avance sería imparable. Rápidamente empezaron a aparecer las primeras aplicaciones con las evidentes preocupaciones éticas asociadas. Las terapias de edición genética para curar enfermedades de base genética ya están al orden del día y se administran en todos los países, también aquí en España, pero otra cosa muy distinta son estos experimentos que, bajo la influencia de dudosas filosofías transhumanistas, utilizan tecnologías CRISPR con la intención de mejorar a un ser humano con genes que podría transmitir a su descendencia.

«Hace algo más de diez años, en la primera cumbre internacional sobre el tema hubo una serie de intervenciones que dejaban claro que el uso de las herramientas CRISPR para editar genes mutados en embriones, con la intención de que ese embrión nazca con una determinada enfermedad, no son necesarias», recuerda Montoliu. «Con la excepción de unos pocos casos, extremadamente raros y poco habituales, donde el padre y la madre sean portadores de mutaciones de tal manera que su descendencia posea el cien por cien de posibilidades de heredarlas, la inmensa mayoría de supuestos se solucionan con tecnologías ya disponibles. Contamos con diagnósticos genéticos preimplantacionales que nos permiten distinguir cuál es el embrión que lleva la mutación y cuál es el que no la lleva y seleccionar ese embrión para que se geste solamente el que no lleva la mutación».

En 2023 se aprobó en Reino Unido la primera terapia basada en CRISPR, un tratamiento denominado Casgevy que se aplica a personas mayores de 12 años afectadas por anemia falciforme con crisis recurrentes de oclusión vascular o por beta-talasemia dependiente de transfusiones, para las que no existan donantes de médula ósea compatibles. Esto es el futuro pero es muy diferente a lo que propone Sabulescu desde Nature. Las terapias CRISPR deben centrarse en «tratar a personas adultas y enfermas con terapias génicas somáticas», concluye Montoliu, «no para aquellos que quieran vivir cien años o que pretendan bonitos ojos azules para sus hijos».

Referencias y más información:

Julian Savulescu et al. (2025) Heritable Polygenic Editing: The next Frontier in Genomic Medicine? Nature (2025) DOI: 10.1038/s41586-024-08300-4.

Kevin Mitchel et al. (2025) Human Embryo Editing against Disease Is Unsafe and Unproven — despite Rosy Predictions Nature (2025) DOI: 10.1038/d41586-024-04105-7.

Comunicado de la Asociación para la Investigación Responsable e Innovación en Edición Genética (ARRIGE): ARRIGE statement on heritable polygenic editing

Agradecimientos a Lluis Montoliu, biólogo e investigador del CSIC en el Centro Nacional de Biotecnología.

Sobre el autor: Javier «Irreductible» Peláez (Puertollano, 1974) es escritor y comunicador científico. Autor de 500 años de frío. La gran aventura del Ártico (Crítica, 2019) y Planeta Océano (Crítica 2022). Es uno de los fundadores de la plataforma Naukas.com, editor de ciencia en Yahoo España y Latinoamérica. Es guionista científico en los programas de televisión «El Cazador de Cerebros» y «Órbita Laika» de RTVE. Durante más de una década ha escrito en diferentes medios de comunicación (El País, El Español, National Geographic, Voz Populi). Es autor de los podcasts Catástrofe Ultravioleta y La Aldea Irreductible, y ha colaborado en diferentes proyectos radiofónicos y televisivos (Radio Nacional de España, Radio Televisión Canaria). Es ganador de tres premios Bitácoras, un premio Prisma a la mejor web de divulgación científica y un Premio Ondas al mejor programa de radio digital.

El artículo Edición genética hereditaria: lo que era imprudente en 2018 lo sigue siendo en 2025 se ha escrito en Cuaderno de Cultura Científica.

Naukas Bilbao 2024: El sexo obliga a cocinar

La decimocuarta edición del mayor evento de divulgación científica volvió al Palacio Euskalduna de Bilbao durante los días 19, 20, 21 y 22 de septiembre de 2024.

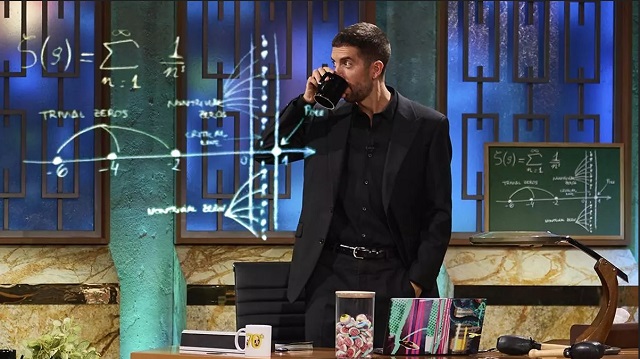

Esa fuerza de la naturaleza que es Juan Antonio Cuesta, Catedrático de estadística (jubilado «desde el 7 de octubre de 2024 por la mañana») de la Universidad de Cantabria, explica por qué el que las personas mientan a la hora de responder encuestas implica que es necesario «cocinarlas».

Si no ve correctamente el vídeo, use este enlace.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Naukas Bilbao 2024: El sexo obliga a cocinar se ha escrito en Cuaderno de Cultura Científica.

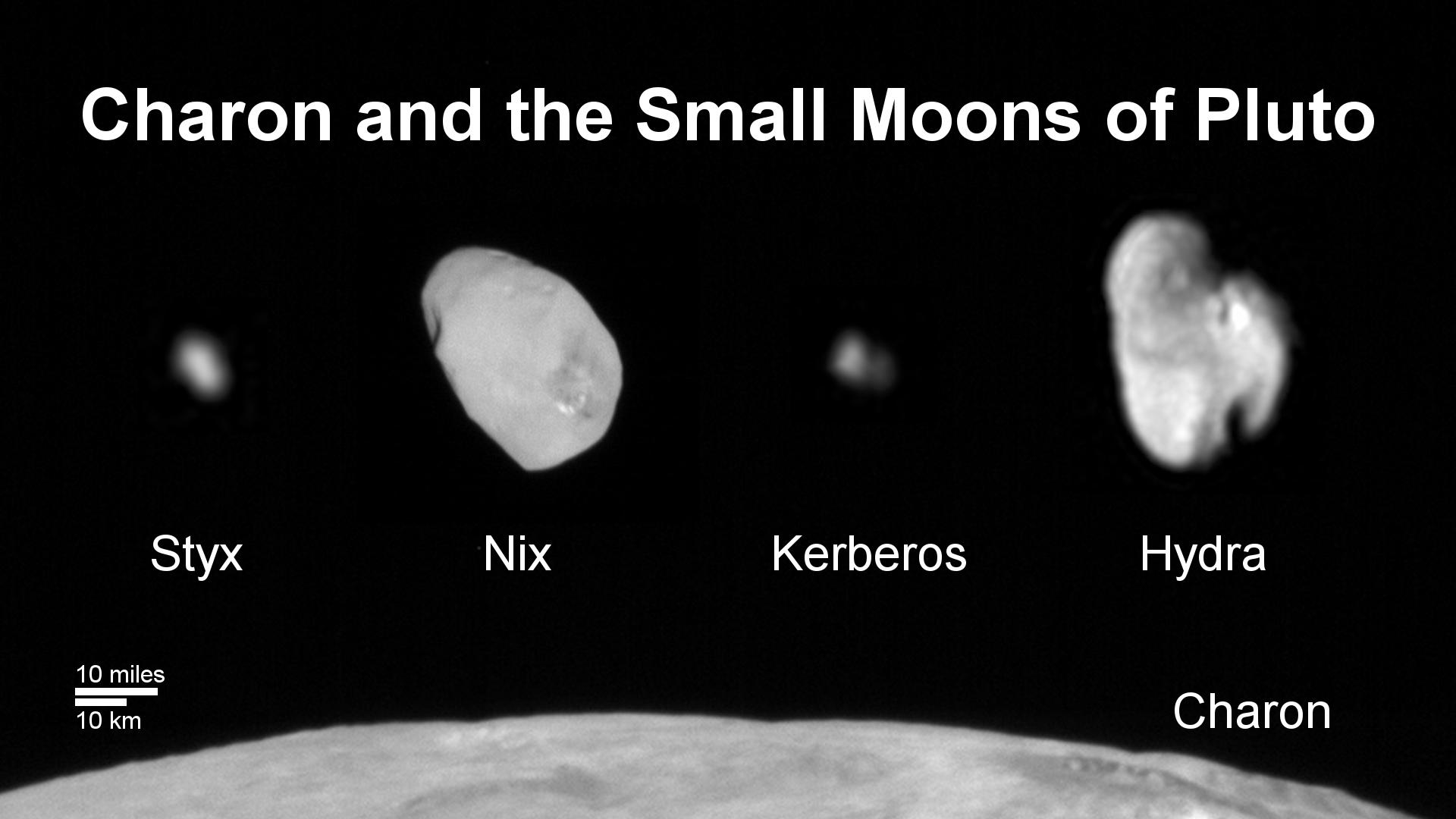

Identificadas estrellas individuales en el universo distante

Un equipo internacional de astrónomos/as entre los que se encuentra el investigador Ikerbasque Tom Broadhurst, que desarrolla su trabajo en la Universidadd el País Vasco (UPV/EHU) y DIPC- Donostia International Physics Center- fotografió más de 40 estrellas individuales en una galaxia tan lejana que su luz ha tardado la mitad de la edad del universo en llegar hasta nosotros.

Arco del Dragón en Abell 370. Fuente: Hubble / NASA

Arco del Dragón en Abell 370. Fuente: Hubble / NASAUtilizando el Telescopio Espacial James Webb (JWST) de la NASA, observaron una galaxia a casi 6.500 millones de años luz de la Tierra, momento en que el universo tenía la mitad de su edad actual. En esta galaxia distante, el equipo identificó 44 estrellas individuales, visibles gracias al uso de lentes gravitacionales y a la alta sensibilidad del JWST. Este descubrimiento marca un logro sin precedentes: el mayor número de estrellas individuales detectadas en el universo distante. Además, abre una vía para investigar uno de los mayores misterios del universo: la materia oscura.

El equipo de astrofísicos localizó estas estrellas mientras inspeccionaban imágenes del JWST de una galaxia conocida como el Arco del Dragón, ubicada en la línea de visión desde la Tierra detrás de un cúmulo masivo de galaxias llamado Abell 370. Debido a la gravitación (por la inmensa masa de este cúmulo) se produce el llamado efecto de lente gravitacional, deformando la luz que nos llega de lo que esté detrás (el arco de dragón) y haciéndonos ver ese pasillo de proporciones cósmicas en lugar de la característica espiral. Que es lo que se vería sin ese efecto.

El equipo analizó los colores de cada una de las estrellas dentro del Arco del Dragón y descubrió que muchas son supergigantes rojas, similares a Betelgeuse en la constelación de Orión, que se encuentra en las etapas finales de su vida. Esto contrasta con descubrimientos anteriores, que identificaron predominantemente supergigantes azules, como Rigel y Deneb, que se encuentran entre las estrellas más brillantes del cielo nocturno. Según los investigadores, esta diferencia en los tipos estelares también destaca el poder único de las observaciones del JWST en longitudes de onda infrarrojas.

La mayoría de las galaxias, incluida la Vía Láctea, contienen decenas de miles de millones de estrellas. En galaxias cercanas como Andrómeda, las científicas y científicos pueden observar las estrellas una por una. Sin embargo, en galaxias a miles de millones de años luz, las strellas aparecen combinadas, ya que su luz debe viajar miles de millones de años antes de llegar a nosotros, lo que representa un desafío constante para los y las científicas que estudian cómo se forman y evolucionan las galaxias. Las galaxias que están muy lejos suelen parecer una mancha difusa y borrosa, y aunque estuvieran formadas por muchísimas estrellas individuales, hasta la fecha no había sido posible identificarlas una a una por las limitaciones de los telescopios.

Se espera que futuras observaciones con el JWST capturen más estrellas magnificadas en la galaxia del Arco del Dragón. Estos esfuerzos podrían conducir a estudios detallados de cientos de estrellas en galaxias distantes. Además, estas observaciones de estrellas individuales podrían proporcionar información sobre la estructura de las lentes gravitacionales e incluso arrojar luz sobre la esquiva naturaleza de la materia oscura, ya que como concluyen en un reciente artículo el equipo de la UPV/EHU-DIPC, formado por el propio investigador Ikerbasque Tom Broadhurst, junto a George Smoot, galardonado con el Premio Nobel de Física y la estudiante de doctorado Paloma Morillo, las posiciones de las estrellas en el arco del dragón implican que la materia oscura es similar a ondas en lugar de partículas pesadas.

Referencia:

Fudamoto, Y., Sun, F., Diego, J.M. et al. (2025) Identification of more than 40 gravitationally magnified stars in a galaxy at redshift 0.725. Nat Astron doi: 10.1038/s41550-024-02432-3

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Identificadas estrellas individuales en el universo distante se ha escrito en Cuaderno de Cultura Científica.

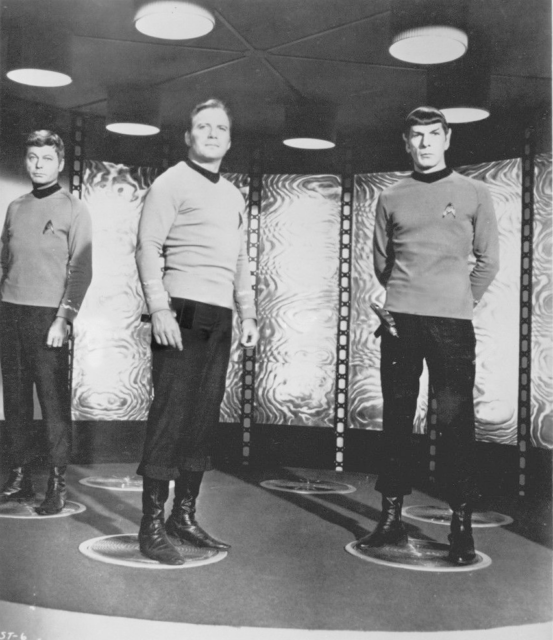

¡Ni se te ocurra teletransportarme, Scotty!

Es posible que solo exista una persona en el mundo que no haya soñado alguna vez con teletransportarse a… bueno, a cualquier sitio: Leonard McCoy —Bones, para los amigos—, director médico de la nave USS Enterprise. Y, si nos atenemos a las leyes de la física, puede que en ese sentido fuera el más cuerdo de toda la tripulación, porque, aunque es posible que el sistema de teletransporte de Star Trek sea el más coherente que podemos encontrar en la ciencia ficción desde el punto de vista científico —y tampoco es que lo sea mucho—, pasa por alto detalles que podrían hacer que el viaje no fuera tan placentero y seguro como parece.

El actor DeForest Kelly, como el doctor Leonard McCoy; William Shatner, como el capitán Kirk, y Leonard Nimoy, como Spock en la sala del transportador de la USS Enterprise (Star Trek, TOS, 1968). Fuente: NBC Television

El actor DeForest Kelly, como el doctor Leonard McCoy; William Shatner, como el capitán Kirk, y Leonard Nimoy, como Spock en la sala del transportador de la USS Enterprise (Star Trek, TOS, 1968). Fuente: NBC Television

Existen innumerables manuales técnicos —ficticios, claro— en los que podemos encontrar información sobre cómo funcionan todos los sistemas de la nave Enterprise. En el escrito en 1991 por Rick Sternbach y Michael Okuda —el que tengo más a mano, aunque es el manual de la Enterprise de Picard—, se describe el funcionamiento de los teletransportadores en cuatro etapas:

-

Programación de las coordenadas de destino y análisis del entorno. Algo bastante conveniente para que nadie acabe materializándose dentro de una roca o en un ecosistema mortal.

-

Escáner de los átomos, a nivel individual, del sujeto al que se va a teletransportar.

-

Almacenamiento en memoria y compensación del desplazamiento Doppler del haz de teletransporte debido al movimiento entre la nave y el lugar de destino.

-

Envío del haz.

Suena bastante sensato, ¿no? Y lo es en bastantes sentidos, sobre todo en algunos detalles. No solo tienen en cuenta el efecto Doppler, sino la distorsión del espacio-tiempo en condiciones de curvatura, lo que haría imposible el teletransporte; el peligro de chocar contra el escudo deflector de otra nave si los tiene activados, o mi favorita: la imposibilidad de, a diferencia del replicador de alimentos que funciona a nivel molecular, utilizar el teletransportador para clonar personas, algo que, efectivamente, prohíbe la mecánica cuántica.

Pero vayamos poco a poco y veamos a qué nos referimos cuando hablamos de teletransporte en el mundo real —o en el mundo cuántico, para ser más precisos— y cómo funciona.

Cada cierto tiempo, de forma recurrente, aparece en los medios alguna noticia relacionada con este tema. Suelen ser ciertas: hemos logrado el teletransporte cuántico de partículas muchísimas veces. Ahora bien, de ahí a que podamos empezar a pensar en irnos de vacaciones al otro extremo del mundo utilizando este sistema hay un trecho.

En física cuántica, eso a lo que llamamos teletransporte es posible gracias a una de las propiedades más espeluznantes —según diría Albert Einstein— de las partículas: el entrelazamiento. Que dos partículas se encuentren entrelazadas solo significa que comparten la misma función de onda, por lo que, si actuamos sobre una, estamos actuado irremediablemente sobre la otra. Desarrollemos un poco esto: podríamos tener dos partículas diferentes, cada una con su propia función de onda, y sumarlas sin mayor problema; en ese caso, podríamos volver a separar cada componente si quisiéramos. En cambio, en el entrelazamiento no hay dos funciones de onda individuales, sino que el sistema de dos, tres, cuatro… o las partículas que sean está descrito por la misma ecuación, y es imposible hacer nada sobre ninguna de ellas sin que afecte al resto. Lo espeluznante, en realidad,no es que se puedan relacionar partículas de esta manera, sino que cualquier acción que se ejerza sobre una parte del sistema, se va a reflejar en el resto de componentes de manera inmediata, con independencia de si están en la misma habitación, en la Luna o en la galaxia de Andrómeda, algo que parece que desafía el límite de la velocidad de la luz. En realidad no es así, como veremos más adelante, ya que lo que podemos o no hacer con el entrelazamiento tiene sus limitaciones y enviar información es una de ellas.

Dos partículas entrelazadas comparten la misma función de onda. Esto quiere decir que cualquier operación que efectuemos sobre uno de ellos, le afectará al otro. Fuente: Mark Garlick / Science Photo Library

Dos partículas entrelazadas comparten la misma función de onda. Esto quiere decir que cualquier operación que efectuemos sobre uno de ellos, le afectará al otro. Fuente: Mark Garlick / Science Photo Library

Perfecto, pero ¿cómo podemos usar esta propiedad para teletransportar cosas? Lo cierto es que hay que hacer algunos trucos. Tengamos en cuenta que, cuando hablamos de teletransporte cuántico lo que enviamos no son partículas materiales, sino estados, esto es, la información que describe la partícula y gracias a la cual podemos replicarla al otro lado.

Dejemos que Scotty y, por ejemplo, Spock, le amarguen un poquito la existencia a McCoy y hagan un pequeño experimento con él. Van a intentar teletransportarlo a la superficie del planeta al que acaban de llegar, pero utilizando las propiedades de la física cuántica en lugar del sistema habitual. Para ello, antes de nada, habrá que hacer algunos preparativos.

En primer lugar, haría falta un sistema auxiliar que ayudara con todo el proceso, así que Spock construye un par de tricorders que van a estar entrelazados. Se encontrarán metidos cada uno en una caja, en estado de superposición encendido/apagado, de tal manera que, si en un momento dado alguien abre una de las cajas, observa uno de ellos y ve que está encendido, sabrá que el de la otra caja está apagado. Spock le da un de los tricorders a McCoy y el otro se lo lleva él en una lanzadera a la superficie del planeta.

Centrémonos ahora en McCoy y su tricorder, y vamos a entrelazarlos entre sí también. Para que los estados no colapsen, Scotty encerrará a Bones con su dispositivo en la sala del teletransportador, cerrará la puerta y lo dejará ahí aislado, de tal manera que tendremos un estado de superposición conjunto: McCoy, desde ese momento, podría estar vivo o muerto —independientemente de que también esté muy enfadado— y su tricorder podría estar encendido o apagado. Así que habría cuatro estados posibles: McCoy vivo-tricorder encendido, McCoy muerto-tricorder apagado, McCoy vivo-tricorder apagado, McCoy muerto-tricorder encendido, que se denominan estados de Bell.

Ahora bien, como hemos dicho que el tricorder de McCoy está entrelazado, a su vez, con el que se llevó Spock a la superficie del planeta, sabemos que cualquier cosa que le pase a McCoy en la Enterprise influirá en el estado del tricorder de Spock.

Scotty empieza con el proceso de teletransporte, así que, a partir de este momento, debe tener mucho cuidado si no quiere cargarse a McCoy. Necesita enviarle a Spock información sobre lo que está pasando dentro de la sala del teletransportador, pero sin abrir la puerta ni obtener información directa de McCoy o su tricorder, porque, al ser un sistema cuántico, podría hacer que colapsara en un estado no deseado. Una estrategia que podría seguir sería hacer mediciones indirectas, utilizando los sensores de la Enterprise para averiguar si, en determinado momento, los dos se encuentran en estados similares como vivo/encendido o muerto/apagado, o si uno está «funcionando» y el otro no, sin especificar cuál es cuál… Este proceso se llama medida de Bell, y es una forma de obtener información de un sistema de dos partículas entrelazadas. En la práctica, los estados que le interesan a Scotty son aquellos en los que McCoy está vivo, y que, recordemos, debido al entrelazamiento guardarán relación también con el estado del tricorder de Spock. Solo hay un pequeño problema… aunque Scotty consiga acceder a uno de los estados en los que Bones está bien, cuando haga la medida de Bell, se lo tendrá que cargar igualmente.

Pero mantengamos la calma. Aunque McCoy desaparezca, para entonces su información habrá quedado codificada en los tricorders entrelazados, y Spock, con las instrucciones necesarias, que Scotty tendrá que enviarle por canales convencionales, podrá recuperarla y recrear a su compañero sano y salvo sobre la superficie del planeta en el que está.

Aquí la cosa se pone demasiado bizarra, porque, en esta analogía, lo que sucedería es que, cuando Spock abriera su caja para ver el estado de su tricorder, se encontraría a McCoy dentro, lo que es bastante antiintuitivo. Así que, llegados a este punto… llamemos a McCoy fotón C, al tricorder que se queda con él, fotón A, y al tricorder que tiene Spock, fotón B. Ahora el proceso de teletransporte en este universo paralelo de Star Trek quedaría así:

-

Spock entrelaza los fotones A y B.

-

Se lleva el fotón B consigo al planeta.

-

Scotty quiere enviarle a Spock un fotón C que tiene en la Enterprise, así que lo entrelaza con el A, que se ha quedado él.

-

Scotty hace una medida de Bell sobre el sistema C + A, destruyendo C en el proceso, pero haciendo que la información quede codificada en el sistema A + B.

-

Le envía la información de su medida a Spock por medios convencionales.

-

Spock recrea en su fotón B el estado de C.

Ahora todo parece algo más complicado que lo que vemos en televisión, ¿no? Por no mencionar que no podemos teletransportar nada a ningún lugar en el que no hayamos estado antes o, en su defecto, hayamos enviado una parte de nuestro sistema auxiliar entrelazado, que podría ser tremendamente complejo si estamos hablando de teletransportar a un ser vivo. Este tipo de teletransporte tampoco nos sirve para comunicarnos —de ahí que el límite de la velocidad de la luz no suponga un problema—, porque sin la información que Scotty le envía a Spock por canales sublumínicos, este no sabría qué tendría que hacer para recrear el estado del fotón que le quieren enviar.

Cuestión aparte es el destino que le esperaría al pobre McCoy o a cualquiera que se prestara como tribble de experimentos para probar este tipo de teletransporte: ¿seguro que el original que destruiríamos y la copia que recrearíamos serían la misma persona? Y sí, destruir el original es completamente necesario, porque, como comentamos más arriba, la física cuántica no permite hacer copias perfectas, solo puede existir una a la vez.

Aunque no soy tan tecnofóba como Bones, creo que, en este asunto, me voy a poner de su lado. En estos términos… ¡ni se te ocurra teletransportarme, Scotty! Dicho lo cual… larga vida y prosperidad a todos.

NBC Television

NBC Television

Bibliografía

Bennett, C. H., Brassard, G., Crépeau, C., Jozsa, R., Peres, A. y Wootters, W. K. (1993) Teleporting an unknown quantum state via dual classical and Einstein–Podolsky–Rosen channels Physical Review Letters doi: 10.1103/PhysRevLett.70.1895

Sternbach, R., Okuda, M. y Roddenberry, G. (1991). Star Trek. TNG. Technical manual. Pocket Books.

.

Sobre la autora: Gisela Baños es divulgadora de ciencia, tecnología y ciencia ficción.

El artículo ¡Ni se te ocurra teletransportarme, Scotty! se ha escrito en Cuaderno de Cultura Científica.

Los humanos, un Macguffin matemático

Siempre que escucho la palabra “Macguffin” mi mente se va hacia el gran cineasta británico Alfred Hitchcock (1899-1980), autor de grandes películas como La ventana indiscreta (1954), Vértigo (1958), Con la muerte en los talones (1959), Psicosis (1960) o Los pájaros (1963). Y más concretamente me remite al libro El cine según Hitchcock, que recoge la entrevista que le hizo el cineasta francés Francois Truffaut (1932-1984), un libro de cuya lectura he disfrutado en varias ocasiones.

Fotografía de la entrevista que hizo el cineasta francés Francois Truffaut al cineasta británico Alfred Hitchcock en 1962

Fotografía de la entrevista que hizo el cineasta francés Francois Truffaut al cineasta británico Alfred Hitchcock en 1962¿Qué es el Macguffin?

El Macguffin, término acuñado por el maestro del suspense Alfred Hitchcock, es un objeto, persona, situación o suceso necesario para impulsar la trama y la motivación de los personajes, pero insignificante, sin importancia o irrelevante en sí mismo. Como diría Truffaut “es el pretexto”.

Por ejemplo, en las películas de espías suele ser un secreto o unos documentos, que hacen que la trama se desarrolle, pero que realmente da igual cuál sea el secreto o el contenido de los documentos. Como afirmó el propio Hitchcock, “el Macguffin es lo que persiguen los espías, pero al público le da igual”. En la película Con la muerte en los talones, el protagonista, encarnado por el actor estadounidense Cary Grant (1904-1986), es un agente publicitario que es confundido con un agente del gobierno por unos espías e intentan asesinarlo, motivando la huida del publicista para salvar su vida. Mientras que en la película Psicosis el Macguffin es el robo de un dinero y la posterior huida de su protagonista femenina, interpretada por la actriz estadounidense Vera Miles (1929), que provoca que se esconda en un pequeño hotel regentado por el tímido Norman Bates, que interpretaba el actor estadounidense Anthony Perkins (1932-1992), y que era realmente la parte central de la película. Otro ejemplo interesante es la estatuilla de la película El halcón maltés (1941), interpretada por Humphrey Bogart, Mary Astor y Peter Lorre, y basada en la novela negra homónima del escritor estadounidense Dashiell Hammett (1894-1961), que es el objeto de deseo de una serie de personajes de dudosa moral.

Cartel de la película Con la muerte en los talones (1959), dirigida por Alfred Hitchcock e interpretada por Cary Grant, Eva Marie Saint, James Mason y Martin Landau

Cartel de la película Con la muerte en los talones (1959), dirigida por Alfred Hitchcock e interpretada por Cary Grant, Eva Marie Saint, James Mason y Martin LandauPara finalizar con los ejemplos, un Macguffin esclarecedor, más moderno y en otro tipo de película, como es The Blues Brothers (1980), donde los personajes encarnados por los actores estadounidenses John Belushi (1949-1982) y Dan Aykroyd (1952), intentan conseguir el dinero necesario para salvar el orfanato en el cual se criaron, lo cual no es más que la excusa para realizar un viaje con el objetivo de reunir a los miembros de un grupo musical y llenar ese viaje de humor y música, buena música de blues y soul.

En el libro El cine según Hitchcock, el maestro del suspense explicaba el origen del término de la siguiente forma.

Y ahora, conviene preguntarse de dónde viene el “MacGuffin”. Evoca un nombre escocés y es posible imaginarse una conversación entre dos hombres que viajan en un tren. Uno le dice al otro: “¿Qué es ese paquete que ha colocado en la red?” Y el otro contesta: “Oh, es un Mac Guffin”. Entonces el primero vuelve a preguntar: “¿Qué es un Mac Guffin?” Y el otro: “Pues un aparato para atrapar a los leones en las montañas Adirondaks”. El primero exclama entonces: “¡Pero si no hay leones en las Adirondaks!” A lo que contesta el segundo: “En ese caso no es un Mac Guffin”.

Esta anécdota demuestra el vacío del Mac Guffin … la nada del Mac Guffin.

Los humanos, de Matt HaigLa novela a la que vamos a dedicar esta entrada del Cuaderno de Cultura Científica, Los humanos (2013), del escritor británico Matt Haig (1975), contiene un Macguffin matemático. Pero vayamos por partes. Primero presentemos brevemente a su autor.

Matt Haig es un periodista y escritor inglés, que escribe tanto para adultos, como para jóvenes. Estudió Inglés e Historia en la Universidad de Hull. Entre sus libros nos encontramos novelas como Los humanos (2013), Cómo detener el tiempo (2017), La biblioteca de la medianoche (2020) o La vida imposible (2024), cuya protagonista es matemática; libros para jóvenes como Shadow Forest: el bosque de las sombras (2007), El chico que salvó la navidad (2015), La duendecilla sincera (2018) o Evie, la amiga de los animales (2019), y libros de no ficción como Razones para seguir viviendo (2015), Apuntes sobre un planeta estresado (2018) o El libro de la esperanza (2021).

Fotografía de Matt Haig en el Edinburgh International Book Festival de 2024

Fotografía de Matt Haig en el Edinburgh International Book Festival de 2024

Respecto a la novela Los humanos, lo primero es recomendar a las personas que estáis leyendo esta entrada que la leáis, no porque sea una novela relacionada con las matemáticas, sino porque es una novela interesante y muy divertida.

Pero para hablar de esta novela podemos empezar por la sinopsis escrita por la editorial:

El profesor Andrew Martin de la Universidad de Cambridge acaba de descubrir el secreto de los números primos, encontrando al mismo tiempo la clave que garantizará el fin de la enfermedad y la muerte. Convencidos de que los secretos de los números primos no pueden dejarse en manos de una especie tan primitiva como los humanos, los vonadorianos, una civilización extraterrestre mucho más evolucionada, envían a un emisario para hacer desaparecer a Martin y a su descubrimiento. Y así es como un vonadoriano con el aspecto externo de Martin aparece con la misión de matar a la esposa, al hijo y al mejor amigo del profesor, pero no puede dejar de sentirse fascinado por esa fea especie y sus costumbres incomprensibles.

Portada de la novela Los humanos, de Matt Haig (Roca Editorial, 2014)

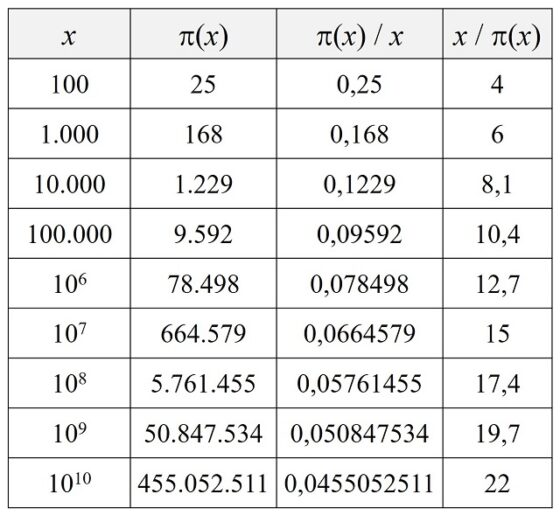

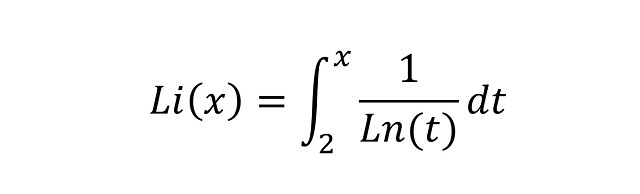

Portada de la novela Los humanos, de Matt Haig (Roca Editorial, 2014)El punto de partida de la novela es que el matemático y profesor de la Universidad de Cambridge (Gran Bretaña) Andrew Martin ha demostrado la llamada hipótesis de Riemann, uno de los problemas matemáticos abiertos, es decir, que está aún por resolverse, más importantes. De hecho, la hipótesis de Riemann es uno de los siete “problemas del milenio” que anunció el Instituto Clay de Matemáticas en el año 2000, con una recompensa de un millón de dólares para quien lo resolviese. Más aún, este problema ya estaba en la lista de los 23 problemas que recogió el matemático alemán David Hilbert (1862-1943) en el Congreso Internacional de Matemáticos de 1900, como problemas más importantes para el nuevo siglo xx.

Sin embargo, para una civilización extraterrestre, los vonadorianos, este es un conocimiento demasiado poderoso, que en manos de los humanos podría poner en peligro el equilibrio del universo y provocar su destrucción. Por este motivo, deciden reemplazar a Martin por un clon alienígena, que es realmente el protagonista de esta historia narrada por él mismo, y borrar toda evidencia de su descubrimiento, destruyendo los documentos relacionados con la demostración, los rastros digitales de la misma o las personas que hayan podido tener algún conocimiento de esta prueba, como la familia del matemático, su mujer y su hijo, y alguno de sus colegas.

Resulté ser un hombre casado de 43 años, la mitad exacta de una vida humana. Tenía un hijo. Era el profesor que acababa de resolver el enigma matemático más importante al que se habían enfrentado los humanos. Apenas tres horas antes había hecho progresar la especie humana más allá de lo que cualquiera habría podido imaginar.