La fe en las leyes de conservación

La energía “liberada” en una explosión nuclear es idéntica a la que tenía la bomba antes de explosionar.

La ley de conservación de la energía ha tenido un éxito enorme. Se cree tan firmemente que parece casi imposible que cualquier nuevo descubrimiento pueda refutarla. Sin embargo, en algunos experimentos, la energía parece aparecer o desaparecer en un sistema, sin que pueda ser explicado el fenómeno por cambios en formas conocidas de energía macroscópica. Por ejemplo, a medida que se añade calor a un cubo de hielo que está fundiéndose la temperatura del cubito de hielo no aumenta. En casos como este, históricamente los científicos han preferido asumir que el calor añadido toma la forma de una especie de energía aún no investigada, en lugar de considerar seriamente la posibilidad de que la energía no se conserva [1].

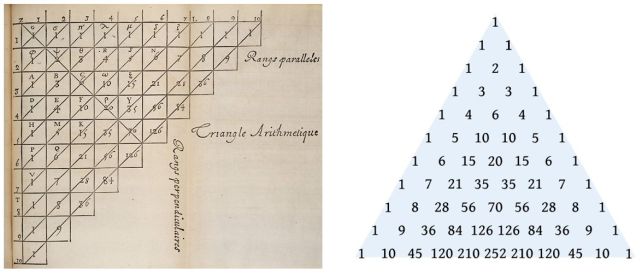

Así, el filósofo alemán Leibniz propuso en su momento que la energía podría ser disipada entre “las pequeñas partes” de los cuerpos. Avanzó esta idea específicamente para mantener el principio de conservación de energía en colisiones inelásticas y en procesos donde hay fricción. La fe de Leibniz en la conservación de la energía estaba justificada. Posteriormente se demostró que la “energía interna”, almacenada como movimiento de las partículas submicroscópicas en el material con el que se experimenta, cambió la cantidad exacta para explicar los cambios observados en la energía externa, como es el caso de un cubo de hielo que se funde.

Otro ejemplo similar es la “invención” del neutrino por Wolfgang Pauli en 1930. Los experimentos habían sugerido que la energía desaparecía en ciertas reacciones nucleares. Pauli propuso que en estas reacciones se producía una partícula subatómica desconocida e indetectable (con la tecnología disponible en aquel momento), que Enrico Fermi llamó el “neutrino”. Pauli propuso que el neutrino portaba parte de la energía. Los físicos aceptaron la teoría de los neutrinos durante más de 20 años, sin que se demostrase su existencia experimentalmente. Finalmente, en 1956, los neutrinos fueron detectados en experimentos con la radiación de un reactor nuclear. De nuevo, la fe en la ley de conservación de la energía resultó estar justificada.

La idea de “conservación” es tan poderosa en ciencia que los científicos creen que siempre estará justificada. Cualquier aparente excepción a la ley se entenderá tarde o temprano de una manera tal que no nos obligue a renunciar a la ley. A lo sumo, estas excepciones podrán conducirnos a descubrir nuevas formas de materia o energía, haciendo que la ley sea aún más general y poderosa [2].

El matemático y filósofo francés Henri Poincaré expresó esta idea en 1903 en su libro La Science et l’Hypothèse:

. . . el principio de conservación de la energía significa simplemente que hay algo que permanece constante. De hecho, sin importar las nuevas nociones que las experiencias futuras nos den del mundo, estamos seguros de antemano que habrá algo que permanecerá constante, y a lo que podremos llamar energía.

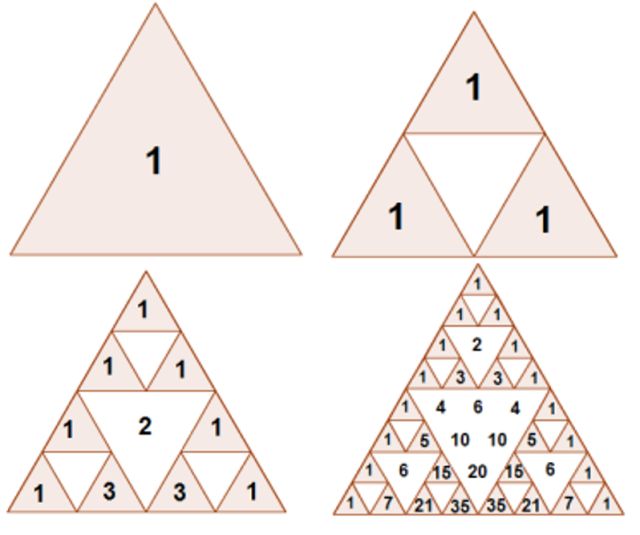

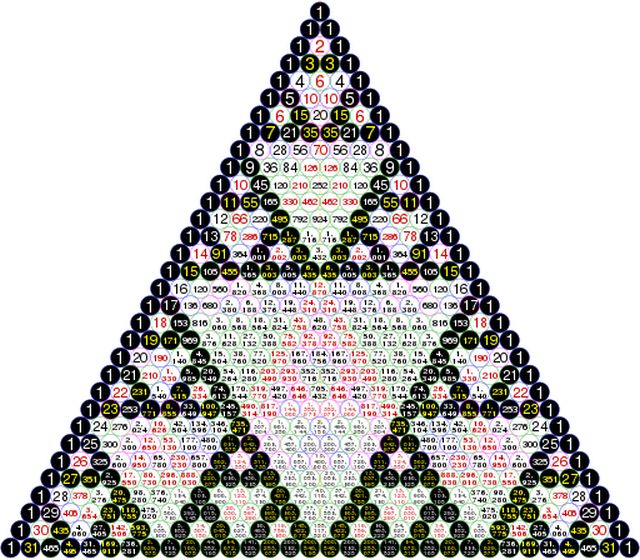

El descubrimiento de qué se conserva en la naturaleza constituye la colección [3] de logros más importante de las ciencias físicas. De hecho, estas leyes de conservación constituyen poderosísimas herramientas de análisis y todas afirman que, pase lo que pase en un sistema de cuerpos en interacción, ciertas propiedades medibles permanecerán constantes mientras el sistema permanezca aislado

Notas:

[1] A este respecto pude ser interesante leer El tribunal de la experiencia sobre el concepto de hipótesis auxiliar.

[2] La teoría de la relatividad y los estudios de las reacciones nucleares, como en el caso del neutrino, permitió generalizar la ley de conservación de la energía a la ley de conservación de la masa-energía, siendo masa y energía dos formas equivalentes según E = mc2, donde c es la velocidad de la luz en el vacío. Esto no es más que una generalización de la primera ley de la termodinámica.

[3] La colección se ha ampliado en las últimas décadas gracias a los avances en física de partículas. Esta es una lista parcial de las leyes de conservación conocidas. Hay otras candidatas pendientes de más datos.

Masa-Energía.

Momento lineal.

Momento angular.

Carga eléctrica.

Carga de color.

Isoespín débil.

Probabilidad.

Simetría CPT.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo La fe en las leyes de conservación se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Se intuye la conservación de la energía (1)

- De las leyes de conservación (I)

- De las leyes de conservación (y III)

Eguneroko zientzia

Rosalind Franklin: “Zientzia eta eguneroko bizitza ezin dira bereizi eta ez dute bereizita egon behar”.

—————————————————–

Egileez: Eduardo Herrera Fernandez, Leire Fernandez Inurritegi eta Maria Perez Mena UPV/EHUko Letraz – Diseinu Grafikoko eta Tipografiako Ikerketa Taldeko ikertzaileak dira.

—————————————————–

Aipua eta irudia UPV/EHUko Zientzia Astea: Alfabetatze zientifikoa Alfabetización científica liburutik jaso dugu. Eskerrak eman nahi dizkiegu egileei eta UPV/EHUko Zientzia Astearen arduradunei, edukia blogean argitaratzeko baimena emateagatik.

The post Eguneroko zientzia appeared first on Zientzia Kaiera.

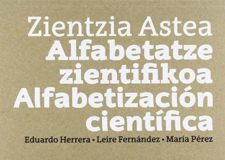

Ingredientes para la receta: El maíz

“Únicamente masa de maíz entró en la carne de nuestros padres, los cuatro hombres que fueron creados.”

Popol Vuh, Libro Sagrado de los Mayas.

El maíz, de nombre científico Zea mays, pertenece a la familia Graminiae, y es, por tanto, una gramínea como el arroz, el trigo, el centeno o la avena. Es el cereal más importante de la dieta en Latinoamérica y en África, y el segundo cereal más cultivado en el planeta. Proviene de América, donde mantiene una gran diversidad de tipos y es su centro Vavilov. Llegó a la templada Europa y a Asia y África en los siglos XVI y XVII. Era un alimento seguro y barato y lo fue durante siglos, sobre todo en Europa central. También alimentaba a los esclavos en el tráfico de África hacia América.

En el siglo XX, la producción de maíz aumentó con la mejora en las semillas, los regadíos, los nuevos abonos, los pesticidas y los nuevos usos del cereal en la industria y en la dieta. En Europa y Norteamérica, las cosechas se doblaron y, después, se triplicaron. Es una planta con facilidad para adaptarse a diferentes entornos, gran poder energético y fácil cosecha. En muchos países en desarrollo está desplazando a cultivos tradicionales más problemáticos.

Es, también, uno de los principales cultivos para alimentar al ganado. Es más, en la actualidad se siembra sobre todo para su uso como pienso. Ellen Messer afirma que solo un quinto del maíz sembrado va a la dieta humana, dos tercios son para el ganado y un décimo para alimentos procesados e, incluso, para productos que no se usan en alimentación.

El maíz crece entre los 50º de latitud norte, en Rusia y Canadá, hasta casi los 50º de latitud sur, en Sudamérica. Lo hace a altitudes bajo el nivel del mar, en las llanuras del mar Caspio, hasta los 3600 metros de altura, en los Andes del Perú, y con precipitaciones desde 250 mililitros, en Rusia, hasta más de 10000 mililitros, en la costa de Colombia hacia el Pacífico, y con tiempos de crecimiento que van de los 3 a los 13 meses.

Las variedades del maíz tienen características a veces muy diferentes. Las plantas tienen de 70 centímetros a 6 metros de altura, de 8 a 48 hojas por planta, de 1 a 15 troncos por semilla sembrada, con mazorcas de 7 a 70 centímetros de longitud. Además, tienen diferentes distribuciones geográfica, climática y de resistencia a las plagas. Como dijo algún experto hace décadas, los primeros que cultivaron el maíz crearon “una de las plantas cultivadas más heterogéneas que existen.”

El rendimiento es de 2.5 toneladas por hectárea de media en los países en desarrollo hasta las 6.2 toneladas por hectárea en los países industrializados. Es en el Medio Oeste de Estados Unidos donde, desde el final de la Segunda Guerra Mundial, se cosecha más de la mitad de la cosecha mundial de maíz. En el año 2008 fueron algo más de 300 millones de toneladas. El segundo productor mundial es China, y el tercero Brasil. Entre Estados Unidos, China, Francia, Argentina, Hungría y Thailandia controlan el 95% del comercio mundial de maíz que varía entre 60 y 70 millones de toneladas, la mayoría para alimentación animal. España, en 2008, produjo algo más de 3.5 millones de toneladas.

El maíz sigue siendo un componente importante en la dieta en las regiones en que se domesticó: México, América Central, el Caribe y en los Andes en Sudamérica. Y se ha convertido en un componente esencial de la dieta en África Oriental, en parte de Indochina y en algunas regiones de China. El consumo más alto por persona es de casi 100 kilogramos al año en México, Guatemala y Honduras, donde se prepara como tortillas. En estas regiones, más África y Rumania, supone el 70% de las calorías de la dieta. En África Oriental se come como gachas.

Sin embargo, como ya he escrito más arriba, el uso más significativo del maíz es como alimento del ganado y, en último término, como carne, leche y otros productos en la dieta humana. En Estados Unidos, más de la mitad del maíz cosechado es para el ganado y en Alemania llega a las tres cuartas partes. En países como Pakistán, India o Egipto, el maíz como pienso para el ganado es más caro que el maíz como alimento humano.

Hay más de 300 variedades de maíz, muchas de ellas con decenas de linajes. Pero su ancestro salvaje sigue siendo un misterio, cada vez más claro por las investigaciones como veremos ahora, pero todavía objeto de debate tanto sobre la especie originaria como sobre la región geográfica donde ocurrió la domesticación.

Dos matas de teosinte

El origen parece estar en el teosinte, que pueden ser varias subespecies de la especie Zea mays, la misma que el maíz cultivado. Es una hierba de gran porte que crece en México y Guatemala. Ya Vavilov, en 1931, propuso al teosinte como antepasado del maíz. Entre las hierbas conocidas como teosinte hay cuatro con el mismo número de cromosomas que el maíz y que pueden hibridar con él y entre sí.

La mayoría de los expertos en maíz aceptan que se domesticó hace de 7000 a 10000 años en Centroamérica. Pero está en discusión si ocurrió una o más veces en uno a más sitios de esa área geográfica. La diversidad de variedades en México y la no presencia de teosinte en el Perú convencieron a Vavilov de que el origen del maíz estaba en Centroamérica. Por cierto, en la actualidad el teosinte es una planta invasora de los cultivos de maíz en Aragón. Se detectó su presencia a finales de 2014.

El yacimiento de Tehuacan, en Puebla, México, guarda muestras de maíz, con mazorcas de unos 2.5 centímetros de longitud, fechadas hace casi 6000 años, hasta las más recientes, de unos 500 años, y todas ellas sirven para ilustrar la evolución de la planta. Destaca un periodo explosivo de variaciones hace unos 3500 años. En el estrato El Riego de este yacimiento se recuperó la evidencia más antigua que se conoce de uso de maíz silvestre, y está fechada hace 7200-9200 años. Y en el estrato Coxcatlan, de hace 5400-7200 años, ya se encuentra maíz cultivado.

La secuenciación del genoma de una muestra de maíz del yacimiento de Tehuacan, fechada hace 5310 años, por el grupo de Jazmín Ramos, de la Universidad de Copenhague, demuestra que viene de la misma población que fue origen del maíz moderno. Es un maíz más cercano, ya hace 5000 años, al maíz actual que al teosinte.

Uno de los cambios más importantes en la domesticación del maíz es que la planta, en la madurez, no disperse las semillas y permita que queden en la mazorca y, de esta manera, facilita la recolección por el que ha sembrado el maíz. Además, si no dispersa las semillas se convierte en una planta dependiente de quien la siembra, que dispone de granos, que ha cosechado, para repetir la cosecha. El teosinte dispersa las semillas y, en la domesticación, se seleccionó que la planta no lo hiciera como ocurre en el maíz moderno. El maíz recuperado en Tehuacan, de hace 5000 años, todavía mantiene los genes que dispersan las semillas.

Con hallazgos publicados casi continuos se decía , que son tres granos de maíz fechados hace 6250 años los más antiguos encontrados hasta ahora. Aparecieron en el Abrigo de Guila Naquitz, en Oaxaca, México. Dos de los granos recuerdan al teosinte pero el tercero tiene las características del maíz doméstico. O, también, el equipo de Mary Pohl, de la Universidad Estatal de Florida, recuperó restos de maíz en la excavación de San Andrés, en Tabasco, y quedaron fechados hace 7300 años.

Los estudios genéticos de la relación entre maíz y teosinte colocan el origen del cultivo en una población de teosinte del valle del río Balsas, en el Estado de Guerrero, en México. Allí, el grupo de Anthony Ranere, de la Universidad Temple, de Philadelphia, encontró restos de maíz y piedras para moler el grano y producir harina. Entonces, y ahora, en ese valle hay teosinte. Todos los restos están fechados hace 8700 años y, en la actualidad, se consideran los más antiguos conocidos de maíz, superando a los tres granos de Guila Naquitz.

Esta presencia del cultivo del maíz desde hace miles de años en Centroamérica implica que apareció una culinaria relacionada con este cultivo. George Beadle (Premio Nobel en 1958), que durante años estudió la genética y el origen del maíz, escribió que la primera receta para cocinar el maíz, y también el teosinte, serían las palomitas, colocando los granos directamente sobre el fuego, en las brasas o sobre roca o arena calientes. Beadle también sugiere que los granos de maíz se pueden comer crudos después de ablandarlos un tiempo en agua. O molerlos hasta conseguir harina, separando las cáscaras por flotación en agua.

El polen de la planta se ha identificado en yacimientos en Panamá de hace 7000 años, y en la Amazonia de Ecuador fechado hace 6000 años. Estos datos han llevado a algunos autores a proponer un segundo centro de domesticación del maíz en los Andes centrales, hace 6000 a 8000 años, y con variedades diferentes a las habituales en Centroamérica. Sin embargo, recuerdo que el teosinte no aparece en Sudamérica.

Borono

Pero fueron los incas los que comían un pastel hecho de sangre de camélidos, de llama en concreto, y harina de maíz. Yawar Zanen los llamaban. Aquí, en el norte de la Península, todavía se elabora un pastel parecido: es el llamado borono. La borona era el pan que se amasaba con harina de otros cereales y no con trigo como, por ejemplo, mijo, cebada o centeno. Pero, llegó el maíz, y el nombre quedó, desde finales del siglo XVI, para el pan de maíz. Pero también tenemos, como decía el borono, una especie de embutido que se obtiene del cerdo y se come en Palencia, Asturias o Cantabria. J.L. Lastras, en el blog El Laboratorio Gastronómico, nos explica como se cocina:

En un barreño grande, mejor si es de barro, ponemos sangre de cerdo, algo de agua para que no endurezca, sal, cebolla bien picada, grasa de cerdo y perejil. Añadimos harina de maíz y, si se quiere, también harina de trigo, y amasamos hasta formar una masa no muy seca. Modelamos la forma del borono, así como gruesa y rechoncha. Ponemos en agua hirviendo y cocemos durante un par de horas. Ya están para comer, si se quiere fritos o, si no, con azúcar y leche.

Como ocurre en los procesos de domesticación, y ya lo adelantó Vavilov, solo una fracción de la biodiversidad del maíz original se llevó, primero, a Norteamérica y hacia Sudamérica (en el siglo XV los europeos encontraron cultivos de maíz en la desembocadura del río San Lorenzo, en Canadá, y en el centro de Chile por el sur), después a Europa y al resto del mundo. Por ejemplo, entre los genomas del teosinte y el maíz ya hay una disminución del 20%, aunque a diferencia de otros organismos domesticados, hay una cierta recuperación por los cruces entre sí de la gran cantidad de variedades de maíz que existen.

El maíz llegó a Europa con Cristóbal Colón en su primer viaje y ya se menciona en 1500 en Sevilla y, rápidamente, se extendió por toda la Península. Colón había encontrado extensos cultivos de maíz en la isla de Cuba cuando llegó el 27 de octubre de 1492. Escribió en su diario que “la tierra es muy fértil y muy labrada de aquellos mames y faxoes y havas muy diversas de las nuestras; eso mismo panizo…”. Ahora llamamos panizo al maíz pero en tiempos de Colón, que no conocía el maíz, era el nombre de una planta, originaria de Oriente, que se parecía al maíz. Colón se lo presentó a los Reyes Católicos en Barcelona en abril de 1493 y “maravilláronse que no hubiese trigo allá, sino que todos comiesen pan de aquel maíz”.

Y después llegó al resto de Europa con la curiosa peculiaridad de que, en casi todos los países, era reconocido como un cultivo extranjero y, de ahí, el nombre que recibía la planta: era romano en algunas regiones de Francia, siciliano en la Toscana, indio en Sicilia, español en los Pirineos franceses, de Guinea en Provenza, de Egipto en Turquía, de Siria en Egipto, de Turquía en Inglaterra o de Gales en Alemania.

Para finales del siglo XVI se conocía y cultivaba en toda Europa. Y en Egipto, Libia y Siria para 1520. O en China para 1555. De América podían llegar de 200 a 300 variedades de maíz que ya se cultivaban, lo que facilitó su adaptación a tan extensa geografía y a muchos entornos diferentes.

Era barato, de fácil cultivo, no requería muchas labores agrícolas y resistía los cambios del tiempo. Pronto se convertiría en la comida de los pobres y así se mantendría durante siglos, como afirma Manuel de Paz, de la Universidad de La Laguna. En la actualidad tiene muy escasa presencia en la dieta de nuestra especie. Pero, como antes comentaba, si abunda en la dieta de nuestro ganado. O en nuestro desayuno donde el maíz es muy popular desde hace unas décadas cuando llegaron a Europa los cereales típicos del “breakfast” de Estados Unidos.

Ya en el siglo XVI, el clima del norte de la Península Ibérica favorecía el cultivo del maíz sobre otros cereales y no tardó en aparecer una cocina basada en el maíz. Al País Vasco, el maíz llegó en el siglo XVI. Todavía no se conoce con exactitud ni cómo ni cuando llegó el maíz al País Vasco, aunque a menudo se menciona a Gonzalo de Parcaiztegui, de Hernani, que fue escribano y alcalde en su pueblo, y fechas de la segunda mitad del siglo XVI. Sin embargo, tal como cuenta Fausto de Arocena, en 1521 hay algún texto que menciona maizales en San Sebastián.

Familia en la puerta del caserío Isasi Barrenengua (Eibar). Fuente: gureGipuzkoa

A finales de siglo XIX y principios del XX, y siempre en épocas de escasez, la comida en el caserío, nos cuenta Gurutzi Arregi, se completaba con el maíz preparado como talo, una especie de torta hecha con harina de maíz. En el desayuno, el talo acompañaba la leche, en la comida se echaba a la sopa o se comía con trozos de tocino o carne, y en la cena se terminaba con talo y leche, como en el desayuno. Y el talo con chorizo, o txistorra, era ya una buena merienda.

Talo con txistorra. Fuente: Comida’s

Cuando Gurutzi Arregi estudia la etnografía de Durango, nos cuenta cómo hacían el talo en los caseríos y en las casas, pues era, de nuevo, la comida de los pobres para una época de escasez. Era el año 1942:

“Se ponía a hervir agua con sal. En un recipiente se ponía la harina de maíz o la harina de trigo y se iba echando el agua poco a poco, y se iba amasando hasta hacer una bola grande. Encima de la mesa, se echaba harina, y se cogían trozos de la masa, en proporciones mayores o menores según el tamaño de los talos y se iba aplastando, dándoles forma, generalmente redonda.

En los caseríos se colocaba el talo en la talopara de hierro y mango de madera. En las casas de la calle encima de la chapa -cocina económica-, bien caliente. Primero se le hacia dorar por un lado, y después se le daba la vuelta para que se dorase la otra cara.

Es muy corriente comer tocino frito con el talo. También se comía mucho el talo con leche.”

Espero que les guste. Con txistorra está rico pero con tocino frito es ya pecado de dieta poco saludable. O eso dicen.

Referencias:

Arocena, F. de. 1933. La introducción del maíz, Gonzalo de Percaiztegui. Revista Internacional de Estudios Vascos 24: 362-364.

Arregi, G. 1985. Etnografía de Durango. Datos geográficos. La alimentación. Juegos infantiles. Instituto Labayru. Bilbao. 98 pp.

Beadle, G.W. 1980. El origen del maíz. Investigación y Ciencia marzo: 84-92.

Bentz, B. 2002. La domesticación del maíz. Mundo Científico mayo: 36-40.

Brothwell, D. & P. Brothwell. 1969. Food in Antiquity. A survey of the diet of early peoples. Johns Hopkins University Press. Baltimore and London. 283 pp.

Cohen, M.N. 1981. La crisis alimentaria de la Prehistoria. La superpoblación y los orígenes de la agricultura. Alianza Ed. Madrid. 327 pp.

Gobierno de Aragón, 2014. El teosinte (Zea mays, spp.). Dirección General de Alimentación y Fomento Agroalimentario. Zaragoza. 6 pp.

Hake, S. & J. Ross-Ibarra. 2015. Genetic, evolutionary and plant breeding insights from the domestication of maize. eLife 4: e05861

Hufford, M.B. et al. 2012. Comparative population genomics of maize domestication and improvement. Nature Genetics 44: 808-813.

Lastras, J.L. 2009. Boronos, los más desconocidos de la Matanza. Blog El Laboratorio Gastronómico. 6 enero.

Messer, E. 2000. Maize. En “The Cambridge World History of Food, vol. 1”, p. 97-112. Ed. por K.F. Kiple & K.C. Ornerlas. Cambridge University Press. Cambridge.

Paz, M. de 2013. El trigo de los pobres. La recepción del maíz en el Viejo Mundo. Batey: Revista Cubana de Antropología Sociocultural 5: 142-174.

Pohl, M.E.D. et al. 2007. Microfossil evidence for pre-Columbian maize dispersals in teh neotropics from San Andres, Tabasco, Mexico. Proceedings of the National Academy of Sciences USA 104: 6870-6875.

Ramos Madrigal, J. et al. 2016. Genome sequence of a 5310-year-old maize cob provides insights into the early stages of maize domestication. Current Biology doi: 10.1016/j.cub.2016.09.036

Ranere, A.J. et al. 2009. The cultural and chronological context of early Holocene maize and squash domestication in the Central Balsas River Valley, Mexico. Proceedings of the National Academy of Sciences USA 106: 5014-5018.

Riera Climent, L. & J. Riera Palmero. 2007. Los alimentos americanos en los Extractos de la Bascongada (1768-1793): El maíz y la patata. Llull 30: 319-332.

Ritchie, C.I.A. 1986. Comida y civilización. De cómo los gustos alimenticios han cambiado la Historia. Alianza Ed. Madrid. 272 pp.

Toussaint-Samat, H. 2009. A history of the food. Wiley-Blackwell. Chichester. 756 pp.

Sobre el autor: Eduardo Angulo es doctor en biología, profesor de biología celular de la UPV/EHU retirado y divulgador científico. Ha publicado varios libros y es autor de La biología estupenda.

El artículo Ingredientes para la receta: El maíz se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Ingredientes para la receta: el ajo

- Ingredientes para la receta: El conejo

- Ingredientes para la receta: El arroz

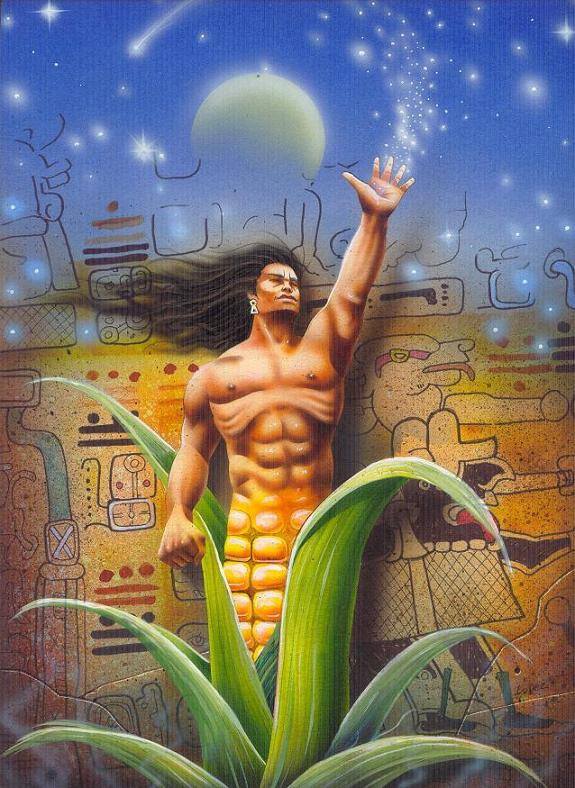

La teoría de bandas de los sólidos se hace topológica

Hasta hace prácticamente 10 años los materiales, según las teorías de física y química establecidas, se dividían en metales, semimetales y aislantes, siendo los materiales semiconductores un caso particular de estos últimos. Esa clasificación en tres grandes grupos se basa en lo que se conoce como “teoría de bandas”, que básicamente se fija en propiedades electrónicas y en cómo los enlaces entre los elementos químicos de un material influyen en esas propiedades. Desde el punto de vista físico, la asignación de un material a uno de esos tipos depende de la existencia o no de un salto energético entre las bandas de valencia y conducción y, si existe este salto, de su magnitud.

Tras un largo paréntesis sin descubrir nuevos estados o propiedades, en los últimos tiempos ha resurgido el interés en este área de conocimiento a raíz de la predicción, mediante la teoría de bandas convencional, de unos materiales que son aislantes en su interior, pero son conductores en la superficie, es decir, son aislantes y metales al mismo tiempo. Resulta, además, que ese estado conductor o metálico de la superficie apenas presenta pérdidas de energía a temperatura ambiente y es muy robusto frente a posibles impurezas: se dice que está protegido topológicamente. La topología es la rama de las matemáticas que estudia qué propiedades de los cuerpos geométricos no se alteran al deformarlos de manera continua. Siguiendo con esa analogía, los materiales topológicos son aquellos cuyas propiedades están definidas o “protegidas” por la propia estructura y simetría del cristal, de forma que si no se modifica dicha estructura, estas propiedades no se pueden cambiar.

El interés surgido a partir del descubrimiento de estos materiales topológicos con propiedades exóticas lo demuestra el hecho de que el Premio Nobel de Física de 2016 fue concedido a tres de los pioneros de ese nuevo campo. Sin embargo, a pesar de las extraordinarias y prometedoras propiedades de estos materiales, de los casi 200.000 materiales que hay catalogados en las bases de datos de estructuras inorgánicas, apenas se han encontrado en los últimos 10 años 100 materiales que presenten esta fase o estado topológico.

El trabajo ha sido portada de Nature.

Ahora, un equipo internacional de investigadores, en el que han tomado parte los profesores Luis Elcoro y Mois Aroyo, del Departamento de Física de la Materia Condensada de la Facultad de Ciencia y Tecnología de la UPV/EHU y Maia García Vergniory, del Departamento de Física ApIicada II de la misma facultad de la UPV/EHU y también investigadora del DIPC, ha introducido y desarrollado un nuevo paradigma en la teoría de estructura electrónica de bandas, completando así el trabajo pionero, entre otros, del físico suizo Felix Bloch en la primera mitad del siglo XX. Este novedoso y revolucionario estudio introduce nuevas consideraciones matemáticas, de las teorías de grupos y grafos, en el análisis que de los sistemas cristalinos hace la teoría de Bloch y proporciona una forma más descriptiva, rápida y eficaz para descubrir y caracterizar metales y aislantes con propiedades topológicas.

El grupo de investigación ha utilizado su nueva teoría de “química cuántica topológica” para caracterizar todos los tipos de bandas elementales posibles para todas las simetrías posibles, generando una especie de catálogo de consulta a disposición de toda comunidad científica, en el cual investigadores de todo el mundo puedan buscar fácilmente candidatos de posibles materiales topológicos, y evitar tediosos y costosos cálculos computacionales. Toda esta información y las herramientas para su elaboración se encuentra disponible en el Bilbao Crystallographic Server, desarrollado y mantenido por personal docente e investigador de la UPV/EHU.

“Los resultados publicados demuestran que los aislantes y materiales topológicos son más comunes en la naturaleza de lo que hasta ahora se había creído; lo cual resulta muy prometedor e interesante, ya que abre las puertas a una nueva forma de entender los materiales, así como a una electrónica de baja disipación energética, y tantos otros descubrimientos que están por llegar”, explican los autores del estudio.

Fuente:

Barry Bradlyn, L. Elcoro, Jennifer Cano, M. G. Vergniory, Zhijun Wang, C. Felser, M. I. Aroyo, and B. Andrei Bernevig Topological quantum chemistry Nature. DOI: 10.1038/nature23268

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo La teoría de bandas de los sólidos se hace topológica se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Aislantes topológicos en sólidos amorfos

- Superelasticidad nanométrica

- La óptica se hace atómica: la lente más pequeña del mundo

Onddo erresistenteari aurre egiten

1. irudia: Lomentospora prolificans onddoa.

Hari formako onddoa da L. prolificans (lehen Scedosporium izenez zen ezaguna), lizun taldekoa da, egoera txarreko elikagaietan (fruituetan, ogian) ikus daitezkeen onddoak bezala. Mikroorganismo multierresistentea da eta egun erabiltzen diren antifungikoei (onddoen aurkako antibiotikoei) erresistentea.

Onddoak ez du minik eragiten pertsona osasuntsuengan immunitate sistemaren babesari esker. Oso infekzio larriak sor ditzake, baina, immunitate sistema ahula duten pazienteengan (minbizia tratatzeko kimioterapia hartutakoek ala HIESA dutenek, adibidez) eta %80-100 hilkortasun tasa du.

Lomentospora prolificans antifungikoei erresistentea da, bera bezalako hari formako onddoek sortzen dituzten mikosiak tratazeko botikak ez dira eraginkorrak. Onddo honi aurre egiteko medikamenturik erabiliena voriconazola da, eraginkortasun handiena erakutsi duena baita. Hala ere, eraginkortasuna oso baxua da.

MetodologiaLomentospora prolificans onddoa voriconazolarekin tratatzean jasaten dituen aldaketak ikertu dituzte. Zehazki, zelula hormaren arkitekturan eta konposizioan gertatzen diren aldaketak, voriconazolari erresistente izatea ahalbidetzen duten mekanismo eta molekulak identifikatzeko.

- Egitura

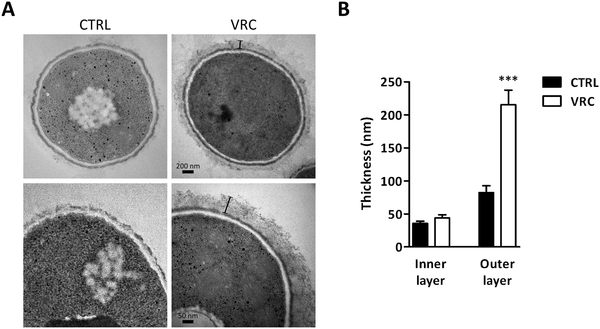

Egiturari dagokionez, medikamentuaren dosiaren araberako zelula hormaren zabaleraren handitzea eta luzeraren txikitzea izan da behatutako aldaketa. Hormaren zabaleraren aldaketa, gainera, kanpo geruza fibrilarrean gertatzen dela zehaztu da.

2.. irudia: Tratatu gabeko zelularen hormaren (CTRL) eta voriconazolarekin tratatutako hormaren (VRC) alderaketa.

- Konposizioa

Hormaren konposizioaren analisiak, bere aldetik, karbohidratoen konposizioan aldaketak erakutsi ditu, tratatutako zeluletan kantitatea handitzen delarik. Honekin batera, kitina kontzentrazioan ere aldaketak behatu dira, dosiaren araberakoak hauek ere; zenbat eta voricazol gehiago, orduan eta kitina gehiago.

Horretaz gain, mintzari eragiten dion SDS agentearekin eta hormari eragiten dioten kalkofluor-zuri eta kongo gorria agenteekin batera aplikatu da voriconazola, konposatu hauekiko sentsibilitatea neurtzeko. Agente hauek voriconazolaren eraginkortasuna handitzen dutela frogatu da.

Azkenik, proteina lokalizazioak aztertu dira eta espresioan ezberdintasunak topatu dira, baita voriconazolarekin tratatutako zeluletan bakarrik agertzen den lokalizazio bat identifikatu ere.

Tratamendurako lehen pausuaOinarrizko ikerketa da honakoa, beharrezko ezagutza sortzen ari da etorkizunean terapia berriak diseinatu ahal izateko.

Onddoa voriconazolarekin tratatzean zelula horman gertatzen diren aldaketak behatuta, orain arte ezezaguna zen erresistentzia mekanismoa aurkitu du ikerketak, praktikan onddoari aurre egiteko botika eraginkorrak diseinatzea ahalbidetu dezakeena.

Fernando L. Hernando, Aitor Rementeria eta Andoni Ramirez irakasleek zuzendu dute ikerketa eta Aize Pellón ikerlariak (bere doktore tesiari esker sortu da azterlana), Idoia Buldain, Xabier Guruceaga eta Aitziber Antoran ikerlariek hartu dute parte UPV/EHUko Fungal and Bacterial Biomics taldearen baitan.

Erreferentzia bibliografikoa:

Aize Pellon, Andoni Ramirez-Garcia, Idoia Buldain, Aitziber Antoran, Aitor Rementeria, Fernando L. Hernando. Molecular and cellular responses of the pathogenic fungus Lomentospora prolificans to the antifungal drug voriconazole. PLOS ONE 12(3): e0174885. DOI: 10.1371/journal.pone.0174885.

Iturria:

UPV/EHUko komunikazio bulegoa: %90eko hilkortasuna eragin dezakeen onddo baten erresistentzia-mekanismo bat azaldu dute

The post Onddo erresistenteari aurre egiten appeared first on Zientzia Kaiera.

Al rescate

Una hormiga herida, con dos termitas colgando de su cuerpo esperando, el rescate.

El pasado abril se publicaron los resultados de un estudio que ha documentado el primer caso conocido en que unas hormigas acuden al rescate de una compañera herida en combate. Los insectos en cuestión pertenecen a la especie Megaponera analis, una hormiga africana cuyos miembros realizan expediciones en grupos de entre 200 y 500 individuos para cazar termitas en sus termiteros. Las batallas entre termitas y hormigas no son precisamente incruentas; al contrario, las termitas también tienen poderosas mandíbulas y no son presa fácil para las hormigas. Como consecuencia, no son raras las ocasiones en que las hormigas resultan heridas de gravedad. Muchas veces llegan a perder alguna extremidad en la mandíbula de una termita.

Pues bien, es en esos casos cuando las compañeras de la hormiga a la que se ha cercenado una pata o llevan una termita firmemente anclada en su cuerpo acuden en su busca, la rescatan y se la llevan de vuelta al hormiguero. Una vez allí, en un alto porcentaje de las ocasiones se recupera y puede volver a tomar parte en nuevas partidas de caza. Si han perdido una extremidad, las hormigas rescatadas no la recuperan; sencillamente aprenden a desplazarse y a operar sin la que les falta. Un 95% de las recuperadas vuelven a cazar una o dos horas después de haber sido devueltas al hormiguero. De acuerdo con los cálculos hechos por los investigadores que han observado este comportamiento, las colonias de esta especie son un 29% mayores de lo que serían si abandonasen a su suerte a las hormigas heridas. La razón por la que ese proceder ha podido surgir en esta especie es que cazan en grupo, sus colonias son relativamente pequeñas y el número de hormigas heridas en cada ataque es relativamente alto, por lo que cada hormiga cuenta.

El mecanismo implicado es asombrosamente simple y se basa en la comunicación química a distancia mediante feromonas. Las feromonas son sustancias secretadas por ciertos seres vivos que provocan comportamientos específicos en otros individuos de la misma especie. Los ejemplares de Megaponera analis heridos en los termiteros liberan dos feromonas desde sus glándulas maxilares; esa es la señal que, al ser recibida por las compañeras, induce la respuesta consistente en acudir en su busca.

Cuando el comportamiento de rescate se dio a conocer, muchos medios se hicieron eco del mismo, y en la mayoría de los consultados por este cronista se incidía en el hecho de que el rescate no debía ser entendido como altruismo equivalente al de nuestra especie, dado que la razón por la que las hormigas lo practican es el interés por contar con abundantes efectivos para las partidas de caza. Sin embargo, esa forma de entender el altruismo me parece naif. Implica una concepción desenfocada de los comportamientos prosociales en general y altruistas o generosos en particular.

Las hormigas son organismos eusociales. Forman colonias que funcionan como si se tratase de un superorganismo. En ellos la colaboración, el trabajo en equipo y la ayuda mutua son esenciales. Pero el comportamiento prosocial también es valioso para los integrantes de los grupos humanos. También en nuestra especie rinde beneficios en términos de aptitud: tiene valor adaptativo y, con toda probabilidad, ha sido seleccionado en el curso de nuestra evolución. Por esa razón, aunque la biología, los mecanismos y las estructuras sociales son diferentes en hormigas y seres humanos, las consecuencias de la colaboración son semejantes. En rigor, por ello, no hay ninguna razón para pensar que los rescates de hormigas y los que puedan realizarse en las situaciones humanas equivalentes son sustancialmente diferentes: ambos son igualmente prosociales.

—————————-

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

————————

Una versión anterior de este artículo fue publicada en el diario Deia el 7 de mayo de 2017.

El artículo Al rescate se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Asteon zientzia begi-bistan #164

Txori migratzaileak ezagutzeko aukera izan dugu testu honen bitartez. Txoriek gantza eta proteinak pilatzen dituzte migrazioa prestatzeko. Migratzen hasi baino lehen gehiago jaten dute, lau bider gehiago jatera iristen ahal dira. Horretarako, handitu egiten dute digestio-sistemaren edukiera. Migrazioan zehar, hegaldi eta geldialdi zenbait txandakatzen dituzte latitude epeletako txori migratzaile gehienek. Geldialdi horietan energia eta elikagai erreserbak berreraikitzeko aukera dute. Adibide gisa, Dendroica striata txoria dugu. Txikia da eta Ipar Amerikatik Erdialdeko Amerikara edo Hego Amerikako iparraldera migratzen du. Bataz beste, 3.000 km-ko distantzia egiten du itsasoaren gainetik, eta horrek esan nahi du 88 orduko hegaldi etengabea egin behar duela.

Beleak adimena aztertzeko tresna bikainak dira. Lund Unibertsitateko (Suedia) Can Kabadayi eta Mathias Osvath ikertzaileek hainbat esperimentu egin dituzte animalia horiekin. Ondorioztatu dute beleak gai dira etorkizuna planifikatzeko. Esperimentu ugari egin dituzte beleekin. Ikerketa honetatik ondorioztatzen dute, adibidez: “Beleak erabakiak hartzeko gai izan dira, etorkizunean gertatuko diren gauzak irudikatuz. Hau da, etorkizunean gerta daitekeen zerbait kontuan hartu dute unean uneko erabakiak hartzeko”.

PaleontologiaJoan Wiffen izan da aste honetako protagonista. Modu autodidaktan ikasi zuen paleontologia eta “Dinosauroen erregina” deitzen zioten. Bi aurkikuntza nagusi egin zituen Zeelanda Berriko Ipar Uhartean, Hawkeseko badian: duela 75 milioi urteko dinosauro teropodo baten buztanaren orno bat eta tiranosauro baten hezur bat. Halere, adituek ez zioten erraz jarri Joani. Izan ere, lurralde horretan ez zirela dinosauroak existitu zioten gehienek. Joanek horien existentzia frogatzen zituen fosilak topatu zituen arte.

EkonomiaBarbara Ward (1914-1981) Britainia Handiko ekonomialari, kazetari eta idazlea da. Ahalegin handiak egin zituen mendebaldeko oparotasuna munduaren gainerako herrialdeekin partekatzeko. 60.eko hamarkadan, ingurumenari lotutako gaiak landu zituen, garapen iraunkorraren aldeko defentsan aitzindari bilakatuz. United Nations Conference on the Human Environment biltzarraren aurreko txostenaren idazketan parte hartu zuen.

NeurozientziaTxinan egindako ikerketa batean ikusi dute anai-arrebarik ez duten haurrek sormen handiagoa dutela eta ez direla hain atseginak. Halaber, ikerketa horren bitartez egiaztatu dute anai-arrebak izan edo ez, garuneko zati batzuetan bolumena aldatu egiten dela. Garuneko eskanerrek eman dituzte datu deigarrienak. Horien arabera, ikerketa honetako ume bakarrek bolumen handiagoa dute lobulu parietaleko atal batean: zirkunboluzio supramarginalean. Ikerketa honetan aurrenekoz egiaztatu da garuneko egitura anatomikoan ikus daitezkeen desberdintasun zenbaitek lotura izan dezaketela jokabidearekin.

IngeniaritzaZurichen (Suitza) 3D inprimagailu bat erabiliz silikonazko bihotz bat “inprimatu” dute eta taupadaka jartzeko gai izan dira, ia-ia benetako bihotz baten gisan. Prototipo bat da oraindik, jakina, asko falta da oraindik bihotz-transplanteetan erabiltzeko. Oso-osorik artifiziala den lehenengo bihotza da. “Gaixoaren bihotzaren berdin-berdina den beste bat sortzea da helburua, neurriz eta itxuraz, eta bere funtzionamendua erabat imitatzea”, adierazi dute ikertzaileek.

Victor Mayoral elkarrizketatu dute Berrian, H-ROS nazioarteko proiektuagatik izendatu dute Inovators Under 35 sarietan. Robotikan espezializatutako ingeniaria da, proiektu horretan, “oso berritzailea” bere ustetan, robotetan erabil daitezkeen piezak sortzen ditu. Zertan datza baina? Mayoralek azaltzen duenez, “helburua pieza batzuk sortzea da, robot mota ezberdinen artean truka daitezkeenak, eta baita fabrikatzaile ezberdinen artean trukatu daitezkeenak ere”. Etorkizunera begira, robotek zer aldaketa ekarriko duten galdetuta, hauxe dio: “Oso aldaketa nabarmenak ikusiko ditugu; esaterako, bakarrik ibiliko diren auto eta kamioiak. Aurreratu dezaket datorren hamarkadan sukaldeko robot asko eta asko ikusiko ditugula”.

MedikuntzaLarrialdi medikoetako zerbitzuetan eta zainketa intentsiboen unitateetan (ZIU) erabili ohi da Allen maniobra –odol fluxuaren kalitatea begiratzeko erabiltzen da–. Ahurra goraka dagoela, eskua ukabilean ixten da. Hatzekin arteria erradiala eta kubitala eskumuturraren albo bietan estutzen dira aldi berean, ahurrak kolore zurbila hartzen duen arte. Arteria kubitalaren gaineko presioa askatzen da, erradialaren gainekoari eusten zaiola. Bada, ikerketa batean ondorioztatu dute Allen testak ez duela %100ean odol zirkulazioaren kalitatea ezagutzea bermatzen eta ez duela eragozten arteria ziztatu ostean iskemiaren bat agertzea.

———————————————————————–

Asteon zientzia begi-bistan igandeetako atala da. Astean zehar sarean zientzia euskaraz jorratu duten artikuluak biltzen ditugu. Begi-bistan duguna erreparatuz, Interneteko “zientzia” antzeman, jaso eta laburbiltzea da gure helburua.

———————————————————————–

Egileaz: Uxue Razkin Deiako kazetaria da.

———————————————————————–

The post Asteon zientzia begi-bistan #164 appeared first on Zientzia Kaiera.

Arte & Ciencia: Analogías entre el arte y la ciencia como formas de conocimiento

El arte y la ciencia son dos formas de conocimiento aparentemente alejadas, en gran medida consecuencia de la especialización profesional y la educación compartimentada. Del estudio de esta impostada separación surgió el estereotipo de las dos culturas, las ciencias y las humanidades, para referirnos a esa brecha de conocimiento. La realidad es que la ciencia y el arte sí están conectadas y que ninguna forma de conocimiento es impermeable a otra. Por poner algunos ejemplos: ¿Cómo podría crearse una obra plástica sin las técnicas propiciadas por la ciencia? ¿Cómo podríamos interpretar la elección de materiales?

Estas y otras cuestiones relacionadas furon tratadas por destacados profesionales -artistas, ilustradores, filósofos y científicos- que han puesto el foco en ese difuso trazo que une la ciencia y el arte. El ciclo Ciencia & Arte se desarrolló, bajo la dirección de Deborah García Bello, a lo largo de cuatro jornadas que se celebraron los jueves días 6 y 27 de abril y 11 y 25 de mayo de 2017 en el auditorio del Museo Guggeheim Bilbao.

Esta actividad de la Cátedra de Cultura Científica de la UPV/EHU se enmarca en el programa TopARTE que conmemora el XX Aniversario del Museo Guggenheim Bilbao.

Tercera jornada. 2ª Conferencia

Pau Alsina, Profesor en la Universidad Oberta de Catalunya y director de Artnodes, revista de arte, ciencia y tecnología: Analogías entre el arte y la ciencia como formas de conocimiento.

''Analogías entre el arte y la ciencia como formas de conocimiento''Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Arte & Ciencia: Analogías entre el arte y la ciencia como formas de conocimiento se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Arte & Ciencia: La relación entre el desarrollo de la ciencia y la creación artística

- Arte & Ciencia: Cómo descubrir secretos que esconden las obras de arte

- Arte & Ciencia: La importancia de la ciencia para la conservación del arte

Ezjakintasunaren kartografia #180

Ez dugu izan haren berri orain arte, baina Pliozenoan suntsipen masiboa gertatu zen. Rocío Pérezek ematen digu azaltzen digu: Where have all the megasharks gone?

Solidoen banden teoriaren sorrerak 90 urte ditu jada eta ibilbide honetan arrakasta izan du, besteak beste, erdieroaleak bezalako fenomenoak azaltzeko orduan. Baina azken urteotan isolatzaile topologikoen aurkikuntza dela eta teoria hau arrakalatzen hasita egon da. Asteon Nature aldizkariaren azalean banden teoria zehazten duen ikerketa bat aurkeztu du. Ikerlan honetan DIPCko ikertzaileen partaidetza izan du. Ikerketa taldeak teoria berri bat aurkeztu eta garatu du, propietate topologikoak dituzten materialak era sistematikoan eta eraginkorrean aurkitu eta karakterizatu ahal izateko. Xehetasun guztiak Topological Quantum Chemistry, the band theory of solids is now complete artikuluan.

–—–

Mapping Ignorance bloga lanean diharduten ikertzaileek eta hainbat arlotako profesionalek lantzen dute. Zientziaren edozein arlotako ikerketen azken emaitzen berri ematen duen gunea da. UPV/EHUko Kultura Zientifikoko Katedraren eta Nazioarteko Bikaintasun Campusaren ekimena da eta bertan parte hartu nahi izanez gero, idatzi iezaguzu.

The post Ezjakintasunaren kartografia #180 appeared first on Zientzia Kaiera.

¿Cómo una bacteria inofensiva de Gambia acaba generando una epidemia en Wisconsin?

Elizabethkingia anophelis fue aislada en 2011 a partir de muestras del intestino medio del complejo de ciptoespecies al que pertenece el mosquito Anopheles gambiae1. Aunque podría haber quedado olvidada entre las publicaciones de las revistas de taxonomía, la bacteria saltó a la fama en 2016 cuando las noticias de Wisconsin se hicieron eco de su existencia, algo que cuando hablamos de bacterias no suele estar relacionado con buenas nuevas. E. anophelis estaba tras la infección de más de 60 personas y lo que era peor, era la causa de la muerte de 20.

¿Qué hacia una bacteria sin historial como patógeno infectando y matando gente?, una bacteria que además, habitualmente vive en el sistema digestivo de mosquitos. Sin olvidar el dato climático, los mosquitos no son algo común en Wisconsin durante el invierno.

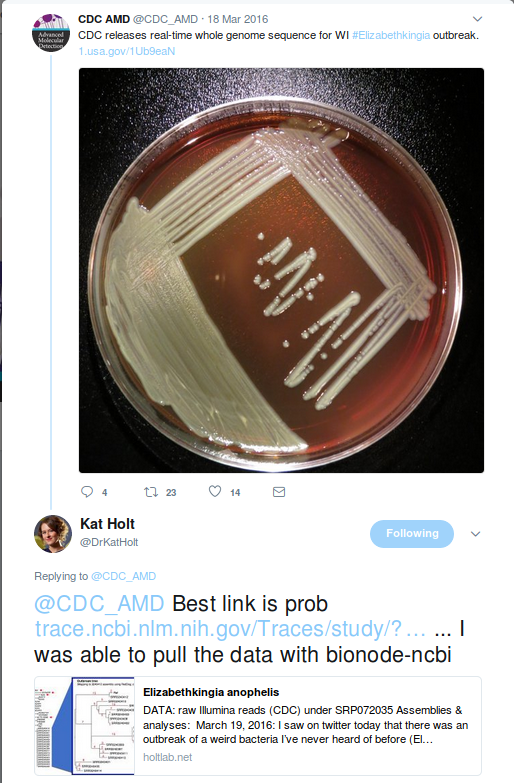

No es una sorpresa ver a microorganismos inofensivos convertidos en patógenos: los cambios en el genoma, los plásmidos y otros mecanismos son capaces de generar esta situación. Por ello el CDC (Centro de control de enfermedades) hizo algo poco común, liberó por twitter el genoma recién secuenciado e imagino que sin procesar, rápidamente algunos microbiólogos como Kat Holt o Sylvain Brisse se unieron para solucionar el problema.

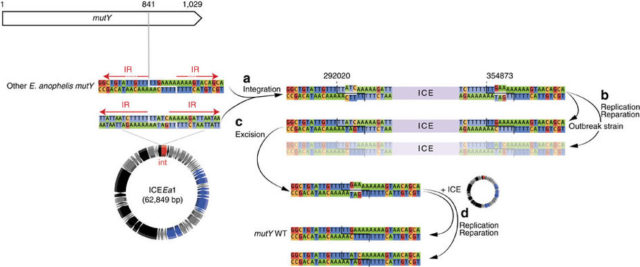

La primera cosa que observaron es que las secuencias procesadas de las muestras de los enfermos eran demasiado distintas. Normalmente las epidemias las causan una misma cepa con una secuencia genética casi idéntica con variaciones mínimas propias de cambios individuales, 40, 50 o incluso 100 pares de bases dentro del total. Sin embargo en esta ocasión las diferencias eran mucho mayores. Así que tras asegurarse por medio de herramientas mucho más potentes como el análisis cgMLST y aproximaciones comparativas de SNP en el genoma completo… Se llegó a la indudable conclusión de que aún siendo tan distintas, eran no sólo la misma especie sino que provenían de una misma cepa-ancestro. La diferencia entre ellas provenía principalmente de una enorme trozo insertado en el medio del gen mutY.

El gen mutY, se encarga de codificar para una proteína encargada de reparar errores en el ADN, así que ahora podéis imaginar que tras llevar un trozo de código más grande que la propia secuencia, la capacidad para producir la proteína desaparece completamente. Sin reparación, tenemos mutación descontrolada, y aunque la mayoría de las mutaciones son negativas o sin función…con el suficiente tiempo un pequeño porcentaje podrán dar habilidades no deseadas (por nosotros) a las bacterias. Y claro, de camino también ayudaría a volver locos a los microbiólogos que trataban de identificar al patógeno.

Aunque resuelto e identificado el culpable, seguía sin estar claro cómo una bacteria de esas características había llegado allí y lo que era más extraño, el modo en el que aparecieron los casos. Normalmente las epidemias aparecen en un hospital o lugar concreto desde el que se expanden, pero en este caso apareció de forma diseminada. El CDC analizó todas las posibles fuentes de esta bacteria dentro del ambiente hospitalario sin dar en ningún comento con la bacteria en el medio. Por lo que el foco se centró en la comunidad.

Cerrada la vía del estudio en el medio ambiente, el esfuerzo se centró en la secuencia genética de las muestras obtenidas de los enfermos2. -Y Ahora empieza quizás la parte más complicada, pero si ha llegado hasta aquí leyendo, no se asuste estimado lector, porque vamos a intentar entender lo básico de algunas técnicas. (Si además queréis saber más de taxonomía bacteriana y sus limitaciones con técnicas de antes de ayer podéis leer mi colaboración en la Cátedra de Cultura Científica).

El árbol filogenético se realizó usando la que es quizás la herramienta más potente en taxonomía microbiona, el cgMLST. Esta técnica está basada en el análisis MLST, pero vayamos poco a poco. En taxonomía microbiana existen muchas aproximaciones a la descripción de especies. Centrándonos en los métodos moleculares, concretamente en los que implican secuencias genéticas, el más conocido es el análsis del ADNr 16S del que hablo en el texto citado en el párrafo anterior. Voy a contarlo de una forma muy sencilla, casi näif:

Phylogenetic tree of the outbreak isolates. From: Evolutionary dynamics and genomic features of the Elizabethkingia anophelis 2015 to 2016 Wisconsin outbreak strain

Si queremos describir en base a la secuencia genética necesitamos un código que sea muy similar, que cambie muy poco, y ya sabemos que los seres vivos tienden a mutar y cambiar con las generaciones. Pero existen genes muy muy importantes, tanto que los cambios en ellos son muy pocos. Estos genes, o mejor dicho trozos de ellos, son los candidatos elegidos para secuenciar e identificar mediante multilocus sequence typing (MLST). Cada especie bacteriana tiene un número de genes de este tipo, suelen elegirse siete y en base a ellos se realizan árboles mediante procesos estadísticos (en los que no vamos a entrar). Quizás os preguntéis por qué no usar Whole-genome sequencing (WGS), la secuenciación del genoma completo y la hibridación es el método “final” para publicar una nueva especie microbiana, básicamente alineas el genoma completo de esa especie y la más cercana para demostrar que hay partes que no son iguales y que esas partes son lo suficientemente grandes para considerarse una especie nueva. Sin embargo este método no es útil en epidemiología. Es complicado estandarizar, ya que arroja tantos por ciento de similitud, lo que complica un poco la colaboración entre distintos centros de investigación.

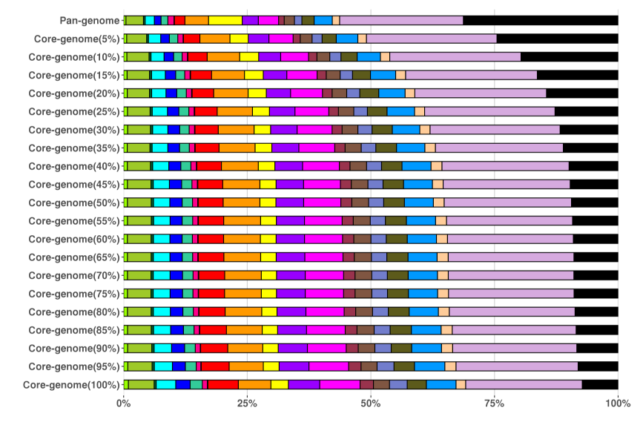

¿La solución?, ya la imagináis core genome MLST (cgMLST). Retrocedamos a los médicos que tomaban muestras de los enfermos, muestras de una bacteria que cambiaba casi cada día…bacterias que siendo responsables de la misma epidemia eran sensiblemente distintas entre ellas. El genoma de las bacterias estudiadas era distinto en gran parte, pero claramente perteneciente a la misma especie. A la suma de todos esos genomas que tenemos es a lo que llamamos pan-genoma,

Pan-genoma vs. Core-genoma.

El Core Genoma sería (simplificando muchísimo) las partes de la secuencia que van caracterizando las similitudes entre cepas de la misma especie. Dejando los “genes únicos” como las zonas que diferencian a cada cepa de las demás. Así que tenemos un Pan-genoma que contiene partes compartidas llamadas Core-genoma, partes distintas llamadas genes únicos. El Pan-genoma por decirlo de otra forma, sería una secuencia consenso entre las cepas.

Pues mezclando ambos conceptos se desarrolló el cgMLST. En el cual se estandarizó y dotó de un sistema numérico a los alelos ayudándose del mapeo de single nucleotide polymorphism (SNP), que son pequeños cambios en el ADN usados también para diferenciar y clasificar. La ventaja de todo este sistema, es su velocidad y usabilidad una vez automatizado. Tomar una muestra de la bacteria, secuenciar los genes MLST, y cotejar con el sistema cgMLST para poder colocar y clasificar.

Se tomaron muestras casi diarias de prácticamente todos los pacientes, y tras procesarlas en el cgMLST se vio que el core-genoma era idéntico excepto por un único SNP encontrado en uno de los aislamientos (en el mismo paciente otros dos aislamientos también fueron distintos para ese SNP) Este dato confirmó lo dicho al inicio de la historia, que se trataba de una bacteria con un origen común pero con una gran capacidad de mutar.

Por si fuera poco sorprendente, los análisis bayesianos demostraron que había una “firma temporal”, lo que implicaba que la cepa de la epidemia se había continuado diversificando de una forma mesurable durante el curso de la epidemia. Se estimó que el ratio de evolución era de 5.98 × 10−6 substituciones nucleotídicas por año y sitio. Atendiendo al ratio de diversificación y a que las muestras fueron tomadas alrededor de julio de 2015. Se pudo determinar la aparición del ancestro de la cepa epidémica aproximaciones a finales de diciembre de 2014. Para asegurarse, los investigadores realizaron un experimento similar pero atendiendo a los SNP del genoma completo y no sólo de los cgMLST, este experimento situó el origen de la cepa en agosto de 2014. Uniendo ambos resultados se confirmó que la cepa apareció un año antes de la epidemia, y evolucionó en un reservorio desconocido para luego generar la epidemia, siguiendo su diversificación durante todo el proceso.

Excision of ICEEa1 can lead to mutY WT in outbreak strains.

Estudiando el elemento externo que se había insertado en el genoma de la bacteria causando este fenómeno de “hipermutación” y patogenia, los investigadores descubrieron que se trataba del elemento, al que bautizaron como ICEEa1 (integrative and conjugative element 1 of E. anophelis). Era en realidad un enorme paquete que originalmente pertenecía a un Sistema de secreción tipo 4 de Bacteroidetes (T4SS-B). El ICEEa1, además de los 12 genes que codificaban para el T4SS, también incluía: un set completo de genes para integración/escisión y conjugación bacteriana, una relaxasa, una ATPasa, la metilasa de ADN N-6 y reguladores para tetraciclinas. Si esto fuese poco, también se encontraron genes para sistemas de producción de sideróforos (para capturar hierro libre) y bombas de transporte para: cobalto, zinc, cadmio, níquel, cobre y mercurio.

La incapacidad de reparar su genoma por tener todo esto en medio del mutY, parece que generó en la cepa original muchos daños por estrés oxidativo. El tipo de mutaciones así lo indicaban, así que observar esta increíble resistencia a metales pesados cuadraba bastante con la hipótesis de que la cepa inicial evolucionó en un ambiente contaminado en la comunidad y no en hospitales.

Aunque lo más sorprendente y preocupante fue descubrir que el ICEEa1 era de “quita y pon”, la bacteria podía llevar insertado el trozo y perder su capacidad para reparar el genoma, pero a cambio convertirse en fenotipo hipermutador, adquirir resistencia a metales pesados y volverse muy patógena. Y en cualquier momento soltar el trozo para recuperar sus capacidades normales manteniendo algunas de las adquiridas. No os imaginéis algo voluntario, más bien pensad en una enorme población de bacterias que van multiplicándose y por transferencia horizontal pasándose el trozo unas a otras generando estas cepas hipermutantes de vez en cuando.

Dicho esto, a los investigadores sólo les faltaba una cosa por contar, ¿por qué se había vuelto patógena ahora si nunca había causado problemas? Pues quizás siempre lo había sido… Como ya se ha dicho muchas veces la taxonomía basada en el ADNr16S y la tipificación por métodos bioquímicos no son por si mismas suficientes, esto es algo que empieza a admitirse lentamente. Los investigadores piensan que muchas de las bacterias identificadas como Elizabethkingia meningoseptica, un típico patógeno de ambientes hospitalarios eran en realidad E. anophelis, por lo que se propuso la actualización de las bases de datos del MALDI-TOF, herramienta usada en la identificación rápida de patógenos. Y se puso en aviso a la comunidad de epidemiólogos pues trozos como el ICEEa1 podían pasar a otras bacterias distintas dejando el aviso de que una nueva epidemia es sólo cuestión de tiempo.

Este post ha sido realizado por José Jesús Gallego Parrilla (@Raven_neo) y es una colaboración de Naukas con la Cátedra de Cultura Científica de la UPV/EHU.

Referencias científicas y más información:

1.Kämpfer, P. et al. Elizabethkingia anophelis sp. nov., isolated from the midgut of the mosquito Anopheles gambiae. International Journal of Systematic and Evolutionary Microbiology 61, 2670–2675 (2011).

2.Perrin, A. et al. Evolutionary dynamics and genomic features of the Elizabethkingia anophelis 2015 to 2016 Wisconsin outbreak strain. Nature communications 8, 15483 (2017).

El artículo ¿Cómo una bacteria inofensiva de Gambia acaba generando una epidemia en Wisconsin? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La falta de hierro y cómo un pez acaba con ella

- Sobre la predisposición genética a padecer enfermedades (II)

- Sobre la predisposición genética a padecer enfermedades

Joan Wiffen (1922- 2009): Dinosauroen atzetik

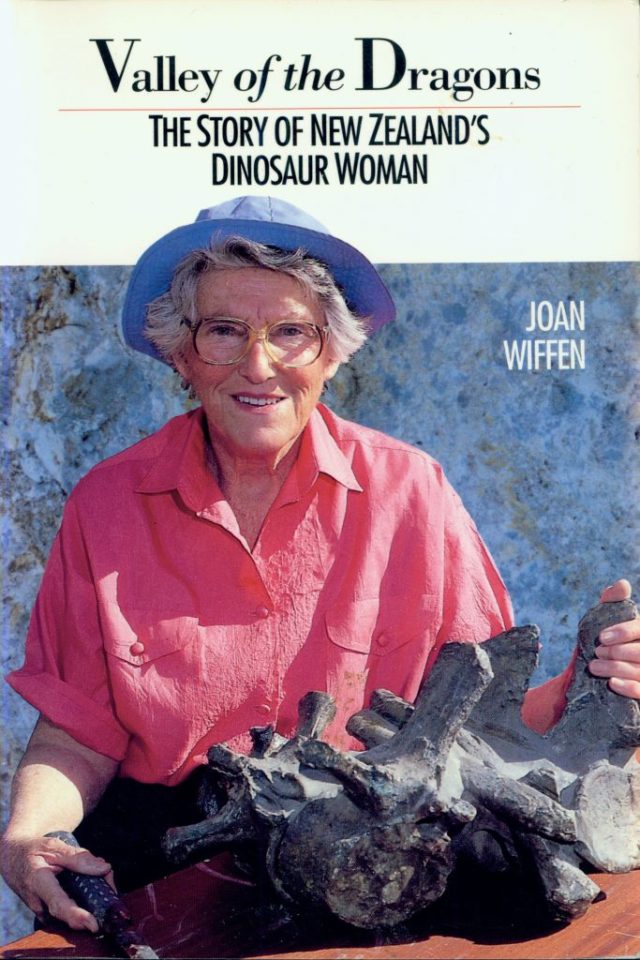

1. irudia: Joan Wiffen, Zeelanda Berriko Dinosauroen erregina. (Argazkia: John Cowpland/NZPA)

Txikitan eskola utzi behar izan zuen. Hasieratik naturarekiko lotura berezia garatu zuen, aparteko jakin-mina sorrarazten zion zientziak. Esaterako, uretako maskorrak asko gustatzen zitzaizkion eta horiek biltzeko ohitura zuen, nahiz eta txikia zenean, ez zekien zer ziren. Bigarren Mundu Gerra gertatu bitartean, bere ametsak alboratu zituen, Women’s Auxiliary Air Forcen izena eman baitzuen; bertan, 6 urtez egin zuen lan. 1953an Pont Wiffenekin ezkondu zen. Hawkeko badian landetxe bat eraiki zuten, abandonatutako etxe bat atondu eta lurra landu zuten, animaliak hezi zituzten eta bi ume eduki ere.

Liburuak tresna izan ziren zientziarekiko zuen lotura hori berreskuratzeko. Liburutegi publikoan hartzen zituenak bere seme-alabekin partekatzen zituen. Zientziarekiko jakin-mina handitzen hasi zen familia osoan. Hala, Pont Wiffenek geologian matrikulatzea erabaki zuen eta gauean antolatzen ziren klase batzuetara joaten hasi zen. Baina, gaixotu zenean, eta matrikula ez galtzearren, Joanek erabaki zuen bera joango zela klaseetara senarraren ordez. Ordu hartatik aurrera, geologiaz maitemindu zen; Lurraren historiaz eta antzinako animaliez, are zehatzago, dinosauroez.

Non gogoa, han zangoaAustraliatik barrena espedizioak egin zituen Wiffen-familiak, beti harri eta mineralak aurkitzeko asmotan. Joanen azken helburua zen dinosauroen fosilak aurkitzea lurralde horietan. Une hartan, baina, ez zekien aditu gehienek sinisten zutela Zeelanda Berrian ez zirela dinosauroak existitu, uharteak isolaturik egon zirelako denbora luzez. Charles Fleming izan zen iritzi horren aurkari bakarra. Honela zioen: “Lurraldeak ez zuen dinosauroen fosilik, inork aurkitu ez zituelako oraindik”. Hortaz, Flemingen iritziari men eginez, lurralde horietara joango zela erabaki zuen Joanek.

2. irudia: 1991. urtean Joan Wiffenek egindako aurkikuntzei buruzko liburua argitaratu zuen.

Mapa geologiko zahar bat eskuratu zuen horretarako. Bertan zehazten zen narrastien hezurrak zeudela Mangahouanga haranean. Zehazki, Te Hoe ibaian, Hawkeko badian. Sei hilabete kostatu zitzaion batetik, zehaztea non zegoen leku hori eta bestetik, esploratzeko baimena lortzea. 1972. urtean bilaketa abiatu zuen boluntario talde txiki batekin eta bere senarrarekin batera. Joanek publikatutako liburuan Valley of the dragons, zehatz azaltzen du azkar topatu zituela espedizio horretan “hortzak, ezkatak eta arrainen ornoak zituzten harriak, baita marrazoen hortzak eta mota guztietako maskorrak ere”. Urteak igaro zituen zonalde hori esploratzen. Han aurkitu zuten uretako narrasti baten hezur-fosila. Aurkikuntza hori, gerora etorriko zen arrakastaren hasiera besterik ez zen izan.

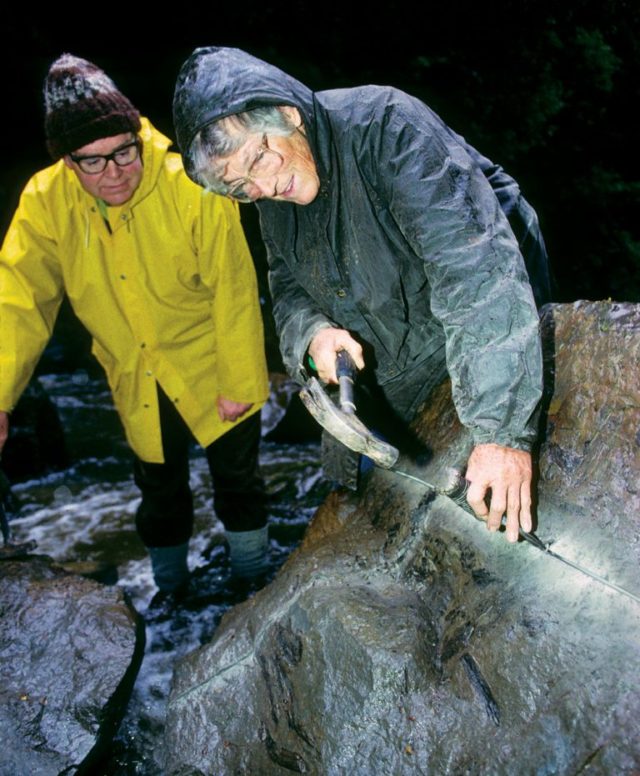

Paleontologiari ekarpena1975ean Joanek bere lehenengo dinosauro baten hezur-fosila topatu zuen Mangahouangan. Une horretan bazekien oso berezia zela hezurra, lurrean bizi zen animalia batena. Aurkikuntza, baina, fosilak identifikatzen ikasi aurretik egin zuen. Lau urteren buruan, Australian oporretan zegoela, Brisbaneko Queensland museora joan zen. Bertan, Ralph Molnar paleontologoarekin jarri zen kontaktuan. Bere bulegoan ezaguna egiten zitzaion hezur bat ikusi zuen. Molnarrek esan zion dinosauro batena zela eta Joanek erantzun zion bere etxean oso antzekoa zen hezurra zeukala. Azkenean, Molnarrek konfirmatu zuen Joanek berak aurkitutako hezurra orain dela 75 milioi urteko dinosauro teropodo baten buztanaren ornoa zela. Hala, bera izan zen lurralde horretan dinosauroen existentzia frogatu zuen lehena. Are gehiago, hezur hori haragijale batena zela ohartu zen, belarjaleena baino zailagoa aurkitzekoa dena.

1999. urtean beste aurkikuntza esanguratsu bat egin zuen. Tiranosauro baten hezurra topatu zuen. Halaxe kontatu zuen Joanek: “Sedimentuzko harri bat ikusi nuen Te Hoe ibaiaren ertzean, Rugbyko pilota baten tamaina zuena. Hondeatu nuen eta lagun bati eskatu nion mailu batekin irekitzeko. Berehalaxe ikusi nuen hezur-egitura ez zela uretako narrastien berdina”.

3. irudia: Joan Wiffen eta Ralph Molnar lanean. (Argazkia: Michael Schneider)

Aipatu moduan, autodidakta izan zen eta paleontologia arloan aurkikuntza garrantzitsuak egitera iritsi zen. Baina ez hori bakarrik. Fosilak arroketatik ateratzen ikasi zuen ere: mailuak, zizelak, esku-zerrak eta lehergailuak erabiltzen zituen. Horretaz gain, aurkitutako fosilen moldeak egiten ikasi zuen, adituei “kopiak” bidali ahal izateko. Bere ibilbide zientifikoa oparoa izan zela frogatzen duena jasotako sarien zerrenda da. 1994an, Masseyeko Unibertsitateak (Zeelanda Berria) ohorezko doktoretza eta Zientzia eta Teknologiako brontzezko dominarekin saritu zuten. Hurrengo urtean, CBE-ko (Commander of the British Empire) ohorezko titulua jaso zuen. 2004. urtean, saririk garrantzitsuena esleitu zioten: Morris Skinner Saria irabazi zuen, Estatu Batuetako Ornodunen Paleontologia Elkartearen eskutik.

Zientzia arloan ezagutzarik ez zuela leporatu zioten hainbat adituk, pentsa, dinosauroak ikusten zituen existitu ez ziren lurraldeetan. Egia esan, ez zioten bidea erraztu Joani baina aurrera jarraitu zuen. Paleontologia ikasi egin zuen eta azkenean lortu zuen, kostata, adituek osatzen zuten komunitatera sartzea. Horra hor Dinosauroen erregina.

———————————————————————–

Egileaz: Uxue Razkin Deiako kazetaria da.

———————————————————————–

The post Joan Wiffen (1922- 2009): Dinosauroen atzetik appeared first on Zientzia Kaiera.

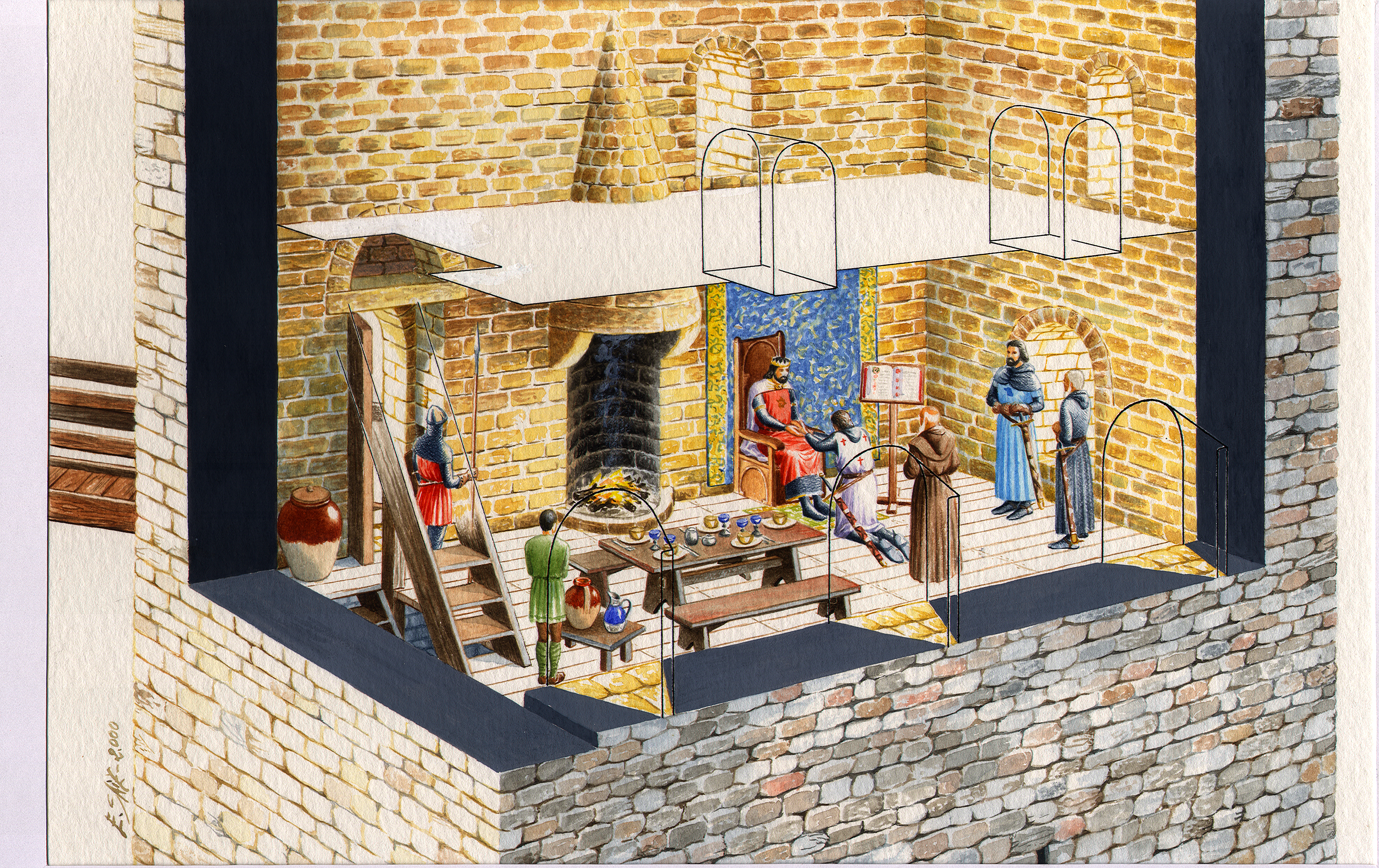

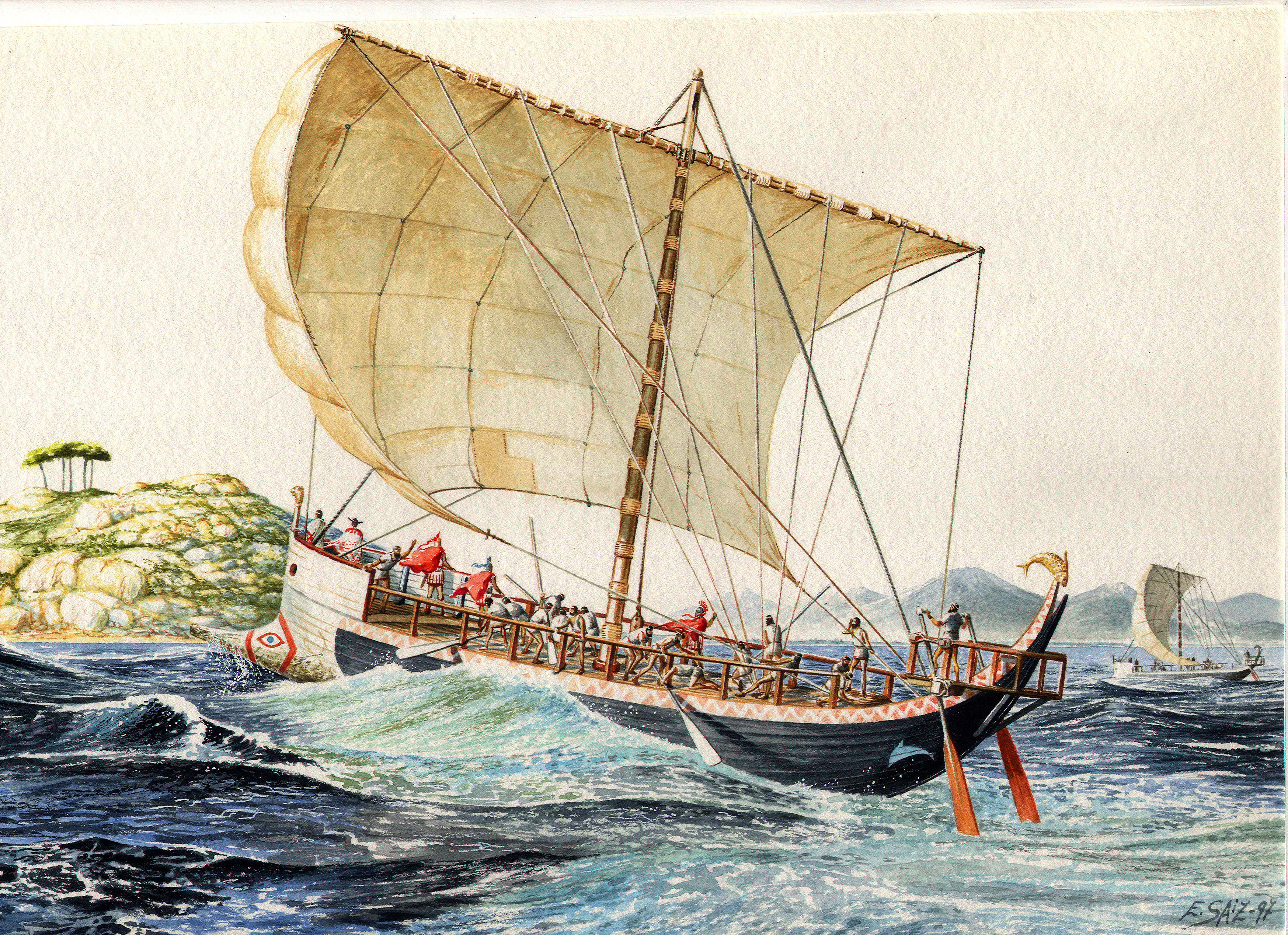

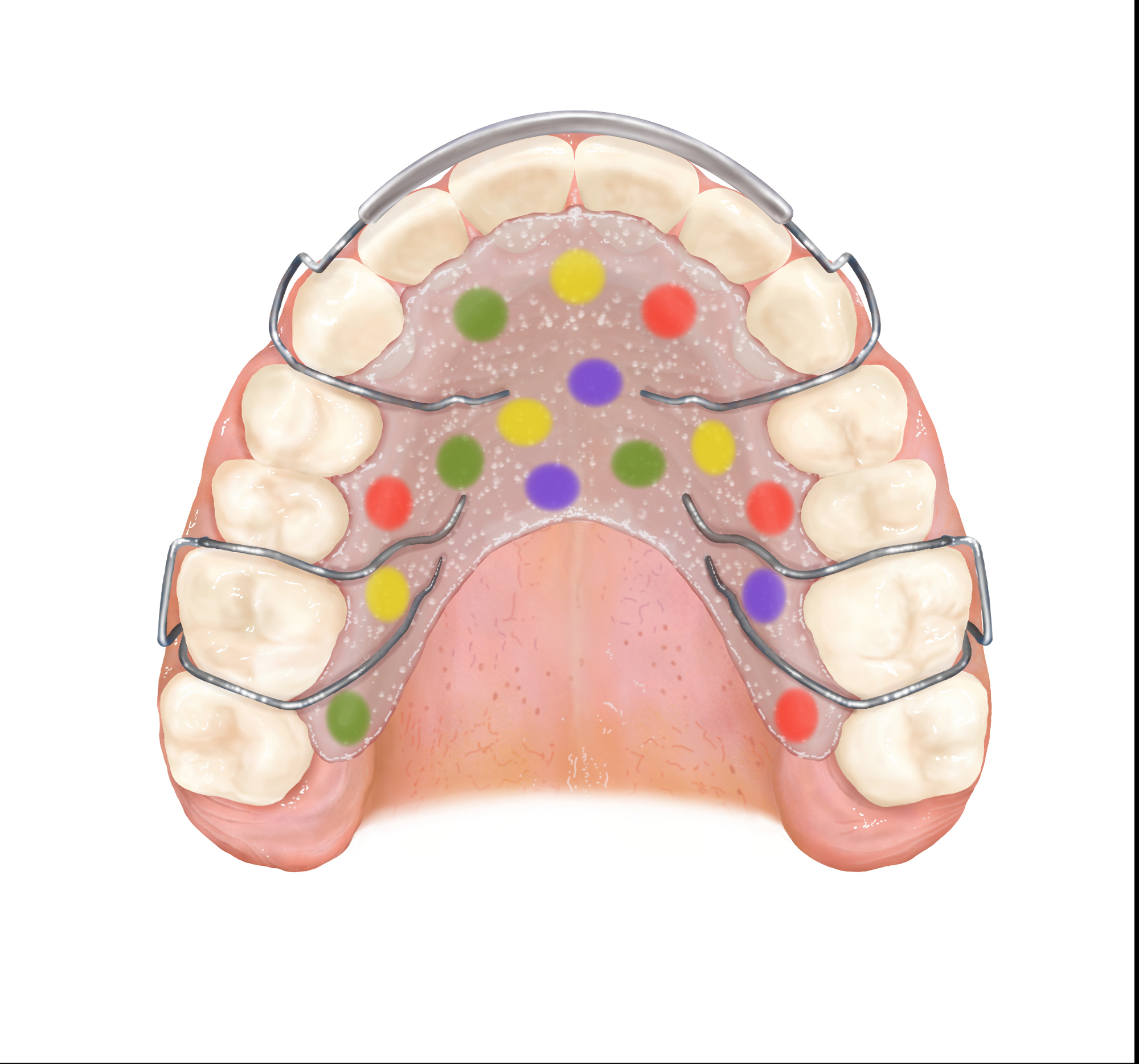

El primer postgrado en Ilustración Científica, esa profesión invisible

Vega Asensio

El ser humano es visual. Buena parte de las capacidades cognitivas de nuestro cerebro están orientadas al procesamiento de la imagen. Por ello, para comprender y comunicar la ciencia la imagen es una herramienta fundamental. Dibujos, diagramas, gráficas, ilustraciones,… no sólo están presentes en prácticamente todo artículo, libro, clase, presentación de ciencia sino que las hemos estado disfrutando desde nuestra infancia en todo tipo de formatos: enciclopedias, guías, folletos, museos, periódicos, etc. Los profesionales formados para crear estos materiales son las ilustradoras e ilustradores científicos.

Estos y estas profesionales tienen normalmente formación científica y han virado hacia la ilustración o son profesionales de las bellas artes que se han especializado en ciencia. La ciencia y el arte se unen para crear la profesión de la Ilustración Científica, una de las ramas de la comunicación científica, cuyo objetivo es comunicar la ciencia de forma visual per se o apoyando a la palabra oral o escrita.

Normalmente son profesionales autodidactas ya que la formación reglada en está disciplina es inexistente en España. Puede que este sea uno de los principales factores que hacen de la profesión de Ilustración Científica una desconocida. Pequeños talleres o cursos, principalmente relacionados con la ilustración de la naturaleza, organizados de forma esporádica por museos o ayuntamientos y que no pueden abarcan la complejidad de la disciplina, es lo que podemos encontrar.

En Europa hay muy pocos centros donde se dé formación reglada [1], aunque en estas universidades este tipo de postgrado se oferta desde hace años y se impulsa desde departamentos diferentes: bellas artes o diseño, ciencias o medicina. La universidad pionera en el mundo y una de las más prestigiosas es la Johns Hopkins (http://medicalart.johnshopkins.edu/) de Estados Unidos con más de 100 años de historia.

Sabiendo que la comunicación científica es fundamental para que la ciencia avance, la Facultad de Ciencia y Tecnología (ZTF-FCT) de la Universidad del País Vasco con el apoyo de otras facultades e instituciones oferta por primera vez un título propio de Especialista Universitario en Ilustración Científica. Toda la información referente al postgrado está en www.ehu.eus/ilustracion-cientifica.

El profesorado está compuesto por un grupo variado y equilibrado de excelentes científicos, artistas, juristas y comunicadores reconocidos y galardonados internacionalmente. Este equipo docente está fuertemente motivado para dar lo mejor de sí en este postgrado primicia.

El postgrado cuenta con el apoyo económico del museo Laboratorium de Bergara, el centro tecnológico experto en innovación marina y alimentaria AZTI-Tecnalia y la casa de material de bellas artes Colart y sigue abierto a nuevos patrocinadores que quieran embarcarse en el proyecto.

El postgrado se ofertará el año académico 2017-2018, actualmente está en periodo de prematrícula hasta septiembre y en octubre comenzarán las clases. Los requisitos para entrar en este postgrado son ser graduado o licenciado y tener conocimientos básicos de dibujo. Para garantizar la calidad en la formación del alumnado, sólo un máximo de 15 alumnos serán aceptados por año académico. Esto permitirá realizar un seguimiento individualizado de cada alumno o alumna por parte del profesorado.

El postgrado tiene 40 créditos entre clases presenciales (34,5 ECTS) y el proyecto final (5,5 ECTS) que podrá realizarse en entidades colaboradoras como museos, departamentos universitarios o centros tecnológicos, etc. y aprovechamos la ocasión para invitar a nuevos colaboradores. Estos proyectos serán de provecho reciproco entre el alumnado, que realiza prácticas reales, y estas entidades, que disfrutarán y conocerán de estos y estas profesionales y la profesión en sí misma.

El postgrado formará la primera generación de tituladas y titulados en Ilustración Científica de España. Pero pretende ir más allá y convertirse en un referente en el área de la ciencia visual, ser un nexo de unión para las ilustradoras e ilustradores científicos, dar a conocer y promocionar esta profesión al servicio de la ciencia, la tecnología y la sociedad.

Más información:

www.ehu.eus/ilustracion-cientifica

ilustracioncientifica.fct@ehu.eus

[1]

Maastricht Academy of Fine Arts and Design

Liverpool John Moores University

École Supérieure Estienne des Arts Graphiques

Zurich University of the Arts Scientific Visualization

Hochschule Luzern Design & Kunst

Medical Artists’ Education trust.

Sobre la autora: Vega Asensio, doctora en biología e ilustradora científica profesional, es la directora del título propio de Especialista Universitario en Ilustración Científica de la UPV/EHU

El artículo El primer postgrado en Ilustración Científica, esa profesión invisible se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La ciencia moderna y la Ilustración

- Planeta X, en busca del inquilino invisible del sistema solar

- Science + : 1 – La carrera científica I: el doctorado y la investigación académica”

Errar es humano, y científico

Por un clavo se perdió una herradura; por una herradura se perdió un caballo, por un caballo se perdió un reino. A veces los más pequeños detalles puede echar a perder todo un complejo edificio teórico (hermosas teorías asesinadas por feos e insignificantes datos), o dificultar la comprensión de un fenómeno durante décadas. El último caso célebre es justo lo contrario: localizar un error de calibración de un instrumento en un satélite ha permitido dar sentido a un incomprensible dato que se interponia ante la aceptación de un proceso en marcha. Como tal se convertirá seguramente en polémica y se discutirá ferozmente, ya que se trata de un tema políticamente candente como es el calentamiento global. Pero sobre todo subraya una realidad de la práctica científica que a veces no se entiende bien desde fuera: la ciencia no es perfecta, y lo sabe: por eso jamás es permanente y siempre está en proceso de mejora.

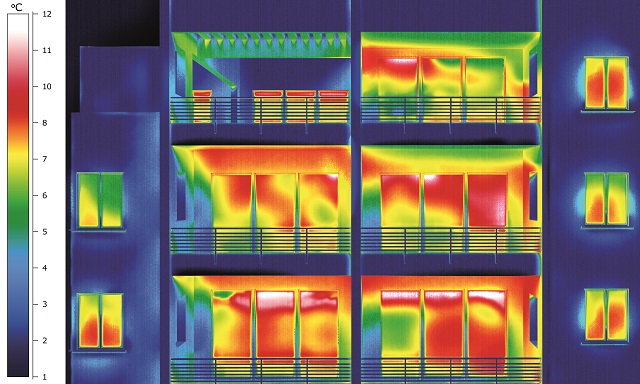

En este caso se trataba de explicar el hecho de que una serie de satélites puestos en órbita para medir, con precisión milimétrica, el nivel del mar en el planeta mostraban datos que no encajaban con otros fenómenos conocidos. En la superficie de la Tierra abundan los indicios de que el sistema océano-atmósfera se está haciendo más cálido, con sus lógicas consecuencias que incluyen el retroceso de los glaciares y por tanto el vertido a los mares de mayores cantidades de agua. Se daba por supuesto que esto causaría un aumento del nivel global del mar, y para medirlo con precisión se diseñaron, construyeron y pusieron en órbita estos satélites. Y sin embargo los datos mostraban que el nivel del mar no estaba subiendo; de hecho incluso podría estar bajando en algunos lugares. Un regalo para los negacionistas del cambio climático, y un quebradero de cabeza para los científicos, porque no hay nada que incordie más a una mente que dos juegos de datos incompatibles sobre el mismo fenómeno.

En un artículo recién publicado un grupo de climatólogos han llegado a la conclusión de que un error de calibración del primero de los satélites lanzados ha provocado un sesgo sistemático en las medidas de todos los que vinieron después, contaminando esos datos. Al eliminar este factor de distorsión y corregir otros errores sistemáticos el resultado encaja mucho mejor con el resto de los datos sobre el calentamiento global: el nivel del mar aumenta, y lo hace a ritmo creciente. Las líneas de tendencia ahora encajan con las que muestran otras fuentes de información. La discrepancia ha desaparecido.

La ciencia trabaja con la suposición de que toda hipótesis debe ser confirmada y de que toda medida es susceptible de contener errores. Por eso se desarrollan complejos e ingeniosos sistemas para poner a prueba las hipótesis, y por eso se trabaja denodadamente en localizar y eliminar, a ser posible de antemano, cualquier fuente de error. Por eso también la práctica científica puede ser frustrante cuando diminutas imperfecciones ajenas a propio científico (errores del instrumental, fallos en la composición de los reactivos, pequeñas catástrofes como congeladores desenchufados, etc) echan a perder un experimento en el que se puede llevar trabajando meses, o incluso años. El método científico da por supuesto que todo puede fallar, desde el equipo a los materiales estudiados e incluso el propio científico, y por eso sistemáticamente trabaja para eliminar toda fuente de error.

Algo que, por supuesto, es imposible, porque los científicos son humanos y errar también lo es. Por eso el método científico incorpora el reconocimiento de los errores entre sus herramientas: porque la gente que practica ciencia es consciente de que hay que luchar con denuedo contra los fallos, pero también de que esa lucha puede fácilmente terminar en derrota. Los errores se cuelan en los experimentos, tanto más en cuanto que los actuales aparatos y sistemas de investigación tienen una sensibilidad mucho más elevada que antaño y los fenómenos que se estudian están mucho más cerca del umbral del ruido. Los errores son inevitables, y aunque el científico hace lo que puede por mantenerlos a raya, sabe que nunca podrá estar seguro del todo de haberlo conseguido.

Por eso la ciencia aprende, y cuando se detecta y corrige el error el nuevo dato se incorpora al acervo científico sin demora. Esto a veces supone cambiar teorías completas o adaptar partes de hipótesis tenidas por ciertas durante mucho tiempo, algo que resulta desconcertante desde fuera. A veces puede dar la impresión de que los científicos no tienen bemoles intelectuales; que hoy están dispuestos a confiar en una teoría que ayer consideraban rechazable. Pero no se trata de volubilidad o de falta de principios, sino de honestidad intelectual. La ciencia actúa como un sastre, ajustando sus hipótesis y teorías lo más posible a la realidad; a veces se descubre un desgarrón en la tela o un deshilado, y entonces hay que rehacer el patrón en una parte concreta. El proceso es continuo y no se trata de tropezones, sino de avances sucesivos: en cada prueba el traje ajusta mejor a la realidad del cosmos. Así es como la ciencia avanza: eliminando sus errores y cambiando, cuando es preciso, de opinión. Un empeño humano por antonomasia.

Sobre el autor: José Cervera (@Retiario) es periodista especializado en ciencia y tecnología y da clases de periodismo digital.

El artículo Errar es humano, y científico se ha escrito en Cuaderno de Cultura Científica.

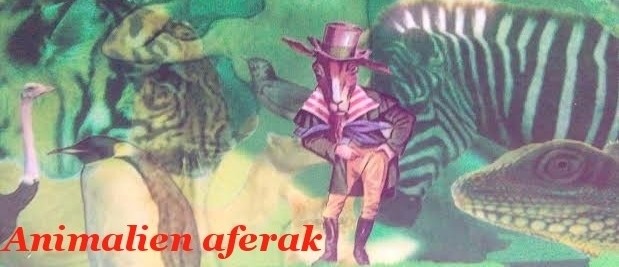

Entradas relacionadas:Erreginatxo marraduna

Juan Ignacio Pérez eta Miren Bego Urrutia Janaria

Juan Ignacio Pérez eta Miren Bego Urrutia Janaria ———————————————————————————————————–

Jakin-min handia sortu dute, betidanik, hegazti migratzaileek. Bizi-baldintzak oso gogorrak diren tokietan ugaltzen diren espezie askok latitude bigunagoetara migratzen dute negua igarotzera. Latitude altuetan janari ugari dago udan eta uda inguruko hilabeteetan, eta, gainera, ingurune-tenperatura egokia da. Negua eta neguaren inguruko hilabeteak, berriz, oso gogorrak: janari gutxi dago, edo ezer ere ez, eta bizirik irautea bera ere ezinezkoa izan daiteke muturreko tenperatura hotzetan.

1. irudia: Hegazti-saldo migratzailea.

Txori txikientzat bereziki gogorrak dira latitude altuetako bizi-baldintzak. Txori txikiek handiek baino bero gehiago galtzen dute masa-unitateko, eta horregatik janari gehiago behar dute. Ez da harritzekoa, beraz, latitude altuetako txoriak migratzaileak izatea. Baina migratzea oso gogorra da. Scott McWilliams ikertzaile estatubatuarrak ikerketa interesgarriak egin ditu txori migratzaileei buruz, eta hemen laburbilduko ditugu berak lorturiko emaitzak.

Txoriek gantza eta proteinak pilatzen dituzte migrazioa prestatzeko. Migratzen hasi baino lehen gehiago jaten dute eta, gainera, proteina eta gantzetan aberatsak diren jakiak aukeratzen dituzte. Lau bider gehiago jan dezakete migratu aurreko egunetan, eta horretarako, handitu egiten dute digestio-sistemaren edukiera, handitu barik ezingo lukete-eta horrenbeste jan. Ingurune-seinale batek, fotoperiodoak, abiarazten du digestio-sistemaren edukiera handitzeko prozesua. Izan ere, egunaren argi-ordu kopuruaren aldaketa esperimentalen bidez piztu ahal izan dira laborategian gatibu mantenduriko txorien digestio-sistemaren handitzea eta ingestio-tasaren igoera. Hortaz, egun-argiaren iraupenaren sasoi-aldaketek sorturiko aldaketa endokrinoak dira gehiago jatearen, loditzearen eta gauaz hegan egiteko joeraren bitartekoak.

Beharrezkoak izango zaizkien proteinak eta gantzak metatu ondoren, txoriek migratze-bidaiari ekiten diote ugaltze-aldeetatik negua igarotzeko aldeetara joateko. Migrazioan zehar, hegaldi eta geldialdi zenbait txandakatzen dituzte latitude epeletako txori migratzaile gehienek. Beraz, energia eta elikagai erreserbak berreraikitzeko aukera dute geldialdietan, baina zenbait kasutan malgutu egin behar dute elikatze-portaera. Izan ere, txori intsektujale batzuk fruta jatera aldatzen dira geldialdietan, intsektu gutxi dauden tokietan fruta janez arinago lor baitezakete behar duten energia.

Hego Amerikan reinita rayada edo chipe gorranegra izenez ezaguna den Dendroica striata dugu aipatzeko moduko txoria. Txikia da: 14 cm-ko luzera du eta 12 g-ko pisua Ipar Amerikatik Erdialdeko Amerikara edo Hego Amerikako iparraldera migratzen du, eta bidaiaren zati handi bat Atlantikoaren gainetik egiten du. Bataz beste, 3.000 km-ko distantzia egiten du itsasoaren gainetik, eta horrek esan nahi du 88 orduko hegaldi etengabea egin behar duela. Bidaiaren eskakizun-maila, beraz, oso altua da, eta horren araberakoak dira txori horrek erakusten dituen moldaera fisiologikoak: batetik, migratzen hasi baino lehen, bere masa bikoiztu egiten du oso denbora laburrean (aste batean egin dezake), gantz- eta proteina-erreserbak metatuz. Bestetik, digestio-sistema atrofiatu egiten zaio hegaz egiten hasten denean. Digestio-aparatua oso aktiboa da, metabolismoa oso altua, eta, beraz, energia asko kontsumitzen du. Hori dela eta, eta 88 ordutan ezertarako ere erabili behar ez duenez, hobe du ahalik eta gutxien gastatzea aldi horretan. Horregatik atrofiatzen du digestio-sistema, atrofiaturik askoz gutxiago gastatzen duelako eta horrela aurrezten duen energia hegaz egiteko erabil dezakeelako.

2. irudia: Dendroica striata txoria. (Cephasen argazkia).

Aurkako bakarra du horrela jokatzeak. Izan ere, hegaldia bukatu eta berehala ezin du galdutako energia berreskuratu, digestio-sistemak egun bat edo bi baino gehiago behar baitu janaria berriro digeritu eta xurgatu ahal izateko. Hala ere, Dendroicak etekin argia ateratzen dio jokabide horri, migrazioa bukatu ostean galdutakoa berreskuratzeko denbora sobera baitu.

Izugarria da, bai, txori txiki horren digestio-sistemaren malgutasuna: migratu aurretik handitu egiten du, haren edukiera fisiko eta funtzionala nabarmenki emendatuz; migratzen hasterakoan, atrofiatu egiten du, baliabiderik xahutu ez dezan; eta migratu ostean funtzional bihurtzen du berriro ere.

—————————————————–

Egileez: Juan Ignacio Pérez Iglesias (@Uhandrea) eta Miren Bego Urrutia Biologian doktoreak dira eta UPV/EHUko Animalien Fisiologiako irakasleak.

—————————————————–

Artikulua UPV/EHUren ZIO (Zientzia irakurle ororentzat) bildumako Animalien aferak liburutik jaso du

The post Erreginatxo marraduna appeared first on Zientzia Kaiera.

Un observador cuántico de lo más útil

De todos es conocida la aparente paradoja del gato de Schrödinger, en la que el papel del observador humano determina el destino del gato encerrado en la caja. Sin embargo el papel del observador en mecánica cuántica es real. Tanto que un grupo de investigadores, encabezado por Robert Biele, de la Universidad del País Vasco (UPV/EHU) ha conseguido controlar los flujos térmicos y eléctricos en un dispositivo de tamaño nanoscópico por medio de observaciones cuánticas locales.