Ezjakintasunaren kartografia #289

Lurra laua dela uste dutenak ez dira ezjakinak, geneetan daramate. Literalki. Mikael Klintmanen Conspiracy theories: how belief is rooted in evolution – not ignorance

Lurraldean zelan zabaltzen den ezagutzea ezinbestekoa da espezie inbatitzailea bera eta eragiten dituen ingurugiro kalteak eta kalte ekonomikoak kontrolatzeko. Altitudea bezalako faktore geografiko fisikoak kontuan izan behar ditu eredu on batek. BCAMenparte hartzea izan duen hau bezala: A model for the spread of invasive species that brings the landscape into the equation

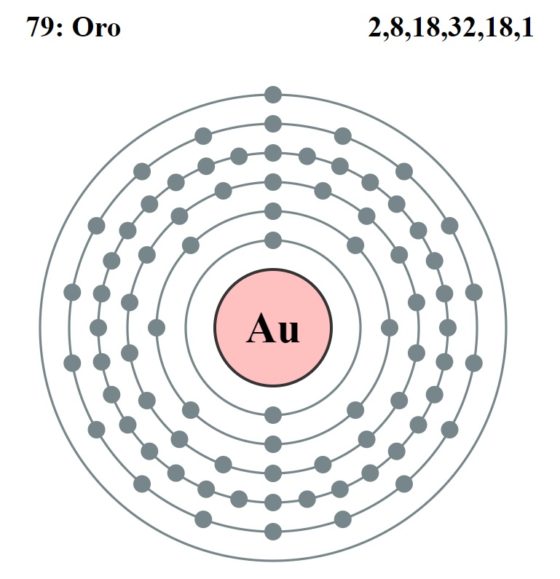

Substantzia batzuen jokaera optiko ez lineala beste batzuen, urrea edo zilarra bezala, plasmoiekin konbitatu daiteke azken belaunaldiko mikroespektroskopioen sentsore-puntak sortzeko, sistema bizien egitura sekretuak eta sekretu kimikoak argitzeko gai direnak. DIPCren Next generation nanoprobes for the microspectroscopic study of biosystems

–—–

Mapping Ignorance bloga lanean diharduten ikertzaileek eta hainbat arlotako profesionalek lantzen dute. Zientziaren edozein arlotako ikerketen azken emaitzen berri ematen duen gunea da. UPV/EHUko Kultura Zientifikoko Katedraren eta Nazioarteko Bikaintasun Campusaren ekimena da eta bertan parte hartu nahi izanez gero, idatzi iezaguzu.

The post Ezjakintasunaren kartografia #289 appeared first on Zientzia Kaiera.

Un aislante topológico intrínsecamente magnético

Un cristal de telururo de bismuto y manganeso, el primer aislante topológico magnético predicho y confirmado. Foto: A. Isaeva, TU Dresden/IFW Dresden

Un cristal de telururo de bismuto y manganeso, el primer aislante topológico magnético predicho y confirmado. Foto: A. Isaeva, TU Dresden/IFW DresdenLos materiales llamados aislantes topológicos son aquéllos que no dejan pasar la corriente eléctrica en su volumen, pero sí sobre su superficie. A diferencia de los conductores habituales, como los metales, la corriente no sufre ninguna pérdida de energía al circular en la superficie de un aislante topológico. Esta propiedad abre grandes posibilidades de aplicación en electrónica, pues facilitaría la fabricación de dispositivos más eficientes y rápidos, propiedades muy deseables habida cuenta del rápido avance de la demanda energética mundial asociada a la electrónica. No es de extrañar, por tanto, que el descubrimiento de los aislantes topológicos hace aproximadamente una década causase que la investigación en nanotecnología y en física de la materia condensada dedicase buena parte de sus recursos a ellos.

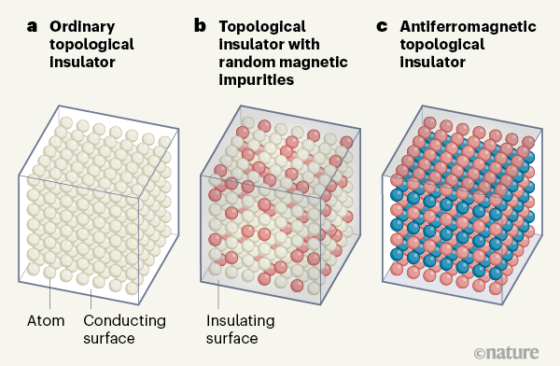

Uno de los retos durante estos años de intensa investigación, por las aplicaciones tecnológicas que podría tener en las tecnologías de la información, por ejemplo, ha sido la creación de un aislante topológico magnético. Hasta hace poco el magnetismo se introducía en los aislantes topológicos no-magnéticos exclusivamente por la llamada vía extrínseca, que consiste en añadir átomos que confieren propiedades magnéticas. Sin embargo, gracias al esfuerzo de un grupo de investigadores del Centro de Física de Materiales (CFM, centro mixto CSIC-UPV/EHU), el Donostia International Physics Center (DIPC) y la Universidad del País Vasco (UPV/EHU) ahora ya es posible fabricar un aislante topológico magnético intrínseco, esto es, que tiene propiedades magnéticas por su propia naturaleza. Los resultados se han publicado en Nature y han merecido un análisis en News & Views.

Fuente: Nature

Fuente: NatureEl equipo formado por los investigadores Mikhail Otrokov, Evgueni Chulkov, María Blanco Rey y Pedro M. Etxenike, ha logrado predecir teóricamente el primer aislante topológico magnético, el telururo de bismuto y manganeso, de fórmula química MnBi2Te4. El investigador Ikerbasque y líder del estudio, Mikhail Otrokov, afirma que «el trabajo previo desde diferentes enfoques nos llevó a la conclusión de que la ruta intrínseca era la única viable hoy en día. Entonces dirigimos nuestros esfuerzos a encontrar un aislante topológico magnético intrínseco basándonos en experiencias previas, gracias a las cuales supimos qué estructura cristalina y composición atómica debía tener tal material».

La confirmación experimental de la predicción ha sido un trabajo que ha involucrado a investigadores expertos en distintas áreas de centros de investigación de referencia de Rusia, Azerbaiyán, Alemania, Austria, Japón, Italia y los EE.UU, coordinados por los investigadores de los centros vascos. Otrokov ha explicado que para la confirmación experimental la primera tarea fue la síntesis de los cristales del compuesto por parte de los expertos en síntesis química. Una vez sintetizadas, las muestras fueron sometidas a multitud de experimentos de caracterización estructural, magnética, electrónica, de transporte, de composición atómica, etc. que han permitido verificar las características predichas.

«El MnBi2Te4 además de ser un aislante topológico con propiedades magnéticas intrínsecas, ha resultado ser un material antiferromagnético, tal y como habíamos calculado», explica Blanco. El antiferromagnetismo consiste en un orden magnético a escala atómica tal que el material carece de magnetización neta. Por ello estos materiales son mucho más robustos frente a perturbaciones por imanes.

El telururo de bismuto y manganeso tiene un gran potencial tanto a nivel fundamental como a nivel tecnológico. Es extraordinariamente rico en propiedades exóticas, como, por ejemplo, varios efectos de Hall, incluido el efecto Hall cuántico, algunos de los cuales se utilizan en la calibración de constantes físicas por su excepcional precisión. El MnBi2Te4 también se puede usar para la creación de los llamados fermiones de Majorana. Un tipo de partícula que se ha llegado a considerar la piedra angular de la computación cuántica. Asimismo, el MnBi2Te4 es el primer material intrínseco para el que se predice una respuesta electromagnética muy similar a la de un axión, una hipotética partícula postulada en el marco de la cromodinámica cuántica, que es buena candidata para resolver el problema de la materia oscura. Por ello se están diseñado muchos experimentos dirigidos precisamente a la detección de señales de un comportamiento de tipo axión en la familia de este compuesto.

Los resultados del estudio, que ya habían sido publicados en arXiv y difundidos en charlas impartidas por los autores en congresos internacionales, han sido bien recibidos por la comunidad científica internacional. A día de hoy el MnBi2Te4 y otros materiales basados en él se están estudiando en decenas de centros de investigación, siendo los radicados en EE.UU. y China los que muestran una actividad más intensa.

Ya se han patentado ya varios dispositivos basados en los aislantes topológicos magnéticos. Así, el MnBi2Te4 puede ser utilizado en las interconexiones quirales de los circuitos integrados, que prometen un rendimiento superior a las conexiones de cobre ordinarias que se emplean actualmente en los circuitos disponibles comercialmente. Otras aplicaciones incluyen moduladores ópticos, sensores de campo magnético y elementos de memoria.

Los investigadores, junto a su red de colaboradores internacionales, esperan poder observar en el MnBi2Te4 algunas de las exóticas propiedades mencionadas y descubrir nuevos aislantes topológicos magnéticos intrínsecos con características incluso superiores que las del propio MnBi2Te4.

Referencia:

M. M. Otrokov, I. I. Klimovskikh, H. Bentmann, D. Estyunin, A. Zeugner, Z. S. Aliev, S. Gaß, A. U. B. Wolter, A. V. Koroleva, A. M. Shikin, M. Blanco-Rey, M. Hoffmann, I. P. Rusinov, A. Yu. Vyazovskaya, S. V. Eremeev, Yu. M. Koroteev, V. M. Kuznetsov, F. Freyse, J. Sánchez-Barriga, I. R. Amiraslanov, M. B. Babanly, N. T. Mamedov, N. A. Abdullayev, V. N. Zverev, A. Alfonsov, V. Kataev, B. Büchner, E. F. Schwier, S. Kumar, A. Kimura, L. Petaccia, G. Di Santo, R. C. Vidal, S. Schatz, K. Kißner, M. Ünzelmann, C. H. Min, Simon Moser, T. R. F. Peixoto, F. Reinert, A. Ernst, P. M. Echenique, A. Isaeva and E. V. Chulkov.(2019) Prediction and observation of an antiferromagnetic topological insulator. Nature doi: 10.1038/s41586-019-1840-9

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Un aislante topológico intrínsecamente magnético se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La teoría de bandas de los sólidos se hace topológica

- Superelasticidad nanométrica

- Trayectorias de las partículas cargadas en un campo magnético

Mary Allen Wilkes: abokatu izan nahi zuen (eta lortu zuen) informatikari aitzindaria

1. irudia: Mary Allen Wilkes lanean 1960. urtean (Iturria: Mujeres con Ciencia bloga)

Beharbada Wilkesen istorioa ez da ohikoena. Historian zehar, zientzialari gehienek txikitatik aurkitu dute euren bokazioa, eta horri eutsi diote, gustuko zutena ofizio bilakatu duten arte. Ez zen hori Wilkesen kasua izan, ordea. Berak ez zuen programatzailea izan nahi, abokatua baizik, baina gurasoek ez zioten utzi. “Oso zaila da abokatu gisa lan egitea emakumea bazara”, esan zioten. Hori entzun zuenean, zur eta lur gelditu zen, baina berehala eman zion buelta egoerari. Informatika arloan murgildu zen eta alor horretan bide-urratzaile bihurtu zen Laboratory INstrument Computer (LINC)-ko LAP6 sistema eragilearen diseinuari esker, lehenengo ordenagailu pertsonalaren aitzindari. Gainera, etxetik ordenagailu batekin lan egin zuen lehen pertsona izan zen.

Lengoaia bat deskodetzea helburuMary Allen Wilkes Chicagon jaio zen, 1937an. 1959an Filosofian graduatu zen, Wellesleyko Unibertsitatean. Abokatu izateko ametsa zapuztu egin zitzaion, eta informatikaren munduan sartzea erabaki zuen. MITeko Lincoln Laborategian hasi zen lanean, eta 1963ra arte eutsi zion karguari. Lehenik, ahotsa ezagutzeko sistema bat garatu zuen eta ondoren, zulatutako txarteletan buru-belarri aritu zen denbora batez; haren esanetan, lan “neketsua baina dibertigarria” izan zen. Izan ere, txartelek izan zitzaketen akatsak aurkitzeaz arduratzen zen.

Garai horretan, hainbat sistema eragile diseinatu zituen, besteak beste, LINCarena, hasieran LAP (LINC Assembly Program) izenaz bataiatu zuena, eta ondoren LAP6 bihurtu zena. 1964an, LINCa garatu zuen taldea Washingtongo Unibertsitatera joan zen, San Luisera (Missouri). Alabaina, Wilkes ezin izan zen hara joan, bere ama gaixo zegoenez eta Baltimorren bizi zenez, ez baitzuen bakarrik utzi nahi izan. Gauzak horrela, taldeak erabaki zuen LINCa –hozkailu baten tamainakoa– bere etxera bidaltzea, ordenagailuaren eta telefono baten laguntzaz etxetik lan egin zezan. 1965ean, bere etxeko egongelan zegoela, LAP6 sistema eragilea garatu zuen, eta, beraz, etxean ordenagailu bat erabili zuen lehen pertsona izan zen.

2. irudia: Mary Allen Wilkes 2017. urtean, 1963ean garatu zuen ordenagailu pertsonalarekin. (Argazkia: Imago/EDP/Werner Krueper)

Programazioari buruz noziorik ez zuten pertsonak ordenagailua erabiltzeko gai izatea zuen helburu Wilkesek. Horren gainean, honako hau esan zuen: “Ikasteko denbora behar da, oso sofistikatua delako programa, baina irakats daiteke”. Eskuliburu bat idatzi zuen horretarako: LAP6 Handbook. Eta beste liburu baten egilekide ere izan zen: Linc-a programatzen.

AEBtako Buru Osasuneko Institutu Nazionala lehena izan zen LINCa erabiltzen, hain justu, katu baten erantzun neuronalak aztertzeko erabili zuten. Wilkesek laborategietako ikertzaileei erakutsi zien nola instalatu behar zuten, eta nola erabili ondoren.

Programatzailea izatetik, abokatua izateraOso jende gutxi ausartzen da norabidea aldatzen dena ondo doakionean. Gauzak ondo doazenean, ezer gutxi aldatzen dugu eta ez zaigu gustatzen bat-bateko erabakiak hartzea, badaezpada ere. Are gutxiago informatikan aitzindari bihurtzen bazara. Karmelo C. Iribarrenek Diario de K liburuan dio “aldaketa baten beharrean nago” esaldiarekin tragedia asko hasten direla. Wilkesentzat ez zen hala izan. Inoiz ez zion bere ametsari uko egin, zientzia konputazionalaren alorrean izandako arrakastak ez zuen abokatu bihurtzeko bere gogoa itzali. Haren arabera, informatikan aritzea “zoragarria” izan zen eta zoriontsu izan zen lortu zuen guztia ikusita. Baina berak aspaldiko amets bat zuen buruan bueltaka.

Agian gurasoek Zuzenbidea ikastea debekatu zioten egun hura gogoratu zuen, lanbide horretan emakumeek ez zutela beren lekua aurkituko argudiatu zutenean. Duela urte batzuk MITen aurkeztu zen ausardi berarekin agertu zen Harvarden; Zuzenbideko ikasketak hasi zituen, eta erretiroa hartu zuen arte abokatu gisa lan egin zuen. Wilkesentzat tragedia ez saiatzea izango litzateke.

Iturriak:

- Wikipedia: Mary Allen Wilkes.

- Mujeres con ciencia: Mary Allen Wilkes, programadora.

- Sánchez, Cristina (2016). La madre del teletrabajo: “Fui la primera que tuvo un ordenador personal en casa”, El Diario, 2016ko irailaren 5a.

———————————————————————–

Egileaz: Uxue Razkin (@UxueRazkin) kazetaria da.

———————————————————————–

The post Mary Allen Wilkes: abokatu izan nahi zuen (eta lortu zuen) informatikari aitzindaria appeared first on Zientzia Kaiera.

La ciencia de llorar a gusto

Composers have a gift, as Barber did, for confirming with music what we already know—sad music intensifies sadness, and in that intensity, solace is somehow provided. [*]

The saddest music ever written, Thomas Larson, 2010.

Los humanos somos unos monos muy raros. A veces, cuando nos duele algo, goteamos. Pongamos que se nos ha muerto un cactus, que nuestro gato nos deja, que nos pillamos un dedo con la puerta. Entonces, una glándula de la región externa del ojo empieza a liberar un líquido salado lleno de proteínas, agua, moco y grasa. Este líquido, más conocido como lágrimas, fluye por la superficie del ojo y se desprende desde las pestañas hasta que, además de goteras, tenemos la cara roja, la nariz congestionada, el rímel como si lo hubiese aplicado Jackson Pollock…

A priori, no parece una reacción especialmente provechosa y, para colmo, los humanos somos la única especie que produce las llamadas lágrimas psíquicas o emocionales1. En su tercer libro sobre teoría evolutiva, La Expresión de las Emociones en el Hombre y los Animales (1872), Charles Darwin llegó a afirmar que este tipo de lágrimas son “inútiles”. Por suerte, algo hemos aprendido desde entonces.

Para empezar, hoy sabemos que no todas las lágrimas son iguales. Las lágrimas emocionales son solo un tipo. Las producimos cuando sentimos emociones intensas, principalmente dolor, pero también con la risa y la felicidad. Existen además lágrimas reflejas o irritativas, que son las que derramamos al ver sufrir a una cebolla o si se nos mete algo en el ojo. Y aunque desde fuera puedan parecer iguales, al microscopio las diferencias se vuelven evidentes. Si bien todas contienen lípidos, metabolitos, electrolitos y enzimas, las lágrimas emocionales tienen además una mayor cantidad de proteínas y hormonas que no se encuentran en el caso de las reflejas. En concreto, se encuentran sustancias relacionadas con la respuesta al estrés y al dolor, como la Encefalina (un anestésico natural) y la Adrenocorticotropa (un trabador de lenguas artificial), que podrían tener un efecto autorregulador. Eso explicaría por qué a veces uno se encuentra mejor después de una buena llorera.

Y para el profesor David Huron explicaría también, por qué disfrutamos de la música triste2: “Cuando una persona está en un estado triste, esta hormona llamada prolactina se libera y tiene un efecto psicológico de consuelo”. Es como si nuestro cuerpo tuviese un mecanismo para que la tristeza y el dolor no se agudicen demasiado, no alcancen ciertos límites que nos incapaciten. Ahora bien, es posible sentir esta sensación de alivio incluso en situaciones donde no existe ningún duelo real. Y una de esas situaciones se da cuando escuchamos música. “La música triste nos pone en un estado de duelo. Pero al final del día, ¡nada terrible ha sucedido!”, no se nos ha muerto el cactus, no nos ha dejado el gato, no hay restos de dedo en ninguna puerta. Por ello, afirma Huron, “sí es posible llorar a gusto, gracias a la música”.

Sin embargo, esta hipótesis sobre el llanto no es la única ni tampoco la más explicativa3. Si bien las lágrimas desencadenan una respuesta fisiológica, su función principal es actuar como señal. Los ojos con goteras, la nariz congestionada, la cara hinchada y salpicada como un Pollock… todos estos síntomas combinados comunican a otros Sapiens un mensaje claro y directo: “Socorro, necesito ayuda”.

En ese sentido, el llanto es muy distinto de la apacible tristeza. Mientras la tristeza deja ver indicios que pueden llegar a confundirse con otros estados fisiológicos (como el cansancio), el llanto es una señal explícita, su función es comunicar y por ello se vale de varios canales, para resultar más evidente e inequívoca. Cuando lloramos, no sólo goteamos; también vocalizamos de una manera muy peculiar: nuestra garganta se tensa, nuestra voz se agudiza, emitimos sonidos vibrantes y ruidosos, a veces sostenidos en el tiempo —notas largas que languidecen y se rinden hacia el grave—, otras veces, entrecortados en forma de sollozo. Nada que ver con los sonidos de la tristeza.

Algunos estudios muestran que, cuando vemos a alguien llorar, se activa en nosotros automáticamente una respuesta de empatía y compasión por los demás. ¿Quizás sucede lo mismo cuando oímos a un violín llorar?

Referencias:

1Asmir Gračanin, Lauren M. Bylsma, Ad J. J. M. Vingerhoets. “Why Only Humans Shed Emotional Tears”. Humane Nature, 2018.

2David Huron. “Why is sad music pleasurable? A possible role for prolactin”. Musicae Scientiae, 2011.

3Michael Trimble. “Why humans like to cry: Tragedy, evolution and the brain”. 2012

Nota:

[*] Los compositores tienen un don, como lo tenía Barber, para confirmar con música lo que ya sabemos; la música triste intensifica la tristeza, y en esa intensidad, de alguna manera, se proporciona consuelo. [Traducción de César Tomé López]

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo La ciencia de llorar a gusto se ha escrito en Cuaderno de Cultura Científica.

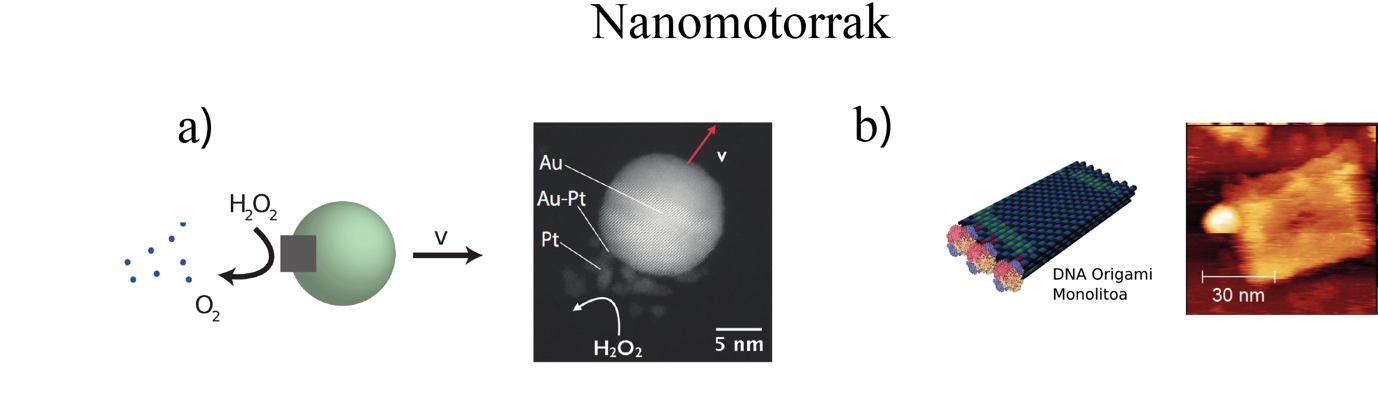

Entradas relacionadas:DNAren nanoteknologia eta materia aktiboaren auto-antolakuntza

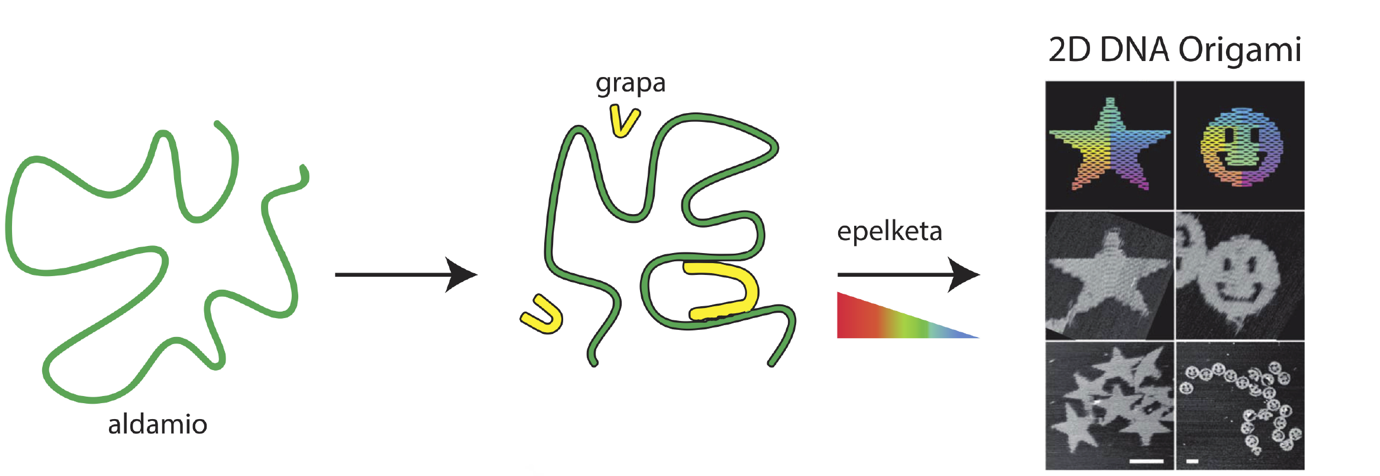

1. irudia: DNAren molekulen auto-antolaketa gaitasunari esker, base-sekuentzia batean programatu dezakegu 3D-ko edozein egitura eta hau behetik gora (bottom-up) eraiki.

DNA garrantzi biologiko handiko molekula da, honek gordetzen baitu proteinak sortzeko beharrezkoa den informazio genetikoa. Azken urteotan ingeniaritza genetikoan aurrerapauso handiak eman dira. CRISPR/Cas9 bezalako teknologiei esker, genoma editatzea nabarmenki erraztu da eta ondorengo belaunaldiko sekuentziazioak (NGS) DNA masiboki irakurtzea (sekuentziazioa) ahalbidetu du. DNAren manipulazioak aukera handiak eskaintzen ditu medikuntzaren arloan, diagnosi eta terapia berriei ateak irekiz.

Testuinguru genetikoaz gain, DNA fisika eta nanoteknologia arloekin guztiz loturik dagoen molekula ere bada. Rosalind Franklin kristalografoaren 1952ko X izpien difrakzio bidezko DNAren lehen irudiek, molekula honen ezaugarri boteretsua azaldu zuten: Watson-Crick base-parekatzea, alegia. DNA nukleotidoz osaturiko polimeroa da eta base-parekatze arauari esker osagarriak diren bi kate (adibidez, ATTA eta TAAT) batzen dira eta helize bikoitza sortu.

LEGO jokoan bezala, osagarriak diren piezekin egitura konplexuak eraiki daitezke. DNArekin ere. Azken hamarkadan, DNAren berezitasun honek «arkitektura molekularrari» ateak ireki dizkio, eta nanoteknologiaren munduan erreminta paregabea bihurtu da materiaren antolakuntza espaziala kontrolatzeko. Giza ile baten diametroa baino ehun mila aldiz txikiagoa da nanometroa. Tamaina honetan bereizmen atomikoko nano-materialak goitik-behera (top-down) sortzea oso zaila da, eta normalean tresna oso garestiak behar dira. LEGO piezak balira bezala, DNAren molekulen auto-antolaketa gaitasunari esker, base-sekuentzia batean programatu dezakegu 3D-ko edozein egitura eta hau behetik gora (bottom-up) eraiki. DNAren bidezko nanoegituren eraikuntza molekularrari DNA nanoteknologia deritzo.

2. irudia: DNA Origamia: DNA kate luze bat (aldamioa) eta osagarriak kate txikiagoak (grapak) batzen dira. Berotze- eta epeltze-prozesu kontrolatu baten on- doren, aldez aurretik diseinaturiko egiturak sortzen dira. Eskuineko irudian bi di- mentsioko lehen DNA Origamia (izarra eta irribarrea [1]).

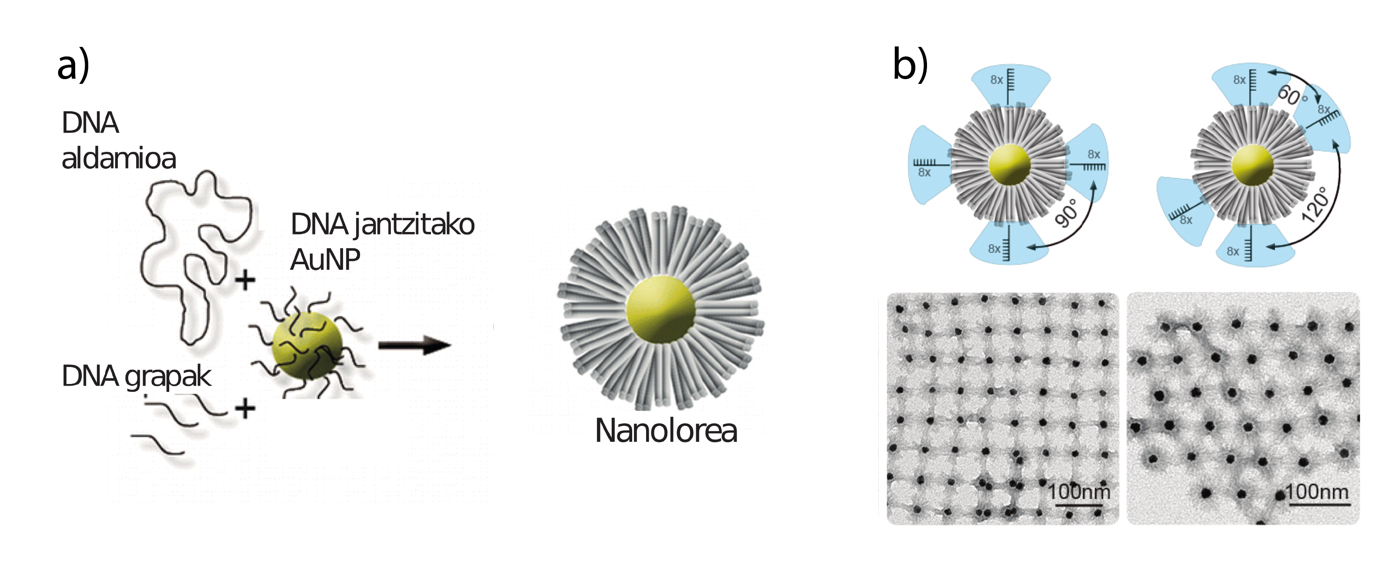

Japoniarrek Origami egitura ederrak sortzen dituzte papera tolestuz. Era berean, DNA kate luze bat bere osagarriak diren kateekin parekatzen da, DNA Origami egitura sortuz (Irudia 1). Teknika hauek jorratuz, 2D eta 3Dko egitura berriak sortu dituzte Oxfordeko Unibertsitatean. Urrezko nano-partikulak, lore itxurako Origami batekin „jantzi“ dituzte nano-loreak sortuz. Nano-loreak DNA katez egindako petaloak ditu eta base-parekatzeari esker, DNA sekuentzian kodifikaturik dago nano-loreen antolakuntza espaziala (Irudia 3). Nanopartikulen kokapena kontrolatuz, hauen ezaugarri optikoak ere alda daitezke, plasmonika arloan erabilera interesgarriak irekiz.

3. irudia: a) Nanolore baten osagaiak eta eraikuntza-prozesua DNA Origami teknika bidez. DNA aldamioak eta grapek, erdialdean hutsunea duen egitura sortzen dute. Hutsunea DNA katez “jantzia” dagoen urrezko nanopartikula batek betetzen du. Guztia nahastuz, berotu eta epelduz, nanolorea (DNA Origami+ nanopartikula egitura) auto-antolatzen da. b) Nanolorearen petaloen kokapenek, simetria desberdineko nanolore sareak sortzen dituzte.

Materiaren behetik-gorako auto-antolakuntza posible da DNA molekula itsaskor eta programagarria delako. Nanoegituren garraioa eta higidura kontrolatzea nanoteknologian beste erronka zientifiko garrantzitsua da. Naturak motore molekularrak erabiltzen ditu higidura sortzeko. Adibidez, miosina gure gihar-zeluletan dagoen motore molekularra da eta aktinarekin batera gihar-uzkurdura eragiten du ATP molekulak erregai bezala erabilita. Horrela, gaur gosaldu duzun sagarra motore molekularrei esker web orri honetan klik egiteko beharrezko erregai kimikoa higiduran transformatu da. Materia aktiboa erregaia kontsumituz orekatik kanpo mantentzen diren material mugikorrak dira.

4. irudia: a) Janus partikulak katalitikoki aktiboak dira esferaerdi batean soilik. Urrezko nanopartikula platinozko gainazal katalitikoa du. Erregai kimikoan murgiltzean (hidrogeno peroxidoa kasu honetan) zuziriak bezala higitzen dira b) Monolito itxurako DNA Origamia partikula katalitikoei lotua.

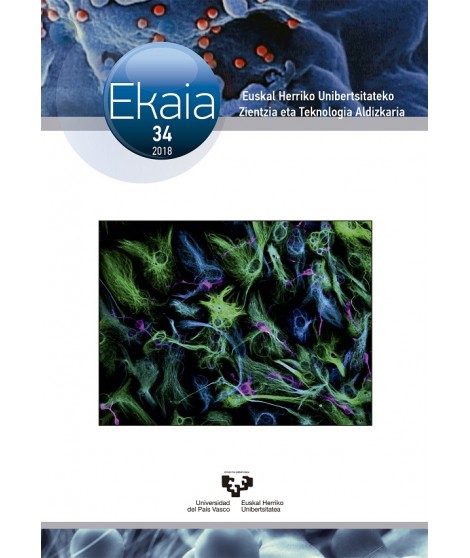

Posible da konplexutasun antzeko egitura higikorrak laborategian sintetizatzea? DNA nano eraikuntza materiala izateaz gain, ingurune aktibo eta dinamikoak sortzeko erabili daiteke. EKAIA artikulu honetan, Ibon Santiagok DNA Origami egiturak nanopartikula katalitikoekin lotuz, nano-zuziriak bezalako egiturak aurkezten ditu (Irudia 3). Erregai kimikoak kontsumituz, difusioa baino azkarragoak diren higidura sortzen duten egiturak azaltzen ditu, bai DNA Origami teknikarekin baita DNAz osaturiko uhin kimikoekin. Lan honetako emaitzek lehenengo aldiz lotzen dituzte DNAren nanoteknologiaren erremintak eta materiak aktiboaren fisika, mugitzeko gai diren nano-egituren auto-antolaketa ikertuz.

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: Ekaia 35

- Artikuluaren izena: DNAren nanoteknologia eta materia aktiboaren auto-antolakuntza.

- Laburpena: DNA material bikaina da nano-egiturak eraikitzeko. Garrantzi genetikoaz gaindi, azido nukleikoak nano-teknologiarako eraikuntza material programagarriak dira. «DNA Origami» eta «DNA bricks» (adreiluak) DNA nano-teknologiaren bidez sorturiko adibide nagusiak dira. DNA molekula itsaskorra ere bada, eta base-parekatzeari esker nano-partikulen arteko interakzioa kontrola daiteke, adibidez «DNA nano-loreak» sortuz. Lan honek DNA nano-teknologiaren teknika desberdinak aurkeztu eta materia aktiboarekin lotzen ditu. Materia aktiboa erregaia kontsumituz orekatik kanpo mantentzen diren material mugikorrak dira. Hemen, DNA bidez auto-antolatutako nano-egiturak aurkezten ditugu, nano-motor katalitikoen laguntzarekin higitzen direnak. Ikerketa hau nano-eskalako garraio kontrolatua lortzeko aurrerapausoa da.

- Egileak: Ibon Santiago.

- Argitaletxea: UPV/EHUko argitalpen zerbitzua.

- ISSN: 0214-9001

- Orrialdeak: 9-19

- DOI: 10.1387/ekaia.19679

————————————————–

Egileez:

Ibon Santiago Erresuma Batuko Oxford Universityko Department of Physicsen dabil.

———————————————–

Ekaia aldizkariarekin lankidetzan egindako atala.

The post DNAren nanoteknologia eta materia aktiboaren auto-antolakuntza appeared first on Zientzia Kaiera.

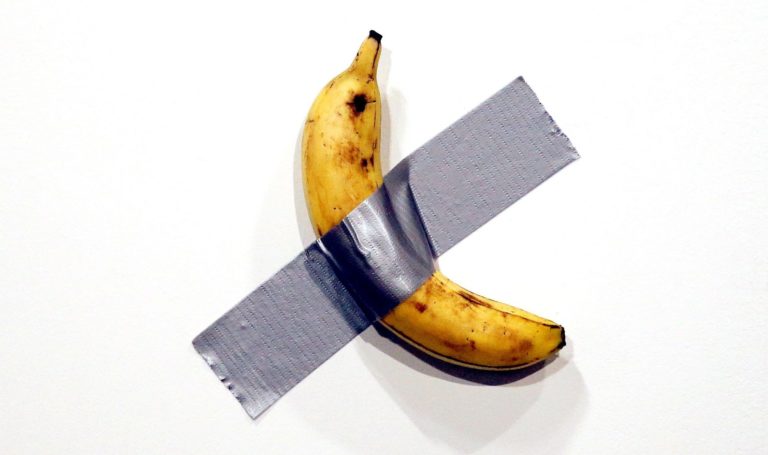

El arte contemporáneo que mira al Tangram

En la octava edición del FIG Bilbao, Festival Internacional de Grabado y Arte sobre Papel, que tuvo lugar el pasado mes de noviembre en Bilbao, descubrí una serie de interesantes grabados del artista madrileño Javier Abad Alonso, co-fundador del estudio de grabado y galería Arco Tijera, relacionada con el Tangram, el clásico rompecabezas de tipo geométrico.

Fotografía de la mesa de la galería Arco Tijera durante la celebración del festival FIG Bilbao, en la que podemos ver dos fotolitografías del artista Javier Abad Alonso de la serie que relaciona el rompecabezas Tangram con el cosmos. Imagen de la página de Facebook de Arco Tijera

Fotografía de la mesa de la galería Arco Tijera durante la celebración del festival FIG Bilbao, en la que podemos ver dos fotolitografías del artista Javier Abad Alonso de la serie que relaciona el rompecabezas Tangram con el cosmos. Imagen de la página de Facebook de Arco Tijera

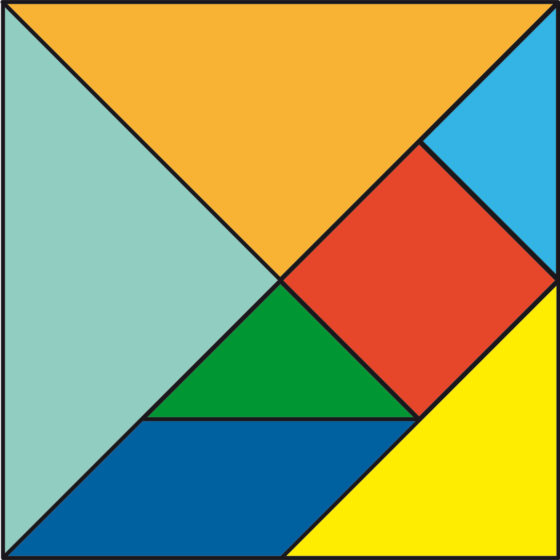

El Tangram es un rompecabezas geométrico de origen chino, aunque de antigüedad desconocida (véase más sobre su historia en la entrada Tangram), formado por 7 piezas poligonales –5 triángulos, 1 cuadrado y 1 paralelogramo de tipo romboide (que pueden verse en la siguiente imagen) – con las cuales se puede formar la figura básica, que es un cuadrado, o una enorme familia de figuras, tanto figurativas (animales, personas, objetos, números, letras, etc), como geométricas (figuras poligonales convexas, etc), además de poder ser utilizado de forma didáctica para aprender matemáticas (teorema de Pitágoras, áreas, ángulos, etc).

Las siete piezas del Tangram formando la figura básica del cuadrado

Las siete piezas del Tangram formando la figura básica del cuadradoEste rompecabezas geométrico nos permite incluso jugar con algunas paradojas, es decir, dos figuras formadas por las siete piezas del Tangram, de igual aspecto, salvo que aparentemente una de ellas es una “extensión” (tiene un añadido) de la otra. La paradoja más conocida es la que consiste en dos monjes y que aparece en el libro Amusements in Mathematics (1917), del matemático recreativo Henry Dudeney (1857-1930). Otras dos conocidas paradojas pertenecen a la persona que popularizó el Tangram, el jugador de ajedrez y matemático recreativo Sam Loyd (1841-1911), que las incluye en su libro The Eighth Book of Tan (1903). En la siguiente imagen mostramos la paradoja de la taza mágica.

Paradoja de la taza mágica, de Sam Loyd, que consiste en tres tazas similares, aparentemente una de ellas con más superficie que las otras dos. Imagen de Wikimedia Commons

Paradoja de la taza mágica, de Sam Loyd, que consiste en tres tazas similares, aparentemente una de ellas con más superficie que las otras dos. Imagen de Wikimedia Commons

Pero regresemos a la serie de grabados de Javier Abad Alonso, que recibe el nombre “Supremus, el cerebro del hombre también es el cosmos”. Este artista toma como punto de partida las ideas del movimiento artístico Suprematismo y en particular de su cofundador Kazimir Malevich (1879-1935), recogiendo además la idea de imitar la naturaleza utilizando módulos geométricos, como explica el propio artista en el texto del proyecto. Así mismo, explica que una referencia fundamental en su trabajo es la pintura icónica de Kazimir Malevich Cuadrado negro (1915-1930):

“El espíritu revolucionario del cuadro de Malévich más de un siglo después de ser exhibido por primera vez sigue manteniendo intacto su espíritu transgresor y aún resulta controvertida para la mayor parte de la sociedad actual, el debate que genera, es algo que aún no ha sido superado y su vigencia es mi punto de partida. Modificar el color negro por paisajes extraídos de un observatorio astronómico e ir deconstruyendo el cuadrado con la ayuda de un juego geométrico siguiendo las reglas suprematistas expuestas de su manifiesto.”

Para esta serie de fotolitografías (como se explica en el Diccionario de Historia del Arte, la fotolitografía es un proceso de impresión litográfico que utiliza una imagen formada a través de medios fotográficos), este artista del grabado utilizada por una parte fotografías del cielo estrellado, tomadas con el telescopio de un observatorio astronómico, y el rompecabezas geométrico más conocido, el Tangram.

A través de una serie de ejemplos concretos de sus fotolitografías, que mostraremos a continuación, podemos observar el uso que hace este artista del grabado de este versátil rompecabezas geométrico.

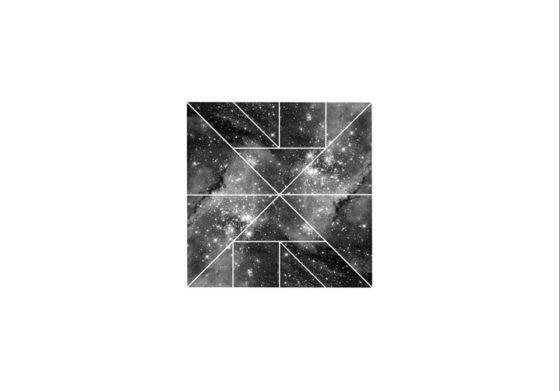

En el primer grabado, que forma parte de un grupo de cinco fotolitografías de la serie Supremus, El cráneo del hombre también es el cosmos con las que este artista ganó el primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019), podemos observar la imagen de un trozo de cielo estrellado dividida en siete zonas poligonales, en concreto con la forma de las siete piezas del Tangram. Además, la imagen que configuran las siete piezas, que es la imagen del cielo estrellado, tiene la forma de una figura poligonal convexa, un hexágono irregular, que es una de las 13 configuraciones poligonales convexas (un polígono convexo es un polígono cuyos ángulos interiores miden menos de 180º, es decir, no hay zonas que externas metidas hacia dentro) que puedes realizarse con las piezas del Tangram.

Fotolitografía de la serie “El cráneo del hombre también es el cosmos”, de Javier Abad Alonso, serie ganadora del primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019). Imagen de la página de Facebook de Arco Tijera

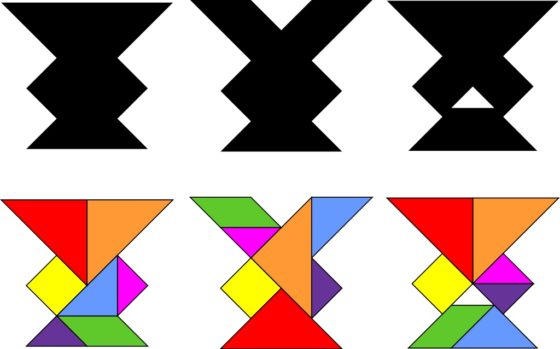

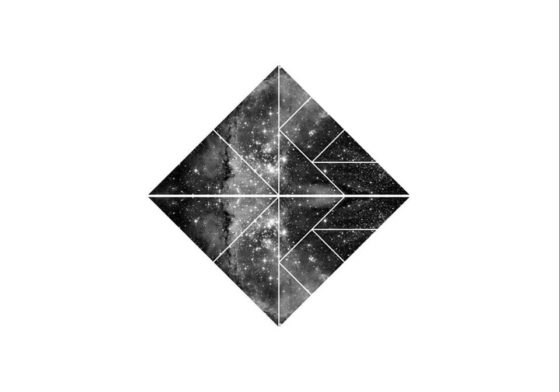

Fotolitografía de la serie “El cráneo del hombre también es el cosmos”, de Javier Abad Alonso, serie ganadora del primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019). Imagen de la página de Facebook de Arco TijeraEn los dos siguientes grabados, pertenecientes al tríptico que este artista madrileño ha expuesto durante la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019), vemos dos fotolitografías, cuyas imágenes son cuadradas, del cielo estrellado y divididas, de nuevo, en las piezas de un rompecabezas geométrico.

Si nos fijamos bien, en la primera litografía la mitad superior es la imagen de una fotografía recortada por las siete piezas del Tangram formando un rectángulo (de proporciones 1:2), mientras que el rectángulo de la mitad inferior es un giro de 180 grados de la pieza de arriba alrededor del centro de la imagen global. Por lo tanto, en esta composición las piezas de arriba y abajo son las mismas en forma e imagen.

Sin embargo, en la segunda litografía la mitad superior está formada por la imagen de una fotografía recortada por las siete piezas del Tangram formando un triángulo (también de proporciones, 1:2), pero ahora el triángulo de abajo es la imagen especular (de tipo espejo) del triángulo de arriba. Por lo cual, ahora las piezas de abajo y arriba son las mismas en forma, las siete piezas del Tangram (bueno, la pieza romboide volteada), pero realmente no en imagen, ya que la imagen de cada pieza de abajo la imagen de espejo respecto de la de arriba.

Fotolitografía 1 del tríptico de Javier Abad Alonso expuesto en la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019). Imagen de la página de Facebook de Arco Tijera

Fotolitografía 1 del tríptico de Javier Abad Alonso expuesto en la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019). Imagen de la página de Facebook de Arco Tijera

Fotolitografía 2 del tríptico de Javier Abad Alonso expuesto en la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019). Imagen de la página de Facebook de Arco Tijera

Fotolitografía 2 del tríptico de Javier Abad Alonso expuesto en la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019). Imagen de la página de Facebook de Arco Tijera

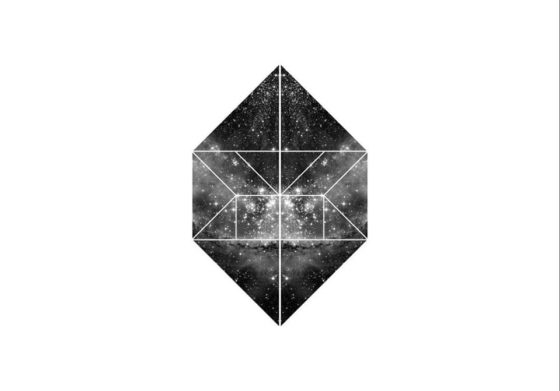

En los ejemplos que hemos comentado hasta ahora podemos observar como Javier Abad utiliza configuraciones convexas del Tangram, distintas del cuadrado básico, como son el hexágono irregular, el rectángulo 1:2 y el triángulo 1:2. En la siguiente fotolitografía utiliza un trapecio isósceles, en las partes derecha e izquierda de la imagen, que son una la imagen especular de la otra.

Fotolitografía 3 del tríptico de Javier Abad Alonso expuesto en la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019). Imagen de la página de Facebook de Arco Tijera

Fotolitografía 3 del tríptico de Javier Abad Alonso expuesto en la VIII Bienal Iberoamericana de obra gráfica ciudad de Cáceres (2019). Imagen de la página de Facebook de Arco Tijera

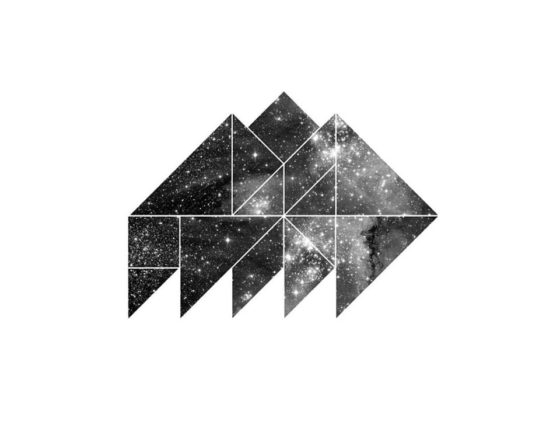

Y en la siguiente obra utiliza la configuración convexa de un trapecio rectangular. Sin embargo, en esta fotolitografía, aunque las piezas que aparecen se corresponden también con dos juegos enteros del rompecabezas Tangram, no ocurre, como en los ejemplos anteriores, que una parte es simétrica a la otra, sino que las dos configuraciones (derecha e izquierda) son dos imágenes celestes distintas.

Fotolitografía de la serie “El cráneo del hombre también es el cosmos”, de Javier Abad Alonso, serie ganadora del primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019). Imagen de la página de Facebook de Arco Tijera

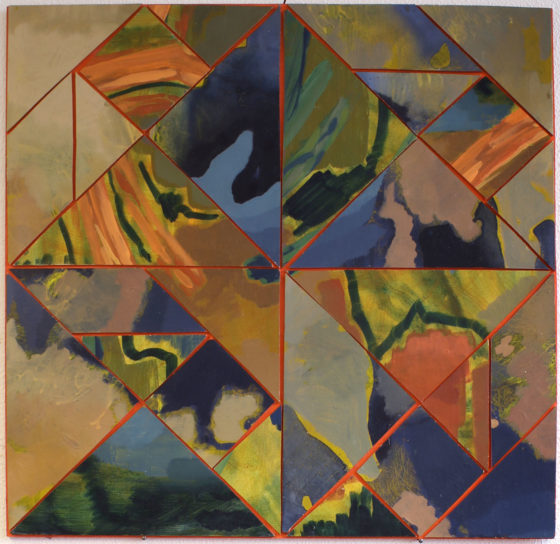

Fotolitografía de la serie “El cráneo del hombre también es el cosmos”, de Javier Abad Alonso, serie ganadora del primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019). Imagen de la página de Facebook de Arco TijeraAunque Javier Abad no siempre utiliza configuraciones convexas como puede verse en alguna de las obras que hay en la página de Facebook de Arco Tijera, o incluso maneja las piezas de dos juegos completos del rompecabezas Tangram creando una nueva configuración con las 14 piezas, como en la siguiente fotolitografía, donde además ya no se trata de una imagen del cielo “duplicada”, sino una única imagen.

Fotolitografía de la serie “El cráneo del hombre también es el cosmos”, de Javier Abad Alonso, serie ganadora del primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019). Imagen de la página de Facebook de Arco Tijera

Fotolitografía de la serie “El cráneo del hombre también es el cosmos”, de Javier Abad Alonso, serie ganadora del primer premio de la 17 Edición «Gran Canaria Series de Obra Gráfica» (2019). Imagen de la página de Facebook de Arco TijeraSin embargo, Javier Abad Alonso no es el único artista contemporáneo que ha utilizado, o utiliza, el rompecabezas geométrico Tangram, como se mostrará a lo largo de esta entrada del Cuaderno de Cultura Científica.

Vamos a continuar este pequeño paseo por el arte contemporáneo que mira al Tangram por el artista italiano, aunque en la actualidad reside en Grecia, Francesco Moretti, quien cultiva varios formatos, como la pintura, la escultura, el video, el diseño interior o los libros artísticos (como puede verse en su página web), pero también el grabado. De hecho, tiene varias series de maravillosos grabados en los que hace uso del rompecabezas Tangram y algunas de las configuraciones que pueden realizarse con sus piezas.

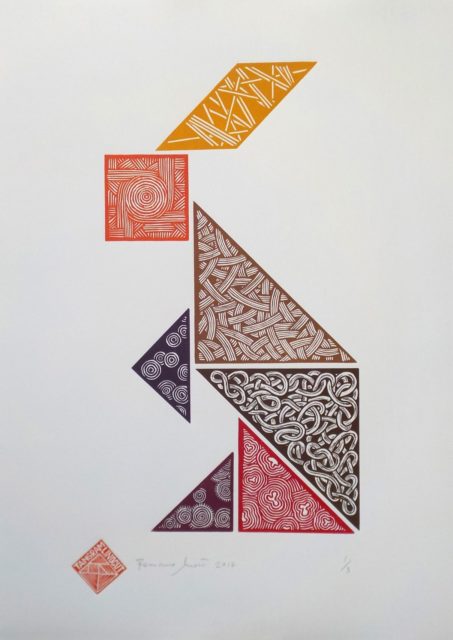

La primera serie de grabados de Francesco Moretti lleva el título de Tangram game. Estas obras son algunas de las configuraciones conocidas del Tangram (hombre cayendo, avión, pez, cisne, caballo, gato, flecha o conejo). Cada pieza del Tangram tiene un diseño geométrico diferente. Además, en cada grabado todas las piezas son del mismo color o cada una tiene un color distinto.

Conejo (2018), de Francesco Moretti. Linograbado con 7 colores, de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti

Conejo (2018), de Francesco Moretti. Linograbado con 7 colores, de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti Gato (2018), de Francesco Moretti. Linograbado con 7 colores, de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti

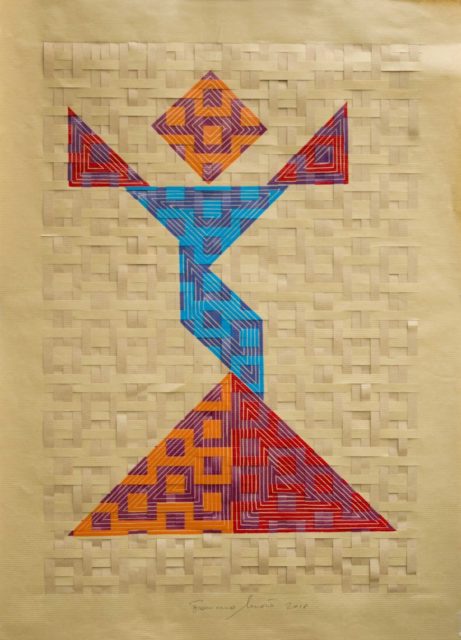

Gato (2018), de Francesco Moretti. Linograbado con 7 colores, de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco MorettiTiene una segunda serie dedicada a las mujeres, titulada Tangram Ladies, en la cual utiliza para cada obra dos impresiones en color de la imagen que ha diseñado, las cuales son cortadas en tiras y “entrelazadas como si fueran hilos de lana en un tejido”. Las configuraciones del Tangram utilizadas son, por supuesto, de figuras femeninas. El resultado es de una gran belleza.

Mujer Tangram 01 (2018), de Francesco Moretti. Linograbado con 2 impresiones, de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti

Mujer Tangram 01 (2018), de Francesco Moretti. Linograbado con 2 impresiones, de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti

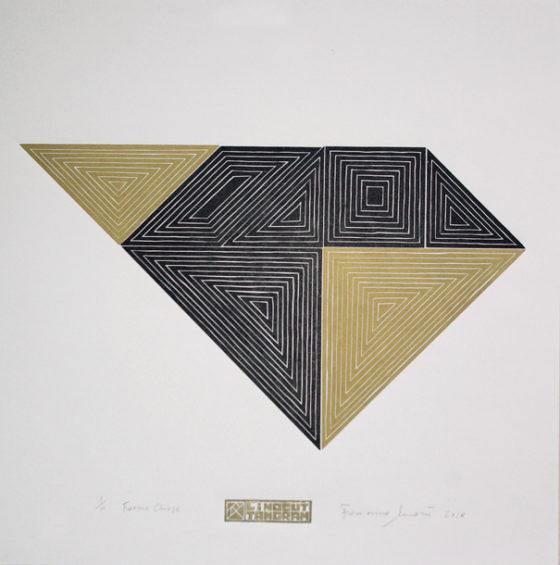

La siguiente serie de grabados, denominada Closed forms (formas cerradas), está formada por algunas de las 13 configuraciones convexas que existen para este rompecabezas geométrico. Además, en cada figura incluye líneas paralelas con la forma de la misma figura, que nos recuerdan a algunas de las obras del artista abstracto y minimalista norteamericano Frank Stella (véase la entrada Frank Stella, la forma del lienzo).

Forma cerrada 03 (2018), de Francesco Moretti. Linograbado en 2 colores, de tamaño 50 x 50 cm. Imagen extraída de la página del artista Francesco Moretti

Forma cerrada 03 (2018), de Francesco Moretti. Linograbado en 2 colores, de tamaño 50 x 50 cm. Imagen extraída de la página del artista Francesco MorettiEn la última serie de grabados en los que utiliza este rompecabezas geométrico, que recibe el nombre de Tangram óptico, utiliza diferentes configuraciones de animales del Tangram (camello, gallina, oso, ardilla y tejón). Por otra parte, sobre las piezas diseña una serie de líneas que crean cierto efecto óptico y a que, a diferencia de los anteriores diseños, las líneas se continúan de unas piezas a otras ya dentro de la configuración realizada.

Oso (2018), de Francesco Moretti. Linograbado de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti

Oso (2018), de Francesco Moretti. Linograbado de tamaño 50 x 70 cm. Imagen extraída de la página del artista Francesco Moretti

Pero la utilización del Tangram que realiza este artista italiano no se limita al grabado, sino que también realiza una serie de potentes esculturas inspiradas en el rompecabezas, realizadas tanto en madera, como en acero.

Cisne (2018), de Francesco Moretti. Madera. Tamaño 43 x 19 x 45 cm. Imagen extraída de la página del artista Francesco Moretti

Cisne (2018), de Francesco Moretti. Madera. Tamaño 43 x 19 x 45 cm. Imagen extraída de la página del artista Francesco Moretti

En el año 2016, la galería Espacio Líquido de Gijón en su nueva propuesta por difundir la obra de artistas del entorno organizó una muestra titulada Estructura primitiva, que unía el trabajo de dos creadores como Jorge Nava (Gijón, 1980) y Job Sánchez (A Coruña, 1979). La propuesta del artista gallego Job Sánchez fue su serie Tangram, en la que se utilizaban algunas configuraciones convexas del rompecabezas. Por ejemplo, en cuatro collages de papel y vinilo sobre papel (con los títulos Tangram 1, 2, 3, 4) se utilizaban cuatro de estas configuraciones. Aunque quizás la propuesta más impactante fue el mural, de acrílico y grafico sobre la pared, de un tamaño de 135 x 180 cm, que vemos a la derecha en la siguiente imagen.

Imagen de la exposición Estructura Primitiva en la Galería Espacio Líquido, en 2016. A la derecha, Sin título (2016), del artista Job Sánchez, perteneciente a la serie Tangram. Acrílico y grafico sobre la pared, de un tamaño de 135 x 180 cm. Imagen de la página de la revista cultural online LaEscena

Imagen de la exposición Estructura Primitiva en la Galería Espacio Líquido, en 2016. A la derecha, Sin título (2016), del artista Job Sánchez, perteneciente a la serie Tangram. Acrílico y grafico sobre la pared, de un tamaño de 135 x 180 cm. Imagen de la página de la revista cultural online LaEscena

Imagen de la exposición Estructura Primitiva en la Galería Espacio Líquido, en 2016. Tangram 1, 2, 3, 4 (2016), collage de papeles y vinilo sobre papel, y Sin título (2016), tangram de madera pegado y pintado, con vinilo en la pared, del artista Job Sánchez, perteneciente a la serie Tangram. Imagen de la página de la revista cultural online LaEscena

Imagen de la exposición Estructura Primitiva en la Galería Espacio Líquido, en 2016. Tangram 1, 2, 3, 4 (2016), collage de papeles y vinilo sobre papel, y Sin título (2016), tangram de madera pegado y pintado, con vinilo en la pared, del artista Job Sánchez, perteneciente a la serie Tangram. Imagen de la página de la revista cultural online LaEscena

Otra artista que utiliza el Tangram es la artista francesa, afincada en Aarhus (Dinamarca), Lucie Payoux. Tiene dos obras en las que utiliza la configuración básica del cuadrado, del Tangram, en las cuatro posiciones obtenidas al rotar 90 grados esa configuración básica. Y cada pieza tiene su propio diseño.

Tangram (2019), de la artista Lucie Payoux. Acrílico y óleo sobre madera. Tamaño de 55 x 55 cm. Imagen de la página web de la artista

Tangram (2019), de la artista Lucie Payoux. Acrílico y óleo sobre madera. Tamaño de 55 x 55 cm. Imagen de la página web de la artistaEl artista holandés Daan Roukens también utiliza las cuatro rotaciones de 90 grados de la configuración básica del cuadrado en su graffiti sobre madera On the Wall / Sobre el muro (2010), que realizó para el Artpie 2010, en Ámsterdam, en el que se van repitiendo las cuatro imágenes de forma periódica.

On the Wall / Sobre el muro (2010), del artista Daan Roukens, para el Artpie 2010, en Ámsterdam. Grafitti sobre madera. Tamaño de 1 x 16 metros. Imagen de la página web del artista

On the Wall / Sobre el muro (2010), del artista Daan Roukens, para el Artpie 2010, en Ámsterdam. Grafitti sobre madera. Tamaño de 1 x 16 metros. Imagen de la página web del artistaLa francesa Françoise Bergaglia ha desarrollado un interesante trabajo como ceramista en los últimos años. Como ella misma ha comentado en su página La galerie des Tangram, este rompecabezas geométrico le fascina, sus siete piezas y la infinidad de configuraciones posibles que existen. En La galerie des Tangram tiene más de 50 piezas, de diferentes tamaños, realizadas en terracota sobre configuraciones del Tangram.

Variaciones rojo y azul sobre fondo pintado, de Françoise Bergaglia. Imagen de su página La galerie des Tangram

Variaciones rojo y azul sobre fondo pintado, de Françoise Bergaglia. Imagen de su página La galerie des TangramSigamos con el diseño. La compañía de diseño 22 Studio Room de Taipei (Taiwan) realizó la escultura Ciudad Tangram que vemos en la siguiente imagen tomando como base la configuración cuadrada del Tangram.

Escultura Ciudad Tangram, diseñada por la compañía 22 Studio Room de Taipei (Taiwan). Imagen de la página The Journal Shop

Escultura Ciudad Tangram, diseñada por la compañía 22 Studio Room de Taipei (Taiwan). Imagen de la página The Journal ShopTambién podemos encontrar ejemplos dentro de la arquitectura. El estudio de arquitectura de Barcelona del arquitecto Carlos Ferrater, OAB – Office of Architecture in Barcelona, diseño en el año 2013 el proyecto de Casa Tangram, de Borja Ferrater y Carlos Ferrater, para ser construida en Angelo Drive, Beverly Hills.

El estudio OAB explica así la relación del rompecabezas geométrico con su diseño arquitectónico:

“La relación entre el rompecabezas y nuestro proyecto se ha vuelto casual pero con un alcance muy significativo. Nuestro propósito de simplificar el proyecto destacando sus aspectos más importantes nos llevó a relacionar el proyecto con esta brillante, pero a la vez simple idea del juego de rompecabezas, que nos permite representar múltiples formas desde el punto de partida.

Tangram utiliza siete figuras geométricas y con cada una de ellas podemos crear múltiples posibilidades. Nuestro proyecto comenzó con unas premisas muy claras desde el primer día, tales como la relación natural con el paisaje existente, una perfecta organización del programa arquitectónico y un objeto bellamente terminado diseñado para ser visto desde diferentes lugares.

Siempre hemos querido convertir estos tres temas principales en una solución muy clara y potente, tomando como creencia fundamental la fuerza de abstracción en la arquitectura.

Queríamos simplificar la forma mientras transmitíamos estos conceptos importantes con formas geométricas. Este tipo de lógica y pensamiento está bien relacionado con la abstracción, rigor y austeridad que se han utilizado en la arquitectura moderna a lo largo del siglo XX, teniendo California como un magnifico epicentro.”

En la página web del estudio OAB puede encontrarse la descripción completa del proyecto.

Imágenes del proyecto Casa Tangram, de Borja Ferrater y Carlos Ferrater, para ser construida en Angelo Drive, Beverly Hills

Imágenes del proyecto Casa Tangram, de Borja Ferrater y Carlos Ferrater, para ser construida en Angelo Drive, Beverly Hills

Y vamos a terminar este pequeño paseo con una hermosa obra del diseñador gráfico e ilustrador Hugo Giner.

Ilustración de Hugo Giner. Imagen de su Instagram, a través de su página web

Ilustración de Hugo Giner. Imagen de su Instagram, a través de su página web

Bibliografía

1.- Página web del artista Javier Abad Alonso

2.- Javier Abada Alonso, Supremus, el cerebro del hombre también es el cosmos [comunicación personal]

3.- Diccionario de Historia del Arte: fotolitografía

4.- Página web del artista Francesco Moretti

5.- Página web del artista Job Sánchez

6.- Página web de la artista Lucie Payoux

7.- Página web del artista Daan Roukens

8.- Página web de la ceramista Françoise Bergaglia

9.- Página web de la compañía de diseño 22 Studio Room

10.- Página web del estudio OAB – Office of Architecture in Barcelona

11.- Página web del diseñador gráfico e ilustrador Hugo Giner

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo El arte contemporáneo que mira al Tangram se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Marteko goiko atmosferaren haizeen mapa osatu dute

Espazioaren esplorazioari buruz ari garenean, askotan suposatutzat ematen dugu goi mailako teknologiez eta protokolo zuhurrez betetako mundua dela, eta hala da gehienetan. Baina hasiera-hasieratik ezustekoek eta azken orduko aldaketek ere berebiziko garrantzia izan dute, eta horrela eskuratu dira lorpen garrantzitsu batzuk. Adibidez, 1990an Carl Saganek NASAko arduradunak konbentzitu zituen Vogager I zunda Lurrari begira jartzeko, eta modu horretan Pale blue dot izenez ezagutzen den Lurraren argazkia lortu zen. Zientziaren interes hutsetik begiratuta, zundaren mugimendu horrek ez zuen apenas baliorik izan, baina irudi horrek Gizaterian eragindako eragin positiboa seguruenera zundak eskuratutako datu askorenak baino handiagoa izan da.

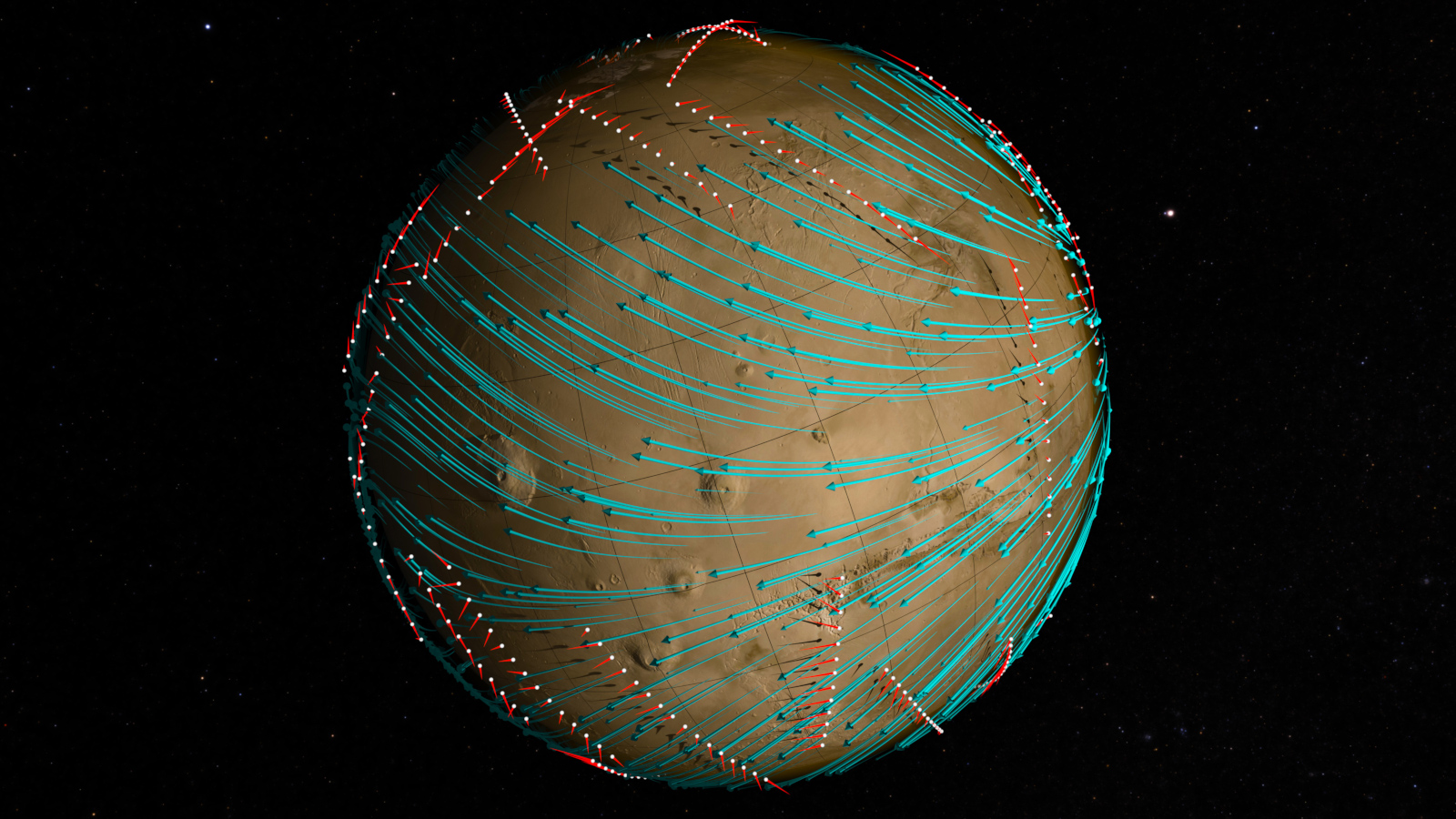

1. irudia: MAVEN zundak jarraitutako ibilbidea (zuriz) eta ondorioztatutako haizeak (urdinez), ordenagailu bidezko irudikapen batean. Marra gorriek neurtutako haizeen norabidea eta indarra erakusten dute. (Irudia: NASA Goddard/MAVEN/SVS/Greg Shirah)

2014. urtetik Marte orbitatzen duen MAVEN zundaren kasua da ere. Mars Atmosphere and Volatile Evolution edo Marteko Atmosferaren eta Lurrunkorren Bilakaera esaldiaren akronimoa da MAVEN, eta ez da planeta gorriaren atmosfera ikertu duen zunda bakarra. Mars Global Surveyor, Mars Odyssey eta Mars Recoinnaissance Orbiter zunden bitartez ere datu garrantzitsuak eskuratu dira eremu horri buruz; baina, beti ere, datu horiek mugatuak izan dira.

MAVEN zundaren barruan hainbat tresna daude, eta horietako bat NGIMS izeneko espektrometroa da. Bada, 2016ko apirilean Mehdi Benna NASAko zientzialariari bururatu zitzaion tresna hori egokitzeko aukera. Bennaren ustez, haizearen jarioak aztertzeko aukera ematen zuen espektrometroaren birprogramatzeak, tresnak 8 graduko angelu batean mugitzeko aukera duelako. Esan beharrik ez dago hasiera batean zundaren arduradunak zuhur azaldu zirela horrelako aukera baten aurrean, baina azkenean hori egiten ausartu ziren. Eskerrak.

Zunda behin eta berriz murgildu da goiko atmosferan, 140-240 kilometro arteko altueran. Espektrometroan moldaketa hori eginda, 30 segundoko tartean atmosferaren bi puntu hurbiletan neurketak egiteko moduan egon dira. 2016tik 2018ra, hilabetean bitan egin dituzte neurketak. Zeharka bada ere, ikertzaileek aukera izan dute haizearen abiadura eta norabidea ondorioztatzeko, berez espektrometroa horretarako bideratuta ez zegoen arren. Hala, anemometro bihurtutako tresna horren bitartez, zientzialariek eskuratu ahal izan dituzte Marteko atmosferan dauden haizeen inguruko xehetasunak. Science aldizkarian aurkeztu dituzte emaitzak.

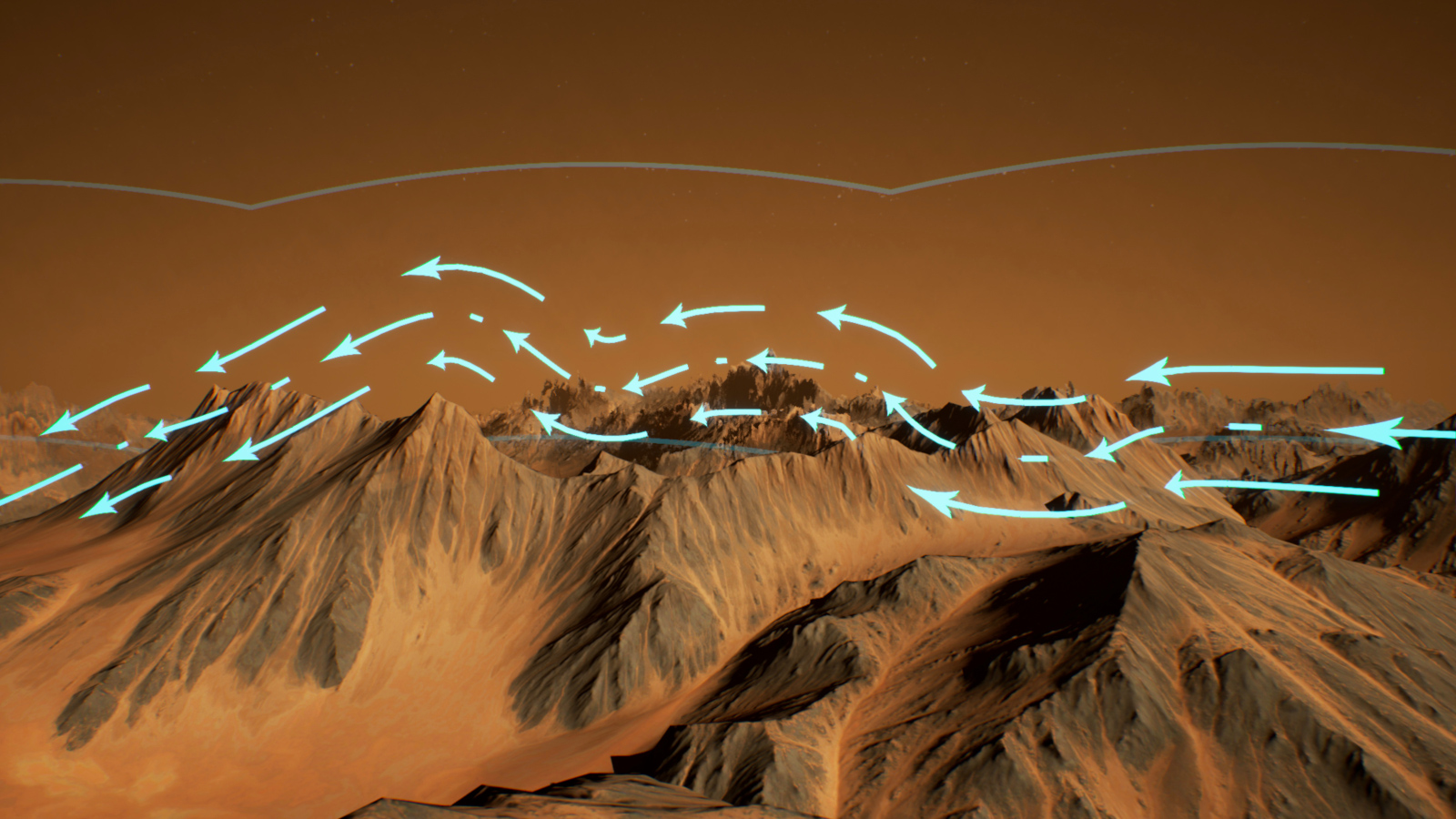

2. irudia: Orografiak Marteko haizeetan duen eraginaren irudi eskematikoa. Haizeak eragiten dituen grabitate-uhinak neurtuta, lurrazalean dauden mendiak eta haranak hautemateko gai izan da MAVEN. (Irudia: NASA Goddard/MAVEN/CI Lab/Jonathan North)

Lurrean bezala, termosfera eta ionosfera dira goiko atmosferan dauden geruzak, eta bertan ere nagusiki bi faktorek baldintzatzen dute eremua: Eguzkitik datorren energia eta beheko atmosferatik datorrena. Desberdinak izanda ere, Lurraren eta Marteren atmosferek badute antzekotasunik, eta horregatik hasieratik ikertzaileen xedeetako bat izan da Lurreko atmosfera hobeto ulertzea.

Oroitu beharra dago MAVEN misioaren bitartez ere argitu nahi izan dutela zergatik galdu zen Marteko atmosfera gehiena. Hein handi batean, MAVENi esker orain badakigu eguzki-haizea dela galera horren zio nagusiena. Eragin hori are handiagoa izan da Martek erradiazio horretatik babesteko eremu magnetiko indartsurik ez duelako.

Zirkulazio globalaGaiari buruz aurreikusitako ereduak berretsi dituzte, Bennak berak prentsa ohar batean azaldu duenez. “Interesgarria izan zen ikustea goiko atmosferan behatutako joerek orokorrean bat egiten dutela ereduetatik aurreikus daitekeenarekin. Fisika badabil”, adierazi du. Atera duten ondorio nagusiena da Marteko zirkulazio-patroiak Lurrarenak baino sinpleagoak direla, goiko atmosferan bederen, eta ez direla asko aldatzen sasoi bakoitzaren arabera.

Bestalde, ikusi dute oso altuera handian egon arren, hein handi batean lurrazaleko orografiak ere baldintzatzen dituela goizko atmosferako haizeen norabideak. Horrela, 200 inguru kilometrora dauden haize horiek Marteko mendien, arroila edota haranen araberakoak dira ere. Ondorio hori ateratzeko haizeek sortutako grabitate-uhinak aztertu dituzte [ez nahastu grabitazio-uhinekin]. Ikertzaileek azpimarratu dute Lurrean ere orografiak eragin handia duela haizeetan, baina hemen ez dela iristen hain altuera handietara.

Hartu duten ezusteko nagusiena izan da denbora gutxian oso aldagarriak direla haize horiek. Izan ere, epe luzera nahiko egonkorrak izan arren, epe motzean dinamika handiagoa dago, eta orain arte eredu teorikoek espero zutena baino aldagarritasun gehiago topatu dute. Hori zergatik gertatzen den argitu nahi dute orain. Zientzian gertatu ohi den moduan, ate bat irekitzen den aldiro galdera berriak azaltzen dira zirrikitu guztietatik. Baita haize indartsuak ere.

Erreferentzia bibliografikoa:

Benna et al., (2019). Global circulation of Mars’ upper atmosphere. Science, 366 (6471), 1363-1366. DOI: 10.1126/science.aax1553.

———————————————————————————-

Egileaz: Juanma Gallego (@juanmagallego) zientzia kazetaria da.

———————————————————————————-

The post Marteko goiko atmosferaren haizeen mapa osatu dute appeared first on Zientzia Kaiera.

El comportamiento corpuscular de la luz: el efecto Compton

Foto: Bessi / Pixabay

Foto: Bessi / PixabayHemos visto que el momento lineal del fotón es inversamente proporcional a su longitud de onda, p = h/λ. ¿Tiene sentido físico definir el momento lineal de un fotón de esta manera?

Consideremos un haz de luz (visible o de rayos X) que incide sobre los átomos de una objeto diana, una delgada lámina de metal, por ejemplo. Según la teoría electromagnética clásica, la luz se dispersará en varias direcciones, pero su frecuencia no cambiará. La absorción de luz de cierta frecuencia por un átomo puede ser seguida por la reemisión de luz de una frecuencia diferente. Pero si la onda de luz simplemente se dispersa, entonces, según la teoría clásica, la frecuencia no debería cambiar.

Según la teoría cuántica, sin embargo, la luz está compuesta de fotones. Según la teoría de la relatividad, los fotones tienen momento lineal. Si esto es así, en una colisión entre un fotón y un átomo debería aplicarse la ley de conservación del momento, una consecuencia directa de la tercera ley de Newton. Según esta ley cuando un cuerpo de masa pequeña choca con un objeto de masa mucho mayor en reposo, simplemente o rebota hacia atrás o se desvía; experimenta muy poca pérdida de velocidad y los cambios en su energía son mínimos. Pero si las masas de los dos objetos que chocan no son muy diferentes sí se puede transferir una cantidad significativa de energía en la colisión.

Arthur Compton calculó cuánta energía debería perder un fotón en una colisión con un átomo si el momento del fotón fuese h/λ. Llegó a la conclusión de que el cambio en la energía es demasiado pequeño como para poder observar el efecto mecánico de un fotón en algo tan grande comparativamente como un átomo completo. Pero si un fotón golpeara un electrón, que tiene una masa significativamente más pequeña, el fotón debería transferir una cantidad significativa de energía al electrón.

En 1923, Compton pudo demostrar que los rayos X se comportan de hecho como corpúsculos con momento lineal p = h/λ cuando chocan con electrones. Compton midió la longitud de onda (o la frecuencia) de los rayos X incidentes y una vez dispersados y, de esta manera, pudo determinar el cambio en el momento lineal del fotón de rayos X. Al medir por separado el momento lineal del electrón tras la dispersión, pudo verificar que p = h/λ utilizando la ley de conservación del momento. Por este trabajo Compton recibió el Premio Nobel en 1927.

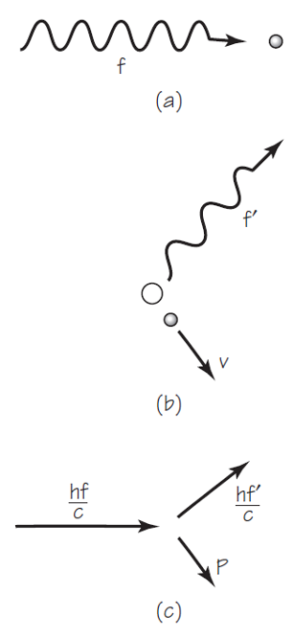

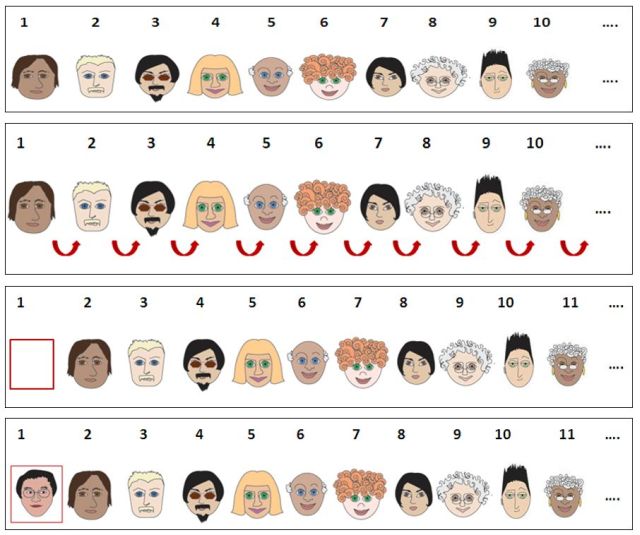

Efecto Compton. (a) Un fotón de frecuencia f incide sobre un electrón en reposo; (b) el fotón es dispersado tras la colisión con una frecuencia diferente f ‘, mientras que el electrón adquiere una velocidad v; (c) la ley de conservación del momento lineal establece que el momento lineal antes de la colisión debe ser igual al momento lineal tras la colisión (recuerda que es una suma vectorial, por lo que en la imagen se representan la dirección y sentido con flechas y se anota la magnitud; p en este caso es el producto de la masa del electrón por la velocidad adquirida v).

Efecto Compton. (a) Un fotón de frecuencia f incide sobre un electrón en reposo; (b) el fotón es dispersado tras la colisión con una frecuencia diferente f ‘, mientras que el electrón adquiere una velocidad v; (c) la ley de conservación del momento lineal establece que el momento lineal antes de la colisión debe ser igual al momento lineal tras la colisión (recuerda que es una suma vectorial, por lo que en la imagen se representan la dirección y sentido con flechas y se anota la magnitud; p en este caso es el producto de la masa del electrón por la velocidad adquirida v).Por lo tanto, el experimento de Compton demuestra que un fotón puede considerarse como una partícula con un momento lineal (p = h/λ) y una energía (E = hc/λ = hf) definidos. También demuestra que las colisiones entre fotones y electrones obedecen las leyes de conservación del momento lineal y la energía.

La explicación de Eisntein del efecto fotoeléctrico ya apuntaba a que la luz tiene propiedades similares a las de los corpúsculos. La expresión matemática del momento lineal y el efecto Compton proporcionaron pruebas adicionales de este hecho. Debe quedarnos claro, sin embargo, que los fotones no son como corpúsculos ordinarios, aunque solo sea porque los fotones no existen a velocidades diferentes a la de la luz [*]. Pero en lo demás, como en su comportamiento durante la dispersión, los fotones actúan de manera muy parecida a las corpúsculos de materia; de entrada, tienen momento lineal y energía.

Sin embargo, también sabemos que la luz, los fotones por tanto, actúa como una onda, teniendo frecuencia y longitud de onda. En otras palabras, la radiación electromagnética en algunos experimentos exhibe un comportamiento similar a lo que se considera un comportamiento de corpúsculo, y en otros experimentos su comportamiento es similar a lo que se considera un comportamiento de onda. Este patrón de comportamiento se suele llamar dualidad onda-corpúsculo de la radiación.

¿Es un fotón una onda o un corpúsculo? La única respuesta, señaló Bohr, es que puede actuar como una u otro, dependiendo de lo que se haga con él.

Nota:

[*] No puede haber fotones en reposo y, por lo tanto, no hay masa en reposo para los fotones. Véanse La velocidad de las ondas electromagnéticas y la naturaleza de la luz y El principio de constancia de la velocidad de la luz.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo El comportamiento corpuscular de la luz: el efecto Compton se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El comportamiento corpuscular de la luz: momento lineal del fotón

- El dilema del efecto fotoeléctrico

- La explicación de Einstein del efecto fotoeléctrico

Mahatsa, ardoa eta molekula baten bidaia (eta II)

1. irudia: Glukosaren hartziduraz etanola lortzen da. (Argazkia: PhotoMIX – domeinu publikoan. Iturria: pixabay.com)

Mahatsetik ardo botilaraArdoa hiru etapatan egiten da. Lehendabizi mahatsak zanpatzen dira zukua lortzeko. Ondoren, zukuaren hartzidura alkoholikoa eta malolaktikoa gertatzen da -bigarrena ez kasu guztietan- eta, azkenik, ardoaren heltzea dator. Lehen pausoan, glukosa molekula bidaiaria mahatsean dago, beste hainbat konposaturekin batera. Gutxi gorabehera, mahatsak dituen osagaien %20-30 azukreak dira -nagusiki fruktosa eta, esan bezala, glukosa-. Azidoak ere badituzte: azido malikoa, zitrikoa eta tartarikoa dira ugarienak. Taninoen ondorioz zapore lehorgarria dute eta koloreak, aldiz, hainbat pigmentutan dauka azalpena -horien artean antozianinak eta flabonoleak-.

Mahatsak zanpatzean ardo bihurtuko den zukua lortzen da. Ardo zurien kasuan, ateratako muztioa mahats azalekin kontaktuan uzten da ordu batzuk, baina gero banatu egiten da. Ardo gorriaren eta beltzaren kasuan, azalak muztioarekin batera mantentzen dira hartziduran zehar. Hartzidura legamien elikatzeko beharraren ondorioa da eta, etanola, prozesu horren azpiproduktua. Ardoaren hartzidura kupel handietan egin ohi da eta Saccharomyces cerevisiae legamiak egiten du. Legamiek, oxigeno gutxiko ingurunean, hartzidura alkoholikoaren bitartez lortzen dute energia. Azukreak metabolizatzen dituzte eta haiei energia kentzearekin batera, etanola ekoizten dute. Etanolak, gainera, defentsa-mekanismo moduan egiten du lan; izan ere, bakterioak hil egiten dira etanola duen ingurunean. Legamiak, aldiz, %20ko kontzentrazioa jasaten du.

2. irudia: Etanola ekoiztea legamien defentsa-mekanismoa da, gure onurarako erabiltzen duguna. (Argazkia: Grace Chang – domeinu publikoan. Iturria: pixabay.com)

Etanolaren toxikotasuna da, azken batean, ardoa edatean gertatzen zaizkigun asalduren erantzulea. Bada, glukosa molekula bidaiaria legamiaren metabolismoan sartzean, etanol bihurtuta ateratzen da beste milioika molekulekin batera. Horrekin batera, legamiek ardoaren ezaugarriak hobetzen dituzten konposatu usaintsuak sintetizatzen dituzte, esaterako, kate luzeko alkoholak eta esterrak. Muztioa eta mahatsaren beste osagai solidoak hartzitzen egongo dira 2-3 astez ardo beltzen kasuan eta 4-6 astez ardo zurien kasuan. Tenperatura ere ondo zaindu beharreko parametroa da; izan ere, tenperatuta altuagoan hartzidura azkarrago gertatzen da tenperatura baxuan baino. Tenperatura zenbat eta baxuagoa izan eta hartzidura denbora zenbat eta gehiago luzatu, molekula aromatiko gehiago izango ditu ardoak.

Muztioaren azukre guztia -edo ia- etanol bihurtu denean, hartzidura nagusia amaitutzat jotzen da. Azukrerik ez duen ardoari lehorra deritzo, baina, azukrea mantentzen duten ardoak ere badira –hartzidura lehenago moztu delako edo azukredun muztioa gehitu delako-. Hartzidura alkoholikoa amaitzean bigarren hartzidura gertatzen da: hartzidura malolaktikoa. Hartzidura hori Leuconostoc oenos bakterioak egiten du eta muztioak duen azido malikoa azido laktiko bihurtzea du helburu. Hartzidura malolaktikoaren eraginez ardoaren azidotasuna murrizten da eta konposatu usaintsu berriak sintetizatzen dira.

Azken pausoan, ardoa ontziz aldatzen da mahatsaren partikula solidoak eta legamia kentzeko. Horretarako partikulak hauspeatzen uzten dira eta ontzi aldaketan hauspeakina likidotik banatzen da. Prozesua behin eta berriz errepikatzen da partikula solidoen gehiengoa kendu arte, baina, ardotan murgilduta jarraitzen du karbono dioxido eta glukosa izandako etanol bidaiariak, beste milaka konposaturekin batera dantzan. Jarraian, ardoak 6 hilabetetik gora pasatzen ditu upelean heltzen -ardo motaren arabera epe hauek asko alda daitezke-. Ondoren, gasen trukaketa ahalbidetuko duen kortxo egokiarekin, ardoak botilatu egiten dira eta urtebetez -ardo zurien eta gorrien kasuan- edo bi urtez -zenbait ardo beltzen kasuan- haien ezaugarriak hobetzen jarraituko dute. Ardo beltz batzuk hamarkadatan zehar egon daitezke botilatuta ezaugarriak hobetzen baina, oro har, ardo guztien bizitzak muga bat du eta kalitatea galtzen hasiko dira uneren batean. Horregatik, lehenbailehen edatea hobe.

Botilatik gibeleraEtanol molekula bidaiaria denbora luzez egon da ardo beltz botilan gordeta, likidoetan gertatzen den higidura browndarraren eraginez alde batetik bestera mugitzen. Une batean, botila ireki da eta koparantz atera da ardo deritzon nahaste heterogeneoarekin batera. Ardoa kopan dagoenean milaka konposatu usaintsu gas fasera pasatzen hasi dira. Sudur hobietatik barrura, usain-hartzaileekin lotzen dira eta sagar, udare, anana, arrosa, belar, egur eta abarreko usainak gogorarazten dituzte. Ester etilikoek, azetato esterrek, alkohol konplexuek eta beste hainbat molekula dira usain berezi horien erantzuleak.

Ardoa edatearekin batera, etanola organismoan sartu eta haren metabolismo prozesuetan barneratzen da. Organismoak hainbat erreakzio eginez deskonposatzen du etanola; izan ere, gorputzarentzat toxikoa da eta lehenbailehen murriztu behar da bere kontzentrazioa. Transformazio hori nagusiki urdailean eta gibelean gertatzen da. Oro har, etanolak 30-60 minuturen buruan izaten du kontzentrazio maximoa odolean eta hortik zelula guztietara sakabanatzen da fluidoen bitartez. Lehen pausoan, alkohol deshidrogenasa entzimak etanola azetaldehido bihurtzen du -konposatu hori da, hain zuzen ere, ajearen ondorioen erantzule nagusia-. Jarraian, azetaldehidoa azetato bihurtzen du beste entzima batek -alkohol deshidrogenasak-, toxikotasun baxuagoa duen azetatoa lortuz. Azkenik, airearen karbono dioxidoa, mahatsaren glukosa, ardoaren etanola eta gibeleko azetaldehidoa izandako azetato molekula bidaiaria gibelean eta beste ehunetan oxidatzen da, karbono dioxidoa eta ura emanez. Arnasketaren bidez karbono dioxidoa atmosferara kanporatzen da eta hortxe dugu zikloaren itxiera. Karbono dioxidotik karbono dioxidora, mahatsetik, ardotik eta giza-organismotik pasata.

Atomo bakarrari -hasierako karbono dioxidoaren karbonoari- jarraipena eginez, puntu berera iritsi gara, baina, beste milaka atomo beste bide batzuk egitera egin dute ihes. Karbono horrentzat ere ez da bidaiaren amaiera; izan ere, beste milaka lekutan egongo da oraindik atomo hori. Guzti horretan pentsatuz upeltegiaren kanpoan dauden mahastiei begira geratu da eta, lasaitasunez, arnasa hartu du. Edandako ardo onarekin gozatu ondoren upeltegira sartu da.

Informazio gehiago:

La cocina y los alimentos, Harold McGee, Debate, 2017.

—————————————————–

Egileaz: Josu Lopez-Gazpio (@Josu_lg) Kimikan doktorea, irakaslea eta zientzia dibulgatzailea da. Tolosaldeko Atarian Zientziaren Talaia atalean idazten du eta UEUko Kimika sailburua da.

—————————————————–

Mahatsari buruzko artikulu-sorta:

- Mahatsa, ardoa eta molekula baten bidaia (I)

- Mahatsa, ardoa eta molekula baten bidaia (II)

The post Mahatsa, ardoa eta molekula baten bidaia (eta II) appeared first on Zientzia Kaiera.

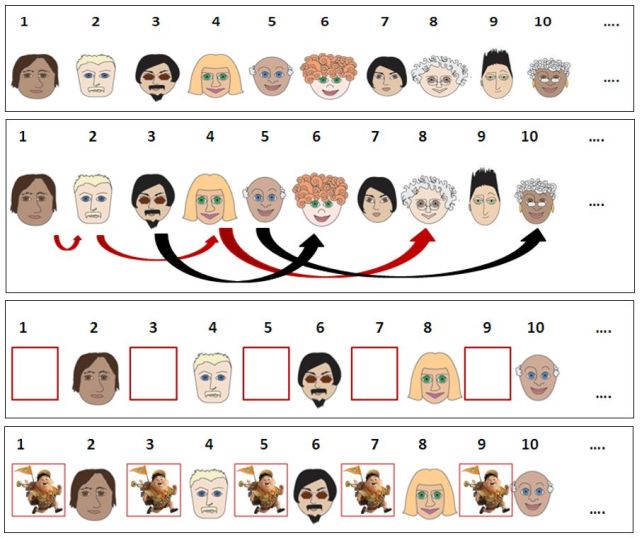

Las publicaciones científicas

Foto: Nationale Bank van Belgie – Banque Nationale de Belgique / flickr

Foto: Nationale Bank van Belgie – Banque Nationale de Belgique / flickrUn componente clave de la empresa científica es el sistema de publicaciones, pues sin él no sería posible exponer al escrutinio crítico las conclusiones del trabajo de cada uno.

Ya desde los albores de la ciencia moderna las cosas funcionaban de ese modo. Copérnico, Kepler y Galileo, cada uno a su manera, publicaron los resultados de sus observaciones o experimentos (en el caso de Galileo experimentos mentales, algunos de ellos). Lo propio hizo Harvey, por ejemplo, y otros reconocidos pioneros de la ciencia tal y como la conocemos hoy. Además, algunos también operaron de una forma algo diferente. Algunos miembros de la Royal Society acostumbraban, en sus primeros años, a realizar experimentos y demostraciones ante sus compañeros. El contraste era directo; al hacerlos testigos de la forma en que se había obtenido algún resultado de interés, la validación o refutación del resultado era inmediata. Pero ya la misma Royal Society, en 1665 (cinco años después de su creación) comenzó a publicar la Philosophical Transactions of the Royal Society. Ese mismo año, algo antes, se había empezado a publicar en París Le Journal des Sçavans, considerada la primera revista científica de la historia.Andando el tiempo las ciencias de la naturaleza han alcanzado unas dimensiones tales que ya no sería posible recurrir a las demostraciones directas para dar fe de la validez de los resultados obtenidos. Por eso, el aumento de la actividad científica ha venido acompañado por un crecimiento paralelo del sistema de publicaciones científicas.

Los primeros artículos científicos tenían un estilo narrativo más literario y con un hilo argumental biográfico, el autor contaba cómo había ido haciendo el descubrimiento. Posteriormente (se suele citar a Pasteur como el principal impulsor de la idea) el hilo narrativo se centra en la reproducibilidad del descubrimiento, independientemente de la historia que llevo a hacerlo. Hoy día esa estructura (resumen, introducción, materiales y métodos, resultados, discusión, conclusiones y referencias) se ha hecho universal. En el lado positivo, esta estructura permite una alta densidad de información, a cambio los trabajos son difíciles de leer y más aún de escribir.

En principio, las revistas científicas se publican para dar a conocer los resultados de las investigaciones. De otra forma no sería posible poner al alcance de todos los resultados obtenidos ni, por lo tanto, podrían someterse a crítica general. Y por otro lado, la publicación de los resultados supone también un bien en sí mismo, dado que en la medida a que obliga a los investigadores a sistematizar y ordenar los resultados, y a elaborar un argumento que les dé coherencia y los enmarque en el curso general del desarrollo científico, también sirve de ayuda para mejorar los conocimientos y sentar las bases de su progreso. Hay, de hecho, quien argumenta que las publicaciones científicas constituyen el conocimiento científico propiamente dicho, dado que son el archivo de todo lo investigado y conocido.

Pero las publicaciones científicas, además de las señaladas, han pasado a cumplir otras funciones que tienen poco que ver con ellas. Se han convertido en uno de los medios más utilizados para evaluar la productividad y la calidad de investigadores e instituciones científicas y académicas. Por ello, han pasado a formar parte de las herramientas métricas básicas que se utilizan para, en función de las evaluaciones, decidir el acceso a puestos de trabajo de personal investigador, su posterior promoción profesional y, en general, asignar los recursos públicos en el marco de la política científica de gobiernos y universidades.

Por todo ello, desde el punto de vista de los intereses de investigadores e instituciones, las publicaciones científicas no se consideran solo como un elemento de prestigio, el distintivo que señala al buen investigador o la institución de alto nivel. Han pasado a ser una herramienta de promoción profesional e institucional e, incluso, de mera supervivencia en el sistema científico. Ello genera una presión muy grande sobre científicos y centros.

El método que siguen las editoriales para seleccionar los artículos merecedores de ser publicados es someterlos a la consideración de especialistas de reconocido nivel. Es lo que se denomina revisión por pares. El término par, como sinónimo de igual, hace referencia al hecho de que los revisores son investigadores como los autores de los trabajos. Así pues, los evaluadores son colegas de los autores y, en principio, se encuentran al mismo nivel que aquellos. Se supone que este procedimiento garantiza que los trabajos que se publican cumplen los requisitos exigibles para aceptar que un trabajo sea dado a conocer. Normalmente cuanto mayor es el nivel de las revistas y más son los investigadores que les remiten sus trabajos para publicación, y de esa forma se genera un circuito de retroalimentación positiva que funciona de acuerdo con la siguiente secuencia: cuantos más son los trabajos remitidos a una revista, más son los rechazados, por lo que como solo se seleccionan los muy buenos, la calidad de los que se publican es cada vez mayor; ello actúa como incentivo para publicar en esa revista, con lo que la remisión de trabajos aumentará, y así sucesivamente. Esa es la teoría.

Este artículo se publicó originalmente en el blog de Jakiunde. Artículo original.

Sobre los autores: Juan Ignacio Perez Iglesias es Director de la Cátedra de Cultura Científica de la UPV/EHU y Joaquín Sevilla Moroder es Director de Cultura y Divulgación de la UPNA.

El artículo Las publicaciones científicas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Hacia un nuevo sistema de publicaciones científicas

- #Naukas15 De publicaciones científicas

- #Naukas14 Acceso abierto a las publicaciones científicas

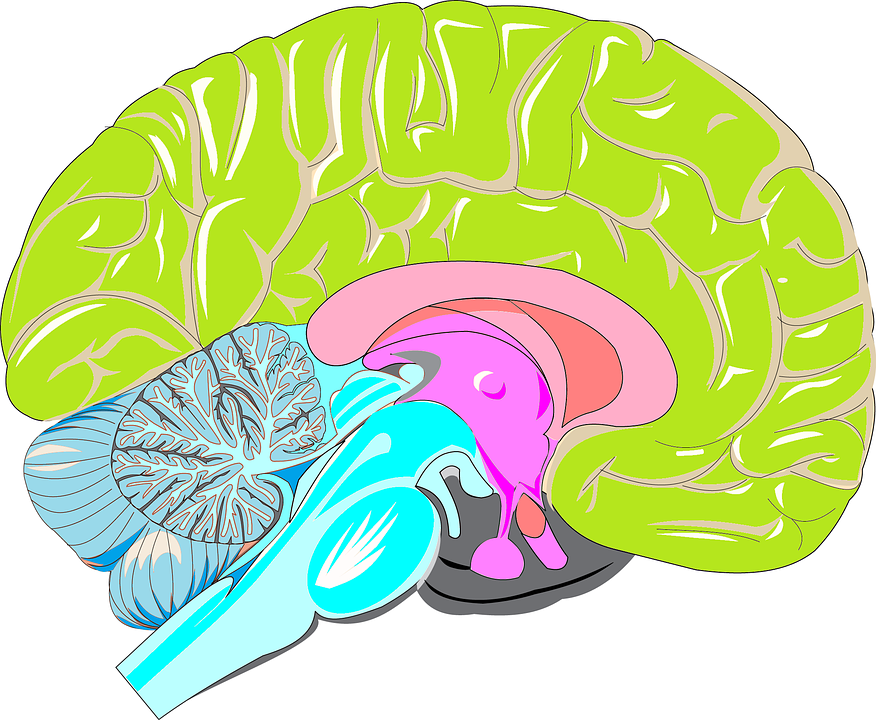

Giza garunak denbora behar du garatzeko

Substantzia grisak hainbat elementu hartzen ditu barnean: neurona gorputzak eta horien dendritak –luzakin adarkatuak, zeinen bidez neurona batek beste baten seinaleak jasotzen baititu–; gliako zelulak, aurrekoen euskarri eta babes direnak (alabaina, gliaren funtzioak ezagutzeko, ikus [1]); odol kapilarrak, neuronei eta glia zelulei behar dituzten oxigenoa eta mantenugaiak ematen dizkietenak; eta neuronarteko konexioak, alegia, sinapsiak. Substantzia grisa garunaren eta zerebeloaren azalean banatzen da, bai eta entzefaloaren barnean oso sakon dauden egitura askotan ere. Substantzia zuri esaten diegu neuronen axoiei; substantzia lipidiko batez (mielina) gainestalita daude. Axoi bat hodi formako luzakin bat da, nerbio seinaleak eroaten dituena nagusiki neurona gorputz batetik aparte samar dagoen beste batera, edota muskulu zeluletara. Axoia estaltzen duen mielina zorroa isolatzailea da; hala, nerbio pultsuak lasterrago eta modu efikazean transmititzen dira.

Irudia: Gizakiok, beste animalia batzuekin alderatuz, tamaina handiko buruarekin jaiotzen gara, hala ere, entzefaloa guztiz hazi eta garatu arte denbora tarte bat behar izaten da. (Ilustrazioa: srossign / Pixabay)

Garun azalaren eskualde batzuetako substantzia grisaren bolumena 10 urterekin iristen da gehieneko garapenera. Hazkundea neuronarteko konexioak ugaritzearen isla da, eta ugaritzea, esperientziaren, trebakuntzaren eta ikaskuntzaren ondorio. Urte horietan guztietan, jarduera entzefalikoa hain da bizia, organismoak atsedenean kontsumitzen duen energiaren % 60 ere gastatu baitezake, eta eguneko energia premia osoaren ia erdia. Energia kontsumo horri egozten dio zenbaitek gorputzaren hazkundea hain motela izatea haurtzaroan, eta denbora behar izatea.

Hamaika edo hamabi urte bete ondotik, gauzak bestela dira. Garun azaleko substantzia grisaren lodiera argaltzen hasten da, baita nabarmen argaldu ere nerabezaroan. Alderdi batzuetan, murrizketa % 17koa ere izaten da prozesuaren amaieran, 15 urte geroago. Kontua da, konexio sinaptikoen parte bat, hein batean, «kimatu» egiten dela, neurozientzialarien hizkeran esanda. Kimaketan, erabiltzen ez diren edo gutxi erabiltzen diren konexioak ezabatzen dira, erabilienei eutsita. Aldi berean, substantzia zuriaren tamaina handitu egiten da. Alegia, axoi seinale eroaleak lodiagoak dira, eta estaldura zabalagoa dute, mielina geruza lipidikoari esker. Axoiak lodituta eta mielinizazioa areagotuta, nerbio pultsuak lasterrago eta modu efikazagoan transmititzen dira; beraz, efizienteagoa da komunikazioa garun azalaren eta gainerako eremu entzefalikoen artean. Hitz bitan esanda: garunak hobeto funtzionatzen du.

Garun azala heltzeko denbora behar da; ondorioz, nerabezaroa aldi zaila izaten da. Alabaina, aro horretan ikasten du giza adimenak zer-nola jokatu helduaroko gizarte ingurune konplexuan. Nerabezaroa, beraz, ikaskuntza horren truke ordaintzen den prezioa genuke.

[1] Xurxo Mariño erabiltzaileak (@xurxomar) diostanez, mende hasieratik kontsideratu da glia (zehazki, astrozitoak) neurona jarduera doitzeko funtsezko elementu. Horrenbestez, praktikan, egungoak halako bi lirateke NSZren barnean geneuzkakeen konputazio elementuak. Alegia, sinapsi askotan, hiru elementu daude: neurona presinaptikoa, post-sinaptikoa eta glia. Neurotransmisore neuronalak glia zelularen jarduera aldatu dezake, eta azken horrek, berriz, orain gutxiz geroztik gliotransmisore deitzen direnak ekoizten ditu, neurotransmisoreen analogiaz, eta horiek doitzen dute funtzio neuronala. Eta esteka hau eta beste hau eskaini dizkit. Eskerrik asko, Xurxo!

———————————————————————————-

Egileaz: Juan Ignacio Pérez Iglesias (@Uhandrea) UPV/EHUko Fisiologiako katedraduna da eta Kultura Zientifikoko Katedraren arduraduna.

———————————————————————————

Oharra:

Nerabezaroko neuropsikologiari buruzko hiru artikuluko sorta baten zatia da hau. Hauek dira sortako artikuluak:

- Nerabezaroko desoreka

- Norbere identitatearen bila

- Giza garunak denbora behar du garatzeko

Iturri nagusiak (hiru artikuluenak):

- Blakemore, Sarah-Jayne (2018). Inventing Ourselves: The Secret Life of the Teenage Brain. Doubleday. London: Penguin Books. (espainieraz, La invención de uno mismo: La vida secreta del cerebro adolescente, 2018, Ariel)

- Hainbat egile (2018): Collection – Adolescence. Coming of age: the emerging science of adolescence. Nature.

- Mas, Salguero, María José (2018): La aventura de tu cerebro. Pamplona: Next Door Publishers.

- Sapolsky, Robert (2017): Behave. London: Penguin Books. (espainieraz, Compórtate, 2018, Capitán Swing)

The post Giza garunak denbora behar du garatzeko appeared first on Zientzia Kaiera.

Las angulas se van a China

Menú de Sabino Arana en la Nochebuena de 1895 en la cárcel de Larrínaga, en Bilbao:

“Ostras, chirlas, alubias, bacalao, angulas, besugo, bermejuelas, merluza y caracoles; de postre, compota de manzana, pastel, mazapán y turrón de Jijona; y de bebida, vino de Aranburuzabala, txakoli, jerez, oporto y chartreuse.”

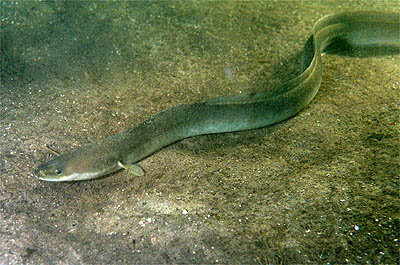

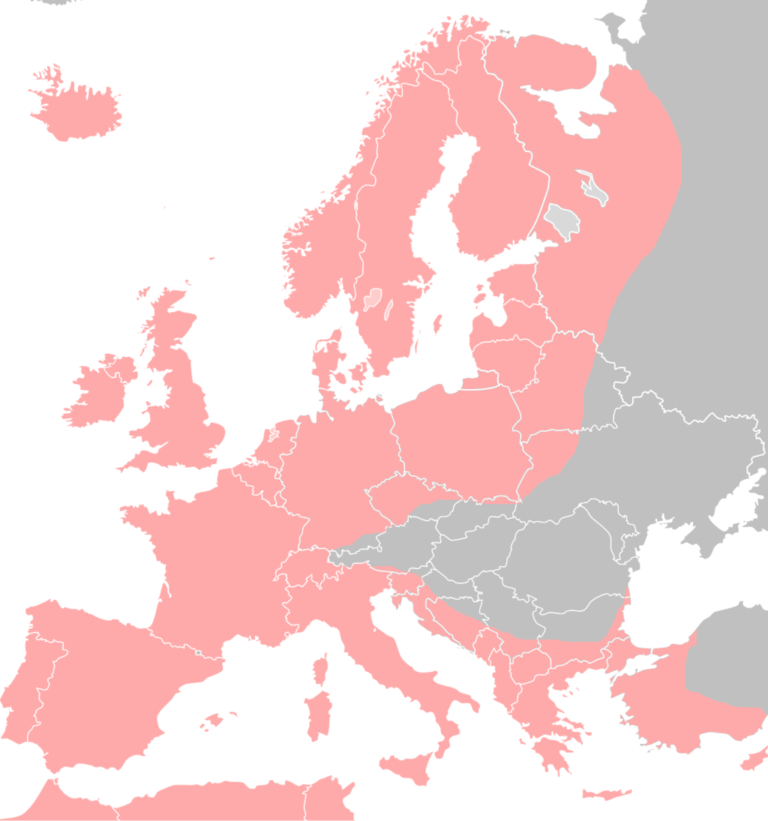

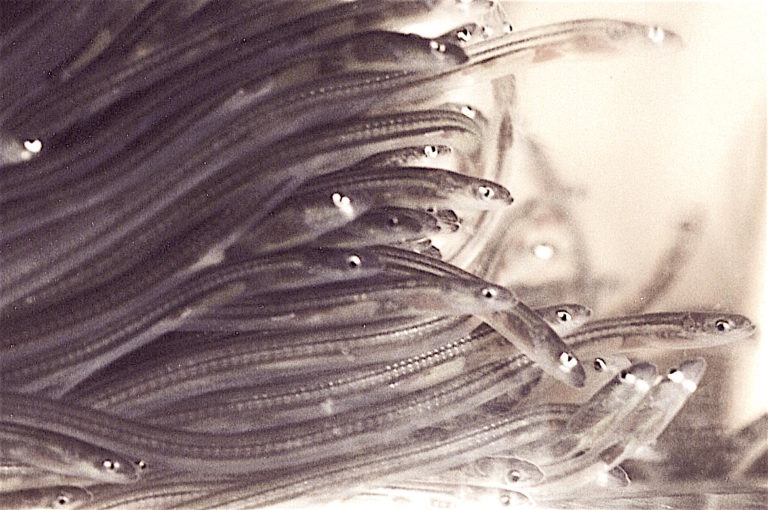

Angulas. Fuente: Wikimedia Commons

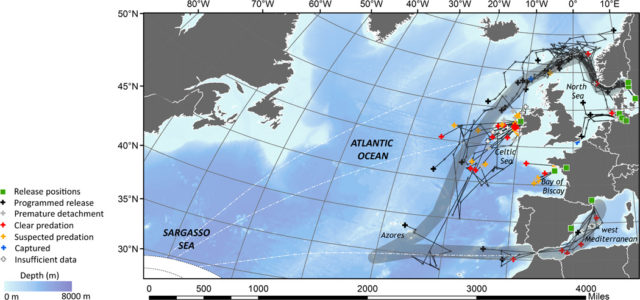

Angulas. Fuente: Wikimedia CommonsLlega la Navidad. Llegan las felicitaciones, las compras, la espectacular iluminación, el Nacimiento y el Árbol de Navidad, los Reyes Magos, Santa Klaus y el Olentzero, la familia, los amigos, las comidas y las cenas y, en el recuerdo, un lejano recuerdo, las angulas. Uno descubre que va perdiendo la memoria, quizá por los años, sobre todo por los años que han pasado desde que comió angulas por última vez, y ha olvidado hasta su sabor. Pero, seguro que no pasa lo mismo en Shanghai, punto de destino de 40 kilos de angulas vivas requisadas en el Aeropuerto de Loiu a finales de abril de 2017. Al año siguiente, se desmanteló otra red en España, Portugal y Marruecos, preparada para enviar media tonelada de angulas a China. En febrero de 1918, la Guardia Civil entregó 310 kilos de angulas, incautadas en Barajas, a la Diputación de Gipuzkoa para repoblar los ríos Oiartzun y Oaria.

El tráfico ilegal de angulas viene de años atrás, y, por ejemplo, en 2012, el SEPRONA incautó tonelada y media de angulas, valoradas en millón y medio de euros. Iban, también, a China, para su crecimiento y venta como anguilas. Y en 2016 fueron 2.5 toneladas. Los contrabandistas llegan a pagar las angulas hasta a 2800 euros el kilo. Entran unas 3000 angulas en cada kilo, y aunque algunas mueren durante los traslados, el negocio es muy rentable. Por cada kilo de angulas se obtienen 1260 kilos de anguilas, y ya sin cabeza, ahumadas y envasadas, se venden en Asia a 40 euros el kilo. Por tanto, por un kilo de angulas a 2800 euros se obtienen 50000 euros de anguilas. Los 40 kilos de Loiu podrían haber alcanzado los 74000 euros en China. Se ha escrito que el contrabando de angulas es más rentable que el tráfico de cocaína.

En la red más organizada de contrabando de angulas, que se desmanteló a principios de marzo de 2017, la Guardia Civil recuperó angulas capturadas en el Guadalquivir, la Albufera de Valencia y el Delta del Ebro. De allí, en camión frigorífico y en cubetas de agua, se transportaban hasta el Aeropuerto de Atenas, donde embarcaban en avión con destino a Hong Kong. Se calcula que los beneficios de esta organización eran unos siete millones de euros al año.

La primera condena por contrabando de angulas, en junio de 2019, supuso seis millones de euros de multa y seis años de cárcel.