Leonardo Torres Quevedo en Bilbao, 1919-2019: Naútica, Aeronáutica y Computación

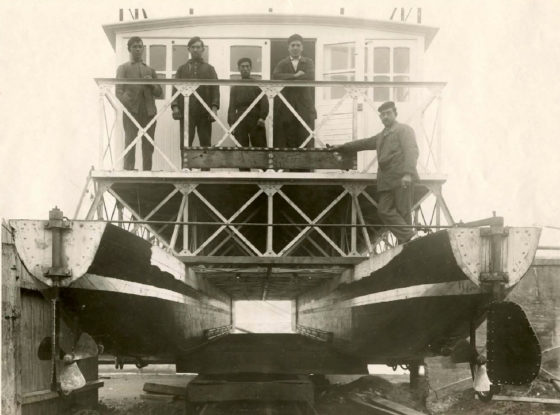

El catamarán que Leonardo Torres Quevedo diseñó y se construyó en los astilleros de Euskalduna en Bilbao. Conocido como «binave» se probó en la ría de Bilbao en 1918 por primera vez. Fotografía: Francisco Gonzalez Redondo – Museo Torres Quevedo

El catamarán que Leonardo Torres Quevedo diseñó y se construyó en los astilleros de Euskalduna en Bilbao. Conocido como «binave» se probó en la ría de Bilbao en 1918 por primera vez. Fotografía: Francisco Gonzalez Redondo – Museo Torres QuevedoEl ingeniero Leonardo Torres Quevedo (1852-1939) fue el protagonista de importantes sucesos ocurridos en Bilbao hace cien años. Por un lado, completó en la ría de la capital vizcaína las pruebas de su “Binave”, el primer catamarán moderno construido en los astilleros Euskalduna. Por otro, hacía público en el Teatro Arriaga el proyecto del dirigible trasatlántico “Hispania”, culminación de su obra aeronáutica.

Otro de los grandes logros del ingeniero de origen vasco fue su “aritmómetro electromecánico”, aparato que puede considerarse el primer ordenador de la historia en el sentido actual del término y que fue presentado en la Exposición de Material Científico.

Todos estos grandes inventos, entre otros, hicieron que fuera calificado en 1930 como el más prodigioso inventor de su tiempo, por lo que ocupa un importante lugar en la historia universal de la ciencia y la técnica. Francisco A. González Redondo, profesor de la Universidad Complutense de Madrid (UCM), analizó las grandes obras del ingeniero el pasado 18 de septiembre en la Biblioteca Bidebarrieta de Bilbao.

Francisco A. González Redondo es profesor en la Universidad Complutense de Madrid (UCM) en el Departamento de Didáctica de las Ciencias Experimentales, Sociales y Matemáticas, además de ser uno de los grandes especialistas en la vida y obra de Leonardo Torres Quevedo. Sobre él ha escrito una biografía y numerosos artículos, además de organizar numerosos congresos y exposiciones.

Edición realizada por César Tomé López

El artículo Leonardo Torres Quevedo en Bilbao, 1919-2019: Naútica, Aeronáutica y Computación se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- «Leonardo Torres Quevedo, el más prodigioso inventor de su tiempo» por F.A. González Redondo

- Neandertales ¿crónica de una muerte anunciada?, por María Martinón-Torres

- Francisco Ayala en Bilbao

Ezjakintasunaren kartografia #279

Egia izango da garagardo bat hartzearren sedentario bilakatu ginela? Did we settle down for beer? Pablo Ortizen eskutik.

CRISPR teknologiak emaitza garrantzitsuetarantz doa: Rosa García-Verdugoren CRISPR gene therapy against AIDS

Kristaletako akatsak, bereziki bidimentsionalak badira, kristala bera bezain garrantzitsua izan daitezke. Zuzen identifikatzeko tresna teoriko eta esperimentalak behar direla frogatzen dute DIPCkoek How to identify a point defect in 2D transition metal dichalcogenides

–—–

Mapping Ignorance bloga lanean diharduten ikertzaileek eta hainbat arlotako profesionalek lantzen dute. Zientziaren edozein arlotako ikerketen azken emaitzen berri ematen duen gunea da. UPV/EHUko Kultura Zientifikoko Katedraren eta Nazioarteko Bikaintasun Campusaren ekimena da eta bertan parte hartu nahi izanez gero, idatzi iezaguzu.

The post Ezjakintasunaren kartografia #279 appeared first on Zientzia Kaiera.

¿Quiere que coman fruta y verdura? Conviértalos en pequeños artistas

«Vertumnus» (1590/1591) de Gisussepe Arcimboldo

«Vertumnus» (1590/1591) de Gisussepe ArcimboldoLas tasas de sobrepeso y obesidad infantil son preocupantes a nivel mundial. Por ello, se han llevado a cabo programas para promover hábitos alimentarios saludables. La mayoría se ha centrado fundamentalmente en la educación nutricional, pero esta no es la única estrategia posible. Nosotros hemos optado por una aproximación diferente a este problema.

Es habitual que niños y niñas rechacen probar nuevos alimentos, sobre todo frutas y verduras. Este comportamiento se denomina neofobia alimentaria y se considera como característico del desarrollo evolutivo entre los 2 y 6 años. Sin embargo, si no se gestiona adecuadamente puede prolongarse hasta la edad adulta.

Frutas y verduras son, además, una fuente de minerales y vitaminas. Por todo ello es sumamente importante explorar nuevas estrategias para fomentar el consumo de estos alimentos entre la población infantil.

El papel de los sentidos

La simple exposición ha sido una de las estrategias más utilizadas para inducir el consumo de nuevas frutas y verduras. De esta manera, el niño se familiariza con el alimento. Además, durante un tiempo se consideró que en su aceptación era decisivo el sentido del gusto y, por eso, había que probar y saborear estos alimentos.

No obstante, otros autores observaron que la información de los sentidos del tacto, de la vista y del olfato también eran importantes para probar nuevas verduras.

Centrémonos en el sentido de la vista. En un estudio donde se presentaron los vegetales con diferentes formas (enteros, a rebanadas, en palitos y con figuras de estrella), los resultados mostraron que los pequeños preferían mucho más las verduras con figura de estrella.

De manera similar, otros autores encontraron que los niños comieron el doble de fruta cuando esta se presentaba decorada con palillos para cócteles y dentro de una sandía que cuando se mostraba de manera habitual. Los elementos divertidos siempre han resultado atractivos para los más pequeños: un claro ejemplo de ello es la variedad de colores y formas que presentan la mayoría de golosinas.

Efecto ‘Ikea’

Hasta el momento, varios estudios han identificado una relación entre la participación de los niños en la preparación de los alimentos (concretamente, en la compra y el cocinado) y el aumento de su disposición a probar cosas nuevas.

Este tipo de actividades prácticas son muy valoradas entre los pequeños, y se ha demostrado que aportan una sensación de responsabilidad y orgullo. Dichas emociones han sido explicadas a través del denominado “Efecto Ikea” o, más específicamente en relación a la comida, “lo cocino para mí”.

Este fenómeno explica cómo los consumidores aprecian más (por tanto, les gusta más e ingieren mayor cantidad) aquellas comidas que han preparado ellos mismos, comparadas con las elaborados por otras personas. Además, crear experiencias positivas con nuevos alimentos es también interesante, ya que la aceptación de nuevos sabores puede generalizarse y aumentar así la de otros diferentes.

Preparar platos artísticos

En un estudio, llevado a cabo en el departamento de I+D del Basque Culinary Center de Donostia-San Sebastián analizamos los efectos en el consumo y el agrado de nuevas frutas y verduras al involucrar a los niños en la creación de una merienda artística.

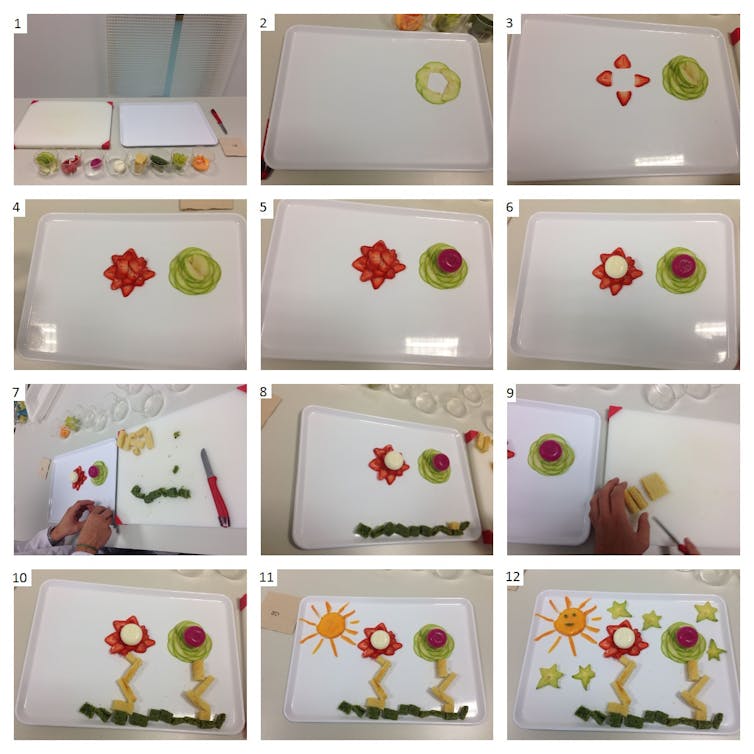

Uno de los platos artísticos preparados para el experimento.

Uno de los platos artísticos preparados para el experimento.Para ello, se crearon tres grupos:

- El grupo ART, en el que los pequeños elaboraron ellos mismos el plato artístico y luego lo comieron para merendar.

- El grupo VISUAL, donde los niños participaron en una actividad creativa de tipo collage con imágenes de frutas y verduras. A continuación merendaron el mismo plato artístico que el grupo anterior, pero elaborado por los investigadores.

- El grupo CONTROL, en el que los niños participaron en la misma actividad creativa que el grupo anterior y merendaron los mismos alimentos que el resto, pero presentados de la manera habitual (simplemente cortados).

Los resultados mostraron que tanto el grupo ART como el VISUAL aumentaron su disposición a probar y comer nuevos alimentos. Esto indica que tanto la creación como la presentación del plato artístico pueden ser dos estrategias válidas para fomentar el consumo de nuevas frutas y verduras.

Proceso de elaboración del plato.

Proceso de elaboración del plato.Este experimento ha demostrado, además, que los niños también “comen primero con la vista”.

No obstante, el grupo que elaboró el plato por ellos mismos (ART) mostró un estado de ánimo más positivo, así como una mayor dominancia. Esto prueba que participar en la elaboración tiene un mayor impacto en el estado emocional que el simple hecho de comer algo elaborado por otro.

También es importante recalcar la importancia de jugar con los alimentos, tocándolos con las manos e implicando diferentes sentidos. Al final, crear comidas artísticas es una nueva forma de jugar y divertirse en familia.![]()

Sobre la autora: Edurne Maiz Aldalur es profesora adjunta de la Facultad de Psicología, Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo ¿Quiere que coman fruta y verdura? Conviértalos en pequeños artistas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Acumuladores térmicos domésticos más pequeños usando parafinas

- Artistas científicos

- Artistas que miran a las matemáticas

Lur Epelde: “Lurzoruek ematen digute jaten dugunaren %95a” #Zientzialari (123)

Lurzoru osasuntsuak izatea benetan garrantzitsua da, izan ere, gizakiok jaten dugunaren gehiengoa horietatik dator, klima aldaketa arintzen laguntzen dute eta uraren zikloa erregulatzen dute. Lurzoruak sistema biziak dira, eta planetako biodibertsitate handiena dute, mikroorganismo ugari daudelako bertan.

Lurzoruetako Mikroorganismoen Ekologia taldeak mikroorganismoen azterketa du lan-ildo nagusi eta, hain zuzen ere, klima-aldaketek, lurzoru kutsatuek edota nekazal praktika desberdinek lurzoruan duten inpaktua aztertzen dute.

Neiker Tecnaliako Lurzoruetako Mikroorganismoen Ekologia taldeko kidea da Lur Epelde, eta berarekin hitz egin dugu lantaldeak jorratzen duen azterketaren nondik norakoak eta erronka nagusiak ezagutzeko.

“Zientzialari” izeneko atal honen bitartez zientziaren oinarrizko kontzeptuak azaldu nahi ditugu euskal ikertzaileen laguntzarekin.

The post Lur Epelde: “Lurzoruek ematen digute jaten dugunaren %95a” #Zientzialari (123) appeared first on Zientzia Kaiera.

A la sombra de un Adagio

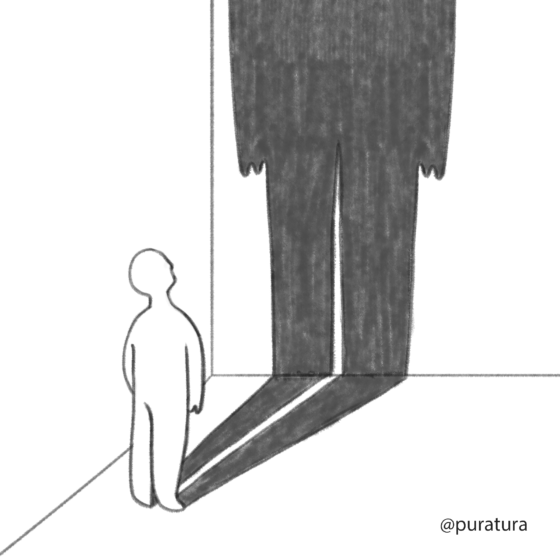

Imagen de Almudena M. Castro (@puratura)

Imagen de Almudena M. Castro (@puratura)El Adagio de Barber ha sonado en cientos de funerales, exequias y homenajes. Pero hubo uno donde su ausencia se hizo notar: el funeral de su propio compositor, Samuel Barber. Él mismo lo vetó poco antes de su muerte, cansado del que fue simultáneamente su mayor éxito y un espejo asfixiante durante toda su carrera.

Barber copuso su famoso Adagio en 1936, cuando apenas tenía 26 años. Pocos años antes, había conocido a Arturo Toscanini, uno de los compositores más célebres de su tiempo, quien le había animado a enviarle alguna de sus obras. Barber, un compositor joven y deseoso de darse a conocer, arregló rápidamente el movimiento lento de un cuarteto de cuerda que había compuesto poco antes y así nació su famoso Adagio para cuerdas.

La obra se estrenó el 5 de noviembre de 1938. Un selecto grupo de melómanos fue invitado al Estudio 8H del Rockefeller Center para ver a Toscanini dirigir la premier al frente de la Orquesta Sinfónica de la NBC. La obra además se grabó y emitió en directo para todos los oyentes de la Radio Nacional. Hasta la fecha, pocas obras del repertorio clásico se habían estrenado ante una audiencia tan inmensa y un público tan pequeño.

Desde entonces, y a partir de las primeras críticas positivas, su fama no dejó de crecer. Funerales, elegías, películas, televisión… durante el s. XX, no hubo lugar triste donde no sonase el Adagio. A día de hoy, algunas orquestas aún lo ensayan periódicamente, por si a alguna celebridad le da por estirar la pata.

Sin embargo, el compositor acabó lamentando este éxito tan temprano. Por un lado, su tremenda intensidad emocional fijó un estándar que Barber se sentía presionado a replicar en cada un de sus obras, condenado a destilar, una y otra vez, la fórmula que le había llevado al éxito. Pero además, sucedió que esta ópera prima eclipsó por completo el resto de su obra (y lo sigue haciendo a día de hoy, basta con buscar Samuel Barber en Spotify, por ejemplo).

Barber estaba convencido de haber escrito obras al menos igual de buenas que el Adagio, como sus conciertos para violín y para piano. Por eso no entendía que estas no llenasen los escenarios. Su irritación se volvía evidente, cada vez que alguien le comentaba cuánto admiraba su (dichoso) Adagio. En una entrevista de 1949, un periodista de la CBS le interpela, admirado, explicando que el Adagio fue la primera composición de Barber que él conoció. El compositor le contesta, “ojalá hubieses escuchado alguna de las nuevas” y añade con desdén “todo el mundo toca esa”. Hacia 1979, la acidez parece haber ido in crescendo: “A veces me aburro escuchando el Adagio. Pero me divierto durante las representaciones porque sé que siempre va a haber un error en alguna parte; simplemente espero que suceda. Es una obra tan sencilla, que ni siquiera se molestan en ensayarla”. A pesar del paso de los años, su Adagio lo seguía y ocultaba como una sombra, un espejo plano y oscuro en el que el compositor ya no se reconocía y que otros se empeñaban en mostrar.

No es de extrañar, por tanto, que Barber pidiese excluirlo de su propio funeral. Carlo Menotti, su pareja de toda la vida, se aseguró de que así fuera: durante la ceremonia sonaron corales de Bach, otras obras de música vocal de Barber, un madrigal del propio Menotti… ni resto del Adagio. Sin embargo, no logró silenciarlo durante la agonía del pobre Barber, atrapado en el hospital a causa del cancer: poco antes de su muerte, el director Lukas Foss dirigió su propia interpretación al frente de la Orquesta Filarmónica de Brooklyn y se la dedicó al compositor convaleciente. También Bernstein lo dirigió como homenage, poco tiempo después. Los amigos de Barber fueron a visitarle al hospital y le tocaron el Adagio en directo con todo su amor (y para aburrimiento mortal del compositor, segúnel testimonio de Menotti)… no falta comedia en esta pequeña tragedia, si uno la quiere ver.

Referencia:

Thomas Larson (2012) «The Saddest Music Ever Written: The Story of Samuel Barber’s Adagio for Strings»

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo A la sombra de un Adagio se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Naukas Bilbao 2017 – Ángel Gómez Roldán: Tras la sombra de la Luna

- Tema y variaciones

- El último puzle de Bach

Gorbeialdeko Hondakinen Partzuergoak kudeatutako hiri-hondakin solidoen errefusaren karakterizazioa

Irudia: Karakterizatutako hiri hondakin solidoen batez besteko konposizioari dagokionez, materia organiko biodegradagarriak osatu du masa-portzentajerik handiena (% 49a).

Modu ez selektiboan biltzen diren HHSen (errefusa, zabor nahasia) konposizioa ezagutzea da gaur egun egiten den kudeaketa hobetzeko lehenengo pausua. Ildo horretan, Gorbeialdeko Hondakinen Partzuergoak kudeatzen duen errefusa karakterizatu da, horren konposizio zehatza ezagutu ahal izateko (ze masa-portzentaje dagokio frakzio bakoitzari?). Modu horretan bakarrik diseinatu ahal izango dira legez ezarritako birziklatze-tasak lortzea ahalbidetuko duten ekintzak.

Gorbeialdeko Hondakinen Partzuergoak Urkabustaiz, Zuia, Zigoitia, Legutio, Otxandio eta Oletako kontzejuko errefusa kudeatzen du, besteak beste. Udalerri horiek Gorbeialdeko Koadrilan kokatzen dira (Otxandio ezik), eta ikerketa-eremua osatu dute. Ikerketa lan honetan HHSen errefusaren konposizioan eragina duten bi aldagai aztertu dira: etxebizitza-egitura eta urtaroa. Etxebizitza-egiturari dagokionez, ikerketa-eremuan hiru multzo nagusi identifikatu dira: baserrialdea (baserriak), herrialdea (biztanle nukleo handiak), eta txaleten-ingurunea (lorategia duten bigarren etxebizitzak). Urtaroaren eragina ere aztertu da, eta horretarako laginak udan eta neguan hartu dira. Guztira, beraz, sei karakterizazio egin dira: hiru neguan, bat eremu bakoitzeko, eta beste hiru udan.

Laginketa bakoitzean, etxebizitza-egitura eta urtaro bakoitzari dagokion errefusa bildu, eta 250 kg-ko lagina karakterizatu da. Horretarako, hondakin-mota ezberdinak (beira, papera eta kartoia, ontzi arinak, materia organikoa, eta bestelako hondakinak) begi bistaz identifikatu, eta eskuz bereiztu dira. Azkenik, frakzio bakoitzaren masa determinatu eta masa totalaren konposizioa kalkulatu da, masa-portzentajean.

Karakterizatutako HHSen batez besteko konposizioari dagokionez, materia organiko biodegradagarriak osatu du masa-portzentajerik handiena (% 49a), ez da harritzekoa, izan ere frakzio honen bereizketa selektiboa ez da ematen eskualdean. Nahiz eta eremutik eremura desbiderapen txikiak antzeman, laginketa guztietan frakzio horrek masa totalaren erdia izan du (% 43-53), gutxi gorabehera. Beirari (% 2,1), ontzi birziklagarriei (% 7,2) eta papera eta kartoiari (% 6,8) dagozkion batez besteko portzentajeak baxuak izan dira. Datu hauek, frakzio hauen bereizketa selektiboa egokia dela mahai gaineratu du; beraz, hobekuntza tartea frakzio horietan txikia da. Beste hondakinen frakzioak (birziklatu eta konpostatu ezin diren horiek, alegia) masa totalaren % 35a osatu du (batez beste), hau da, benetan sortzen den errefus masa dagokion kontenedorean jasotzen dena baino askoz txikiagoa da (HHSen masa osoaren %65.6 izatetik %23.1ra izatera pasako litzateke bereizketa egokia izango balitz).

Urtaroak eta etxebizitza motak eragina izan dute azterturiko HHSen errefusaren konposizioan. Udan materia organiko biodegradagarriaren, beiraren, paper eta kartoiaren, eta ontzi birziklagarrien frakzioek gora egin dute aztertu diren hiru eremuetan. Etxebizitza motari dagokionez, txaleten-inguruneko HHSetan materia organiko biodegradagarriaren masa-portzentajerik handiena antzeman da (batez beste: txaleten-ingurunean % 53; herrialdean % 50, baserrialdean % 43), eta baserrialdean, aldiz, bestelako hondakinen frakzioren portzentajerik handiena (batez beste: baserrialdean % 43, herrialdean % 33, txaleten-ingurunean: % 30).

Azkenik, adierazi deigarria suertatu dela, baserrialdean eta txaleten-ingurunean, aztertutako bi urtaroetan, jasotako plastiko handien (normalean nekazaritzan erabiltzen direnak) masa-portzentajea, baita hildako animalien presentzia ere. Bi zona horietako materia organiko biodegradagarrian, janari-hondarrez gain, inausketa-hondakinen, lurraren, eta soropilaren presentzia nabaria izan da. Azken hondakin horiek udako laginketan negukoan baino ugariagoak izan dira.

Artikuluaren fitxa:- Aldizkaria: Ekaia

- Zenbakia: Ekaia 34

- Artikuluaren izena: Gorbeialdeko Hondakinen Partzuergoak kudeatutako hiri-hondakin solidoen errefusaren karakterizazioa

- Laburpena: Ikerketa-lan honetan Arabako Gorbeialdeako Hondakinen Partzuergoak kudeatzen dituen hiri-hondakin solidoen (HHSen) errefusa frakzioa karakterizatzeko proposaturiko metodologia eta lorturiko emaitza nagusiak jaso dira. Aztertu diren laginak osatzeko, bilketa kamioiek egin beharreko ibilbideak diseinatu dira, eta horretarako aldagai orokor bi kontuan hartu dira: sasoia (negua eta uda) eta etxebizitza-mota (herrialdea, baserrialdea eta txaletak). Egindako analisiek adierazi dute bi aldagai horiek eragina dutela errefusa frakzioaren konposizioan, eta batez ere errefusa osatzen duten bi frakzio nagusietan: materia organikoa eta bestelako hondakinak. Nabarmentzekoa da errefus masa totalaren %65 (gutxi gorabehera) birzikla edota berrerabil daitezkeen materialek osatzen dutela. Oro har, aztertutako lagin guztiek hobetzeko hein zabala dute materia organikoaren bilketa selektiboan.

- Egileak: Daniel Zuazagoitia, Naiara Rojo, Arrate Santaolalla, Iñigo Zuazagoitia.

- Argitaletxea: UPV/EHUko argitalpen zerbitzua.

- ISSN: 0214-9001

- Orrialdeak: 225-242

- DOI: 10.1387/ekaia.19068

————————————————–

Egileez:

Daniel Zuazagoitia UPV/EHUko Hezkuntza eta Kirol fakultateko Matematika eta Zientzia Esperimentalen Didaktika Sailean dabil; Naiara Rojo eta Arrate Santaolalla UPV/EHUko Gasteizko Ingeniaritzako Unibertsitate Eskolako Ingeniaritza Kimikoa eta Ingurumenaren Ingeniaritza Sailean; Iñigo Zuazagoitia UPV/EHUko Gasteizko Ingurugiro Gaietarako Ikastegian dabil.

———————————————–

Ekaia aldizkariarekin lankidetzan egindako atala.

The post Gorbeialdeko Hondakinen Partzuergoak kudeatutako hiri-hondakin solidoen errefusaren karakterizazioa appeared first on Zientzia Kaiera.

42, la respuesta definitiva a la vida, el universo y todo lo demás

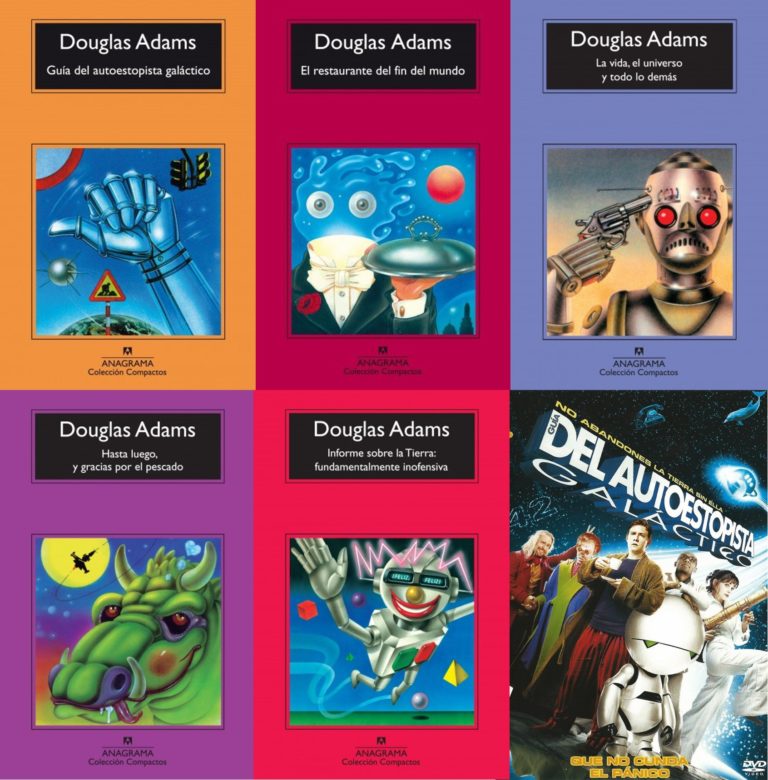

Una serie clásica de novelas de ciencia ficción de la década de los años 1980 es La guía del autoestopista galáctico, del escritor inglés Douglas Adams (1952 – 2001). Originalmente fue una serie para la radio, de 1978, con ese mismo nombre. La serie literaria se compone de cinco libros, el primero que da título a toda la serie, La guía del autoestopista galáctico, fue publicado en 1979, al que siguieron El restaurante del fin del mundo; La vida, el universo y todo lo demás; Hasta luego, y gracias por el pescado e Informe sobre la Tierra.

Portadas de las novelas de la serie de ciencia ficción La guía del autoestopista galáctico, publicadas por la editorial Anagrama, y cartel de la película

Portadas de las novelas de la serie de ciencia ficción La guía del autoestopista galáctico, publicadas por la editorial Anagrama, y cartel de la películaEn la novela aparece un superordenador, llamado Pensamiento Profundo y que es el segundo ordenador más grande del universo del espacio y del tiempo, que ha sido construido por una raza de seres “pan-dimensionales” que buscan el sentido de la vida. Cuando le preguntan al superordenador cuál es la “respuesta definitiva a la vida, el universo y todo lo demás”, éste contesta, después de siete millones y medio de años haciendo cálculos, que “cuarenta y dos”.

– Buenos días –dijo al fin Pensamiento Profundo.

– Hmmm… Buenos días, Pensamiento Profundo –dijo nerviosamente Loonquawl–, ¿tienes… hmmm, es decir…?

– ¿Una respuesta que daros? –le interrumpió Pensamiento Profundo en tono majestuoso–. Sí, la tengo.

Los dos hombres temblaron de expectación. Su espera no había sido en vano.

– ¿De veras existe? –jadeó Phouchg.

– Existe de veras –le confirmó Pensamiento Profundo.

– ¿A todo? ¿A la gran pregunta de la Vida, del Universo y del Todo?

– Sí.

Los dos hombres estaban listos para aquel momento, se habían preparado durante toda la vida; se les escogió al nacer para que presenciaran la respuesta, pero aun así jadeaban y se retorcían como criaturas nerviosas.

[…] Los dos hombres se agitaron inquietos. La tensión era insoportable.

– En serio, no os va a gustar –observó Pensamiento Profundo.

– ¡Dínosla!

– De acuerdo –dijo Pensamiento Profundo–. La Respuesta a la Gran Pregunta…

– ¡Sí…!

– … de la Vida, del Universo y de Todo… –dijo Pensamiento Profundo.

– ¡Sí…!

– Es… –dijo Pensamiento Profundo, haciendo una pausa.

– ¡Sí…!

– Es…

– ¡¡¡¿Sí…?!!!

– Cuarenta y dos –dijo Pensamiento Profundo, con calma y majestad infinitas.

Ante el asombro de sus creadores, el supercomputador les plantea que tienen que buscar cuál es la “pregunta definitiva”. Y como ese ordenador no puede contestar a esa pregunta construyen el superordenador más grande del universo, llamado Tierra, que es destruido antes de responder a la cuestión de cuál es la “pregunta definitiva” y se pierde la posibilidad de conocer esa información de vital importancia.

Esta historia de La guía del autoestopista galáctico es el motivo por el cual cuando hace unas semanas se pudo leer en la prensa que los matemáticos habían resuelto un problema relacionado con el número 42, a muchas personas nos vino a la cabeza la “respuesta definitiva a la vida, el universo y todo lo demás”.

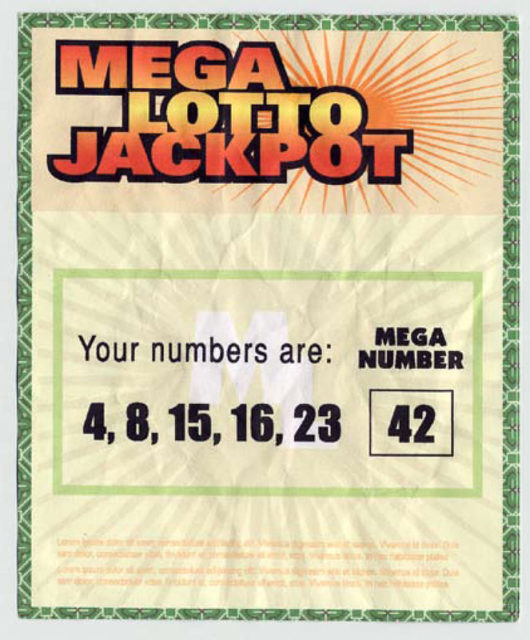

El número 42 era el último número de la conocida sucesión de números 4, 8, 15, 16, 23, 42 de la serie de televisión Lost. Aquí vemos el billete de lotería que, en la serie, tocó a uno de los personajes, Hurley

El número 42 era el último número de la conocida sucesión de números 4, 8, 15, 16, 23, 42 de la serie de televisión Lost. Aquí vemos el billete de lotería que, en la serie, tocó a uno de los personajes, Hurley

Algunos de los titulares de prensa que pudieron leerse hace unas semanas fueron

“Matemáticos resuelven el diabólico acertijo del número 42, sin solución durante 65 años” (ABC Ciencia)

“Un viejo problema sobre el 42, resuelto” (Investigación y Ciencia)

“Resuelven por fin un misterioso problema matemático que lo puede cambiar todo” (El Confidencial)

Dejando la ciencia ficción a un lado, expliquemos cuál es el problema matemático al que se estaban refiriendo los titulares de la prensa. El problema es el siguiente.

Problema: ¿cómo expresar los números naturales del 1 al 100 como suma de tres cubos de números enteros?

Si lo escribimos de forma algebraica sería lo siguiente. Dado un número natural k, entre 1 y 100, buscar los números enteros x, y, z tales que verifican la ecuación diofántica:

x3 + y3 + z3 = k.

Empecemos explicando qué es una ecuación diofántica. Estas son ecuaciones polinómicas de dos o más variables x, y, z, etc, para las que se estudian las soluciones con números enteros (los naturales, el cero y los negativos).

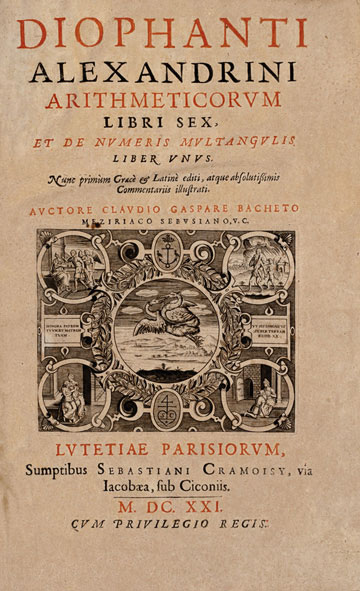

Por ejemplo, se puede considerar la ecuación, en las variables x, y, z, relacionada con el teorema de Pitágoras x2 + y2 = z2 y estudiar sus soluciones enteras. Una solución de esta ecuación es la clásica (3, 4, 5), ya que 32 + 42 = 52. Estas soluciones enteras se conocen con el nombre de ternas pitagóricas. Otras ternas pitagóricas son (5, 12, 13) o (8, 15, 17). Los griegos se dedicaron a investigar la existencia de diferentes ternas pitagóricas. El matemático griego Diofanto, que vivió en Alejandría en el siglo III, escribió un libro sobre ecuaciones algebraicas de título Arithmetica. En particular, Diofanto elaboró una regla general para encontrar todas las ternas pitagóricas, y se interesó por el estudio de lo que hoy llamamos ecuaciones diofánticas.

Portada de la edición de 1621 de la Arithmetica de Diofanto. Imagen de Wikimedia Commons

Portada de la edición de 1621 de la Arithmetica de Diofanto. Imagen de Wikimedia CommonsPero volviendo a nuestro problema, a la ecuación diofántica concreta x3 + y3 + z3 = k, o cómo expresar los números naturales del 1 al 100 como suma de tres cubos de números enteros, esta cuestión fue planteada de forma explícita y extensamente estudiada en un artículo publicado en 1955, en la revista Journal of the London Mathematical Society, por los matemáticos ingleses, J. C. P. Miller y M. F. C. Woollett, con el explícito título Solutions of the Diophantine Equation x3 + y3 + z3 = k.

Estos matemáticos se interesaron por este problema a raíz de un comentario del matemático inglés L. J. Mordell en otro artículo anterior, de 1953, en la misma revista:

“No sé absolutamente nada sobre las soluciones enteras de x3 + y3 + z3 = 3, más allá de la existencia de (1, 1, 1) y (4, 4, – 5); y tiene que ser realmente muy difícil descubrir algo sobre otras soluciones”.

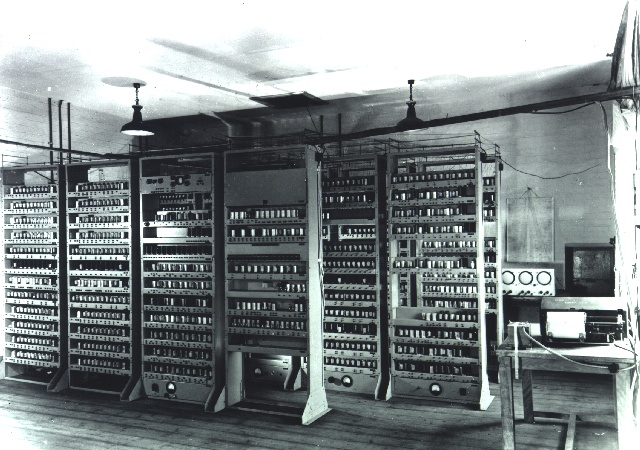

Además, Mordell sugirió a sus colegas Miller y Woollett que utilicen el ordenador ERSAC, de la Universidad de Cambridge, para obtener soluciones de la ecuación diofántica x3 + y3 + z3 = k, para valores de k menores, o iguales, a 100. Fruto de ese trabajo es el mencionado artículo.

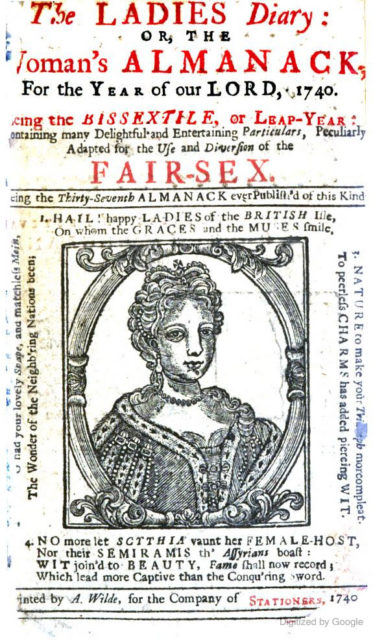

Aunque ya con anterioridad de había estudiado la ecuación x3 + y3 + z3 = k. En la revista inglesa de matemática recreativa The Ladies’ Diary se publicó en 1825, por S. Ryley, una familia de soluciones racionales, no enteras, de esa ecuación. Y las primeras soluciones enteras fueron obtenidas para las ecuaciones diofánticas x3 + y3 + z3 = 1 y x3 + y3 + z3 = 2 (k = 1, 2), en 1908 y 1936, respectivamente.

Portada de 1740 de la revista The Ladies’ Diary, en la que aparece un retrato de Carolina de Brandeburgo-Ansbach, reina consorte del rey Jorge II de Gran Bretaña [*]. Desde el inicio de la revista se incluían en la portada retratos de mujeres prominentes británicas, para atraer a las mujeres a leer la revista. Imagen de la Princeton University Library, a través de Google Books

Portada de 1740 de la revista The Ladies’ Diary, en la que aparece un retrato de Carolina de Brandeburgo-Ansbach, reina consorte del rey Jorge II de Gran Bretaña [*]. Desde el inicio de la revista se incluían en la portada retratos de mujeres prominentes británicas, para atraer a las mujeres a leer la revista. Imagen de la Princeton University Library, a través de Google Books

Pero volvamos a la ecuación diofántica x3 + y3 + z3 = k y al estudio de sus soluciones enteras.Veamos algunos ejemplos que nos permitan entender mejor la cuestión. Podríamos incluso plantearnos primero la ecuación x3 + y3 + z3 = 0, la cual por el último teorema de Fermat (véase la entrada Euler y el último teorema de Fermat) no tiene soluciones más allá de las triviales, del tipo (a)3 + (– a)3 + 03 = 0.

Para k = 1, además de la solución trivial 13 + 03 + 03 =1, se pueden encontrar otras soluciones, como 93 + (–8)3 + (–6)3 = 729 – 512 – 216 = 1 o (– 12)3 + 103 + 93 = –1728 + 1000 + 729 = 1. De hecho, en 1908 se demostró que existen infinitas formas de obtener 1 como suma de cubos, como aparece en el artículo de Miller y Woollett:

(9 t4)3 + (3 t – 9 t4)3 + (1 – 9 t3)3 = 1.

Este resultado se extiende, de forma natural, a los números que son cubos, a3. Luego, para números menores de 100 serían 8, 27 y 64.

También se probó, en 1936, que para k = 2, algunas de cuyas soluciones son 13 + 13 + 03 = 2 y 73 + (– 5)3 + (–6)3 = 2, existen, de nuevo, infinitas soluciones:

(6 t3 + 1)3 + (– 6 t3 + 1)3 + (– 6 t2)3 = 2,

que se extiende a los números que son el doble de un cubo, 2 a3. Para menores de 100 serían 16 y 54.

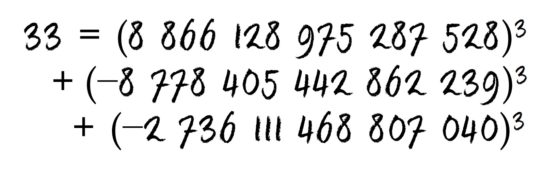

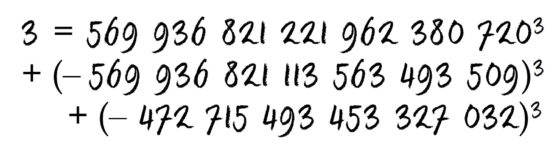

Para el 3, como menciona Mordell, se conocían solo las soluciones 13 + 13 + 13 = (– 5)3 + 43 + 43 = 3. A pesar de los intentos computacionales de encontrar más soluciones a esta ecuación diofántica x3 + y3 + z3 = 3, no se produjo ningún avance. Solo, en 1985, se demostró que una condición necesaria para que una terna de números enteros (x, y, z) fuese solución de esa ecuación debía de cumplir que x, y y z fuesen congruentes entre sí, módulo 9. Es decir, que el resto al dividirlos por 9 fuese el mismo. Pero ninguna solución particular fue encontrada.

Ahora tocaría el turno a los números 4 y 5. Aunque os recomiendo que no lo intentéis, puesto que no es posible. De hecho, el resultado es más general.

Proposición: No existen soluciones de la ecuación diofántica x3 + y3 + z3 = k, para valores de k “congruentes con 4 o 5, módulo 9”, es decir, que al dividirlos por 9 el resto de la división es 4 o 5, como los números 4, 5, 13, 14, 22, 23, 31, 32, 40, 41, 49, 50, 58, 59, 67, 68, 76, 77, 85, 86, 94 y 95.

Esto se debe a que cualquier número elevado al cubo a3 es congruente con 0, 1 u 8, módulo 9, es decir, el resto de dividir a3 entre 9 solo puede ser 0, 1 u 8. Por lo tanto, la suma de tres cubos no puede ser congruente con 4 o 5, módulo 9, puesto que no hay forma de sumar tres valores (pueden ser repetidos) de 0, 1 u 8 para que quede un resultado congruente con 4 o 5, módulo 9. Por ejemplo, los siguientes cubos 23 = 8, 33 = 27, 53 = 125, son congruentes con 8, 0 y 8, módulo 9, respectivamente, luego su suma es congruente con 8 + 0 + 8 = 16, es decir, congruente con 7, módulo 9. Efectivamente, 8 + 27 + 125 = 160 es congruente con 7, módulo 9, ya que al dividir 160 entre 9 nos queda 17 y de resto 7.

Ordenador británico Electronic delay storage automatic calculator (EDSAC), de la Universidad de Cambridge, fue utilizado por los matemáticos Miller y Woollett para encontrar soluciones a las ecuaciones diofánticas. Las primeras tareas de EDSAC, en 1947, fueron el cálculo de una tabla de cuadrados de números y un listado de números primos. Imagen de la Universidad de Cambridge

Ordenador británico Electronic delay storage automatic calculator (EDSAC), de la Universidad de Cambridge, fue utilizado por los matemáticos Miller y Woollett para encontrar soluciones a las ecuaciones diofánticas. Las primeras tareas de EDSAC, en 1947, fueron el cálculo de una tabla de cuadrados de números y un listado de números primos. Imagen de la Universidad de CambridgeLos matemáticos británicos Miller y Woollett, utilizando el ordenador EDSAC, encontraron soluciones particulares para 69 valores de k entre 1 y 100, buscando en un rango de valores de x, y, z comprendidos entre – 3.164 y 3.164. Si tenemos en cuenta que además había 22 valores, menores que 100, para los que no existen soluciones, quedaron sin resolver las ecuaciones diofánticas correspondientes a nueve valores, a saber, 30, 33, 39, 42, 52, 74, 75, 84 y 87.

Llegados a este punto de esta entrada del Cuaderno de Cultura Científica, os animo a que os enfrentéis vosotros mismos a la búsqueda de soluciones particulares al problema de expresar los números naturales del 1 al 100 (evitad los nueve valores que no consiguieron resolver Miller y Woollett, así como los 22 valores que no tienen solución) como suma de tres cubos de números enteros. Para algunos valores de k no es difícil encontrar soluciones, mientras que para otros no es tan sencillo, aunque para la mayoría existen soluciones con x, y, z menores, en valor absoluto, que 25 (esto es, entre – 25 y 25). En particular, para k = 16 la solución de Miller y Woollett es complicada,

16263 + (– 1609)3 + (– 511)3 = 16.

Bueno, pues si os animáis, disfrutad del problema/juego… divertíos… pero no os olvidéis de seguir leyendo esta entrada.

A partir del artículo Solutions of the Diophantine Equation x3 + y3 + z3 = k, de J. C. P. Miller y M. F. C. Woollett, se empezó a trabajar en la solución de estos nueve números menores que 100 que quedaban pendientes, pero también se estudió la ecuación diofántica x3 + y3 + z3 = k, para valores de k mayores que 100, en particular, se puso mucho énfasis en los menores que 1.000. Para resolver estas ecuaciones diofánticas se desarrollaron nuevos algoritmos computacionales y se amplió el rango de valores para x, y, z.

Hasta el año 2001 se había resuelto el problema para todos los números menores que 100, salvo 33, 42 y 74, para los cuales se sabía que no existían soluciones para x, y, z menores (en valor absoluto) que 1011. Así mismo, se habían encontrado soluciones para las ecuaciones diofánticas de todos los valores menores de 1000, salvo veinte, además de los tres anteriores.

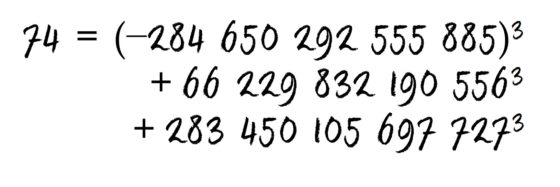

Hubo que esperar a 2016 para obtener una solución para el número 74 y al inicio de este año 2019, aún quedaban por resolver los números 33 y 42.

En abril de este año, 2019, el matemático británico Andrew Booker, de la Universidad de Bristol, empezó a trabajar en el problema de escribir el número 33 como suma de tres cubos a raíz del video The uncracked problem with 33 [https://www.youtube.com/watch?v=wymmCdLdPvM] del canal de Youtube Numberphile.

Booker desarrolló un nuevo algoritmo que le permitiera buscar soluciones enteras con números de 16 dígitos de la ecuación diofántica x3 + y3 + z3 = 33. Y, con ayuda de este algoritmo, encontró la buscada solución. Como cuenta el propio Andrew Booker en una entrevista para Numberphile, saltó de alegría en su despacho cuando encontró esa solución.

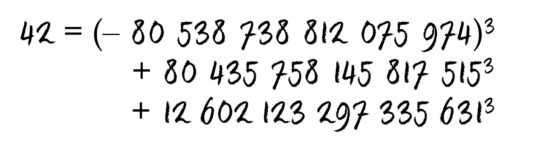

Y a principios del pasado mes de septiembre (de 2019) Andrew Brooker, junto con el matemático estadounidense Andrew Sutherland del MIT, han conseguido la solución del número que faltaba, el 42. Para ello han tenido que subir el rango de las posibles soluciones x, y, z a números de 17 dígitos. En concreto, el 42 se puede expresar como suma de tres cubos de la siguiente forma

Booker y Sutherland también encontraron algunas soluciones para números menores que 1000, como 165, 795 y 906. De esta forma ha quedado resuelto el problema, hasta los 100 primeros números, aunque hasta 1.000 aún quedan unos pocos… 114, 390, 579, 627, 633, 732, 921 y 975, sobre los que se seguirá trabajando en el diseño de algoritmos que los resuelvan.

Pero, ¡sorpresa! Solo diez días más tarde del anuncio de que habían conseguido resolver el problema de expresar el 42 como suma de tres cubos, Booker y Sutherland volvieron a hacer otro importante anuncio, relacionado con este problema. Por fin, habían encontrado una nueva solución de la ecuación diofántica citada por el matemático británico L. J. Mordell en 1953, x3 + y3 + z3 = 3, más allá de las ya conocidas (1, 1, 1) y (4, 4, – 5). Los números de esta solución no trivial tienen 21 dígitos.

Para resolver estos complicados problemas de computación, asociados a la solución de la ecuación diofántica, los matemáticos Andrew Booker y Andrew Sutherland utilizaron la aplicación Charity Engine, que conecta más de 500.000 ordenadores personales de todo el planeta, creando una red planetaria de ordenadores.

Existen muchos otros problemas que implican la suma de cubos de números, por ejemplo, el problema de ver qué números, en progresión aritmética, verifican que la suma de sus cubos es, de nuevo, un cubo. Por ejemplo, 33 + 43 + 53 = 63 (por cierto, que a este número, 63, se le conoce como el número de Platón) o 113 + 123 + 133 + 143 = 203, pero eso es otra historia que será contada en otra ocasión.

Floating cubes, an essay in superrealism (1962), del artista irlandés Harry Kernoff (1900 – 1974). Imagen de la galería WHYTE’S

Floating cubes, an essay in superrealism (1962), del artista irlandés Harry Kernoff (1900 – 1974). Imagen de la galería WHYTE’S

Bibliografía

1.- University of Bristol: Sum of three cubes for 42 finally solved

2.- Andrew R. Booker, Cracking the problem with 33, Res. Number Theory vol. 5, n. 29, 2019.

3.- John Pavlus, Sum-of-Three-Cubes Problem Solved for “Stubborn” number 33, Quanta Magazine, March, 2019.

4.- J. C. P. Miller y M. F. C. Woollett, Solutions of the Diophantine Equation x3 + y3 + z3 = k, Journal of the London Mathematical Society, vol. 30, pp. 101 – 110, 1955.

5.- L. J. Mordell, On the integer solutions of the equation x2+y2+z2+2xyz = n, Journal London Math. Soc, vol. 28, pp. 500-510, 1953.

6.- Armen Avagyan, Gurgen Dallakyan, A New Method in the Problem of Three Cubes, Universal Journal of Computational Mathematics vol. 5, n. 3, pp. 45-56, 2017.

7.- J. W. S. Cassels, A Note on the Diophantine Equation x3 + y3 + z3 = 3, Mathematics of Computation, vol. 44, n. 169, pp. 265-266, 1985.

8.- University of Bristol: Almost imposible 66-years-old maths puzzle solved

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

Nota del editor: Como es costumbre en España se traduce el nombre del rey o la reina y su correspondiente consorte. También es correcto su título como «rey de Gran Bretaña»; la denominación «Gran Bretaña» para el estado duró desde el 1 de mayo de 1707 al 1 de enero de 1801, momento en el que pasó a ser «Reino Unido de la Gran Bretaña e Irlanda» («…Irlanda del Norte» desde 1927).

El artículo 42, la respuesta definitiva a la vida, el universo y todo lo demás se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- 1 = 0, la prueba definitiva

- Cuando todo tu universo es un sólido

- El universo en un día: El origen de la vida, por Carlos Briones

Mundu mikroskopikoan ere ‘ikasten’ dela proposatu dute

Txakur bat trebatzea eta software bat programatzea, funtsean, oso antzeko jardunak dira. Programazio batzuk oso sinpleak dira; baina badira kode gehiago behar duten programak, eta baita pazientzia gehiagoren beharra duten txakurrak. Beagle bat duten edo izan duten guztiek ondo dakite zeinen burugogorrak diren. Zoragarriak, baina temati hutsak.

1. irudia: Estimuluen asoziazioan oinarrituta, baldintzatze klasikoa ikerketa prozesu askoren abiapuntua da. Arlo askotan gertatzen den arren, txakurren trebatzean oso ondo ikusten da horren eraginkortasuna. (Argazkia: Wyatt Ryan / Unsplash)

Txuska halakoa zen ere. Bereziki lehen urteetan, ondo funtzionatzeko programa bakarra behar zuen:

> IF gaileta dago, THEN kasu egin; ELSE jaramonik ez.Hau da, baldin eta gailetatxoa badago, orduan jarri arreta; bestela, ez du merezi.

Denborarekin, baina, eskua ixtea eta besoa altxatzea nahikoa zen Txuskaren arreta erakartzeko. “Tira, izan errealista eta utzi fantasiazko untxi hori bilatzeari: tipo horrek eskua altxatzen duen aldiro bertan gaileta bat dago!”. Txuskaren sistema eragilea mendean hartzeko programazio-estrategian, beraz, kodea zertxobait konplikatu zen.

> IF gaileta dago, OR besoa gora, THEN kasu egin; ELSE jaramonik ez.Hainbeste aldiz teorian eta praktikan ikusita ere, oraindik liluragarria da guztiz egiaztatzea baldintzapen klasikoan oinarritutako ikasketa prozesuren atzean dauden sinpletasuna eta eraginkortasuna. Ivan Pavlov zientzialari famatuak landutako proposamenari jarraiki, gaileta estimulu ez-baldintzatua izango litzateke, eta besoa altxatuta, berriz, estimulu baldintzatua.

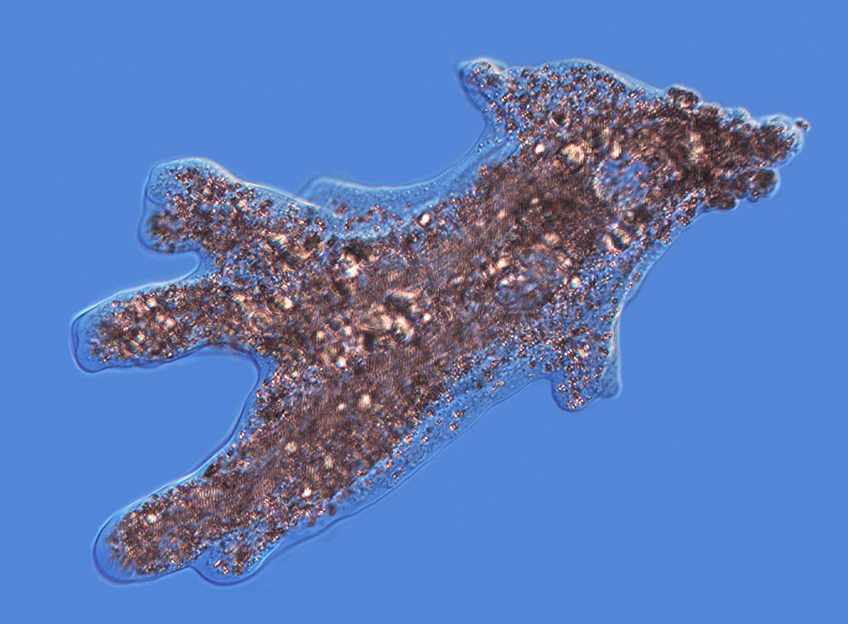

Asoziazioan oinarritzen den ikasketa hau nerbio sistema zentrala duten organismoetan gertatzen da; baina, egia esanda, norbaitek esango balizu hau ere organismo unizelularretan gertatzen dela, seguruenera zorotzat hartuko zenuke. Bada, aldatu txipa. Izan ere, eta hau benetan hala izan ala ez izan, modu oso serioan proposatu dute aukera hau Nature Communications aldizkarian argitaratutako artikulu batean. Ikerketa horretan, zientzialari talde batek proposatu du baldintzapen klasikoaren bidetik amebak portaera berriak ikasteko gai direla, estimuluen asoziazioan oinarrituta.

Jokabide hau zelula indibidualetan atzematen den lehen aldiz litzateke honakoa, ikerketa egin duten adituen arabera. Lehen aipatu bezala, orain arte soilik animalia konplexuetan ikusi izan den portaera da hau.

Kasu honetan, estimulu baldintzatu gisa eremu elektriko bat baliatu dute. Estimulu ez-baldintzatu gisa, berriz, konposatu kimiko espezifiko bat erabili dute (zehazki, peptido kimiotaktiko bat). Behin tresna hauek eskura izanda, 700 zelula baino gehiagoren ibilbideak aztertu dituzte. Bi espezie unizelular dira erabili dituztenak: Amoeba proteus eta Metamoeba leningradensis.

“Emaitzek erakusten dute zalantzarik gabe organismo unizelularrak gai izan zirela estimuluen asoziazioaren bitartez portaera berriak ikasteko”, azaldu du artikuluaren egile nagusi Idelfonso Martinez de la Fuentek.

2. irudia: Bi ameba espezie baliatu dituzte ikerketa egiteko. Horietako bat Amoeba proteus izan da –irudian–. (Argazkia: CBAS-CSIC)

Proposatu dutenaren arabera, zelulak gai dira migrazio zelularrari lotutako portaera hauek ikasteko eta denbora luzean gogoan mantentzeko: batez bestean, 45 minutuz mantendu da “oroimen” hau, 24 orduko ziklo batean. Ziklo horren ostean, oroimen hori galdu egiten dute.

Bai zelula libreen kasuan zein organismo plurizelularretako zeluletan ere, zelula-migrazioa funtsezko ezaugarria dela azaldu dute zientzialariek. Gizakien kasuan, migrazio horren adibide dira, esaterako, enbrioiaren garapenean zehar gertatzen den organoen eraketa, erantzun immunitarioa edota ehuntzen konponketa. Hain funtsezkoa izanik, prozesuan akatsak gertatuz gero ondorio larriak sor daitezke, besteak beste, adimen-atzeratasuna edota zenbait gaitz kardiobaskular. Minbiziaren garapenean ere garrantzitsua da zelulen mekanismo hau, funtsean, metastasia ere migrazio prozesu bat delako: tumore primario batetik beste tumore batera zelulek egiten duten bidea, hain justu.

Minbiziaren aurkako irakaspenakMartinez de la Fuentek babestu du migrazio hori baldintzatzen duten prozesuak ezagututa aukera gehiago egongo direla “gaixotasun horri lotutako hilkortasuna nabarmenki gutxitzeko”. Are gehiago, eta mundu mikroskopikoan gertatzen den fenomeno hau ikertzen jarraituko duten arren, Martinez de la Fuentek aurreratu du haren ikerketa taldeak minbiziaren aurkako borrokan irekitzen den bidezidor hau urratzeari ere ekingo diola.

Zientzia artikuluan onartu dute momentuz fenomenoaren atzean dagoen prozesu molekularra ez dagoela azaltzerik, baina azalpenean epigenetikak pisu bat izan zezakeela proposatu dute: “Oraindik goizegi da zelulen baldintzapen asoziatibo hau azalduko duten prozesu molekularrak azaltzeko. Dena dela, memoria funtzional baten ebidentziak badira, eta prozesu epigenetikoetan gertatzen diren marka molekular egonkor askoren barruan kokatu daiteke memoria funtzional hori”, idatzi dute.

CSIC erakundeko hiru institutuko eta Ben-Gurion Unibertsitateko (Israel) ikertzaileekin batera, Gurutzetako Unibertsitate Ospitaleko eta EHUko zientzialariek ere parte hartu dute ikerketan.

Ikerketa berari dagokionez, sare metaboliko konplexuen ikerketan abiatu ziren, ordenagailu bidezko azterketak eginda. Zehazki, ikusi zuten sare horien atzean Hopfield motako dinamikak egon zitezkeela. Konputazio neuronalean erabiltzen den Hopfield eredua sare konplexuetan gertatzen diren harremanak sinplifikatzeko modu bat da, bide horretatik sistema hori analizatu eta ondorioak atera ahal izateko.

Erreferentzia bibliografikoa:

De la Fuente, Ildefonso M. et al. (2019). Evidence of conditioned behavior in amoebae. Nature Communications, 10, 1; 3690. DOI: 10.1038/s41467-019-11677-w.

———————————————————————————-

Egileaz: Juanma Gallego (@juanmagallego) zientzia kazetaria da.

———————————————————————————-

The post Mundu mikroskopikoan ere ‘ikasten’ dela proposatu dute appeared first on Zientzia Kaiera.

El tamaño del átomo de hidrógeno

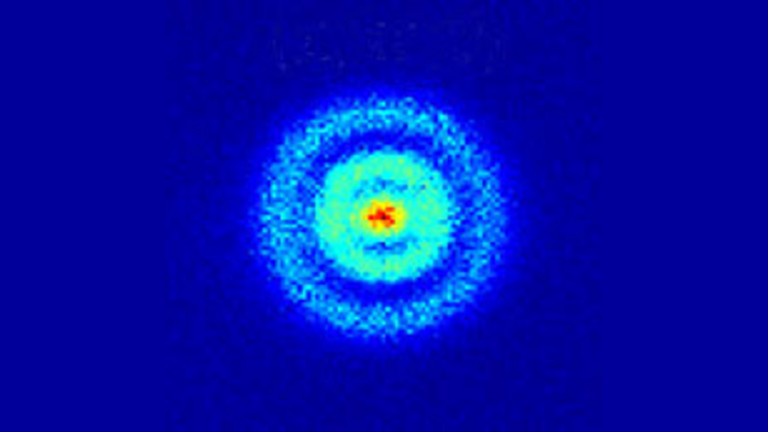

Visualización real de los estados de Stark de un átomo de hidrógeno. Fuente: A. S. Stodolna et al (2013) Hydrogen Atoms under Magnification: Direct Observation of the Nodal Structure of Stark States Phys. Rev. Lett. 110, 213001

Visualización real de los estados de Stark de un átomo de hidrógeno. Fuente: A. S. Stodolna et al (2013) Hydrogen Atoms under Magnification: Direct Observation of the Nodal Structure of Stark States Phys. Rev. Lett. 110, 213001Sin duda, una prueba de fuego para el modelo de Bohr tendría que ser explicar los espectros de los elementos, empezando por el del hidrógeno. Pero antes tenía que pasar una prueba cuantitativa básica: el tamaño del átomo derivado del modelo tenía que ser compatible con los datos ya conocidos.

De entrada estaban los órdenes de magnitud impuestos por los resultados de dispersión obtenidos por el laboratorio de Rutherford. De ellos se podían deducir algunas cosas interesantes. Para empezar, el tamaño aproximado del núcleo atómico. Supongamos que una partícula α se mueve directamente hacia un núcleo. Su energía cinética se transforma en energía eléctrica potencial: se ralentiza y finalmente se detiene, como una pelota rodando cuesta arriba. Lo más cerca que la partícula estará del núcleo puede calcularse a partir de la energía cinética original de la partícula y las cargas de la partícula y el núcleo. El valor calculado resulta ser de unos 3·10-14 m.

Si la partícula no penetra en el núcleo, esta distancia debe ser, al menos, la suma de los radios de las partículas y el núcleo; de aquí, el radio del núcleo no podría ser mayor que aproximadamente 10-14 m. Pero 10-14 m es solo aproximadamente 1/1000 del radio que establece la teoría cinética para un átomo. Como el volumen total del átomo es proporcional al cubo de su radio, eso quiere decir que el átomo está mayormente vacío, con el núcleo ocupando solo una milmillonésima parte del espacio. Esto explica cómo las partículas o los electrones pueden penetrar miles de capas de átomos en láminas de metal o en gases, con solo una desviación grande ocasional de la trayectoria y muy pocos rebotes.

Con estas condiciones de contorno veamos la aplicación del modelo de Bohr al átomo más sencillo, el hidrógeno que, recordemos, tiene un solo electrón alrededor del núcleo. Bohr supuso que las posibles órbitas de los electrones son circulares por simplicidad. El resultado de Bohr para los radios de las posibles órbitas estables rn fue rn = a·n2, donde a es una constante (a = h2 / 4π2mkqe2) [1] que se puede calcular a partir de valores físicos conocidos, y n representa cualquier número entero, n = 1, 2, 3… .

El resultado de Bohr es muy llamativo. En los átomos de hidrógeno los posibles radios orbitales de los electrones son múltiplos enteros de una constante que se puede calcular fácilmente; es decir, n2 adquiere valores de 12, 22, 32,. . . , y todos los factores a la izquierda de n2 en rn = a·n2 son cantidades conocidas previa e independientemente.

El valor de a es aproximadamente de 5,3·10-11 m. Por lo tanto, según el modelo de Bohr, los radios de las órbitas estables tenía que se n2 veces 5,3·10-11 m. Es decir, para n = 1, la primera órbita permitida el radio era, precisamente, 5,3·10-11 m, 4 veces esta cantidad la segunda y 9 veces la tercera. Entre ellas, simple y llanamente, no podía estar el electrón.

En resumen, las distintas órbitas electrónicas están espaciadas alrededor del núcleo de manera regular, con los radios permitidos cuantificados de manera regular. Por lo tanto, la emisión y absorción de luz debe corresponder a la transición del electrón de una órbita permitida a otra. La emisión de luz ocurre cuando el electrón «cae» de un estado de energía más alto a un estado más bajo; la absorción de luz ocurre cuando el electrón «salta» desde un estado de baja energía hasta un estado de mayor energía. Un resultado muy bonito que indica qué radios son posibles y dónde se encuentran. Pero hasta ahora, todo esto es la construcción de un modelo. ¿Soporta la comparación con los datos conocidos?

En su primer artículo de 1913, Bohr pudo dar al menos un «sí» parcial como respuesta. Hacía tiempo que se sabía que el átomo de hidrógeno normal «no excitado» tenía un radio de aproximadamente 5·10-11 m (es decir, el tamaño del átomo obtenido, por ejemplo, al interpretar las características medidas de los gases en términos de la teoría cinética) [2]. Este valor conocido de aproximadamente 5·10-11 m se corresponde mejor que bien con la predicción de la ecuación para el radio orbital r si n tiene el valor más bajo, es decir 1. El modelo proporcionaba un mecanismo para entender el tamaño del átomo de hidrógeno neutro y no excitado. Para cada átomo, el tamaño corresponde al tamaño de la órbita electrónica más interna permitida.

Nota:

[1] Esta constante, llamada radio de Bohr, comparte el honor con la constante de Boltzman o la constante de Avogadro, de haber sido descritas en realidad por otras personas (respectivamente, Haas, Planck y Cannizaro). Pero esto es otra historia…

[2] Este valor de 5·10-11 m para un átomo de hidrógeno no es más que la mitad del 10-10 m que proporcionaba la teoría cinética para la molécula de hidrógeno.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo El tamaño del átomo de hidrógeno se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Las regularidades en el espectro del hidrógeno

- La carga del núcleo y el sistema de periodos

- Un átomo con un centro masivo diminuto

Nola lehortu behar dira eskuak?

1. irudia: Eskuak lehortzeko gailuak ikertu dira eskuak lehortzeko tekniken artean. (Argazkia: Hans Braxmeier – domeinu publikoko irudia. Iturria: pixabay.com)

Suen eta bere lankideek Hong Kongen egindako lan esperimentalean, esan bezala, eskuak garbitu ondoren lehortzeko sei metodo deskribatu dituzte: norberaren arroparekin lehortzea, paperezko toalla bat erabiliz lehortzea, bi toalla erabiliz lehortzea, eskuak mugitu gabe aire epelezko lehorgailua erabiltzea, eskuak igurtziz aire epelezko lehorgailua erabiltzea eta jet edo txorro motako esku-lehorgailua erabiltzea -eskuak barrurantz sartzen diren potentzia handiko lehorgailu horietakoa, alegia-.

Ikerketaren muina honakoa da: ondo lehortzen ez diren eskuekin probableagoa da mikroorganismoak transmititzea guztiz lehorrak dauden eskuekin baino. Hortik abiatuta, eskuak modu eraginkorrean lehortzeko metodoak bilatzea ezinbestekoa da -ospitaletan segurtasun neurriak hartzeko, adibidez-. Oro har, Suen eta bere lankideek aurkezten duten berrikuspen bibliografikoan ez dira desberdintasun nabarmenak aipatzen eskuak lehortzeko metodo desberdinen artean. Alabaina, eskuak lehortzeko teknika bakoitzak eraginkortasun aldakorra du bere helburua betetzerakoan. Esaterako, aire beroko lehorgailuek 45 segundo behar izaten dituzte eskuetako hezetasuna %3ra murrizteko -hain zuzen, eskuak ondo lehortzeko metodorik motelenak dira–.

Zalantzak argitzeko, ikertzaileek Serratia marcescens erabili zuten markatzaile moduan, alegia, mikroorganismo patogenoek izan ditzaketen joerak aztertzeko aipatutako bakterio ez-patogenoak erabili zituzten. Bakterio horiek hazi ostean, 30 boluntarioz baliatu ziren lehortze metodo desberdinak probatzeko. Jakina, sei metodoak estandarizatu egin zituzten, hots, zehatz-mehatz deskribatu zuten eskuak nola eta zenbat denboraz garbitu behar ziren, gero konparaketa egokiak egin ahal izateko.

Ikerketaren ostean ikusi zenez, jet edo txorro motako esku-lehorgailuak eskuetako bakterioak kentzeko metodorik eraginkorrena zen eta okerrena, aldiz, eskuak arroparekin lehortzea. Hain zuzen ere, bakterioek erraz biziraun dezakete arropan lau orduz -baina, baita 24 ordu ere zenbait kasutan-. Oro har, aipatutako esku-lehorgailuekin 27,4 segundo behar dira eskuak guztiz lehortzeko eta aire-lehorgailu arruntekin boluntarioek 20 segundo inguru egoten ziren eskuak lehortzen. Azken horien kasuan, 20 segundo ez dira nahikoak hezetasuna ondo kentzeko -45 bat segundo behar direla jotzen da- eta, hortaz, eskuen lehortzea ez da egokia. Ondorioz, mikroorganismoak kutsatzeko aukerak handitu egiten dira.

Suen eta bere lankideen hitzetan, egindako ikerketak frogatzen du aire epeleko lehorgailuen kasuan beharrezkoa da eskuak guztiz lehortu direla ziurtatzea. Alabaina -eta azken puntu hau garrantzitsua da-, txorro motako lehorgailuak norberaren mikroorganismoak kentzeko oso eraginkorrak badira ere, duela bost urte egindako ikerketa batek lehorgailu horien eraginkortasuna zalantzan jar dezake. Hain zuzen ere, lehorgailu bortitz horiek ur tantak oso urrutira –metro batera iritsi daitezke– zabaltzen dituzte eta kutsadura gurutzatua gertatzeko aukerak handitzen dituzte.

Horrekin lotuta, Best eta bere lankideek 2014an ikerketa bat argitaratu zuten eskuak lehortzeko metodo desberdinek ingurunean zuten eragina aztertzeko -eta ez norberaren eskuaren mikroorganismo murrizketa-. Kasu horretan, emaitzak aurrez pentsa zitekeena baieztatu zuten: txorro motako lehorgailuek tantak asko sakabanatzen dituzte, aire epel edo beroko lehorgailuek gutxiago eta paperezko toallek oso gutxi -hain justu, norberarentzat eraginkorrena dena ingurukoentzat okerrena da-. Ikertzaileen kalkuluen arabera, txorro motako lehorgailuak hogeita sei aldiz bakterio gehiago zabaltzen ditu aerosolizazio bidez airezko lehorgailu arrunt batek baino.

Horrexegatik, airea erabiltzen duten lehorgailuak ez dira gomendatzen osasunarekin lotutako eraikinetan; izan ere, mikroorganismo gehiago zabal daitezke airearen bidez. Edozein kasutan, oso zaila den oreka bilatzea da gakoa: norbera garbitu, ingurua kutsatu gabe. Momentuz ez dago erantzun magikorik, baina, lasai, zientziak aurrera jarraitzen du eta.

Erreferentzia bibliografikoa:

Suen, L. K. P., Lung, V. Y. T., Boost, M. V., Au-Yeung, C. H. eta Siu, G. K. H. (2019). Microbiological evaluation of different hand drying methods for removing bacteria from washed hands. Scientific Reports, 9. DOI: 10.1038/s41598-019-50239-4

—————————————————–

Egileaz: Josu Lopez-Gazpio (@Josu_lg) Kimikan doktorea, irakaslea eta zientzia dibulgatzailea da. Tolosaldeko Atarian Zientziaren Talaia atalean idazten du eta UEUko Kimika sailburua da.

—————————————————–

The post Nola lehortu behar dira eskuak? appeared first on Zientzia Kaiera.

¿Es contagiosa la enfermedad de Alzheimer?

![]()

Foto: Simon Wijers / Unsplash

Foto: Simon Wijers / UnsplashEn la actualidad se conocen más de cincuenta demencias resultantes de enfermedades neurodegenerativas, y la enfermedad de Alzheimer es la más extendida. Se estima que cerca de 35 millones de personas la sufren en el mundo, y que el número de enfermos podría alcanzar los 115 millones de personas en los próximos 30 años.

Aunque en algunos casos —pocos— el alzhéimer puede deberse a un problema genético, el factor de riesgo principal es el envejecimiento. Así pues, es lógico que la prevalencia de estas enfermedades guarde relación con el aumento de la esperanza de vida.

No obstante, recientemente se han llevado a cabo trabajos que también apuntan a que, en determinadas condiciones, la enfermedad de Alzheimer podría transmitirse entre personas. Es cierto que su mecanismo recuerda el de las enfermedades producidas por priones, como la enfermedad de Creutzfeldt-Jakob, de la que se produjeron decenas de casos como consecuencia de la crisis de las vacas locas. A continuación ofrecemos algunas explicaciones.

La enfermedad de Alzheimer, un problema de proteínas

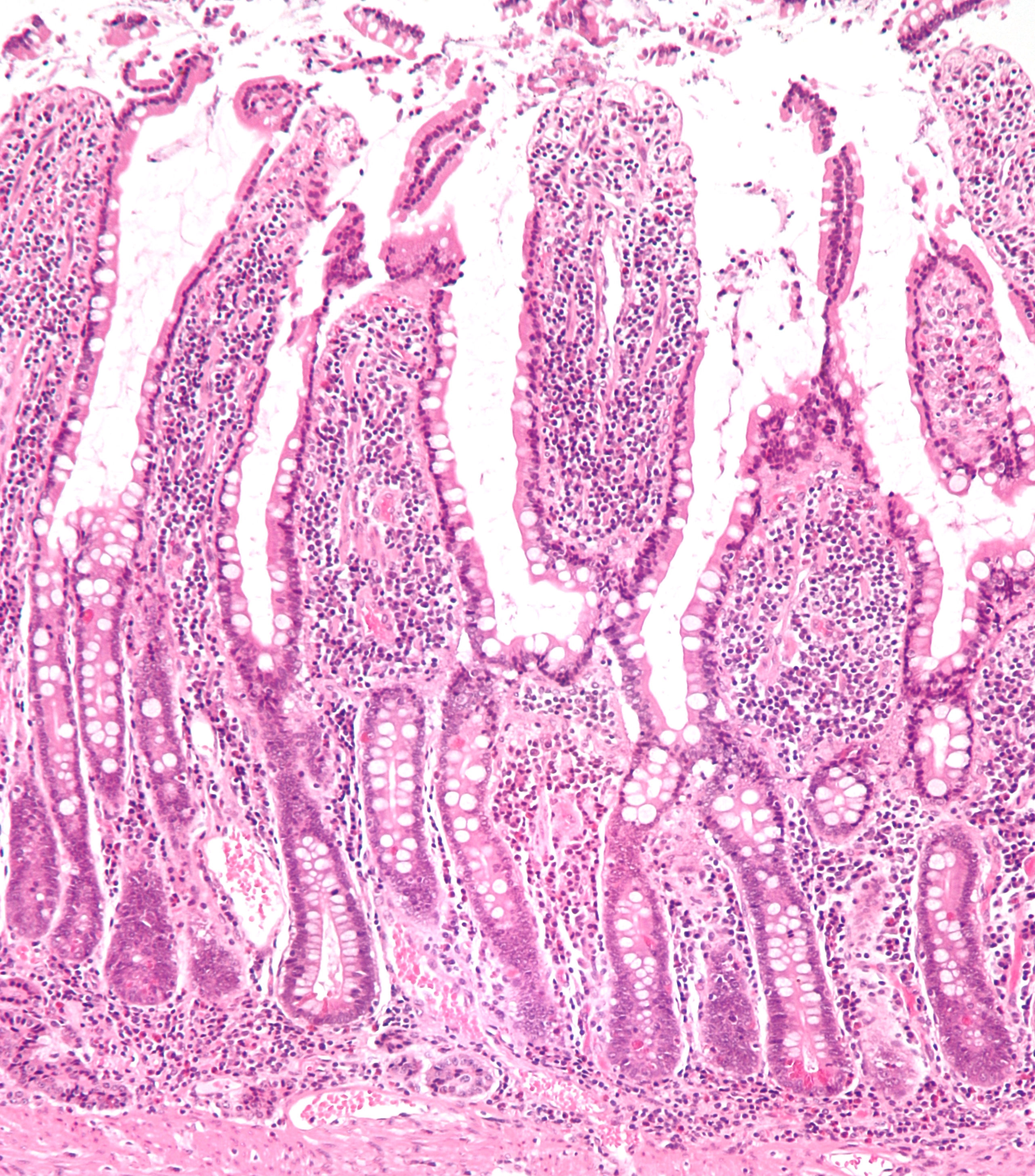

Desde un punto de vista sintomático, el alzhéimer se caracteriza por un deterioro drástico de las facultades psíquicas y físicas debido a la muerte de las neuronas cerebrales. Cuando se analizan los cerebros de los pacientes fallecidos, se observa la presencia de dos tipos de depósitos de proteínas.

Las proteínas son moléculas de gran tamaño constituidas por una secuencia de moléculas más pequeñas denominadas aminoácidos. Se trata de componentes esenciales de la vida: las células y los tejidos de los seres vivos contienen miles de proteínas, que cumplen funciones variadas y específicas (hormonas, enzimas, proteínas de estructura como el colágeno, la tubulina, que constituye el “esqueleto” de las células y les da su forma, etc.). En la enfermedad de Alzheimer, algunas de estas proteínas se vuelven anormales y se acumulan.

El primer tipo de depósitos proteicos encontrados en el cerebro de pacientes con esta demencia contiene una proteína denominada “Tau” (del inglés Tubulin-associated unit). En condiciones normales, una de sus funciones es estabilizar la estructura de las neuronas. En la enfermedad de Alzheimer, Tau se modifica y deja de cumplir su función. Las neuronas se degeneran, mientras que las proteínas anormales se agregan unas a otras y se acumulan en las células nerviosas.

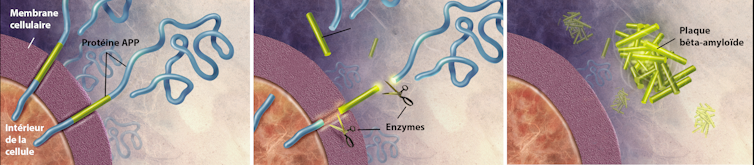

El péptido Aβ se produce a partir de un corte en la secuencia de aminoácidos de una gran proteína denominada APP o precursor proteico amiloide. Esta proteína se sitúa en la superficie de las neuronas e interviene sobre todo en su crecimiento, su supervivencia y su reparación.

En condiciones normales, los péptidos Aβ se eliminan, pero en la enfermedad de Alzheimer se acumulan en el exterior de las células nerviosas, en forma de placas amiloides, también denominadas placas seniles. Estos depósitos se encuentran, asimismo, alrededor de los capilares sanguíneos del cerebro y pueden ser causa de microhemorragias cerebrales denominadas angiopatías amiloides cerebrales.

Formación de las placas amiloides.

Formación de las placas amiloides.Wikimedia, CC BY

Proteínas capaces de contaminar otras

El aspecto más destacable de los mecanismos que dan lugar al alzhéimer es que la neurodegenerescencia no se deriva de una simple acumulación pasiva de proteínas.

En realidad, las proteínas implicadas cambian de forma, lo que modifica su acción a escala celular. Cabe señalar que la función de una proteína depende generalmente de su forma (que, a su vez, depende en gran medida de la secuencia de los aminoácidos que la compone). Este cambio de morfología es lo que confiere al péptido Aβ propiedades totalmente diferentes de las de su forma normal. Al ser capaz de autoagregarse, puede formar los depósitos de fibras amiloides que, probablemente, causan la muerte de las neuronas.

Pero aún hay más: los investigadores han demostrado que las formas tóxicas son capaces de obligar a sus álter ego normales a imitarlas y a adoptar a su vez una forma patógena. Este fenómeno, denominado “autorreplicativo”, explica cómo una célula enferma que produce la forma tóxica del péptido puede “contaminar” la célula vecina.

Este contagio de una célula a otra también explica por qué, durante la evolución de la enfermedad de Alzheimer, la propagación de las lesiones cerebrales se extiende de forma progresiva a todo el cerebro siguiendo un esquema bien determinado que se observa en todos los pacientes.

¿Qué es la enfermedad de Alzheimer?Mecanismos similares a los de los priones

Este proceso autorreplicativo es similar al que se observa en el caso de otra enfermedad neurodegenerativa, la enfermedad de Creutzfeldt-Jakob. Esta se debe a la propagación en el seno del cerebro de un agente patógeno muy particular: el prion.

Aunque no es una bacteria, ni un parásito, ni un virus, ni un hongo, el prion es, sin embargo, transmisible. El descubrimiento de estas “partículas proteicas infecciosas” (el acrónimo prion procede del inglés proteinacious infectious particule) ha sido objeto de un amplio debate y ha obligado a los investigadores a crear un nuevo concepto, el de “agentes transmisibles no convencionales”. Al contrario de lo que ocurre con los otros agentes patógenos, los priones están desprovistos de genoma (no tienen ADN ni ARN) y se componen exclusivamente de una única proteína.

Como sucede con las proteínas implicadas en la enfermedad de Alzheimer, las células producen de forma natural una versión “normal” del prion. Esta versión cumpliría numerosas funciones biológicas, pero todavía no se conocen bien sus diversas utilidades. También posee la propiedad de replegarse y agregarse para formar partículas infecciosas. En su forma infecciosa, los priones son capaces de infectar a un nuevo individuo tras la ingesta de determinados tejidos contaminados, o a través de la sangre, por ejemplo.

La gran resistencia de los priones a los procesos de destrucción clásicos ha dado lugar a varias crisis económico-sanitarias de gran alcance, como la crisis de las vacas locas en los años ochenta y noventa o el escándalo de la hormona del crecimiento contaminada.

¿Es contagiosa?

Los procesos de agregación del péptido Aβ y de la proteína Tau presentan semejanzas con el proceso observado en los priones. Así pues, ¿es posible que la enfermedad pueda transmitirse entre personas, según un mecanismo idéntico al del prion? Diversos grupos de científicos han intentado responder a esta pregunta.

De forma experimental, varios equipos de investigadores han podido inducir la proliferación de agregados de péptidos Aβ en animales de laboratorio. Por otra parte, más recientemente, se han llevado a cabo diferentes trabajos que apuntan a la existencia de casos de transmisión iatrogénica del péptido Aβ patógeno, lo que ha dado lugar a angiopatías amiloides cerebrales. Las hormonas de crecimiento producidas, en particular, antes de 1977 no solo habrían estado contaminadas por el prion, sino también por el péptido Aβ, y habrían podido intervenir en el desarrollo de la enfermedad de Alzheimer.

Paralelamente a la publicación de estos trabajos, se ha detallado de manera especial otra población llamada “de riesgo”, la de los pacientes que han recibido un trasplante de duramadre. Esta fina membrana fibrosa que protege el cerebro podía extraerse de cadáveres y utilizarse como “gasa” tras la realización de operaciones neuroquirúrgicas invasivas. Esta práctica se prohibió en Francia en 1994, pues los trasplantes de duramadre dieron lugar a casos de transmisión iatrogénica del prion humano.

Se llevaron a cabo tres estudios (suizo, japonés e internacional) que mostraron respectivamente que el 71,4%, el 81% y el 61,5% de los pacientes que recibieron este tipo de trasplante desarrollaron posteriormente angiopatías amiloides cerebrales. Aunque no es posible aportar la prueba formal de la contaminación por causa de los trasplantes, la localización de las lesiones y de los depósitos proteicos indica con claridad que el trasplante es la causa del cambio de forma y de la agregación de los péptidos Aβ del receptor.

Un estudio también ha señalado que los instrumentos quirúrgicos utilizados en neurocirugía tal vez podrían constituir a veces una fuente de contaminación, aunque el riesgo es probablemente muy bajo. No obstante, los autores de estos trabajos proponen que se mejoren los procedimientos de esterilización.

¿Es una enfermedad producida por priones?

Desde un punto de vista mecanístico, queda claro que la enfermedad de Alzheimer se parece a las enfermedades producidas por priones. Si nos atenemos a la definición estricta de la palabra prion —partícula proteica infecciosa—, la enfermedad de Alzheimer debería estar incluida, puesto que ha quedado demostrado el carácter transmisible de los ensamblajes proteicos tóxicos que la causan, al menos de forma experimental.

No obstante, de acuerdo con los resultados de investigación, el concepto de prion se ha ampliado: se ha revelado la existencia de diferentes cepas de priones así como su capacidad para “mutar” y adaptarse a su nuevo huésped. En este aspecto, las enfermedades producidas por priones se diferencian de la enfermedad de Alzheimer. Así pues, de acuerdo con el nivel de conocimientos actual, parece más justo calificar esta última como “enfermedad de tipo prion” o “de amiloides infecciosos”. O ampliar el término de agente transmisible no convencional a los ensamblajes proteicos causantes de la enfermedad de Alzheimer.![]()

Sobre la autora: Angélique Igel-Egalon es ingeniera de investigación del grupo de macroagregados proteicos y enfermedades priónicas del Inra

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo ¿Es contagiosa la enfermedad de Alzheimer? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Prevenir y tratar la enfermedad de Alzheimer: Una visión moderna

- El papel de la insulina en la enfermedad de Alzheimer

- El citoesqueleto de las neuronas y el alzhéimer

Eltxoen, eskoziarren, esklaboen eta nazien inguruko historia bat

1. irudia: Anopheles gambiae familia osatzen duen sei espezietako eltxo bat. Eltxo hauek ziztada baten bitartez odola xurgatzeaz gain, listua sartzen dio gizakiari. Horrela, malaria sortzen duten protozooak gorputzean sartzen dira. Eltxo hauek malariaren bektore biologikok dira. (Argazkia: Domeinu publikoko argazkia – Wikipedia)

Beraz, horrek esan nahi du udako izerdi edo txosnako musika nekagarriak baino inpaktu handiagoa dutela. Izan ere, eltxoek, mendez mende, eragin handia izan dute biztanleriaren mugimenduetan eta gerrako emaitzetan. Horixe bera azaltzen du Timothy Winegard historialariaren The Mosquito: A Human History of Our Deadliest Predator liburuak. Hain zuzen, giza historia moldatu duen naturaren indar gisa deskribatzen ditu intsektu horiek.

Panamako eltxoak eta Eskoziaren independentziaWinegardek, adibidez, The New Yorker aldizkariko artikulu honetan, historiako gertaera bat kontatzen du. 1698an, bost itsasontzi abiatu ziren Eskoziatik Mundu Berrira, kargamentu komertzial oso mamitsuarekin: ileordeak, artilezko galtzerdiak eta tapakiak, nakarrez egindako orraziak, bibliak eta larruzko zapatak. Horrez gain, inprimatzeko makina bat zeramaten itsasontzian, kolonoek, helmugara iristean, kontratuak, itunak eta hitzarmenak inprimatzeko asmoa baitzuten. Kargamentua sartu ahal izateko, janari errazioen erdia bakarrik eraman zuten.

Helmuga Panamako Darién eskualdea zen. Eskoziako Konpainiak merkataritza gune bat sortu nahi zuen, istmoaren bitartez harremanetarako bide bat egiteko eta, hala, Ozeano Pazifikoa eta Atlantikoa lotzeko. Horren bidez, beren herrialdeko ekonomia bultzatu nahi zuten; izan ere, hainbat urte zeramatzaten gerran Ingalaterraren aurka, eta defendatzen zuten independentzia arriskuan zegoen, gosete luze baten ondorioz. Ekimen hori ez zen bakarra izan: uste da garai hartan Eskozian mugitzen zen diruaren laurdena edo ia erdia Panamako merkataritzarekin lotuta zegoela.

Espedizioa erabateko porrota izan zen. Kolonoak gaixotu egin ziren, sukar horiak eta malariak jota, eta ez zutenez gaixotasun horien aurkako defentsarik, egun bakar batean hamar lagun hiltzera ere iritsi ziren. Kolonoen egunerokoetan askotan aipatzen dira eltxoak. Sei hilabete igaro ondoren, bizirik atera zirenak iparralderantz abiatu ziren, baina bidean ere hil egiten ziren, eta itsasora botatzen zituzten gorpuak.

2. irudia: 1690. urtearen bueltan Afrika eta Indiekin komertzioa gauzatzen zuen Eskoziako Merkataritza-etxearen banderaren erreprodukzioa. (Argazkia: Domeinu publikoko argazkia – Shadowxfox / Wikipedia)

Egin zuten ahalegin handi horren emaitza komertzialak benetan etsigarriak izan ziren. Eraman zituzten gauza guztietatik (orraziak, zapatak, etab.), inprimatzeko makina bakarrik iritsi zen helmugara. Baina, Winegardek bere liburuan kontatzen duen bezala, misioaren porrotak ezusteko emaitza izan zuen: bidaiak sortu zuen zorraren ondorioz –beste arrazoi batzuen artean–, eskoziarrek Ingalaterrarekin bateratzeko eskaintza onartu behar izan zuten. Eta horrela lagundu zuten Panamako eltxoek Britainia Handia sortzen.

Jakina, eltxoek (haien infekzioekin) eta gizakiek denbora luzez izan dute harreman estua, eta batzuentzat tamalgarria izan zen arren, beste batzuentzat, askoz lehenago, lagungarria izan zen. Eskoziarrak Panama konkistatzen saiatu baino hamabost mende lehenago, Erromako armadak Eskozia bereganatzeko egin zuen saiakera. Uste da, garai hartan, herrialde hori konkistatzeko helburuarekin joan ziren zortzi mila soldadu erromatarren erdiak hil zituela malariaren andui endemiko batek. Tokiko beste andui batzuek hildako asko eragin zituzten Hanibalen armada Italiatik igaro zenean; Gengis Khanen gudu taldeak Europako hegoaldera iritsi baino lehen geldiarazi zituzten, eta Europako gurutzatuei Lur Santua konkistatzea eragotzi zieten historiako beste une garrantzitsu batzuetan.

Gaixotasun zaharrak eta kontinente berriakEltxoek egiteko garrantzitsua izan zuten historiako gertakari horietan; bereziki, gaixotasun zaharrak kontinente berrietara iristen zirenetan. Kolon Amerikan lehorreratu zenean, kolonoek berekin eraman zituzten eltxoek ere gaixotasun berriak eraman zituzten. Baztangaz eta gripeaz gain, intsektu horrek eragindako gaixotasunen ondorioz, 95 milioi indigena hil ziren; hau da, europarrak bertara iritsi baino lehen zeuden biztanleen % 90 baino gehiago. Hortaz, inpaktu zuzena izan zuen bai lurraldearen konkistan bai biztanle taldeek orduan hasi eta mendeetan eta mendeetan izan zituzten harremanetan. Gehienbat balio izan zuen ia biztanlerik ez zuen lurralde zabal eta emankor baten ideiari forma emateko; lurraldea kolonoen zain zegoen, hari probetxu ateratzeko, jainkoaren deiera izango balitz bezala.

Dirudienez, gizakiek aitzakiak sobera dituzte haien kidekoekin krudel jokatzeko, eta, gainera, eltxoek, euren ziztadek eta euren gaixotasunek eragina izan zuten Atlantikoan zeharreko esklaboen merkatuaren garapenean eta bilakaeran. Afrikar jatorriko lehen esklaboak Amerikara iritsi zirenean, malariaren bertsio oso gogor bat iritsi zen, Plasmodium falciparum parasitoak eragindakoa eta eltxoek transmititutakoa.

Orduan, XVII. eta XVIII. mendeetan, esklaboek inportatutako gaixotasunekiko zuten kaltegarritasunak eragina zuen euren prezioetan: indigena batek gaixotasun horien ondorioz hiltzeko arrisku handia bazuen, ez zuen balio gaixotasunak jasan zitzakeela erakutsi zuen europar batek bezain beste, eta hark ere Afrikatik zuzenean eramandako pertsona batek baino gutxiago balio zuen. Garestienak afrikarrak ziren, Mundu Berrian denbora nahikoa eman baitzuten frogatzeko gai zirela lurralde bateko eta besteko gaixotasunak jasateko.

Eltxoak, nazien arma biologikoakBeste garai batzuetan, intsektu hilgarri hori beren alde menderatzen eta baliatzen saiatu izan dira. Adibidez, Hitlerren Alemania nazian. 1942. urtean, SSetako komandante Heinrich Himmlerrek Entomologia Institutua sortu zuen Dachauko kontzentrazio esparruan. Institutuaren helburua eltxoen erabilera belikoa ikertzea zen, Hirugarren Reicheko etsaien aurka gerra kimiko eta bakteriologiko baten elementu gisa. Ideia hori ez zen ezerezetik sortu: hilabete batzuk lehenago, 1941. urteko Eguberrietan, Himmlerrek Ekialdeko Fronteko tropak bisitatu zituen, eta ikusi zuen soldaduak zorriek janda zeudela. Ongi zekien Lehen Mundu Gerran zorriek transmititutako tifusak hildako asko eragin zituela alemaniar tropetan, eta hierarka naziak berak ere fobia zien eltxoei. Horrela piztu zen intsektuak bere alde erabiltzeko ideia.

3. irudia: Himmlerren inspekzio bat Dachaun 1936ko maiatzean. (Argazkia: CC BY-SA 3.0 DE lizentziapean – Wikipedia)

Historialariek urte luzez pentsatu izan dute Himmlerren Entomologia Institutuko jarduerak intsektuen, haien bizi zikloen eta transmititzen zituzten gaixotasunen inguruan gehiago ikasteko eta Alemaniako tropak babesteko nola immunizatu ikertzeko zirela. Baina, 2014an, Klaus Reindhart entomologoak eskuragarri zegoen dokumentazioa berrikusi eta beste ondorio bat atera zuen; zirudienez, beste arrazoi bat edo behintzat beste arrazoi bat gehiago zegoen Himmlerrek intsektuekiko zuen interesaren atzean: etsaien aurka gerrako arma bezala erabiltzea.

Esperimentazioa Dachaun egin zen, SSek guztiz kontrolatzen zuten esparruan, hain zuzen. Bertan, gainera, presoekin esperimentu krudelenak egin ziren, eta horietako batzuk malariarekin lotuta zeuden. Horrez gain, institutua zuzentzeko Alemaniako beste aditu batzuk baztertu eta Eduard May aukeratu zuen, hala moduzko entomologoa baina guztiz antisemita. Horregatik guztiagatik, Reindhartek susmoa zuen Himmlerri interesatzen zitzaion bakarra ez zela eltxoen bizi zikloa. Mayren txosten batean (1944. urtekoa), iruzkin hau aurkitu zen Reindhartek: «malariaren parasitoak infekzio masibo artifizial bat eragitea posible zen argitzeko».

Giza historia hainbat faktoreren baldintzapean egon da beti, eta faktore horietako batzuk gure espeziearen kontroletik kanpo egon dira gainera. Horietako bat da, hain zuzen, espezie hau, orain baino ez baikara hasi hari aurre egiten ikasten, eta hala moduan bakarrik. Azken finean, gure onetik ateratzen gaituzte udako gauetan belarri ondoan haien burrunba entzuten dugunean. Pentsa ziztada bat dela eltxoek eragin dezaketen ondoriorik arinena. Bestela, esan diezaietela Eskoziako kolonoei…

Iturriak:

- How Mosquitoes Helped Shape the Course of Human History – The Smithsonian Magazine

- How mosquitos changed everything – The New Yorker

- Los nazis investigaron con mosquitos infectados de malaria como armas biológicas – Materia

- The Entomological Institute of the Waffen-SS: evidence for offensive biological warfare research in the third Reich – Endeavour

—————————————————–

Egileaz: Rocío Benavente (@galatea128) zientzia kazetaria da.

—————————————————–

Oharra: Jatorrizko artikulua Cuaderno de Cultura Científica blogean argitaratu zen 2019ko abuztuaren 19an: Una historia de mosquitos, escoceses, esclavos y nazis.

The post Eltxoen, eskoziarren, esklaboen eta nazien inguruko historia bat appeared first on Zientzia Kaiera.

Sin intimidad genética

Fuente: Pixabay

Fuente: PixabayMadonna, la conocida cantante, contrata equipos para que limpien de manera concienzuda las habitaciones de hotel en que se ha alojado. Pretende evitar así que alguien consiga muestras biológicas de las que extraer material que pueda ser utilizado para secuenciar su genoma. Puede ser prudencia exagerada, pero no es ninguna extravagancia.

Al lado de la información genética que pueda extraerse de una muestra biológica mínima y, sobre todo, de la forma en que esa información sea transmitida al gran público, las imágenes que capturan hoy los paparazzi de las celebridades serían juegos de patio de colegio. ¿Se lo imaginan?

Angelina Jollie se sometió a sendas operaciones quirúrgicas para extirparse las mamas y los ovarios porque tenía, por causas genéticas, un 87 y un 50% de probabilidades de sufrir cáncer de mama y cáncer de ovario respectivamente. Hizo públicas esas decisiones porque quiso. Pero lo que teme Madonna es que otros, sin que ella pueda ejercer control alguno, puedan hacer pública alguna información de ese estilo relativa a su persona.

¿Se imaginan lo que harían ciertos medios o algunos políticos con información genética relativa a un adversario? Un candidato a ocupar un alto cargo podría ser presentado a la opinión pública como alguien predispuesto genéticamente a adoptar comportamientos de riesgo, por ejemplo. Incluso suponiendo que hubiera algo de verdad en esa supuesta propensión, ¿cómo lo presentaría un medio sensacionalista? ¿cómo se haría alusión a ello en las tertulias de radio o televisión? ¿cómo lo entendería el máximo responsable de su partido? ¿qué pensaráin los votantes de ese partido? Presumo que esas prácticas no serían legales, pero ¿supodría ello una diferencia importante en la práctica?

Análisis genéticos comerciales han servido ya en los Estados Unidos para localizar a la madre de un donante de semen. Cuando esa práctica se generalice, los donantes dejarán de ser anónimos, lo que introducirá cambios importantes en las reglas o podría, incluso, conducir a la desaparición de esa modalidad de donación.

Pero la pérdida del anonimato no se limita al ámbito de los donantes de semen. Solo en Estados Unidos hay del orden de 90 empresas que hacen análisis de ADN para rastrear los ancestros de quienes recurren a sus servicios. Pues bien, el acceso a un porcentaje muy pequeño de la población es suficiente para poder trazar la ascendencia de la gran mayoría. Eso, que resulta sorprendente, es consecuencia de la tupida red de relaciones familiares que tiene cada persona. En los Estados Unidos, por ejemplo, desde el 2% se puede acceder, a traves de primos terceros, a la información genética del 99% de la población.

En esa progresiva pérdida de intimidad, el rizo lo ha rizado Ancestry, una conocida compañía norteamericana de genealogía que comercializa tests genéticos. Tras aliarse con Spotify la conocida firma de música on-line, ofrece, además del correspondiente test de ADN, la lista de música inspirada, supuestamente, en los orígenes del cliente. Nada hay en el ADN de una persona que pueda servir a tal fin. Por mucho que el gusto genérico por la música pueda de alguna forma estar codificado en el genoma, no hay manera de saber qué música escuchaban nuestros ancestros, si es que escuchaban alguna, a partir de su análisis. Porque la particular forma que adquiere la expresión musical es un rasgo cultural y se transmite, por ello, mediante aprendizaje y contagio social.