Una nueva (e inesperada) función de los sacos aéreos

Desde el punto de vista energético el vuelo de las aves es prodigioso. Los músculos de las aves, y de forma especial los pectorales, requieren un ingente aporte de energía para cumplir su función. El esfuerzo muscular y el mantenimiento de una temperatura constante hacen que las aves consuman una gran cantidad de alimento, generalmente entre el 10 y el 20% de su masa corporal cada día. El caso extremo es el de los colibríes, los animales endotérmicos con mayor tasa metabólica, que pueden consumir diariamente hasta cinco veces su masa corporal.

El alimento no es el único condicionante del metabolismo aviar. Ese alimento debe ser oxidado para producir energía, por lo que el sistema respiratorio debe suministrar oxígeno en grandes cantidades. Esta es la razón por la que el sistema respiratorio de las aves es completamente diferente al de cualquier otro grupo de vertebrados, incluyendo a los mamíferos. Y un componente esencial de este particular sistema son los sacos aéreos.

Los sacos aéreos son divertículos de los pulmones que se distribuyen por el cuerpo del animal. Un grupo se localiza en la parte anterior del tronco y otro en la región posterior del tórax y en el abdomen. Se les atribuyen funciones tales como regular la temperatura interna, reducir la fricción entre los músculos o disminuir la densidad corporal. Pero su función principal está relacionada con el sofisticado sistema de ventilación pulmonar de las aves.

Los pulmones de las aves no se hinchan y deshinchan como los nuestros. Esto no sería suficientemente eficaz, ya que en los pulmones de los mamíferos el contenido en oxígeno se va empobreciendo tras la inspiración, al ir pasando a la sangre. Al final del ciclo el aire enrarecido es exhalado y se renueva en la siguiente inspiración.

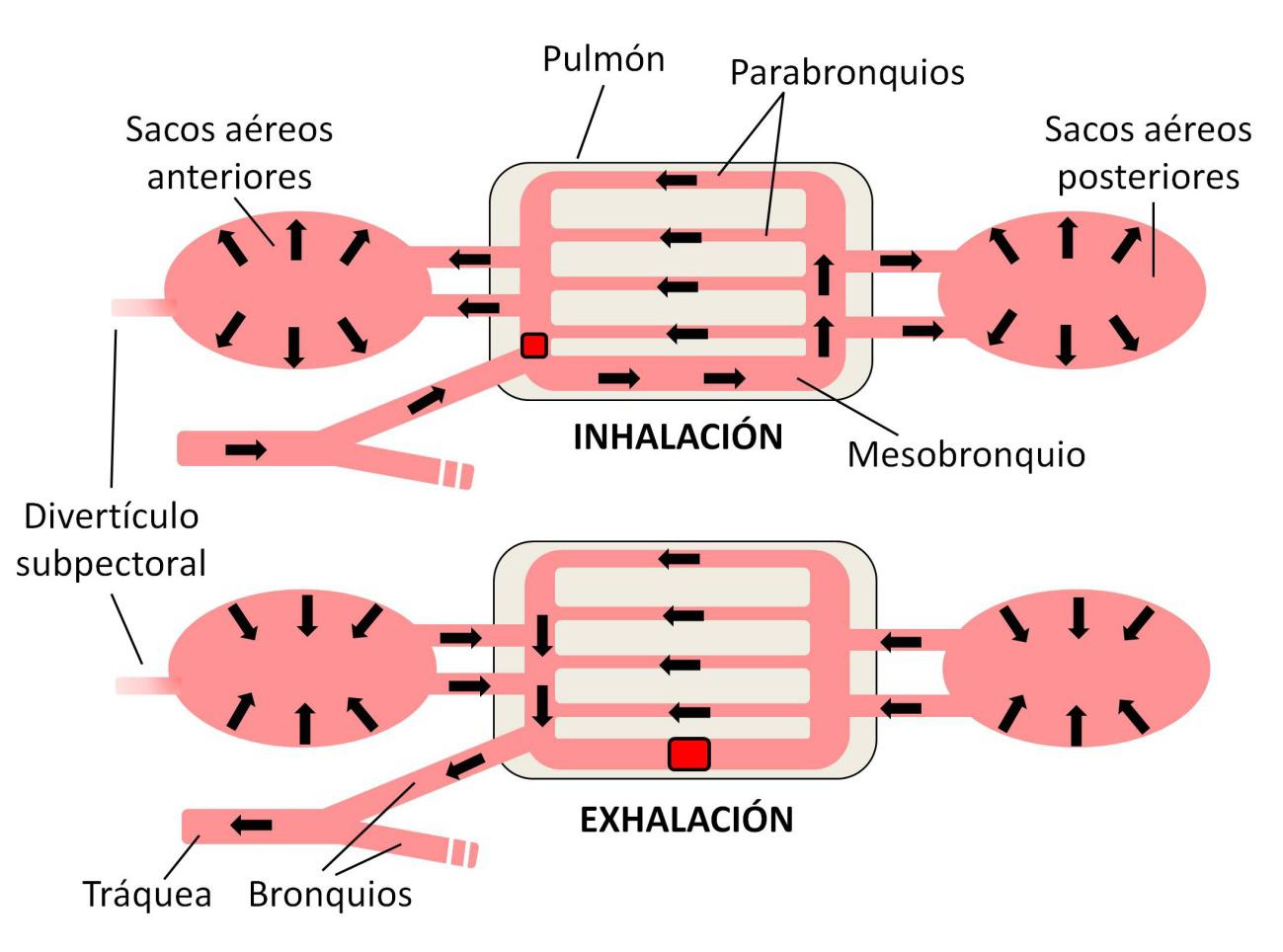

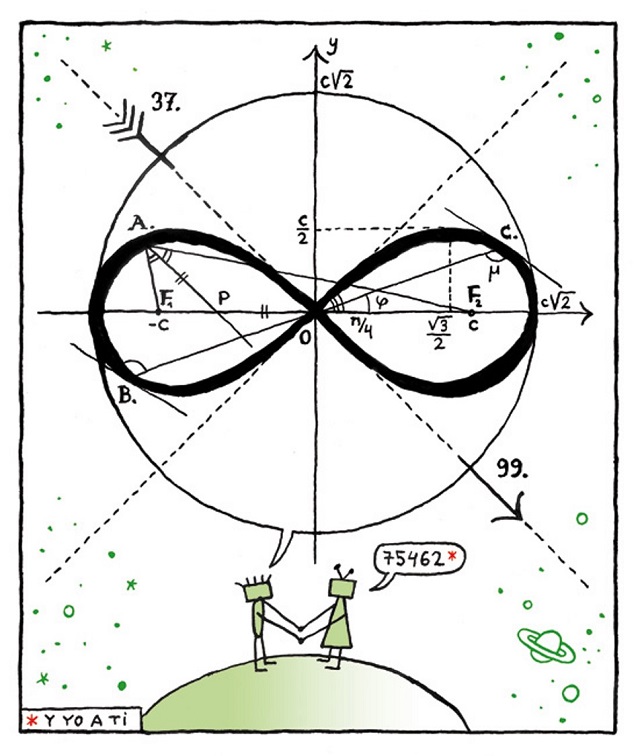

Figura 1. Ciclo de ventilación pulmonar en las aves. Durante la inhalación, el aire llena los sacos aéreos posteriores y circula por los parabronquios. El aire empobrecido en oxígeno se acumula en los sacos aéreos anteriores. En la exhalación, la contracción de los sacos aéreos posteriores mantiene una corriente de aire fresco a través de los parabronquios, mientras que se expulsa el aire de los sacos anteriores. Un sistema de válvulas (en rojo) regula los flujos. Se muestra la posición del divertículo subpectoral

Figura 1. Ciclo de ventilación pulmonar en las aves. Durante la inhalación, el aire llena los sacos aéreos posteriores y circula por los parabronquios. El aire empobrecido en oxígeno se acumula en los sacos aéreos anteriores. En la exhalación, la contracción de los sacos aéreos posteriores mantiene una corriente de aire fresco a través de los parabronquios, mientras que se expulsa el aire de los sacos anteriores. Un sistema de válvulas (en rojo) regula los flujos. Se muestra la posición del divertículo subpectoralLos pulmones de las aves (Figura 1) están formados por una compleja red de tubos finos y muy vascularizados llamados parabronquios. Por estos parabronquios circula una corriente continua de aire fresco, lo que mantiene siempre altos los niveles de oxígeno para su captación por la sangre. Los sacos aéreos posteriores, funcionando como el fuelle de la gaita gallega, almacenan el aire de entrada y lo dirigen hacia los parabronquios durante la espiración. El aire empobrecido en oxígeno se almacena en los sacos anteriores hasta su expulsión. Así, aunque el ave inspire y espire de forma cíclica, el flujo de aire en los parabronquios es continuo, unidireccional y rico en oxígeno.

El llenado y vaciado rítmico de los sacos aéreos se logra por acción de los músculos torácicos y abdominales. Es decir, la acción muscular contribuye a la ventilación pulmonar, de una forma análoga a lo que hace nuestro diafragma. Por eso ha resultado tan sorprendente el descubrimiento de que, a la inversa, los sacos aéreos tienen una función importante en la mecánica del vuelo, en concreto del vuelo planeado.

Figura 2. El alimoche (Neophron percnopterus) es un ave planeadora que utiliza el mecanismo de los divertículos subpectorales para reducir el esfuerzo de sus músculos pectorales. Fuente: lifegyptianvulture.it

Figura 2. El alimoche (Neophron percnopterus) es un ave planeadora que utiliza el mecanismo de los divertículos subpectorales para reducir el esfuerzo de sus músculos pectorales. Fuente: lifegyptianvulture.itLas aves planeadoras mantienen las alas desplegadas para generar su sustentación (Figura 2). Sus músculos pectorales tienen que trabajar menos que los encargados de batir las alas, pero así y todo deben realizar un esfuerzo sustancial para mantener el despliegue de las alas. Curiosamente, las aves planeadoras generalmente tienen unos pequeños divertículos de los sacos aéreos anteriores, localizados bajo los músculos pectorales y de función hasta ahora desconocida. Se denominan divertículos subpectorales, y no aparecen en aves con vuelo batido.

Un reciente artículo publicado en Nature ha mostrado que este divertículo apareció al menos siete veces de forma independiente en la evolución de las aves, siempre coincidiendo con el desarrollo del vuelo planeado. Tienen divertículos subpectorales las gaviotas, grullas, albatros, cormoranes, pelícanos, águilas y otras rapaces planeadoras. La propuesta de los autores de este estudio es que el inflado del divertículo subpectoral disminuye el esfuerzo necesario para mantener el despliegue de las alas durante el vuelo planeado.

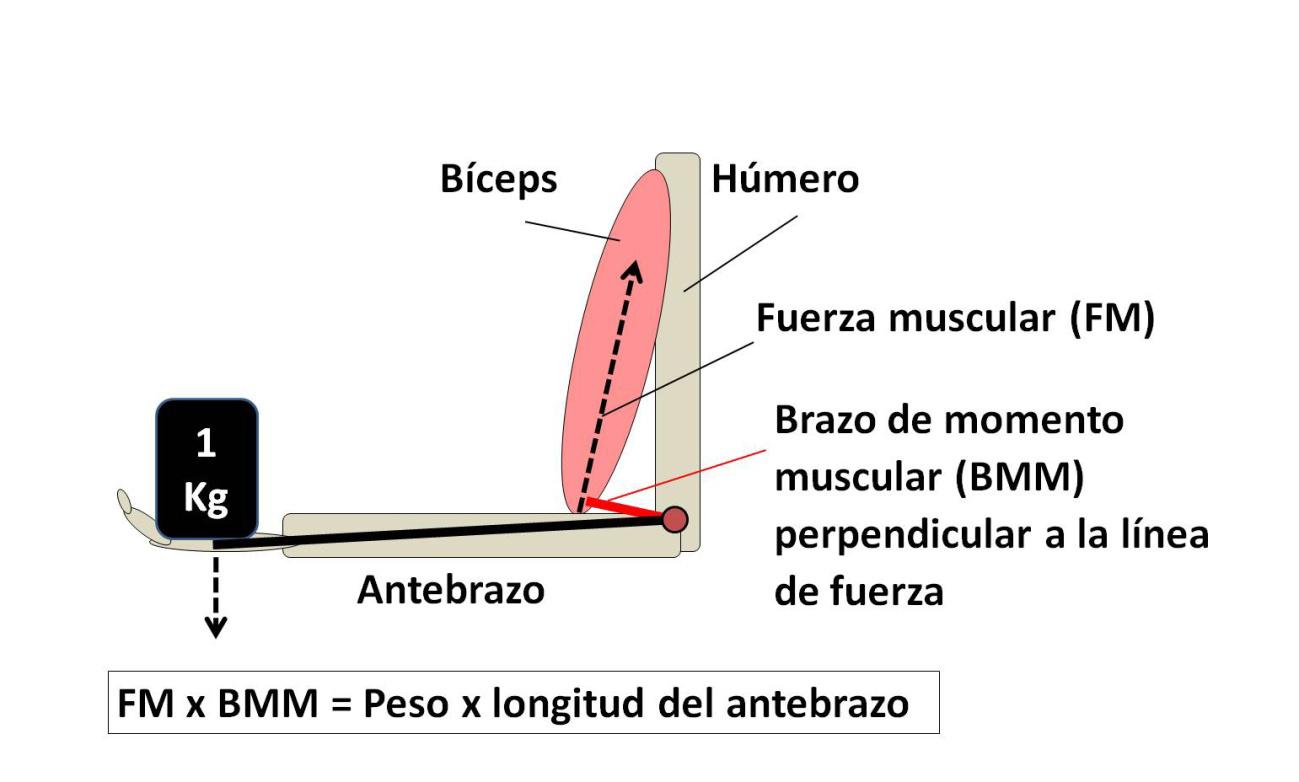

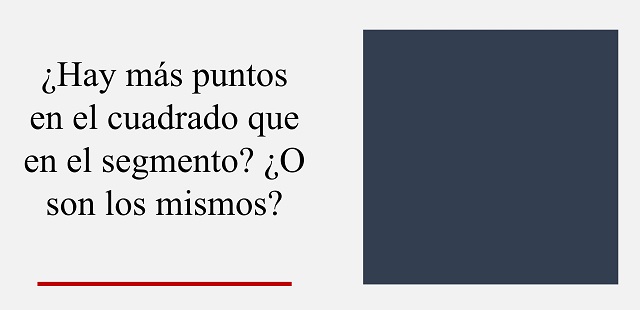

Figura 3. Cuando sostenemos un peso con el brazo en ángulo recto a una distancia determinada del codo, dicha distancia multiplicada por el peso debe ser igual a la fuerza ejercida por el bíceps multiplicada por el brazo de momento muscular

Figura 3. Cuando sostenemos un peso con el brazo en ángulo recto a una distancia determinada del codo, dicha distancia multiplicada por el peso debe ser igual a la fuerza ejercida por el bíceps multiplicada por el brazo de momento muscularPara comprender esto tenemos que explicar el concepto de brazo de momento, la distancia perpendicular entre la línea de acción de una fuerza y un eje de rotación. La figura 3 ilustra esta idea. Si ponemos el brazo en ángulo recto y sostenemos un peso, la fuerza que tenemos que hacer será tanto mayor cuando más cerca del codo esté el eje del bíceps y viceversa. Esta distancia perpendicular entre línea de fuerza muscular y articulación del codo es el brazo de momento muscular.

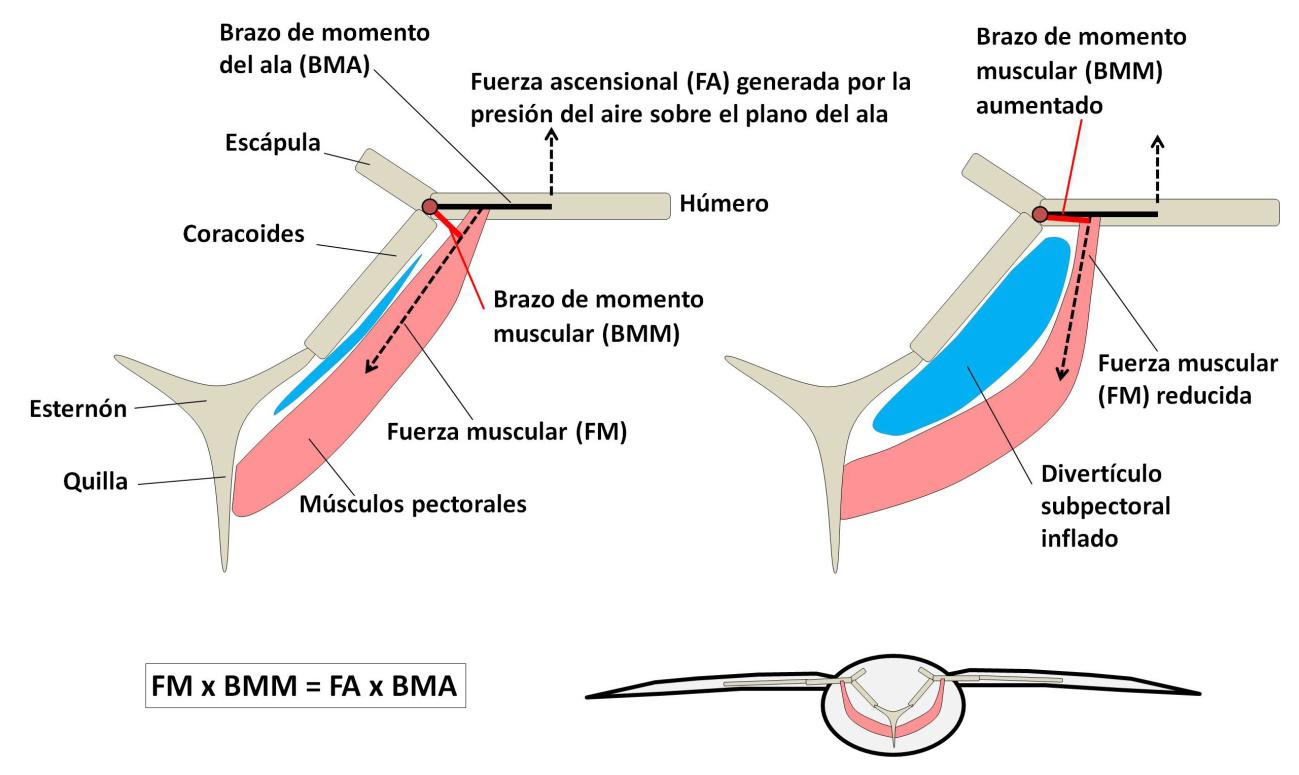

Figura 4. La disminución del esfuerzo necesario para mantener el ala desplegada en las aves planeadoras se produce por el inflado del divertículo subpectoral, que cambia el ángulo de inserción de los músculos pectorales sobre el húmero. De esta forma, aumenta el brazo de momento muscular

Figura 4. La disminución del esfuerzo necesario para mantener el ala desplegada en las aves planeadoras se produce por el inflado del divertículo subpectoral, que cambia el ángulo de inserción de los músculos pectorales sobre el húmero. De esta forma, aumenta el brazo de momento muscularLa figura 4 ayudará a entender la insospechada función de los divertículos subpectorales. Los músculos pectorales se insertan en el húmero y en el esternón, pasando por encima de otros huesos de la cintura pectoral (coracoides y clavícula). Para mantener el planeo, la fuerza desplegada por los músculos debe compensar la fuerza ascensional generada por la presión del aire sobre las alas. Para ser más preciso, el brazo de momento muscular de los pectorales (BMM) multiplicado por la fuerza muscular (FM) debe igualar al brazo de momento del ala (BMA) multiplicado por la fuerza ascensional (FA):

BMM x FM = BMA x FA

La clave está en que el inflado del divertículo subpectoral aumenta el brazo de momento muscular, y disminuye proporcionalmente el esfuerzo muscular necesario para equilibrar la fuerza ascensional. Se trata de una nueva e inesperada función de los sacos aéreos, una innovación adquirida al menos por siete linajes de aves de forma concomitante al desarrollo del vuelo planeado. Y otro fascinante ejemplo de bricolaje evolutivo.

Referencias:

Schachner, E.R., Moore, A.J., Martinez, A. et al. (2024) The respiratory system influences flight mechanics in soaring birds. Nature. doi:10.1038/s41586-024-07485-y

Tobalske BW. (2024) Air sacs reduce energy costs for soaring birds. Nature. doi: 10.1038/d41586-024-01508-4.

Sobre el autor: Ramón Muñoz-Chápuli Oriol es Catedrático de Biología Animal (jubilado) de la Universidad de Málaga

El artículo Una nueva (e inesperada) función de los sacos aéreos se ha escrito en Cuaderno de Cultura Científica.

Algo repentino acabó con el mamut lanudo

Un análisis genómico demuestra que la población de estos grandes mamíferos en la isla de Wrangel, en Rusia, fue relativamente estable hasta su repentina desaparición hace tan solo 4000 años. Este descubrimiento refuta la teoría de que se extinguieron por razones genéticas.

Colmillo de mamut lanudo (Mammuthus primigenius) en la isla rusa de Wrangel. Foto: Love Dalén

Colmillo de mamut lanudo (Mammuthus primigenius) en la isla rusa de Wrangel. Foto: Love DalénLa última población de mamut lanudo (Mammuthus primigenius) quedó aislada en la isla de Wrangel (Rusia), frente a la costa de Siberia, hace unos 10.000 años, cuando el nivel del mar subió y separó la montañosa isla del continente.

Un nuevo análisis genómico revela que los mamuts aislados, que vivieron en la isla durante los 6.000 años siguientes, se originaron a partir de un máximo de 8 individuos, pero crecieron hasta 200-300 ejemplares en 20 generaciones.

Según el estudio, publicado en la revista Cell, los genomas de los mamuts de la isla de Wrangel mostraban signos de endogamia y baja diversidad genética, pero no hasta el punto de poder explicar su definitiva y misteriosa extinción.

«Ahora podemos rechazar con confianza la idea de que la población era simplemente demasiado pequeña y que estaban condenados a extinguirse por razones genéticas», afirma la autora principal Love Dalén, genetista evolutiva del Centro de Paleogenética (iniciativa conjunta del Museo Sueco de Historia Natural y la Universidad de Estocolmo).

«Esto significa que probablemente fue algún suceso aleatorio el que acabó con ellos, y si ese suceso no hubiera ocurrido, entonces seguiríamos teniendo mamuts hoy en día», afirma.

Enseñanzas para la conservaciónAdemás de arrojar luz sobre la dinámica de población del mamut lanudo, este análisis de los mamuts de la isla rusa podría ayudar a fundamentar las estrategias de conservación de animales actuales en peligro de extinción.

«Los mamuts son un sistema excelente para comprender la actual crisis de biodiversidad y lo que ocurre desde el punto de vista genético cuando una especie sufre un cuello de botella poblacional, porque reflejan el destino de muchas poblaciones actuales», afirma la primera autora, Marianne Dehasque, del Centro de Paleogenética.

Para comprender las consecuencias genómicas del cuello de botella de la isla de Wrangel en la población de mamuts, el equipo analizó los genomas de 21 mamuts lanudos: 14 de la isla de Wrangel y 7 de la población continental anterior al cuello de botella. En total, las muestras abarcaban los últimos 50.000 años de existencia del mamut lanudo, lo que permitía comprender cómo había cambiado la diversidad genética de los mamuts a lo largo del tiempo.

La comparación de los genomas de los mamuts de la isla con los de sus antepasados del continente fue lo que reveló los signos de endogamia y baja diversidad genética en los primeros. Además, mostraban una diversidad reducida en el complejo mayor de histocompatibilidad, un grupo de genes conocidos por desempeñar un papel fundamental en la respuesta inmunitaria de los vertebrados.

Foto de la réplica de mamut en el Royal British Columbia Museum. Foto: Geoff Peters / Wikimedia CommonsUn tamaño de la población estable

Foto de la réplica de mamut en el Royal British Columbia Museum. Foto: Geoff Peters / Wikimedia CommonsUn tamaño de la población estable

Los investigadores demostraron que la diversidad genética de la población siguió disminuyendo durante los 6.000 años que los mamuts habitaron la isla de Wrangel, aunque a un ritmo muy lento, lo que indica que el tamaño de la población se mantuvo estable hasta el final.

Y aunque la población de mamuts de la isla fue acumulando mutaciones moderadamente dañinas a lo largo de sus 6.000 años de permanencia, los investigadores demostraron que la población iba purgando lentamente las mutaciones más dañinas.

«Si un individuo tiene una mutación extremadamente dañina, básicamente no es viable, así que esas mutaciones desaparecieron gradualmente de la población con el tiempo, pero por otro lado, vemos que los mamuts fueron acumulando mutaciones medianamente dañinas casi hasta que se extinguieron», dice Dehasque.

«Es importante que los programas de conservación actuales tengan en cuenta que no basta con que la población vuelva a tener un tamaño decente –subraya–, y también hay que vigilarla genéticamente y de forma activa, porque estos efectos genómicos pueden durar más de 6.000 años».

Los últimos años del mamutAunque los genomas de mamut analizados en este estudio abarcan un amplio periodo de tiempo, no incluyen los últimos 300 años de existencia de la especie. Sin embargo, los investigadores han desenterrado fósiles del periodo final del mamut y planean llevar a cabo la secuenciación genómica en el futuro.

«No sabemos por qué se extinguieron después de haber estado más o menos bien durante 6.000 años, pero creemos que fue algo repentino», afirma Dalén, que concluye: «Yo diría que aún hay esperanzas de averiguar por qué se extinguieron, pero no hay promesas».

Una versión anterior de este artículo se ha publicado originalmente en SINC

El artículo Algo repentino acabó con el mamut lanudo se ha escrito en Cuaderno de Cultura Científica.

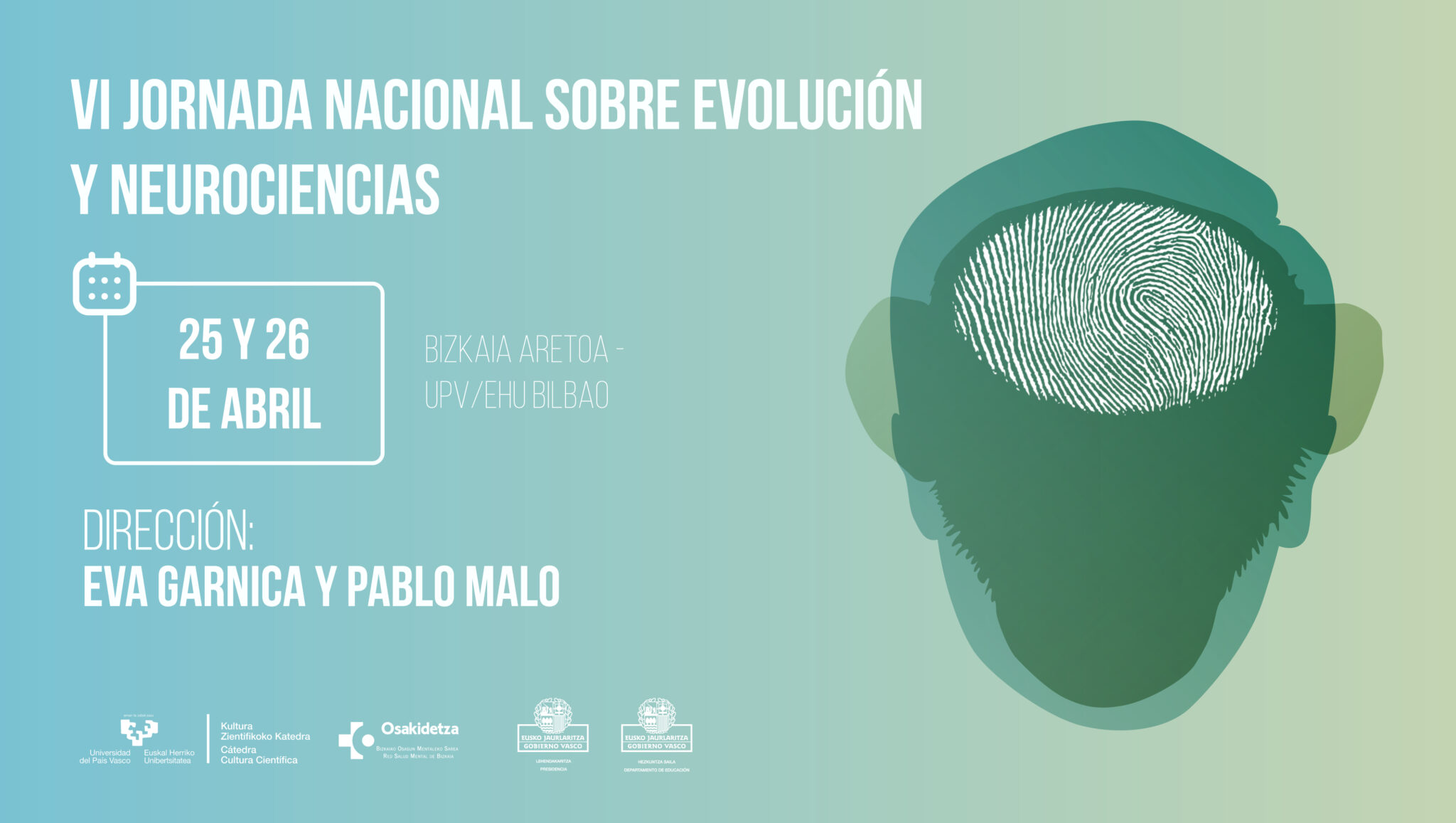

Cambios cerebrales durante el embarazo y la maternidad

Los cambios del cerebro durante el embarazo y la maternidad, cómo el estrés ha pasado de ser un mecanismo de supervivencia a un eventual elemento de riesgo para nuestra salud o cuál ha sido el papel que ha jugado el suicidio en la evolución del ser humano fueron algunos de los temas que se tratarán en la VI Jornada Nacional sobre Evolución y Neurociencias.

La jornada tuvo lugar el Bizkaia Aretoa de la UPV/EHU los pasados 25 y 26 de abril y estuvo dirigida por Eva Garnica y Pablo Malo, de la Red de Salud Mental de Bizkaia, institución que organizó la jornada junto a la Cátedra de Cultura Científica de la UPV/EHU.

El encuentro, cuya primera edición se celebró en 2017, se ha convertido en una cita imprescindible para las y los expertos en ámbitos como la psiquiatría, la psicología o la biología. Una jornada que sirve para analizar el comportamiento humano desde un punto de vista evolutivo y divulgar de un modo accesible para todos los públicos.

Los cambios fisiológicos y neuronales asociados al embarazo y crianza de los hijos transforman a la persona. Susana Carmona nos explica cómo afectan al cerebro de las madres en Cambios cerebrales durante el embarazo y la maternidad.

Susana Carmona Cañabate, psicóloga clínica y doctora en neurociencias, es investigadora principal del Grupo de Neuroimagen del Hospital General Universitario Gregorio Marañón (Madrid).

Si no ve correctamente el vídeo, use este enlace.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Cambios cerebrales durante el embarazo y la maternidad se ha escrito en Cuaderno de Cultura Científica.

La IA podría convertir la ciencia en algo incomprensible

Hace unos días un artículo preaceptado en la revista Nature nos hablaba de las maravillas del modelo de inteligencia artificial (IA) AlphaFold 3, que superaban en mucho a su versión anterior. Se trata de un sistema capaz de predecir la estructura de proteínas, ácidos nucleicos y moléculas pequeñas cuyo potencial para la medicina de precisión y la creación de medicamentos es enorme. Además, el uso de modelos –tanto predictivos como generativos– de IA para diagnóstico está produciendo resultados asombrosos.

Casi al mismo tiempo, se nos informaba en los medios del proyecto de creación en la Unión Europea de un centro de investigación en IA dedicado especialmente al desarrollo de sistemas útiles para la investigación científica.

Todo esto no ha hecho más que comenzar. Las consecuencias que la extensión del uso de modelos predictivos tendría para la ciencia desde el punto de vista epistemológico y metodológico es un asunto sobre el que hay un creciente interés.

Esta imagen fue creada por Twistedpoly como parte del proyecto Visualizando la IA de Google DeepMind. Foto: Google DeepMind / Unsplash

Esta imagen fue creada por Twistedpoly como parte del proyecto Visualizando la IA de Google DeepMind. Foto: Google DeepMind / UnsplashEn otro artículo publicado este año en Nature se señalan tres ilusiones a las que puede conducir una aplicación acrítica de la IA en la investigación científica:

- La ilusión de profundidad explicativa. Consistiría en hacer creer a los científicos que entienden más sobre un conjunto de fenómenos porque han sido predichos con exactitud por un modelo de IA.

- La ilusión de amplitud exploratoria. Consistiría en creer que lo que puede ser modelizado por la IA agota la realidad que ha de ser explorada.

- La ilusión de objetividad. Consistiría en creer que las herramientas de la IA eliminan cualquier elemento de subjetividad y representa a todos los puntos de vista relevantes.

Son tres peligros que habrá que esquivar. La pérdida de importancia de la comprensión profunda de los fenómenos en la ciencia es un riesgo. La ciencia ha buscado la explicación y la predicción. Cabe la posibilidad de que el enorme éxito predictivo conseguido a través de sistemas de IA –que se comportan como cajas negras, puesto que son incapaces de justificar sus resultados–, relegue a un segundo plano la capacidad explicativa.

Como resultado, perdería peso la elaboración teórica en la ciencia y la búsqueda de las causas.

Estos modelos predictivos pueden ser muy útiles en la práctica, puesto que son capaces establecer correlaciones precisas que nos avisen con bastante seguridad de cuándo puede suceder algo –cuándo está aumentando la incidencia de una enfermedad–, pero el precio a pagar podría ser la imposibilidad de desentrañar lo que ocurre para encontrar una explicación causal.

Es cierto que no todos los sistemas de IA que se emplean en investigación funcionan como cajas negras. También es cierto que las correlaciones halladas por los modelos predictivos podrían ayudar a encontrar, mediante investigaciones ulteriores, relaciones causales imprevistas, conexiones nuevas e incluso fenómenos no conocidos o no conceptualizados hasta entonces.

Sin embargo, el empleo cada vez más extendido de sistemas de IA que presentan lo que se ha denominado opacidad epistémica puede conducir a la merma en la comprensión de la realidad que nos procura la capacidad explicativa de hipótesis, modelos y teorías.

“Calla y calcula”Se suele decir que la interpretación de Copenhague de la mecánica cuántica se resume en el mandato “calla y calcula”. Es una exageración, claro está, que buscaba que los físicos no se entretuvieran demasiado con las cuestiones de fundamento, ampliamente filosóficas, y se centraran en el éxito predictivo de la teoría. Cabría la posibilidad de que muchos científicos tomaran esa boutade como un mandato inevitable de la ciencia sometida a los designios de la IA.

Esta actitud podría tener consecuencias negativas en ciencias sociales y biomédicas, en las que se basan políticas públicas, y las decisiones que se tomen pueden afectar a la vida de las personas a causa, por ejemplo, de sesgos no detectados. Estas ciencias tratan sobre sistemas complejos en los que con frecuencia una pequeña variación en las condiciones iniciales puede llevar a resultados completamente diferentes.

¿Cómo decirle a un paciente que un modelo predictivo ha dado como resultado una alta probabilidad de padecer una enfermedad mortal de la que no muestra ningún síntoma, pero sin que haya posibilidad de darle ninguna explicación acerca de cómo el sistema ha llegado a tal conclusión? ¿Bastará con señalarle que el sistema es altamente fiable porque su éxito predictivo está bien constatado? ¿Debería un médico actuar de alguna manera o prescribir un tratamiento sin tener una garantía epistémica adicional que justifique su intervención?

Un resultado interesante a este respecto es que algunos estudios recientes han mostrado que las personas son favorables a priorizar la exactitud en las predicciones de los sistemas de IA frente a la explicabilidad de los resultados si tienen que elegir entre ambas cosas.

De esa elección entre explicación y predicción podrían decir mucho todas las ciencias basadas en modelos matemáticos, como la economía o la biología evolutiva. Pero, hasta ahora, incluso en esas ciencias los modelos cuantitativos buscaban establecer en la medida de lo posible relaciones causales, cosa que no es objetivo central de los modelos predictivos de IA, que solo buscan el acierto.

Sin embargo, la tentación de usar estos modelos predictivos es fuerte, puesto que los gestores de políticas públicas reclaman con frecuencia a los científicos sociales respuestas claras para los problemas acuciantes. Aquí se trata en el fondo de obtener respuestas fiables a problemas complejos, aún a costa de no entender bien por qué esa debe ser la respuesta correcta. Hay quienes abogan por una integración de ambos tipos de modelos, los centrados en la explicación causal y los centrados en la predicción. Está por ver cómo lograr tal cosa.

¿Hacia una ciencia ininteligible?El uso generalizado de estos modelos en la ciencia afectaría también a la idea de que el progreso científico se basa en la elaboración de hipótesis revisables que van siendo sustituidas por mejores hipótesis. En ese proceso, como ya señaló el filósofo de la ciencia Larry Laudan, una ganancia explicativa puede compensar una cierta pérdida predictiva.

No menos perturbadora sería la tendencia a creer que lo no tratable mediante modelos de IA deja de tener interés para la propia ciencia. En último extremo, podría conducir incluso a una ciencia en buena medida ininteligible para los humanos, en el sentido de que tendrán resultados conseguidos mediante modelos no interpretables. Este cambio nos obligaría a replantearnos no ya solo qué noción de verdad es la que aceptaremos sino, incluso, si no tendríamos que abandonar el concepto como tal, contentándonos con la mera utilidad de una creencia.

No parece que el ser humano esté, de momento, capacitado para este cambio.

Todo esto son buenas razones para no poner todo el peso de la investigación en los modelos predictivos, por beneficiosos que puedan ser. Estos modelos han de ser completados con el uso de modelos explicativos y con la búsqueda de hipótesis explicativas contrastables. Una contrastación para la que los modelos predictivos pueden cumplir una importante función.

Otra cosa sería que finalmente pudiera lograrse abrir de algún modo esas cajas negras, quizás mediante otros sistemas de IA que no fueran a su vez ellos mismos cajas negras, o bien que pudiera alcanzarse en el futuro una IA transparente, en la que los algoritmos fueran capaces de dar cuenta cabal de sus resultados de un modo inteligible para los seres humanos. Es un objetivo en el que se trabaja con creciente atención por parte de la inteligencia artificial explicable (XAI), pero el camino es aún incierto. Ojalá seamos capaces de hallarlo pronto.![]()

Sobre los autores: Antonio Diéguez Lucena, Catedrático de Lógica y Filosofía de la Ciencia, Universidad de Málaga e Iñigo De Miguel Beriain, Investigador distinguido, Facultad de Derecho, Ikerbasque Research Professor, Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo La IA podría convertir la ciencia en algo incomprensible se ha escrito en Cuaderno de Cultura Científica.

El software humano del Proyecto Manhattan

A día de hoy, impresiona bastante darse cuenta de que algunos de los hitos científicos y tecnológicos más relevantes de la historia reciente se consiguieron con una capacidad computacional limitada por la cantidad de cerebros humanos que hubiera disponibles para trabajar en un problema. Pero el caso es que, en algunos centros de investigación, esos cerebros estaban casi mejor organizados que cualquier máquina de la que pudieran disponer. Ese fue el caso, alrededor de 1943, de las instalaciones de computación de Los Alamos durante el Proyecto Manhattan.

Lo importante de toda esta cuestión, y sin entrar ahora a detallar cómo se gestó o las circunstancias científicas, políticas y bélicas que llevaron hasta la determinación de financiar la creación de la primera bomba atómica, es que en los años cuarenta del siglo XX, los cálculos necesarios para diseñar un artefacto semejante no eran, ni mucho menos, triviales. Sobre todo en lo que concernía al diseño del mecanismo y el cálculo de la hidrodinámica de implosión de la bomba de plutonio ―el tipo que la que se probó en el test Trinity―, lo que suponía, entre otras cosas, determinar cuánta energía liberaría el artefacto. La imposibilidad, sobre todo al principio, de hacer pruebas implicaba que había que trabajar con modelos matemáticos que conllevaban la resolución de ecuaciones diferenciales en derivadas parciales no lineales, algo, para cualquiera que no esté familiarizado con ellas, bastante arduo sin un ordenador.

En aquel momento, sobre todo antes de la Segunda Guerra Mundial, se contaba, principalmente, con tres tipos de dispositivos de cálculo: calculadoras electromecánicas de escritorio; máquinas tabuladoras de tarjetas perforadas, y analizadores diferenciales ―un tipo de computador analógico como el que Vannevar Bush construyó en el MIT―. En el Proyecto Manhattan se utilizaron, sobre todo, los dos primeros. El analizador diferencial se destinó durante la guerra sobre todo a la elaboración de tablas de artillería.

A principios de 1943, Stanley P. Frankel y Edred Nelson llegarían a Los Alamos para encargarse de organizar todo el trabajo de matemáticas teórico. Ya habían adquirido experiencia de ese tipo en el Laboratorio Lawrence de Berkeley haciendo cálculos relacionados con la separación de isótopos de uranio y la estimación de la masa crítica necesaria para mantener una reacción en cadena. En Nuevo México se encargarían, en un principio, de los cálculos relacionados con la bomba de uranio, de tipo balístico, para más tarde, hacia 1944 y tras la insistencia de John von Neumann en un cambio de enfoque, pasar a encargarse de los relacionados con la bomba de uranio y su mecanismo de implosión.

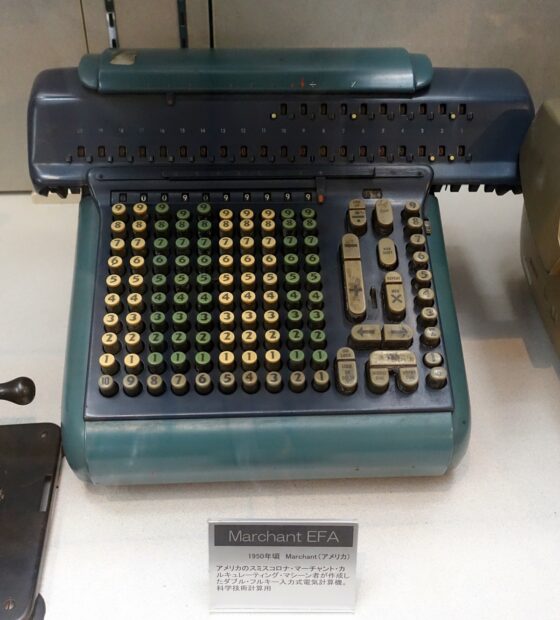

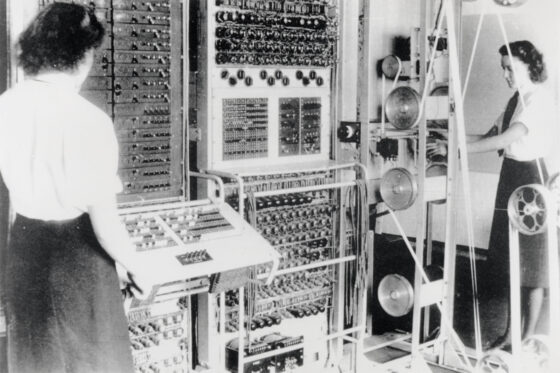

Para ello, lo primero que hicieron fue encargar ciertas unidades de calculadoras de escritorio Marchant, Fridens y algunas Monroe, y las distribuyeron entre las «computadoras humanas» que se encargarían del proceso y que solían ser mujeres. Más adelante empezaron a valorar la posibilidad de utilizar máquinas tabuladoras y en marzo de 1944 llegó el refuerzo de las IBM 601, entre otras.

En Los Alamos, computadoras humanas, normalmente mujeres, realizaban a mano los cálculos necesarios para el desarrollo de la bomba atómica con calculadoras electromecánicas Marchant similares a la que aparece en la foto. Fuente: CC0 1.0/Daderot

En Los Alamos, computadoras humanas, normalmente mujeres, realizaban a mano los cálculos necesarios para el desarrollo de la bomba atómica con calculadoras electromecánicas Marchant similares a la que aparece en la foto. Fuente: CC0 1.0/Daderot

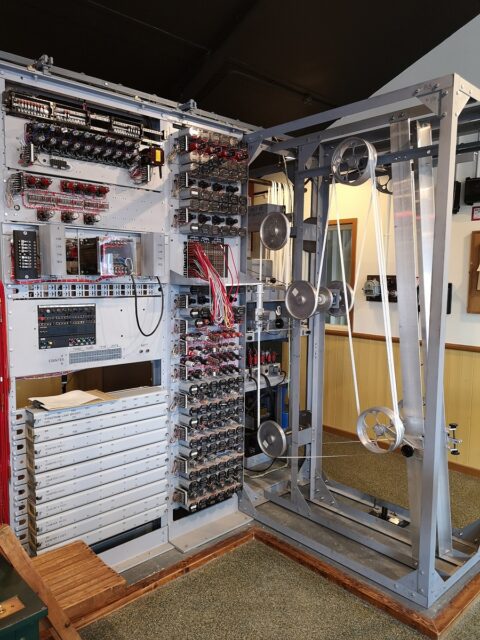

La IBM 601 era una máquina tabuladora capaz de multiplicar ―aunque no dividir― dos números que se introducían en ella utilizando tarjetas perforadas. Se llegaron a instalar cuatro de ellas en Los Alamos para finales de 1944, además de otros modelos similares de IBM con otras aplicaciones. El sistema se componía de ocho máquinas en total. Fuente: CC BY-SA 3.0/Sandstein

La IBM 601 era una máquina tabuladora capaz de multiplicar ―aunque no dividir― dos números que se introducían en ella utilizando tarjetas perforadas. Se llegaron a instalar cuatro de ellas en Los Alamos para finales de 1944, además de otros modelos similares de IBM con otras aplicaciones. El sistema se componía de ocho máquinas en total. Fuente: CC BY-SA 3.0/SandsteinAquí merece la pena hacer un inciso. Es de sobra conocido que, en los inicios de la historia de la computación, quienes se encargaban principalmente de las labores de programación de los primeros computadores eran ellas. En el caso del Proyecto Manhattan, quienes lo hacían eran, en un gran porcentaje, las esposas de los científicos que trabajaban allí. Así, podemos encontrar nombres como Mary Frankel, que llegó a supervisar uno de los grupos de cálculo, o Mici Teller, cuyos apellidos de casadas no deberían resultar desconocidos. También son reseñables los trabajos que Klara Dan von Neumman llevó a cabo allí tras la guerra con el ENIAC. Se estima que hubo más de trescientas mujeres allí ocupando puestos técnicos en el Proyecto Manhattan. En el caso de Los Alamos, el lugar era, además, una ciudad en miniatura donde se mudaron familias enteras, y se incentivó activamente el trabajo de estas mujeres, muchas de ellas amas de casa, otorgándoles ciertas ayudas, normalmente relacionadas con el cuidado del hogar y de los hijos.

Mary Frankel (X214) y Mici Teller (X169) fueron dos de las numerosas mujeres calculadoras que trabajaban en Los Alamos. Fuente: Los Alamos National Laboratory

Mary Frankel (X214) y Mici Teller (X169) fueron dos de las numerosas mujeres calculadoras que trabajaban en Los Alamos. Fuente: Los Alamos National Laboratory

No obstante, lo que más llama la atención del el equipo de computación de Frankel y Nelson no eran ni las mujeres calculadoras ni las máquinas que utilizaban en sí, sino la organización. Cuando empezaron a valorar el uso de máquinas tabuladoras para realizar los cálculos, idearon un sistema para agilizarlos creando una especie de «programa» o diagrama de flujo que dividía el proceso de resolución de una ecuación en pasos sencillos. Hasta que contaron con las IBM no pudieron probarlo directamente, así que hicieron una especie de simulacro utilizando el equipo de mujeres calculadoras. El proceso era bastante intuitivo. Con su Marchant encima de la mesa, cada una efectuaba uno de los pasos: unas hacían multiplicaciones, otras divisiones, otras raíces cuadradas… siempre lo mismo, y pasaban su resultado a la siguiente mesa en una tarjeta para que otra compañera continuara con su parte del cálculo. El sistema funcionó increíblemente bien, muchísimo mejor y más eficientemente que si una sola persona resolvía la ecuación completa paso a paso.

En medio de todo aquello se encontraba un jovencísimo físico de veintiséis años que en el futuro casi pasaría más a la historia por tocar los bongos que por ganar un premio Nobel: Richard Feynman. Era uno de los que se encargaba de reparar las calculadoras Marchant cuando se rompían ―no había tiempo de enviarlas al fabricante y esperar a que las devolviera―, y conocía muy bien el funcionamiento de todo aquello. Cuando llegaron las primeras IBM, en abril de 1944, también ayudó a Frankel y Nelson a montarlas ―el secretismo extremo alrededor de todo lo relacionado con el Proyecto Manhattan complicó, en un primer momento, que ningún empleado de IBM consiguiera autorización para ir a Los Alamos para hacerlo―. Y en cuanto todo estuvo listo, obviamente, Feynman tuvo una de sus peculiares ideas: poner a competir a las mujeres calculadoras y a las máquinas tabuladoras realizando el mismo trabajo: ¿quién tardaría menos en resolver un problema? A día de hoy, diríamos que cualquier ordenador, pero entonces ganaron las mujeres. La única desventaja que mostraron, utilizando el mismo proceso de cálculo, era que, obviamente y a diferencia de las IBM, la fatiga acababa haciendo mella en ellas.

Aquel «programa» humano, unido al uso de las máquinas tabuladoras ya operativas, supuso un aumento de rendimiento espectacular porque, además, vieron que de esta manera no tenían que limitarse a realizar un solo cálculo por vez, sino que podían llegar a efectuar hasta dos o tres en paralelo. Utilizando tarjetas de colores, en cada puesto se realizaba el mismo paso siempre, pero para diferentes asuntos, cada uno identificado con un color.

Es curioso, además, como aquellas máquinas tan básicas hicieron perder la cabeza a Stanley Frankel, que se puso a utilizarlas para cualquier cosa menos para lo que las habían comprado y a probar qué serían capaces de hacer ―como el geek que se compra un PC nuevo con las últimas especificaciones del mercado―. Feynman acabaría sustituyéndolo en su puesto, y demostró ser un gran organizador. El equipo que trabajaba con las máquinas tabuladoras, ahora formado principalmente por chavales jóvenes sacados del instituto con algún conocimiento técnico o de ingeniería, ni siquiera sabía para qué eran todos aquellos cálculos. Feynman consiguió permiso para contárselo y, de nuevo, la productividad se disparó: los chicos empezaron a buscar maneras de mejorar y agilizar los procesos trabajando día y noche. Se pasó de resolver tres problemas en nueve meses, antes de las tabuladoras y de aquel software humano, a nueve problemas en tres meses.

Es increíble, que con tan solo lápiz, papel y talento, los científicos sacaran todo ese partido a aquellas máquinas rudimentarias y se las apañaran para desentrañar uno de los secretos más intrincados del átomo.

La única imagen a color de la explosión de Trinity con buena exposición, tomada por Jack Aeby. Fuente: Wikimedia Commons

La única imagen a color de la explosión de Trinity con buena exposición, tomada por Jack Aeby. Fuente: Wikimedia Commons

Bibliografía

Archer, B. J. (2021). The Los Alamos computing facility during the Manhattan Project. Nuclear technology, 204, pp. S190-S203. doi: 10.1080/00295450.2021.1940060

Feynman, R. P. (2018 [1987]). ¿Está usted de broma, Sr. Feynman? Aventuras de un curioso personaje. Alianza Editorial.

Howes, R. y Herzenberg, C. L. (1999). Their day in the sun. Women of the Manhattan Project labor and social change. Temple University Press.

Sobre la autora: Gisela Baños es divulgadora de ciencia, tecnología y ciencia ficción.

El artículo El software humano del Proyecto Manhattan se ha escrito en Cuaderno de Cultura Científica.

El teorema de Morley

La geometría euclidiana y, en particular, la geometría plana, está repleta de hermosos y sorprendentes teoremas, que suelen venir acompañados de diagramas con mucho encanto, como el teorema de Napoleón (véase la entrada Variaciones artísticas del teorema de Napoleón), el teorema de van Aubel (véase la entrada Una pequeña joya geométrica: el teorema de van Aubel), el teorema de Viviani (cuya demostración sin palabras podéis admirar en la entrada Teoremas geométricos sin palabras: Viviani), el teorema de la circunferencia de Conway (un moderno resultado geométrico del que podéis leer en la entrada Teoremas geométricos sin palabras: Conway), el teorema de Marion (véase la entrada El teorema de Marion (Walter)), el teorema de la bandera británica (véase la entrada El teorema de la ikurriña), o el mismísimo teorema de Pitágoras (véase la entrada Pitágoras sin palabras), entre muchos otros.

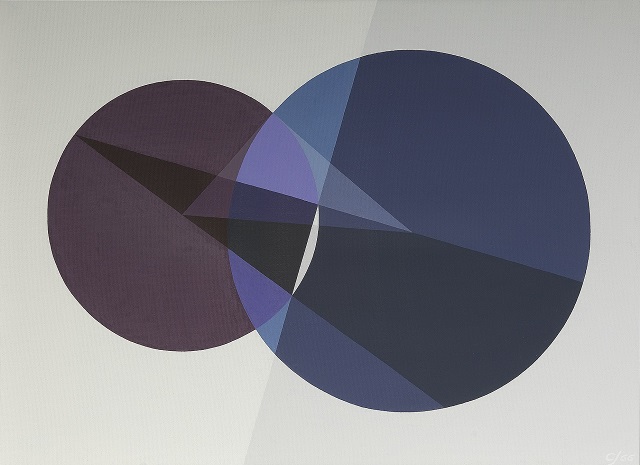

Línea polar de un punto y un círculo (Apolonio), del dibujante e ilustrador infantil estadounidense Crockett Johnson (1906-1975). Imagen de la página web de The National Museum of American History

Línea polar de un punto y un círculo (Apolonio), del dibujante e ilustrador infantil estadounidense Crockett Johnson (1906-1975). Imagen de la página web de The National Museum of American HistoryExisten muchos otros fascinantes teoremas geométricos del plano. En esta entrada del Cuaderno de Cultura Científica vamos a hablar de uno especialmente interesante y atractivo, que ha cautivado a muchas personas, en particular, del ámbito de las matemáticas, a lo largo del siglo XX (no es un teorema antiguo). Durante este tiempo se han desarrollado una cantidad importante de diferentes demostraciones, muchas de ellas de la mano de grandes matemáticos, como el matemático francés, que recibió la Medalla Fields en 1982, Alain Connes (1947), el matemático húngaro Béla Bollobás (1943), el matemático, físico y científico de la computación Edsger W. Dijkstra (1930-2002), el prolífico e imaginativo matemático británico John H. Conway (1937-2020), creador del autómata celular denominado el juego de la vida, o el matemático y físico matemático británico Roger Penrose (1931), que recibió el Premio Nobel de Física en 2020, entre muchos otros. Es el teorema de Morley, que debe su nombre al matemático británico, que vivió gran parte de su vida en Estados Unidos, Frank Morley (1860-1937), relacionado con las trisectrices de un triángulo cualquiera.

El teorema de las trisectrices de MorleyAntes de nada, enunciemos la versión simple del teorema de Morley, que es un resultado geométrico de una especial sencillez en su enunciado, pero de una gran profundidad en su significado.

Teorema de Morley (1899): Los puntos de intersección de las trisectrices adyacentes de los ángulos de un triángulo cualquiera, son los vértices de un triángulo equilátero.

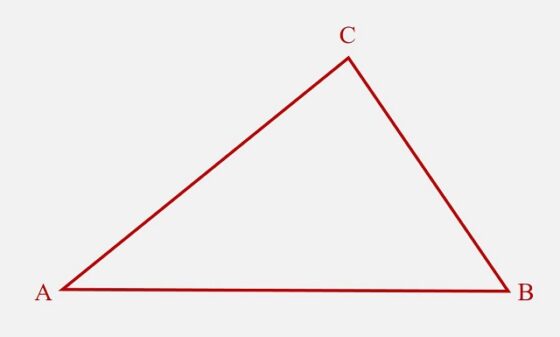

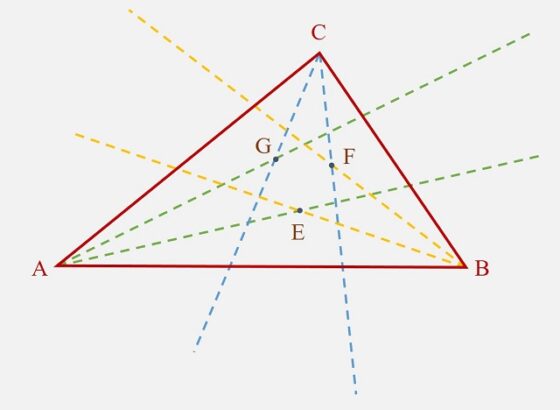

Expliquémoslo brevemente. Partimos de un triángulo ABC cualquiera, como el que vemos en la siguiente imagen.

Triángulo ABC

Triángulo ABC

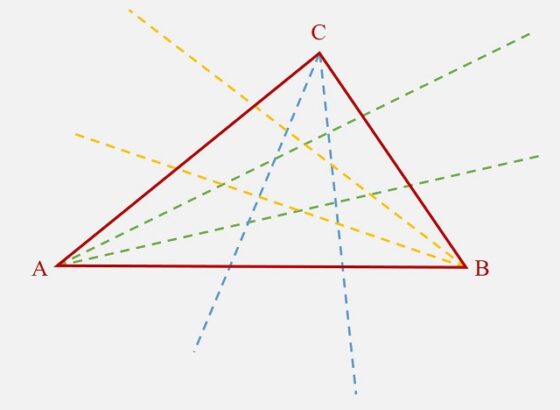

A continuación, en cada uno de los tres ángulos del triángulo ABC se trazan las trisectrices, es decir, las dos rectas que dividen al ángulo en tres ángulos iguales, como se muestra en la siguiente imagen.

Los tres pares de trisectrices, líneas rectas, de los ángulos del triángulo ABC

Los tres pares de trisectrices, líneas rectas, de los ángulos del triángulo ABC

Alguien, al leer que estamos tomando las trisectrices de un ángulo, podría pensar que esto no es posible. La confusión puede venir del hecho de que hay tres problemas clásicos de la matemática griega, la cuadratura del círculo, la trisección de un ángulo y la duplicación de un cubo, que no tienen solución, pero solo si esta solución se intenta construir “con regla y compás”, que son los instrumentos clásicos de la matemática griega (véase, por ejemplo, el artículo Los tres problemas clásicos, de Santiago Fernánez, o el libro Historia de las matemáticas, de Carl B. Boyer).

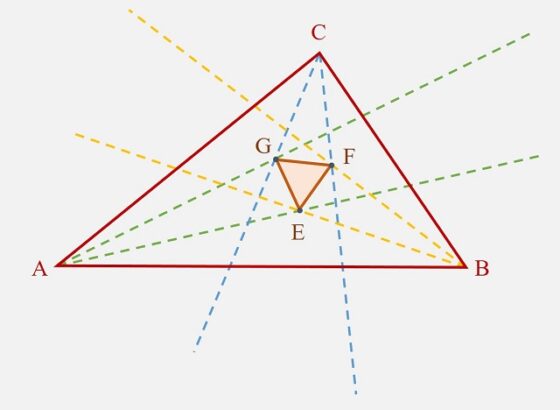

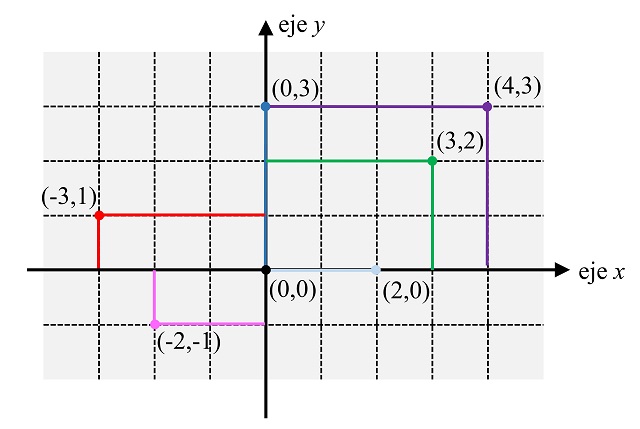

A continuación, se toman los tres puntos que son la intersección de las trisectrices adyacentes de los ángulos del triángulo ABC, que en la imagen hemos denominado E, F y G.

Los puntos E, F y G son las intersecciones de las trisectrices adyacentes de los ángulos del triángulo ABC

Los puntos E, F y G son las intersecciones de las trisectrices adyacentes de los ángulos del triángulo ABC

Entonces, el teorema de Morley establece que el triángulo EFG, cuyos vértices son los puntos de intersección de las trisectrices adyacentes de los ángulos del triángulo ABC, es un triangulo equilátero, es decir, con los tres lados iguales (así como sus ángulos, de 60 grados). A este triángulo equilátero se le llama “triángulo de Morley”.

El triángulo EFG es equilátero

El triángulo EFG es equilátero

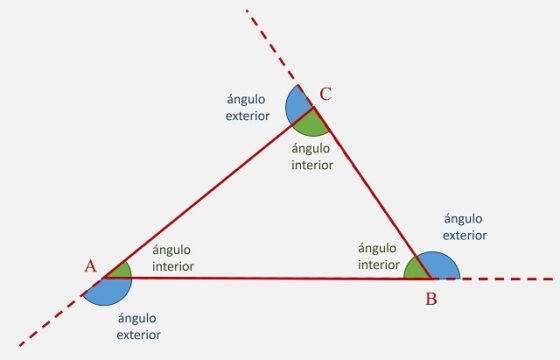

Si en lugar de tomar las trisectrices de los ángulos interiores del triángulo, se toman las trisectrices de los ángulos exteriores, se forma otro triángulo equilátero. Antes de mostrar este resultado, recordemos cuales son los ángulos exteriores de un triángulo.

Ángulos interiores y exteriores de un triángulo ABC

Ángulos interiores y exteriores de un triángulo ABC

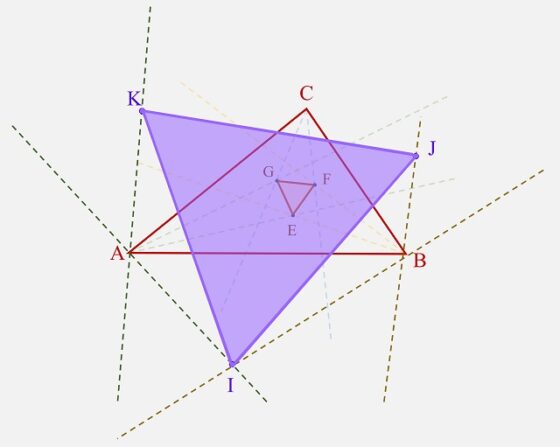

Por lo tanto, también sería cierto el teorema de Morley para ángulos exteriores, es decir, que los puntos de intersección de las trisectrices adyacentes de los ángulos exteriores de un triángulo cualquiera, son los vértices de un triángulo equilátero.

Teorema de Morley para las trisectrices de los ángulos exteriores, es decir, el triángulo IJK es equilátero

Teorema de Morley para las trisectrices de los ángulos exteriores, es decir, el triángulo IJK es equiláteroLa historia del teorema de Morley

Como se comentaba al principio de esta entrada del Cuaderno de Cultura Científica, el teorema de Morley debe su normbre al matemático británico, afincado en Estados Unidos, Frank Morley (1860-1937).

Aunque de origen británico, Frank Morley, graduado en el King’s College de la Universidad de Cambridge en 1884, emigró a Estados Unidos en 1887, donde fue contratado en el Haverford College, en centro cuáquero de Pensilvania. Como se puede leer en el obituario de la American Mathematical Society, Frank Morley, In memoriam, en 1889 se casó con la británica Lilian Janet Bird y tuvieron tres hijos, el periodista y escritor Christopher Morley, autor de novelas como La librería ambulante, La librería encantada o Kathleen, que pueden leerse en las ediciones en castellano de la editorial Periférica, el periodista, ganador del Premio Pulitzer, Felix Morley, y el matemático Frank Vigor Morley, que publicaría con su padre el libro Inversive Geometry.

Tras su periodo en el Haverford College, en 1900 se trasladó a la Universidad Johns Hopkins, en Baltimore (Maryland), donde dirigió el departamento de matemáticas hasta que se jubiló en 1928, siendo además editor de su prestigiosa revista, American Journal of Mathematics, de 1900 a 1920. Fue miembro de la New York Mathematical Society (fundada en 1888) y su sucesora la American Mathematical Society, donde ocupó varios cargos, entre ellos su presidencia. Entre sus publicaciones destacan los libros A Treatise on the Theory of Functions (Macmillan, 1893) y Introduction to the Theory of Analytic Functions (Macmillan, 1898).

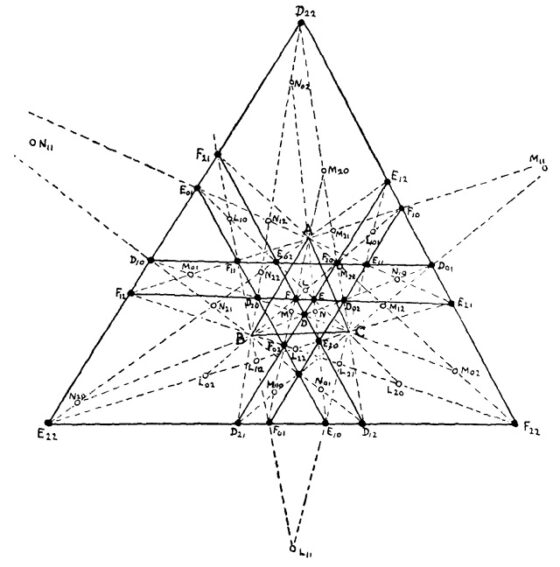

Retrato del matemático británico-estadounidense Frank Morley, realizado por el artista y fotógrafo Alfred Hugh Fisher (1867-1945)

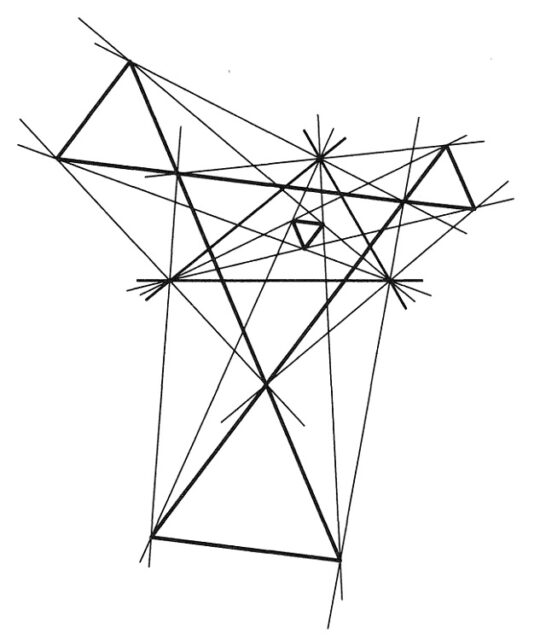

Retrato del matemático británico-estadounidense Frank Morley, realizado por el artista y fotógrafo Alfred Hugh Fisher (1867-1945)En 1900, Frank Morley publicó su excepcional artículo On the Metric Geometry of the Plane n-line, en el primer número de la revista Transactions of the American Mathematical Society, en el que desmuestra varios resultados sobre el comportamiento de las n-líneas en el plano. Aunque en este artículo, como era normal en esa época, no se estructuraba en la forma actual de teorema/demostración. Inmerso dentro del contenido de este brillante artículo estaba enuciado el conocido como “teorema de Morley” (los puntos de intersección de las trisectrices adyacentes de los ángulos de un triángulo cualquiera, son los vértices de un triángulo equilátero), más aún su teoría consideraba 18 casos de triángulos equiláteros “de Morley”. Uno de los casos cuando se consideran las trisectrices de los ángulos interiores (el primero de los casos analizados en esta entrada, el teorema de Morley en su versión simple y clásica), otro de los casos cuando se consideran las trisectrices de los ángulos exteriores (el otro triángulo equilátero de Morley, más grande, visto arriba) y los casos, no mencionados aún, de cuando se mezclan las trisectrices de dos angulos exteriores y uno interior (un ejemplo con los tres triángulos equiláteros exteriores que aparecen ahora se muestra en la siguiente imagen), siendo los demás casos más complejos.

Cinco, de los dieciocho, triángulos equiláteros de Morley, construidos mediante las trisectrices de los ángulos de un triángulo cualquiera. Imagen del libro The Penguin Dictionary of Curious and Interesting Geometry, de David Wells

Cinco, de los dieciocho, triángulos equiláteros de Morley, construidos mediante las trisectrices de los ángulos de un triángulo cualquiera. Imagen del libro The Penguin Dictionary of Curious and Interesting Geometry, de David WellsEl geómetra Frank Morley era completamente consciente de este resultado, el conocido como teorema de Morley, en su versión simple, y con los 18 triángulos equiláteros en su versión completa, que era parte de una teoría más global, sin embargo, no publicó el enunciado del teorema de forma explícita y separada, ni ofreció una demostración del mismo. Aunque sí lo menciónó en sus comunicaciones privadas, en particular, sus cartas a sus amigos, como las que escribió en 1904 al matemático británico Herbert William Richmond (1863-1948) y al físico y matemático británico Sir Edmund Taylor Whittaker (1873-1956).

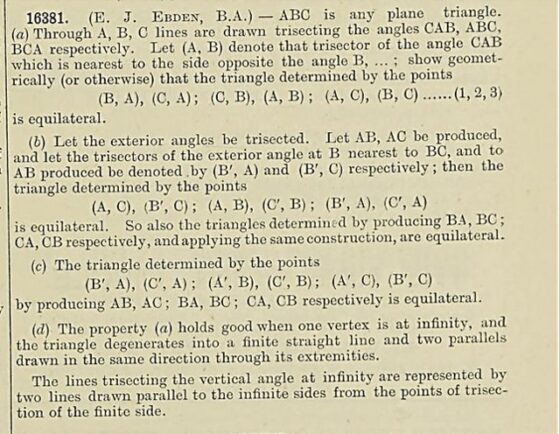

La primera vez que se publica el teorema de Morley es en forma de problema, presentado por E. J. Ebden, en la revista británica The Educational Times (revista que se publicó entre 1847 y 1923, cuando se convirtió en la revista Education Today), como el problema 16381 (que se muestra en la siguiente imagen), en 1908; así como, el mismo año, presentado por T. Delahaye y H. Lez, en la revista belga Mathesis (que se publicó entre los años 1881 y 1915), como problema 1655.

Problema 16381, presentado por E. J. Ebden, en The Educational Times (1908)

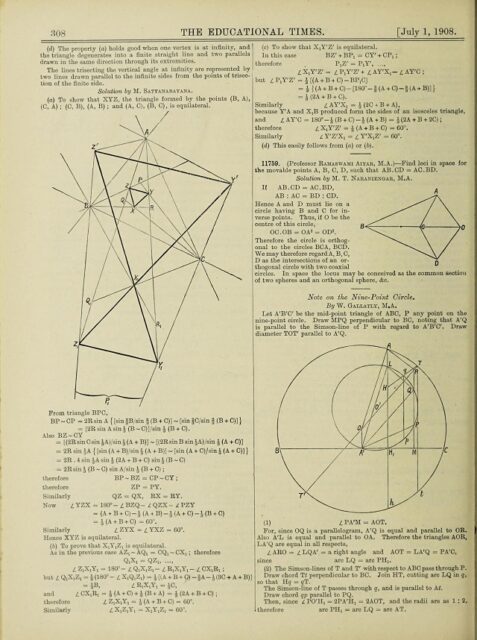

Problema 16381, presentado por E. J. Ebden, en The Educational Times (1908)La primera solución al problema 16381 de The Educational Times fue dada por M. Satyanarayana ese mismo año, en julio, mientras que el problema había sido publicado en febrero. En la siguiente imagen vemos la solución mencionada. Mientras que los mismos T. Delahaye y H. Lez, publicaron la solcuión al problema 1655 en la revista belga Mathesis.

Solución al problema 16381, en The Educational Times (1908) , dada por M. Satyanarayana

Solución al problema 16381, en The Educational Times (1908) , dada por M. SatyanarayanaLa siguiente demostración conocida es la del matemático indio Mandyam T. Naraniengar (1871-1940), que sería presidente de la Indian Mathematical Society (1930-1932), así como editor de la revista Journal of the Indian Mathematical Society (1909-1927), publicada en Mathematical Questions and Solutions, from The Educational Times, en 1909.

Por otra parte, la solución completa del teorema de Morley, considerando los casos de los 18 triángulos equilateros, fue publicada en 1913, en el artículo The six trisectors of each of the angles of a triangle, de la revista Proceedings of the Edinburgh Mathematical Society, por los matemáticos F. Glanville Taylor y W. L. Marr, que lo reconocían como un resultado de Frank Morley.

Esquema general del teorema de Morley, con los 18 triángulos equiláteros asociados, que aparece en el artículo de los matemáticos F. Glanville Taylor y W. L. Marr

Esquema general del teorema de Morley, con los 18 triángulos equiláteros asociados, que aparece en el artículo de los matemáticos F. Glanville Taylor y W. L. Marr

Desde entonces, se han publicado muchas demostraciones del teorema de Morley.

Una demostración del teorema de MorleyExisten muchas demostraciones diferentes del teorema de las trisectrices de Morley, también conocido como el teorema del milagro de Morley, pruebas geométricas, trigonométricas o algebraicas, algunas bastante técnicas, otras de ideas más sencillas y algunas de una gran belleza, como la demostración del matemático británico John H. Conway. En la página Cut the knot [https://www.cut-the-knot.org/], del matemático Alexander Bogomolny, podéis encontrar veintisiete pruebas diferentes, más otras tres que no son válidas.

Vamos a terminar esta entrada con una pequeña idea de la demostración clásica de Naraniengar del teorema de Morley. Recordemos que queremos demostrar que “los puntos de intersección de las trisectrices adyacentes de los ángulos de un triángulo cualquiera, son los vértices de un triángulo equilátero”.

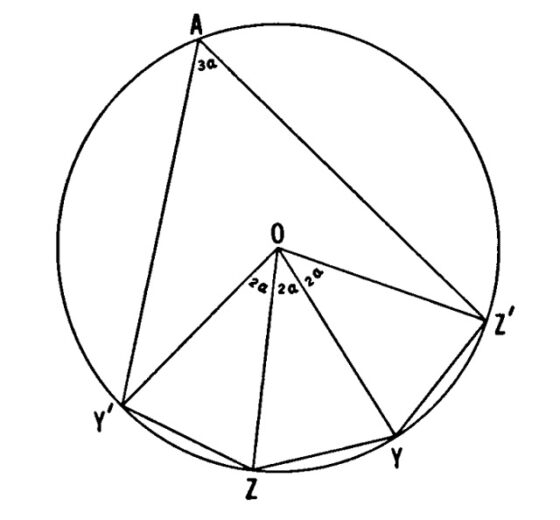

En primer lugar, Naraniengar demuestra el siguiente lema técnico.

Lema: Si cuatro puntos Y’, Z, Y, Z’ satisfacen las condiciones

i) Y’Z = ZY = YZ’

ii) ángulo(YZY’) = ángulo (Z’YZ) = 180º – 2 (alpha) > 60º,

entonces los cuatro puntos Y’, Z, Y, Z’ están en una misma circunferencia. Además, si un punto A, en el lado contrario al punto Y respecto a la recta Y’Z’, está colocado tal que ángulo(Y’AZ’) = 3 (alpha), entonces el quinto punto A también está en la misma circunferencia.

Ilustración del lema técnico de la demostración de Naraniengar

Ilustración del lema técnico de la demostración de Naraniengar

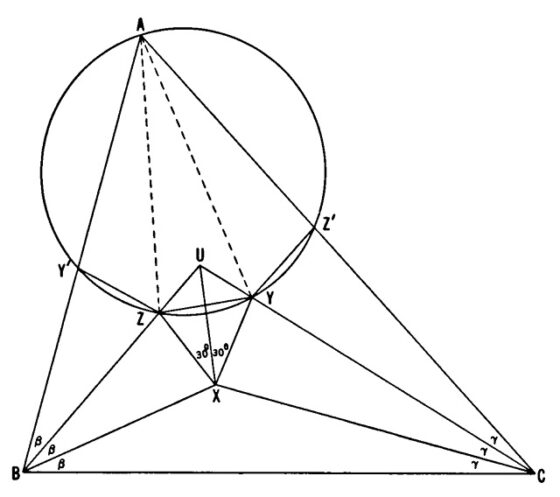

En segundo lugar, dado un triángulo cualquiera ABC, con ángulos internos iguales a 3 (beta), en B, y a 3 (gama), en C, como en la siguiente imagen, se consideran los dos pares de trisectrices de los ángulos en B y C, y sus intersecciones en los puntos U y X.

Si ahora tomamos el triángulo BCU, entonces los ángulos en B y C son bisecados por las rectas BX y CX, por lo tanto X es el incentro del triángulo BCU (recordemos que el incentro es el punto en el que se cortan las tres bisectrices de sus ángulos internos). En consecuencia, la recta UX biseca el ángulo en U.

Ahora se construyen los puntos Y y Z que están en los segmentos CU y BU, tales que los segmentos XY y XZ forman un ángulo de 30 grados con el segmento XU en lados opuestos, como en la imagen. Lo que nos lleva a que los triángulos UXY y UXZ son semejantes, los segmentos XY y XZ son iguales, y el ángulo en X es de 60 grados. Por lo tanto, el triángulo XYZ es un triángulo equilátero.

La última parte de la demostración de Naraniengar consiste en demostrar que Z e Y son precisamente las otras dos intersecciones de las trisectrices de A con las trisectrices de B y C adyacentes, de esta manera el triángulo central descrito por el teorema de Morley sería XYZ, que ya sabemos que es equilátero. Para ello se utilizará el lema técnico. Lo primero que hacemos es definir los puntos Y’ y Z’ de la siguiente forma. Sobre el segmento BA consideramos el punto Y’ tal que BY’ = BX, mientras que sobre el segmento CA consideramos el punto Z’ tal que CZ’ = CX. Entonces, por semejanza de triángulos, se observa fácilmente que

Y’Z = ZX = ZY = YX = YZ’.

Por otra parte, comparándo los ángulos alrededor de Z y alrededor de Y, se puede observar que los ángulos implicados ángulo(YZY’) y ángulo (Z’YZ) son iguales y de la forma 180º – 2 (alpha) > 60º.

Finalmente, aplicando el lema técnico. Entonces, como las cuerdas Y’Z, ZY y YZ’ son iguales, también lo son los tres ángulos que determinan en A, luego las líneas AZ y AY son trisectrices del ángulo en A. De esta forma, se concluye que los puntos X, Y, Z son las intersecciones de las trisectrices adyacentes de los ángulos del triángulo ABC que forman un triángulo, como ya se ha probado al principio, equilátero. Y queda demostrado el teorema de Morley.

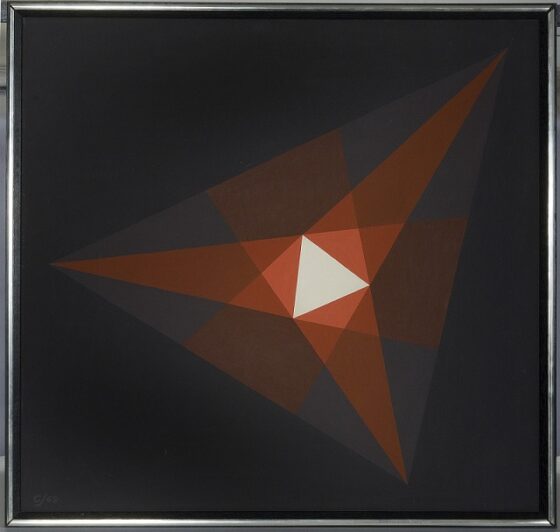

Morley Triangle (1969), del dibujante e ilustrador infantil estadounidense Crockett Johnson. Imagen de la página web de The National Museum of American History.

Morley Triangle (1969), del dibujante e ilustrador infantil estadounidense Crockett Johnson. Imagen de la página web de The National Museum of American History.En una próxima entrada disfrutaremos de la hermosa demostración del teorema de Morley propuesta por el matemático británico John H. Conway.

Bibliografía

1.- David Wells, The Penguin Dictionary of Curious and Interesting Geometry, Penguin, 1991.

2.- Martin Gardner, Nuevos pasatiempos matemáticos, Alianza editorial, 2018.

3.- H. S. M. Coxeter and S. L. Greitzer, Geometry Revisited, Mathematical Association of America, 1967.

4.- C. O. Oakley, J. C. Baker, The Morley Trisector Theorem, American Mathematical Monthly 85, pp. 737-745, 1978.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo El teorema de Morley se ha escrito en Cuaderno de Cultura Científica.

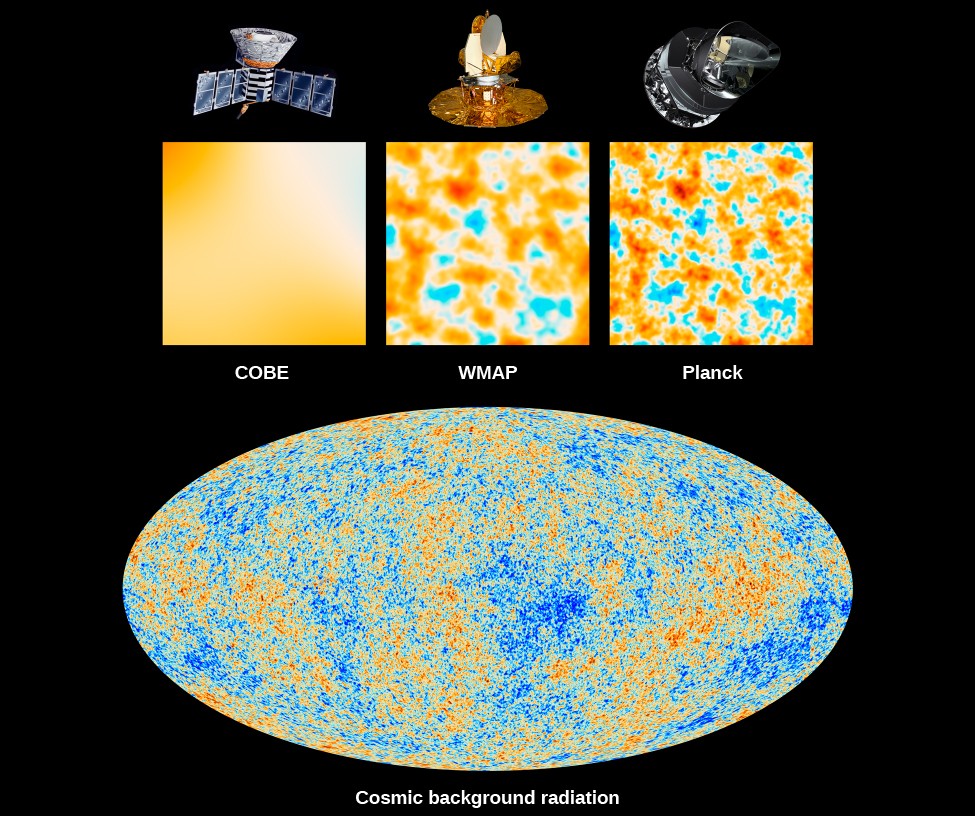

Un solo campo explica la inflación observada

Arriba: Ilustración de los satélites CBE, WMAP y Planck, con una imagen muestra resolución de cada experimento. Abajo: mapa de la radiación del Fondo de Microondas obtenida con Planck. Fuente: Astronomy/OpenStax CNX.

Arriba: Ilustración de los satélites CBE, WMAP y Planck, con una imagen muestra resolución de cada experimento. Abajo: mapa de la radiación del Fondo de Microondas obtenida con Planck. Fuente: Astronomy/OpenStax CNX.La inflación cósmica, la teórica expansión exponencial del espacio en el Universo temprano, ofrece soluciones a importantes enigmas cosmológicos. Explica por qué el Universo parece perfectamente plano: la expansión estira cualquier curvatura hasta el punto de ser imperceptible. También explica cómo las fluctuaciones del vacío cuántico podrían convertirse en semillas de la estructura del Universo.

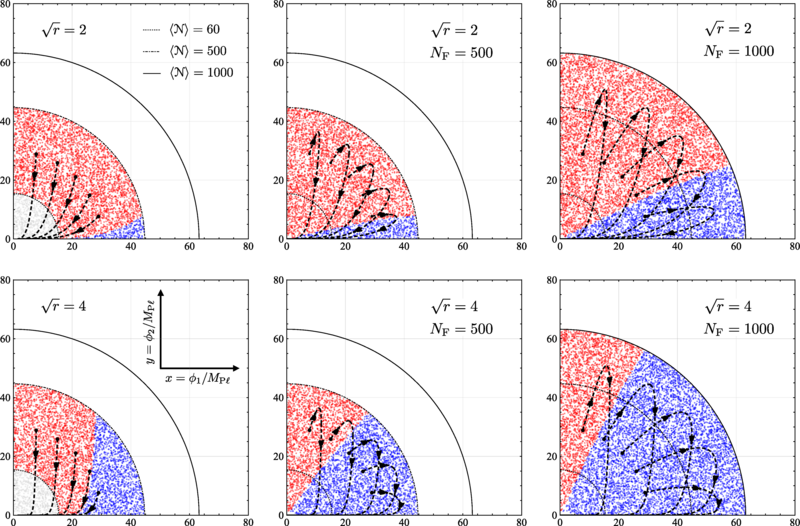

La mayoría de los modelos de física más allá del modelo estándar implican muchos campos cuánticos nuevos, lo que sugiere que la inflación podría haber sido impulsada por múltiples campos. Sin embargo, las observaciones de la radiación del fondo de microondas cósmico favorecen la existencia de un solo campo “inflatón”. Entonces, ¿son los modelos multicampo incompatibles con las observaciones?

Ahora, Koki Tokeshi, de la Universidad de Tokio (Japón), y Vincent Vennin, de la Universidad de la Sorbona (Francia), proponen una explicación para la aparición de un único campo que domina la inflación. Los investigadores consideran un modelo de inflación que involucra dos campos inflatón cuyas fluctuaciones cuánticas hacen que su dinámica sea estocástica. En cualquier porción microscópica del espacio los campos evolucionan estocásticamente hasta que termina la inflación.

Utilizando una prueba existente, el dúo calcula que, en esa zona, esta evolución puede hacer que el campo más ligero (el asociado a un “parámetro de masa” más pequeño) domine sobre el otro. Por lo tanto, la inflación en esa zona podría aproximarse bien mediante una teoría con un solo campo.

Pero, ¿qué tan comunes son las zonas del Universo susceptibles de una evolución como esta? Tokeshi y Vennin muestran que las zonas con condiciones iniciales adecuadas corresponden a regiones espacio-temporales que sufren más inflación y, por tanto, acaban teniendo mayores volúmenes.

Como resultado, la inflación con dos campos puede parecer inflación de un solo campo porque estas regiones terminan constituyendo la mayor parte del volumen del Universo. Los investigadores dicen que esperan que se obtengan resultados similares en el caso de más de dos campos.

Referencias:

K. Tokeshi and V. Vennin (2024) Why does inflation look single field to us? Phys. Rev. Lett. doi: 10.1103/PhysRevLett.132.251001

C. M. Peterson and M. Tegmark, (2011) Testing two-field inflation Phys. Rev. D doi: 10.1103/PhysRevD.83.023522

R. Garisto (2024) One Field to Rule Them All Physics 17, s78

El artículo Un solo campo explica la inflación observada se ha escrito en Cuaderno de Cultura Científica.

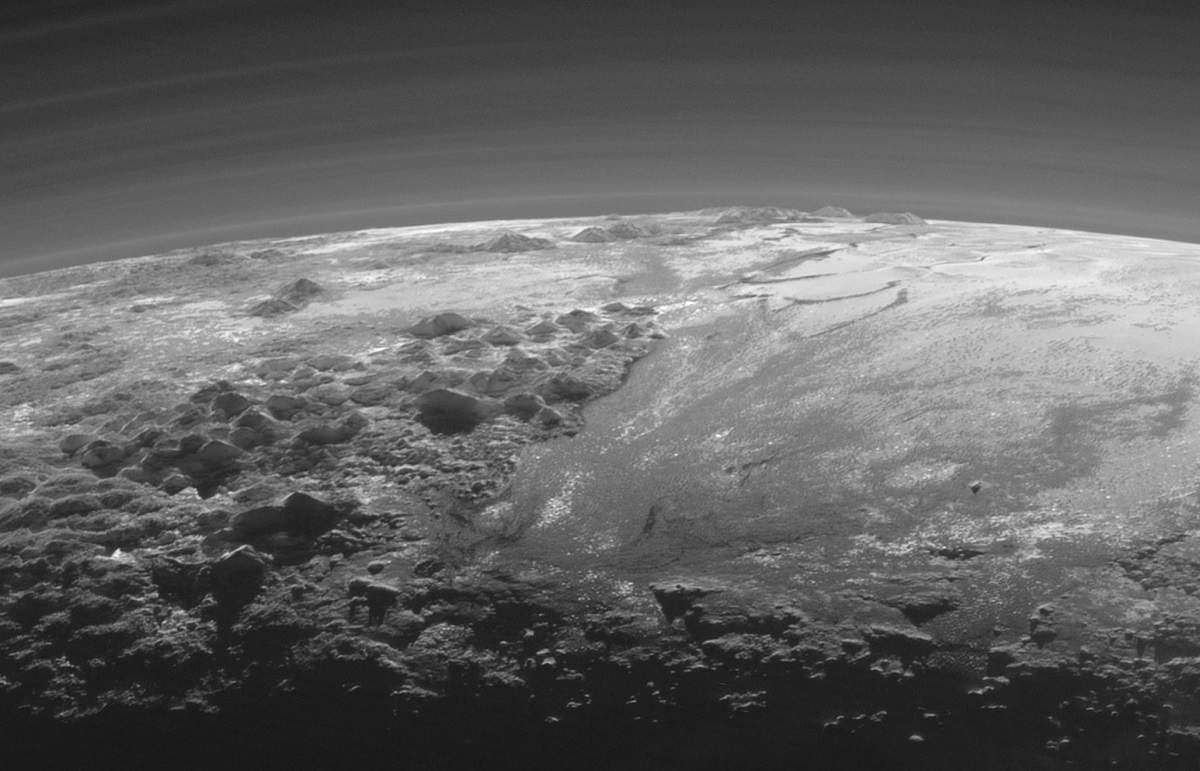

¿Cuánta sal tiene el océano de Plutón?

Ochenta y cinco años pasaron entre el descubrimiento de Plutón -allá por 1930- y la primera visita por parte de una sonda espacial en julio de 2015, cuando la sonda New Horizons nos permitió ver de cerca por primera vez la superficie del hoy planeta enano y que, a priori, debido a su pequeño tamaño y la aparente ausencia de fuentes de energía que pudiese ayudarle a mantener cierto grado de actividad, pensábamos que podría tratarse de un cuerpo frío y anodino.

Nada más lejos de la realidad: lo que pudimos ver fue un mundo complejo y activo con llanuras y glaciares de nitrógeno, montañas de hielo de agua y una tenue atmósfera. Precisamente en la mayor de sus llanuras, Sputnik Planitia, los científicos encontraron una serie de patrones poligonales que parecían indicar un mecanismo convectivo dentro del hielo que lo obligara a fluir, pero no solo eso, sino que la presencia de la propia llanura podría apuntar a la existencia de un océano de agua líquida bajo la superficie.

Imagen de Plutón. Obsérvese la gran diversidad presente en su superficie, con lugares llanos, montañosos y zonas totalmente desnudas de cráteres. Fuente: NASA/Johns Hopkins University Applied Physics Laboratory/Southwest Research Institute.

Imagen de Plutón. Obsérvese la gran diversidad presente en su superficie, con lugares llanos, montañosos y zonas totalmente desnudas de cráteres. Fuente: NASA/Johns Hopkins University Applied Physics Laboratory/Southwest Research Institute.¿Cómo es posible que a esa distancia del Sol y un cuerpo tan pequeño como Plutón haya sido capaz de mantener un océano subterráneo? En primer lugar, en su núcleo rocoso todavía podrían existir elementos radioactivos que durante su desintegración fuesen capaces de generar un calor que mantenga una temperatura adecuada para que el agua pueda mantenerse en estado líquido.

Por otro, la presencia de sales dentro del propio océano serviría como un anticongelante, bajando todavía más la temperatura necesaria para congelar el agua, de un modo similar a cuando, en invierno, usamos la sal para ayudar a eliminar el hielo de nuestras carreteras.

Pero hay un detalle más: Sputnik Plantia podría ser una de las grandes cuencas de impacto de nuestro Sistema Solar, como la de Hellas en Marte o la de Caloris en Mercurio y su posición y características se pueden explicar mejor si existe un océano por debajo de esta, como explican Nimmo et al. (2016), ya que la anomalía gravitatoria positiva que se ha detectado en esta zona estaría provocada por el ascenso de aguas frías y densas del océano hacia la superficie.

En esta imagen oblicua de la superficie de Plutón podemos ver perfectamente las montañas formadas principalmente por bloques de hielo de agua y Sputnik Planitia, extendiéndose más allá del horizonte. Fuente: NASA/Johns Hopkins University Applied Physics Laboratory/Southwest Research Institute.

En esta imagen oblicua de la superficie de Plutón podemos ver perfectamente las montañas formadas principalmente por bloques de hielo de agua y Sputnik Planitia, extendiéndose más allá del horizonte. Fuente: NASA/Johns Hopkins University Applied Physics Laboratory/Southwest Research Institute.Si, además, le sumamos el efecto del depósito de nitrógeno sobre la llanura, provocado por la congelación de este gas desde la atmósfera cuando las temperaturas son muy bajas, la anomalía gravitatoria también se puede comprender mejor. La anomalía gravitatoria detectada tampoco se podría explicar solo con el depósito de nitrógeno, ya que se necesitaría una capa de más de 40 kilómetros de espesor para explicar las observaciones.

Uno de los requisitos de los que hablábamos para mantener el agua líquida es que el océano sea salado, pero, ¿cuánta sal necesita para mantenerlo en este estado? Un nuevo estudio publicado por McGovern et al. (2024) ha analizado la respuesta del océano ante la carga que le supone la corteza superior (recordemos, de hielo) y cuál sería la deformación que debemos esperar en la superficie ante el peso del hielo de nitrógeno.

Obviamente no hay una respuesta única a esta pregunta, ya que el resultado es diferente según el espesor de la propia corteza de hielo, la profundidad de Sputnik Planitia y, en último lugar, por la densidad del océano subterráneo. Por ello, los científicos han tenido que crear una serie de escenarios diferentes variando los parámetros. Por ejemplo, para la salinidad han escogido valores en los que la densidad del agua varía entre los 1000 y los 1400 kg/m3. O lo que es lo mismo, de agua pura a agua muy salina.

Uno de los hallazgos más interesantes de estos modelos es que si se incrementa la salinidad del océano, algo que haría las aguas más densas, las estructuras geológicas que se observan en la superficie no se ajustarían tan bien a los modelos, pero si la densidad de agua del océano está por debajo 1100 kg/m3. Este detalle implica una salinidad muy modesta, hay un mejor ajuste entre el modelo y la deformación observada en la superficie.

La atmósfera de Plutón destaca en esta imagen por crear un “brillo” provocado por la dispersión de la luz del Sol y que rodea el planeta. fuente: NASA/Johns Hopkins University Applied Physics Laboratory/Southwest Research Institute.

La atmósfera de Plutón destaca en esta imagen por crear un “brillo” provocado por la dispersión de la luz del Sol y que rodea el planeta. fuente: NASA/Johns Hopkins University Applied Physics Laboratory/Southwest Research Institute.Un océano menos salino sería más estable a lo largo del tiempo y provocaría una menor deformación en la corteza de hielo, al mismo tiempo generando menos deformación en la superficie, algo que explica por qué la superficie de Sputnik Planitia es tan suave a nivel topográfico.

Por otro lado, una salinidad moderada tiene muchas implicaciones astrobiológicas ya que, si se confirma este dato, el océano de Plutón sería un lugar mucho más hospitalario para la vida que si fuese extremadamente salado por lo que este estudio deja de manifiesto que, al menos en este aspecto, el océano de Plutón podría ser un ambiente potencialmente habitable.

Probablemente tardaremos todavía muchas décadas en volver a ver una misión que surque los cielos de Plutón y nos pueda decir si estos modelos están en lo cierto pero, sea cual sea la respuesta, estoy seguro que este planeta enano no dejará de sorprendernos.

Referencias:

Nimmo, F., D. P. Hamilton, W. B. McKinnon, P. M. Schenk, R. P. Binzel, C. J. Bierson, R. A. Beyer, et al. (2016) Reorientation of Sputnik Planitia Implies a Subsurface Ocean on Pluto Nature 540, no. 7631 (2016): 94–96. doi: 10.1038/nature20148.

Kimura, Jun, and Shunichi Kamata (2020) Stability of the Subsurface Ocean of Pluto Planetary and Space Science doi: 10.1016/j.pss.2019.104828

McGovern, P. J., and A. L. Nguyen (2024) The Role of Pluto’s Ocean’s Salinity in Supporting Nitrogen Ice Loads within the Sputnik Planitia Basin Icarus doi: 10.1016/j.icarus.2024.115968.

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario, divulgador científico y autor de la sección Planeta B.

El artículo ¿Cuánta sal tiene el océano de Plutón? se ha escrito en Cuaderno de Cultura Científica.

El queso, entre los genes y la cultura

Todos los mamíferos nos alimentamos de leche al nacer. La leche es un alimento complejo y muy nutritivo, que contiene proteínas, grasas, hidratos de carbono, vitaminas A y B, y minerales como calcio y fósforo: casi todo lo que necesitamos para vivir. Los primeros indicios de consumo de leche animal por parte de la humanidad se remontan al primer Neolítico. Por ejemplo, en yacimientos arqueológicos de hace casi 9.000 años, cerca del mar de Mármara en la actual Turquía, se encontraron grasas lácteas en antiguos fragmentos de cerámica [1].

La capacidad humana para digerir la leche de otros animales se desarrolló recientemente, y con probabilidad según los estudios genéticos, en los últimos 10.000 años. Un puñado de mutaciones permitió a buena parte de las personas adultas persistir la producción de la enzima lactasa, capaz de descomponer el azúcar de la leche, la lactosa. No toda la población mundial tiene extendidas las mismas mutaciones respecto a la persistencia de la lactasa.

La transformación de la leche -y muy en particular la producción de queso- constituyó un acontecimiento cultural fundamental para la historia de la humanidad. Ello no sólo permitía conservar los productos lácteos de manera no perecedera, sino que también hacía de la leche un alimento mucho más digerible y aprovechable para las primeras poblaciones agricultoras-ganaderas del Neolítico, con o sin beneficiosas mutaciones genéticas [2]. Es muy llamativo que esto es un ejemplo de coevolución genética-cultural a escalas temporales diferentes, pero beneficiosas simultáneamente para la supervivencia humana y su desarrollo. La fabricación del queso no es, por tanto, una actividad humana menor, sino de primera importancia.

Queso tipo Idiazábal confeccionado por el autor. Foto: Victor Etxebarria

Queso tipo Idiazábal confeccionado por el autor. Foto: Victor EtxebarriaHoy día la industria láctea produce múltiples tipos de leche que podemos ver en las estanterías de los supermercados. No todas las leches son leches, ya que se someten a procesos industriales más o menos beneficiosos para obtener bebidas lácteas. Hace unas décadas el único proceso que se efectuaba era la pasteurización de la leche, o el hervido en casa de la leche cruda adquirida directamente a las granjas o ganaderías. Esto es importante para consumir leche con seguridad, ya que es la forma más sencilla y eficaz de matar posibles microorganismos patógenos que se pueden desarrollar en la leche.

La fabricación de gran cantidad de queso en la industria láctea requiere recoger leche de distintas ganaderías y tienen que pasteurizarla porque no pueden garantizar su higiene y calidad global. De esta manera, el queso que se produce en la industria no es de calidad superior.

Las granjas dedicadas al pastoreo elaboran quesos con leche cruda, ordeñando su propio rebaño para producir algunos de los mejores quesos del mundo. La proximidad de las casas rurales a la propia fuente les permite controlar la calidad de la leche y la producción del queso. A diferencia de otros productores, no mezclan la leche de una vaca enferma tratada con antibióticos con la leche utilizada para hacer queso, mantienen escrupulosa limpieza, la salud individual de los miembros de su cabaña, así como la cadena de frío de la leche.

La leche cruda no es peligrosa para la fabricación de queso, si se mantiene su higiene y frescura. El queso elaborado con leche cruda es muy superior a la versión pasteurizada por la complejidad de su composición inicial y las características, texturas y sabores que puede proporcionar. En cualquier caso, el ganado sano y la leche fresca, limpia y de calidad (pasteurizada o no pasteurizada) es el factor más importante de todos en el proceso de elaboración del queso. Este proceso consiste a grandes rasgos en fermentar, cuajar, salar y curar, lo cual elimina las posibles bacterias patógenas. Además, y de forma inversa, la idea de que la leche pasteurizada ya no puede contaminarse no es cierta [3].

La fabricación de queso implica en primer lugar la fermentación por medio de bacterias presentes en la leche cruda, que transforman la lactosa en ácido láctico. Esta acidificación de la leche facilita su conversión en queso por medio de enzimas proteasas que actúan sobre las proteínas de la leche y precipitan en una cuajada de proteínas y grasa. La fermentación bacteriana continúa consumiendo la lactosa hasta que la eliminación del suero sobrante y el salado de los cuajos detienen la acidificación. Este queso puede colocarse en un molde y curarlo durante unos meses, desarrollando su textura, aromas y sabores, principalmente mediante las enzimas de la leche cruda que catalizan la ruptura de las moléculas grasas (lipolisis) y proteicas (proteólisis), liberando ácidos grasos de cadena corta y aminoácidos libres. Estos componentes volátiles generan el olor del queso, sus sabores y transforman su estructura molecular.

Este proceso resulta en un nutritivo manjar. La ley alimentaria en la mayor parte de los países permite la venta de quesos fabricados a partir de leche cruda, si se han curado durante al menos 60 días, proceso que elimina posibles patógenos. La pasteurización de la leche para quesería calienta la leche al menos a 72ºC durante 30 segundos. Esto mata la mayor parte de las bacterias (patógenas o no) e inutiliza todas sus enzimas. El queso puede fabricarse, pero la materia prima no es óptima. La ordinaria pasteurización UHT (150ºC durante 2 segundos) permite conservar los principales nutrientes de la leche muchos meses en un envase tipo tetrabrik, pero hace inviable fabricar queso.

Existen muchos tipos de quesos en el mundo. Solamente en Francia al parecer existen unas 1000 variedades. La mayor parte de los quesos pueden alimentar a todo tipo de personas, incluidas las intolerantes a la lactosa. En cierto sentido, el queso es un alimento pre-digerido por los fermentos y por el curado. La reducción drástica de la lactosa y el segmentado de las moléculas grasas y proteicas, lo hacen muy fácil de asimilar, muy nutritivo y exquisito. Si a usted no le gusta mucho el queso, es muy probable que no ha buscado bien, porque los sabores, aromas, texturas y sutilezas que existen son casi infinitas. Algunas joyas son quesos artesanos producidos por pequeñas explotaciones ganaderas en todo el mundo. Como casi siempre, es mejor apostar por la calidad que por la cantidad, y la ciencia y la tecnología del queso forma parte de la cultura universal.

Referencias

[1] Evershed, R., Payne, S., Sherratt, A. et al. (2008) Earliest date for milk use in the Near East and southeastern Europe linked to cattle herding. Nature 455, pp 528–531 https://doi.org/10.1038/nature07180

[2] Salque, M., Bogucki, P., Pyzel, J. et al. (2013) Earliest evidence for cheese making in the sixth millennium BC in northern Europe. Nature 493, pp 522–525. https://doi.org/10.1038/nature11698

[3] Montel, M.C., Buchin, S., Mallet, A., Delbes-Paus, C., Vuitton, D.A., Nathalie Desmasures, N. and Berthier, F. (2014) Traditional cheeses: Rich and diverse microbiota with associated benefits. International Journal of Food Microbiology vol. 177, pp.: 136–154. https://doi.org/10.1016/j.ijfoodmicro.2014.02.019

Sobre el autor: Victor Etxebarria Ecenarro es Catedrático de Ingeniería de Sistemas y Automática en la Universidad del País Vasco (UPV/EHU)

El artículo El queso, entre los genes y la cultura se ha escrito en Cuaderno de Cultura Científica.

La inversión de las élites en la prehistoria

Los cambios del cerebro durante el embarazo y la maternidad, cómo el estrés ha pasado de ser un mecanismo de supervivencia a un eventual elemento de riesgo para nuestra salud o cuál ha sido el papel que ha jugado el suicidio en la evolución del ser humano fueron algunos de los temas que se tratarán en la VI Jornada Nacional sobre Evolución y Neurociencias.

La jornada tuvo lugar el Bizkaia Aretoa de la UPV/EHU los pasados 25 y 26 de abril y estuvo dirigida por Eva Garnica y Pablo Malo, de la Red de Salud Mental de Bizkaia, institución que organizó la jornada junto a la Cátedra de Cultura Científica de la UPV/EHU.

El encuentro, cuya primera edición se celebró en 2017, se ha convertido en una cita imprescindible para las y los expertos en ámbitos como la psiquiatría, la psicología o la biología. Una jornada que sirve para analizar el comportamiento humano desde un punto de vista evolutivo y divulgar de un modo accesible para todos los públicos.

El aburrimiento ha acompañado al ser humano desde que es ser humano. En La inversión de las élites en la prehistoria Josefa Ros Velasco nos cuenta el papel del aburrimiento en la prehistoria de la mano de las tesis de Hans Blumenberg de que se trataría de una presión selectiva.

Josefa Ros Velasco es investigadora especializada en el aburrimiento. Se doctoró en filosofía por la Universidad Complutense de Madrid y ha sido investigadora postdoctoral en distintas instituciones, entre ellas la Universidad de Harvard. Ha editado de varios libros especializados sobre el aburrimiento y el suicidio, y es la autora de «La enfermedad del aburrimiento» (Alianza Editorial).

Si no ve correctamente el vídeo, use este enlace.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo La inversión de las élites en la prehistoria se ha escrito en Cuaderno de Cultura Científica.

El origen de la Gran Mancha Roja

Investigadores de la Universidad del País Vasco, de la Universitat Politècnica de Catalunya – BarcelonaTech (UPC) y del Barcelona Supercomputing Center– Centro Nacional de Supercomputación (CNS-BSC) ha analizado las observaciones históricas de la Gran Mancha Roja de Júpiter desde el siglo XVII y ha desarrollado a partir de ellas modelos numéricos para explicar la longevidad y naturaleza de este impresionante fenómeno meteorológico en la atmósfera del planeta gigante gaseoso.

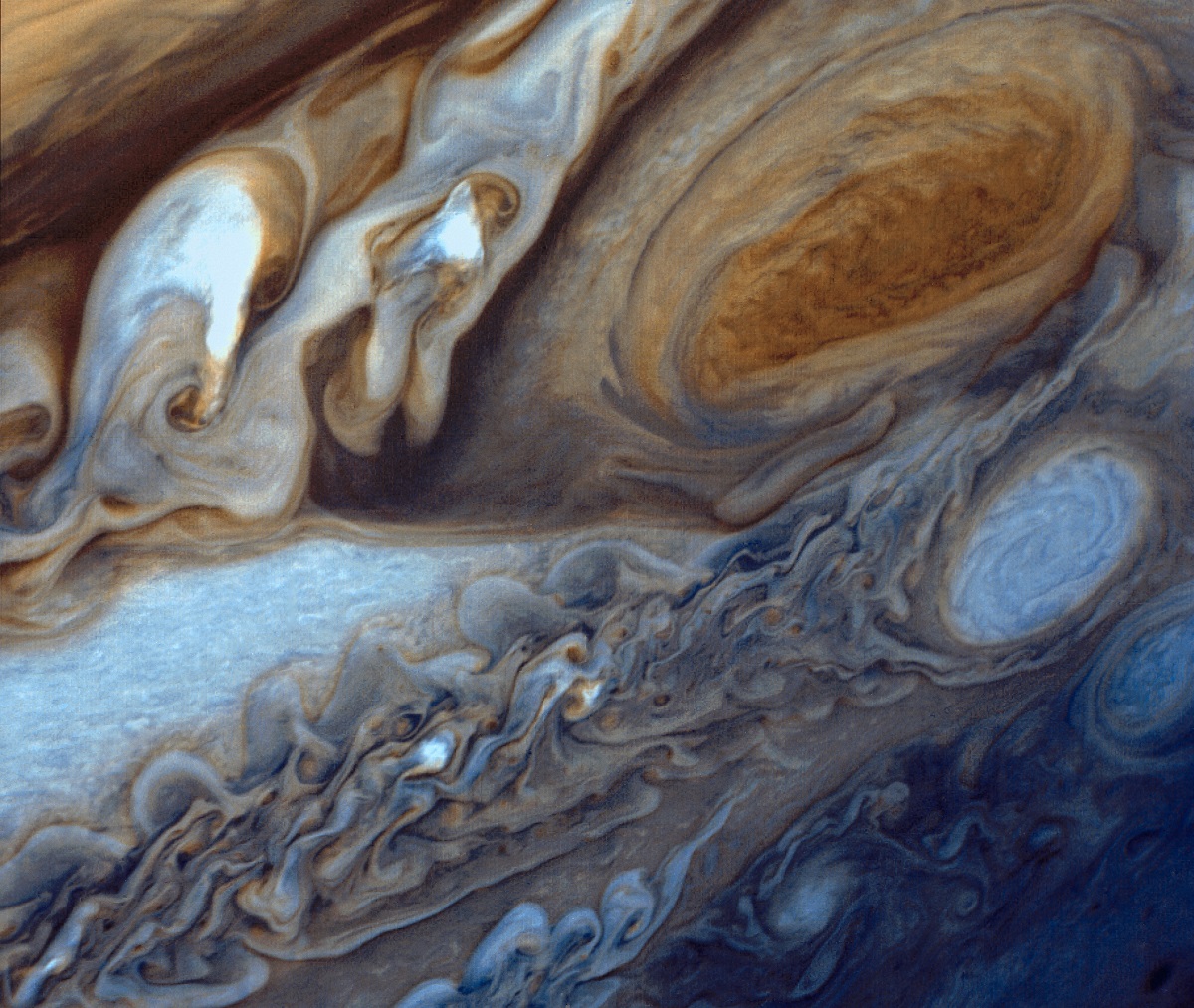

Imagen obtenida por la Voyager 1 de la Gran Mancha Roja de Júpiter en 1979. Fuente: NASA / Caltech/JPL

Imagen obtenida por la Voyager 1 de la Gran Mancha Roja de Júpiter en 1979. Fuente: NASA / Caltech/JPLLa Gran Mancha Roja de Júpiter (conocida como GRS por sus siglas en inglés, Great Red Spot), es probablemente la estructura atmosférica más conocida, un icono popular entre los objetos del Sistema Solar. Su gran tamaño (actualmente tiene el diámetro de la Tierra) y el contraste de su color rojizo frente a las nubes pálidas del planeta, hace que sea un objeto fácilmente visible incluso con pequeños telescopios. La Mancha Roja de Júpiter es un enorme remolino anticiclónico por cuya periferia los vientos circulan a 450 km/h. Es el vórtice más grande y longevo de todos los existentes en las atmósferas de los planetas del Sistema Solar, pero su edad es objeto de debate y el mecanismo que dio origen a su formación, permanece oculto.

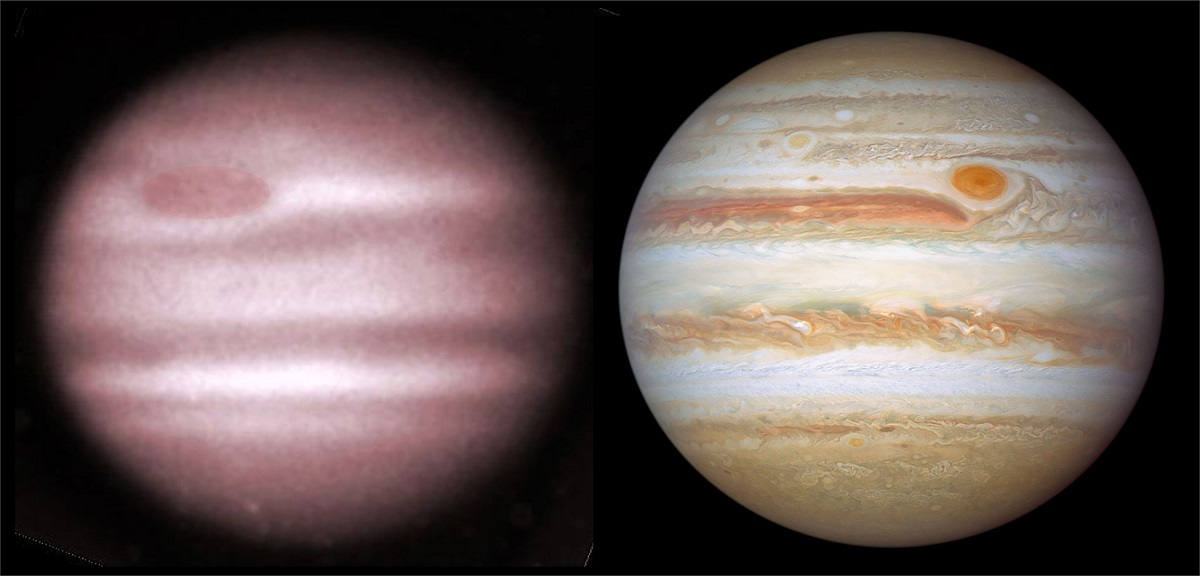

Cambios en la Gran Mancha Roja de Júpiter en los últimos 134 años. Izquierda: Imagen obtenida el 14 de octubre de 1890 por el Observatorio Lick (EE.UU.). Fuente: BDIP-Observatoire de Paris. Derecha: Imagen obtenida por el Telescopio Espacial Hubble el 5 de enero de 2024. Fuente: HST / NASA / ESA /OPAL Program

Cambios en la Gran Mancha Roja de Júpiter en los últimos 134 años. Izquierda: Imagen obtenida el 14 de octubre de 1890 por el Observatorio Lick (EE.UU.). Fuente: BDIP-Observatoire de Paris. Derecha: Imagen obtenida por el Telescopio Espacial Hubble el 5 de enero de 2024. Fuente: HST / NASA / ESA /OPAL ProgramLas elucubraciones sobre el origen de la GRS se remontan a las primeras observaciones telescópicas del astrónomo Giovanni Domenico Cassini, quien en 1665 descubrió un óvalo oscuro en la misma latitud que la GRS y lo bautizó como “Mancha Permanente” (PS de sus siglas en inglés), ya que fue observada por él y por otros astrónomos hasta 1713. Posteriormente se perdió su rastro durante 118 años y no es hasta 1831 y en años posteriores cuando S. Schwabe observa de nuevo una estructura clara, de forma aproximadamente ovalada y en la misma latitud que la GRS, que puede considerarse como la primera observación de la GRS actual, quizás de una GRS naciente. Desde entonces, la GRS se ha venido observando regularmente con telescopios y por las diferentes misiones espaciales que han visitado el planeta, hasta nuestros días.

En el estudio llevado a cabo los autores han analizado, por una parte, la evolución del tamaño a lo largo del tiempo, su estructura y los movimientos de ambas formaciones meteorológicas, la antigua PS y la GRS; para ello han acudido a fuentes históricas que se remontan a mediados del siglo XVII, poco después de la invención del telescopio. “De las medidas de tamaños y movimientos deducimos que es altamente improbable que la actual GRS fuese la PS observada por G. D. Cassini. Probablemente la PS desapareció en algún momento entre mediados de los siglos XVIII y XIX, en cuyo caso podemos decir que la Mancha Roja tiene al menos, por ahora, una longevidad de más de 190 años” explica Agustín Sánchez Lavega, catedrático de física de la UPV/EHU que ha liderado esta investigación. La Mancha Roja, que en 1879 tenía un tamaño de 39.000 km en su eje más largo ha ido contrayéndose a la vez que se ha redondeado, hasta alcanzar actualmente unos 14.000 km.

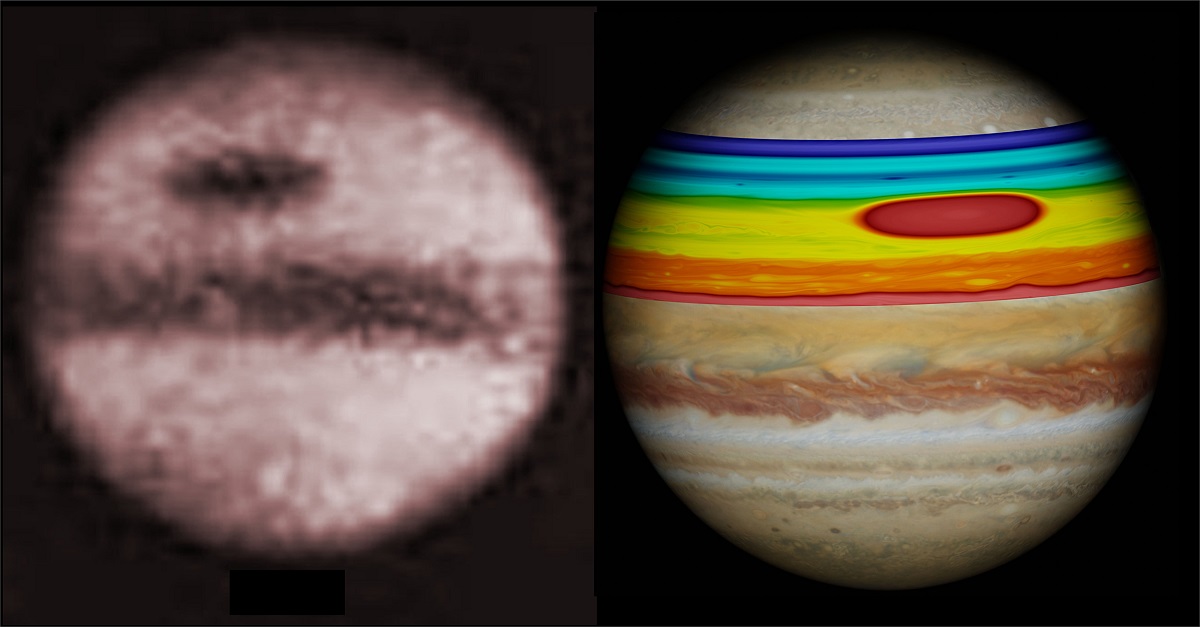

Por otra parte, desde la década de los años 70, diferentes misiones espaciales han estudiado de cerca este fenómeno meteorológico. Recientemente, “diferentes instrumentos a bordo de la misión Juno en órbita alrededor de Júpiter han mostrado que la GRS es poco profunda y delgada cuando se compara con su tamaño horizontal, pues verticalmente se extiende unos 500 km”, explica Sánchez Lavega.

Izquierda: Primera fotografía de la Gran Mancha Roja obtenida por A.A. Common desde Ealing (Reino Unido) el 3 de septiembre de 1879. Derecha: Superposición de una simulación numérica de la mancha de aquel año sobre una imagen reciente obtenida por el Telescopio Espacial Hubble. Fuente: UPV/EHU – UPC.

Izquierda: Primera fotografía de la Gran Mancha Roja obtenida por A.A. Common desde Ealing (Reino Unido) el 3 de septiembre de 1879. Derecha: Superposición de una simulación numérica de la mancha de aquel año sobre una imagen reciente obtenida por el Telescopio Espacial Hubble. Fuente: UPV/EHU – UPC.Con el fin de averiguar cómo pudo formarse este inmenso torbellino, los equipos de la UPV/EHU y de la UPC han realizado simulaciones numéricas en superordenadores españoles como el MareNostrum IV del BSC, integrado en la Red Española de Supercomputación (RES), mediante dos tipos de modelos complementarios del comportamiento de vórtices delgados en la atmósfera de Júpiter. En el planeta gigante, dominan intensas corrientes de vientos que fluyen a lo largo de los paralelos alternando en su dirección con la latitud. Al norte de la GRS, los vientos soplan hacia el Oeste con velocidades de 180 km/hr mientras que por el sur, lo hacen en sentido contrario, hacia el Este, con velocidades de 150 km/hr. Esto genera una enorme cizalla de norte a sur en la velocidad del viento, que es un ingrediente básico para que crezca el vórtice en su seno.

En la investigación han explorado diferentes mecanismos para explicar la génesis de la GRS, entre ellos la erupción de una gigantesca supertormenta, semejante a las que muy rara vez se observan en el planeta gemelo Saturno, o bien la fusión de múltiples vórtices más pequeños engendrados por la cizalla del viento. Los resultados indican que, si bien en ambos casos se forma un anticiclón, este difiere en su forma y propiedades dinámicas de los de la actual GRS. “Además pensamos que de haberse producido uno de tales inusuales fenómenos, seguramente él o sus consecuencias en la atmósfera, hubieran sido observadas y reportadas por los astrónomos de la época”, señala Sánchez Lavega.

En un tercer grupo de experimentos numéricos, el equipo de investigación ha explorado la generación de la GRS a partir de una conocida inestabilidad en los vientos que, en opinión de los investigadores, es capaz de engendrar una célula alargada que los encierra y atrapa. Dicha célula sería una proto-GRS, una Mancha Roja naciente, cuyo posterior encogimiento daría lugar a la GRS compacta y rápidamente rotante que se observa a finales del siglo XIX. La formación de grandes células alargadas ya se ha observado en la génesis de otros vórtices importantes en Júpiter. “En nuestras simulaciones, gracias al uso de superordenadores, hemos encontrado que las células alargadas son estables cuando rotan por su periferia con la velocidad de los vientos de Júpiter, tal y como se esperaría cuando se forman por dicha inestabilidad” declara Enrique García-Melendo, investigador del Departamento de Física de la UPC. Utilizando dos tipos diferentes de modelos numéricos, uno en la UPV/EHU y el otro en la UPC, los investigadores concluyen que si la velocidad de rotación de la proto-GRS es menor que la de los vientos circundantes, esta se fragmenta, haciendo imposible la formación de un vórtice estable. Y, si es muy alta, sus propiedades difieren de las de la actual GRS.