La probabilidad en mecánica cuántica

Foto: skeeze / Pixabay

Foto: skeeze / PixabayLa dualidad onda-corpúsculo es un aspecto fundamental de la mecánica cuántica. Una de las consecuencias de este hecho es que el concepto de probabilidad se establece en la base misma del modelo.

Debemos entender bien qué significa probabilidad. Hay situaciones en la que un acontecimiento concreto no se puede predecir con certeza. Pero sí podemos predecir para estas mismas situaciones las probabilidades estadísticas de muchos acontecimientos similares. Por ejemplo, en un fin de semana largo se pueden producir en España 15 millones de desplazamientos en automóvil. Yo voy a realizar dos de esos desplazamientos, uno de ida y otro de vuelta. ¿Moriré en la carretera? No lo sé, no lo puedo saber. Pero Tráfico sabe que se va a producir del orden de 1 muerte por cada millón y medio de desplazamientos, por lo que cabe esperar que ese fin de semana se produzcan del orden de 10 muertos en carretera. No se sabe quienes van a ser pero la predicción estadística es esa. Dicho en otras palabras, el comportamiento promedio es bastante predecible.

A grandes rasgos el razonamiento para el tráfico se puede aplicar también al comportamiento de los fotones y las partículas materiales. Las limitaciones básicas en la capacidad de describir el comportamiento de una partícula individual, ya habían demostrado no ser un problema a la hora de describir el comportamiento de grandes colecciones de partículas con buena precisión; el caso más significativo quizás fuese la distribución de las velocidades moleculares de Maxwell y la teoría cinética de los gases en general.

Aquí está el quid de la cuestión: la ecuación de Schrödinger para las ondas asociadas con las partículas cuánticas da las probabilidades de encontrar las partículas en un lugar determinado y en un momento dado; no da el comportamiento preciso de una partícula individual.

Consideremos una onda electrónica que está confinada a una región concreta del espacio. Un ejemplo sería la onda de Broglie asociada con el electrón de un átomo de hidrógeno, que se extiende por todo el átomo. Otro ejemplo sería la onda de Broglie de un electrón en un buen conductor de electricidad. Pues bien, la amplitud de la onda en un punto representa la probabilidad de que el electrón esté allí. [1]

De lo anterior se sigue que, según la mecánica cuántica, el átomo de hidrógeno no consiste en una partícula negativa localizada (un electrón) que se mueve alrededor de un núcleo como en el modelo de Bohr que hemos estado usando como referencia hasta ahora. De hecho, el modelo no proporciona ninguna imagen concreta y fácilmente visualizable del átomo de hidrógeno. Una descripción de la distribución de probabilidad es lo más parecido a una imagen que proporciona la mecánica cuántica. [2]

En la teoría cinética es fácil predecir el comportamiento promedio de un gran número de partículas, a pesar de que no se sabe nada sobre el comportamiento de ninguna de ellas. Sin embargo, a diferencia de la teoría cinética, el uso de probabilidades en la mecánica cuántica no es por conveniencia, sino que parece ser una necesidad intrínseca. No hay otra forma de abordar la mecánica cuántica.

El modelo no se ocupa realmente de la posición de ningún electrón individual en ningún átomo individual, sino que ofrece una representación matemática que puede usarse para predecir interacciones con partículas, campos y radiación. Por ejemplo, se puede usar para calcular la probabilidad de que el hidrógeno emita luz de una longitud de onda concreta. La intensidad y la longitud de onda de la luz emitida por una gran cantidad de átomos de hidrógeno se pueden comparar con estos cálculos. Comparaciones como estas han demostrado que la teoría concuerda con el experimento.

Max Born, el fundador principal de la interpretación de probabilidad, condensó magistralmente la idea básica en 1926:

El movimiento de las partículas se ajusta a las leyes de probabilidad, pero la probabilidad misma se propaga de acuerdo con la ley de causalidad.

O como saben los pastores desde tiempos inmemoriales: no sabemos que hará cada oveja, pero sí lo que hará el rebaño.

Notas:

[1] Si se pudiese realizar una medición de la ubicación del electrón, se entiende.

[2] El lector interesado en una lectura más filosófica de esta consecuencia puede ver El universo ametafórico y La verdadera composición última del universo (y IV): Platónicos, digitales y pansiquistas

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo La probabilidad en mecánica cuántica se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Construyendo la mecánica cuántica

- El comportamiento corpuscular de la luz: el efecto Compton

- El comportamiento ondulatorio de los electrones

Motivos para un día internacional

Hemos ido a un centro de enseñanza y hemos preguntado a un grupo de jóvenes a qué científicas conocen. Han nombrado a Marie Curie, a nadie más.

A partir de ahí se ha iniciado un diálogo entre el grupo acerca de la presencia de las mujeres en el mundo de la ciencia. Se han referido, entre otras cosas, a la falta de reconocimiento, al hecho de que antes las mujeres tenían vedado el acceso de determinados estudios, y a la orientación mayoritaria de las mujeres a profesiones relacionadas con la atención y cuidado de las personas. Exponen diferentes puntos de vista y mencionan la existencia de presiones sociales y familiares para orientar la formación y vidas profesionales de las chicas en una u otra dirección.

Tienen la impresión de que las cosas han mejorado y la idea de que ahora ellas pueden escoger lo que quieran ser.

Todas estas son cuestiones que atañen a los motivos por los que, cada 11 de febrero, se celebra el Día Internacional de la Mujer y la Niña en la Ciencia. Hay una presencia desigual de chicos y chicas en unos y otros estudios y, sobre todo, hay muy pocas chicas que se decantan por estudiar grados y posgrados de disciplinas a las que se atribuye una especial dificultad y para los que se supone es necesario ser especialmente brillante. Las diferencias en el acceso a unos y otros estudios tienen después consecuencias sociales y económicas, pues contribuyen a generar brechas sociales y económicas o ampliar las ya existentes.

La Universidad del País Vasco está comprometida con el objetivo de una sociedad en la que hombres y mujeres tengan los mismos derechos y gocen de las mismas oportunidades. La Cátedra de Cultura Científica de la UPV/EHU comparte ese compromiso y se ha propuesto, en la medida de sus modestas posibilidades, contribuir a cambiar ese estado de cosas. Por esa razón publica desde el 8 de mayo de 2014 Mujeres con ciencia.

Pero hoy, 11 de febrero, no hemos querido quedar al margen de la celebración internacional, promovida por Naciones Unidas del Día Internacional de la Mujer y la Niña en la Ciencia. Con ese propósito hemos producido el vídeo Somos capaces, que acompaña este texto. Hemos querido mostrar la visión que jóvenes que cursan estudios preuniversitarios tienen de la situación de las mujeres en el mundo de la ciencia.

Compartimos con los chicos y chicas que aparecen en el vídeo la disconformidad con un estado de cosas injusto, y queremos compartir también el optimismo y la confianza en sus capacidades que expresan. Pero para que ese optimismo se justifique con avances en la igualdad de derechos y oportunidades de hombres y mujeres es preciso actuar y seguir trabajando. Ese es el propósito de la Cátedra de Cultura Científica. Y por esa razón, para nosotros, mañana, como ayer, también será día de la mujer y la niña en la ciencia.

Somos capaces es una producción de K2000, ha sido dirigido por Jose A. Pérez Ledo, la música es de Borrtex (Christmas Tree) y ha sido grabado en Begoñazpi Ikastola (Bizkaia), a la que queremos agradecer su colaboración en el proyecto. Este vídeo ha contado con la colaboración de Iberdrola.

—————————————————————–

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

Más sobre el 11 de febrero

- Juan Ignacio Pérez, Hoy es el día de la mujer y la niña en la ciencia, todos lo son, 11 febrero 2016.

- Juan Ignacio Pérez, No es una percepción, 11 febrero 2017.

- Juan Ignacio Pérez, Mi hija quiere ser ingeniera, 11 febrero 2018.

El artículo Motivos para un día internacional se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Comienza Jakin-mina, el programa de conferencias para estudiantes de 4 de ESO

- Hoy es el día de la mujer y la niña en la ciencia, todos lo son

- Ciencia Clip: un concurso de vídeos de ciencia para jóvenes estudiantes

Sesgos cognitivos que aquejan a la ciencia

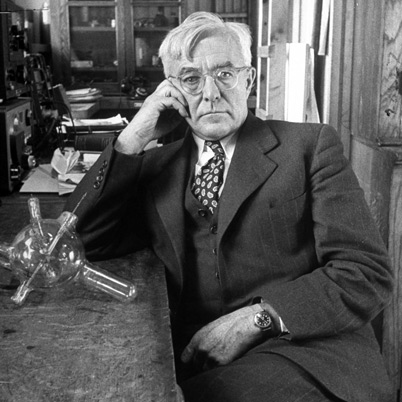

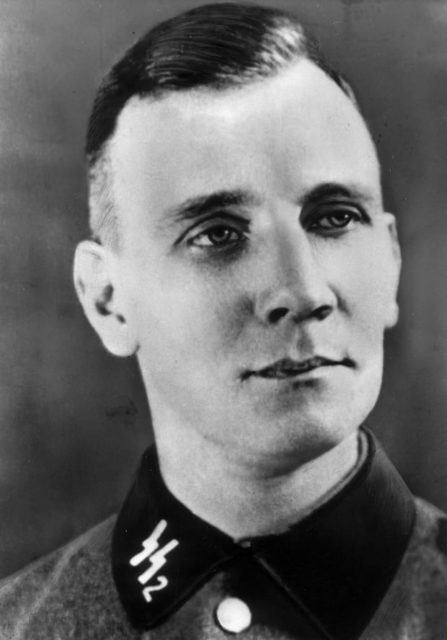

Linus Pauling (1901-1994). Ganador de dos premios Nobel. Uno de los padres de la química cuántica y de la biología molecular. Pacifista y activista. Pero también prisionero de sus sesgos cognitivos. Padre de la medicina ortomolecular (sin base científica; una superchería inventada en un sillón, como el psicoanálisis de Freud o la homeopatía de Hahnemann) y perseguidor arrogante, hostil e incansable de Dan Shechtman, los cuasicristales y de cualquiera que trabajase en ellos desde su descubrimiento en 1984 hasta la muerte del propio Pauling en 1994 (Shechtman recibiría el Nobel en 2011 por el descubrimiento de los cuasicristales).

Linus Pauling (1901-1994). Ganador de dos premios Nobel. Uno de los padres de la química cuántica y de la biología molecular. Pacifista y activista. Pero también prisionero de sus sesgos cognitivos. Padre de la medicina ortomolecular (sin base científica; una superchería inventada en un sillón, como el psicoanálisis de Freud o la homeopatía de Hahnemann) y perseguidor arrogante, hostil e incansable de Dan Shechtman, los cuasicristales y de cualquiera que trabajase en ellos desde su descubrimiento en 1984 hasta la muerte del propio Pauling en 1994 (Shechtman recibiría el Nobel en 2011 por el descubrimiento de los cuasicristales).Algunas de las modalidades de fraude, así como los casos de ciencia patológica vistos en anotaciones anteriores no se producirían de no ser por la existencia de malas prácticas y sesgos que los facilitan o, incluso, los propician.

En lo relativo a los sesgos, estos pueden ser de dos tipos. Están, por un lado, los que afectan a las personas concretas que practican la investigación científica. Y por el otro, los que afectan al funcionamiento del sistema en su conjunto y a los que podríamos denominar sistémicos. Eso que se suele denominar “método científico” no deja de ser, en el fondo, un conjunto de estrategias que se han ido poniendo en práctica para evitar los sesgos que afectan a los científicos; se trata, por lo tanto, de que el conocimiento no dependa de la persona que lo produce y que, por esa razón, tenga la máxima validez posible. Los sesgos sistémicos precisan de otro tipo de medidas para su corrección pues no afectan a los individuoa, sino al conjunto del sistema.

El sesgo de confirmación lleva a favorecer, interpretar y recordar la información que confirma las creencias o hipótesis propias. Es un sesgo que nos afecta a todos, también opera en la actividad científica. Una variante de este sesgo es la que afecta a las publicaciones científicas, aunque en este caso se suele denominar sesgo de publicación. Es la tendencia a publicar solamente resultados positivos, confirmatorios. Incluye también la tendencia a publicar resultados novedosos, que anticipan interesantes desarrollos científicos. Por esa razón, puede consistir en la confirmación de los resultados que avalan la hipótesis de partida, los de investigaciones anteriores que han abierto una nueva vía o, incluso, resultados acerca de los cuales de piensa que abren nuevas posibilidades. Lo que no se suelen publicar son resultados que simplemente no confirman las hipótesis de partida.

Los evaluadores de las revistas (los pares) tienen la tendencia a rechazar la publicación de resultados negativos con el argumento de que no suponen una aportación relevante al campo de conocimiento. Además, como ha mostrado Fanelli (2010), ese fenómeno se acentúa en las disciplinas consideradas “ciencias blandas”. O sea, es de menor importancia en física o química, intermedia en ciencias biomédicas y máxima en ciencias cognitivas o sociales. Mientras que el sesgo de confirmación es personal, el de publicación, sin embargo, es sistémico.

El sesgo retrospectivo consiste en proponer post hoc una hipótesis como si se hubiese formulado a priori. En otras palabras, se adapta la hipótesis de un trabajo a los resultados obtenidos. Este sesgo actúa porque la hipótesis original que era el punto de partida de la investigación no se suele publicar con anterioridad. Kerr (1998) denomina a esta práctica HARking (de HARK: Hypothesizing After the Results are Known). El problema del HARKing radica en que eleva la probabilidad de rechazar erróneamente una hipótesis nula, o sea, de que se produzcan errores de tipo I (falsos positivos). También conduce, de manera indirecta, a un despilfarro de recursos, tanto de tiempo como de dinero, ya que se necesitan más estudios de los que deberían ser necesarios para mostrar que no se producen los efectos que se producen.

El psicólogo Brian Nosek, de la Universidad de Virginia, sostiene que el sesgo más común y de mayores consecuencias en ciencia es el razonamiento motivado, que consiste en interpretar los resultados de acuerdo con una idea preconcebida. La mayor parte de nuestro razonamiento es, en realidad, racionalización. En otras palabras, una vez tomada una decisión acerca de qué hacer o de qué pensar sobre algo, nuestro razonamiento es una justificación post hoc por pensar o hacer lo que queremos o lo que creemos (Ball, 2017).

Karl Popper sostenía que los científicos buscan refutar las conclusiones a que han llegado otros científicos o ellos mismos. Esa es la forma en que, a su entender, avanza la ciencia. La práctica real es, sin embargo, diferente. Lo normal es que los científicos busquemos la manera de verificar nuestros hallazgos o los de los científicos con los que nos alineamos. Por eso, cuando los datos contradicen las expectativas, no es extraño que se rechacen por irrelevantes o erróneos.

Estos sesgos ejercen un efecto muy importante debido a que para los investigadores es crucial publicar artículos con sus resultados en revistas importantes. Es clave pata obtener la estabilidad en el puesto de trabajo, para promocionarse, para obtener financiación para sus proyectos, en definitiva, para ser reconocidos en su comunidad. Y para poder publicarlos, han de acomodarse a lo que se ha señalado antes: descartar resultados negativos, seleccionar los positivos y, si es posible, dar cuenta de hallazgos que sean considerados relevantes para el avance del conocimiento. La presión por publicar es tan fuerte que provoca una relajación de los controles subjetivos frente a los sesgos personales e introduce sesgos sistémicos, dirigiendo el tipo de investigaciones que se hacen y los resultados que se reportan, dado que las revistas acepatan más fácilmente resultados positivos.

Curiosamente, sin embargo, tampoco resulta fácil conseguir que se acepten para su publicación resultados verdaderamente revolucionarios. En cierto modo eso es lógico, ya que el escepticismo obliga a tomar con cautela todas las alegaciones relativas a hallazgos novedosos y a exigir que superen el cedazo de la prueba o, al menos, que las evidencias a su favor sean muy sólidas. Pero eso no quiere decir que esas alegaciones se desestimen o se les opongan obstáculos difícilmente salvables sin darles la debida oportunidad. Eso es lo que ocurrió con las investigaciones de, entre otros, Barbara McClintock (Nobel en 1984), Stanley Prusiner (Nobel en 1997), Robin Warren y Barry Marshall (Nobel en 2005), o Dan Shechtman (Nobel en 2011) cuyos descubrimientos necesitaron más tiempo y esfuerzo del que debería haber sido necesario para su aceptación. Y no sabemos en cuántas ocasiones resultados de similar trascendencia y carácter revolucionario han sido silenciados. Por lo tanto, no se trata solo de que ideas erróneas pervivan durante demasiado tiempo, sino que además, estos sesgos suponen un obstáculo serio para que nuevos descubrimientos e ideas se abran paso y se afiancen en el bagaje universal del conocimiento.

Los científicos solemos decir que la ciencia se corrige a sí misma. Y es cierto, pero a veces pasa demasiado tiempo hasta que se produce la corrección. Y a veces la corrección se hace con alto coste para quienes se atreven a desafiar el status quo. Las dificultades para la corrección se deben, en parte, a lo que hemos expuesto aquí. Pero también a que no se suelen intentar replicar las investigaciones y cuando se replican, es relativamente probable que no se reproduzcan los resultados originales. Pero de eso nos ocuparemos en una próxima anotación.

Para acabar, merece la pena reseñar, eso sí, que ya se han hecho propuestas concretas para mejorar la fiabilidad de los resultados que se publican (Ioannidis, 2014). Propone, entre otras, la participación en proyectos colaborativos de gran alcance, generalizar una cultura de la replicación, registrar los proyectos con sus hipótesis de partida antes de empezarlos y mejorar los métodos estadísticos. Algunas de esas propuestas se están llevando a la práctica.

Este artículo se publicó originalmente en el blog de Jakiunde. Artículo original.

Sobre los autores: Juan Ignacio Perez Iglesias es Director de la Cátedra de Cultura Científica de la UPV/EHU y Joaquín Sevilla Moroder es Director de Cultura y Divulgación de la UPNA.

El artículo Sesgos cognitivos que aquejan a la ciencia se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Los primeros pasos de la evolución darwiniana y sesgos cognitivos y evolución (Día de Darwin 2018)

- Ciencia Patológica

- #Naukas14 Algunos trucos para reducir sesgos

Los supermicrobios amenazan con ser más letales que el cáncer

Imagen: Ally White / Pixabay

Imagen: Ally White / PixabaySi de algo puede presumir España es de ser uno de los países con personas más longevas. Cada vez hay más octogenarios con una excelente calidad de vida. Sin embargo, no siempre ha sido así. Hace un siglo la esperanza media de vida en Europa no llegaba a los 50 años. Muchas personas morían a edades tempranas por infecciones que hoy pueden prevenirse con vacunas o tratarse con antibióticos.

No obstante, este «milagro terapéutico» podría tener sus días contados. Porque la resistencia a los antibióticos se cierne como un peligro para nuestro estado del bienestar. Estos «supermicrobios» resistentes vuelven ineficaces a muchos antibióticos. Sin la ayuda de estos fármacos, los trasplantes y otras cirugías complejas, la quimioterapia contra el cáncer o muchas pruebas diagnósticas serían irrealizables debido a las complicaciones infecciosas que surgirían.

¿El fin de un «milagro terapéutico»?

Diez millones de personas podrían estar en riesgo mortal por culpa de las infecciones por bacterias resistentes a antibióticos en el año 2050. Para hacernos una idea, esta mortalidad superaría a la causada por el cáncer (ocho millones de muertes anuales). Además, el coste de su tratamiento se dispararía, con una caída estimada del PIB mundial de entre el 1,2 y el 4%.

Ante esta situación, es fácil entender por qué la lucha contra las resistencias microbianas se ha convertido en un objetivo prioritario. La Organización Mundial de la Salud propone eliminar de una vez por todas el empleo innecesario de antibióticos. No en vano se estima que, en atención médica primaria, solo uno de cada cinco tratamientos con antibióticos es realmente necesario.

Microbios sublevados

Para entender por qué surgen resistencias hay que empezar por saber que un microbio resistente a un antibiótico adquiere una ventaja evolutiva sobre otros competidores.

Unas veces surgen por mutaciones genéticas aleatorias (y poco frecuentes) que se pueden transmitir a la descendencia.

Otras, los genes responsables de esta resistencia se adquieren del medio ambiente (transformación bacteriana), de bacterias afines (conjugación) o de virus bacteriófagos (transducción). La presencia de genes de resistencia en plásmidos (anillos de ADN extracromosómico) facilita también su propagación.

Por regla general, un tratamiento antibiótico correcto disminuye la selección de microbios resistentes. El problema surge cuando se le da un mal uso, por ejemplo consumiéndolo injustificadamente y sin prescripción médica (automedicación). O interrumpiendo un tratamiento antes de tiempo.

Por otra parte, el uso inadecuado de los antibióticos para el engorde de los animales, la depuración incorrecta de aguas residuales y residuos orgánicos, la manipulación sin garantías de los alimentos o la higiene deficiente, también aumentan la frecuencia de bacterias resistentes.

A este problema se suma el consumo de antibióticos caducados, falsificados o que no contienen la dosis suficiente. Los antibióticos fraudulentos son, con frecuencia, los únicos asequibles en los mercados de muchos lugares del planeta. Además de que Internet facilita la venta de estos productos engañosos.

Mueren más personas a manos de superbacterias que en accidentes de tráfico

La resistencia a los antibióticos es un problema global. Existen bacterias resistentes tanto en países muy industrializados (Estados Unidos o Japón), como en islas prácticamente deshabitadas (las Svalbard en el Océano Ártico), o incluso en tribus aisladas en las selvas de la Amazonia. En la diseminación y persistencia de estos supermicrobios intervienen muchos factores, como el cambio climático, la migración de poblaciones, el transporte de mercancías o la contaminación del medio ambiente.

El mayor consumo de antibióticos se observa en países con economías emergentes (India, China, Indonesia, Nigeria o Sudáfrica). En Europa son los países del Mediterráneo y del Este los que se llevan la palma. No parece que sea casualidad que casi la mitad de las infecciones en estos países estén causadas por microbios resistentes.

La Sociedad Española de Enfermedades Infecciosas y Microbiología Clínica ha estimado que, solo en 2018, las superbacterias resistentes a los antibióticos causaron infecciones a 180 600 personas, en 82 centros sanitarios, de las que 35 400 murieron. Si comparamos estas cifras con las 1 098 muertes en accidentes de tráfico notificadas por la Dirección General de Tráfico en 2019, ¡las superbacterias fueron 32 veces más letales!

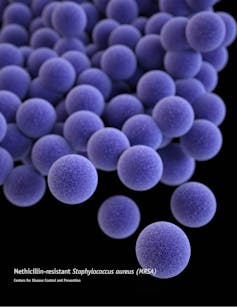

Staphylococcus aureus MRSA. Fuente: CDC.

Staphylococcus aureus MRSA. Fuente: CDC.Últimamente a los supermicrobios clásicos, como Staphylococcus aureus resistente a la meticilina, Escherichia coli, Klebsiella pneumoniae y otras enterobacterias multirresistentes, como Acinetobacter baumannii y Pseudomonas aeruginosa se han añadido unos cuantos nuevos. Como el bacilo de la tuberculosis, el parásito Plasmodium falciparum o los hongos Candida auris y Candida glabrata.

Lo preocupante del asunto es que estas infecciones requieren de tratamientos más prolongados y menos eficaces, con fármacos no exentos de toxicidad. Y también suponen una estancia más prolongada en el hospital, que continúa siendo su reservorio principal por la presencia de pacientes graves tratados con múltiples fármacos.

Y hace poco saltaron las alarmas porque están apareciendo resistencias a los llamados antibióticos de último recurso, como aztreonam, carbapenems, linezolid o vancomicina, que son a los que recurrimos cuando otros no funcionan.

«Una Salud»

La salud humana, la de los animales y la del ambiente están íntimamente relacionadas. Muchos supermicrobios habitan los intestinos de las personas y de los animales y se propagan por las aguas residuales o contaminan el suelo. Para preservar esta salud global hay que realizar un esfuerzo importante.

Necesitamos mejores técnicas de diagnóstico rápido para realizar un tratamiento antibiótico más apropiado y temprano. Los científicos se han lanzado a buscar dianas terapéuticas nuevas y alternativas que eviten la selección de mutantes microbianos resistentes. Además, la modificación de los antibióticos clásicos podría mejorar el espectro antibacteriano y disminuir el uso de otros antibióticos más recientes.

Pero no es una batalla que involucre solo a los científicos. A luchar contra los supermicrobios podemos contribuir todos. ¿Cómo? Aplicando el sentido común:

- No automedicándonos

- Evitando tomar antibióticos contra el resfriado y otras infecciones por virus

- Siguiendo el tratamiento que nos aconseja nuestro médico hasta el final

- No usando antibióticos caducados, de otras personas o de procedencia dudosa (Internet)

- Actualizando nuestro calendario de vacunación

- Preparando los alimentos de manera higiénica

- Y, muy importante, lavándonos las manos con frecuencia.

Sobre el autor: Guillermo Quindós Andrés es catedrático de microbiología médica en el Departamento de Inmunología, Microbiología y Parasitología de la Facultad de Medicina y Enfermería, Universidad del País Vasco / Euskal Herriko Unibertsitatea

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Los supermicrobios amenazan con ser más letales que el cáncer se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Microbiota y cáncer

- No era tan fácil: wifi y cáncer

- ¿Qué nos puede decir un elefante del cáncer en humanos?

El coronavirus de Wuhan, ¿qué sabemos hasta ahora?

Desde principios de enero, el coronavirus de Wuhan, también conocido como neumonía de Wuhan, ha pasado a colapsar los telediarios y los periódicos. Recibimos información constante sobre nuevos infectados, síntomas, medidas de prevención, posibles soluciones, tasa de mortalidad… En esta vorágine de información es difícil conocer la realidad en torno a este virus. ¿Cuáles son sus síntomas reales? ¿Somos susceptibles de contagiarnos sin haber salido del país? ¿Qué sabemos y qué no?

Ignacio López Goñi da respuesta a estas y otras estas cuestiones y nos habla sobre todo lo que se sabe a ciencia cierta hasta ahora (actualizado al 6 de febrero de 2020) en la conferencia “El coronavirus de Wuhan, ¿qué sabemos hasta ahora?”.

La charla, una iniciativa de la Cátedra de Cultura Científica de la UPV/EHU, se celebró en la Sala Mitxelena del Bizkaia Aretoa de Bilbao el pasado jueves 6 de febrero de 2020.

Ignacio López Goñi es Catedrático de Microbiología e investigador del Departamento de Microbiología y Parasitología de la Universidad de Navarra y, además, es director del Museo de Ciencias de dicha universidad. Como investigador trabaja en varias líneas de investigación como la patogenicidad bacteriana o la caracterización molecular de factores de virulencia, vacunas, desarrollo de nuevas técnicas para el diagnóstico y tipificación molecular. Además, López Goñi desarrolla una intensa e innovadora labor en la divulgación y comunicación de la ciencia.

Edición realizada por César ToméLópez

El artículo El coronavirus de Wuhan, ¿qué sabemos hasta ahora? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- ¿Sabemos lo que comemos?

- Naukas Bilbao 2017 – Ignacio López-Goñi: Las bacterias también se vacunan

- Ignacio López-Goñi: «El sistema de defensa de las bacterias es el mejor editor de genomas que existe»

Identificación genética de restos humanos de la Guerra Civil y la dictadura

Fosa común en Estépar (Burgos). Fuente: Wikimedia Commons

Fosa común en Estépar (Burgos). Fuente: Wikimedia CommonsInvestigadores del grupo de investigación BIOMICs de la UPV/EHU han publicado los procedimientos de análisis que han utilizado para la identificación genética de 525 restos humanos exhumados en diferentes fosas de la Guerra Civil y la dictadura. El grupo optimiza continuamente las técnicas de identificación mediante la comparación con los familiares. En sus diez años de andadura, el grupo ha conseguido identificar 137 restos humanos, y ha obtenido el perfil genético de otros 297.

Se estima que durante la Guerra Civil y la posterior dictadura desaparecieron en torno a 114.000 personas en todo el territorio español. Desafortunadamente, 80 años después, no se ha podido recuperar o identificar más que un pequeño porcentaje de estas víctimas: en los últimos quince años se han recuperado aproximadamente los restos de unas 9.000 víctimas, de unas 700 fosas comunes (se estima que hay unas 2.000). Con el transcurso de todos esos años, y el consecuente deterioro de las muestras, los métodos convencionales no son suficientemente discriminatorios para identificar los restos de todas estas personas desconocidas. Los análisis genéticos son una herramienta eficiente en la identificación de estas víctimas.

El grupo de investigación de la UPV/EHU BIOMICs lleva diez años intentando identificar a estas personas desaparecidas, mediante el estudio genético de muestras óseas y dentales de restos exhumados de diferentes fosas de la Guerra Civil y la posterior dictadura y la comparación con el ADN de familiares. “Una vez obtenido el ADN de los restos exhumados, estudiamos unos marcadores genéticos concretos, dependiendo del tipo de relación de parentesco que queremos estudiar”, explica la doctora Miriam Baeta, investigadora de BIOMICs, del Departamento de Zoología y Biología Celular Animal de la UPV/EHU.

El objetivo de los análisis genéticos es obtener el perfil de los restos o la suficiente información para poder cotejarlos con los perfiles de sus familiares o de la base de datos del banco de ADN de familiares de desaparecidos, o, en su caso, para guardarlos en la base de datos a la espera de más perfiles de familiares. Cada caso es diferente porque “por ejemplo, si queremos estudiar por vía paterna estudiamos el cromosoma Y; sin embargo, la vía materna la estudiamos mediante el ADN mitocondrial”, explica Baeta.

La investigadora pone de manifiesto la complejidad que tiene el trabajo de identificación, “porque estamos hablando de ADN post mortem, que a menudo llega muy degradado y no conseguimos obtener el perfil genético completo. La identificación o la coincidencia es más fácil de probar cuantos más marcadores se estudien. Además, en muchos casos no contamos con los miembros familiares adecuados, en el sentido de que ya no existen familiares lo suficientemente cercanos o los marcadores que conseguimos no se pueden cotejar con las muestras de ADN de los familiares”, añade la investigadora. Miriam Baeta hace hincapié en la importancia del banco de ADN de familiares, “para que en futuras exhumaciones se puedan hacer más comparaciones”.

Asimismo, Baeta se muestra optimista, porque “gracias al avance de las tecnologías cada vez podemos estudiar marcadores más pequeños, que tienen más probabilidad de éxito en el análisis, porque al ser más pequeños sobrevivirán a la degradación”. En los diez años que el grupo lleva trabajando en este campo, son muchos los avances que han conseguido en la optimización del sistema de identificación: “Entre otros, hemos optimizado los sistemas de extracción de ADN, así como distintos pasos a lo largo del proceso con el objetivo de obtener perfiles que sean informativos. Siempre intentamos ir mejorando todas las partes”, detalla. Concretamente, el último avance propuesto por el grupo “permite estudiar fragmentos más pequeños de ADN mitocondrial. Esta técnica nos permite hacer un primer cribado para descartar de forma coste-efectiva posibles relaciones por vía materna; es decir, podemos discriminar de una forma más sencilla el parentesco por vía materna: sólo si hay coincidencia en esta primera fase, habría que aplicar después las metodologías que se vienen usando hasta ahora para analizar el ADN mitocondrial”.

Los investigadores del grupo han publicado un artículo en el que dan a conocer todo el conocimiento adquirido con el trabajo de diez años. Concretamente, exponen las técnicas y los procedimientos utilizados en la identificación de 525 restos humanos. Para esta identificación, paralelamente, obtuvieron las muestras de saliva de 879 familiares, y así consiguieron identificar a 137 personas desaparecidas. En total, de un 17 % de las muestras analizadas no obtuvieron el perfil informativo, como consecuencia del ADN limitado o degradado de las muestras, pero sí obtuvieron perfiles informativos de otros 297 restos humanos que, pese a todo, quedaron sin identificar. “En general, obtenemos perfiles de la mayoría de los restos esqueléticos, pero no tenemos a los familiares adecuados con los que comparar”, comenta la doctora.

La investigadora afirma que “cuando obtenemos una identificación es una alegría, porque, además de la alegría que nos produce el propio resultado en sí, hay un trabajo muy complejo detrás. Al final, es un esfuerzo colectivo, tanto nuestro como de la Sociedad de Ciencias Aranzadi, del Instituto Gogora y de las asociaciones de víctimas y familiares de personas desaparecidas en la Guerra Civil y la dictadura”.

Referencias:

Miriam Baeta, Carolina Nuñez, Caterina Raffone, Eva Granizo, Leire Palencia-Madrid, Sergio Cardoso, Francisco Etxeberria, Lourdes Herrasti, Marian M. de Pancorbo (2019) Updating data on the genetic identification of bone remains of victims of the Spanish Civil War Forensic Science International: Genetics Supplement Series (2019) doi: 10.1016/j.fsigss.2019.10.098

Miriam Baeta, Sandra García-Rey, Leire Palencia-Madrid, Caterina Raffone, Marian M. de Pancorbo (2019) Forensic application of a mtDNA minisequencing 52plex: Tracing maternal lineages in Spanish Civil War remains Forensic Science International: Genetics Supplement Series doi: 10.1016/j.fsigss.2019.10.050

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Identificación genética de restos humanos de la Guerra Civil y la dictadura se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Formas moleculares de excreción de restos nitrogenados

- Al menos de 24 siglos de continuidad genética

- La «Nocardia de San Sebastián» infecta a humanos

Crisis, emergencia, apocalipsis

Lo llamábamos calentamiento global. A finales de los 90 se popularizó cambio climático. A finales de los años 10 de este siglo triunfó el término crisis climática. En poco tiempo dio paso a la emergencia climática. Antes de que nos acostumbrásemos a esta nueva expresión, apareció una nueva: apocalipsis climático. La emergencia del lenguaje suele usarse para esconder la crisis de las ideas.

Detalle de Inflatable Flowers (Four Tall Purple with Plastic Figures). Jeff Koons, 1978. Foto: Corrado Serra. Fuente

Detalle de Inflatable Flowers (Four Tall Purple with Plastic Figures). Jeff Koons, 1978. Foto: Corrado Serra. FuenteUn nuevo entendimiento requiere del uso de nuevos términos. Así, el calentamiento global se refiere al aumento de la temperatura, mientras que el cambio climático incluye el calentamiento y todos los efectos secundarios que derivan de él: aumento de la frecuencia de los eventos meteorológicos extremos, subida del nivel del mar, acidificación de los océanos, pérdida de biodiversidad, mengua de recursos, empobrecimiento, entre otros. Hubo consenso entre científicos, comunicadores, políticos y lingüistas en el uso de esta nueva y más precisa denominación. Tanto es así, que el IPCC, el organismo de referencia mundial creado por las Naciones Unidas para evaluar la ciencia relacionada con el cambio climático, lleva el término en sus siglas y se refiere a él con esa expresión en todos los documentos oficiales.

No obstante, las recomendaciones actuales en términos de comunicación indican que la expresión crisis climática es más adecuada para referirse a la magnitud y a las consecuencias del cambio climático causado por la actividad humana. Es la expresión preferida por la mayoría de políticos y periodistas. La definición de crisis comprende un cambio profundo de consecuencias importantes. Históricamente se ha empleado la declaración de situaciones de crisis para definir objetivos y tomar decisiones concretas.

Es cierto que el uso de la expresión crisis climática ha coincidido en el tiempo con una mayor conciencia medioambiental. Según los datos, cada vez hay más personas que optan por el transporte público por una motivación medioambiental, que escogen electrodomésticos de bajo consumo, que reciclan, que prefieren materiales reciclados y reciclables, que han modificado su alimentación y su forma de ocio.

A pesar de ello, según el barómetro del CIS, el 60% de los entrevistados creen que los esfuerzos individuales son inútiles si no se toman medidas de carácter global. El 80% cree que es imprescindible que los gobiernos intervengan. Esta percepción se corresponde con la realidad de los hechos. Según datos del Ministerio, el 75% de las emisiones de CO2, el principal gas responsable del calentamiento global, proviene del sector energético. El 27% lo emite el transporte, el 18% la generación eléctrica, el 19% la combustión en industria y el 9% deriva del uso comercial y residencial. Los procesos agrícolas, sin contar transporte, son el 12%, donde el 8% del CO2 proviene de la ganadería y el 4% de la agricultura.

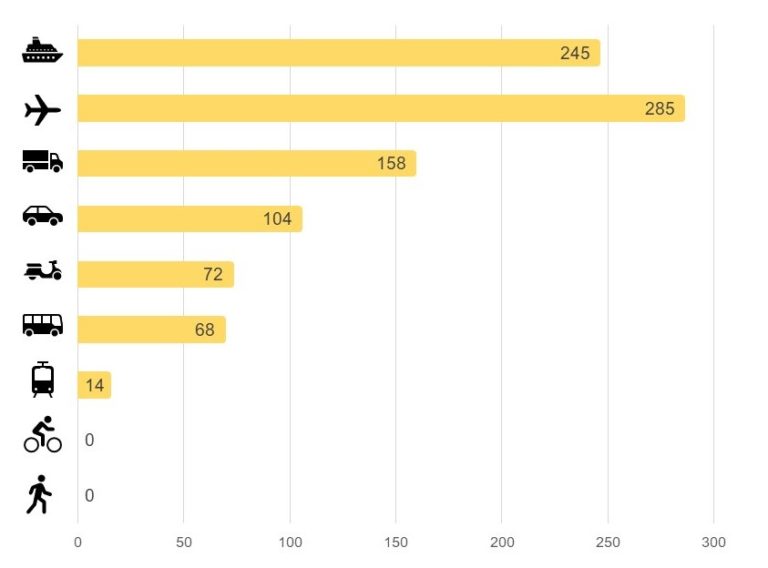

Sin un plan estratégico global concreto y ambicioso, es cierto que el impacto medioambiental de las acciones individuales es despreciable. A esto hay que sumarle que la toma de decisiones que afectan al ámbito privado acostumbra a estar mediada por prejuicios y desinformación. Por ejemplo, desde el punto de vista medioambiental, la cruzada contra el uso del plásticos es anticientífica: usar bolsas de plástico es más sostenible que usar bolsas de papel o de algodón, y el impacto medioambiental de los materiales cerámicos es mayor que el de los plásticos, aunque cause más desasosiego una montaña de basura de plástico que una montaña de basura de hormigón. La realidad es que optar por recorrer 5 km en trasporte público en lugar de hacerlo en coche particular, ahorra más CO2 al planeta que todo el plástico que usarías en un año.

Gramos de CO2 emitidos por el medio de transporte por persona y kilómetro recorrido. Imagen: Deborah García Bello. Datos: Agencia Europea de Medio Ambiente

Gramos de CO2 emitidos por el medio de transporte por persona y kilómetro recorrido. Imagen: Deborah García Bello. Datos: Agencia Europea de Medio AmbienteDe poco o nada servirá que cada uno de nosotros se fabrique su propia bolsa de patchwork ideológico, a base de retales de tela de algodón, poliéster y bambú, si no se toman medidas mensurables cuyo impacto real concuerde con las dimensiones del problema.

Según el IPCC, las principales opciones de mitigación del cambio climático radican en el sector energético: mejorar la eficiencia energética y reducir las emisiones de gases de efecto invernadero. Esto solo puede lograse, según el IPCC, apostando por el uso de energías renovables, el uso de energía nuclear, y el uso de sistemas de captura y almacenamiento de dióxido de carbono.

Así escrito en un párrafo parece sencillo. Pero la realidad es que cambiar un modelo energético requiere de tiempo y solvencia. Necesitamos gobiernos sólidos y ambiciosos capaces de afrontar inversiones y planes que vayan más allá de los años de legislatura. Por eso no se apuesta por las centrales nucleares, porque pocos países tienen la certeza de ser capaces de soportar el periodo de amortización. Por eso se cierran centrales térmicas sin hacer demasiado ruido mediático, porque el cierre, desde el punto de vista tecnológico es sencillo, y desde el punto de vista del cambio climático es conveniente, pero la gestión del impacto social y económico es harina de otro costal.

Atemorizar a la gente con palabras como emergencia o apocalipsis, sabemos que solo genera miedo, ansiedad e inmovilismo. No quiero ciudadanos actuando como pollos sin cabeza, tomando decisiones que afectan a su bienestar sin ser conscientes de la relevancia de sus actos. No quiero que paguen por sellos ecológicos de kiwis que vienen de Nueva Zelanda, creyendo que ese esfuerzo económico responde a un acto heroico por el planeta. No quiero que restrinjan su alimentación y su ocio más allá de lo simbólico o lo ético. No quiero que cada persona a título individual cargue con la culpa y la responsabilidad de gestionar desde su parcela privada algo tan grande como el cambio climático. Hablo de culpa porque hay quien habla de apocalipsis. Ese juego dialéctico ha pasado de responder a un uso apropiado del lenguaje, a un uso circense. Crisis, emergencia, apocalipsis. Si el lenguaje es importante, uno debería usarlo como si lo fuera.

Sobre la autora: Déborah García Bello es química y divulgadora científica

El artículo Crisis, emergencia, apocalipsis se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Lo prudente es hablar de emergencia climática

- El legado de Fisher y la crisis de la ciencia

- Apocalipsis alienígena: ¿puede alguna civilización sobrevivir a un cambio climático?

Área = perímetro

Algunos descubrimientos en matemáticas –y en ciencia en general– nacen de errores. Es algo que repetimos a menudo en el aula a nuestro alumnado: no deben temer equivocarse. En muchas ocasiones, el análisis de un error ayuda a entender un enunciado o un razonamiento con precisión.

En 1981, el matemático Lee Markowitz –de la Universidad de Bowling Green State, Ohio, EE. UU.– publicó un artículo en la revista Mathematics Teacher en la que precisamente comentaba cómo un error le había llevado a preguntarse sobre cierta propiedad relativa a triángulos.

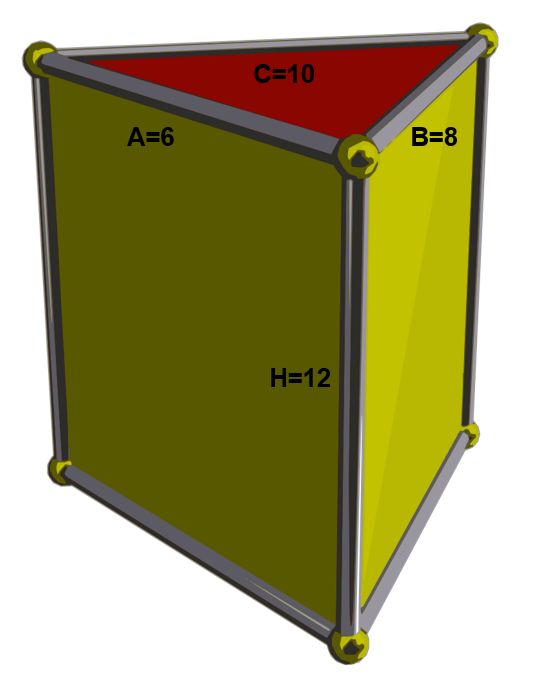

Mientras el matemático estaba explicando un ejercicio de geometría a uno de sus estudiantes, cometió un error que le llevó a preguntarse cuándo el perímetro y el área de un triángulo eran iguales. El ejercicio en cuestión consistía en calcular el área lateral de un prisma recto de base triangular. El triángulo tenía catetos de longitudes A=6 y B=8 unidades e hipotenusa de C=10 de largo, siendo la altura del prisma de H=12.

Imagen realizada a partir de la imagen del prisma de Wikimedia Commons.

Imagen realizada a partir de la imagen del prisma de Wikimedia Commons.

Recordemos que el área lateral de un prisma recto es PH, donde P es el perímetro de la base y H la altura del prisma.

Markowitz se equivocó y calculó el área del triángulo en vez de su perímetro. El error pasó desapercibido en un primer momento porque, efectivamente, el área del triángulo es AB/2 –es decir, 24– y el perímetro es A+B+C=6+8+10=24.

Al ser consciente del error, como buen matemático, Markowitz comenzó a hacerse varias preguntas.

-

Cuestión 1: ¿Es este el único triángulo de lados de longitud natural cuyo perímetro y área coinciden?

-

Cuestión 2: ¿Hay más triángulos cuyos lados tengan longitud racional, no necesariamente entera?

-

Cuestión 3: ¿Existen triángulos no rectángulos, con lados de longitud natural y cuyo perímetro y área coincidan?

Y Markowitz comenzó a investigar, llegando a demostrar dos teoremas:

Teorema 1: Existen solo cinco triángulos con lados de longitud entera para los cuales el área coincide con el perímetro. Solo dos de estos triángulos son rectángulos.

Teorema 2: Existen infinitos triángulos rectángulos con lados de longitud racional para los cuales el área coincide con el perímetro.

Vamos a responder a las preguntas –a probar los teoremas– siguiendo las indicaciones de Lee Markowitz en su artículo.

Un triángulo de lados A, B y C (hipotenusa) respondiendo a la cuestión 1 debe verificar las siguientes propiedades:

- A, B y C son números naturales,

- el área del triángulo coincide con su perímetro, es decir, ½AB=A+B+C, y

- el triángulo es rectángulo, es decir, A2+B2=C2.

Despejando C de (2) se deduce que C=½AB-A-B. Y sustituyendo C en la condición (3) queda que A2+B2=(½AB-A-B)2, es decir, AB(AB-4A-4B+8)=0. Como A y B son positivos, debe ser AB-4A-4B+8=0. De otro modo, se obtiene la condición:

- (A-4)(B-4)=8.

Considerando dos triángulos rectángulos iguales si se intercambian los papeles de los dos catetos, solo hay dos soluciones que verifican (1), (2), (3) y (4), a saber (A,B,C)=(6,8,10) y (A,B,C)=(5,12,13). El resultado se obtiene fácilmente al tener en cuenta que 8 se puede escribir como producto de números naturales solo de dos maneras: como el producto de 1 por 8 o el de 2 por 4.

La cuestión 2 se resuelve eliminando la condición (1), es decir, estudiando aquellos triángulos verificando únicamente (2) y (3). Así, debe resolverse la condición (4) permitiendo valores racionales positivos para A y B. Despejando B de (4), se obtiene la ecuación

- B=(-8+4A)/(A-4).

El cociente de -8+4A entre A-4 es positivo cuando A es mayor que 4 o cuando A es menor que 2 (y positivo). Esto prueba que hay infinitos triángulos con lados racionales cuya área y perímetro coinciden.

Y, para finalizar, asumamos que el triángulo no tiene que ser rectángulo, aunque debe tener lados enteros. Así, debemos eliminar la condición (3) del análisis. El área de un triángulo no rectángulo en términos de la longitud de sus lados no se escribe como en (2). La expresión del área sigue la llamada fórmula de Herón –que, por supuesto, corresponde a la condición (2) en el caso de un triángulo rectángulo– es la raíz cuadrada de S(S-A)(S-B)(S-C), donde S es el semiperímetro del triángulo. Así la cuestión 3 se resuelve imponiendo las condiciones (1) y

- S(S-A)(S-B)(S-C)=(A+B+C)2.

Analizando (1) y (6) –simplificando la ecuación (6) y descartando las soluciones no enteras– se obtienen cinco pares de triángulos que cumplen esas condiciones, a saber: (A,B,C)=(6,8,10), (A,B,C)=(5,12,13), (A,B,C)=(6,25,29), (A,B,C)=(7,15,20) y (A,B,C)=(9,10,17). Las dos primeras corresponden a los triángulos rectángulos ya citados con anterioridad.

Así hemos demostrado los dos teoremas enunciados por Lee Markowitz; son hermosos y sencillos resultados fruto de un error… y de la tan necesaria curiosidad en la actividad investigadora.

Referencias

[1] Math Notes, Futility Closet, 23 enero 2020.

[2] Lee Markowitz, Area = Perimeter, Mathematics Teacher 74:3 (1981), 222-223.

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad.

El artículo Área = perímetro se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:¿Por qué los átomos tienen el tamaño que tienen?

Imagen: Berndthaller / Wikimedia Commons

Imagen: Berndthaller / Wikimedia CommonsA escala atómica el principio de incertidumbre se usa principalmente en argumentos generales sobre la teoría atómica más que en problemas numéricos concretos. Por ejemplo, el principio de incertidumbre ayuda a responder una pregunta fundamental que los pensadores se han planteado desde que apareció el concepto de átomo: ¿por qué los átomos tienen el tamaño que tienen? [1]

Los átomos en realidad están compuestos principalmente de espacio vacío. En el centro de cada átomo hay un núcleo muy pequeño, en el que se concentra toda la carga positiva y casi toda la masa del átomo. Alrededor del núcleo hay una cantidad de electrones igual a la carga positiva del núcleo. Los electrones están dispuestos en varias órbitas cuánticas. La más baja se llama el «estado fundamental». Pero incluso la órbita del estado fundamental todavía está lejos del núcleo. En la mayoría de los átomos, el radio del estado fundamental es de unos 10-8 cm, mientras que el radio del núcleo es de unos 10-12 cm. Esto significa que un núcleo ocupa solo una pequeña fracción del espacio dentro de un átomo; el resto está vacío (a excepción de unos pocos electrones que podemos considerar de tamaño puntual) [2].

El modelo de Rutherford, basado en un modelo planetario del átomo, es inestable, ya que el átomo debería colapsar en el núcleo, porque los electrones deberían irradiar su energía y girar en espiral hacia el núcleo. Bohr intentó explicar por qué esto no sucede al postular la existencia de estados cuánticos estacionarios, mientras que la mecánica cuántica asocia dichos estados con ondas estacionarias, teniendo el estado fundamental la onda de electrónica estacionaria más pequeña posible en esa órbita. Pero es el principio de incertidumbre el que explica por qué no podemos tener estados más bajos y por qué los electrones negativos no pueden existir dentro de o sobre el núcleo positivo. Bueno, para ser estrictos, el principio de incertidumbre combinado con el principio de constancia de la velocidad de la luz de la teoría de la relatividad.

Una aplicación simple de la relación de incertidumbre para la posición y el momento (Δx·Δpx≥h/4π) muestra que si un electrón está confinado a un espacio de 10-8 cm, el tamaño de un átomo promedio en centímetros, entonces la incertidumbre en su velocidad es menor que la velocidad de la luz. Pero si se limita a un espacio mucho más pequeño, o incluso al tamaño del núcleo, la incertidumbre en su velocidad excedería la velocidad de la luz, que es, redondeando, 3·1010 cm/s. Pero nada puede superar a la velocidad de la luz [3], ninguna partícula material puede exceder la velocidad de la luz. Por lo tanto, el espacio dentro del átomo entre el núcleo y el primer estado cuántico debe permanecer vacío. [4]

Ya tenemos un tamaño mínimo para el átomo dado por la combinación de incertidumbre y relatividad. ¿Existe algún límite al tamaño máximo?

Para aumentar el tamaño de un átomo, tendríamos que llevar electrones a estados cuánticos mucho más altos. Además de requerir la inyección de una gran cantidad de energía, los estados energéticos más altos no están espaciados uniformemente, sino que están cada vez más separados. Por lo tanto, la probabilidad aumenta enormemente de que los electrones en estos estados superiores puedan escapar del átomo y liberarse, por lo que dicho átomo no existiría durante mucho tiempo debido a la menor atracción electrostática del núcleo, lo que significa que en la práctica la mayoría de los átomos que se pueden estudiar tienen un tamaño de aproximadamente 10-8 cm.

Veremos en su momento que el hecho de que los átomos tengan un tamaño del orden de 10-8 cm ayuda a explicar muchas de las propiedades de la materia que vemos a nuestro alrededor.

Notas:

[1] Veremos que para responder a esta pregunta tendremos que echarmano de lo que hemos visto hasta ahora de Átomos y Cuantos.

[2] Implícitamente estamos considerando el aspecto corpuscular de los electrones. Esta interpretación es la que nos conviene en esta explicación, pero no debemos olvidar la dualidad onda-corpúsculo.

[3] Véase nuestra serie La teoría de la invariancia, una teoría popularmente llamada con un nombre que da lugar a equívocos: teoría de la relatividad.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo ¿Por qué los átomos tienen el tamaño que tienen? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- El tamaño del átomo de hidrógeno

- La estructura de la tabla periódica se deduce de la estructura de capas de los átomos

- El tamaño de las moléculas

Ciencia Patológica

Irving Langmuir. Imagen: Wikimedia Commons

Irving Langmuir. Imagen: Wikimedia CommonsAdemás del fraude, hay otros comportamientos por parte de quienes realizan investigación de vanguardia que pueden conducir a obtener –y en ocasiones anunciar o publicar- conclusiones erróneas o insostenibles. El que da lugar a la denominada “ciencia patológica” es uno de ellos.

La expresión “ciencia patológica” fue acuñada por Irvin Langmuir, químico y físico estadounidense que fue premio Nobel de química en 1932. Se movió entre la ciencia experimental y la teórica, y fue presidente de la Asociación Química Americana.

En la conferencia “Coloquio en el Laboratorio de Investigación Knolls de la General Electric”, impartida el 18 de Diciembre de 1953, Langmuir describió la “ciencia de las cosas que no son”, más tarde conocida como “ciencia patológica”. Esa denominación no hace referencia a una forma particular de pseudociencia, pues esta no tiene pretensión alguna de seguir el denominado “método científico”, sino a un tipo de investigación científica afectada por sesgos inconscientes y efectos subjetivos.

En su conferencia, Langmuir previno contra los peligros del autoengaño y dio cuenta de varios casos famosos, entre ellos: Los Rayos N, (Blondlot, 1903), una prueba experimental contraria a la Teoría de la Relatividad (Kaufmann, 1906), las radiaciones mitogenéticas o rayos Gurwitsch (1923), una verificación prematura del ”corrimiento al rojo” gravitacional (Adams, 1924), y los experimentos dudosos sobre rayos canales de Rupp (1926)*. J M Barandiarán (2017) incluye también en esa relación el caso de Percival Lowell y los “canales” marcianos, a los que dedicó la mayor parte de su actividad en el observatorio (privado) de Flagstaff (Arizona).

La ciencia patológica es un fenómeno que presenta los siguientes rasgos relativos a un supuesto descubrimiento científico:

- El efecto observable máximo es producido por un agente causante de intensidad apenas perceptible, y la magnitud del efecto es sustancialmente independiente de la intensidad de la causa.

- La magnitud del efecto es cercana al límite de la detectabilidad, o muchas medidas son necesarias debido a la baja relevancia estadística de los resultados. Suele ocurrir que el investigador encuentre excusas en estos casos para descartar datos convenientemente.

- Hay afirmaciones de gran exactitud.

- Se proponen teorías fantásticas contrarias a la experiencia.

- Las críticas se resuelven con excusas ad hoc.

- La proporción de partidarios frente a los críticos aumenta y después cae gradualmente al olvido. Los críticos no pueden reproducir los experimentos, sólo pueden los que son partidarios. Al final no se salva nada. De hecho, nunca hubo nada.

Como regla general la ciencia patológica trabaja en los límites difusos, no hay pretensión de fraude, simplemente es mala ciencia, que se practica por no saber reconocer las limitaciones epistemológicas del investigador, sus instrumentos y sus diseños experimentales. Hay mucha más de lo que sería deseable, sobre todo en algunos campos nuevos y de moda. El caso más sonado de ciencia patológica es, quizás, el de la supuesta “fusión fría”.

Si pensamos que para los investigadores constituye un fuerte incentivo la posibilidad de realizar descubrimientos cruciales, nos encontraríamos, paradójicamente, ante un caso en el que el reconocimiento por los hallazgos –que compensa, supuestamente, el carácter desinteresado de la actividad científica-, actuaría como factor principal de esta variedad de mal. Se trata de un efecto similar al de la segunda modalidad de fraude científico. También en este caso, es el escepticismo, la virtud mertoniana que queda en entredicho, no tanto porque se impida su ejercicio, sino porque no se actúa conforme a lo que tal virtud exige.

El contenido de esta anotación se ha basado, sobre todo, en esta otra de César Tomé López (2013) en el Cuaderno de Cultura Científica, y en la de J M Barandiarán (2017) en la web de BC Materials.

Nota:

[*] Rupp tuvo que admitir finalmente que sus extraordinarios resultados se debían, en parte, a una falsificación de datos.

Este artículo se publicó originalmente en el blog de Jakiunde. Artículo original.

Sobre los autores: Juan Ignacio Perez Iglesias es Director de la Cátedra de Cultura Científica de la UPV/EHU y Joaquín Sevilla Moroder es Director de Cultura y Divulgación de la UPNA.

El artículo Ciencia Patológica se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Ni ciencia, ni pseudociencia, ciencia patológica.

- Ciencia a presión: Ciencia patológica y patología editorial

- El fraude y las malas prácticas en ciencia

El efecto hoy en día

Foto: Cristina Gottardi / Unsplash

Foto: Cristina Gottardi / Unsplash“Ahora los chicos aman el lujo. Tienen malas maneras, desprecian la autoridad; no respetan a los mayores y prefieren la cháchara al ejercicio”. Las personas mayores decimos cosas semejantes con frecuencia. Y eso no es de ahora; se han dicho, al menos, desde que tenemos registros escritos de lo que pensaban nuestros antepasados. La cita entrecomillada con la que se abre este texto, en concreto, se atribuye a Sócrates. Pero si eso fuera cierto, si los jóvenes fuesen cada vez más disolutos, mas irrespetuosos, más holgazanes o más alocados, por citar solo algunos de los defectos que se les suelen atribuir, la juventud y con ella el resto de la humanidad, habría degenerado de una forma difícilmente soportable. Algo falla en esas expresiones.

Una investigación cuyas conclusiones se han dado a conocer recientemente ha abordado este asunto, indagando acerca del fenómeno denominado “efecto hoy en día” (these days effect en inglés). Y para ello ha pulsado la opinión de las personas mayores acerca de cómo han evolucionado tres rasgos en concreto desde nuestros años mozos hasta la juventud de hoy en día. Los rasgos son el respeto a las personas mayores, la inteligencia y el gusto por la lectura.

La conclusión general del estudio es que hay, efectivamente, una tendencia general a hablar mal de la juventud en lo relativo al respeto a los mayores y el gusto por la lectura. Y también una tendencia a valorar de forma negativa a la gente joven en aquellos rasgos en los que uno destaca o cree destacar; esta tendencia es común a los tres rasgos investigados. O sea, cuando una persona adulta es muy respetuosa con la autoridad, tiende a pensar que la gente joven de ahora respeta a los mayores menos que los jóvenes de su época. Y lo propio ocurre con la inteligencia y con la afición a leer. El efecto es, sobre todo, específico de cada rasgo, porque, por ejemplo, alguien muy aficionado a la lectura pero que valora poco la autoridad, no tiende a pensar que los jóvenes de hoy en día no respetan a los mayores como se les respetaba antes. En otras palabras, ese “efecto hoy en día” no consiste en una minusvaloración o mala opinión general de la juventud sino que se circunscribe a dominios relativamente específicos.

Los autores del trabajo identificaron dos mecanismos que subyacen al efecto. Por un lado, observaron que la gente que destaca en algún rasgo tiene una especial tendencia a percibir los fallos en ese mismo rasgo de los demás, tanto en los jóvenes como en los adultos. Y por otra parte, tienden a proyectar sus características actuales hacia el pasado, incurriendo en el error de pensar que cuando eran jóvenes tenían las mismas virtudes o rasgos favorables que en el presente. Por eso se comparan tal y como se ven a sí mismos hoy con los jóvenes, sin caer en la cuenta de que ellos no son ahora como eran hace cuarenta años. Este mismo sesgo ha podido estar actuando durante milenios, con lo que ello implica.

Si llevamos siglos valorando de forma negativa a los “jóvenes de hoy en día”, es muy improbable que los mayores dejemos de hacerlo en adelante. Por esa razón, cuando oiga a sus familiares o colegas, o incluso, se descubra a sí mismo diciendo que los jóvenes de ahora son indisciplinados, no respetan a sus mayores, no leen, antes llegaban mejor preparados a la universidad, o cosas semejantes, antes de asentir o de seguir con la diatriba piense que eso mismo decían los griegos hace casi veinticinco siglos.

Fuente:

John Protzko and Jonathan W. Schooler (2019): Kids these days: Why the youth of today seem lacking Science Advances: 5 (10) eaav5916 DOI: 10.1126/sciadv.aav5916

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo El efecto hoy en día se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- No duermas, hay leones

- El efecto escenario: por qué la gente elige la opción de en medio

- El desajuste adolescente

Energía… ¿oscura?

¿Podemos predecir el destino del Universo? Aunque parezca sorprendente, al parecer sí que se puede. Sin embargo, en el intento nos hemos encontrado con el efecto de la llamada ‘energía oscura’. ¿Podemos entender de dónde viene la energía oscura y cuál es su efecto, o debemos simplemente aceptar su existencia?

Ciertamente, nos encontramos ante grandes incógnitas. Para abordar estas cuestiones y reflexionar sobre ellas, el ciclo de conferencias Bidebarrieta Científica acogió la charla titulada “Energía… ¿oscura?” de la mano de Marcos Pellejero Ibáñez, investigador postdoctoral en el Donostia International Physics Center, el pasado 29 de enero de 2020.

Marcos Pellejero habló sobre el Universo y el vacío en esta conferencia del ciclo Bidebarrieta Científica, iniciativa impulsada por la Cátedra de Cultura Científica de la UPV/EHU y la Biblioteca Bidebarrieta y que en esta ocasión se celebrará en el marco de la tercera edición del ciclo de cine y ciencia organizado por la Filmoteca Vasca, el Donostia International Physics Center (DIPC) y el Festival de Cine de San Sebastián.

Edición realizada por César Tomé López

El artículo Energía… ¿oscura? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:Prótesis biocompatibles por impresión 3D

Koldo Artola de Domotek y Pedro Guerrero de Biomat. Foto: Nagore Iraola -UPV/EHU.

Koldo Artola de Domotek y Pedro Guerrero de Biomat. Foto: Nagore Iraola -UPV/EHU.La impresión en tres dimensiones (3D) ha constituido un gran avance en la medicina personalizada al desarrollar biomodelos que facilitan en gran medida la labor del profesional de la salud. Un nuevo paso en este camino es el trabajo colaborativo llevado a cabo entre el grupo Biomat de la Universidad del País Vasco y la empresa Domotek que ha permitido la obtención de biomodelos personalizados de colágeno nativo. Gracias a los avances en la obtención de biomateriales procesables por impresión 3D, desarrollados por Biomat, y en la adquisición y procesado de datos para impresoras 3D, llevados a cabo por Domotek, los productos fabricados pueden ser utilizados como piezas de utillaje o prótesis gracias a su biocompatibilidad.

“A partir de imágenes médicas tomadas al paciente, principalmente mediante Tomografía Axial Computarizada (TAC) o Imagen por Resonancia Magnética (MRI), se pueden obtener modelos digitales 3D de gran precisión -explica Pedro Guerrero, investigador del grupo Biomat-. Estos modelos digitales se pueden transformar en datos que pueden ser procesados por las impresoras 3D para imprimir réplicas exactas (biomodelos) de la anatomía del paciente. Estos biomodelos sirven al médico para verificar los procedimientos quirúrgicos y mejoran la comunicación de los médicos con el paciente, mostrándole el biomodelo al paciente para que este comprenda mejor la intervención a realizar. En la actualidad, los implantes personalizados hacen posible la reconstrucción del defecto sin alterar la anatomía del paciente, consiguiéndose una mejora en la eficiencia de la cirugía y reduciendo la duración y los costes de la misma”.

Las impresoras 3D pueden reproducir los biomodelos en plástico o resina, pero estos materiales presentan riesgos de infección o rechazo, por ello el desarrollo de nuevos materiales es clave. “Con el desarrollo llevado a cabo por Biomat y Domotek, los biomodelos se pueden fabricar con colágeno nativo tipo I, un material biocompatible, biodegradable, poroso, adecuado para la adhesión celular y que no presenta citotoxicidad. Por tanto, estos biomodelos fabricados con materiales basados en colágeno nativo pueden ser las prótesis del mañana, ya que, gracias a sus propiedades, pueden comportarse como sustitutos temporales del tejido dañado mientras este se regenera. En el caso de los implantes, la biodegradabilidad es muy importante ya que evita una segunda cirugía para eliminar el implante”, aclara el profesor Guerrero.

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Prótesis biocompatibles por impresión 3D se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Polímeros biocompatibles para integrar dispositivos electrónicos en nuestro cuerpo

- Cómo regular la velocidad de disolución de los biometales de las prótesis

- Control adaptativo de robots para rehabilitación

El efecto escenario: por qué la gente elige la opción de en medio

Ante una lista de opciones o elementos similares colocados en fila, los humanos tendemos a descartar los extremos y quedarnos con aquellos situados en medio. Sucede con números, con imágenes e incluso con concursantes de un programa de televisión1. El efecto de preferencia central (“center stage effect” o “centrality preference” en la literatura en inglés) ha sido estudiado por la psicología desde hace décadas y presenta una robusta evidencia23. Los motivos de esta curiosa preferencia no terminan de estar claros 4: podría tratarse de una cuestión perceptiva56 (fijamos nuestra mirada en el centro por lo que tendemos a elegir cosas situadas ahí), cultural7 (el prestigio y la autoridad asociados a una posición central), o una estrategia para reducir el esfuerzo mental que supone elegir8. De un modo u otro, las implicaciones de este efecto resultan de lo más variopintas. Aquí van algunas:

Servicios públicos

En un artículo publicado en 19959, Nicholas Christenfeld presentó una serie de experimentos sobre este curioso sesgo: en uno de ellos, examinó las preferencias de los playeros de California a la hora de ir a mear. Como hubiese sido un poco violento plantarse en la puerta de los servicios públicos a contar visitantes, Christenfeld usó una medida indirecta. Con ayuda del personal de limpieza, registró el uso de papel higiénico de cada una de las cabinas. El resultado confirmó la sospecha: los playeros utilizaban los retretes centrales con bastante más frecuencia de la que cabía esperar por puro azar. Así que la próxima vez, ya sabes… si quieres usar el retrete más limpio, deberías optar por los extremos. No sólo estarán menos usados, además tendrás más posibilidades de encontrar papel higiénico.

¡Compra, compra!

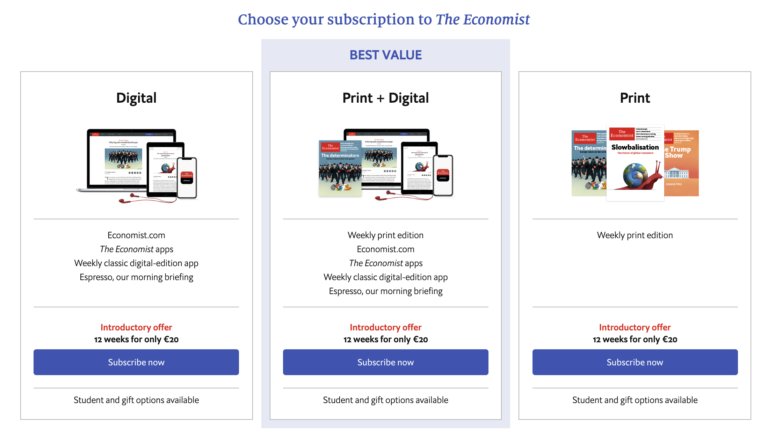

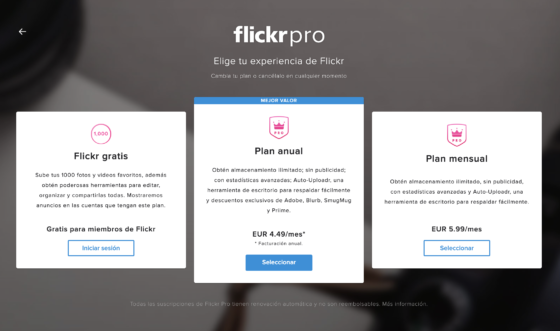

Objetos similares colocados en fila. Está claro que nuestra preferencia por la centralidad tiene muchas ocasiones de salir a relucir cada día. Pero quizás la más clara es la que nos sitúa como compradores ante una colección de productos. Esta colección puede tomar distintas formas: puede ser un escaparate, perfectamente ordenado tras un cristal. También puede tratarse de un catálogo, la balda del supermercado, o las bebidas en la nevera al final de un buffet. Y, claro está, también puede darse en internet: desde la galería de amazon a cualquier página web de venta online. En todos estos casos, los clientes tienden a elegir y gastar más dinero en los elementos situados hacia el centro de su campo visual. Es algo que saben quienes disponen los productos en tiendas físicas y también quienes crean páginas web. De hecho, si recientemente has contratado alguna suscripción o servicio online, es probable que esta distribución te resulte sospechosamente familiar:

Esta es una captura de la página de suscripción a The Economist. Pero la idea no es precisamente original. La misma idea se repite una y otra vez. Sencillamente, porque funciona.

Exámenes tipo test

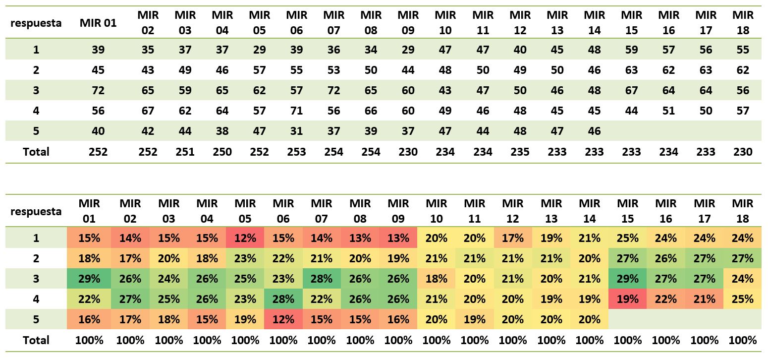

El MIR es, quizás, una de las pruebas más exigentes a las que se enfrenta todo médico durante su carrera. Sin embargo, hasta hace algunos años, los estudiantes recién salidos de la facultad podían contar con una pequeña ventaja. Si algún concepto sobre anatomía humana se les escapaba, siempre podían jugársela con la psicología: debido a los sesgos de quienes habían diseñado el examen, no todas las respuestas eran correctas con igual probabilidad. Según me cuentan los doctores Elena Alvar y Julián Palacios (especialistas en anestesiología y cardiología, respectivamente), este hecho era ampliamente conocido por los estudiantes y se contaba en algunos cursos de preparación a las pruebas. Las respuestas correctas seguían una distribución muy similar a las de las carreras de tortugas. Los examinadores, sin saberlo, tendían a colocar las respuestas correctas con mayor probabilidad hacia el centro. Los estudiantes, incluso sin haberlo sabido, hubiesen optado por ellas también: el sesgo funciona en ambos sentidos y quienes se someten en este tipo de tests, tienden a buscar la respuesta correcta lejos de los extremos.

Esta colaboración no buscada entre examinadores y examinados tiende a darse en todas las pruebas de elección múltiple10. Pero en el caso del MIR tuvo su fin hacia 2010. Desde ese año y hasta 2014, el Ministerio hizo un esfuerzo deliberado por equilibrar la distribución de aciertos entre las 5 respuestas posibles. En 2015, los exámenes pasaron a tener cuatro alternativas en lugar de 5 y parece que los resultados han vuelto a perder el equilibrio favoreciendo ligerísimamente las opciones de en medio. El margen es tan leve que nadie se va a librar de estudiar. Pero ante la duda… siempre mejor quedarse con la segunda o tercera tortuga.

Distribución de las respuestas correctas, según su posición, en las pruebas del MIR, año a año. Fuente.

Distribución de las respuestas correctas, según su posición, en las pruebas del MIR, año a año. Fuente.Referencias:

1Raghubir, P. & Valenzuela. (2006). Centre-of-inattention: Position biases in decision-making. Organisational Behaviour and Human Decision Processes, 99, 66-80

2Paul Rodway Astrid Schepman & Jordana Lambert (2011). Preferring the One in the Middle: Further Evidence for the Centre‐stage Effect. Applied cognitive Psychology.

3Maya Bar-Hillel (2015). Position Effects in Choice From Simultaneous Displays: A Conundrum Solved. Perspectives on Psychological Science.

4Paul Rodway, Astrid Schepman, Volker Thoma (2015). Reachability Does Not Explain the Middle Preference: A Comment on Bar-Hillel

5Benjamin W. Tatler (2007). The central fixation bias in scene viewing: Selecting an optimal viewing position independently of motor biases and image feature distributions. Journal of Vision.

6 A. Selin Atalay, H. Onur Bodur, and Dina Rasolofoarison (2012). Shining in the Center: Central Gaze Cascade Effect on Product Choice. Journal of Consumer Research.

7Valenzuela, Ana & Raghubir, Priya. (2009). Position-based beliefs: The center-stage effect. Journal of Consumer Psychology,

8Jerry I. Shaw, Jon E. Bergen, Chad A. Brown & Maureen E. Gallagher (2000) Centrality Preferences in Choices Among Similar Options, The Journal of General Psychology,

9Nicholas Christenfeld (1995). Choices from Iden tical Options. Psychological Science,

10Attali, Yigal & Bar-Hillel, Maya (2003). Guess Where: The Position of Correct Answers in Multiple‐Choice Test Items as a Psychometric Variable. Journal of Educational Measurement.

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo El efecto escenario: por qué la gente elige la opción de en medio se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Estas Navidades no engordarás medio kilo

- Los números feos de la lotería

- ¿Cuánta gente ha vivido en la Tierra?

Las curvas del espirógrafo

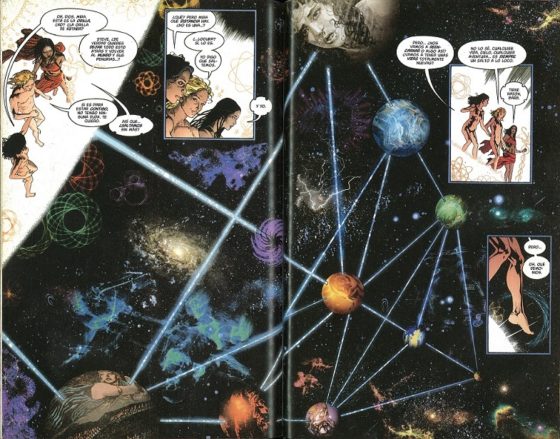

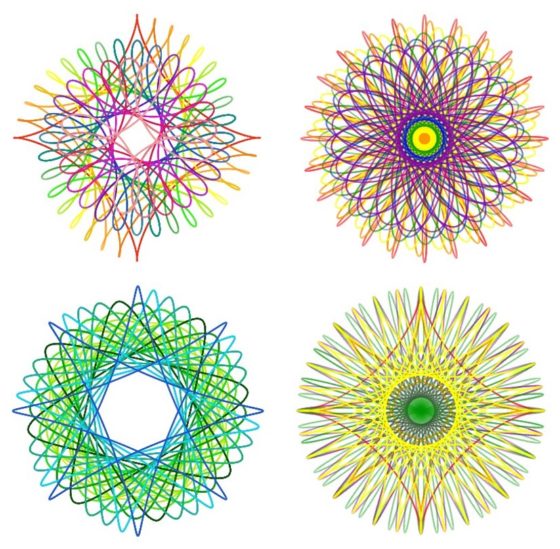

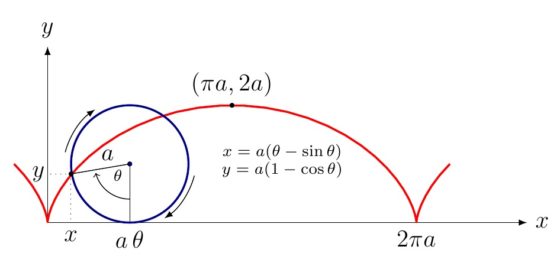

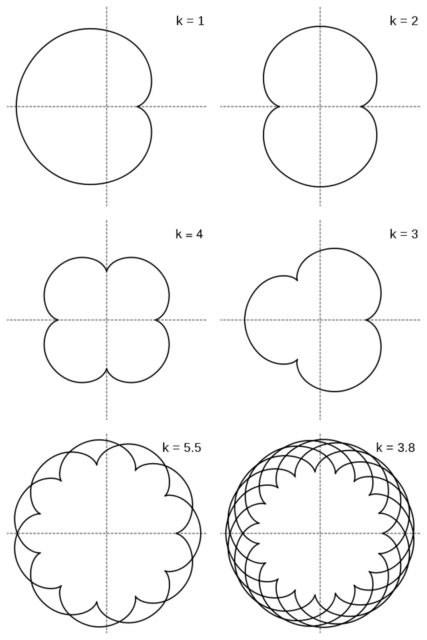

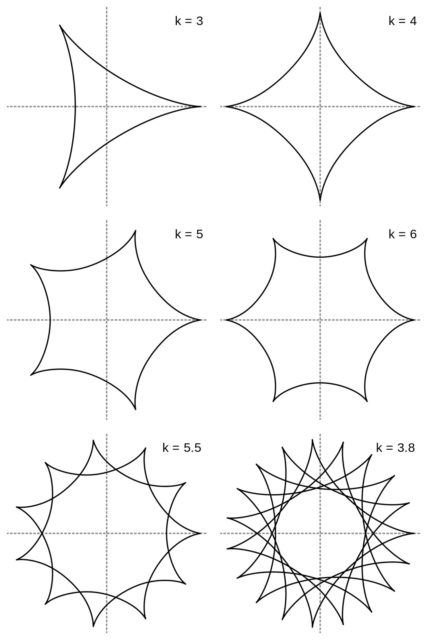

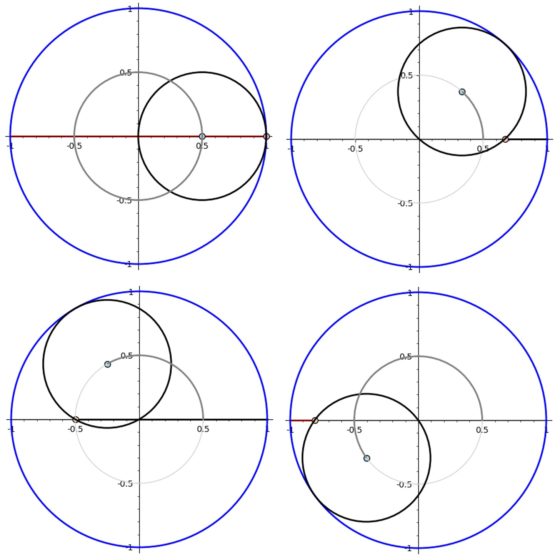

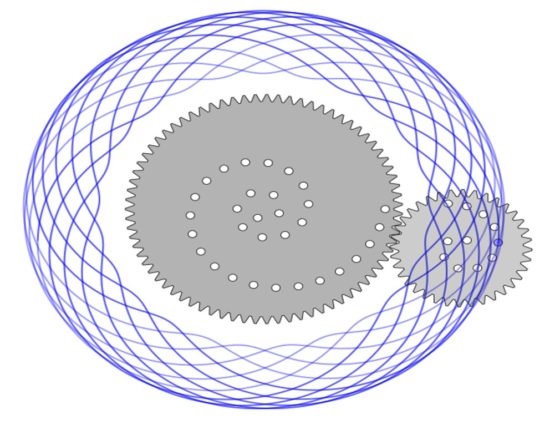

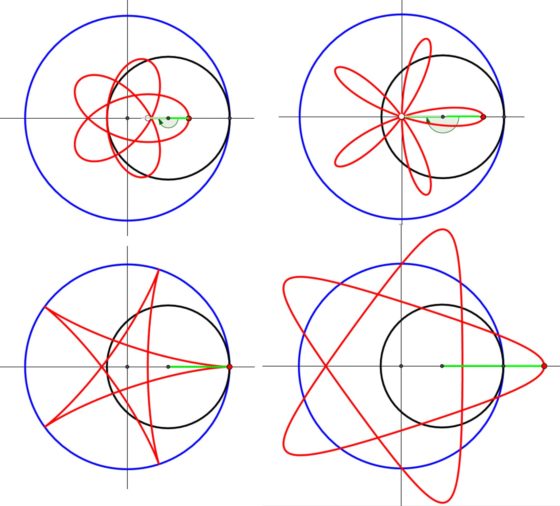

En mi anterior entrada del Cuaderno de Cultura Científica Guía matemática para el cómic ‘Promethea’, sobre las referencias matemáticas que aparecen en Promethea (1999-2005), del guionista Alan Moore y el dibujante James H. Williams III, mencioné que en algunas partes del mismo aparecían “curvas hipotrocoides dibujadas con un espirógrafo”, como las que se pueden ver en la siguiente imagen.

Doble página del cómic Promethea, de Alan Moore (guion) y J.H. Williams III (dibujo)

Doble página del cómic Promethea, de Alan Moore (guion) y J.H. Williams III (dibujo)

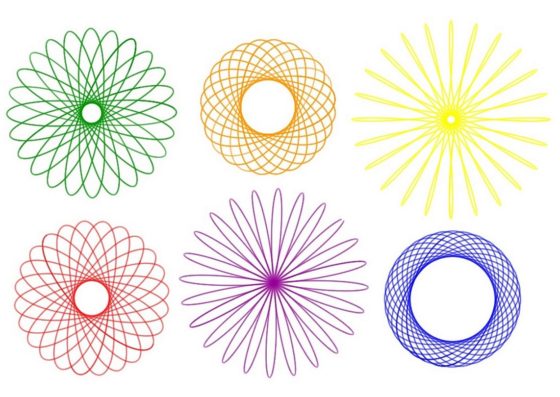

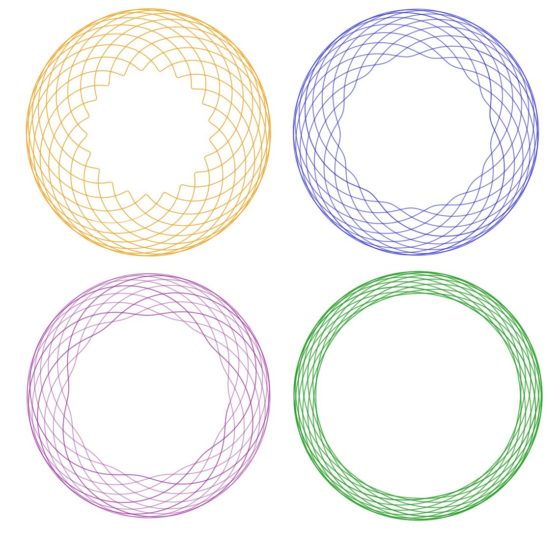

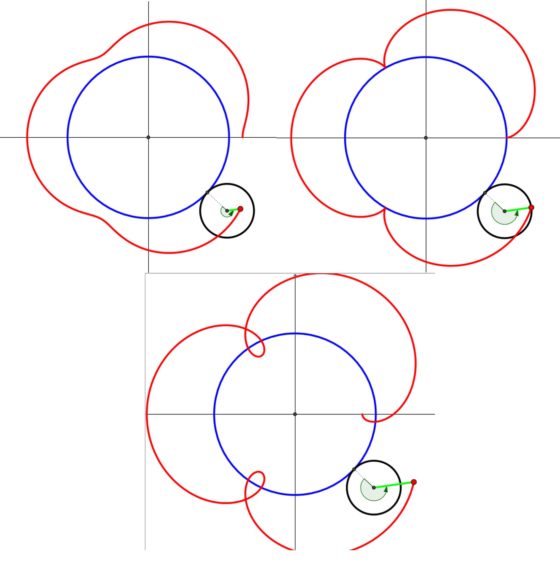

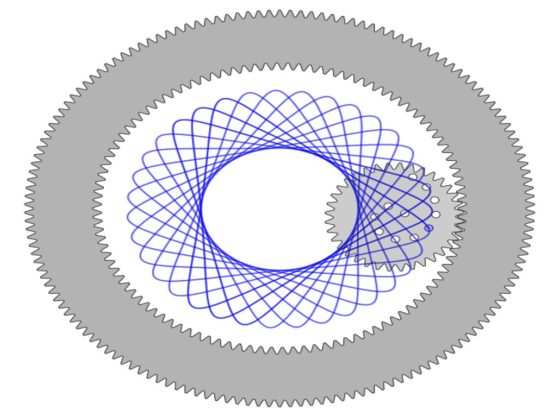

Si nos fijamos en las curvas que aparecen dibujadas en el cómic es posible que nos recuerden a los diseños geométricos realizados con un juguete llamado espirógrafo, con el que tal vez jugamos en nuestra infancia. Diseños geométricos como los que aparecen en la siguiente imagen.

O también los dibujos de esta otra imagen.

Estos diseños geométricos los he realizado con el Inspirograph, que es una réplica digital del espirógrafo desarrollada por el ingeniero canadiense Nathan Friend.

“Kate conocía a todos los tenderos y se llevaba bien con ellos. La verdulería la llevaban Eric y su mujer Mavis. No tenían hijos, pero eran amables con Kate y todas las navidades le compraban un regalo con el que –era increíble– siempre daban en el clavo. El año pasado le habían comprado un espirógrafo, y Kate lo había utilizado para confeccionar un logotipo para sus tarjetas de visita.”

[Katherine O Flynn, Lo que perdimos, Alfaguara, 2009]

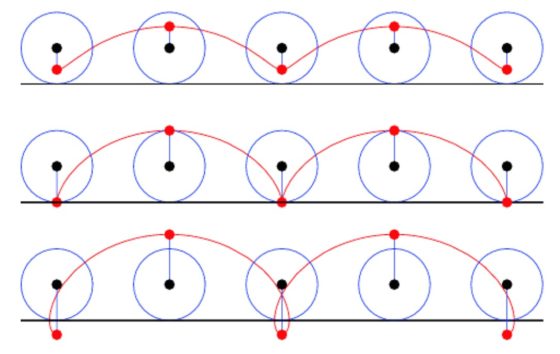

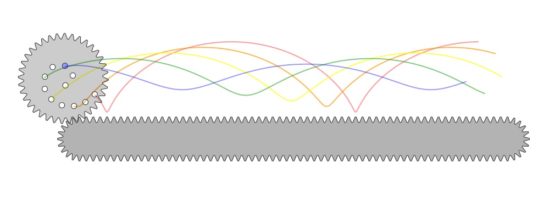

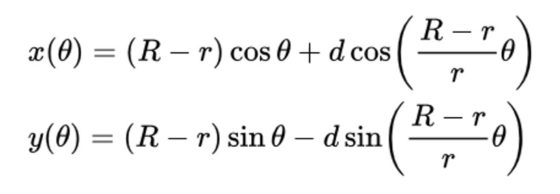

El espirógrafo es un juguete con el que dibujar diseños geométricos que consisten en curvas cíclicas, en concreto, las curvas conocidas con los nombres de hipotrocoides (como los primeros dibujos que hemos trazado) y epitrocoides (como los segundos dibujos), que describiremos matemáticamente más adelante. Este juguete consiste en una serie de engranajes o ruedas dentadas –círculos o coronas circulares en la versión original y más sencilla, pero con formas más complejas en la actualidad–, de tal forma que al girar una rueda dentada sobre la otra, que permanece fija, se producen los diseños geométricos. El dibujo se realiza con un lápiz o rotulador cuya punta se coloca en uno de los agujeros que tiene el interior de la rueda dentada que se hace girar. La rueda dentada fija puede ser tanto una corona circular dentada, de forma que se puede girar la otra rueda dentada tanto por el exterior (generando las curvas epitrocoides), como por el interior (generando las curvas hipotrocoides), de las que solía haber dos en el juego, o un círculo dentado de diferentes tamaños sobre el que solo se puede hacer girar la otra por el exterior (generando hipotrocoides).

Versión del juguete espirógrafo fabricada por Palitoy y vendida en Gran Bretaña en la década de los años 1980. Imagen: Multicherry / Wikimedia Commons

Versión del juguete espirógrafo fabricada por Palitoy y vendida en Gran Bretaña en la década de los años 1980. Imagen: Multicherry / Wikimedia Commons

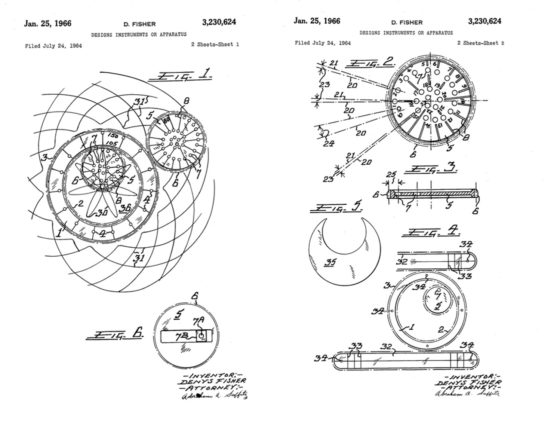

El espirógrafo fue creado por el ingeniero británico Denys Fisher (1918-2002) en los primeros años de la década de 1960. Animado por su familia y amigos, el ingeniero británico fundó Denys Fisher Toys (que en 1970 compraría la empresa Palitoy, la cual acabaría formando parte de Hasbro en 1991) y empezó a comercializar el juguete. Se presentó en la Feria Internacional de Juguetes de Nurenberg en 1965 y fue declarado juguete británico del año en 1967. Fue patentado en 16 países. La siguiente imagen es de la patente de 1966 en Estados Unidos.

Imágenes pertenecientes a la patente en EEUU del espirógrafo de Denys Fisher, US32230624

Imágenes pertenecientes a la patente en EEUU del espirógrafo de Denys Fisher, US32230624

El juego fue todo un éxito. Además, evolucionó rápidamente incluyendo engranajes de formas variadas, que permitían diseños geométricos cada vez más sofisticados y originales. En 2013 la compañía de juguetes Kahootz relanzó el espirógrafo y ganó varios premios, como el Astra Best Toys for Kids de 2013, así mismo fue finalista a juguete del año en 2014.

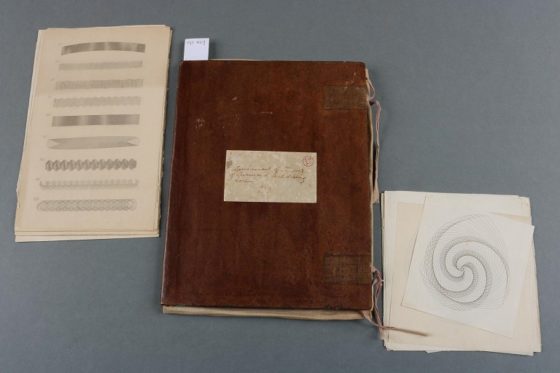

Pero mencionemos algunos antecedentes de la creación del ingeniero británico Denys Fisher. En 1827 el ingeniero y arquitecto británico Peter Hubert Desvignes (1804-1883) diseñó un mecanismo que llamó “speiragraph” y que servía para dibujar complejas curvas de tipo espiral. El objetivo de este mecanismo era crear diseños que ayudasen a evitar las falsificaciones de los billetes.

Carpeta con 26 hojas de papel que contienen dibujos realizados con el “speiragraph” de Peter Hubert Desvignes, perteneciente al Science Museum Group. A la izquierda se observa una hoja con una serie de dibujos horizontales de curvas de tipo espiral, mientras que a la derecha hay una hoja con un dibujo de tipo circular de una curva espiral

Carpeta con 26 hojas de papel que contienen dibujos realizados con el “speiragraph” de Peter Hubert Desvignes, perteneciente al Science Museum Group. A la izquierda se observa una hoja con una serie de dibujos horizontales de curvas de tipo espiral, mientras que a la derecha hay una hoja con un dibujo de tipo circular de una curva espiral

El matemático, ingeniero eléctrico e inventor polaco Bruno Abakanowicz (1852-1900), quien inventaría mecanismos como el intégrafo, para representar la integral de una función definida gráficamente, y el parabológrafo, para trazar parábolas, inventó otro mecanismo con el nombre de “spirograh” (espirógrafo), entre 1881 y 1900, que también debía trazar curvas de tipo espiral (spiro + graph), aunque no he podido encontrar ninguna referencia directa del mismo.

El primer juguete precursor del espirógrafo fue el llamado “The Marvelous Wondergraph” con el que realizar diseños geométricos de curvas espirales, pero que pasó bastante desapercibido. En la publicación The Boy Mechanic apareció en 1913 un artículo explicando cómo construir tu propio wandergraph.

Juguete The Marvelous Wondergraph, perteneciente al The Children’s Museum of Indianapolis

Juguete The Marvelous Wondergraph, perteneciente al The Children’s Museum of Indianapolis

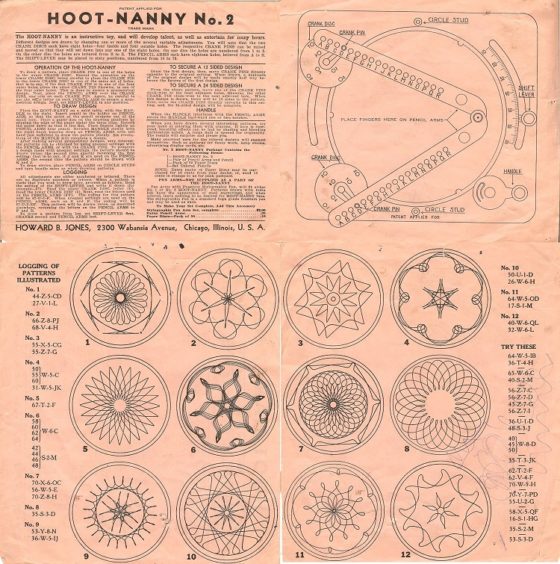

En la década de los años 1930 se comercializó otro juguete para trazar diseños geométricos de curvas, llamado “Hoot-Nanny, The Magic Desiner”, que tuvo más éxito que el anterior y se vendió hasta la década de los años 1950. En la siguiente imagen vemos las instrucciones originales del juguete, con algunas de las curvas que podían trazarse con el mismo. Además, hay un simulador en la red del Hoot-Nanny, con el que podéis divertiros trazando curvas curiosas.

Instrucciones originales del juguete Hoot-Nanny

Instrucciones originales del juguete Hoot-Nanny

Aunque el juguete espirógrafo del ingeniero británico Denys Fisher fue el que más éxito alcanzó, quizás por la sencillez de su diseño y su manejo, por lo que también trazaba curvas más sencillas, o tal vez porque en los años 60 la sociedad estaba más abierta a este tipo de imágenes geométricas, ya que era el tiempo de la psicodelia y del arte pop.

Diseños geométricos realizados con el espirógrafo digital Inspirograph

Diseños geométricos realizados con el espirógrafo digital Inspirograph