Oppenheimer: dilemas de la ciencia

En el marco de ciclo de cine organizado por Filmoteca Vasca y el Donostia International Physics Center (DIPC), el presidente del DIPC, Pedro Miguel Etxenike, impartió la conferencia titulada «Oppenheimer: el dilema de la ciencia». Esta charla sirvió como introducción a la proyección en el Bizkaia Aretoa del primer título del ciclo, «Oppenheimer», de Christopher Nolan, el pasado 13 de enero. La presentación del conferenciante corre a cargo del físico y director de Euskampus Fundazioa, Igor Campillo.

El documental mencionado en la presentación puede verse aquí: El secreto de la naturaleza

Edición realizada por César Tomé López

El artículo Oppenheimer: dilemas de la ciencia se ha escrito en Cuaderno de Cultura Científica.

Ansiedad, TACR3 y testosterona

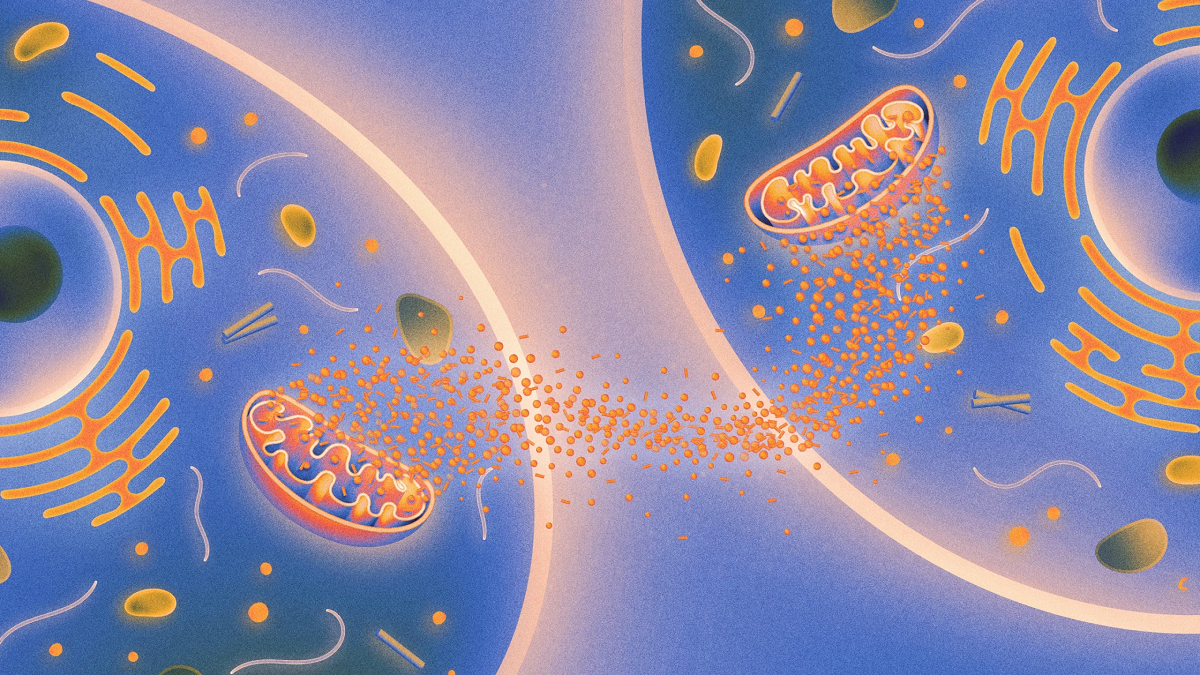

Existe una conexión significativa entre los trastornos de ansiedad, un receptor cerebral conocido como TACR3 y la testosterona. Así lo ha puesto de manifiesto un estudio con ratas dirigido por la profesora e investigadora Ikerbasque Shira Knafo en el Laboratorio de la Cognición Molecular de la UPV/EHU.

La ansiedad es una respuesta común al estrés, pero para todos aquellos que lidian con trastornos de ansiedad, el impacto en la vida diaria puede ser muy significativo. La evidencia clínica ha insinuado una estrecha relación entre los niveles bajos de testosterona y la ansiedad, especialmente en hombres con hipogonadismo, una condición caracterizada por una función sexual reducida. Sin embargo, la naturaleza precisa de esta relación ha permanecido poco clara hasta ahora.

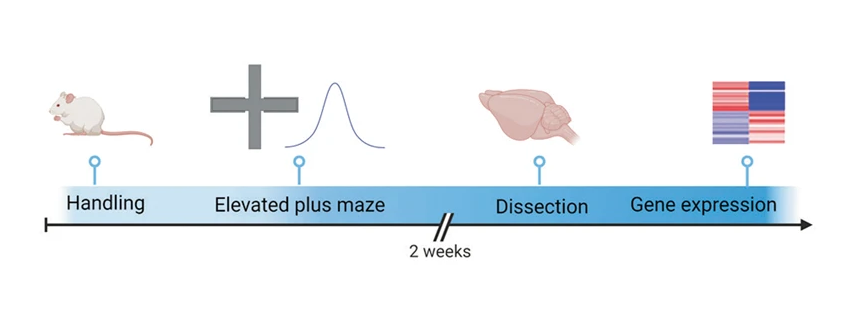

Diseño experimental del estudio. Fuente: Referencia

Diseño experimental del estudio. Fuente: ReferenciaEl estudio comenzó con un descubrimiento fascinante: los animales machos que exhibían niveles extremadamente altos de ansiedad tenían notablemente menos receptores específicos llamados TACR3 en su hipocampo. El hipocampo es una región cerebral estrechamente relacionada con los procesos de aprendizaje y memoria. TACR3 es parte de la familia de receptores taquicinina y responde a una sustancia conocida como neuroquinina. Esta observación despertó la curiosidad de los investigadores y sirvió como base para una investigación exhaustiva sobre la relación entre la deficiencia de TACR3, las hormonas sexuales, la ansiedad y la plasticidad sináptica.

Los animales se clasificaron según su comportamiento en una prueba estándar de resolución de un laberinto, que mide los niveles de ansiedad. Posteriormente, se aislaron sus hipocampos y se sometieron a un análisis de expresión génica para identificar genes con expresión diferencial entre los animales con ansiedad extremadamente baja y los que tenían ansiedad severa. Uno de los genes que destacó fue TACR3. Investigaciones anteriores habían revelado que las mutaciones en genes asociados con TACR3 conducían a una condición conocida como «hipogonadismo congénito», lo que resultaba en una producción reducida de hormonas sexuales, incluyendo la testosterona. Es importante destacar que los hombres jóvenes con bajos niveles de testosterona a menudo experimentan un desarrollo sexual retrasado, acompañado de depresión y ansiedad elevada. Esto llevó a los investigadores a profundizar en el papel de TACR3 en la ansiedad.

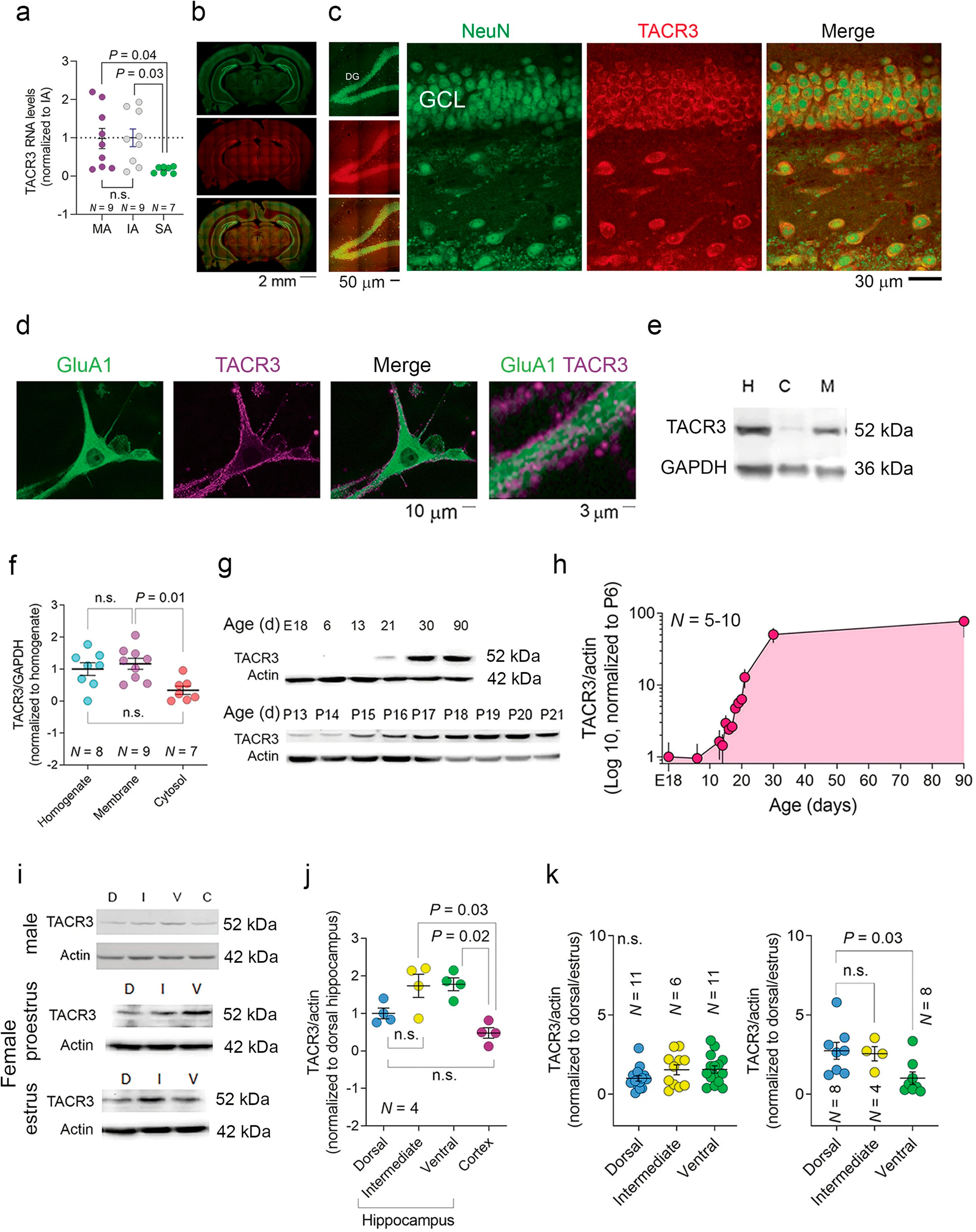

Resumen de resultados experimentales. Fuente: Referencia

Resumen de resultados experimentales. Fuente: ReferenciaEl equipo de investigación utilizó con éxito dos herramientas innovadoras creadas en su laboratorio para el estudio. La primera, llamada FORTIS, tiene la capacidad de detectar cambios en los receptores AMPA dentro de neuronas vivas. Al utilizar FORTIS, demostraron que la inhibición de TACR3 resultaba en un aumento significativo de los receptores AMPA en la superficie celular, interrumpiendo el proceso paralelo de fortalecimiento sináptico a largo plazo, conocido como LTP.

La segunda herramienta utilizada fue una aplicación novedosa de la correlación cruzada para medir la conectividad neuronal dentro de un sistema de matriz multi-electrodo. Esta herramienta desempeñó un papel fundamental al descubrir el profundo impacto de las manipulaciones de TACR3 en la plasticidad sináptica. Lo más importante es que reveló que las deficiencias derivadas de la inactividad de TACR3 podían corregirse eficazmente mediante la administración de testosterona, Ofreciendo esperanza para desarrollar nuevas pautas terapéuticas y abordar los desafíos relacionados con la ansiedad asociada a la deficiencia de la testosterona.

Esta investigación posiciona a TACR3 como un actor central en la conexión entre la ansiedad y la testosterona. El equipo ha descifrado uno de los mecanismos complejos detrás de la ansiedad y ha abierto caminos para terapias novedosas, incluyendo tratamientos con testosterona, que podrían mejorar la calidad de vida de las personas que se enfrentan a trastornos del desarrollo sexual y a la ansiedad y depresión asociadas.

Referencia:

Wojtas, M.N., Diaz-González, M., Stavtseva, N., Shoam, Y., Verma, P., Buberman, A., Izhak, I., Geva, A., Basch, R., Ouro, A., Perez-Benitez, L., Levy, U., Borcel, E., Nuñez, Á., Venero, C., Rotem-Dai, N., Veksler-Lublinsky, I. & Knafo, S. (2023) Interplay between hippocampal TACR3 and systemic testosterone in regulating anxiety-associated synaptic plasticity. Molecular Psychiatry doi: 10.1038/s41380-023-02361-z

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo Ansiedad, TACR3 y testosterona se ha escrito en Cuaderno de Cultura Científica.

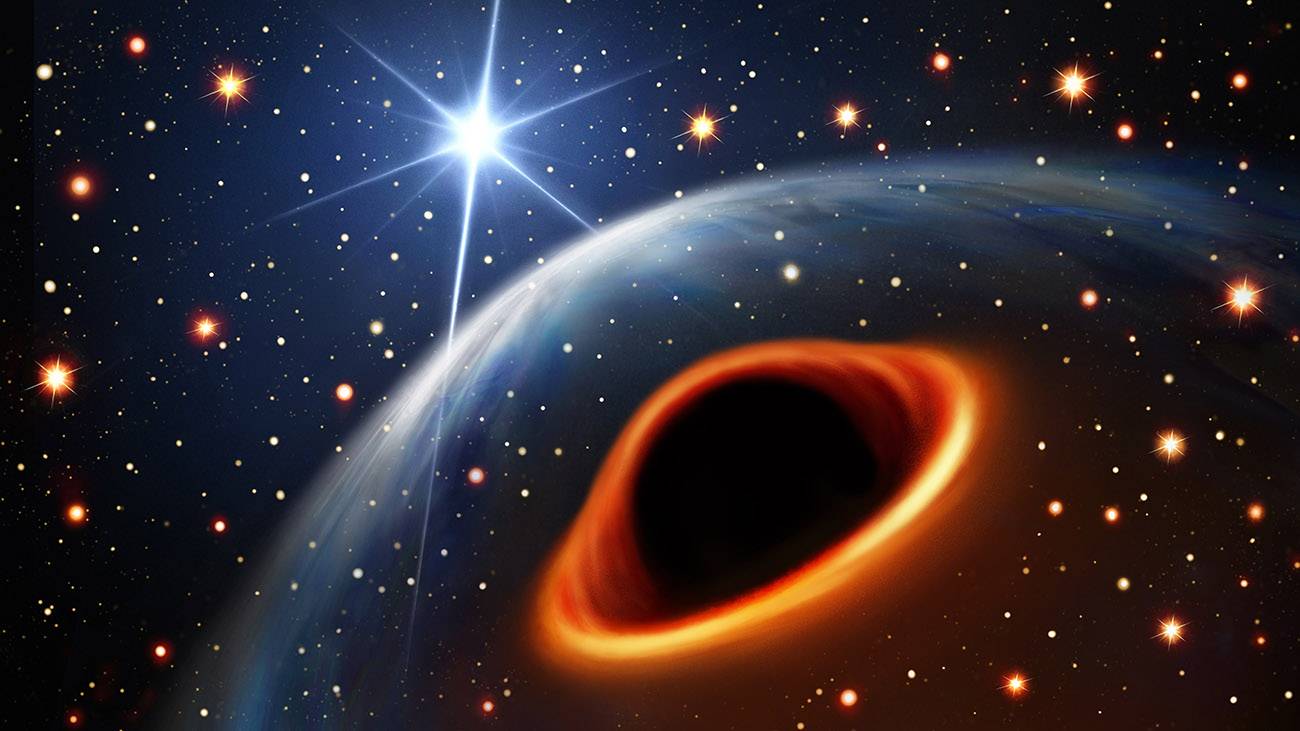

¿Agujero negro más ligero o estrella de neutrones más pesada?

Con un radiotelescopio de Sudáfrica se ha identificado un sistema binario formado por una estrella pulsante y un misterioso objeto compacto, con unas 2,35 masas solares, lo que lo sitúa en la llamada ‘brecha de masas’ entre las estrellas de neutrones y los agujeros negros. Si fuera esto último, se tendría la codiciada pareja púlsar de radio-agujero negro, que permitiría nuevos test de la relatividad general de Einstein.

lustración del sistema binario suponiendo que el objeto compacto descubierto sea un agujero negro, junto al púlsar de radio PSR J0514-4002E (la estrella compañera más brillante del fondo). Ambos estarían separados por 8 millones de kilómetros y giran uno alrededor de la otra cada 7 días. Fuente: MPIfR / Daniëlle Futselaar (artsource.nl)

lustración del sistema binario suponiendo que el objeto compacto descubierto sea un agujero negro, junto al púlsar de radio PSR J0514-4002E (la estrella compañera más brillante del fondo). Ambos estarían separados por 8 millones de kilómetros y giran uno alrededor de la otra cada 7 días. Fuente: MPIfR / Daniëlle Futselaar (artsource.nl)Las estrellas de neutrones, los restos ultradensos de la explosión de una supernova, solo pueden tener un peso limitado. Una vez que adquieren demasiada masa, por absorber o colisionar con otra estrella, se colapsan. Se ha especulado mucho sobre en qué se convierten luego, pero la opinión predominante es que en agujeros negros, objetos tan gravitatoriamente potentes que ni siquiera la luz puede escapar de ellos.

La teoría, respaldada por la observación, indica que los agujeros negros más ligeros que pueden crearse por el colapso de estrellas son unas 5 veces más masivos que el Sol, es decir, que tienen unas 5 masas solares. Esto es considerablemente mayor que las 2,2 masas solares que se requieren para que colapse una estrella de neutrones (las más masivas tienen hasta 2,5), dando lugar a lo que se conoce como la brecha de masa de los agujeros negros. Se desconoce la naturaleza de los objetos compactos que se encuentran dentro de este ‘hueco’, ya que solo se han captado algunos datos en lejanos eventos de fusión de ondas gravitacionales.

Ahora, el descubrimiento de un objeto en esta brecha de masa en nuestra propia galaxia por un equipo de astrónomos de la colaboración internacional TRAnsients and PUlsars with MeerKAT (TRAPUM) puede ayudar a comprender por fin lo que son.

Su trabajo, coordinado desde el alemán Instituto Max Planck de Radioastronomía (MPIfR, que colidera TRAPUM junto a la Universidad de Mánchester) y publicado esta semana en la revista Science, informa sobre una pareja masiva de estrellas u objetos compactos en el cúmulo globular NGC 1851, en la constelación austral de Columba (la paloma).

Utilizando el radiotelescopio MeerKAT de Sudáfrica, en combinación con potentes instrumentos construidos por ingenieros del MPIfR, pudieron detectar débiles pulsos procedentes de una de las estrellas, identificándola como un púlsar de radio, un tipo de estrella de neutrones que gira rápidamente y emite haces de luz de radio hacia el universo como un faro cósmico. Este púlsar, denominado PSR J0514-4002E, gira más de 170 veces por segundo, y cada rotación produce un pulso rítmico, como el tic-tac de un reloj.

Radiotelescopio MeerKAT, situado en el semidesierto de Karoo, en Sudáfrica. Fuente: SARAO

Radiotelescopio MeerKAT, situado en el semidesierto de Karoo, en Sudáfrica. Fuente: SARAOMediante la observación de pequeños cambios en este tic-tac a lo largo del tiempo, utilizando una técnica llamada pulsar timing o cronometraje de púlsares, fueron capaces de realizar mediciones extremadamente precisas de su movimiento orbital.

«Es como orbitar un cronómetro casi perfecto alrededor de una estrella a casi 40.000 años luz de distancia y cronometrar esas órbitas con una precisión de microsegundos», explica Ewan Barr, que dirigió el estudio junto con Arunima Dutta, colega y doctoranda del MPIfR.

Esa temporización regular también permitió medir con gran precisión la ubicación del sistema, lo que demostró que el objeto que se mueve junto al púlsar no era una estrella normal (es invisible en las imágenes de NGC 1851 del telescopio espacial Hubble), sino un resto extremadamente denso de una estrella colapsada.

Además, el cambio observado en el tiempo del punto más cercano de aproximación entre las dos estrellas u objetos (el periastro) mostró que la compañera o compañero tiene una masa que es mayor que la de cualquier estrella de neutrones conocida pero menor que la de cualquier agujero negro conocido, lo que la sitúa directamente en la brecha de masa de los agujeros negros.

Como las estrellas de neutrones más masivas suelen tener entre 2,2 y 2,5 masas solares (más cerca de lo primero, aunque es objeto de debate), mientras que los agujeros negros de menos de 5 masas solares rara vez se observan, ¿qué es entonces este misterioso objeto compacto, que tiene entre 2,09 y 2,71 masas solares?

“Depende de cuál sea realmente la masa máxima de las estrellas de neutrones”, subraya Barr a SINC, y lo explica: “Existen pruebas convincentes, procedentes de fusiones por ondas gravitacionales, de que la masa máxima de una estrella de neutrones se sitúa en torno a 2,17. Según nuestras observaciones, la masa más probable de la compañera es de 2,35 masas solares. Basándonos en esto, el balance de probabilidades sugiere que lo que hemos encontrado es demasiado pesado para ser una estrella de neutrones y, por tanto, es más probable que sea un agujero negro”.

“Sin embargo, sinceramente, yo no me fiaría ni de lo uno ni de lo otro –comenta–. La masa por sí sola no es una prueba especialmente persuasiva para una u otra interpretación y es seguro que tras hacer público este resultado habrá teóricos que soñarán con nuevas formas de crear estrellas de neutrones ultramasivas”.

¿Y si fuera una estrella de quarks?Respecto a la posibilidad de que no sea ni una estrella de neutrones ni un agujero negro, apunta: «La probabilidad de que eso ocurra es extremadamente pequeña. Existen objetos teóricos más densos que una estrella de neutrones, pero no lo suficiente como para colapsar y convertirse en un agujero negro. Un candidato es una estrella de quarks compuesta por una especie de plasma estable de quarks y gluones que no se colapsa debido a las fuerzas de repulsión entre estos quarks. Una estrella así sería masiva y densa, pero también muy difícil de detectar directamente debido a la falta de emisión electromagnética. Por el momento, no existen pruebas convincentes de la existencia de este tipo de estrellas».

«Sea lo que sea este objeto, es una noticia apasionante», afirma Paulo Freire, también del MPIfR. «Si es un agujero negro, será el primer sistema púlsar-agujero negro conocido, que ha sido el Santo Grial de la astronomía de púlsares durante décadas», indica. Esta codiciada pareja estelar permitiría realizar nuevas pruebas o test de la relatividad general de Einstein.

«Y si es una estrella de neutrones –continúa–, tendrá implicaciones fundamentales para nuestra comprensión del desconocido estado de la materia a estas increíbles densidades».

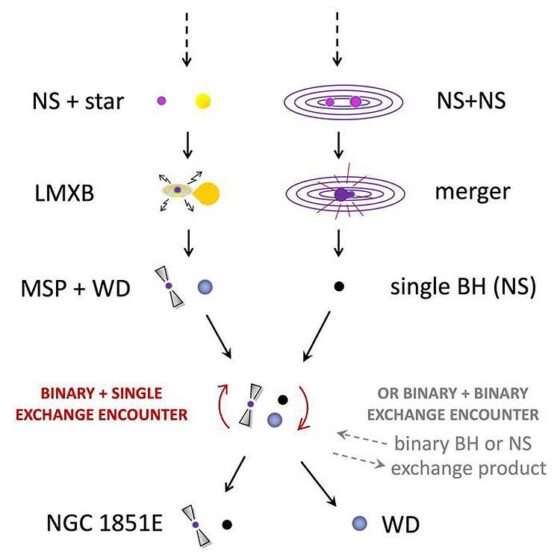

Una historia de formación exóticaEl equipo propone que la formación del objeto masivo, y su posterior emparejamiento con el púlsar de radio de giro rápido en una órbita estrecha, es el resultado de una historia de formación bastante exótica, solo posible debido a su particular entorno local. Este sistema se encuentra en un cúmulo globular (NGC 1851) con una densa colección de estrellas viejas que están mucho más apretadas que las del resto de la galaxia. Aquí, la aglomeración es tal que las estrellas pueden interactuar entre sí, perturbando sus órbitas y, en los casos más extremos, colisionando.

La explicación sobre su posible formación no es sencilla. Se cree que una de esas colisiones entre dos estrellas de neutrones creó el objeto masivo misterioso (sea agujero negro o estrella de neutrones). Por su parte, el púlsar de radio (de milisegundos, MSP) debió adquirir material de una estrella donante en una binaria de rayos X de baja masa (LMXB).

Este proceso de «reciclaje» es necesario para que el púlsar alcance su velocidad de rotación actual. Los autores creen que esta estrella donante (que quedó como enana blanca, WD) fue sustituida por el objeto masivo actual durante un encuentro de intercambio.

Posible historia de formación del púlsar de radio NGC 1851E y su exótico compañero. Fuente: Thomas Tauris (Aalborg University / MPIfR)

Posible historia de formación del púlsar de radio NGC 1851E y su exótico compañero. Fuente: Thomas Tauris (Aalborg University / MPIfR)«Se trata del púlsar binario más exótico descubierto hasta ahora», afirma el coautor Thomas Tauris, de la Universidad de Aalborg (Dinamarca), «y su larga y compleja historia de formación supera los límites de nuestra imaginación».

Aunque el equipo no puede afirmar de forma concluyente si han encontrado la estrella de neutrones más masiva conocida, el agujero negro más ligero conocido o incluso alguna nueva variante de estrella exótica, lo cierto es que han descubierto un laboratorio único para sondear las propiedades de la materia en las condiciones más extremas del universo.

«Aún no hemos terminado con este sistema», afirma Arunima Dutta, que concluye: «Descubrir la verdadera naturaleza de la compañera será un punto de inflexión en nuestra comprensión de las estrellas de neutrones, los agujeros negros y cualquier otra cosa que pueda estar al acecho en la brecha de masa de los agujeros negros».

Próximos pasos para resolver el misterioPor su parte, Barr comenta los próximos pasos: “Estamos realizando observaciones para detectar cambios en la señal del púlsar debidos al campo gravitatorio de su pareja. La detección de estos efectos nos indicaría con mayor seguridad cuál es la masa del púlsar y del objeto compacto. El radiotelescopio MeerKAT no es lo suficientemente sensible para detectar estos efectos, y esperamos con impaciencia la llegada de nuevos instrumentos, como el telescopio Square Kilometre Array, que debería detectar fácilmente estos cambios”.

“Hay un efecto relativista en particular que nos interesa, llamado precesión Lense-Thirring, que se produce en presencia de objetos fuertemente gravitatorios (básicamente, los objetos arrastran consigo el espacio-tiempo a medida que giran, como las corrientes en el océano). A diferencia de otros efectos, que solo nos indicarían la masa de la estrella u objeto compañero, la detección de la precesión Lense-Thirring nos informa sobre la velocidad a la que gira. Se espera que los agujeros negros giren mucho más rápido que las estrellas de neutrones, por lo que esto nos daría una forma directa de saber cuál de los dos es”. La investigación del enigmático objeto continúa.

Referencia:

Ewan Barr, Arunima Dutta et al. (2024) A pulsar in a binary with a compact object in the mass gap between neutron stars and black holes Science doi: 10.1126/science.adg300

Una versión de este artículo fue publicada originalmente en SINC el 18 de enero de 2024. Autor: Enrique Sacristán.

El artículo ¿Agujero negro más ligero o estrella de neutrones más pesada? se ha escrito en Cuaderno de Cultura Científica.

Los sólidos platónicos

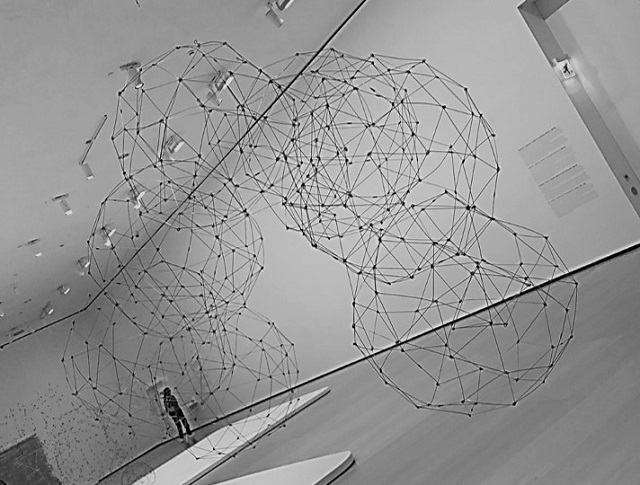

Recientemente, he tenido el placer de organizar una visita, con ojos matemáticos, a la maravillosa exposición Gego, mirando el infinito, que el Museo Guggenheim Bilbao acoge estos días, del 7 de noviembre de 2023 al 4 de febrero de 2024. Gertrude Goldschmidt (Hamburgo, 1912–Caracas, 1994), cuyo nombre artístico es Gego, fue una artista venezolana, de origen alemán, pionera del arte abstracto latinoamericano, cuya obra artística podemos enmarcar dentro de las corrientes de la abstracción geométrica, el arte cinético y el arte óptico, con una fuerte influencia matemática. Entre las obras que se pueden admirar en esta exposición hay esculturas colgantes como Esfera n. 2 (1976), Esfera n. 4 (1976) o Siete icosidodecaedros (1977), de su serie Esferas, que son poliedros, esto es, figuras geométricas tridimensionales, cuyas caras planas son polígonos y se unen unas con otras a través de sus lados y que, además, encierran un volumen finito. Algunos de esos poliedros, en particular, los de la escultura Siete icosidodecaedros, pertenecen a la familia de poliedros denominada sólidos arquimedianos, como expliqué en la mencionada visita y sobre los que tenía la intención de escribir en esta entrada del Cuaderno de Cultura Científica. Sin embargo, no tiene sentido explicar qué son los sólidos arquimedianos sin pasar primero por los sólidos platónicos, que es lo que vamos a hacer finalmente en esta anotación.

Escultura colgante Siete icosidodecaedros (1977), de la artista venezolana, de origen alemán, Gego, que forma parte de la exposición Gego, mirando el infinito, (Museo Guggenheim Bilbao, 7 de noviembre de 2023 – 4 de febrero de 2024). Fotografía: Raúl IbáñezLos sólidos platónicos

Escultura colgante Siete icosidodecaedros (1977), de la artista venezolana, de origen alemán, Gego, que forma parte de la exposición Gego, mirando el infinito, (Museo Guggenheim Bilbao, 7 de noviembre de 2023 – 4 de febrero de 2024). Fotografía: Raúl IbáñezLos sólidos platónicos

Para introducir a los sólidos platónicos primero vamos a definir de forma sencilla qué es un poliedro. Un poliedro es una figura geométrica tridimensional formada por caras poligonales planas (triángulos, cuadriláteros, pentágonos, hexágonos, etc; aunque también podrían ser estrellados, como la estrella pentagonal (pentagrama o pentalfa), y la estrella hexagonal (hexagrama o estrella de David), que generan curiosos poliedros que se autointersecan, aunque en esta entrada no vamos a dedicar mucha atención a estos), aristas rectas (que son los lados compartidos de cualesquiera dos caras poligonales planas) y los vértices (que son los puntos en los que se juntan las aristas).

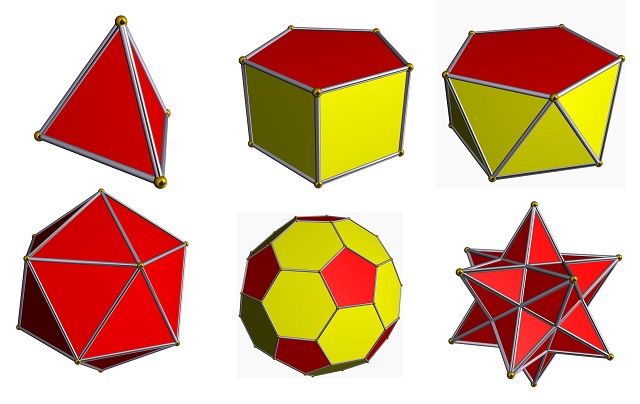

Algunos ejemplos de poliedros, desde el tetraedro, que es una pirámide triangular, pasando por el prisma y el antiprisma pentagonales, el icosaedro formado por 20 triángulos, el icosaedro truncado, formado por pentágonos y hexágonos, que fue la forma de los balones de fútbol durante años, y un poliedro estrellado, más complejo de ver, ya que sus caras son estrellas pentagonales y, por lo tanto, se autointersecan. Imágenes de Tomruen, a través de Wikimedia Commons

Algunos ejemplos de poliedros, desde el tetraedro, que es una pirámide triangular, pasando por el prisma y el antiprisma pentagonales, el icosaedro formado por 20 triángulos, el icosaedro truncado, formado por pentágonos y hexágonos, que fue la forma de los balones de fútbol durante años, y un poliedro estrellado, más complejo de ver, ya que sus caras son estrellas pentagonales y, por lo tanto, se autointersecan. Imágenes de Tomruen, a través de Wikimedia Commons

La anterior definición es imprecisa. Aunque nuestro objetivo no es dar una definición estricta de poliedro, si matizaremos un poco la definición. Por una parte, cada cara del poliedro tiene que estar en un plano distinto a los planos de las demás caras y, por otra parte, consideraremos que los poliedros encierran un volumen finito (en particular, no son abiertos).

Existen muchas familias de poliedros, por este motivo primero vamos a centrarnos en los más sencillos y regulares, los sólidos platónicos. Un sólido platónico es un poliedro regular convexo. Vamos por partes. Un poliedro es regular si sus caras son polígonos regulares (esto quiere decir que los lados del polígono, respectivamente, sus ángulos interiores, son iguales entre sí) todos iguales y la estructura de todos los vértices es la misma. Por ejemplo, el tetraedro de la anterior imagen es un poliedro regular, puesto que todas sus caras son triángulos equiláteros del mismo tamaño y la estructura de todos los vértices es la misma, cada vértice recibe tres triángulos equiláteros. Por otra parte, el concepto de poliedro convexo tiene cierta complejidad, pero podemos explicarlo de la siguiente forma. Un poliedro es convexo si dados dos puntos cualesquiera del mismo, el segmento que los une está en el interior del poliedro, como en los cinco primeros ejemplos de la imagen anterior, y no será convexo en caso contrario, como en el poliedro estrellado anterior, en el que, por ejemplo, los segmentos que unen cualesquiera dos vértices son exteriores. Otra forma de definir la convexidad es que para cualquier plano en el que se apoye una cara del poliedro, este estará colocado completamente a un solo lado de dicho plano. Por ejemplo, en el caso del tetraedro si consideramos el plano en el que descasa cualquiera de sus caras triangulares, vemos claramente que el tetraedro estará completamente colocado a un lado del plano, luego el tetraedro es un sólido platónico. Sin embargo, si tomamos el plano que contiene a cualquiera de las caras del poliedro estrellado anterior (que es una estrella pentagonal), tenemos que hay partes del poliedro a cada lado del plano, luego es no convexo.

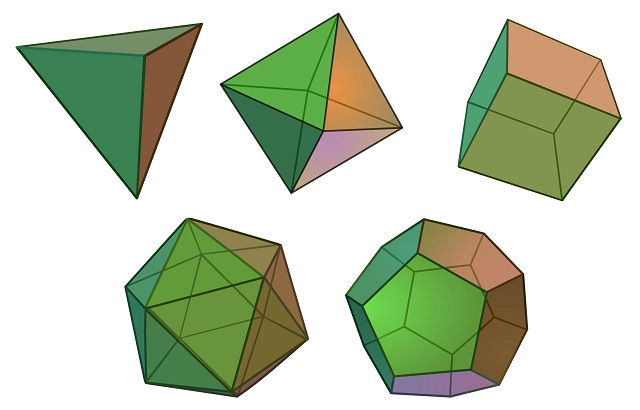

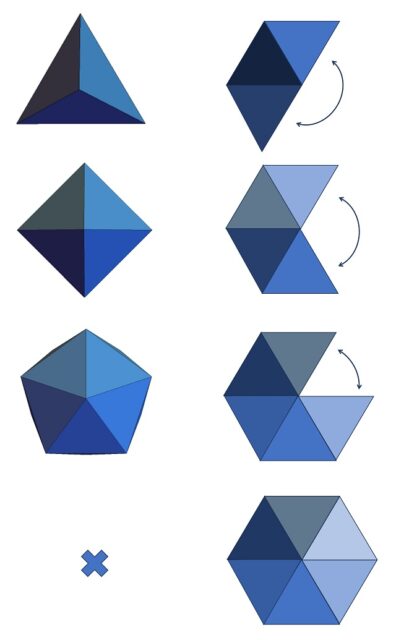

A pesar de la existencia de infinitos polígonos regulares, que van desde los sencillos triángulo equilátero (3 lados iguales), cuadrado (cuatro lados) o pentágono (5 lados), subiendo en la cantidad de lados, hexágono (6), heptágono (7), octógono (8), nonágono (9), así hasta el infinito, solamente existen cinco sólidos platónicos. A saber, el tetraedro (formado por 4 triángulos equiláteros y cuya estructura en los vértices está formada por la confluencia de tres triángulos equiláteros, lo cual podemos expresarlo como que tiene una estructura {3, 3, 3}), el octaedro (8 triángulos equiláteros y estructura de los vértices igual a {3, 3, 3, 3}), el cubo (6 cuadrados y estructura de los vértices {4, 4, 4}), el icosaedro (20 triángulos equiláteros y estructura de sus vértices {3, 3, 3, 3, 3}) y el dodecaedro (12 pentágonos y estructura de sus vértices {5, 5, 5}), que vemos en la siguiente imagen.

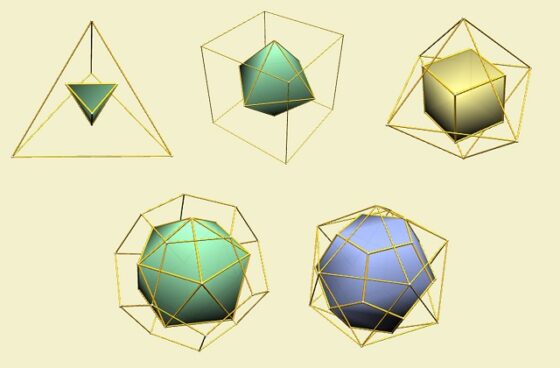

Imagen de los sólidos platónicos, tetraedro, octaedro, cuadrado, icosaedro y dodecaedro. Imagen de DTR, a través de Wikimedia Commons

Imagen de los sólidos platónicos, tetraedro, octaedro, cuadrado, icosaedro y dodecaedro. Imagen de DTR, a través de Wikimedia Commons

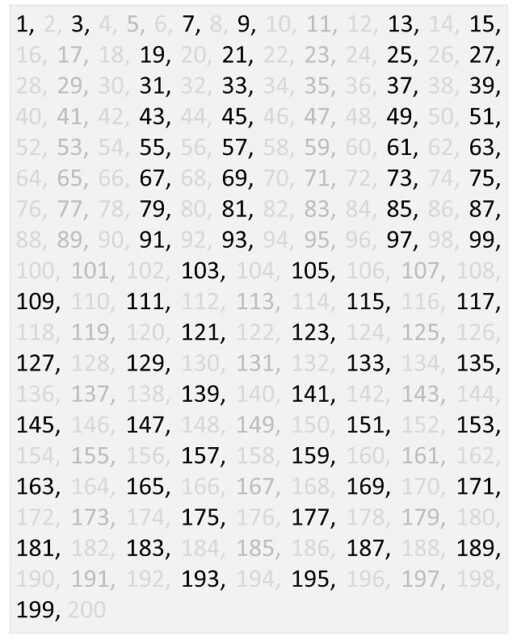

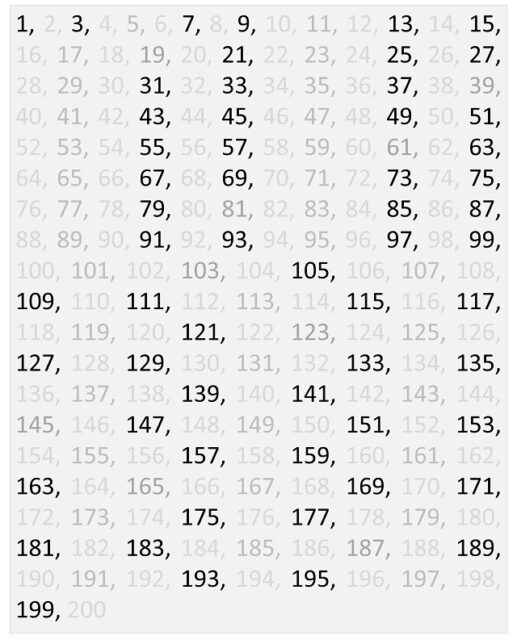

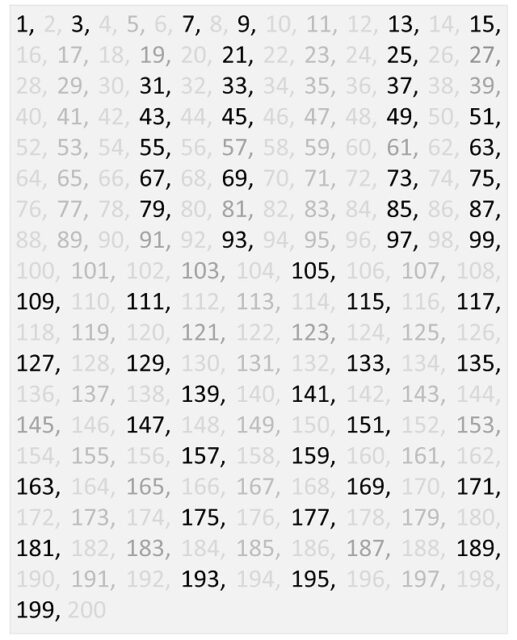

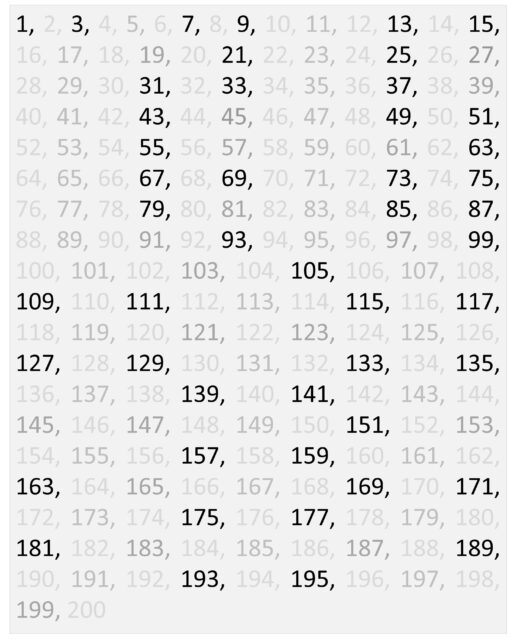

Antes de continuar, vamos a contar la cantidad de vértices, aristas y caras que tienen estos cinco poliedros regulares convexos y que recogemos en la siguiente tabla.

Los antiguos matemáticos griegos ya demostraron que tan solo existen cinco sólidos platónicos, es decir, poliedros regulares (mismas caras y mismos vértices) convexos. Por ejemplo, en la gran obra de la matemática griega, y universal, Los Elementos, del matemático griego Euclides de Alejandría (aprox. 325 – 265 a.n.e.) se estudian los sólidos platónicos (principalmente, en su libro número XIII) y se demuestra que solamente existen cinco. La idea, que es muy simple, consiste en estudiar las posibles estructuras en los vértices. Puedes saltarte la demostración, aunque es tan sencilla e intuitiva que merece la pena leerla.

Empecemos por los triángulos. Como en un plano, alrededor de un vértice, podemos disponer de seis triángulos equiláteros, puesto que 6 x 60 = 360 grados (recordemos que los ángulos interiores de un triángulo equilátero son de 60 grados), el número máximo de triángulos equiláteros alrededor de un vértice del poliedro regular convexo será, como mucho, cinco. Por lo tanto, obtenemos que solamente hay tres sólidos platónicos formados por triángulos, a saber, el tetraedro, con tres triángulos equiláteros {3, 3, 3}, el octaedro, con cuatro triángulos equiláteros {3, 3, 3, 3} y el icosaedro, con cinco triángulos equiláteros {3, 3, 3, 3, 3}. Y no hay más posibilidades. Con tan solo dos triángulos es imposible formar un poliedro cerrado, ya que no podemos cerrar la estructura en el vértice. Y con seis triángulos equiláteros la figura en el vértice sería plana, no hay manera de que sea tridimensional, y no hay espacio para encajar más de seis triángulos equiláteros alrededor de un vértice.

Imagen de los tres poliedros regulares convexos formados por triángulos, vistos con uno de sus vértices en el centro, el tetraedro (3 triángulos equiláteros por vértice), el octaedro ((4 triángulos equiláteros)) y el icosaedro (5 triángulos equiláteros) y, en cada caso, el mismo número de triángulos equiláteros en el plano que los que están alrededor de un vértice. Imagen construida a partir de imágenes de los poliedros de Stephen Wolfram y Eric W. Weisstein, realizadas con Mathematica

Imagen de los tres poliedros regulares convexos formados por triángulos, vistos con uno de sus vértices en el centro, el tetraedro (3 triángulos equiláteros por vértice), el octaedro ((4 triángulos equiláteros)) y el icosaedro (5 triángulos equiláteros) y, en cada caso, el mismo número de triángulos equiláteros en el plano que los que están alrededor de un vértice. Imagen construida a partir de imágenes de los poliedros de Stephen Wolfram y Eric W. Weisstein, realizadas con Mathematica

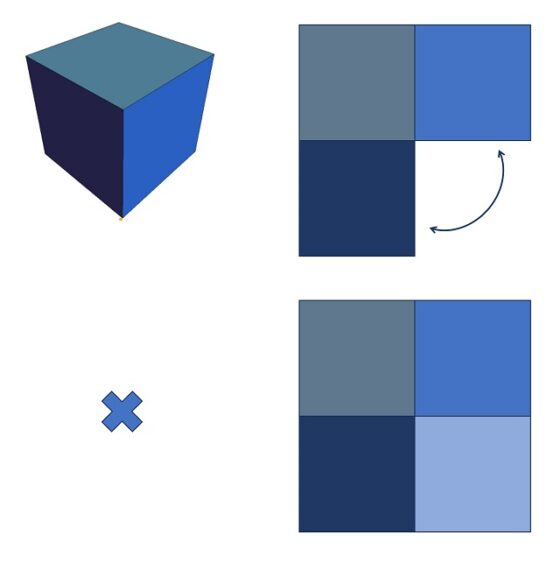

Si continuamos con los cuadrados, resulta que alrededor de un vértice no podrá haber más de tres cuadrados, ya que 4 x 90 = 360 grados (recordemos que los ángulos interiores de un cuadrado son de 90 grados), luego con cuatro cuadrados la figura sería plana y no hay forma de construir un poliedro. Con dos cuadrados no llegamos a nada, como en el caso anterior, pero con tres cuadrados por vértice se obtiene el cubo.

Imagen del único poliedro regular convexo formado por cuadrados, visto con uno de sus vértices en el centro, el cubo, con 3 cuadrados por vértice, y el mismo número de cuadrados en el plano. Imagen construida a partir de una imagen del cubo de Stephen Wolfram y Eric W. Weisstein, realizada con Mathematica

Imagen del único poliedro regular convexo formado por cuadrados, visto con uno de sus vértices en el centro, el cubo, con 3 cuadrados por vértice, y el mismo número de cuadrados en el plano. Imagen construida a partir de una imagen del cubo de Stephen Wolfram y Eric W. Weisstein, realizada con Mathematica

Algo similar pasa para los pentágonos, cuyo ángulo interior en sus vértices es de 108 grados, luego el número máximo de pentágonos alrededor de un vértice de un sólido platónico es tres, ya que con cuatro nos pasamos de los 360 grados (108 x 4 = 432 grados).

Imagen del único poliedro regular convexo formado por pentágonos, visto con uno de sus vértices en el centro, el dodecaedro, con 3 pentágonos por vértice, y el mismo número de pentágonos en el plano. Imagen construida a partir de una imagen del cubo de Stephen Wolfram y Eric W. Weisstein, realizada con Mathematica

Imagen del único poliedro regular convexo formado por pentágonos, visto con uno de sus vértices en el centro, el dodecaedro, con 3 pentágonos por vértice, y el mismo número de pentágonos en el plano. Imagen construida a partir de una imagen del cubo de Stephen Wolfram y Eric W. Weisstein, realizada con Mathematica

Los hexágonos nos van a dar una idea de lo qué ocurre con polígonos de más lados. Ya hemos comentado más arriba que con dos polígonos solamente, da igual el número de lados de estos, es imposible crear un poliedro. El problema es que con tres hexágonos en un vértice tenemos que la figura ya es plana, puesto que 3 x 120 = 360 grados (los ángulos interiores de un hexágono son de 120 grados), luego es imposible generar un poliedro con 3, o más, hexágonos. La cosa es peor aún para polígonos de siete, o más, lados, puesto que es imposible encajar tres, o más, polígonos en un vértice, ya que la suma de sus ángulos siempre es mayor de 360 grados.

Por lo tanto, los únicos poliedros regulares convexos, es decir, sólidos platónicos, son el tetraedro, el octaedro, el icosaedro, el cubo y el dodecaedro.

Esculturas de los cinco sólidos platónicos (1996), realizadas por el artista alemán Ekkehard Neumann, para el parque Bagno de la ciudad alemana de Steinfurt

Esculturas de los cinco sólidos platónicos (1996), realizadas por el artista alemán Ekkehard Neumann, para el parque Bagno de la ciudad alemana de Steinfurt

Sin embargo, la mayoría de los historiadores atribuyen el contenido del libro XIII de Los Elementos de Euclides al matemático griego Teeteto (aprox. 417 – 369 a.n.e.), quien estudió bajo la dirección del matemático pitagórico Teodoro de Cirene (465 – 398 a.n.e.), al igual que el filósofo griego Platón (aprox. 427 – 347 a.n.e.), quien lo incluiría, como interlocutor del personaje principal de todos sus diálogos, el filósofo Sócrates (470 – 399 a.n.e.), en dos de sus diálogos, el Sofista y Teeteto.

Cosmogonía platónicaEl nombre de sólidos platónicos para los poliedros regulares convexos viene del diálogo Timeo, de Platón. En este diálogo, se describen los poliedros regulares convexos, que posteriormente, recibirán el nombre de sólidos platónicos, y se relacionan con la creación del cosmos. Para Platón los cuatro primeros poliedros regulares, tetraedro, octaedro, icosaedro y cubo, están relacionados con los cuatro elementos que forman el cosmos, fuego, aire, agua y tierra. Así podemos leer en este diálogo (hemos tomado la edición bilingüe de José María Zamora Calvo, publicada por Abada Editores, en 2010):

A la tierra asignemos la figura cúbica, ya que es la más difícil de mover de los cuatro géneros y la más plástica de entre los cuerpos; y es del todo necesario que lo que posea tales características tenga al nacer las caras más estables. Ahora bien, entre los triángulos supuestos al comienzo, la cara de lados iguales es por naturaleza más estable que la de lados desiguales, y la superficie de cuatro lados iguales formada por dos equiláteros resulta necesariamente una base más estable que el triángulo equilátero, tanto en sus partes como en el todo. Por consiguiente, si atribuimos esta figura a la tierra, aseguramos el discurso verosímil y, asimismo, al agua la forma menos móvil de las restantes, al fuego la más móvil, y al aire la intermedia. Y atribuimos el cuerpo más pequeño [tetraedro] al fuego, el más grande [icosaedro] al agua, y el del medio [octaedro] al aire; y, a su vez, el más agudo al fuego, el segundo más agudo al aire, y el tercero al agua.

El universo está formado por los cuatro elementos fuego [tetraedro], tierra [cubo], agua [icosaedro] y aire [octaedro], pero Dios utiliza el dodecaedro, que en el diálogo solo se menciona como la “quinta composición” (esto es, el quinto poliedro regular convexo), para crear el universo, ya que el dodecaedro es el poliedro regular convexo más próximo a la esfera. Platón escribe en el diálogo (edición bilingüe de José María Zamora Calvo, publicada por Abada Editores, en 2010):

Había aún una quinta composición [dodecaedro]; el dios la utilizó para el universo, cuando lo pintó con diversos colores.

Dios habría tomado el quinto poliedro como modelo para crear el universo y este es el motivo por el cual se ha considerado el dodecaedro como el símbolo del universo. Si nos fijamos en la pintura, La última cena (1955), o más exactamente El sacramento de la última cena, del artista catalán Salvador Dalí (1904-1989), Jesús y los apóstoles están rodeados en esa última cena de un enorme dodecaedro.

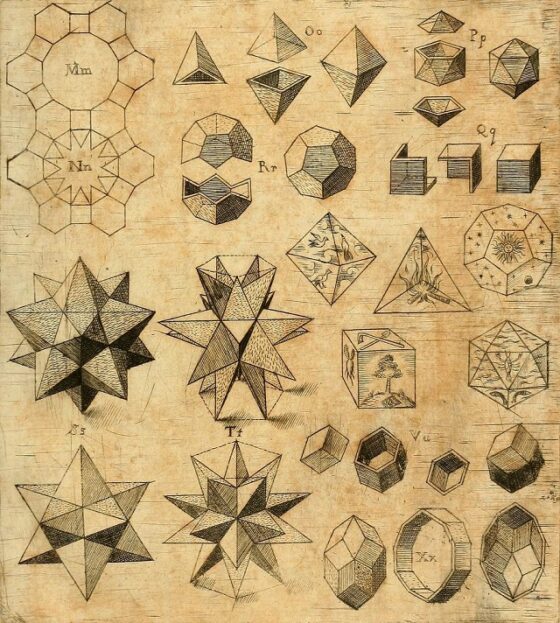

Ilustración del libro Harmonices mundi (1619), del matemático y astrónomo alemán Johannes Kepler (1571-1630), que incluye -en el centro a la derecha- la imagen de los cinco sólidos platónicos con dibujos que los relacionan con la cosmogonía platónica

Ilustración del libro Harmonices mundi (1619), del matemático y astrónomo alemán Johannes Kepler (1571-1630), que incluye -en el centro a la derecha- la imagen de los cinco sólidos platónicos con dibujos que los relacionan con la cosmogonía platónicaAlgunas fuentes, entre las que están el filósofo neoplatónico griego Proclo (412-485), atribuyen a Pitágoras la cosmogonía descrita en el diálogo Timeo de Platón, aunque la mayoría de los historiadores consideran bastante improbable que Pitágoras hubiese planteado este origen del universo. Según muchas fuentes los primeros pitagóricos conocerían solo tres de los cinco sólidos platónicos, el cubo, el tetraedro y el dodecaedro, y se atribuye a Teeteto el octaedro y el icosaedro.

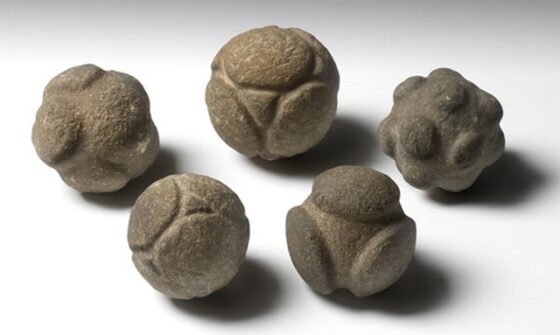

¿Se conocían los poliedros regulares en el neolítico?En la siguiente imagen, del libro Time Stands Still; New Light on Megalithic Science / El tiempo se detiene; Nuevos descubrimientos en la ciencia del Megalítico (1979), del profesor de arquitectura, escritor y artista británico Keith Critchlow (1933-2020), apasionado de la denominada “geometría sagrada”, aparecen cinco “bolas de piedra talladas”. Las bolas de piedra talladas son objetos artificiales esféricos tallados en piedra, lo que se denomina petroesferas, que datan de finales del neolítico (hace más de 4.000 años) y que han sido encontradas principalmente en Escocia, aunque también en el resto de Gran Bretaña e Irlanda. Su tamaño suele ser de unos 7 centímetros de diámetro y cuentan con entre 3 y 160 abultamientos. Además, se desconoce cuál era el uso de estas bolas de piedra talladas. Esta imagen ha sido utilizada por Critchlow para demostrar que en el neolítico ya se conocían los cinco sólidos platónicos, más de mil años antes de Platón.

Imagen del libro Time Stands Still; New Light on Megalithic Science / El tiempo se detiene; Nuevos descubrimientos en la ciencia del Megalítico (1979), del británico Keith Critchlow, con las supuestas cinco bolas de piedra talladas con la forma de los cinco sólidos platónicos

Imagen del libro Time Stands Still; New Light on Megalithic Science / El tiempo se detiene; Nuevos descubrimientos en la ciencia del Megalítico (1979), del británico Keith Critchlow, con las supuestas cinco bolas de piedra talladas con la forma de los cinco sólidos platónicosSin embargo, algunas personas, como el artista y matemático estadounidense George W. Hart, encontraron algunas contradicciones en esta imagen. Por este motivo, hay quienes acudieron a la fuente original. Las cinco bolas de piedra talladas que menciona Critchlow se encuentran en el Museo Ashmolean de Oxford (Inglaterra, Gran Bretaña) y son las que aparecen en la siguiente imagen.

Imagen de las cinco bolas de piedra talladas que se encuentran en el Museo Ashmolean de Oxford. Imagen de la página web del Museo Ashmolean

Imagen de las cinco bolas de piedra talladas que se encuentran en el Museo Ashmolean de Oxford. Imagen de la página web del Museo AshmoleanSi vamos revisando las cinco bolas de piedra tallada una a una observamos lo siguiente. La primera, arriba a la izquierda, tiene siete abultamientos, luego estos no pueden corresponderse ni con vértices, ni con caras, de un poliedro regular convexo (véase la tabla anterior), como ocurría en la interpretación que hacía Critchlow en su imagen. La segunda bola, arriba en el centro, tiene seis abultamientos y podríamos interpretarla tanto como un octaedro, si los abultamientos se consideran como los vértices del poliedro, o como un cubo si los abultamientos (que están bastante aplanados) se consideran como las caras del poliedro. Esta doble interpretación que estamos realizando, está relacionada con el hecho de que el cubo y el octaedro son duales, como comentaremos más adelante. La tercera bola, arriba a la derecha, tiene 14 abultamientos, que no se corresponde con ningún poliedro regular, ya se consideren los abultamientos como caras o vértices (véase la tabla anterior). La cuarta bola, abajo a la izquierda, posee 6 grandes abultamientos, es como segunda bola, pero con abultamientos un poco más grandes. Y, finalmente, la última bola posee cuatro abultamientos, por lo que podemos interpretarla como la representación del tetraedro, ya se consideren los abultamientos como caras o vértices.

Por lo tanto, las cinco bolas de piedra talladas del Museo Ashmolean no están relacionadas con los cinco sólidos platónicos, como afirmaba Critchlow. En conclusión, la mencionada fotografía parece estar amañada.

Existen más ejemplos de bolas de piedra talladas con estructura de tetraedro o cubo/octaedro (en función de si los abultamientos son más o menos planos parecerán más un cubo o un octaedro), similares a las bolas del Museo Ashmolean. En las siguientes imágenes vemos algunos de estos ejemplos.

Tres bolas de piedra talladas, que se encuentran en el Kelvingrove Art Gallery and Museum, de Glasgow (Gran Bretaña), con seis abultamientos. Las dos primeras, con abultamientos más planos, nos recuerdan más al cubo, mientras que la tercera, con abultamientos más pronunciados, nos remite a la estructura del octaedro

Tres bolas de piedra talladas, que se encuentran en el Kelvingrove Art Gallery and Museum, de Glasgow (Gran Bretaña), con seis abultamientos. Las dos primeras, con abultamientos más planos, nos recuerdan más al cubo, mientras que la tercera, con abultamientos más pronunciados, nos remite a la estructura del octaedro

Fotografía de la bola de piedra tallada, encontrada en Towie, Aberdeenshire (Escocia) y que se encuentra en el Museo Nacional de Escocia, fechada alrededor del 3.000 a.n.e. Esta bola tiene estructura de tetraedro. Imagen del Museo Nacional de Escocia

Fotografía de la bola de piedra tallada, encontrada en Towie, Aberdeenshire (Escocia) y que se encuentra en el Museo Nacional de Escocia, fechada alrededor del 3.000 a.n.e. Esta bola tiene estructura de tetraedro. Imagen del Museo Nacional de EscociaIncluso puede encontrarse alguna bola de piedra tallada en la que podemos interpretar un dodecaedro. En la siguiente imagen vemos el modelo 3d de una bola de piedra tallada, encontrada en Aboyne, Aberdeenshire (Escocia), con 12 abultamientos, cada uno de los cuales está rodeado de otros cinco, luego simulan caras pentagonales lo que hace que la bola de piedra tallada parezca un dodecaedro.

Dos vistas del modelo 3d, realizado por Hugo Anderson-Whymark, de una bola de piedra tallada, encontrada en Aboyne, Aberdeenshire (Escocia), con 12 abultamientos, cada uno de los cuales está rodeado de otros cinco (primera imagen), luego simulan caras pentagonales lo que hace que la bola de piedra tallada parezca un dodecaedro (segunda imagen)

Dos vistas del modelo 3d, realizado por Hugo Anderson-Whymark, de una bola de piedra tallada, encontrada en Aboyne, Aberdeenshire (Escocia), con 12 abultamientos, cada uno de los cuales está rodeado de otros cinco (primera imagen), luego simulan caras pentagonales lo que hace que la bola de piedra tallada parezca un dodecaedro (segunda imagen)Por otra parte, si relacionamos los abultamientos con los vértices de un poliedro regular, podríamos relacionar la anterior bola de piedra tallada con el icosaedro, lo cual está relacionado con el hecho de que el dodecaedro y el icosaedro son duales, como veremos.

Nos podríamos plantear si en el neolítico conocían los poliedros regulares convexos, como sugería Critchlow. Todo hace pensar que, aunque podamos relacionar algunas de las bolas de piedra talladas con los sólidos platónicos, esto no demuestra que las personas que tallaron estas piedras esféricas con abultamientos simétricos tuvieran en mente los poliedros regulares a la hora de crearlos. Claramente tenían cierta intuición geométrica, relacionada con la simetría, pero no un conocimiento de los sólidos platónicos. La relación de las bolas de piedras talladas con los poliedros regulares es más bien una interpretación moderna de las bolas. Además, como ya hemos comentado antes, existen bolas con muy distinto número de abultamientos, que van desde 3 hasta 160.

Bolas de Piedra talladas del Hunterian Museum de Glasgow (Escocia)Algunos poliedros regulares antiguos

Bolas de Piedra talladas del Hunterian Museum de Glasgow (Escocia)Algunos poliedros regulares antiguos

Lo que sí podemos afirmar es que existen algunas representaciones antiguas de algunos de los sólidos platónicos, como los dodecaedros romanos, de bronce o piedra, encontrados (hasta un centenar de ellos) en diferentes partes de Europa, que datan de entre los siglos II y IV, luego no anteriores a Teeteto o Platón, y cuya función se sigue desconociendo hoy en día, o el icosaedro romano encontrado en una excavación de Alemania.

Fotografía de dos dodecaedros y un icosaedro romanos de bronce, del siglo III, encontrados en dos excavaciones alemanas y que pertenecen al Museo regional renano Tréveris. Imagen de kleon3 a través de Wikimedia Commons

Fotografía de dos dodecaedros y un icosaedro romanos de bronce, del siglo III, encontrados en dos excavaciones alemanas y que pertenecen al Museo regional renano Tréveris. Imagen de kleon3 a través de Wikimedia Commons

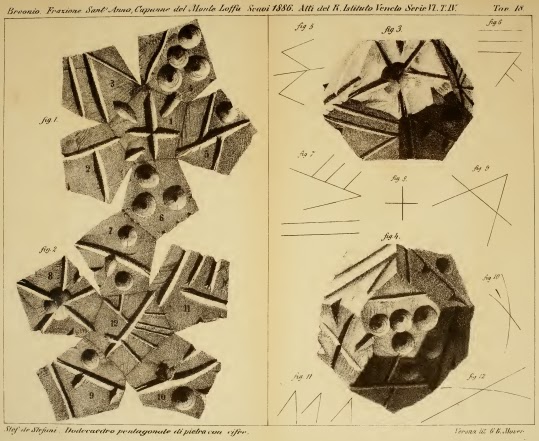

Incluso existen algunos más antiguos, como el dodecaedro etrusco, un dodecaedro de piedra encontrado en una excavación en Monte Loffa (Véneto, Italia), datado por lo menos en el 500 a.n.e. En algunos libros se acompaña esta afirmación con la imagen de un dodecaedro romano, como los anteriores, sin embargo, esa imagen no se corresponde con el dodecaedro etrusco. Amelia Carolina Sparavigna, del Politécnico de Turín (Italia), en su artículo An Etruscan Dodecahedron / Un dodecaedro etrusco, acude a la investigación original, el artículo Intorno un dodecaedro quasi regolare di pietra a facce pentagonali scolpite con cifre, scoperto nelle antichissime capanne di pietra del Monte Loffa / Sobre un dodecaedro de piedra casi regular, con caras pentagonales talladas con figuras, descubierto en las antiguas cabañas de piedra de Monte Loffa (1885), de Stefano De’ Stefani, quien estudia este pequeño dodecaedro de piedra y lo acompaña con una ilustración del mismo (la de la siguiente imagen).

Ilustración del dodecaedro etrusco perteneciente al texto Sobre un dodecaedro de piedra casi regular, con caras pentagonales talladas con figuras, descubierto en las antiguas cabañas de piedra de Monte Loffa (1885), de Stefano De’ Stefani

Ilustración del dodecaedro etrusco perteneciente al texto Sobre un dodecaedro de piedra casi regular, con caras pentagonales talladas con figuras, descubierto en las antiguas cabañas de piedra de Monte Loffa (1885), de Stefano De’ StefaniEn opinión de De’ Stefani el dodecadero etrusco podría ser un dado y las marcas corresponderse con algún tipo de representación de los números del 1 al 12.

También se han encontrado diferentes dados icosaédricos, realizados con distintos materiales, del Antiguo Egipto, tanto del período helenístico, como del romano, entre el siglo II a.n.e. y el siglo IV n.e., y con números, en griego o romano, en sus caras.

Dos dados icosaédricos, con 20 caras, con letras griegas en sus caras del Antiguo Egipto, entre los siglos II a.n.e. y IV n.e. Imágenes del Museo Metropolitano de ArteDualidad

Dos dados icosaédricos, con 20 caras, con letras griegas en sus caras del Antiguo Egipto, entre los siglos II a.n.e. y IV n.e. Imágenes del Museo Metropolitano de ArteDualidad

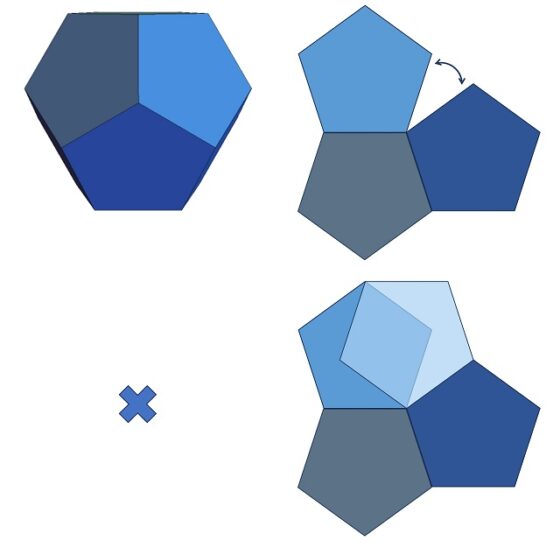

Antes de dar por finalizada esta entrada del Cuaderno de Cultura Científica vamos a explicar el concepto de dualidad para los poliedros. Se dice que dos poliedros son duales si las caras de uno se corresponden con los vértices del otro, y recíprocamente. Construyamos los poliedros duales de los sólidos platónicos.

Dado un poliedro regular convexo se construye el poliedro dual uniendo los puntos centrales de las caras adyacentes, de esta forma cada cara del poliedro original se corresponde con un vértice del nuevo poliedro. De forma análoga, cada vértice del poliedro original se va a corresponder con una cara del nuevo poliedro, ya que cada vértice del poliedro original tiene alrededor una serie de caras adyacentes dos a dos y conectadas de forma cíclica, de manera que al unir sus centros, que son los vértices del nuevo poliedro, se obtiene la cara de ese nuevo poliedro, que está conectada con el vértice del que partíamos).

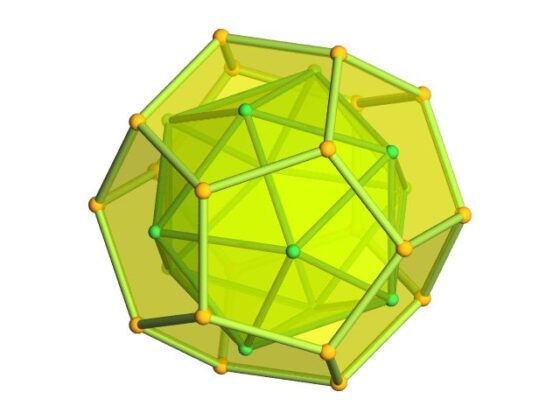

Por ejemplo, el poliedro dual del dodecaedro es el icosaedro, como se muestra en la siguiente imagen. Como vemos, las caras del dodecaedro se corresponden, por construcción, con los vértices del icosaedro, así como los vértices del dodecaedro se corresponden con las caras del icosaedro.

Imagen que ilustra que el icosaedro es dual del dodecaedro, realizada por la estudiante Klara Mundilova (2012), utiñizando POV-Ray – The Persistance of Vision Raytracer, para la clase del profesor Hans Havlicek, de la TU DMG Technische Universität Wien, de Austria

Imagen que ilustra que el icosaedro es dual del dodecaedro, realizada por la estudiante Klara Mundilova (2012), utiñizando POV-Ray – The Persistance of Vision Raytracer, para la clase del profesor Hans Havlicek, de la TU DMG Technische Universität Wien, de Austria

Resulta que los poliedros duales de los sólidos platónicos siguen siendo sólidos platónicos. Más concretamente, el dodecaedro y el icosaedro son duales, el cubo y el octaedro son duales, y el tetraedro es dual de sí mismo, como podemos observar en la siguiente imagen.

Dualidad de los sólidos platónicos. Imagen del proyecto ATRACTOR de Portugal, a través de su página web

Dualidad de los sólidos platónicos. Imagen del proyecto ATRACTOR de Portugal, a través de su página webLa dualidad se puede obtener mediante otros procesos, pero no vamos a entrar en ellos en esta ocasión. Para terminar esta entrada vamos a mostrar las esculturas basadas en la dualidad de los sólidos platónicos de la artista saudí-palestina Dana Awartani (1987),

Escultura Tetraedro dentro de un tetraedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani

Escultura Tetraedro dentro de un tetraedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani Escultura Octaedro dentro de un cubo II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani

Escultura Octaedro dentro de un cubo II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani Escultura Cubo dentro de un octaedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani

Escultura Cubo dentro de un octaedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani Escultura Icosaedro dentro de un dodecaedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani

Escultura Icosaedro dentro de un dodecaedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani Escultura Dodecaedro dentro de un icosaedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana Awartani

Escultura Dodecaedro dentro de un icosaedro II (2019), perteneciente a la serie Los duales de los sólidos platónicos, de la artista saudí-palestina Dana Awartani. Materiales: Madera, cobre y latón. Tamaño: 121 x 100 x 100 cm. Imagen de la página web de la artista Dana AwartaniEn la siguiente entrada continuaremos hablando de los sólidos platónicos, los poliedros regulares convexos.

Bibliografía

1.- Geaninne Gutiérrez-Guimaraes (editora), Gego, midiendo el infinito (catálogo de la exposición), Museo Guggenheim Bilbao, 2023.

2.- Pedro Miguel González Urbaneja, Los sólidos pitagórico-platónicos (Geometría, Arte, Mística y Filosofía), FESPM, 2008.

3.- Claudi Alsina, Las mil caras de la belleza geométrica (los poliedros), El mundo es matemático, RBA, 2010.

4.- David Wells, The Penguin Dictionary of Curious and Interesting Geometry, Penguin, 1991.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo Los sólidos platónicos se ha escrito en Cuaderno de Cultura Científica.

Cómo garantizar la seguridad de los vehículos autónomos

A medida que los automóviles y aeronaves pilotados por ordenador se vuelven más comunes, la clave para prevenir accidentes, según muestran los investigadores, es saber lo que no se sabe.

Un artículo de Steve Nadis. Historia original reimpresa con permiso de Quanta Magazine, una publicación editorialmente independiente respaldada por la Fundación Simons.

Señor Salme para Quanta Magazine

Señor Salme para Quanta MagazineLos automóviles y aeronaves sin piloto ya no son cosa del futuro. Solo en la ciudad de San Francisco, dos compañías de taxis han registrado colectivamente 12,9 millones de kilómetros de conducción autónoma hasta agosto de 2023. Y más de 850.000 vehículos aéreos autónomos, o drones, están registrados en los Estados Unidos, sin contar los militares.

Pero existen preocupaciones justificadas sobre la seguridad. Por ejemplo, en un período de 10 meses que finalizó en mayo de 2022, la Administración Nacional de Seguridad del Tráfico en Carreteras de los Estados Unidos informó de casi 400 accidentes que involucraron automóviles que utilizaban alguna forma de control autónomo. Seis personas murieron como consecuencia de estos accidentes y cinco resultaron gravemente heridas.

La forma habitual de abordar este problema, a veces denominada “prueba por agotamiento”, implica probar estos sistemas hasta que estés convencido de que son seguros. Pero nunca se puede estar seguro de que este proceso descubrirá todos los defectos potenciales. «La gente realiza pruebas hasta que agotan sus recursos y su paciencia», explica Sayan Mitra, científico informático de la Universidad de Illinois en Urbana-Champaign. Sin embargo, las pruebas por sí solas no pueden ofrecer garantías.

Mitra y sus colegas sí pueden. Su equipo ha logrado demostrar la seguridad de las capacidades de seguimiento de carriles para automóviles y de los sistemas de aterrizaje para aeronaves autónomas. Su estrategia se está utilizando ahora para ayudar a aterrizar drones en portaaviones, y Boeing planea probarla en un avión experimental este año. «Su método para proporcionar garantías de seguridad de extremo a extremo es muy importante», afirna Corina Pasareanu, científica investigadora de la Universidad Carnegie Mellon y del Centro de Investigación Ames de la NASA.

Su trabajo consiste en garantizar los resultados de los algoritmos de aprendizaje automático que se utilizan para informar a los vehículos autónomos. A alto nivel, muchos vehículos autónomos tienen dos componentes: un sistema de percepción y un sistema de control. El sistema de percepción te dice, por ejemplo, a qué distancia está tu coche del centro del carril, o en qué dirección va un avión y cuál es su ángulo con respecto al horizonte. El sistema funciona alimentando datos sin procesar de cámaras y otras herramientas sensoriales a algoritmos de aprendizaje automático basados en redes neuronales que recrean el entorno fuera del vehículo.

Luego, estas evaluaciones se envían a un sistema independiente, el módulo de control, que decide qué hacer. Si se avecina un obstáculo, por ejemplo, decide si aplica los frenos o gira para evitarlo. Según Luca Carlone, profesor asociado del Instituto de Tecnología de Massachusetts, si bien el módulo de control se basa en tecnología bien establecida, «toma decisiones basadas en los resultados de la percepción y no hay garantía de que esos resultados sean correctos».

Para brindar una garantía de seguridad, el equipo de Mitra trabajó en asegurar la confiabilidad del sistema de percepción del vehículo. Al principio supusieron que es posible garantizar la seguridad cuando se dispone de una representación perfecta del mundo exterior. Luego determinaron cuánto error introduce el sistema de percepción en su recreación del entorno del vehículo.

La clave de esta estrategia es cuantificar las incertidumbres involucradas, conocidas como banda de error, o las “incógnitas conocidas”, como lo expresa Mitra. Este cálculo proviene de lo que él y su equipo llaman contrato de percepción. En ingeniería de software, un contrato es un compromiso de que, para una determinada entrada a un programa de ordenador, la salida estará dentro de un rango especificado. Calcular este rango no es fácil. ¿Qué precisión tienen los sensores del coche? ¿Cuánta niebla, lluvia o resplandor solar puede tolerar un dron? Pero si puedes mantener el vehículo dentro de un rango específico de incertidumbre y si la determinación de ese rango es lo suficientemente precisa, el equipo de Mitra demostró que puedes garantizar su seguridad.

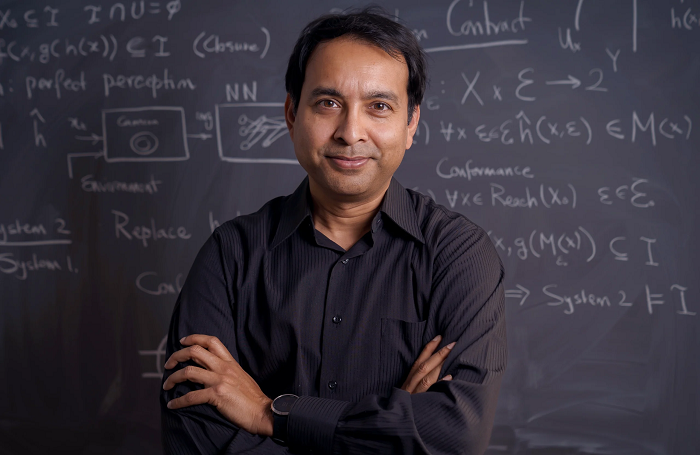

Sayan Mitra, informático de la Universidad de Illinois, Urbana-Champaign, ha ayudado a desarrollar un enfoque sistemático para garantizar la seguridad de ciertos sistemas autónomos. Foto: Virgil Ward II

Sayan Mitra, informático de la Universidad de Illinois, Urbana-Champaign, ha ayudado a desarrollar un enfoque sistemático para garantizar la seguridad de ciertos sistemas autónomos. Foto: Virgil Ward II

Es una situación familiar para cualquiera que tenga un velocímetro impreciso. Si sabes que el dispositivo nunca se desvía más de 5 kilómetros por hora, puedes evitar la multa por exceso de velocidad manteniéndote siempre 5 km/h por debajo del límite de velocidad (tal y como lo indica tu velocímetro no confiable). Un contrato de percepción ofrece una garantía similar de seguridad de un sistema imperfecto que depende del aprendizaje automático.

«No se necesita una percepción perfecta», explica Carlone. «Lo único que quieres es que sea lo suficientemente buena como para no poner en riesgo la seguridad». Las mayores contribuciones del equipo, afirma, son «introducir la idea completa de los contratos de percepción» y proporcionar los métodos para construirlos. Lo han hecho recurriendo a técnicas de la rama de la informática llamada verificación formal, que proporciona una forma matemática de confirmar que el comportamiento de un sistema satisface un conjunto de requisitos.

«Aunque no sabemos exactamente cómo la red neuronal hace lo que hace», como afirma Mitra, han demostrado que todavía es posible probar numéricamente que la incertidumbre de la salida de una red neuronal se encuentra dentro de ciertos límites. Y, si ese es el caso, entonces el sistema será seguro. «Podemos entonces proporcionar una garantía estadística sobre si (y en qué medida) una red neuronal determinada realmente cumplirá esos límites».

La empresa aeroespacial Sierra Nevada está probando actualmente estas garantías de seguridad al aterrizar un dron en un portaaviones. Este problema es, en cierto modo, más complicado que conducir automóviles debido a la dimensión adicional que implica volar. “Al aterrizar, hay dos tareas principales”, explica Dragos Margineantu, tecnólogo jefe de IA en Boeing, “alinear el avión con la pista y asegurarse de que la pista esté libre de obstáculos. Nuestro trabajo con Sayan implica obtener garantías para estas dos funciones”.

«Las simulaciones que utilizan el algoritmo de Sayan muestran que la alineación [de un avión antes del aterrizaje] mejora», afirma. El siguiente paso, previsto para finales de este año, es emplear estos sistemas mientras aterriza de hecho un avión experimental de Boeing. Uno de los mayores desafíos, señala Margineantu, será descubrir lo que no sabemos – “determinar la incertidumbre en nuestras estimaciones” – y ver cómo eso afecta a la seguridad. «La mayoría de los errores ocurren cuando hacemos cosas que creemos saber, y resulta que no es así».

El artículo original, How to Guarantee the Safety of Autonomous Vehicles, se publicó el 16 de enero de 2024 en Quanta Magazine.

Traducido por César Tomé López

El artículo Cómo garantizar la seguridad de los vehículos autónomos se ha escrito en Cuaderno de Cultura Científica.

El origen incierto de las islas evanescentes de Titán

Titán es un mundo apasionante. Junto con la Tierra, es el único lugar de nuestro Sistema Solar donde existe un ciclo hidrológico, aunque radicalmente distinto al nuestro: Mientras que en nuestro planeta este ciclo funciona con el agua y sus cambios de estado, las frías temperaturas de Titán -hablamos de unos 180 grados centígrados bajo cero de media- hacen que este ciclo esté basado en el metano y el etano, que a esas temperaturas se comporta de una manera similar al agua en nuestro planeta.

En este exótico o extraño -para nuestros ojos, claro- ciclo, las nubes de metano y etano se forman sobre una atmósfera compuesta principalmente por nitrógeno y desde ella precipitan las gotas de lluvia capaces de llenar lagos y mares y de excavar unas redes de drenaje que nos recuerdan tanto a nuestros valles, ríos y ramblas.

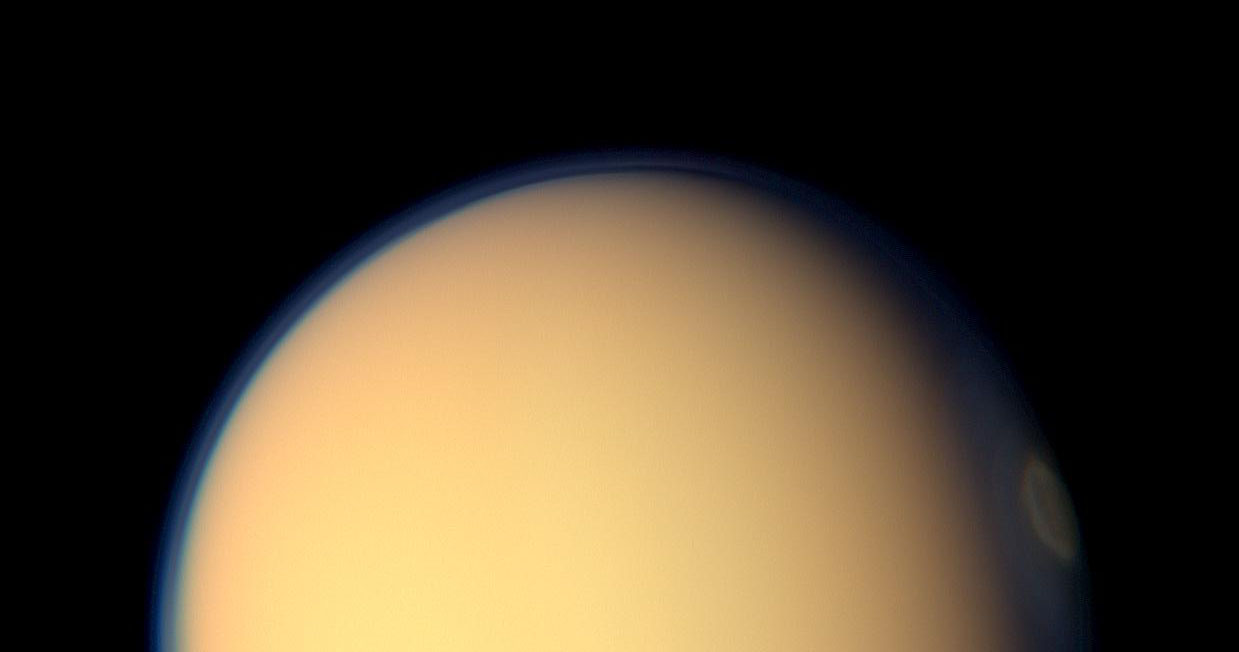

Titán, visto desde la sonda Cassini. En luz visible, no podemos ver nada de su superficie, solo su atmósfera. Cortesía de NASA/JPL-Caltech/Space Science Institute.

Titán, visto desde la sonda Cassini. En luz visible, no podemos ver nada de su superficie, solo su atmósfera. Cortesía de NASA/JPL-Caltech/Space Science Institute.Este ciclo hidrológico -entiéndase en todo este artículo el uso del término hidrológico lato sensu – es susceptible de comparaciones con el nuestro, puesto que, a pesar de ser mundos radicalmente diferentes, es capaz de modelar el paisaje de una manera similar, lo que nos da una perspectiva sobre la gran diversidad de procesos que se dan en los distintos cuerpos del Sistema Solar y como son capaces de crear paisajes similares. Eso no quita que no se puedan dar procesos diferentes a los que hay en la Tierra, aunque, por muy marciano que nos parezca un paisaje, en ocasiones tenemos más cosas en común que diferencias.

La llegada de la sonda Cassini al sistema de Saturno fue una verdadera revolución en nuestro conocimiento sobre este satélite, ya que la distancia a nuestro planeta y una superficie perpetuamente cubierta de una neblina de compuestos orgánicos, hacía tarea imposible que pudiésemos saber que pasaba en su superficie, algo que tuvo solución gracias a los datos de radar, pero también a las imágenes tomadas en determinadas “ventanas” ópticas -entiéndase por ventanas en el sentido de longitudes de onda- que también nos aportaban algunos detalles de una superficie hasta entonces inédita para el ser humano.

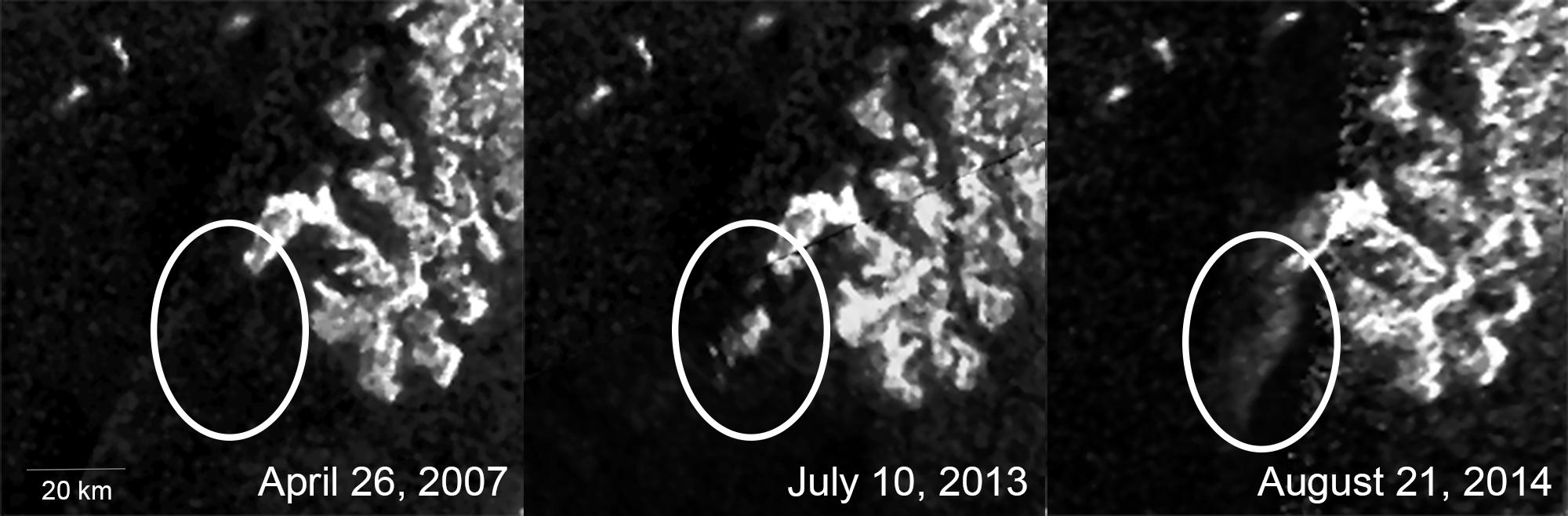

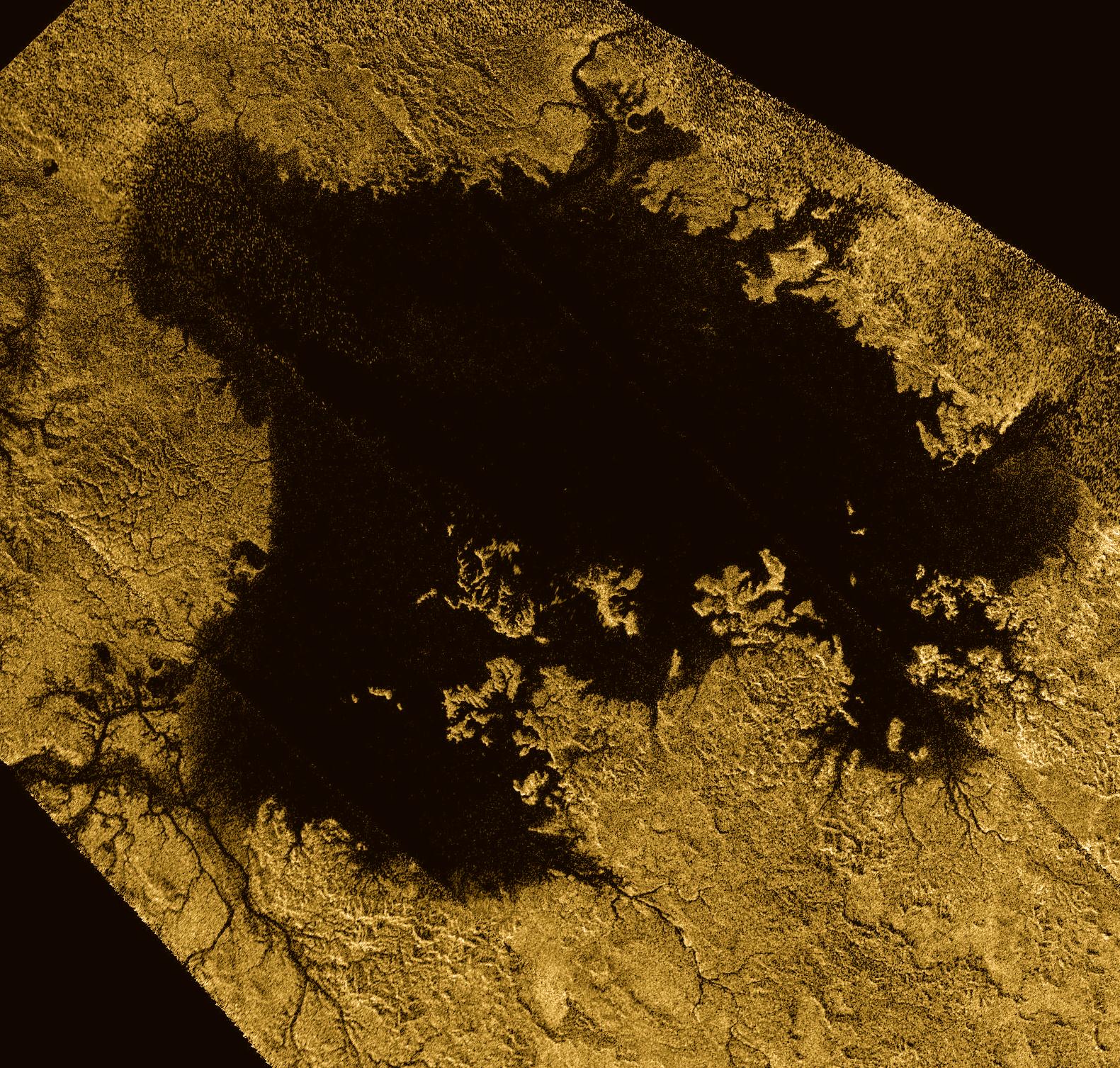

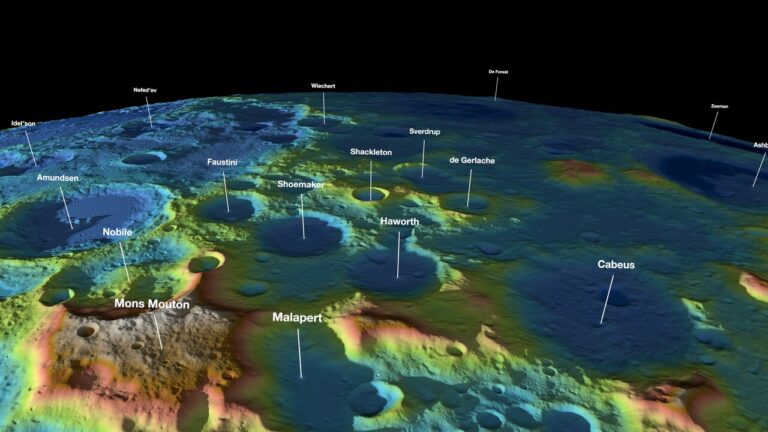

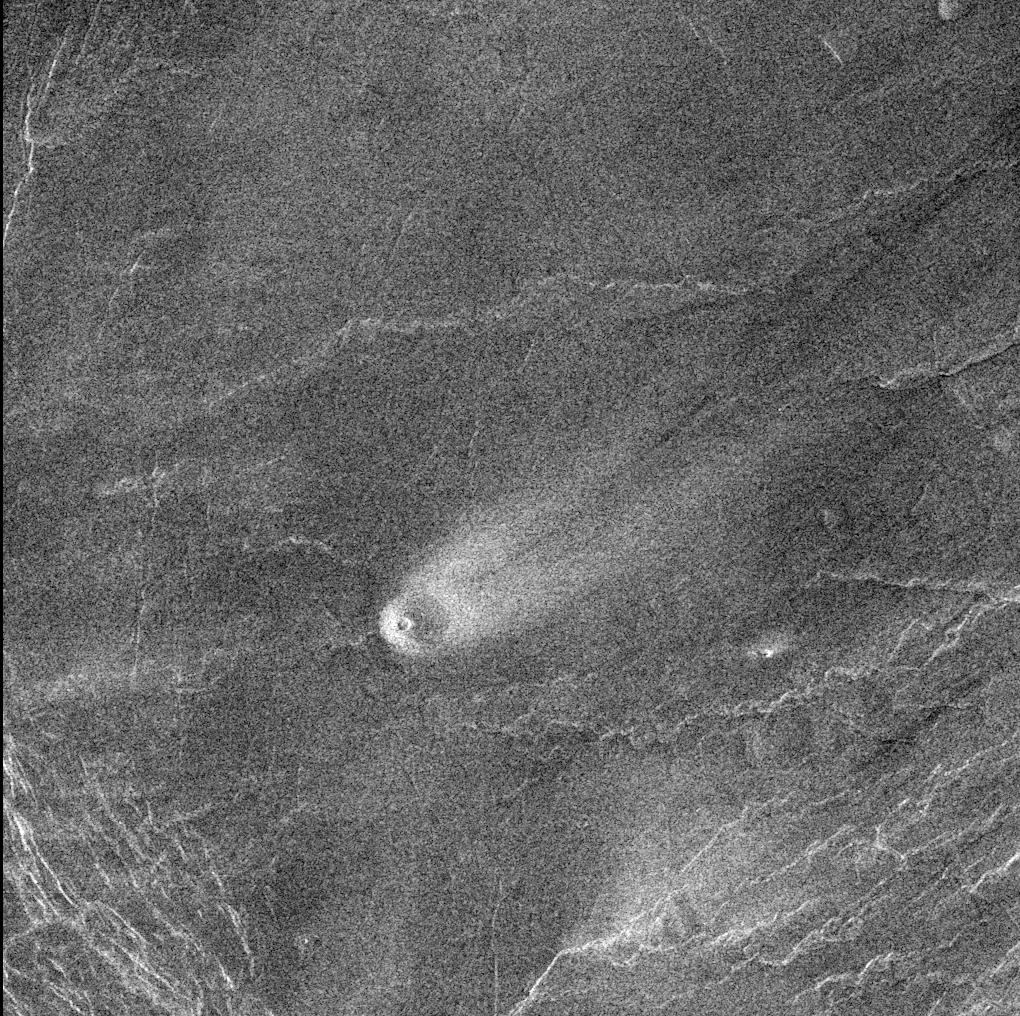

Las islas que aparecen y desaparecen en Ligeia Mare, vistas con el radar de la misión Cassini. Cortesía de NASA/JPL-Caltech/Space Science Institute.

Las islas que aparecen y desaparecen en Ligeia Mare, vistas con el radar de la misión Cassini. Cortesía de NASA/JPL-Caltech/Space Science Institute.En el año 2014 un equipo de científicos publicó el descubrimiento una nueva isla en Ligeia Mare, el segundo mar más extenso de Titán y que se encuentra en la región polar del hemisferio norte. Era la primera vez que observábamos un fenómeno dinámico en las masas de líquido del satélite… pero, ¿por qué no estaba esta isla antes? ¿Qué había provocado su aparición?

Las primeras teorías apuntaron a que fuesen el resultado de las olas que provocaron un “reflejo” de las ondas de radar que tendría ese aspecto, a la presencia de burbujas de gas ascendiendo desde el fondo del mar, trozos de compuestos orgánicos sólidos que al calentarse el líquido dejasen flotarlos… e incluso islas de verdad, pero los científicos no tenían ninguna preferencia muy marcada…. Al fin y al cabo, era la primera vez que veíamos algo así.

Un nuevo estudio publicado en Geophysical Research Letters afirma que la aparición de estas islas en realidad tiene mucho que ver con la relación entre la composición de la atmósfera y las reacciones químicas que allí se dan, los lagos y los materiales sólidos que se depositan en la superficie procedentes también de la atmósfera.

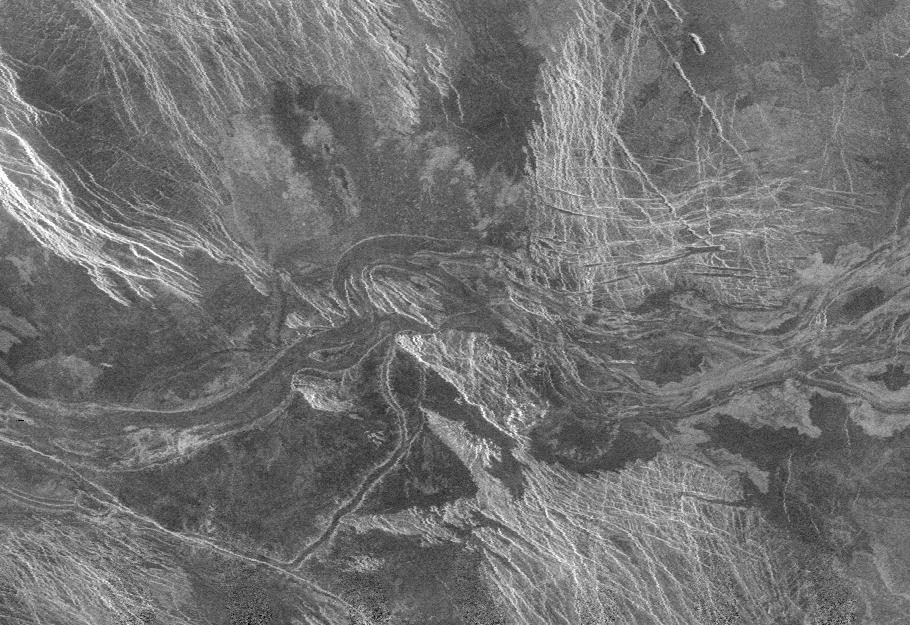

Ligeia Mare, la segunda masa de líquido más grande de Titán. Obsérvense las numerosas redes de drenaje que desembocan en el mar. Cortesía de NASA/JPL-Caltech/Space Science Institute.

Ligeia Mare, la segunda masa de líquido más grande de Titán. Obsérvense las numerosas redes de drenaje que desembocan en el mar. Cortesía de NASA/JPL-Caltech/Space Science Institute.Estos sólidos compuestos de compuestos orgánicos se acumulan cerca de la línea de costa, con el paso del tiempo pueden formar una capa que, al romperse, podría acabar flotando sobre el mar, de una manera muy similar a como ocurre la ruptura de los glaciares terrestres que da lugar a los icebergs u otros trozos de hielo flotante.

Estas masas flotantes estarían durante un tiempo sobre el mar, ya que poco a poco se irían saturando sus poros y poco a poco hundiéndose, como ocurre con la pumita -esa roca de origen volcánico- en la Tierra, que al principio flota y a veces incluso la vemos en los océanos formando grandes “balsas” de roca, pero conforme esos poros se llenan de agua, lentamente se van hundiendo en el agua.

De algún modo estamos hablando de glaciares, pero, en este caso, de compuestos orgánicos que, además, según este estudio, no se disolverían en las masas de metano y etano como tampoco sería muy raro que ocurriese si estas partículas tuviesen una determinada composición.

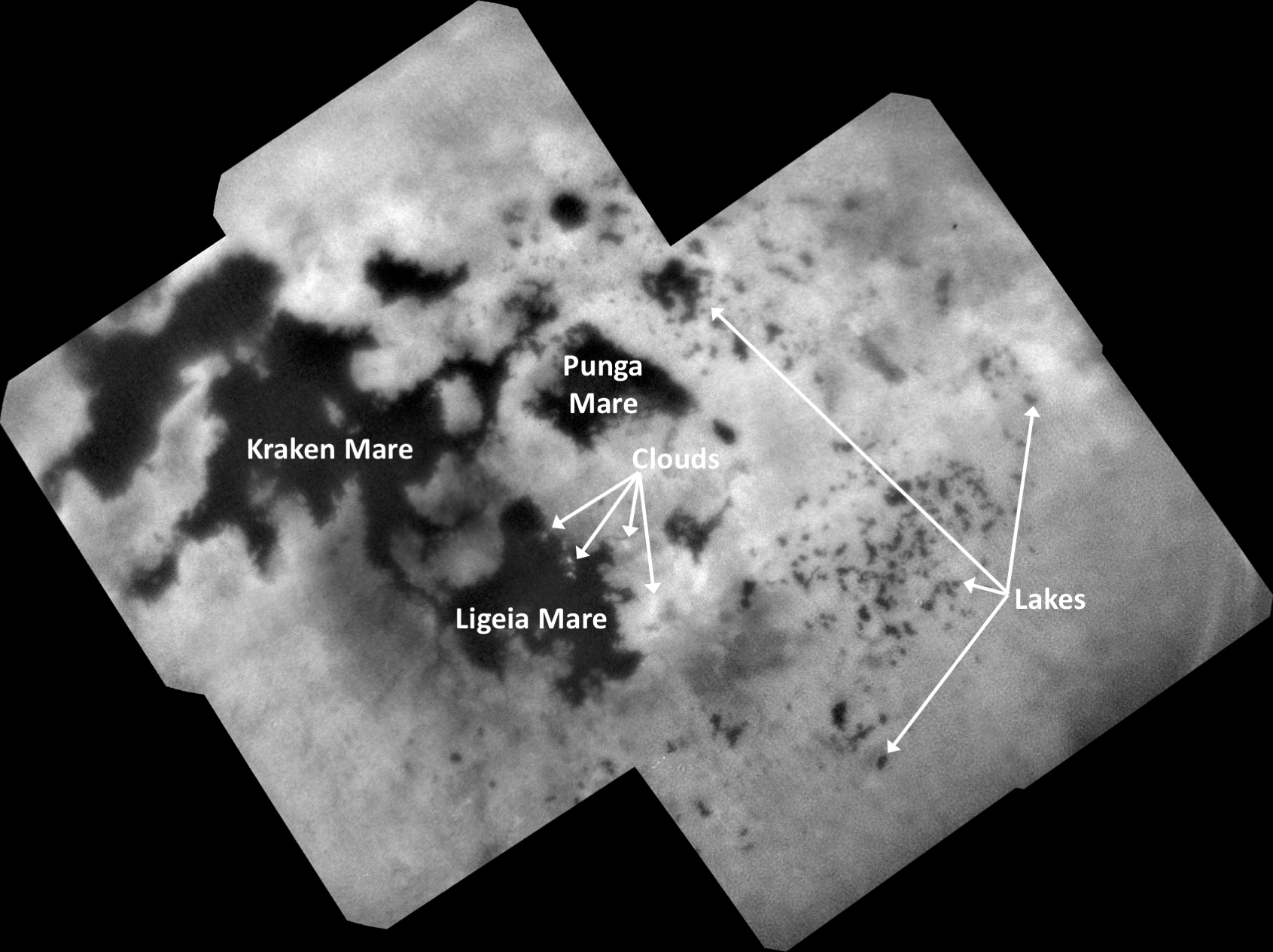

Algunos de los mares y lagos de la región polar norte de Titán. Si contamos los más pequeños, hay decenas de estos cuerpos de líquido. Cortesía de NASA/JPL-Caltech/Space Science Institute.

Algunos de los mares y lagos de la región polar norte de Titán. Si contamos los más pequeños, hay decenas de estos cuerpos de líquido. Cortesía de NASA/JPL-Caltech/Space Science Institute.Pero este estudio también se centra en un detalle muy importante y que hasta ahora no ha tenido tampoco una explicación clara… ¿Por qué los mares de Titán tienen una superficie tan suave, sin un oleaje visible? Los autores sugieren que podría ser fruto de una capa de compuestos orgánicos sólidos congelados que cubre la superficie de estos, una capa muy fina, dándole esa apariencia poco revuelta.

Si todo va bien, es posible que podamos saber si este estudio está en lo cierto con la llegada de la misión Dragonfly a Titán en el año 2034 y que, si todo va bien, despegará de nuestro planeta en julio de 2028. Esta misión tendrá una duración estimada de unos dos años y no solo nos mostrará la superficie desde el nivel del suelo, sino que será un dron capaz de surcar los cielos de este satélite tan interesante.

Referencias:

Hofgartner, J. D., Hayes, A. G., Lunine, J. I., Zebker, H. A., Stiles, B., Sotin, C., Barnes, J. W., Turtle, E. P., Baines, K. H., Brown, R. H., Buratti, B. J., Clark, R. N., Encrenaz, P., Kirk, R., Gall, A. L., Lopes-Gautier, R., Lorenz, R. D., Malaska, M. J., Mitchell, K. L., . . . Wood, C. A. (2014). Transient features in a Titan sea Nature Geoscience doi: 10.1038/ngeo2190

Yu, X., Yu, Y., Garver, J., Zhang, X., & McGuiggan, P. (2024). The fate of simple organics on Titan’s Surface: A theoretical perspective Geophysical Research Letters doi: 10.1029/2023gl106156

Sobre el autor: Nahúm Méndez Chazarra es geólogo planetario y divulgador científico.

El artículo El origen incierto de las islas evanescentes de Titán se ha escrito en Cuaderno de Cultura Científica.

Einstein, Tesla, Eratóstenes y sus triángulos

Los triángulos son los polígonos más simples, pero los más especiales. Aprendemos en la escuela a temprana edad sus mágicas propiedades, como por ejemplo que sus ángulos siempre suman 180 grados o el famoso teorema de Pitágoras, que se cumple si uno de los tres ángulos es recto. Estas sencillas peculiaridades pueden aplicarse al mundo real y ayudarnos a comprender mejor cómo funcionan las cosas.

Foto: Tusik Only / UnsplashRelatividad especial

Foto: Tusik Only / UnsplashRelatividad especial

La conocida teoría de la relatividad especial de Albert Einstein relaciona el tiempo y el espacio, y da lugar a llamativas consecuencias físicas. Entre ellas, las más mencionadas son la dilatación del tiempo, la contracción de la longitud o el aumento de la energía que podemos medir, si un objeto se desplaza a cierta velocidad con respecto a nosotros. Todo esto parece muy complicado, pero puede expresarse mediante un simple triángulo rectángulo.

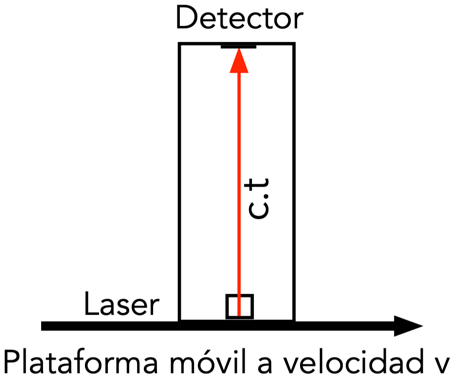

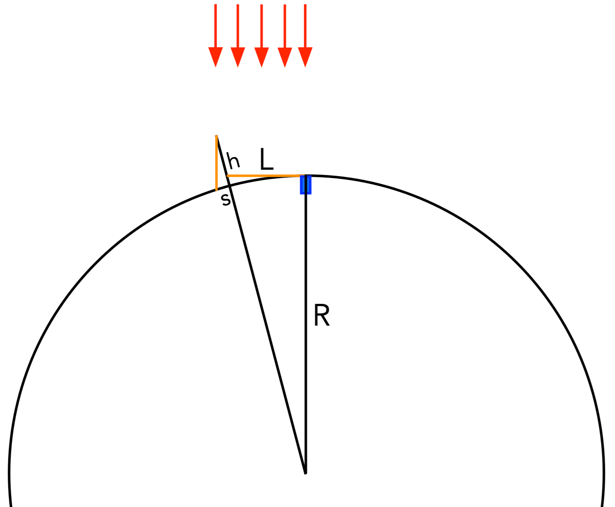

La velocidad por el tiempo es igual a la distancia. Si tenemos un láser y un detector colocados a cierta distancia como vemos en la Figura 1, podemos detectar el instante t en el que llega la luz al extremo superior. Como la velocidad de la luz es c, la distancia recorrida es c por t.

Figura 1: Láser y detector: al llegar la luz al detector nos marca el instante t y podemos calcular la distancia recorrida por el haz (c por t).

Figura 1: Láser y detector: al llegar la luz al detector nos marca el instante t y podemos calcular la distancia recorrida por el haz (c por t).

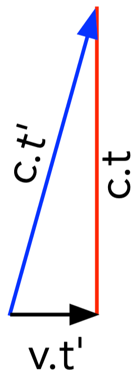

Si, como aparece en la Figura 1, montamos el láser en una plataforma que se mueve a velocidad v, pero en dirección perpendicular a como apuntamos el láser, podemos repetir el experimento, pero esta vez observándolo desde fuera de la plataforma. Como se muestra en la Figura 2, desde fuera veremos un recorrido diagonal del láser, debido a la composición del movimiento vertical y horizontal que percibimos desde el exterior. Como la velocidad de la luz es siempre c, la distancia diagonal recorrida por el láser que vemos desde fuera es c por t’. Finalmente, el tercer lado del triángulo de la Figura 2 es el recorrido horizontal de la plataforma (v por t’).

Figura 2: Distancias recorridas por el láser y la plataforma, observadas desde fuera, completando un triángulo rectángulo

Figura 2: Distancias recorridas por el láser y la plataforma, observadas desde fuera, completando un triángulo rectángulo

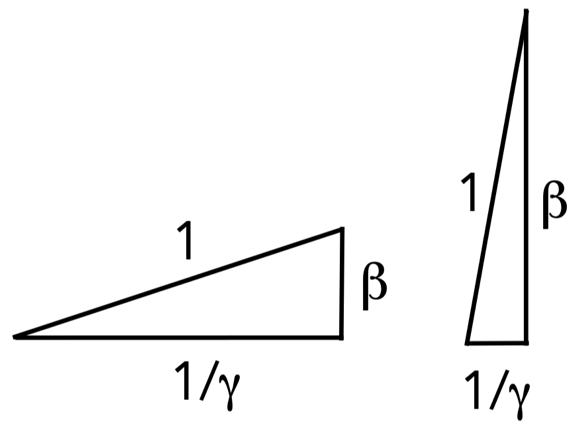

Tenemos un triángulo rectángulo, así que podemos aplicar el teorema de Pitágoras: la suma de los cuadrados de los catetos es igual al cuadrado de la hipotenusa. Con este simple cálculo extraemos de este triángulo las transformaciones de Lorenz, que son las fórmulas que nos cuantifican cuánto se dilata el tiempo o se contrae la longitud, si un objeto se mueve a una velocidad v respecto a nosotros. Este factor se llama factor de Lorenz γ. Si llamamos β a la razón entre una velocidad v y la máxima velocidad posible (la velocidad de la luz en el vacío c) podemos construir otro triángulo rectángulo como mostramos en la Figura 3:

Figura 3: Cómo calcular el factor de Lorenz: bajas velocidades (izquierda) y altas velocidades (derecha)

Figura 3: Cómo calcular el factor de Lorenz: bajas velocidades (izquierda) y altas velocidades (derecha)

Aplicando de nuevo el teorema de Pitágoras podemos fácilmente calcular cuánto se modifican las medidas del tiempo y la longitud cuando los objetos se mueven a mayor o menor velocidad. Vemos por ejemplo que si β es pequeña (bajas velocidades, a la izquierda de la Figura 3), 1/γ es ligeramente menor que 1 y. por tanto, γ es ligeramente superior a 1, con lo cual las medidas del tiempo y longitud apenas se modifican. Para velocidades altas (a la derecha de la Figura 3), 1/γ es muy pequeño, con lo que el factor de Lorenz γ es muy grande, y se produce un gran efecto.

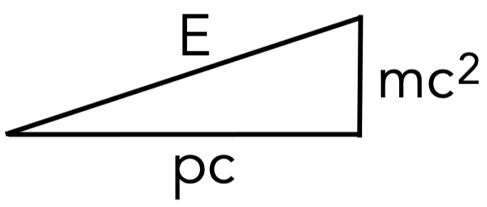

Una de las consecuencias más llamativas de la relatividad especial es la relación energía-momento, que se utiliza en todas partes, desde la mecánica cuántica hasta la relatividad general. Una vez más el teorema de Pitágoras nos permite cuantificar la energía de un objeto de cierta masa y de cierta cantidad de movimiento (momento o ímpetu p). Este triángulo mostrado en la Figura 4 nos permite calcular la energía de cualquier objeto móvil, incluso aquellas partículas sin masa, como los fotones, que viajan a la velocidad de la luz, cuyo cateto derecho de la Figura 4 es nulo, o un objeto inmóvil, cuyo cateto inferior en la Figura 4 sería nulo, pero su energía sería igual a la famosa equivalencia de masa y energía de Einstein E=mc2.

Figura 4: Cómo calcular la energía de un objeto de cierta masa m y cierto momento p.

Figura 4: Cómo calcular la energía de un objeto de cierta masa m y cierto momento p.Energía eléctrica

La mayoría de los generadores de electricidad son máquinas rotatorias, como un aerogenerador (“molino” de viento), un salto de agua de un embalse, que mueve las turbinas de una central hidroeléctrica, o el vapor de agua que se produce en una central nuclear o en una térmica, que también actúa sobre sus turbinas de vapor, que giran y generan electricidad.

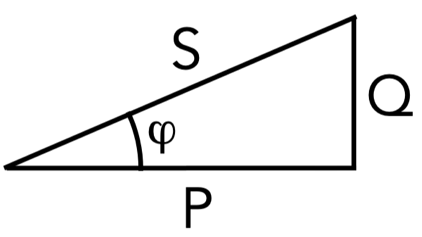

Al ser máquinas rotatorias, la electricidad que se produce es de corriente alterna. Las señales alternas se expresan de forma compacta en matemáticas con números complejos, lo cual a veces parece algo muy complicado de entender, pero de nuevo aparecen los sencillos triángulos para representar gráficamente la tensión (voltios), la corriente (amperios) y la impedancia (ohmios) de cualquier circuito eléctrico.

La potencia eléctrica que nos da un suministrador es el producto de la tensión por la corriente eléctrica que circula cuando enchufamos un aparato. Resulta que si medimos los voltios y los amperios alternos que circulan, puede ser que estas oscilaciones no se produzcan a la vez, sino que la corriente esté ligeramente desfasada con respecto a la tensión. Este desfase se representa en la Figura 5 mediante el ángulo φ del triángulo mostrado. Este triángulo nos indica que si el desfase φ es grande, no aprovechamos bien la electricidad generada y transportada. En trigonometría el coseno de un ángulo pequeño es cercano a 1, y el cosφ es el conocido factor de potencia eléctrica, que cuanto más cerca esté de 1, más eficiente resulta el circuito.

Figura 5: Potencia eléctrica Activa (P: que hace trabajo), Aparente (S: que debe generarse y transportarse) y Reactiva (Q: que no se aprovecha). Si conseguimos que la corriente y la tensión oscilen en fase (φ=0), aprovechamos eficientemente la energía eléctrica

Figura 5: Potencia eléctrica Activa (P: que hace trabajo), Aparente (S: que debe generarse y transportarse) y Reactiva (Q: que no se aprovecha). Si conseguimos que la corriente y la tensión oscilen en fase (φ=0), aprovechamos eficientemente la energía eléctricaEl desfase φ se produce típicamente por la gran cantidad de cableados y bobinados que son necesarios para generar, transformar y transportar la energía eléctrica. Para mejorar la eficiencia podemos contrarrestar el desfase en este caso mediante un conjunto de condensadores eléctricos para regular φ hacia valores mínimos y mejorar el factor de potencia.

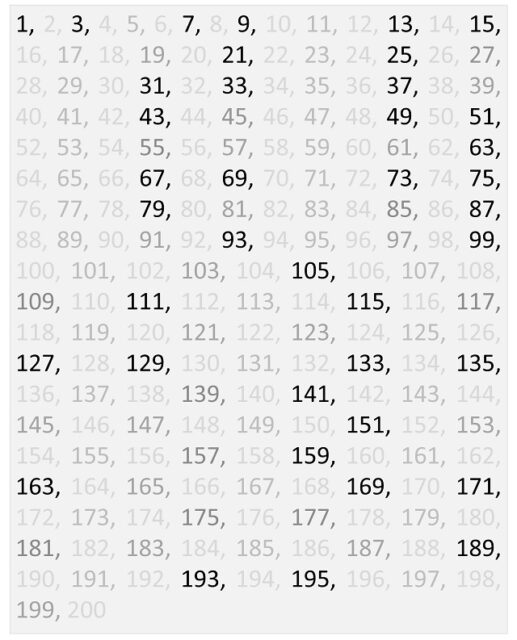

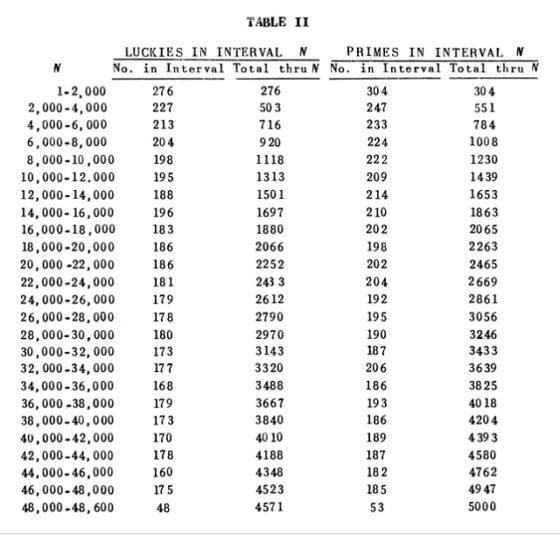

Medida del radio de la tierraEratóstenes de Cirene (276-194 a.e.c.) fue uno de los sabios de la antigüedad que más conocimiento pudo adquirir y aplicar, al hacerse cargo de la Biblioteca de Alejandría durante más de 40 años. Entre sus muchas contribuciones a la ciencia, la maravillosa criba de Eratóstenes, sencillo algoritmo para obtener números primos y la medida del radio de la Tierra con instrumental rudimentario son, en mi opinión, sus más alucinantes aportaciones, por la importancia de sus resultados aplicados, la simplicidad de su realización y la potencia de su razonamiento.

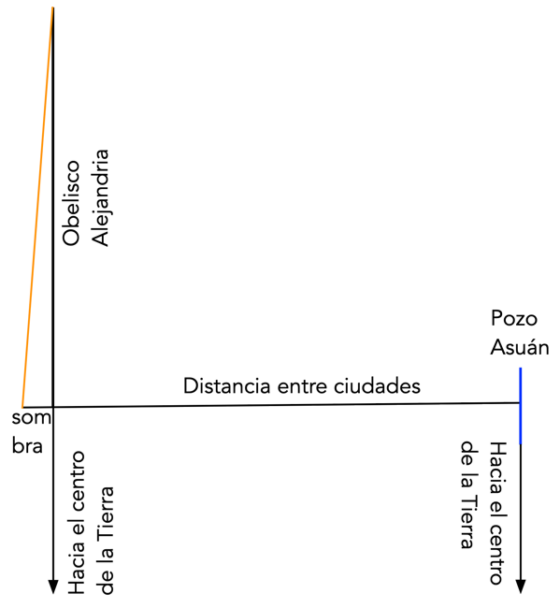

No sabemos con todo detalle cómo midió Eratóstenes el radio de la Tierra, ya que no nos han llegado sus escritos directos, sino lo narrado por otros autores. Así todo, es brillante su observación de que el solsticio de verano, el sol al mediodía no arrojaba sombra en los pozos de Siena (hoy Asuán), y, sin embargo, en su ciudad, Alejandría, los árboles, obeliscos o palos verticales sí que proyectaban sombra de longitud medible.

Figura 6: Posible medida de Eratóstenes y sus colaboradores

Figura 6: Posible medida de Eratóstenes y sus colaboradores

Si Eratóstenes utilizó alguno de los antiguos obeliscos de Alejandría, de una altura aproximada de 21 metros, pudo medir una sombra bien mensurable de unos 2,6 metros. Sus colaboradores o los datos de la Biblioteca le dieron una medida de distancia entre las ciudades de Asuán y Alejandría de aproximadamente 800 kilómetros (ver Figura 6).

El cálculo de Eratóstenes suele narrarse con cierta exactitud geométrica, al aplicar el quinto postulado de Euclides, de Los Elementos, que con seguridad se hallaba presente en la Biblioteca de Alejandría. Este postulado equivale a que los ángulos de cualquier triángulo suman 180 grados, o también que, si dos rectas son paralelas, los ángulos alternos internos formados con otra recta que corta a ambas son iguales. Sin embargo, resulta muy complicado medir con exactitud un ángulo tan pequeño como el de los rayos del sol proyectando sombra en Alejandría, ya que Eratóstenes no disponía entonces de cálculo trigonométrico.

Figura 7: Posible cálculo de Eratóstenes, utilizando la longitud de los catetos de dos triángulos semejantes en lugar de un ángulo difícil de medir. Nótese que el ángulo real de Eratóstenes es aún mucho menor que el mostrado en este diagrama

Figura 7: Posible cálculo de Eratóstenes, utilizando la longitud de los catetos de dos triángulos semejantes en lugar de un ángulo difícil de medir. Nótese que el ángulo real de Eratóstenes es aún mucho menor que el mostrado en este diagrama

Para evitar un cálculo fino de 7,2 grados, y, por tanto, el ángulo del sector terrestre que separa ambas ciudades, en la Figura 7 se muestra un posible cálculo no exacto, pero sí sencillo, que es plausible Eratóstenes pudo haber usado para obtener el radio de la Tierra. Se trata de dos triángulos semejantes. Tenemos bien medidos los dos catetos del triángulo pequeño del obelisco, y aproximadamente medido el cateto pequeño del triángulo grande, que es la distancia entre ambas ciudades. Esta distancia curva entre ciudades es solo ligerísimamente inferior a la longitud L mostrada en la Figura 7, de modo que la magia de dos triángulos semejantes permitiría a Eratóstenes efectuar una simple regla de tres, y el radio de la Tierra es R=L(h/s), es decir R = 800 km (21 m/2,6 m) = 6461 km. Los triángulos son asombrosos.

Sobre el autor: Victor Etxebarria Ecenarro es Catedrático de Ingeniería de Sistemas y Automática en la Universidad del País Vasco (UPV/EHU)

El artículo Einstein, Tesla, Eratóstenes y sus triángulos se ha escrito en Cuaderno de Cultura Científica.

¡Ups! Galileo y las mareas

Muchos desconfiaron de la teoría de Johannes Kepler para explicar las mareas. Según el astrónomo alemán, estas se debían por alguna clase de atracción misteriosa que la Luna ejercía sobre las mareas. Uno de los que desconfió de esta teoría fue Galileo Galilei y se puso a pensar en la suya propia. Para él las mareas eran producto de la rotación y la traslación de la tierra. Aquello parecía tener todo el sentido del mundo. Al girar sobre sí misma y alrededor del sol, la tierra sufría aceleraciones y desaceleraciones periódicas. Hoy sabemos que Galileo se equivocó y las arriesgadas intuiciones de Kepler eran correctas.

Los vídeos de ¡UPS¡ presentan de forma breve y amena errores de la nuestra historia científica y tecnológica. Los vídeos, realizados para la Cátedra de Cultura Científica de la UPV/EHU, se han emitido en el programa de ciencia Órbita Laika (@orbitalaika_tve), en la 2 de RTVE.

Producción ejecutiva: Blanca Baena

Guion: José Antonio Pérez Ledo

Grafismo: Cristina Serrano

Música: Israel Santamaría

Producción: Olatz Vitorica

Doblaje: K 2000

Locución: José Antonio Pérez Ledo

Edición realizada por César Tomé López

El artículo ¡Ups! Galileo y las mareas se ha escrito en Cuaderno de Cultura Científica.

Primera vía metabólica que produce óxido nítrico en plantas a partir de aminoácidos

Una investigación, liderada por la Universidad Pública de Navarra (UPNA) y en la que colabora la Universidad del País Vasco (UPV/EHU), muestra la primera vía metabólica que produce óxido nítrico (NO) en plantas a partir de aminoácidos y la importancia de las oximas, un tipo de compuestos químicos, como productoras de dicha molécula. Este hallazgo, anhelado durante más de veinte años en el ámbito de la biología vegetal, tiene potenciales aplicaciones en la agricultura y la medicina.

El monóxido de nitrógeno (según la nomenclatura IUPAC), más conocido como óxido nítrico, una molécula pequeña (un átomo de nitrógeno unido a un átomo de oxígeno, NO), gaseosa e incolora, juega un papel clave como señalizador en muchas funciones vitales de los organismos vivos. En humanos regula aspectos cruciales como la salud cardiovascular e influye en el rendimiento deportivo. Además, está involucrado en la síntesis de antioxidantes y en procesos inflamatorios. Su importancia fue reconocida con el Premio Nobel de Medicina de 1998.