Actúa localmente: electrónica de papel

Foto: Thomas Renaud / Unsplash

Foto: Thomas Renaud / UnsplashLa digitalización del mundo parece a estas alturas un hecho irreversible. Internet es ya accesible desde casi cualquier rincón del planeta y, donde no lo es, pronto será posible con proyectos como Starlink. Teléfonos móviles, tabletas, ordenadores y lo que se ha dado en llamar wearables, esto es, cosas que vestimos, como relojes o gafas inteligentes, cada vez serán más omnipresentes. La internet de las cosas será la guinda.

Un mundo hiperconectado, sí, pero también de recursos limitados.

Todos estos dispositivos se basan en el uso de materiales no renovables, algunos son reciclables es verdad, como la mayoría de los metales, pero eso es algo complicado y lo que es complicado es caro. Llegará un momento en que solo lo reciclado será económicamente viable, y eso ocurrirá cuando los recursos naturales se vuelvan tan difíciles de extraer que compense el proceso de reciclar.

Por tanto, la digitalización tal y como la conocemos implica a la larga un problema grave de materias primas. En estos días estamos viviendo en el mundo una situación similar con el suministro de chips, lo que conlleva que no se puedan fabricar coches suficientes para satisfacer la demanda, lo que dispara el mercado de los coches de segunda mano, lo que a su vez, dispara la inflación.

¿Será el futuro uno distópico en el que solo unos pocos privilegiados podrán permitirse el uso de los últimos dispositivos espintrónicos, de precio desorbitante, mientras el resto de la humanidad reutiliza componentes? No necesariamente. Los que ya tenemos una edad recordamos unos argumentos similares con el papel, hablo de justo antes de Internet. Periódicos y libros iban a acabar con los bosques del planeta. Pero no, sistemas inteligentes de gestión de los bosques industriales ha conseguido que hoy haya más superficie forestal en algunos países que hace tres décadas.

La gran diferencia con los materiales para la electrónica es que no pueden plantarse como los árboles, puede parecer un argumento definitivo. Pero, ¿y por qué no? Bastaría con que el soporte de la electrónica fuese papel y cartón. En vez de usar hilos de metal como conductores, el papel podría imprimirse con tintas conductoras. Parece de ciencia ficción, pero la solución es tan real como el problema global al que se enfrenta la humanidad.

El proyecto Innpaper, coordinado por Cidetec, se basa precisamente en esas características del papel que lo harían el soporte electrónico perfecto: barato, flexible, renovable y reciclable. Las fibras de celulosa del papel se pueden adaptar a casi cualquier propósito imaginable: conducir electricidad, repeler el agua, proteger de los campos magnéticos. El objetivo de Innpaper es desarrollar tintas y papeles funcionales con los que imprimir baterías, antenas, circuitos y hasta monitores; esto es, utilizar el papel no solo como sustrato sino también como componente activo en dispositivos electrónicos.

Los primeros usos de estos nuevos dispositivos podrían encontrarse en las industrias del envase y embalaje, la seguridad, la alimentación y la salud en forma de etiquetas inteligentes o dispositivos de detección de presencia de drogas, sustancias indeseadas, contaminaciones o enfermedades.

Como demostración de que la idea es viable, Innpaper pretende contruir tres dispositivos operativos concretos orientados a los sectores alimentario, de seguridad y médico. Los tres casos de uso integrarán diferentes sensores en la plataforma electrónica en papel, adaptada a los requisitos de la industria. Para el sector alimentario, etiquetas inteligentes para envasado de alimentos que incluyen sensores de humedad, temperatura y presión; para el de seguridad, un dispositivo para la detección de cafeína y drogas en bebidas y saliva; y, para el médico, un sistema para la detección de la presencia del virus de la gripe y de bacterias estreptococos.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Actúa localmente: electrónica de papel se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Actúa localmente: convertidores de potencia basados en carburo de silicio

- Actúa localmente: la espintrónica que viene

- Actúa localmente: simulaciones hiperrealistas

Viaje al corazón de la transición ecológica

María Larumbe / GUK

Trabajos de campo en la mina Gonçalo (Portugal). En la parte inferior puede observarse un dique subhorizontal de pegmatita enriquecida en lepidolita (mena de litio), de tonos rosados. El dique está encajado en roca granítica (material gris). En la imagen el doctor Jon Errandonea Martin señala hacia la mena mientras con el metro provee de escala a la fotografía.

Trabajos de campo en la mina Gonçalo (Portugal). En la parte inferior puede observarse un dique subhorizontal de pegmatita enriquecida en lepidolita (mena de litio), de tonos rosados. El dique está encajado en roca granítica (material gris). En la imagen el doctor Jon Errandonea Martin señala hacia la mena mientras con el metro provee de escala a la fotografía.Desde la prehistoria, el hombre ha explotado la tierra para la fabricación de herramientas, armas y material de construcción extrayendo piedras, materiales cerámicos y metales. La minería es, de facto, una de las profesiones más antiguas del mundo y, pese a todos los avances tecnológicos, el ser humano sigue siendo muy dependiente de los minerales en su día a día.

De hecho, algunos de los elementos, como el litio, que se encuentran en minerales concretos, son la base de los teléfonos móviles, tablets y otros dispositivos electrónicos, así como de las baterías de coches eléctricos, imprescindibles para realizar la transición ecológica y minimizar la huella de carbono. Su extracción, que se hace principalmente a partir de dos tipos de depósitos: salmueras y pegmatitas, paradójicamente, no siempre es todo lo ecológica que cabría esperar: pudiendo impactar de forma negativa en la flora y fauna de los alrededores, contaminar el aire, las aguas superficiales y provocar daños en la superficie de la tierra.

En este contexto, desarrollar nuevas técnicas menos invasivas de exploración de metales que se utilizan en la tecnología verde se ha convertido en una prioridad. Este es uno de los principales objetivos de GREENPEG, un proyecto europeo que busca desarrollar tecnologías de exploración avanzada que se puedan utilizar en la búsqueda de pegmatitas. Se trata de rocas ígneas de composición granítica, principalmente constituidas por cuarzo, feldespato y mica, que pueden contener otros minerales enriquecidos en metales como litio, cesio o tantalio, con importantes aplicaciones en el desarrollo de dispositivos electrónicos o en el coche eléctrico.

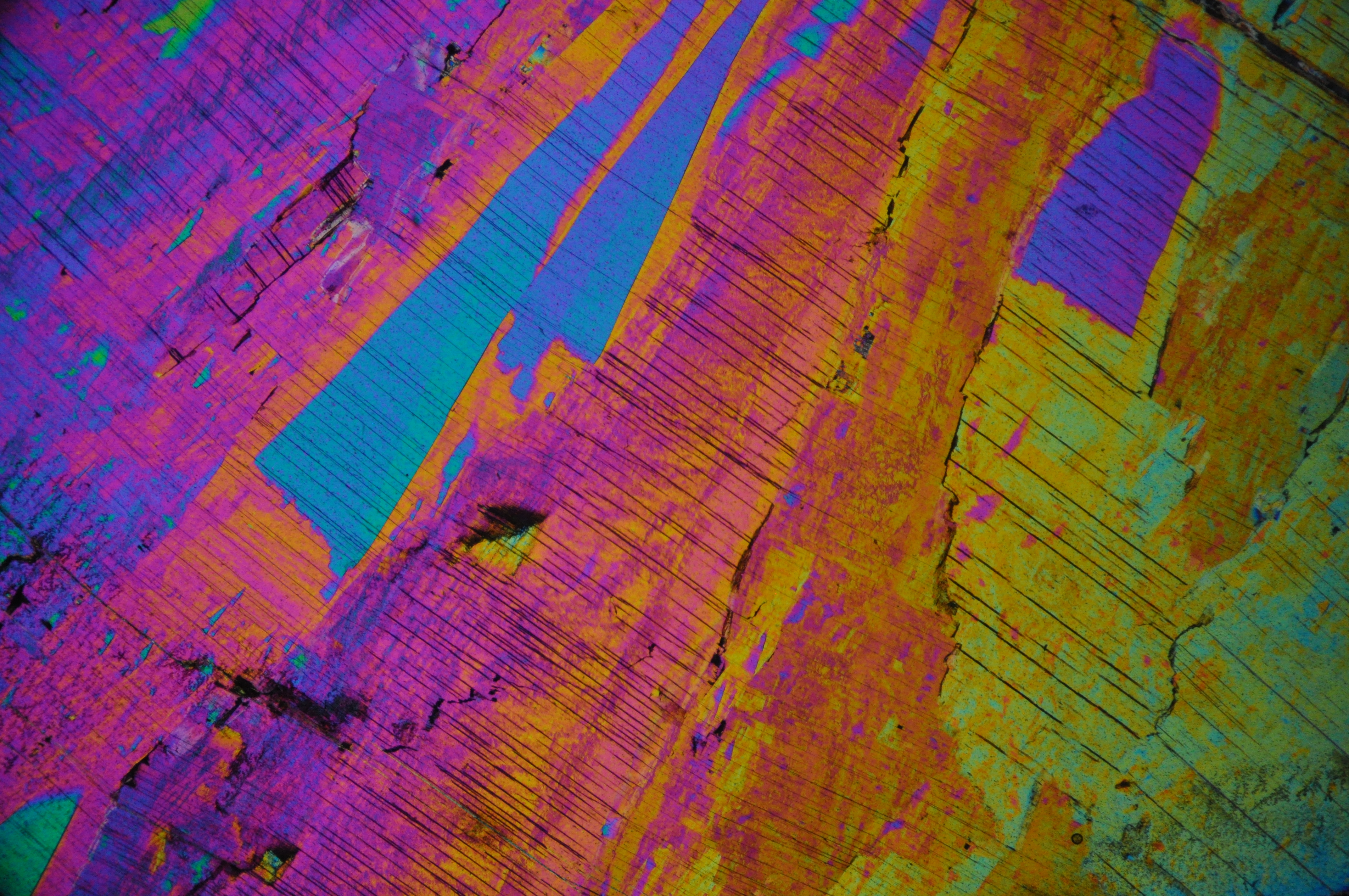

La doctora Idoia Garate Olave observando algunas de las muestras de lepidolita (en la pantalla), por medio de un microscopio petrográfico.

La doctora Idoia Garate Olave observando algunas de las muestras de lepidolita (en la pantalla), por medio de un microscopio petrográfico.Dentro de este proyecto participan varias empresas de exploración y minería y diferentes universidades de Europa. Entre ellas, el grupo de investigación que dirige la doctora Encarnación Roda-Robles, geóloga e investigadora principal de la Facultad de Ciencia y Tecnología de la UPV/EHU. Desde su grupo, VARISBLIP, se encargan de una parte muy destacada del proyecto, el diseño de las herramientas de exploración de las rocas pegmatíticas de tipo LCT (Litio-Cesio-Tantalio), que contienen estos minerales, para la explotación de material relacionado con las energías verdes. “Estas herramientas que vamos a diseñar queremos que sean fáciles y rápidas en el uso, económicas y poco invasivas para el medio ambiente”, explica la doctora Roda-Robles.

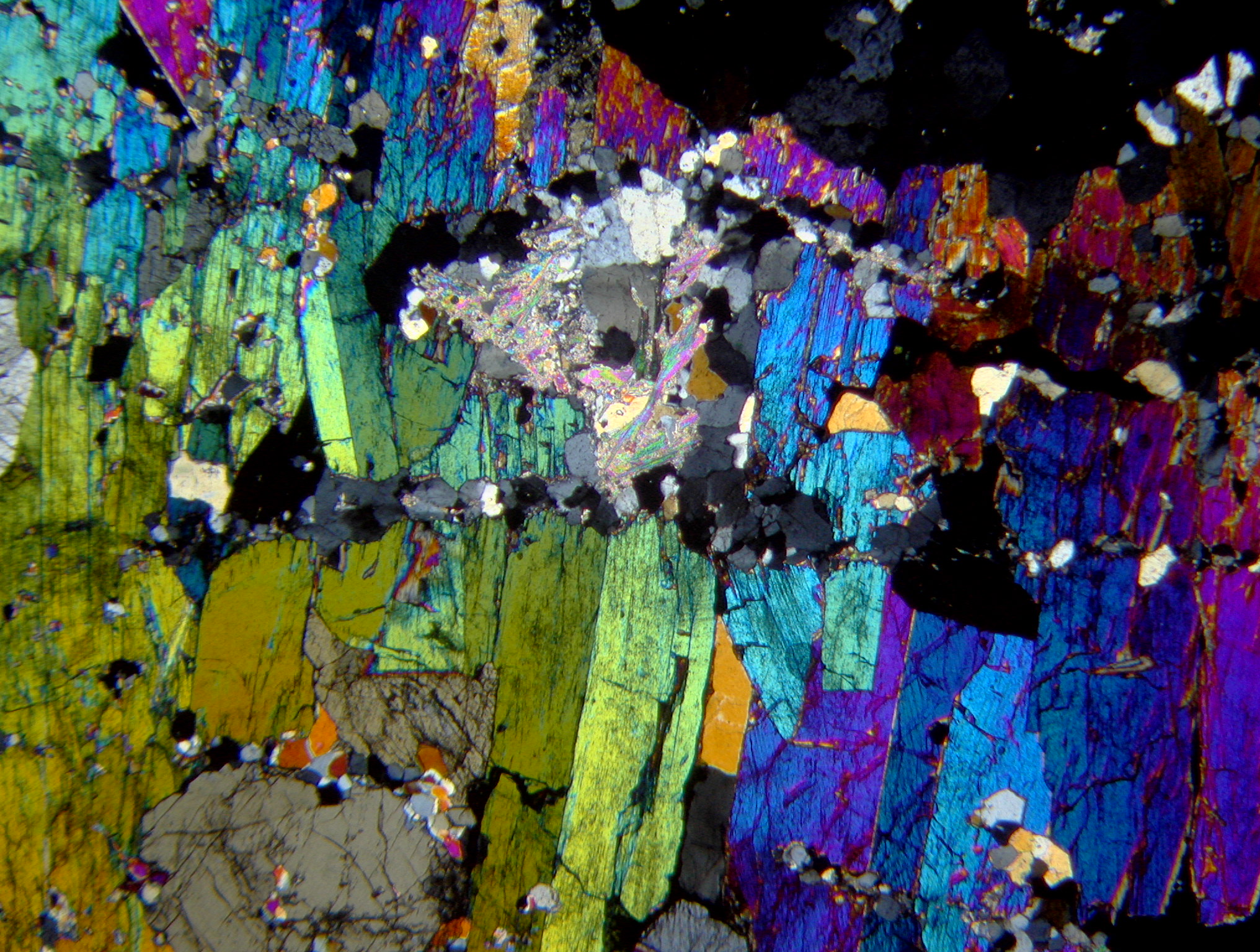

Cristales de lepidolita (mena de litio) vistos al microscopio petrográfico.

Cristales de lepidolita (mena de litio) vistos al microscopio petrográfico.Otro de los objetivos de este proyecto es reducir la dependencia de Europa de otros países como China y Australia, pioneros en la explotación del litio, y favorecer la explotación de los recursos minerales que tiene Europa de una forma más sostenible, económica y menos invasiva. Para ello, el grupo de investigación está centrado en el estudio de las rocas pegmatíticas que, como indica la doctora, “pueden ser particularmente ricas en metales tecnológicos, aunque a menudo presentan pequeñas dimensiones y son difíciles de encontrar por medio de técnicas de exploración tradicionales”.

Pegmatitas, el “cerdo” de la tierra

Cristales de espodumena (mena de litio) en una masa de roca pegmatítica (mina Alberto, Salamanca)

Cristales de espodumena (mena de litio) en una masa de roca pegmatítica (mina Alberto, Salamanca)Las pegmatitas son unas rocas muy interesantes ya que de ellas se extraen elementos poco abundantes en la corteza terrestre, y también piedras preciosas como pueden ser el aguamarina o la turmalina. Según explica la doctora y responsable del grupo de investigación, de estas rocas “se puede aprovechar todo, como del cerdo: desde la obtención de minerales industriales como el cuarzo y el feldespato o las micas, pasando por metales como el litio, tantalio o estaño, o incluso piedras preciosas para la industria joyera y para colecciones de minerales, tanto de museos o de particulares”.

Cristales de espodumena (mena de litio) vistos al microscopio petrográfico.

Cristales de espodumena (mena de litio) vistos al microscopio petrográfico.Estas rocas tienen una gran importancia para realizar la transición ecológica. De las pegmatitas se pueden extraer metales como el litio, el cesio, o el tantalio, que son elementos indispensables en la fabricación de dispositivos de energía verde como, por ejemplo, dispositivos para el almacenamiento de energía, en células fotovoltaicas, para la fabricación de turbinas eólicas y condensadores o en los móviles, cámaras y tablets.

En este sentido, como explica la doctora Rodas-Robles, “Europa es muy dependiente del exterior para poder fabricar estas baterías de litio. Son ya conocidos algunos depósitos de litio de la Península Ibérica, y hay un buen número de indicios geológicos que señalan que este es un territorio muy rico en este elemento. Ahora tenemos que buscarlo”. Dentro del proyecto, desde el grupo de investigación están trabajando en Arribes del Duero (Salamanca), Almendra y Gonçalo (Portugal), Tres Arroyos (Badajoz) y en distintas localidades de Cáceres. Su objetivo es abordar la exploración de estas rocas a distintas escalas: desde la localización, el muestreo y el análisis de rocas. El proyecto se inició hace un año, en mayo de 2020, y se desarrollará durante cuatro años y medio.

Hacia una minería más ecológica

La investigación que está llevando a cabo el equipo de la doctora Rodas-Robles tiene dos partes principales. La primera es realizar un estudio litogeoquímico, es decir, investigar la huella que ha dejado la pegmatita dentro de la roca donde está encajada. En concreto, su trabajo consiste en el muestreo y análisis de rocas mineralizadas en litio de la Península Ibérica con el objetivo de determinar la extensión y cuantía de la huella química dejada por los diques pegmatíticos mineralizados en litio en las rocas que los albergan.

“Una vez obtengamos estos datos, los complementaremos con estudios de sedimentos de arroyos y suelos, ya que siempre que se produce una anomalía química en una roca, el aumento en la concentración de los elementos implicados se va a reflejar no solo en las rocas cercanas, sino también en los suelos que se forman a partir de esas rocas y en los depósitos de los ríos.”

Al no necesitar de la realización de sondeos ni excavaciones en roca, esta herramienta de exploración tendrá la ventaja de ser más rápida y económica, al mismo tiempo que menos invasiva, con un impacto mínimo en las zonas de estudio, que en el caso de la Península Ibérica se desarrollará a pequeña escala, en áreas con un radio limitado a 25 kilómetros.

Aunque la dependencia de los minerales siga siendo evidente, si el ser humano quiere mantener su estilo de vida y garantizar un futuro para las generaciones que están por llegar, es necesario pensar en verde. O al menos eso se deduce de la Agenda 2030 de la Organización de las Naciones Unidas para transformar el mundo durante esta década. O de iniciativas como GREENPEG que tratan de recuperar la competitividad del sector de la minería desde una perspectiva sostenible y con la mirada puesta en reducir las emisiones de CO2, apostando por el coche eléctrico en detrimento de los combustibles fósiles.

Foto de todos los miembros del equipo de investigación VARISBLIP, tomada en una zona de estudio (Alburquerque, Badajoz). De izquierda a derecha: Pedro Pablo Gil Crespo, Jon Errandonea Martin, Idoia Garate Olave, Alfonso Pesquera Pérez y Encarnación Roda Robles.

Foto de todos los miembros del equipo de investigación VARISBLIP, tomada en una zona de estudio (Alburquerque, Badajoz). De izquierda a derecha: Pedro Pablo Gil Crespo, Jon Errandonea Martin, Idoia Garate Olave, Alfonso Pesquera Pérez y Encarnación Roda Robles.Encarnación Roda-Robles es geóloga e investigadora principal del grupo de investigación VARISBLIP de la Universidad del País Vasco UPV/EHU.

El artículo Viaje al corazón de la transición ecológica se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La variedad de residuos madereros y la riqueza ecológica de los hayedos

- Un viaje al pasado a lomos del coltán

- Nivel formativo y transición demográfica

Obesidad y adicción a la comida: un problema emergente de salud pública

Gabriel Rubio Valladolid y Francisco López-Muñoz

Foto: Shutterstock / Creativa Images

Foto: Shutterstock / Creativa Images

La obesidad representa un importante problema de salud pública, no solamente por el número de personas afectadas, sino por las severas complicaciones médicas y los costes sanitarios que ocasiona. Se considera obesidad cuando una persona tiene tiene un índice de masa corporal (IMC) igual o superior a 30 kg/m². Un IMC igual o mayor de 40 kg/m² se considera obesidad extrema. El sobrepeso queda definido entre 25 y 29,9 kg/m².

Según la Organización Mundial de la Salud, desde la década de 1980 hasta la actualidad se ha duplicado la prevalencia mundial de la obesidad. En países como España, el 39,4 % de la población adulta tiene sobrepeso y el 22,9 %, obesidad. Si esta tendencia continúa en incremento, se estima que en 2030 la cantidad de personas con exceso de peso aumentará un 16 % más, lo que supondría un coste añadido de 3 100 millones de euros anuales, solo de costes médicos.

¿Qué es la adicción a la comida?

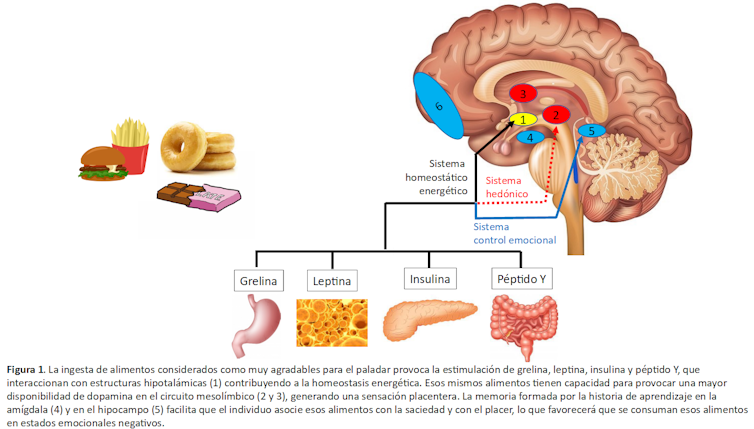

La adicción a la comida es una propuesta teórica con importantes apoyos experimentales y clínicos. Esta considera que algunos individuos pueden sufrir una respuesta similar al consumo de drogas cuando ingieren alimentos con alto contenido de grasa o carbohidratos refinados como el azúcar (Figura 1).

Una reciente revisión sistemática analizó 52 estudios sobre obesidad y adición a la comida publicados entre 1999 y 2017, tanto clínicos como realizados en animales de experimentación. Sus resultados pusieron de manifiesto que los criterios que estaban presentes en ambos trastornos eran:

- Preocupación por la comida.

- Comer en exceso a pesar de los riesgos para la salud.

- Perder el control sobre la ingesta.

- Malestar cuando se hace régimen de adelgazamiento.

- Deterioro de la vida social debido al sobrepeso.

- Cronicidad del trastorno.

- Tendencia a las recaídas.

Esta teoría sigue siendo controvertida, sobre todo porque las investigaciones que pretenden identificar el agente adictivo en los alimentos (por ejemplo, el azúcar añadido) están en sus fases iniciales.

Sin embargo, cada vez hay más apoyo a que la adicción a la comida podría relacionarse con un fenotipo presente en un subgrupo de personas con obesidad. Cuando se ha utilizado la escala de Yale para la adicción a la comida se ha constatado la presencia de este trastorno en pacientes que presentan atracones de comida, en quienes sufren frecuentes ciclos de adelgazamiento y engorde debido a las dietas, y en personas con obesidad.

Entre las personas con obesidad, la prevalencia de la adicción oscila entre el 15 y el 25 % y se considera el factor causal del desarrollo del sobrepeso. En un reciente trabajo realizado en población general norteamericana se ha confirmado que, de los 986 individuos representativos de ese país, el 15 % cumplía criterios de la adicción y se asociaba a la presencia de obesidad, edad joven, mujeres con elevado índice de masa corporal y a menores ingresos económicos.

Modelo de adicción a la comida

Como se observa en la Figura 1, la comida, y de forma más clara la comida rica en hidratos de carbono o grasas agradables al paladar (como los que aparecen en el lado izquierdo de la figura), interaccionan con el organismo a través de tres sistemas.

Por un lado, la ingesta provoca la liberación de hormonas producidas en diferentes órganos, como el estómago o el páncreas, o el tejido adiposo. Estos mediadores interaccionan con el hipotálamo para modular la sensación de hambre o de saciedad.

Por otro lado, también estimulan el sistema hedónico implicado en la recompensa cerebral, a través de la dopamina, como ocurre con sustancias como el alcohol o la cocaína.

La historia de aprendizaje previo que cada sujeto haya realizado con la ingesta de diferentes alimentos, en circunstancias y estados emocionales diversos, facilita el aprendizaje por condicionamiento. De esta manera el sujeto vuelve a querer ingerir dichos alimentos cuanto se repiten esos contextos.

La interacción con esos sistemas pone en marcha los mismos tres estadios que ocurren en la adicción a drogas. Inicialmente, la persona asocia determinados alimentos con una sensación placentera inducida por la dopamina en el circuito de la recompensa.

Posteriormente, el sujeto percibe que echa de menos la ingesta de esos alimentos, y con el tiempo experimenta el deseo o ansia por los mismos. De esa forma, y con mayor frecuencia, cuando atraviesa estados emocionales negativos (aburrimiento, ira o ansiedad) o está expuesto a esos alimentos, siente una importante ansia. Esto provoca la compulsión por ingerirlos.

Los estudios de imágenes cerebrales indican que los circuitos alterados en personas con obesidad son los mismos que se encuentran alterados en personas con adicción a drogas de abuso y pone en evidencia un desequilibrio entre los que motivan las conductas (por su implicación en la recompensa y el condicionamiento) y los que controlan e inhiben las respuestas de alimentación.

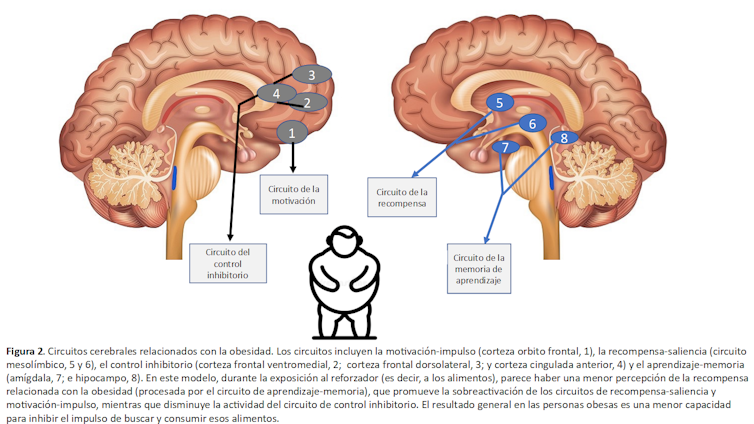

El modelo de la Figura 2 muestra estos 4 circuitos: (i) recompensa-saliencia; (ii) motivación-impulso; (iii) aprendizaje-memoria; y (iv) circuito de control inhibitorio.

En los individuos vulnerables, el consumo de alimentos apetecibles, en grandes cantidades, puede alterar el equilibrio normal entre estos circuitos. Esto da lugar a un mayor valor hedónico de los alimentos y a un debilitamiento del control inhibitorio. La exposición prolongada a dietas hipercalóricas también puede alterar directamente el aprendizaje condicionado y, por tanto, reajustar los umbrales de recompensa en esas personas. Los cambios en las redes corticales descendentes que regulan las respuestas prepotentes conducen a la impulsividad y a la ingesta compulsiva de alimentos.

¿Qué importancia tiene esto en el tratamiento de la obesidad?

El hecho de desconocer que al menos un subgrupo de personas con obesidad pueda tener adicción a la comida tiene graves repercusiones para la planificación del programa de tratamiento.

En primer lugar, en ellos el adecuado seguimiento del tratamiento dietético no es un problema de voluntad. Las dificultades de estas personas para resistir el valor motivacional de la comida constituyen una barrera que los profesionales deben conocer para evitar la injusta culpabilización y el consiguiente estigma de las personas con obesidad. Muchos de ellos lo expresan con frases como: “No como para disfrutar, sino para evitar encontrarme mal”.

Una idea muy extendida es que todas las personas deben perder peso si ingieren menos calorías de las que gastan. Este planteamiento lineal no se sostiene en personas con obesidad y adicción a la comida, donde el estado de estrés crónico es la norma.

En esas condiciones, la activación del eje hipotálamo-hipófisis-adrenal provoca una elevación del cortisol y de los glucocorticoides, que favorece la producción de tejido adiposo visceral y la ingesta de alimentos. Además, decrece la producción de leptina y se incrementa la producción de grelina, aumentando las sensaciones de hambre.

Asimismo, se produce un aumento de la insulina y del neuropéptido Y, el cual incrementa la ingesta de alimentos, especialmente aquellos con alto contenido en azúcares y grasas. La sobreingesta de azúcares, en esas circunstancias, puede interrumpir las señales de saciedad, modificando los mecanismos fisiológicos homeostáticos que regulan la ingesta energética y llevan a los individuos a un aumento de la misma (comer hedónico).

Si el efecto de las dietas “yo-yo” (adelgazamiento y pronta recuperación del peso) es muy frecuente, más lo es todavía en personas con adicción a la comida, y de hecho estos altibajos suelen agravarla.

En los casos de personas que se someten a cirugía bariátrica, los equipos de tratamiento deberían adaptar el programa de tratamiento posterior y llevar a cabo intervenciones psicoterapéuticas orientadas a la adicción, así como tener en cuenta la tendencia de estas personas a desarrollar otras, como por ejemplo al alcohol.

Otro elemento a tener en cuenta es la elevada prevalencia de trastornos depresivos y de ansiedad entre los sujetos obesos. La creencia de que estas personas suelen estar contentas es otro error y el infradiagnóstico de estos trastornos la norma.

Finalmente, otro asunto relevante es el de la exclusión o no de los alimentos con elevada capacidad adictiva (chocolate, hamburguesas, bollería industrial). En bastantes dietas se permite que las personas puedan ingerir, al menos un día a la semana, los alimentos que deseen. Sin embargo, en las personas con adicción a la comida se debe tener un exquisito cuidado con este tipo de recomendaciones.

Como en otras conductas adictivas (alcohol, juego), la publicidad alienta al consumo de este tipo de comida (basura). En este sentido, la Administración debería incluir advertencias en el etiquetaje o informar sobre los riesgos de determinados alimentos sobre la salud.![]()

Sobre los autores: Gabriel Rubio Valladolid es catedrático de psiquiatría en la Universidad Complutense de Madrid y Francisco López-Muñoz profesor titular de farmacología en la Universidad Camilo José Cela

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Obesidad y adicción a la comida: un problema emergente de salud pública se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Campañas de salud pública con efecto bumerán

- La obesidad infantil podría iniciarse antes de la concepción

- Obesidad y delgadez también se heredan

Iñaki Úcar – Naukas 19: Aprendiendo de las máquinas

Imagen: Pixabay

Imagen: PixabayLa inteligencia artificial es la ciencia de conseguir que las máquinas hagan cosas que, si las hiciesen los humanos, requerirían de eso que llamamos inteligencia. En esta definición no se dice que las máquinas piensen, ni que las metáforas asociadas (algoritmo genético, red neuronal) tengan que ver con la realidad biológica, ni siquiera que tengan que aprender de los humanos. De hecho, aprender de las máquinas puede ser uno de los principales hitos del presente siglo.

Iñaki Úcar es doctor en telemática por la Universidad Carlos III de Madrid e investigador postdoctoral del UC3M-Santander Big Data Institute. Podeís leerle en Aprendiendo de las máquinas.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Iñaki Úcar – Naukas 19: Aprendiendo de las máquinas se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Aprendiendo de las máquinas

- Las máquinas moleculares que han ganado un Nobel

- Máquinas inteligentes (II): Inteligencia artificial y robótica

El grafeno, un caballo de Troya contra los peces

Foto: UPV/EHU

Foto: UPV/EHUEl grafeno es un nanomaterial bidimensional compuesto por carbono, formado por una sola capa de átomos de carbono densamente empaquetados. Su elevada resistencia mecánica y sus importantes propiedades eléctricas y térmicas hacen que el grafeno sea muy apropiado para muchas aplicaciones nuevas en los campos de la electrónica, los sensores biológicos, químicos y magnéticos, los fotodetectores y el almacenamiento y la generación de energía. Debido a sus potenciales aplicaciones, se espera que la producción de grafeno aumente considerablemente en los próximos años, pero dada su escasa implantación en el mercado y las limitaciones para el análisis de sus efectos, en la actualidad todavía no se dispone de mucha información sobre las concentraciones de nanomateriales de grafeno en los ecosistemas.

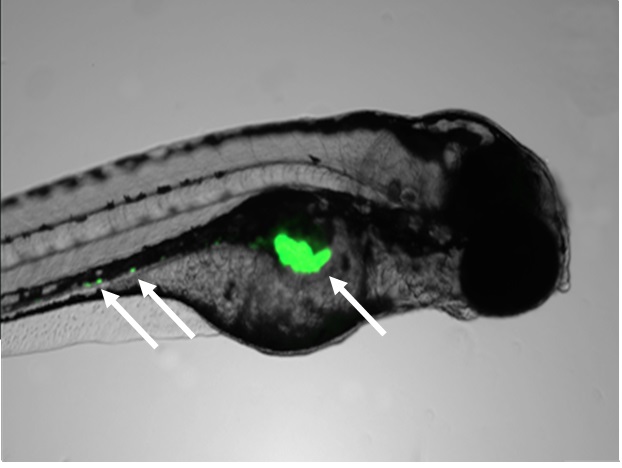

Como consecuencia de las características superficiales del grafeno, una vez en el medio acuático, el grafeno podría actuar como portador de contaminantes orgánicos, como los hidrocarburos aromáticos policíclicos, para los organismos acuáticos. En este sentido, el grupo de investigación CBET (Biología Celular en Toxicología Ambiental) ha evaluado la capacidad del óxido de grafeno para adsorber hidrocarburos aromáticos policíclicos y la toxicidad del óxido de grafeno solo y en combinación con ciertos hidrocarburos aromáticos policíclicos en embriones y adultos de pez cebra. La investigación ha sido realizada en colaboración con la Universidad de Burdeos.

“Los resultados han puesto de manifiesto que el óxido de grafeno puede portar hidrocarburos aromáticos policíclicos al interior del pez cebra (mediante una especie de efecto de caballo de Troya) y producir efectos subletales. En las condiciones que empleamos, los efectos tóxicos no han sido enormes, no han muerto peces ni embriones, pero en algunos biomarcadores hemos detectado efectos que nos ponen sobre aviso”, ha señalado Amaia Orbea, doctora del grupo CBET de la UPV/EHU.

Por un lado, han detectado que en los embriones puede haber malformaciones a altas concentraciones, “lo que significa que en exposiciones más largas y en concentraciones más altas es posible que nazcan animales inviables”, explica Orbea. Por otro lado, en esta investigación han comprobado que “a largo plazo, en una exposición de tres semanas, la enzima acetilcolinesterasa, que frena los estímulos nerviosos, estaba inhibida en todos los peces tratados, por lo que a pesar de no utilizar concentraciones muy altas, hemos visto que al aumentar el tiempo de exposición empiezan a aparecer efectos neurotóxicos”, ha señalado la investigadora.

“Nosotros hemos utilizado unas concentraciones y unos plazos concretos, pero desconocemos la evolución que tendrán estas concentraciones a partir de ahora en la naturaleza y su posible influencia en relación con otros contaminantes. Los resultados nos han demostrado que las concentraciones que pueden existir en este momento en el medioambiente no son muy peligrosas, pero tenemos que tener cuidado: no sabemos qué efectos pueden tener estas concentraciones bajas en exposiciones más largas. Los resultados obtenidos están relacionados con las condiciones aplicadas en nuestros experimentos. Normalmente no encontramos grafeno solo en el medio ambiente; junto al grafeno hay muchos otros contaminantes que también afectan a los animales… Deberíamos considerarlos todos a la vez”, ha concluido.

Referencia:

Ignacio Martínez-Álvarez, Karyn Le Menach, Marie-Hélène Devier, Iranzu Barbarin, Radmila Tomovska, Miren P. Cajaraville, Hélène Budzinski, Amaia Orbea (2021) Uptake and effects of graphene oxide nanomaterials alone and in combination with polycyclic aromatic hydrocarbons in zebrafish Science of the Total Environment doi: 10.1016/j.scitotenv.2021.145669

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo El grafeno, un caballo de Troya contra los peces se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Construcción de heteroestructuras de grafeno con precisión atómica

- Una fuente de radiación terahertz usando grafeno

- Un gigantesco efecto espín-órbita confina a los electrones del grafeno en islas de plomo

Kepler y la simetría de los copos de nieve

Foto: Olga Sytina & Alexey Kljatov

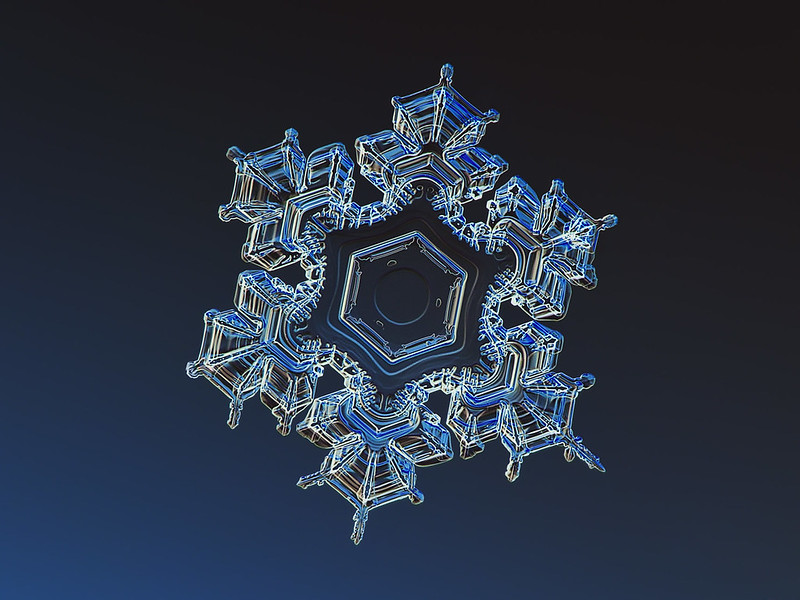

Foto: Olga Sytina & Alexey KljatovEn enero de 1611, Johannes Kepler le hizo un regalo verdaderamente peculiar a su amigo y benefactor, Johannes Matthaeus Wacker von Wackenfels. Para celebrar el Año Nuevo le entregó una carta en la que explicaba por qué los copos de nieve tienen forma hexagonal.

Kepler, que en aquel momento ejercía como matemático imperial en la corte del emperador Rodolfo II, había empezado a reflexionar sobre este tema después de un paseo de invierno por Praga. Al observar los copos de nieve que caían sobre su abrigo, “todos con seis esquinas y radios emplumados”1, pensó que aquel era un motivo perfecto para escribir un ensayo con el que sorprender a su amigo:

“Algo más pequeño que cualquier gota, pero con un patrón subyacente. Aquí estaba el obsequio de Año Nuevo ideal para quien no necesita nada, justo lo que un matemático puede regalar […] puesto que procede del cielo y parece una estrella».

Hoy, la simetría de los copos de nieve nos resulta tan familiar, que sus seis puntas se han convertido en un icono del invierno, y de los festejos navideños que acompañan a esta época del año en nuestro hemisferio. Pero, por sorprendente que pueda parecer, Kepler fue el primer europeo en escribir sobre esta cuestión a comienzos del siglo XVII —en China, en cambio, varios siglos antes de nuestra era, T’ang Chin ya había propuesto una explicación de numerológica; argumentaba que “dado que el seis es el verdadero número del agua, cuando el agua se congela en flores, estas han de tener seis puntas”2.

El físico alemán intenta averiguar los motivos que subyacen a este número. «Debe haber una causa por la cual la nieve tiene la forma de una estrella de seis esquinas», escribió en su breve ensayo. “No puede ser casualidad. ¿Por qué siempre seis?”. Esta pregunta, tan sencilla en apariencia, aún tardaría varios siglos en encontrar una respuesta precisa. Pero la curiosidad de Kepler le lleva a intuir, hace cuatrocientos años, las bases de lo que hoy constituye la ciencia de la cristalografía.

Según describe en El copo de seis puntas, «la unidades naturales más pequeñas de un líquido como el agua» (eso que hoy entendemos como átomos o moléculas) se agrupan a escala infinitesimal de la manera más compacta posible. En un tono siempre poético y recreativo, Kepler imagina esas partículas como pequeñas esferas microscópicas y argumenta que el hexágono es, precisamente, la figura que optimiza su empaquetamiento. Aquí estaba en deuda con el matemático inglés Thomas Harriot, quien había resuelto este mismo problema geométrico en 1585. Lo había hecho a bordo de un navío. Como asesor científico de una expedición a las Américas, le encargaron encontrar la manera más compacta de apilar las balas de cañón en la cubierta de los buques, y la simetría hexagonal no tardó en aparecer.

Hoy sabemos que esta explicación peca un poco de simplista. Si bien es cierto que la materia está formada por partículas elementales, diminutas e idénticas entre sí, las moléculas de agua tienen una forma más compleja que la de una esfera, en realidad. A falta de este dato, Kepler no consigue entender por qué, al apilarse, acaban dando lugar a cristales planos, como los copos de nieve. Tampoco puede explicar la diversidad de otro tipo de cristales, cuyas formas no siempre son hexagonales. El mismo Kepler se da cuenta de esta limitación y termina su ensayo aclarando que aún queda investigación por delante:

“He llamado a las puertas de la química y veo cuánto queda por decir antes de que podamos comprender nuestra causa».

Pero incluso en esta claudicación aparente, Kepler termina estando en lo cierto. A fin de cuentas, la clave de esta hermosa simetría se encuentra en la química de las moléculas. Los átomos de oxígeno del agua ocupan un volumen mayor y tienden a empaquetarse en una red hexagonal, pero son los enlaces que forma el hidrógeno entre las moléculas los que facilitan que el crecimiento del cristal en seis direcciones de forma regular. Gracias a estas fuerzas invisibles, podemos admirar una pequeña escultura de agua que, como decía Kepler “procede del cielo y parece una estrella”.

Referencias:

1Kepler, Johannes. The Six-Cornered Snowflake. Oxford University Press, 1966.

2Schlichting, H. Joachim. “La belleza cristalina de los copos de nieve.” Investigación y Ciencia, 2017, pp. 88-89. Investigación y Ciencia, https://www.investigacionyciencia.es/revistas/investigacion-y-ciencia/la-observacin-de-ondas-gravitacionales-695/la-belleza-cristalina-de-los-copos-de-nieve-14944.

Para saber más:

Copos de nieve, Frankenheim o el nuevo Euclides

Sobre la autora: Almudena M. Castro es pianista, licenciada en bellas artes, graduada en física y divulgadora científica

El artículo Kepler y la simetría de los copos de nieve se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Cristalografía (5): Copos de nieve, Frankenheim o el nuevo Euclides

- El microondas es seguro, lo que hace es calentar

- Presión y volumen de un gas

Con Maryam Mirzakhani como inspiración, hoy se celebra el «Día de las Mujeres Matemáticas»

Nos dijeron que no podíamos hacer matemáticas porque éramos mujeres. […] Hubo mucho desdén flagrante y manifiesto, pero también hubo un estímulo sutil. Había mucha gente que apreciaba los buenos estudiantes, hombres o mujeres, y yo era una muy buena estudiante. Me gustó hacer lo que se suponía que no debía hacer, fue una especie de rebelión legítima.

Karen Uhlenbeck (1942), Premio Abel 2019. Cita original en este enlace.

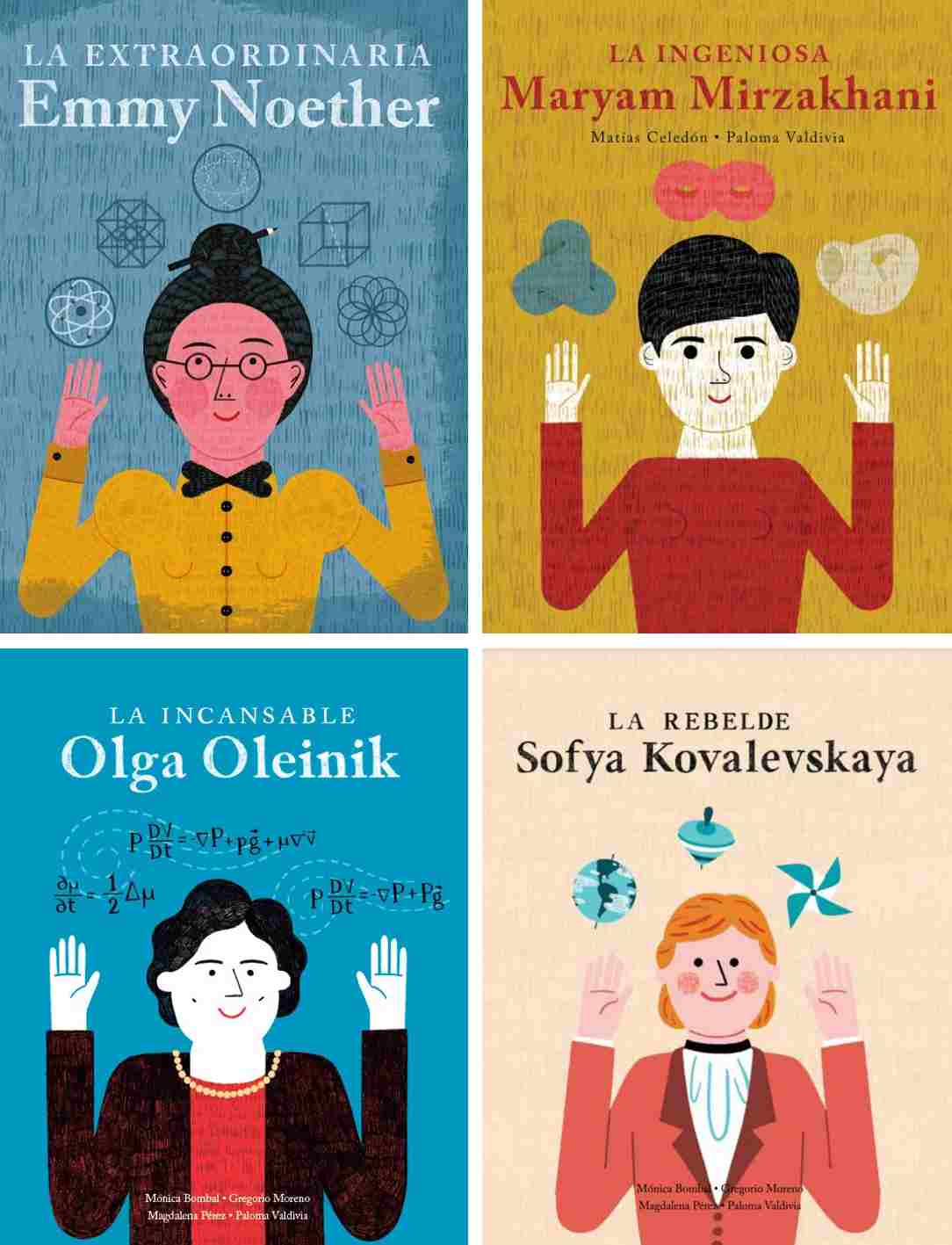

Hace dos años, el 12 de mayo de 2019, se celebró por primera vez el Día de las Mujeres Matemáticas, una iniciativa propuesta por el Comité de Mujeres y Matemáticas de la Sociedad Matemática Iraní durante el World Meeting for Women in Mathematics, un evento satélite del International Congress of Mathematicians 2018. La fecha se eligió en homenaje a la matemática iraní Maryam Mirzakhani (1977-2017), nacida un 12 de mayo, y única mujer en haber ganado una Medalla Fields.

En este día de celebración de las aportaciones de las mujeres matemáticas comparto una iniciativa creada por el equipo del Núcleo Milenio Modelos Estocásticos de Sistemas Complejos y Desordenados de la Universidad de Chile y la Pontificia Universidad Católica de Chile.

Se trata de una serie de cuatro cuentos ilustrados –de momento, aunque su idea es continuar con al menos uno más dedicado a Sophie Germain–, pensados para edades comprendidas entre los 6 y los 10 años, y centrados en las figuras de cuatro mujeres matemáticas.

Al final de cada cuento se añade un glosario que pretende aclarar los conceptos matemáticos y físicos que se citan en el texto, así como dar algunos datos sobre los científicos aludidos.

La extraordinaria Emmy Noether (2017)

Los dibujos son de la ilustradora Paloma Valdivia, y los textos de ella misma y del escritor y periodista Matías Celedón. El matemático Gregorio Moreno se ha encargado de revisar los contenidos científicos.

Además de las dificultades en su vida –fundamentalmente por ser mujer y judía en la Alemania de principios del siglo XX– el cuento repasa algunas de las aportaciones matemáticas de Emmy Noether (1882-1935).

El libro alude, por ejemplo, a su colaboración con los matemáticos David Hilbert y Felix Klein en problemas relacionados con la teoría de la relatividad de Albert Einstein. También se menciona que sus matemáticas, aunque abstractas, tuvieron repercusiones muy relevantes en física.

La ingeniosa Maryam Mirzakhani (2018)

Los dibujos son de la ilustradora Paloma Valdivia, los textos de ella misma y del escritor y periodista Matías Celedón, y el matemático Gregorio Moreno se ha ocupado de revisar los contenidos científicos.

La narración comienza cuando Maryam Mirzakhani (1977-2017) era una niña que leía con pasión y soñaba con ser escritora. Al principio no se le daban demasiado bien las matemáticas, pero gracias a una profesora que confío en ella y a su amiga Roya, se enamoró de esta materia.

El cuento alude a su trabajo en superficies hiperbólicas en los comienzos de su investigación, a su costumbre de ‘dibujar garabatos’ para centrarse en el problema en el que estaba pensando, y en los problemas de billares en los que también investigó. Por supuesto también se alude al galardón que recibió en 2014: la Medalla Fields, siendo Maryam la primera mujer en obtenerlo.

La incansable Olga Oleinik (2019)

Los dibujos son de las ilustradoras Magdalena Pérez y Paloma Valdivia y los textos de la profesora de literatura Mónica Bombal y el matemático Gregorio Moreno.

La narración comienza hablando de la situación de guerra en Ucrania, en el momento en el que nació Olga Arsenievna Oleinik (1925-2001). Cuando el ejército alemán invadió el lugar en el que vivía, la familia tuvo que huir para trasladarse a los Urales. También evacuaron a esa zona al Departamento de Física y Matemáticas de la Universidad Estatal de Moscú y así, de manera totalmente inesperada, Olga pudo estudiar con los más destacados científicos rusos.

En la época de la Guerra Fría, ya en Moscú, pudo completar su tesis doctoral sobre ecuaciones en derivadas parciales: su director fue Ivan Georgevic Petrovsky.

Escribió más de 350 artículos de investigación y tutorizó más de 50 tesis doctorales, además de colaborar con científicas y científicos de otros muchos países.

La rebelde Sofya Kovalevskaya (2020)

Los dibujos son de la ilustradora Magdalena Pérez y los textos de la profesora de literatura Mónica Bombal y el matemático Gregorio Moreno.

El texto comienza comentando el entorno familiar de Sofia Kovalevskaya (1850-1891) y las influencias que tuvo de sus antepasados a través de sus diferentes pasiones.

Un amigo de su padre descubrió sus enorme capacidad e intuición para las matemáticas, aunque en Rusia no tenía posibilidad de estudiar. Gracias a su matrimonio de conveniencia con Vladimir Kovalevski, Sofía pudo salir de su país. Se puso en contacto con Karl Weierstrass quien, tras ponerla a prueba y comprobar su brillantez, se convirtió en su mentor y la ayudó a conseguir un doctorado en Matemáticas en la Universidad de Gotinga.

Tras conseguir un contrato en la Universidad de Estocolmo gracias a la ayuda del matemático Gösta Mittag-Leffler –aunque tuvo que trabajar sin salario durante un año–, Sofía ganó el Premio Bordin de la Académie des sciencies de Francia por un trabajo sobre la rotación de sólidos alrededor de un punto fijo.

Bonus

Aunque la matemática iraní Maryam Mirzakhani inspiró la celebración del Día de las Mujeres Matemáticas, la enfermera y estadística Florence Nightingale (1820-1910) también nació tal día como hoy, hace 201 años.

Referencias

-

La extraordinaria Emmy Noether pueden leerse online en este enlace, o descargarse gratuitamente en formato pdf.

-

La ingeniosa Maryam Mirzakhani pueden leerse online en este enlace, o descargarse gratuitamente en formato pdf.

-

La incansable Olga Oleinik pueden leerse online en este enlace, o descargarse gratuitamente en formato pdf.

-

La rebelde Sofya Kovalevskaya puede leerse online en este enlace, o descargarse gratuitamente en formato pdf.

Sobre la autora: Marta Macho Stadler es profesora de Topología en el Departamento de Matemáticas de la UPV/EHU, y colaboradora asidua en ZTFNews, el blog de la Facultad de Ciencia y Tecnología de esta universidad

El artículo Con Maryam Mirzakhani como inspiración, hoy se celebra el «Día de las Mujeres Matemáticas» se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Los experimentos de Alex Plota o cómo las matemáticas revelan los resultados de una reacción química

- El rostro humano de las matemáticas

- ¿Cómo mejorar la comunicación entre las matemáticas y las ciencias de la vida?

Actúa localmente: blockchain para la cadena de suministros

Fuente: Tecnalia

Fuente: TecnaliaEn un mundo cada vez más interconectado los datos, y la información que se extrae de ellos, son un recurso de un valor económico incalculable. Por otra parte esa misma interconexión permite que grupos de hackers delincuentes* puedan atacar remotamente instalaciones, ya sea para provocar el caos, ya sea para pedir rescates.

Una de las actuaciones que estos delincuentes pueden llevar a cabo es alterar la trazabilidad de las cosas. Por ejemplo, puede alterar todos los registros que indican que un determinado producto se fabricó en determinado lugar en determinada fecha por un agente concreto. La utilidad de esto se encuentra rápidamente si pensamos criminalmente: ese producto podría ser un pasaporte falso, un cargamento de explosivos o una partida de fármacos defectuosa. Igualmente los delincuentes pordrían alterar el destino de mercancías con solo alterar los datos asociados a ellas en los registros correspondientes.

Un caso especialmente preocupante de lo anterior, porque nos puede tocar a cualquiera en donde más duele, es alterar la cadena de custodia de nuestro dinero en nuestras cuentas corrientes o la propiedad de nuestros activos financieros, empezando por la suplantación de nuestra identidad. Existe todo un subgénero cinematográfico dedicado a este peligro.

La ciberseguridad se ocupa precisamente de proteger nuestra identidad en la red y garantizar que solo nosotros podamos acceder a lo que es nuestro. En este sentido un prodecimiento que sea capaz de asegurar que una cadena de transacciones es inalterable porque cualquier intento de alterarla queda inmediata y automáticamente al descubierto sería más que útil. Este prodecimiento y la tecnología asociada existe: blockchain. Sin duda asociamos este término con las criptomonedas en general y con el bitcoin en particular.

Iñaki Úcar explicaba así qué es el blockchain:

El blockchain surge en 2009 como solución a un problema clásico de sistemas de moneda virtual descentralizados: el problema del doble gasto. Las divisas tradicionales funcionan porque hay una entidad central que se encarga de su buen funcionamiento, y en la que el sistema económico y financiero deposita su confianza (e.g., el Banco Central Europeo). Con la adopción de Internet y los sistemas distribuidos, surge un interés en el desarrollo de divisas digitales que no dependan de un mediador de confianza, pero todos los planteamientos chocan frontalmente con el problema del doble gasto: que una misma moneda (en el sentido de “unidad básica” de la divisa) pueda ser falsificada y gastada más de una vez. En 2009 el creador del bitcoin (bajo el pseudónimo Satoshi Nakamoto) propone una solución basada en un triple enfoque: todas las transacciones se comparten públicamente; las transacciones válidas se determinan por un sistema de prueba de trabajo (proof of work); y se incentiva económicamente la contribución a este sistema (por los llamados mineros).

Estos tres pilares se integran en la tecnología blockchain, que no es más que la unión de dos técnicas bien conocidas y desarrolladas: los árboles Merkle y la criptografía (en forma de firma digital de clave pública y funciones hash). El árbol Merkle es una estructura de datos ideada y patentada en 1979 por Ralph Merkle, diseñada para concatenar información de forma que un nodo dado permite verificar de forma segura y eficiente toda la información que cuelga de él. Tiene muchas aplicaciones, como en el intercambio de archivos en redes P2P o en software de control de versiones como Git. Blockchain es básicamente una cadena de bloques (tipo Merkle, pero, en principio, sin ramificaciones) a la que se añade la firma digital para verificar los participantes en las transacciones.

La tecnología blockchain puede usarse como contenedor de cualquier tipo de datos encadenados, como los que corresponden a la trazabilidad segura de un producto. En Tecnalia están desarrollando Traceblock, que permite obtener una visión única del estado, no solo para una partida concreta, sino para toda la cadena de suministro. Ofrece una garantía de origen inalterable, donde cada actor de la cadena escribe/firma y responde sobre la veracidad de su información que es consistente con la concatenación de acciones en blockchain.

Nota:

* No todos los hackers son delincuentes.

Sobre el autor: César Tomé López es divulgador científico y editor de Mapping Ignorance

El artículo Actúa localmente: blockchain para la cadena de suministros se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Actúa localmente: robots inteligentes autoadaptativos para la producción industrial

- Actúa localmente: la espintrónica que viene

- Actúa localmente: tranvías eléctricos sin catenaria

Por qué tu color de ojos no coincide con el de tus padres

Antonio José Caruz Arcos

Fuente: Shutterstock / Gaiteal

Fuente: Shutterstock / Gaiteal

A la pregunta “¿En qué te fijas para juzgar el atractivo de una persona?”, son muchos los que responden que el color de los ojos es determinante. El color azul causa furor más que ningún otro, quizás por ser mucho menos frecuente que el marrón. Aunque, para raro y exclusivo, el color de la cautivadora mirada de la actriz Liz Taylor, de un tono violeta propio de la ciencia ficción.

En nuestra vida cotidiana es frecuente preguntarnos por qué hijos de los mismos padres han heredado colores de ojos totalmente diferentes. ¿Acaso no sigue un patrón convencional de típica genética mendeliana? ¿Qué determina este carácter? ¿Por qué, por ejemplo, hay más del doble de mujeres con ojos verdes que hombres?

El largo camino del color

La mayoría de las poblaciones del mundo tienen ojos de diferentes tonos de marrón. Sin embargo, en gentes de origen europeo existe mayor diversidad. Además del marrón –el más común– hay otros colores prácticamente ausentes en poblaciones de otros continentes. Entre ellos azul, gris, verde o ámbar.

Semejante variedad no puede existir por capricho. Si la evolución ha favorecido que existan diferentes tonos de iris debe ser por algo. Sin embargo, lo cierto es que tanto la función fisiológica del color del iris como sus posibles ventajas biológicas son un misterio.

Con el color de la piel no hay tanto desconocimiento. Sabemos que este carácter está asociado con la intensidad de la radiación ultravioleta. Y que la evolución selecciona una piel más clara a medida que nos alejamos del Ecuador.

Se debe a que es necesario que exista un equilibrio entre la protección de la piel frente a la radiación ultravioleta y la producción de vitamina D que es estimulada por los rayos del sol. Una piel excesivamente pigmentada en latitudes muy al norte (o al sur) daría lugar a una deficiencia de esta vitamina y problemas de salud, especialmente en la formación de los huesos. Pero nada de esto parece guardar relación directa con el color de los ojos.

Lo que sí sabemos es que el color del iris depende de 3 parámetros fundamentales:

- El tipo de pigmento, eumelanina para el marrón oscuro-negro y feomelanina de color rojizo;

- la cantidad y distribución de melanosomas, es decir, de los pequeños sacos cargados de pigmento dentro de las células del epitelio;

- las variaciones en la estructura fina del iris, las encantadoras contracciones y los misteriosos nudos que podemos observar especialmente en personas de ojos claros.

¿Y qué hay de los genes? En 2007 se realizó el primer estudio de genoma completo en poblaciones europeas identificándose 10 genes implicados en este carácter. Este estudio fue posteriormente replicado y los genes confirmados por otro equipo de investigadores. Esto permitió desarrollar un sistema de predicción del color de los ojos en función de datos genéticos, el denominado Hirisplex.

Sin embargo, no era un sistema de predicción totalmente fiable. Funcionaba muy bien para discriminar entre ojos marrones y azules, pero para el resto de los colores era relativamente ineficiente.

¿Por qué? Pues porque se habían quedado cortos. Lo demuestra un estudio publicado este mismo año y basado en el mayor número de voluntarios reclutados hasta la fecha, casi 200 000. Los autores identificaron un total de 52 genes diferentes que influyen en el color de los ojos. ¡Más de medio centenar!

Parece claro que estamos ante un carácter biológico complejo donde los haya. Esto no se parece nada a la herencia de los grupos sanguíneos ni al color de las flores de los guisantes de Mendel que nos enseñaban en el instituto.

Genética de caracteres complejos

Es solo un ejemplo de lo que nos depara la llamada genética de caracteres complejos. Una de las grandes beneficiadas será la ciencia forense, dado que pronto podremos predecir a partir de una gota de sangre o de un trozo de hueso, no solo el color de la piel y los ojos, sino también otros caracteres morfológicos más complejos.

Sin ir más lejos, un estudio español reciente permitió conocer el aspecto de los cazadores del paleolítico. Eran negros de piel y con ojos azules, un fenotipo ausente en las poblaciones europeas actuales y absolutamente inesperado.![]()

Sobre el autor: Antonio José Caruz Arcos es catedrático de genética de la Universidad de Jaén

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Por qué tu color de ojos no coincide con el de tus padres se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Un alelo para las gafas de color de rosa

- Envejecemos mejor que nuestros padres

- El color y sus orígenes

Efectos colaterales de la Covid19

Photo by David Veksler on Unsplash

Photo by David Veksler on UnsplashLas medidas de orden higiénico y social adoptadas por las autoridades de casi todo el mundo desde febrero de 2020 no solamente han conseguido limitar la expansión del SARS-CoV-2, que es lo que se buscaba, también han contenido la expansión de otros patógenos, como el de la gripe, o varios catarrales. Uno de estos es el virus respiratorio sincitial (VRS).

El VRS es responsable de muchos catarros invernales, pero en niños puede provocar afecciones más serias. La primera infección por este virus en los menores de un año puede producir infecciones graves de las vías aéreas inferiores; es responsable del 50% de las bronquiolitis y del 25% de las neumonías. Es muy contagioso; la probabilidad de que un niño de un año haya sido contagiado por ese virus es superior al 95%. Se estima que las infecciones por VRS provocan en España entre 15000 y 20000 visitas anuales a urgencias pediátricas y entre 7000 y 14000 hospitalizaciones. Entre 70 y 250 niños fallecen al año por su causa.

Hace un año, cuando en Australia se encontraban en mitad del otoño y los virus respiratorios deberían haber empezado a circular por la población, sobre todo la infantil, tan solo a un 1% de los niños y niñas ingresados en un hospital de Perth se les diagnosticó una infección por VRS. El verano siguiente, fueron un 70% de los hospitalizados los que dieron positivo en el correspondiente test. Las medidas para detener el avance de la Covid19 habían provocado un retraso de medio año en la expansión del VRS. En otras zonas de Australia se registraron fenómenos similares.

El hemisferio norte, como es lógico, no es ajeno al fenómeno. En Francia la epidemia de VRS empezó en febrero, 12 semanas más tarde de lo habitual. Y de acuerdo con simulaciones basadas en los casos de registrados en los Estados Unidos en 2020, en próximos años pueden producirse brotes importantes de VRS -los más intensos en el próximo invierno- como consecuencia de las medidas de aislamiento y distanciamiento entre la gente implantadas.

Muchos pediatras australianos y de otros países están preocupados. En Australia se han dado cuenta de que la mayoría de niños y niñas de menos de 18 meses de edad no ha estado en contacto nunca con el VRS, y otros muchos, mayores de esa edad, llevan 18 meses sin haberlo estado, y es posible que la inmunidad frente a ese virus se haya desvanecido. El problema es que no saben cómo reaccionará el sistema inmunitario de todos esos niños y niñas cuando se contagien con el virus.

Esa es la razón por la que en los servicios de salud del Reino Unido, por ejemplo, se han propuesto observar con atención la evolución de esa viriasis, por si tuvieran que tomar medidas especiales al respecto. El único tratamiento disponible, de carácter profiláctico –anticuerpos monoclonales– se utiliza para casos de alto riesgo, bebés prematuros o criaturas con problemas cardiacos, principalmente.

El VRS no es el único patógeno con el que entran en contacto los niños durante sus primeros meses y años de vida. Y lo apuntado para ese virus sería, en principio, aplicable a esos otros microorganismos. Por ello, los especialistas recomiendan que, ante la previsible reducción de la incidencia de Covid19 hasta niveles manejables por los servicios de salud, no se abandonen rápidamente todas las medidas en vigor para limitar los contagios, como las recomendaciones higiénicas, el uso de mascarilla o evitar aglomeraciones. Los contagios por VRS se producirían más lentamente y los servicios de salud dispondrían así de más tiempo y recursos para hacerle frente.

Fuentes:

Asociación Española de Pediatría: Virus Respiratorio Sincicial (VRS)

Rachel E. Baker et al (2020): The impact of COVID-19 nonpharmaceutical interventions on the future dynamics of endemic infections. PNAS 117 (48) 30547-30553.

Donna Lu (2021): Children´s immunity at risk. New Scientist 250 (3332): 8-9

Sobre el autor: Juan Ignacio Pérez (@Uhandrea) es catedrático de Fisiología y coordinador de la Cátedra de Cultura Científica de la UPV/EHU

El artículo Efectos colaterales de la Covid19 se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- #Naukas13 El anumerismo y sus efectos colaterales

- Sí con mis impuestos

- Lo que funciona, y lo que no, contra la Covid-19

Iván Rivera – Naukas Bilbao 2019: ¿Qué inventen ellos?

Fuente: Wikimedia Commons

Fuente: Wikimedia CommonsEl mito del buen salvaje de Rousseau, absolutamente infundado, ha influido en el pensamiento contemporáneo hasta límites insospechados. Desde el «buenismo» (todo el mundo es bueno, son las circunstancias la que lo hacen malo, en la base de cosas como el concepto de prisión como centro de rehabilitación, o de la transferencia de la responsabilidad de actuar adecuadamente al individuo durante una pandemia) hasta la animadversión contra la tecnología, la industria y la civilización en general, fuentes de todo mal. Es posible que se reconozcan estas ideas sin refinar como parte consustancial de algunas formaciones políticas contemporáneas. Iván Rivera nos presenta algunas de las falacias relacionadas con la tecnología dentro de las ideas más influyentes de este personaje.

Iván Rivera es ingeniero de telecomunicaciones, director de innovación en una empresa de tecnologías ferroviarias y miembro del Comité Ejecutivo del Railway Innovation Hub.

Edición realizada por César Tomé López a partir de materiales suministrados por eitb.eus

El artículo Iván Rivera – Naukas Bilbao 2019: ¿Qué inventen ellos? se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Naukas Bilbao 2017 – Ricardo Oltra: Que inventen ellos

- Carlos Briones – Naukas Bilbao 2019: Luna

- José Miguel Viñas – Naukas Bilbao 2019: Meterorología cuántica

El impacto medioambiental del ciclo de vida del tren de alta velocidad en España

Fuente: Mariano Álvaro / Wikimedia Commons

Fuente: Mariano Álvaro / Wikimedia CommonsEspaña cuenta con la segunda red de líneas de alta velocidad más larga del mundo, solo superada por China. En términos relativos, España es el líder mundial. Actualmente, cuatro corredores principales conectan Madrid con otras regiones periféricas: Madrid-Cataluña, Madrid-León (corredor norte), Madrid-Levante y Madrid-Andalucía. En 2016, en total, ya estaban en servicio 2.583 km de líneas, y actualmente varios tramos más están en construcción o proyectadas.

El tren de alta velocidad (TAV; AVE en su denominación comercial) se presenta habitualmente como un medio de transporte sostenible con un enorme potencial de reducción de las emisiones de gases de efecto invernadero y de consumo de energía. “La mayoría de los estudios realizados sobre este medio de transporte se han centrado en el análisis y la estimación del ahorro relacionado con la explotación de la red, pero ignoran las cargas asociadas a la construcción de la infraestructura”, explica Andoni Kortazar, investigador de la UPV/EHU. Ante eso, el grupo de investigación Ekopol de la UPV/EHU ha calculado el balance ambiental de todas las líneas de TAV en funcionamiento en España en 2016 con un enfoque del ciclo de vida completo, es decir, teniendo en cuenta las fases de construcción y mantenimiento, además de la fase operativa del tren.

“La metodología de ciclo de vida completo incluye todos los impactos que el tren va a producir a lo largo de toda su vida, desde las materias primas hasta el derribo de la red ferroviaria —afirma Kortazar—. Y para ello hemos realizado el inventario de toda la red: hemos hecho un repaso aéreo o por satélite de los cuatro corredores del AVE, metro a metro”.

El balance ambiental concluye que la variable de mayor incidencia es la demanda de transporte: “El AVE español tiene a nivel global 4,7 millones de pasajeros·kilómetro (o pasajeros equivalentes) al año; se trata de una densidad muy inferior al transporte utilizado en otros países (Francia tiene 25 millones; Alemania 11 millones; China 18 millones; Taiwán 30 millones y Japón (CJRC) 99 millones)”, señala. Así, “a pesar de que el balance ambiental de los corredores de Andalucía y Cataluña es relativamente modesto, la construcción de los corredores de Levante y del norte no está justificada en términos de ahorro energético y de reducción de emisiones debido a la baja demanda que tienen. Por tanto, la decisión de construir nuevos tramos de TAV debería basarse en un análisis de la demanda, y así solo se construyan corredores con alta demanda de transporte”, explica el investigador.

Por otro lado, en el estudio se ha determinado que “para compensar los impactos medioambientales en la construcción, el AVE debe operar durante 15 años”. La mejora en las emisiones que provoca la red ferroviaria durante un año “supone tan solo el 1 % de las emisiones totales de CO2 del transporte en España”, ha añadido. Según el investigador, es muy importante que el tren vaya siempre lleno, que transporte el mayor número de personas posible en cada viaje y que todos esos viajeros y viajeras sean retirados de las carreteras.

Los investigadores creen que el TAV no es la única y mejor solución actual para la transición ecológica en España. Asimismo, señalan que los responsables políticos deberían poner en marcha otras medidas relacionadas con el transporte que reduzcan mucho y rápidamente los impactos ambientales sin la carga que supone la construcción de nuevas infraestructuras. Por ejemplo, “para lograr la citada reducción de emisiones tan modesta, basta con aumentar el grado de ocupación de los vehículos privados que circulan por la carretera en la actualidad; por otro lado, la electrificación del transporte por carretera tendría beneficios desde un punto de vista ambiental, y más aún de cara a un futuro lejano, si se utiliza electricidad procedente de fuentes renovables”, concluye.

Referencia:

Andoni Kortazar, Gorka Bueno & David Hoyos (2021) Environmental balance of the high speed rail network in Spain: A Life Cycle Assessment approach Research in Transportation Economics doi: 10.1016/j.retrec.2021.101035

Edición realizada por César Tomé López a partir de materiales suministrados por UPV/EHU Komunikazioa

El artículo El impacto medioambiental del ciclo de vida del tren de alta velocidad en España se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Cómo regular la velocidad de disolución de los biometales de las prótesis

- La contribución global de los ríos intermitentes al ciclo del carbono

- Cómo garantizar la seguridad del suministro eléctrico en España sin nucleares ni carbón

Un niño recostado delicadamente, el primer enterramiento humano de África

María Martinón-Torres

Una de las características más idiosincráticas del ser humano es la relación que establece con los muertos. La paleontología y la arqueología documentan un amplio abanico de formas de interaccionar con los que han fallecido, pero no todas ellas denotan igual grado de simbolismo o intención.

Algunos de estos comportamientos tienen una finalidad más funcional, como apartar los cadáveres para no atraer a depredadores, desarticular el cuerpo para facilitar su transporte o aprovecharlo nutricionalmente, lo que también se conoce como canibalismo gastronómico.

Pero existen otros comportamientos que se apartan de la “utilidad”, gestos que involucran más recursos y tiempo de los que serían necesarios para simplemente disponer de un cuerpo inerte. La utilización de forma repetida de un lugar, una cavidad natural, por ejemplo, de difícil acceso, protegida, para depositar a los que fallecen, como es el caso del yacimiento de la Sima de los Huesos, en Atapuerca, trasluce una dedicación y un esfuerzo que se escapan de lo meramente práctico.

A partir de ahí, en la evolución de los homininos se despliega una variedad de actos que revelan una implicación cada vez más intensa hacia el fallecido. Con los enterramientos, la comunidad asume el esfuerzo de planificar, de excavar o crear deliberadamente un lugar para depositar el cuerpo en una posición y forma específica y premeditada, a veces acompañado de objetos u ornamentos y, después, sellarlo para protegerlo.

Kenia, Alemania, Burgos

El estudio de los huesos hallados en Panga ya Saidi (Kenia), un yacimiento excavado por el Instituto Max Planck para la Ciencia de la Historia Humana (Jena, Alemania) y los Museos Nacionales de Kenia (Nairobi, Kenia), nos ha permitido descubrir el enterramiento humano más antiguo que se conoce en toda África.

Cueva del yacimiento de Panga ya Saidi donde fue enterrado el niño.

Cueva del yacimiento de Panga ya Saidi donde fue enterrado el niño.Créditos: MPI-SHH

Dada la extrema fragilidad de los restos, los arqueólogos decidieron rescatar los huesos dentro de un bloque de sedimento que, durante más de dos años, se excavó manual y virtualmente –con técnicas de imagen– en los laboratorios del CENIEH (Burgos).

Reconstrucción virtual ideal del esqueleto del niño en el yacimiento.

Reconstrucción virtual ideal del esqueleto del niño en el yacimiento.Autores: Jorge González/Elena Santos.

Mediante el análisis de los fósiles y la tierra circundante hicimos la reconstrucción forense de lo sucedido hace 78 000 años. Un niño de apenas 3 años de edad era enterrado con delicadeza en una cavidad deliberadamente excavada para ello, envuelto en un sudario, en posición encogida, sobre su costado derecho y con una almohada bajo la cabeza. Se trata de una tumba, sí, pero el niño ha sido arropado y dispuesto como si estuviera en su lecho, dormido. ¿Para qué? ¿Por qué se hace todo esto si ya no sirve para nada? Precisamente por eso. Que no sirva para nada le da todo su valor.

Representación artística del enterramiento humano de Panga ya Saidi.

Representación artística del enterramiento humano de Panga ya Saidi.Autor: Fernando Fueyo

En nuestra especie, defenderse de la muerte dejó de ser un acto reflejo y se convirtió en un acto reflexivo. Vivimos con una voluntad terca por domesticar la muerte, por combatirla, por prevenirla, por retrasarla. Y cuando sucede, cuando ya no hay vuelta atrás y la muerte deshabita el cuerpo de un ser amado, entonces, a Homo sapiens aún le queda el orgullo de no agachar la cabeza y decide seguir tratando a los muertos –aunque estén muertos– con la consideración con la que tratamos a los vivos: con delicadeza, con respeto, con compasión. Con esa parte de nuestra vida, la muerte no puede. Y la noción de esa pequeña victoria nos da algo de la paz que la muerte nos arrebata.![]()

Sobre la autora: María Martinón-Torres es directora del Centro Nacional de Investigación sobre la Evolución Humana (CENIEH)

Este artículo fue publicado originalmente en The Conversation. Artículo original.

El artículo Un niño recostado delicadamente, el primer enterramiento humano de África se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- Genuinamente humano

- Los fundamentos del altruismo humano

- La Sima de los Huesos sería el primer acto funerario conocido de la historia de la Humanidad

La simetría como estrategia ganadora: la margarita y bloqueado

En el primer capítulo de mi libro Del ajedrez a los grafos, la seriedad matemática de los juegos, cuyo título era Pensamiento matemático, abordaba diferentes estrategias para la resolución de problemas matemáticos, así como la obtención de estrategias ganadoras en diferentes juegos. Una de las herramientas que quedó fuera en la versión final del libro fue la utilización de la simetría, que hoy abordaremos en esta entrada del Cuaderno de Cultura Científica.

Portada del libro Del ajedrez a los grafos, la seriedad matemática de los juegos (Raúl Ibáñez), de la colección El mundo es matemático, RBA, 2015

Portada del libro Del ajedrez a los grafos, la seriedad matemática de los juegos (Raúl Ibáñez), de la colección El mundo es matemático, RBA, 2015

La simetría es una herramienta muy útil en las demostraciones matemáticas, en la resolución de problemas, incluidos los juegos de ingenio, y en la obtención de estrategias ganadoras en los juegos de competición.

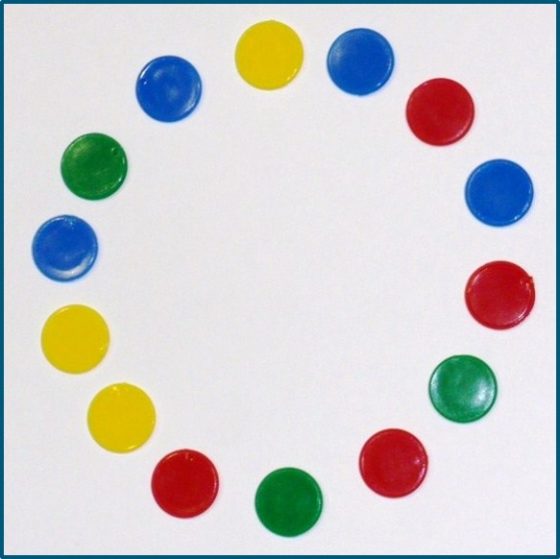

Aunque cuando hablamos de estrategias ganadoras basadas en la simetría en este contexto solemos referimos a que uno de los dos jugadores, normalmente el segundo, realiza movimientos simétricos a los del jugador rival. En esta entrada vamos a mostrar y analizar dos juegos sencillos, la margarita y bloqueado.

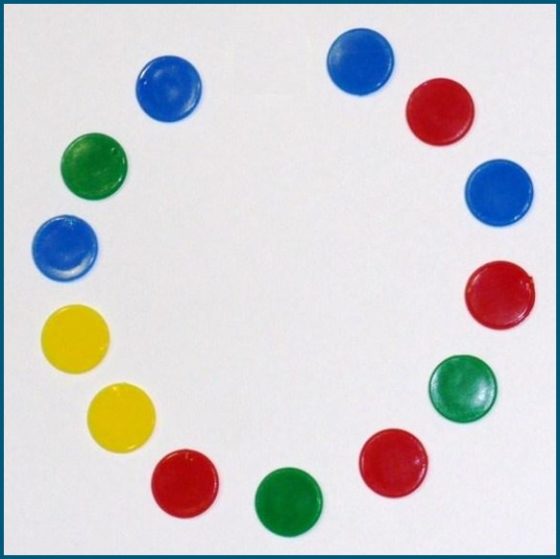

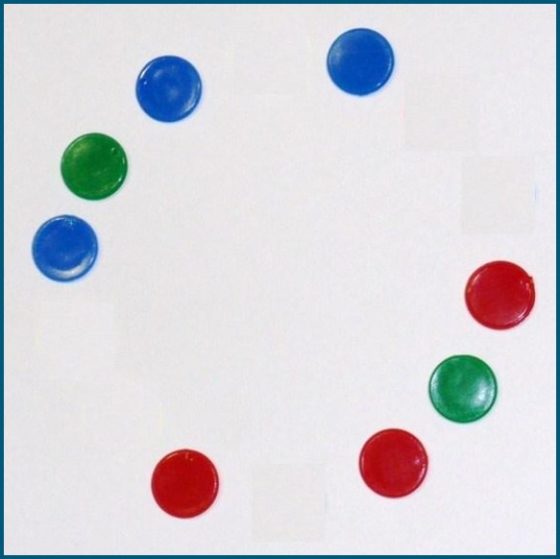

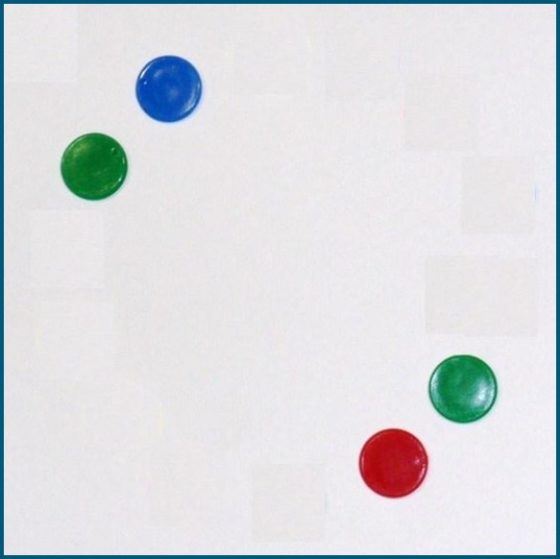

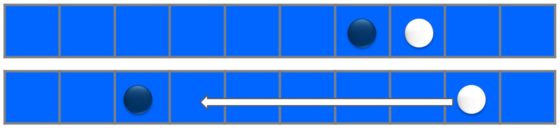

La margarita es un juego para dos personas que se juega con un cierto número de fichas, por ejemplo, dieciséis, formando una circunferencia, como muestra la siguiente imagen. Los jugadores, por turnos, deberán retirar o bien una ficha o bien dos, pero en tal caso que estén una junto a la otra, sin hueco entre ellas. Gana el jugador que retira la última ficha.

Posición inicial del juego la margarita, con 16 fichas

Posición inicial del juego la margarita, con 16 fichasInspirado en el conocido juego infantil “me quiere, no me quiere” mientras se deshoja una margarita, fue inventado por el matemático recreativo y ajedrecista estadounidense Sam Loyd (1841-1911) a finales del siglo XIX. Publicó este juego en 1896 en su columna de rompecabezas del periódico The Brooklyn Daily Eagle, y posteriormente, en la revista británica Tits-Bits en 1897.

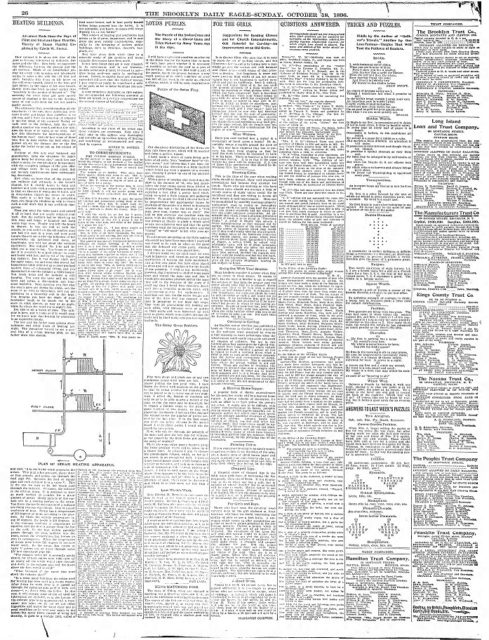

Página del periódico The Brooklyn Daily Eagle, del día 18 de octubre de 1896 que incluye el juego The Daisy Game Problem (El problema del juego de la margarita)

Página del periódico The Brooklyn Daily Eagle, del día 18 de octubre de 1896 que incluye el juego The Daisy Game Problem (El problema del juego de la margarita)

Sam Loyd es uno de los grandes de la matemática recreativa. No solo creaba rompecabezas o problemas de ingenio, o adaptaba algunos ya existentes (con polémicas incluidas sobre su autoría), sino que los vestía con una narrativa fantástica y cautivadora, o los acompañaba de toda clase de trucos publicitarios, como la creación de impactantes premios (un ejemplo fueron los 1.000 dólares que ofreció a quien resolviera el rompecabezas 14-15, que acabaría alcanzando una gran popularidad).

Durante la educación secundaria se aficionó al ajedrez y a la creación de problemas para este juego. Después empezó a estudiar ingeniería, pero descubrió que se podía vivir de la creación de rompecabezas matemáticos y problemas de ajedrez. A lo largo de su vida realizó trabajos muy variados, como contratista de fontanería, grabador de madera, caricaturista o compró una cadena de tiendas de música, pero sobre todo dedicó su tiempo a la creación y publicación de problemas de ingenio.

Escribió columnas en periódicos y revistas, como The Brooklyn Daily Eagle, Tits-Bits (donde colaboró con el británico Henry E. Dudeney) o Scientific American, y editó sus propias revistas, como Sam Loyd’s puzzle magazine.

Entre sus rompecabezas más famosos están el problema de los burros, el puzzle 14-15, de regreso a Klondike o Fuera de la Tierra. Tras su muerte, su hijo publicaría su libro Sam Loyd’s Cyclopedia of 5000 Puzzles, Tricks and Conundrums with Answers (1914).

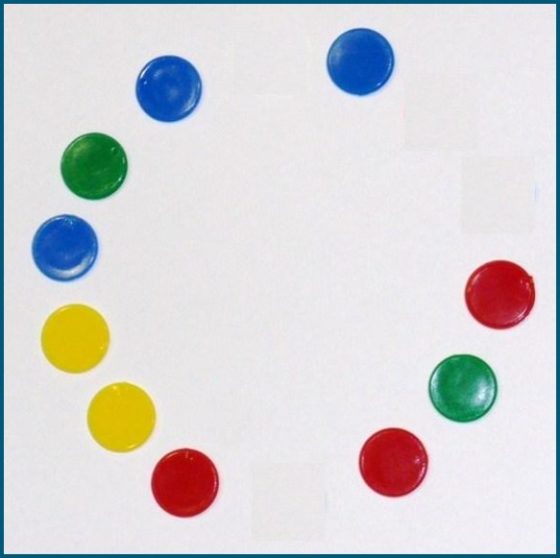

Imagen de la página del libro Cyclopedia of 5000 Puzzles, Tricks, and Conundrums (1914) de Sam Loyd, que incluye el juego de la margarita

Imagen de la página del libro Cyclopedia of 5000 Puzzles, Tricks, and Conundrums (1914) de Sam Loyd, que incluye el juego de la margarita

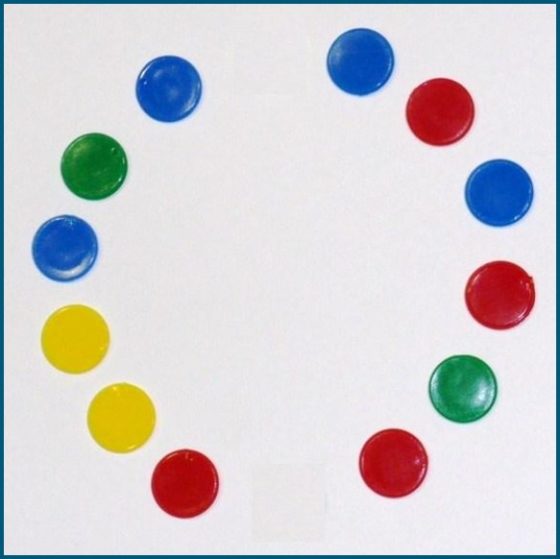

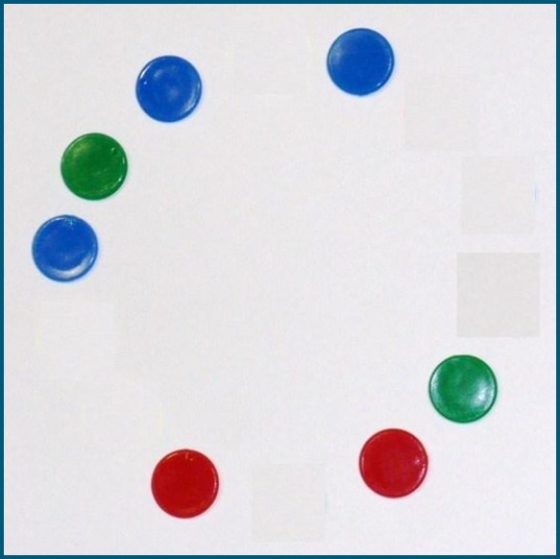

La margarita, también conocido con el nombre la cadena, admite una estrategia ganadora para el segundo jugador basada en la simetría. Si el jugador que inicia la partida retira una ficha (respectivamente, dos), la respuesta del otro jugador será retirar la ficha (respectivamente, las dos fichas) que está en la posición diametralmente opuesta en la circunferencia, generando así dos partes aisladas simétricas (para la margarita de dieciséis fichas, o cualquier cantidad par de fichas).

A partir de la posición inicial de las fichas del juego, como en la imagen que está más arriba, mostramos la primera jugada de los dos jugadores, si el primero quita una de las fichas y el segundo la diametralmente opuesta, quedando efectivamente dos partes aisladas con la misma cantidad de fichas.

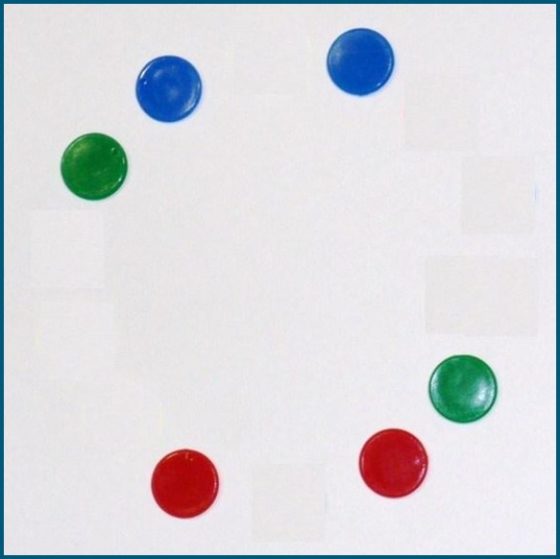

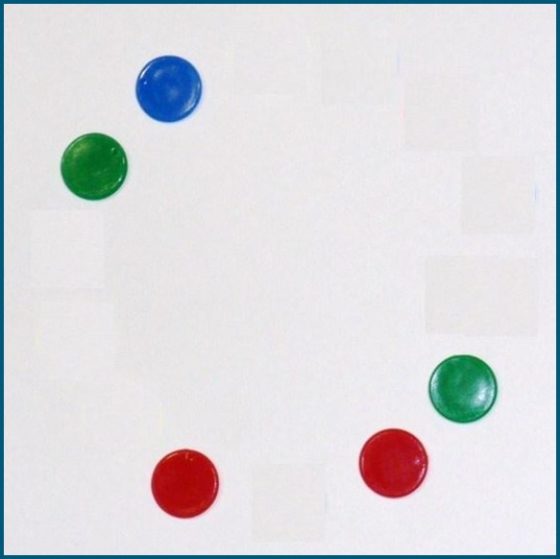

A partir de ese momento, el segundo jugador aplicará la simetría, retirando en cada movimiento las mismas fichas que haya quitado el primero, pero en la parte contraria a la de su oponente. Mostramos las siguientes jugadas del juego iniciado en las anteriores imágenes. Si el primer jugador quita dos fichas de la parte derecha, como muestra la imagen.

El segundo jugador quitará las dos en la parte contraria.

Y así con las demás jugadas, en las que el segundo jugador quita las fichas simétricas a las retiradas por el primer jugador, de manera que así se asegura que será este jugador el que será el último en retirar fichas.

Si el juego empieza con un número impar de fichas, el primer movimiento del segundo jugador consistirá en retirar una cantidad distinta de fichas a la del primer jugador, dos si este ha quitado una y una si han sido dos, con el objetivo de dejar de nuevo las fichas restantes divididas en dos partes simétricas aisladas.

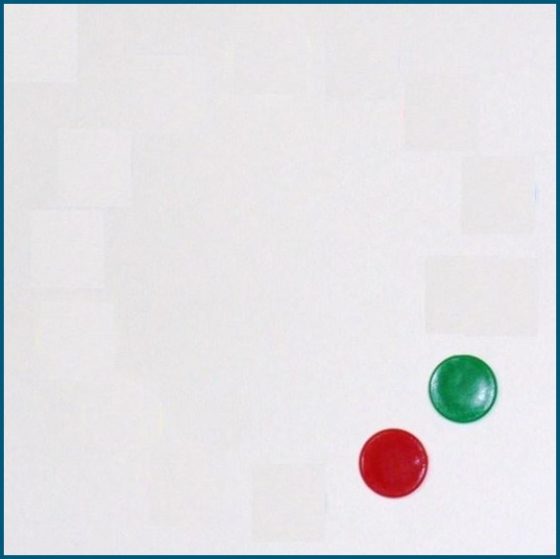

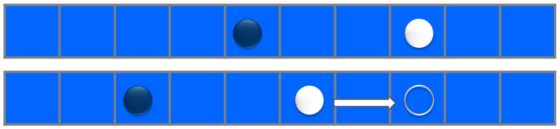

Bloqueado es otro juego para dos personas cuya estrategia ganadora está basada en la simetría. El tablero, que puede pintarse sobre una hoja de papel o construirse con más encanto en madera, consta de dos filas de 10 casillas contiguas. Al iniciarse la partida, cada jugador dispondrá de dos fichas colocadas en un extremo de las dos filas, como se muestra en la imagen.

Posición inicial del juego bloqueado

Posición inicial del juego bloqueado

Las reglas del juego son las siguientes:

i) cada jugador mueve, por turnos, una de sus fichas, con las que avanzará (hacia la derecha o izquierda, dependiendo de su posición inicial), o retrocederá, tantas casillas como desee, sin saltar por encima de las fichas del contrario;

ii) gana el jugador que consiga que su oponente quede bloqueado, es decir, que no pueda mover ninguna de sus dos fichas.

Más allá de las reglas, será jugando cuando nos percataremos de cómo funciona el juego. Una de las primeras observaciones que podemos hacer es que, si un jugador cierra una de las filas, el otro deberá cerrar la otra, obligándole al primero a retroceder hasta que quede bloqueado

Luego la estrategia es obligar al jugador contrario a que cierre una fila, evitando a su vez ser quien la cierra primero. Así, si un jugador (fichas oscuras en la imagen de abajo) cierra una de las filas, el otro jugador (fichas blancas) cerrará inmediatamente la otra fila, obligando a su rival a retroceder movimiento a movimiento hasta quedar bloqueado, y perder.

Tras cerrar la ficha oscura el paso a la blanca en la fila de arriba, el jugador de blancas cerrará la fila de abajo en su turno, obligando a retroceder a las fichas oscuras

Tras cerrar la ficha oscura el paso a la blanca en la fila de arriba, el jugador de blancas cerrará la fila de abajo en su turno, obligando a retroceder a las fichas oscuras

En este juego, existe una estrategia ganadora para el segundo jugador que consiste en no ser el primero en cerrar alguna de las filas y obligar al adversario a hacerlo. Pero, ¿cómo conseguirlo? La clave está, de nuevo, en la simetría.

Para evitar bloquear una de las líneas, el segundo jugador deberá conseguir en cada movimiento que la distancia entre fichas –el número de casillas que las separan- en las dos filas sea la misma (distancia de simetría), así no cerrará ninguna fila, salvo cuando cierre las dos. Por otra parte, será el primer jugador quien rompa la simetría en cada movimiento.

Y para forzar al primer jugador para que sea quien cierre primero una de las dos filas el segundo jugador deberá conseguir que la distancia de simetría entre las fichas sea cada vez más pequeña. Esto va a ser posible ya que cuando el primer jugador rompe la simetría pueden ocurrir dos cosas:

i) si ha hecho avanzar una de sus fichas (las fichas oscuras hacia la derecha, las blancas hacia la izquierda), la distancia ahora entre las fichas de esa fila será más pequeña que la distancia de simetría anterior, con lo cual el segundo jugador podrá mover su ficha en la otra fila para disminuir la distancia de simetría;

ii) si ha retrocedido una de sus fichas, de forma que la distancia entre las fichas de esa fila sea mayor que la distancia de simetría, el segundo jugador avanzará su ficha en esa fila para mantener la distancia de simetría, con la diferencia de que al retroceder el primer jugador va perdiendo terreno, casillas para mover, y llegará el momento que no tendrá más opción que cerrar una de las filas, y perderá.

La distancia de simetría es de dos casillas y el primer jugador, blancas, retrocede dos casillas en la línea de abajo, entonces el primer jugador avanzará dos casillas en esa misma línea para mantener la distancia de simetría, pero las blancas empezarán a estar más arrinconadas

La distancia de simetría es de dos casillas y el primer jugador, blancas, retrocede dos casillas en la línea de abajo, entonces el primer jugador avanzará dos casillas en esa misma línea para mantener la distancia de simetría, pero las blancas empezarán a estar más arrinconadas

Una variante de este juego consiste en que las longitudes de las filas sean distintas. ¿Sigue siendo válida la estrategia ganadora?

Bibliografía

1.- Raúl Ibáñez, Del ajedrez a los grafos, la seriedad matemática de los juegos, colección El mundo es matemático, RBA, 2015.

2.- Sam Loyd’s Cyclopedia of 5000 Puzzles, Tricks and Conundrums with Answers [http://www.mathpuzzle.com/loyd/], publicado en 1914.

3.- Luis Ferrero, El juego y la matemática, Ed. La Muralla, 2001.

Sobre el autor: Raúl Ibáñez es profesor del Departamento de Matemáticas de la UPV/EHU y colaborador de la Cátedra de Cultura Científica

El artículo La simetría como estrategia ganadora: la margarita y bloqueado se ha escrito en Cuaderno de Cultura Científica.

Entradas relacionadas:- La estrategia ganadora de Helena

- ‘La simetría en nuestro entorno’, por M.A. Cuevas Diarte

- «El bacteriófago ø29 como sistema modelo en biología molecular» por Margarita Salas

Actúa localmente: la espintrónica que viene

Imagen de seagul / Pixabay

Imagen de seagul / Pixabay¿Para qué sirve una lámina hecha a base de átomos de carbono unidos entre sí ocupando los vértices de hexágonos? Dicho así, para no mucho. Todo el mundo ha oído hablar del grafeno, que es como se llama esta lámina, sí, pero ¿para qué sirve en la vida real? Ahora mismo puede que para poco, la verdad, pero eso puede cambiar más pronto que tarde.

Las necesidades de procesamiento de datos crecen exponencialmente en el mundo por muchos factores: desde el número de personas que generan datos por el crecimiento de la población y el desarrollo económico, hasta los datos que esas mismas personas consumen empleando dispositivos más conectados y portátiles. Para poder afrontar esta creciente necesidad de procesamiento y comunicación hay limitaciones a las que la electrónica (entendida como procesamiento basado en electrones) se enfrenta que están en el límite de sus posibilidades.

Por otra parte, estas mismas necesidades demandan cada vez más energía y recursos materiales para poder llevarse a cabo. El cambio climático, y la sostenibilidad no ya de la Tierra, sino de la propia tecnología, requiere que las nuevas formas de procesar la información sean mucho más eficientes, empleando mucha menos energía por unidad de datos procesada. Aquí es donde entran las tecnologías cuánticas y, ligado a ella, el espín. El espín es una propiedad de algunas partículas, como los electrones.

La electrónica dará paso muy probablemente a la espintrónica, sí, pero para ello harán falta soportes físicos magnéticos donde pueda producirse. Uno de ellos es el grafeno. Se pueden concebir nanoestructuras de grafeno hechas a medida como componentes activos elementales de una nueva generación de dispositivos espintrónicos cuánticos. Ello sería posible porque las estructuras de grafeno pueden desarrollar espontáneamente un magnetismo (π-paramagnetismo, para un físico) intrínseco a partir de cambios en su estructura (lo que afecta a sus características topológicas, que diría una física). Lo interesante es que este magnetismo no convencional es móvil, de largo alcance y puede ser direccionable eléctricamente, es decir, lo podemos montar en un dispositivo que podamos cargar enchufándolo en casa.